この記事のポイント

Azure上でAI開発を一気通貫で回すなら、Microsoft Foundry(旧Azure AI Foundry)が第一候補

1,900超のモデルカタログ(GPT-5.4、Claude 4.6、Grok 4.2等)から用途別に最適モデルを選べるため、自前GPU不要

Foundry Agent Serviceは2026年3月にGA。Prompt AgentはGA、Workflow Agent/Hosted AgentとVoice Liveはプレビューで、用途に応じて段階的に選べる

Foundry IQ・Evaluations GA・Purview連携で、本番RAGや継続的評価までマネージドに組める

Azure AI Foundry ModelsはISO/IEC 42001:2023認証取得済み。金融・医療など規制業界でも導入しやすい

新規Azure顧客なら無料アカウント+30日間有効の200ドルクレジットで小規模PoCをほぼコストゼロで始められる

Microsoft MVP・AIパートナー。LinkX Japan株式会社 代表取締役。東京工業大学大学院にて自然言語処理・金融工学を研究。NHK放送技術研究所でAI・ブロックチェーンの研究開発に従事し、国際学会・ジャーナルでの発表多数。経営情報学会 優秀賞受賞。シンガポールでWeb3企業を創業後、現在は企業向けAI導入・DX推進を支援。

「AI開発を始めたいが、モデル選定からデプロイ・監視まで自社で全部やるのは現実的ではない」——Azure環境でAI活用を考える企業の多くが、この課題に直面しています。

Microsoft Foundry(旧Azure AI Foundry)は、1,900以上のモデルカタログとGA済みのAgent Serviceを統合し、プロトタイプから本番運用までを1つのプラットフォームで完結させるサービスです。

本記事では、2026年4月時点の最新仕様をもとに、Microsoft Foundryの機能全体像、使い方、セキュリティ、導入事例、競合比較、料金体系(GPT-5.4系・Claude Sonnet 4.6を含む)を体系的に解説します。

既にAzure環境をお持ちの企業はもちろん、これからAI開発基盤を選定する企業にとっても判断材料になる内容です。

目次

Microsoft Foundry(旧Azure AI Foundry)とは?

Agent Service — AIエージェントの構築・運用基盤

Prompt Flow — ワークフロー開発(classic/移行期)

Microsoft Foundryのセキュリティとコンプライアンス

ISO/IEC 42001:2023認証の取得(Foundry Models対象)

Microsoft Foundry(旧Azure AI Foundry)とは?

**Microsoft Foundry(旧Azure AI Foundry)**は、Microsoftが提供するエンタープライズAI開発の統合プラットフォームです。

エージェント・モデル・ツールを1つのリソースに統合し、開発者がインフラ管理ではなくアプリケーション構築に集中できるよう設計されています。

以前はAzure AI Studioとして提供されていましたが、機能統合と名称変更を経て現在の形に進化しました。

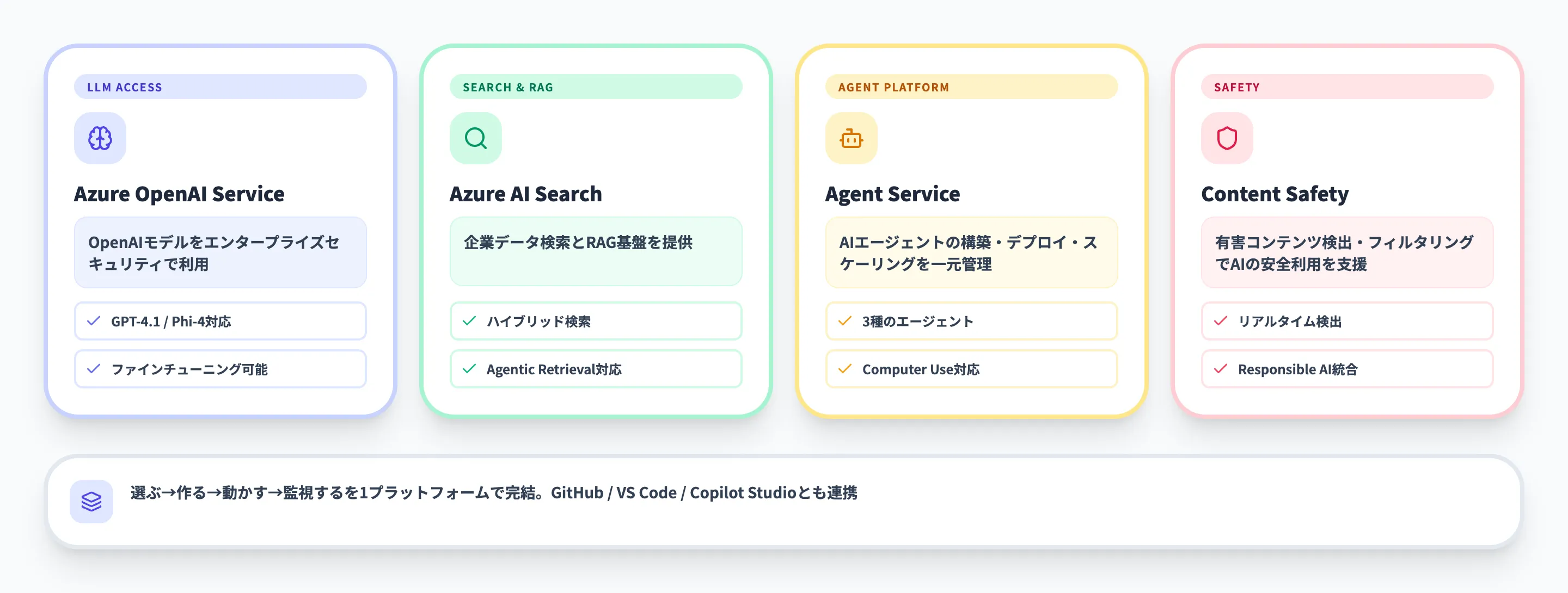

GitHub、Visual Studio Code、Copilot Studioとも連携し、開発者が既存の環境でAIソリューションを効率的に構築できます。

Microsoft Foundryの本質は、AIの「選ぶ→作る→動かす→監視する」を1つの場所で完結させる統合基盤という点です。モデルの選定からプロトタイピング、評価、本番デプロイ、監視まで一貫したワークフローで進められます。

主要な統合サービスは以下のとおりです。

-

Azure OpenAI Service

OpenAIの言語モデルをエンタープライズグレードのセキュリティで利用できるAPIアクセスを提供します。

-

Azure AI Search

企業内の膨大なデータから必要な情報を検索し、RAG(検索拡張型生成)の基盤として機能します。

-

Microsoft Foundry Agent Service

AIエージェントの構築・デプロイ・スケーリングを管理するフルマネージドプラットフォームです。

-

Azure AI Content Safety

有害コンテンツの検出・フィルタリングにより、AIの安全な利用を支援します。

また、Microsoft Foundryのローカル利用については、以下の記事で詳しく解説しています。

【関連記事】

Windows AI Foundryとは?Build 2025で示されたMicrosoftの新しいAI開発基盤の全貌

Foundryの進化 - 名称変更とアップデートの遍歴

Microsoft Foundryは複数のAzureサービスを段階的に統合してきました。以下の表で、公式ドキュメントに基づく旧名称と現在の対応関係を整理しています。

| 項目 | 旧 | 現在 |

|---|---|---|

| ブランド | Azure AI Studio / Azure AI Foundry | Microsoft Foundry |

| AIサービス群 | Azure AI Services | Foundry Tools |

| ポータル | Foundry(クラシック) | Foundry(新ポータル) |

| エージェントAPI | Assistants API(v0.5/v1) | Responses API(Agents v2) |

| APIバージョン | 月次のapi-versionパラメーター指定 | 安定ルート(/openai/v1/ 以下に統一) |

| リソースモデル | ハブ + Azure OpenAI + Azure AI Services | Foundryリソース(単一、プロジェクト付き) |

| SDK | 複数パッケージ(azure-ai-inference / azure-ai-generative / azure-ai-ml 等) | 統合クライアント(AIProjectClient 2.0、azure-ai-agents 依存廃止) |

この変更で実務上最も影響が大きいのは、SDKの統合です。従来は用途ごとに5つ以上のパッケージを使い分ける必要がありましたが、2026年3月リリースのPython/JavaScript/TypeScript/Java SDK 2.0(.NETは4月)でAIProjectClientに一本化されました。

エージェント・評価・メモリ・推論がすべて同じクライアント配下で扱えるため、新規開発のシンプルさが大幅に向上しています。

また、用語も「スレッド/メッセージ/ラン/アシスタント」から「会話/アイテム/レスポンス/エージェントバージョン」へ整理されました。

Microsoft Foundryの主な機能

Microsoft Foundryは、AI開発のライフサイクル全体を効率化する機能群を統合しています。ここでは、実際の開発現場で特に価値の高い主要機能を解説します。

Agent Service — AIエージェントの構築・運用基盤

Foundry Agent Serviceは、AIエージェントの構築・デプロイ・スケーリングを一元管理するフルマネージドプラットフォームです。

ホスティング、スケーリング、ID管理、オブザーバビリティ、エンタープライズセキュリティをプラットフォーム側が処理するため、開発者はエージェントロジックに集中できます。

2026年3月のアップデートでOpenAI Responses API互換・プライベートネットワーキングを備えた形でGA(一般提供)に昇格し、対応リージョンも拡大しました。

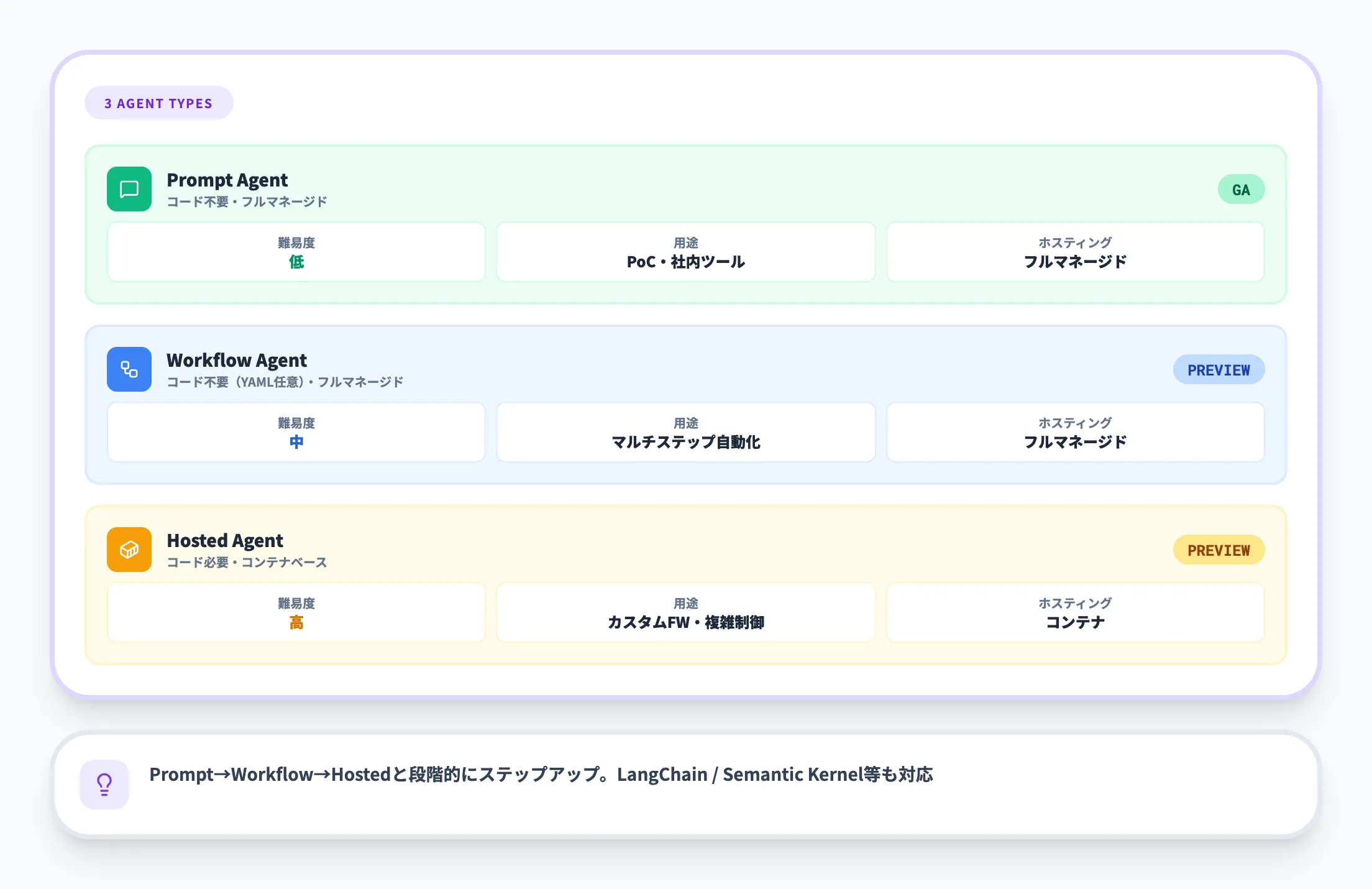

Agent Serviceが提供する3種類のエージェントを以下の表に整理しました。

| エージェント種別 | コード | ホスティング | 最適な用途 |

|---|---|---|---|

| Prompt Agent | 不要 | フルマネージド | プロトタイプ、社内ツール |

| Workflow Agent(プレビュー) | 不要(YAML任意) | フルマネージド | マルチステップ自動化、承認フロー |

| Hosted Agent(プレビュー) | 必要 | コンテナベース | カスタムフレームワーク、複雑な制御 |

用途に応じた使い分けのポイントとして、まず試したい段階ではPrompt Agentでノーコード作成し、複数エージェントの連携が必要になったらWorkflow Agent、独自のオーケストレーションロジックが必要な場合はHosted Agentを選ぶという段階的な導入が有効です。

PoC段階からいきなりHosted Agentを選ぶと運用負荷が高くなりがちなため、プロンプトエージェントで業務適合性を確認してから段階的に昇格させる進め方が失敗を減らします。

エージェント一覧画面で「エージェントの作成」をクリックし、エージェントの名前を設定するとすぐにエージェントをデプロイできます。

エージェント一覧画面

エージェント作成後は、モデルや手順(エージェントへの指示)を設定できます。

エージェント設定画面

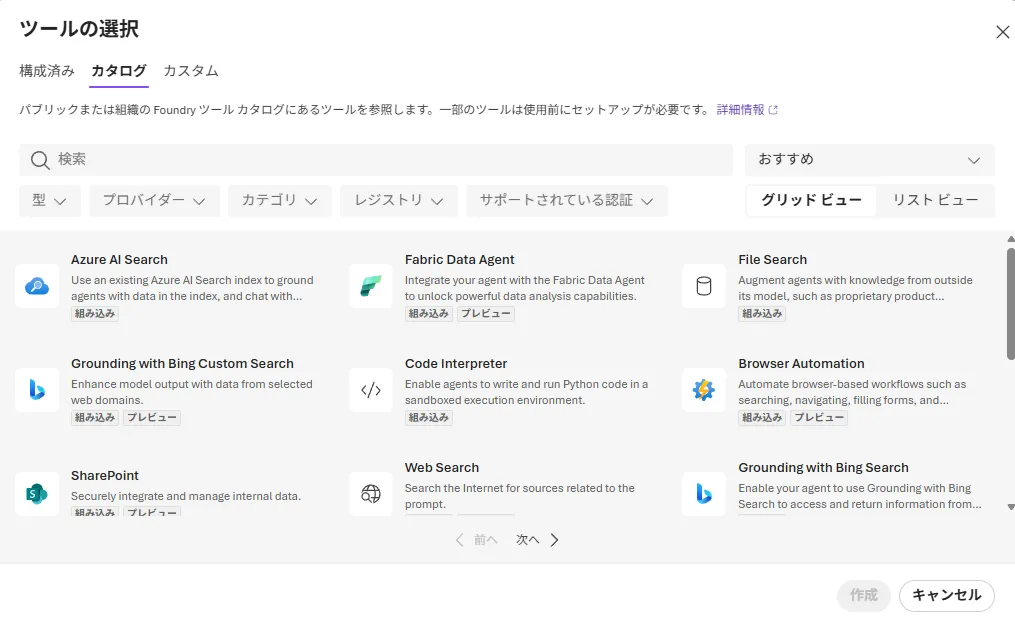

エージェントの設定画面で「ツール」タブの「ツールの選択」をクリックすると、Azure AI SearchやBrowser Automationといったツールをエージェントに組み込むことができます。

ツール追加画面

2026年時点の注目機能

Computer Useツール(プレビュー)

AIがコンピュータのUIを操作してタスクを実行します。複数のWebサイトから情報を収集してまとめる、社内システムへのデータ入力を自動化するといった反復作業に適しています。

:::messageただし、公式ドキュメントでは、プロンプトインジェクションなどのセキュリティリスクが明記されており、機密データにアクセスできない仮想マシン上で使用することが推奨されています。

:::

Browser Automationツール(プレビュー)

Microsoft Playwrightワークスペースを使い、自然言語プロンプトからブラウザタスクを実行します。「競合他社の製品価格を調べて表にまとめて」といった指示だけで、AIがブラウザを操作して情報を収集・整形できます。

Memory機能(プレビュー)

対話間でコンテキスト情報を保持・呼び出しできる機能です。ユーザーが毎回同じ前提条件を入力し直す手間がなくなります。

Voice Live(プレビュー)

2026年3月のアップデートで案内されたリアルタイム音声対話機能です。コールセンター補助や社内ヘルプデスクなど、音声でのやり取りが中心の業務での活用が想定されます。

Foundry Agent Service本体はGAですが、Voice Live自体はパブリックプレビューのため、本番運用前にSLAと対応リージョンを公式で確認してください。

エージェントID(Entra連携)

各エージェントに専用のMicrosoft Entra IDを付与でき、人間のアカウントと資格情報を共有せずにリソースへのスコープアクセスを制御できます。

ツールカタログと安全制御

パブリック・プライベートカタログを通じて1,400以上のツールに接続可能です。

MCP(Model Context Protocol)とA2Aプロトコルの認証サポートに加え、クロスプロンプトインジェクション攻撃(XPIA)を軽減する統合ガードレールや、Azure DevOps MCP Server(プレビュー)などの接続設定も用意されています。

対応フレームワークは、Microsoft Agent Framework、Semantic Kernel、LangChain、LangGraph、OpenAI Agents SDKなど主要なものを網羅しています。

既にLangChainで開発したエージェントがあれば、Microsoft Foundryに移行して追加機能を活用できるため、ベンダーロックインを避けた柔軟な開発が可能です。

発行時はMicrosoft 365 Copilot、Microsoft Teams、Entra Agent Registryといった社内利用導線へそのまま配布できるため、「作ったはいいが誰も使わない」状態を避けやすい設計になっています。

RAGとFoundry IQ — 企業データの活用

RAG(Retrieval Augmented Generation)は、企業固有のデータに基づいてLLMが回答を生成するパターンです。マニュアル、過去のプロジェクト資料、技術文書など、社内に蓄積された知識資産をAIで活用するための核となる技術です。

Microsoft Foundryでは、RAGに対して2つのアプローチを提供しています。

-

Agentic Retrieval(プレビュー)

LLMがクエリ計画を自律的に立て、複数のデータソースにアクセスし、エージェント向けに最適化された構造化応答を返します。

「当社の主力製品の市場シェアと競合戦略を比較して」といった複雑な質問に対し、社内データと外部情報を組み合わせた包括的な回答を生成できます。

-

Classic RAGパターン

ハイブリッド検索とセマンティックランキングを使用する実績ある手法です。安定性が求められるシステムに適しています。

2026年に追加されたFoundry IQは、エンタープライズコンテンツやWebコンテンツを引用元として回答の根拠を提示するマネージド・ナレッジ層です。

Azure Blob Storage・SharePoint・OneLake・パブリックWebなど複数のナレッジソースを1つのナレッジベースに束ね、複数エージェントから共有できます。

「情報は社内のどの文書に書いてあるのか」まで示せるため、回答の信頼性を検証しやすい仕組みです。

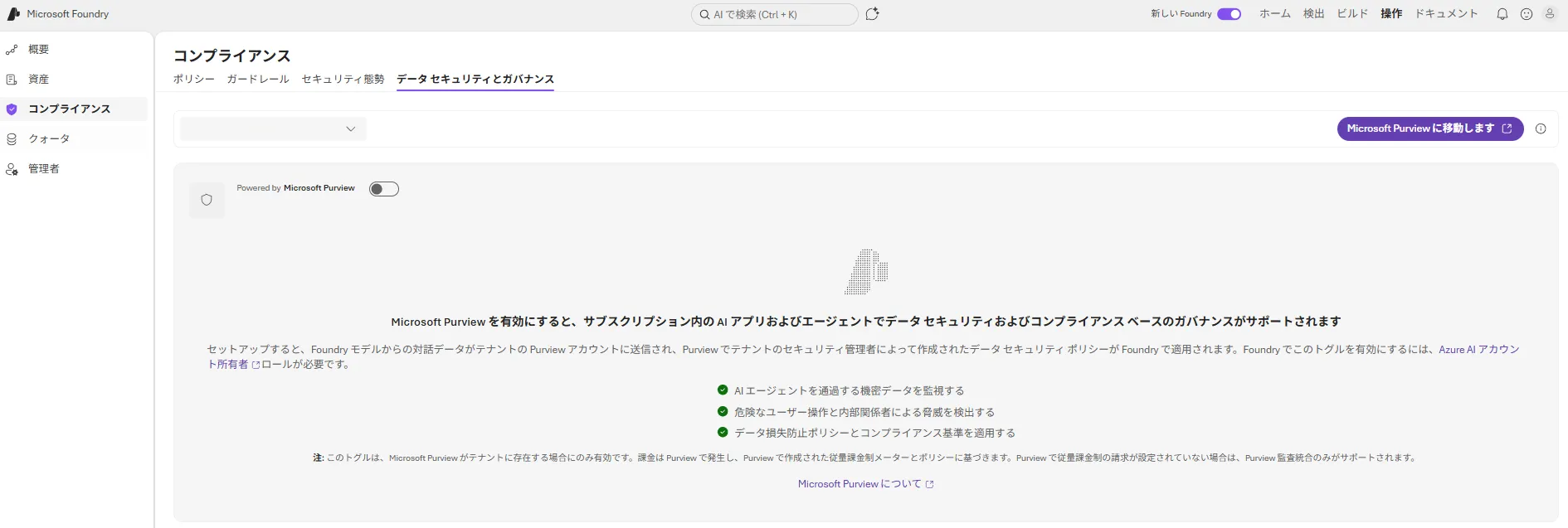

さらにアクセス制御リスト(ACL)同期とMicrosoft Purviewの機密ラベル連携により、ユーザーごとに閲覧許可のあるコンテンツだけがエージェントの回答に使われるよう制御できます。

金融や医療のように「誰が見られる情報か」を厳密に管理する必要がある業務でも、RAGの導入ハードルを下げられる点が実務的な価値です。

3つのIQワークロード

Microsoftはエージェント向けに3つのIQワークロードを提供しており、用途によって組み合わせが変わります。

| IQワークロード | 守備範囲 | 代表的なデータソース |

|---|---|---|

| Foundry IQ | エンタープライズのナレッジ層 | Azure Storage、SharePoint、OneLake、Web |

| Fabric IQ | Microsoft Fabricのビジネスデータ・セマンティック層 | OneLake、Power BI、セマンティックモデル |

| Work IQ | Microsoft 365のコンテキスト層 | ドキュメント、会議、チャット、ワークフロー |

社内文書横断の検索・QAであればFoundry IQ、財務や販売など分析系ならFabric IQ、Microsoft 365の業務文脈ならWork IQ、という切り分けが実務の出発点になります。

複雑な業務を支えるエージェントでは3つを組み合わせて使うケースも珍しくありません。

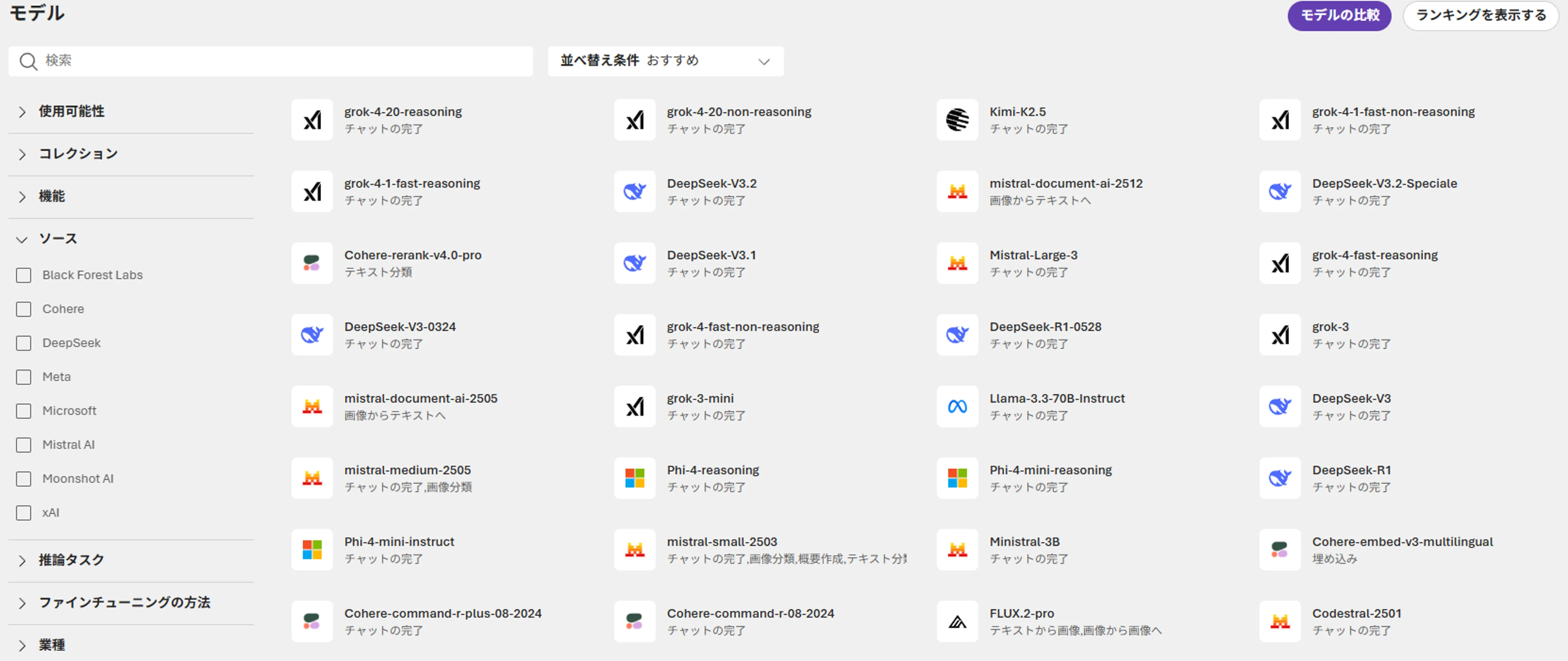

モデルカタログ — 1,900以上のAIモデル

Microsoft Foundryの大きな強みが、1,900以上のAIモデルを提供するモデルカタログです。ファンデーションモデル、推論モデル、マルチモーダルモデル、業界特化モデルなど、幅広いカテゴリをカバーしています。

2026年3月にはGPT-5.4世代、Phi-4 Reasoning Vision 15B、Grok 4.2(ベータから本番昇格)が追加され、Fireworks AI経由のオープンモデル推論やNVIDIA Nemotronモデルも一級カタログとして組み込まれました。

モデルカタログの全体画面

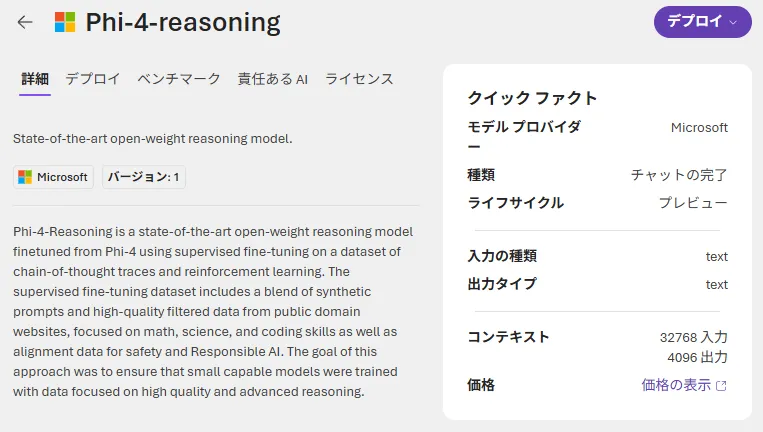

実際にモデルカタログからモデルを選択すると、以下のような詳細情報を確認できます。

モデルの詳細表示画面

モデルの詳細表示画面で「デプロイ」をクリックすると、デプロイ名とデプロイの種類を設定して、モデルのデプロイが可能です。

モデルデプロイ画面

以下の表で、主要プロバイダーと代表モデルを整理しました。

| プロバイダー | 代表モデル | 特徴 |

|---|---|---|

| OpenAI | GPT-5.4、GPT-5.4 Pro、GPT-5.4 Mini、GPT-4.1シリーズ | 命令追従性と統合Computer Use、長文入力、ファインチューニング対応 |

| Microsoft | Phi-4(140億パラメータ)、Phi-4-reasoning、Phi-4 Reasoning Vision 15B | 複雑推論・数学・マルチモーダル処理、オンデバイス運用に強み |

| xAI | Grok 4.2、Grok 4 Fast | 高度な推論とツール利用、学術ベンチマークで最先端の性能 |

| DeepSeek | DeepSeek-V3.2、DeepSeek-R1 | 推論タスク特化、コスト効率が高い |

| Meta | Llama 3シリーズ | オープンソース、カスタマイズ性が高い |

| Anthropic | Claude Opus 4.6、Claude Sonnet 4.6 | 長文処理・高精度分析に強み、200Kトークン超は割増料金 |

| Mistral AI / NVIDIA | Mistralシリーズ、NVIDIA Nemotron | 効率的な推論、企業向けのファインチューニングに対応 |

モデルカタログはAzure直販モデルとパートナー・コミュニティモデルの2カテゴリに分かれています。

Azure直販モデルはMicrosoftのResponsible AI基準に基づく内部レビューを受けており、エンタープライズSLAが付帯します。

パートナー・コミュニティモデルは各提供元がサポートを担当し、専門領域やニッチなユースケースへの対応力に優れています。2026年3月からはFireworks AI経由のDeepSeek V3.2やMiniMax M2.5など、高性能なオープンモデルもマネージド形式で試せるようになりました。

モデル選択のポイント

実務でモデルを選ぶ際のポイントは、タスクの複雑さとコストのバランスです。

GPT-5.4やClaude Opus 4.6を全てのタスクに使う必要はなく、単純な分類・抽出にはGPT-4.1-nanoやPhi-4、要約やRAG回答生成にはGPT-5.4 Miniを使い、深い分析や複雑な推論にのみGPT-5.4 ProやOpus 4.6を当てる設計にすれば、品質を保ったままコストを大幅に抑えられます。

Prompt Flow — ワークフロー開発(classic/移行期)

Prompt Flowは、LLMアプリケーションの開発サイクル全体を効率化してきたビジュアル開発ツールです。

プロトタイピング、実験、反復、デプロイを統合し、プロンプトエンジニアリングを体系化できます。「文書を要約→要点を抽出→表形式に整形」といった処理をドラッグ&ドロップで設計でき、RAGパイプラインの構築・テストや複数のプロンプトバリエーションの並行テストにも使えます。

ただし、2026年3月のFoundry更新でPrompt FlowはDeprecation(非推奨)扱いとなり、Foundry (classic) ポータルでのlegacyサポートに位置づけられました。Microsoftは後継としてMicrosoft Framework Workflows(Agent Frameworkベースのワークフロー)への移行を案内しており、移行期限の目安は2027年1月です。

これから新規にワークフロー基盤を選定する場合は、Prompt Flow単体に長期投資するより、Framework Workflows/Workflow Agentで設計し、必要に応じてPrompt Flow資産は移行する前提で扱うのが安全です。

既にPrompt Flowで本番運用している場合も、移行計画を早めに描いておくと事故が減ります。

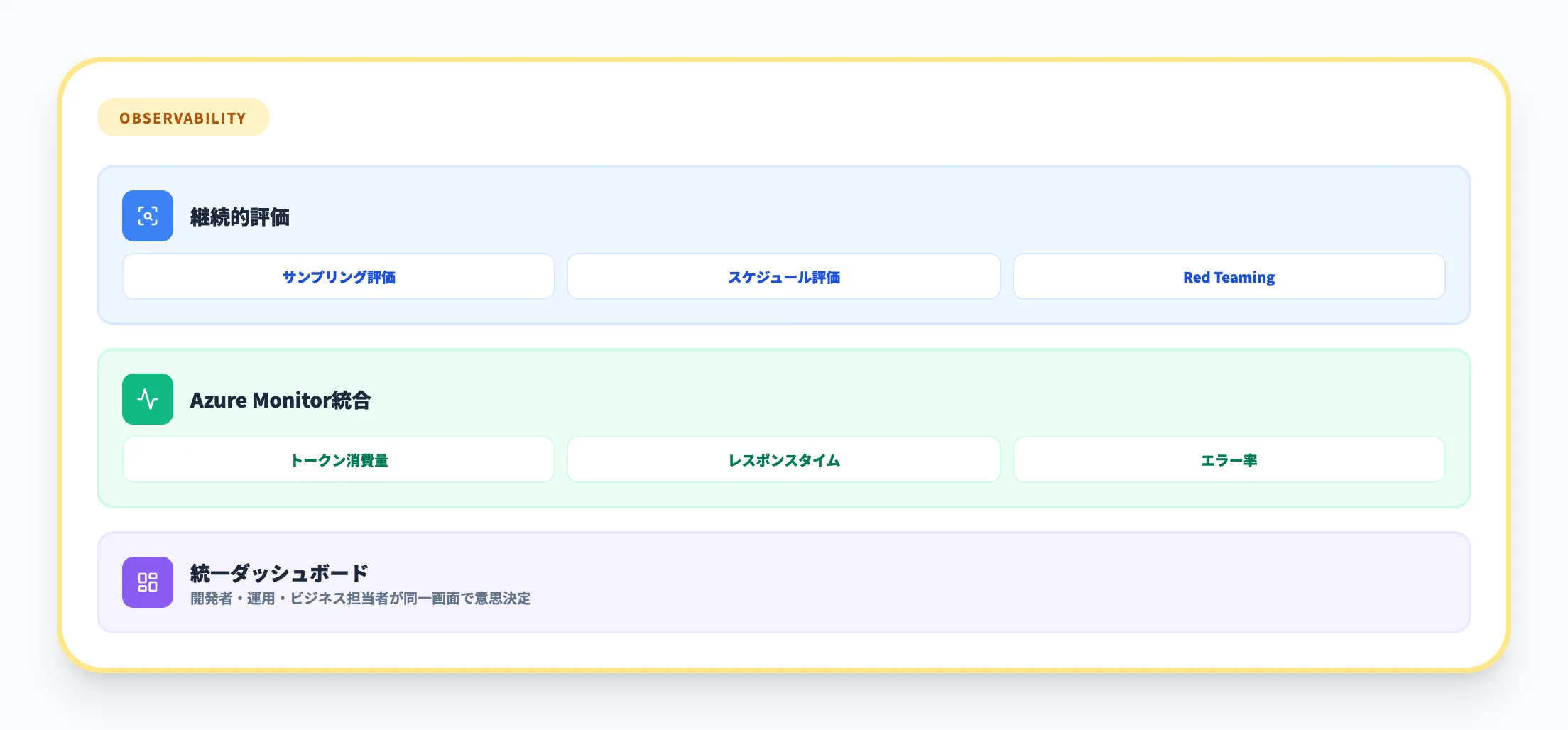

評価・監視・オブザーバビリティ

Microsoft Foundry Observabilityは、AI開発ライフサイクル全体に統合されるガバナンス、評価、トレーシング、監視の統一ソリューションです。

2026年3月のアップデートでEvaluations(評価機能)がGAに昇格し、本番環境での継続的な品質モニタリングが正式サポート対象になりました。

AIシステムは本番運用後も継続的な改善が不可欠です。モデルの性能はデータやユーザーの使い方によって変化するため、定期的な評価と問題の早期発見が安定運用の鍵になります。

主な監視機能は以下のとおりです。

-

継続的評価(GA)

本番トラフィックのサンプリング評価でAIの応答品質を把握し、テストデータによるスケジュール評価でモデルドリフトを検出します。組み込み評価器とカスタム評価器を組み合わせられ、Red Teamingによる敵対的テストも可能です。

-

Azure Monitor統合

Application Insightsとシームレスに統合され、トークン消費量、レスポンスタイム、エラー率を既存の運用ダッシュボードで監視できます。

- 統一ダッシュボード

主要メトリクスを単一画面に集約し、開発者・運用担当者・ビジネス担当者が同じデータを見て意思決定できます。

評価ダッシュボード画面

- サードパーティのランタイムガードレール

Palo Alto Networks Prisma AIRSやZenityとの統合により、プロンプトインジェクションやデータ漏洩をランタイムで検出できます。既存のセキュリティ運用(SOC)ルールに乗せやすい点が企業導入で評価されるポイントです。

ノーコード・ローコード開発

Microsoft Foundryでは、コーディング経験がなくても使えるノーコード・ローコード環境を提供しています。

ビジネスアナリストや業務担当者もAI開発に参加でき、現場のニーズに即したAIソリューションを迅速に開発できます。

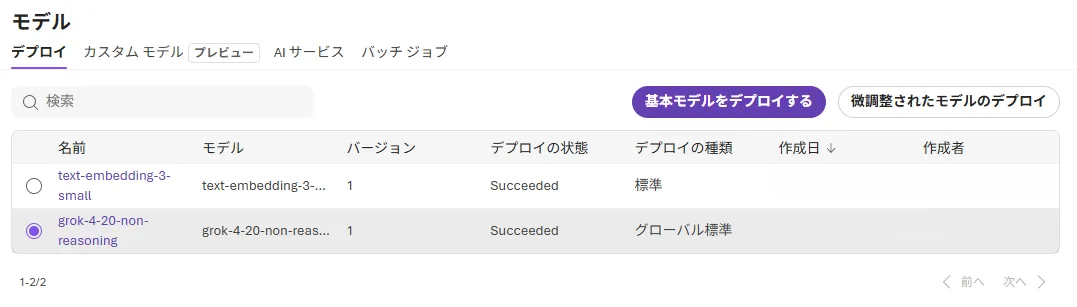

モデルのデプロイ画面

ただし、ノーコード・ローコードにも限界はあります。複雑なカスタマイズや高度なオーケストレーションが必要な場合はコーディングが必要です。

Prompt AgentからHosted Agentへと段階的にステップアップできる設計になっているため、小さく始めて徐々に本格化するアプローチが取れます。

セキュアなデータ管理機能

Microsoft Foundryの使い方

Microsoft Foundryの始め方と、実際にAI機能を試す手順を解説します。Azureアカウントがあれば、追加のアカウント作成は不要でそのまま利用を開始できます。

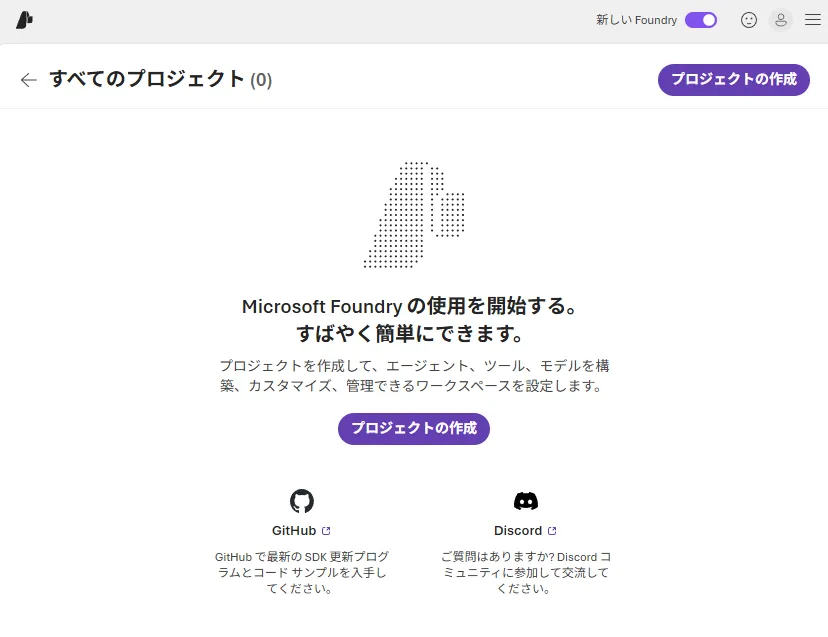

始め方 — サインアップからプロジェクト作成まで

ステップ1: サインアップ

Microsoft Foundry公式サイトにアクセスし、Azureの使用を開始するをクリックします。

Microsoft Foundryの利用画面

Microsoft Foundryの利用にはAzureアカウントが必要です。既にAzureを利用中の企業であれば、同じアカウントでそのまま使えます。

ステップ2: アカウントタイプの選択

無料アカウントか有料のプリペイドアカウントを選びサインアップします。

アカウントの選択画面

Azure無料アカウントは新規Azure顧客限定の特典で、サインアップから30日以内に使える200米ドル分のクレジットが付与されます。既存のAzure契約者やpay-as-you-goユーザーは対象外で、その場合は通常の従量課金から始める形になります。新規アカウントで無料枠を活用するなら、PoCを30日以内に終わらせる前提でスケジュールを組むのが現実的です。

ステップ3: Microsoftアカウントでログイン

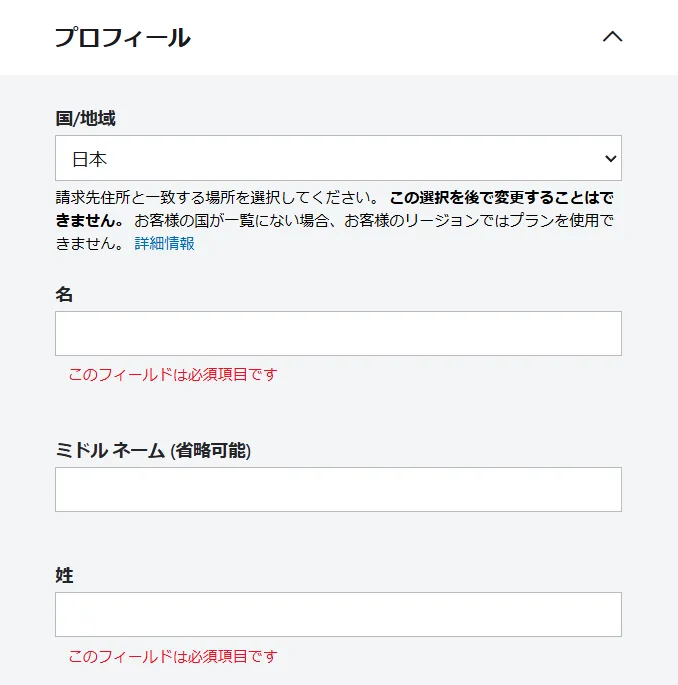

Microsoftアカウントでログインします。アカウントを持っていない場合は新規作成し、プロフィールに必要な情報を入力します。

プロフィール入力画面

ログインが完了すると、Microsoft Foundryポータルにアクセスできます。

Microsoft Foundryポータルのトップ画面

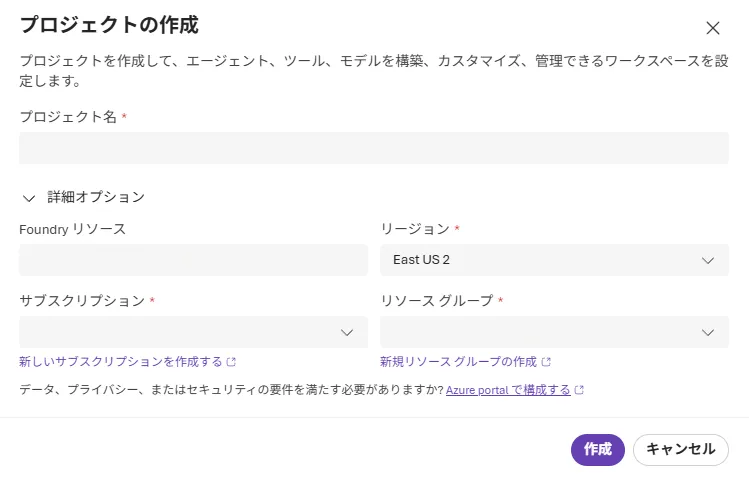

ステップ4: プロジェクトの作成

Microsoft Foundryのプロジェクト作成画面でプロジェクト名を入力し、新規作成します。

プロジェクトの作成画面

プロジェクトの作成が完了すると、モデルのデプロイやエージェントの構築が可能になります。

プロジェクト作成後のダッシュボード画面

プロジェクト単位でリソースを管理できるため、「顧客サポートチャットボット」と「需要予測AI」を分けて管理すれば、コストや権限を明確に分離できます。各機能にMicrosoft公式のチュートリアルが用意されており、初めての方でも段階的に学習できます。

活用デモ — 文書読み取りAIを試してみた

ここでは具体例として、文書からテキストを読み取るAIソリューションの利用手順を紹介します。

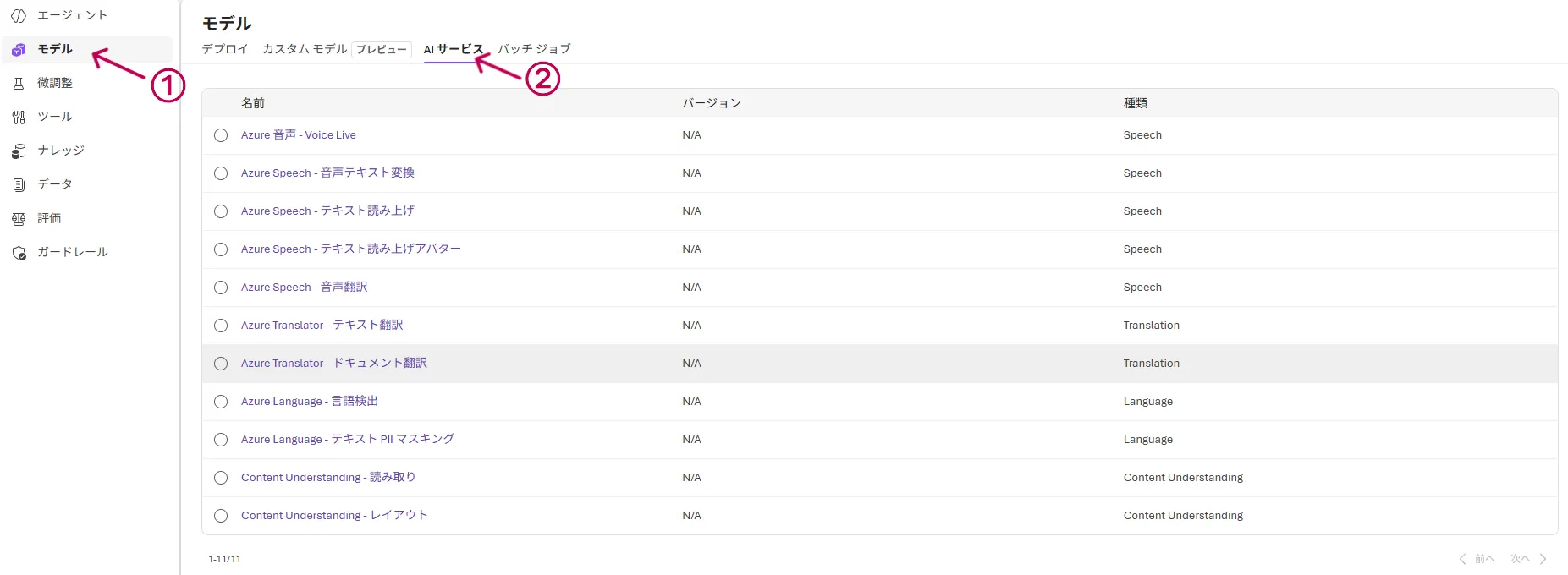

ステップ1: サービスの選択

まずは、Microsoft Foundryのサイドバーの「モデル」から「AIサービス」タブを選択します。

AIサービスの選択画面

ステップ2: 機能の選択

ここで「Content Understanding - 読み取り」を選択すると、文書を読み取るサービスのUIが表示されます。

機能の選択画面

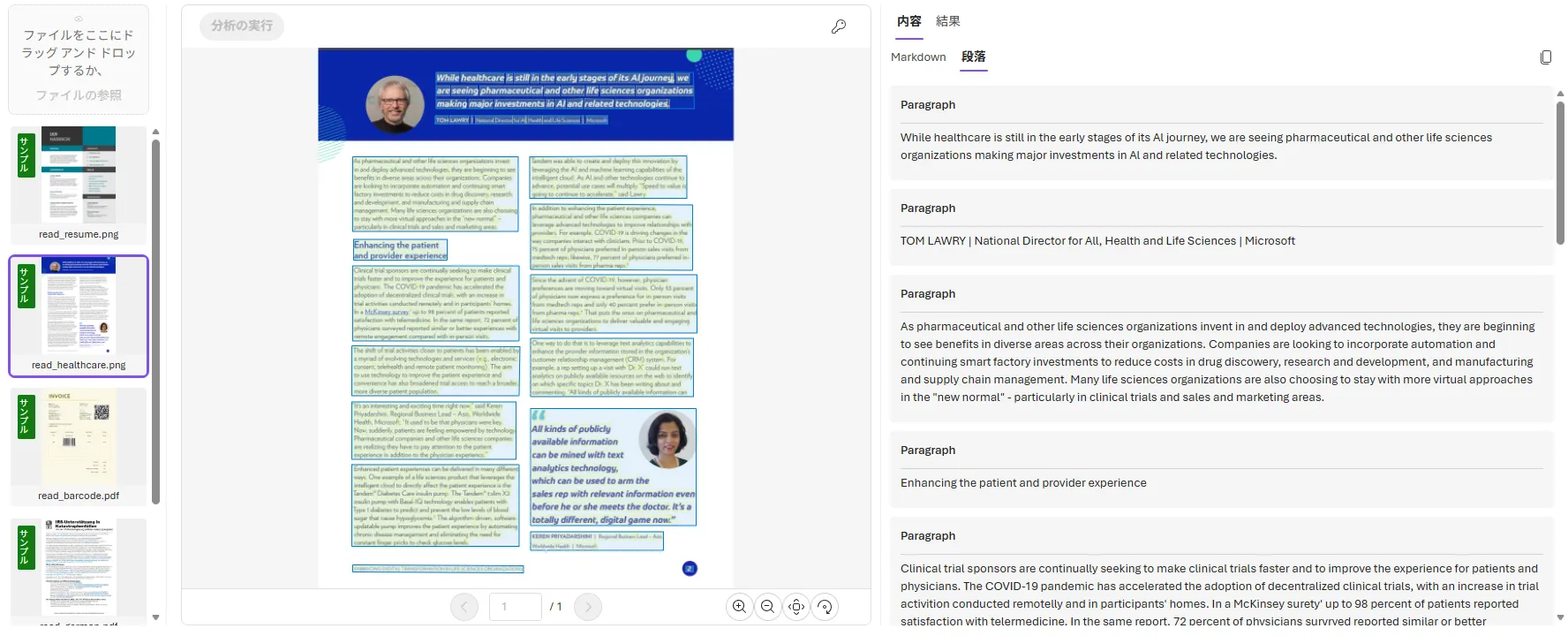

ステップ3: 結果の確認

実際に文書をアップロードすると、markdown形式や段落形式でテキストを確認できるほか、JSON形式でドキュメントの内容を出力させることも可能です。テキストだけでなく、文書のレイアウトに関する情報も格納されていることがわかります。

結果の確認画面

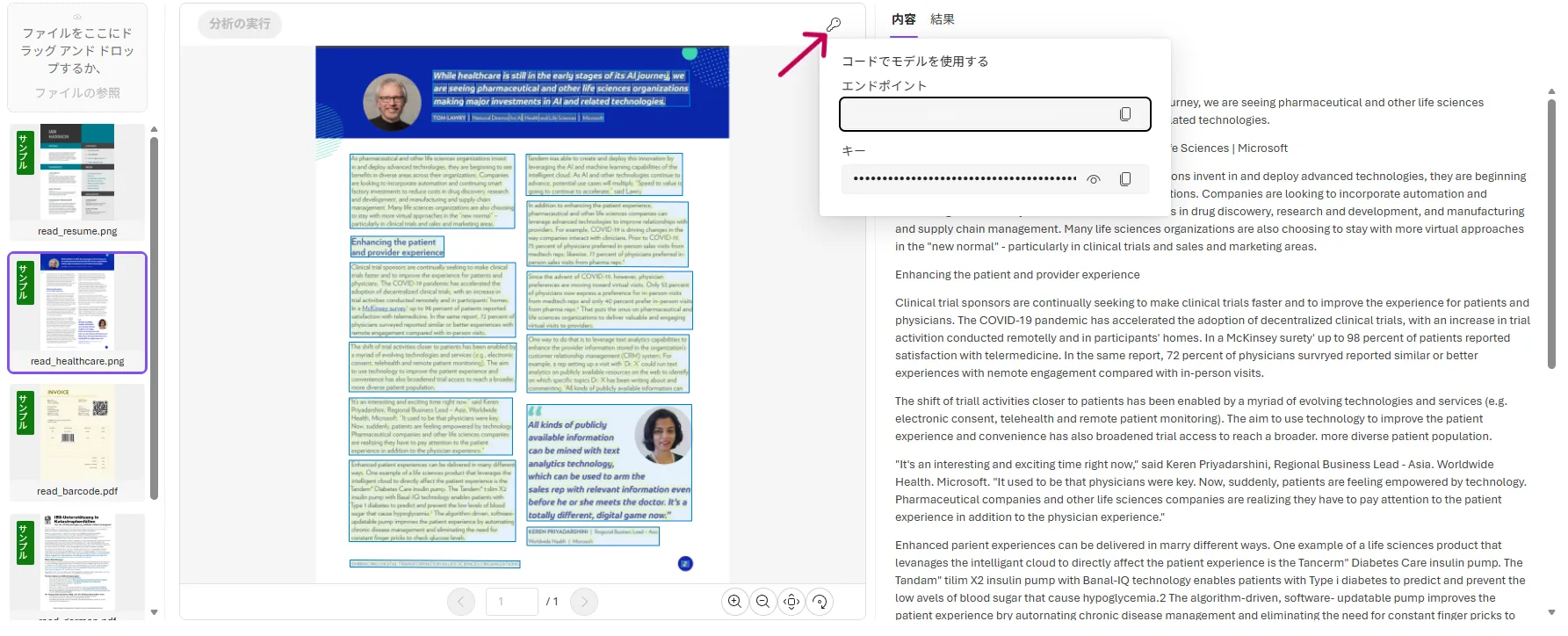

ステップ4: サービスのデプロイ

Microsoft Foundry上で動作を確認したサービスは、「鍵アイコン」をクリックすることで、エンドポイントとキーを確認することができます。これにより、実際のアプリケーション上でAIサービスを呼び出すことが可能です。

サービスのデプロイ画面

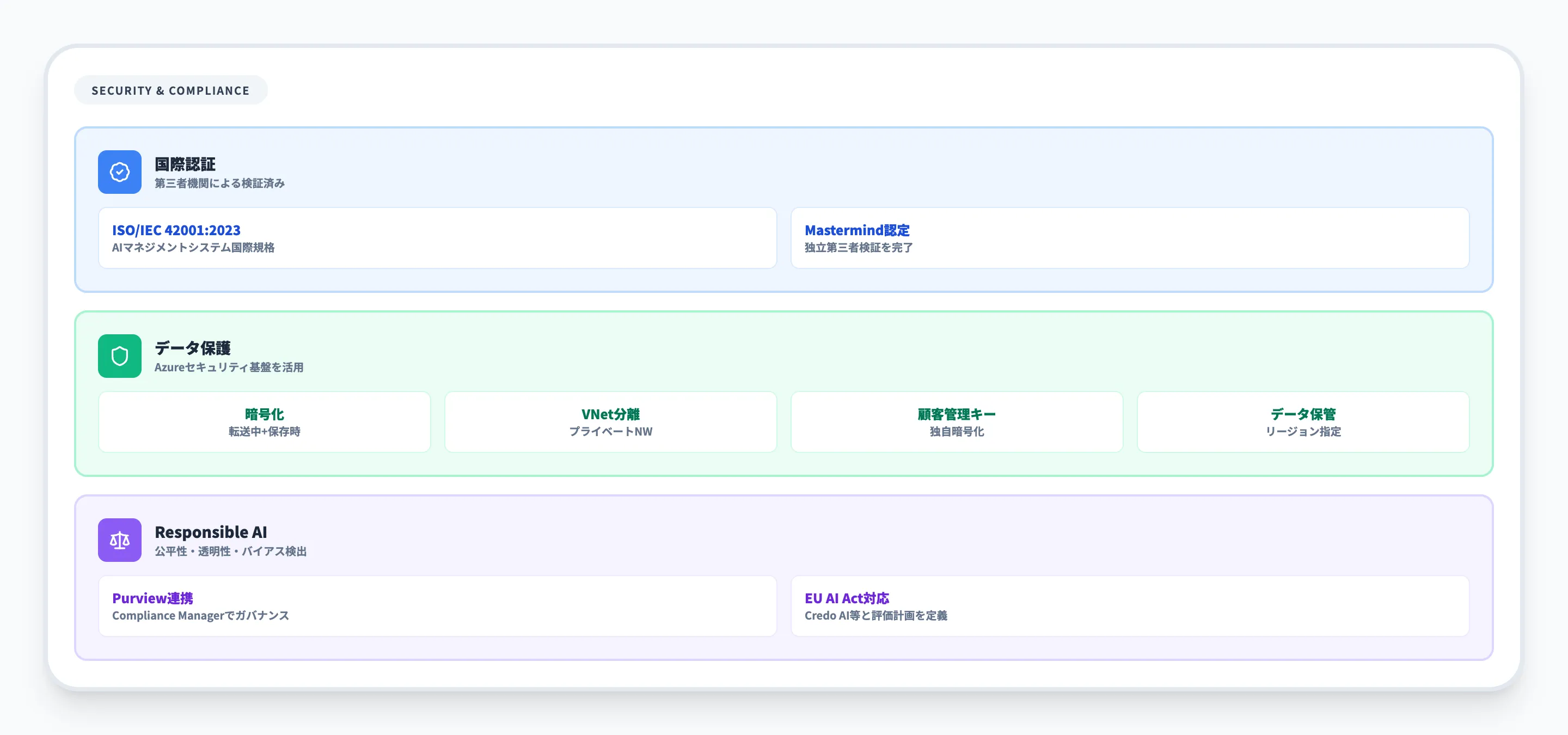

Microsoft Foundryのセキュリティとコンプライアンス

エンタープライズAI開発では、技術的な性能と同等にセキュリティとコンプライアンスが問われます。Microsoft Foundryは、Azureのセキュリティ基盤を活用した包括的な対策を提供しています。

ISO/IEC 42001:2023認証の取得(Foundry Models対象)

Microsoftの公式ブログによれば、ISO/IEC 42001:2023(AIマネジメントシステムの国際規格)の認証対象はAzure AI Foundry Models(Azure OpenAIモデルを含む)とMicrosoft Security Copilotです。

Foundryプラットフォーム全体・全機能が一括で認証されているわけではないため、本文の他の箇所でも対象スコープを意識して読み解く必要があります。

認証は、ISO認定機関による独立した第三者検証を受けたものです。AI開発のライフサイクル全体にわたるガバナンス、リスク管理、品質保証のフレームワークが国際基準で検証されているため、金融機関や医療機関など高度なコンプライアンス要件を持つ企業がFoundry Modelsを採用する際の判断材料として有効です。

データ保護とプライバシー

Microsoft Foundryは、Azureのセキュリティ基盤を活用した以下のデータ保護機能を提供しています。

-

データの暗号化

転送中および保存時のデータを暗号化します。

-

プライベートネットワーク

Azure Virtual Networkによる分離されたネットワーク環境を構築できます。

-

顧客管理キー

独自の暗号化キーによるデータ保護が可能です。

-

データレジデンシー

特定地域内でのデータ保管を保証します。

GDPRや日本の個人情報保護法など各国の規制に対応する必要がある企業にとって、データレジデンシー機能は特に重要な要素です。

Responsible AIツール

Microsoft Foundryには、**Responsible AI(責任あるAI)**を実現するための専用ツールが組み込まれています。AIモデルの公平性評価、説明可能性の向上、バイアス検出を開発プロセスに統合しており、コンプライアンス担当者が手動でチェックする工数を削減できます。

さらに、Microsoft Purview Compliance ManagerやCredo AI等と連携し、EU AI Actなどのフレームワークに準拠した評価計画を定義できます。

AIの規制が世界的に強化される中、こうしたコンプライアンス連携機能の価値は今後さらに高まっていくと考えられます。

Microsoft Foundryの活用事例

Microsoft Foundryは、日本企業を含む多くの組織で実際に導入が進んでいます。ここでは出典が確認できる導入事例を紹介します。

日立システムズ — 製造業向けアシスタントAI

日立システムズは、Microsoft Foundryを活用して製造業向けアシスタントAIを開発しています。日立グループの成長戦略「Lumada」に基づくこの取り組みでは、Microsoft Defender for Cloudなどのセキュリティサービスを組み合わせて安全性を確保しています。

Playgroundで開発前にAIエージェントの精度を確認できるため、開発工数を大幅に削減できたと評価されています。製造業のように現場のノウハウが暗黙知として蓄積されている業界では、RAGを活用した知識活用の効果が特に大きいといえます。

電通総研 — AIエージェント構築支援サービス

電通総研は2026年1月より、Microsoft Foundryを活用したAIエージェント構築支援サービスの提供を開始しました。PoCからエージェントの量産・運用までを一気通貫で支援するサービスで、Agent Serviceを核としたエージェント開発を企業に提供しています。

SIerの立場から見ると、電通総研のようなパートナー企業がMicrosoft Foundryベースの支援サービスを立ち上げている点は、プラットフォームの成熟度を示す指標の一つです。自社にAIエンジニアが不足している企業でも、パートナー経由で導入を進めやすい環境が整いつつあります。

JAL — 客室乗務員レポート作成効率化

日本航空(JAL)は、富士通・ヘッドウォータースと連携しMicrosoft Foundryを活用したSLM(Small Language Model)アプリ「JAL-AI Report」を構築しています。Phi-4を軽量化したSLMをオンデバイスで動かすことで、ネットワークが不安定な機内でも客室乗務員がインシデント報告書を生成できます。2025年1月〜3月のPoCでは、1時間かかっていたレポート作成が20分、30分かかるものは10分に短縮されたと報告されています。

機内環境のようにクラウド常時接続が難しい現場では、Phi-4クラスのSLMをローカル推論で使う構成が現実解になります。Foundryはクラウドで学習・評価・配信を回しつつ、エッジ側は軽量モデルで動かす「ハイブリッド運用」に設計上対応している点が、この事例の核心です。

大和証券 — AIオペレーター

大和証券はMicrosoft Foundry(Azure OpenAI Service)を活用した「大和証券AIオペレーター」を開発し、音声で口座手続きやNISA関連の問い合わせに応対するサービスを提供しています。

2025年6月には日本マイクロソフトと戦略的枠組み契約を締結し、AIエージェントの企画・開発・運用・教育を包括的に進める体制を整えました。金融業界はコンプライアンス要件が厳しく、ISO/IEC 42001認証やデータレジデンシー機能が導入決定の重要な要因となっています。

業界を問わず共通するのは、PoCを小さく始めて効果を実証してからスケールするというアプローチです。

新規Azure顧客であれば30日間有効の200米ドルクレジットを使ってPrompt Agentベースで素早くPoCを立ち上げ、既存契約者であっても従量課金とPrompt Agentを組み合わせれば数日でプロトタイプを動かせます。

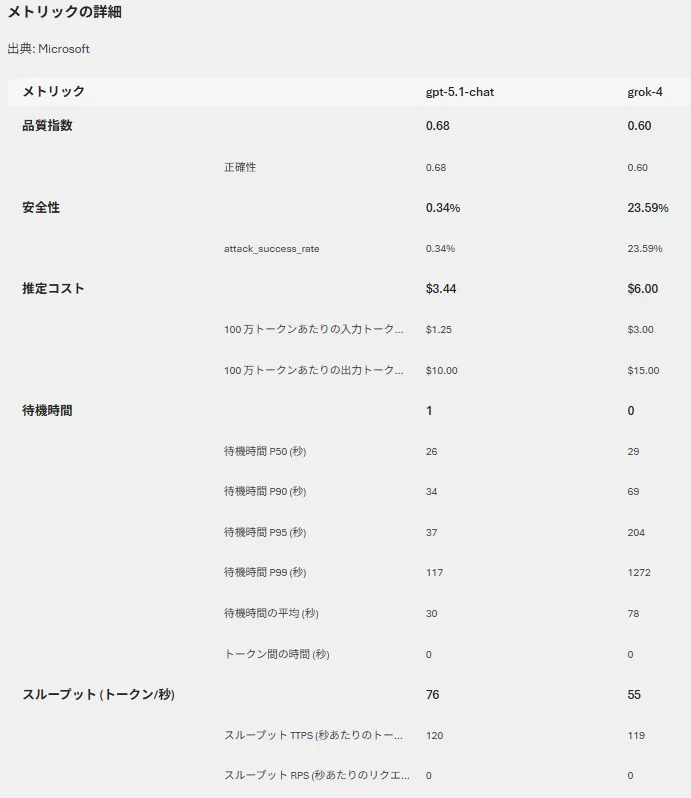

Microsoft Foundry vs 競合サービス比較

AI開発プラットフォームの選択肢はMicrosoft Foundry以外にも存在します。以下の表で主要サービスの特徴を比較しました。

主要サービスの特徴比較

| 項目 | Microsoft Foundry | AWS Bedrock | Google Vertex AI |

|---|---|---|---|

| モデル数 | 1,900+ | 100+ | 200+ |

| 独自モデル | GPT-5.4 / GPT-4.1 / Phi-4 | Titan、Nova | Gemini 2.5 |

| Agent機能 | ◎(Agent ServiceはGA。Prompt AgentはGA、Workflow Agent / Hosted Agentはプレビュー。Computer Use・Voice Liveもプレビュー) | ○(Agents for Bedrock) | ○(Agent Builder) |

| RAG機能 | ◎(Agentic RAG+Foundry IQ) | ○(Knowledge Base) | ○(RAG Engine) |

| ローコード開発 | ○(Prompt Flowはclassic/Microsoft Framework Workflowsへ移行中) | △(限定的) | ○(Vertex AI Pipelines) |

| エンタープライズ統合 | ◎(Microsoft 365連携) | ○(AWS連携) | △(Google Workspace連携) |

| AI管理システム認証(ISO/IEC 42001:2023) | Azure AI Foundry Modelsで取得 | 公表情報なし | Google CloudのAI管理システムで取得 |

モデル数ではMicrosoft Foundryが圧倒的ですが、数の多さ自体よりも自社のユースケースに合うモデルが含まれているかが選定のポイントです。

パートナー・コミュニティモデルを含む1,900以上の選択肢があることで、業界特化モデルや軽量モデルを見つけやすいのは実務上の大きな利点です。

導入判断で詰まる3つの論点

AI開発プラットフォームの選定で企業が最も迷うポイントを整理します。

論点1: 既存クラウドとの整合性

最も影響が大きいのは、既に使っているクラウド環境です。

Azure環境がある企業にとってMicrosoft Foundryは、Microsoft Entra ID(旧Azure AD)やMicrosoft 365との統合が最もスムーズです。同様に、AWSベースのシステムを持つ企業はBedrock、GCPベースならVertex AIが自然な選択肢になります。

新規にAI基盤を導入する場合は、AI機能の充実度だけでなく、今後のクラウド戦略全体との整合性を考慮すべきです。

論点2: エージェント機能の成熟度

2026年時点で、エージェント機能の充実度にはプラットフォーム間で差があります。

Microsoft FoundryのAgent Serviceは3種類のエージェント(Prompt/Workflow/Hosted)と1,400以上のツールカタログを提供し、2026年3月にはGAへ昇格しました。

Computer Use・Browser Automation・Voice Liveなどの拡張機能はパブリックプレビュー段階にあるため、本番採用時はSLA対象範囲を確認したうえで、自律型AIエージェント構築の柔軟性を活かす方針が現実的です。

論点3: コンプライアンス要件

金融、医療、行政など規制が厳しい業界では、ISO/IEC 42001:2023(AIマネジメントシステム)認証の対象範囲が選定の決め手になることがあります。

Microsoft側はAzure AI Foundry ModelsとMicrosoft Security Copilotで、Google側はGoogle CloudのAI管理システムで認証取得を公表しており、対象スコープと認証範囲は提供元によって粒度が異なります。

EU AI Actへの対応やデータレジデンシー要件が厳しい案件では、自社で使う具体的なサービス・モデルが認証範囲に含まれているかを公式情報で確認したうえで判断することを推奨します。

Microsoft Foundryの料金体系

Microsoft Foundryの料金を解説します。プラットフォーム自体は無料で利用でき、課金はモデル使用やサービス利用に対して発生します。

料金モデルの全体像

Microsoft Foundryの課金は、主に以下の要素で構成されています。

-

従量課金(Standard)

処理するトークン数に応じて課金される方式です。使った分だけ支払うため、PoCや実験的な用途に最適です。トラフィックが変動しやすいアプリケーションでも、繁忙期は自動スケールアップ、閑散期はコスト抑制が可能です。

-

PTU(Provisioned Throughput Units)

専用キャパシティを事前に確保する方式です。予測可能なコストと安定したレスポンスタイムを保証し、大規模な本番環境に適しています。

複数モデル間でキャパシティを共有できるFlex capacityオプションもあり、日中はGPT-4.1、夜間はDeepSeekを使うといった柔軟な運用が可能です。

主要モデルの料金比較

以下の表で、主要モデルの2026年4月時点の料金(Global Standardデプロイ)を整理しました。

| モデル | 入力(100万トークンあたり) | 出力(100万トークンあたり) | 用途 |

|---|---|---|---|

| GPT-5.4 Pro | $30 | $180 | 深い分析、複雑な推論 |

| GPT-5.4 Standard | $2.50 | $15 | 高度な推論、統合Computer Use |

| GPT-5.4 Mini | $0.25 | $2 | コスパ重視の分類・抽出 |

| GPT-4.1 | $2 | $8 | 長文理解、ファインチューニング |

| GPT-4.1-mini | $0.40 | $1.60 | 大量APIコール、要約 |

| GPT-4.1-nano | $0.10 | $0.40 | 軽量タスク、並列処理 |

| Claude Sonnet 4.6 | $5 | $25 | 長文処理、高精度分析(200Kトークン超は$10/$37.50) |

| Grok 4.2 | $5.50 | $27.50 | 高度な推論、ツール利用 |

| DeepSeek-V3.2 | $0.28 | $0.42 | 推論タスク、コード生成 |

料金は2026年4月時点でグローバル標準デプロイを前提にしており、リージョン別やPTU契約では単価が変わります。

GPT-5.4 MiniはGPT-5.4 Proの100分の1以下の単価で利用できる一方、深い分析にはPro相当の推論力が必要です。タスクの複雑度ごとにモデルを使い分ける設計が、最も効果的なコスト削減戦略になります。

例えば、カスタマーサポートの一次対応にはGPT-5.4 Miniを使い、エスカレーションが必要な複雑な案件のみGPT-5.4 ProやClaude Opus 4.6で処理する設計にすれば、同等の処理量でもコストを大幅に抑えられます。

「想定トラフィック × 1件あたりの平均トークン × モデル単価」で月次概算を先に置き、上限を超えそうならルーティング(GPT-5.4 Mini→GPT-5.4 Standard→Pro)で逃がす設計に最初から寄せることを推奨しています。

コスト最適化のポイント

以下の表で、コスト最適化の主要なアプローチを整理しました。

| アプローチ | 内容 | 期待効果 |

|---|---|---|

| モデルの使い分け | タスク複雑度に応じて最適モデルを選択 | 最大80%以上のコスト削減 |

| プロンプト最適化 | 不要な説明文を省き、必要最小限の指示に絞る | トークン消費量の削減 |

| キャッシュ活用 | 同一データの繰り返し処理結果をキャッシュ | API呼び出し回数の削減 |

| PTU検討 | 大量処理が継続する場合に固定料金へ切替 | 最大50%のコスト削減 |

| Azure Cost Management | リアルタイムのコスト監視と予算アラート設定 | 想定外の高額請求を防止 |

コスト最適化は一度やって終わりではなく、継続的なプロセスです。初期段階ではさまざまなモデルを試し、本番運用では最適なモデルに絞り込むことで、品質を維持しながらコストを削減できます。

Foundryで作ったAIエージェントを業務フローに載せるなら

Microsoft FoundryでAgentやモデルを開発できても、それを実際の業務システム(基幹・CRM・ERP)と接続し、Teams上の日常業務として回すところまで進めないと投資のROIは回収できません。開発基盤の整備と並行して、「運用・業務実装のレイヤー」を誰がどう担うかを設計しておくことが鍵になります。

ここで効いてくるのが、Microsoft Foundryで開発したAgentを自社Azureテナント内の本番業務へつなぐAIエージェント基盤 AI Agent Hub です。Foundry Agent ServiceやCopilot Studio、n8nで構築したAgentを、管理・実行する共通レイヤーとして機能します。

- Foundryで作ったAgentをTeamsから業務として呼び出す

Microsoft Foundryで設計したAIエージェントを、全社員が使い慣れたTeamsから自然言語で呼び出せます。エージェント開発と業務導線が分断されがちな課題を、実行基盤の統一で解消します。

- 構築基盤をまたいだ一元管理

Microsoft Foundry・Copilot Studio・n8nなど複数の構築基盤で作ったAgentの実行ログ・アクセス権限・セキュリティスキャンを、1つのダッシュボードに集約。シャドーAIの乱立を防ぎます。

- 使い慣れたMicrosoft環境をそのまま活用

Teams・Excel・Outlookなど既存ツールの延長でAIエージェントが動作します。新しいツールの学習コストはゼロです。

- データは100%自社Azureテナント内に保持

Azure Managed Applicationsとして顧客テナント内で動作が完結するため、業務データが外部SaaSに渡ることはありません。

AI総合研究所の専任チームが、FoundryでのAgent開発から業務システム接続・全社運用まで一貫してサポートします。無料の資料で導入プロセスの全体像をご確認ください。

Foundryで作ったAIを業務に載せる

モデル開発から業務実装・運用までを一気通貫

Microsoft Foundryでエージェントやモデルを開発しても、実業務に載せるには基幹システム連携・権限設計・実行ログ管理が必要です。AI Agent Hubで、Foundryで作ったAIを自社Azureテナント内で運用する全体像をご確認ください。

まとめ

本記事では、Microsoft Foundry(旧Azure AI Foundry)の機能全体像、使い方、セキュリティ、導入事例、競合比較、2026年4月時点の料金体系までを解説しました。

Foundryが提供するエンタープライズAI開発の価値は、以下の3点に集約されます。

- 開発速度の向上

1,900以上のモデルカタログとGA済みのFoundry Agent Serviceを組み合わせ、AIProjectClient 2.0で統合されたSDKを使うことで、プロトタイプを数日で立ち上げられます。

- エンタープライズグレードの信頼性

Azure AI Foundry ModelsとMicrosoft Security CopilotがISO/IEC 42001:2023認証を取得。Purview連携やデータレジデンシー機能と合わせて、金融・医療など規制の厳しい業界でも採用しやすい構成になっています。

- Microsoftエコシステムとの統合

Microsoft 365・Microsoft Entra ID・Power Automateとの深い統合により、SharePointドキュメントのRAG活用やPower AutomateによるAI処理の自動化など、既存ワークフローを活かした拡張が可能です。

一方で、Workflow Agent/Hosted Agent、Computer Use、Browser Automation、Voice Liveはプレビュー段階のため、本番採用前にはSLA対象範囲の確認が前提になります。ワークフロー設計についてもPrompt FlowはclassicとしてlegacyサポートになったためMicrosoft Framework Workflowsベースで新規設計する前提で計画を組むのが安全です。

Azure環境でAI活用を始めるなら、新規Azure顧客はAzure無料アカウント(30日間有効の200ドルクレジット付き)、既存契約者は従量課金を利用し、まずはPrompt Agentを1つ作成して自社業務との適合性を検証するところから始めるのが現実的です。小さな成功体験を積み重ねることで、AIの価値を組織内で実証し、本格導入へと進めていけます。