この記事のポイント

AIエージェントに外部ツール連携を持たせるなら、個別API統合よりMCPを採用すべき。主要サービスが対応済みで開発工数を大幅に削減できる

Linux Foundation傘下の業界標準プロトコルであり、ベンダーロックインを避けたいマルチモデル戦略にはMCPが最適

データ検索だけならRAGで十分だが、外部システムへの書き込みや操作が必要な場合はMCPを選ぶべき

GitHub Copilot・OpenAI・Gemini・Azure・Cursor・VS Codeが対応済みのため、既存の開発環境にそのまま導入できるのが強み

まずはTools機能で既存の社内ツールを1つ接続するPoCから始め、段階的にResources・Promptsへ拡張するのが有効

Microsoft MVP・AIパートナー。LinkX Japan株式会社 代表取締役。東京工業大学大学院にて自然言語処理・金融工学を研究。NHK放送技術研究所でAI・ブロックチェーンの研究開発に従事し、国際学会・ジャーナルでの発表多数。経営情報学会 優秀賞受賞。シンガポールでWeb3企業を創業後、現在は企業向けAI導入・DX推進を支援。

「AIに社内データベースを参照させたい」「外部ツールと連携した自律的なAIエージェントを構築したい」「でも、ツールごとに個別のAPI統合を開発するのは限界がある」

AI活用が本格化するなか、こうした課題に直面する企業や開発者が急増しています。

この課題を解決するために生まれたのが、Anthropicが提唱したオープンプロトコル「Model Context Protocol(MCP)」です。

本記事では、MCPとは何か、その仕組みやアーキテクチャから、RAGとの違い、具体的な導入手順、主要サービスの対応状況、セキュリティの注意点まで、2026年最新の情報を交えて徹底的に解説します。

目次

MCP(Model Context Protocol)とは?

RAG(Retrieval-Augmented Generation)とは

MCPの使い方:Claude DesktopでのMCPサーバー導入

GitHub Copilot:エージェントモードでのMCP活用

MCP(Model Context Protocol)とは?

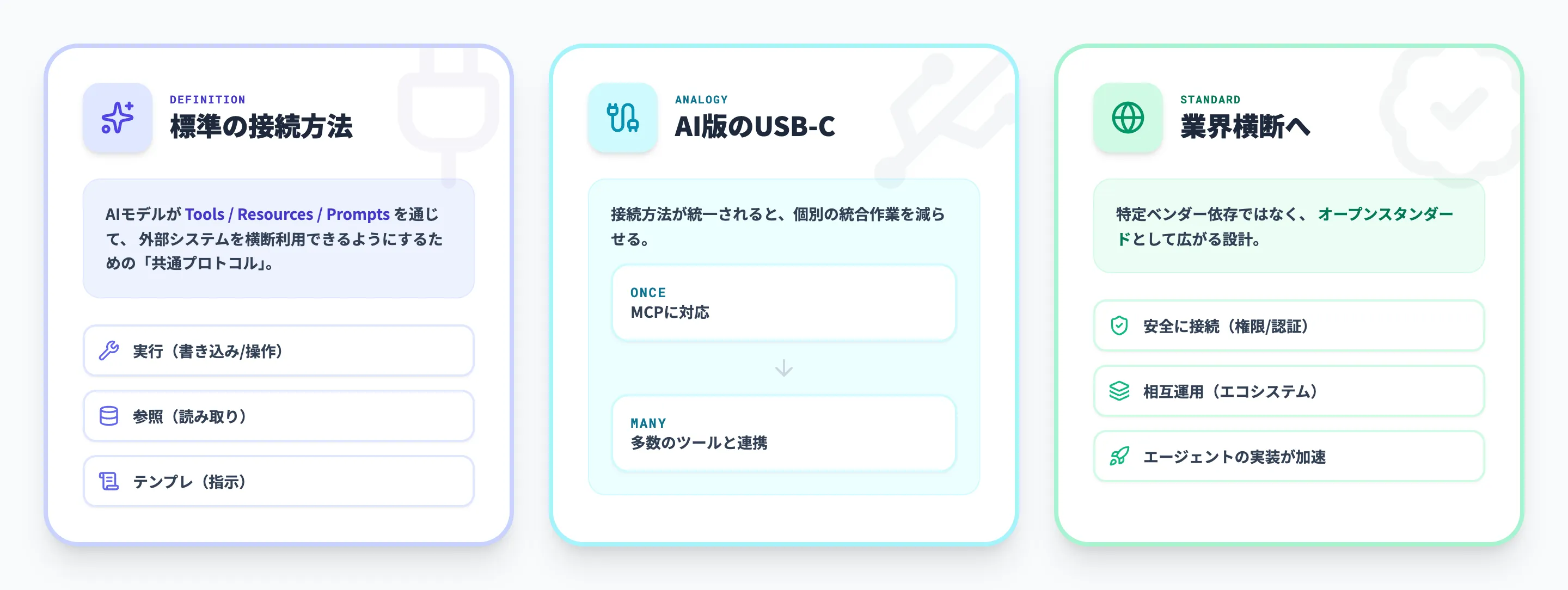

MCP(Model Context Protocol)は、AIアプリケーションが外部のツールやデータソースと安全かつ標準的な方法で接続するためのオープンプロトコルです。Anthropicが2024年11月に公開し、AIエージェント時代における接続の標準規格として、急速に業界全体へ普及が進んでいます。

MCPの役割を身近なもので例えると、「AIアプリケーション版のUSB-C」と表現できます。USB-Cが充電・データ転送・映像出力といった異なる機能を1つの端子で統一したように、MCPはAIモデルと外部システムの接続方法を1つのプロトコルで標準化します。これにより、開発者はツールごとに個別の接続コードを書く必要がなくなり、一度MCPに対応すれば、あらゆるMCP対応サービスとの連携が可能になります。

2025年12月には、AnthropicがMCPをLinux Foundation傘下のAgentic AI Foundation(AAIF)に寄贈しました。OpenAI、Google、Microsoft、AWS、Cloudflareといった主要企業が共同設立メンバーとして参加しており、MCPは特定ベンダーに依存しない業界横断のオープンスタンダードとして位置づけられています。

本記事では、MCPの仕組みやアーキテクチャから、RAGとの違い、具体的な導入手順、主要サービスの対応状況、セキュリティの注意点まで、2026年最新の情報を交えて解説します。

なぜMCPが必要なのか

MCPが登場する以前、AIアプリケーションと外部ツールの連携にはどのような課題があったのでしょうか。ここでは、MCPが解決する根本的な問題と、標準化がもたらす価値を解説します。

従来のAI連携が抱える「M×N問題」

AIアプリケーションの実用化が進むにつれ、GitHub、Slack、Google Drive、データベースなど、さまざまな外部サービスとの連携ニーズが急増しています。しかし、MCP登場以前は、AIモデルと外部ツールを接続するための統一的な方法が存在しませんでした。

この状況が引き起こすのが「M×N問題」と呼ばれる課題です。以下の表で、この問題の構造と、MCPによる解決策を整理しました。

| 項目 | 従来の個別統合 | MCPによる標準化 |

|---|---|---|

| 接続パターン | M個のAIアプリ × N個のツール=M×N通りの個別開発 | 各ツールが1つのMCPサーバーを実装すれば全AIアプリから利用可能 |

| 開発コスト | ツールが増えるたびに統合コードを新規開発 | MCP対応を一度実装すれば追加コストが大幅に減少 |

| 保守性 | API仕様変更のたびに全統合先を修正 | MCPサーバー側の修正だけで対応完了 |

| セキュリティ | 統合ごとに認証・認可を個別設計 | OAuth 2.1ベースの標準的な認証フローを共有 |

ここで注目すべきは、AIアプリケーションが5つ、連携したいツールが10個ある場合、従来は最大50通りの個別統合が必要だったという点です。MCPを導入すれば、各ツールが1つのMCPサーバーを実装するだけで、すべてのMCP対応AIアプリケーションから利用可能になります。つまり、開発・保守コストが劇的に削減されるのです。

MCPが実現する標準化の価値

MCPは単なる技術仕様ではなく、AI連携のエコシステム全体を変革する標準規格です。MCPの標準化がもたらす主な価値を以下に整理しました。

-

相互運用性の確保

MCPに対応したAIアプリケーションは、追加開発なしで任意のMCPサーバー(ツール)と接続できます。これは、開発者がツールの組み合わせを自由に選択できることを意味します。

-

エコシステムの成長加速

MCP対応のサーバーは誰でも開発・公開できるため、コミュニティ主導でツール連携の選択肢が急速に拡大しています。2026年2月時点で、GitHub上には数千のMCPサーバーが公開されています。

-

ベンダーロックインの回避

Linux Foundation傘下のオープンスタンダードであるため、特定のAIプロバイダーに依存することなく、長期的な技術戦略を立てることが可能です。

これらの価値により、MCPは企業のAI導入における「接続の標準」として、急速に採用が拡大しています。

MCPの仕組み

MCPは具体的にどのようなアーキテクチャで動作し、AIアプリケーションと外部ツールの接続を実現するのでしょうか。ここでは、MCPの中核となる構成要素と通信の仕組みを解説します。

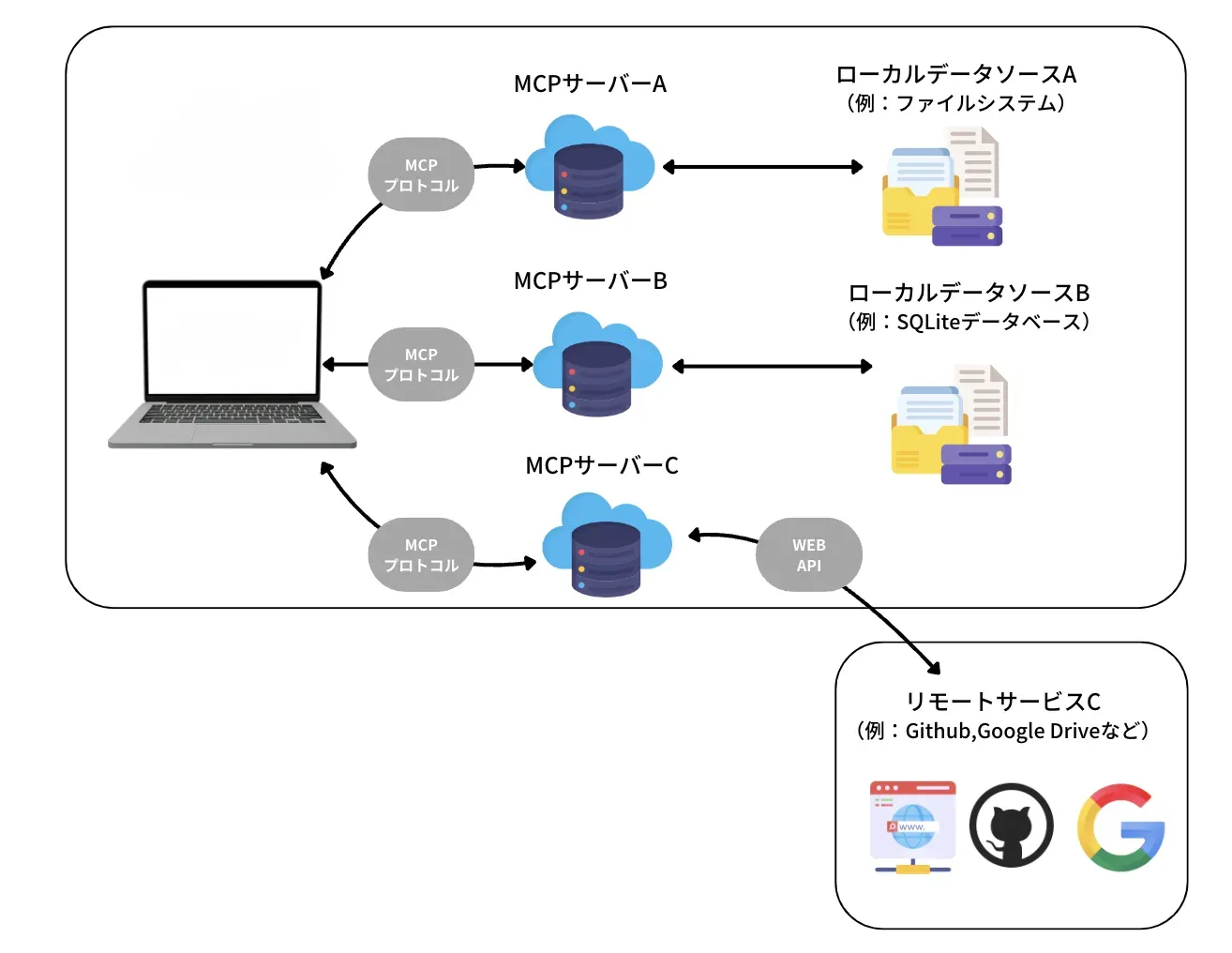

MCPのアーキテクチャ(ホスト・クライアント・サーバー)

MCPのアーキテクチャは、3つの主要コンポーネントで構成されています。

MCPの概念図

以下の表で、各コンポーネントの役割を整理しました。

| コンポーネント | 役割 | 具体例 |

|---|---|---|

| MCPホスト | ユーザーが操作するアプリケーション本体。MCPクライアントを内蔵し、LLMとの対話を管理する | Claude Desktop、Cursor、VS Code(GitHub Copilot)、Windsurf |

| MCPクライアント | MCPホスト内に組み込まれ、MCPサーバーとの1対1の接続・通信を担当する | 各ホストアプリに内蔵(ユーザーが直接操作することは少ない) |

| MCPサーバー | 外部ツールやデータソースへのアクセス機能を提供する軽量なサービス | GitHub MCPサーバー、Slack MCPサーバー、PostgreSQL MCPサーバー |

ここで注目すべきは、1つのMCPホストが複数のMCPサーバーに同時接続できるという点です。たとえば、Claude Desktopから同時にGitHub、Slack、データベースのMCPサーバーに接続し、AIがこれらのツールを横断的に活用してタスクを遂行できます。つまり、MCPはAIに「複数の手足」を与えるプロトコルなのです。

MCPの通信プロトコルとトランスポート

MCPの通信はJSON-RPC 2.0プロトコルに基づいています。MCPクライアントとMCPサーバー間のメッセージは、すべてJSON-RPC形式でやり取りされ、リクエスト・レスポンス・通知の3種類のメッセージタイプをサポートしています。

トランスポート層(通信経路)は、用途に応じて使い分けが可能です。以下の表で主要なトランスポートの特徴を整理しました。

| トランスポート | 用途 | 特徴 |

|---|---|---|

| stdio(標準入出力) | ローカル環境でのMCPサーバー実行 | セットアップが簡単。Claude Desktopなどでローカルサーバーを起動する際に使用 |

| Streamable HTTP | リモートMCPサーバーとの通信 | 2025年6月の仕様で導入。HTTPベースのため、既存のWebインフラ(認証・CORS・ロードバランサー)と統合しやすい |

ここで注目すべきは、Streamable HTTPトランスポートの登場により、MCPサーバーをクラウド上にデプロイしてリモートから利用できるようになった点です。これにより、ユーザーのローカル環境にMCPサーバーをインストールする必要がなくなり、企業でのMCP導入がより現実的になりました。

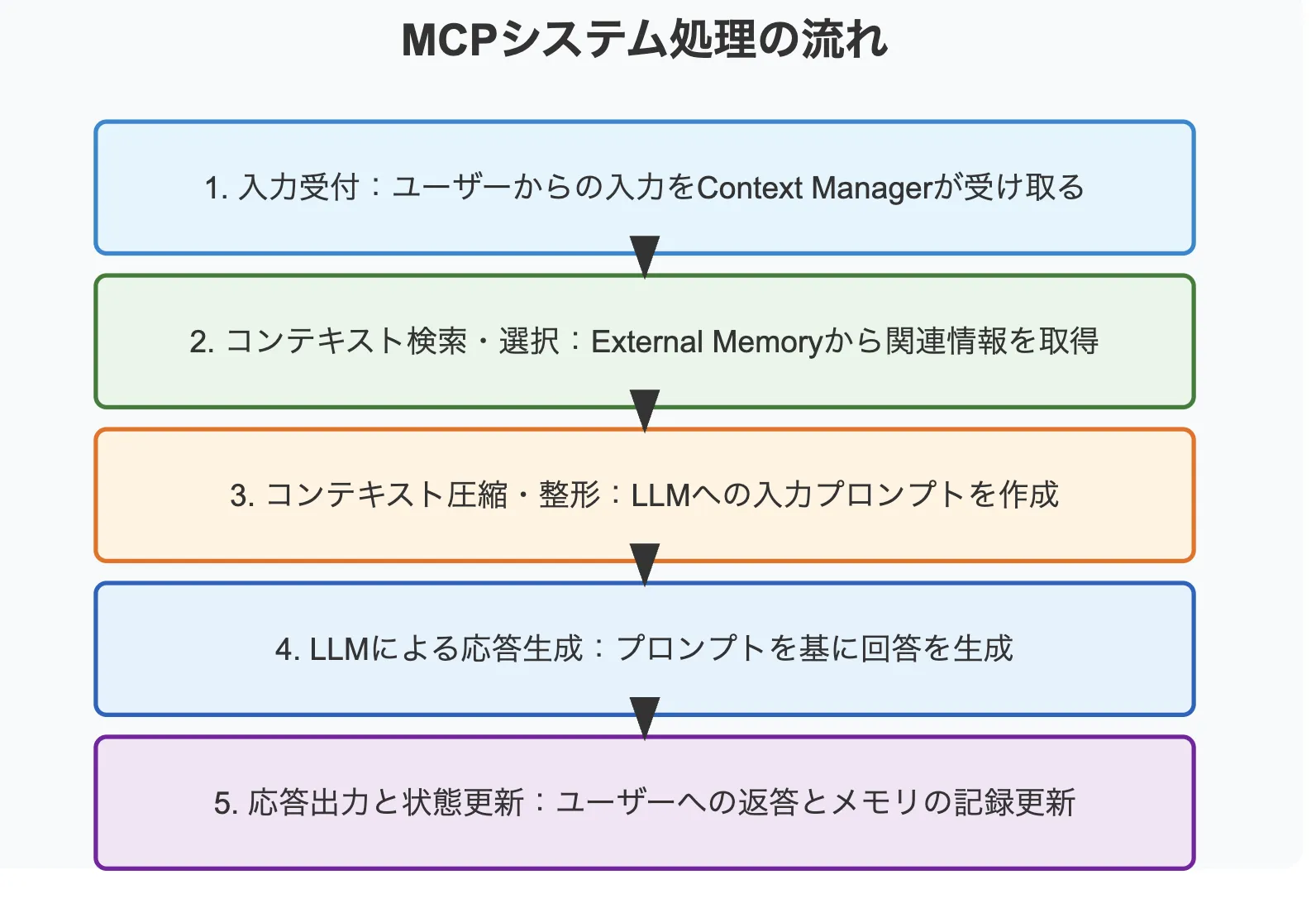

MCPの処理フロー

MCPに基づいたシステムでは、ユーザーの入力からAIの応答生成まで、以下のような流れで処理が進みます。

MCP処理の流れ

- 初期化:MCPホスト(例:Claude Desktop)が起動時にMCPクライアントを生成し、設定されたMCPサーバーとの接続を確立します。この段階で、各サーバーが提供する機能(ツール・リソース・プロンプト)の一覧を取得します。

- ユーザー入力:ユーザーがMCPホストに質問やタスクを入力します。

- LLMによる判断:MCPホスト内のLLMが入力を分析し、タスク遂行に必要な外部ツールやデータを判断します。

- ツール呼び出し:LLMの判断に基づき、MCPクライアントが該当するMCPサーバーにJSON-RPCリクエストを送信します。

- 外部サービス実行:MCPサーバーが外部ツール(GitHub API、データベースなど)にアクセスし、結果を取得します。

- 結果の統合:MCPサーバーからの結果がMCPクライアント経由でLLMに返され、LLMがユーザーへの最終的な応答を生成します。

この一連のフローにより、ユーザーは自然言語で指示を出すだけで、AIが複数の外部ツールを連携させてタスクを完了できるようになります。

MCPの3つの主要機能

MCPサーバーは、AIアプリケーションに対して3つの主要機能を提供します。これらの機能を理解することで、MCPが実現できることの全体像が把握できます。

Tools(AIが実行できるアクション)

Toolsは、AIモデルが外部システムに対してアクションを実行するための機能です。ファイルの作成・編集、API呼び出し、データベースへのクエリ実行など、「何かを実行する」操作が該当します。

Toolsの実行は原則としてユーザーの承認が必要であり、AIが勝手に重要な操作を実行することを防ぐ設計になっています。MCPホスト(Claude Desktopなど)では、ツール実行時に確認ダイアログが表示される仕組みが標準的です。

Resources(AIがアクセスできるデータ)

Resourcesは、AIモデルが参照できるデータやコンテンツを提供する機能です。ファイルの内容、データベースのレコード、API経由で取得した情報など、「読み取り専用のデータ」が該当します。

Toolsとの違いは、Resourcesは外部システムの状態を変更しないという点です。たとえば、GitHubリポジトリのファイル一覧を取得する操作はResourcesですが、新しいIssueを作成する操作はToolsに分類されます。

Prompts(AIへの指示テンプレート)

Promptsは、MCPサーバーが提供する再利用可能な指示テンプレートです。特定のタスクに最適化されたプロンプトをサーバー側で定義し、AIモデルに提供できます。

たとえば、コードレビュー用のMCPサーバーが「このコードのセキュリティリスクを分析してください」というプロンプトテンプレートを提供し、ユーザーがそれを選択するだけで、専門的な分析を実行できる仕組みです。プロンプトエンジニアリングの知見をサーバー側に組み込めるため、ユーザーが高度なプロンプト設計を行う必要がありません。

以下の表で、3つの機能の特性を整理しました。

| 機能 | 役割 | 操作の性質 | 具体例 |

|---|---|---|---|

| Tools | 外部システムでアクションを実行 | 書き込み・実行(状態変更あり) | ファイル作成、Issue作成、メール送信、データベース更新 |

| Resources | 外部データを読み取り提供 | 読み取り専用(状態変更なし) | ファイル内容の取得、データベースのクエリ結果、API応答 |

| Prompts | 再利用可能な指示テンプレート | AIへの指示定義 | コードレビューテンプレート、データ分析手順、レポート生成テンプレート |

ここで注目すべきは、これら3つの機能を組み合わせることで、AIエージェントが「データを参照し(Resources)、適切な手順で(Prompts)、外部ツールを操作する(Tools)」という一連のワークフローを自律的に実行できるようになるという点です。つまり、MCPは単なるデータ取得の仕組みではなく、AIの行動能力そのものを拡張するプロトコルなのです。

MCPとRAGの違い

LLMの能力を拡張する技術として広く知られるRAGとMCPは、一見すると似た目的を持っていますが、そのアプローチと適用範囲には明確な違いがあります。ここでは、両者の特徴と使い分けを解説します。

RAG(Retrieval-Augmented Generation)とは

RAG(Retrieval-Augmented Generation、検索拡張生成)は、LLMが応答を生成する際に、外部の知識ソースから関連情報を検索し、その情報をプロンプトの一部としてLLMに与えることで、応答の精度や事実性を向上させる技術です。

RAGの基本的な流れは「質問 → 関連文書の検索 → 検索結果をプロンプトに追加 → LLMが回答生成」というものです。詳しくはこちらの記事で解説しています。ぜひ併せてご覧ください。

生成AIのRAGとは?その仕組みや作り方、活用事例を解説!

MCPとRAGの主な違い

MCPとRAGの違いを以下の表で整理しました。この表を読んだ上で、続くセクションで両者の補完関係を解説します。

| 比較項目 | RAG(検索拡張生成) | MCP(Model Context Protocol) |

|---|---|---|

| 主な目的 | 外部知識を検索し、LLMの応答の正確性を補強する | AIアプリケーションと外部ツール・データソースの接続を標準化する |

| 操作の方向 | 読み取り専用(情報を検索してプロンプトに注入) | 双方向(データの読み取りに加え、外部ツールの実行・操作も可能) |

| 対象範囲 | 主にテキストデータ(文書、ナレッジベース) | データソース、API、開発ツール、業務アプリケーションなど広範 |

| 適用場面 | 社内ドキュメントQ&A、ナレッジ検索 | AIエージェントによる複数ツール連携、業務自動化 |

| 標準化 | 実装方法はプロジェクトごとに異なる | オープンプロトコルとして仕様が標準化されている |

ここで注目すべきは、RAGが「情報の検索と注入」に特化した技術であるのに対し、MCPは「外部システムとの双方向の接続」を標準化するプロトコルであるという点です。RAGはLLMに知識を与える仕組みですが、MCPはLLMに行動能力を与える仕組みといえます。

MCPとRAGの補完関係

MCPとRAGは競合する技術ではなく、補完的に活用できます。実際に、MCPの枠組みの中でRAGを機能の一部として組み込むことが可能です。

たとえば、MCPサーバーのResources機能を使ってRAGパイプラインを構築し、AIエージェントが「社内文書を検索して回答を生成し(RAG)、その結果をSlackに投稿する(MCPのTools)」という一連のワークフローを実行するケースが考えられます。

つまり、RAGは知識補強の手段として、MCPはシステム連携の標準として、それぞれの強みを活かした組み合わせが実務では最も効果的です。なお、AIに与えるコンテキスト全体の設計アプローチについては、コンテキストエンジニアリングの記事もあわせて参照してください。

MCPの使い方:Claude DesktopでのMCPサーバー導入

ここでは、MCPを実際に体験するための導入手順を紹介します。Playwright MCPとClaude Desktopを活用した、ブラウザ自動操作の例で解説します。

Playwright MCPは、LLMによるWebページの操作を可能にするMicrosoft製のMCPサーバーで、GitHubのplaywright-mcpリポジトリから利用が可能です。

Claude Desktopは、Anthropic社のAIモデルClaudeをデスクトップアプリとして使用できるソフトで、MCPを完全にネイティブサポートしています。

Claude Desktopのインストールと初期設定

-

Claude Desktopの公式サイトにアクセスし、インストールを行います。

Claude Desktop -

Claudeのアカウントにサインインします。

アカウントにサインイン

-

開発者モードを有効化し、設定から開発者を選択します。「構成を編集」をクリックし、JSON形式の設定ファイルを編集します。

設定

-

以下のように記述し、Playwright MCPサーバーとの接続を設定します。

{

"mcpServers": {

"playwright": {

"command": "npx",

"args": ["@playwright/mcp"]

}

}

}

上記の設定が完了すると、Claude Desktop上からMCPサーバーが提供するツールを確認できるようになります。以下のようにプロンプト入力画面にサーバーのツールアイコンが表示されれば成功です。

サーバーが提供するツールの確認

MCPを活用したブラウザ自動操作のデモ

設定が完了したら、MCPの機能を実際に試してみましょう。Playwright MCPサーバーを使って、AIにブラウザ操作を指示します。

-

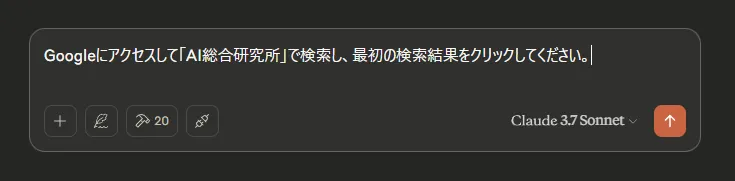

プロンプトに操作内容を自然言語で入力します。

プロンプト -

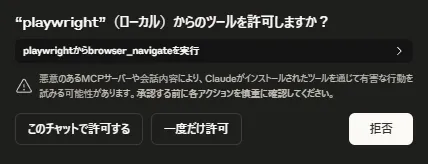

MCPツールの使用許可を求めるメッセージが表示されるので、内容を確認して許可します。この承認プロセスは、MCPのセキュリティ設計の一環です。

ツールの使用確認 -

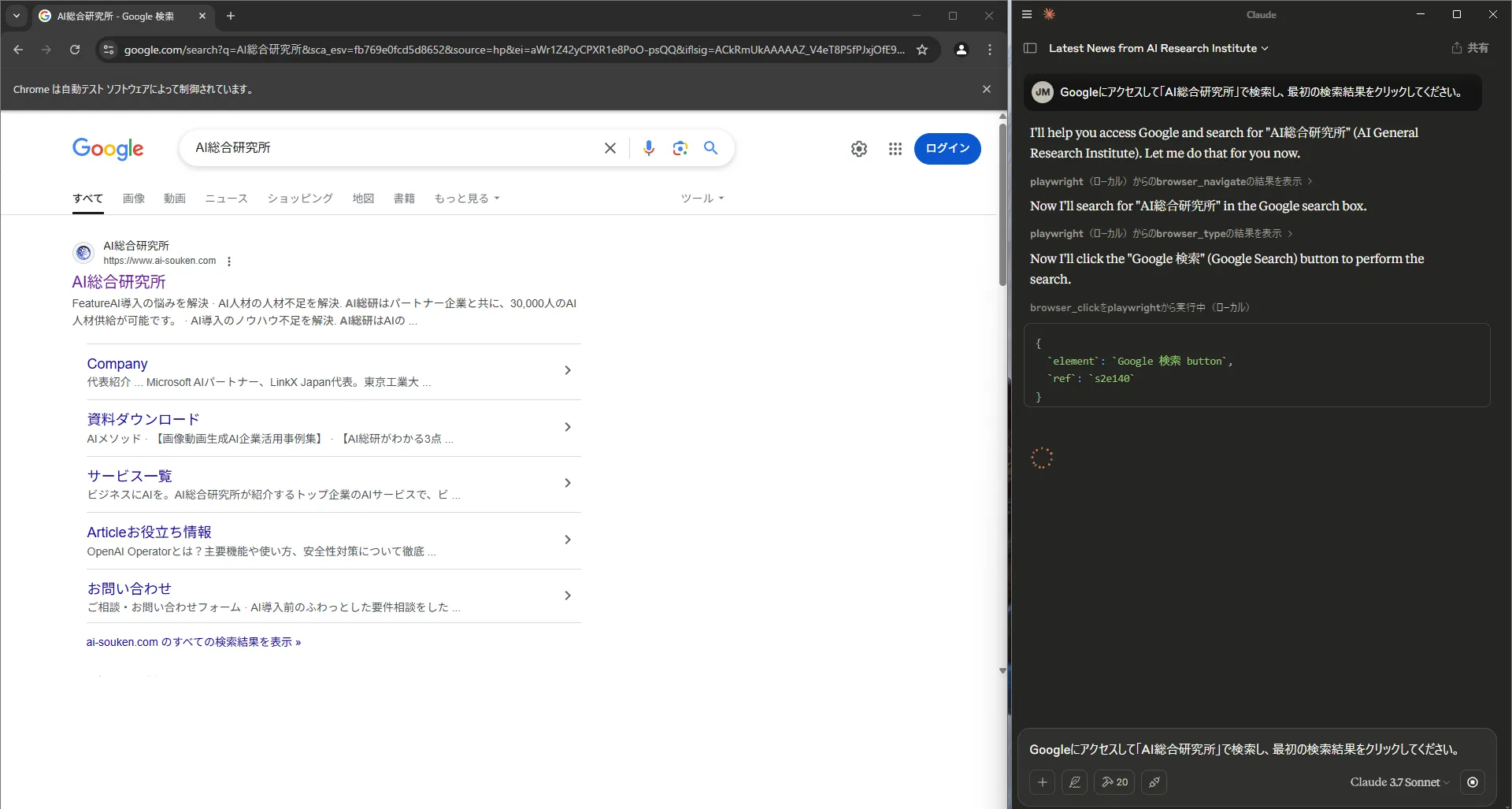

ブラウザが自動的に起動し、AIの指示に基づいた操作が実行されます。

ブラウザの操作 -

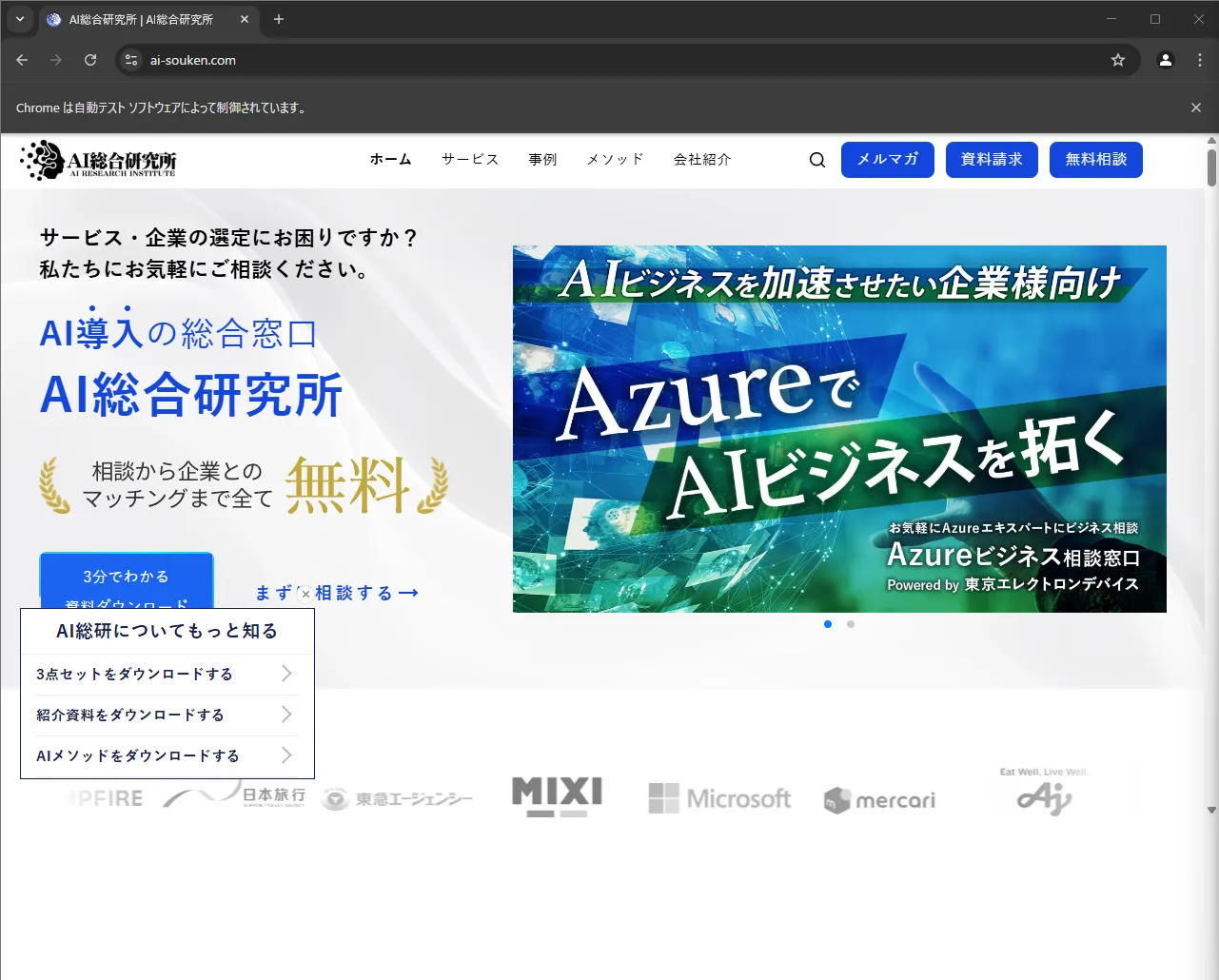

最終的に、目的のサイトへのアクセスが完了しました。

サイトのアクセス

このように、MCPを導入することで、従来のLLMだけでは不可能だったブラウザ操作やファイル操作、外部API連携などが、自然言語の指示だけで実現できるようになります。Playwright MCP以外にも、GitHub、Slack、Google Drive、PostgreSQLなど、多様なMCPサーバーを同様の手順で追加できます。

MCPを導入するメリットとユースケース

MCPの導入により、AIアプリケーションの能力は飛躍的に拡張されます。ここでは、MCPの主なメリットを、対応する具体的なユースケースとともに解説します。

MCPによる開発効率の向上

MCPは、AIと外部ツールの連携における開発コストを大幅に削減します。従来はツールごとに個別のAPI統合を開発する必要がありましたが、MCPに対応すれば一度の実装で複数のAIアプリケーションから利用可能になります。

MCPによる開発効率向上の具体的なユースケースを以下にまとめました。

-

コード生成・レビュー支援

GitHub MCPサーバーを接続することで、AIがリポジトリのコードを参照し、Issue作成、プルリクエストのレビュー、コード修正提案を一貫して行えます。

-

プロジェクト管理の自動化

Jira・Linear・NotionなどのMCPサーバーを組み合わせることで、AIがタスクの作成、進捗確認、関連ドキュメントの参照をシームレスに実行します。

MCPによるAPI連携コストの削減と相互運用性

MCPの標準化により、ツール統合にかかる開発期間が大幅に短縮される事例が報告されています。特に複数のAIモデルやツールを組み合わせる企業にとって、相互運用性の確保は大きなメリットです。

-

マルチクラウド環境でのAI活用

MCPに対応したAIアプリケーションは、Azure、AWS、Google Cloudのいずれのサービスとも共通の方式で連携できるため、クラウド戦略の柔軟性が高まります。

-

カスタマーサポートの効率化

CRMシステム、ナレッジベース、チャットプラットフォームのMCPサーバーを接続し、AIが顧客情報の参照から回答生成、チケット作成までを一貫して処理します。

MCPによるセキュリティとガバナンスの強化

MCPは、AIと外部システムの接続において、標準化されたセキュリティフレームワークを提供します。OAuth 2.1ベースの認証フローや、ツール実行時のユーザー承認プロセスが組み込まれています。

-

社内データベースへの安全なアクセス

MCPサーバーを経由することで、AIがアクセスできるデータの範囲を明確に制御でき、情報漏洩リスクを低減できます。

-

監査ログの一元化

MCP経由の全操作がログとして記録されるため、AIの行動を監査・追跡する仕組みを構築しやすくなります。

MCPによるパーソナライズと専門知識の活用

MCPを通じてユーザー固有のデータや専門的なナレッジベースにAIを接続することで、高度にパーソナライズされたサービスを実現できます。

-

医療・法務Q&Aシステム

専門文献データベースのMCPサーバーを構築し、最新の診療ガイドラインや判例に基づいた高精度な回答を生成します。

-

教育・学習支援

学習管理システムのMCPサーバーを通じて、受講者の進捗や理解度に応じた個別最適化された学習コンテンツを提供します。

MCPの主要な対応サービスとエコシステム

MCPは、すでに多くの主要サービスやプラットフォームで対応が進んでいます。ここでは、2026年2月時点での主要な対応状況とエコシステムの広がりを解説します。

GitHub Copilot:エージェントモードでのMCP活用

GitHub Copilotは、エージェントモードでMCPを採用し、外部ツールやコンテキストとの連携を強化しています。

GitHub Copilot

MCP対応により、GitHub Copilot Agentは以下のような高度なタスクを実行できます。

-

ローカルファイルシステムへのアクセス

プロジェクト全体のコードや設定ファイルを直接参照・分析し、より文脈に即したコード生成やリファクタリング提案を行います。

-

ターミナルコマンドの実行

コードのビルド、テスト実行、依存関係のインストールなどをAIが代行します。

-

GitHub Issueとの連携

Issueの内容を理解し、関連するコードを修正したり、プルリクエストを作成したりします。

GitHub CopilotはVS Codeに統合されており、開発者は使い慣れたエディタ上でMCPの恩恵を受けることができます。参考:GitHub Copilot Agent Mode Activated(GitHub Blog JP, 2025-04-07)

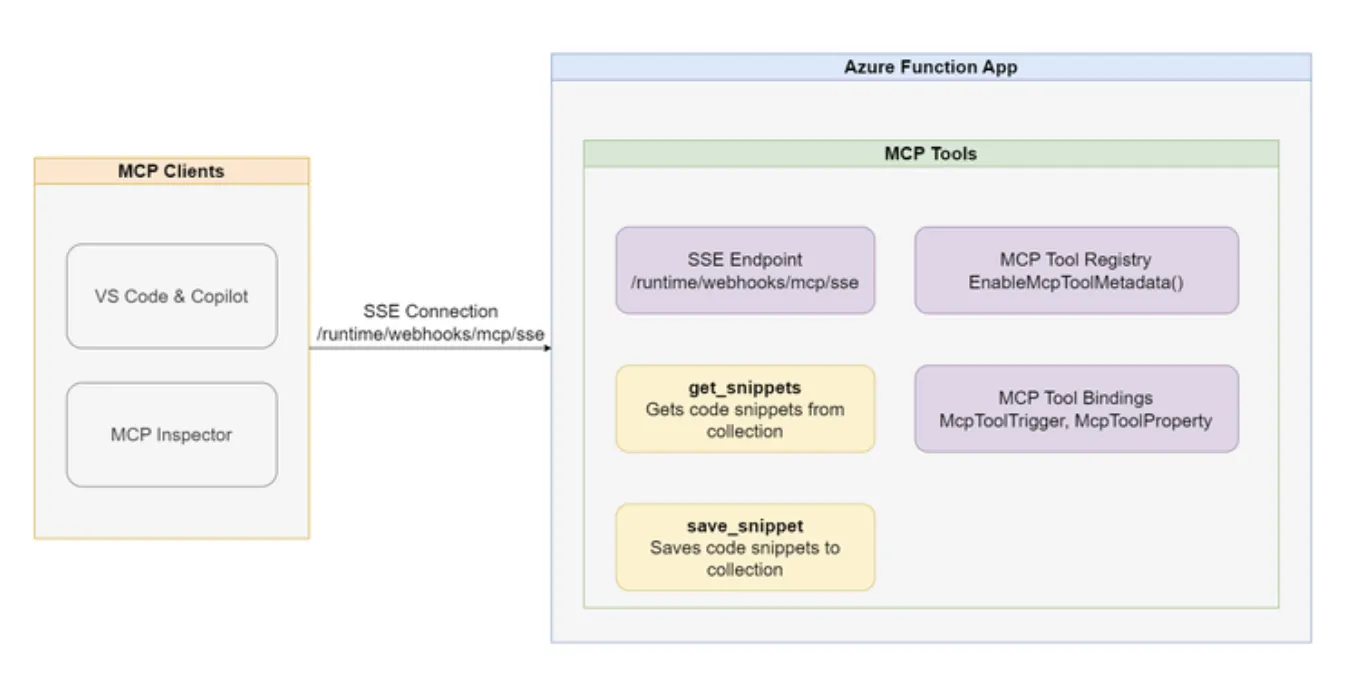

Microsoft Azure:Azure FunctionsでのMCPサーバー構築

MicrosoftのクラウドプラットフォームAzureでは、Azure Functionsを利用してカスタムMCPサーバーを構築・ホストする方法が提供されています。

Microsoft MCPサーバー構築 参考:Build AI Agent Tools using Remote MCP with Azure Functions(Microsoft Tech Community, 2025-04-05)

Azure FunctionsでMCPサーバーを構築するメリットを以下にまとめました。

-

スケーラビリティとコスト効率

Azure Functionsはリクエストに応じて自動的にスケールするため、サーバーの運用管理の手間なく、必要な時に必要なだけリソースを利用できます。

-

豊富なAzureサービスとの連携

Azure OpenAI Service、Azure AI Search、Azure SQL Database、Azure Blob Storageといった他のAzureサービスへ容易にアクセスできます。

-

企業内システムとのセキュアな連携

Azureのネットワーク機能やセキュリティ機能を活用し、オンプレミス環境や他のクラウドにある基幹システムへ安全にアクセスするMCPサーバーを構築できます。

MicrosoftはAgentic AI Foundationの共同設立メンバーでもあり、Azure上でのMCPエコシステム拡大に積極的に取り組んでいます。なお、Azure MCPサーバーの具体的なツール一覧については、Azure MCP Serverとは?の記事で詳しく解説しています。

OpenAI:Agents SDKでのMCPサポート

OpenAIもMCPへの対応を進めています。Agents SDKでMCPクライアント機能が実装され、OpenAIのモデルからMCPサーバーへの接続が可能になっています。

OpenAIはAgentic AI Foundationの共同設立メンバーであり、ChatGPTデスクトップアプリのMCPサポートについても対応が進んでいます。これにより、Claude以外のAIモデルからもMCPサーバーを活用できる環境が整いつつあります。参考:OpenAI Agents SDK

Google:GeminiエコシステムでのMCP展開

Googleは、Gemini CLIやFirebase MCPサーバーなど、自社のAIエコシステム全体でMCP対応を展開しています。Geminiモデルとの組み合わせにより、Google Cloud上でのMCPサーバー構築が可能です。

Android StudioへのMCPサーバー追加機能も提供されており、モバイルアプリ開発を含む幅広い開発シーンでMCPを活用できる環境が整備されています。

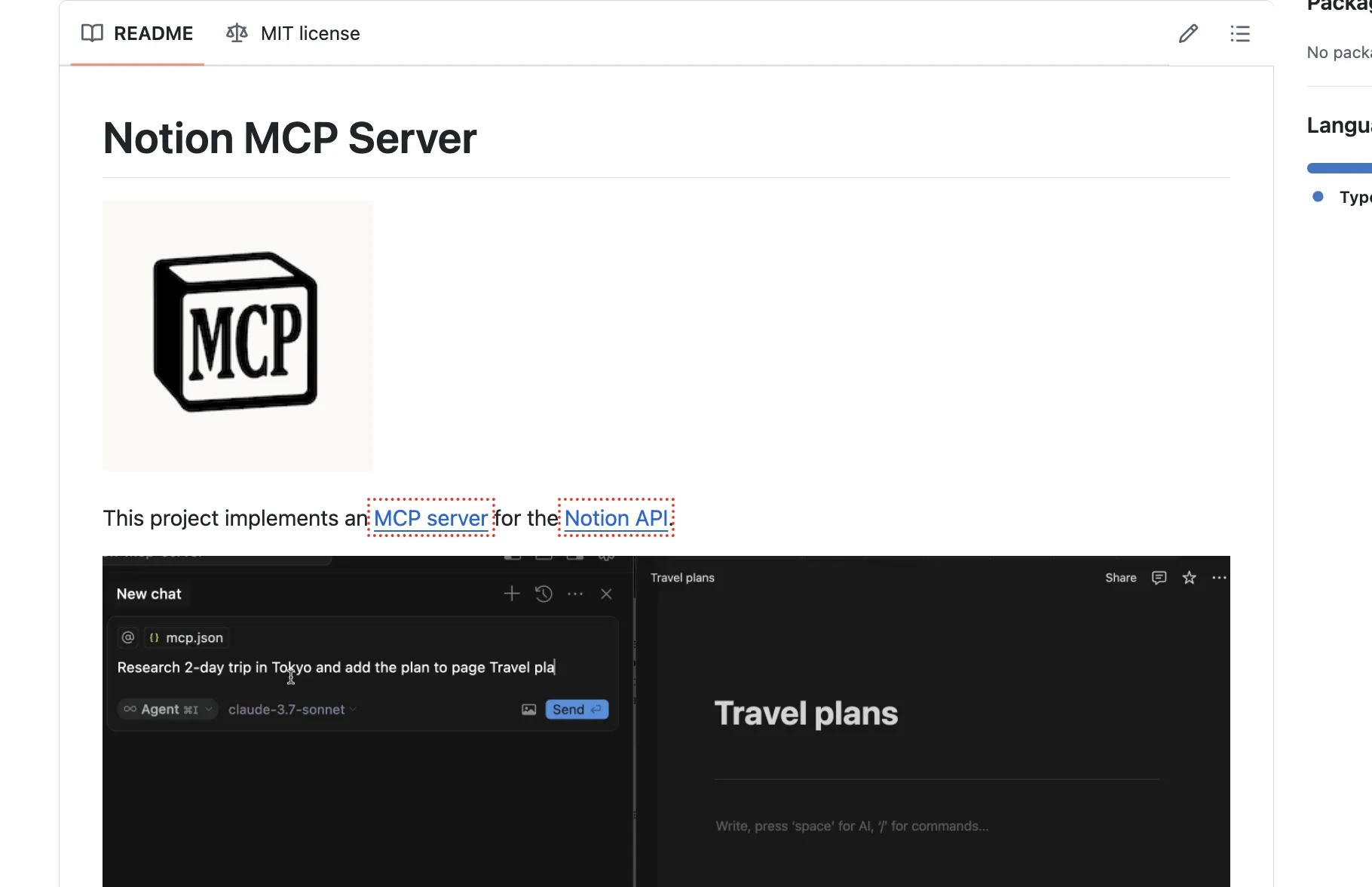

Notion:MCPサーバーによるナレッジ連携

Notion公式のMCPサーバーが提供されており、AIアプリケーションからNotionのドキュメント、データベース、議事録などに直接アクセスできるようになっています。

Notion MCPサーバーの活用例を以下にまとめました。

-

社内ナレッジ検索

AIアシスタントがNotion内の情報を検索し、社内規定や過去のプロジェクト情報に関する質問に回答します。

-

ドキュメント要約・タスク生成

Notion上の長文ページの内容をAIが要約したり、会議の議事録からタスクリストを自動生成したりします。

-

パーソナライズされた情報提供

ユーザー個人のNotionワークスペースの内容をAIが参照し、関連情報やタスクのリマインダーなどを提供します。

MCPの対応クライアントとツール一覧

MCP対応のエコシステムは急速に拡大しています。以下の表で、2026年2月時点での主要な対応クライアントを整理しました。

| カテゴリ | サービス名 | 概要 |

|---|---|---|

| AIコーディングエディタ | Cursor、Windsurf、Zed | コーディング支援AIにMCPサーバーを接続し、外部ツールとの連携を強化 |

| AIアシスタント | Claude Desktop、Claude Code | Anthropic製AIアシスタント。MCPの最も成熟した実装 |

| 開発ツール | VS Code(GitHub Copilot)、JetBrains IDE | 主要なIDEでMCPサーバーの接続が可能 |

| クラウドプラットフォーム | AWS、Google Cloud、Azure | 各社がMCPサーバーの構築・ホスティング環境を提供 |

ここで注目すべきは、AIモデルプロバイダー(Anthropic、OpenAI、Google)だけでなく、クラウドプラットフォーム(AWS、Azure、Google Cloud)やIDEベンダー(Microsoft、JetBrains)まで、業界全体がMCPに収束しつつあるという点です。MCPサーバーの一覧は、公式GitHubリポジトリで確認できます。

【関連記事】

Agent2Agent(A2A)とは?A2Aプロトコルの概要・MCPとの違い・使い方を解説

MCP導入時のセキュリティと注意事項

MCPの利便性と柔軟性の一方で、適切なセキュリティ対策がなければ、情報漏洩や意図しない操作のリスクが生じます。ここでは、MCP導入時に考慮すべきセキュリティ上の注意点と、MCPが向いている場面・向かない場面を解説します。

MCPの権限管理とアクセス制御

MCPで扱うデータには、ユーザー情報や業務上の機密が含まれることがあります。過剰な権限でMCPサーバーを実行すると、攻撃を受けた際の被害範囲が拡大するため、最小権限の原則に基づいた設計が重要です。

具体的に注意すべきリスクを以下にまとめました。

-

権限昇格のリスク

MCPサーバーが広範な権限で実行されている場合、不正なプロンプトインジェクションによって意図しない操作が実行される可能性があります。MCPサーバーに付与する権限は、必要最小限に制限することが推奨されます。

-

コンテキストスプーフィング

悪意のあるMCPサーバーが、信頼できるサーバーになりすまして偽の情報を返す手法です。MCPサーバーの信頼性を検証する仕組みや、公式のサーバーを優先利用する運用ルールの整備が求められます。

-

データ保持ポリシーの明確化

MCPを介して取得したデータのライフサイクル管理は重要です。保存期間、保持場所、削除タイミングを明確に定義し、必要以上のデータ蓄積を避けましょう。

MCPの認証とトランスポートのセキュリティ

MCPの2025年11月の仕様では、OAuth 2.1がリモートMCPサーバーの標準認証フレームワークとして採用されました。PKCE(Proof Key for Code Exchange)やDynamic Client Registrationなど、セキュリティのベストプラクティスが組み込まれています。

通信の暗号化についても、Streamable HTTPトランスポートではHTTPSを通じたTLS暗号化が標準であり、ローカルのstdioトランスポートではプロセス間通信のため外部ネットワークへの露出がありません。

リモートMCPサーバーを公開する場合は、トークン委譲方式の採用が推奨されています。これは、MCPクライアントからサーバーに認証トークンを引き渡し、サーバーがデータソースへのアクセス時にそのトークンを使用する方式で、サーバー自体が広範な認証情報を保持するリスクを回避できます。

MCPが向いている場面と向かない場面

MCPは強力なプロトコルですが、すべてのケースに最適というわけではありません。以下の表で、導入判断の基準を整理しました。

| 項目 | MCPが向いている場面 | MCPが向かない場面 |

|---|---|---|

| ツール連携数 | 複数のツール・データソースをAIから利用したい | 連携するツールが1つだけで、直接API統合のほうがシンプル |

| AIモデルの多様性 | 複数のAIモデル・アプリケーションから同じツールを利用したい | 単一のAIモデルのみ使用し、変更予定がない |

| チーム規模 | 複数の開発者がAI連携を担当し、統一的な方法が必要 | 個人開発で、既存のライブラリや直接API呼び出しで十分 |

| 将来の拡張性 | ツールやAIモデルの追加・変更を見据えている | 一度構築したら変更の予定がない |

ここで注目すべきは、MCPの導入が最も効果を発揮するのは「複数のツールと複数のAIアプリケーションを組み合わせて使う場面」だという点です。逆に、単一ツールとの単純な連携であれば、直接API統合のほうがオーバーヘッドが少ない場合もあります。

複数ツール連携の発想を組織のAI業務改革に持ち込む

MCPが解決する「AIと外部ツールの接続」という課題は、組織の業務自動化においても本質的なテーマです。個々のAIツールを点で使うのではなく、業務システムと連携させて面で自動化する設計が求められています。

AI総合研究所では、Microsoft環境でのAI業務自動化を段階的に進める実践ガイド(220ページ)を無料で提供しています。部門別のBefore/After付きユースケースから、PoC→全社展開のロードマップまで、システム連携を前提とした導入ステップを解説しています。

AI総合研究所が、AI連携の技術理解を組織の業務プロセス改革に転換する支援を提供します。

エージェント接続技術を組織導入に活かす

プロトコル理解から業務AI設計へ

MCPやA2Aのようなエージェント接続技術を理解したなら、次は組織として業務にAIを組み込む導入設計が鍵になります。Microsoft環境での段階的導入プロセスを220ページの実践ガイドで解説しています。

まとめ

本記事では、AIアプリケーションと外部ツール・データソースの接続を標準化するオープンプロトコルModel Context Protocol(MCP)について、その仕組みから実践的な導入方法まで詳しく解説しました。

-

AIの「接続」を標準化するプロトコル

MCPは、AIアプリケーションと外部ツールの連携方法を統一するオープンスタンダードです。USB-Cのように、一度対応すればあらゆるMCP対応サービスとの接続が可能になります。

-

3つの機能でAIの行動能力を拡張

Tools(アクション実行)、Resources(データ参照)、Prompts(指示テンプレート)の3機能により、AIは外部システムと双方向にやり取りできるようになります。

-

業界横断のオープンスタンダード

2025年12月にLinux Foundation傘下のAgentic AI Foundationに移管され、OpenAI、Google、Microsoftなど主要企業が参加する業界標準として発展を続けています。

-

急速に拡大するエコシステム

GitHub Copilot、Azure、OpenAI、Google Gemini、Cursor、VS Codeなど、主要な開発ツールやクラウドサービスがMCPに対応済みです。

MCPは、AIエージェント時代における「接続の標準規格」として、今後さらに普及が加速していくことが予想されます。AI導入を検討している企業にとって、MCPの概念とエコシステムを理解しておくことは、将来を見据えた技術戦略の策定において重要な要素となるでしょう。