この記事のポイント

本番環境でAIモデルを運用するなら、Google AI Studioではなく Vertex AIに移行すべき。SLA・セキュリティ・スケーラビリティが段違い

Model Gardenで200超のモデルを同一基盤から選択でき、Gemini 2.5 ProからClaudeやLlamaまでワンストップで利用可能

Agent Builder+Agent Engineでエージェント構築から本番デプロイ・監視までVertex AI内完結、2026年4月EAPで統合拡張

GCPにデータ資産が集中しているなら、BigQueryとの零コピー連携だけでもVertex AIを選ぶ理由になる

従量課金のためコスト管理が重要。予算アラートとクォータ設定を導入初期に設定し、想定外の課金を避けるべき

Microsoft MVP・AIパートナー。LinkX Japan株式会社 代表取締役。東京工業大学大学院にて自然言語処理・金融工学を研究。NHK放送技術研究所でAI・ブロックチェーンの研究開発に従事し、国際学会・ジャーナルでの発表多数。経営情報学会 優秀賞受賞。シンガポールでWeb3企業を創業後、現在は企業向けAI導入・DX推進を支援。

Google Cloudの「Vertex AI」は、機械学習と生成AIの開発から本番運用までを一気通貫で支援する統合AIプラットフォームです。2026年4月時点では200超のモデルを集約したModel Garden、エージェント構築基盤のAgent Builder、RAG Engineなど、生成AI時代に対応した機能群へと大きく進化しています。

さらに2026年4月のGoogle Cloud Next '26では、Vertex AIのエージェント領域を統合するGemini Enterprise Agent Platformへの進化方針が発表され、Build / Scale / Govern / Optimizeの4層でエージェント開発ライフサイクルを再構成する動きが本格化しています。

本記事では、Vertex AIの主要機能からAgent Builder・Agent Engineの最新動向、Gemini 2.5世代の料金体系、国内企業の活用事例、Amazon Bedrock・Azure AIとの比較、Agent Platformへの進化、導入判断で詰まりやすいポイントまでを体系的に解説します。

✅Googleの最新動画生成AIモデル「Gemini Omni」については、以下の記事をご覧ください。

Gemini Omniとは?その性能や使い方、料金体系を徹底解説!

目次

Vertex AI Studio — プロンプト設計とチューニングの作業場

Vertex AIのエージェント機能 — Agent Builder

Agent Development Kit(ADK)— オープンソースの開発フレームワーク

GROWTH VERSE — マーケティングAI SaaSの高度化

Vertex AI vs Amazon Bedrock vs Azure AI

Vertex AIとは?

Vertex AIとは、Google Cloudが提供する機械学習(ML)と生成AIの開発から運用(MLOps)まで、AIプロジェクトの全ライフサイクルを単一のインターフェースで支援するフルマネージドの統合プラットフォームです。

データの準備、モデルの構築、トレーニング、デプロイ、そして本番環境での監視・管理といった一連のプロセスをシームレスに連携させることで、AI開発の効率を飛躍的に向上させます。もともとGoogle Cloudには、コーディング不要でモデルを構築できる「AutoML」と、専門家向けの「AI Platform」という2つのサービスが存在しましたが、Vertex AIはこれらを統合し、ノーコードからプロコードまで対応する懐の深いプラットフォームとして2021年5月に登場しました。

2026年4月時点では、Gemini 2.5世代のモデルをはじめ200超のモデルを集約したModel Garden、エージェント構築基盤のAgent Builder、RAG Engineなど、生成AI・エージェント時代に対応した機能群へと大きく進化しています。

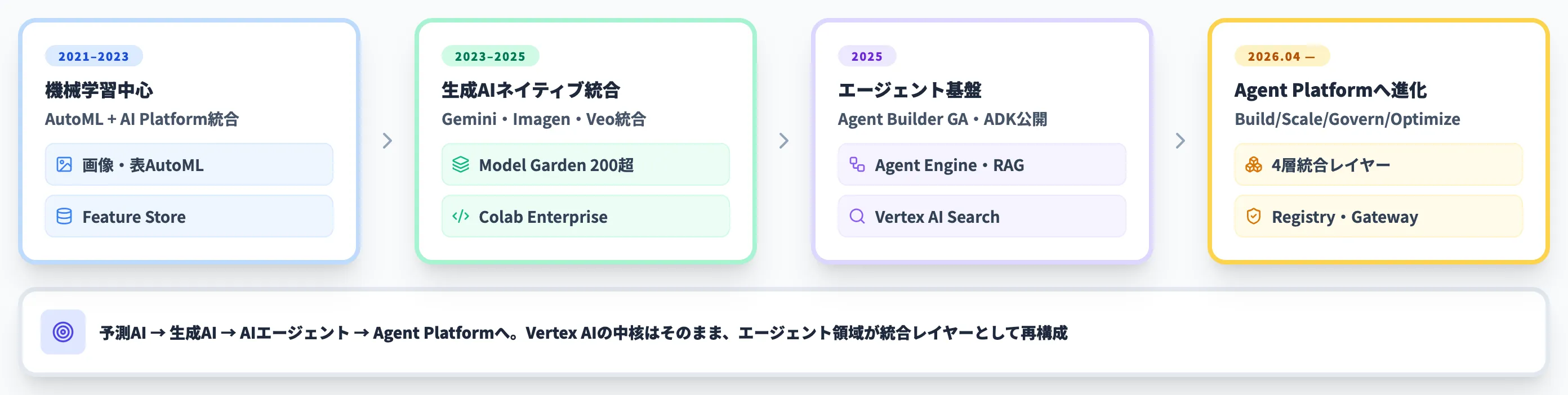

MLプラットフォームから統合AIプラットフォームへの進化

リリース当初は予測分析などの伝統的な機械学習が中心でしたが、生成AIの急速な発展を受けて、Vertex AIはその役割を大きく変えてきました。

2021年〜2023年 機械学習中心の時代

- AutoMLによる画像・テキスト・表形式データの分析

- カスタムモデルのトレーニングとデプロイ

- Feature StoreやModel Monitoringなどの基本的なMLOps機能

2023年〜2025年 生成AIのネイティブ統合

- Gemini、Imagen(画像生成)、Veo(動画生成)などGoogle最先端の基盤モデルをAPI経由で利用可能に

- Model Gardenの拡充で、Google製モデルに加えMeta社のLlamaやAnthropic社のClaudeもVertex AI経由で利用可能に

- Colab EnterpriseをVertex AIに統合し、エンタープライズ水準のセキュリティと開発環境を一体化

2025年〜現在 エージェント基盤への拡張

- Agent BuilderのGA化で、AIエージェントの構築・デプロイ・運用をVertex AI内で完結可能に

- Agent Engine、RAG Engine、Vertex AI Searchなど、エージェント運用に必要なインフラが揃う

- Agent Development Kit(ADK)をオープンソースで公開し、マルチエージェントシステムの構築を支援

2026年4月〜 Gemini Enterprise Agent Platformへの進化

2026年4月のGoogle Cloud Next '26で、Vertex AIはエージェント開発に特化した統合レイヤー「Gemini Enterprise Agent Platform」として進化する方針が発表されました。Build / Scale / Govern / Optimize の4層でエージェント開発ライフサイクルを再構成する構想で、Vertex AIが培ってきたモデル・データ・MLOps基盤はAgent Platformに引き継がれる位置づけです。

- Agent Designer / Agent Studio / ADK などの開発ツールをAgent Platformとして再整理

- Agent Runtime、Memory Bank、Sessions、Workspacesなどエージェント実行基盤を拡充

- Registry、Gateway、Identity、Inboxなどガバナンス・運用機能を標準装備

Vertex AI Agent Builderなど既存プロダクトの今後の扱いや移行要件については、公式ドキュメントと契約条件の確認が必要です。既存のVertex AI資産(Model Garden・Pipelines・Feature Store・MLOps機能)は引き続きVertex AIの中核として利用できる見通しです。

予測AI → 生成AI → AIエージェントの3領域を一気通貫で管理する統合基盤へ

この進化により、Vertex AIは単なるML基盤ではなく、予測AI・生成AI・AIエージェントの3領域を企画から本番運用まで一気通貫で管理できる、企業のAI戦略そのものを支える中核プラットフォームへと変貌を遂げました。

Vertex AIとGoogle AI Studioの違い

Vertex AIのエコシステムを理解するうえで、無料のプロトタイピングツール「Google AI Studio」との役割分担を押さえておくことが重要です。両者の関係は、「アイデアを試す無料の実験場(Google AI Studio)」と「ビジネスとしてスケールさせる本格的な工場(Vertex AI)」に例えられます。

以下の表で、両者の特性を整理しました。

| 比較項目 | Google AI Studio(実験場) | Vertex AI(工場) |

|---|---|---|

| 目的 | プロンプトの試行錯誤、アイデアの迅速な検証 | 本番環境でのアプリケーション開発・運用 |

| 料金 | 無料(利用回数制限あり) | 従量課金制 |

| 機能 | 生成AIのプロンプト実験に特化 | 予測AI、生成AI、MLOps、エージェント構築まで包括的 |

| セキュリティ | 基本的な認証のみ | VPC Service Controls、IAM、監査ログなどエンタープライズ水準 |

| モデル選択 | Geminiシリーズ中心 | 200超モデル(Google製+サードパーティ+OSS) |

実務での使い分けとしては、まずGoogle AI Studioで無料でプロンプトを検証し、有効性が確認できたらVertex AIへ移行するのが効率的です。Google AI Studioで作成したプロンプトはコードエクスポート機能で簡単にVertex AIへ持ち込めるため、移行のハードルは低く設計されています。

Google AI Studio(実験場)とVertex AI(工場)の使い分け

Vertex AIの主要機能

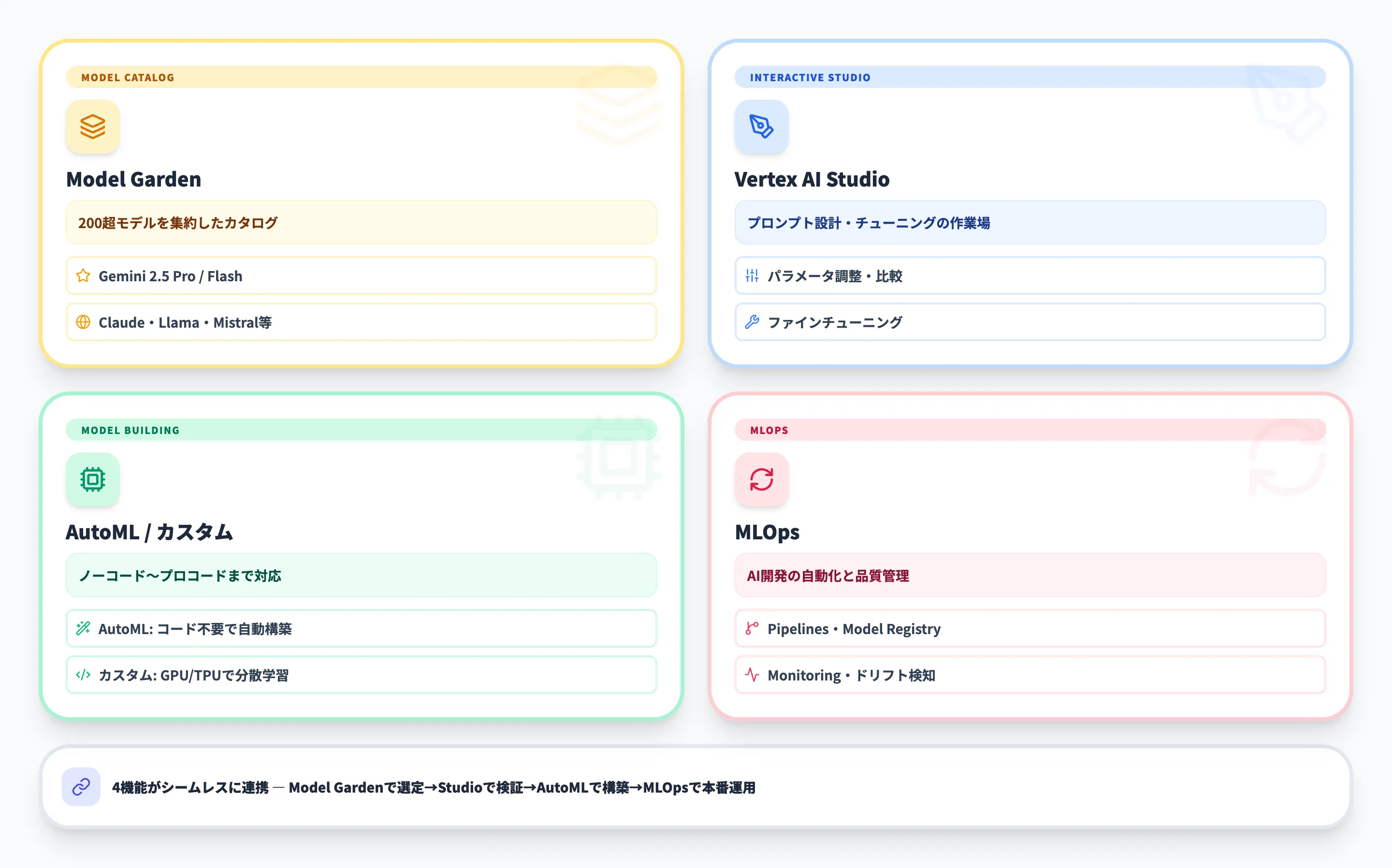

Vertex AIは、AI開発のあらゆるフェーズに対応する包括的なツール群を提供します。ここでは、エージェント機能を除く基盤的な機能を整理します(エージェント機能は次のセクションで詳述)。

4機能がシームレスに連携 — Model Gardenで選定→Studioで検証→AutoMLで構築→MLOpsで本番運用

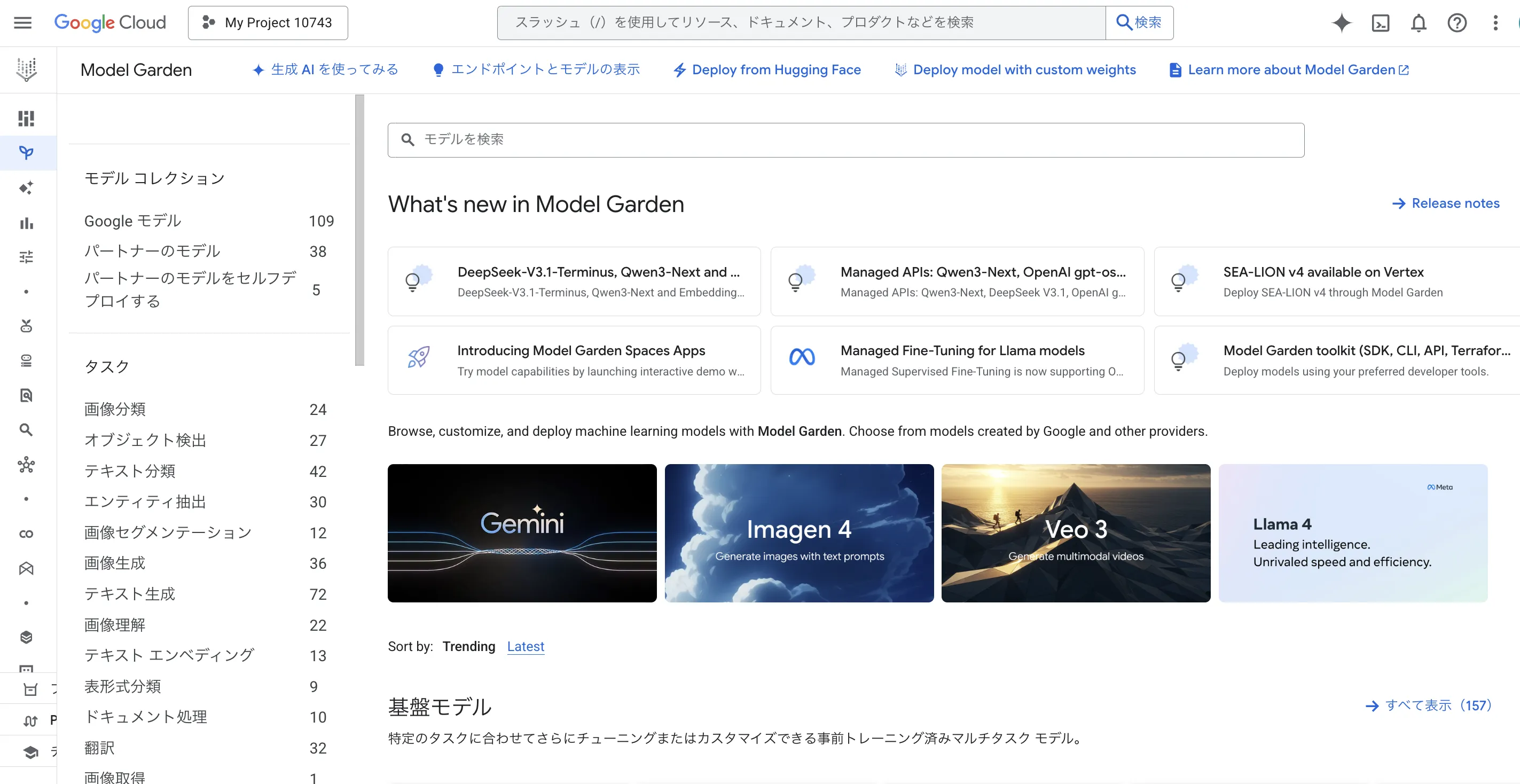

Model Garden — 200超モデルのカタログ

Model Gardenは、Google製モデルに加え、Anthropic社のClaude、Meta社のLlama、Mistral AIなど200以上のモデルを集約したカタログです。目的に合ったモデルを選び、チューニングやデプロイを同一基盤で行えます。

2026年4月時点の主要モデルは以下のとおりです。

- Gemini 2.5 Pro

最大100万トークンのコンテキストを持つフラッグシップモデル。テキスト・画像・動画・音声のマルチモーダル処理に対応

- Gemini 2.5 Flash

高速・低コストで、レイテンシが重要なアプリケーションに最適。思考モード(Thinking)対応

- Claude(Anthropic)

長文処理と安全性に強みを持つモデル。Vertex AI経由でGCPのセキュリティ基盤と組み合わせて利用可能

- Llama(Meta)

オープンソースモデル。透明性とカスタマイズ性が必要なユースケースに適する

- Imagen 3 / Veo 2

画像生成・動画生成に特化したGoogle製モデル

特にGeminiシリーズはGemini APIを通じてVertex AI Studioやアプリケーションから直接呼び出せるため、プロトタイプから本番環境まで同じAPIで運用できる点が実務上の大きなメリットです。

Model Gardenの利用画面

Vertex AI Studio — プロンプト設計とチューニングの作業場

Model Gardenで選んだモデルを実際に試すための「インタラクティブな作業場(UI)」です。プロンプトの設計と比較、パラメータの調整、自社データを使ったファインチューニングといった作業をブラウザ上で行えます。

コード不要でプロンプトを試行錯誤できるため、エンジニアだけでなく業務部門の担当者がPoCを主導するケースでも活用されています。

Vertex AI Studioの利用画面

AutoML / カスタムトレーニング

Vertex AIは、スキルレベルに応じた2つの開発パスを提供しています。

- AutoML

コーディング不要で、画像・表形式データから高精度なカスタムMLモデルを自動構築する機能。データサイエンティストではないビジネス担当者でもPoCを迅速に進められる(参考: AutoML 初心者向けガイド)。なお、AutoML Textは2025年6月に提供終了しており、テキスト分類・感情分析などのタスクはGeminiのプロンプトまたはチューニングへ移行が推奨されている

- カスタムトレーニング

TensorFlowやPyTorchなど任意のフレームワークで独自モデルを構築する環境。Googleの強力なインフラ(GPU / TPU)を活用し、大規模な分散学習も実行可能

実務での段階的なアプローチとしては、まずAutoMLでベースラインを構築し、精度が不足する場合にカスタムトレーニングへ移行するのが効率的です。AutoMLの結果がそのまま十分な精度を出すケースも多く、この段階でPoCを完了できることもあります。

まずAutoMLでベースライン構築 → 精度限界が見えたらカスタムへ段階移行

MLOps — AI開発の自動化と品質管理

AIモデルを一度作って終わりではなく、継続的に価値を創出し続けるための運用機能が充実しています。

- Vertex AI Pipelines

データの取り込みからモデルのデプロイ、監視までの一連のフローを自動化し、開発プロセスの信頼性と再現性を担保

- Model Registry / Monitoring

開発したモデルのバージョンを一元管理し、本番環境で稼働中のモデルの性能を自動監視。入力データの傾向変化(ドリフト)を検知し、再学習が必要なタイミングを通知

- Colab Enterprise(Vertex AI Workbench)

Jupyterノートブックのエンタープライズ版。IAM権限管理・VPC内実行・大規模リソースへのアクセスを備え、チームでの安全な共同開発を実現

Pipelines → Registry → Monitoring の循環でモデルの継続的価値創出を自動化

これらの機能が独立して存在するのではなく、シームレスに連携できる点がVertex AIの真の価値です。Model GardenからGeminiを選びファインチューニング → Colab Enterpriseで検証 → Pipelinesで自動デプロイ → Monitoringで品質監視、という一気通貫のフローを同一基盤で実現できます。

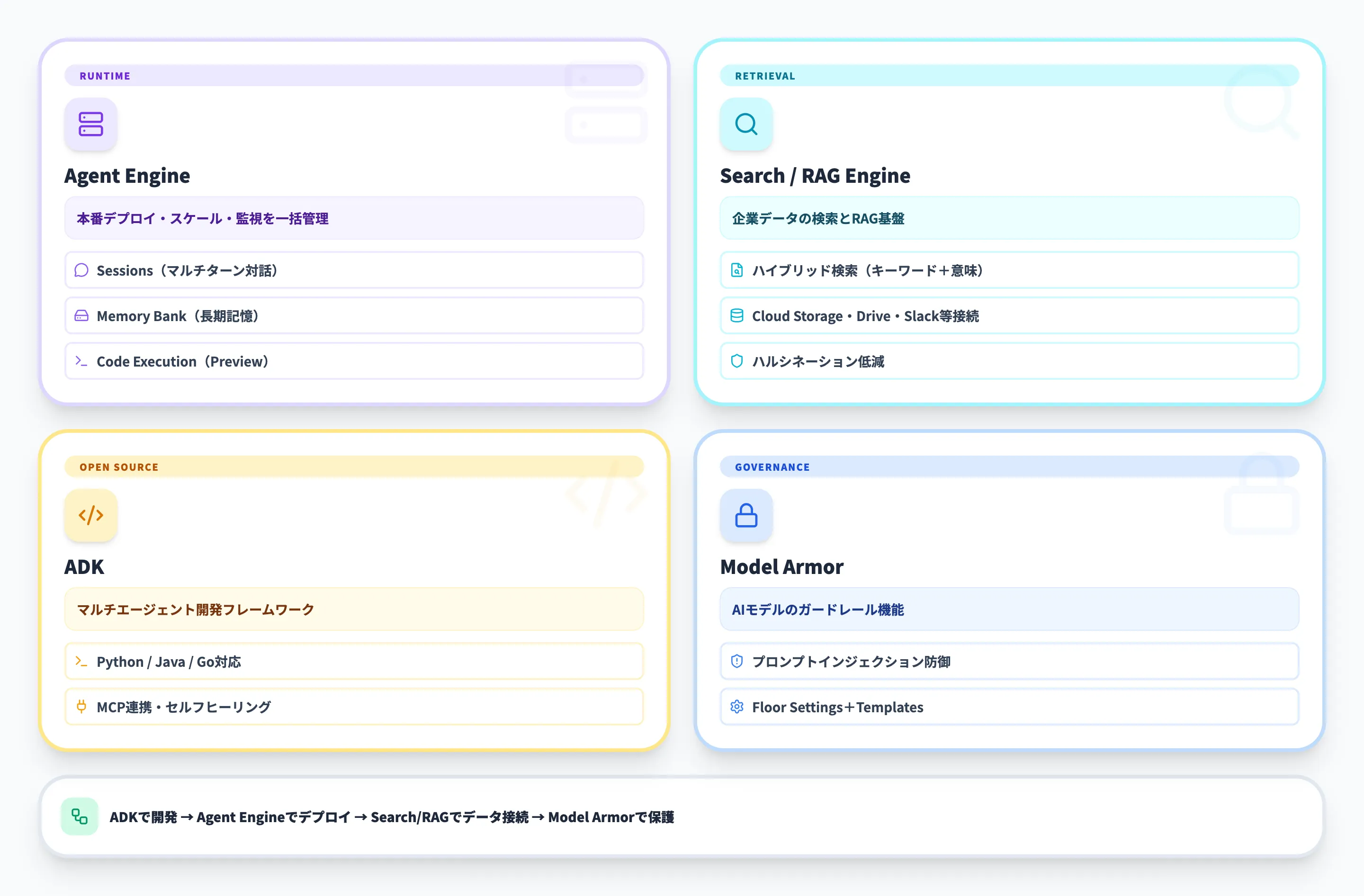

Vertex AIのエージェント機能 — Agent Builder

2025年以降、Vertex AIの中で最も急速に拡充されているのがAIエージェント関連の機能群です。Vertex AI Agent Builderは、エージェントの構築(Build)、本番運用(Scale)、ガバナンス(Govern)を一貫して担うスイートとして位置づけられています。

なお、2026年4月のGoogle Cloud Next '26で発表されたGemini Enterprise Agent Platformは、これらAgent Builderが担ってきた領域を含めてエージェント開発ライフサイクル全体を統合し直すプラットフォームとして位置づけられています。既存のAgent Builder資産(Agent Engine / Vertex AI Search / RAG Engine / ADK)の今後の扱いや移行要件は公式ドキュメントと契約条件の確認が必要ですが、本セクションで紹介する機能群はAgent Platform上でも引き続き活用できる見通しです。

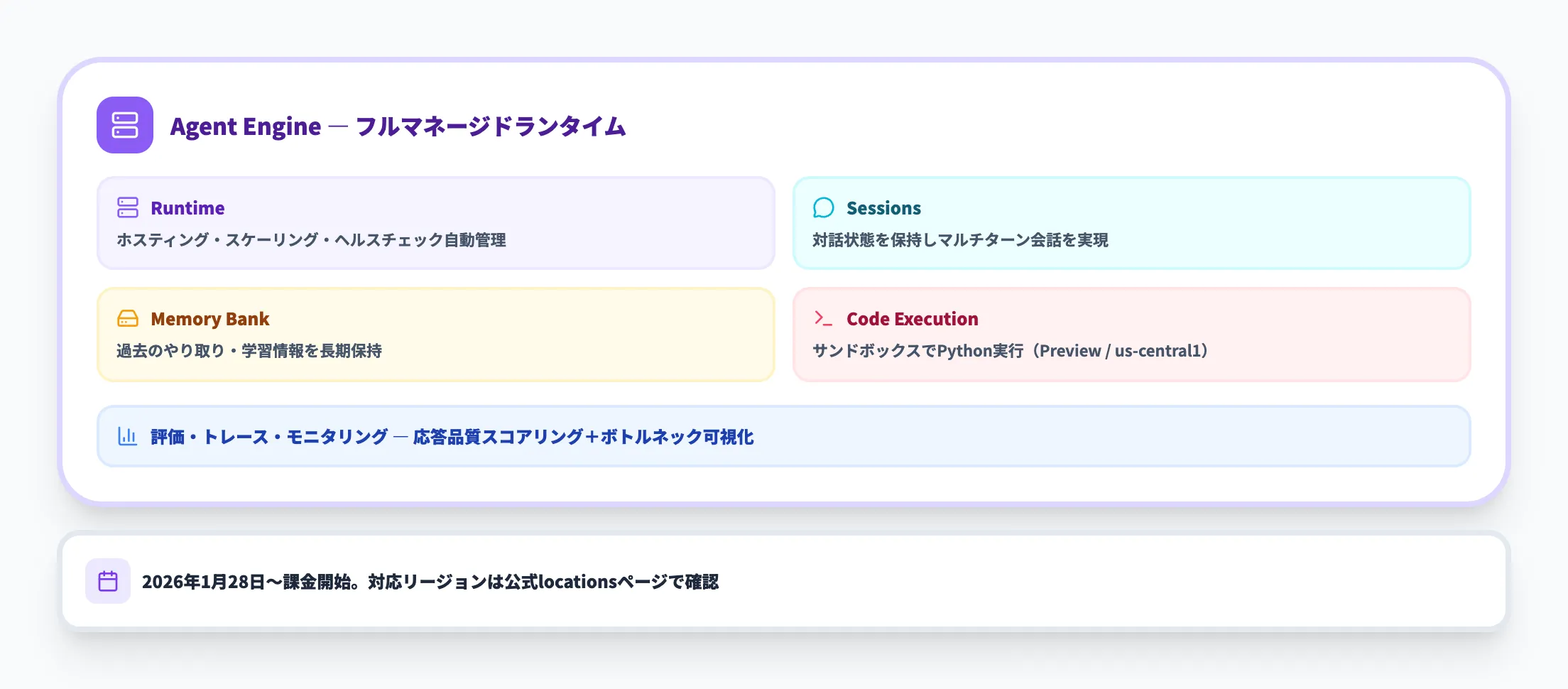

Agent Engine — 本番デプロイと運用管理

Agent Engineは、開発したエージェントを本番環境にデプロイし、管理・スケールさせるためのフルマネージドランタイムです。2026年4月時点で提供されている主な機能は以下のとおりです。

- フルマネージドランタイム

エージェントのホスティング、スケーリング、ヘルスチェックを自動管理

- Sessions(セッション管理)

エージェントとユーザーの対話状態を保持し、マルチターン会話を実現

- Memory Bank(メモリ管理)

エージェントが過去のやり取りや学習した情報を長期的に保持

- Code Execution(コード実行)

エージェントがサンドボックス環境でPythonコードを実行し、データ分析や計算処理を自律的に行う。2026年4月時点ではPreviewで、対応リージョンはus-central1のみ

- 評価・トレース・モニタリング

エージェントの応答品質をスコアリングし、ボトルネックを可視化

Agent Engine Runtime・Sessions・Memory Bankは2026年1月28日から課金が開始されています。対応リージョンは公式のlocationsページで確認できます。

Agent Engine — フルマネージドランタイムでエージェントのデプロイから監視まで一括管理

Vertex AI Search — 企業データのAI検索

Vertex AI Searchは、社内ドキュメント・データベース・Webサイトなどの企業データを対象にしたAI検索エンジンです。エージェントがユーザーの質問に対して正確な回答を返すためのRAG(検索拡張生成)基盤として機能します。

独自のランキングアルゴリズムに加え、Geminiによる意味理解を組み合わせたハイブリッド検索が特徴で、従来のキーワード検索では拾えなかった関連情報も高精度に取得できます。

RAG Engine — 検索拡張生成の基盤

RAG Engineは、外部のナレッジソース(Cloud Storage、Google Drive、Slack、Jiraなど多様なデータソース)をLLMのコンテキストとして統合するためのフレームワークです。

LLMの回答にプライベートデータを組み込むことで、ハルシネーション(事実と異なる回答)を低減し、社内情報に基づいた正確な応答を実現します。Vertex AI Searchがアウトオブボックスの検索ソリューションであるのに対し、RAG Engineはより柔軟にカスタマイズ可能なRAGパイプラインを構築したい場合に適しています。

Agent Development Kit(ADK)— オープンソースの開発フレームワーク

ADKは、マルチエージェントシステムの構築を効率化するオープンソースフレームワークです。Python・Java・Goで利用可能で、以下の特徴を持ちます。

- エージェントのコンテキスト層(静的・ターン・ユーザー・キャッシュ)を制御し、トークン使用量を削減

- MCP(Model Context Protocol)ツールとの連携に対応

- adk deployコマンドでローカル開発からAgent Engineへのシームレスなデプロイが可能

- ツール呼び出し失敗時の自動リトライ(セルフヒーリング)機能

Agent Gardenというプレビュー段階のライブラリも提供されており、カスタマーサービスやデータ分析などのプリビルトエージェントテンプレートを起点に開発を始められます。

Agent Builder — ADKで開発→Agent Engineでデプロイ→Search/RAGでデータ接続→Model Armorで保護

Vertex AIの活用事例

Vertex AIは、マーケティング、製造、金融、ヘルスケアなど幅広い業界で導入が進んでいます。ここでは、Google Cloud公式ブログやプレスリリースで公表されている事例を紹介します。

GROWTH VERSE — マーケティングAI SaaSの高度化

マーケティングAI SaaS「AIMSTAR」を開発・運営するGROWTH VERSEは、Vertex AIを導入してデータ分析とクリエイティブ制作の双方をスケールアップしました。従来は数個の要素に基づいていたカタログ送付先の選定に、生成AIで200もの特徴量を組み込んだ結果、売上が大幅に向上したとGoogle Cloud公式ブログで報告されています。

導入の決め手として、Vertex AIはGemini経由のマルチモーダル対応に加え、ターゲティングAIやレコメンドエンジンの改善がしやすい点が挙げられています。

中外製薬 — 創薬プロセスの効率化

中外製薬はVertex AIを活用し、創薬プロセスにおける候補物質の探索と分析を高速化しています。機械学習モデルの活用で研究者の負担を軽減しながら精度の高い判断が可能となり、EnterpriseZineなどで取り上げられています。

その他の活用事例

以下の日本企業でも、Google Cloudの生成AI基盤を活用した取り組みが進んでいます。

- 日本情報通信

過去の問い合わせ履歴と製品マニュアルを学習した生成AIエージェントを開発し、サポート品質と効率を向上

- イオンフィナンシャルサービス

リテールメディアの運用分析と広告配信業務を生成AIで効率化

- 人・夢・技術グループ

Vertex AI Agent Builderを活用し、公開オープンデータの自動収集・整理を行う生成AIアプリのPoCを実施

これらの事例に共通するのは、既にGoogle Cloud上にデータ資産がある企業がVertex AIを選択しているという点です。BigQueryやCloud Storageに蓄積されたデータをそのままAI開発に活用できるため、データ移行のコストと時間を大幅に削減できることが導入の決め手になっています。

国内企業の活用事例 — GCP上のデータ資産を活かしたVertex AI導入

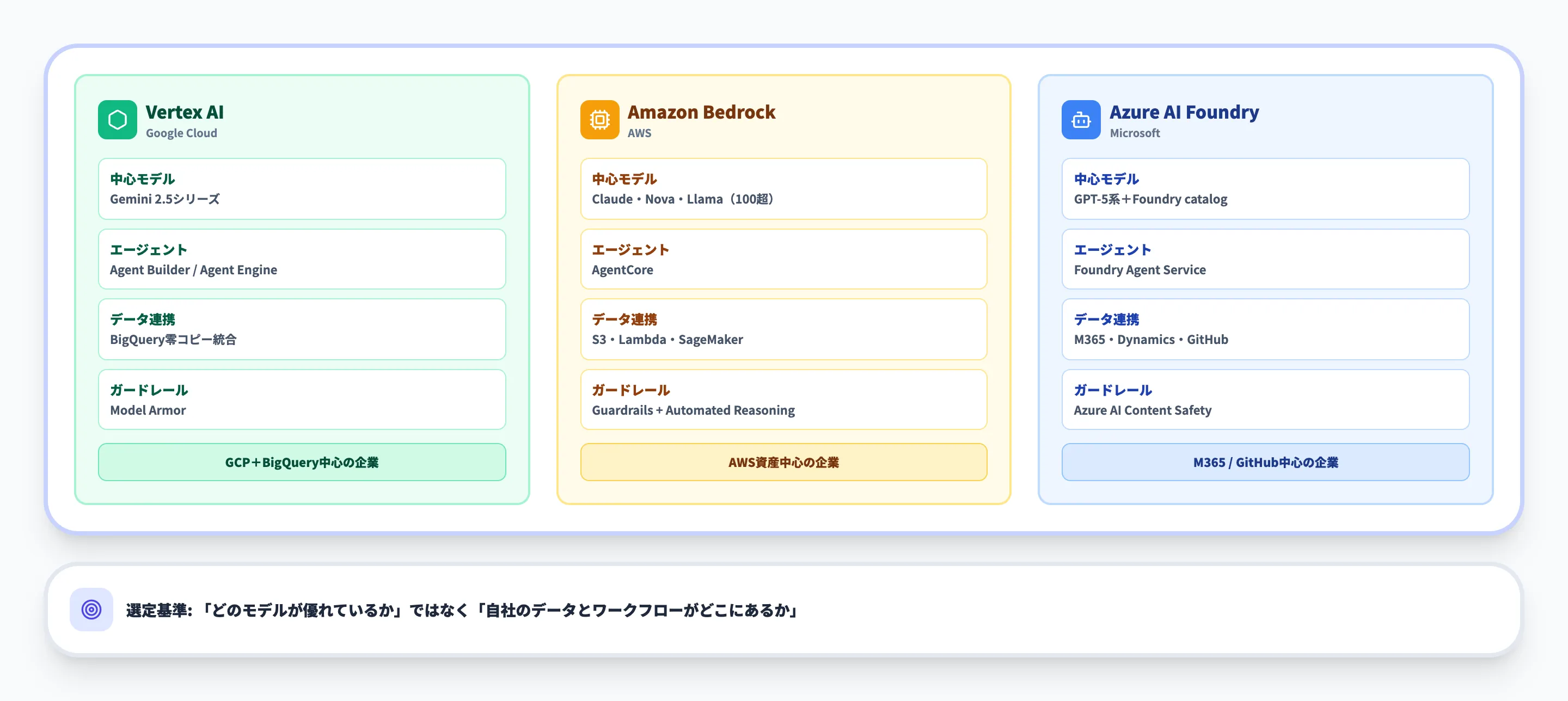

Vertex AI vs Amazon Bedrock vs Azure AI

企業がAI開発基盤を選定する際、Vertex AIの主な比較対象になるのがAmazon Bedrock(AWS)とAzure OpenAI / Azure AI Foundry(Microsoft)です。

以下の表で、3つのプラットフォームの特性を整理しました。

| 比較項目 | Vertex AI(Google Cloud) | Amazon Bedrock(AWS) | Azure OpenAI / AI Foundry(Microsoft) |

|---|---|---|---|

| 中心モデル | Gemini 2.5シリーズ | Claude・Nova・Llama(100超モデル) | GPT-5系+Foundry model catalog経由で複数プロバイダー |

| モデル数 | 200超(Model Garden) | 100超 | OpenAI+Cohere・DeepSeek・Meta・Mistral等(Foundry catalog) |

| エージェント基盤 | Agent Builder / Agent Engine | AgentCore | Foundry Agent Service |

| RAG | Vertex AI Search / RAG Engine | Knowledge Bases | Azure AI Search |

| ガードレール | Model Armor | Guardrails(Automated Reasoning付) | Azure AI Content Safety |

| データ連携の強み | BigQuery(零コピー統合) | S3・Lambda・SageMaker | M365・Dynamics・GitHub |

| ML/MLOps | AutoML・Pipelines・Model Registry | SageMaker連携 | Azure ML連携 |

| 最適な企業 | GCP+BigQuery中心の企業 | AWS資産中心の企業 | M365 / GitHub中心の企業 |

この比較から分かるのは、「どのモデルが優れているか」ではなく**「自社のデータとワークフローがどこにあるか」**が選定基準だという点です。

GCPに既にデータ資産がある、特にBigQueryを中心にデータ分析基盤を構築している企業にとっては、BigQuery MLやリモートモデル連携によりデータ移動を最小化しながらAI開発を進められるVertex AIが最も合理的な選択肢です。一方、AWSやAzureに資産が集中している場合はそれぞれのネイティブサービスを選ぶほうが合理的です。

マルチクラウド環境で運用している場合は、各クラウドのAI基盤を用途別に使い分ける(例: データ分析はBigQuery + Vertex AI、業務アプリはM365 + Azure OpenAI)というハイブリッドアプローチも現実的な選択肢です。

3社比較 — 選定基準は「自社のデータとワークフローがどこにあるか」

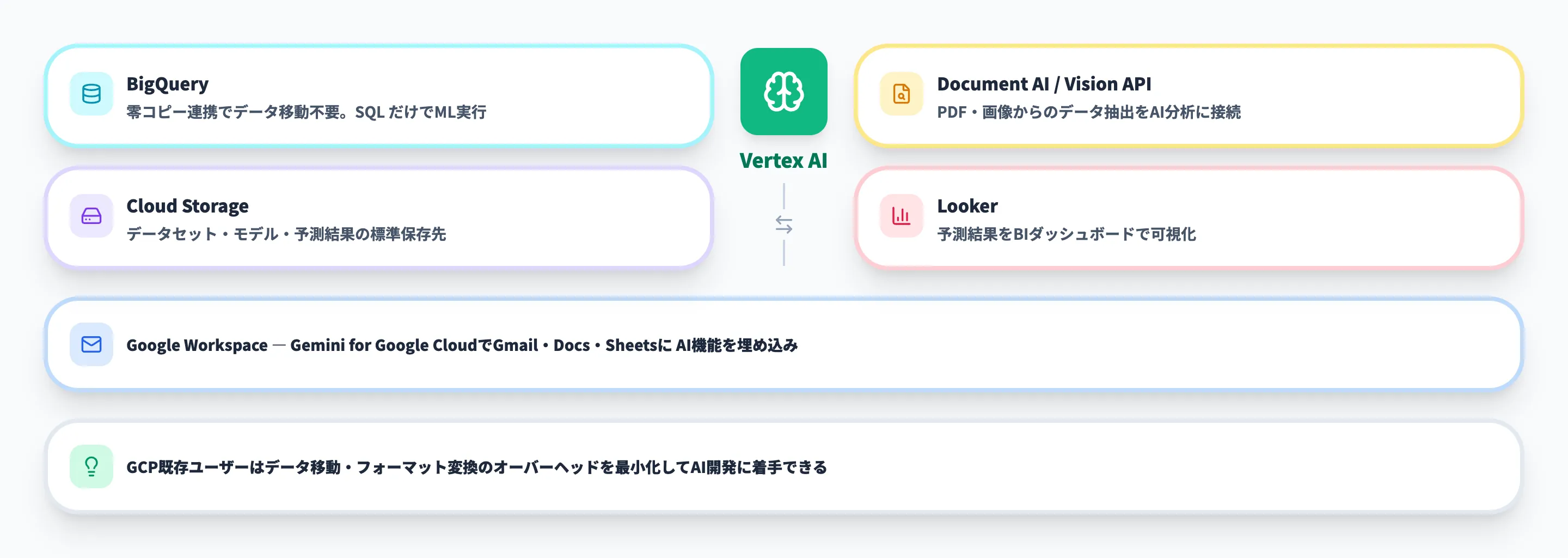

Vertex AIと他Google Cloudサービスの連携

Vertex AIの価値は、Google Cloudが持つデータ基盤や各種サービスと密接に連携することでさらに高まります。

BigQueryとのネイティブ統合

ペタバイト級のデータを扱えるデータウェアハウスBigQueryとのシームレスな連携は、Vertex AIの最大の差別化ポイントの一つです。

BigQueryに格納されたデータを移動させることなく、直接Vertex AIのトレーニングデータとして利用できるため、データパイプラインが簡素化され、開発速度が向上します。さらに、BigQuery MLを使えばSQLだけで機械学習モデルを構築・実行でき、データアナリストがVertex AIの高度な機能を意識せずにML活用を始められます。

その他の主要サービスとの連携

- Cloud Storage

データセット、学習済みモデル、予測結果など、あらゆるAI関連アセットの保存場所として標準的に利用される

- Document AI / Vision API

PDFや画像からテキストや構造化データを抽出し、その結果をVertex AIでさらに高度な分析にかけるワークフローを構築可能

- Looker

Vertex AIで生成した予測結果をBIツールのLookerでダッシュボード化し、ビジネス上の意思決定に活用

- Google Workspace

Gemini for Google Cloudを通じて、GmailやGoogle Docs、SheetsなどのWorkspaceアプリ内にAI機能を埋め込み可能

GCPを既に利用している企業であれば、これらの連携によりデータの移動やフォーマット変換といったオーバーヘッドを最小化できます。逆に言えば、GCP以外のクラウドにデータが集中している場合は、データ移行コストを見積もったうえで判断する必要があります。

GCP既存ユーザーはデータ移動のオーバーヘッドを最小化してAI開発に着手できる

Vertex AIの料金体系

Vertex AIの料金は従量課金制で、利用した機能・リソースに応じて課金されます。

Geminiモデルの料金比較 — Flashは入力コストProの約1/4

Vertex AIの主要な課金項目

Vertex AIでは、機能ごとに料金が設定されています。最も利用頻度が高い生成AIモデルのAPI料金と、その他の主要サービスの課金体系を整理します。

以下の表は、Geminiモデルの2026年4月時点のPay-as-you-go料金です。

| モデル | 入力(≤200Kトークン) | 入力(>200Kトークン) | 出力 | 出力(>200K) |

|---|---|---|---|---|

| Gemini 2.5 Pro | $1.25 / 1Mトークン | $2.50 / 1Mトークン | $10.00 / 1Mトークン | $15.00 / 1Mトークン |

| Gemini 2.5 Flash | $0.30 / 1Mトークン | $0.30 / 1Mトークン | $2.50 / 1Mトークン | $2.50 / 1Mトークン |

| Gemini 2.0 Flash | $0.15 / 1Mトークン | — | $0.60 / 1Mトークン | — |

Gemini 2.5 Flashは入力コストがProの約4分の1で、レイテンシも高速なため、チャットボットや大量バッチ処理ではFlashを第一候補にするのがコスト効率の面で有利です。Proは複雑な推論やコード生成など、品質が最優先のタスクに絞って使うと全体コストを抑えられます。

その他の主要課金項目は以下のとおりです。

| 機能カテゴリ | 課金モデル | 料金目安 |

|---|---|---|

| AutoML(画像) | トレーニングのノード時間あたり | 約$1.375 / ノード時間 |

| カスタムトレーニング | マシンタイプ(CPU/GPU)×時間 | マシン構成による |

| Vertex AI Pipelines | パイプライン実行ごと+リソース | 約$0.03 / 実行 |

| Vertex AI Search | クエリ数+インデックス容量 | 構成による |

| Agent Engine | ランタイム+Sessions+Memory Bank+Code Execution | 2026年1月28日〜課金開始 |

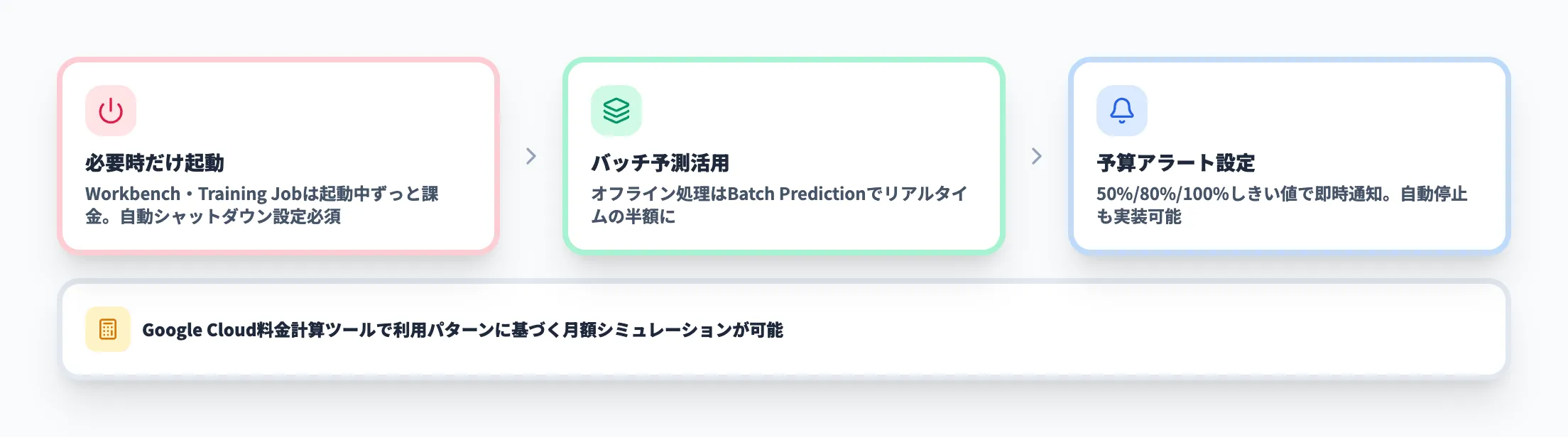

Vertex AIのコスト最適化

効率的なコスト管理のために、以下のポイントを押さえておくことが重要です。

開発環境は必要なときだけ起動する

Vertex AI WorkbenchインスタンスやカスタムトレーニングJobは起動中ずっと従量課金されます。Notebookを閉じるだけでは停止扱いにならないため、コンソールの「停止」ボタンやNotebookの自動シャットダウンを設定すべきです。

バッチ予測を活用する

レイテンシ要件が厳しくないワークロード(分析ジョブ、オフラインレポート生成など)はBatch Predictionを選ぶと大幅に節約できます。Geminiなど生成AI APIのバッチ要求は、リアルタイムリクエストの半額で利用可能です。

予算アラートを初期段階で設定する

Google Cloud BillingのBudgets & Alertsでプロジェクト単位の上限額としきい値(例: 50% / 80% / 100%)を設定すると、メールやPub/Sub経由で即時通知が届きます。予算超過時のエンドポイント自動停止やSlackへの警告投稿も実装可能です。

料金見積もりにはGoogle Cloud料金計算ツールの活用がおすすめです。実際の利用パターンに基づいて月額料金をシミュレーションできます。

必要時だけ起動 → バッチ予測活用 → 予算アラート設定の3ステップでコスト管理

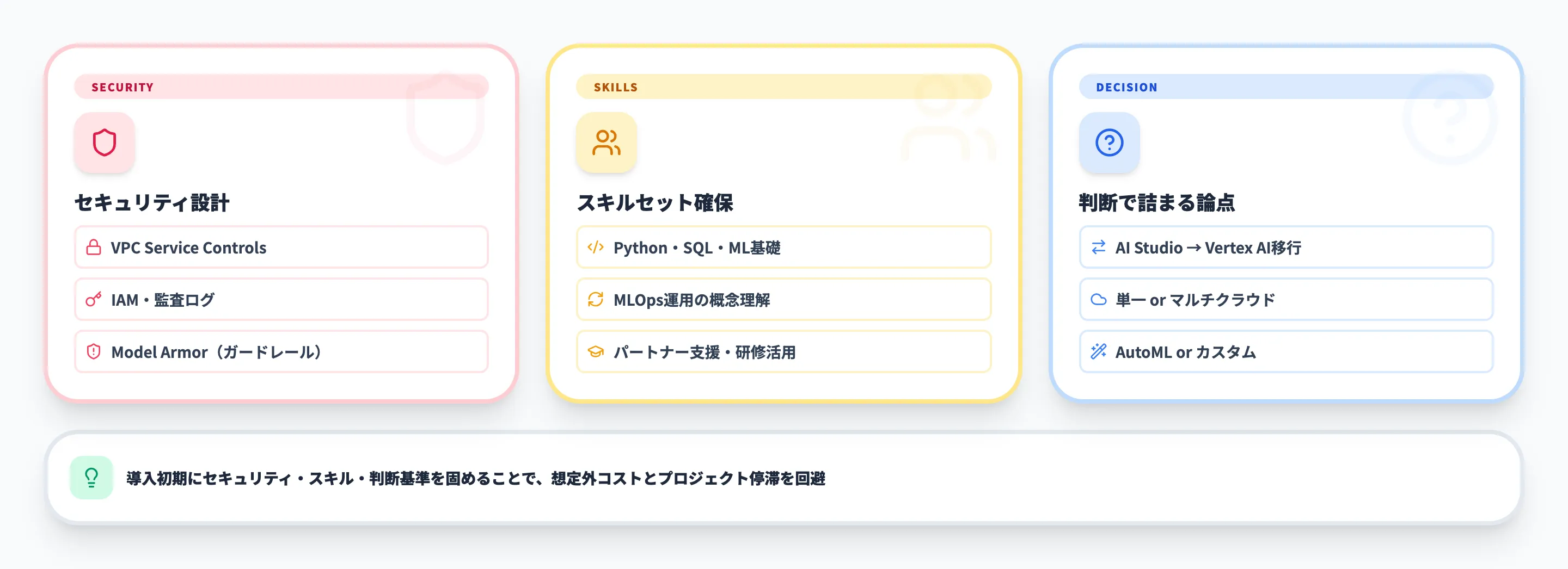

Vertex AI導入時の注意点と判断ポイント

Vertex AIは強力なプラットフォームですが、導入前に以下の点を検討しておくことで、想定外のコストやプロジェクトの停滞を避けられます。

導入初期にセキュリティ・スキル・判断基準を固めて停滞を回避

セキュリティとコンプライアンスの設計

企業の機密データを扱う以上、セキュリティ設計は導入初期に固めておく必要があります。Vertex AIが提供するVPC Service Controls(ネットワーク隔離)、IAM(権限管理)、監査ログ、そしてModel Armor(AIモデルに対するガードレール機能。プロンプトインジェクション防御・有害コンテンツフィルタリング・マルウェア検出に対応)を正しく設定・運用することが前提です。

Model Armorは、Vertex AI上のGemini generateContent呼び出しに対してプロンプトとレスポンスの保護を適用できます(2026年4月時点でプレビュー)。利用にはプロジェクトレベルでfloor settingsまたはtemplatesを明示的に設定する必要があり、floor settingsの既定はINSPECT_ONLY(検知のみ)です。組織全体の最低基準をフロア設定で定義し、リクエスト単位でテンプレートを使い分ける階層的なガバナンスが実装できます。

必要なスキルセットの確保

Vertex AIはAutoMLのようなノーコード機能から始められますが、本格的なカスタム開発やMLOps運用には専門スキルが求められます。機械学習の基礎知識、PythonとSQL、MLOpsの概念を理解した人材の確保または育成が、プロジェクトの成否を分けるポイントです。

GCPのパートナー企業による導入支援やトレーニングプログラムも提供されているため、社内にスキルが不足している場合は外部リソースの活用も検討すべきです。

Vertex AI導入判断で詰まる論点

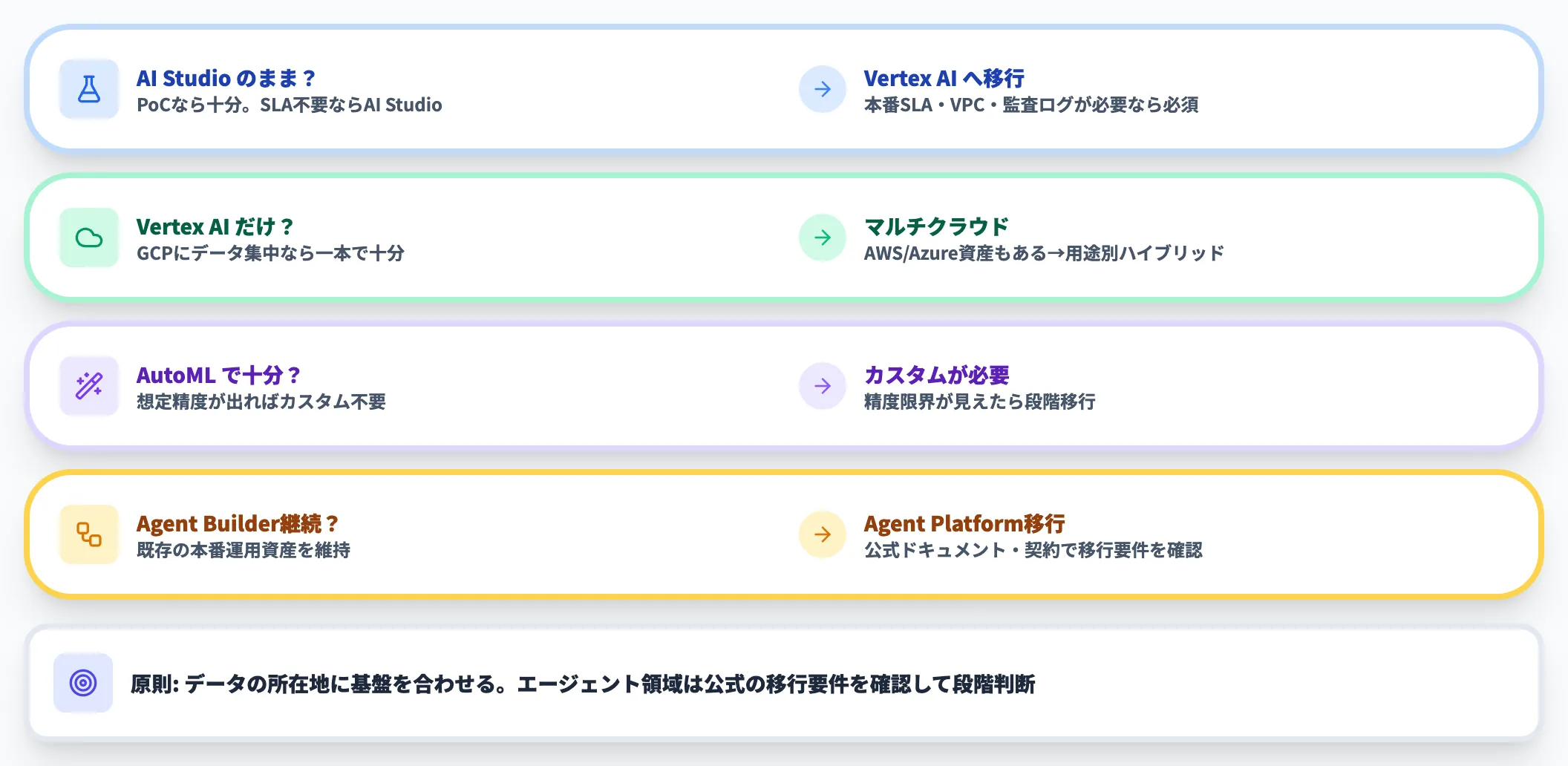

以下の4点は、導入を検討する企業が判断に迷いやすいポイントです。

- 「Google AI Studioのまま」か「Vertex AIに移行」か

PoCやプロトタイプ段階で十分ならGoogle AI Studioで問題ありません。ただし、本番環境でSLA・監査ログ・VPC隔離が必要になった時点でVertex AIへの移行は避けられません。早い段階でVertex AIに移行しておくほうが、後からの移行コストを減らせます

- 「Vertex AIだけ」か「マルチクラウド」か

GCPにデータが集中しているならVertex AI一本で問題ありません。一方、AWSやAzureにも資産がある場合は、用途別に使い分けるハイブリッド構成が現実的です。無理にどちらかに集約するよりも、データの所在地に基盤を合わせるのが原則です

- 「AutoMLで十分」か「カスタムが必要」か

AutoMLで想定精度が出るなら、あえてカスタムトレーニングに進む必要はありません。AutoMLの精度限界が見えた段階でカスタムに移行すれば、無駄なコストと時間を避けられます

- 「既存Agent Builder資産」か「Gemini Enterprise Agent Platform」か

2026年4月発表のGemini Enterprise Agent Platformは、Vertex AIのエージェント領域を統合する新しい開発基盤として位置づけられています。既存のAgent Engine / Vertex AI Search / RAG Engine / ADKをすでに本番運用している場合は、移行要件・対応リージョン・契約条件を公式ドキュメントで確認したうえで、Agent Platformに段階的に乗せ換えるか現行構成を継続するかを判断するのが現実的です

原則: データの所在地に基盤を合わせる。無理な集約より用途別の使い分け

AI開発基盤の理解を業務でのAI導入計画に結びつける

AI業務自動化ガイド

Vertex AIのようなML基盤の全体像を把握したなら、次は自社業務へのAI実装を具体的に設計するフェーズです。AI総合研究所のAI業務自動化ガイドでは、モデル選定からデプロイ、運用設計まで220ページの実践手法を提供しています。

AI開発基盤の理解を業務でのAI導入計画に結びつける

Vertex AIのようなフルマネージドプラットフォームの全体像を把握できたなら、次は自社の業務課題にAIをどう組み込むかを具体的に設計するフェーズです。モデルの選定からデプロイ、運用監視まで一貫した視点で導入計画を立てることが成功の鍵になります。

AI総合研究所では、AI基盤の評価から業務プロセスへの実装設計まで体系的にまとめた「AI業務自動化ガイド」を無料で公開しています。Vertex AIで得た技術的な理解を、実務での成果につなげるための220ページの実践ガイドです。

AI開発基盤の理解を業務でのAI導入計画に結びつける

AI業務自動化ガイド

Vertex AIのようなML基盤の全体像を把握したなら、次は自社業務へのAI実装を具体的に設計するフェーズです。AI総合研究所のAI業務自動化ガイドでは、モデル選定からデプロイ、運用設計まで220ページの実践手法を提供しています。

Vertex AIのまとめ

本記事では、Vertex AIの設計思想から主要機能、Agent Builder・Agent Engineのエージェント基盤、Gemini 2.5世代の料金体系、国内企業の活用事例、Amazon Bedrock・Azure AIとの比較、2026年4月のGoogle Cloud Next '26で発表されたGemini Enterprise Agent Platformへの進化までを、2026年4月時点の情報をもとに整理しました。

Vertex AIがもたらす実務的な価値は、大きく次の3点に整理できます。

- 統合性

ML・生成AI・エージェントの3領域を同一基盤で開発・運用でき、ツール間の連携コストを最小化できる

- データ親和性

BigQuery MLやリモートモデル連携により、GCPにデータ資産を持つ企業はデータ移動を最小化しながらAI開発を進められる

- スケーラビリティ

Google AI Studioでの無料実験からVertex AIでの本番運用まで、同じAPIとツール体系で段階的にスケールできる

AI開発基盤の選定で最も重要なのは、「どのプラットフォームが優れているか」ではなく「自社のデータとワークフローがどこにあるか」です。GCPに資産が集中している、またはBigQueryを中心にデータ分析基盤を運用しているなら、Vertex AIが最も合理的な選択肢になります。

まずはGoogle AI Studioの無料利用枠でプロンプト実験を始め、有効性が確認できたらVertex AIへ移行する段階的アプローチがおすすめです。$300の無料クレジットはVertex AIを含むGoogle Cloudサービスで利用できるため、移行後の本格検証に活用できます。