この記事のポイント

671Bパラメータ+MoEアーキテクチャで主要ベンチマーク上位の推論精度

FP8トレーニング+MTPで推論速度最大1.8倍の高速処理

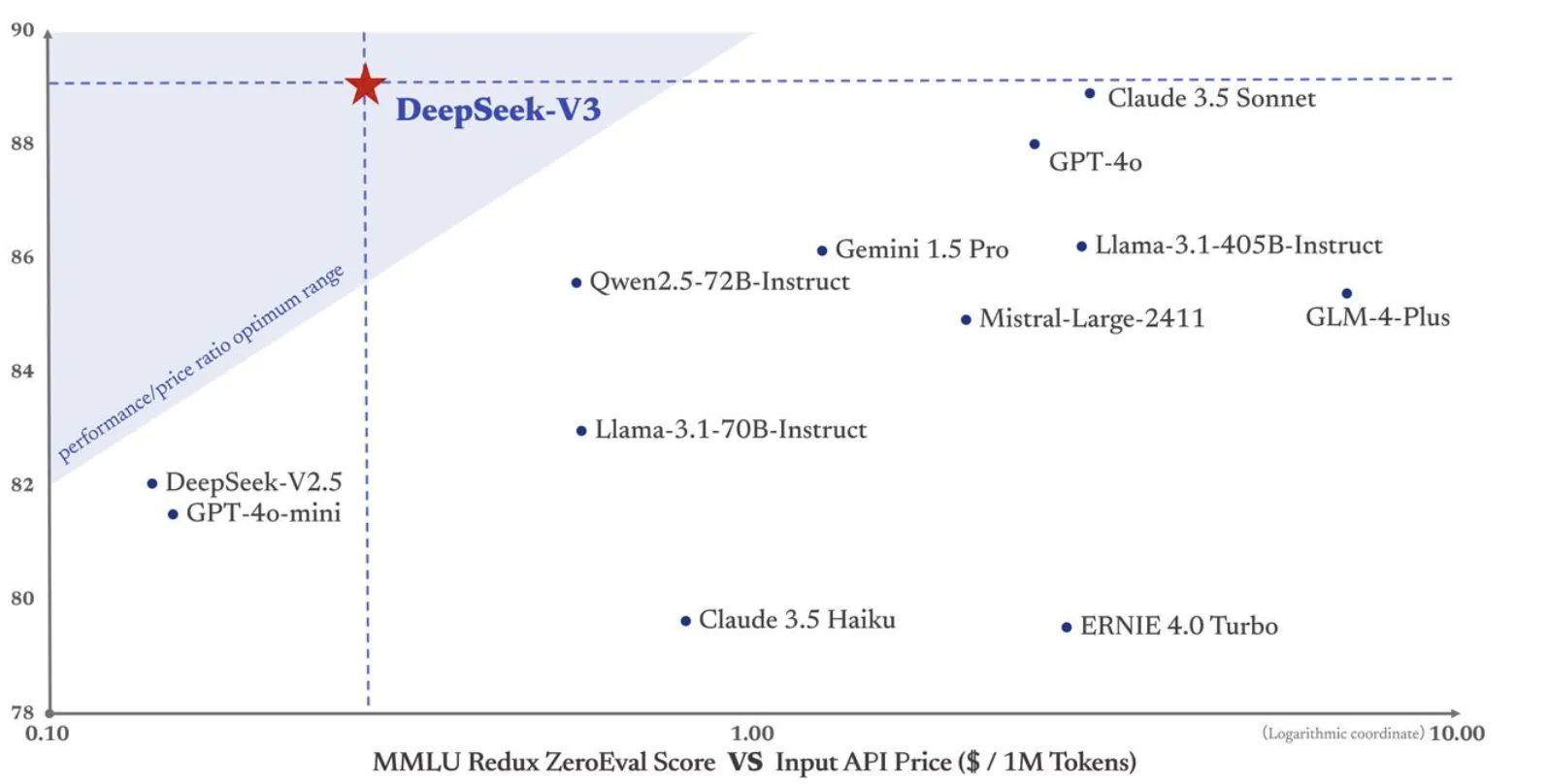

入力$0.07/1Mトークンと主要APIの数十分の一の料金設定

Webチャット・API・Ollama・VSCode拡張の4経路で即時利用可能

利用規約の中国法準拠・データ保管リスクへの事前確認が必須

Microsoft MVP・AIパートナー。LinkX Japan株式会社 代表取締役。東京工業大学大学院にて自然言語処理・金融工学を研究。NHK放送技術研究所でAI・ブロックチェーンの研究開発に従事し、国際学会・ジャーナルでの発表多数。経営情報学会 優秀賞受賞。シンガポールでWeb3企業を創業後、現在は企業向けAI導入・DX推進を支援。

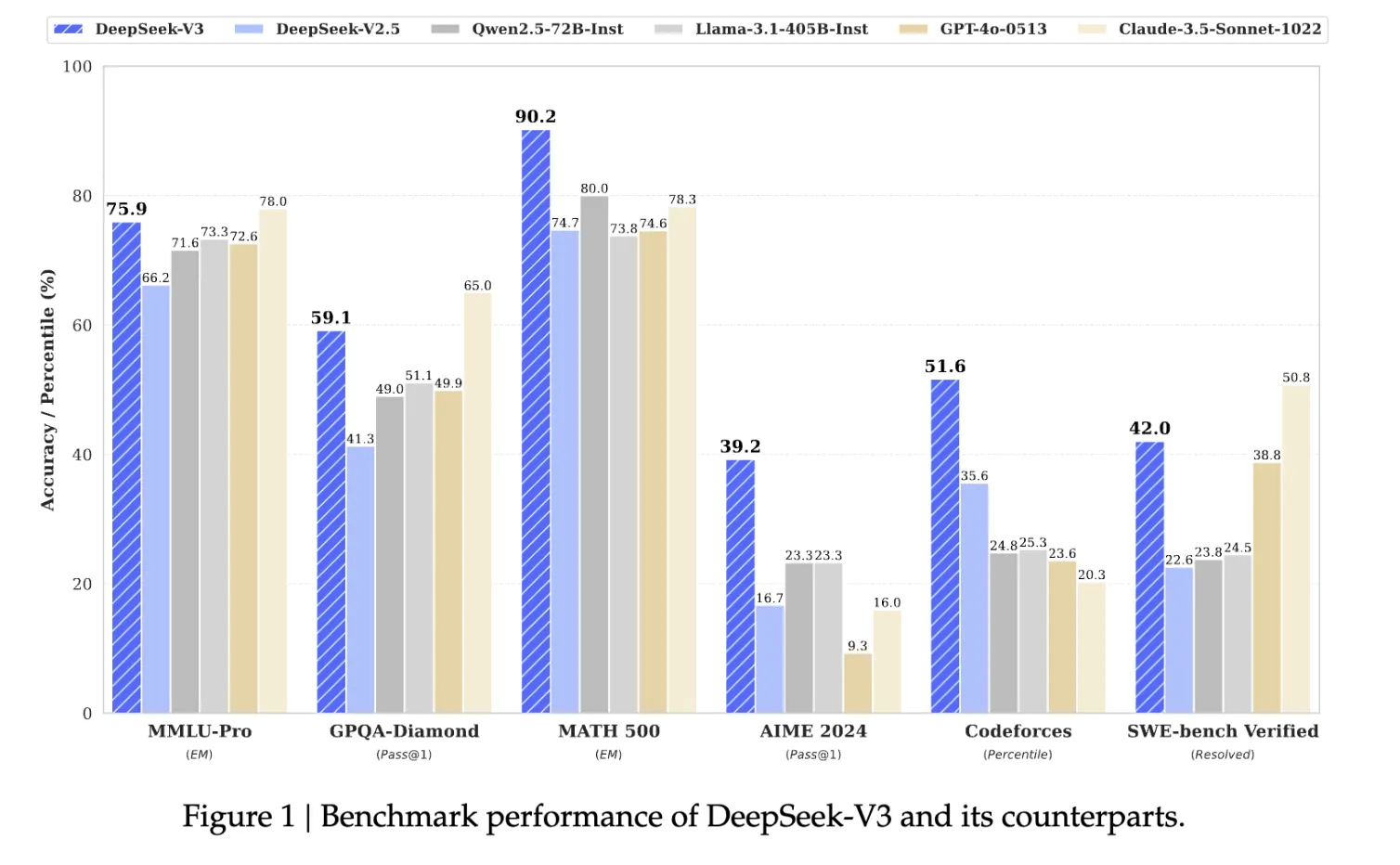

DeepSeek-V3は、671Bパラメータを持つMixture-of-Experts(MoE)アーキテクチャ採用の大規模言語モデルです。主要ベンチマークでGPT-4oやClaude 3.5 Sonnetと同等以上のスコアを達成しながら、入力$0.07/1Mトークンという低コストのAPI料金を実現しています。

この記事では、DeepSeek-V3の技術的特徴からAPI・ローカル環境での使い方、利用規約の注意点までを解説します。

目次

1. Mixture-of-Experts (MoE)アーキテクチャ

2. Multi-Token Prediction (MTP)

DeepSeek-V3とは

DeepSeek-V3は、Mixture-of-Experts (MoE) アーキテクチャを採用した最新の大規模言語モデル(LLM)です。

DeepSeek-V3は、671Bという膨大なパラメータを持ちつつ、効率的なトレーニングと推論を実現しています。

従来モデルのDeepSeek-V2で培った技術を基盤としながら、新たにAuxiliary-Loss-Free Load Balancingや Multi-Token Prediction (MTP) といった革新的な技術を搭載。

これにより、推論精度やスピードが大幅に向上しました。

【最新モデル】DeepSeek-R1が発表

2025年1月、DeepSeekシリーズの最新モデルとして、推論能力に特化した DeepSeek-R1 が発表されました。

DeepSeek-R1は、このDeepSeek-V3のアーキテクチャをベースとし、強化学習(RL)の直接適用や効率的な強化学習アルゴリズムGRPOの採用、教師あり微調整(SFT)と強化学習(RL)の組み合わせといった革新的な技術により、さらなる性能向上を実現しています。

その結果、DeepSeek-R1は、数学、コーディング、推論などのベンチマークにおいて、OpenAI-o1-1217と同等またはそれ以上の性能を達成しています。

DeepSeek-R1の詳細については、DeepSeek-R1の技術的特徴についての記事を参照してください。

DeepSeek-V3のパフォーマンス

DeepSeekトップ画面

DeepSeek-V3は、以下の技術的な革新を通じて、他のオープンソースモデルを超える性能を達成しています。

ベンチマークパフォーマンス参照:DeepSeek_V3

数学と推論

- MATH-500: 90.2%の精度を達成。

- AIME 2024: Pass@1で39.2%のスコア。

コード生成

- HumanEval: Pass@1で82.6%を記録。

- LiveCodeBench: Pass@1-CoTで40.5%を達成。

多言語対応

- 英語と中国語での複数の評価で、他モデルを上回る性能を発揮。

【関連記事】

{{https://www.ai-souken.com/article/ai-agent-overview}}

DeepSeek-V3の技術的特徴

その性能を支える技術は以下の通りです。

1. Mixture-of-Experts (MoE)アーキテクチャ

DeepSeekMoEは、複数の専門家ノードを効率的に活用し、Auxiliary-Loss-Free Load Balancing技術により計算負荷を均等化します。

これにより、性能を維持しつつ計算効率を最大化しています。

- 柔軟性の向上: 専門家の負荷を動的に調整し、タスクごとに最適な専門家を選択。

- 負荷バランス: 従来のAuxiliary-Loss手法に依存せず(補助損失なしで実現)、性能を低下させることなく計算リソースを活用。

2. Multi-Token Prediction (MTP)

一度に複数のトークンを予測するMTP技術を採用。これにより、学習信号の強化やデータ効率の向上が可能となり、推論速度も最大1.8倍に向上します。

- 効率的な学習: より多くの学習信号を生成し、データ効率を向上。

- 高速推論: 推論時に複数トークンを予測し、処理速度を大幅に向上。

3. Multi-head Latent Attention (MLA)

注意機構の計算効率を高めるMLAは、低ランク圧縮技術を活用し、必要なメモリ量を削減。従来のTransformerベースのアテンションに匹敵する性能を発揮します。

- メモリ効率: Key-Valueキャッシュを大幅に削減。

- 精度向上: 高精度なアテンションを維持しつつ、計算負荷を低減。

4. FP8トレーニング技術

低精度FP8を用いたトレーニングにより、メモリ使用量を削減しつつ計算速度を向上。これにより、大規模なモデルでも安定したトレーニングが可能となっています。

- 混合精度フレームワーク: 必要な部分のみ高精度(FP32/BF16)を使用。

- トレーニング安定性: FP8での安定したトレーニングを実現。

DeepSeek-V3の料金

DeepSeek-V3は、他のAPIサービスと比較して料金が安いことが大きな特徴です。

他APIとのコストパフォーマンス

価格の単位

- 価格は1Mトークン(100万トークン)ごとに設定されています。

- トークンはモデルが認識する最小単位で、単語、数字、句読点などが含まれます。

- モデルの入出力トークン数の合計に基づいて課金されます。

価格詳細(USD / CNY)

| モデル | コンテキスト長 | 最大出力トークン | 入力価格(キャッシュヒット) | 入力価格(キャッシュミス) | 出力価格 |

|---|---|---|---|---|---|

| deepseek-chat | 64K | 8K | $0.07 / 1Mトークン (通常価格) | $0.014 / 1Mトークン (割引価格) | $0.27 / 1Mトークン (通常価格) |

| (割引価格) | ¥0.14 / 1Mトークン (割引価格) | ¥1.10 / 1Mトークン (通常価格) |

最新の情報はDeepSeek公式料金ページから確認できます。

DeepSeek-V3の使い方

DeepSeek-V3の利用は非常に簡単で、大きく2つの選択肢があります。

それはWebチャットでの利用か、APIでの利用かです。

2つの方法について紹介します。

2種類のサービス選択

Webチャットでの利用方法

手順は以下のとおりです。

-

まずDeepSeek公式サイトにアクセスします。

-

ログインを行います。Googleアカウントでのログインも可能です。

ログイン画面

-

するとチャットUIに移行しますのであとは通常通り利用できます。

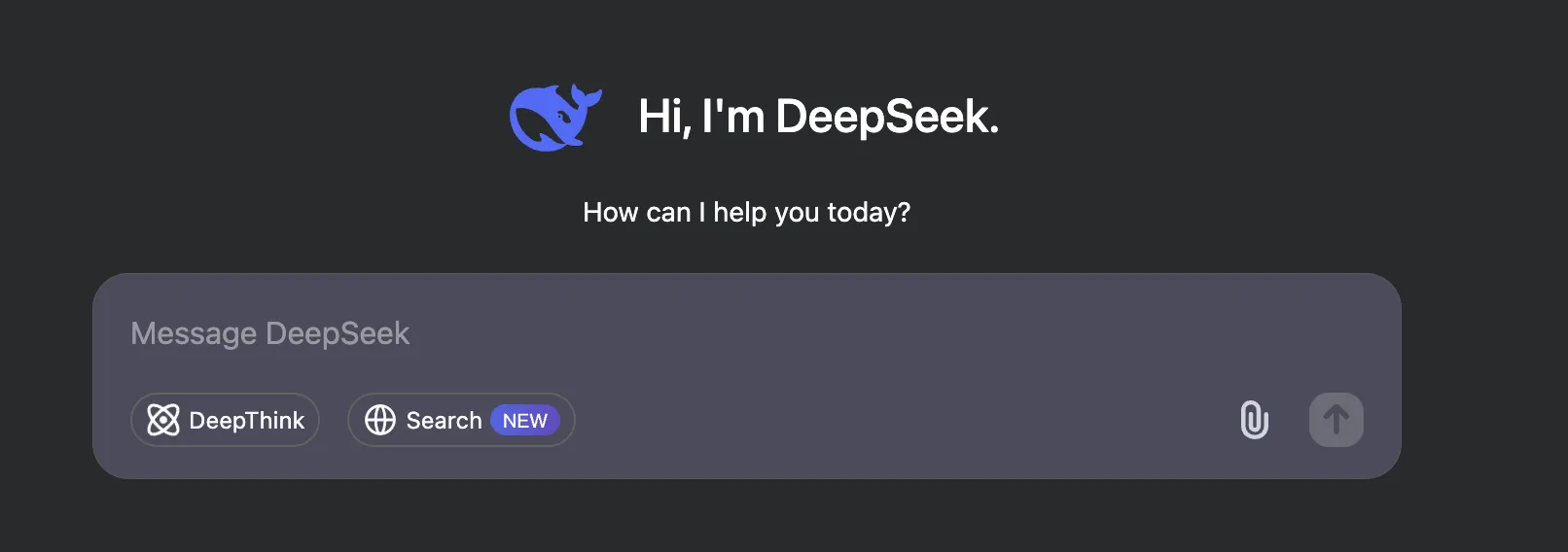

チャット画面

DeepThinkボタンで推論モードを切り替えられます。

APIでの利用方法

DeepSeekはOpenAI互換のAPIを提供しており、既存のOpenAI SDKを使用して簡単に組み込めます。

-

APIキーの取得: DeepSeekの公式ウェブサイトでアカウントを作成し、APIキーを取得します。

-

環境変数の設定: 取得したAPIキーを環境変数に設定します。

export DEEPSEEK_API_KEY=your_api_key_here

-

リクエストの送信: 以下のようなコマンドでAPIにリクエストを送信できます。

curl https://api.deepseek.com/v1/chat/completions \ -H "Content-Type: application/json" \ -H "Authorization: Bearer $DEEPSEEK_API_KEY" \ -d '{ "model": "deepseek-chat", "messages": [{"role": "user", "content": "こんにちは、元気ですか?"}] }'このコマンドは、ユーザーからのメッセージ「こんにちは、元気ですか?」をDeepSeekに送信し、応答を取得します。

VSCode拡張機能「Cline」での利用方法

Visual Studio Code(VSCode)の拡張機能「Cline」を使用して、DeepSeekを統合できます。

【関連記事】

【AI開発】VSCode拡張機能「Cline」とは?使い方やCusorとの違いを徹底解説

-

Clineのインストール: VSCodeの拡張機能マーケットプレイスから「Cline」をインストールします。

-

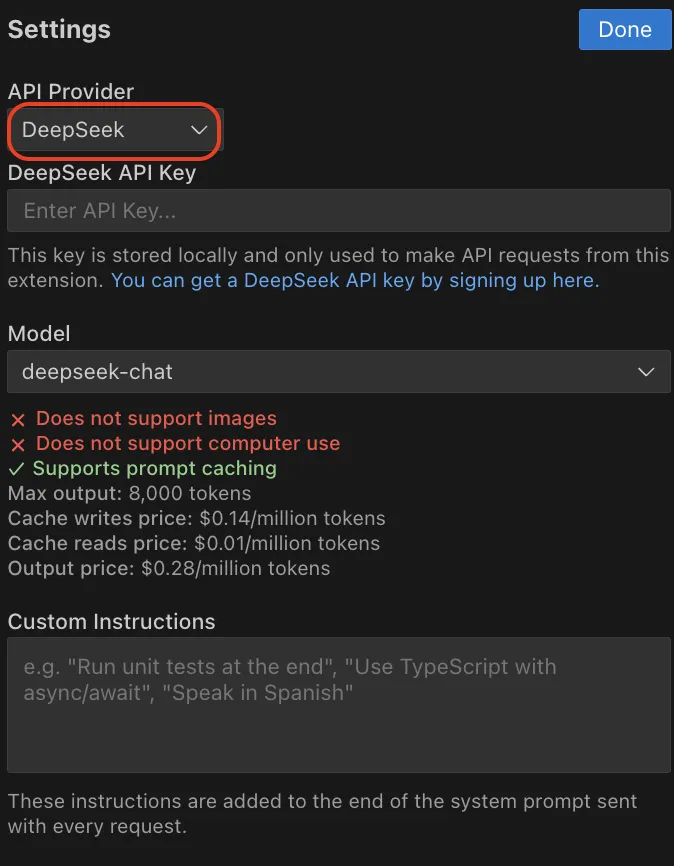

DeepSeekの設定: Clineの設定で、プロバイダーとしてDeepSeekを選択し、APIキーを入力します。

Clineでの設定

-

プロンプトの入力: VSCode上でClineを起動し、実行したいプロンプトを入力します。

例:

カレントディレクトリにあるymlファイルから、positionに関する項目を削除してください。このプロンプトにより、指定されたディレクトリ内のymlファイルから特定の項目を一括で削除する操作を自動化できます。

ローカル環境での実行手順

DeepSeekのモデルをローカル環境で実行することも可能です。特に、Ollamaなどのツールを使用してモデルをダウンロードし、コマンドラインから利用できます。

手順詳細

-

Ollamaのインストール: 公式サイト(https://ollama.com)からOllamaをダウンロードし、インストールします。

-

モデルのダウンロード: ターミナルで以下のコマンドを実行し、DeepSeekのモデルをダウンロードします。

ollama create deepseek-33b -f ./modelfileこのコマンドは、Hugging Faceのリポジトリから必要なファイルをダウンロードし、モデルを作成します。

-

モデルの実行: 以下のコマンドでモデルを起動し、対話セッションを開始できます。

ollama run deepseek-33bこれにより、コマンドライン上でDeepSeekモデルと直接対話できます。

これらの方法を活用することで、コマンドラインからDeepSeekの強力なAI機能を効果的に利用できます。

DeepSeek利用時の注意点:利用規約

DeepSeekサービスを利用する際には、以下の点に注意するべき事項があります。

DeepSeekの利用規約には、エンドユーザーや開発者を含む利用者が 不利益を被る可能性のある条項 が含まれています。サービスを利用する前に、利用規約を十分に確認し、内容を理解した上で利用することを推奨します。

特に以下の点に注意が必要です。(詳細は原文を確認してください。)

準拠法および管轄裁判所

DeepSeekのサービス利用に関する一切の紛争は、中華人民共和国の法律に準拠し、Hangzhou DeepSeek Artificial Intelligence Co., Ltd.の登録事務所の所在地(中国)の裁判所が管轄となります。

これにより、日本国内の法律や裁判所は適用されません 。

万が一、DeepSeekとの間でトラブルが発生した場合、中国の法律に基づき、中国の裁判所で手続きを行う必要があります。

日本国内の利用者(エンドユーザーおよび開発者)にとっては、言語や手続きの違い、費用負担などの面で対応が難しくなる可能性があります。

ユーザーデータの保管場所

DeepSeekサービスを利用する方(エンドユーザーおよび開発者)が入力した情報や利用履歴などのデータは、中国国内のサーバーに保管され、中国の法律に基づいて取り扱われます。

これは、日本の個人情報保護法が適用されない可能性があることを意味します。 中国の法令や基準に基づいて、データがどのように収集、利用、保管されるのか、十分に確認する必要があります。

また、データが中国国外に移転される可能性についても留意する必要があります。

DeepSeekの責任制限、保証否認、補償

- DeepSeekは、サービスの利用によってDeepSeekサービスを利用する方(エンドユーザーおよび開発者)が損害を被った場合でも、一切の責任を負いません。

- DeepSeekは、サービスの品質、適合性、信頼性などについて、明示的または黙示的な保証を行いません。

- DeepSeekサービスを利用する方(エンドユーザーおよび開発者)がDeepSeekの規約に違反したり、違法行為を行ったりした場合、DeepSeekやその関連会社に損害を与えた場合、損害を補償する義務を負う可能性があります。

これらの規定は、DeepSeekのサービス利用に伴う法的リスクを理解する上で非常に重要です。具体的には、中国の法律に基づいた不利な判決や、中国での訴訟に伴う負担、法的救済の困難さ、DeepSeekによる責任回避、保証の欠如、損害賠償の請求などのリスクが考えられます。

さらに、DeepSeekは、DeepSeekサービスを利用する方(エンドユーザーおよび開発者)の入力したデータや生成されたコンテンツを、自社のサービスの改善や開発などに自由に利用できる権利を有しています。

この点についても、プライバシーの観点から注意が必要です。

利用を考えている方は、最新の情報・利用規約の詳細含めて以下の資料を確認してください。

参考:

DeepSeek利用規約

DeepSeekプライバシーポリシー

DeepSeekオープンプラットフォーム利用規約

DeepSeek-V3の活用事例

DeepSeek-V3はすでに日本でも利用されはじめており、以下のような具体的な活用例があります。

- Deep Seek-V3 Diagram

DeepSeek-V3, diagrammed. pic.twitter.com/Tk8qKnGKtq

— Vincent Abbott (@vtabbott_) January 1, 2025

- Clineでの活用

Cline+DeepSeek-V3、もう試しましたか?

— オカムラ | 株式会社メイク・ア・チェンジ CEO (@masa_oka108) January 5, 2025

DeepSeek-V3はGPT-4oと同等がそれ以上で2月までは10倍以上安い。

私は基本Cursorを使っていますがCline+DeepSeek-V3の導入で詰まった時に聞けるプロのエンジニアが一人増えたような安心感。2ドルから使えるしコスパ抜群すぎる。 pic.twitter.com/JtXmOFnKln

- AWSのElastic Beanstalk 一式を作成

Cool Cline:3大Clineの"いいとこ取り"で誕生した最強のAIコーディングアシスタント使ってみた①

— Maki@Sunwood AI Labs. (@hAru_mAki_ch) January 6, 2025

DeepSeek V3と連携してAWSのElastic Beanstalk 一式を作成してもらった

結構いい感じな気がする。。。ただ、Roo-clineと違ってコマンドの実行は自動承認ないのでソコが結構痛い。。。 https://t.co/64wN7Sfn2v pic.twitter.com/UPmx4rhSj0

- 数学・コーディングでの活用

DeepSeek v3がほんとに強い。

— Takuma (@ikrfun) January 6, 2025

数学、コーディングがめっちゃつよい。

しかもこれローカルで(頑張れば)動くから、ネットは禁止だけど持ち込みは自由の数学テストで最強です!!!

🔗 公式サイト: https://t.co/jvWK0509Oi pic.twitter.com/XA6hYvYMUo

低コストLLMの進化を自社業務のAI導入に結びつけるなら

DeepSeek V3のような低コスト・高性能モデルの登場で、中小企業でもAI導入のハードルが大きく下がっています。

モデルのコスト構造を理解したことで、「自社でもAIを使えるのでは」という発想が生まれたなら、次は具体的な導入計画を立てる段階です。AI総合研究所のガイドでは、コスト効率を重視した業務自動化の進め方を解説しています。

AI総合研究所のガイドで、低コストAI活用の具体的な始め方をご確認ください。

低コストLLMの可能性を自社業務のAI化に結びつける

コスト効率の高いAI導入を実践解説

DeepSeek V3の低コスト・高性能を理解した次は、コスト効率の良いAI導入計画を具体化しましょう。ガイドでは業務プロセスへのAI導入を段階的に進める方法を解説しています。

まとめ

この記事では、DeepSeek-V3の基本性能から料金体系、具体的な使い方までを解説しました。

DeepSeek-V3を活用することで、以下の3つの価値が得られます。

-

671Bパラメータ+MoEアーキテクチャにより、主要ベンチマークで上位の推論精度を実現

GPT-4oやClaude 3.5 Sonnetと同等以上のスコアを達成しており、数学・コード生成・多言語処理で高い精度を発揮します。 -

入力$0.07/1Mトークンと、主要API比で大幅なコスト削減が可能

同等性能のモデルと比較して数十分の一の料金設定のため、大量のAPI呼び出しが必要なプロジェクトでもコストを抑えられます。 -

Webチャット・API・ローカル・VSCode拡張の4経路で、用途に応じた柔軟な利用が可能

個人利用からチーム開発、エンタープライズ用途まで、環境を選ばずに導入できます。

まずはWebチャットで基本性能を確認し、次にAPI経由でプロトタイプを構築、本番環境ではローカル実行やCline連携で開発ワークフローに組み込むのが効果的です。なお、利用規約の中国法準拠やデータ保管に関するリスクは事前に確認してください。