この記事のポイント

自社コードを学習に使わせたくないなら、Business(月額19ドル/ユーザー)以上が第一候補。個人プランは既定で学習オプトアウト済みだが、組織統制は弱い

著作権侵害が経営リスクの現場ではPublic Code Filter常時ON+Biz/EntのIP補償(未改変提案のみ適用)の併用が防衛線

MCP連携は強力だがデータの第三者流出口になりやすい。最小権限+人間の最終承認を原則にし、組織ポリシーで外部MCPを制御する

Copilot単体のデータレジデンシーは2026年4月時点で米国・EUの2リージョンのみ、日本リージョンはロードマップ段階で金融・医療は送信範囲限定設計が必要

全社導入は「禁止/全面解禁」の二択にせず、PoC→部門→全社の段階でポリシー・レビュー・監査ログ・教育をセットで整備する

Microsoft MVP・AIパートナー。LinkX Japan株式会社 代表取締役。東京工業大学大学院にて自然言語処理・金融工学を研究。NHK放送技術研究所でAI・ブロックチェーンの研究開発に従事し、国際学会・ジャーナルでの発表多数。経営情報学会 優秀賞受賞。シンガポールでWeb3企業を創業後、現在は企業向けAI導入・DX推進を支援。

GitHub Copilotは開発生産性を大きく押し上げる一方、企業導入ではソースコードの外部送信、生成コードの脆弱性、OSSライセンス混入、MCP連携時の権限逸脱といったセキュリティリスクが論点になります。

Business/Enterpriseプランは学習不利用が契約で明記され、IP補償も条件付きで利用できるなど、個人プランとは前提条件がまったく異なります。

本記事では、2026年4月時点の最新情報をもとに、GitHub Copilotの主なリスク、公式の保護機能、プラン別料金、機能別の注意点、データレジデンシーの現状、企業導入のステップまでを体系的に整理します。

【⚠️重要】2026年6月1日からGitHub Copilotはプレミアムリクエスト方式から従量課金(GitHub AIクレジット)方式へ移行します。詳細は【2026年6月】GitHub Copilot 従量課金移行解説をご覧ください。

目次

【重要】2026年6月1日からのGitHub AIクレジット移行

GitHub Copilot利用で想定される5つのセキュリティリスク

GitHub Copilotのプラン別セキュリティ機能と料金

GitHub CopilotのIDE・Chat・MCP連携別の注意点

GitHub Copilotの規制業界・データレジデンシー対応

GitHub Copilotの企業導入ステップ:PoC→部門→全社

Q1. GitHub Copilotは自社のコードを学習に使いますか?

Q2. 機密性の高いコードでもGitHub Copilotを使ってよいですか?

Q3. 日本リージョンのデータレジデンシーはいつ対応しますか?

GitHub Copilotのセキュリティ全体像

GitHub Copilotのセキュリティは、単体機能の設定で終わる話ではなく、契約・設定・運用の3層で組み立てるのが前提です。この章では全体像を一気に俯瞰し、以降の章で詳細に入っていきます。

3層それぞれの役割と担当領域を上図にまとめました。以降の章では「どの層で何を担保するか」を繰り返し出発点にします。

GitHub Copilotは、IDE・GitHub.com・ブラウザから入力を受け、GitHub側のプロキシを経由してモデルに渡り、結果を返すAIコーディング支援サービスです。公式ドキュメントでも明示されているとおり、自社コードがGitHub経由で外部処理されることが大前提のサービスです。

この前提のもと、企業導入で必ず問われるのは次の3点です。

-

学習ポリシー

自社コードがモデルの学習に再利用されないか

-

IP保護

公開コードとの類似による著作権・ライセンスリスクをどこまで抑えられるか

-

データ境界

機密情報・規制対象データをどの範囲まで送信してよいか

3つの論点は、プラン選定(Free/Pro/Pro+/Business/Enterprise)・組織ポリシー設定・運用ルールの3層で担保します。ツール単体ではなく、契約・設定・運用の組み合わせで決まるという構造が、本記事を通して繰り返し出てくる判断軸になります。

GitHub Copilotとは(参考:GitHub)

実務の現場では、Copilot導入方針が「セキュリティ部門の反対で全面禁止」か「現場主導で無秩序に利用」の両極端に振れるケースが多く見られます。本記事の論点を押さえておけば、適用範囲を限定して統制しつつ活用する中間解に落とし込めます。

【重要】2026年6月1日からのGitHub AIクレジット移行

GitHubは2026年4月27日、Copilot全プランをプレミアムリクエスト方式からGitHub AIクレジット制(使用量ベース請求) へ移行することを発表しました(2026年6月1日施行)。クレジット制では組織レベルでのプール運用と4階層(Enterprise/Organization/Cost Center/User)の予算管理が前提となり、ガバナンス設計の見直しも必要になります。

詳しくはGitHub Copilot従量課金への移行を徹底解説【2026年6月】で解説しています。

GitHub Copilot利用で想定される5つのセキュリティリスク

この章では、GitHub Copilotを業務で使うときに発生しうるリスクを5つに整理します。個別の機能論点は後の章で扱うので、ここでは「導入可否の判断材料になる全体像」をつかむことを目的とします。

公式資料や企業の検討会議で挙がる論点を横断的に集めると、リスクは概ね次の5つに収束します。入力側・出力側・プロセス側の3系統で見ると、対策の当て方がはっきりします。

| # | リスク | 発生経路 | 実害の例 |

|---|---|---|---|

| ① | 機密情報の外部送信 | IDE補完時のコンテキスト送信、Chatへの貼り付け | APIキー・顧客データのクラウド流出 |

| ② | 生成コードの脆弱性 | 提案コードをレビューなしで採用 | SQLi・XSS等の混入 |

| ③ | OSSライセンス侵害 | 公開コードと酷似する提案の採用 | GPL汚染・著作権侵害クレーム |

| ④ | サプライチェーンリスク | 不正パッケージの提案採用 | マルウェア混入・依存関係の汚染 |

| ⑤ | レビュー省略による品質低下 | 生成コードを過信した確認不足 | バグ流出・運用障害 |

見てわかるとおり、リスクは「入力側(①)」「出力側(②③④)」「プロセス側(⑤)」の3系統に分かれます。対策も3方向を揃える必要があり、Copilotの設定変更だけでは①②③すべてをカバーできません。

① 機密情報・APIキーの外部送信

IDEに統合されたCopilotは、カーソル周辺だけでなく、状況によっては開いている他ファイルの断片もプロンプトに取り込みます。そのため、開発者が送信を意識していないコードまでクラウドに送られ得る構造になっています。APIキーやトークンをハードコードしているファイルが開かれていると、意図せず送信対象に含まれるのが典型例です。

対策としては、シークレットを環境変数やシークレットマネージャーに分離し、GitHub Advanced SecurityのSecret Scanningなどで常時監視する運用が現実的です。

② 生成コードの脆弱性

2021年のPearceらの研究論文では、Copilot生成コードの約40%に脆弱性が含まれていたと報告されています。研究時点・特定条件下での結果ではあるものの、AI支援が生成するコードに一定割合で脆弱性が混入しうる傾向を示す代表的な実証データです。実装現場で頻出するのは、プレースホルダー不使用のSQL、入力検証なしの外部通信、旧式の暗号化アルゴリズムなどです。

Copilot単体で脆弱性をゼロにはできないため、コードレビューと静的解析(SAST)の併用が前提になります。

③ OSSライセンス侵害

Copilotは公開リポジトリで学習されたモデルを使うため、提案コードがGPL・AGPLなど特定ライセンスの公開コードと類似するケースが発生します。

類似度が一定閾値を超えると、事実上のライセンス承継義務が問われる可能性があります。Public Code Filterを有効化すれば高類似候補をブロックできますが、完全な保証ではありません。

詳細はGitHub Copilotの著作権問題で別途整理しています。

④ サプライチェーン(不正パッケージ)

攻撃者が類似名の不正パッケージ(タイポスクワッティング)をnpmやPyPIに登録し、Copilotが誤って提案するケースが観測されています。これはCopilot固有ではなくAI支援全般の共通リスクで、依存関係の導入はCopilot提案に関わらず既存のレビュー・承認プロセスに従うことが重要です。

⑤ レビュー省略による品質低下

経験が浅い開発者ほど、Copilotの提案を「GitHubが出しているのだから正しい」と誤認しがちです。実際には、提案は文脈に沿った候補であって正解ではありません。AI生成コードにも人間のコードと同じレビュー基準を適用する原則を、オンボーディング時点で明文化する必要があります。

5つに分けて見ると、Copilotの設定で対処できるのは①③の一部だけで、②④⑤はレビュー・自動検査・教育という既存プロセスで受け止める必要があります。「Copilotの設定さえ正しければ安全」という整理は誤りで、開発プロセス全体との統合設計が前提です。

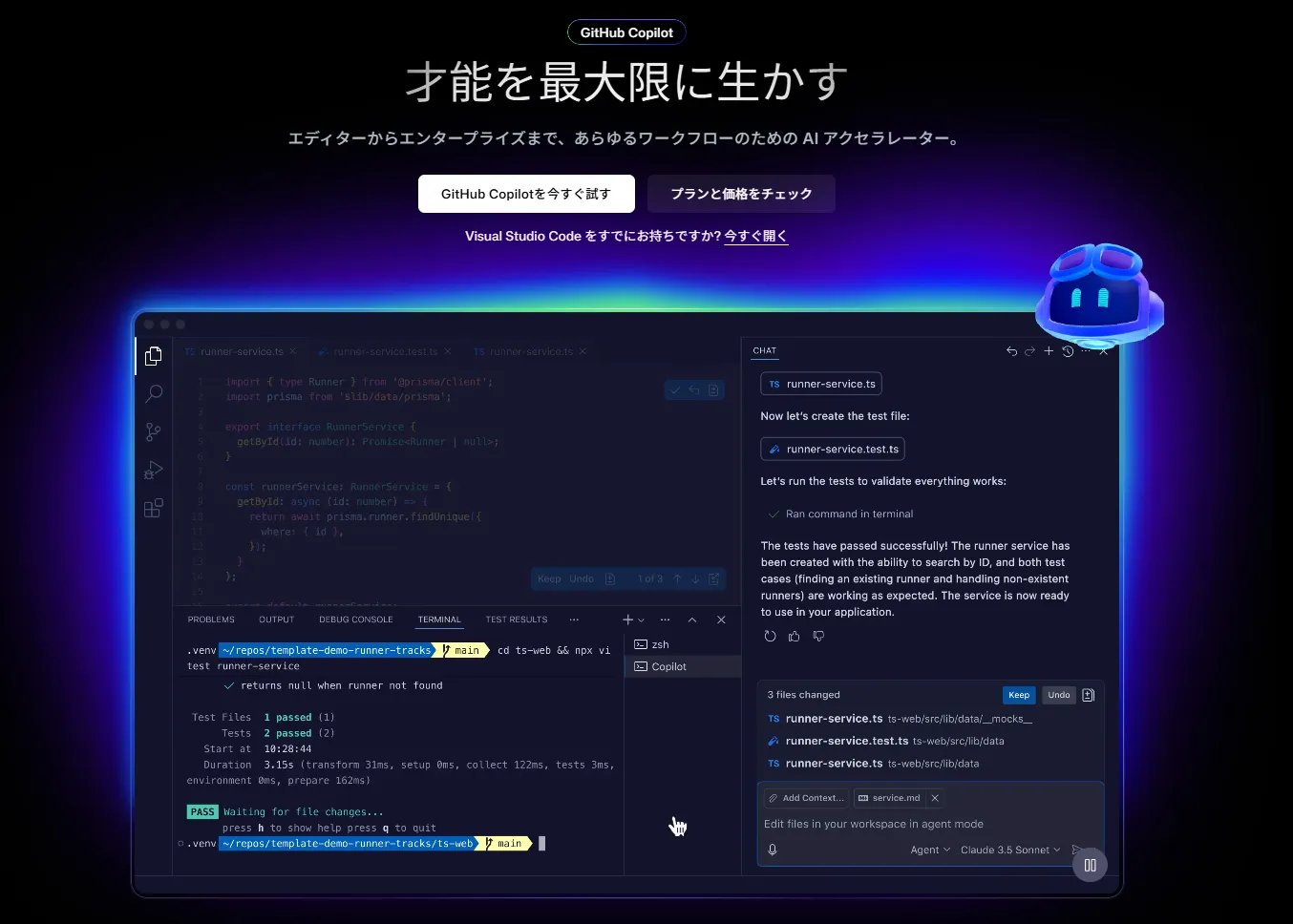

IDEにおけるGitHub Copilotコード提案のライフサイクル(参考:GitHub Resources)

GitHub Copilotのデータフローと学習ポリシー

この章では、GitHub Copilotのデータの流れと学習ポリシーを公式情報にもとづいて整理します。企業導入でまず確認される「自社コードは学習に使われるか?」に、ここで結論を出します。

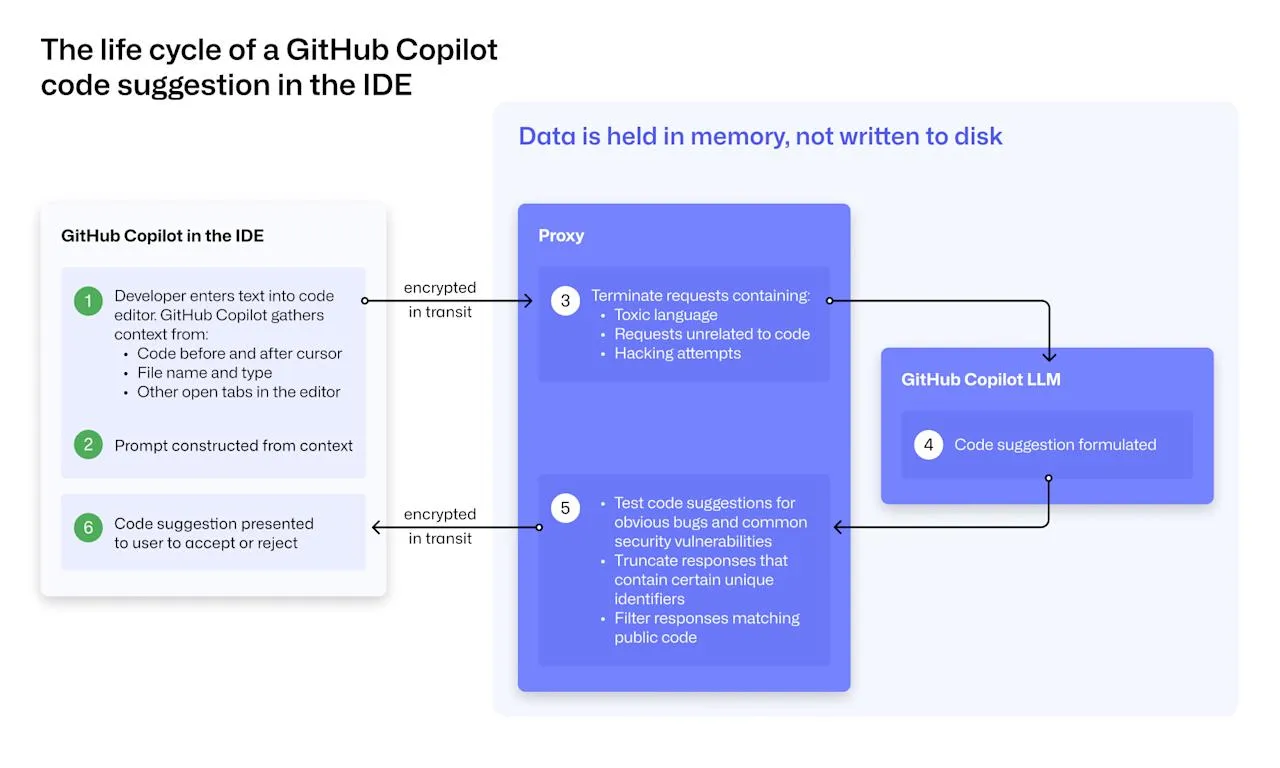

コード生成時のデータフロー

Copilotで提案が生成されるまでの流れは、概ね次の5ステップです。

-

入力コンテキストの収集

編集中ファイルのカーソル前後、同一リポジトリ内の関連ファイル、Chatに入力した自然言語などが対象になります。 -

プロンプト構築

GitHubのプロキシサーバー上でコンテキストが整形され、プロンプトが組み立てられます。 -

LLMによる推論

構築されたプロンプトがモデルに渡り、提案コードやチャット応答が生成されます。 -

ポストプロセスとフィルタ

公開コードと一致する候補をブロックするフィルタ、有害コンテンツ検出などが適用されます。 -

IDE/ブラウザへの返却

開発者が受け入れ/編集/拒否を選択します。

5ステップのうち、データ保持が発生するかどうかはプラン・機能・設定で変わります。IDE経由のCopilot Business/Enterpriseでは、プロンプトや提案はGitHub側に保存されないことが公式に明示されています。一方、Chatの対話履歴や使用状況メトリクスは一定期間保持されます。

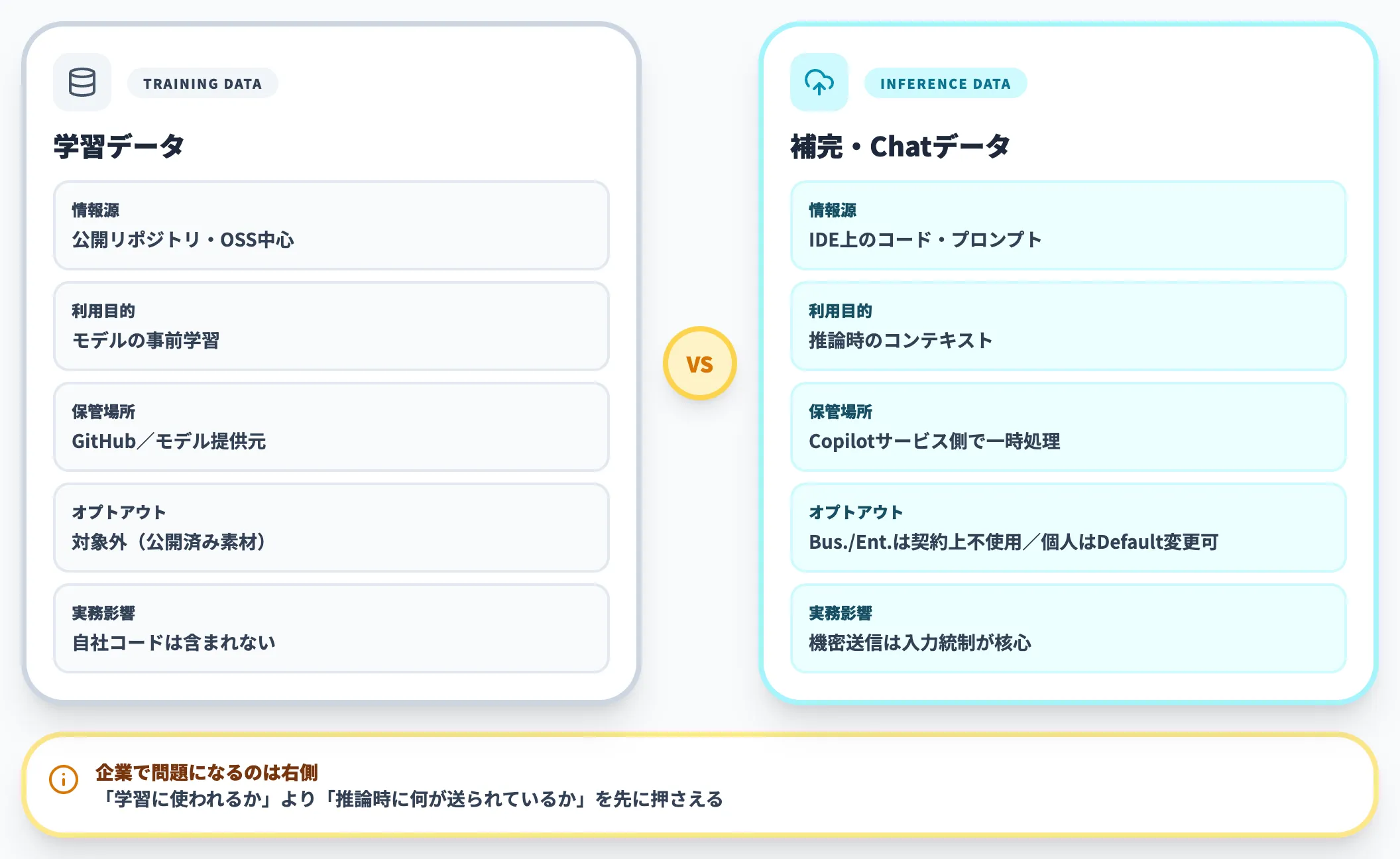

学習データと補完データは別物

Copilotで扱われるデータは、モデルの事前学習に使われるデータと補完・チャットのために入力されるデータの2系統があります。ここを混同すると議論が噛み合いません。

-

学習データ

Copilotの基盤モデルは、公開リポジトリを中心とするコードで事前学習されています。

-

補完・チャットデータ

開発者のローカルコード、プライベートリポジトリの断片、IDE内の文脈情報、Chatに入力した自然言語などが該当します。

企業利用で問われるのは後者、特に「補完・チャットデータがモデル学習に再利用されるか」が焦点です。GitHub公式はCopilot Business/Enterpriseのデータはモデル学習に使用しないと明言しており、契約条件として担保されています。

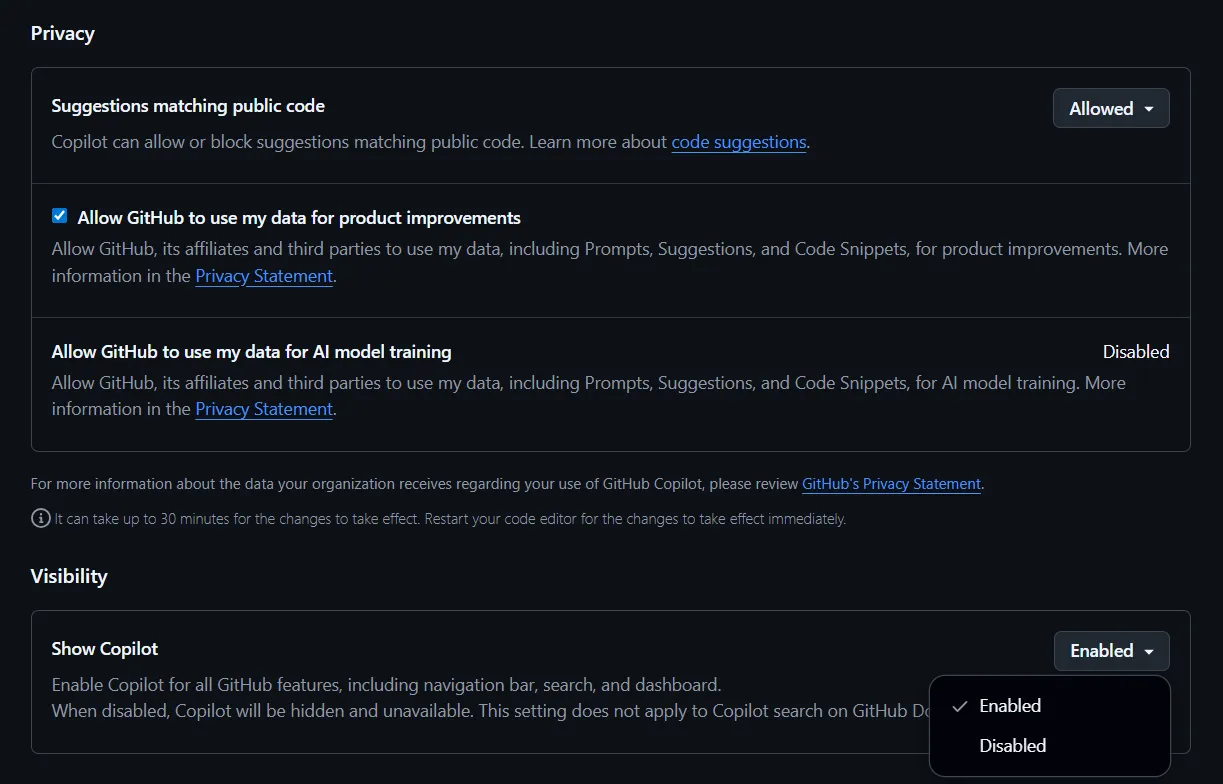

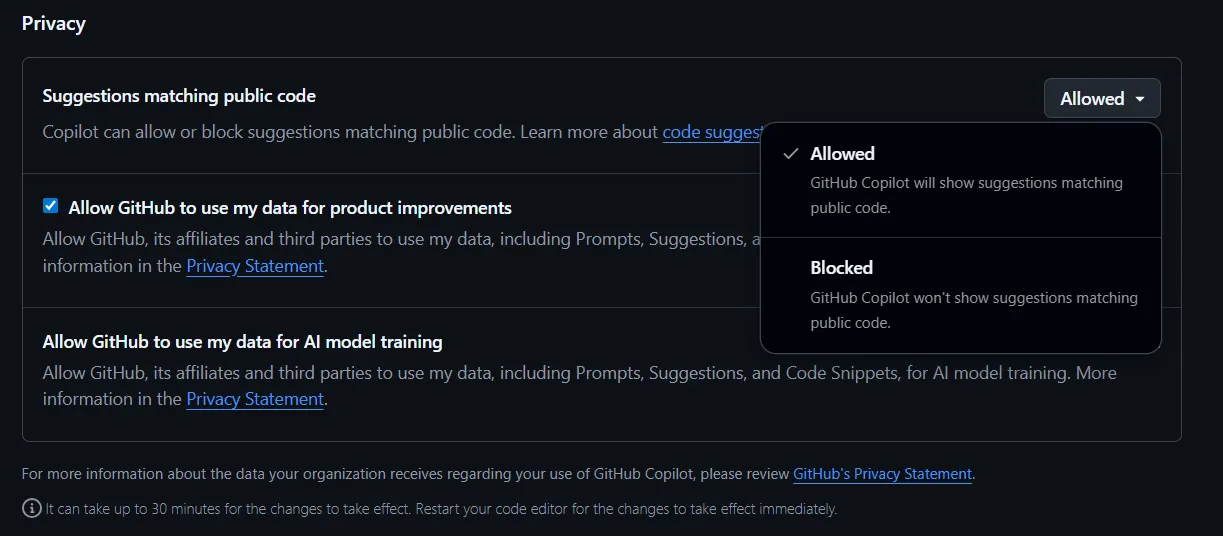

プラン別の学習再利用ポリシー

学習再利用の取り扱いは、プラン別に次のように分かれます。

| プラン | モデル学習への再利用 | 設定の粒度 | 2026年4月22日時点の既定値 |

|---|---|---|---|

| Free / Pro / Pro+ | オプトアウト可能 | 個人設定で変更可能 | 学習に使われない |

| Business / Enterprise | 契約上使用しない | 組織ポリシーで一括管理 | 学習に使われない |

ここで注目すべきは、Business/Enterpriseが「契約上」担保される点です。個人プランは設定で変更可能ですが、Business/Enterpriseは契約書(DPA:Data Protection Agreement)に非使用が明記されるため、監査やコンプライアンス審査で根拠として示せます。法務・セキュリティ部門の同意を取り付けるには、プラン選定時点でBusiness以上が事実上の前提になります。

データの保持期間

Copilotが扱うデータは、種類ごとに保持期間が異なります。代表的な項目を整理します。

-

IDE経由のプロンプト・提案(Business/Enterprise)

保持されません。

-

Copilot Chatの対話履歴

経路・機能により異なり、一定期間の保持が発生するケースがあります。

-

使用状況メトリクス(last_activity_atなど)

90日のローリング保持で、それ以降にアクティビティがなければ nil にリセットされます。

-

エンゲージメントデータ

最大2年程度の保持になる場合があります。

保持期間の差は、**「いつ削除依頼を出せば原状に戻せるか」**に直結します。GDPR等の削除要求を想定するなら、保持期間の長い項目(エンゲージメントデータ等)を先に把握しておくのが実務上の定石です。

GitHub Copilotの設定(参考:GitHub)

GitHub公式が提供するセキュリティ機能

この章では、GitHubが公式に提供するセキュリティ機能を整理します。前章の契約面のポリシーに加えて、実際に有効化すべき技術的な保護機能がどこまで揃っているかを押さえます。

主要な保護機能の一覧

代表的な6つの機能を先に並べます。プラン別の対応は次章で整理します。

-

Public Code Filter(公開コード一致フィルタ)

提案と公開コードを比較し、高類似度の候補をブロックします。OSSライセンス混入の第一防衛線です。

-

IP Indemnity(知的財産補償)

Business/Enterprise契約下で、Public Code Filter有効化かつ未改変の提案を採用した場合に限り、GitHubが提供するIP indemnificationに基づいて著作権侵害クレームへの防御が受けられます(MicrosoftのCopyright Commitmentを参照する形でも整理されています)。プランに加入するだけで全生成物に自動適用されるわけではない点に注意が必要です。

-

Content Exclusions(コンテンツ除外)

特定ファイル・リポジトリを提案対象から外すBusiness/Enterprise向けの機能です。公式ドキュメントで明示されているとおり、適用範囲はインライン補完と一部のChat/Code Reviewに限られ、CLI・Copilot cloud agent・IDE Agent modeには効きません。

-

Secret Scanning連携

GitHub Advanced SecurityのSecret Scanningと組み合わせ、APIキー・トークン等の誤コミットを事前検知できます。

-

Dependabot連携

依存関係の脆弱性を継続監視し、アップデート提案を出します。Copilotが提案した新規依存関係にも適用されます。

-

監査ログ(Audit Log)と利用状況レポート

監査ログはBusiness/Enterpriseいずれでも利用でき、Copilot関連の設定変更・ポリシー変更・ライセンス(シート)付与と剥奪、GitHub Web上で動作するエージェント活動を記録します。一方で、IDEやCLIでのローカル利用、ユーザーが送ったプロンプト本文(client session data)は監査ログの対象外です。利用状況の把握は、管理者向けのuser activity data/利用状況レポートや集計メトリクスで補完する建て付けになっています。Enterpriseではエンタープライズアカウント全体での集約や外部ログ基盤へのストリーミングも利用可能です。

前章の5大リスクに照らすと、機能で潰せるのは①(Secret Scanning)③(Public Code Filter+IP補償)④(Dependabot)までです。②と⑤は機能では解決できず、人間のレビューと自動検査の運用で受け止めるしかありません。

IP補償プログラムの適用条件

IP Indemnityは「有効化すれば万全」ではありません。明確な3条件を満たしたときのみ補償が成立します。

- Business/Enterprise契約下で利用していること

- Public Code Filterを有効化していること

- Copilotからの提案を未改変で採用した場合

改変した提案は補償対象外です。実務では、Public Code Filterを常時ON運用にしたうえで、重要プロジェクトでは採用した提案を採否ログとして残しておくと、後から適用条件を立証しやすくなります。

3条件がすべて揃った場合のみ補償が成立することを上図に整理しました。運用ルールの設計と採否ログの保存が、そのまま補償の立証性に直結します。

類似度を持つ候補を検出・ブロックするフィルタ(参考:GitHub)

テレメトリと利用ログの扱い

管理者向けには、Copilot usage metrics(シート割当・アクティビティ等)が提供されます。代表的な項目は次のとおりで、90日のローリング保持が公式ドキュメントに明示されています。

| 項目 | 内容 |

|---|---|

| last_activity_at | ユーザーがCopilotを最後に利用した日時 |

| 保持期間 | 90日(ローリング) |

| 90日経過後 | 新たな利用がなければ nil にリセット |

テレメトリはセキュリティ教育の普及状況把握、ライセンス有効活用度の評価、不審利用パターンの検知などに使えます。ただし閲覧権限・保存期間・二次利用は、社内のプライバシーポリシーや監査要件と整合する形で設計する必要があります。特に「誰がどのプロジェクトで使ったか」はセンシティブな情報なので、人事評価への流用は避けるべきです。

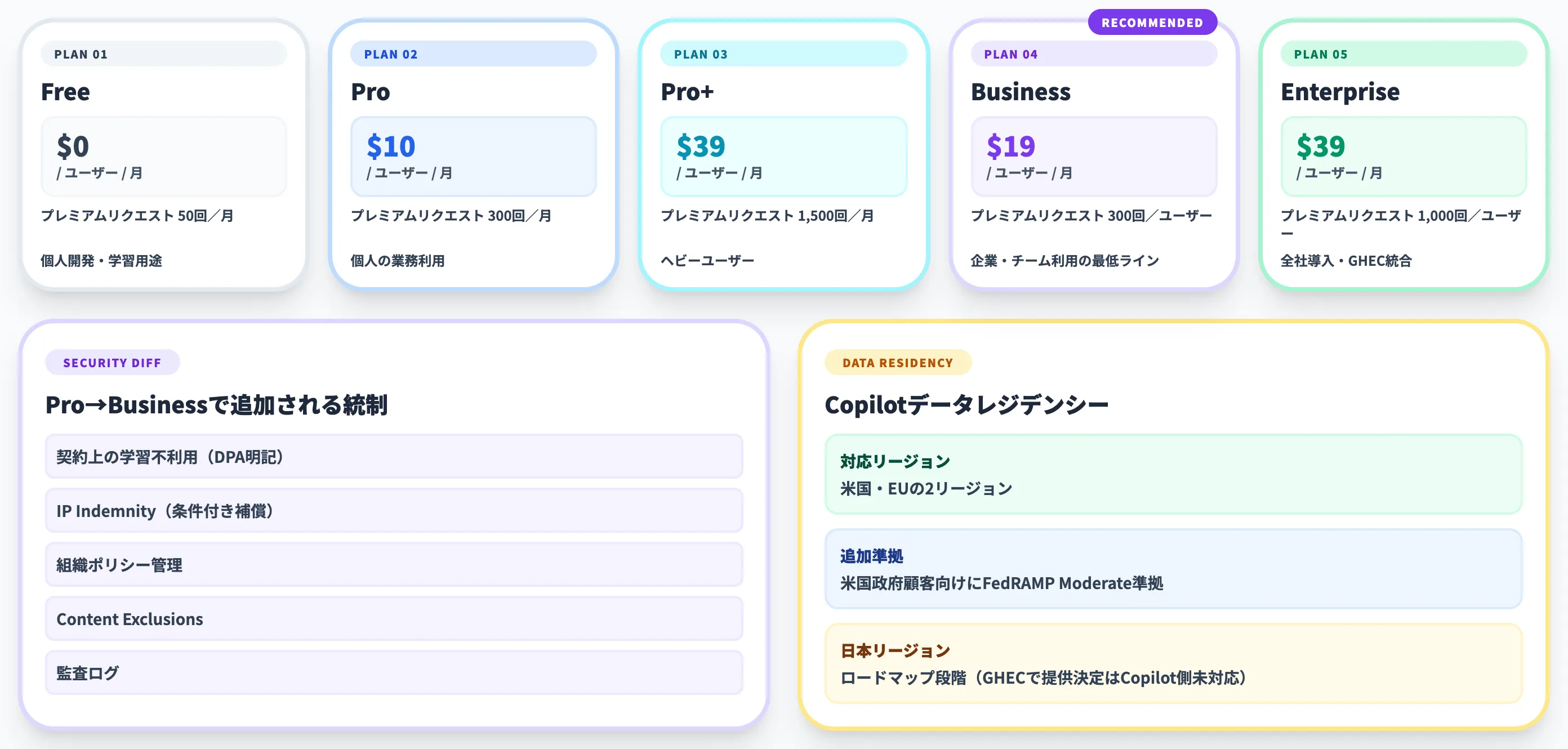

GitHub Copilotのプラン別セキュリティ機能と料金

この章では、GitHub Copilotの主要プランをセキュリティ機能と料金の両面で比較します。企業導入ではBusiness以上が事実上の前提ですが、PoC時点のプラン選定で迷うケースが多いため、判断基準をここで揃えます。

プラン体系と月額料金

GitHub Copilotは2026年4月時点で、個人向けにFree/Pro/Pro+、Student、組織向けにBusiness/Enterpriseが提供されています。本記事では**企業導入で比較対象になりやすい主要5プラン(Student除く)**を扱います。価格はすべて1ユーザー月額で、組織向けは公式Docs上は月次課金として案内されています。最新の全プラン一覧はGitHub Copilot公式プランページで確認できます。

なお、2026年4月22日時点でPro/Pro+/Studentは新規申込が一時停止中です(公式プランページで案内)。新規にCopilotを導入する場合、個人利用はFree、組織利用はBusiness/Enterpriseが実質的な選択肢になります。

| プラン | 月額料金 | プレミアムリクエスト | 主な想定ユーザー |

|---|---|---|---|

| Free | 0ドル | 50回/月 | 個人開発・学習 |

| Pro | 10ドル | 300回/月 | 個人の業務利用 |

| Pro+ | 39ドル | 1,500回/月 | ヘビーユーザー |

| Business | 19ドル/ユーザー | 300回/ユーザー | 企業・チーム利用 |

| Enterprise | 39ドル/ユーザー | 1,000回/ユーザー | 全社導入・Enterprise Cloud |

価格注記:2026年4月時点。プレミアムリクエストの追加購入は1回0.04ドルです。最新情報はGitHub Copilot公式プランページで確認してください。詳細比較はGitHub Copilotの料金プラン一覧でも扱っています。

プラン別セキュリティ機能マトリクス

料金の差を「何が使えるか」で見ると、企業導入で重要な分岐はBusinessの19ドルラインに集約されます。

| セキュリティ機能 | Free | Pro | Pro+ | Business | Enterprise |

|---|---|---|---|---|---|

| データの学習不利用 | 既定(設定変更可) | 既定(設定変更可) | 既定(設定変更可) | 契約上保証 | 契約上保証 |

| Public Code Filter | ○ | ○ | ○ | ○ | ○ |

| IP Indemnity(補償) | × | × | × | ○ | ○ |

| 組織ポリシー管理 | × | × | × | ○ | ○ |

| Content Exclusions | × | × | × | ○ | ○ |

| 監査ログ | × | × | × | ○ | ○ |

| データレジデンシー(US/EU) | × | × | × | △ | △ |

際立つのは、Business = 19ドルでIP補償と組織統制が一括で付いてくる価格対効果です。BusinessとProの差額9ドルは、そのままIP補償・ポリシー管理・監査対応のコストと見なせます。Proで統一して月額を抑えるケースもありますが、IP補償とポリシー統制を外部契約で担保するコストを考えるとBusinessに揃えたほうが総コストは下がることがほとんどです。

なお、データレジデンシーはCopilotの席プラン単体ではなく、テナント側のGitHub Enterprise Cloud with data residency構成によって決まります。GHEC with data residencyを導入したテナント上でCopilot Business/Enterpriseいずれかの席プランを選ぶ形が公式の整理で、2026年4月13日以降は米国・EUの2リージョン対応、米国政府顧客向けにFedRAMP Moderate準拠となりました(日本リージョンはロードマップ段階)。Enterpriseプランに入れば自動的に日本でデータレジデンシーが効く、という理解は誤りなので、計画段階で構成を分けて確認する必要があります。

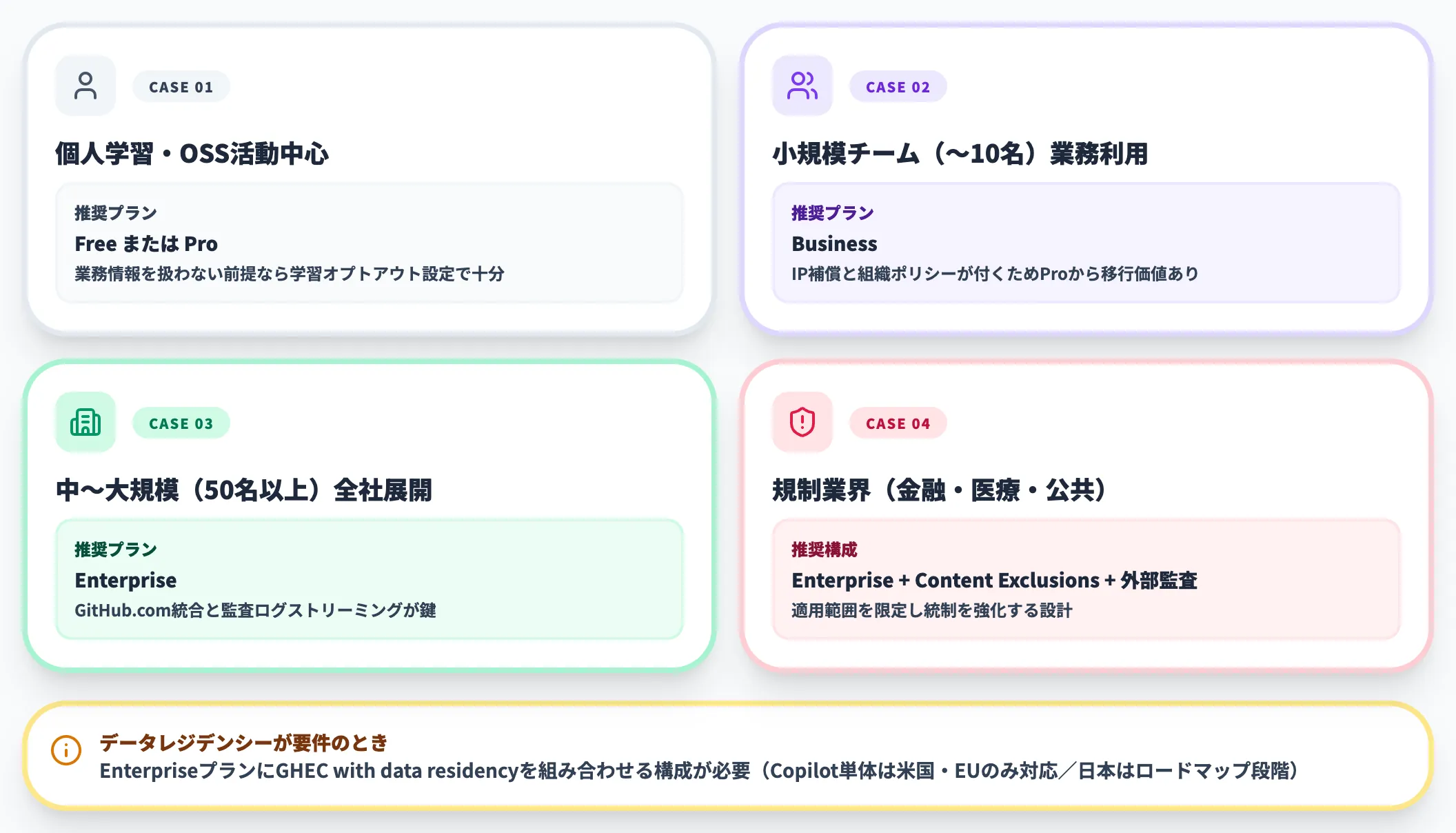

ケース別のプラン選定

導入支援の現場で判断軸にしている選定基準を整理すると、次の4パターンに集約されます。

-

個人学習・OSS活動中心

FreeまたはPro。業務情報を扱わない前提なら学習オプトアウト設定だけで十分です。

-

小規模チーム(〜10名)で業務利用

Business一択。IP補償と組織ポリシーが付くため、ライセンス費用を払ってでもProから移行する価値があります。

-

中〜大規模(50名以上)で全社展開

Enterprise。GitHub.com統合と監査ログストリーミングがロックイン要素になります。データレジデンシーが要件なら、加えてGitHub Enterprise Cloud with data residencyを組み合わせる構成が必要です。

-

規制業界(金融・医療・公共)

Enterprise+Content Exclusions+外部監査の組み合わせを前提に設計します(後の章で詳述)。

導入判断で詰まりやすいのが、「Pro 10ドル × 20名」と「Business 19ドル × 20名」の比較です。見かけ上は月額180ドルの差ですが、IP補償・組織ポリシー・監査ログの代替コストを考えればBusinessのほうが確実に安く付きます。業務で扱うコードが1行でも流れる可能性があるなら、BusinessからスタートするのがSIerとしての一貫した推奨です。

プラン別の機能詳細はGitHub Copilot BusinessおよびGitHub Copilot Enterpriseで個別に扱っています。

GitHub CopilotのIDE・Chat・MCP連携別の注意点

この章では、Copilotの主要機能ごとにセキュリティリスクの性質を分け、それぞれに必要な運用ルールを整理します。同じCopilotでも、インライン補完/Chat/ツール連携ではリスクの発生源も対策も異なるため、機能別に見る必要があります。

IDE補完で起きる情報露出

IDE統合のCopilotは、カーソル周辺のコードだけでなく、状況により開いている他タブの断片やリポジトリ内の関連情報もコンテキストとして送信します。開発者が意識していない周辺コンテキストも送信対象になり得ます。

代表的なリスクは次のとおりです。

- APIキー・トークンを含むコードが開かれた状態で補完を実行する

- 脆弱なコードや旧式の暗号化アルゴリズムを含む提案を採用する

- 類似名の不正パッケージを依存関係に追加してしまう

これに対する実装側の対策は以下のとおりです。

- シークレットは直書きせず、環境変数やシークレットマネージャーで管理する

- 生成コードはコードレビューと静的解析(SAST)を通す

- Public Code Filterを有効化する

- 機密リポジトリではContent Exclusionsで除外設定を追加する(適用範囲はインライン補完・一部のChat/Code Reviewに限られ、CLI・Copilot cloud agent・IDE Agent modeには効かない点に注意)

IDE補完は「便利すぎる」ことが最大のリスクです。送信内容を毎回レビューするのは非現実的なので、「送信されても困らない状態」をコードベース側で保つ運用にするほうが事故が減ります。

Copilot Chatでの入力統制

Copilot Chatは自然文で詳細が書きやすいため、入力内容の統制が重要になります。実務で頻発する危険パターンは次のようなものです。

- 顧客リストやログを丸ごと貼り付けて「このエラーの原因を教えて」と聞く

- 社内システムのアーキテクチャ図やインシデント詳細をそのまま流す

- 個人情報を含むテストデータを例として使う

これらを避けるには、情報分類(個人情報・営業機密・認証情報など)に基づいて「送信してよい情報/避ける情報」を明文化し、必要に応じて匿名化・マスキングの運用にするのが現実的です。詳細はGitHub Copilot Chatで整理しています。

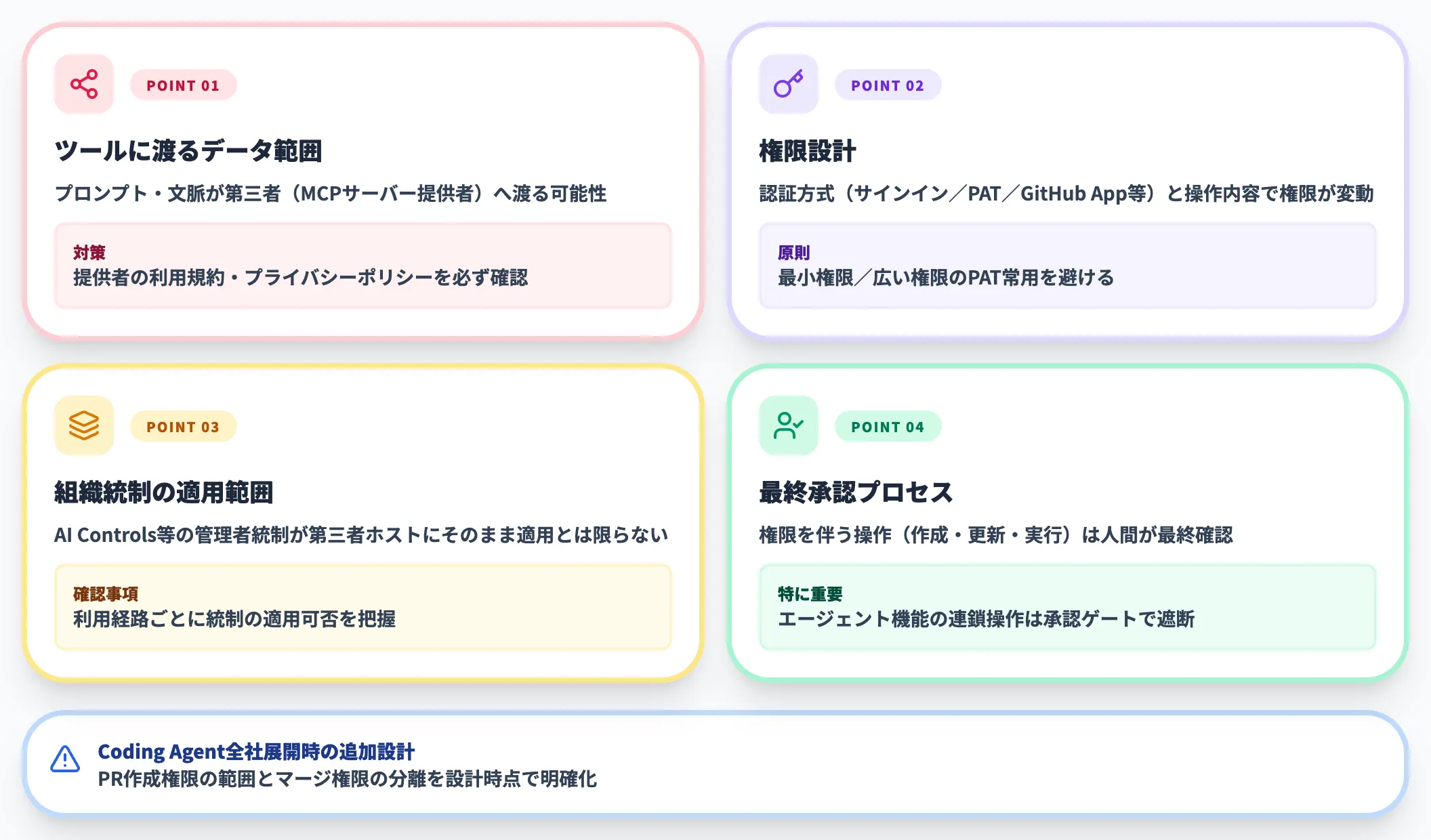

MCP連携で押さえるべき4点

2025年9月24日、GitHubは公式ChangelogでCopilot Extensions(GitHub Appベース)の非推奨化とMCP(Model Context Protocol)への統合方針を告知し、Developer Policyにも反映しました。旧Extensionsは2025年11月10日にサンセットされ、2026年4月時点でMCPがCopilot外部連携の主要プロトコルになっています。

MCPを使うとCopilotから外部ツールやデータソースにアクセスできるようになりますが、どのデータがどこに渡り、どの権限で操作できるかが論点になります。

-

ツールに渡るデータ範囲

プロンプトや文脈が第三者(MCPサーバー提供者)に渡る可能性があります。提供者の利用規約・プライバシーポリシーを必ず確認します。

-

権限設計

GitHub MCP Serverの権限は、認証方式(サインイン/PAT/GitHub App等)や操作内容で変わります。原則は最小権限で、広い権限のPATを常用しないことが重要です。

-

組織統制の適用範囲

CopilotのAI Controls等の管理者コントロールは、第三者ホストアプリ上のMCP利用にそのまま適用されるとは限りません。利用経路ごとに統制の適用範囲を確認します。

-

最終承認プロセス

権限を伴う操作(作成・更新・実行)は、人間が最終確認する運用が前提になります。特にGitHub Copilot Coding Agent等のエージェント機能は自律的に複数操作を連鎖させるため、承認ゲートの設計が事故防止に直結します。

エージェント機能を広げるほど、権限の連鎖が長くなります。全社展開する場合は、PR作成権限の範囲とマージ権限の分離を設計時点で明確にしておくべきです。

GitHub Copilotの規制業界・データレジデンシー対応

この章では、金融・医療・公共など規制要件が厳しい業界での導入論点を整理します。一般的な企業ガバナンスに加えて、データ所在地要件とクラウド利用制限が追加の論点になります。

日本リージョンでのデータレジデンシー現状

GitHubはGitHub Enterprise Cloud with Data Residencyとして、特定リージョンでコード・リポジトリデータを保持するオプションを提供しています。2025年12月18日にはGitHub Enterprise Cloud全体の日本リージョン対応が一般提供になりました。

ただし、GitHub Copilot単体のデータレジデンシーは2026年4月時点で米国・EUの2リージョンのみが対応済みで、加えて米国政府顧客向けにFedRAMP Moderate準拠のCopilotが提供されています(公式changelog)。日本・オーストラリア等のリージョンはロードマップ段階です。

| 対象 | 日本リージョン対応状況 |

|---|---|

| GitHub Enterprise Cloud(リポジトリデータ) | 2025年12月18日に一般提供 |

| GitHub Copilot(推論・関連データ) | 2026年4月時点で未対応。ロードマップで計画中 |

「リポジトリは日本に置けるが、Copilotの推論は米国/EUを経由する」という区分が現時点の実態です。金融・医療で「Copilotを含めて日本完結」を要件とする場合は、Copilotの日本GAを待つか、Copilotの適用範囲を非機密コードベースに限定する選択になります。

日本リージョンでのData Residency一般提供(参考:GitHub Blog)

規制業界で確認すべきチェック項目

規制業界でGitHub Copilotの採否を評価する際、典型的に問われる項目は次のとおりです。

- データ所在地要件(日本/EU等)を満たせるか、または要件を緩められる余地があるか

- 個人データ・機微情報をクラウド送信してよい区分があるか

- モデル学習への再利用禁止が契約(DPA)上で担保されているか

- MCP/第三者連携でデータが第三者へ共有され得る範囲

- FedRAMP等の第三者認証要件をGitHubが満たしているか

規制対応の実務ポイントは、機能説明よりも**「どのデータが、どの国・どの委託先・どの契約条件で処理されるか」を説明できる状態**を整えることです。導入時点で対象データを分類し、例外(持ち出し禁止・外部共有禁止など)を具体例で定義しておくと、現場判断の揺れや監査時の説明コストを抑えられます。

機密情報・個人情報の取り扱い

機密情報・個人情報をCopilotに送らないことは、ほぼすべての企業で共通する原則です。実務では次のような対策を組み合わせます。

- Copilotを使う環境では生の顧客データ・個人情報を扱わない

- ダミーデータや匿名化データを使う

- GitHub Advanced SecurityのSecret ScanningやDLPソリューションを併用する

- 貼り付け前に情報分類を確認する運用をチェックリスト化する

実務では「送らない」を徹底するだけでなく、送信が発生し得る前提で「貼り付け前に一呼吸置ける仕組み」を作ることが効きます。ログや設定値は最小限に切り出し、識別子や数値はマスキングしたうえで再現に必要な情報だけに絞る運用にすると、利便性を落とさずに事故を減らせます。

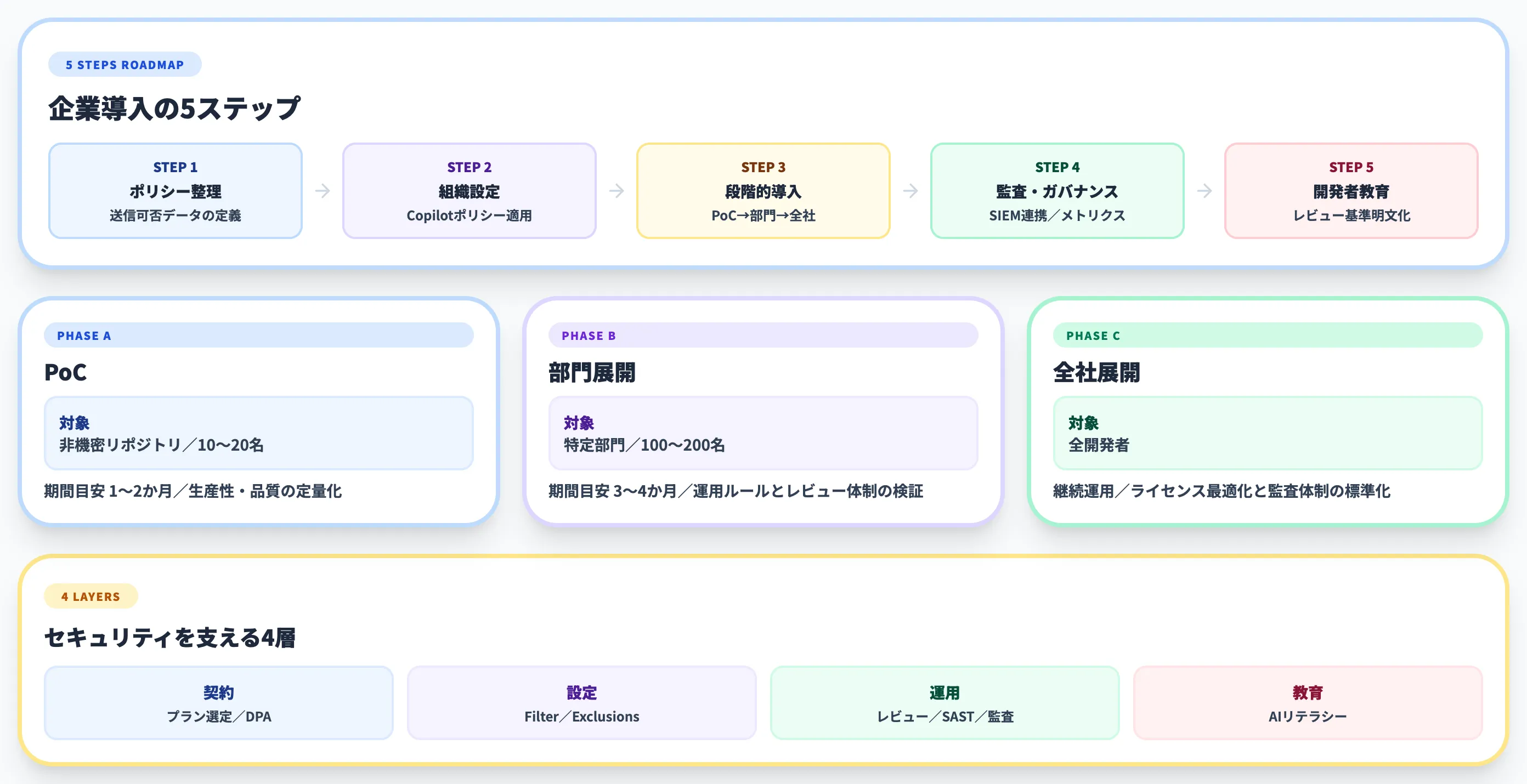

GitHub Copilotの企業導入ステップ:PoC→部門→全社

この章では、GitHub Copilotを企業で本格導入する際のステップを整理します。ツール導入ではなく、開発プロセスの再設計として捉えることが成否を分けます。

3フェーズの段階導入モデル

全社一斉解禁は統制が追いつかず、インシデントの温床になります。導入支援の現場でもっとも成功率が高いのが3フェーズ導入です。

| フェーズ | 対象 | 期間目安 | 目的 |

|---|---|---|---|

| PoC | 非機密リポジトリの10〜20名 | 1〜2か月 | 生産性・品質インパクトの測定 |

| 部門展開 | 特定部門(100〜200名) | 3〜4か月 | 運用ルールとレビュー体制の検証 |

| 全社展開 | 全開発者 | 継続 | ライセンス最適化と監査体制の運用 |

この段階設計は、AI総合研究所が関わる国内企業の導入事例でも繰り返し有効性が確認できている設計です。PoCで効果とリスクを定量化し、部門展開でガバナンスを磨き込み、全社展開で運用を標準化する流れが、統制と活用のバランスを取りやすくなります。

導入前に決めるポリシー

最初のフェーズ(PoC)に入る前に、社内の「Copilotデータ利用ポリシー」を明文化しておきます。次の観点を整理しておくと運用が安定します。

- Copilotに送信してよいデータの種類(ソースコード、ログ、疑似データ等)

- 個人情報・機微情報を送信してよい場面の有無

- 生成コードの著作権・ライセンス取り扱い、レビュー必須範囲

- 既存のAI利用ガイドラインとの整合性

- 外部連携(MCP等)を許可する範囲と例外承認プロセス

これらを「AI利用ポリシー」や「開発標準」の一部として文書化すれば、現場の開発者が迷わず判断できるようになります。

組織設定と管理者コントロール

次に、GitHub Enterprise Cloudや組織側で設定できるCopilotポリシーを確認します。代表的なコントロールは以下のとおりです。

- Copilotを使えるユーザー・チームの範囲

- Chat、Coding Agent等のエージェント機能、MCPの利用可否

- 収集・保持に関するポリシー

- Public Code Filterの既定値

- Content Exclusionsによるリポジトリ除外設定

可能な範囲で組織の既定設定として統一し、例外が必要なときは対象リポジトリ・機能・理由を明確にして管理します。属人的な「〇〇さんの特例」を残すと、後から監査時に説明できなくなります。

監査ログ・ガバナンスの運用

導入後は、「入れて終わり」にしないためのガバナンスが重要です。

- 利用状況メトリクス(ユーザー数・アクティビティ・採用率)を定期的に確認する

- 異常な利用パターン(過剰利用・不審な時間帯アクセス)を検知する

- 生成コード起因のインシデント発生時、影響範囲をトレースできる体制を作る

- AI利用ポリシー違反時のエスカレーションと是正プロセスを定める

Enterpriseの監査ログは外部ログ基盤へのストリーミングが可能なため、SIEMやログ分析基盤と連携することで監査性が高まります。規制業界では特に効きます。

開発者教育とAIリテラシー

最後に、導入成果を左右するのが開発者教育です。リスク⑤(レビュー省略による品質低下)は機能では防げず、教育でしか対処できません。

- オンボーディング時にCopilot利用ポリシーを必ず説明する

- 「AI生成コードも人間のコードと同じレビュー基準」を明文化する

- シークレット管理・依存関係レビューの基礎を座学で提供する

- 代表的な誤用事例(顧客データ貼り付け等)をケーススタディ化する

研修を外部で揃える場合は、GitHub Copilot関連の研修のように、ポリシー設計から技術ハンズオンまで一気通貫で設計されたものを選ぶと導入までの時間を短縮できます。

導入時に詰まりやすい論点

実務でもっとも詰まりやすいのが、セキュリティ部門がBusiness以上でも許可を出さないケースです。ここで論点になるのは、データレジデンシー要件(日本完結にできるか)と、MCP連携時の第三者データ共有です。どちらも「要件を緩める余地」と「技術的に分離可能な範囲」を並行して検討すれば、PoCの入口で止まらずに済みます。逆に、最初から全社一斉解禁に突っ込むと、たった1件のインシデントで全面凍結に戻るリスクが高くなります。

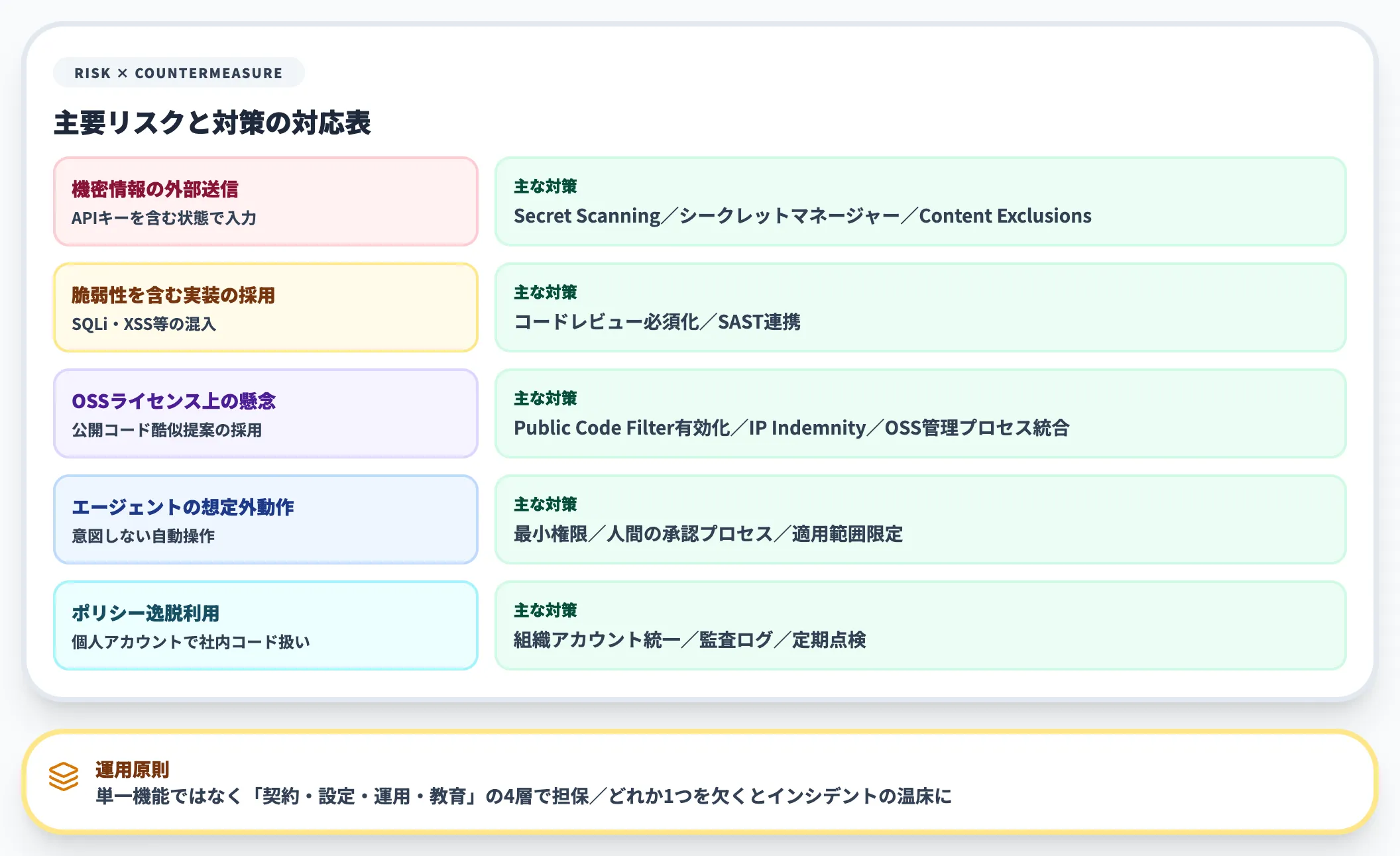

リスクと対策の対応まとめ

最後に、主要リスクと対策方針を一覧化します。

| リスク | 具体例 | 主な対策 |

|---|---|---|

| 機密情報の外部送信 | APIキー含む状態で入力 | Secret Scanning、シークレットマネージャー、Content Exclusions |

| 脆弱性を含む実装の採用 | SQLi・XSS等の混入 | コードレビュー必須化、SAST連携 |

| OSSライセンス上の懸念 | 公開コードと酷似する提案の採用 | Public Code Filter、IP Indemnity、OSS管理プロセス |

| エージェントの想定外動作 | 意図しない自動操作 | 最小権限、人間の承認プロセス、適用範囲限定 |

| ポリシー逸脱利用 | 個人アカウントで社内コードを扱う | 組織アカウント統一、監査ログ、定期点検 |

この表のとおり、Copilotセキュリティは単一機能ではなく「契約・設定・運用・教育」の4層で担保するのが実務の原則です。どれか1つを欠くとインシデントの温床になります。

GitHub Copilotを安全に全社展開するなら

GitHub Copilotのセキュリティ設計を整理してきましたが、実際の導入ではプラン選定・組織ポリシー・教育・監査まで横断的に組み立てる作業が発生します。担当者が孤立して進めると、法務・セキュリティ部門との合意形成やPoCから全社展開までの設計で詰まりやすくなります。

AI総合研究所では、GitHub Copilotの導入計画策定からポリシー実装、開発者向け教育プログラムまで一気通貫で支援しています。Microsoft MVPによる技術監修と600社以上の相談実績で培った組織導入のノウハウをもとに、自社のリスク許容度に合った導入設計を一緒に組み立てます。GitHub Copilotの基本的な使い方、料金体系、セキュリティ・プライバシー設計をまとめた利用ガイドを無料で配布しています。

GitHub Copilotの導入計画を具体化したい方へ

GitHub Copilot利用ガイドを無料で配布中

GitHub Copilotの使い方、Business/Enterpriseの料金、セキュリティ設計、組織ポリシーの実装例をまとめた導入向けガイドです。2026年4月時点の最新仕様を反映し、PoCから全社展開までのステップを整理しています。

GitHub CopilotセキュリティのFAQ

Q1. GitHub Copilotは自社のコードを学習に使いますか?

A. Copilot Business/Enterpriseでは、GitHubは「データをモデル学習に使用しない」と契約上明記しています。個人プラン(Free/Pro/Pro+)は2026年4月22日時点で既定オプトアウト済みですが、2026年3月のポリシー更新でopt-outしない限り学習に使われ得る方向が告知されているため、個人プラン利用者は設定画面で再確認してください。第三者サービス(外部連携・外部提供ツール)を介する場合、データの取扱いは各提供者の条件に依存するため、MCP連携先の規約も個別に確認が必要です。

Q2. 機密性の高いコードでもGitHub Copilotを使ってよいですか?

A. 技術的には利用可能ですが、社内ポリシー・契約要件・データ分類に照らして利用可否と運用条件を先に確定してください。クラウド送信が禁止される区分を扱う場合は、Content Exclusionsで該当リポジトリを除外するかCopilotの適用範囲を限定します。ただしContent Exclusionsはインライン補完と一部のChat/Code Review向けの補助策で、CLI・Copilot cloud agent・IDE Agent modeでは効かないため、これらを併用する場合はリポジトリのアクセス権設計やIDE側の制御で補う必要があります。要件によってはオンプレ/ローカルLLM等の代替手段も検討します。

Q3. 日本リージョンのデータレジデンシーはいつ対応しますか?

A. GitHub Enterprise Cloud(リポジトリデータ)の日本リージョンは2025年12月18日に一般提供済みです。一方GitHub Copilot単体の日本リージョン対応は2026年4月時点で未対応で、ロードマップ段階です。金融・医療などで「Copilotを含めて日本完結」が必須要件の場合は、Copilotの日本GAを待つか、Copilotの適用範囲を非機密コードベースに限定する選択になります。

Q4. 個人プランから組織(Business)への移行はいつ必要ですか?

A. 業務コードを1回でも入力した時点で組織プランへの移行を検討すべきです。個人プランは既定で学習オプトアウト済みですが、契約上の保証がない点と組織統制が効かない点がBusinessとの決定的な差です。業務利用が組織横断で広がる前にBusinessへ揃えるのが、監査・コンプライアンス観点で最も安全です。

GitHub Copilotのセキュリティまとめ

本記事では、GitHub Copilotをセキュリティ視点で捉え、想定リスク、データフロー、公式の保護機能、プラン別料金、機能別論点、規制業界対応、企業導入ステップまでを整理しました。

要点は3つです。

-

プラン選定が最初の関門

学習不利用とIP補償が必要ならBusiness以上が前提。Proで統一したい場合でも、業務コードが流れる瞬間にBusinessへ揃えるほうが総コストは下がる

-

セキュリティは4層で担保

契約(プラン)、設定(Public Code Filter/Content Exclusions)、運用(レビュー・SAST・監査ログ)、教育(AIリテラシー)の4層セットで初めて実用に耐える

-

段階的導入が成功パターン

PoC→部門展開→全社展開の3段階で、ポリシー・運用・監査を磨き込みながら適用範囲を広げる。一斉解禁はインシデントの温床になる

GitHub Copilotの導入は「禁止か全面解禁か」の二択ではありません。適用範囲と運用ルールを先に定め、レビューと自動検査を前提に活用すれば、開発生産性とセキュリティは両立できます。自社の要件がどこに該当するか迷う場合は、本記事のチェック項目を起点にポリシー設計を始めるのが現実的です。