この記事のポイント

議事録・字幕・コールセンター分析を低コストでスケールしたいなら、$0.36/時間で25言語をカバーするMAI-Transcribe-1が第一候補

製品音声・社内ナレーション・カスタムボイス活用には、60秒の音声を1秒で生成するMAI-Voice-1が現実的な選択肢

マーケ素材・プレゼン資料の画像生成は、自然光・肌の質感・画像内文字に強いMAI-Image-2が向く。Foundry/Copilotで既存比2倍以上の生成速度

3モデルとも提供窓口はMicrosoft Foundry(旧Azure AI Foundry)とMAI Playground。LLM部分にOpenAI、音声・画像系にMAIを組み合わせる構成も現実的な選択肢

Microsoftの2027年フロンティア到達計画に連なるリリース。Copilot/Bing Image Creator/PowerPointで段階展開されてきた自社モデルを、Foundry経由で開発者に開放した位置づけ

Microsoft MVP・AIパートナー。LinkX Japan株式会社 代表取締役。東京工業大学大学院にて自然言語処理・金融工学を研究。NHK放送技術研究所でAI・ブロックチェーンの研究開発に従事し、国際学会・ジャーナルでの発表多数。経営情報学会 優秀賞受賞。シンガポールでWeb3企業を創業後、現在は企業向けAI導入・DX推進を支援。

Microsoftは2026年4月2日、自社開発AI基盤モデル「MAI-Transcribe-1」「MAI-Voice-1」「MAI-Image-2」の3種をMicrosoft Foundryでパブリックプレビュー提供すると発表しました。MAI-Voice-1は2025年8月にMicrosoft AIが先行公開していたモデルで、今回のリリースで開発者向けのパブリックプレビュー提供窓口がFoundryに3モデル分そろった形です。

これらは「Microsoft AI(MAI)」部門が育ててきた基盤モデルで、Copilot・Bing Image Creator・PowerPoint・Azure Speechといった一部のMicrosoft製品で段階的に展開されてきました。

本記事では3モデルそれぞれの特徴・ベンチマーク・料金から、Mustafa Suleyman率いるMAI Superintelligenceチームの「2027年フロンティア到達」戦略、競合モデルとの比較、業務への落とし込みまで、2026年4月時点の最新情報をもとに体系的に解説します。

目次

Mustafa Suleyman率いるMAI Superintelligenceチーム

Copilot/Bingで段階展開されてきたモデルの「開放」

音声認識: vs Whisper / GPT-Transcribe / Gemini 3.1 Flash

音声生成: vs ElevenLabs / OpenAI TTS

Microsoft MAIモデルとは?

Microsoft MAIモデルとは、Microsoft AI(MAI)部門が自社開発した基盤AIモデルの総称です。2026年4月2日、音声認識・音声生成・画像生成をカバーする3モデル「MAI-Transcribe-1」「MAI-Voice-1」「MAI-Image-2」をMicrosoft Foundry経由でパブリックプレビュー提供すると発表され、同日からFoundry上で利用できるようになりました。

これまでMicrosoftはOpenAIのモデルを軸にCopilotやAzure OpenAI Serviceを構築してきましたが、MAIシリーズは「Microsoftが自社で訓練し、自社製品の中で展開してきた基盤モデル」を、外部開発者にも開放したという位置づけです。

Copilot Audio Expressions、Copilot Podcasts、Bing Image Creator、PowerPointといった一部のMicrosoft製品で、すでに段階的に展開されています。

3モデルの全体像

最初に、3モデルが何を担当するのかを一覧で整理しておきます。

以下の表でモデル名・対応領域・主な特徴・想定ユースケースをまとめました。表を見たうえで、次のH3で提供窓口(Foundry / MAI Playground)の話に進みます。

| モデル名 | 対応領域 | 主な特徴 | 想定ユースケース |

|---|---|---|---|

| MAI-Transcribe-1 | 音声認識(Speech-to-Text) | 25言語対応、Azure Fast比2.5倍のバッチ速度、$0.36/時間〜 | 議事録、字幕、コールセンター分析、音声エージェント |

| MAI-Voice-1 | 音声生成(Text-to-Speech) | 60秒の音声を1秒で生成、10秒サンプルからのカスタムボイス | 製品ナレーション、ポッドキャスト、e-learning音声 |

| MAI-Image-2 | 画像生成(Text-to-Image) | 自然光・肌の質感・画像内文字に強く、生成速度が既存比2倍以上 | マーケ素材、プレゼン資料、商品ビジュアル |

この表から分かるのは、3モデルが「業務でAIに任せたい音声・画像系タスクの主要3領域」を一気に揃えにきているという点です。

LLM(テキスト生成)はOpenAI側で押さえつつ、その周辺のメディア生成・認識をMAIで自社化する、という棲み分けが見て取れます。

Microsoft Foundryでの提供形態

3モデルの提供窓口は、Microsoftが推進するAI開発プラットフォーム「Microsoft Foundry」(旧Azure AI Foundry)と、新しい試用環境「MAI Playground」です。

Microsoft Foundryの公式ブログによると、MAI-Transcribe-1とMAI-Voice-1はAzure Speechを通じてデプロイ可能で、MAI-Image-2はAPI経由で呼び出せる構成です。

Microsoft MAIモデルが登場した背景

MAIモデルの発表は単発のプロダクトリリースではなく、Microsoftの「自社モデル路線への本格シフト」を示す節目と捉えるべきです。

この章では、なぜ今Microsoftが自社モデルを矢継ぎ早に出してきたのか、その背景を整理します。

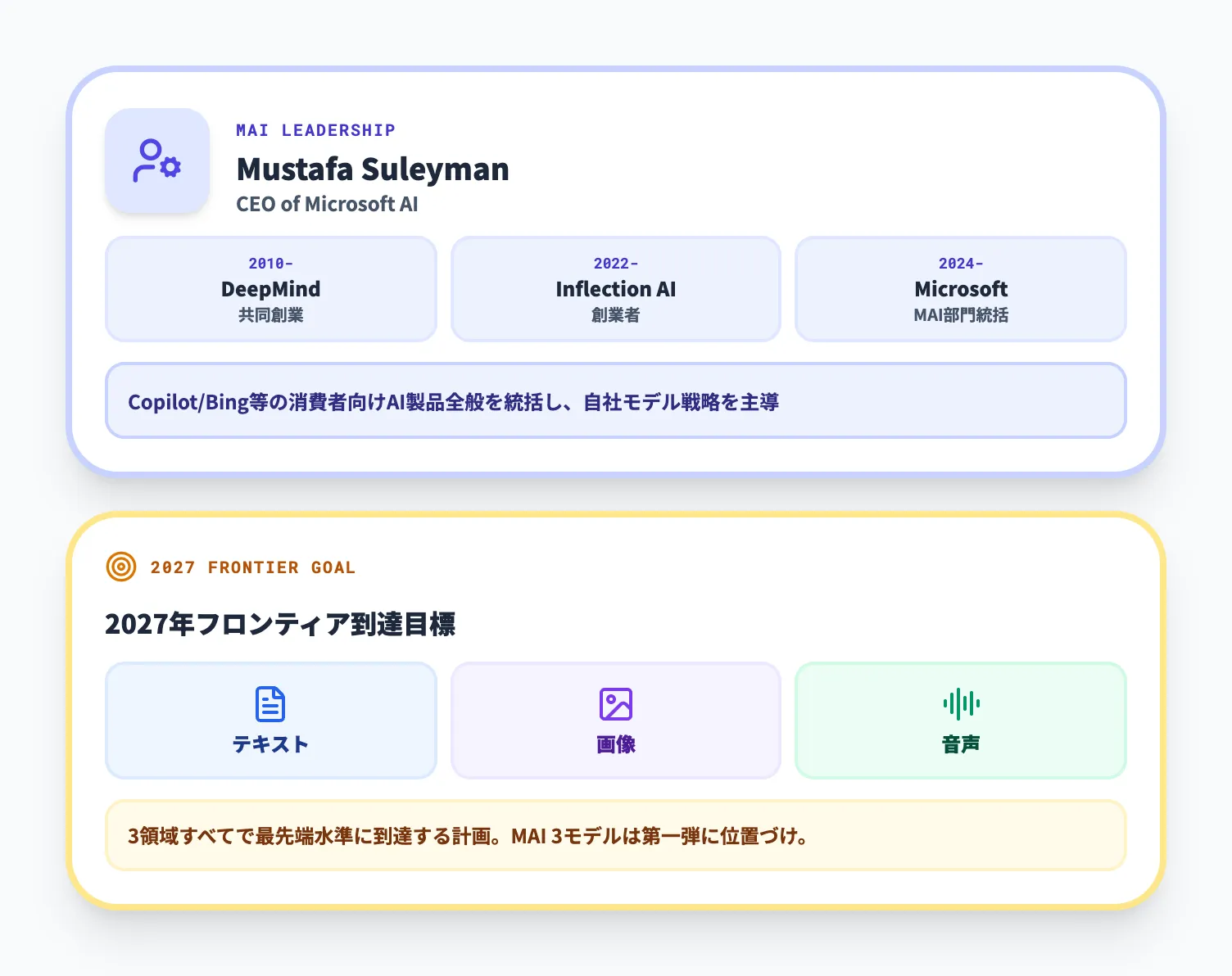

Mustafa Suleyman率いるMAI Superintelligenceチーム

MAIシリーズを開発しているのは、2024年にMicrosoftに合流したMustafa Suleyman氏が率いる「Microsoft AI(MAI)」部門です。

Suleyman氏はDeepMind共同創業者・Inflection AI創業者という経歴を持ち、Microsoft内ではCopilotやBingといった消費者向けAI製品全般を統括しています。

Bloombergの取材に対してSuleyman氏は、「2027年までにテキスト・画像・音声の生成と応答すべてで最先端水準(フロンティア)に到達することが目標」と語っています。

今回のMAI-Transcribe-1 / Voice-1 / Image-2は、このフロンティア計画の第一弾に位置づけられます。

OpenAIとの「2トラック戦略」

注意したいのは、これがOpenAIとの決別を意味するわけではないという点です。

2025年10月に再構築されたMicrosoft-OpenAI契約では、Microsoftは引き続きOpenAIへの大規模な経済的持分(おおむね20〜30%)と、2032年までのIP・モデル利用権を確保しています。

OpenAI側もAzureに対して総額約2,500億ドル規模のクラウド利用枠を契約しており、商業的にも技術的にも依存関係は維持されています。

そのうえでMicrosoftは、自社モデルを並行して育てる「2トラック戦略」に踏み込みました。Copilotの中核がOpenAIモデル一本に依存し続けることのリスクを下げ、Foundry上で開発者に提供する選択肢を厚くする、というのが明示的な狙いです。

Copilot/Bingで段階展開されてきたモデルの「開放」

MAIシリーズのもう一つの特徴は、「未知の研究モデル」ではなく「自社製品で段階的に展開されてきたモデル」を開発者に開放した点にあります。

たとえばMAI-Voice-1はCopilot Audio ExpressionsやCopilot Podcastsで、MAI-Image-2はCopilot・Bing Image Creator・PowerPointで、MAI-Transcribe-1はCopilotの音声モード文字起こしで利用されています。

MAI-Transcribe-1は段階的なロールアウト中(phased rollouts)と公式に説明されており、3モデルとも一部のMicrosoft製品から順次展開されている状況です。

社内サービスでの利用を経たモデルが先にあって、それを後から開発者向けに開放するというリリースの流れは、Microsoftがどの順序で自社モデルを外販していくのかを示しています。新規モデルを触る側からすると、Microsoft製品側で先行して使われているモデルがそのままFoundry経由で呼び出せるようになる、という見え方になります。

MAI-Transcribe-1(音声認識)の特徴

ここからは3モデルそれぞれの特徴を順に見ていきます。まず音声認識を担う「MAI-Transcribe-1」について、ベンチマーク・速度・対応言語・想定用途を整理します。

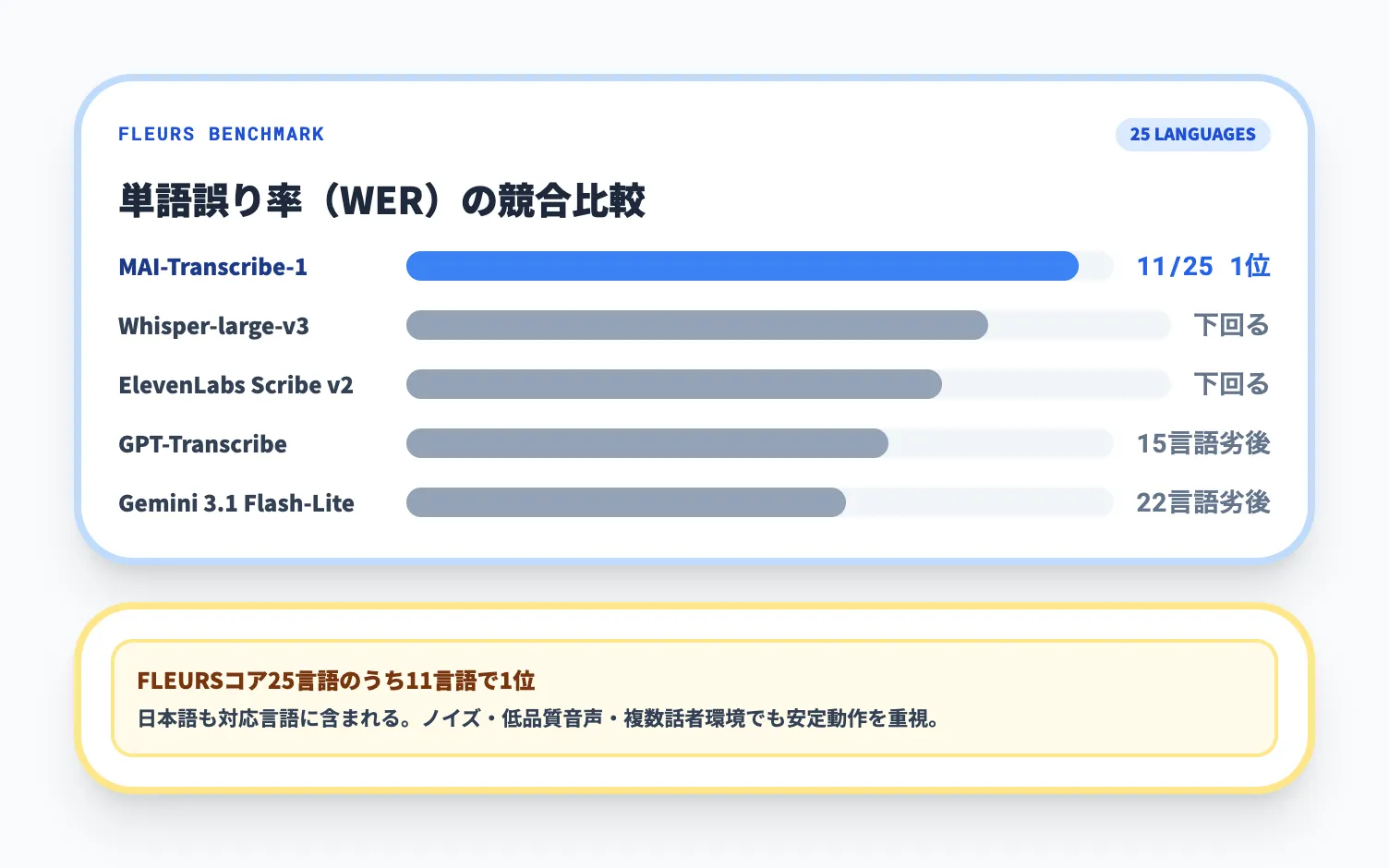

25言語対応とFLEURSベンチマーク

MAI-Transcribe-1は、Microsoft製品で最も使われている上位25言語をカバーする音声認識モデルです。日本語も対応言語に含まれます。

Microsoft AIの解説ブログによると、MAI-Transcribe-1は業界標準の音声認識ベンチマーク「FLEURS」において、コア25言語のうち11言語で1位の単語誤り率(WER)を記録し、Whisper-large-v3、ElevenLabs Scribe v2、GPT-Transcribe、Gemini 3.1 Flash-Liteといった主要競合モデルを上回る結果を出しています。

マイナビのレポートでも、Gemini 3.1 Flashに対しては22言語、GPT-Transcribeに対しては15言語でMAI-Transcribe-1のWERが低かったと報告されています。

設計上は、ノイズの多い環境、低品質な音声、複数話者が重なる音声でも安定して文字起こしできることを重視しているとされており、研究室のクリーン音声だけでなく実環境の音源を意識した訓練が行われています。

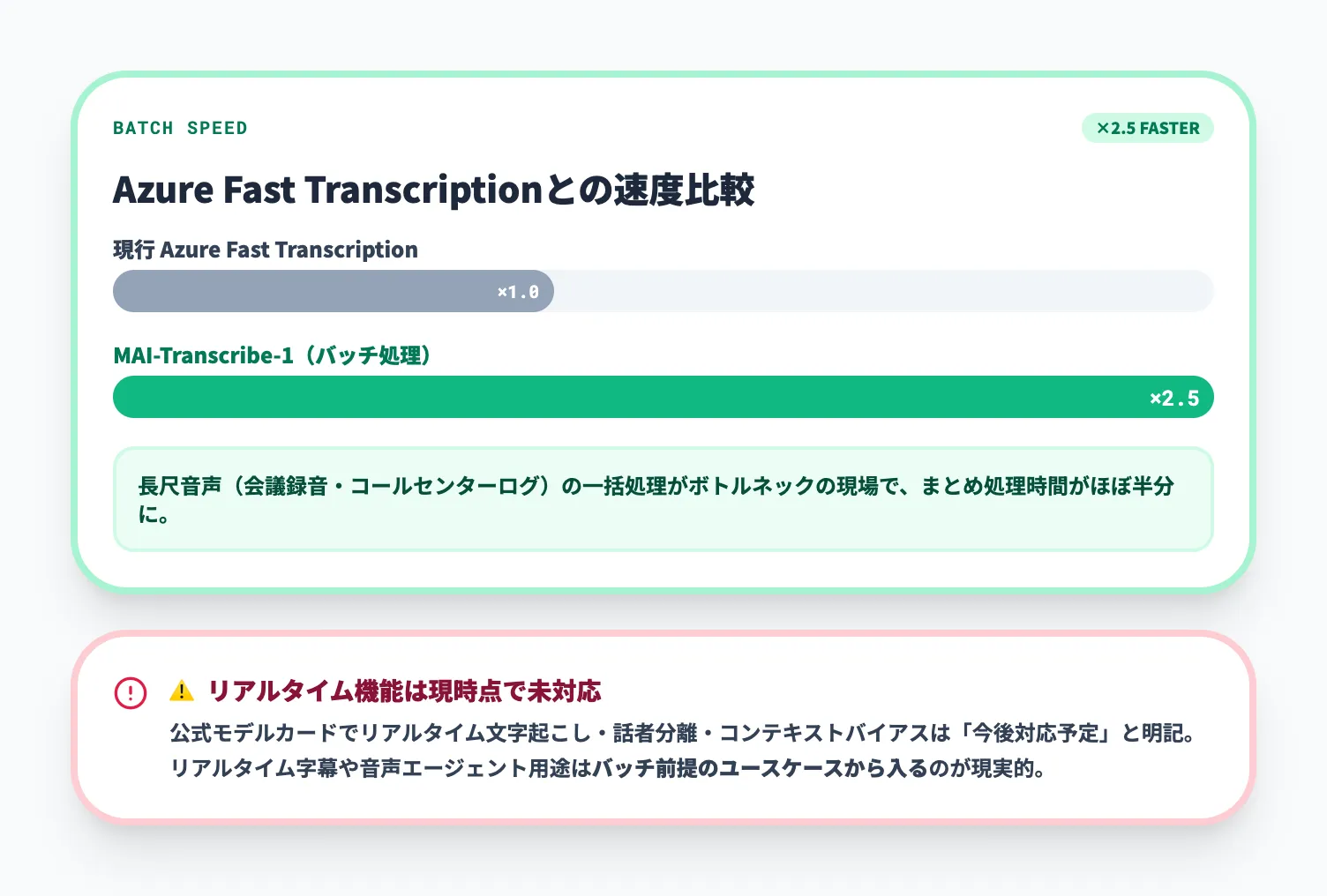

Azure Fast比2.5倍のバッチ処理速度

MAI-Transcribe-1のもう一つの特徴は、バッチ処理のスループットです。Microsoftによると、現行のAzure Fast Transcription機能と比べて2.5倍の速度でバッチ文字起こしを処理できるとされています。この差は、長尺音声(会議録音やコールセンターログのまとめ処理)を扱う現場にとって直接コストに効きます。

加えて、低レイテンシ動作も設計上の目標として掲げられています。ただし、公式のMAI-Transcribe-1モデルカードでは、リアルタイム文字起こし・話者分離(ダイアライゼーション)・コンテキストバイアスといった機能は現時点で未対応で、今後対応予定と明記されています。リアルタイム字幕や音声エージェントへの組み込みを検討する場合は、この点を踏まえてバッチ前提のユースケースから入るのが現実的です。

価格と料金優位性

MAI-Transcribe-1の料金は、音声1時間あたり$0.36からとなっています。これは、競合する主要音声認識サービスと比べてGPUコストベースでおよそ50%低いとされており、長時間音源を扱う業務では効果が大きい価格帯です。

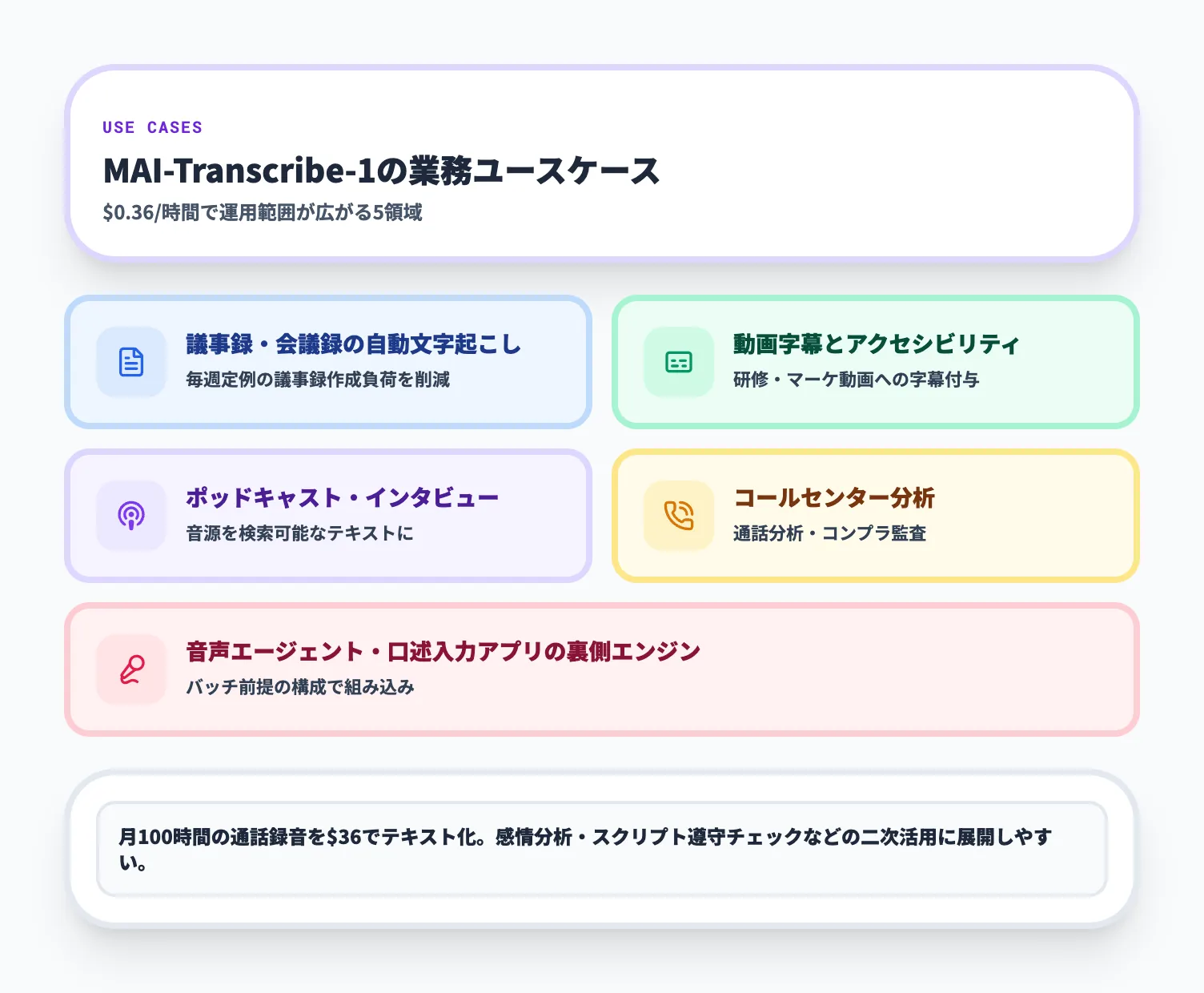

想定される業務ユースケース

MAI-Transcribe-1の用途は幅広く、次のようなシーンで実運用が想定されています。導入文として整理しておきます。

- 議事録・会議録の自動文字起こし

- 動画コンテンツの字幕生成・アクセシビリティ対応

- ポッドキャスト・インタビュー音源の文字起こし

- コールセンターの通話分析・コンプライアンス監査

- 音声エージェント・口述入力アプリの裏側エンジン

これらの用途は、いずれも「音声→テキスト変換のコストが下がるほど運用範囲が広がる」性質を持っています。たとえば「全ての商談音声をテキスト化して検索可能にする」ような構想は、これまで料金面で諦めていたケースが多かったはずです。$0.36/時間という単価で25言語に対応するなら、社内の通話・会議録音を網羅的に文字化してナレッジ化する選択肢が現実的に視野に入ります。

【関連記事】

Azure OpenAI Whisperとは?サービス概要や利用手順、活用例を紹介

MAI-Voice-1(音声生成)の特徴

続いて、音声合成(Text-to-Speech)を担う「MAI-Voice-1」を見ていきます。最大の特徴は「圧倒的な生成速度」と「カスタムボイス」の組み合わせです。

60秒の音声を1秒で生成する高速性

MAI-Voice-1は、単一GPU上で60秒分の音声を1秒未満で生成できると公表されています。表現力のあるナチュラルな読み上げを保ったままこの速度を実現している点が、ElevenLabsやOpenAI TTSなどの先行サービスに対する明確な差別化要素です。

リアルタイム読み上げや音声エージェントとの組み合わせを想定すると、この速度差はそのままユーザー体験のレイテンシに効きます。ストリーミング再生ではなく「数秒のナレーションをまとめて生成→再生」のような使い方をしたい場合、MAI-Voice-1の処理速度は有利に働きます。

Personal Voiceによるカスタムボイスと対応言語

MAI-Voice-1はAzure SpeechのPersonal Voice機能と統合されており、わずか10秒程度の音声サンプルから話者の声を学習し、カスタムボイスを生成できる点も大きな特徴です。

ただし対応言語は現時点では英語のみで、日本語をはじめとする非英語のTTSは未対応です。公式のMAI-Voice-1モデルカードでも、サポート言語はEnglishと明記されており、10以上の言語への拡大は今後のロードマップとして示されている段階です。日本語ナレーションを含む多言語TTSを業務要件に組み込む場合、Voice-1単体での対応はまだ前提にできません。当面は英語ユースケースで導入し、対応言語の拡大に合わせて適用範囲を広げる段階的な進め方が現実的です。

社内ナレーター・経営者の声・キャラクターボイスなど、企業独自のブランドボイスを揃えたい場合に向きます。ただしクローンボイスは悪用リスクも大きいため、利用は同意取得・本人確認を前提に運用設計する必要があります(公式にも責任あるAI利用のガイドラインが提示されています)。

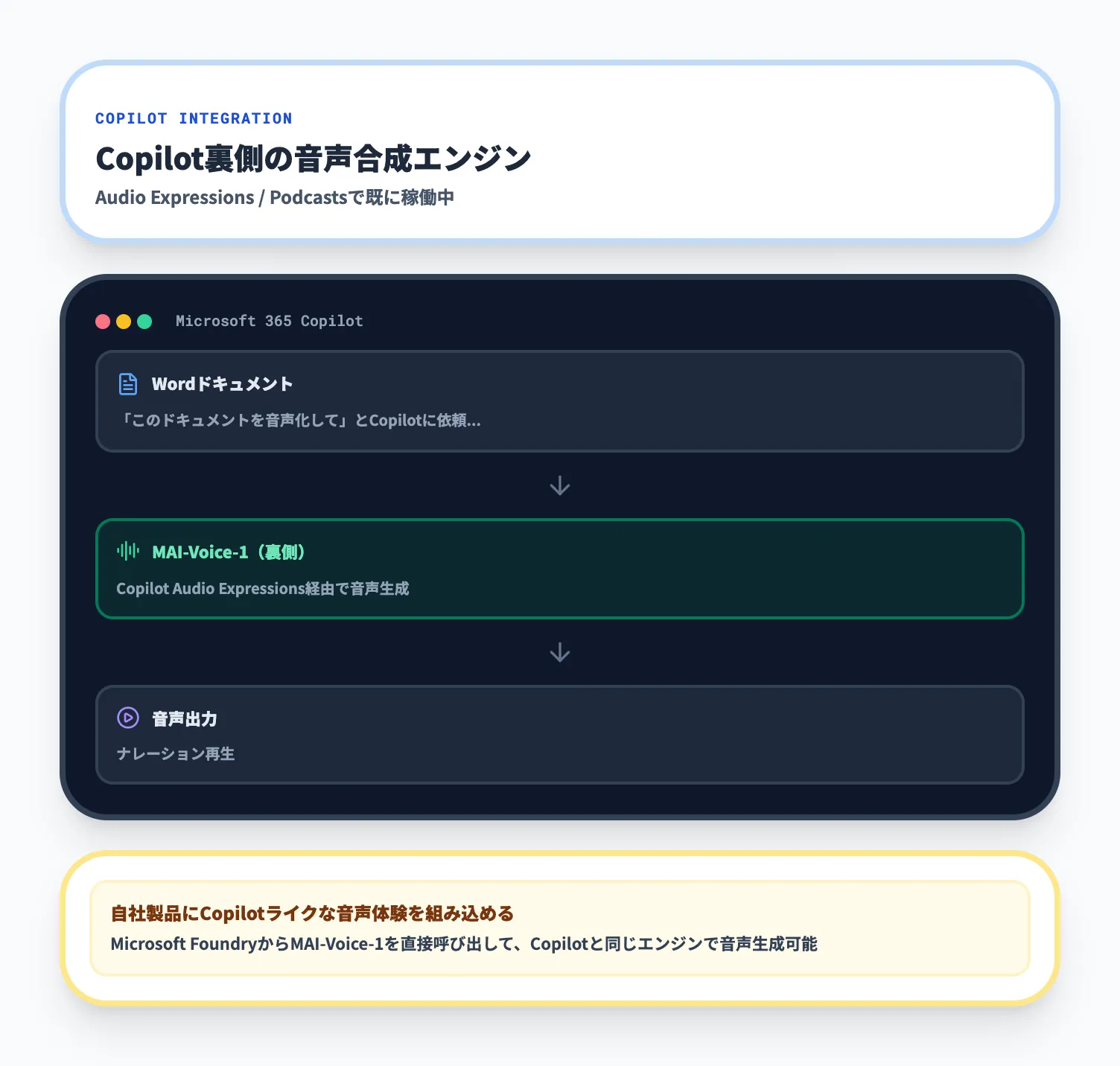

Copilot Audio Expressionsとの連携

MAI-Voice-1は、すでにCopilot Audio ExpressionsやCopilot Podcastsの音声合成エンジンとして稼働しています。つまり「Microsoft 365 Copilot上でドキュメントを音声化する」「Copilotが生成したポッドキャスト風コンテンツを読み上げる」といった機能の裏側で、このモデルが実際に音を生成しているわけです。

開発者向けにはMicrosoft Foundryから直接呼び出せるため、自社製品にCopilotライクな音声体験を組み込みたい場合の選択肢として現実的になりました。

【関連記事】

Azure AI Speech(Azure AI 音声)とは?主要機能や使い方、料金体系を解説

MAI-Image-2(画像生成)の特徴

3モデル目は、画像生成を担う「MAI-Image-2」です。Microsoftはこのモデルを「自社の最高性能text-to-imageモデル」と位置づけています。

写真家・デザイナー向けの精細表現

MAI-Image-2の設計上の力点は、「カメラマンやデザイナーが現場で求める品質」に置かれています。具体的には、自然な採光・正確な肌の質感・画像内に挿入する文字の明瞭な描写の3点が強化ポイントとして挙げられています。

VentureBeatの記事によると、MAI-Image-2はArena.aiの画像モデルファミリーリーダーボードで第3位デビューを果たしたとされています。Midjourney、Imagen、Nano Banana系列が並ぶ中での3位は、Microsoftが基盤モデル分野で本気の競争に参加する体制が整ったことを示しています。

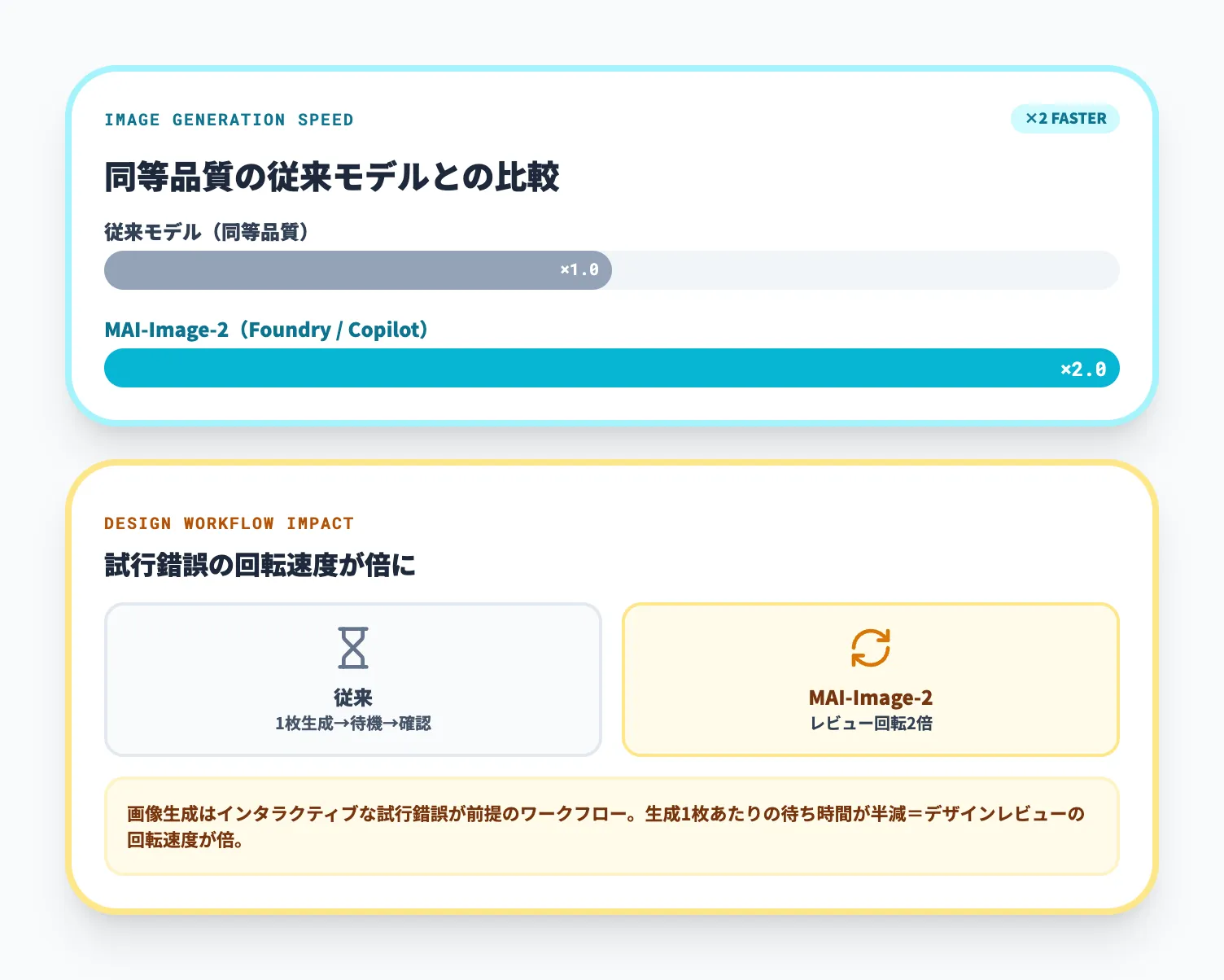

Foundry/Copilotで既存比2倍の生成速度

MAI-Image-2は、Foundry経由およびCopilot内のいずれでも、同等品質の従来モデルと比べて少なくとも2倍速い生成時間を達成していると公表されています。画像生成はインタラクティブな試行錯誤が前提のワークフローなので、生成1枚あたりの待ち時間が半減すれば、デザインレビューの回転速度がそのまま倍になります。

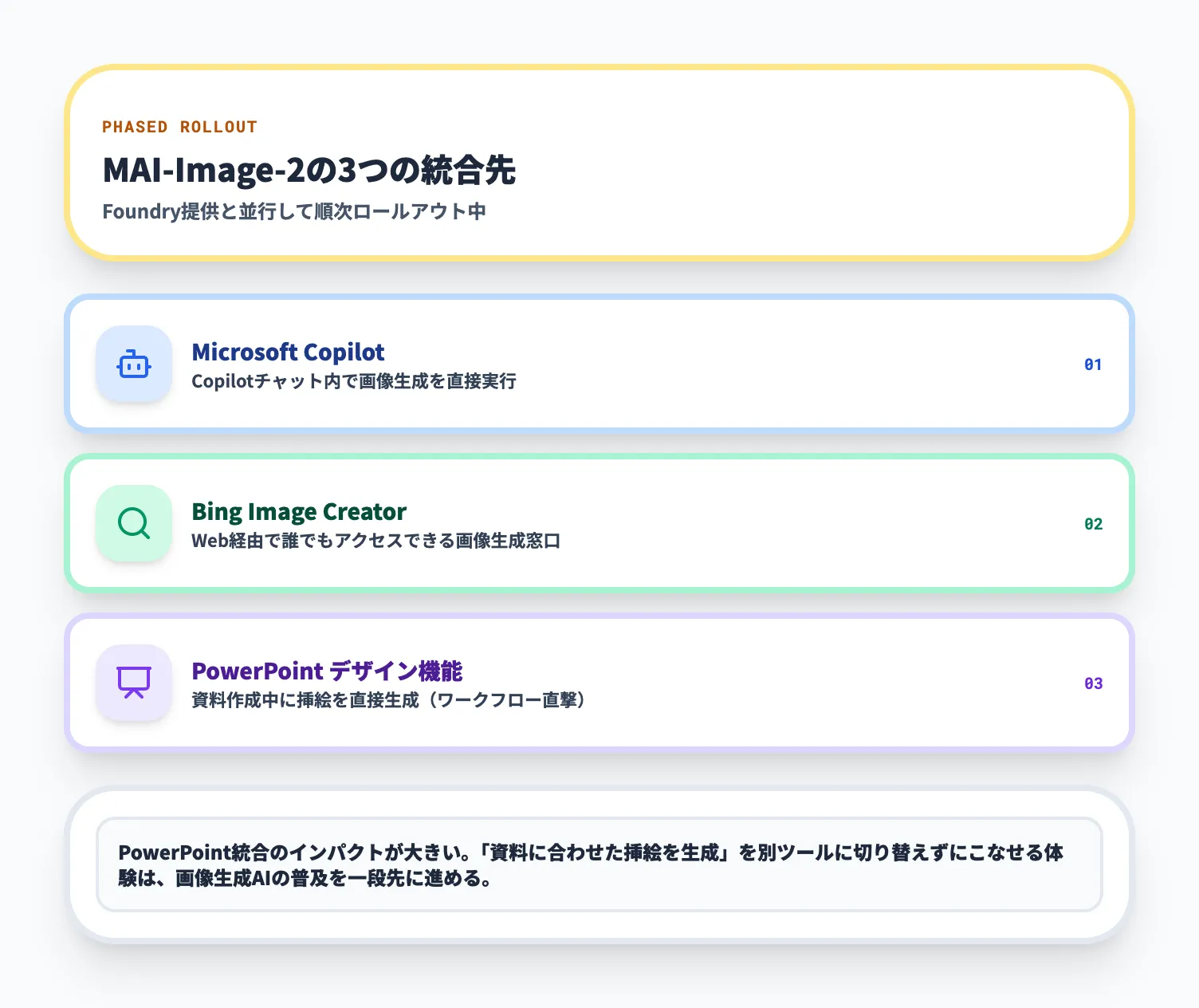

Copilot・Bing・PowerPointへの段階展開

MAI-Image-2は、Microsoft Foundryでの開発者向け提供と同時に、Copilot・Bing Image Creator・PowerPointへの段階的なロールアウトが進められています。とりわけPowerPointのデザイン機能との統合は、現場のドキュメントワークフローへの直接的なインパクトが大きい部分です。

PowerPointユーザーが「資料に合わせた挿絵を生成したい」と思った時に、別ツールを開かずにそのままMAI-Image-2を呼び出せる体験は、画像生成AIの普及を一段先に進めると考えられます。

【関連記事】

Nano Banana 2とは?特徴や料金、使い方を徹底解説!

競合モデルとMAIシリーズの比較

MAI 3モデルの特徴を押さえたところで、競合モデルとの位置関係を整理します。各カテゴリでどの製品の何と競合するのか、選定時のポイントを確認しておきます。

音声認識: vs Whisper / GPT-Transcribe / Gemini 3.1 Flash

音声認識の主要選択肢を比較します。以下の表は、現時点で代表的に検討されるモデルを「対応言語数」「速度」「料金水準」「特徴」の観点で整理したものです。価格はベンダーごとに課金単位が異なるため目安として参照してください。

| モデル | 対応言語 | 速度の特徴 | 料金水準(目安) | 強み |

|---|---|---|---|---|

| MAI-Transcribe-1 | 25言語 | Azure Fast比2.5倍 | $0.36/時間〜 | 25言語のFLEURS精度、低価格 |

| Whisper-large-v3 | 約100言語 | バッチ前提 | OSSなら無料、API課金 | 言語数の多さ、OSS版あり |

| OpenAI GPT-Transcribe | 多言語 | APIベース | API課金 | LLMとの統合性 |

| Gemini 3.1 Flash | 多言語 | APIベース | API課金 | マルチモーダル統合 |

この表から読み取れるのは、MAI-Transcribe-1は「対応言語の数で勝負するのではなく、よく使われる25言語に絞ってFLEURS精度と価格・速度で勝ちにきている」という方針です。100言語をフラットにカバーする必要があるならWhisper、Microsoft Foundryでの統合性とコストパフォーマンスを取るならMAI-Transcribe-1、という棲み分けになります。

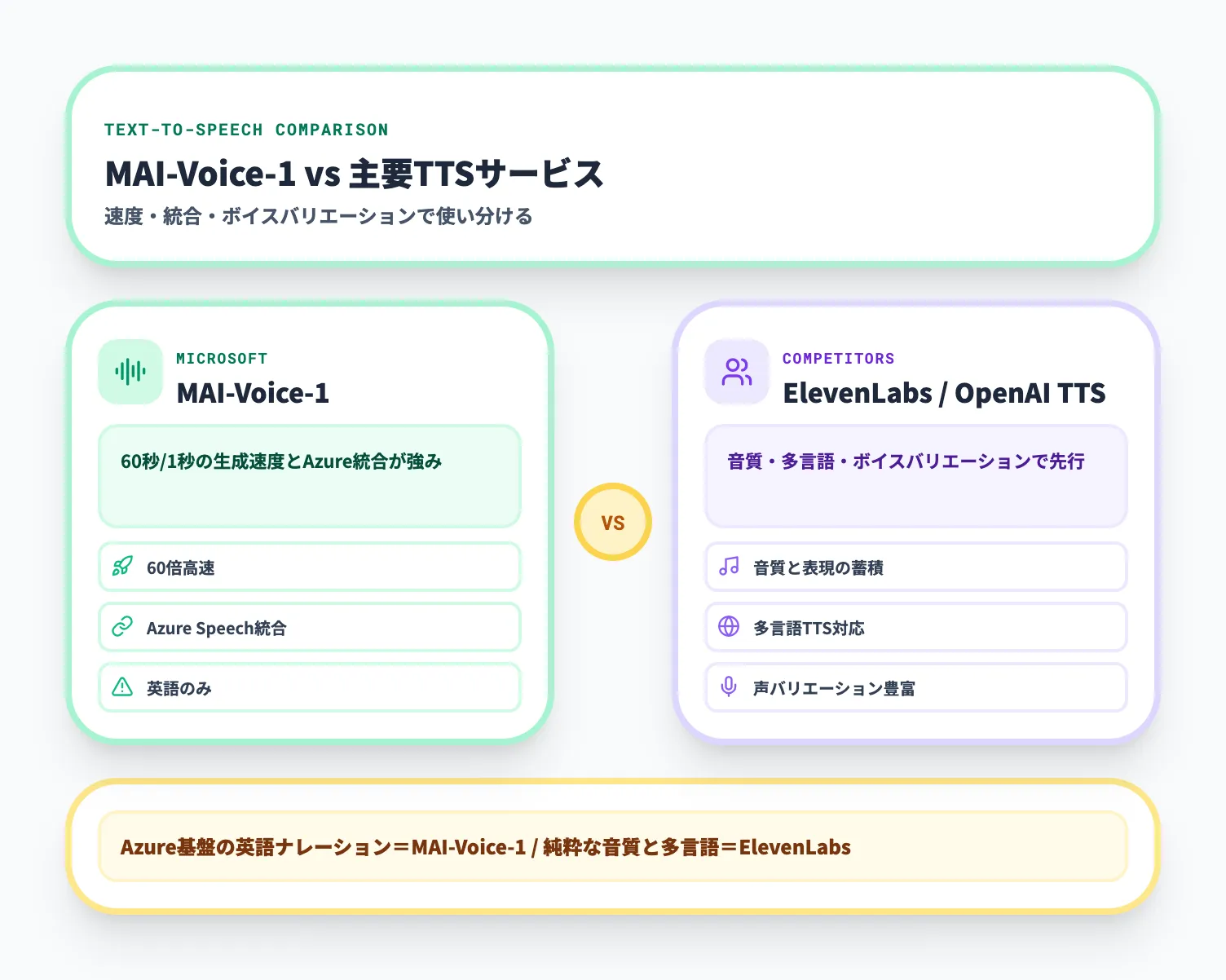

音声生成: vs ElevenLabs / OpenAI TTS

音声生成では、ElevenLabsとOpenAI TTSが最大の競合になります。ElevenLabsは自然さとカスタムボイスで先行してきたサービスですが、MAI-Voice-1は60秒/1秒の生成速度とAzure Speechエコシステムへの統合という2点で差別化できます。

エンタープライズ環境ですでにAzureを使っており、認証・課金・ガバナンスをAzure内で完結させたい場合、MAI-Voice-1は導入摩擦が低い選択肢になります。一方、純粋な音質や声のバリエーション、コミュニティへの蓄積で選ぶならElevenLabsの優位性も依然として残っています。

【関連記事】

ElevenLabs(イレブンラボ)とは?使い方や料金、商用利用について解説

画像生成: vs DALL-E / Imagen / Nano Banana

画像生成カテゴリでは、OpenAIのDALL-E系列、GoogleのImagenシリーズ、Geminiベースの「Nano Banana」系がMAI-Image-2の主な競合です。

商用クオリティの絵画的表現やキャラクター生成という意味では、Midjourney・Imagen 4・Nano Banana 2が引き続き強力な選択肢ですが、MAI-Image-2は「Copilot・Bing Image Creator・PowerPointに直接組み込まれている」「Foundry上で他のAzureサービスと連結できる」という2点で、業務系画像生成の現実的な第一候補に位置づけられます。

【関連記事】

Imagen4とは?使い方や料金・商用利用、プロンプトのコツを解説!

MAIモデルの業務活用シーンと選定の指針

ここまで紹介してきたMAI 3モデルを、実際の業務にどう落とすかを整理します。AI総合研究所が支援する企業のケースを踏まえて、ケース別の推奨を示します。

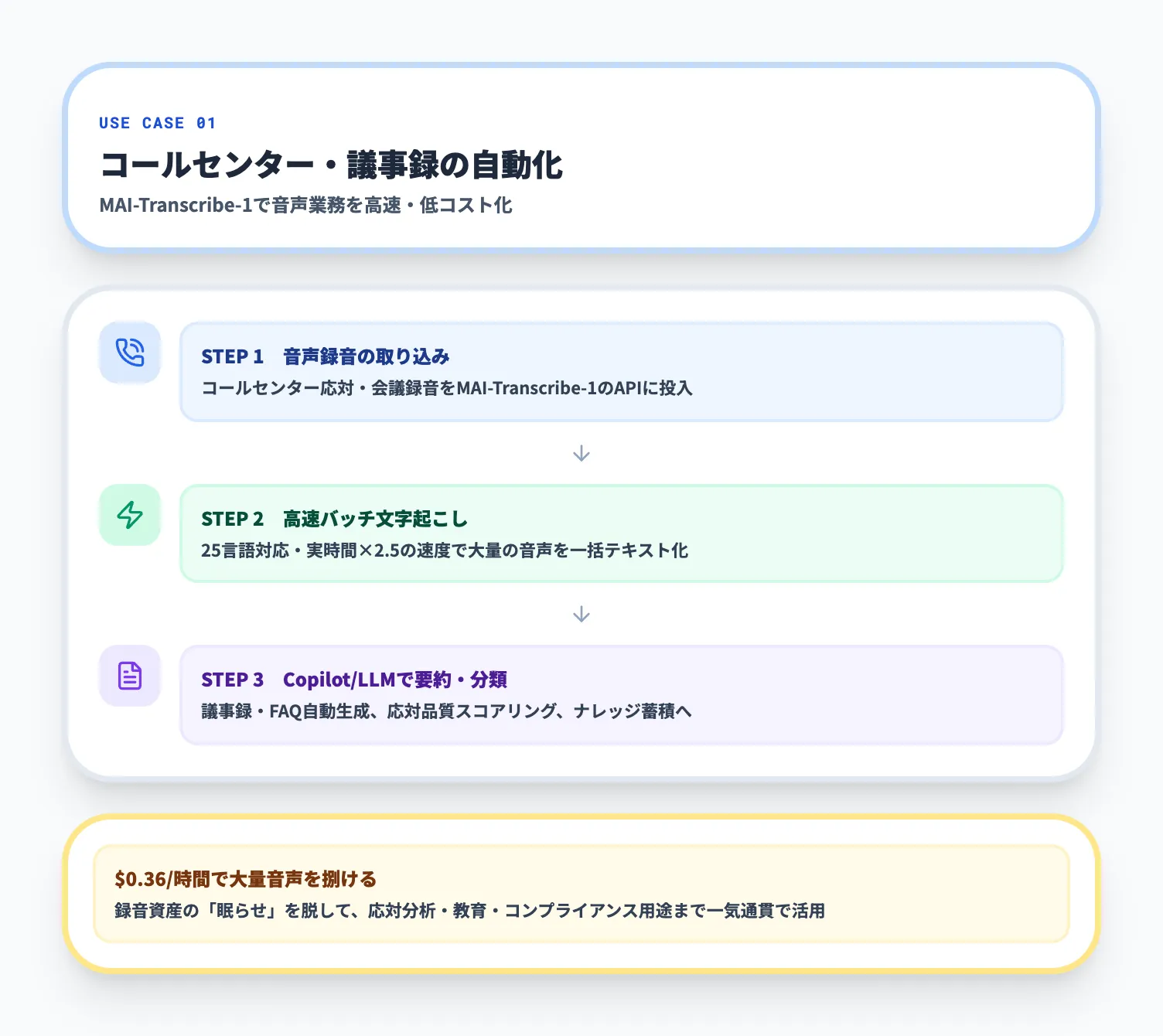

コールセンター・議事録の自動化

通話録音や会議録音を全件文字起こしして検索・分析できるようにしたい、という要件は多くの企業で共通の課題です。これまでは「全件文字起こしのコストが見合わない」という理由で諦めていたケースも、$0.36/時間のMAI-Transcribe-1なら現実的な検討対象になります。

社内に毎月100時間の通話録音があるなら、月額わずか$36でテキスト化できる計算です。ここから感情分析・顧客クレーム検出・スクリプト遵守チェックといった二次活用に展開していくのが、現場で効果が出やすい順序です。

マーケ素材・プレゼン資料の生成

マーケ部門・営業部門で「プレゼン資料に挿入する画像」「LP用のビジュアル」を量産したいケースには、MAI-Image-2が向きます。とくにPowerPointへの統合が進めば、デザイナー以外のスタッフが資料作成と画像生成を同じツール上で完結できるようになります。

ブランドガイドラインを明示的に守りたい企業では、画像内文字の描写精度が高い点も実務的に効きます。ロゴや見出しテキストを画像に焼き込むケースで、文字崩れの修正コストが下がるためです。

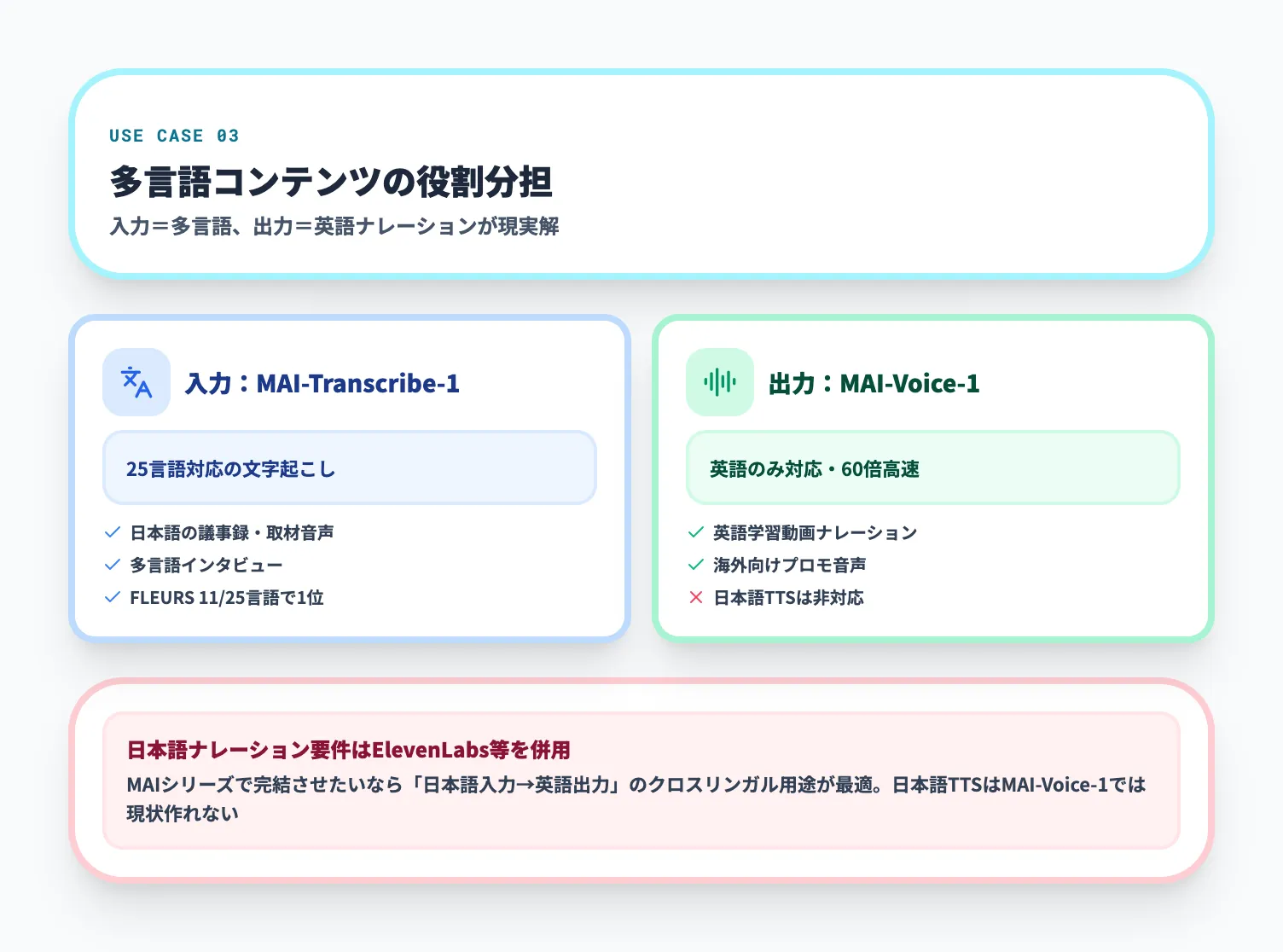

多言語コンテンツの文字起こしと英語ナレーション

グローバル展開する企業では、「海外拠点の会議録音を25言語で文字化したい」「英語の研修ナレーションを大量に内製したい」といったニーズに、MAI-Transcribe-1(音声→テキスト)とMAI-Voice-1(テキスト→音声)の組み合わせが有効です。

ただし役割分担を明確にしておく必要があります。25言語の文字起こしはMAI-Transcribe-1の領分で、MAI-Voice-1の対応言語は現時点で英語のみ、追加言語は今後拡大予定という段階です。日本語ナレーションを含む非英語TTSはVoice-1単体ではまだ実現できません。当面は「Transcribe-1で25言語の文字起こし+英語ナレーション領域でVoice-1」という分担で導入し、Voice-1の対応言語拡大に合わせて適用範囲を広げていくのが現実的です。

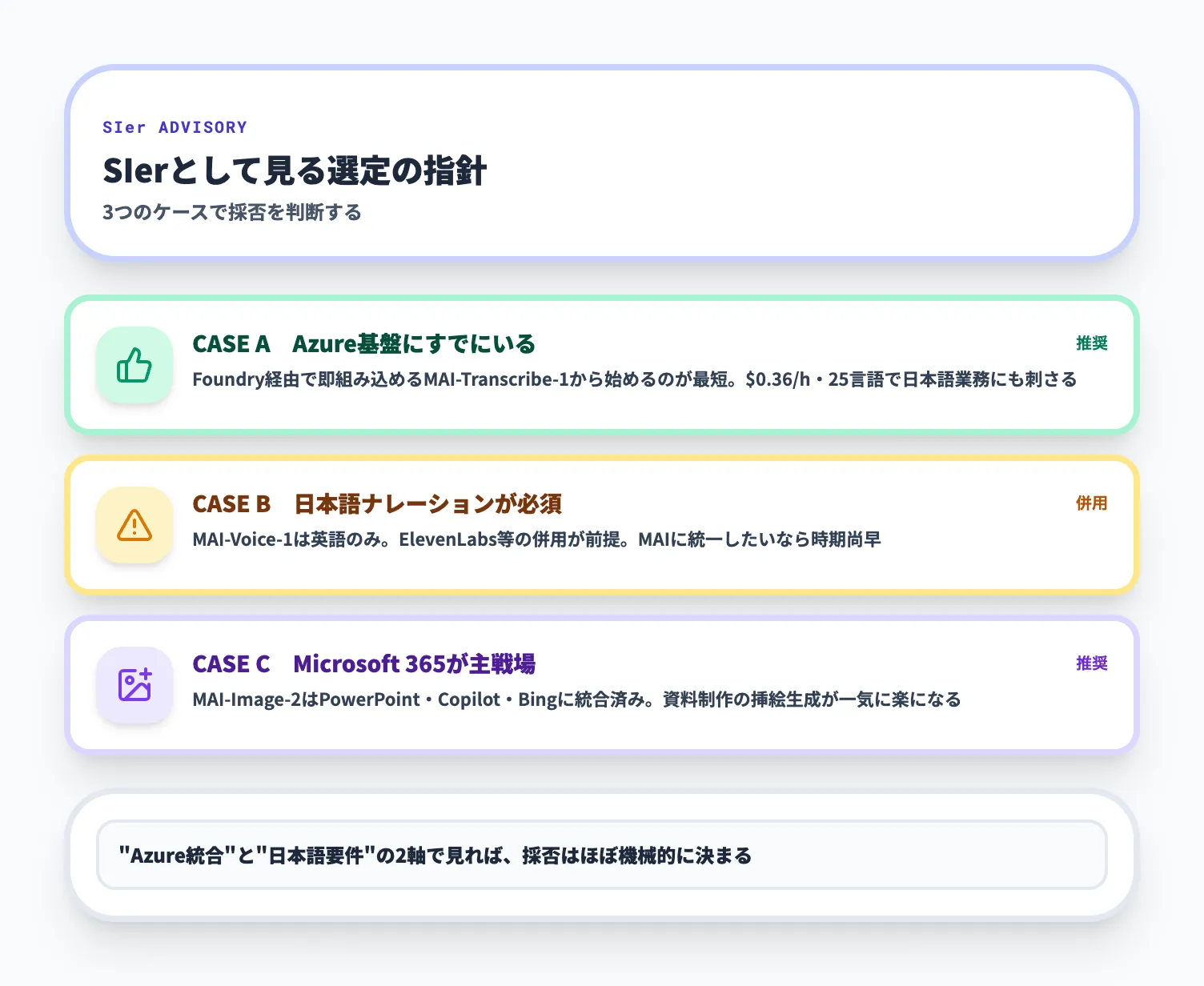

SIerとして見る選定の指針

3モデルを「使うか使わないか」ではなく、「自社の既存スタックと組み合わせてどう使うか」で考えるのが現実的です。AI総合研究所として推奨する判断軸を3つ示します。

- すでにMicrosoft 365 / Azureが基盤になっている企業

MAI 3モデルはMicrosoft Foundryで提供されるため、認証・課金・ガバナンスを既存のAzureテナントで完結できます。新規ベンダーを増やすコストを避けたい場合は第一候補に置く価値があります。

- OpenAI API中心で動いている開発チーム

LLM部分はOpenAI、音声・画像系はMAIという分業が現実的です。両者は競合ではなく補完関係にあり、Foundry経由でMAIを呼び出せばLLM呼び出しと並列で扱えます。

- マルチクラウドで音声・画像を統一したい企業

Whisper(OSS)や独立系SaaS(ElevenLabs等)も依然として有力です。Microsoft依存を避けたい意思決定がある場合、MAIは選択肢の一つとして比較表に並べる程度の位置づけになります。

「結論先行で言えば、Azure系を採用済みかつ音声・画像のSaaS料金を最適化したい組織であれば、MAI 3モデルは現時点で最も検討価値が高い」というのがSIer視点の評価です。

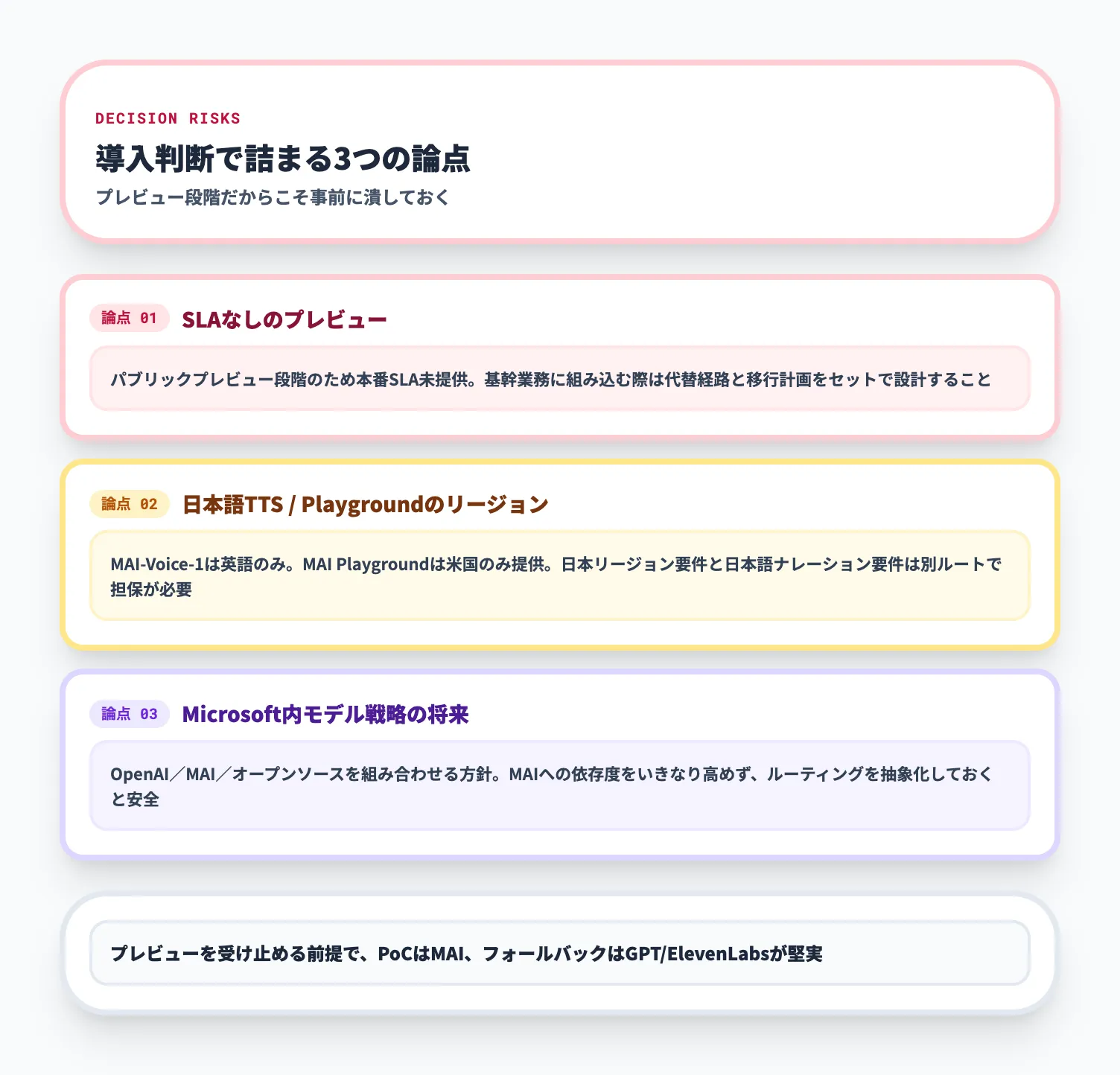

導入判断で詰まる論点

MAI 3モデルの導入を検討するときに、実際に判断が分かれる論点を3つ挙げておきます。先回りで整理しておくと、社内の合意形成がスムーズになります。

- 既存のAzure SpeechやAzure OpenAI Whisperからの乗り換えコストをどう評価するか

- カスタムボイス機能を社内利用に解禁する場合の同意取得・悪用防止プロセスをどこまで作り込むか

- MAI Playgroundが米国のみの提供であるため、日本拠点でのPoC環境をどう確保するか

これらは単なる技術論ではなく、コンプライアンス・調達・運用設計を含む論点です。導入PoCの段階で営業・法務・情シスが同じテーブルに着いて方針を決めておくのが、後戻りを減らすコツになります。

MAIモデルの料金体系

MAI 3モデルの料金を整理します。すべてSaaS型のAPI課金で、Microsoft Foundry経由での提供となるため、AzureインフラのようなリージョンSKU別の価格体系ではなく、利用量ベースの単価で公表されています。価格はいずれも2026年4月時点の公式情報に基づきます。

3モデルの価格一覧

以下の表で3モデルの料金を整理しました。表を見たうえで、その下の「読み解き」で実際にコストを試算する際のポイントを補足します。

| モデル | 課金単位 | 価格(2026年4月時点) |

|---|---|---|

| MAI-Transcribe-1 | 音声1時間あたり | $0.36〜 |

| MAI-Voice-1 | 100万文字あたり | $22〜 |

| MAI-Image-2(テキスト入力) | 100万トークンあたり | $5 |

| MAI-Image-2(画像出力) | 100万トークンあたり | $33 |

この表から見えるのは、Microsoftが3モデルとも「主要競合より安価」を明確に打ち出しているという点です。とくに音声認識の$0.36/時間は、商用音声認識の中でもかなり攻めた価格設定で、長尺音声を扱う業務にとっては従来の見積りを書き換えるレベルの単価です。

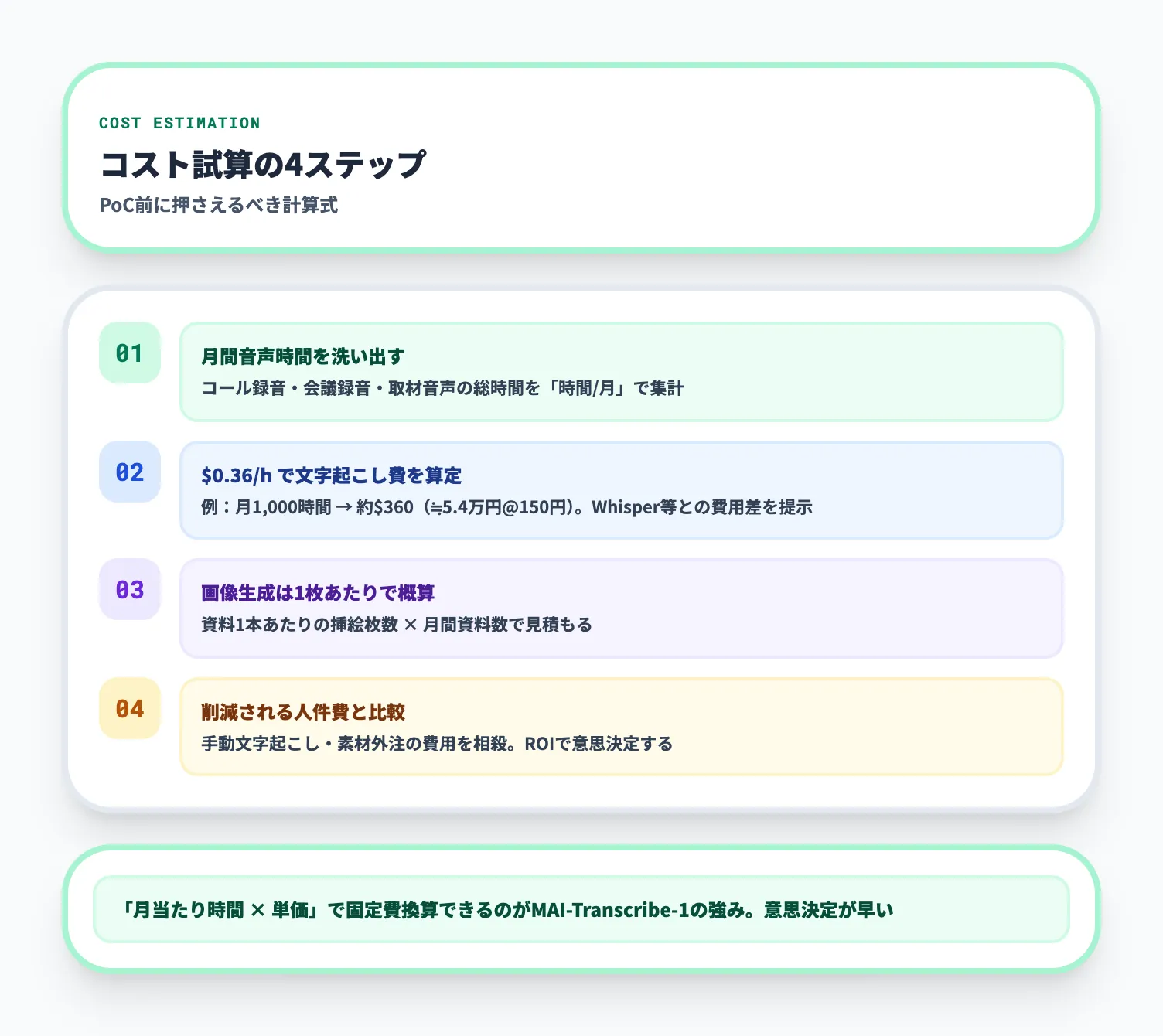

コスト試算の考え方

実務での見積りでは、単価よりも「処理ボリューム」を先に固定するのがポイントです。たとえば次のような順序で試算すると、過剰見積りや見積り不足を防げます。

- 月間の音声時間(議事録・通話・動画素材の総時間)を棚卸しする

- 月間のナレーション需要(合計文字数)を棚卸しする

- 月間の画像生成需要(リクエスト数×平均トークン量)を見積もる

- 上記を3モデルの単価に掛け合わせて月額コストを試算する

この順序で進めれば、「とりあえず入れたが想定外に高くなった」「逆にPoCで止まって本格利用に進まない」という両極端の失敗を避けられます。価格表の数字を眺めるよりも、自社の運用ボリュームを棚卸しする方が判断は早いです。

なお、MAIモデルのMicrosoft Foundry経由での課金は、既存のAzureサブスクリプションに集約できるため、調達側のオペレーション負荷は低く抑えられます。

音声・画像モデルを業務に組み込む設計

Foundryモデル群を成果につなげる

MAI-Transcribe/Voice/Imageを試すだけで終わらせず、議事録・コールセンター・マーケ素材といった具体的業務プロセスに組み込むことが成果の分かれ目です。PoCから全社展開までの段階設計、部門別ユースケース、ROI測定までまとめたAI業務自動化ガイド(220ページ)を無料で公開中です。

まとめ

Microsoft MAIモデル(MAI-Transcribe-1 / MAI-Voice-1 / MAI-Image-2)は、Microsoftが「OpenAI一本足」から「2トラック戦略」へ踏み込んだことを最も象徴するリリースです。3モデルそれぞれの整理を改めて確認しておきます。

- MAI-Transcribe-1

25言語対応・FLEURS精度・$0.36/時間の3点で、音声認識の選定を一段安価な水準に引き下げる存在。長尺音声の全件文字起こしを現実的にする。

- MAI-Voice-1

60秒/1秒の生成速度と10秒サンプルのカスタムボイスで、英語ナレーション・ポッドキャスト用途を中心にカバーする。対応言語は今後拡大予定。

- MAI-Image-2

自然光・肌の質感・画像内文字に強く、Foundry/Copilot上で2倍速い生成。Copilot・Bing Image Creator・PowerPointへの統合で業務系画像生成の現実解になる。

これらは「未知の研究モデル」ではなく、Copilot・Bing Image Creator・PowerPointといった一部のMicrosoft製品で段階展開されてきたモデルを、Foundry経由で開発者向けに開放したものです。Mustafa Suleyman氏の「2027年フロンティア到達」計画に連なるリリースとして、今後はテキスト生成領域でもMAIブランドのモデルが順次登場することが見込まれます。

次の一歩として現実的なのは、自社の音声・画像系ワークフローを棚卸しして「どこにMAIを差し込めるか」を1つだけ決め、MAI Playgroundまたは小さなPoC環境で実測してみることです。価格・速度・精度のいずれも公式公称値が出ているので、自社データでの検証は週単位で進められます。Microsoftの自社モデル路線が本格化する2026年は、Azure導入企業にとって音声・画像系AIのコスト構造を見直す絶好のタイミングと言えます。