この記事のポイント

研究・プロトタイプ開発では動的計算グラフとPythonic記法のPyTorchが第一候補で、論文実装の85%超が採用する事実上の標準

初学者はAnaconda環境でMNIST画像認識から始めるのが最適で、数十行のコードで精度97%超を達成可能

torch.compileで30〜60%の学習高速化が見込めるため、本番運用前に必ず適用すべき最重要オプション

プロダクション展開重視ならTensorFlow、研究最優先ならPyTorch、TPU大規模学習ならJAXを選ぶべきで、用途を無視した選定は避けるべき

クラウドGPU月額2〜50万円のコスト幅があるため、スポットインスタンス活用と混合精度訓練の組み合わせがコスト最適化の鍵

Microsoft MVP・AIパートナー。LinkX Japan株式会社 代表取締役。東京工業大学大学院にて自然言語処理・金融工学を研究。NHK放送技術研究所でAI・ブロックチェーンの研究開発に従事し、国際学会・ジャーナルでの発表多数。経営情報学会 優秀賞受賞。シンガポールでWeb3企業を創業後、現在は企業向けAI導入・DX推進を支援。

PyTorchは、Metaが中心となって開発するオープンソースのディープラーニングフレームワークです。2026年現在バージョン2.10に達し、torch.compileによる30〜60%の学習高速化など、研究から本番運用までを一貫してカバーする基盤として進化を続けています。

この記事では、PyTorchの基本概念と特徴、環境構築からMNIST画像認識の実装例、torch.compileや分散学習などの高度な機能、TensorFlow・JAXとの比較、GPU学習コストの相場までを網羅的に解説します。

目次

PyTorchとは

PyTorchはMeta(旧Facebook)が中心となって開発・公開するオープンソースのディープラーニングフレームワークです。Pythonとの親和性が高く、NumPyのような直感的なテンソル操作とGPU計算最適化を組み合わせることで、研究から実装までをスムーズにつなぎます。2026年3月時点のバージョンは2.10であり、GitHub上のスター数は81,000を超え、深層学習フレームワークの中で最大のコミュニティを形成しています。

公式サイトより引用

公式サイトより引用

現代のディープラーニングにおいて、PyTorchは研究者やエンジニアにとって欠かせないフレームワークです。国際的な機械学習の学会で発表される論文の約70%がPyTorchで実装されており、研究分野では事実上の標準となっています。

PyTorchが注目される最大の要因は動的計算グラフによる自由度の高さです。コードを書きながら即時に実行し、中間結果をデバッグできます。さらにPyTorch 2.0以降で導入されたtorch.compileにより、既存コードに1行追加するだけで30〜60%の高速化が実現可能になりました。

PyTorchの特徴・メリット

PyTorchは、深層学習モデルの開発プロセスをシンプルかつ強力なものにします。ここでは、動的グラフ、Pythonicなコード記法、豊富な拡張ライブラリ群、研究からプロダクションまでの一貫性という4つの特徴を解説します。

動的グラフによる柔軟性とデバッグ容易性

PyTorchはコードを実行するたびに計算グラフを動的に構築します。そのため、複雑なモデルアーキテクチャや条件分岐を直感的に実装できます。中間層の出力を即座に確認できるため、デバッグやモデル改良がスムーズに行えるのが大きな利点です。

Pythonicな記法と直感的なコード記述

PyTorchはPythonで完結する開発スタイルを採用しています。NumPyに似たテンソル操作は学習コストが低く、直感的なモデル定義やトレーニングループの記述が可能です。Pythonの経験があればすぐに馴染むことができます。

豊富なライブラリ・ツールエコシステム

PyTorchには、画像処理用のTorchVision、自然言語処理用のTorchText、オーディオ分析用のTorchAudioなど、分野別に最適化されたライブラリが揃っています。さらにHugging Faceのtransformersライブラリとの統合により、大規模言語モデル(LLM)のファインチューニングも容易に行えます。

研究からプロダクションまでのシームレスな移行

研究段階で作成したモデルを実運用に移行する際、PyTorchはTorchScriptやONNX形式への変換が可能です。PyTorch 2.0以降のtorch.compileを使えば、コード変更なしに推論速度を大幅に改善できます。また、Lightning(旧PyTorch Lightning)を用いることで、テンプレート化されたコードベースで実装スピードと可読性を高められます。

PyTorchの基本的な使い方・環境構築手順

PyTorchを活用するためには、まずは環境構築と基本的な操作手順を理解する必要があります。

このセクションでは、インストールからテンソル操作、ニューラルネットワークの定義、そしてトレーニング手順までを概観します。

基本を押さえることで、高度な応用やモデル拡張もスムーズに行えるようになります。

以降の解説では、Anaconda(Pythonのパッケージマネージャ兼環境管理ツール)を使用します。Anacondaの環境をまだ用意していない方は、Anaconda公式サイトからインストールしてください。デフォルトの設定のまま進めて問題ありません。

また、環境構築が面倒な方は、「実際にPyTorchを用いて画像認識をしてみる」まで進み、コラボラトリーで実行する事も可能です。

ステップ1:仮想環境の作成

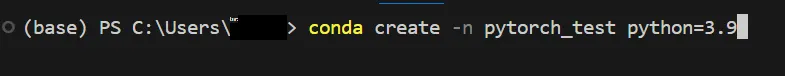

今回は、PyTorchのテストとして、Anacondaでテスト用の新しい仮想環境を作成します。

以下のコマンドを実行して下さい。ここでは、「pytorch_test」という名前で、pythonのバージョンを3.9としています。必要に応じて、変更して下さい。

conda create -n pytorch_test python=3.9

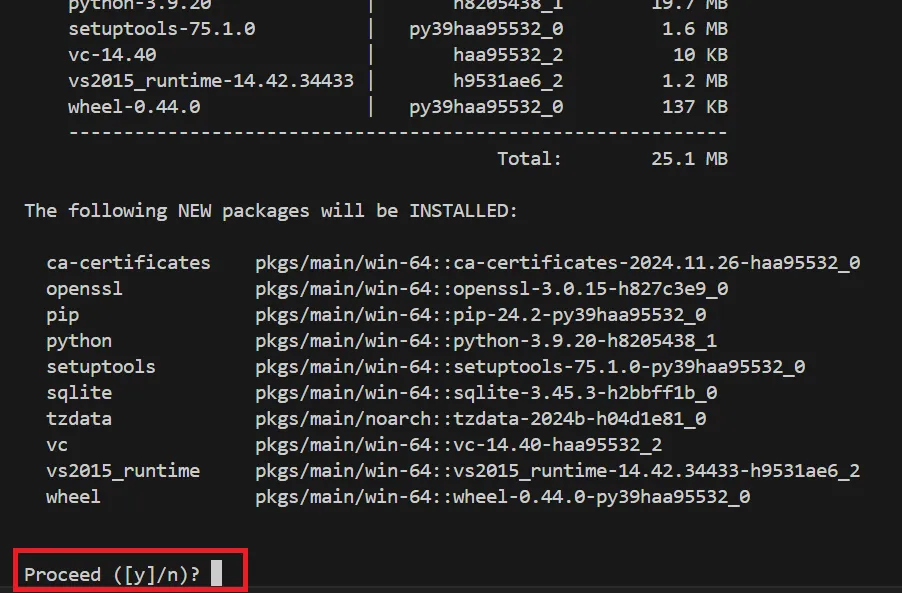

実行すると、途中で以下のように表示されます。

「y」を入力して「Enter」をクリックして下さい。

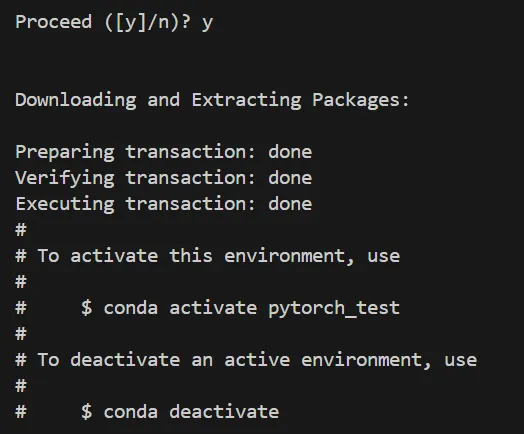

すると、下記のように仮想環境の作成が完了です。

ステップ2:仮想環境を有効化

次に、作成した仮想環境を有効化します。以下のコマンドを実行して下さい。

conda activate pytorch_test

以下のように仮想環境を有効化することが出来ました。

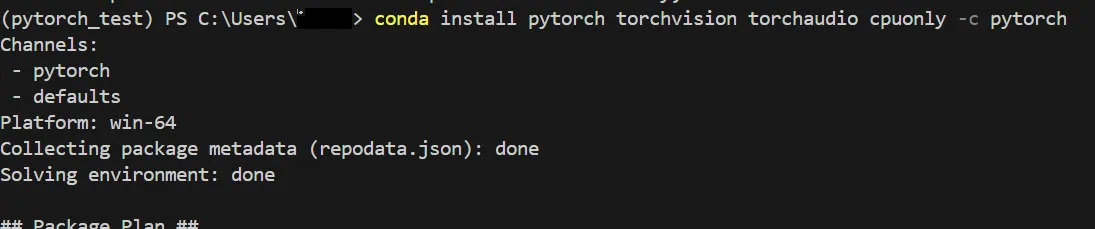

ステップ3:PyTorchのインストール

PyTorchをインストールします。PyTorch公式サイトに記載のインストールコマンドを使用します。

今回は、GPUの無い場合を考慮して、WindowsのCPUのみでPyTorchを動かすようにしています。GPUの用意あったり、別のOSで動かす予定の方は、上記の公式サイトから、該当のインストールコマンドを使用して下さい。

conda install pytorch torchvision torchaudio cpuonly -c pytorch

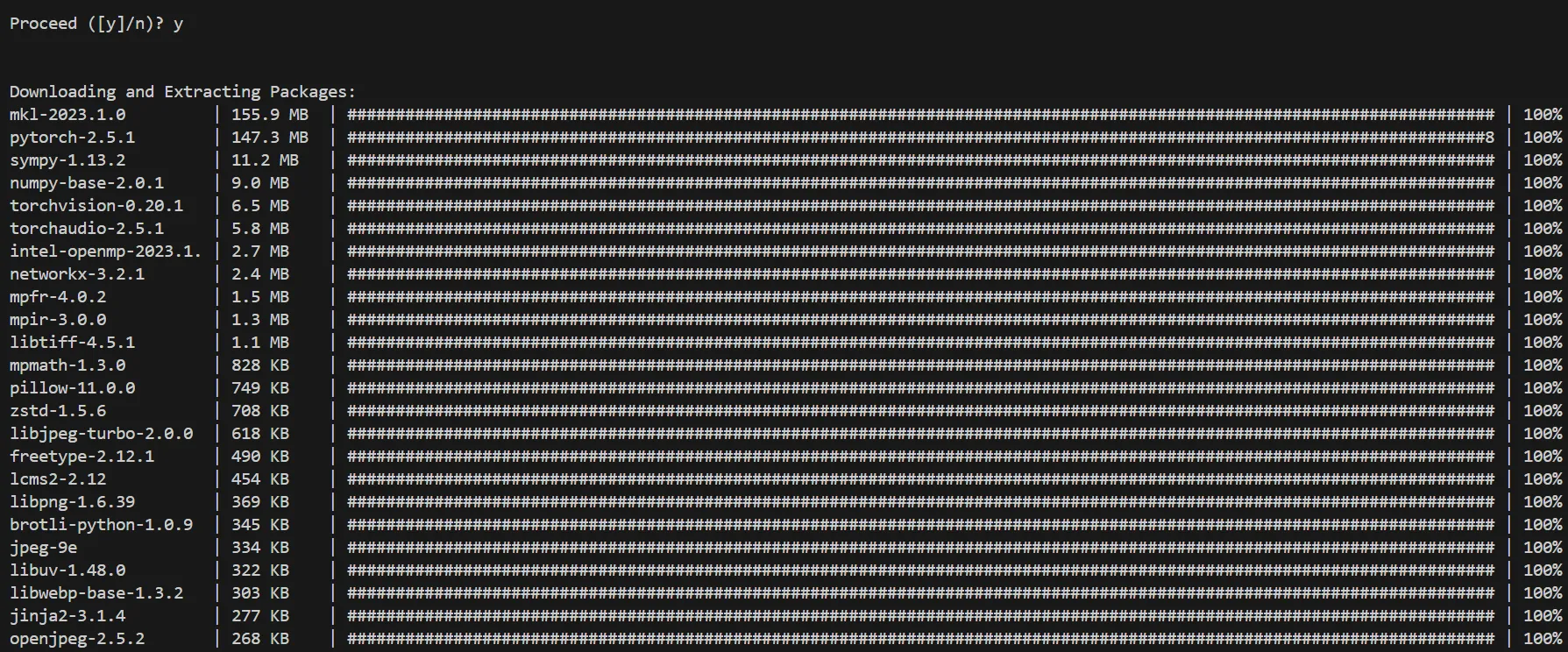

以下は、実行中の画面です。

途中で、先ほどと同様に下記のような表示が出てきます。「y」を入力して「Enter」をクリックして下さい。

すると、以下のようにインストールされていきます。

最終的に、以下のように「done」と表示されたらPyTorchのインストールが終了です。

また、後ほどの解説で使用する「matplotlib」もインストールしておきます。下記のコマンドを実行して下さい。

conda install matplotlib

実行中は先ほどと同様に、「y」を入力して「Enter」をクリックして下さい。

以下のように表示されれば、「matplotlib」のインストールも完了です。

ステップ4:テンソル操作の基本

PyTorchの基礎はテンソル(多次元配列)操作にあります。NumPyのような操作感で、加減乗除や行列演算、GPUへの転送などが簡単にできます。

ここでは、テンソル操作の基本を解説します。

テンソルの作成

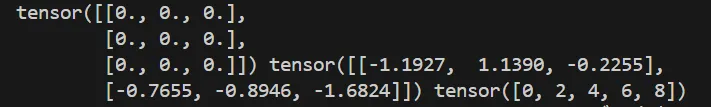

以下は、テンソルを生成する基本操作です。

ゼロテンソルやランダムテンソルは、初期化やデバッグでよく使います。

import torch

# ゼロテンソル

x = torch.zeros(3, 3)

# ランダムテンソル

y = torch.randn(2, 3)

# 範囲指定テンソル

z = torch.arange(0, 10, 2)

print(x, y, z)

上記を実行すると、以下のように出力されました。

形状変換

モデル構築時に、テンソルの形を変えるのは非常に重要です。データのバッチ処理や次元操作に使います。

x = torch.randn(2, 3)

# リサイズ

y = x.view(3, 2)

# 次元を追加

z = x.unsqueeze(0)

# 次元を削除

w = z.squeeze()

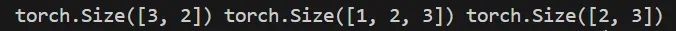

print(y.shape, z.shape, w.shape)

上記を実行すると、以下のように出力されました。

GPUへの転送

PyTorchの強みであるGPU処理を活用するための基本操作です。GPUで計算する事で、学習速度が飛躍的に向上します。

if torch.cuda.is_available():

# GPUへ転送

x = torch.randn(2, 2).cuda()

print(x)

# CPUへ戻す

x = x.cpu()

print(x)

実際にPyTorchを用いて画像認識をしてみる

具体的な例として、画像認識モデル(MNIST手書き数字分類)をPyTorchで構築します。実際のコードに触れることで、画像認識の全体的な流れが明確になります。

MNISTとは、0〜9の手書き数字画像を集めたデータセットです。28x28ピクセルの白黒画像で構成されており、訓練用60,000枚、テスト用10,000枚が含まれています。機械学習や深層学習の入門に最適な教材として広く利用されています。

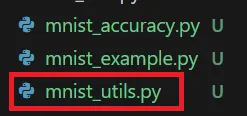

### モジュールファイルの作成

まずは、全体のコードを紹介します。適当なPythonファイルにコピペして保存して下さい。今回筆者は、「mnist_utils.py」という名前で保存しています。

import os

import torch

import torch.nn as nn

import torch.optim as optim

from torch.utils.data import DataLoader

from torchvision import datasets, transforms

# データローダーを作成

def get_dataloaders(batch_size=64):

transform = transforms.Compose([transforms.ToTensor(), transforms.Normalize((0.5,), (0.5,))])

train_dataset = datasets.MNIST(root='./data', train=True, download=True, transform=transform)

test_dataset = datasets.MNIST(root='./data', train=False, download=True, transform=transform)

train_loader = DataLoader(train_dataset, batch_size=batch_size, shuffle=True)

test_loader = DataLoader(test_dataset, batch_size=batch_size, shuffle=False)

return train_loader, test_loader

# モデル定義

class SimpleCNN(nn.Module):

def __init__(self):

super(SimpleCNN, self).__init__()

self.conv1 = nn.Conv2d(1, 32, kernel_size=3)

self.relu = nn.ReLU()

self.flatten = nn.Flatten()

self.fc = nn.Linear(32 * 26 * 26, 10)

def forward(self, x):

x = self.conv1(x)

x = self.relu(x)

x = self.flatten(x)

x = self.fc(x)

return x

# モデルの学習

def train_model(model, train_loader, epochs=5, learning_rate=0.001):

criterion = nn.CrossEntropyLoss()

optimizer = optim.Adam(model.parameters(), lr=learning_rate)

for epoch in range(epochs):

model.train()

running_loss = 0.0

for images, labels in train_loader:

optimizer.zero_grad()

outputs = model(images)

loss = criterion(outputs, labels)

loss.backward()

optimizer.step()

running_loss += loss.item()

print(f"Epoch {epoch+1}/{epochs}, Loss: {running_loss/len(train_loader)}")

# モデルを保存

def save_model(model, path):

torch.save(model.state_dict(), path)

print(f"Model saved to {path}")

# モデルを読み込み

def load_model(path):

model = SimpleCNN()

model.load_state_dict(torch.load(path))

model.eval()

return model

# テスト精度の計算

def evaluate_model(model, test_loader):

correct = 0

total = 0

class_correct = [0] * 10

class_total = [0] * 10

with torch.no_grad():

for images, labels in test_loader:

outputs = model(images)

_, predicted = torch.max(outputs, 1)

total += labels.size(0)

correct += (predicted == labels).sum().item()

for i in range(len(labels)):

label = labels[i].item()

if predicted[i] == label:

class_correct[label] += 1

class_total[label] += 1

# 全体精度

overall_accuracy = 100 * correct / total

# クラスごとの精度

class_accuracies = {

i: 100 * class_correct[i] / class_total[i] if class_total[i] > 0 else None

for i in range(10)

}

return overall_accuracy, class_accuracies

上記のコードは、以下のような動作を記述しています。

- 「get_dataloaders()」を呼び出してデータを準備する。

- 「SimpleCNN」クラスでモデルを定義する。

- 「train_model()」を使ってモデルを訓練する。

- 「save_model()」で学習済みモデルを保存する。

- 「load_model()」で保存済みモデルを読み込む。

- 「evaluate_model()」を使ってテストデータで精度を確認する。

上記のPythonファイルは直接実行しません。コードを保存し終えたら、次の「認識精度の確認」へ進んでください。

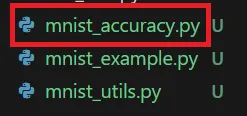

認識精度の確認

次に、先ほど作成したモジュールファイルを使用して、MNISTデータセットへのモデルの認識精度を確認します。

同じく、適当なPythonファイルにコピペして保存して下さい。筆者は、「mnist_accuracy.py」という名前で保存しています。

import os

import torch

from mnist_utils import SimpleCNN, get_dataloaders, train_model, save_model, load_model, evaluate_model

# データローダーの準備

train_loader, test_loader = get_dataloaders()

# モデルの準備

model_path = "mnist_simplecnn.pth"

if os.path.exists(model_path):

print("Saved model found. Loading...")

model = load_model(model_path)

else:

print("No saved model found. Training the model...")

model = SimpleCNN()

train_model(model, train_loader)

save_model(model, model_path)

# モデルの評価

overall_accuracy, class_accuracies = evaluate_model(model, test_loader)

# 結果の表示

print(f"Overall Accuracy: {overall_accuracy:.2f}%")

print("Class-wise Accuracy:")

for class_id, accuracy in class_accuracies.items():

if accuracy is not None:

print(f"Class {class_id}: {accuracy:.2f}%")

else:

print(f"Class {class_id}: No samples")

上記のコードは簡単に言うと、以下のような処理を実行します。

- 「get_dataloaders()」を呼び出して、学習用とテスト用のデータローダーを準備する。

- モデルが保存されているか確認する。

- 保存済みモデルがあれば、load_model()でモデルを読み込む。

- 保存済みモデルがなければ、「impleCNN」クラスで新しいモデルを作成し、「train_model()」で学習させ、「save_model()」で保存する。

- 「evaluate_model()」を使ってテストデータでモデルの精度を計算する。

- 全体精度とクラスごとの精度を表示する。

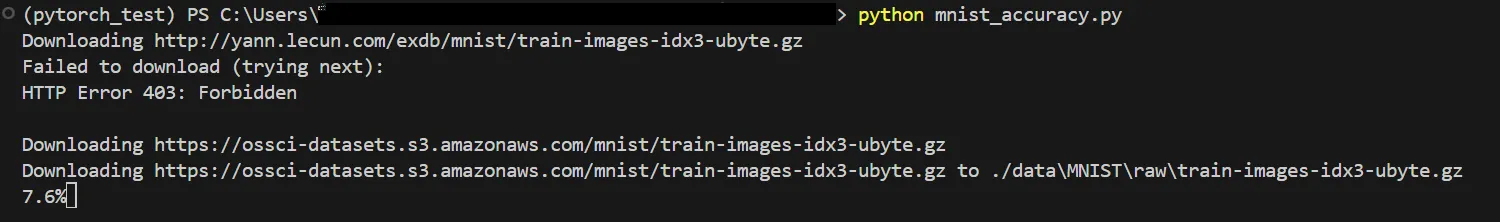

それでは、実際に上記のコードを実行して見ます。以下のコマンドで実行できます。

python mnist_accuracy.py

実行すると、まずは以下のようにMNISTのデータセットをダウンロードします。エラー文が出ていますが、特に気にしなくて大丈夫です。

下記のように、新しく「data」という名前のディレクトリが作成され、その中にMNISTのデータセットが保存されています。

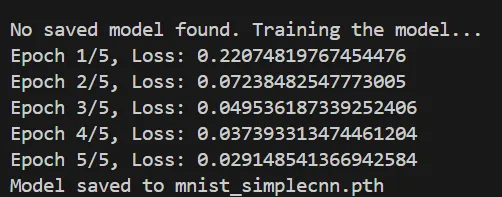

そのまま待っていると、下記のように学習が進行・完了し、学習が完了したモデルは「mnist_simplecnn.pth」という名前で保存されます。

以下のように保存を確認出来ました。

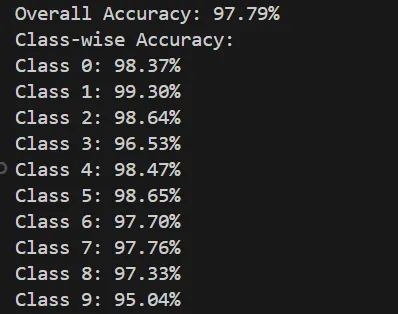

さらにその後、下記のように、用意したMNISTのテストデータへの平均正答率と、各ラベル(0~9の数字)の正答率が表示されます。この正答率は、今回のモデルの精度を表しています。

今回は、0~9の手書き数字10000枚に対して、97.79%の精度で認識できていることが分かります。

また、「1」が99.30%と最も精度良く認識できている事が分かります。

これは、数字の概形的に、「1」は他の数字だと誤認しにくいからであると考えることが出来ます。

画像認識テスト

最後に、1枚の画像を取り出し、先ほど用意した学習済みのモデルを用いて、画像認識のテストをしてみます。

筆者は、「mnist_example.py」という名前で保存しています。

import random

import torch

import matplotlib.pyplot as plt

from mnist_utils import SimpleCNN, get_dataloaders, load_model

# データローダーの準備(テストデータのみ使用)

_, test_loader = get_dataloaders()

test_dataset = test_loader.dataset

# 保存済みモデルをロード

model_path = "mnist_simplecnn.pth"

model = load_model(model_path)

# ランダムな画像を選択

random_index = random.randint(0, len(test_dataset) - 1) # ランダムインデックス

image, label = test_dataset[random_index] # ランダムな画像とラベルを取得

# モデルで予測

with torch.no_grad():

output = model(image.unsqueeze(0)) # バッチ次元を追加

_, predicted = torch.max(output, 1) # 予測クラスを取得

# 画像を表示

plt.imshow(image.squeeze(), cmap="gray")

plt.title(f"True Label: {label}, Predicted: {predicted.item()}")

plt.axis("off")

plt.show()

それでは、MNISTのデータセットからランダムに一枚の画像を取り出し、学習済みのモデルを使用して認識をチェックします。以下のコマンドを使用し、上記のコードを実行します。

python mnist_example.py

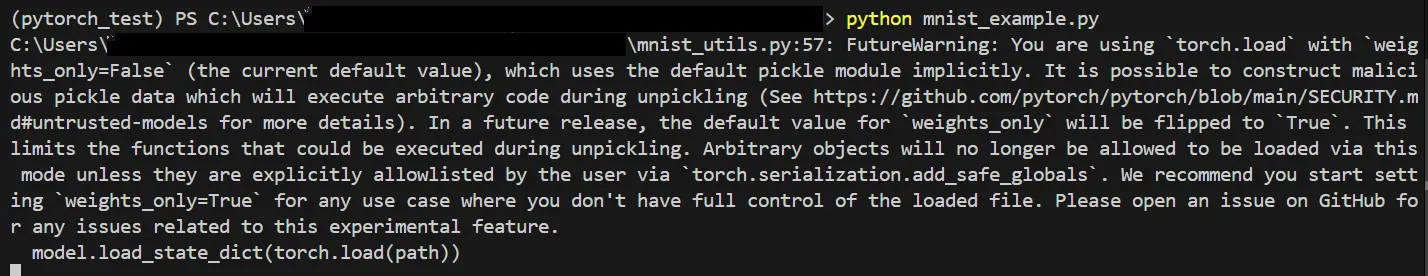

実行すると、下記のように注意喚起の文章が表示されますが、無視で大丈夫です。

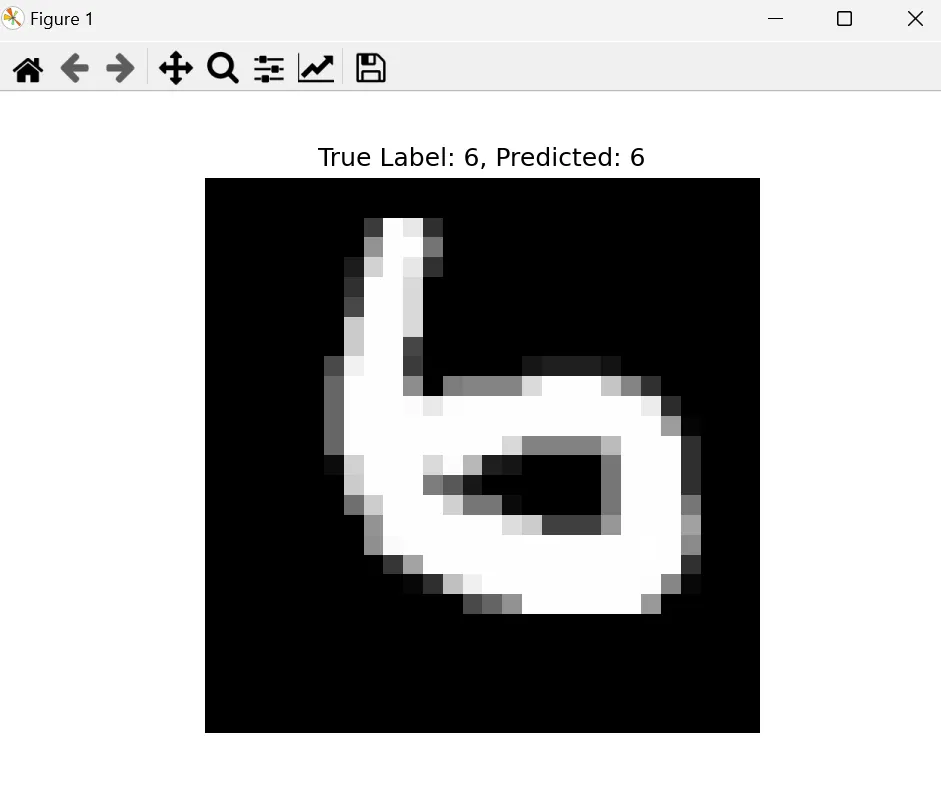

すると、以下のように画像認識の結果が表示されます。

真ん中に大きく表示されている画像が、今回テストに用いた手書き画像です。

私たちが書かれている数字を「6」であると認識出来る通り、画像上部の左側には、「True Label:6」と記載されています。これは、正解が「6」であるという事です。

次に、画像上部の右側には、「Predicted:6」と記載されています。これは、先ほど作成した学習済みのモデルが、数字を「6」だと認識した事を表しています。

このように、PyTorchを用いたCNNによって、画像認識モデルを作成し、実際に画像認識を行う事が出来ました。

AIによる画像認識の仕組みと活用事例については別記事で詳しく解説しています。

仮想環境の削除

今回の解説に際して作成した仮想環境が不要な方は、以下のコマンドで削除する事が出来ます。

conda remove -n pytorch_test --all

PyTorchを用いた高度なトピック

基礎を押さえた後は、高度な機能やツールを活用することで、性能向上や開発効率化を図ることができます。

転移学習、分散学習、torch.compile、エッジ展開といった主要テーマについて解説します。

torch.compileによる高速化

PyTorch 2.0で導入されたtorch.compileは、既存のPyTorchコードに1行追加するだけで30〜60%の学習・推論高速化を実現する機能です。Pythonコードをグラフレベルで最適化し、カーネル融合やメモリアクセスの効率化を自動的に行います。

2026年現在のバージョン2.10では、リージョナルコンパイルによってコールドスタート時間が大幅に短縮されており、本番環境での実用性がさらに高まっています。

転移学習とファインチューニング

学習済みの大規模モデル(ResNet、Vision Transformer、BERTなど)を再利用し、新しいタスクに適用する手法です。事前学習済みモデルの特徴を活かすことで、少ないデータと計算コストで高精度なモデルを構築できます。

ファインチューニングでは、学習済みモデルの一部または全体を微調整して、特定の課題に最適化します。Hugging Faceのtransformersライブラリと組み合わせることで、LLMのファインチューニングも効率的に行えます。

分散学習とマルチGPUサポート

torch.distributedを使用して、複数のGPUや複数のマシンにまたがる大規模データセットの学習が可能です。PyTorchのFSDP(Fully Sharded Data Parallel)により、数十億パラメータ規模のモデルでもメモリ効率の良い分散学習を実現できます。

単一マシンで複数GPUを活用する場合も、DataParallelやDistributedDataParallelで計算負荷を分散し、学習速度を向上させられます。

TorchScriptとONNX形式への変換

TorchScriptは、PyTorchモデルを最適化して保存し、C++ランタイム上で実行する仕組みです。推論速度の向上やリソース制約のある環境でのデプロイに適しています。

ONNX形式に変換すると、TensorRTやOpenVINOなど他の推論エンジンでもモデルを実行できるようになります。プラットフォームごとに最適な推論環境を選択できる柔軟性が得られます。

ExecuTorchによるエッジ展開

ExecuTorchは、PyTorch Mobileの後継として開発されたエッジ向けデプロイフレームワークです。スマートフォン、IoTデバイス、ウェアラブル端末などのリソース制約がある環境でPyTorchモデルを実行できます。

モデルの量子化やプルーニングと組み合わせることで、推論速度とメモリ使用量を最適化し、リアルタイム処理が求められるエッジアプリケーションへの展開が可能です。

Lightningの活用

Lightning(旧PyTorch Lightning)は、コードの可読性と再利用性を高めるフレームワークです。モデル定義やトレーニングループをテンプレート化し、分散学習やmixed precisionの設定もフラグひとつで切り替えられます。

大規模プロジェクトでも統一されたコード構造を維持でき、研究コードをそのまま本番環境に持ち込む際の工数を削減します。

PyTorch導入事例・活用例

PyTorchはアカデミックな研究だけでなく、ビジネスや産業界でも幅広く利用されています。2026年時点で、研究論文の約70%、Hugging Face上のモデルの80%以上がPyTorchで実装されており、事実上の標準フレームワークとしての地位を確立しています。

研究分野での利用例

NeurIPSやICMLなどの国際学会で発表される論文の大半がPyTorchで実装されています。画像生成分野では拡散モデル(Stable Diffusion、DALL-E)、自然言語処理分野ではGPTやLLaMAといった大規模言語モデルの学習基盤としてPyTorchが採用されています。

画像処理の応用技術であるControlNetもPyTorchで実装されており、研究から実用までを一貫してカバーしています。

企業での実装事例

製造業では品質検査や異常検知、医療分野では画像診断支援など、多岐にわたる領域でPyTorchモデルが実運用されています。MetaはPyTorchを自社のレコメンドエンジンやコンテンツモデレーションに活用しており、Teslaの自動運転システムでもPyTorchベースのモデルが稼働しています。

国内では、製造業の外観検査やリテール業の需要予測などでPyTorchモデルの導入が進んでいます。AIによる画像認識サービスの比較と活用事例も参考にしてください。

実務プロダクトでのデプロイ

TorchServeを用いると、学習済みモデルをWeb API化し、クラウド上にデプロイできます。AWS SageMakerやGoogle Cloud Vertex AIなどのマネージドサービスとの統合も進んでおり、スケーラブルな推論環境の構築が容易になっています。

エッジデバイスへの展開にはExecuTorchが利用でき、スマートフォンやIoT機器での推論をサポートします。

PyTorch・TensorFlow・JAXの比較

左:PyTorchの公式サイトより引用、右:TensorFlowの公式サイトより引用

左:PyTorchの公式サイトより引用、右:TensorFlowの公式サイトより引用

2026年現在、ディープラーニングフレームワークの選択肢はPyTorch、TensorFlow、JAXの3つが主流です。以下の比較表で、各フレームワークの特性を整理しました。プロジェクトの要件に応じた選定の判断材料として活用してください。

| 項目 | PyTorch | TensorFlow | JAX |

|---|---|---|---|

| 開発元 | Meta | Google Research | |

| GitHubスター数 | 約81,000 | 約74,000 | 約35,000 |

| 計算グラフ | 動的(Eager) | 静的+Eager | 関数変換ベース |

| 高速化手法 | torch.compile | XLA | JIT+XLA |

| TPUサポート | 限定的 | ネイティブ | ネイティブ |

| 研究論文採用率 | 約70% | 約20% | 約10% |

| エッジ展開 | ExecuTorch | TFLite | 非対応 |

| 高レベルAPI | Lightning | Keras 3.0 | Flax/Optax |

| 主な用途 | 研究・プロダクション | プロダクション・モバイル | 大規模学習・TPU活用 |

この比較から分かるのは、研究から本番運用までの一貫性ではPyTorchが優位であり、TPUを活用した大規模学習ではJAXが性能面で強みを持つという点です。TensorFlowはKeras 3.0でバックエンド非依存のAPIを提供しており、PyTorch・JAXのバックエンドとしても利用可能になっています。

開発フローの違い

TensorFlowは元々静的計算グラフを採用していましたが、後にEager Executionを導入して柔軟性を改善しています。PyTorchは動的計算グラフにより、コードの修正やデバッグが容易で、試行錯誤を繰り返す研究やプロトタイプ開発に適しています。

JAXはNumPyライクな関数型APIを採用し、jitによる自動コンパイル、vmapによる自動ベクトル化、gradによる自動微分をシンプルに組み合わせられる設計です。

学習速度・性能面の差異

GPUクラスタ環境ではPyTorchとTensorFlowの性能差はモデルやハードウェア構成によって異なります。TensorFlowはGoogleが開発したTPUをネイティブに活用でき、特定の環境では高い効率を発揮します。

JAXはTPU上でPyTorchの1.2〜2.5倍、GPU上でも1.1〜1.8倍の速度優位性があるとされており、大規模モデルの学習では有力な選択肢です。ただし、エコシステムの成熟度やデバッグの容易さではPyTorchに及びません。

フレームワーク選定の判断基準

実務での選定は、チームのスキルセットと用途で決まります。研究やプロトタイピングにはPyTorchが最適です。TPUを活用した大規模学習が主目的ならJAXを検討する価値があります。既存のTensorFlowコードベースがある場合は、Keras 3.0への移行で将来の柔軟性を確保できます。

TensorFlowの詳細な解説も参考にしてください。

PyTorch利用時のよくある質問(FAQ)

PyTorchを実務で活用する際に直面しやすい課題について、Q&A形式でまとめました。

GPUメモリが不足して学習が進まない場合は?

バッチサイズを減らすのが最も簡単な対策です。また、Mixed Precision Training(torch.cuda.amp)を活用することで、メモリ使用量を大幅に削減できます。

高メモリ搭載のGPUを利用するか、Gradient Checkpointingで中間計算を再計算に切り替えることも有効です。

学習速度を上げるには?

以下の方法が効果的です。

-

torch.compileの適用

既存コードに1行追加するだけで30〜60%の高速化が見込めます

-

データローダーの最適化

num_workersを増やしてデータローディングを並列化します

-

高速GPUの利用

RTX 4090やA100、H100など演算性能の高いGPUを選択します

-

プロファイリングによるボトルネック特定

torch.profilerでCPU/GPU間の待機時間やメモリ使用パターンを可視化し、最適化すべき箇所を特定します

GPU(グラフィックボード)の選び方については別記事で詳しく解説しています。

学習済みモデルをどのようにデプロイすれば良いか?

TorchScript形式(torch.jit.traceまたはtorch.jit.script)に変換すると推論が高速化します。TorchServeを使えばモデルをAPIとして提供でき、AWS SageMakerやGoogle Cloud Vertex AIなどのマネージドサービスとの統合も可能です。

ONNX形式への変換により、TensorRTやOpenVINOでの高速推論も実現できます。

モバイル・エッジデバイスでPyTorchモデルを使用できるか?

ExecuTorch(PyTorch Mobileの後継)を利用することで、AndroidやiOSデバイス、IoT機器にモデルを展開できます。量子化やプルーニングと組み合わせることで、リソース制約のある環境でも効率的に動作します。

PyTorchをバージョンアップした場合、コードが動かなくなる可能性は?

基本的に後方互換性が保たれていますが、新バージョンでは一部のAPIが非推奨になることがあります。リリースノートの確認と、テスト環境での事前動作確認を推奨します。

どのPyTorchバージョンを選ぶべきか?

安定した環境を求める場合は最新の安定版を利用してください。2026年3月時点の最新安定版はPyTorch 2.10です。torch.compileの最新最適化を活用するためにも、可能な限り最新バージョンへの更新を推奨します。

PyTorchの学習・運用コスト

PyTorchのフレームワーク自体は無料ですが、実務でモデルを学習・運用する際にはGPUインスタンスの費用が発生します。以下の表でクラウドGPUサービスの価格帯を整理しました。

| GPU種別 | 用途 | 月額コスト目安 | 提供サービス |

|---|---|---|---|

| T4(16GB) | 小規模学習・推論 | 約2〜5万円 | AWS, GCP, Azure |

| A10G(24GB) | 中規模学習 | 約5〜15万円 | AWS, GCP |

| A100(80GB) | 大規模LLM学習 | 約20〜50万円 | AWS, GCP, Azure |

| H100(80GB) | 最大規模学習 | 約40〜80万円 | AWS, GCP, Azure |

この価格帯はオンデマンドインスタンスの場合です。スポットインスタンス(AWS)やプリエンプティブVM(GCP)を活用すると、60〜80%のコスト削減が可能です。ただし、中断リスクがあるため、チェックポイント保存の仕組みを組み込む必要があります。

コスト最適化の実務指針

GPU費用は学習フェーズで集中的に発生するため、以下のポイントを押さえることでコストを抑えられます。

-

torch.compileの適用

学習時間を30〜60%短縮でき、その分GPU利用料を直接削減できます

-

Mixed Precision Training

FP16やBF16を活用することで、同じGPUでより大きなバッチサイズを処理でき、学習効率が向上します

-

スポットインスタンスの活用

定常的な学習タスクではなく、バースト的な学習にはスポットインスタンスが費用対効果に優れます

-

段階的なGPU選定

プロトタイプはT4で検証し、本番学習にA100やH100を使うという段階的なアプローチが合理的です

個人学習や小規模プロジェクトであれば、Google ColabのGPU環境(無料枠あり、月額1,179円〜のPro版)から始めるのが最も手軽です。

DLフレームワークの実装力を組織のAI戦略に発展させるなら

PyTorchでモデルの設計からGPU学習、デプロイまでを経験した方は、AIの「実装コスト」と「運用コスト」を肌感覚で理解しています。この知見は、組織全体にAIを導入する際に「どの業務から着手し、どこまでスケールさせるか」を現実的に設計するための重要な判断材料になります。

AI総合研究所では、Microsoft環境でのAI業務自動化を段階的に進めるための実践ガイド(220ページ)を無料で提供しています。Copilot ChatからCopilot Studio、Microsoft Foundryへと段階的にスケールする設計手順を、部門別のBefore/After・KPI付きで解説しています。torch.compileでの最適化や分散学習でコスト管理を経験した方にこそ、組織導入における「段階設計とROI管理」の重要性が伝わる内容です。

AI総合研究所の専任チームが、DL実装の経験を組織のAI導入戦略に接続するところまで支援します。まずはガイドで自社環境に合った段階設計をご確認ください。

DLフレームワークの知見を組織導入に活かす

実装力から組織のAI戦略設計へ

PyTorchでモデル実装の経験を積んだなら、次は組織としてAIを業務に組み込む設計力が問われます。Microsoft環境での段階的導入を220ページの実践ガイドで解説しています。

まとめ

PyTorchは、研究から本番運用までを一貫してカバーするディープラーニングフレームワークとして、2026年現在も進化を続けています。本記事で解説した内容から、以下の3つの価値を整理します。

1つ目は、動的計算グラフとPythonicな記法による開発効率の高さです。Pythonの知識があればすぐに使い始めることができ、torch.compileによる30〜60%の高速化も既存コードへの変更なしに実現できます。

2つ目は、エコシステムの充実度です。Hugging Faceとの統合、TorchVision/TorchText/TorchAudioなどの分野別ライブラリ、ExecuTorchによるエッジ展開まで、学習からデプロイまでの全工程をカバーしています。

3つ目は、コミュニティの規模と実績です。GitHub 81,000スター、論文採用率約70%という数字が示すとおり、最先端の研究成果に最も早くアクセスできるフレームワークです。

PyTorchを導入する際は、まずAnaconda環境で小規模なモデル(本記事のMNIST実装など)を動かし、torch.compileの効果を確認した上で、本格的なプロジェクトに展開していくことを推奨します。