この記事のポイント

Copilot Free/Pro/Pro+ユーザーは学習利用を避けたいなら4月24日までに設定の事前確認が必要

Business/Enterpriseプランなら今回の変更は対象外、追加対応は不要

個人管理のprivate repositoryではCopilot利用中のインタラクションデータが学習対象になりうる(paid organization配下は除外)

オプトアウトしても利用可能な機能が制限されるとの説明はなく、懸念がある場合は無効化を検討

個人プランで機密性の高いコードを扱うならBusinessプラン移行も選択肢

Microsoft MVP・AIパートナー。LinkX Japan株式会社 代表取締役。東京工業大学大学院にて自然言語処理・金融工学を研究。NHK放送技術研究所でAI・ブロックチェーンの研究開発に従事し、国際学会・ジャーナルでの発表多数。経営情報学会 優秀賞受賞。シンガポールでWeb3企業を創業後、現在は企業向けAI導入・DX推進を支援。

2026年3月25日、GitHubはCopilot Free / Pro / Pro+ユーザーのインタラクションデータを、AIモデルの学習・改善に使用する方針変更を発表しました。

本記事では、学習対象になるデータの範囲やprivate repositoryの扱い、対象外のBusiness / Enterpriseプラン、そしてオプトアウトの具体的な設定手順を、GitHub公式の一次情報に基づいて整理します。

【⚠️重要】2026年6月1日からGitHub Copilotはプレミアムリクエスト方式から従量課金(GitHub AIクレジット)方式へ移行します。詳細は【2026年6月】GitHub Copilot 従量課金移行解説をご覧ください。

目次

【重要】2026年6月1日からのGitHub AIクレジット移行

GitHub Copilotの学習データ利用変更はいつから適用されるか

GitHub Copilotで学習対象になるプランと対象外プラン

対象外:Copilot Business / Enterprise

GitHub Copilotの学習利用をオプトアウトする方法

GitHub Copilotのオプトアウトで確認すべき実務ポイント

GitHub Copilotの学習データ利用変更とは

GitHub Copilotの学習データ利用変更とは、2026年3月25日にGitHubが発表したCopilot個人向けプランのインタラクションデータをAIモデルの学習に使用するというポリシー変更です。

具体的には、Copilot Free / Pro / Pro+ユーザーがCopilotを利用した際のやり取り——入力したプロンプト、生成されたコード提案、その周辺のコンテキスト——が、GitHubのAIモデル改善に使われるようになります。この設定はデフォルトで有効化されるため、学習に使われたくない場合はユーザー自身がオプトアウト(無効化)する必要があります。

GitHubのCPO(最高プロダクト責任者)であるMario Rodriguez氏は、公式ブログで「参加することで、開発ワークフローへの理解を深め、より正確で安全なコードパターン提案の実現に貢献できる」と説明しています。

変更の背景と経緯

今回の変更には技術的な背景があります。GitHubは過去1年間、Microsoft社員のCopilotインタラクションデータを学習に活用してきました。その結果、複数のプログラミング言語でコード提案の受け入れ率が向上するなど、性能面で有意な改善が見られたとしています。

この成果を個人ユーザーのデータにも広げることで、モデル全体の精度を引き上げるのが今回の方針変更の目的です。GitHubはこのアプローチについて、AnthropicやJetBrains、Microsoftなど他社も同様のオプトアウト方式を採用していると説明しています。

ただし、コードリポジトリには企業の知的財産や機密情報が含まれることがあり、他のサービスとは事情が異なるという指摘もあります。この点については「実務ポイント」のセクションで掘り下げます。

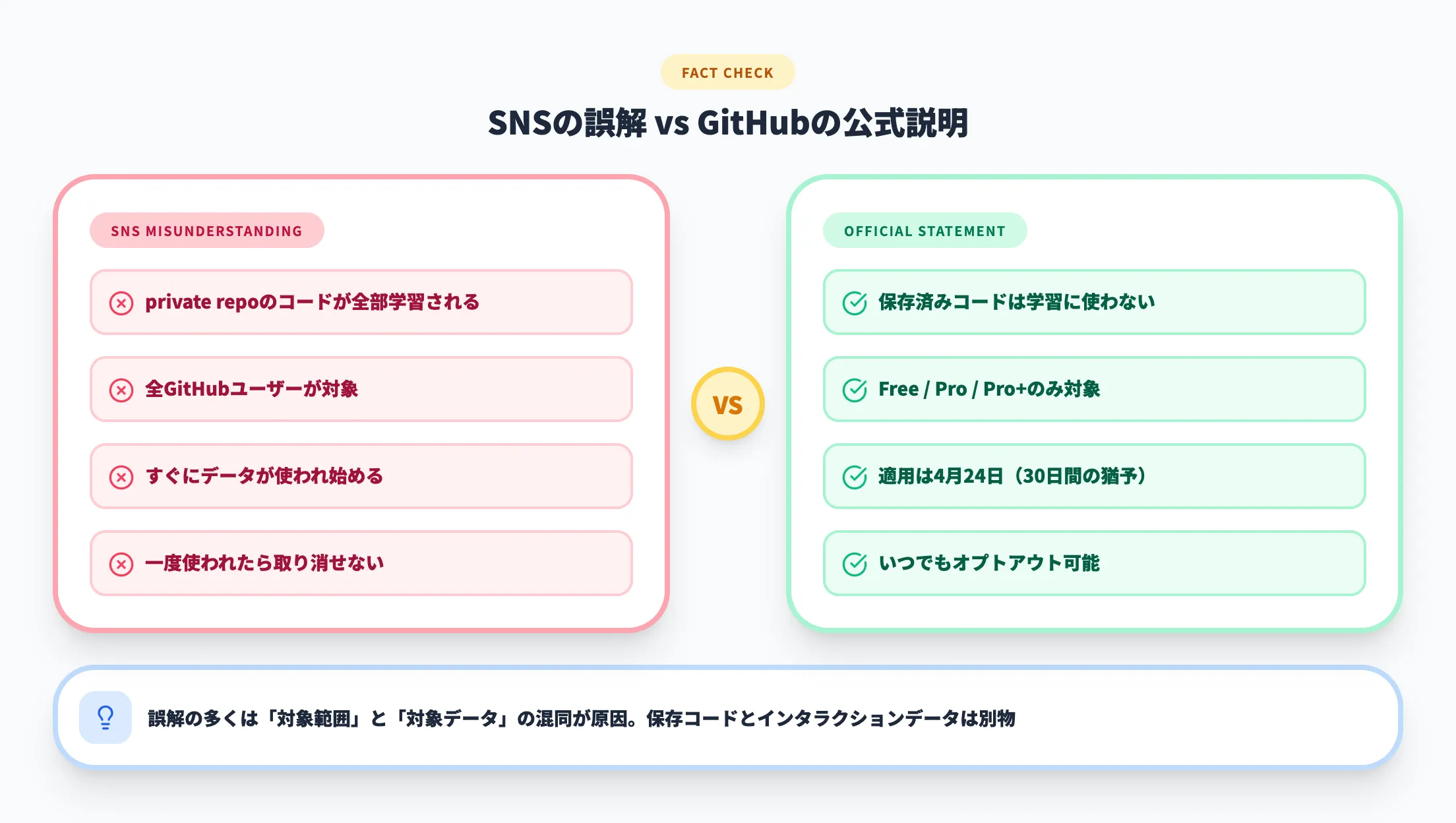

SNSで広がった誤解と公式説明の違い

この発表を受けて、SNS上では「GitHubがprivate repositoryのコードを勝手に学習する」「すべてのGitHubユーザーが対象になる」といった投稿が広がりました。しかし、公式説明と照らし合わせると、いくつかの重要な違いがあります。

以下の表で、SNSで見られた主な誤解と、GitHubの公式説明を対比しました。

| SNSで広がった言い回し | GitHubの公式説明 |

|---|---|

| private repoのコードが全部学習される | private repositoryの保存済みコードは学習に使わない |

| 全ユーザーが対象になる | 対象はFree / Pro / Pro+のみ。Business / Enterpriseは対象外 |

| すぐにデータが使われ始める | 適用開始は2026年4月24日。30日間の猶予がある |

| 一度使われたら取り消せない | 設定画面からいつでもオプトアウト可能 |

誤解の多くは「対象範囲」と「対象データ」の混同から生じています。GitHubが学習に使うのはCopilot利用中のインタラクションデータ(Copilotとのやり取りで送受信されるデータ)であり、リポジトリに保存されているコードそのものではありません。この違いは記事の後半で詳しく解説します。

とはいえ、「デフォルトで有効化」というアプローチに対して開発者コミュニティからは強い反発が出ています。GitHub Community Discussionsの投稿では反発や懸念の声が上がっており、批判の焦点は、オプトアウトではなくオプトイン(明示的な同意)にすべきだという点に集中しています。

【重要】2026年6月1日からのGitHub AIクレジット移行

GitHubは2026年4月27日、Copilot全プランをプレミアムリクエスト方式からGitHub AIクレジット制(使用量ベース請求) へ移行することを発表しました(2026年6月1日施行)。学習データ利用のオプトアウト(本記事のテーマ)とは別軸ですが、料金体系も同じ6/1にPRUからAIクレジット制(使用量ベース請求)へ切り替わります。法人プラン(Business/Enterprise)には6〜8月の移行支援プロモが用意されます。

詳しくはGitHub Copilot従量課金への移行を徹底解説【2026年6月】で解説しています。

GitHub Copilotの学習データ利用変更はいつから適用されるか

GitHub Copilotの学習データ利用変更は、2026年4月24日から適用されます。GitHubは発表日(2026年3月25日)から適用日まで30日間の猶予期間を設けており、この間にユーザーが設定を確認・変更できるようにしています。

発表から適用までのスケジュール

以下の表で、今回の変更に関する主要な日程を整理しました。

| 日付 | 内容 |

|---|---|

| 2026年3月25日 | GitHubがPrivacy StatementとTerms of Serviceの更新を発表 |

| 2026年3月25日 | 対象ユーザーへ30日前告知 |

| 2026年4月24日 | 新しいポリシーが適用開始。オプトアウトしていないユーザーのデータが学習対象になる |

4月24日を過ぎてからオプトアウトすることも可能ですが、それまでの間に収集されたインタラクションデータは、学習対象として扱われる可能性があります。学習に使われたくない場合は、4月24日より前に設定を変更しておくのが確実です。

GitHub Copilotで学習対象になるプランと対象外プラン

今回の変更で最も重要なのは、すべてのCopilotユーザーが対象ではないという点です。対象となるのは個人向けプランのみで、法人向けプランは対象外です。

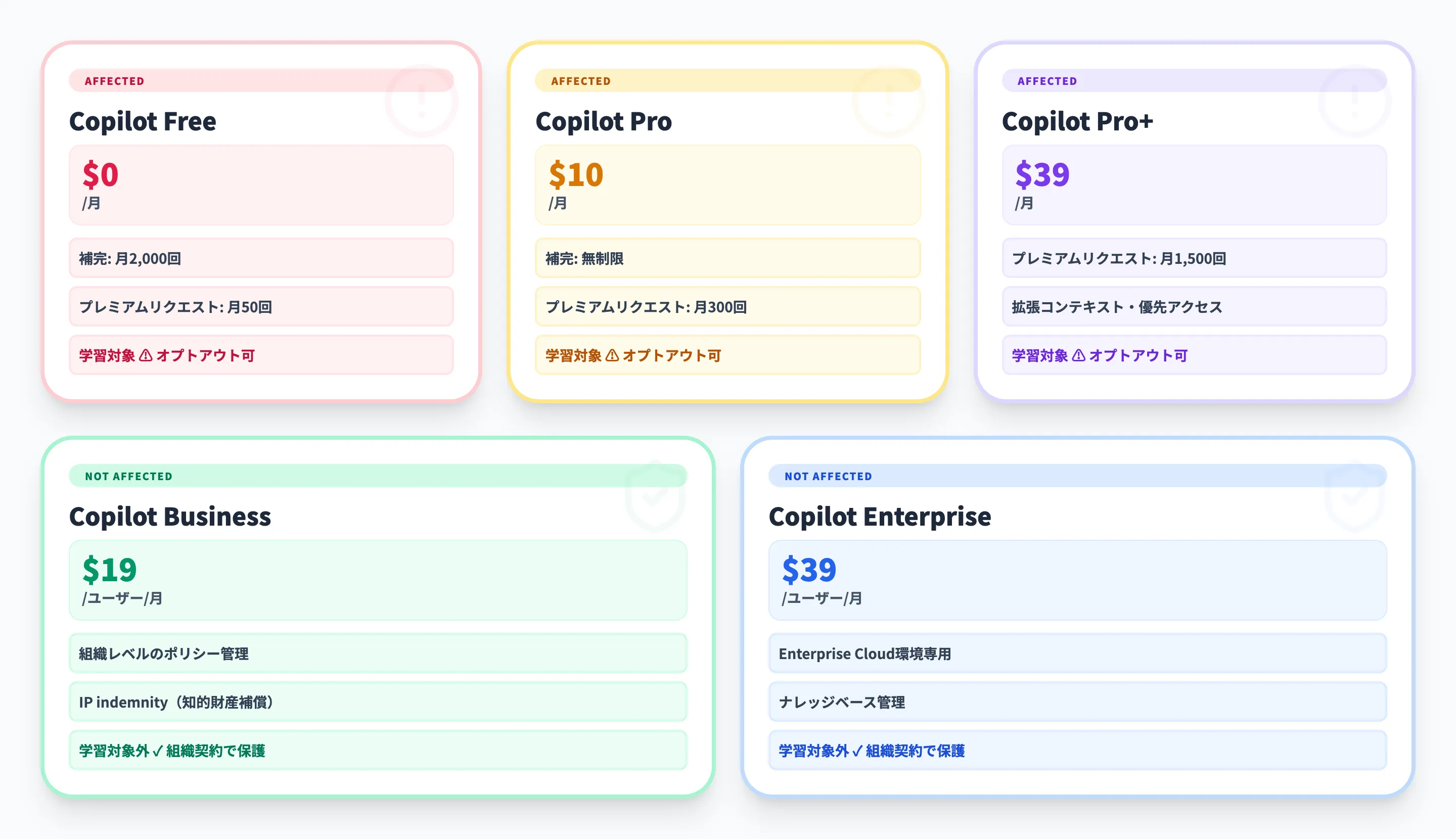

対象:Copilot Free / Pro / Pro+

以下の3つの個人向けプランが、学習データ利用の対象になります。

-

Copilot Free

月額無料で利用できるプランです。月2,000回のコード補完と50回のプレミアムリクエストが含まれます。

-

Copilot Pro

月額10ドルの個人向け有料プランです。無制限のコード補完と月300回のプレミアムリクエストが利用できます。

-

Copilot Pro+

月額39ドルの上位プランです。月1,500回のプレミアムリクエストに加え、拡張コンテキストや優先モデルアクセスが含まれます。

これら3プランのユーザーは、2026年4月24日以降、設定を変更しない限りインタラクションデータがAI学習に使用されます。

対象外:Copilot Business / Enterprise

法人向けの以下2プランは、今回の変更の対象外です。

-

Copilot Business

月額19ドル/ユーザーの法人向けプランです。組織レベルのポリシー管理やIP indemnity(知的財産補償)が提供されます。組織向け契約上、Copilotインタラクションデータのモデル学習利用は禁止されています。

-

Copilot Enterprise

月額39ドル/ユーザーの大企業向けプランです。GitHub Enterprise Cloud環境でのみ利用可能で、Businessプランの保護に加えてナレッジベースの管理などが追加されています。

この違いを一覧にすると、以下のようになります。

| プラン | 月額 | 学習データ利用 | IP補償 | 組織向け契約 |

|---|---|---|---|---|

| Free | 無料 | 対象(オプトアウト可) | なし | なし |

| Pro | 10ドル | 対象(オプトアウト可) | なし | なし |

| Pro+ | 39ドル | 対象(オプトアウト可) | なし | なし |

| Business | 19ドル/ユーザー | 対象外 | あり | あり |

| Enterprise | 39ドル/ユーザー | 対象外 | あり | あり |

ここで注目すべきは、個人向けの最上位プランであるPro+(月額39ドル)でも学習データ利用の対象になる一方、法人向けのBusinessプラン(月額19ドル/ユーザー)は対象外であるという点です。価格だけで見ればPro+のほうが高いにもかかわらず、データ保護の観点ではBusinessプランのほうが手厚い設計になっています。

【関連記事】

GitHub Copilotの料金プラン一覧!個人・法人プランの違いと選び方を解説

学生・教員アカウントの扱い

GitHubの公式FAQによると、GitHub Education経由でCopilot Proに無料アクセスしている学生・教員アカウントは、今回の学習データ利用の対象外です。ただし、学生・教員であっても、Education特典とは別に個人でFree / Pro / Pro+を契約している場合は対象になります。

GitHub Copilotが学習に使うデータの範囲

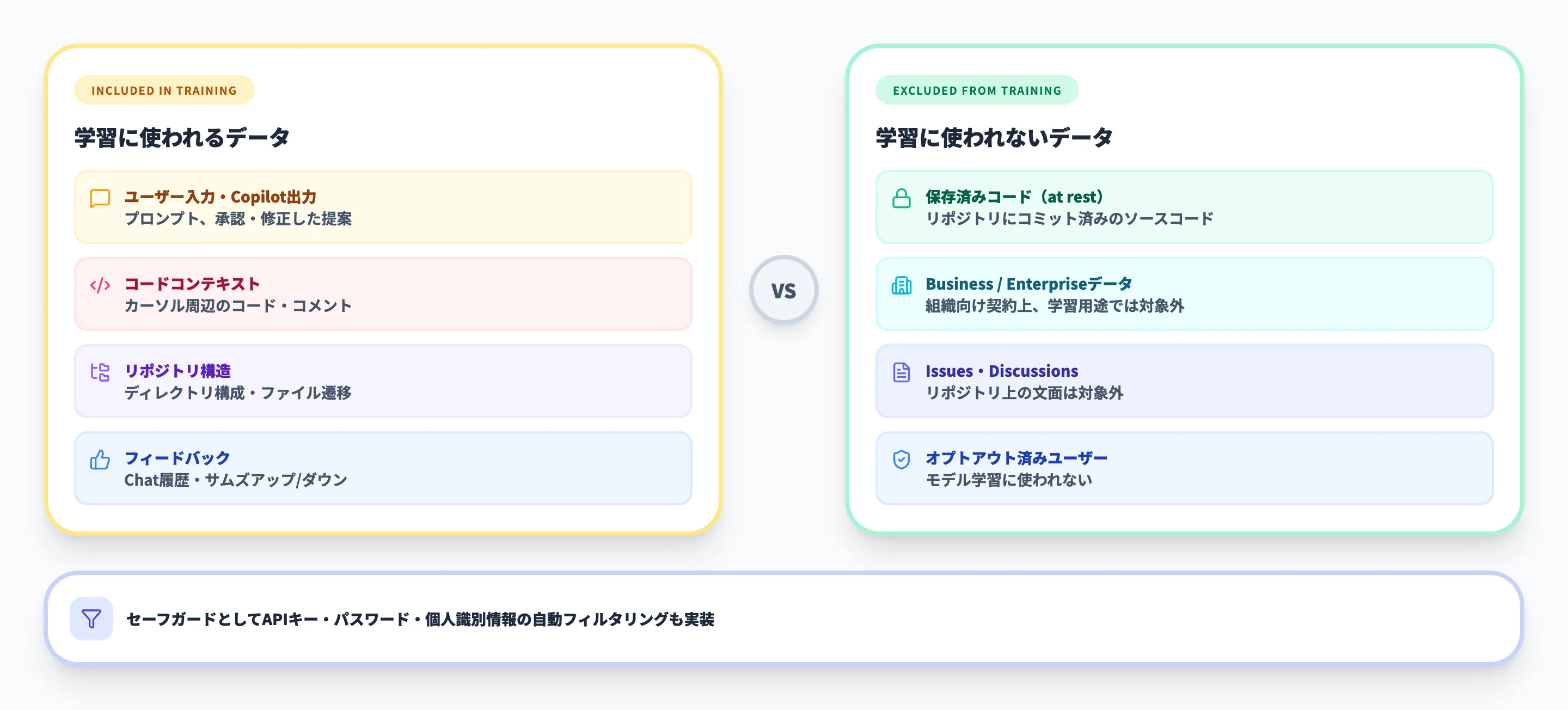

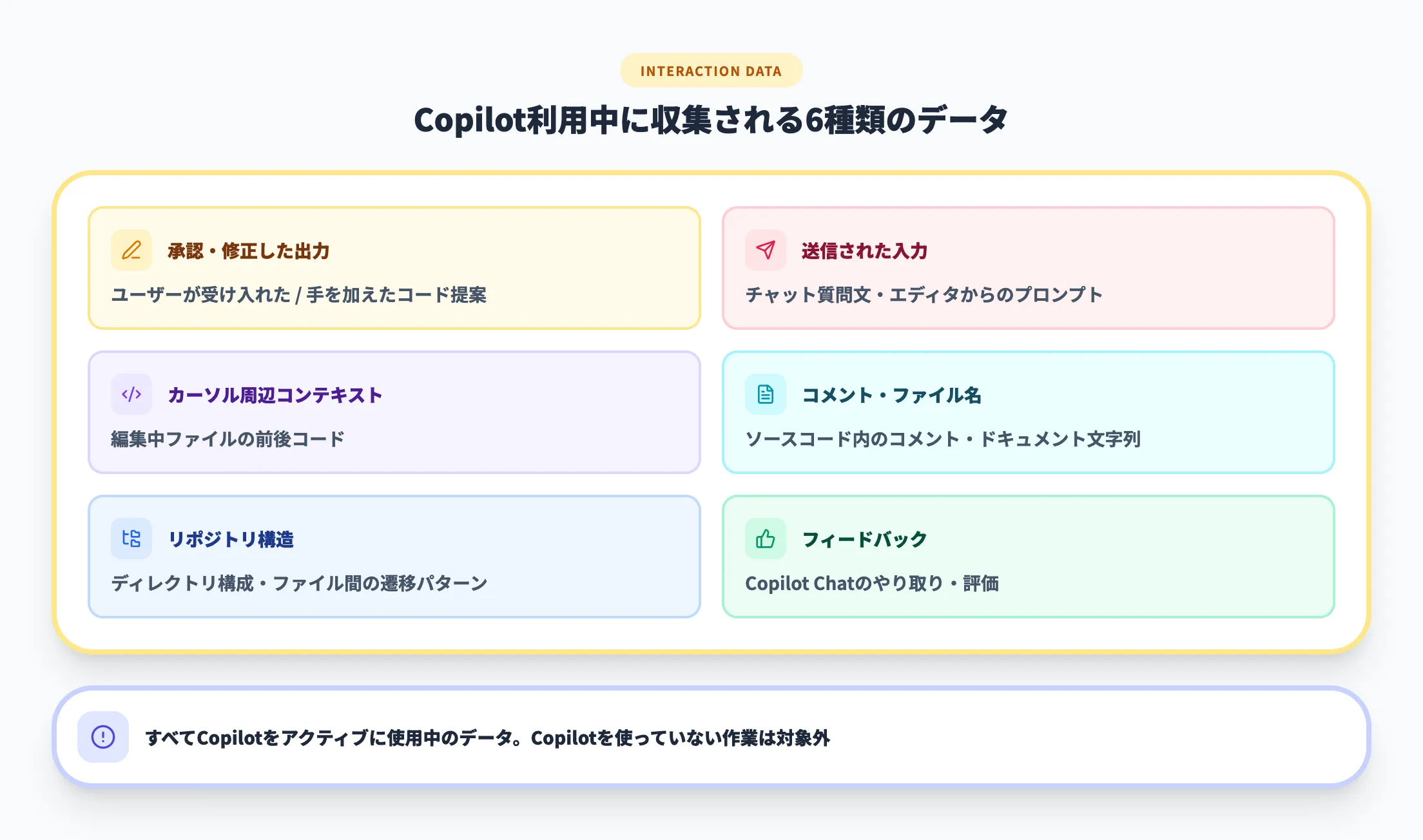

今回の変更で学習に使われるデータは何か——この点は正確に理解しておく必要があります。GitHubは「interaction data(インタラクションデータ)」という用語で範囲を定義しています。

学習に使われるデータ(interaction data)

GitHubの公式ブログおよびTerms of Serviceの新Section Jで定義されている、学習対象のインタラクションデータは以下のとおりです。

-

ユーザーが承認または修正した出力

Copilotが提案したコードのうち、ユーザーが受け入れたり手を加えたりしたもの

-

Copilotに送信された入力

チャットでの質問文、コード補完を求めるためにエディタから送信されたプロンプト

-

カーソル位置の周辺にあるコードコンテキスト

Copilotがコード補完の精度を上げるために参照する、編集中のファイルの前後のコード

-

コメント・ドキュメント・ファイル名

ソースコード内のコメントやドキュメンテーション文字列、ファイル名

-

リポジトリ構造・ナビゲーションパターン

ディレクトリ構成やファイル間の遷移パターン

-

Copilot機能とのインタラクション

Copilot Chatとのやり取り、提案に対するサムズアップ/サムズダウンなどのフィードバック

重要なのは、これらはすべてCopilotをアクティブに使用している最中のデータであるという点です。Copilotを使っていない作業は対象になりません。

学習に使われないデータ

一方で、GitHubが学習に使わないと明言しているデータもあります。

-

private repositoryに保存されているコード

リポジトリに保存された状態のソースコード(at rest)は学習対象外です

-

Business / EnterpriseのCopilotインタラクションデータ(学習用途では対象外)

法人プランのインタラクションデータは組織向け契約上、モデル学習には使用されません

-

Issues・Discussionsの内容

リポジトリ上のIssueやDiscussionsの文面は対象外です

-

オプトアウト済みユーザーのインタラクションデータ

設定で学習利用を無効にしたユーザーのインタラクションデータはモデル学習に使われません

GitHubはセーフガードとして、APIキー・パスワード・個人識別情報の自動フィルタリングも実装していると説明しています。

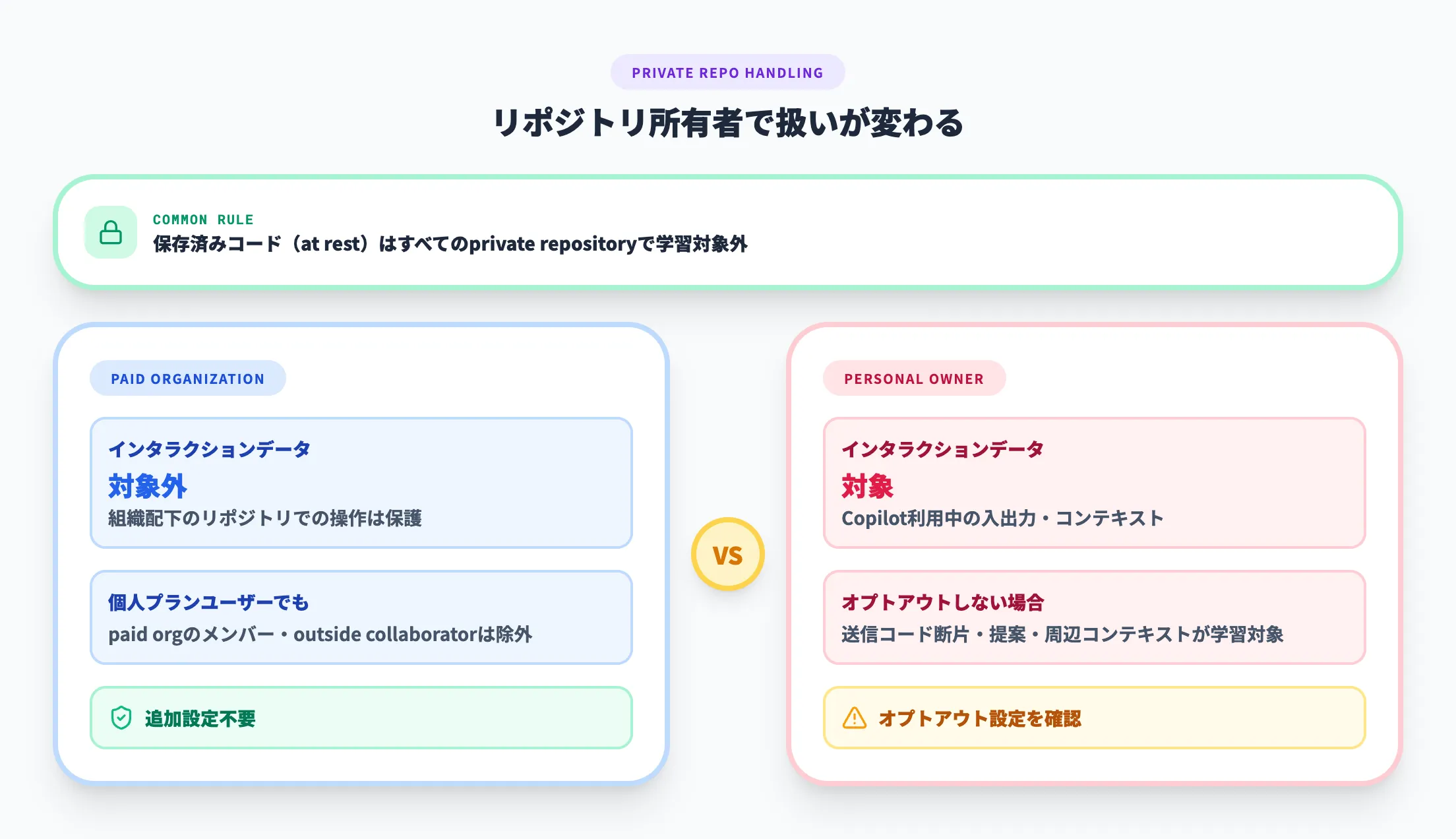

private repositoryはどう扱われるか

private repositoryの扱いは、今回の変更で最も混乱が生じているポイントです。結論から言うと、リポジトリの所有者が誰かによって扱いが変わるという構造になっています。

まず、GitHubは公式に「We do not use private repository content at rest to train AI models」(private repositoryに保存された状態のコンテンツはAIモデルの学習に使用しない)と明言しています。ここでいう「at rest」とは、リポジトリにコミットされて保存されている状態のコードを指します。この点はすべてのprivate repositoryに共通です。

次に、Copilot利用中のインタラクションデータ(Copilotとのやり取りで送受信されるデータ)については、リポジトリの所有者によって扱いが分かれます。

-

paid organization(Business / Enterprise契約の組織)配下のリポジトリ

公式FAQによると、paid organizationのメンバーやoutside collaboratorがそのリポジトリ上でCopilotを使った場合、個人アカウントがFree / Pro / Pro+であっても、そのインタラクションデータは学習対象から除外されます。

-

個人が所有するprivate repository

個人アカウントが所有するprivate repository上でCopilotを使った場合、オプトアウトしていなければ、Copilot利用中のインタラクションデータ(送信されたコード断片、生成された提案、カーソル周辺のコンテキスト等)は学習対象になります。

つまり、「private repositoryだから安心」とは言い切れませんが、paid organization配下のリポジトリであれば、個人プランのユーザーでもインタラクションデータは保護されるという点は重要です。個人所有のprivate repositoryで機密性の高いコードを扱いながらCopilotを使う場合は、オプトアウト設定を確認しておくのが安全です。

この区別を理解したうえで、次のセクションでオプトアウトの具体的な手順を説明します。

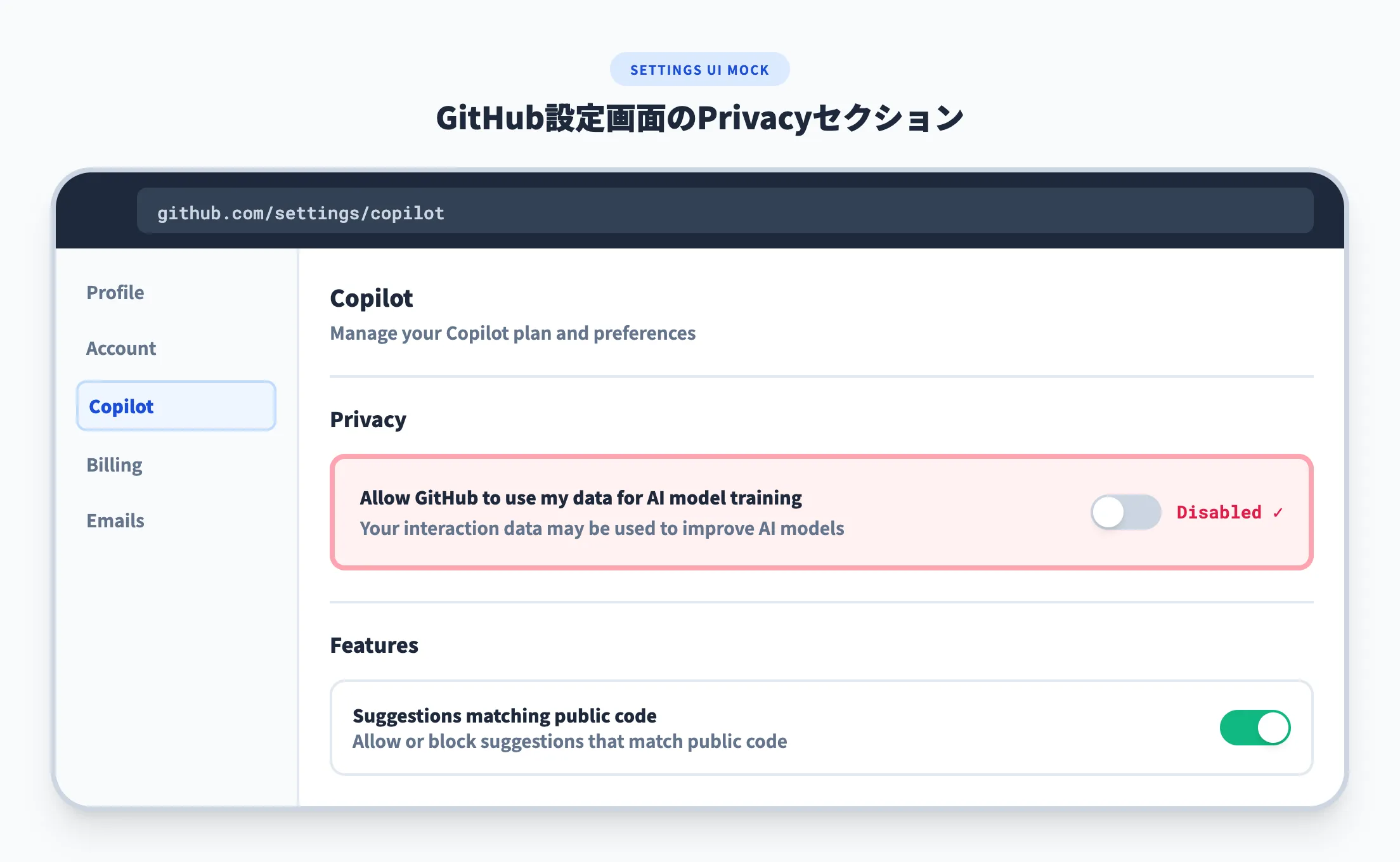

GitHub Copilotの学習利用をオプトアウトする方法

GitHub Copilotの学習利用をオプトアウトする方法は、設定画面でトグルを切り替えるだけです。手順はシンプルです。

設定画面でのオプトアウト手順

GitHub Docsに記載されている手順は以下のとおりです。

- GitHubにログインし、右上のプロフィールアイコンをクリックする

- メニューから「Settings」を選択する

- 左サイドバーの「Copilot」をクリックする

- 「Privacy」セクションにある「Allow GitHub to use my data for AI model training」を「Disabled」に変更する

- 設定を保存する

設定画面のURLは https://github.com/settings/copilot です。直接アクセスすれば、手順2〜3を省略できます。

GitHubの公式ブログでは、オプトアウトしても「AI featuresを引き続きフルに活用できる」と説明されています。公開一次ソース上、オプトアウトによって利用可能な機能が制限されるという記述はありません。

既にオプトアウト済みの場合

以前からGitHubのCopilot設定で「Allow GitHub to use my code snippets for product improvements」(製品改善のためにコードスニペットの使用を許可する)をオフにしていたユーザーは、その設定が引き継がれます。

GitHubの公式FAQでは、「以前のprompts and suggestions collection設定を無効にしていた場合、その選択は維持され、新たなアクションは不要」と説明されています。旧設定名から「AI model training」という新しい設定名に自動的に移行されているため、改めて設定し直す必要はありません。

ただし、念のため設定画面を開いて「Disabled」になっていることを確認しておくと安心です。

【関連記事】

GitHub Copilotの使い方を解説、vscode対応、ショートカットも紹介

プラン別のセキュリティ設定を把握する

Copilotの料金・セキュリティ・使い方を1冊で確認

GitHub Copilotの料金体系やセキュリティとプライバシーの仕組みを整理した無料ガイドです。プラン選択やオプトアウトの判断に必要な情報をまとめて確認できます。

GitHub Copilotのオプトアウトで確認すべき実務ポイント

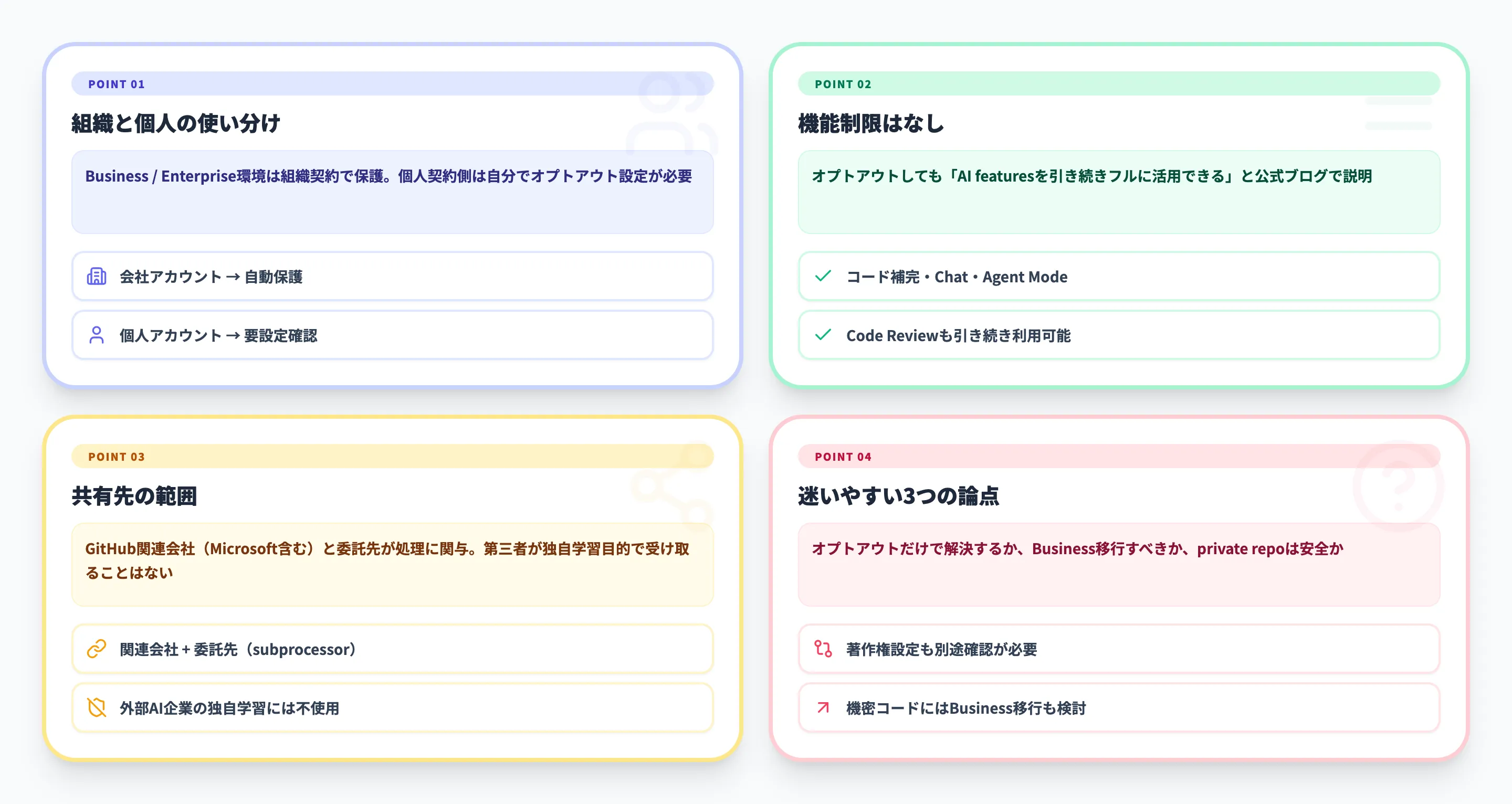

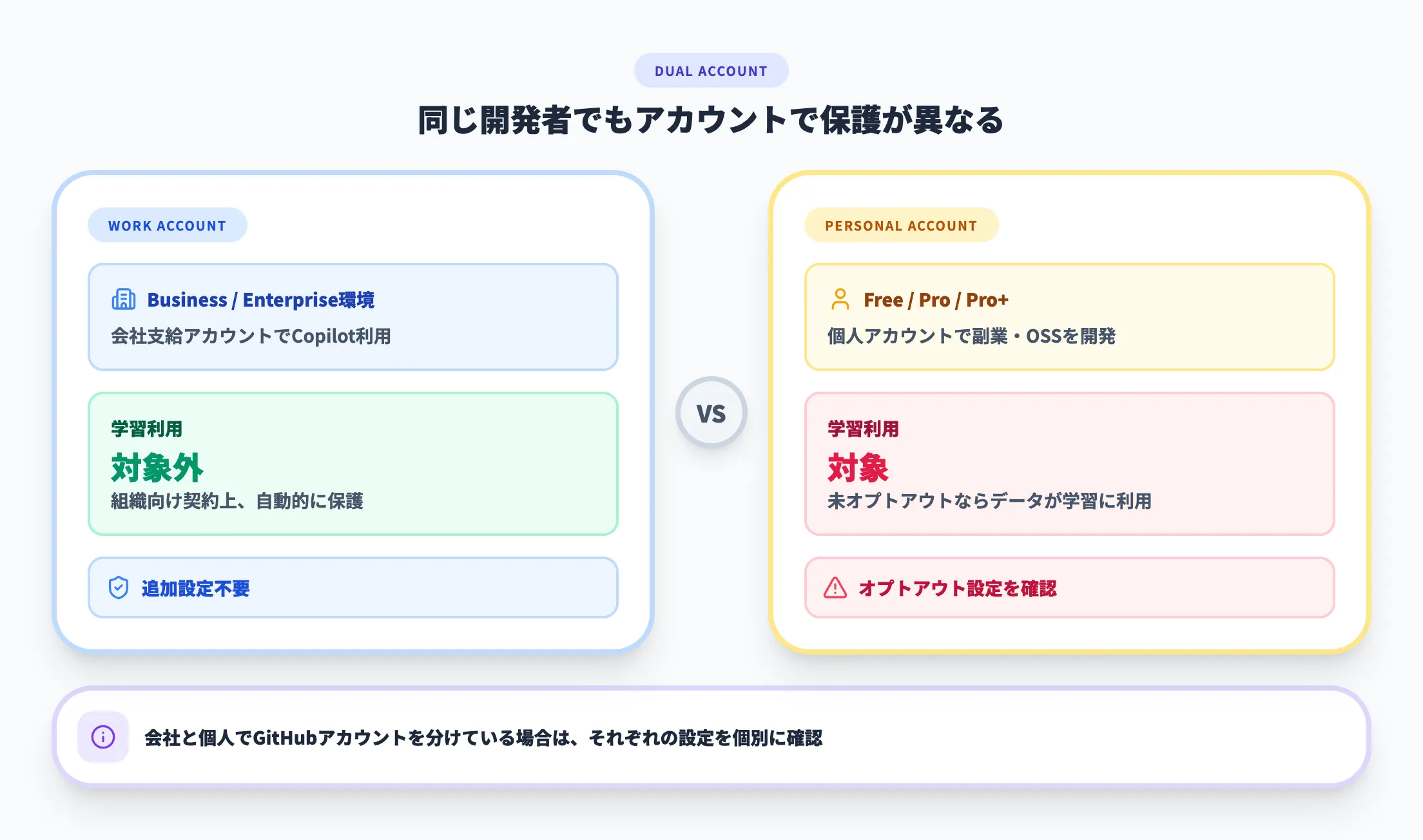

オプトアウトの手順自体は簡単ですが、実務上はいくつか確認しておくべきポイントがあります。特に、組織から付与されたCopilot環境と個人契約のCopilotを使い分けている場合は注意が必要です。

組織契約と個人契約の使い分け

企業でBusiness / Enterpriseプランを使いつつ、個人のGitHubアカウントでもCopilot Free / Proを利用しているケースは珍しくありません。この場合、組織から付与されたCopilot環境は自動的に保護されますが、個人契約側は自分で設定を確認する必要があります。

たとえば、会社支給のBusiness/Enterpriseアカウントで仕事中にCopilotを使う分には、組織向け契約上、学習に使われません。しかし、帰宅後に個人のProアカウントで副業やOSSプロジェクトのコーディングをすると、そのインタラクションデータは——オプトアウトしていなければ——学習対象になります。

会社と個人でGitHubアカウントを分けている開発者は、それぞれのアカウントで設定状況を確認してください。

オプトアウトしてもCopilotの機能は変わらない

GitHubの公式ブログでは、オプトアウトしても「AI featuresを引き続きフルに活用できる」と説明されています。コード補完、Copilot Chat、Agent Mode、Code Reviewといった機能がオプトアウトによって制限されるという記述は、公開一次ソース上にはありません。

「データを提供しないと性能が落ちるのではないか」という懸念を持つ方もいるかもしれませんが、オプトアウトはあくまで個人のインタラクションデータが学習に使われるかどうかの設定です。オプトアウトした個人に対してモデルの品質を下げるといった説明はGitHubから出ていません。

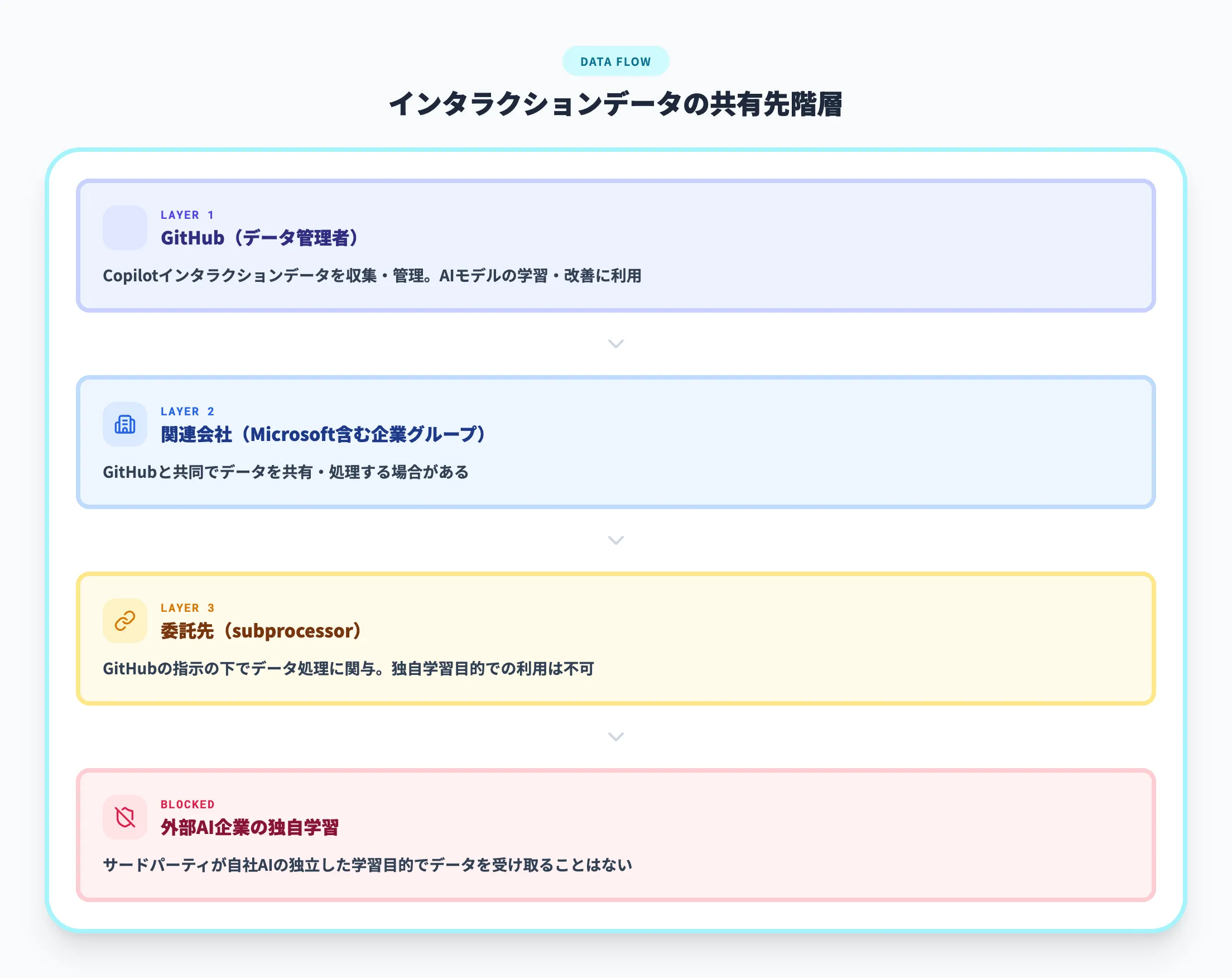

データの共有先はGitHub関連会社と委託先

収集されたインタラクションデータの共有先についても、GitHubは範囲を明示しています。データはGitHubの関連会社(Microsoftを含む企業グループ)と共有される場合がありますが、サードパーティのAIモデルプロバイダーや独立したサービスプロバイダーが、自社の独立した学習目的でデータを受け取ることはないと説明されています。

一方で、公式FAQでは、GitHubの委託先(subprocessor)がGitHubの指示の下でデータを処理する可能性があることも補足されています。つまり、第三者が自社のAIモデルを独自に学習する目的でデータを受け取るわけではありませんが、GitHubのサービス提供・改善の一環として委託先が処理に関わる可能性はあります。

実務で迷いやすい論点

今回のポリシー変更を受けて、開発者が判断に迷いやすいポイントを整理します。

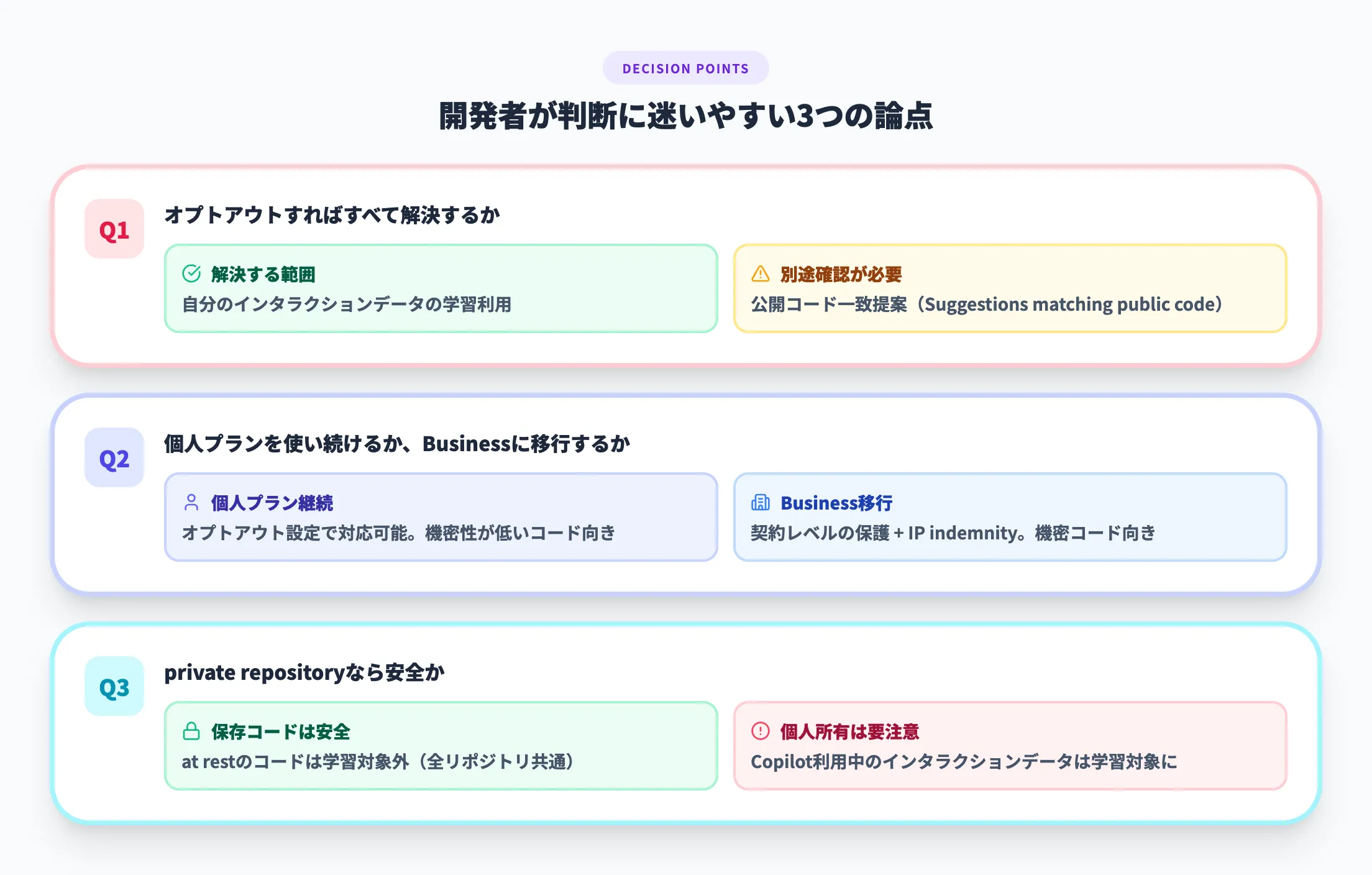

オプトアウトすればすべて解決するか

オプトアウトすれば、自分のインタラクションデータが学習に使われることはなくなります。ただし、Copilotが提案するコードは他のデータソース(公開リポジトリ等)で学習されたモデルに基づいているため、著作権やライセンスの観点から懸念がある場合は、別途「Suggestions matching public code」の設定も確認しておくべきです。

個人プランを使い続けるか、Businessに移行するか

個人プランで機密性の高いコードを扱っている場合、オプトアウト設定だけでなく、法人向けのBusinessプランへの移行も選択肢になります。Businessプランは組織向けの契約・ポリシー管理・IP indemnityが提供されており、リスク管理の観点から個人プランとは根本的に保護水準が異なります。チーム規模が小さくても、扱うコードの機密性が高いなら検討する価値があります。

private repositoryなら安全か

前述のとおり、private repositoryの保存済みコードは学習対象外です。また、paid organization配下のリポジトリであれば、個人プランのユーザーでもインタラクションデータは保護されます。一方、個人が所有するprivate repositoryでCopilotを使う場合は、利用中のインタラクションデータが学習対象になりうるため、オプトアウト設定を確認しておくのが安全です。

【関連記事】

GitHub Copilot完全ガイド!使い方や料金、設定方法を徹底解説

GitHub Copilot Memoryのデフォルト有効化との違い

今回のポリシー変更と前後して、2026年3月4日にはCopilot MemoryがPro / Pro+ユーザー向けにデフォルト有効化されるという別の変更もありました。混同しやすいため、ここで違いを整理します。

Copilot Memoryとは、リポジトリ単位でコーディング規約やアーキテクチャパターンを記憶し、次回以降のセッションで文脈を再利用できる機能です。GitHubのChangelogによると、記憶されたデータは単一リポジトリにスコープされ、28日後に自動失効します。

以下の表で、学習データ利用変更とCopilot Memoryの違いを整理しました。

| 項目 | 学習データ利用変更(本記事の主題) | Copilot Memory |

|---|---|---|

| 発表日 | 2026年3月25日 | 2026年3月4日 |

| 適用開始日 | 2026年4月24日 | 2026年3月4日(即時) |

| 対象プラン | Free / Pro / Pro+ | Pro / Pro+ |

| 目的 | GitHubのAIモデル全体の学習・改善 | 個別リポジトリ内でのコンテキスト再利用 |

| データの範囲 | インタラクションデータ全般 | リポジトリ単位の規約・パターン |

| データの扱い | AIモデルの学習・改善に利用 | 28日で自動失効 |

| 無効化方法 | Privacy設定でDisabled | Features設定でMemoryをオフ |

この2つの変更は目的もデータの扱いもまったく異なります。学習データ利用変更はGitHub側のAIモデル改善が目的であるのに対し、Copilot Memoryはユーザー自身の開発体験を向上させるための機能です。

どちらもデフォルトで有効化されるという共通点がありますが、設定画面での操作箇所は異なります。両方の設定を個別に確認しておくのが確実です。

【関連記事】

GitHub Copilot 2026年アップデートまとめ【毎月更新】

Copilotのプラン・セキュリティ設定を整理したい方へ

今回のポリシー変更では、プランごとにデータ保護の範囲が異なることが分かりました。「Free / Pro / Pro+のどれが自分に合うのか」「Businessへの移行は本当に必要か」といった判断には、料金体系だけでなくセキュリティ面の違いも把握しておく必要があります。

AI総合研究所では、GitHub Copilotの使い方・料金体系・セキュリティとプライバシーをまとめた資料を無料で公開しています。オプトアウトだけでなく、プラン選択やチームへの導入を検討する際の参考資料としてご活用ください。

プラン別のセキュリティ設定を把握する

Copilotの料金・セキュリティ・使い方を1冊で確認

GitHub Copilotの料金体系やセキュリティとプライバシーの仕組みを整理した無料ガイドです。プラン選択やオプトアウトの判断に必要な情報をまとめて確認できます。

まとめ

GitHub Copilotの学習データ利用変更について、要点を振り返ります。

- 2026年4月24日から、Copilot Free / Pro / Pro+のインタラクションデータがAIモデルの学習に使用される

- Business / Enterpriseプランは対象外。法人契約ユーザーは追加対応不要

- private repositoryの保存済みコードは学習対象外。Copilot利用中のインタラクションデータは個人所有リポジトリでは対象になりうるが、paid organization配下は除外される

- オプトアウトはGitHubの設定画面で「Allow GitHub to use my data for AI model training」をDisabledにするだけで完了

- 公開一次ソース上、オプトアウトで利用可能な機能が制限されるとの説明はない

- 既に製品改善向けのオプトアウトを設定済みの場合、その選択は自動的に引き継がれる

個人プランでCopilotを使いながら業務コードや副業のプロジェクトを開発している方は、4月24日までに設定画面を開いて確認してください。Disabledに切り替えるだけで、この変更への対応は完了します。

一方、チームや組織で機密性の高いコードを扱っている場合は、個々のオプトアウト設定に依存するのではなく、組織向けの契約・ポリシー管理があるBusinessプランやEnterpriseプランへの移行を検討するのも有効な選択肢です。