この記事のポイント

時系列予測や異常検知にはLSTMを第一候補にすべき。Transformerが主流のNLP分野とは異なり、時系列領域ではLSTMが依然として有力

リソースが限られたエッジデバイスでの推論にはLSTMの軽量さとメモリ効率が大きな利点。Transformerは計算コストが入力長の二乗に比例するため不向き

NLPタスクにはTransformerを選ぶべき。LSTMは逐次処理が必要で並列化できないため、大規模言語処理には適さない

2026年はxLSTMとSSMの登場でLSTMの設計思想が再評価されている。長系列処理の計算コスト問題を解決する有力な選択肢

Python実装はKerasのLSTMレイヤーで数行から始められる。株価予測や電力需要予測の入門として最適

Microsoft MVP・AIパートナー。LinkX Japan株式会社 代表取締役。東京工業大学大学院にて自然言語処理・金融工学を研究。NHK放送技術研究所でAI・ブロックチェーンの研究開発に従事し、国際学会・ジャーナルでの発表多数。経営情報学会 優秀賞受賞。シンガポールでWeb3企業を創業後、現在は企業向けAI導入・DX推進を支援。

ディープラーニングの分野で広く使われるLSTM(Long Short-Term Memory)は、時系列データや言語処理などのシーケンシャルな情報を扱うのに適したニューラルネットワーク構造です。

LSTMは、RNN(Recurrent Neural Network)が抱える勾配消失問題を克服し、長期的な文脈を捉えることが可能な設計になっています。

2026年現在、Transformerが自然言語処理の主流となる一方で、xLSTM(Extended LSTM)やSSM(State Space Model)の登場により、LSTMの設計思想が再評価されています。時系列予測やエッジデバイスでの推論など、Transformerが苦手とする領域でLSTMの技術が再び注目を集めています。

この記事では、LSTMの基本的な仕組みからゲート構造、RNNとの違い、応用分野、Transformer・xLSTM・SSMとの比較、そしてPythonでの実装例まで、2026年の最新動向を含めて体系的に解説します。

目次

LSTMとは(2026年最新)

LSTM(Long Short-Term Memory)は、ニューラルネットワークの一種であるRNN(Recurrent Neural Network)を拡張したアーキテクチャで、特に時系列データの処理に優れた構造を持っています。1997年にSepp HochreiterとJurgen Schmidhuberによって原著論文が発表され、RNNが抱える勾配消失問題を「ゲート」と呼ばれる機構によって克服しました。

以下の表で、LSTMの基本的な特性を整理しました。

| 項目 | 内容 |

|---|---|

| 正式名称 | Long Short-Term Memory(長期短期記憶) |

| 提案年 | 1997年(Hochreiter & Schmidhuber) |

| 分類 | リカレントニューラルネットワーク(RNN)の拡張 |

| 主な特徴 | ゲート機構による長期依存関係の学習 |

| 核となる構造 | 忘却ゲート、インプットゲート、アウトプットゲート、セルステート |

| 主な応用分野 | 時系列予測、自然言語処理、音声認識、異常検知 |

| 後継技術 | GRU、Transformer、xLSTM、SSM(Mamba) |

この表が示すように、LSTMは1997年に提案された技術でありながら、2026年現在もさまざまな分野で活用されています。特に時系列データの処理においては、Transformerが主流となった自然言語処理分野とは異なり、LSTMが依然として有力な選択肢であり続けています。

2026年現在、ChatGPTやClaudeなどの大規模言語モデル(LLM)がTransformerベースで構築される一方で、LSTMの設計思想を発展させたxLSTMやSSM(State Space Model)が新たな注目を集めています。Transformerの計算コスト(入力長の二乗に比例)が課題となる長いシーケンスの処理において、LSTMベースのアーキテクチャが再び競争力を発揮し始めています。

LSTMの構造

RNNの仕組みとLSTMが生まれた背景

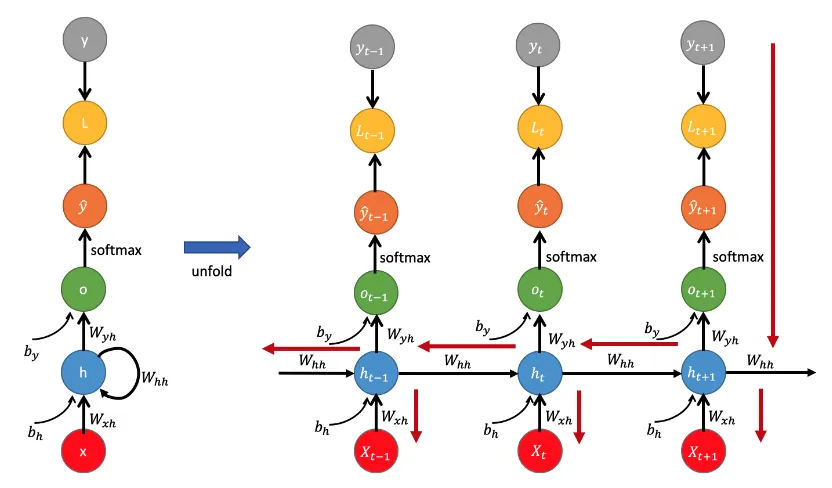

LSTMの仕組みを理解するには、まずその前身であるRNN(Recurrent Neural Network)の特徴と限界を把握する必要があります。RNNは、時系列データやシーケンスデータを処理するために設計されたニューラルネットワークで、前のステップの出力が次のステップの入力になるという再帰的な構造を持っています。

RNNの仕組み (参考:Backpropagation Through Time for Recurrent Neural Network)

RNNでは、現在の入力

RNNの問題点と勾配消失

RNNには致命的な弱点があります。シーケンスが長くなるにつれて、初期の情報が後方のステップに伝わりにくくなる「勾配消失問題」が発生するのです。

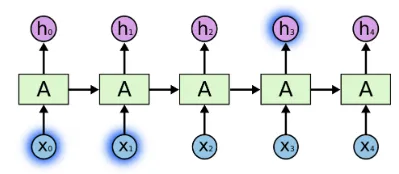

短い文章の場合 (出典:Understanding LSTM Networks)

たとえば「Whales are in the ○○」という文章の○○を予測する場合、直前の文脈を見るだけで「ocean」や「sea」と予測できます。しかし、より長い文脈が必要になるとどうでしょうか。

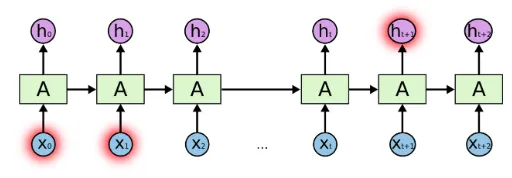

長い文章の場合 (出典:Understanding LSTM Networks)

「I grew up in Japan ..., and I speak fluent ○○」のような文章では、○○に何らかの言語が入ることは直前の文脈から分かりますが、「Japanese」と具体的に特定するには文の冒頭にある「Japan」という情報を保持する必要があります。予測したい部分とそれに関連する情報との間のギャップが大きいと、RNNでは情報を伝達するのが困難になります。

この問題を解決するために設計されたのがLSTMです。LSTMは「セルステート」と呼ばれる長期記憶の経路と、3つのゲート機構を導入することで、重要な情報を長期間保持し、不要な情報を適切に「忘れる」ことを可能にしました。

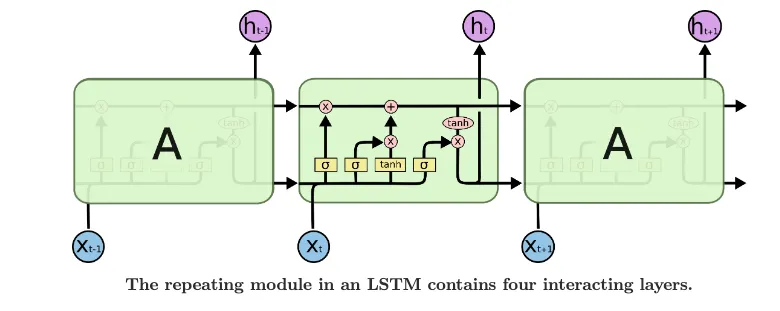

LSTMの仕組みとゲート構造

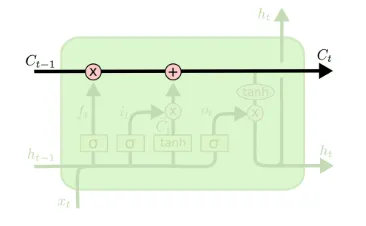

LSTMの中核は、「セルステート」と呼ばれる情報の長期記憶経路と、情報の流れを制御する3つのゲートです。以下の表で、各構成要素の役割を整理しました。

| 構成要素 | 役割 | 出力の範囲 |

|---|---|---|

| セルステート(Cell State) | 情報を長期的に保持・伝達する経路 | 制限なし |

| 忘却ゲート(Forget Gate) | 過去の情報のうち、どれを捨てるかを決定 | 0(完全に忘れる)から1(完全に保持) |

| インプットゲート(Input Gate) | 新しい情報のうち、どれをセルステートに追加するかを決定 | 0(追加しない)から1(完全に追加) |

| アウトプットゲート(Output Gate) | セルステートの情報のうち、どれを出力するかを決定 | 0(出力しない)から1(完全に出力) |

このゲート構造が、LSTMがRNNの勾配消失問題を解決できる理由です。セルステートは情報を変化させずに長距離伝達できる経路として機能し、各ゲートがシグモイド関数を使って0から1の値で情報の通過量を制御します。

3つのゲートの役割

cell state (出典:Understanding LSTM Networks)

セルステートはLSTMの上部を通る経路で、前の状態から次の状態へ情報を伝達します。LSTMはこのセルステートに対して、ゲートを通じて情報を削除したり追加したりすることで、長期的な記憶の管理を行います。

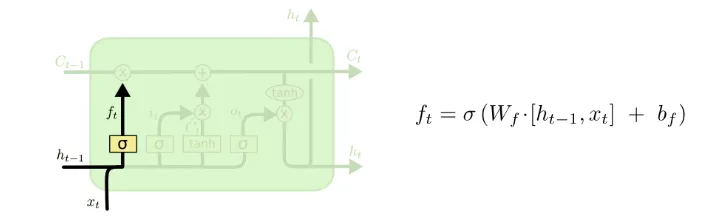

忘却ゲート (出典:Understanding LSTM Networks)

忘却ゲートはLSTMで最初に動作する部分で、セルステートからどの情報を削除するかを決定します。現在の入力

たとえば言語モデルにおいて、新しい主語が現れた場合、忘却ゲートが古い主語の性別情報を忘れ、新しい主語の情報を受け入れる準備をします。

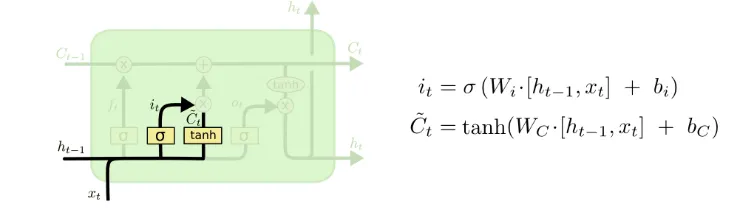

インプットゲート (出典:Understanding LSTM Networks)

インプットゲートは、新しい情報をセルステートに追加する役割を担います。まずシグモイド層が入力のうちどの値を更新するかを決定し、次にtanh関数が新しい値の候補を生成します。シグモイドの出力が各候補への重み付けとなり、どの情報をどれだけ追加するかを制御します。

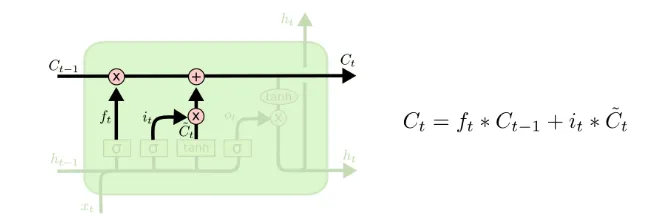

忘却ゲートとインプットゲートの連携 (出典:Understanding LSTM Networks)

忘却ゲートとインプットゲートの連携により、古いセルステートから不要な情報を削除し、新しい情報を追加して、次の状態のセルステートを生成します。

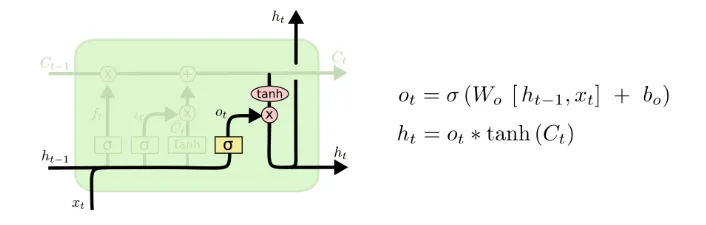

アウトプットゲート (出典:Understanding LSTM Networks)

アウトプットゲートは、セルステートの情報のうちどれを出力するかを決定します。入力と前の出力をシグモイド関数に通して出力の重みを算出し、セルステートにtanh関数を適用した結果と掛け合わせて最終的な出力を生成します。tanhの値域は-1から1であり、シグモイドの出力がtanhの各値をどれだけ最終出力に反映するかを制御しています。

LSTMの応用分野と活用事例

LSTMは、時間的な依存関係を持つデータの処理において幅広い分野で活用されています。以下の表で、代表的な応用分野とその活用内容を整理しました。

| 応用分野 | 活用内容 | 具体例 |

|---|---|---|

| 時系列予測 | 過去のデータパターンから将来の値を予測 | 株価予測、電力需要予測、気象予報 |

| 自然言語処理 | テキストの生成、分類、感情分析 | チャットボット、スパムフィルタリング |

| 音声認識 | 音声信号をテキストに変換 | 音声アシスタント、自動文字起こし |

| 機械翻訳 | 異なる言語間の翻訳 | Encoder-Decoderモデル |

| 異常検知 | センサーデータから異常パターンを検出 | 製造ラインの品質管理、ネットワーク侵入検知 |

| 手書き文字認識 | 手書きの文字をデジタルテキストに変換 | OCR(光学文字認識)システム |

| 予測保守 | 機器の故障を事前に予測 | 工場設備のメンテナンス最適化 |

この表から分かるように、LSTMは「過去の情報に基づいて未来を予測する」タスクに特に強みを発揮します。2026年現在でも、株価予測や電力需要予測などの時系列タスクではLSTMが主要な選択肢として使われています。AIの自然言語処理分野ではTransformerに主役の座を譲りましたが、リソースが限られたエッジデバイスでの推論や、リアルタイムストリーミングデータの処理においては、LSTMの軽量さとメモリ効率の良さが依然として大きな利点です。

LSTM・Transformer・SSMの比較

2026年現在、シーケンスデータの処理にはLSTM、Transformer、SSM(State Space Model)の3つの主要なアーキテクチャが存在します。以下の表で、これらの特性を比較しました。

| 項目 | LSTM | Transformer | SSM(Mamba) |

|---|---|---|---|

| 提案年 | 1997年 | 2017年 | 2023年 |

| 計算量(推論時) | O(N)(線形) | O(N²)(二乗) | O(N)(線形) |

| 並列化 | 不可(逐次処理) | 可能(自己注意機構) | 可能(選択的SSM) |

| 長距離依存関係 | ゲート機構で対応(限界あり) | 自己注意で直接参照 | 選択的状態空間で対応 |

| メモリ使用量 | 固定(状態サイズに依存) | 入力長に比例して増加 | 固定(状態サイズに依存) |

| 主な活用分野 | 時系列予測、音声認識 | LLM、画像認識 | 長系列処理、音声、DNA配列 |

| 代表的なモデル | BERT以前のNLPモデル | GPT-5、Claude | Mamba、Jamba |

特に注目すべきは、計算量とメモリ使用量の違いです。Transformerは入力長の二乗に比例する計算量が必要なため、長い系列の処理ではコストが急増します。一方、LSTMとSSMは線形の計算量で済むため、長い時系列データやリアルタイム処理に有利です。ただし、LSTMは逐次処理が必要なため学習時の並列化ができないという制約があり、この点をSSMが克服しています。

xLSTMとState Space Modelの登場

2024年、LSTM原著者のSepp Hochreiterらが「xLSTM(Extended LSTM)」を発表し、LSTMの設計思想が再び脚光を浴びました。xLSTMは以下の2つの重要な改良を導入しています。

-

指数ゲーティング(Exponential Gating)

従来のシグモイド関数(0から1)に代わり、指数関数を用いたゲーティングを採用しました。適切な正規化と安定化技術を組み合わせることで、情報の選択性が大幅に向上しています。

-

行列メモリ(Matrix Memory)

従来のLSTMのスカラーメモリを行列に拡張した「mLSTM」を導入しました。mLSTMは共分散更新規則を用いることで、完全に並列化可能な学習を実現しています。これにより、LSTMの最大の弱点であった「学習時の並列化不可」という制約が解消されました。

xLSTMは7Bパラメータのモデルが2.3兆トークンで学習されており、TransformerやSSMと同等の性能を示す結果が報告されています。

一方、SSMの代表的なアーキテクチャであるMambaは、「選択的状態空間モデル」という仕組みを採用し、入力に応じて動的にモデルのパラメータを変化させることで、Transformerに匹敵する性能を線形の計算量で実現しています。2026年現在では、DeepSeek-R1などの最新LLMの開発で培われたMixture-of-Experts(MoE)技術をMambaに組み合わせたMoE-Mambaや、TransformerとMambaのハイブリッドモデル(Jamba等)など、複数のアーキテクチャを融合するアプローチが研究の最前線となっています。

生成AIの今後の発展において、Transformerの計算コストの課題を解決する技術として、xLSTMやSSMは重要な選択肢です。RAGのように大量の文脈を処理する必要があるアプリケーションでは、線形計算量のアーキテクチャが特に有効になると考えられています。

PythonでのLSTMの実装方法

以下は、PythonとTensorFlow/Kerasを使用してLSTMで時系列データの予測を行う実装例です。サイン波データを生成し、次の時刻の値を予測するシンプルなモデルを構築します。

import numpy as np

import tensorflow as tf

from tensorflow import keras

import matplotlib.pyplot as plt

# サイン波データの生成

def generate_sine_data(num_points=1000, seq_length=50):

x = np.linspace(0, 100, num_points)

y = np.sin(x)

X, Y = [], []

for i in range(len(y) - seq_length):

X.append(y[i:i+seq_length])

Y.append(y[i+seq_length])

return np.array(X), np.array(Y)

# データの準備

seq_length = 50

X, Y = generate_sine_data(seq_length=seq_length)

X = X.reshape(-1, seq_length, 1) # (samples, timesteps, features)

# 学習用とテスト用に分割

split = int(len(X) * 0.8)

X_train, X_test = X[:split], X[split:]

Y_train, Y_test = Y[:split], Y[split:]

# LSTMモデルの定義

model = keras.Sequential([

keras.layers.LSTM(64, input_shape=(seq_length, 1), return_sequences=True),

keras.layers.LSTM(32),

keras.layers.Dense(1)

])

model.compile(optimizer='adam', loss='mse')

# 学習の実行

history = model.fit(X_train, Y_train, epochs=50, batch_size=32,

validation_split=0.2, verbose=1)

# 予測と可視化

predictions = model.predict(X_test)

plt.plot(Y_test, label='Actual')

plt.plot(predictions, label='Predicted')

plt.legend()

plt.title('LSTM Time Series Prediction')

plt.show()

このコードのポイントは、Kerasの Sequential APIを使ってLSTMモデルを簡潔に定義している点です。2層のLSTMを積み重ねることで、より複雑なパターンの学習が可能になります。1層目は return_sequences=True を設定して全タイムステップの出力を返し、2層目が最終的な特徴を抽出します。

実務では、このサイン波予測の基本構造を応用して、株価データや電力消費量などの実際の時系列データに適用できます。データの前処理(正規化、欠損値処理)やハイパーパラメータの調整(ユニット数、層数、学習率)が予測精度に大きく影響するため、段階的なチューニングが推奨されます。

ハルシネーションが課題となるLLMとは異なり、LSTMによる時系列予測は学習データに基づく数値予測であるため、出力の解釈と検証が比較的容易であるという利点もあります。

AI技術の基礎を学んだなら業務へのAI導入を設計する

LSTMのゲート構造やTransformerとの比較を通じて、AI技術には用途に応じた最適なアーキテクチャの選択が重要であることを理解された方も多いでしょう。この「課題に合ったAI手法を選ぶ」という視点は、時系列予測モデルの構築だけでなく、自社の業務課題にどのAI技術を適用すべきかを判断する際にも直接役立ちます。

AI総合研究所では、AI技術の基礎知識を実務に活かすための「AI業務自動化ガイド」を無料で公開しています。220ページにわたる実践的な内容で、技術的な理解を自社の業務改善やAI導入計画に結びつけるための具体的なアプローチを網羅しています。

AI技術の基礎知識を業務へのAI導入計画に結びつける

220ページ超のAI業務自動化ガイドを無料配布中

LSTMの仕組みを理解すると、AIが時系列データや自然言語をどう処理するかの本質が見えてきます。その技術的知見を業務AI導入に活かす方法を、AI業務自動化ガイドが220ページ超で体系的にまとめています。

まとめ

本記事では、LSTMの基本概念からゲート構造の仕組み、RNNとの違い、応用分野、Transformer・xLSTM・SSMとの比較、そしてPythonでの実装例まで体系的に解説しました。

LSTMは1997年に提案されたアーキテクチャですが、2026年現在も時系列予測、音声認識、異常検知などの分野で広く活用されています。Transformerが自然言語処理の主流となった一方で、xLSTMやSSMの登場によりLSTMの設計思想が再評価されており、計算効率の高いシーケンスモデルとしての価値は今後も継続すると見られています。

LSTMの学習を始めたい方は、まず本記事のPythonコード例をGoogle ColabやJupyter Notebookで実行し、サイン波予測の動作を体験してみてください。基本的な仕組みを理解した上で、自社の時系列データ(売上推移、センサーデータ等)を用いたPoC(概念実証)を行い、予測精度と計算コストのバランスを確認することが推奨されます。