この記事のポイント

時系列データの予測・分類タスクにはRNNが有効で、過去の文脈情報を保持する必要がある場面ではCNNより適している

長い系列データにはLSTM、計算コスト重視ならGRU、文脈の双方向理解が必要なら双方向RNNを選ぶべき

勾配消失問題が発生する場合はLSTMまたはGRUへの切り替えが第一の対処法で、標準RNNのまま長系列を扱うのは避けるべき

2026年時点ではTransformerが自然言語処理の主流だが、リアルタイム音声認識やセンサーデータ予測などエッジ環境ではRNNが依然として有力な選択肢

Python実装はTensorFlow/Kerasから始めるのが最短ルートで、Grad-CAMによる可視化で予測根拠の説明性も確保すべき

Microsoft MVP・AIパートナー。LinkX Japan株式会社 代表取締役。東京工業大学大学院にて自然言語処理・金融工学を研究。NHK放送技術研究所でAI・ブロックチェーンの研究開発に従事し、国際学会・ジャーナルでの発表多数。経営情報学会 優秀賞受賞。シンガポールでWeb3企業を創業後、現在は企業向けAI導入・DX推進を支援。

RNN(Recurrent Neural Network)は、時系列データや順序のあるデータを処理するために設計されたニューラルネットワークです。テキスト生成、機械翻訳、音声認識、株価予測など、過去の情報を記憶しながら処理するタスクで効果を発揮します。

本記事では、RNNの基本構造(入力層・隠れ層・出力層)、LSTM・GRU・双方向RNNなどの主要な種類、BPTTによる学習方法と勾配消失問題、Pythonでの実装例、活用事例を解説します。

Microsoft 365 Copilotの最新エージェント機能については、以下の記事をご覧ください。

Copilot Coworkとは?機能や料金、Claude Coworkとの違いを解説

RNNとは

RNN(Recurrent Neural Network:再帰型ニューラルネットワーク)は、時間的な順序を持つデータを処理するために設計された特殊なニューラルネットワークです。

RNNは、過去の情報を「記憶」して利用します。通常のニューラルネットワークとは異なり、ループ構造を持っています。

このループにより、RNNは過去の情報を保持可能です。

そのため、RNNは以下のような時系列データを扱うタスクで特に威力を発揮します。

| タスク | 具体例 | RNNの強み |

|---|---|---|

| テキスト生成 | ・文章作成 ・プログラムコード生成 ・チャットボット |

・文脈の理解 ・一貫性の維持 ・自然な文章生成 |

| 機械翻訳 | ・文章翻訳 ・同時通訳 ・多言語変換 |

・語順の違いに対応 ・文脈を考慮した訳出 |

| 音声処理 | ・音声認識 ・話者識別 ・音声合成 |

・連続的な信号処理 ・音の特徴抽出 |

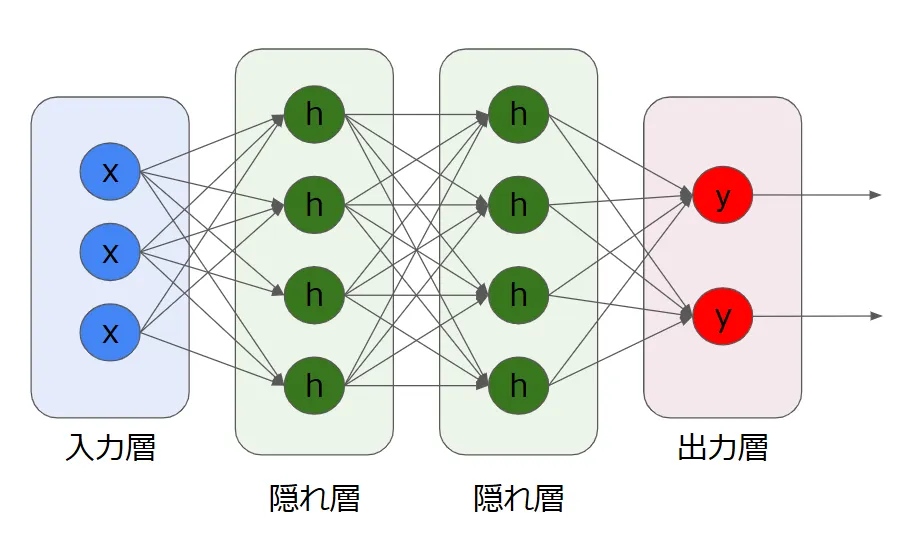

ニューラルネットワークとは

人間の脳の神経回路をまねた仕組みで、データを学習して「正しい答え」を出すモデルです。データを入力して計算を行い、何らかの結果を出力する「学習するアルゴリズム」といえます。

- 入力(データ)を受け取り、層を通じて処理して結果を出します

- 一方向に処理を進めます(例: 入力 → 隠れ層 → 出力)

CNNとは

CNN(畳み込みニューラルネットワーク)は、画像や空間情報を理解するために作られた、特別なニューラルネットワークです。画像認識や物体検出に強い理由は、画像の中の「重要な部分」を自動で学習する仕組みがあるからです。

画像を小さな「部分(特徴)」に分けて、それを認識して処理します。

| 特徴 | ニューラルネットワーク | CNN(畳み込みニューラルネットワーク) | RNN(再帰型ニューラルネットワーク) |

|---|---|---|---|

| 目的 | 一般的なデータの処理 | 画像や空間情報の処理 | 時系列データや順序が重要なデータの処理 |

| 主な構造 | 全結合層(データを一方向に処理) | 畳み込み層・プーリング層+全結合層 | 再帰的に隠れ状態を持ちながら処理 |

| 入力データの例 | 数値や特徴量 | 画像データ | テキスト、音声、時系列データ |

| 情報の流れ | 一方向のみ | 層ごとに特徴を抽出 | 前のステップの情報を次に引き継ぐ |

| 得意な分野 | シンプルな分類や予測 | 画像認識、物体検出 | 翻訳、音声認識、予測変換 |

たとえば、ニューラルネットワークは「家のサイズと間取り」を入力して「価格」を予測するタスクに使われます。CNNは写真を見て「猫か犬か」を判別し、RNNは翻訳アプリで「私は学校に行く」を英語に変換するといった使い方がされています。

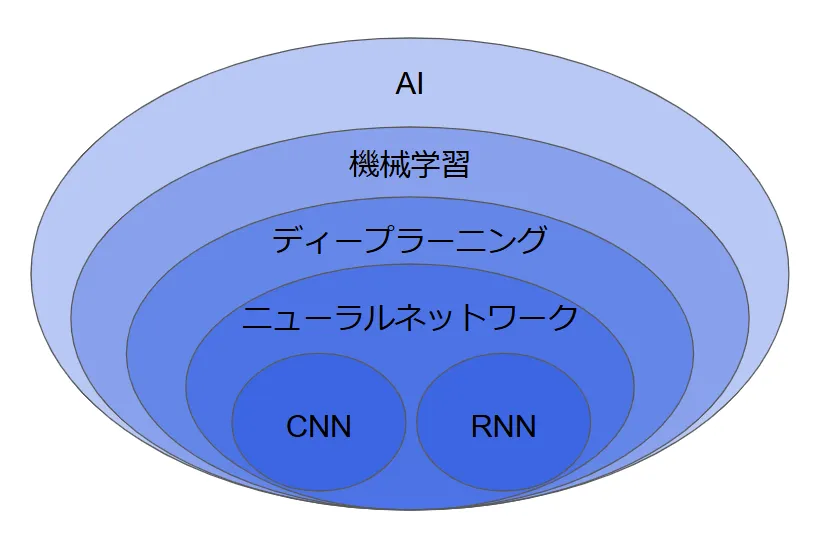

RNN・ニューラルネットワーク・CNNの比較

以上の情報を基に関係性をまとめると以下のようになります。

AIや機械学習の基礎については生成AIの概要や機械学習とディープラーニングの違いの記事も参照してください。

RNNの構造

RNNは特殊な構造を持つニューラルネットワークで、過去の情報を記憶し活用できる設計になっています。

入力層

入力層は、RNNにデータを渡す部分です。例えば、あなたがRNNに「昨日の天気データ」や「過去の株価データ」を渡したいとき、この層でデータがRNNに入ります。

シーケンシャルデータ(例えば時間ごとのデータや、文章の単語、音声の波形など)を渡します。データが1つずつRNNに渡され、RNNがそれを1つずつ「覚えていきます」。

隠れ層

隠れ層は、RNNの中核を成す部分で、ネットワークの状態を保持し、時間的な依存関係を学習します。RNNは隠れ層で、以前の入力と現在の入力を組み合わせて新しい情報を生成します。

- 過去の情報を保持

RNNは、以前の入力データが「次に来るもの」にどう影響を与えるかを学びます。 - 状態を更新

隠れ層は、前の時刻の状態と現在の入力を元に、現在の状態を計算します。この計算がRNNの学習の要です。 - 時間的依存性を学習

隠れ層は、時系列データにおける「順番」や「関連性」を理解します。これがRNNの大きな特徴です。

出力層

出力層は、RNNが最終的に「予測」した結果を出力する部分です。

- 予測結果を生成

隠れ層で学習した内容を基に、次に来るデータや予測を出力します。 - 分類や回帰に対応

出力層は、分類タスク(例えば、どのカテゴリに分類するか)や、回帰タスク(連続した値を予測する)に対応します。- 分類の場合

Softmax関数を使って、クラスの確率を出力。 - 回帰の場合

連続した値を出力。

- 分類の場合

たとえば、RNNを使って「過去3日間の天気」を入力し、「明日の天気」を予測する場合は以下のように動作します。入力層では過去3日間の天気データ(1日目「晴れ、25℃」、2日目「曇り、22℃」、3日目「雨、20℃」)を受け取ります。隠れ層では各入力時点の内部状態を「記憶」として保持し、過去の記憶を組み合わせて「明日の天気のパターン」を学習・予測します。出力層では「明日の天気」の予測結果(例:「曇り、23℃」)を出力します。

RNNの仕組み

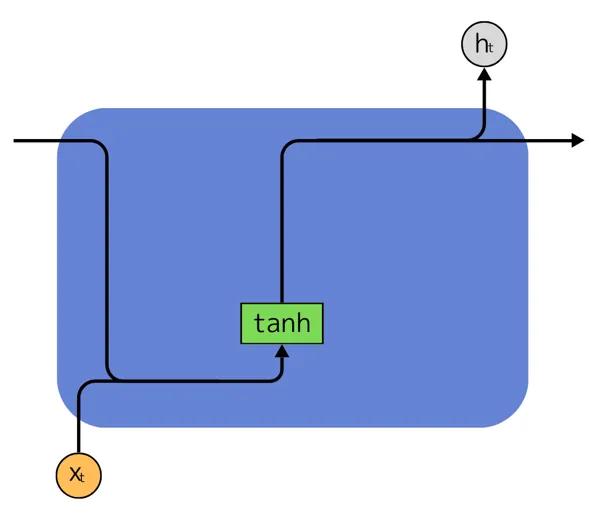

内部状態の更新(過去の情報を覚える仕組み)

RNNは、過去の情報を記憶しながら、新しい情報を次々に処理していきます。これを実現するために、内部状態(h_t)が更新されます。

h_t

今の時刻でRNNが持っている「記憶」や「状態」。h_{t-1}

前の時刻の状態。この部分が「過去の記憶」を意味します。x_t

今、RNNに入ってきた新しいデータ(例えば、テキストなら現在の単語)。W_h, W_x

過去の状態や現在の入力にどれだけ重要度をつけるかを決める「重み」です。b

モデルを調整するためのパラメータです。

つまり、RNNは前の時刻(

情報の伝播方法

RNNは過去の情報をどのように保持し、次に伝えるかという方法を決める仕組みがあります。

フィードバック接続による情報保持

- RNNでは、前の時刻の情報を「フィードバック」で受け取り、それを次の時刻に伝えます。このフィードバックが「過去の情報を覚えている」というメカニズムを作っています。

- つまり、RNNは「前の状態」が次にどう影響するかを考えながら、次の時刻に進んでいくのです。

状態ベクトルによる文脈表現

- RNNの「状態」は状態ベクトルとして表されます。状態ベクトルは「文脈」を表現し、例えば文章の意味や時系列データのパターンなどを覚えます。

- これにより、RNNは入力データが持つ意味のつながりや時間的な順番を理解できるようになります。

時間方向への展開

- RNNは、時間を順番に処理していきます。つまり、時系列データ(例えば、言葉や株価など)の一つ一つを順番に入力して、そのつながりを学習していきます。

- これにより、RNNは「過去の出来事」が次にどう影響するかを予測できるようになります。

RNNの種類

RNNには様々な派生アーキテクチャが存在し、それぞれが特定の課題を解決するために設計されています。

Simple RNN

Simple RNNは、最も基本的なRNNの構造です。時間の流れに沿って情報を「記憶」し、次に進むときにその記憶を使うシンプルな仕組みです。

- シンプルな構造

入力と出力を順番に処理し、過去の情報(状態)を次に伝えるだけ。 - 短期記憶

過去の情報をどんどん忘れていく傾向があり、長期的な依存関係をうまく捉えられない。

短期的な予測(昨日の気温から今日の気温を予測するなど)には有効ですが、長期的な依存関係(長期間の天気の傾向など)をうまく記憶するのが困難です。

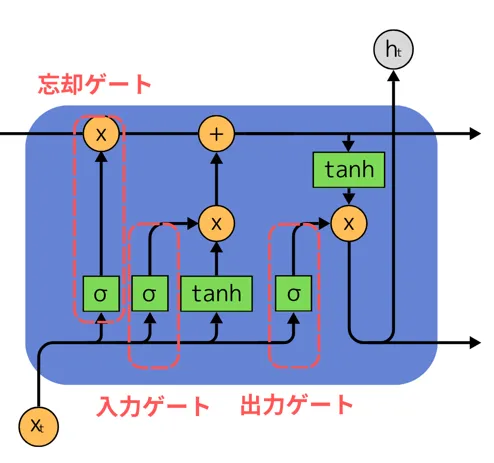

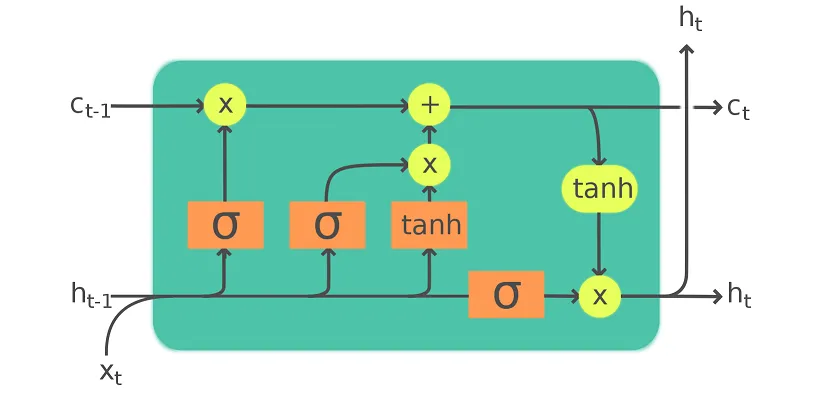

LSTM (Long Short-Term Memory)

LSTMは、Simple RNNの短期的な記憶の問題を解決するために作られた改良型のRNNです。

長期的な依存関係を学習する能力に優れており、情報を長期間保持することができます。

- 3つのゲート

LSTMは、情報をどれだけ「覚える」か、どれだけ「忘れる」か、そして「どの情報を新たに加えるか」を制御する3つのゲート(入力ゲート、忘却ゲート、出力ゲート)を使います。 - 長期記憶

これにより、LSTMは過去の重要な情報を長期間にわたって保持しやすくなります。

長期的な依存関係を捉える必要があるタスク(長い文章の意味の理解、機械翻訳など)に有効です。

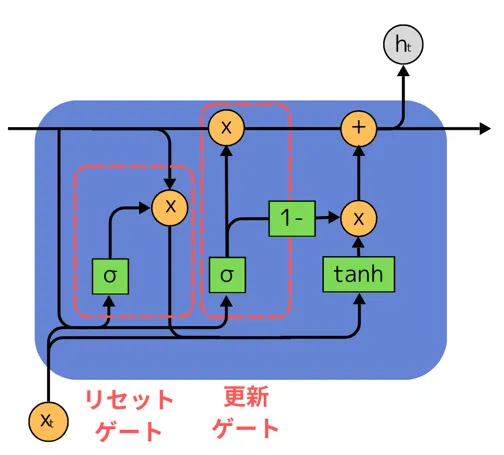

GRU (Gated Recurrent Unit)

GRUは、LSTMと似たような機能を持つRNNですが、構造が少し簡略化されており、計算の効率性が高いです。

LSTMのゲートを一部統合し、モデルを簡単にしています。

- 2つのゲート

GRUは、LSTMの「入力ゲート」と「忘却ゲート」を統合して、「更新ゲート」と「リセットゲート」という2つのゲートを使用します。 - 簡素化された計算

LSTMと同じように長期的な依存関係を捉える能力がありながらも、計算が効率的です。

計算リソースが限られている場合や、モデルのトレーニング速度を重視する場合に適しています。

双方向RNN (Bidirectional RNN)

双方向RNNは、入力データを「前から後ろ」と「後ろから前」の2方向から同時に処理するRNNです。これにより、過去の情報だけでなく未来の情報も取り入れて学習することができます。

- 2つのRNN

1つのRNNが順方向(過去から未来へ)に情報を処理し、もう1つのRNNが逆方向(未来から過去へ)に情報を処理します。両方の情報を結びつけて最終的な出力を決定します。 - 未来の文脈を考慮

文章や時系列データのようなタスクでは、未来の情報を考慮に入れることで、精度が向上することがあります。

音声認識や機械翻訳では、文脈を前後両方から理解するために効果的です。文章全体を通して意味を捉えやすくなります。

RNNの学習

RNNの学習には特有の手法と課題があり、効果的な学習のために様々な工夫が必要です。

時系列データとは?

時系列データとは、時間の経過とともに変化するデータのことを指します。

- 順序依存性

データの順番が重要です。過去のデータが未来の予測に影響を与えるため、RNNは過去の情報を「記憶」しながら処理します。 - 動的な変化

時系列データは時間とともに動的に変化し、モデルはその変化をうまく捉える必要があります。

RNNは時系列データに対して、時間的な依存関係を学習し、次の予測を行うのに適しています。

Backpropagation Through Time (BPTT)

RNNの学習は、通常のニューラルネットワークで使う**逆伝播(バックプロパゲーション)**と似ていますが、**BPTT(Backpropagation Through Time)**という方法を使って学習します。

BPTTとは

RNNの学習は、時間をまたいで行うため、時系列データの各タイムステップにおける誤差を遡って計算します。

これが「時間を遡って誤差を伝播」させるという意味で、「Backpropagation Through Time」と呼ばれます。

各時刻の出力が次の時刻に影響を与えるので、誤差を逆順に遡って計算し、各タイムステップでの重みを更新します。

BPTTの流れ

BPTTは、RNNが時間を超えて学習するための方法ですが、計算が複雑でリソースを消費します。

- フォワードパス

時系列データを入力としてRNNが順番に処理を行い、最終的な予測を出します。 - バックワードパス

誤差を最終出力から逆方向に伝播させ、各タイムステップでの誤差を計算します。この誤差をもとに重みを更新します。

勾配消失問題

BPTTを使用してバックプロパゲーションを行う際に、誤差の勾配が時間とともに非常に小さくなり、更新がほとんど行われなくなる現象を勾配消失問題といいます。

勾配消失問題の原因

時系列が長くなると、逆伝播中に誤差の勾配がどんどん小さくなり、最初の時刻の重みがほとんど更新されないため、長期依存関係を学習できなくなります。

特に、tanhやsigmoidなどの活性化関数を使っている場合、勾配が非常に小さくなるため、この問題が起こりやすくなります。

勾配消失問題の影響

長い時系列データに対して、過去の情報を保持し続けることができず、RNNが「過去の重要な情報」を無視してしまうことになります。

結果的に、RNNは長期的な依存関係を捉えることができず、学習がうまく進まなくなります。

RNNの実装

実際にRNNを実装する場合の例を紹介します。以下はGoogle Colabの環境で実行可能な模擬コードです。

RNNの模擬コード

for layer_name, layer_activation in zip(layer_names, activations):

# 出力の形状を確認

if len(layer_activation.shape) == 3: # return_sequences=True の場合

num_steps = layer_activation.shape[1] # 時系列のステップ数

num_features = layer_activation.shape[2] # 特徴数

# プロットの設定

plt.figure(figsize=(12, 6))

plt.imshow(layer_activation[0].T, aspect='auto', cmap='viridis')

plt.colorbar()

plt.title(f'Feature maps from layer: {layer_name}')

plt.xlabel('Time Steps')

plt.ylabel('Features')

plt.show()

elif len(layer_activation.shape) == 2: # return_sequences=False の場合

num_features = layer_activation.shape[1] # 特徴数のみ

print(f"Layer {layer_name} output shape: {layer_activation.shape}")

plt.figure(figsize=(6, 3))

plt.bar(range(num_features), layer_activation[0])

plt.title(f'Feature map from layer: {layer_name}')

plt.xlabel('Features')

plt.ylabel('Activation')

plt.show()

else:

print(f"Unexpected shape for layer {layer_name}: {layer_activation.shape}")

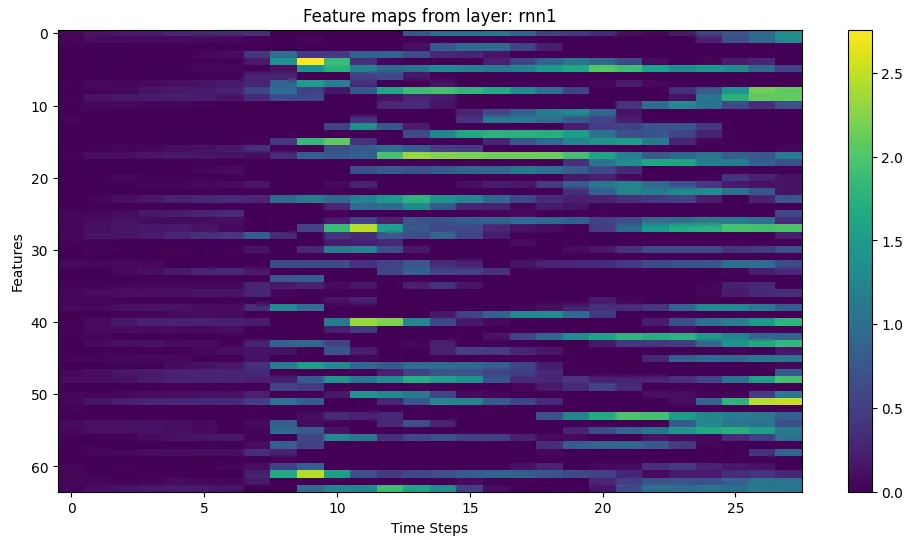

実行結果

実行すると、RNNの時系列処理の結果が以下のように可視化されます。

これは最初のRNN層 (rnn1) の出力を可視化しています。

出力された特徴マップは、縦軸が「特徴量」、横軸が「タイムステップ」、色が「各特徴量の活性化強度」を示します。

これにより、特定の特徴がどのタイムステップで強く活性化しているのかが分かります。

ある特徴が特定のタイミングで高い値を持つ場合、それが重要な時間的イベントである可能性があります。

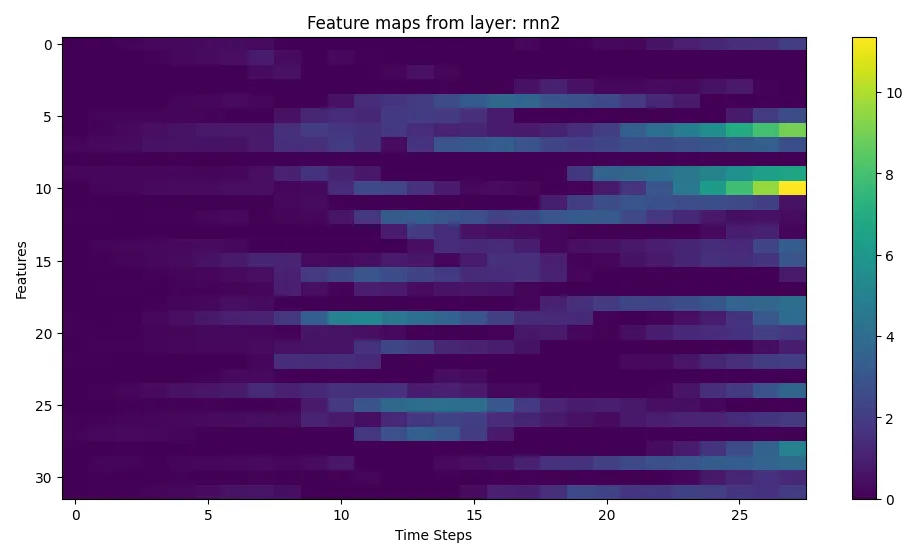

以下の画像は、第2層目のRNN(rnn2)の出力を可視化しています。

第2層は第1層の出力を受け取ります。rnn1 が時系列データの「基本的な特徴」を抽出し、その出力が rnn2 の入力として与えられます。

第2層のRNNは、通常、長期的な文脈情報や、rnn1 が捉えきれなかった時間的な依存性を捕捉する役割を果たします。

たとえば、rnn1が音声データから周波数の変化を学習している場合、rnn2はそれを基に単語やフレーズのような長期的な依存関係を捉える役割を担います。

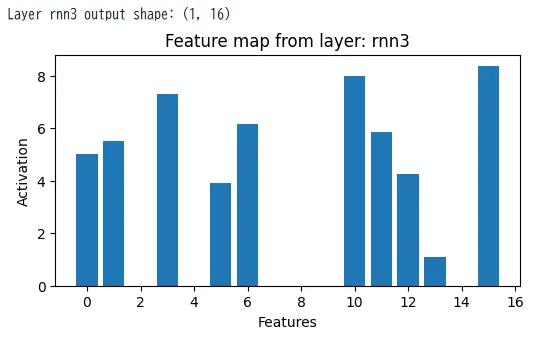

以下は第3層のRNN (rnn3) の出力を可視化しています。

rnn3 は、rnn2 の出力を受け取り、さらに高度な特徴を学習します。

特に rnn3 は、モデルの最も深い層として、時系列全体の情報を統合して出力する役割を果たします。

音声データの場合は、単音や音節(rnn1)→ 単語やフレーズ(rnn2)→ 全体の意味や感情(rnn3)という階層構造になります。株価データの場合は、短期的な変動(rnn1)→ 中期的なトレンド(rnn2)→ 長期的なパターンや異常検出(rnn3)のように情報が抽象化されていきます。

RNNの活用事例

RNNは現在、さまざまな分野で活用されています。以下にその具体例を紹介します。

自然言語処理

機械翻訳

| 応用例 | 特徴 | 具体的なサービス |

|---|---|---|

| テキスト翻訳 | ・文脈を考慮した翻訳 ・自然な文章生成 |

・Google翻訳 ・DeepL |

| 同時通訳 | ・リアルタイム処理 ・話者の意図理解 |

・会議システム ・ビジネス通訳 |

Microsoft Translateの例

Microsoft Translatorも、ニューラルネットワークを基盤にした翻訳技術を使用しており、RNN(リカレントニューラルネットワーク)を利用したアーキテクチャを導入しています。特にAzureの機械翻訳APIを通じて提供される翻訳サービスでは、RNNやLSTMが使われています。

Microsoft ResearchのRNN for Language Understanding論文でも、RNNを活用した言語理解の技術が詳しく解説されています。

テキスト生成

- チャットボット対話

- 文章要約

- コンテンツ自動生成

TensorFlowの例

Googleが提供する機械学習ライブラリTensorFlowの公式サイトでは、RNNを用いたテキスト生成のチュートリアルが公開されています。TensFlowではシェイクスピアの作品をデータセットとして使用し、文字ベースのRNNモデルでテキスト生成することができます。

TensorFlow公式チュートリアルでも、RNNを用いたテキスト生成の実装方法が公開されています。

感情分析

- SNSの投稿分析

- カスタマーレビュー評価

- マーケティング調査

Empathの例

「Empath」は、音声から感情をリアルタイムで解析する技術です。この技術は、RNNを含む深層学習モデルを活用しており、コールセンターでの顧客対応や、アスリートのメンタルサポートなど、さまざまな分野での感情分析に利用されています。

Empath公式サイトで詳細を確認できます。

音声認識

| 用途 | 特徴 | 例 |

|---|---|---|

| 音声文字起こし | ・高精度な認識 ・ノイズ耐性 |

・会議録作成 ・字幕生成 |

| 音声アシスタント | ・自然な対話 ・コマンド認識 |

・Siri ・Google Assistant |

Deepgramの例

Deepgramは、音声認識サービスを提供する企業で、RNNを活用して高精度の音声認識を実現しています。

Deepgramの音声認識システムは、音声データを解析してテキストに変換する際に、RNNやLSTM技術を使用しています。企業はこれを利用して、カスタマーサービスや会話の解析を行っています。

Deepgram公式サイトで詳細を確認できます。

時系列予測

株価予測

- 価格変動の予測

- トレンド分析

- リスク評価

QuantConnectの例

QuantConnectは、アルゴリズムトレーディングと株価予測のためのオープンソースプラットフォームを提供しています。株式市場を予測するためにRNN技術(特にLSTM)を利用することができ、ユーザーはこれを使って自分の取引アルゴリズムを開発できます。

以下はxは入力データ、cは長期記憶、hは現在の状態であり短期記憶として機能します。

https://www.quantconnect.com/docs/v2/research-environment/applying-research/long-short-term-memory

https://www.quantconnect.com/docs/v2/research-environment/applying-research/long-short-term-memory

RNNの展望

RNNは今後さらなる改良が期待されています。以下では、技術面と具体的な応用の2つに分けてRNNの展望を説明します。

技術面

モデルの改良と効率化

- 長期依存関係の改善

- RNNは長期的な依存関係を学習するのが難しいとされていますが、これを解消する新しいアーキテクチャや手法が開発される可能性があります。

- LSTMやGRUの改良版や、TransformerのAttention機構とRNNを組み合わせたハイブリッドモデルが期待されます。

- 勾配消失問題の解決

- 勾配消失問題を軽減するための新しい最適化手法や正則化技術が進化し、RNNがより深い時間的依存関係を学習できるようになることが期待されます。

計算効率の向上

- 軽量化

- モデルのパラメータ数を減らしつつ、性能を維持または向上させる軽量化手法(例: プルーニングや量子化)が進む。

- エッジデバイス(スマートフォン、IoTデバイスなど)でリアルタイム処理が可能になる。

- 専用ハードウェア

- AI向けの専用チップ(TPU、NPUなど)がさらに進化し、RNNの学習と推論が高速化される。

新たな学習手法の導入

- 自己教師あり学習

- ラベルのないデータを使った自己教師あり学習がRNNにも適用され、データの準備が困難な分野でも高性能なモデルが構築可能になる。

- 強化学習の統合

- RNNが強化学習と組み合わさり、長期的な意思決定を伴うタスク(例: ロボット制御、経済シミュレーションなど)での性能向上が期待される。

具体的な応用

上記の技術面での展望を踏まえて、今後どのような分野に活用が期待されるかを以下の表にまとめました。

| 領域 | 技術面の展望 | 応用面の展望 |

|---|---|---|

| モデル改良 | 長期依存関係の学習、勾配消失問題の解決 | 医療(診断支援)、金融(株価予測)、感情分析など |

| 効率化 | モデルの軽量化、エッジデバイスでの利用 | 天気予報、物流の最適化、交通管理 |

| 新学習手法 | 自己教師あり学習、強化学習の統合 | 音声認識、テキスト生成、創造的なエンターテインメント |

AI技術の選定眼を組織の業務改革に活かすなら

RNNやLSTM、Transformerの使い分けを理解した方は、「どのAI技術がどの業務に適しているか」を判断できる力を持っています。この技術選定の視点は、時系列予測や自然言語処理に限らず、組織全体の業務プロセスにAIを導入する際にも不可欠な能力です。

AI総合研究所では、Microsoft環境でのAI業務自動化を段階的に進めるための実践ガイド(220ページ)を無料で提供しています。Copilot ChatからM365 Copilot、Copilot Studio、Microsoft Foundryへと段階的にスケールする設計手順を、経費精算・申請承認・人事・情シスなど部門別のBefore/After・KPI付きで解説しています。モデルの特性を理解している方だからこそ、業務設計と運用設計の重要性にも共感いただける内容です。

AI総合研究所の専任チームが、AI技術の知見を組織の業務導入戦略に接続するところまで支援します。まずはガイドで段階的な導入の設計手順をご確認ください。

機械学習の知見を組織のAI導入に活かす

モデル理解から業務実装設計へ

RNNの仕組みを理解したなら、次はAI技術を組織の業務プロセスにどう実装するかの設計が重要です。Microsoft環境での段階的導入を220ページの実践ガイドで解説しています。

まとめ

本記事では、RNNの基本構造から種類、学習方法、実装例、活用事例までを解説しました。

RNNを理解する上で重要なポイントは3つあります。

1つ目は、ループ構造による時系列データ処理の有効性です。RNNは過去の情報を内部状態として保持しながら処理を進めるため、テキスト・音声・株価など順序のあるデータの解析に適しています。

2つ目は、用途に応じたアーキテクチャの選択です。短期依存ならSimple RNN、長期依存ならLSTM、計算効率重視ならGRU、前後文脈の活用なら双方向RNNと、タスクの要件に合わせて使い分けることが実用上のポイントになります。

3つ目は、Transformerとの使い分けです。2026年現在、自然言語処理の主流はTransformerベースのモデル(GPT・BERT等)に移行していますが、リアルタイム音声処理や軽量デバイスでの時系列予測など、逐次処理が求められる場面ではRNN系アーキテクチャが依然として有効です。

まずは本記事のPython実装例をGoogle Colabで実行し、RNNのレイヤー別出力を可視化するところから始めてください。