この記事のポイント

Azure 503エラーはワーカープロセスクラッシュとリソース枯渇が主因。まずApp Service診断ツールで原因を切り分けるのが最適

Free/Sharedプランの日次CPUクォータ超過による503は本番環境では避けるべき。Basic以上への移行が第一候補

Auto-Heal機能の有効化とAlways On設定は503の予防策として必須。設定していないApp Serviceは即時対応すべき

Application Gatewayの503はバックエンドヘルスチェック設定の不備が原因になりやすく、カスケード障害を防ぐにはカスタムプローブの適切な設計が有効

Azure Functionsの503は従量課金プランのコールドスタートに起因するケースが多く、Premium Planへの移行またはウォームアップ設定が最適解

Microsoft MVP・AIパートナー。LinkX Japan株式会社 代表取締役。東京工業大学大学院にて自然言語処理・金融工学を研究。NHK放送技術研究所でAI・ブロックチェーンの研究開発に従事し、国際学会・ジャーナルでの発表多数。経営情報学会 優秀賞受賞。シンガポールでWeb3企業を創業後、現在は企業向けAI導入・DX推進を支援。

Azure環境でWebアプリケーションやAPIにアクセスした際に表示される503 Service Unavailableエラーは、サーバーが一時的にリクエストを処理できない状態を示します。

本記事では、App Service、Application Gateway、Azure Functionsなど各サービスで503エラーが発生する8つの原因と、サービス別の対処法を解説します。

Auto-Heal機能やスケーリング設定などのベストプラクティスもあわせて紹介し、503エラーの発生を未然に防ぐための知見を提供します。

Azureの503エラー(Service Unavailable)とは

Azureの503エラーは、HTTPステータスコードの一つで、サーバーが一時的にリクエストを処理できない状態であることを示します。ブラウザでは「503 Service Unavailable」というメッセージとともに表示され、Webページのロードが遅くなる、または完全にアクセスできなくなるといった症状として表れます。

503エラーは、サーバー自体は稼働しているがリクエストを受け付けられない「一時的な」状態を意味します。これは、アプリケーション内部のバグで発生する500 Internal Server Errorや、リバースプロキシがバックエンドから無効な応答を受け取る502 Bad Gateway、バックエンドからの応答が時間内に返らない504 Gateway Timeoutとは異なります。以下の表で5xxエラーの違いを整理しています。

| エラーコード | 名称 | 意味 | 主な発生サービス |

|---|---|---|---|

| 500 | Internal Server Error | アプリケーション内部のエラー | App Service、Azure Functions |

| 502 | Bad Gateway | バックエンドからの無効な応答 | Application Gateway、Front Door |

| 503 | Service Unavailable | サーバーが一時的にリクエスト不可 | App Service、Application Gateway、Functions |

| 504 | Gateway Timeout | バックエンドからの応答タイムアウト | Application Gateway、Front Door |

この表からわかるとおり、503エラーはApp Service、Application Gateway、Azure Functionsなど複数のサービスで発生する可能性があり、原因の特定にはサービスごとの切り分けが重要です。API呼び出しやバックエンドサービスへのリクエストが失敗する場合もあり、アプリケーション全体のパフォーマンスに影響を及ぼすことがあります。

Azure 503エラーの主な発生原因

503エラーが発生する原因は多岐にわたります。以下に、Azure環境で頻繁に発生する8つの原因を解説します。原因を正確に特定することが、迅速な復旧への第一歩です。

App Serviceのワーカープロセスクラッシュ

App Serviceで最も一般的な503エラーの原因の一つが、ワーカープロセス(w3wp.exe)のクラッシュです。アプリケーションの起動時に依存関係の不足や設定エラーが発生すると、ワーカープロセスが正常に開始できず、すべてのリクエストに対して503エラーが返されます。

特にNode.jsやPythonアプリケーションでは、パッケージの依存関係の不整合や環境変数の設定ミスが原因で起動に失敗するケースが多く報告されています。ワーカープロセスが繰り返しクラッシュすると、プラットフォームがクールダウン期間を設定してリクエストをブロックするため、503エラーが継続します。

App Serviceプランのリソース枯渇

App Serviceプランに割り当てられたCPUやメモリのリソースが不足すると、新規リクエストを処理できなくなり503エラーが発生します。Azure Portalのメトリクスで、CPU使用率やメモリ使用量が継続的に80%を超えている場合は、リソース枯渇が原因である可能性が高いです。

大量のトラフィックを受けるWebアプリケーションや、重い処理を実行するバッチ処理系アプリケーションで特に発生しやすい原因です。

Free/Sharedプランの日次CPUクォータ超過

App ServiceのFreeプランとSharedプランには、日次CPUクォータの制限が設けられています。以下の表でプラン別のクォータを確認できます。

| プラン | 日次CPUクォータ | メモリ | クォータ超過時の動作 |

|---|---|---|---|

| Free(F1) | 60分/日 | 1 GB | アプリが自動停止、翌日リセットまで503 |

| Shared(D1) | 240分/日 | 1 GB | アプリが自動停止、翌日リセットまで503 |

| Basic(B1)以上 | 無制限 | 1.75 GB以上 | 日次クォータなし |

この表に示されているように、Free/Sharedプランではクォータを超過するとアプリが自動停止され、翌日のリセットまですべてのリクエストに対して503エラーが返されます。開発・テスト環境で使用している場合は問題になりにくいですが、本番環境でFree/Sharedプランを使用すると予期しないサービス停止につながります。

Always On未設定によるアイドルアンロード

App ServiceのAlways On設定が無効になっている場合、一定時間リクエストがないとアプリケーションがメモリからアンロードされます。次のリクエストが来た際にアプリを再読み込みする必要があり、この間に503エラーが返されることがあります。

Always On機能はBasicプラン以上で利用可能です。Free/Sharedプランではこの機能を有効にできないため、定期的なリクエストがない場合はアイドルアンロードが避けられません。

Application Gatewayのバックエンド全インスタンス異常

Application Gatewayでは、ヘルスプローブによってバックエンドサーバーの正常性を監視しています。すべてのバックエンドインスタンスがヘルスプローブに失敗してUnhealthyと判定されると、Application Gatewayはリクエストを転送する先がなくなり、503エラーを返します。

ヘルスプローブの失敗原因としては、NSGやUDRによるネットワークブロック、バックエンドアプリケーションの応答遅延、プローブのタイムアウト設定が短すぎるケースなどが挙げられます。

Azure Functionsのコールドスタート

Azure FunctionsのConsumptionプランでは、一定時間アクセスがないとインスタンスが解放されます。次のリクエスト時にインスタンスの割り当てとアプリケーションの初期化が行われますが、この間にスケールコントローラーの処理が追いつかず、503 HostServiceUnavailableエラーが返されることがあります。

特にトラフィックが急増するシナリオでは、新しいインスタンスがオンラインになるまでの間に既存インスタンスが過負荷となり、散発的な503エラーが発生します。

ヘルスチェックのカスケード障害

App Serviceのヘルスチェック機能は、エンドポイントの応答を監視してインスタンスの正常性を判断します。ヘルスチェックエンドポイントがデータベースや外部APIに依存している場合、それらのサービスが一時的に障害を起こすとヘルスチェックが失敗し、正常なインスタンスまでUnhealthyと判定されて503エラーのカスケード障害が発生します。

Azureインフラストラクチャの障害

Azureのデータセンターやネットワークインフラに障害が発生した場合、影響を受けるリージョン内のサービスで広範囲にわたる503エラーが発生することがあります。この種の障害は個別のアプリケーション設定では対処できないため、マルチリージョン構成による冗長化が重要な対策となります。

Azure 503エラーのサービス別対処法

503エラーの対処法はサービスによって異なります。以下に、主要なAzureサービスごとの対処手順を解説します。

App Serviceの503エラー対処法

App Serviceで発生する503エラーに対しては、以下の手順で対処します。

-

アプリの状態確認

Azure PortalでApp Serviceの状態が「停止」になっていないか確認します。停止状態の場合はすべてのリクエストに対して503が返されるため、まずアプリを起動してください

-

メトリクスの確認

Azure Portalのメトリクスダッシュボードで、CPU使用率とメモリ使用量を確認します。いずれかが継続的に80%を超えている場合は、App Serviceプランのスケールアップ(より上位のプランへの変更)またはスケールアウト(インスタンス数の増加)を検討してください

-

アプリの再起動

一時的な問題であれば、アプリの再起動が最もシンプルな解決策です。Azure Portalからの操作、またはAzure CLIでの再起動が可能です

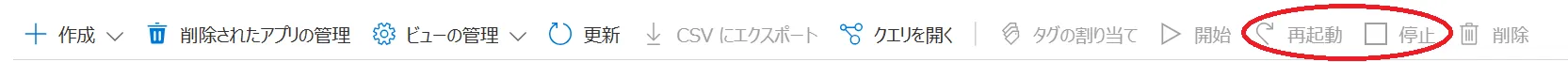

Azure PortalのApp Service管理画面

App Serviceの停止・再起動ボタン

-

プランのアップグレード

Free/SharedプランでCPUクォータ超過が原因の場合は、Basic以上のプランにアップグレードすることで日次クォータ制限を解消できます。本番環境ではStandard以上のプランを推奨します

-

ワーカープロセスのログ確認

アプリケーションログを有効にし、ワーカープロセスのクラッシュ原因を特定します。Kuduコンソール(SCMダッシュボード)にアクセスして、詳細なログとメモリダンプを取得できます

Application Gatewayの503エラー対処法

Application Gatewayで503エラーが発生している場合は、バックエンドプールの正常性を中心に確認します。

-

バックエンドヘルスの確認

Azure Portalでバックエンドヘルスページを確認し、Unhealthyと判定されているインスタンスを特定します。すべてのインスタンスがUnhealthyの場合は、ネットワーク構成(NSG、UDR)やDNS解決の問題を疑ってください

-

ヘルスプローブの設定見直し

デフォルトのヘルスプローブ設定が厳しすぎる場合は、タイムアウト値や異常しきい値を調整します。unhealthyThresholdは最低3に設定し、一時的なネットワークの揺らぎで誤ってUnhealthyと判定されるのを防ぎましょう

-

NSGルールの確認

Application GatewayのサブネットでV1 SKUの場合はポート65503-65534、V2 SKUの場合はポート65200-65535への通信がNSGで許可されているか確認してください。これらのポートはApplication Gatewayの管理通信に必要です

Azure Functionsの503エラー対処法

Azure Functionsで503エラーが発生する場合は、コールドスタートとスケーリングの問題を中心に確認します。

-

プランの変更検討

Consumptionプランでコールドスタートが頻発する場合は、Premium(Elastic Premium)プランへの移行を検討してください。Premiumプランでは事前ウォーム済みインスタンスが常時確保され、コールドスタートを回避できます

-

アプリケーション依存関係の最適化

起動時に大量のパッケージやモジュールを読み込む処理を軽量化することで、コールドスタートの時間を短縮できます。不要な依存関係の削除やレイジーロードの導入が効果的です

-

タイムアウト設定の確認

Consumptionプランの最大タイムアウトは230秒です。長時間実行される処理がある場合は、非同期パターン(Durable Functions)を採用するか、プランの変更を検討してください

Azure 503エラーのトラブルシューティング手順

503エラーが発生した際の体系的なトラブルシューティング手順を4つのステップで解説します。

Step 1 サービス正常性とアプリ状態の確認

最初に確認すべきは、Azureプラットフォーム側の障害有無とアプリケーションの稼働状態です。

Azure Portalにログインし、左メニューの「モニター」からService Healthを確認します。

Azure Portalのモニター画面

Service Healthをクリックすると、現在のサービス状態を確認できます。

Service Healthへのアクセス

サービスに異常がないかを確認し、影響を受けるサービスやリージョンを特定します。

サービス正常性ダッシュボード

Azureプラットフォーム側に障害がない場合は、App Serviceのアプリ状態が「実行中」であることを確認します。停止状態の場合は手動で起動してください。

Step 2 メトリクスとログの収集

Azure Monitorのメトリクスダッシュボードで、503エラーが発生した時刻前後の以下のメトリクスを確認します。

-

CPU使用率

継続的に80%を超えていた場合、リソース枯渇が原因の可能性が高い

-

メモリ使用量

メモリワーキングセットが上限に近づいていた場合、メモリリークやリソース不足を疑う

-

HTTPリクエスト数

503エラーの発生前にリクエスト数が急増していた場合、トラフィックスパイクが原因

-

HTTPサーバーエラー数

503の発生頻度と時間帯のパターンを確認し、散発的か持続的かを判断する

Log Analyticsでアプリケーションログを分析し、エラーの詳細な原因を特定します。

Step 3 診断ツールとKuduコンソールの活用

App Serviceの「問題の診断と解決」機能は、設定不要で利用できるインテリジェントな診断ツールです。Azure PortalでApp Serviceアプリに移動し、左メニューから「問題の診断と解決」を選択すると、AIが問題箇所を特定し、解決に必要な情報を提示します。

Kuduコンソール(SCMダッシュボード)では、ファイルのデバッグ、環境設定の確認、ログストリームの監視が可能です。Azure Portalで「開発ツール」から「高度なツール」を選択し、Kuduを開きます。ワーカープロセスのクラッシュが疑われる場合は、Kuduを通じてメモリダンプを取得し、より詳細な調査を行えます。

Network Watcherを使用してネットワーク構成を検証し、NSGやUDRによる通信ブロックがないかも確認してください。

Step 4 サポートへの問い合わせ

上記の手順で原因を特定できない場合は、Azureサポートに問い合わせてください。問い合わせ時には以下の情報を準備しておくと、迅速な対応が期待できます。

-

エラーの発生時刻と頻度(散発的か持続的か)

-

影響を受けるサービスとリソース名

-

メトリクスのスクリーンショット(CPU、メモリ、HTTPエラー数)

-

診断ツールの結果やKuduログの抜粋

Azure 503エラーを未然に防ぐベストプラクティス

503エラーの発生を最小限に抑えるための予防策を以下に紹介します。

-

Auto-Heal機能の有効化

Auto-Heal機能は、メモリ使用量の閾値超過、リクエスト処理時間の長期化、リクエスト数の急増などの条件に基づいて、ワーカープロセスを自動的に再起動します。多くの場合、プロセスの再起動が問題解決の最も直接的な方法であり、Auto-Healはこれを人手を介さず自動で実行します。Web.configファイルにトリガー条件を設定するだけで有効化できます

-

Always On設定の有効化

Basicプラン以上を使用している場合は、Always On設定を必ず有効にしてください。これにより、アプリがアイドル状態でもメモリにロードされた状態が維持され、コールドスタートによる503エラーを防止できます

-

ヘルスチェックエンドポイントの適切な設計

ヘルスチェックエンドポイントは軽量に設計し、外部サービス(データベース、外部API)への依存を最小限に抑えてください。外部依存がある場合は、依存先の一時的な障害がヘルスチェック失敗を引き起こし、カスケード障害につながるリスクがあります

-

オートスケールの適切な設定

Azure Monitorのメトリクスに基づくオートスケールルールを設定し、トラフィックの増加に応じて自動的にインスタンスを追加できるようにしておきましょう。スケールアウトのクールダウン期間を短めに設定し、トラフィックスパイクに迅速に対応できるようにすることも重要です。予測可能なピーク時間帯には、スケジュールベースのスケーリングルールを追加することを推奨します

-

マルチリージョン構成による冗長化

Azureインフラの障害に備えて、Azure Traffic ManagerやAzure Front Doorを活用したマルチリージョンデプロイメントを検討してください。異なるリージョンや可用性ゾーンにアプリケーションを分散配置することで、一箇所の障害が全体のサービス停止に直結するリスクを軽減できます

-

Application Insights監視の導入

Application Insightsを導入することで、アプリケーションの依存関係マップやスマート検出機能が利用可能になります。異常なパフォーマンス低下やエラー率の上昇を自動検知し、Microsoft Sentinelと連携したアラート通知で迅速な対応が可能です

Azure 503エラーの注意点と実務での落とし穴

安定稼働していたWebアプリケーションが、ある朝突然503エラーを返し始める——Azure環境ではこうした状況は珍しくありません。トラフィックのピーク、ワーカープロセスのクラッシュ、Free/Sharedプランの日次CPUクォータ超過など、原因は多岐にわたり、問題の切り分けなしに対処すると復旧に時間がかかります。

以下に、実務で特に注意すべき4つの落とし穴を整理します。

-

Free/Sharedプランの日次CPUクォータのサイレント超過

Free/Sharedプランでは、CPUクォータを超過してもメール通知やアラートが自動的に送信されません。アプリが突然停止して503エラーが発生し、原因がわからないまま翌日にリセットされて自然復旧するというパターンが繰り返されるケースがあります。本番環境では必ずBasic以上のプランを使用し、開発環境でもクォータの消費状況をAzure Portalで定期的に確認してください

-

ヘルスチェックのカスケード障害

ヘルスチェックエンドポイントにデータベースクエリや外部API呼び出しを含めると、データベースが一時的に応答遅延を起こしただけですべてのインスタンスがUnhealthyと判定され、サービス全体が503エラーを返す事態になります。ヘルスチェックは軽量な内部処理のみで完結させるのが鉄則です

-

オートスケールのクールダウン期間中の503エラー

オートスケールルールのクールダウン期間(デフォルト5分)が長すぎると、急激なトラフィック増加に対して新しいインスタンスの追加が間に合わず、既存インスタンスが過負荷になって503エラーが発生します。ピーク時間帯が予測可能な場合は、事前にスケジュールベースのルールでインスタンス数を増やしておくことが効果的です

-

デプロイメント中の一時的な503エラー

App Serviceへのデプロイメント中、特にスロットスワップを使用しない直接デプロイでは、アプリケーションの再起動が発生し一時的に503エラーが返されます。本番環境では必ずデプロイメントスロットを活用し、スワップ前のウォームアップを確認してからトラフィックを切り替えてください。Azureの障害事例でもデプロイメント起因の503エラーは多く報告されています

Azureのセキュリティ対策の観点からも、503エラーの頻発はDDoS攻撃の兆候である可能性があるため、Azure DDoS Protectionと組み合わせた監視を推奨します。

Azureサポートプランの料金比較

503エラーの原因特定が難しい場合や、迅速な復旧が必要なビジネスクリティカルな環境では、Azureサポートプランの活用が有効です。以下の表で各プランの特徴を比較しています(2026年3月時点)。

| プラン | 月額料金 | 初回応答時間(重大度A) | 技術サポート範囲 |

|---|---|---|---|

| Basic | 無料 | - | セルフサービスのみ |

| Developer | 約$29/月 | 8営業時間以内 | 開発/テスト環境 |

| Standard | $100/月 | 1時間以内 | 本番ワークロード |

| Professional Direct | $1,000/月 | 1時間以内 | ビジネスクリティカル |

| Premier | 個別見積 | 15分以内(+TAM付き) | ミッションクリティカル |

この表に示されている初回応答時間は、重大度A(ビジネスへの影響が大きい障害)の場合の目安です。503エラーが本番環境のサービス停止を引き起こしている場合は、Standard以上のプランが推奨されます。

Azureのサポートプランの詳細や、Azureの料金体系全般については、それぞれの記事で詳しく解説しています。

Azure障害対応の知見をAI業務自動化にも活かすなら

503エラーの切り分けでApp ServiceやApplication Gatewayの障害対応を経験してきたなら、その運用知見はAI業務自動化システムの安定稼働にも不可欠です。AI業務自動化ガイドでは、インフラ運用の知見を活かしたAI導入の進め方を220ページにわたって解説しています。

Azure障害対応力をAI業務自動化にも

503エラー対応の知見をAI環境の安定運用に展開

503エラーの切り分けで培ったApp ServiceやApplication Gatewayの運用知見は、AI業務自動化システムの安定稼働にも不可欠です。220ページの実践ガイドで、Microsoft環境でのAI導入を計画してみませんか。

まとめ

Azure環境で発生する503 Service Unavailableエラーは、App Serviceのワーカープロセスクラッシュ、リソース枯渇、Free/Sharedプランのクォータ超過、Application Gatewayのバックエンド異常、Azure Functionsのコールドスタートなど、多様な原因から発生します。

迅速な復旧のためには、サービスごとの切り分けと段階的なトラブルシューティングが重要です。また、Auto-Heal機能の有効化、Always On設定、適切なヘルスチェック設計、オートスケールルールの最適化といった予防策を事前に講じておくことで、503エラーの発生を大幅に削減できます。

まずはAzure PortalでApp Serviceの「問題の診断と解決」を開き、503エラーが発生した時刻のアプリケーションログとメトリクス(CPU使用率、メモリ使用量、リクエスト数)を確認してみてください。Free/Sharedプランを使用している場合は、日次CPUクォータの消費状況もあわせてチェックすることをお勧めします。