この記事のポイント

VRAM 6GBクラスのGPUで画像生成を始めるなら、75%高速化を実現するForgeが最適な選択肢

AUTOMATIC1111からの移行は設定・拡張機能がほぼそのまま引き継げるため、既存ユーザーはForgeへの乗り換えを推奨

ノードベースの自由度が必要ならComfyUI、使い慣れたWebUI操作で高速化したいならForgeという使い分けが有効

Microsoft MVP・AIパートナー。LinkX Japan株式会社 代表取締役。東京工業大学大学院にて自然言語処理・金融工学を研究。NHK放送技術研究所でAI・ブロックチェーンの研究開発に従事し、国際学会・ジャーナルでの発表多数。経営情報学会 優秀賞受賞。シンガポールでWeb3企業を創業後、現在は企業向けAI導入・DX推進を支援。

Stable Diffusion WebUI Forgeは、AUTOMATIC1111から派生した高性能な画像生成GUIツールで、GPUメモリの最適化と推論速度の高速化に特化しています。2026年時点ではSD-WebUI 1.10.1ベースに更新され、SDXL・SD3.5・Flux.1 GGUF/NF4モデルにネイティブ対応しています。

この記事では、Azure仮想マシンおよびローカル環境でのForge導入手順を、環境構築からモデルのセットアップ、画像生成の実践までステップバイステップで解説します。さらに、AUTOMATIC1111やComfyUIとの違い、推奨GPUスペック、トラブルシューティングまで網羅しています。

おすすめのAI画像生成サービスについてはこちらの記事で詳しく解説しています。

目次

Stable Diffusion WebUI Forgeとは(2026年最新ガイド)

Forge NEOとFlux.1ネイティブ対応が変えるローカル画像生成の2026年動向

Azure VM接続からNVIDIAドライバ・CUDA・Forge起動までの実践ステップ

AUTOMATIC1111・ComfyUI・Fooocusとの4ツール比較と選定基準

Stable Diffusion WebUI Forgeとは(2026年最新ガイド)

Stable Diffusion WebUI Forge(以下Forge)は、lllyasviel氏が開発したオープンソースの画像生成GUIツールです。AUTOMATIC1111 WebUIをベースに、GPUメモリ管理の最適化と推論速度の高速化を実現しており、6GB VRAMのGPUでも最大75%の速度向上、8GB VRAMで約45%の速度向上が報告されています。2026年2月時点でSD-WebUI 1.10.1ベースに更新され、90日ごとに本家WebUIと同期するメンテナンスサイクルが維持されています。

ForgeはControlNet、FreeU、Stable Video Diffusion(SVD)などの人気拡張機能をプリインストールで搭載しているほか、Flux.1のBNB NF4およびGGUF(Q8_0/Q5_0/Q5_1/Q4_0/Q4_1)形式にネイティブ対応しています。GPU重み配分スライダーやQueue/Async Swapトグルにより、限られたVRAMでも大規模モデルを効率的に動作させることが可能です。

以下の表で、Forgeの基本情報を整理しました。この表を確認したうえで、次のセクションで2026年の最新動向とインストール手順を解説します。

| 項目 | 内容 |

|---|---|

| ツール名 | Stable Diffusion WebUI Forge |

| 開発者 | lllyasviel(ControlNet開発者) |

| ベース | SD-WebUI 1.10.1(2026年2月更新) |

| 対応モデル | SD 1.5 / SDXL / SD3.5 / Flux.1 GGUF・NF4 |

| 最小GPU要件 | NVIDIA RTX 1000シリーズ以上(6GB VRAM推奨) |

| 2026年注目機能 | Flux GGUF LoRAサポート、GPU重み配分スライダー |

| ライセンス | AGPL-3.0(オープンソース) |

Forgeの最大の強みは、AUTOMATIC1111では動作困難だったSDXLモデルを8GB VRAMのGPUで安定動作させる点にあります。個人クリエイターから企業のクリエイティブチームまで、幅広いユーザーがローカル環境で高品質な画像生成を行える環境を提供しています。Stable Diffusionの概要と料金については関連記事で解説しています。

Forge NEOとFlux.1ネイティブ対応が変えるローカル画像生成の2026年動向

2026年のローカル画像生成環境は、モデルの大型化とツールの分化が加速しています。Forge NEOと呼ばれるコミュニティ主導のフォーク版では、Torch 2.9.1とCUDA 13への対応が進み、RTX 5000シリーズを含む最新GPUでの動作が最適化されています。NEO版はワンクリックインストーラーを提供しており、WindowsおよびRunPod、Massed ComputeといったクラウドGPU環境での導入も容易になっています。

モデル面では、Flux.1がStable Diffusionの強力な対抗馬として台頭しています。Flux.1はフォトリアリスティックな画像品質とテキスト描画精度でSDXLを上回る評価を得ていますが、生成速度はSDXLの約4倍の時間を要します。ForgeはFlux.1のGGUF量子化モデルをネイティブサポートしているため、12GB VRAM程度のGPUでもFlux.1を動作させることが可能です。一方、SD3.5 Large/Medium/Turboも高品質なテキスト描画を実現しており、用途に応じたモデル選定が重要になっています。

ツール面では、ComfyUIがノードベースのワークフロー構築で上級者層を獲得し、Fooocusが初心者向けのシンプルなUIで入門層を取り込んでいます。Forgeは両者の中間に位置し、AUTOMATIC1111の操作感を維持しながらパフォーマンスを向上させたツールとして、最も幅広いユーザー層に適しています。Flux.1の詳細やFlux.2の最新情報については関連記事で解説しています。

環境構築とForgeのインストール手順

ForgeはローカルPC(Windows/Mac/Linux)およびクラウドGPU環境(Azure VM、RunPodなど)で動作します。本セクションでは、Azure仮想マシンを使用したインストール手順を中心に解説しますが、ローカル環境のユーザーはステップ2以降から同様の手順で導入できます。

以下の表で、Forge導入に推奨されるGPUスペックをモデル別に整理しました。

| モデル | 最小VRAM | 推奨VRAM | 生成速度の目安 |

|---|---|---|---|

| SD 1.5 | 4GB | 8GB | 512x512: 約2-3秒 |

| SDXL | 6GB | 12GB | 1024x1024: 約5-8秒 |

| SD3.5 Medium | 8GB | 12GB | 1024x1024: 約6-10秒 |

| Flux.1 GGUF Q4 | 8GB | 16GB | 1024x1024: 約15-25秒 |

| Flux.1 NF4 | 10GB | 16GB | 1024x1024: 約12-20秒 |

SDXLまでであれば8GB VRAMのGPU(RTX 4060相当)で十分動作しますが、Flux.1を快適に使用するには12GB以上のVRAMが推奨されます。Stable Diffusionにおすすめのグラフィックボードについては関連記事で詳しく解説しています。Azure VMの場合、NCasT4_v3シリーズ(16GB VRAM)やNCv3シリーズ(16-32GB VRAM)が適しています。Azure VMの詳細についてはこちらをご確認ください。

Azure VM接続からNVIDIAドライバ・CUDA・Forge起動までの実践ステップ

以下の手順に沿って、Azure仮想マシン上にForgeをインストールし、画像生成環境を構築します。ローカル環境のユーザーはステップ2以降を参照してください。

ステップ1 Azure VMへの接続

まず、以下のコマンドでAzureにログインします。

az login

使用するアカウントのサブスクリプション一覧が表示されるので、準備した仮想マシンのあるサブスクリプションの番号を入力してください。

サブスクリプションの選択

サブスクリプションの選択

SSHを使用して仮想マシンに接続します。以下のコマンドをターミナルで実行してください。

ssh -i {秘密鍵のパス} azureuser@{パブリックIPアドレス}

パブリックIPアドレスは、以下のコマンドまたはAzureポータルで確認できます。

terraform output public_ip_address

AzureポータルでのパブリックIPアドレスの確認

AzureポータルでのパブリックIPアドレスの確認

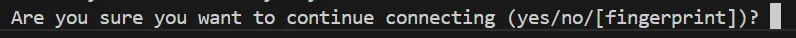

初めてSSH接続を行う場合は以下の警告が表示されますが、「yes」と入力して確定します。

SSH接続を初めて行う際に表示される警告

SSH接続を初めて行う際に表示される警告

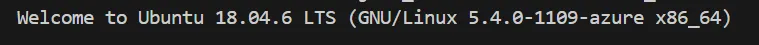

接続が成功すると、システム情報が表示されます。

SSH接続の成功

SSH接続の成功

一定時間操作がないと接続が中断されます。その場合は同じSSHコマンドを再実行して接続を復旧してください。

ステップ2 Homebrewと依存関係のインストール

仮想マシンに接続後、コマンド入力で各種操作を行います。

仮想マシンの操作

仮想マシンの操作

まず、必要な依存関係をインストールします。

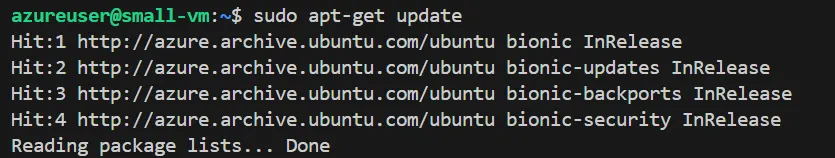

sudo apt-get update

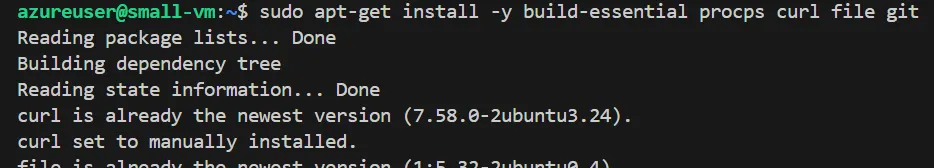

sudo apt-get install -y build-essential procps curl file git

1つ目のコマンドの実行結果

1つ目のコマンドの実行結果

2つ目のコマンドの実行結果の一部

2つ目のコマンドの実行結果の一部

次に、Homebrewをインストールします。

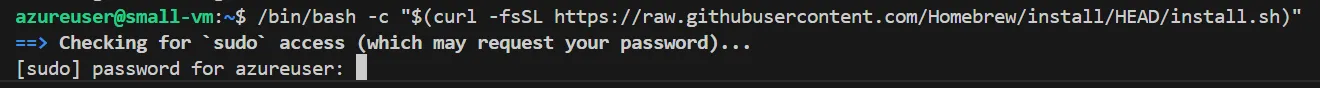

/bin/bash -c "$(curl -fsSL https://raw.githubusercontent.com/Homebrew/install/HEAD/install.sh)"

実行時にパスワードを求められます。

実行時のパスワード入力

実行時のパスワード入力

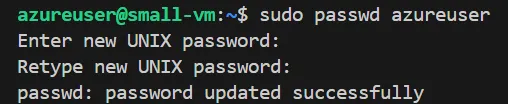

パスワードを忘れた場合は、以下のコマンドで再設定できます。

sudo passwd azureuser

パスワードの設定

パスワードの設定

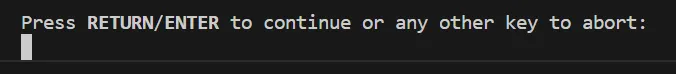

インストール途中で確認表示が出たら「Enter」を押して続行します。

Homebrewインストール時の操作

Homebrewインストール時の操作

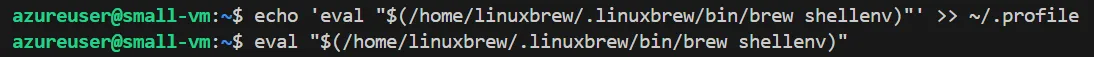

インストール完了後、シェル環境にHomebrewのパスを追加します。

echo 'eval "$(/home/linuxbrew/.linuxbrew/bin/brew shellenv)"' >> ~/.profile

eval "$(/home/linuxbrew/.linuxbrew/bin/brew shellenv)"

Homebrewインストール確認

Homebrewインストール確認

バージョンを確認してインストールが正常に完了したことを確認します。

brew --version

Homebrewバージョン表示

Homebrewバージョン表示

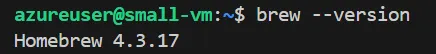

続いて、必要なツールをインストールします。

brew install cmake protobuf rust python@3.10 git wget

必要なツールのインストール

必要なツールのインストール

インストール完了には数分かかります。

ステップ3 NVIDIAドライバとCUDAツールキットのインストール

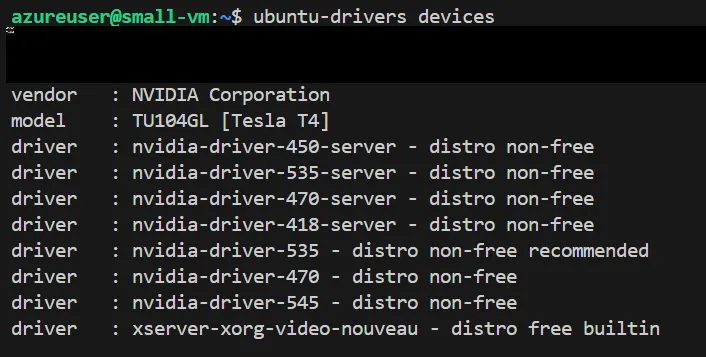

NVIDIAドライバはシステムのハードウェアに深く関わるため、aptを使用してインストールします。まず、使用可能なドライバのバージョンを確認します。

ubuntu-drivers devices

使用可能NVIDIAドライバ一覧

使用可能NVIDIAドライバ一覧

使用するバージョンを選び、以下のコマンドでNVIDIAドライバをインストールします。最後のコマンドで再起動するため、再度SSH接続が必要です。

sudo apt-get update

sudo apt-get install -y nvidia-driver-<バージョン番号>

sudo reboot

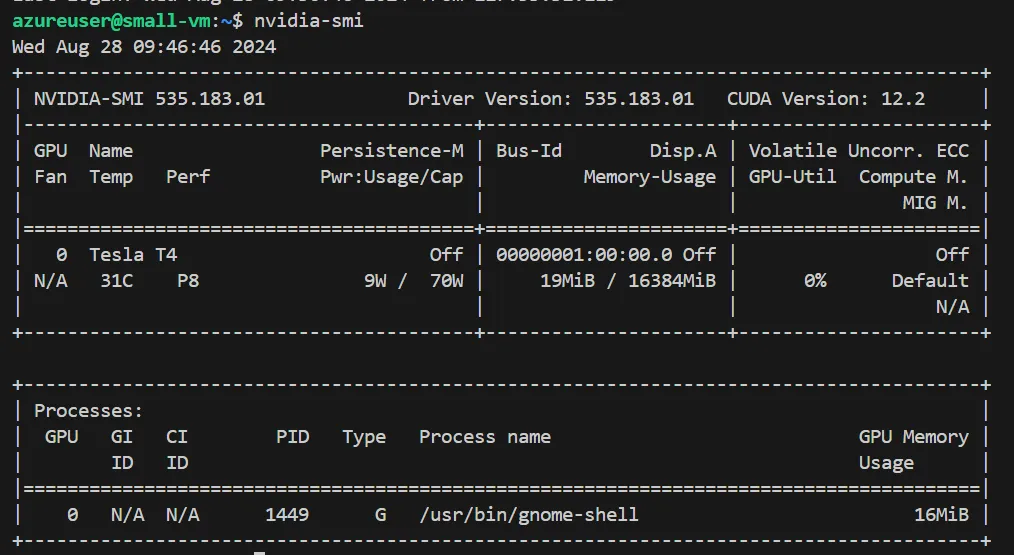

ドライバが正しくインストールされたか確認します。

nvidia-smi

NVIDIAドライバのインストール確認

NVIDIAドライバのインストール確認

次に、CUDAツールキットをインストールします。

sudo apt-get update

sudo apt-get install -y nvidia-cuda-toolkit

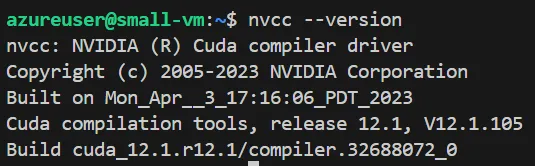

CUDAのインストールを確認します。

nvcc --version

CUDAのインストール確認

CUDAのインストール確認

環境変数を設定します。

echo 'export PATH=/usr/local/cuda/bin:$PATH' >> ~/.bashrc

echo 'export LD_LIBRARY_PATH=/usr/local/cuda/lib64:$LD_LIBRARY_PATH' >> ~/.bashrc

echo 'export LD_LIBRARY_PATH=/usr/lib/x86_64-linux-gnu:$LD_LIBRARY_PATH' >> ~/.bashrc

source ~/.bashrc

ステップ4 Forgeのクローンと起動

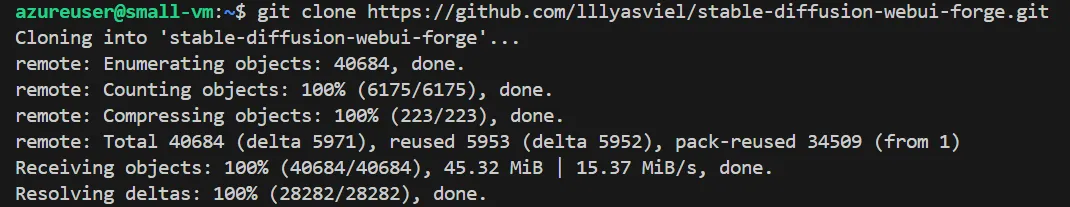

Forgeのリポジトリをクローンします。

git clone https://github.com/lllyasviel/stable-diffusion-webui-forge.git

リポジトリのクローン

リポジトリのクローン

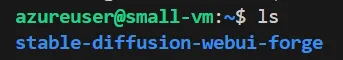

クローン完了後、フォルダが作成されていることを確認します。

ls

クローンの確認

クローンの確認

Forgeへのアクセス方法は、リモートデスクトップで直接アクセスする方法と、Forgeを公開して外部デバイスからアクセスする方法の2通りがあります。リモートデスクトップの場合はそのままステップ5に進んでください。

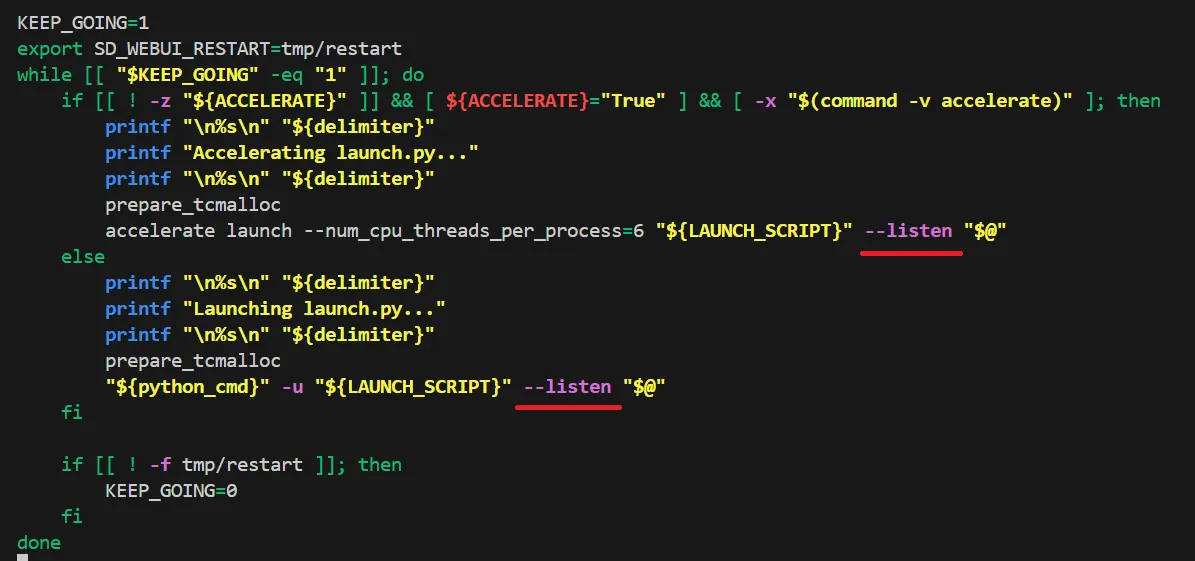

外部デバイスからアクセスする場合は、stable-diffusion-webui-forgeディレクトリで以下のコマンドを実行してエディターを開きます。

nano webui.sh

矢印キーで一番下へ移動し、「--listen」を追加します。

listenの追加

listenの追加

「Ctrl + O」、「Enter」、「Ctrl + X」の順で保存・終了します。

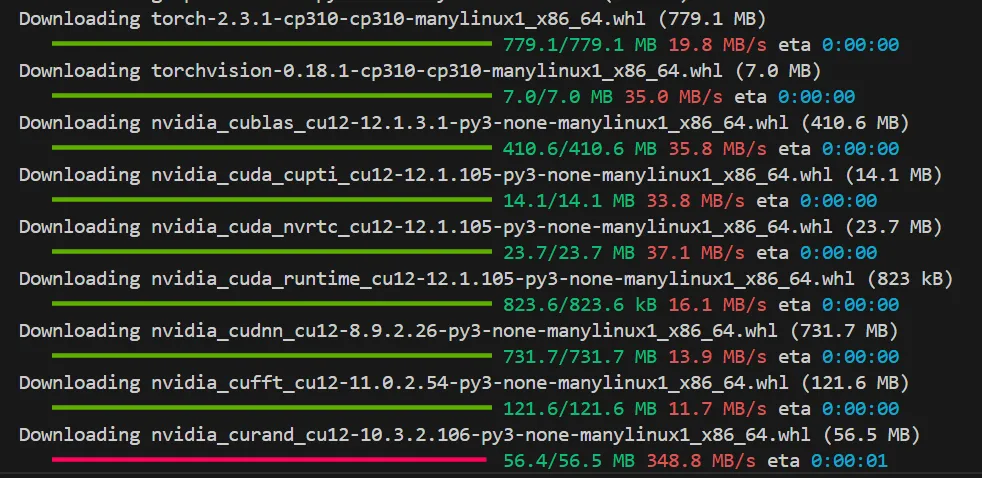

ステップ5 Forgeの起動と初回セットアップ

stable-diffusion-webui-forgeディレクトリで以下のコマンドを実行します。

./webui.sh

初回起動時には依存関係のインストールが行われるため、かなりの時間がかかります。

初回起動時のインストール

初回起動時のインストール

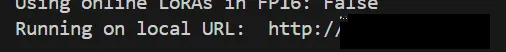

起動が完了すると、ForgeアクセスのためのURLが表示されます。

forgeの立ち上げ成功

forgeの立ち上げ成功

リモートデスクトップの場合は、表示されたURLをブラウザに入力してアクセスします。外部アクセスの場合は、URLの「0.0.0.0」部分をVMのパブリックIPアドレスに置き換えてアクセスします。

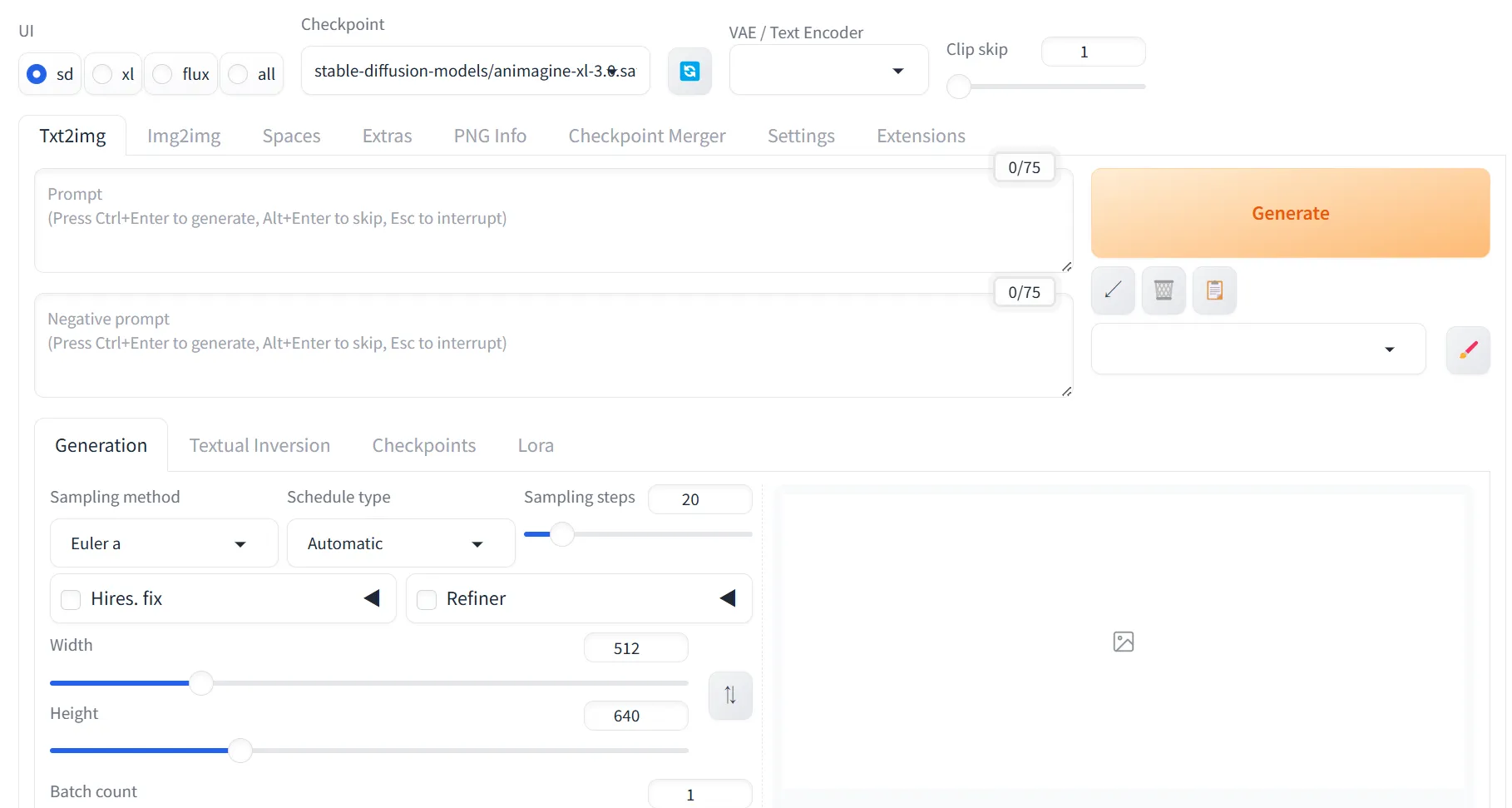

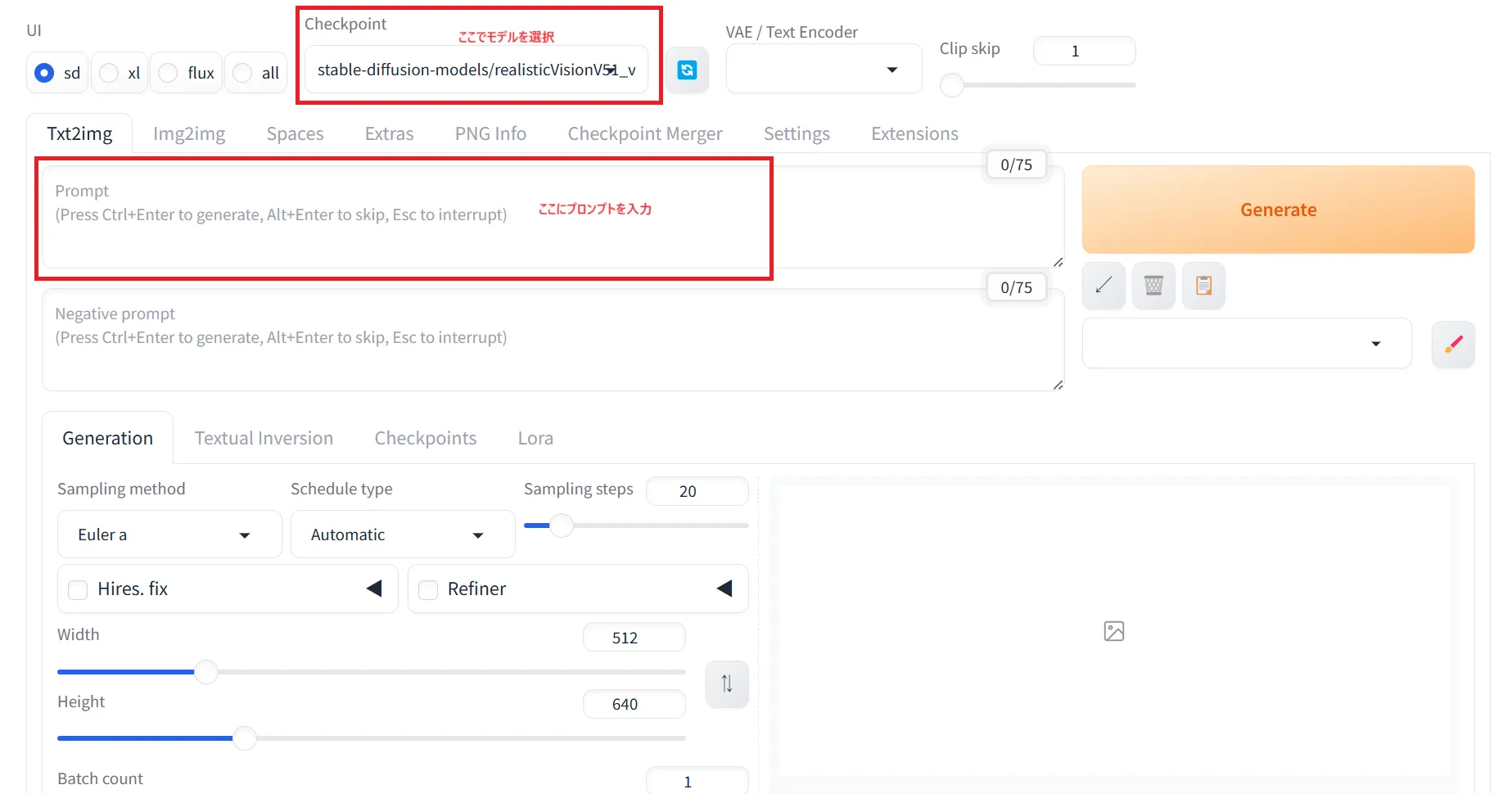

Forgeにアクセスすると、以下の画面が表示されます。

forge起動画面

forge起動画面

Forgeの使い方とモデル活用

Forgeを効果的に活用するには、適切なモデルの準備と基本操作の理解が重要です。以下の表で、Forgeで使用できる主要モデルの特徴を比較しました。

| モデル | 解像度 | 特徴 | Forge対応 |

|---|---|---|---|

| SD 1.5 | 512x512 | 最軽量、LoRA/ControlNet資産が豊富 | 完全対応 |

| SDXL | 1024x1024 | 高品質、リファイナー対応 | メモリ最適化済み |

| SD3.5 Medium | 1024x1024 | テキスト描画改善、軽量版 | 対応 |

| SD3.5 Large | 1024x1024 | 最高品質のSD系モデル | 対応 |

| Flux.1 Dev | 1024x1024 | フォトリアル品質、テキスト精度 | GGUF/NF4対応 |

| Flux.1 Schnell | 1024x1024 | 超高速生成(4ステップ) | GGUF/NF4対応 |

SD 1.5は3年以上の蓄積により最も充実したLoRAやControlNetの資産を持っており、特定のスタイルやキャラクター再現に適しています。SDXLは品質と速度のバランスが優れており、Forgeのメモリ最適化により8GB VRAMでも安定動作します。Flux.1はフォトリアリスティックな画像品質でSDXLを上回りますが、生成速度は約4倍遅くなります。おすすめのStable Diffusionモデルについては関連記事で紹介しています。

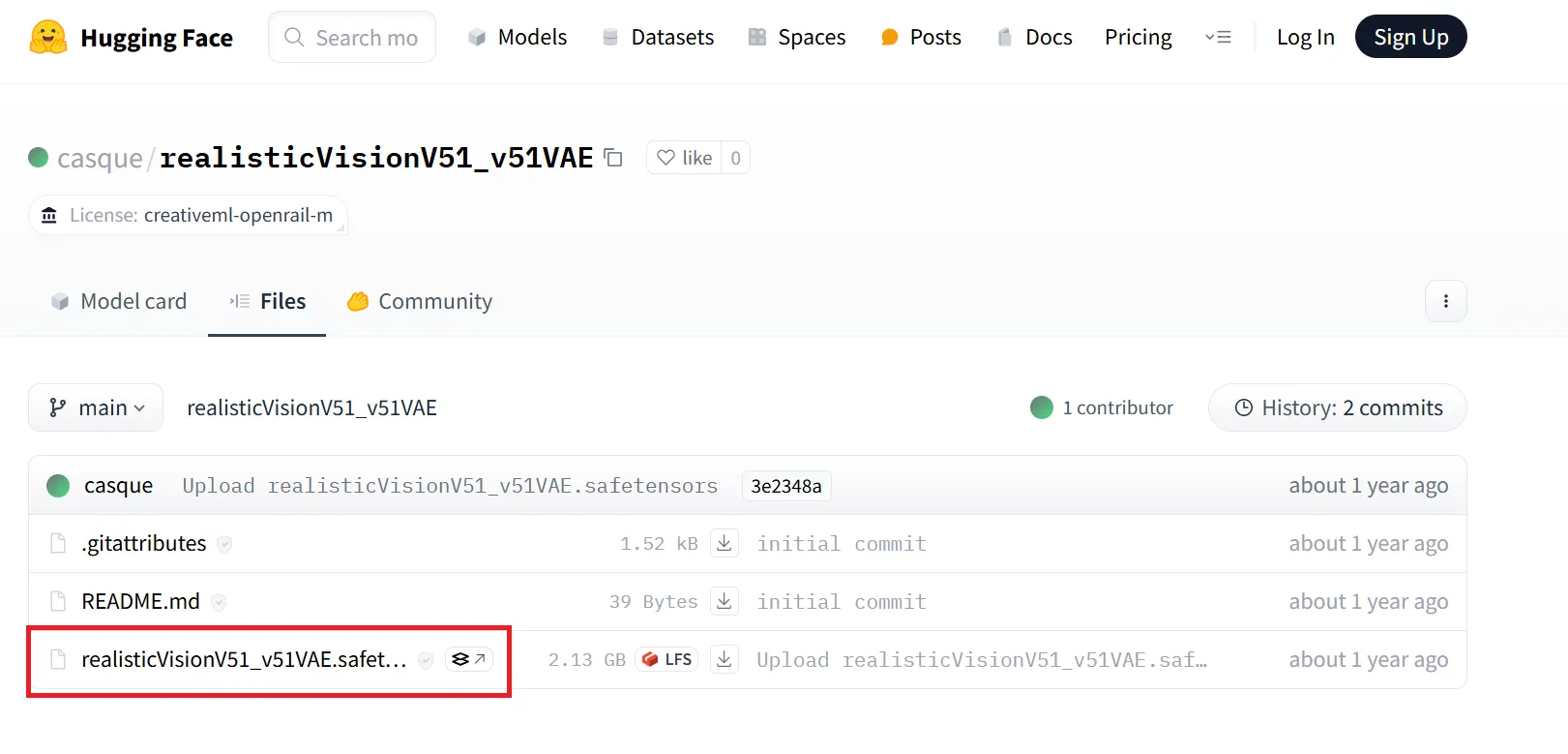

モデルは「stable-diffusion-webui-forge/models/Stable-diffusion」内に保存します。HuggingFaceなどからモデルファイルのダウンロードリンクをコピーし、以下のコマンドで取得します。

モデルのダウンロード手順その1

モデルのダウンロード手順その1

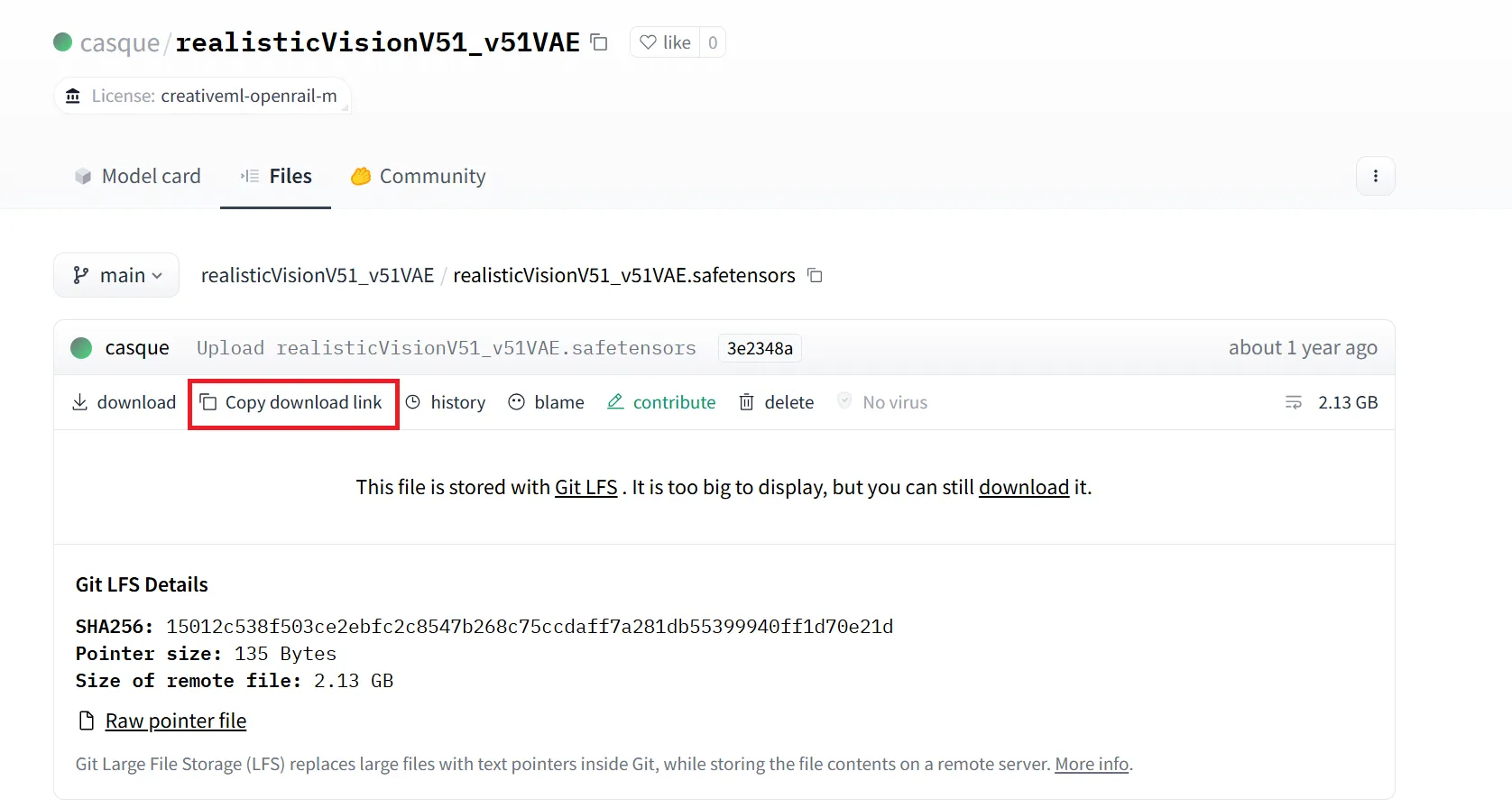

ダウンロードページで「Copy download link」をクリックしてリンクを取得します。

モデルのダウンロード手順その2

モデルのダウンロード手順その2

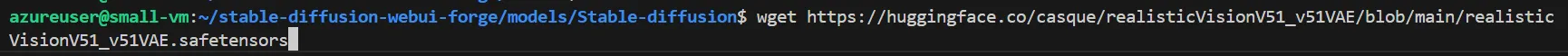

models/Stable-diffusionディレクトリに移動し、以下のコマンドでダウンロードします。

wget {コピーしたリンク}

モデルのダウンロード手順その3

モデルのダウンロード手順その3

Forgeの上部のCheckpointでモデルを選択し、Promptに生成したい内容を入力します。Negative promptには生成を避けたい要素を指定します。

forgeの簡単なテスト

forgeの簡単なテスト

テストとして「金髪の1人の女の子」というプロンプトを試します。

1girl, blond hair

テスト結果その1

テスト結果その1

プロンプトに条件を追加すると、生成画像の内容が変化します。

1girl, blond hair, standing on a busy Tokyo street at night

テスト結果その2

テスト結果その2

生成画像はstable-diffusion-webui-forge内の「outputs」フォルダに保存されます。仮想マシン上の出力をローカルに転送する場合は、以下のscpコマンドを使用します。

scp -i /path/to/your/private_key -r azureuser@<VM_IP_ADDRESS>:/path/to/remote/directory /path/to/local/destination

ネガティブプロンプトの使い方やControlNetの導入方法については関連記事で詳しく解説しています。LoRAの活用についてはこちらの解説記事を参照してください。

AUTOMATIC1111・ComfyUI・Fooocusとの4ツール比較と選定基準

ローカル画像生成ツールは2026年時点で4つの主要選択肢があります。以下の表で、それぞれの特徴と推奨ユーザーを比較しました。

| 項目 | Forge | AUTOMATIC1111 | ComfyUI | Fooocus |

|---|---|---|---|---|

| ベース | SD-WebUI 1.10.1 | SD-WebUI 1.10.1 | 独自(ノードベース) | Gradio(Forge派生) |

| VRAM効率 | 最高(6GB対応) | 標準 | 高い | 高い |

| 速度 | A1111比30-75%高速 | 標準 | A1111比2倍高速 | A1111並 |

| 操作性 | GUIベース(A1111互換) | GUIベース | ノードベース(上級者向け) | ワンクリック(初心者向け) |

| 拡張機能 | ControlNet等プリインストール | 最大のエコシステム | ノードで実現 | 限定的 |

| Flux.1対応 | ネイティブ(GGUF/NF4) | 非公式拡張で対応 | ネイティブ対応 | 非対応 |

| 推奨ユーザー | 中級者・VRAM制限あり | 初中級者・拡張重視 | 上級者・ワークフロー構築 | 完全初心者 |

Forgeの選定基準は「AUTOMATIC1111の操作感を維持しながら、VRAMの制約を克服したい」ユーザーに最適という点です。8GB以下のGPUでSDXLやFlux.1を動作させたい場合、Forgeが最も現実的な選択肢となります。一方、複雑なワークフローを構築したい上級者にはComfyUIが推奨されます。ComfyUIのノードシステムは習得に数週間を要しますが、習得後は他のツールでは実現できない複雑な画像処理パイプラインを構築できます。

完全な初心者にはFooocusが推奨されます。Fooocusはプロンプト入力のみで画像を生成でき、設定項目が最小限に抑えられています。まずFooocusで基礎を学び、より細かい制御が必要になったらForgeまたはAUTOMATIC1111に移行するのが段階的な学習パスとして効果的です。ControlNet Tileの使い方についても関連記事で解説しています。

トラブルシューティングと運用ガイド

Forge導入時にはいくつかの一般的な問題に遭遇することがあります。以下の表で、よくあるトラブルと対処法を整理しました。

| トラブル | 原因 | 対処法 |

|---|---|---|

| insightfaceインストールエラー | webui.sh実行時の自動ダウンロード失敗 | venvディレクトリで手動インストール |

| VMストレージ不足 | モデルファイルの容量超過 | データディスク拡張またはシンボリックリンク作成 |

| ツール・環境の未認識 | パス設定の誤り | 正しいパスの設定またはシンボリックリンク作成 |

| CUDA/ドライバ不整合 | NVIDIAドライバとCUDAバージョンの不一致 | ドライババージョンに対応するCUDAを再インストール |

| Flux.1モデルのメモリ不足 | VRAMが不足 | GPU重み配分スライダーを調整、GGUF Q4量子化モデルを使用 |

insightfaceエラーの場合は、VMに接続し直して以下のコマンドを実行してから、再度webui.shを起動します。

cd stable-diffusion-webui-forge

cd venv

pip install insightface

VMのストレージが不足する場合は、Azure VMのディスク拡張方法を参照してください。データディスクにモデルをインストールし、シンボリックリンクを作成してForgeから参照する方法が有効です。

Stable Diffusionの商用利用や無料で使える方法については関連記事で解説しています。OpenPoseの使い方や画像生成AIの総合ガイドも併せて参照してください。

段階的導入ステップとFAQ

Forgeの導入と活用を効率的に進めるために、以下の3ステップを推奨します。

-

ステップ1 環境構築と基本操作の習得(1〜2日)

本記事の手順に沿ってForgeをインストールし、SD 1.5またはSDXLモデルで基本的な画像生成を行います。プロンプトの書き方、Negative promptの活用、生成パラメータ(ステップ数、CFGスケール、サンプラー)の効果を把握します。

-

ステップ2 モデルとLoRAの活用(1〜2週間)

用途に応じたモデル(フォトリアル、アニメ、イラストなど)を複数導入し、LoRAを組み合わせたスタイル調整を習得します。ControlNetを導入して構図制御やポーズ指定を行い、実用的な画像生成ワークフローを構築します。

-

ステップ3 Flux.1への移行と高度な活用(1か月)

Flux.1のGGUFモデルを導入し、フォトリアリスティックな画像生成やテキスト描画を実践します。GPU重み配分スライダーでメモリ使用量を最適化し、生成速度と品質のバランスを調整します。

以下に、Forge導入に関するよくある質問をまとめました。

Q. ForgeとAUTOMATIC1111の拡張機能は互換性がありますか

大半の拡張機能はそのまま動作しますが、一部のカスタム拡張機能では互換性の問題が発生する場合があります。Forgeは独自のバックエンドアーキテクチャを持つため、AUTOMATIC1111専用に設計された拡張機能は動作確認が必要です。ControlNet、ADetailer、Tiled Diffusionなどの主要拡張機能はForgeに最適化されています。

Q. ForgeとComfyUIのどちらを選ぶべきですか

AUTOMATIC1111の操作に慣れているユーザーや、GUIベースの操作を好むユーザーにはForgeが推奨されます。複雑なワークフローの構築やノードベースの柔軟な制御が必要な上級者にはComfyUIが適しています。両者は共存可能なので、用途に応じて使い分けることも有効です。

Q. ローカルPCでForgeを動作させるための最低スペックは何ですか

NVIDIA GPUが必須で、最低4GB VRAM(SD 1.5の場合)、推奨8GB VRAM(SDXLの場合)です。CPUはマルチコア推奨、RAMは16GB以上を推奨します。AMD GPUでの動作はstable-diffusion-webui-amdgpu-forgeフォークで限定的にサポートされています。

Stable Diffusion Forgeの導入経験を業務でのAI活用に広げる

AI業務自動化ガイド

Forgeで画像生成環境を構築した技術力は、業務でのAI導入にも直結します。AI総合研究所のAI業務自動化ガイドでは、Microsoft環境での業務プロセス自動化を中心に、段階的なAI導入の全体像を220ページで解説しています。

Stable Diffusion Forgeの導入経験を業務でのAI活用に広げる

Forgeのインストールやモデル設定を自ら手がけた経験は、AI環境構築のスキルとして他の業務にも転用できます。画像生成に限らず、テキスト処理やデータ分析など、AIを業務に組み込む場面は急速に広がっています。

AI総合研究所では、Microsoft環境でのAI業務自動化の設計手法をまとめた「AI業務自動化ガイド」を無料で提供しています。Forgeで培った技術的な実装力を、業務全体のAI化に発展させるための実践ガイドです。

Stable Diffusion Forgeの導入経験を業務でのAI活用に広げる

AI業務自動化ガイド

Forgeで画像生成環境を構築した技術力は、業務でのAI導入にも直結します。AI総合研究所のAI業務自動化ガイドでは、Microsoft環境での業務プロセス自動化を中心に、段階的なAI導入の全体像を220ページで解説しています。

まとめ

この記事では、Stable Diffusion WebUI Forgeの導入方法から使い方、2026年の最新動向までを解説しました。

Forgeを活用するために、以下の3つのポイントを押さえておきましょう。

-

VRAM最適化によるローカル画像生成の民主化

Forgeは6GB VRAMのGPUで最大75%の速度向上を実現し、8GB VRAMでSDXLモデルを安定動作させます。AUTOMATIC1111では動作困難だった大規模モデルをローカル環境で実行できるため、クラウドAPIに依存しないコスト効率の高い画像生成環境を構築できます。

-

Flux.1ネイティブ対応による最新モデルの活用

ForgeはFlux.1のGGUF/NF4量子化モデルにネイティブ対応しており、12GB VRAM程度のGPUでフォトリアリスティックな画像生成が可能です。SD3.5やSDXLと用途に応じて使い分けることで、品質と速度を最適化できます。

-

段階的な学習パスによる効率的な習得

Fooocusで基礎を学び、Forgeで本格的な画像生成に移行し、必要に応じてComfyUIで高度なワークフローを構築するという段階的なアプローチが推奨されます。Forgeのインストールから画像生成までは本記事の手順に沿えば数時間で完了します。

Stable Diffusion WebUI Forgeの導入や画像生成AIの活用についてのご相談は、お気軽にお問い合わせください。

出典

- GitHub - lllyasviel/stable-diffusion-webui-forge(公式リポジトリ、2026年2月更新)

- Stable Diffusion Art - SDXL vs Flux.1 Models Comparison(2026年)

- PropelRC - 11 Best Stable Diffusion WebUIs for 2026

- NVIDIA - CUDA Toolkit Documentation(ドライバ・CUDA互換性マトリクス)

- Microsoft Azure - Virtual Machines Pricing(NCasT4_v3シリーズ、2026年3月時点)