この記事のポイント

自動運転・ロボティクスの合成データ生成にはNVIDIA Cosmosが第一候補、物理法則ベースの世界基盤モデルで実データ収集コスト削減

3モデルのうちPredict 2.5で未来予測シミュから着手が最適、2B/14B選択でPoC段階は2Bモデルで十分な精度

Omniverseは3Dシーン、Isaac Simはロボット制御、Cosmosは世界モデルと役割が異なり、三者連携した合成データパイプラインが最効果

商用利用はオープンモデルライセンスで無料、本番のNIMマイクロサービス運用にはNVIDIA AI Enterpriseが必須でコスト試算を先に

物理AI開発企業は今すぐ検証開始すべき、1X・Uber・XPENG等の先行企業との技術格差が広がる前に自社データ適合性を確認

Microsoft MVP・AIパートナー。LinkX Japan株式会社 代表取締役。東京工業大学大学院にて自然言語処理・金融工学を研究。NHK放送技術研究所でAI・ブロックチェーンの研究開発に従事し、国際学会・ジャーナルでの発表多数。経営情報学会 優秀賞受賞。シンガポールでWeb3企業を創業後、現在は企業向けAI導入・DX推進を支援。

「NVIDIA Cosmosって何ができるの?」「OmniverseやIsaac Simとはどう違うの?」

NVIDIA Cosmosは、ロボットや自動運転(AV)をはじめとする物理AI開発を加速させるための世界基盤モデル(WFM)プラットフォームです。

2025年1月のCES 2025で初公開され、同年9月にPredict 2.5・Transfer 2.5を発表、2026年1月のCES 2026でReason 2が加わり3モデル体系が完成しました。500万回以上ダウンロードされ、1X・Figure AI・Uber・Waabi・XPENGなど世界の主要企業が採用しています。

本記事では、Cosmosの最新モデル体系、OmniverseやIsaac Simとの違い・連携、自動運転・ロボティクスの活用事例、使い方、料金・ライセンスまで網羅的に解説します。

AI総合研究所はNVIDIA Inception Programの正式な採択企業です。AI導入を検討中の企業のご担当者様はお気軽にご相談ください。

目次

World Foundation Models(WFM)とは

Cosmos Predict・Transfer・Reasonの3モデル体系【2026年最新】

Cosmos Predict 2.5(未来予測・世界シミュレーション)

Cosmos Transfer 2.5(合成データ変換・スタイル変換)

Cosmos Reason 2(推論VLM・物理的常識理解)

NVIDIA Cosmosとは?物理AI基盤の全体像

NVIDIA Cosmosは、ロボットや自動運転(AV)をはじめとする物理AI(Physical AI)開発を加速させるための世界基盤モデル(World Foundation Models = WFMs)プラットフォームです。2025年1月のCES 2025で初公開され、同年9月にPredict 2.5・Transfer 2.5を発表、2026年1月のCES 2026でReason 2が加わり3モデル体系が完成しました。

%E3%81%A7%E3%81%AE%E3%82%B7%E3%83%A5%E3%83%9F%E3%83%AC%E3%83%BC%E3%82%B7%E3%83%A7%E3%83%B3%E7%94%BB%E5%83%8F.webp)

Cosmos World Foundation Models (WFMs)でのシミュレーション画像

Cosmosが解決する課題

物理AIの開発現場には、2つの根本的な課題があります。1つは、実世界のデータ収集に膨大なコストと時間がかかること。もう1つは、安全テストに必要なレアケースのデータが圧倒的に不足していることです。

たとえば、自動運転車が「突然の飛び出し」や「豪雨の夜間走行」に正しく対応するためには、数百万パターンもの走行データが必要ですが、これを実走行だけで集めるのは現実的ではありません。同様に、ロボットの動作訓練では、倉庫の棚配置や商品サイズのバリエーションを無数にテストする必要がありますが、実物環境を毎回組み替えるのは非効率です。

Cosmosは、膨大な実世界の動画データから物理法則や空間構造を学習したAIモデル(WFM)を提供することで、こうしたデータを合成的に生成する仕組みを実現しました。企業は実機実験に頼らず、仮想空間で大量のシナリオをシミュレーションし、AIモデルを効率的にトレーニングできます。

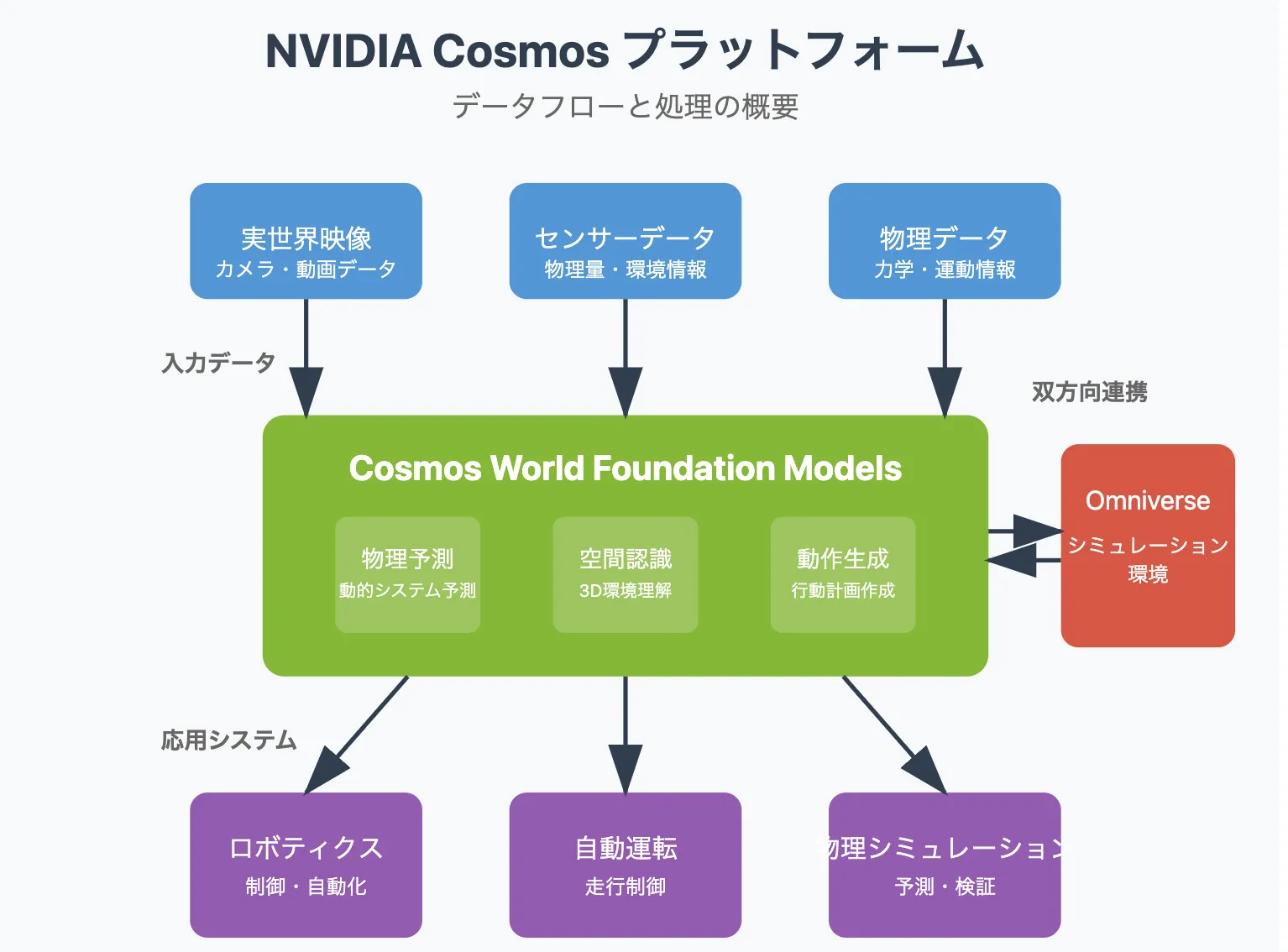

NVIDIA Cosmos プラットフォームイメージ

オープンライセンスと採用状況

CosmosのモデルはNVIDIA Open Model Licenseのもとでオープンに公開されています。従来、大規模AIモデルの構築には数千万ドル規模の投資が必要でしたが、このオープンライセンスにより、スタートアップから大企業まで規模を問わず最先端の物理AI技術を活用できるようになりました。

CES 2026時点で500万回以上ダウンロードされ、1X・Figure AI・Uber・Waabi・XPENGなど世界の主要企業が採用しています。NVIDIAはGPUの開発で知られる半導体企業で、Cosmosはそのハードウェアの強みとAI研究の蓄積を物理AI領域に結集させたプラットフォームです。

物理AI(Physical AI)とは

物理AI(フィジカルAI)とは、現実世界の物理的な環境やオブジェクトに対して行動・学習するAI技術の総称です。ChatGPTのような大規模言語モデルが「テキスト」を理解・生成するのに対し、物理AIは**「現実空間」を理解・操作**します。

ロボットが目の前の箱を正確に掴む、自動運転車が急カーブで適切にステアリングを切る――こうした動作には、重力・摩擦・衝突といった物理法則の理解が不可欠です。画像認識で「箱がある」と分かるだけでは、ロボットは動けません。箱の重さ、表面の滑りやすさ、持ち上げたときの重心の変化まで予測できて初めて、安全で正確な操作が可能になります。

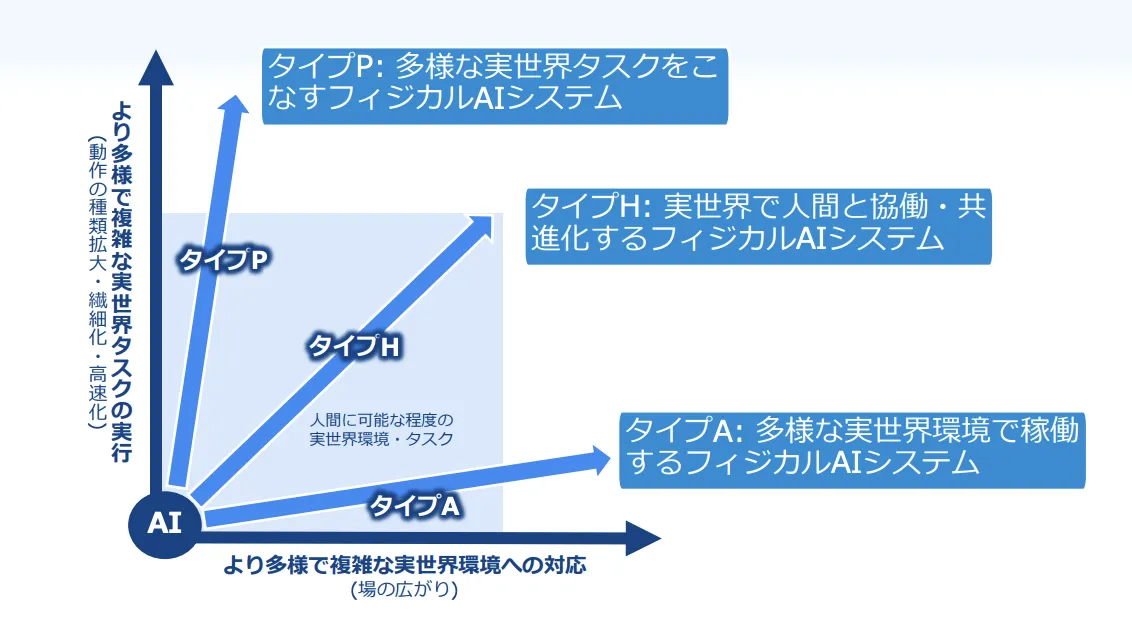

タイプ別のフィジカルAI 科学技術振興機構(JST) 研究開発戦略センター(CRDS)

物理AIは、パフォーマンス(P)・ヒューマノイド(H)・アダプティブ(A)の3タイプに分類されています。パフォーマンス型は特定の作業に特化した産業用ロボットアーム、ヒューマノイド型は人間に近い形で汎用的に動くロボット、アダプティブ型は環境の変化に適応して行動を最適化するシステム(自動運転車など)です。

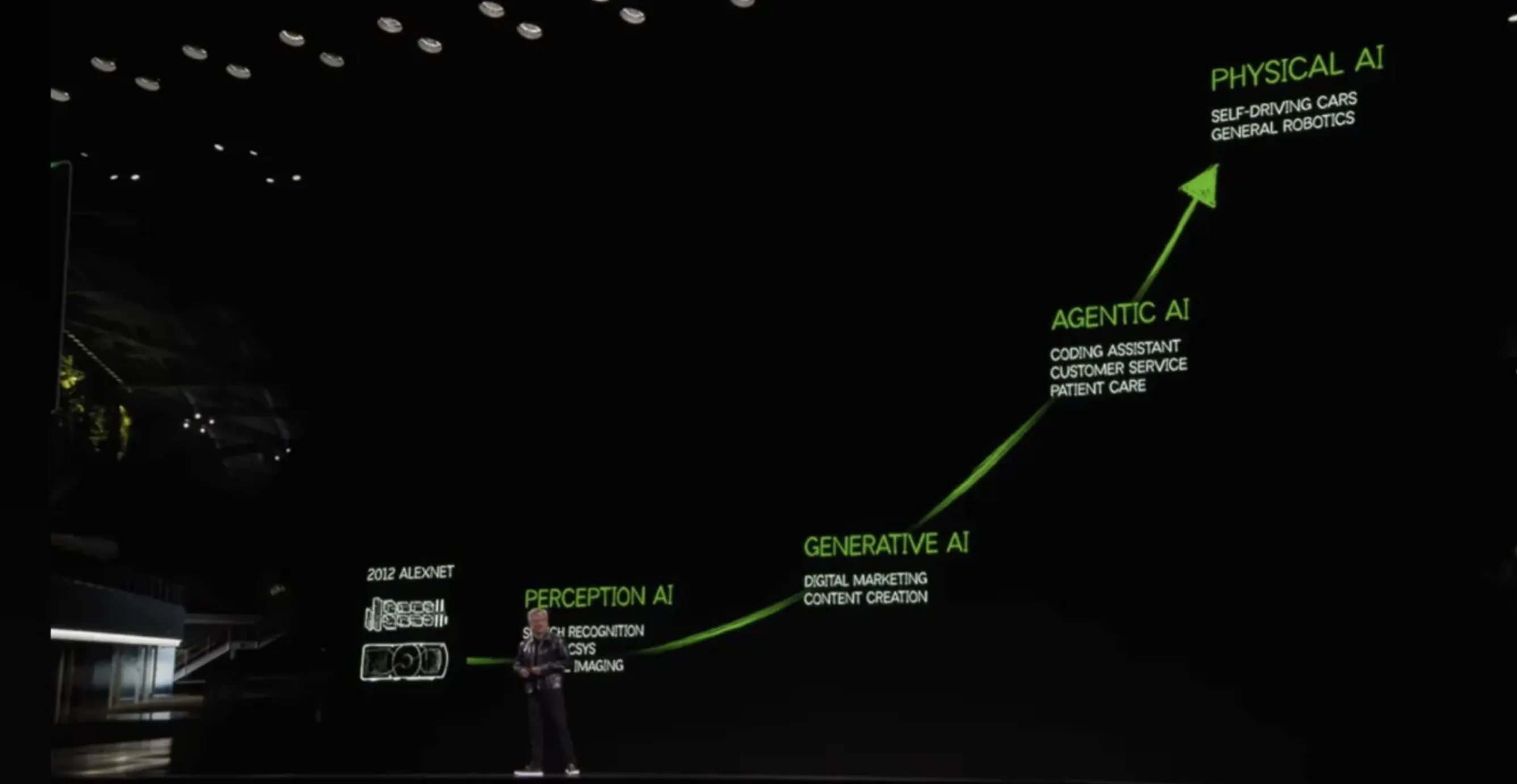

CES2025での一場面:予測AIから生成AI、AIエージェント、物理AIへと発展する様子

生成AI→AIエージェントと続き、産業は次なる成長領域「Physical AI」に進んでいます。NVIDIAのジェンスン・ファンCEOがCES 2025の基調講演で「ロボティクスの時代が到来した」と宣言したのは、まさにこの潮流を象徴する出来事でした。

こちらはNVIDIAが公開しているPhysical AIの説明動画です。

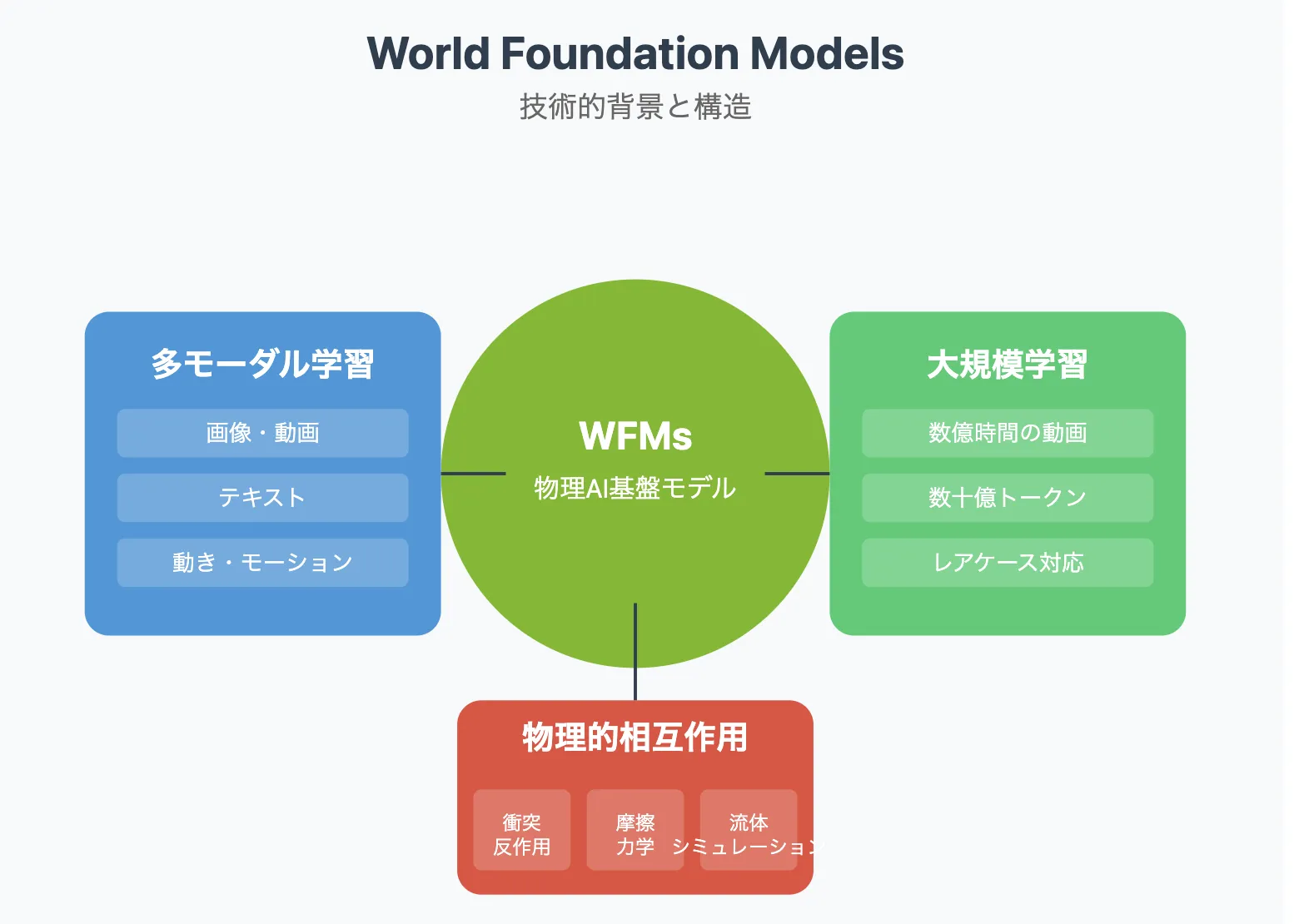

World Foundation Models(WFM)とは

Cosmosの中核を成すのがWorld Foundation Models(WFMs)です。大規模言語モデル(LLM)が「文章の文脈」を理解するのと同じように、WFMは物理空間の文脈を理解するよう設計されたAIモデルです。

WFMイメージ

WFMは9,000兆トークンと2,000万時間の動画データを学習しています。わかりやすくいえば、YouTube上の全動画データに匹敵する規模です。これだけの実世界データを学習することで、単なる映像の「見た目」ではなく、物体がどう動き、衝突したときに何が起きるかという物理的な因果関係まで理解できるようになっています。

WFMの主な特徴は以下の3つです。

-

多モーダル学習

画像・動画・テキスト・モーションキャプチャやセンサー情報などを統合的に学習する。視覚情報だけでなく、言語の指示や身体動作の文脈も理解できるため、「赤い車が雨の中でカーブを曲がる」というテキストから実際のシーンを再現した動画を生成するといった処理が可能になる

-

大規模学習による汎用性

2億クリップ以上の高品質な動画データで事前学習しており、晴天の日中だけでなく、雨天・夜間・雪道・山岳地帯といったレアケースにも対応できる。通常のAIモデルでは学習データが偏りがちな「極端なシナリオ」にこそ、Cosmosの大規模学習が威力を発揮する

-

物理的・空間的相互作用の理解

単に映像のフレームを予測するだけでなく、オブジェクト同士が衝突した際の反作用、摩擦、流体力学などをシミュレーションする。ボールを投げた後の弾道やバウンド、衝撃で周囲の物体が動く様子まで高精度に予測する

ここで重要なのは、従来の動画生成AI(SoraやRunwayなど)との根本的な違いです。SoraやRunwayが「映像として美しいかどうか」を重視するのに対し、CosmosのWFMは**「物理的に正しいかどうか」を重視**します。

たとえば、Soraで生成した「車が急カーブを曲がる動画」は映像としては美しく見えても、タイヤの摩擦や車体の傾きが物理法則に合っていない可能性があります。一方、Cosmosは物理法則を学習しているため、ロボットや自動運転のトレーニングデータとして使える品質の動画を生成できます。この違いが、Cosmosが「エンターテインメント向けの動画生成AI」ではなく**「産業向けの物理AIプラットフォーム」** として位置づけられる理由です。

Cosmos Predict・Transfer・Reasonの3モデル体系【2026年最新】

2025年9月のPredict 2.5・Transfer 2.5発表、そして2026年1月のCES 2026でのReason 2発表により、CosmosはPredict・Transfer・Reasonの3モデル体系へと大幅に進化しました。初期バージョン(Nano/Super/Ultra)はモデルサイズによる区分でしたが、新体系では役割による区分に刷新されています。

.webp)

Cosmosモデルの進化(初期のNano/Super/Ultraから、Predict/Transfer/Reasonの3体系へ)

以下の表で3モデルの役割を整理しました。

| モデル | 役割 | 主な入力 | 主な出力 |

|---|---|---|---|

| Predict 2.5 | 世界の未来を予測・生成 | テキスト・画像・動画 | シミュレーション動画(最大30秒) |

| Transfer 2.5 | CG映像をリアル映像に変換 | 3Dシミュレーション出力 | フォトリアリスティック動画 |

| Reason 2 | 映像を見て物理的に推論・判断 | 画像・動画 | 自然言語(推論結果・行動計画) |

この3モデルの連携こそが、Cosmosの設計思想の核心です。Predictで「次に何が起きるか」を予測し、Transferで「CGをリアル映像に変換」して学習データを大量生成し、Reasonで「今何が起きているか」を推論して行動を決定する――この3つの役割が物理AIの学習サイクル全体をカバーしています。

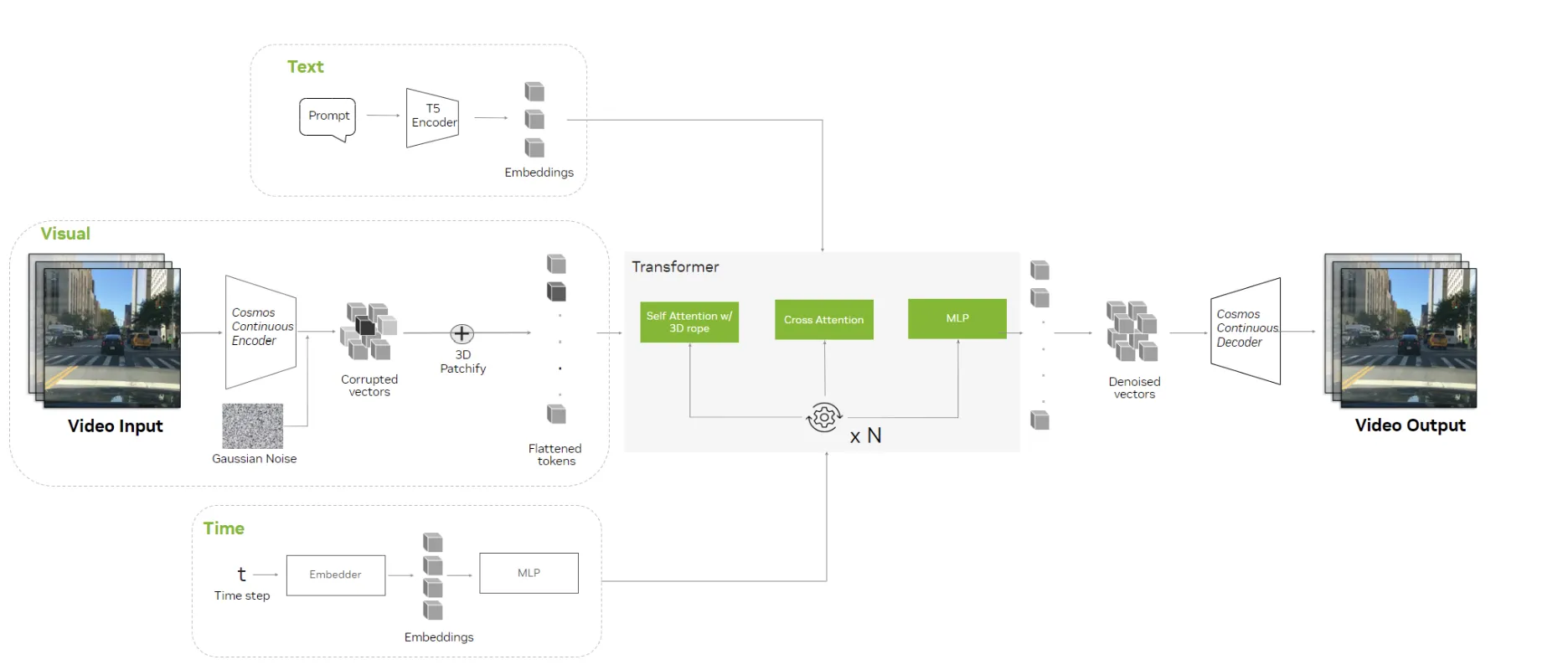

Cosmos Predict 2.5(未来予測・世界シミュレーション)

Cosmos Predict 2.5は、WFMファミリーの最新版で、テキスト・画像・動画から物理世界の未来状態をビデオとして予測・シミュレーションするモデルです。アーキテクチャとしてはフローベースの拡散トランスフォーマーを採用し、Text2World・Image2World・Video2Worldの3つの生成タスクを1つのモデルに統合しています。

Cosmos Predict 2.5の生成例

Predict 2.5の最大の技術的特徴は、テキストエンコーダーに一般的なCLIPやT5ではなく、同じCosmosファミリーのCosmos Reason 1を採用している点です。物理的な常識を理解するVLM(視覚言語モデル)をテキスト理解の基盤に据えることで、「雨の高速道路でトラックが急ブレーキをかける」といった複雑なシナリオでも、物理法則に沿った映像を生成できます。従来の画像生成AIが使うCLIPは「画像とテキストの類似度」を測る汎用モデルですが、Cosmos Reasonは「物理的な出来事の因果関係」を理解するモデルであり、この違いが生成品質に直結しています。

主な仕様

主な仕様を以下に整理しました。

-

最大30秒・720p・16FPSの動画を生成

Text2World(テキスト→世界生成)、Image2World(画像→世界生成)、Video2World(動画→未来予測)の3つの入力方式に対応する。30秒あれば、交差点の通過や物体のピッキング動作といった一連のシナリオを1本の動画で完結できる。5秒程度が主流だった従来モデルと比較すると、シナリオの複雑さが格段に増している

-

35億時間の動画から2億クリップを厳選して学習

35億時間分の未加工動画を処理し、60億クリップを抽出。そこからさらに品質フィルタリングを経て2億クリップの高品質データセットに絞り込んでいる。データの「量」だけでなく「質」を追求した学習パイプラインにより、雨天・夜間・積雪など多様な環境条件で安定した生成品質を実現する

-

2B / 14Bパラメータの2サイズ展開

軽量な2Bモデルはプロトタイピングや軽量な推論に、14Bモデルは高精度なシミュレーションや本格的な学習データ生成に向いている。さらに、自動運転に特化したチェックポイント(/auto/multiview)も提供されている

-

VideoAlignによるポストトレーニング

VLMベースの報酬モデルが「テキストとの整合性」「動きの品質」「視覚品質」の3軸で生成結果を評価し、強化学習で出力を最適化する。人間のアノテーション(ラベル付け)なしで品質を向上できる仕組みで、スケーラブルな品質改善を可能にしている

ローカル環境での動画生成にはハイエンドGPUが必要で、14Bモデルでのフル解像度生成にはRTX 5090クラス以上が推奨されます。2Bモデルであればより少ないVRAMでも実行可能です。本格的な大量生成にはクラウドGPUが現実的な選択肢になります。

参考: NVIDIA Cosmos Predict 2.5 Research Page

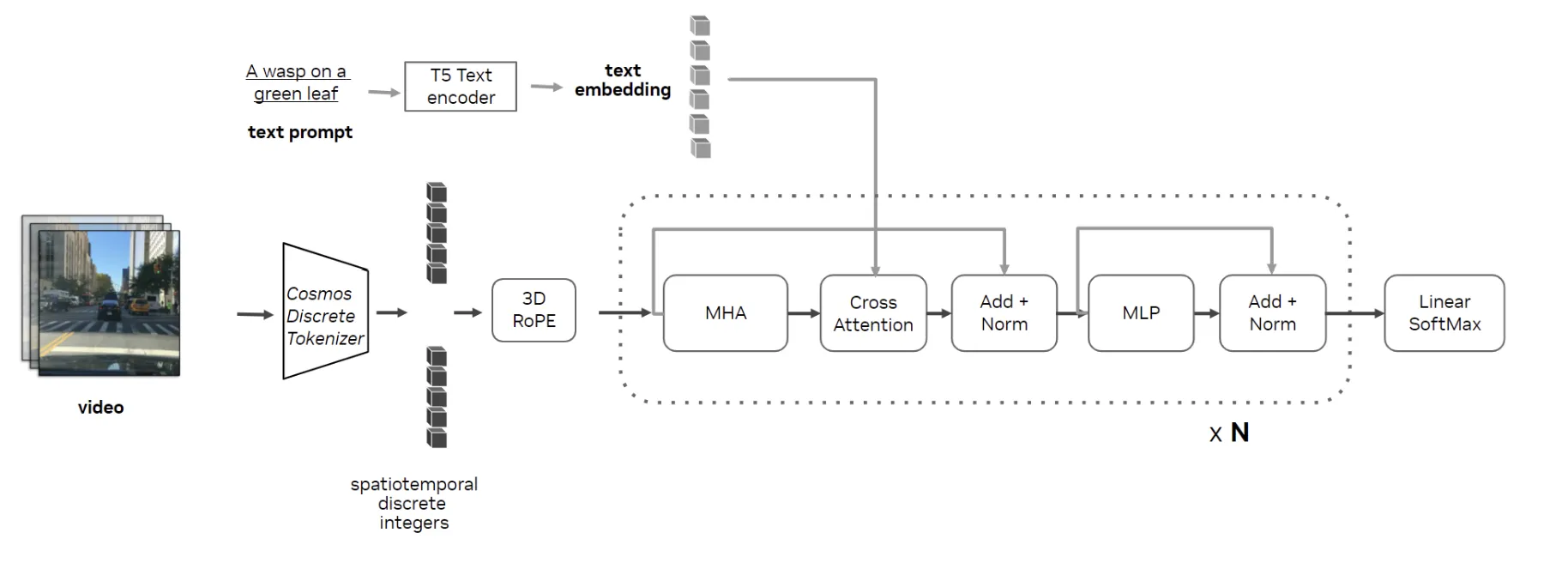

Cosmos Transfer 2.5(合成データ変換・スタイル変換)

Cosmos Transfer 2.5は、複数の空間制御入力に対応するマルチコントロールネットモデルで、3DシミュレーションやCG映像をフォトリアリスティックなリアル映像に変換する機能に特化しています。

Cosmos Transfer 2.5によるスタイル変換の例

「CG映像をリアル映像に変換する」ことがなぜ重要かというと、ロボットや自動運転のAIモデルは最終的に実世界の映像を入力として判断・行動するためです。3Dシミュレータ(Isaac SimやCARLAなど)で生成されたCG映像はデータ構造としては正確でも、「見た目」が実世界とかけ離れていると、AIモデルが学習した知識が実環境で通用しない問題が起きます。これはシム・トゥ・リアル・ギャップ(sim-to-real gap) と呼ばれ、物理AI開発の長年の課題でした。Transfer 2.5はこのギャップを埋めるためのモデルです。

主な特徴

主な特徴を以下にまとめました。

-

複数の制御入力に対応

深度マップ・セグメンテーション・エッジ・ビジュアルブラーなど、複数の空間制御条件をJSON形式で指定できる。これにより、シミュレータの出力を精密にリアル映像に変換しつつ、物理的な構造情報(何がどこにあるか、どれくらいの距離か)を保持する。単なる画像フィルターではなく、空間認識を伴う変換であるという点がポイントになる

-

前世代の3.5倍の軽量化・高速化

Transfer 1.0と比較してモデルサイズと推論速度が3.5倍改善されている。大量の合成データを短時間で変換する必要がある物理AI開発のワークフローでは、この処理速度の差がプロジェクト全体のスケジュールに影響する

-

Distilled Edgeモデル(2026年2月リリース)

NVIDIA Jetsonシリーズなどのエッジデバイスでの低レイテンシ推論を実現するモデル。クラウドに接続できないロボットや車載デバイスでも、リアルタイムでの映像変換が可能になる。今後、さらに多くの蒸留コントロールネットが追加される予定

Transfer 2.5の実用的なワークフローとしては、「Isaac Simで倉庫のロボット動作をシミュレーション→Transfer 2.5でリアル映像に変換→変換された映像でAIモデルをトレーニング」というパイプラインが代表的です。このフローにより、実環境を再現しなくても、数十万パターンの学習データを効率的に生成できます。2つの主要なワークフローが想定されており、1つは「シミュレーション→フォトリアリズム変換」、もう1つは「世界状態の多様性拡張」(同一シーンの天候・照明・視点を自動的に変化させる)です。

参考: NVIDIA Cosmos Transfer 2.5 Research Page

Cosmos Reason 2(推論VLM・物理的常識理解)

Cosmos Reason 2は、画像や動画から物体の動きや物理的関係性を理解し、自然言語で推論・意思決定を行う視覚言語モデル(VLM) です。Physical AI Benchにおいてオープンモデルとしてトップの推論性能を達成しています。

Predict 2.5が「世界を生成する」モデル、Transfer 2.5が「映像を変換する」モデルであるのに対し、Reason 2は**「映像を見て考える」モデル**です。ロボットや自動運転車が周囲の状況を「見て」、何が起きているかを「理解し」、次に何をすべきかを「判断する」ために使われます。人間でいえば、PredictとTransferが「想像力」に相当し、Reasonは「観察力と判断力」に相当します。

主な特徴

主な特徴は以下のとおりです。

-

空間・時間認識の強化

3D座標の取得やバウンディングボックス検出が可能で、映像内の物体の正確な位置と大きさを把握できる。タイムスタンプの精度も向上し、「いつ・どこで・何が」起きたかを時系列で追跡する。これにより、ロボットが「棚の3段目、右から2番目の箱」を正確に特定するような処理が実現する

-

長コンテキスト対応(最大256Kトークン)

長時間の動画データや複雑なシーンの理解に対応する。数分間の映像から複数のイベントを検出し、それらの因果関係を推論できる。たとえば、工場の監視映像から「部品の落下→ラインの停止→作業者の対応」という一連の流れを理解し、原因と結果を報告することが可能になる

-

2B / 8Bパラメータの2サイズ展開

コード部分はApache 2.0、モデル部分はNVIDIA Open Model Licenseで公開されており、商用利用も可能。2Bモデルは軽量で応答速度を重視するロボット制御、8Bモデルはより高精度な推論が求められる分析・意思決定に適する

-

チェーン・オブ・ソート推論

人間のアノテーションなしに、教師ありファインチューニングと強化学習でポストトレーニングされている。複雑な判断を段階的に推論するチェーン・オブ・ソート(思考の連鎖)を用いることで、「なぜその行動が最適か」まで言語化できる

Reason 2の実用例として注目されているのがSalesforceとの連携です。SalesforceのAgentforceプラットフォームとCosmos Reason 2を組み合わせ、ロボットの動作映像を自動的に検索・要約することで、インシデント解決時間を2倍に短縮する成果が報告されています。映像を「ただ録画するだけ」から「AIが解釈して報告する」運用への転換が、現実のものになりつつあります。

参考: NVIDIA Cosmos Reason 2 - Hugging Face Blog

NVIDIA Cosmosの安全機能(ガードレール)

Cosmosは物理AIのための動画生成であり、Soraのようなエンターテインメント向け生成AIとは異なり、実世界のデータを学習して物理的に正確な映像を生成することが目的です。そのため、安全性への配慮もプラットフォームレベルで組み込まれています。

Cosmosの安全機能: 人物の顔にはマスクが自動適用される

入力・出力の2段階フィルタリング

Cosmosのガードレール機能は、入力テキストや画像のフィルタリング(不適切なコンテンツの事前ブロック)と、生成結果のポストプロセッシング(出力後のスクリーニング)の2段階で構成されています。実世界の映像を学習しているため、生成結果に人物が含まれる場合は顔にマスクが自動的に適用されます。

ウォーターマークとトレーサビリティ

AI生成コンテンツにはウォーターマーク(識別タグ)が埋め込まれ、生成データのトレーサビリティを確保しています。合成データが「本物の映像」と混同されるリスクを低減する仕組みです。プライバシーへの配慮と生成物の追跡可能性の両方を、プラットフォームレベルで担保している点は実運用を想定した設計だといえます。

NVIDIA OmniverseとCosmosの違い

NVIDIA OmniverseとCosmosは混同されやすいですが、役割が異なります。Omniverseは**「精密な3D物理シミュレーション環境を構築するツール」、Cosmosは「大規模データから物理世界を学習・生成するAIモデル」** です。

両プラットフォームの比較

以下の表に主要な違いを整理しました。

| 項目 | NVIDIA Omniverse | NVIDIA Cosmos |

|---|---|---|

| 分類 | リアルタイム3Dシミュレーション基盤 | 物理AI向け世界基盤モデル(WFM) |

| 主な機能 | 3Dシーン作成・物理演算・レンダリング | 動画生成・未来予測・物理推論 |

| データ形式 | OpenUSD(3Dシーンデータ) | 動画・画像・テキスト |

| 強み | 物理法則に基づく高精度なシミュレーション環境 | 大規模学習による汎用的な世界理解と生成 |

| ライセンス | 商用ライセンス | オープンモデルライセンス |

建築でたとえるなら、Omniverseは「設計図面を引いて建物の3Dモデルを精密に組み立てるCADソフト」、Cosmosは「その3Dモデルに実際の街並みや天候を合成して写真のようなリアルさを加えるAI」のような関係です。

連携のメリット

OmniverseとCosmosを組み合わせることで、物理AI開発の効率が大幅に向上します。具体的なワークフローは以下の4ステップです。

- Omniverseで3Dシーンを作成 OpenUSD形式でロボットの作業環境や道路シーンを設計する

- 物理シミュレーションを実行 衝突判定、流体シミュレーション、センサーデータ(カメラ・LiDAR)などを物理エンジンで再現する

- Cosmos Transferでリアル映像に変換 CG出力をフォトリアリスティックな映像に変換し、シム・トゥ・リアル・ギャップを解消する

- 変換された映像でAIモデルを学習 実世界に近い品質のデータでロボットや自動運転のAIをトレーニングする

このパイプラインの最大のメリットは、環境条件のバリエーションを自動生成できる点です。1つの3Dシーンから「晴天の昼間」「豪雨の夜間」「雪の早朝」「霧の交差点」といった多様な環境を自動で作り出し、レアケースのデータも効率的にカバーできます。

Omniverseだけでもシミュレーションは可能ですが、CG映像のままではAIモデルが実世界で通用しない可能性があります。Cosmosを加えることで「3Dシーン→フォトリアルな映像→AIの学習データ」というパイプラインが完成し、シミュレーションの結果を実環境に直結させることが可能になります。GR00T Blueprintでは、この連携により学習データ生成が「日単位→時間単位」にまで短縮された事例も報告されています。

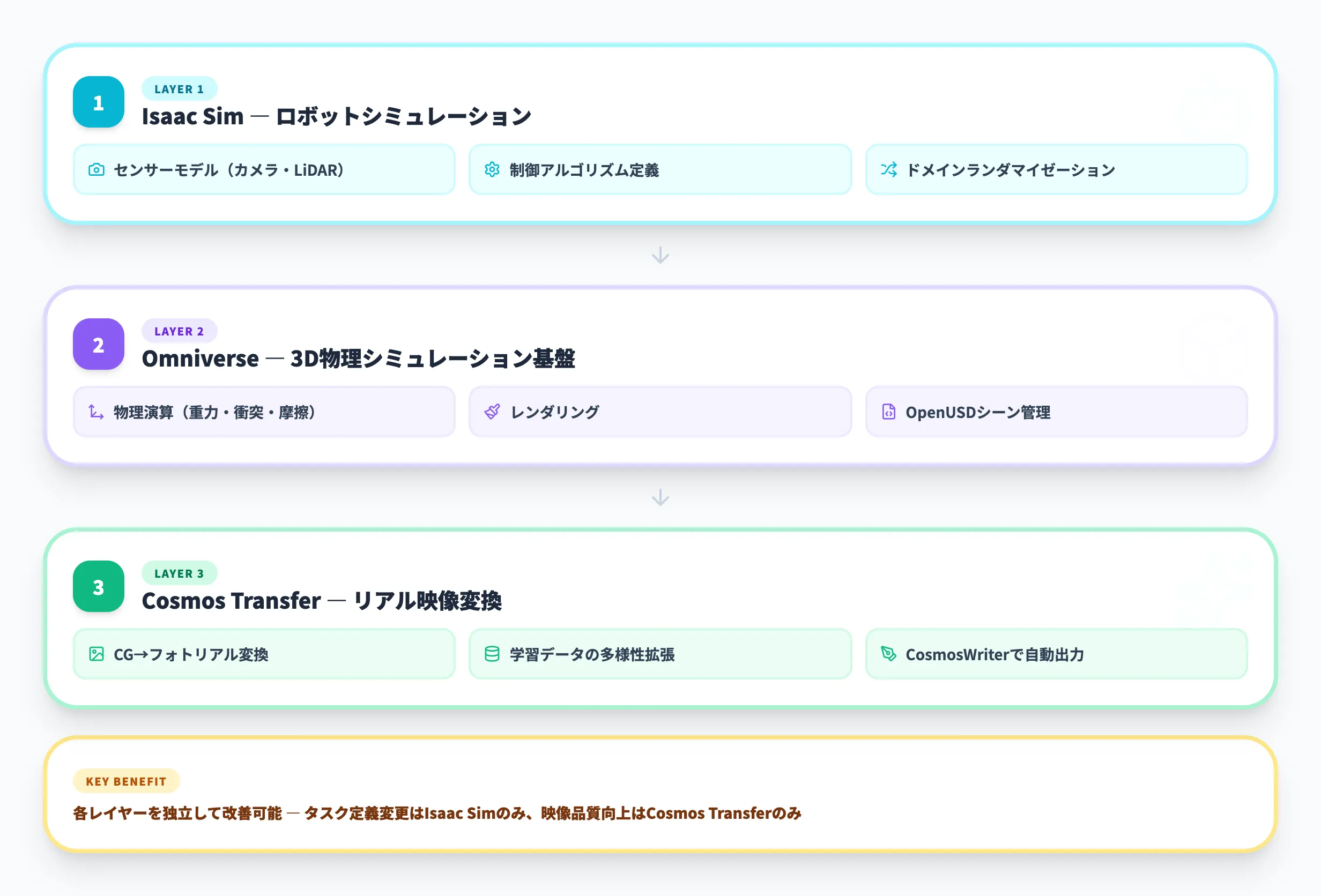

NVIDIA Isaac SimとCosmosの連携

NVIDIA Isaac Simは、Omniverseの上に構築されたロボット特化型のシミュレータです。ロボットのセンサーモデル(カメラ・LiDAR・力覚センサーなど)、制御アルゴリズム、タスク定義をシミュレーション環境で再現する機能を備えています。Cosmosと組み合わせることで、ロボット学習データの生成効率が飛躍的に向上します。

Isaac Sim・Omniverse・Cosmosの3層構造

Isaac Sim、Omniverse、Cosmosはそれぞれ異なるレイヤーを担っており、3つを重ねることで物理AIの学習パイプラインが完成します。

| レイヤー | 役割 | 具体的な処理 |

|---|---|---|

| Isaac Sim | ロボット固有のシミュレーション | センサーモデル(カメラ・LiDAR)、制御アルゴリズム、タスク定義、ドメインランダマイゼーション |

| Omniverse | 3D物理シミュレーション基盤 | レンダリング、物理演算(重力・衝突・摩擦)、OpenUSDシーン管理 |

| Cosmos Transfer | シミュレーション出力のリアル映像変換 | CG映像→フォトリアリスティック映像への変換、学習データの多様性拡張 |

Isaac Simが「ロボットの動きと環境」を設計し、Omniverseが「物理演算とレンダリング」を担当し、Cosmos Transferが「CG→リアル映像への変換」を行う、という役割分担です。

この3層構造の実用的な価値は、各レイヤーを独立して改善できる点にあります。ロボットのタスク定義を変えたいときはIsaac Simだけを調整し、映像品質を上げたいときはCosmos Transferのモデルを更新する、というように、パイプライン全体を作り直す必要がありません。

Isaac Sim 5.0からはCosmosWriterがネイティブに組み込まれ、シミュレーションから直接、RGB・深度・セグメンテーション・エッジデータを同期して出力できるようになりました。これにより、Cosmos Transferへの入力データ生成がシームレスになり、「Isaac Simでの設計→Cosmos Transferでの変換」の接続が大幅に簡素化されています。

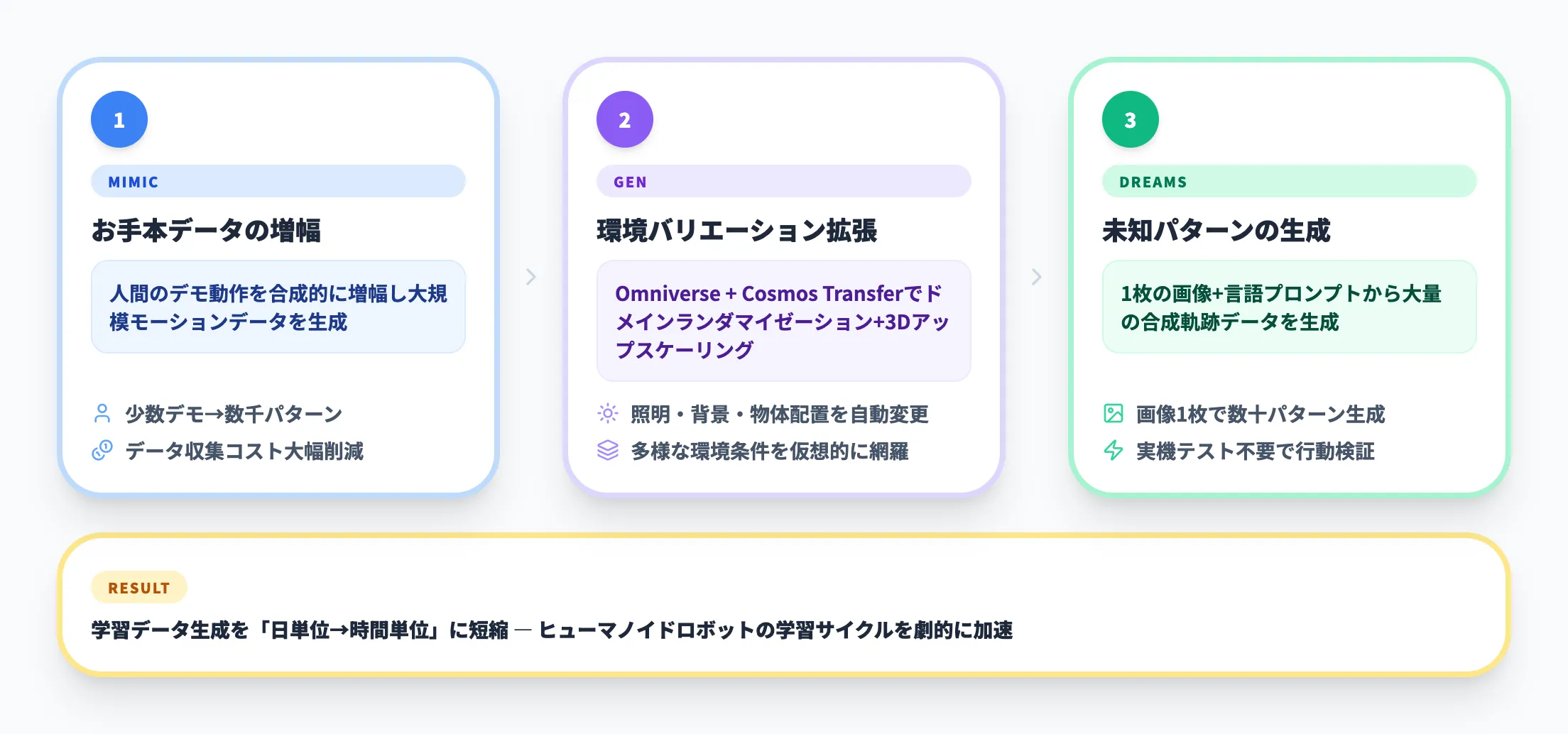

GR00T Blueprint

GTC 2025で発表されたGR00T Blueprintは、Omniverse + Cosmos Transferを組み合わせてヒューマノイドロボット向けの学習データを大量生成するためのフレームワークです。

GR00T Blueprintには、目的に応じた3つのワークフローが含まれています。

-

GR00T-Mimic

人間のデモンストレーション動作をキャプチャし、そのデータを合成的に増幅して大規模なモーションデータセットを生成する。少数のデモから多数のバリエーションを作り出せるため、ロボットに「こう動いてほしい」というお手本を少量用意するだけで、数千パターンの訓練データが得られる

-

GR00T-Gen

OmniverseとCosmos Transferを組み合わせ、ドメインランダマイゼーション(照明・背景・物体配置のランダム変更)と3Dアップスケーリングでデータセットを拡張する。ロボットが実環境で遭遇する多様な状況(明るさの変化、棚の配置替え、障害物の出現など)を仮想的に網羅できる

-

GR00T-Dreams

Cosmosの生成能力を活用し、1枚の画像と言語プロンプトから大量の合成軌跡データを生成する。「ロボットがテーブルの上のカップを持ち上げる」という指示と1枚の画像だけで、数十パターンの動作軌跡をシミュレーションできる。実機テストなしで行動計画の検証が可能になる

3つのワークフローの使い分けとしては、まずMimicで「お手本データの増幅」を行い、次にGenで「環境バリエーションの拡張」を実施し、最後にDreamsで「未知の状況への対応パターン」を生成する、という段階的なアプローチが推奨されています。

Isaac GR00T N1.6

2025年9月に発表されたIsaac GR00T N1.6は、Cosmos Reason 2Bを推論エンジンに採用した汎用ロボット基盤モデル(VLA: Vision-Language-Action)です。視覚・言語・行動を統合的に扱えるアーキテクチャで、ネイティブ解像度をサポートすることにより画像の歪みを排除し、前世代のN1.5を上回る操作性能を実機テスト(YAM、Agibot Genie-1、Unitree G1など)で達成しています。

参考: Isaac GR00T Blueprint - NVIDIA Blog

NVIDIA Cosmosの活用事例

Cosmosプラットフォームの主要機能

Cosmosは、物理シミュレーション・合成データ生成・AIモデルの推論を統合的に提供するプラットフォームです。ここでは自動運転・ロボティクス・産業シミュレーションの活用事例と、NVIDIA DRIVEプラットフォームによるトヨタとの協業を紹介します。

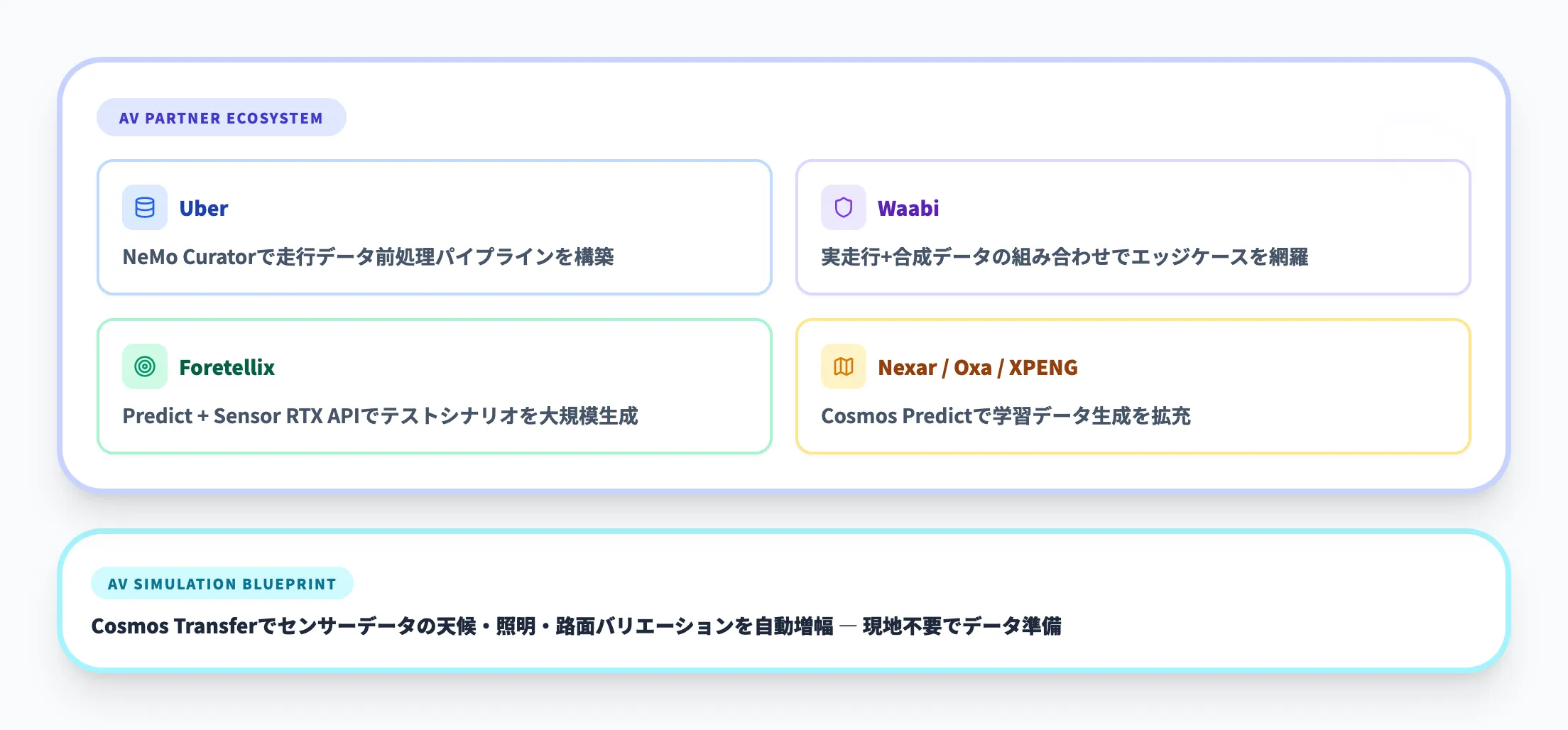

自動運転への活用

自動運転(AV)は、Cosmosの最も活発な活用領域の1つです。安全な自動運転を実現するには、あらゆる走行シナリオを網羅的にテストする必要がありますが、「突然の横断者」「障害物の飛び出し」「豪雨の夜間走行」といったレアシナリオを実際に再現することは極めて困難です。実走行テストでは1kmあたり数万円のコストがかかるケースもあり、特にスタートアップにとっては大きな障壁になっています。

Cosmosを使えば、こうしたシナリオを合成データとして大量に生成し、繰り返し学習・検証できます。以下の表に、自動運転分野の主要パートナーと活用内容を整理しました。

| 企業 | 活用内容 |

|---|---|

| Uber | NeMo Curatorを活用し、膨大な走行データの前処理パイプラインを構築。AVパートナーがより強力なAIモデルを効率的に開発できるデータ基盤を提供 |

| Waabi | 実走行データとCosmosの合成データを組み合わせた高精度シミュレーション。実走行だけでは集めきれないエッジケースを網羅し、安全性検証の精度を向上 |

| Foretellix | Cosmos PredictとOmniverse Sensor RTX APIを組み合わせ、AV向けテストシナリオを大規模に自動生成。シナリオ数の拡張によりバリデーション範囲を拡大 |

| Nexar / Oxa | 自律走行システムの学習データ生成にCosmos Predictを採用 |

| XPENG | AV向け学習データの拡充にCosmosを導入。中国市場特有の走行パターンにも対応 |

AV Simulation Blueprint

GTC 2025で発表されたAutonomous Vehicle Simulation Blueprintも注目です。Cosmos Transferを使ってセンサーデータのバリエーション(天候・照明・路面条件など)を自動的に増幅するフレームワークで、現地に行かなくても多様な走行環境のデータを準備できます。

ロボティクスへの活用

ロボット開発では、実機での試行錯誤に膨大な時間とコストがかかります。新しい動作パターンを1つ追加するだけでも、環境の設定→実行→評価→調整のサイクルに数日を要することも珍しくありません。Cosmosの合成データを活用すれば、倉庫での自動搬送、工場ラインの作業最適化、物体のピッキングなどを仮想空間で大量にシミュレーションし、実機実験への負荷を大幅に削減できます。

| 企業 | 活用内容 |

|---|---|

| 1X | ヒューマノイドロボットNEO GammaのトレーニングにCosmos Predict + Transferを採用。合成データで動作パターンを大量生成し、実機テスト回数を削減 |

| Agility Robotics | 大規模な合成データ生成でロボットモデルのトレーニングを加速。倉庫作業ロボットの動線最適化に活用 |

| Figure AI | Cosmosの早期アドプターとして、人型ロボットの物理AI開発を推進 |

| Skild AI | Cosmos Transferを活用してロボット向け合成データセットを拡張。多様な環境条件での汎用性を強化 |

特に注目すべきは、GR00T Blueprintとの組み合わせです。GR00T-Dreamsを使えば1枚の画像と言語プロンプトから大量の動作軌跡を生成でき、ロボットの学習サイクルを「数日→数時間」に短縮できます。新しい動作パターンの追加や環境変化への適応も迅速に行えるようになり、ロボット開発の反復速度が格段に向上します。

NVIDIA DRIVEプラットフォームとトヨタの協業

Cosmosの活用事例とは別に、NVIDIAはDRIVEプラットフォームを通じた自動車業界との協業も進めています。2025年1月のCES 2025において、NVIDIAはトヨタ自動車、Aurora、Continentalとの戦略的パートナーシップを発表しました。NVIDIAのアクセラレーテッドコンピューティングとAI技術を活用して、自律走行車や高度な運転支援システムの開発を加速させます。

次世代自動車開発

トヨタは、NVIDIAの車載グレードSoC DRIVE AGX Orin と安全認証を受けたDriveOSオペレーティングシステムを組み合わせ、次世代の安全性と高度運転支援機能を備えた車両を開発しています。車載AIの処理能力をNVIDIAのハードウェアで底上げし、リアルタイムの環境認識と判断を実現する構成です。

スマートシティ「ウーブンシティ」

ウーブンシティイメージ画像

トヨタが静岡県裾野市に建設中のスマートシティ「ウーブンシティ」では、NVIDIAの技術がモビリティ分野の中核を担います。車両間通信やAIによる交通最適化を通じて、人・車・ロボットが共存する都市の実現を目指しています。NVIDIAのシミュレーション技術とデジタルツインの組み合わせにより、都市計画の高度化が見込まれます。

Auroraとのレベル4自律走行車

Aurora DriverにNVIDIA DriveOSとDRIVEコンピューティングを統合し、2027年に量産予定のレベル4自律走行システムを開発しています。レベル4とは、特定の条件下でドライバーの操作なしに完全自律走行が可能な段階で、まずは大型トラックの自律走行(ドライバーレストラック)から実用化される見込みです。物流業界の人手不足への解決策として、商用展開が期待されています。

産業シミュレーション・その他の活用

Cosmosの活用範囲は自動運転やロボティクスに限りません。物理的な挙動のシミュレーションが必要なあらゆる領域に応用できます。

-

スマートシティ・交通シミュレーション

都市全体の交通流、歩行者の動き、信号制御をリアルタイムにシミュレーションし、渋滞対策や歩行者安全を検証する。デジタルツインとの組み合わせにより、インフラ投資の優先順位付けや災害時の避難シミュレーションなど、都市計画の意思決定をデータドリブンで支援できる

-

産業用ロボット・工場ライン

工場ラインの動的シミュレーションや安全対策検証に活用。物体の流れ、作業者との干渉リスク、設備配置の最適化を仮想空間で繰り返しテストできる。実際のラインを停止させることなく、レイアウト変更の効果を事前に検証できるのが大きなメリットになる

-

AR/VR・シミュレーション学習

高精度な3D空間と動画生成能力を活かし、整備士や医療従事者向けの訓練プログラムに応用できる。複雑な手術手順の可視化、高所作業の安全訓練など、実地訓練が困難・危険な領域でのシミュレーション学習が期待される

NVIDIA Cosmosの使い方

Cosmosは、GPU環境の有無に応じて複数の利用方法が用意されています。ここでは手軽に試せるWeb版から本格的なローカル運用まで、段階的に解説します。「まずは触ってみたい」という方はWeb版から、「自社データで本格的にモデルを鍛えたい」という方はクラウドGPUやローカル環境を検討してください。

Web版デモで試す(GPU不要)

最も手軽な方法は、NVIDIAの公式Webデモを使うことです。インストールや環境構築は一切不要で、ブラウザさえあればCosmosの基本機能を体験できます。

以下の手順でCosmosの動画生成を試すことができます。

- NVIDIA build.nvidia.comにアクセスする

- テキストプロンプトまたは画像・動画をインプットとして入力する

- 結果(動画や画像)をブラウザでプレビューする

実際の操作画面

動画の生成には60秒ほどかかり、1日あたりの回数制限もあります。生成できる動画の長さや解像度にも制約がありますが、「Cosmosで何ができるのか」を直感的に把握するには最適な方法です。入力画像や動画はサンプルから選んで試すこともできます。

実際にCosmosで生成した動画はこちらです。

実際の生成動画

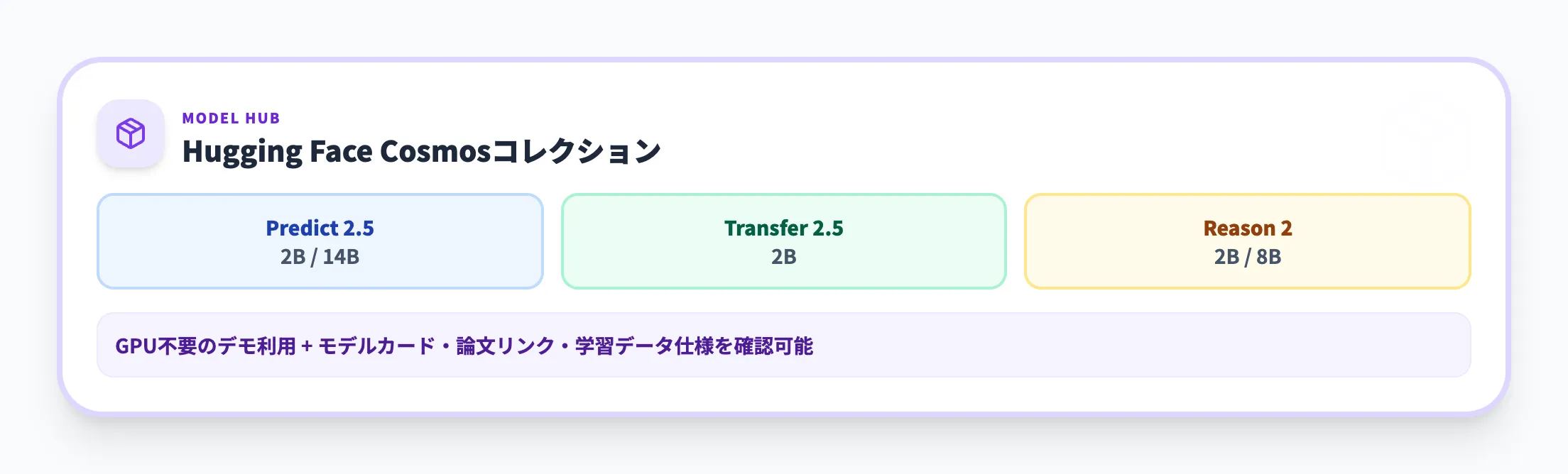

Hugging Faceで試す(GPU不要)

Hugging Face上のCosmosモデルコレクションからもデモを利用できます。Web版と同様にテキストプロンプトで生成結果を確認可能です。

Hugging Faceはモデルカードの技術仕様、論文リンク、学習データの詳細情報も充実しているため、「モデルの内部構造やパフォーマンスを理解した上で試したい」という開発者にはこちらが向いています。Predict 2.5・Transfer 2.5・Reason 2のすべてのモデルがHugging Faceで公開されています。

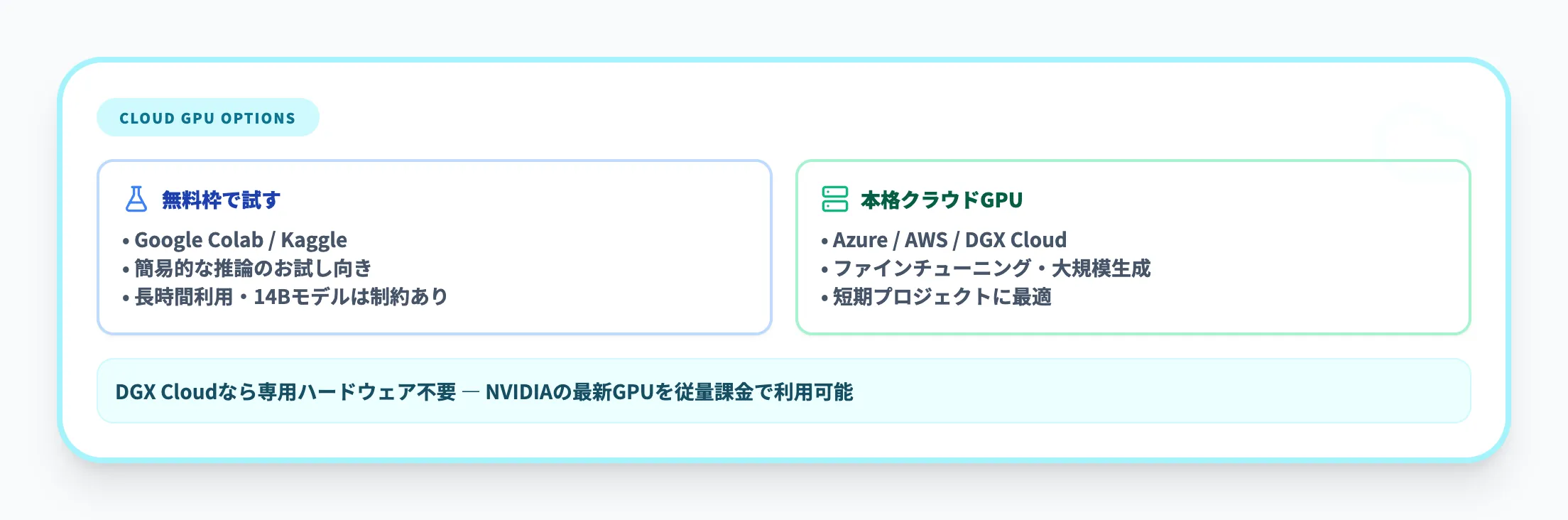

クラウドGPUで本格利用

Google ColabやKaggleの無料GPU枠を使えば、Cosmosモデルの簡易的な推論を試せます。ただし、無料枠では長時間利用や大規模モデル(14B)の実行には制約があります。

本格的なファインチューニング(自社データでの再学習)や大規模な合成データ生成には、Azure、AWS、またはNVIDIA DGX CloudなどのクラウドGPUが必要です。DGX Cloudを使えば、専用のハードウェア環境を構築する手間なく、NVIDIAの最新GPUを利用できます。一時的なプロジェクトや短期間の集中的な学習に特に向いています。

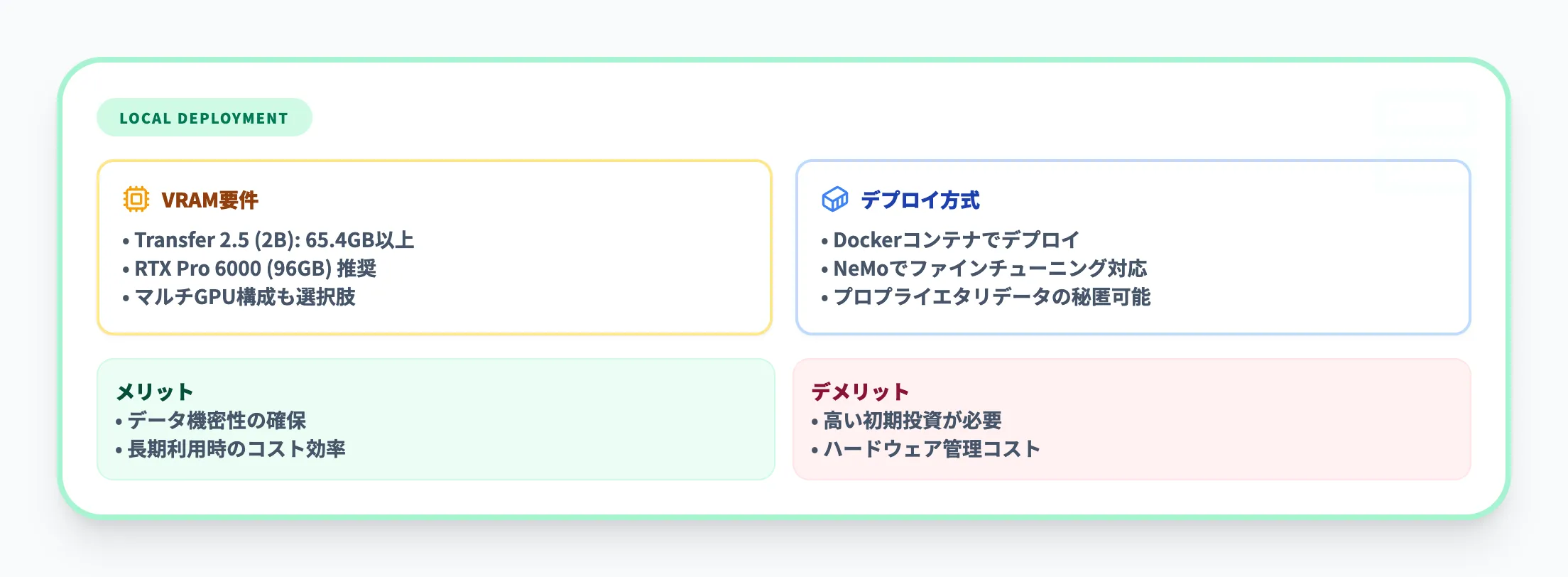

ローカルGPU環境での利用

高性能GPUを搭載したマシンにDockerを使ってデプロイする方法です。モデルによって必要なVRAMは大きく異なり、Transfer 2.5の2Bモデルでも公式Model Matrixでは65.4GBが示されているため、RTX Pro 6000 Blackwell(VRAM 96GB)クラスのワークステーション向けGPUか、マルチGPU構成が現実的です。独自データでのファインチューニング(NeMoフレームワーク利用)にも対応しており、プロプライエタリなデータを外部に出さずにモデルをカスタマイズできます。

ローカル環境は初期投資が必要ですが、大量のデータ生成を繰り返す場合はクラウドよりもコスト効率が良くなるケースがあります。データの機密性が高い場合や、長期的に繰り返し利用する場合にはローカル環境が有利です。独自データでのファインチューニング(NeMoフレームワーク利用)にも対応しており、プロプライエタリなデータを外部に出さずにモデルをカスタマイズできます。

Cosmos Cookbook(公式レシピ集)

NVIDIAが公式に提供しているCosmos Cookbookには、Predict 2.5・Transfer 2.5・Reason 2のレシピ(コードサンプルと手順書)が掲載されています。「何から始めればいいかわからない」という場合は、ここから用途に合ったレシピを選んで試すのが効率的です。モデルの推論からファインチューニングまで、段階的に学べる構成になっています。

NVIDIA Cosmosの料金・ライセンス

Cosmosの導入を検討するうえで押さえておくべきなのが、コストとライセンスの仕組みです。Cosmosはオープンモデルとして公開されていますが、「無料で使える範囲」と「有料ライセンスが必要な範囲」が明確に分かれています。ここを正しく理解しておかないと、プロトタイプから本番移行する際に想定外のコストが発生する可能性があります。

ライセンス体系

以下の表に、Cosmosに関連するライセンスを整理しました。

| ライセンス | 対象 | 用途 |

|---|---|---|

| NVIDIA Open Model License | Predict 2.5, Transfer 2.5, Reason 2 のモデル | 商用利用可。カスタマイズ・再配布も可能 |

| Apache 2.0 | ソースコード(全モデル共通) | オープンソース。制約が最も少ない |

| NVIDIA OneWay Noncommercial | Isaac GR00T N1.6 | 研究・評価目的のみ。商用利用は不可 |

NVIDIA Open Model Licenseの特徴は、商用利用を含む幅広い活用が可能な点です。モデルのファインチューニングや派生モデルの作成・再配布も許可されており、従来の商用AIモデルと比べて参入障壁が大幅に低くなっています。スタートアップや研究機関にとっては、数千万ドル規模の開発コストをかけずに最先端のWFMを活用できるメリットがあります。

ただし、GR00T N1.6は非商用ライセンスである点に注意が必要です。研究や技術検証には自由に使えますが、商用製品にそのまま組み込む場合は別途ライセンス交渉が必要になります。

API利用(NIM)

NVIDIAのNIM(NVIDIA Inference Microservices)を通じて、Cosmosモデルにアクセスすることも可能です。NIMはCosmosモデルをAPIエンドポイントとして提供するサービスで、自前のGPU環境がなくても推論を実行できます。

-

プロトタイピング(無料)

NVIDIA Developerプログラムのメンバーは、NIM APIエンドポイントに無料でアクセスできる。開発・実験段階ではコストを気にせず試行錯誤が可能。さらに、16GPUまでのダウンロード可能なNIMマイクロサービスもR&D用途で無料利用できる

-

本番運用(有料)

NIMマイクロサービスの本番デプロイにはNVIDIA AI Enterpriseライセンスが必要。2026年3月時点の参考価格はGPUあたり年間$4,500

モデル自体はGitHubやHugging Faceから無料でダウンロードでき、NVIDIA Open Model Licenseのもとで自己管理環境での商用利用も無料です。NIMマイクロサービス経由で手軽にデプロイしたい場合のみ、本番運用にAI Enterpriseライセンスが必要になります。つまり、「自前でGPU環境を用意すれば無料で商用利用可能、NIMで楽にデプロイするなら有料」という構成です。

NeMo Curator(データ処理パイプライン)

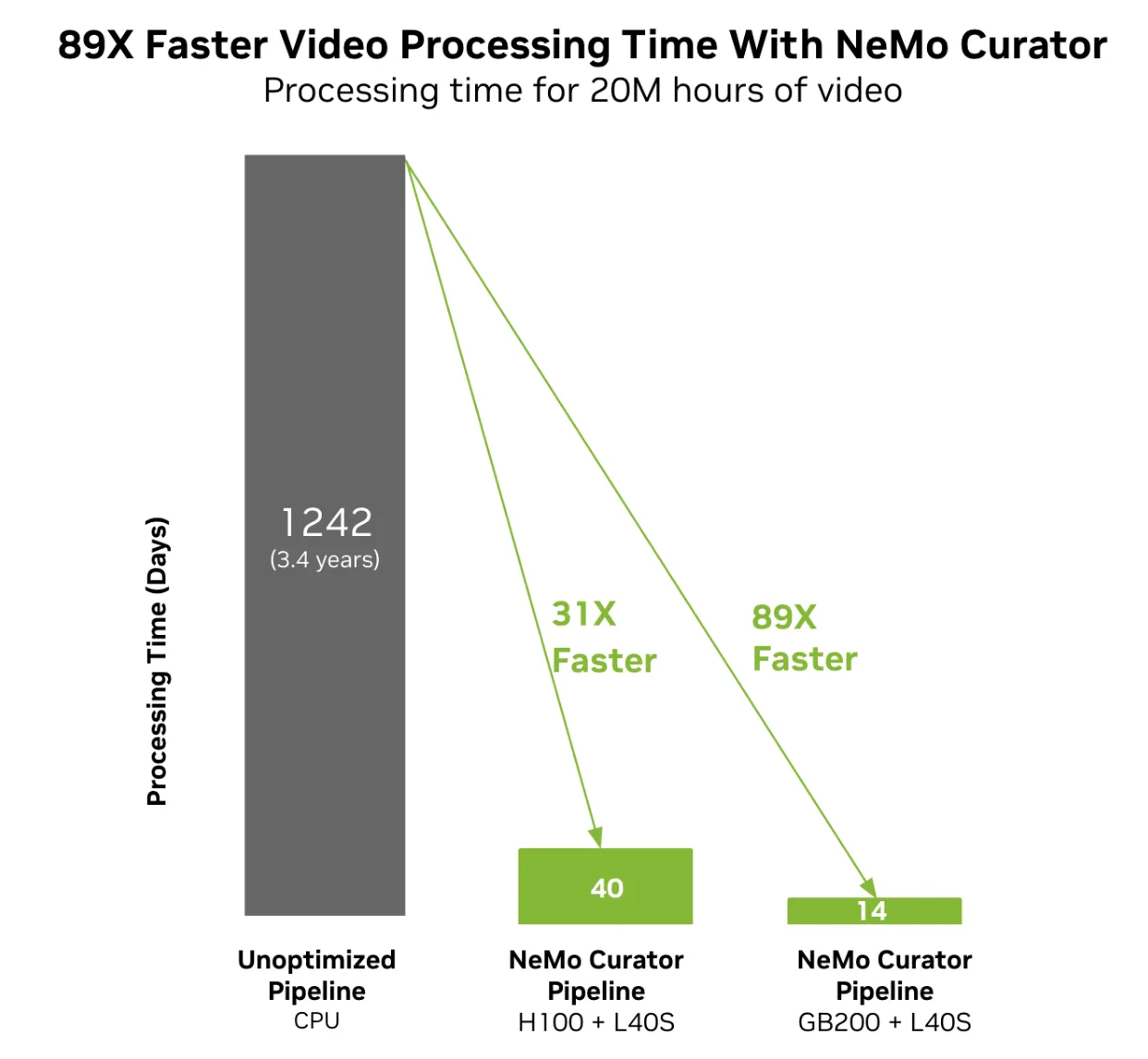

Cosmosに含まれるNeMo Curatorは、大規模データの収集・クリーニング・アノテーションを一括管理するGPUアクセラレーテッドなパイプラインです。物理AI開発では「良質なデータを大量に整備する」ことがモデル性能の鍵を握りますが、その前処理工程を効率化するのがNeMo Curatorの役割です。

NeMo CuratorによるGPU高速処理 参照: NVIDIA

CUDAアーキテクチャによるGPU並列処理を活かし、CPUベースのデータ処理とは桁違いの速度を実現しています。以下の比較表をご覧ください。

| 項目 | CPUベース | GPUベース(Hopper/Blackwell) |

|---|---|---|

| 処理規模 | 数百〜数千時間分/日 | 数万時間以上/日 |

| 処理速度 | 数テラバイト/週 | 数ペタバイト/週 |

| 所要期間(大規模データ) | 3年以上 | 40日〜14日程度 |

CPUベースでは数年かかるデータ処理が、GPUの大規模並列処理で数十分の一の期間に短縮されます。Cosmosの学習にはPredictだけでも35億時間分の動画データが使われていることからも分かるように、物理AI開発では膨大なデータの前処理が避けて通れません。NeMo Curatorはその工程のボトルネックを解消するための重要なコンポーネントです。

物理AIプラットフォームの理解を業務でのAI活用に広げる

AI業務自動化ガイド

NVIDIA Cosmosのような物理AI基盤の進化を追う中で、自社の業務にAIをどう取り入れるかを考え始めた方へ。AI総合研究所のAI業務自動化ガイドでは、AIモデルの業務適用から運用設計まで220ページで実践手法を解説しています。

物理AIプラットフォームの理解を業務でのAI活用に広げる

NVIDIA Cosmosのような先端的なAI基盤の進化を把握できたなら、自社の業務にAIをどう取り入れるかを具体的に考えるタイミングです。シミュレーションや合成データの技術は、製造業の品質管理や物流の最適化など、幅広い産業で実務への応用が進んでいます。

AI総合研究所では、最新のAI技術を業務に落とし込むための「AI業務自動化ガイド」を無料で提供しています。AI基盤の技術動向を理解した上で、自社に適したAI活用の設計を進めるための220ページの実践ガイドです。

物理AIプラットフォームの理解を業務でのAI活用に広げる

AI業務自動化ガイド

NVIDIA Cosmosのような物理AI基盤の進化を追う中で、自社の業務にAIをどう取り入れるかを考え始めた方へ。AI総合研究所のAI業務自動化ガイドでは、AIモデルの業務適用から運用設計まで220ページで実践手法を解説しています。

まとめ

NVIDIA Cosmosは、物理AI開発のための世界基盤モデルプラットフォームとして、CES 2025での初公開から1年で大幅に進化しました。

-

Predict 2.5(未来予測)・Transfer 2.5(合成データ変換)・Reason 2(推論VLM) の3モデル体系で、物理AIの学習サイクル全体をカバー。35億時間の動画から厳選した2億クリップで事前学習し、物理法則に沿った高精度な世界シミュレーションを実現

-

OmniverseやIsaac Simとの連携により、「3Dシーン設計→物理シミュレーション→リアル映像変換→AI学習」という一貫したパイプラインを構築可能。GR00T Blueprintでは学習データ生成を「日単位→時間単位」に短縮

-

1X・Figure AI・Uber・Waabi・XPENGなど世界の主要企業が採用し、自動運転・ロボティクス・産業シミュレーションでの実用化が加速中

-

オープンモデルライセンスで自己管理環境での商用利用も無料。NIMマイクロサービスで手軽にデプロイする場合の本番運用にはNVIDIA AI Enterprise(GPUあたり年間$4,500〜)が必要

-

SoraやRunwayといった動画生成AIとの根本的な違いは、「映像の美しさ」ではなく「物理的な正しさ」 を重視している点。ロボットや自動運転のトレーニングデータとして使える品質を追求している

GTC 2026(2026年3月16〜19日)ではCosmosのさらなる進化が発表される見込みです。最新情報はNVIDIA GTC公式ページをご確認ください。

AI総合研究所では最新AIの企業導入、開発、研修を支援しています。AI導入の企業の担当者様はお気軽にご相談ください。