この記事のポイント

エッジ環境でリアルタイムAI推論を実行するなら、NVIDIA Jetsonが第一候補。クラウド依存を避けるべき現場用途に最適

2025年8月発売のJetson Thorは2070 FP4 TFLOPSでOrin比7.5倍の性能。汎用ロボティクスや大規模エッジAI推論に対応

用途別にOrin Nano Super(入門・生成AI実験)、Orin NX/AGX Orin(産業)、Thor(大規模ロボティクス)と使い分けが有効

JetPack 7のソフトウェアスタックでTensorRT・DeepStream・Isaac等が統合されており、開発環境のセットアップ工数を大幅に削減できる

プロトタイプはOrin Nano Superで始め、量産時にOrin NX/Thorへスケールアップする段階的導入が最もリスクが低い

Microsoft MVP・AIパートナー。LinkX Japan株式会社 代表取締役。東京工業大学大学院にて自然言語処理・金融工学を研究。NHK放送技術研究所でAI・ブロックチェーンの研究開発に従事し、国際学会・ジャーナルでの発表多数。経営情報学会 優秀賞受賞。シンガポールでWeb3企業を創業後、現在は企業向けAI導入・DX推進を支援。

「AIをロボットやドローンに組み込みたいけど、普通のPCでは大きすぎる…」「現場でリアルタイムにAI処理を行いたいけど、クラウドとの通信が不安…」

そんなエッジAI開発の課題を解決するのが、NVIDIAの「Jetson」シリーズです。

2025年8月にはBlackwellアーキテクチャ搭載の最新世代「Jetson Thor」が発売され、従来のOrinシリーズ比で7.5倍のAI演算性能を実現しています。

本記事では、この強力なエッジAIプラットフォーム「NVIDIA Jetson」について、その基本から最新のJetson Thorまでを徹底的に解説します。Jetsonのハードウェア構成、AI処理性能を支える技術、開発を加速するソフトウェアエコシステム、そして自律移動ロボットからスマートシティまで、幅広い活用事例を詳しくご紹介します。

目次

Jetsonが注目される理由:エッジAI・ロボティクスとの密接な関係

NVIDIA Jetsonシリーズ:モデル別ラインナップと進化

他の組み込みプラットフォームとの違い(例:Raspberry Pi + AIアクセラレータなど)

NVIDIA Jetsonとは?

NVIDIA Jetsonは、NVIDIA社が提供する組み込みコンピューティングボードのシリーズです。ロボット、ドローン、インテリジェントカメラ、ポータブル医療機器など、さまざまなエッジデバイス上で高度なAI処理を実行するために設計されており、データセンターで学習させたAIモデルを、現場に近い場所でリアルタイムに活用することを可能にします。

Jetsonは単なるハードウェアではなく、AI開発を加速するための包括的なソフトウェアスタックと共に提供される点が大きな特徴です。2025年8月にはBlackwellアーキテクチャ搭載の最新世代Jetson Thorが発売され、Orin世代比で7.5倍のAI演算性能と3.5倍のエネルギー効率を実現しています。Amazon Robotics、Boston Dynamics、Caterpillar、Figure、Medtronicといった企業がJetson Thorを早期採用しており、汎用ロボティクス時代の本格到来を示しています。

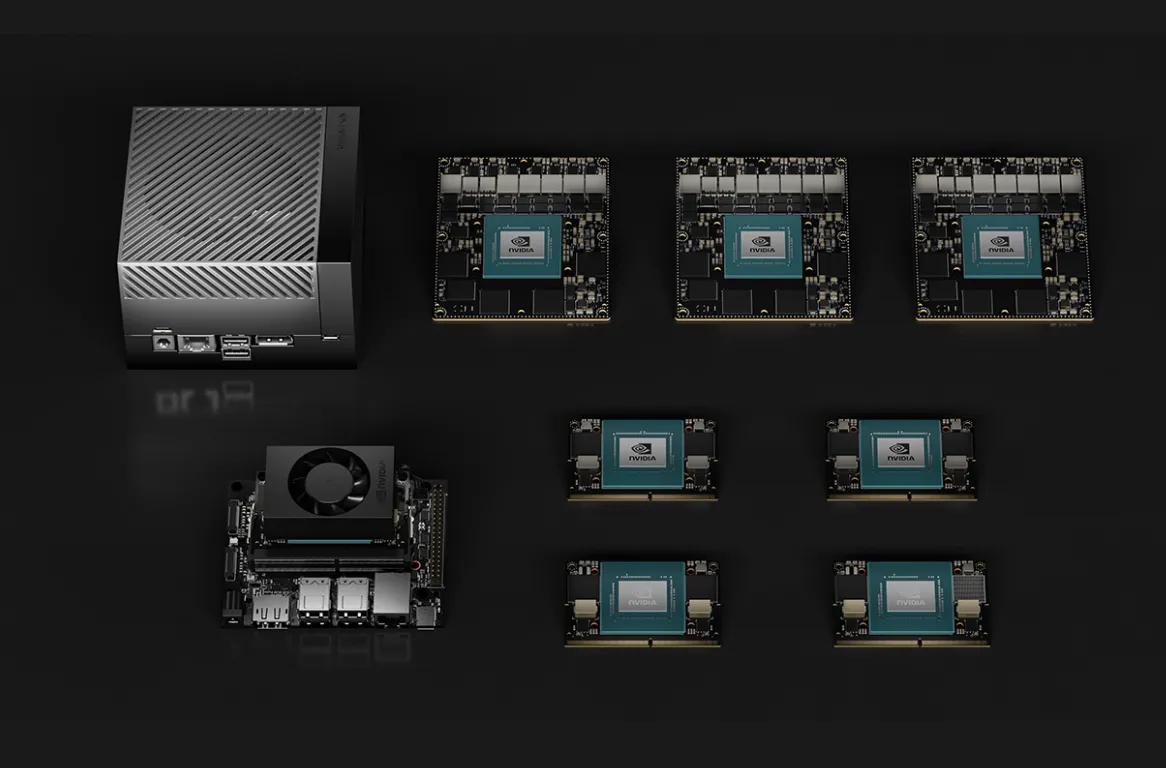

NVIDIA Jetsonのイメージ (参考:NVIDIA)

Jetsonの全体像:基本構成からAI性能、開発効率まで

このセクションでは、NVIDIA Jetsonのハードウェア構成から、そのAI処理能力、そして開発を効率化するソフトウェア技術まで、Jetsonの主要な特徴をまとめて解説します。

Jetsonがどのようにして強力なAI処理能力を実現し、開発者の生産性向上に貢献するのか、具体的な技術やツールと共に見ていきましょう。

ハードウェアの基本構成

NVIDIA Jetsonの物理的な側面と、その設計がもたらす利点について説明します。

SOM(System-on-Module)

Jetsonデバイスの多くは、CPU、GPU、メモリ、ストレージ、電源管理IC(PMIC)などが一つの小さなモジュールに統合された「System-on-Module(SOM)」として提供されます。これにより、開発者はキャリアボードを設計するだけで、Jetsonモジュールを最終製品に容易に組み込むことができます。

このモジュール設計は、製品開発の柔軟性と市場投入までの時間短縮に貢献します。

NVIDIA GPUアーキテクチャの継承

Jetsonに搭載されるGPUは、NVIDIAのデータセンター向けGPUやPC向けGeForceシリーズと同じ、先進的なGPUアーキテクチャをベースにしています。世代ごとにMaxwell、Pascal、Volta、Ampere、そして最新のBlackwellが採用されており、エッジデバイスにおいてもCUDAコアやTensorコアといった専用計算ユニットによる強力な並列処理能力とAI演算性能を利用できます。

特にTensorコアは、AIの推論処理を大幅に高速化する上で重要な役割を果たします。Jetson Thorに搭載された第5世代TensorコアはFP4精度をサポートしており、より効率的なAI推論を実現しています。

【関連記事】

▶︎Tensorコアとは?CUDAコアとの違いや各世代の特徴を比較解説!

電力効率

Jetsonモジュールは、高い処理性能を発揮しながらも、消費電力を低く抑えるように設計されています。Jetson Orin Nanoシリーズは7Wから15Wの範囲で動作し、Jetson Orin NXシリーズは10Wから40Wの範囲で動作します。最新のJetson Thorでも40Wから130Wと、その演算性能に対して効率的な電力設計がなされています。

この優れた電力効率により、バッテリー駆動のポータブルデバイスや、熱設計に制約のある小型製品への組み込みに適しています。

多様なインターフェース

Jetsonモジュールを搭載した開発キットやキャリアボードは、さまざまなセンサーや周辺機器と接続するための豊富なインターフェースを備えています。

-

カメラインターフェース

MIPI CSI-2コネクタを複数備え、高解像度カメラを接続可能です。

-

ディスプレイ出力

HDMIやDisplayPortに対応しています。

-

高速ストレージ

M.2 Key Mスロット(NVMe SSD用)を搭載しています。

-

ネットワーク

ギガビットイーサネットに対応しています。

-

USB

USB 3.2 Gen2などの高速USBポートを備えています。

-

汎用I/O

GPIO、I2C、SPI、UARTなどに対応しています。

これらのインターフェースにより、ロボットの目となるカメラ、モーター制御、センサーデータの収集など、多岐にわたるアプリケーションに対応できます。

AI処理性能とそれを支える技術

NVIDIA Jetsonが持つAI処理能力の具体的な指標と、その性能を引き出すコア技術について解説します。

AIベンチマーク

NVIDIA Jetsonプラットフォームは、画像分類(ResNet-50など)、物体検出(SSD、YOLOなど)、セグメンテーション、自然言語処理(BERTなど)といった標準的なAIモデルにおいて高い推論パフォーマンスを発揮します。Jetson AGX Orinのようなハイエンドモデルでは、複数の高解像度ビデオストリームをリアルタイムで処理する能力があります。最新のJetson Thorでは、大規模言語モデル(LLM)や視覚言語モデル(VLM)のエッジ推論にも対応する性能を備えています。

NVIDIAはMLPerfなどの業界標準ベンチマークにも積極的に参加し、Jetsonプラットフォームの優れたAI性能を実証しています。

Tensorコアの活用

Voltaアーキテクチャ(Jetson Xavierシリーズ)以降のJetsonモジュールには、AI計算、特にディープラーニングで多用される行列演算を高速化するための専用計算ユニット「Tensorコア」が搭載されています。Tensorコアは、FP16(半精度浮動小数点数)やINT8(8ビット整数)といった低精度での演算を得意とし、混合精度コンピューティングにより、精度を維持しつつ処理速度を大幅に向上させます。

Jetson Orinシリーズに搭載されているAmpereアーキテクチャの第3世代Tensorコアは、構造的スパース性(Structured Sparsity)をサポートすることで、対応するニューラルネットワークの演算スループットをさらに高めることができます。Jetson Thorに搭載された第5世代Tensorコアでは、FP4精度やTransformerエンジンにより、LLMやVLMの推論効率がさらに強化されています。

NVIDIAソフトウェアによる推論最適化(TensorRT)

学習済みのニューラルネットワークモデルをJetsonプラットフォーム上で最高のパフォーマンスで実行するためには、最適化が不可欠です。NVIDIA TensorRTは、高性能ディープラーニング推論オプティマイザおよびランタイムであり、この役割を担います。

TensorRTは、モデルのグラフ最適化、レイヤー融合、精度キャリブレーション、カーネルの自動選択などを行い、特定のJetsonデバイスのGPUアーキテクチャに合わせて推論エンジンを最適化します。

これにより、多くの場合、TensorFlowやPyTorchなどのフレームワークで直接推論を実行するよりも大幅なレイテンシ削減とスループット向上が期待できます。

【関連記事】

▶︎TensorRTとは?対応GPUや導入方法、使い方をわかりやすく解説!

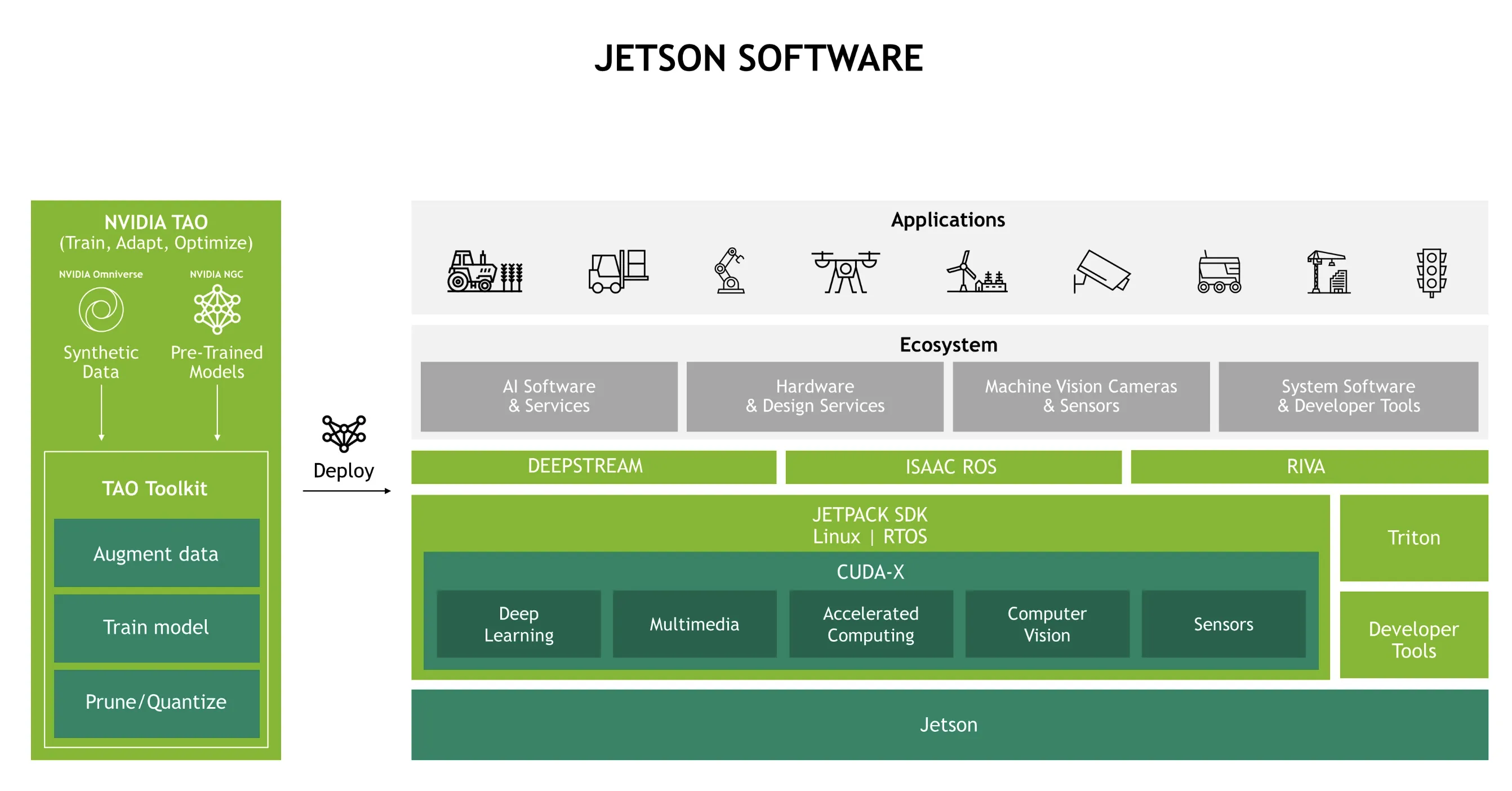

開発を支援するソフトウェアエコシステム

NVIDIA Jetsonの能力を最大限に引き出し、効率的なAIアプリケーション開発を実現するためには、多層的で包括的なソフトウェアエコシステムが不可欠です。

その全体像は下図に示すように、オペレーティングシステムレベルから、AIモデル開発、推論実行、アプリケーション特化型SDK、そして開発ツール群まで、広範なコンポーネントで構成されています。

NVIDIA Jetson ソフトウェアエコシステムの全体像 (参考:NVIDIA)

この広範なエコシステムが、Jetsonプラットフォーム上でのエンドツーエンドのAIソリューション開発を強力にサポートします。

NVIDIA JetPack SDK

NVIDIA JetPack SDKは、Jetsonプラットフォーム向けの最も包括的なソフトウェア開発キットです。これには、Linuxオペレーティングシステム(Jetson Linux)、CUDA-Xアクセラレーテッドライブラリ(CUDA、cuDNN、TensorRTなど)、API、開発者ツール、サンプルコードなどが含まれており、AIアプリケーションの開発をエンドツーエンドでサポートします。

2026年3月時点で、Jetson Thor向けにはJetPack 7.1が提供されており、Linux Kernel 6.8とUbuntu 24.04 LTSをベースにしたモジュラー・クラウドネイティブアーキテクチャが採用されています。Orinシリーズ向けにはJetPack 6.2.1が最新版として提供されています。

JetPack SDKを利用することで、開発者はJetsonのハードウェア性能を最大限に引き出し、開発効率を高めることができます。

NVIDIA TAO Toolkit

NVIDIA TAO Toolkit(Train, Adapt, and Optimize)は、AIモデルの開発とファインチューニングを簡素化し、高速化するためのローコードAI/MLツールキットです。開発者は、NVIDIA NGCカタログから高品質な事前学習済みモデルを選択し、自身のカスタムデータセットを使って特定のタスクに適応(ファインチューニング)させることができます。

TAO Toolkitは、モデルのプルーニング(枝刈り)や量子化といった最適化機能も提供し、Jetsonデバイスでのデプロイに適した軽量かつ高性能なモデルを効率的に作成することを支援します。コーディングの専門知識が少なくても、高度なAIモデルを構築できる点が魅力です。

Jetsonが注目される理由:エッジAI・ロボティクスとの密接な関係

NVIDIA JetsonがエッジAIやロボティクスの分野で特に注目を集めている理由について、その具体的な利点と共に解説します。

リアルタイム処理の実現

自動運転車、自律型ドローン、工場の検査ロボットなど、多くのエッジAIアプリケーションでは、瞬時の判断と応答が不可欠です。Jetsonは、強力なオンボードGPUにより、収集したセンサーデータをクラウドに送信することなく、デバイス上で直接AIモデルを実行し、リアルタイムに結果を出力します。

これにより、通信遅延の影響を受けない、信頼性の高いリアルタイムシステムを構築できます。

プライバシーとセキュリティの向上

医療データや個人の行動データなど、機密性の高い情報を扱う場合、データを外部のクラウドに送信することなくローカルで処理できるエッジコンピューティングは、プライバシー保護の観点から非常に重要です。Jetsonは、データをデバイス内部で完結して処理することで、情報漏洩のリスクを低減します。

また、Jetsonプラットフォームには、セキュアブートやハードウェア暗号化アクセラレーションといったセキュリティ機能も備わっています。

ネットワーク帯域幅の削減とオフライン動作

高解像度のカメラ映像など、大量のデータを常にクラウドに送信するには、広帯域なネットワーク接続が必要となり、通信コストも増大します。Jetsonを用いてエッジでデータを処理し、必要な情報だけをクラウドに送ることで、ネットワーク帯域幅の消費を大幅に削減できます。

また、ネットワーク接続が不安定な環境や、完全にオフラインの環境でもAI機能を利用できるため、活用の幅が広がります。

高度な自律性の実現

ロボットが周囲の環境を正確に認識し、状況に応じて自律的に判断し行動するためには、高度なAI処理能力が不可欠です。Jetsonは、複数のセンサーからの情報を統合し(センサーフュージョン)、複雑なAIモデルを実行することで、ロボットや自律マシンに人間のような認識・判断能力を与えます。

NVIDIA Isaac SDKのような専用ソフトウェアと組み合わせることで、より洗練された自律システムの開発が加速されます。Jetson Thorの登場により、ヒューマノイドロボットのような高度な汎用ロボティクスにも対応可能な演算性能がエッジで利用できるようになりました。

NVIDIA Jetsonシリーズ:モデル別ラインナップと進化

NVIDIA Jetsonは、初代のJetson TK1から始まり、TX1、TX2を経て、Nano、Xavier、Orin、そして最新のThorファミリーへと進化を遂げてきました。ここでは主要なモデルを中心に、そのスペックと特徴を紹介します。

各モデルファミリーの概要

Nanoシリーズ

-

Jetson Nano

Maxwellアーキテクチャ搭載。5W/10WのTDPモードで動作し、教育・ホビー・小規模エッジAI向けの入門モデルです。

-

Jetson Orin Nano / Orin Nano Super

Ampere世代を採用し、従来のJetson Nanoから大幅にAI性能が向上しています。Orin Nano Super Developer Kitは$249で提供されており、ソフトウェアアップデートにより最大67 TOPS(1.7倍向上)のAI性能を発揮します。小規模なLLMやVLMのエッジ推論にも対応可能で、生成AIの実験・プロトタイピングに最適です。

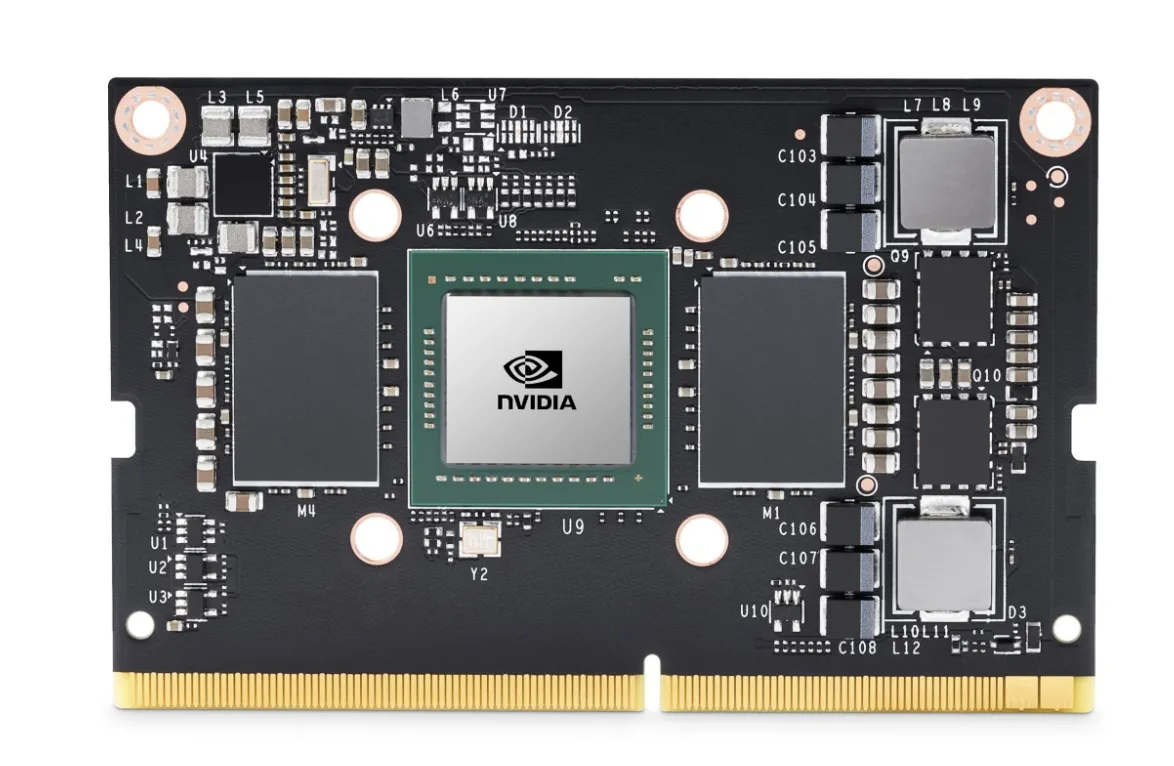

(参考:NVIDIA)

TXシリーズ

-

Jetson TX1

Maxwellアーキテクチャ搭載の初代エッジAIボードです。現行流通は少ないですが、一部産業用途で現役です。

-

Jetson TX2

Pascalアーキテクチャ搭載。7.5W/15Wモードで動作します。産業組込み・商用ロボットで根強い流通があります。

(参考:NVIDIA)

Xavierシリーズ

- Jetson Xavier NX

VoltaアーキテクチャとTensorコアを搭載。10W/20Wモードで最大21 INT8 TOPSのAI性能を実現します。クレジットカードサイズで小型商用ロボットやAIカメラ向けです。

(参考:NVIDIA)

- Jetson AGX Xavier

Voltaアーキテクチャ。最大32 INT8 TOPS。30W/32Wモードで動作します。産業機器や重装ロボティクス向けです。

Orinシリーズ

- Jetson Orin Nano

Ampereアーキテクチャのエントリーモデルです。20〜40 INT8 TOPS、7W/10W/15W対応で、従来Nanoの上位互換にあたります。

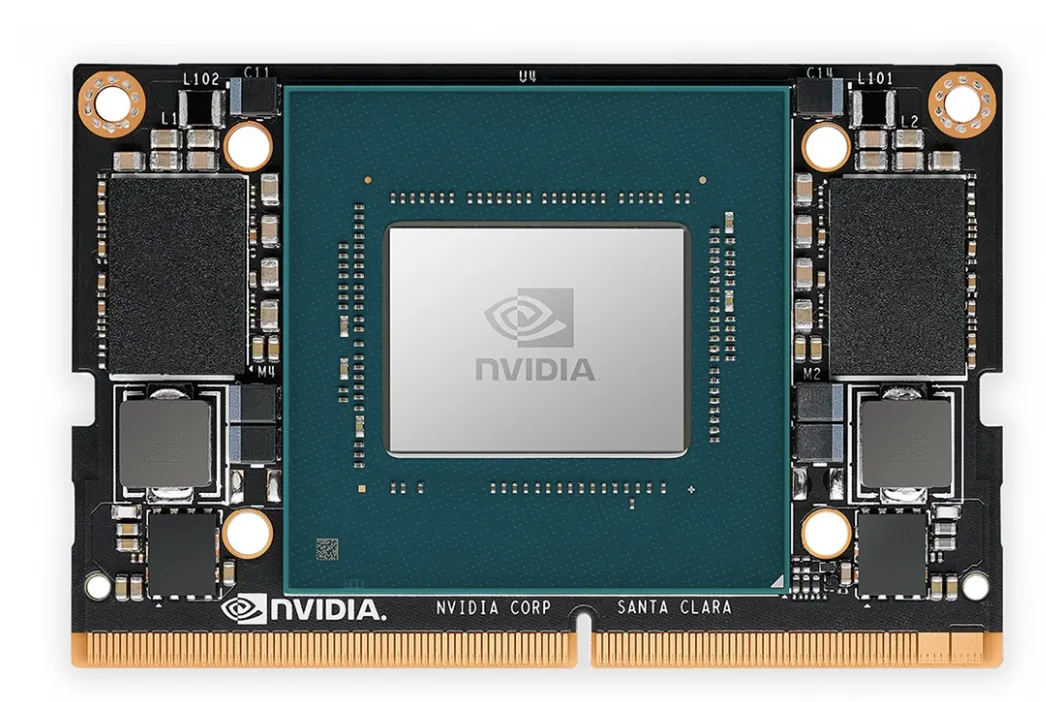

(参考:NVIDIA)

- Jetson Orin NX

Ampereアーキテクチャと第3世代Tensorコアを搭載。70〜100 INT8 TOPSで、10W〜40Wの幅広い電力モードに対応します。多用途なAIエッジ実装に最適です。

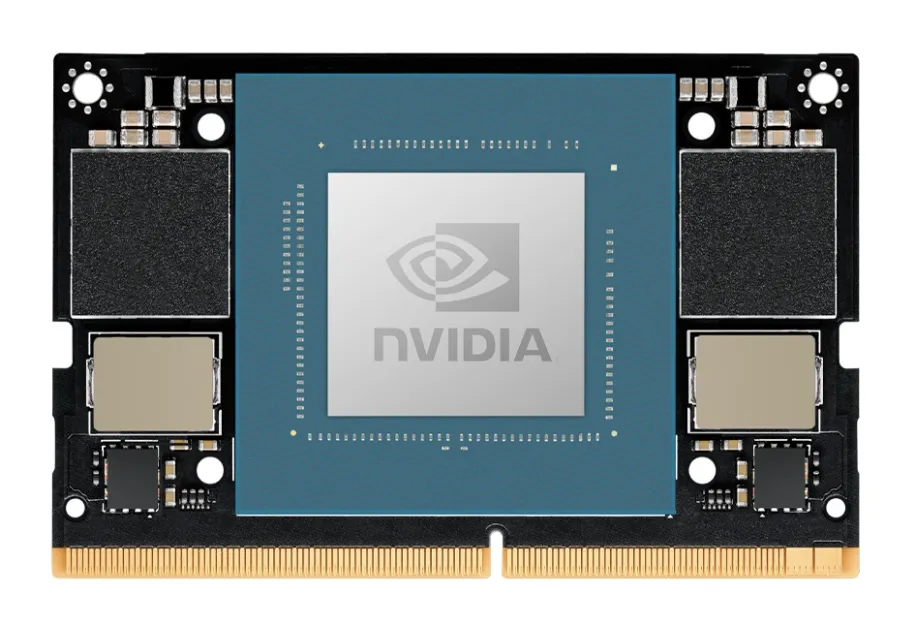

(参考:NVIDIA)

- Jetson AGX Orin

Orinシリーズ最上位モデルです。200〜275 INT8 TOPS(32GB/64GBモデル)。TDPは15W〜60Wで、大規模産業AI・自律ロボティクス用途に対応します。製品ライフサイクルは2030年1月まで延長されています。

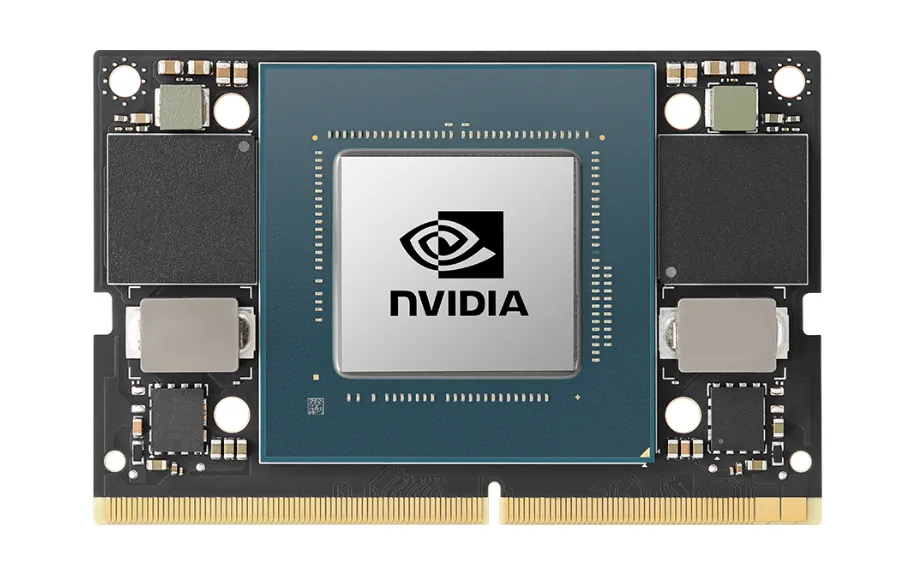

(参考:NVIDIA)

Thorシリーズ(最新世代)

-

Jetson AGX Thor(T5000)

2025年8月に発売されたBlackwellアーキテクチャ搭載の最新フラッグシップモデルです。2,560 CUDAコア、96基の第5世代Tensorコア、14コアのArm Neoverse CPUを搭載し、2070 FP4 TFLOPS(1035 INT8 TOPS)のAI性能を発揮します。128GB LPDDR5xメモリ、40W〜130Wの電力モードに対応し、汎用ロボティクス・大規模エッジAI推論に最適です。開発キットは$3,499で提供されています。

-

Jetson Thor T4000(計画中)

64GB LPDDR5xメモリ、1200 FP4 TFLOPSのAI性能を持つ小型モジュールです。T5000のスケールダウン版として、より幅広い産業用途への展開が見込まれます。

Amazon Robotics、Boston Dynamics、Caterpillar、Figure、Hexagon、Medtronic、Metaといった企業がJetson Thorを早期採用しており、汎用ロボティクスの本格展開が始まっています。

ハードウェア構成比較

以下の表は、各JetsonモデルのCPUコア構成、GPUアーキテクチャ、およびCUDAコア・Tensorコアの搭載数を比較したものです。アーキテクチャ名は各Jetsonモデルが採用しているNVIDIAのGPU世代を示し、CUDAコアは画像処理や並列演算に用いる汎用計算ユニット、Tensorコアはディープラーニング推論を高速化する専用演算ユニットです。

| モデル名 | アーキテクチャ | GPU(CUDAコア / Tensorコア) | CPUコア |

|---|---|---|---|

| Jetson Nano | Maxwell | 128 / 0 | Quad-core ARM A57 1.43GHz |

| Jetson TX2 | Pascal | 256 / 0 | Dual-core Denver2 + Quad-core ARM A57 |

| Jetson Xavier NX | Volta | 384 / 48 | 6-core NVIDIA Carmel ARMv8.2 1.4GHz |

| Jetson AGX Xavier | Volta | 512 / 64 | 8-core NVIDIA Carmel ARMv8.2 2.26GHz |

| Jetson Orin Nano 4GB | Ampere | 512 / 16 | 6-core Arm Cortex-A78AE 1.5GHz |

| Jetson Orin Nano 8GB | Ampere | 1024 / 32 | 6-core Arm Cortex-A78AE 1.5GHz |

| Jetson Orin NX 8GB | Ampere | 1024 / 32 | 8-core Arm Cortex-A78AE 1.5GHz |

| Jetson Orin NX 16GB | Ampere | 1024 / 32 | 8-core Arm Cortex-A78AE 2.0GHz |

| Jetson AGX Orin 32GB | Ampere | 1792 / 56 | 12-core Arm Cortex-A78AE 2.2GHz |

| Jetson AGX Orin 64GB | Ampere | 2048 / 64 | 12-core Arm Cortex-A78AE 2.2GHz |

| Jetson AGX Thor T5000 | Blackwell | 2560 / 96 | 14-core Arm Neoverse |

Jetson NanoやTX2は入門〜産業組込み用途に広く使われており、Xavier・OrinシリーズになるとCUDA/Tensorコア数・CPUコア数ともに増強されています。最新のJetson Thorでは、2,560 CUDAコアと96基の第5世代Tensorコアにより、従来世代とは次元の異なるAI演算性能を備えています。

メモリ・AI性能・消費電力比較

各Jetsonモデルのメモリ容量、AI推論性能、および対応する動作電力(TDPモード)の比較です。メモリはモデルごとに容量や帯域幅が異なり、大規模AI処理や高解像度画像のストリーミングに影響します。AI性能はINT8 TOPS値で示す理論上の最大AI推論スループットです。

| モデル名 | メモリ | AI性能(INT8 TOPS) | 消費電力(TDPモード) |

|---|---|---|---|

| Jetson Nano | 4GB LPDDR4(25.6GB/s) | 0.472(FP16) | 5W / 10W |

| Jetson TX2 | 8GB LPDDR4(59.7GB/s) | 1.33(FP16) | 7.5W / 15W |

| Jetson Xavier NX | 8GB LPDDR4x(59.7GB/s) | 21 | 10W / 15W / 20W |

| Jetson AGX Xavier | 16GB LPDDR4x(137GB/s) | 32 | 30W / 32W |

| Jetson Orin Nano 4GB | 4GB LPDDR5(34GB/s) | 20 | 7W / 10W |

| Jetson Orin Nano 8GB | 8GB LPDDR5(68GB/s) | 40(Super: 67) | 7W / 15W |

| Jetson Orin NX 8GB | 8GB LPDDR5(68GB/s) | 70 | 10W / 15W / 20W / 40W |

| Jetson Orin NX 16GB | 16GB LPDDR5(102.4GB/s) | 100 | 10W / 15W / 25W / 40W |

| Jetson AGX Orin 32GB | 32GB LPDDR5(204.8GB/s) | 200 | 15W〜60W |

| Jetson AGX Orin 64GB | 64GB LPDDR5(204.8GB/s) | 275 | 15W〜60W |

| Jetson AGX Thor T5000 | 128GB LPDDR5x | 1035(FP4: 2070) | 40W〜130W |

Jetson Thorの1035 INT8 TOPSは、Jetson AGX Orin 64GBの275 TOPSと比較して約3.8倍の性能向上を示しています。用途やコストに応じて、Orin Nano Super($249・67 TOPS)からAGX Thor($3,499・1035 TOPS)まで、幅広い選択肢があります。

他の組み込みプラットフォームとの違い(例:Raspberry Pi + AIアクセラレータなど)

市場にはさまざまな組み込みプラットフォームが存在しますが、NVIDIA Jetsonがそれらとどのように異なり、どのような強みを持つのかを解説します。

統合されたAI処理能力

Raspberry Piのような汎用シングルボードコンピュータにUSB接続のAIアクセラレータを追加する構成と比較して、NVIDIA JetsonはNVIDIA GPUがSoCに緊密に統合されている点が大きな違いです。これにより、データ転送のボトルネックが少なく、より高いAI処理性能と効率を実現できます。

Jetsonに搭載されているGPUは、AI処理に特化したTensorコア(Voltaアーキテクチャ以降のモデル)を含むことが多く、専用設計ならではのパフォーマンスを発揮します。

ソフトウェアエコシステム

NVIDIA Jetsonの最大の強みの一つは、成熟し、広範囲にわたるソフトウェアエコシステムです。JetPack SDKには、AI推論を最適化するTensorRT、コンピュータビジョンライブラリのOpenCV、マルチメディア処理ライブラリなどが標準で含まれています。

さらに、ロボティクス開発を加速するNVIDIA Isaacプラットフォームや、インテリジェントビデオ解析(IVA)アプリケーション構築のためのDeepStream SDKなど、用途特化型の高度なSDKも利用可能です。

スケーラビリティ

NVIDIA Jetsonファミリーは、エントリーレベルのJetson Orin Nano Super($249)から、最新かつ最も強力なJetson AGX Thor($3,499)まで、幅広い性能と価格帯のラインナップを提供しています。

これにより、開発者は初期のプロトタイピングから量産製品まで、要求されるAI性能やコストに応じて最適なモジュールを選択し、ソフトウェア資産を再利用しながらシームレスにスケールアップ/ダウンすることが可能です。

産業用途への対応

Jetsonモジュールの中には、より過酷な環境での動作を想定した産業グレードの製品や、長期供給が保証されたモデルも存在します。Jetson AGX Orinは製品ライフサイクルが2030年1月まで延長されており、長期運用が求められる産業機器への採用に適しています。

これは、信頼性や製品ライフサイクル管理が重要となる産業機器や組み込みシステムへの導入において大きなメリットとなります。

NVIDIA Jetsonの使い方:開発フローとソフトウェアスタック

NVIDIA Jetsonを使ってAIアプリケーションを開発するための一般的なフローと、それを支える主要なソフトウェアコンポーネントについて解説します。

開発の始め方

Jetsonでの開発を始めるには、まずNVIDIA Jetson開発者キット(Developer Kit)を入手します。2026年3月時点で入手しやすい開発キットは以下のとおりです。

-

Jetson Orin Nano Super Developer Kit

$249で提供されるエントリーモデルです。67 TOPSのAI性能を備え、生成AIの実験やプロトタイピングに最適です。

-

Jetson AGX Thor Developer Kit

$3,499のフラッグシップモデルです。2070 FP4 TFLOPSの性能で、大規模ロボティクスやエッジAI推論サーバーの開発に対応します。

開発キットにはJetsonモジュールと、必要なインターフェースを備えたリファレンスキャリアボード、電源アダプタなどが含まれています。次に、NVIDIA SDK Managerを使用して、最新のJetPack SDKを開発キットにインストール(フラッシュ)します。SDK ManagerはホストPC(通常はUbuntu Linuxマシン)上で動作し、JetsonデバイスへのOSイメージの書き込みや各種ソフトウェアパッケージのインストールをガイドしてくれます。

NVIDIA JetPack SDK

JetPack SDKはJetson開発の基盤となるソフトウェアスイートです。2026年3月時点で、Jetson Thor向けにはJetPack 7.1(Linux Kernel 6.8 / Ubuntu 24.04 LTS)、Orinシリーズ向けにはJetPack 6.2.1が提供されています。主なコンポーネントは以下のとおりです。

-

Jetson Linux(L4T)

UbuntuベースのLinuxオペレーティングシステムで、Linuxカーネル、ブートローダー、NVIDIAドライバ、ファームウェアなどが含まれます。

-

CUDA Toolkit

NVIDIA GPU向けの並列コンピューティングプラットフォームおよびプログラミングモデルです。Jetson上でGPUアクセラレーションを利用したアプリケーションを開発するために不可欠です。

-

cuDNN

ディープニューラルネットワーク向けのGPUアクセラレーテッドライブラリです。畳み込み、プーリングなどの標準ルーチンを高速化します。

-

TensorRT

高性能ディープラーニング推論オプティマイザおよびランタイムです。

-

Vision Programming Interface(VPI)

コンピュータビジョンや画像処理アルゴリズムをGPUやPVA(Programmable Vision Accelerator)などのハードウェアアクセラレータ上で実行するためのライブラリです。

-

OpenCV

オープンソースのコンピュータビジョンライブラリです。Jetson向けに最適化されています。

-

マルチメディアAPI

ビデオのエンコード/デコード、カメラ制御などのためのライブラリ群です。

-

開発者ツール

パフォーマンス解析ツール(Nsight Systems、Nsight Graphics)、デバッガなどが含まれます。

JetPack 7では、Linuxカーネルのアップストリームサポートや、Jetson AIスタックの独立アップデートなど、モジュラー設計による柔軟性が向上しています。

コンテナ技術の活用

Jetsonプラットフォームでは、Dockerコンテナを利用したアプリケーションの開発とデプロイが推奨されています。NVIDIA Container Runtimeを使用することで、GPUリソースにアクセス可能なコンテナをJetson上で実行できます。

コンテナ化により、開発環境と実行環境の分離、依存関係の管理、アプリケーションのポータビリティと再現性が向上します。NVIDIA NGCカタログからは、最適化済みのAIモデルやフレームワークを含む多数のコンテナイメージが提供されています。

AIモデルのデプロイ

TensorFlow、PyTorch、MXNetなどの主要なディープラーニングフレームワークで学習したモデルは、ONNX(Open Neural Network Exchange)形式を経由するなどしてTensorRTに取り込み、Jetsonデバイス向けに最適化された推論エンジンとしてデプロイできます。

TAO Toolkitで作成したモデルも、TensorRTによる最適化を経てデプロイされます。

アプリケーション開発用SDK

Jetsonプラットフォームの能力を最大限に活用し、特定のアプリケーション開発を加速するために、NVIDIAは以下のような専用SDKを提供しています。

NVIDIA DeepStream SDK

ストリーミングビデオやオーディオからAIで洞察を得るための、スケーラブルなインテリジェントビデオアナリティクス(IVA)アプリケーション構築用SDKです。

複数のビデオ/センサー入力を処理し、物体検出、追跡、分類などのAIタスクを効率的に実行するパイプラインを構築できます。GStreamerフレームワークをベースにしており、C/C++やPythonで開発可能です。

NVIDIA Isaac Sim / Isaac ROS

ロボットのシミュレーション、ナビゲーション、操作のためのAIアルゴリズム開発を支援するプラットフォームです。

-

Isaac Sim

NVIDIA Omniverse上に構築されたロボティクスシミュレーションアプリケーションで、物理的に正確な仮想環境でロボットのテストや学習を行えます。

-

Isaac ROS

Jetson上でハードウェアアクセラレーションを活用したROS 2パッケージ群を提供し、ロボットの認識(Visual SLAM、深度推定など)やナビゲーション機能を強化します。

NVIDIA Jetsonの主な活用事例

NVIDIA Jetsonの強力なエッジAI処理能力は、すでにさまざまな分野で革新的な製品やソリューションを生み出しています。

自律移動ロボット(AMR)・ドローン

工場や倉庫内を自律的に移動して物品を搬送するAMR、広範囲を監視する警備ドローン、農薬散布や生育状況を監視する農業用ドローンなど、Jetsonはこれらのロボットやドローンが周囲の環境を3Dで認識し、障害物を回避しながら目的地へ移動するための「頭脳」として機能します。Amazon RoboticsやBoston DynamicsがJetson Thorを採用し、次世代の汎用ロボットの開発を進めています。

スマートシティ・インフラ

都市における交通流の解析と信号機の最適化、交差点での危険挙動の検知、公共施設やイベント会場での不審者・放置物の監視、橋梁や送電線といったインフラ設備のドローンによる自動点検など、Jetsonは都市機能の効率化と安全性の向上に貢献しています。

製造業・ファクトリーオートメーション

製造ラインにおける製品の外観検査(AOI:Automated Optical Inspection)の精度向上、製造装置の異常を予兆して通知する予知保全、ロボットアームによる複雑な組み立て作業やピッキング作業の自動化など、Jetsonはスマートファクトリーの実現を支援します。CaterpillarがJetson Thorを採用して建設機械の自律制御に活用するなど、重機分野での展開も進んでいます。

小売・サービス

カメラ映像から顧客の属性や動線を分析して店舗レイアウトを最適化する、棚の欠品を自動的に検知する、レジなし決済を実現するスマートカート、AIを活用した対話型デジタルサイネージなど、Jetsonは小売業における顧客体験の向上と業務効率化に活用されています。

ヘルスケア・医療

持ち運び可能な超音波診断装置や内視鏡システムにAI画像解析機能を組み込み、医師の診断を支援する、手術支援ロボットの精度を高める、リハビリテーションをサポートするロボットなど、Jetsonは医療現場におけるイノベーションを促進しています。MedtronicがJetson Thorを医療機器に採用しており、エッジでのリアルタイムAI診断支援が進展しています。

農業(スマートアグリ)

ドローンや地上ロボットに搭載されたJetsonが、カメラやセンサーからの情報に基づいて農作物の生育状況を詳細に把握し、病害虫を早期に発見したり、必要な場所にだけピンポイントで農薬や肥料を散布したりする精密農業を実現します。

教育・研究

Jetson開発者キットは、その手頃な価格と高い性能から、大学や研究機関におけるAI・ロボティクス分野の人材育成や、新しいアルゴリズム、革新的なアプリケーションの研究開発プラットフォームとして広く採用されています。$249のOrin Nano Super Developer Kitは、学生や個人開発者にとって特に入手しやすいエントリーポイントです。

エッジでの生成AI

最新のJetson Orin SuperシリーズおよびJetson Thorは、小規模な大規模言語モデル(LLM)や視覚言語モデル(VLM)、画像生成モデルといった生成AIタスクをエッジデバイス上で実行する能力を備えています。これにより、ネットワーク接続に依存しないインタラクティブなAI体験や、プライバシーに配慮したローカルでのコンテンツ生成が実現可能になっています。

Jetson Orin Nano Super Developer Kitは$249でエッジ生成AI開発を始められるプラットフォームとして、Jetson AGX Thorは大規模VLMのエッジ推論サーバーとして、それぞれ異なる規模の生成AI用途に対応しています。

エッジAIの理解を業務でのAI活用設計に活かす

AI業務自動化ガイド

NVIDIA Jetsonのようなエッジデバイスの進化を把握したなら、次は組織の業務プロセスにAIを組み込む設計です。AI総合研究所のAI業務自動化ガイドでは、Microsoft環境での業務AI自動化の全体像を220ページで解説しています。

エッジAIの理解を業務でのAI活用設計に活かす

NVIDIA Jetsonのエッジ処理能力とソフトウェアエコシステムを理解したなら、自社の現場業務にAIをどう組み込むかを具体的に設計できる段階です。エッジデバイスとクラウドを組み合わせたAI活用は、製造・物流・監視など多くの業種で導入が加速しています。

AI総合研究所では、Microsoft環境での業務AI自動化の全体設計をまとめた「AI業務自動化ガイド」を無料で提供しています。Jetsonで得たエッジAIの知見を、業務全体のAI活用に発展させるための220ページの実践資料です。

エッジAIの理解を業務でのAI活用設計に活かす

AI業務自動化ガイド

NVIDIA Jetsonのようなエッジデバイスの進化を把握したなら、次は組織の業務プロセスにAIを組み込む設計です。AI総合研究所のAI業務自動化ガイドでは、Microsoft環境での業務AI自動化の全体像を220ページで解説しています。

まとめ

NVIDIA Jetsonは、コンパクトなフォームファクタに強力なAI処理能力と包括的なソフトウェアエコシステムを凝縮した、エッジAIおよびロボティクス開発における最先端プラットフォームです。2025年8月にはBlackwellアーキテクチャ搭載のJetson Thorが発売され、Orin世代比7.5倍のAI演算性能により、汎用ロボティクスや大規模エッジAI推論の新たなフェーズに入りました。

用途に応じた選択基準は明確です。生成AIの実験やプロトタイピングにはOrin Nano Super Developer Kit($249・67 TOPS)、産業用AIカメラやAMRにはOrin NX/AGX Orin(70〜275 TOPS)、ヒューマノイドロボットや大規模エッジ推論サーバーにはJetson AGX Thor($3,499・1035 INT8 TOPS)が適しています。

JetPack 7のソフトウェアスタック、TensorRT、Isaac SDKといった包括的な開発環境により、プロトタイプから量産まで一貫した開発が可能です。Amazon Robotics、Boston Dynamics、Caterpillarといった企業のJetson Thor採用は、エッジAIが研究段階から本格的な産業展開のフェーズに移行したことを示しています。エッジAIの導入を検討する際には、まずOrin Nano Superで小規模な実証実験を始め、成果に応じてOrin NX/Thorへスケールアップする段階的なアプローチを推奨します。