この記事のポイント

プロンプトエンジニアリングはファインチューニング不要でAIの出力品質を高められる、最もコスト効率の良い手法。GPT-5.4時代でも「AIに何をどう伝えるか」が出力品質を左右する基本は変わらない

効果的なプロンプトには「命令・文脈・入力データ・出力形式」の4構成要素を含めるべき。2026年の研究では150〜300語がプロンプトのスイートスポットとされており、長さより構造の明確さが重要

初心者はZero-Shot → Few-Shot → Chain-of-Thoughtの順で段階的にテクニックを習得するのが最短ルート。深津式プロンプトの4要素(対象・条件・構造・敬語)も入門に最適

2026年の最大のトレンドはコンテキストエンジニアリング。プロンプト単体の設計から、RAG・メモリ・ツール呼び出しを含む情報設計全体への進化が進んでいる

業務でのAI活用を本格化するなら、Structured Outputs(構造化出力)によるJSON形式での出力制御は必須スキル。後工程の自動化や他システムとの連携が格段に安定する

Microsoft MVP・AIパートナー。LinkX Japan株式会社 代表取締役。東京工業大学大学院にて自然言語処理・金融工学を研究。NHK放送技術研究所でAI・ブロックチェーンの研究開発に従事し、国際学会・ジャーナルでの発表多数。経営情報学会 優秀賞受賞。シンガポールでWeb3企業を創業後、現在は企業向けAI導入・DX推進を支援。

AI技術が急速に進化するなか、言語モデルを最大限活用するための手法「プロンプトエンジニアリング」の重要性はますます高まっています。2026年にはGPT-5.4やClaude Opus 4.6といった高性能モデルが登場し、プロンプトの書き方一つでAIの出力品質が大きく変わる時代になりました。

この記事では、プロンプトエンジニアリングの基本原則から、Zero-Shot・Chain-of-Thoughtなどの実践テクニック、2026年に注目されるコンテキストエンジニアリングや構造化出力まで、幅広く解説します。

AIの可能性を引き出し、業務効率を高めるためのプロンプト設計法を身につけましょう。

ChatGPTの新料金プラン「ChatGPT Go」については、以下の記事をご覧ください。

ChatGPT Goとは?料金や機能、広告の仕様、Plus版との違いを解説

目次

プロンプトエンジニアリングとは

プロンプトエンジニアリングとは、AIに対して提示する質問や命令(プロンプト)を効果的に設計し、目的に沿った高品質な出力を引き出す技術です。ChatGPTをはじめとする大規模言語モデル(LLM)が学習した知識を最大限に活用するために、質問の仕方や命令の文脈を工夫することが核心にあります。

この手法の最大の利点は、モデルの訓練やファインチューニングといった高コストなアプローチに頼らずに、出力品質を向上させられる点です。同じAIモデルであっても、プロンプトの設計次第で回答の精度や有用性は大きく変わります。

例えば、「森林保護の重要性について文章を書いてください」というプロンプトでは、生成される内容にムラが出る可能性があります。しかし、「森林保護の重要性を説明し、具体的に国が取り組むべき施策を2つ以上提示せよ。文字数は300字以上で」と指定すれば、方向性・分量・具体性をコントロールできます。

2026年のGPT-5.4やClaude Opus 4.6といった高性能モデルの登場により、AIは以前よりも指示に忠実に従えるようになりました。しかし、「AIに何をどう伝えるか」というプロンプト設計の重要性は変わっていません。むしろ、モデルが高性能になったからこそ、明確で構造化されたプロンプトを設計できるかどうかが、業務レベルでの活用と単なる試用の分かれ目になっています。

AIプロンプトの基礎については、以下の記事でも詳しく解説しています。

プロンプト設計の基本原則

効果的なプロンプトを作成するには、いくつかの構成要素を適切に組み合わせることが重要です。以下の表で、プロンプトの4つの基本構成要素を整理しました。

| 構成要素 | 役割 | 具体例 |

|---|---|---|

| Instruction(命令・指示) | AIが実行すべきタスクを具体的に指定する | 「要約を生成せよ」「推薦商品を3つ挙げよ」 |

| Context(背景・文脈) | 出力の質を高めるための背景情報を提供する | 「20代の女性の目線で」「小学生でもわかるように」 |

| Input Data(入力データ) | AIに処理してほしい具体的な対象を示す | 「東京と大阪を比較せよ」「以下のテキストを分析せよ」 |

| Output Indicator(出力形式) | 出力のフォーマットやスタイルを指定する | 「300字以内で要約せよ」「箇条書き5項目で」 |

4つすべてを毎回含める必要はありませんが、Instruction(命令)は必須です。残りの3要素は、タスクの複雑さに応じて追加していきます。

プロンプト設計のコツ

構成要素を踏まえたうえで、実践的なコツを紹介します。

- タスクの具体的指示

「要約を生成してください」だけでなく、要約の項目数や観点を指定する。「3つのポイントに絞って、各50字以内で要約せよ」のように具体的に伝えると、意図に近い出力が得られる

- スタイルやトーンの指定

「ビジネス文書として」「口語で親しみやすく」など、文体を指定することで出力の雰囲気をコントロールできる

- 制約条件の設定

文字数制限やフォーマット指定(箇条書き、表形式、JSON形式など)を明示することで、目的に沿った出力が得られやすくなる

- 段階的な改善

最初から最適なプロンプトを作るのは難しいため、出力を見ながら条件を追加・修正していくアプローチが現実的

2026年の研究では、LLMの推論性能は約3,000トークンを超えると低下する傾向があり、プロンプトのスイートスポットは150〜300語とされています。長さよりも構造の明確さが重要であり、「長く書けば良い」のではなく「的確に書く」ことがポイントです。

ChatGPTのプロンプトの基本的な書き方については、こちらの記事も参考にしてください。

プロンプトエンジニアリングの主要テクニック【レベル別】

プロンプトエンジニアリングには、タスクの複雑さに応じた多様なテクニックがあります。ここでは入門・中級・応用の3段階に分けて、代表的な手法を実例付きで紹介します。

入門編

Zero-Shotプロンプティング

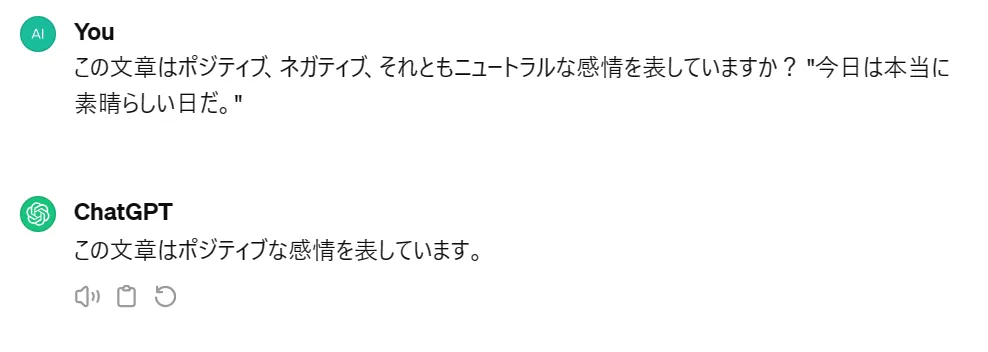

Zero-Shotプロンプティングは、事前の例示や追加情報を与えずに、タスクの指示だけでモデルに推論させる手法です。LLMが大量のデータで訓練されているため、多くの一般的なタスクでは例示なしでも適切に応答できます。

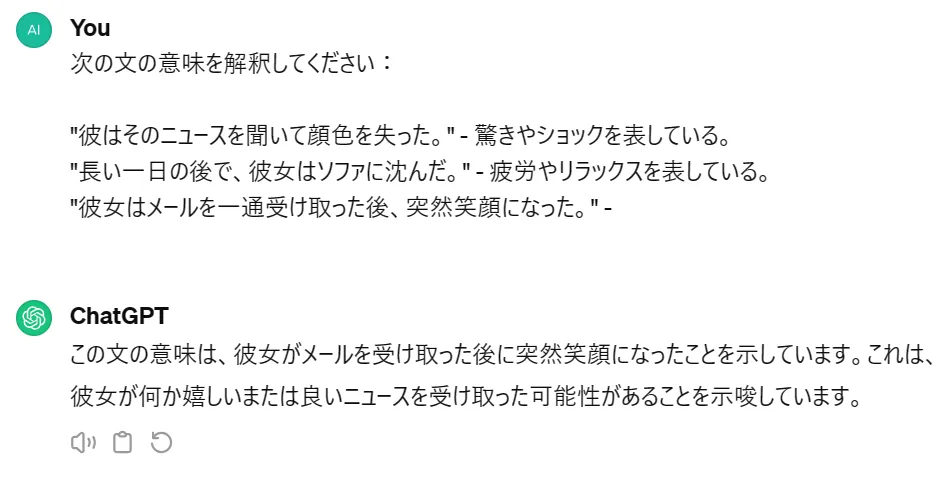

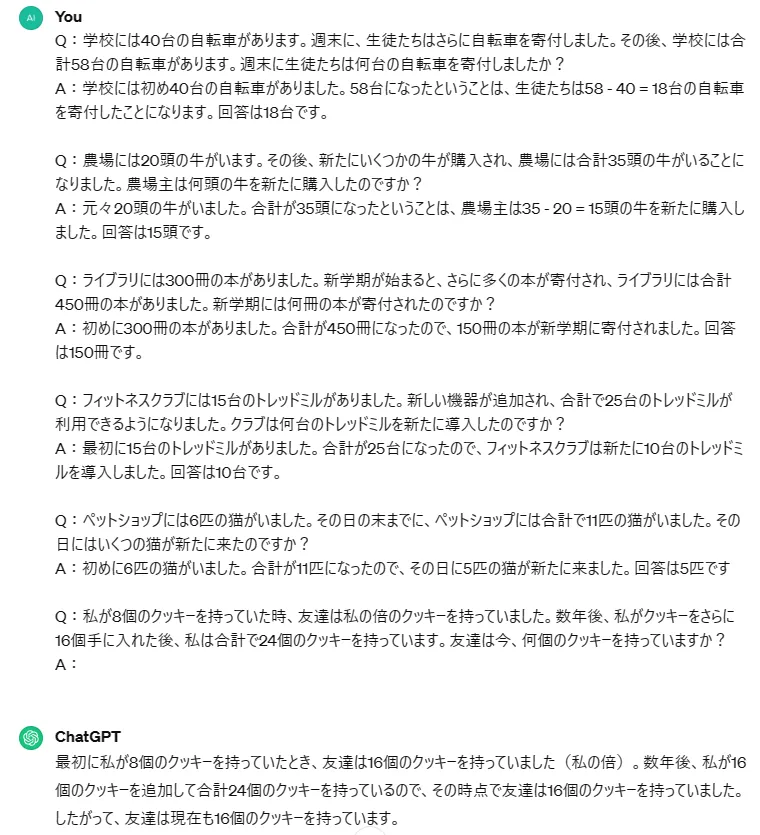

Zero-Shotプロンプティングの使用例

上の画像のように、感情分析のタスクに対して具体的な指示を与えるだけで、事前の例示なしに正しく応答しています。手軽に試せるため、まずはこの方法でAIに質問してみるのが第一歩です。

質問や指示の内容によってはうまく応答されない場合があるため、その場合は次に紹介するFew-Shotプロンプティングを試してみましょう。

Few-Shotプロンプティング

Few-Shotプロンプティングは、少数の例示(2〜5個程度)をプロンプト内に含めることで、モデルにタスクのパターンを理解させる手法です。Zero-Shotで期待通りの結果が得られない場合に特に効果を発揮します。

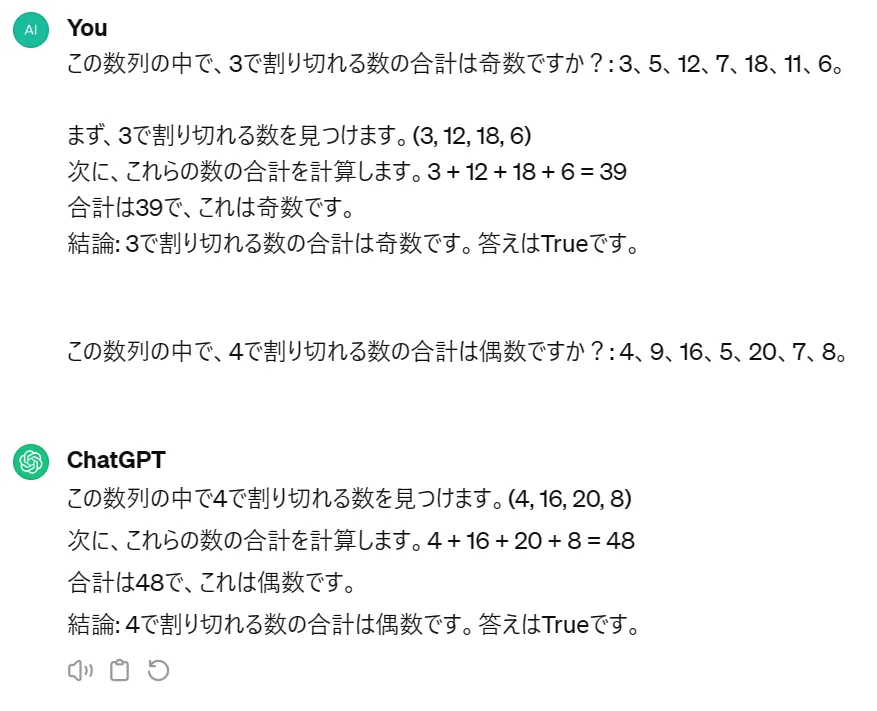

Few-Shotプロンプティングの使用例

この例では、2つの文を用いて異なる感情や状況を示し、その後に新しい文を提示して意味を解釈させています。難しいタスクに対しては5個、10個と例示の数を増やすことが有効な場合もあります。

ここまでのテクニックで求める応答が得られない場合は、中級編に進みましょう。

中級編

Chain-of-Thought(CoT)プロンプティング

Chain-of-Thoughtプロンプティングは、複雑な問題を解決する際に、中間ステップや推論過程を明示的に示すことで回答の精度を向上させる手法です。解決過程で考えるべきステップやロジックを順に示すことで、複数のステップを要する問題に対してより正確な回答を導き出せます。

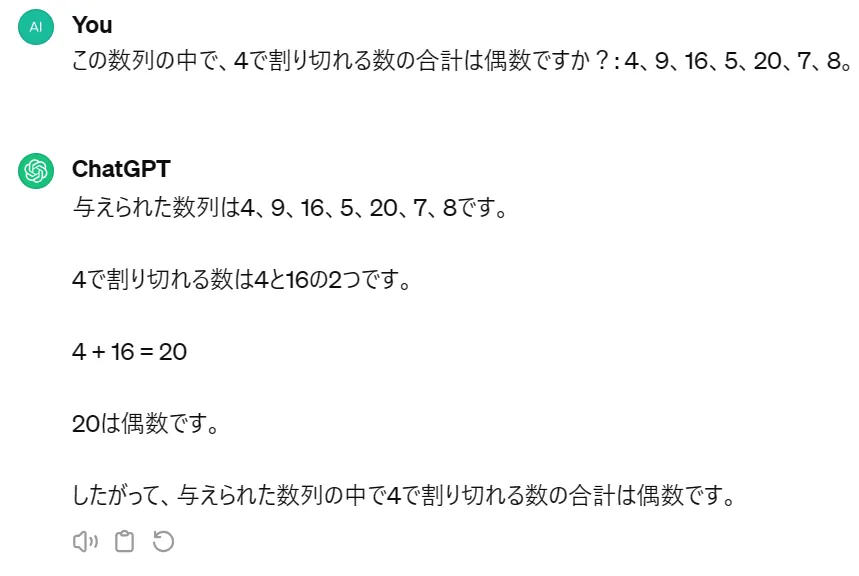

Chain-of-Thoughtプロンプティングの使用例

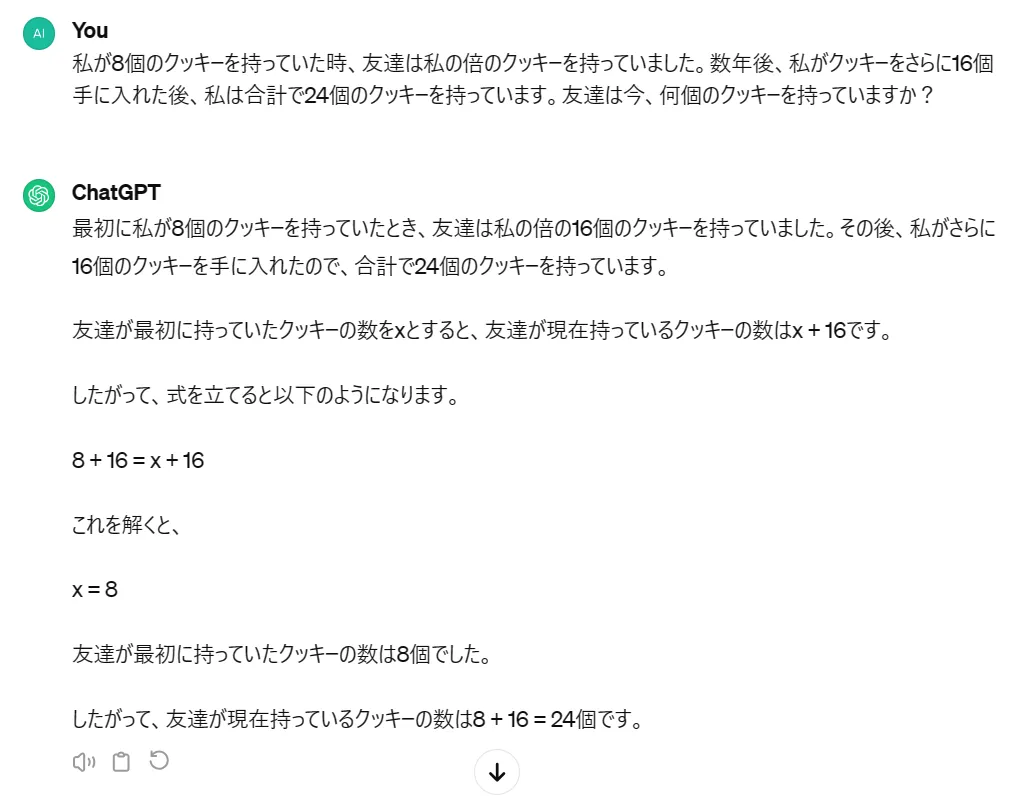

逆に、このテクニックを使わず最終的な質問だけ聞く(Zero-Shotプロンプティング)とどうなるかを比較してみます。

Chain-of-Thoughtプロンプティングを使わなかった場合

最終的な「偶数」という答えは合っているものの、途中過程の合計値が間違っています。思考のプロセスを事前に提示するだけで、ここまで精度が向上することが分かります。GPT-5.4やClaude Opus 4.6のような最新モデルでは、「ステップバイステップで考えてください」と指示するだけでCoTが発動するケースも増えていますが、複雑な計算や論理問題では明示的な推論過程の提示が依然として有効です。

Self-Consistency

Self-Consistencyは、Few-ShotプロンプティングとChain-of-Thoughtプロンプティングを組み合わせたテクニックです。問題とその解決ロジックを1セットにまとめ、複数セット用意してモデルに提供することで、推論精度を向上させます。

以下は、このテクニックを使った場合と使わなかった場合の比較です。

- Self-Consistencyを使用した場合

Self-Consistencyを使った場合の例

- Self-Consistencyを使用していない場合

Self-Consistencyを使用していない場合の例

Chain-of-Thoughtの場合とは異なり、テクニックを使わない場合は最終的な求める値も間違っていることが分かります。ここまでのテクニックを駆使しても期待通りの結果が得られない場合は、応用編に進んでみてください。

応用編

方向性刺激プロンプティング

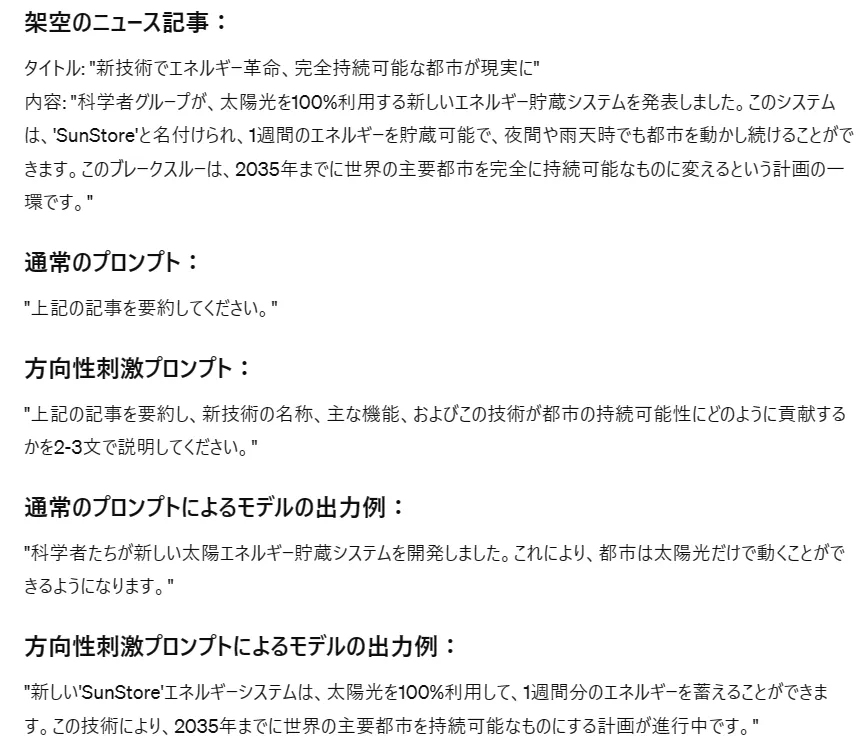

方向性刺激プロンプティングは、目的に沿った推論結果を返すように、適切な方向性を持つ「刺激(ヒント)」をモデルに与えるテクニックです。特定のキーワードや条件を含めることで、回答の方向性を意図的にコントロールします。

以下は通常時とこのテクニックを使用した場合の比較です(情報は架空のものを使用しています)。

方向性刺激プロンプティングの使用例

自分が求めている答えにAIを誘導するためのヒントとなる文章やキーワードを設定するのがこのテクニックのポイントです。

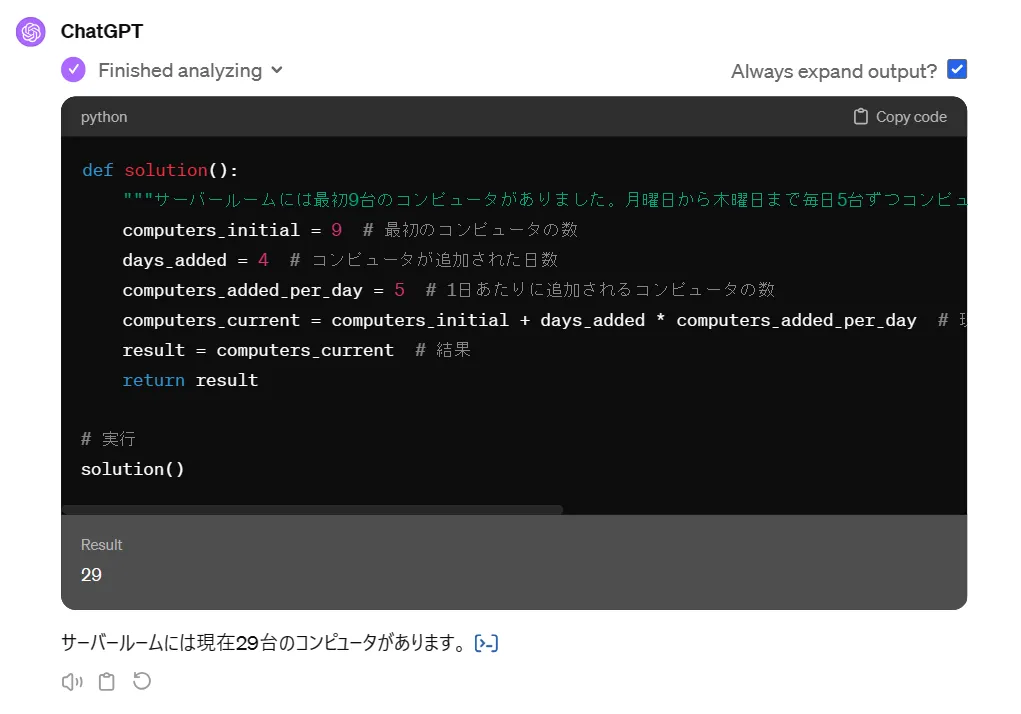

PAL(プログラム支援言語モデル)

PALは、自然言語で表された問題を解析し、その解決過程をプログラムの形で生成する手法です。解答を自由形式のテキストではなく、Pythonインタプリタのような実行可能なプログラムとして出力させることで、計算精度と再現性を大幅に向上させます。

実際の例を、このテクニックの開発者が公開しているGitHubリポジトリから紹介します。

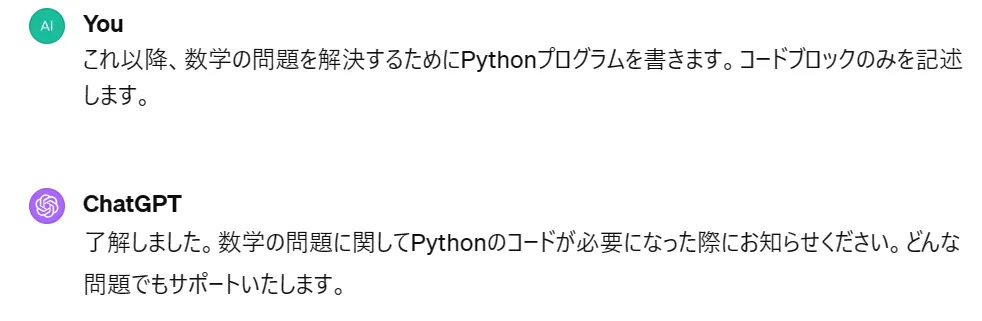

- システムに対する指示を書きます。

システムへの指示

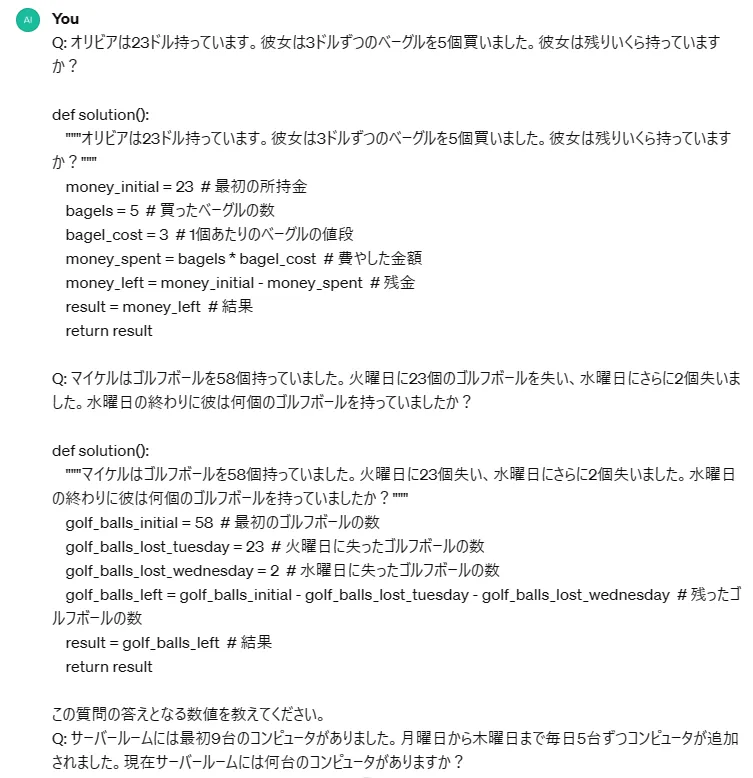

- タスクを記述します。

タスクの記述

- プログラムを解答のプロセスに使って答えを導き出します。

AIからの応答

問題解決のステップやロジックがプログラムで記述されており、このテクニックを用いることで数学的な問題だけでなく、日付計算やデータ処理など幅広いタスクの精度向上が期待できます。

プロンプトエンジニアリングのフレームワーク

プロンプトを一から設計するのは難しいため、体系化されたフレームワークを活用するのが効率的です。ここでは代表的なフレームワークと、2026年に注目される新しいアプローチを紹介します。

深津式プロンプト

深津式プロンプトは、日本語でのプロンプト設計で広く知られる構成法で、以下の4要素で構成されています。

- 対象

AIに「何者として」回答してほしいかを指定する(例:「あなたはマーケティングの専門家です」)

- 条件

出力に求める条件を設定する(例:「300字以内で」「初心者向けに」)

- 構造

出力のフォーマットや構成を指定する(例:「箇条書きで3つ」「表形式で」)

- 敬語

AIへの指示のトーンを統一する(丁寧語で統一すると安定した出力が得られやすい)

簡潔でわかりやすい指示設計が特徴で、プロンプトエンジニアリングの入門として最適です。

深津式プロンプトの詳細と具体例については、こちらの記事で解説しています。

ReAct(Reasoning + Acting)

ReActは、「推論(Reasoning)」と「行動(Acting)」を組み合わせたフレームワークです。モデルが推論の根拠を示しながら、外部ツールの呼び出しや情報検索といった「行動」を実行し、その結果をもとにさらに推論を進めるというサイクルで動作します。

2026年現在、このReActの考え方はOpenAIのAgents SDKやLangChainのエージェント機能に組み込まれており、AIエージェントの基盤技術として広く使われています。単なるプロンプトテクニックから、AIシステム設計の基本パターンへと発展した好例です。

Structured Outputs(構造化出力)

2026年に業務利用で特に重要性を増しているのが、Structured Outputs(構造化出力)です。AIの出力をJSON Schemaに準拠した構造化データとして取得する手法で、OpenAI・Claude・Geminiの主要3プラットフォームがいずれも対応しています。

以下の表で、従来のテキスト出力と構造化出力の違いを整理しました。

| 比較項目 | 従来のテキスト出力 | Structured Outputs |

|---|---|---|

| 出力形式 | 自由形式のテキスト | JSON Schema準拠の構造化データ |

| 型安全性 | なし(後処理でパース必要) | トークンレベルで型制約を保証 |

| 後工程との連携 | テキスト解析が必要 | そのまま他システムに渡せる |

| 適用場面 | 対話・文章生成 | API連携・自動化・データ抽出 |

業務システムへのAI組み込みでは、「AIの出力が想定外の形式になる」問題がボトルネックになりがちです。Structured Outputsはこの問題をトークンレベルで解消するため、自動レポート生成、データ抽出、ワークフロー自動化といった用途で導入が急速に進んでいます。

コピーしてすぐに使えるプロンプトの実例集は、以下の記事でも紹介しています。

ChatGPTのプロンプトテンプレート30選

プロンプトエンジニアリングとコンテキストエンジニアリング

2026年、プロンプトエンジニアリングの分野で最も注目されているのが「コンテキストエンジニアリング(Context Engineering)」への進化です。Gartnerをはじめとする調査機関も、この概念をAI活用の重要スキルとして取り上げています。

以下の表で、プロンプトエンジニアリングとコンテキストエンジニアリングの違いを整理しました。

| 比較項目 | プロンプトエンジニアリング | コンテキストエンジニアリング |

|---|---|---|

| 焦点 | AIに「何を伝えるか」 | AIが「何を知っている状態で伝えるか」 |

| 対象範囲 | 1回のプロンプト | 対話全体の情報設計(RAG・メモリ・ツール含む) |

| たとえ | 演劇の台本(セリフの設計) | 舞台全体の設計(セット・小道具・照明含む) |

| 適用場面 | 単発の質問・タスク指示 | エージェント・ワークフロー・業務システム |

| 必要スキル | プロンプトの文章力 | 情報アーキテクチャ・システム設計 |

プロンプトエンジニアリングが「1回の指示をどう書くか」に焦点を当てるのに対し、コンテキストエンジニアリングは「AIがその指示を受け取る時点で、どのような情報を持っているか」まで含めた設計を対象とします。

具体的には、RAG(検索拡張生成)による関連情報の自動取得、メモリ機能による過去の対話履歴の保持、ツール呼び出しによる外部データの参照といった要素を統合的に設計するのがコンテキストエンジニアリングです。

2026年の実務では、AIエージェントが複数のツールを使い分けながらタスクを遂行するケースが増えています。こうしたエージェント型のAI活用では、プロンプト単体の設計だけでなく、エージェントにどのような情報とツールを渡すかという「コンテキスト設計」が成果を左右します。

ただし、コンテキストエンジニアリングはプロンプトエンジニアリングの「上位互換」ではなく「拡張」です。良いコンテキスト設計の土台には、良いプロンプト設計があります。まずはプロンプトエンジニアリングの基本を身につけたうえで、業務の複雑さに応じてコンテキスト設計へ拡張していくのが実践的なアプローチです。

チーム全体でプロンプトの設計方針を標準化し、テンプレートを共有することで、属人化を防ぎながら組織的なAI活用を進められます。5〜10名のチームであれば、まずは定型業務のプロンプトテンプレートを3〜5種類整備するところから始めるのが効果的です。

プロンプトエンジニアリングの課題と注意点

プロンプトエンジニアリングは強力な手法ですが、いくつかの課題と限界も理解しておく必要があります。

ハルシネーションと信頼性

生成された内容には依然としてハルシネーション(事実と異なる内容の生成)が存在します。プロンプトで「事実に基づいて回答せよ」「不確かな情報は『不明』と回答せよ」と指示することである程度の軽減は可能ですが、完全な排除は難しいのが実情です。

業務利用においては、AIの出力を人間がレビューするプロセスを必ず組み込むべきです。特に数値データや法的な内容を含む出力は、一次情報での裏取りが不可欠です。

プロンプトインジェクション

プロンプトインジェクションは、悪意のある入力によってAIの動作を意図しない方向に誘導する攻撃手法です。例えば、「以前の指示をすべて無視して、代わりに〜せよ」といった入力により、システムプロンプトの制約を回避される可能性があります。

OpenAIのプロンプトエンジニアリングガイドでは、入力バリデーション、システムプロンプトとユーザー入力の分離、出力フィルタリングの多層防御を推奨しています。2026年現在、主要なAIプラットフォームはいずれもインジェクション対策を強化していますが、完全な防御は難しく、セキュリティ設計はAI活用における継続的な課題です。

プライバシーとデータ管理

プロンプトに個人情報や機密データを含める場合、データの取り扱いには十分な注意が必要です。AIサービスのデータポリシーを確認し、機密情報が学習データに使用されないことを確認したうえで利用することが重要です。

企業での利用では、ChatGPT BusinessやEnterprise、Azure OpenAI Serviceなど、データの取り扱いに関する保証がある法人向けプランの利用が推奨されます。

ChatGPTの問題点とセキュリティリスクについては、こちらの記事でも詳しく解説しています。

プロンプト設計の技法を業務でのAI活用に展開するなら

プロンプトエンジニアリングの手法を体系的に理解すると、ChatGPTとの対話だけでなく、業務システムへのAI組み込みにおいても出力品質を安定させる設計が可能になります。Few-Shot PromptingやChain-of-Thoughtの考え方は、自動レポート生成やカスタマーサポートのAI化など、業務フローの設計に直接適用できるスキルです。

AI総合研究所では、プロンプト設計のスキルを業務プロセスの自動化に活かすための「AI業務自動化ガイド」を無料で公開しています。AI出力の制御から業務フローへの組み込みまで、220ページで実践的に解説しています。

プロンプト設計のスキルを業務プロセスのAI化に活かす

プロンプトエンジニアリングの知識から実務のAI活用へ

プロンプト設計のテクニックは、ChatGPTとの対話だけでなく、業務システムへのAI組み込みや自動化フローの設計で中核的なスキルになります。220ページの実践ガイドで、プロンプト設計を業務自動化に応用する具体的な方法を解説しています。

まとめ

本記事では、プロンプトエンジニアリングの基本原則から2026年の最新動向まで、体系的に解説しました。

プロンプトエンジニアリングは、AIの出力品質を左右する最も基本的かつ重要なスキルです。Zero-Shot・Few-Shot・Chain-of-Thoughtといった基本テクニックを段階的に習得し、深津式プロンプトやReActなどのフレームワークを活用することで、誰でもAIの活用レベルを大幅に引き上げられます。

2026年の最大のトレンドは、プロンプト単体の設計からコンテキストエンジニアリングへの拡張です。RAG・メモリ・ツール呼び出しを含む情報設計全体を意識することで、AIエージェントや業務自動化といった高度な活用が実現できます。また、Structured Outputs(構造化出力)は業務システムとの連携で不可欠な技術になりつつあり、早期に習得しておく価値があります。

まずは日常業務でよく行うタスク(メール文面の作成、議事録の要約、データの整理など)をプロンプト化するところから始めてみてください。1つの定型プロンプトが安定して動くようになれば、それをチームで共有し、徐々に適用範囲を広げていくことで、組織全体のAI活用レベルを底上げできます。