この記事のポイント

ワークフローの柔軟性と最新モデル対応を重視するなら、ComfyUIが画像生成ツールの第一候補

Desktop版のワンクリックインストールで導入の敷居が下がり、初心者でもすぐに始められる環境が整っている

VRAM 8GB以上のGPUがあればGGUF量子化で実用的に動作するため、高額なハードウェア投資は不要

AMD GPU(ROCm)やApple Siliconにも対応しており、NVIDIA以外の環境でも選択肢になる

商用利用はGPL v3で可能だが、使用モデルごとにライセンスが異なるため個別確認を怠るべきではない

Microsoft MVP・AIパートナー。LinkX Japan株式会社 代表取締役。東京工業大学大学院にて自然言語処理・金融工学を研究。NHK放送技術研究所でAI・ブロックチェーンの研究開発に従事し、国際学会・ジャーナルでの発表多数。経営情報学会 優秀賞受賞。シンガポールでWeb3企業を創業後、現在は企業向けAI導入・DX推進を支援。

AI画像生成の需要が急速に高まる中、ノードベースの直感的なインターフェースで注目を集めているのがComfyUIです。

2026年2月現在、ComfyUIはDesktop版の正式リリースやAMD GPU対応を経て、画像生成だけでなく動画・音声生成にも対応する統合的なAI生成プラットフォームへと進化しています。

Flux.1やFlux.2をはじめ、WAN 2.1/2.2やLTX-2などの最新モデルにいち早く対応し、ワンクリックでインストールできるDesktop版も一般公開されています。

本記事では、ComfyUIの基本概念からDesktop版のインストール、テキストから画像生成(txt2img)や画像から画像生成(img2img)といった実践的な使い方、さらに拡張機能や商用利用まで、わかりやすく解説します。

ComfyUIとは

ComfyUI(コンフィユーアイ)は、Stable DiffusionやFlux.1をはじめとするAI生成モデルを操作するための、ノードベースのオープンソースUIです。Comfy Orgが開発・メンテナンスしており、2026年2月時点の最新バージョンはv0.14.2です。

ComfyUIの最大の特徴は、画像生成のプロセスをノード(処理単位)を線でつなぐ視覚的なワークフローとして構築できる点にあります。これにより、テキストから画像への変換(txt2img)はもちろん、画像変換(img2img)、動画生成、さらには音声生成まで、複雑なAI生成パイプラインを直感的に設計・管理できます。

2026年現在、ComfyUIは単なる画像生成ツールを超え、画像・動画・音声を横断する統合的なAI生成プラットフォームへと進化しています。Desktop版の正式リリース、AMD GPU対応、ブラウザベースのComfy Cloudなど、利用の敷居も大幅に下がっています。

ComfyUI Desktop V1(正式リリース済み)

2024年10月にアナウンスされたComfyUI V1は、現在正式に一般公開されています。Desktop版はワンクリックでインストールでき、Python/Gitの知識なしでComfyUIを利用開始できます。公式サイトからWindows版・macOS版(Apple Silicon対応)をダウンロードできます。

ComfyUI V1の主な特徴は以下の通りです。

新しいユーザーインターフェース

UIが一新され、より使いやすくなりました。

ComfyUI V1のUI

新しいUIには、以下のような特徴があります。

| 機能 | 説明 |

|---|---|

| トップメニューバー | 多くの操作をメニューバーに統合、カスタムメニュー追加が容易 |

| モデルやログへの簡単アクセス | トレイアイコン右クリックで迅速にアクセス |

| モデルライブラリ | モデルのブラウズとドラッグ&ドロップが可能 |

| ワークフローブラウザ | ワークフローの保存・管理が簡単に |

| 自動モデルダウンロード | 不足しているモデルの自動ダウンロード機能 |

完全にパッケージ化されたデスクトップバージョン

ComfyUIのデスクトップバージョンがリリースされます。このデスクトップバージョンには、以下のような特徴があります。

| 機能 | 説明 |

|---|---|

| コード署名とセキュリティ | ComfyUIはセキュリティ警告なしで起動し、コード署名済み |

| クロスプラットフォーム | Windows、macOS、Linux対応 |

| 自動更新 | 常に最新バージョンに自動更新 |

| 軽量パッケージ | 200MBの小サイズ |

| 推奨Python環境同梱 | 簡単インストール |

| ComfyUIマネージャー搭載 | 最新ノードを簡単インストール |

| タブ機能 | 複数ワークフロー管理 |

| カスタムキーバインド | 自由に設定可能 |

| リソース自動インポート | 既存データを自動インポート |

| 統合ログビューア | デバッグ用ログ表示 |

Desktop版のソースコードもオープンソース化されており、GitHubで公開されています。公式のアナウンスについてはComfy Orgブログをご覧ください。

ComfyUIの主要機能

ComfyUIは2026年2月時点で、画像生成にとどまらない多彩な機能を提供しています。以下に主要な機能を整理しました。

ComfyUIの主要機能

ComfyUIのノードベースワークフロー

ComfyUIは、ノードベースのインターフェースを採用しており、ユーザーは視覚的にワークフローを構築できます。各処理ステップ(モデル読み込み、テキストエンコード、サンプリング、デコードなど)をノードとして配置し、線でつなぐことで、複雑な生成パイプラインを直感的に設計・管理できます。

ComfyUIの対応モデルと生成機能

2026年2月現在、ComfyUIは以下のように幅広いモデルとメディアタイプに対応しています。

-

画像生成モデル

Stable Diffusion(SD1.x / SD2.x / SDXL / SD3 / SD3.5)、Flux.1 / Flux.2、AuraFlow、HunyuanDiTなど

-

動画生成モデル

WAN 2.1 / WAN 2.2(テキスト→動画、画像→動画)、LTX-2(動画+音声同時生成、最大4K/50fps)、Hunyuan Video、Stable Video Diffusionなど

-

GGUF/FP8量子化

大型モデルを量子化することで、VRAM 8GBのGPUでもFlux.1などの高性能モデルを利用可能です。

モデルはCivitaiやHugging Faceからダウンロードして利用できます。LoRAを組み合わせたスタイル制御にも対応しています。

ComfyUIの動作環境

ComfyUIを利用するには、以下の環境が必要です。

| 項目 | 推奨環境 |

|---|---|

| GPU(NVIDIA) | VRAM 8GB以上(CUDA対応)。12GB以上推奨 |

| GPU(AMD) | ROCm 7.1.1対応。v0.7.0で公式統合(Windowsも対応) |

| GPU(Apple Silicon) | M1以降のMacで動作(Desktop版対応) |

| OS | Windows 10以降、macOS(Apple Silicon)、Linux |

| メモリ | 16GB以上推奨 |

ここで注目すべきは、2026年1月のv0.7.0アップデートでAMD GPU(ROCm)が公式に統合された点です。AMD公式ブログによると、SDXL 2.6倍高速、Flux.1で5.2倍高速など、大幅なパフォーマンス向上が報告されています。

GPUの選び方について詳しくは、以下の記事も参考にしてください。

【関連記事】

➡️【2025年版】Stable Diffusionにおすすめのグラフィックボードを解説!

ComfyUI Managerとカスタムノード

ComfyUI Managerは、カスタムノード(拡張機能)のインストール・更新・管理を行うツールです。2026年現在、Comfy Org公式に統合され、Desktop版には標準搭載されています。

主な機能は以下の通りです。

- ワンクリックでのカスタムノードインストール

- 不足しているカスタムノードの自動検出と一括インストール

- カスタムノード間の競合検出

- セキュリティスキャン機能

Desktop版以外の環境(CLIインストール)でManagerを使用する方法は、後述の「拡張機能」セクションで解説します。

ComfyUIのComfy Cloud(ブラウザ版)

GPUを持っていないユーザー向けに、Comfy Cloudというブラウザベースのサービスも提供されています。月額$20のサブスクリプションで、400以上のオープンソースモデルがプリインストールされた環境をブラウザだけで利用できます。

ローカルGPUを持たない方や、チームで共有して利用したい場合に有効な選択肢です。詳細はComfy Org公式ブログをご確認ください。

ComfyUIのその他の機能

-

リアルタイムプレビュー

操作内容をリアルタイムでプレビューでき、生成結果を確認しながら効率的に作業を進められます。

-

テンプレートライブラリ

Flux Text-to-Imageなどのプリセットワークフローが用意されており、初心者でもすぐに画像生成を始められます。不足しているモデルは自動でダウンロードされます。

-

日本語対応

UIの日本語表示に対応しており、設定から言語を切り替えられます。

ComfyUIの使い方

それでは、ComfyUIの実際の使い方についてご紹介します。まずは導入方法から解説し、その後に基本的な画像生成の手順を紹介します。

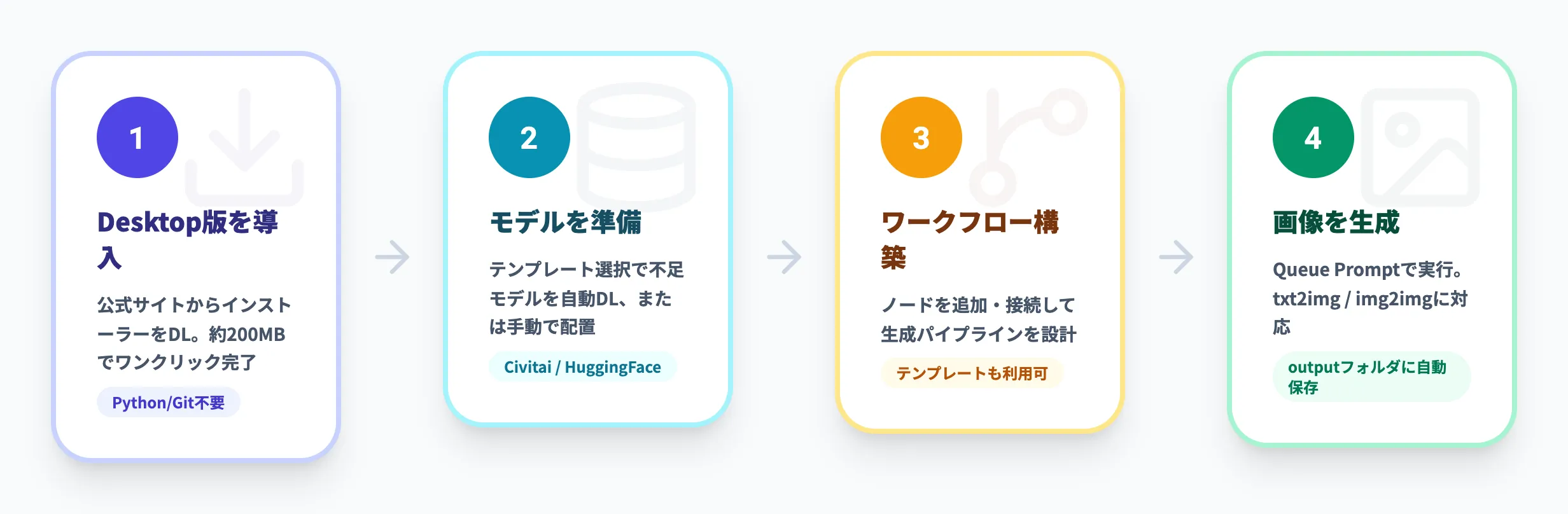

ComfyUIの導入方法(Desktop版・推奨)

2026年現在、ComfyUIの導入はDesktop版のインストールが最も簡単で推奨されています。Python/Gitの知識は不要で、以下の3ステップで利用を開始できます。

-

ComfyUI公式サイトにアクセスし、お使いのOS(Windows / macOS)に合ったインストーラーをダウンロードします。インストーラーのサイズは約200MBです。

-

ダウンロードしたインストーラーを実行します。NVIDIA GPUの場合はCUDA、AMD GPUの場合はROCmが自動で選択されます。

-

インストールが完了すると、ComfyUIが起動します。ComfyUI Managerも標準搭載されているため、カスタムノードのインストールもすぐに行えます。テンプレートライブラリからワークフローを選択すれば、不足しているモデルも自動でダウンロードされます。

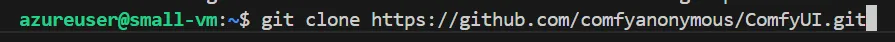

ComfyUIの導入方法(CLIインストール・サーバー向け)

ここでは、Azureの仮想マシン(Linux)上でComfyUIをCLIからインストールする手順をご紹介します。Desktop版が利用できないサーバー環境や、リモートアクセスで利用したい場合に適しています。

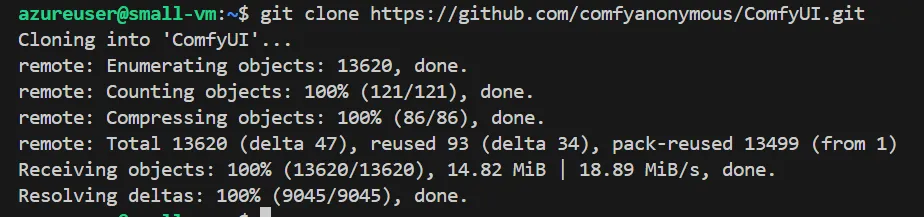

ComfyUIのリポジトリをクローン

まずは、ComfyUIのリポジトリをクローンしていきます。仮想マシンのターミナルを開き、以下のコマンドを実行して下さい。

git clone https://github.com/Comfy-Org/ComfyUI.git

クローンのコマンド入力

すると、以下のようにリポジトリがインストールされます。

ComfyUIリポジトリのインストール完了画面

ComfyUIリポジトリのインストール完了画面

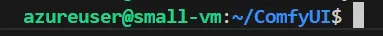

以下のコマンドで、ComfyUIのディレクトリに移動しておきます。

cd ComfyUI

ComfyUIディレクトリへの移動

ComfyUIディレクトリへの移動

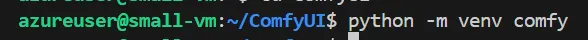

仮想環境の立ち上げ

仮想環境を使用することで、ComfyUI専用の環境を作成し、他のPythonプロジェクトとの依存関係の競合を防ぐことができます。また、問題が発生した場合も環境を簡単にリセットできます。

ComfyUIを動作させるツールをPythonの仮想環境内にインストールし、それを用いてComfyUIを起動させます。

まずは、以下のコマンドを用いて、「comfy」という名前のComfyUI用の仮想環境を作成します。

python -m venv comfy

仮想環境の作成画面

仮想環境の作成画面

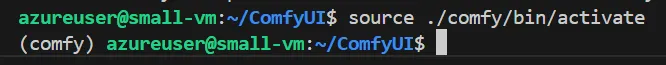

次に以下を実行し、今作成した仮想環境をアクティベートして下さい。

source ./comfy/bin/activate

仮想環境のアクティベート

仮想環境のアクティベート

ツールのインストール

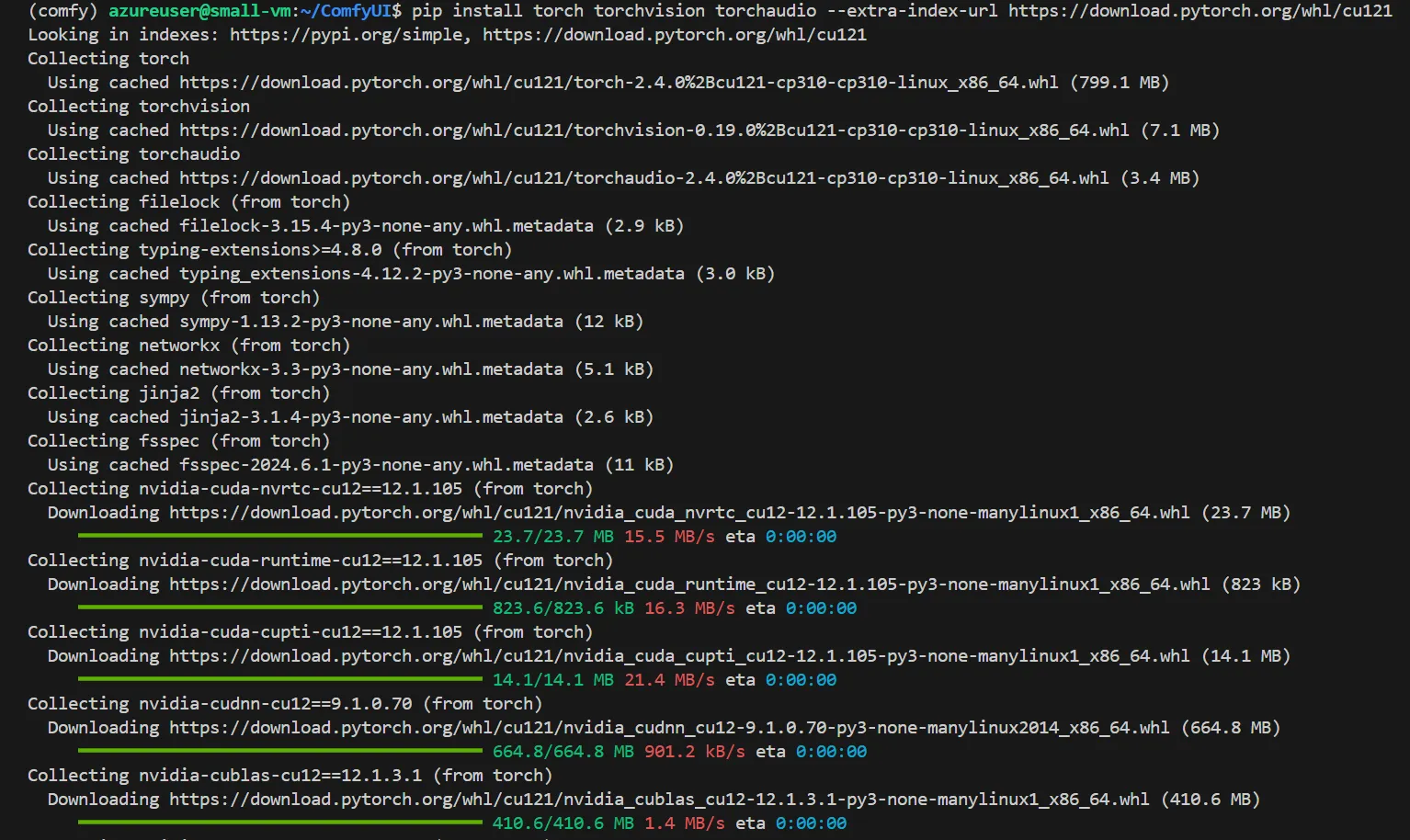

仮想環境内でTorchをインストールします。以下を実行して下さい。

pip install torch torchvision torchaudio --extra-index-url https://download.pytorch.org/whl/cu121

ツールインストールコマンドの入力

ツールインストールコマンドの入力

以下のようにインストールが進んで行きます。

ツールインストール中の画面

ツールインストール中の画面

最終的に下記のような表示されたら、インストールは完了です。

ツールインストール完了画面

ツールインストール完了画面

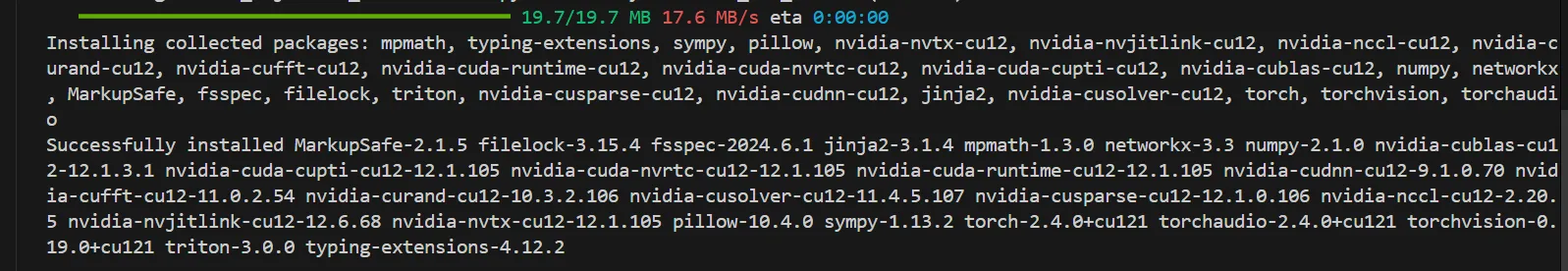

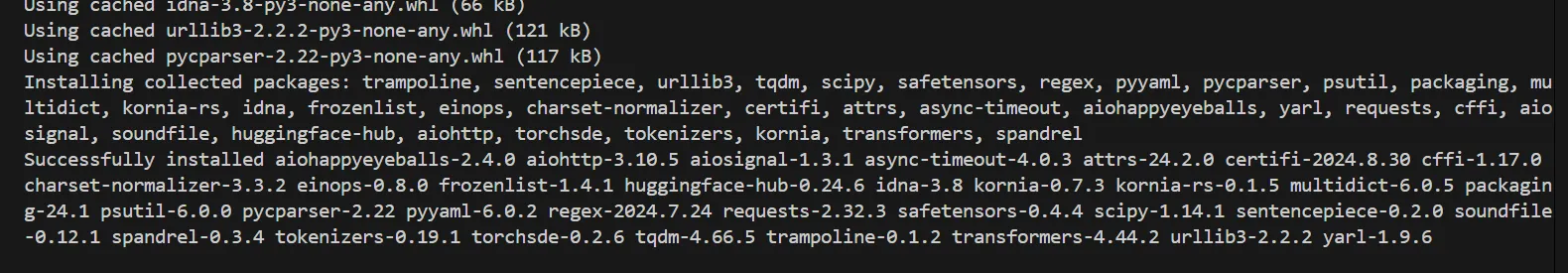

次に、必要な依存関係をインストールします。

下記のコマンドを実行して下さい。

pip install -r requirements.txt

依存関係インストールのコマンド入力

依存関係インストールのコマンド入力

以下のような表示が出てきたら、依存関係のインストールが完了です。

依存関係インストールの完了画面

依存関係インストールの完了画面

起動方法の選択

今回は、仮想マシンでComfyUIを起動します。

仮想マシンの性質上、ComfyUIにアクセスする方法は以下の2種類に分けられます。

選択した方の項目をご覧下さい。

ComfyUIを公開して様々なデバイスからアクセスする

ComfyUIを外部からアクセスできるようにするには、起動時に**--listenフラグ**を付けるだけで対応できます。

VMのバーチャルデスクトップで起動

バーチャルデスクトップを使う場合は、フラグなしで起動して大丈夫です。

ComfyUIの起動

それでは、ComfyUIを起動してみましょう。

外部からアクセスする場合は、以下のコマンドを実行してください。

python main.py --listen 0.0.0.0

バーチャルデスクトップで起動する場合は、以下のコマンドを実行してください。

python main.py

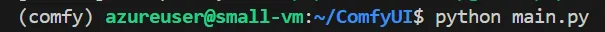

ComfyUIの起動コマンドの入力

ComfyUIの起動コマンドの入力

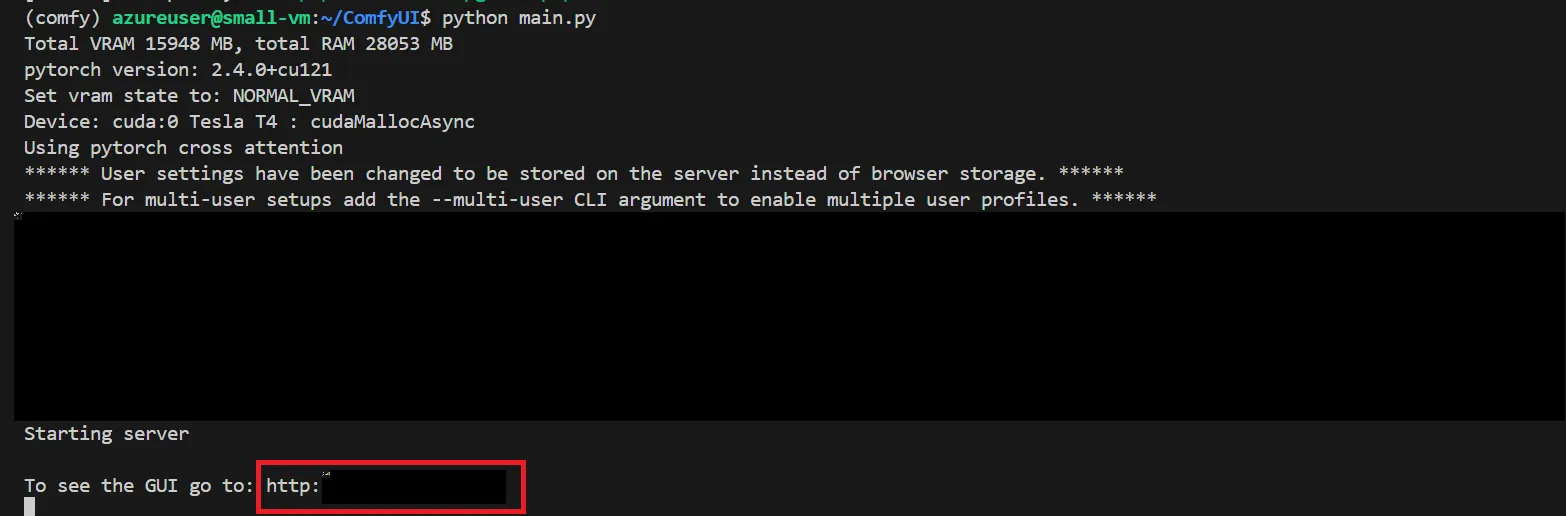

以下のように出力されます、一番下に表示されている赤枠で囲んだURLを控えて下さい。

ComfyUIの起動完了

ComfyUIの起動完了

VMのバーチャルデスクトップで起動する方は、バーチャルデスクトップ上で、控えたURLにアクセスすることで、ComfyUIを開くことが出来ます。

ComfyUIを公開して様々なデバイスからアクセスする方は、控えたURLが「http://〇:△」のような形になっていると思います。〇部分を仮想マシンのパブリックIPアドレスに変更し、それを検索バーに入力することで、ComfyUIへとアクセスすることが出来ます。

「http:// {パブリックIPアドレス}:△」

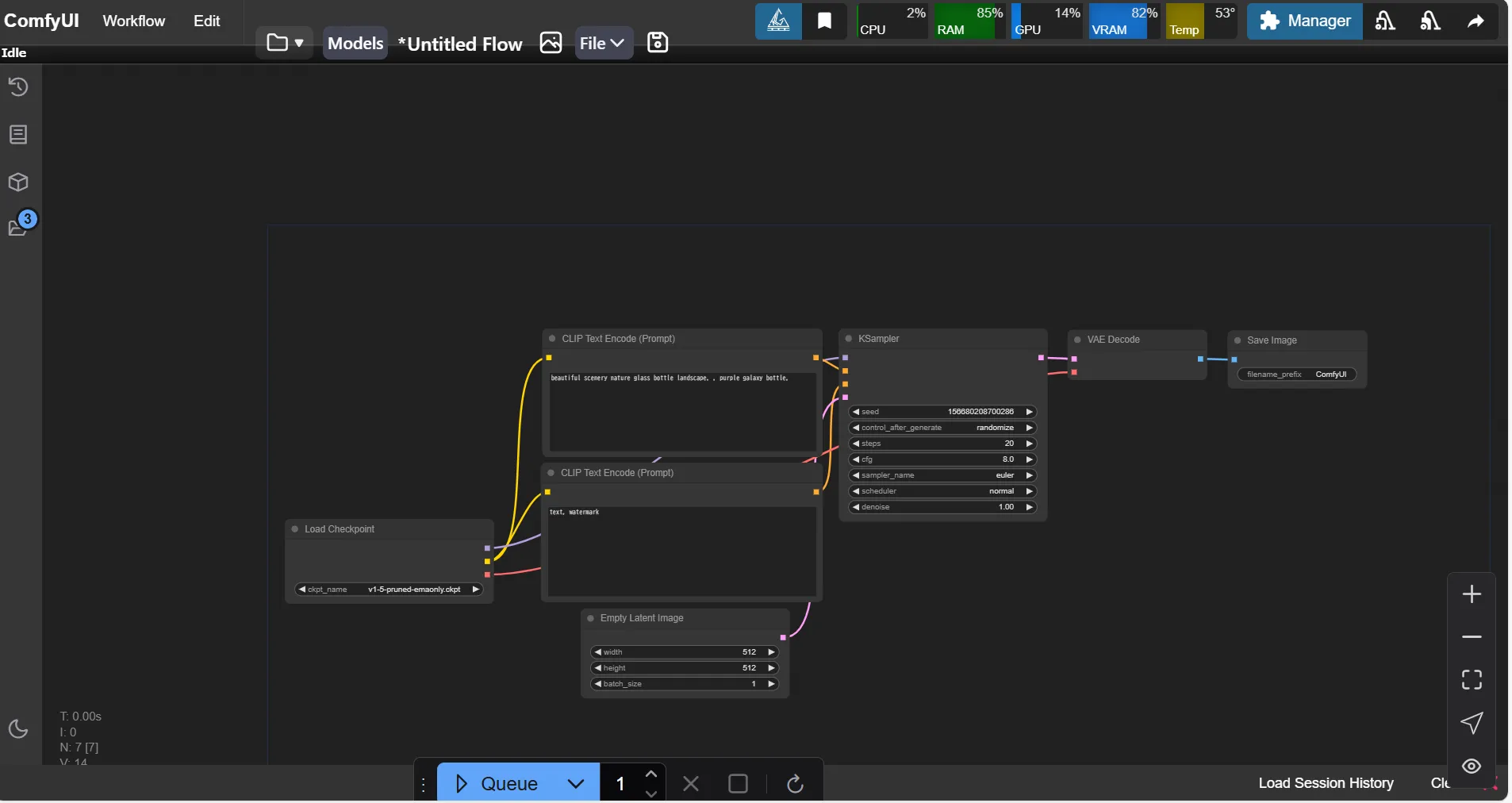

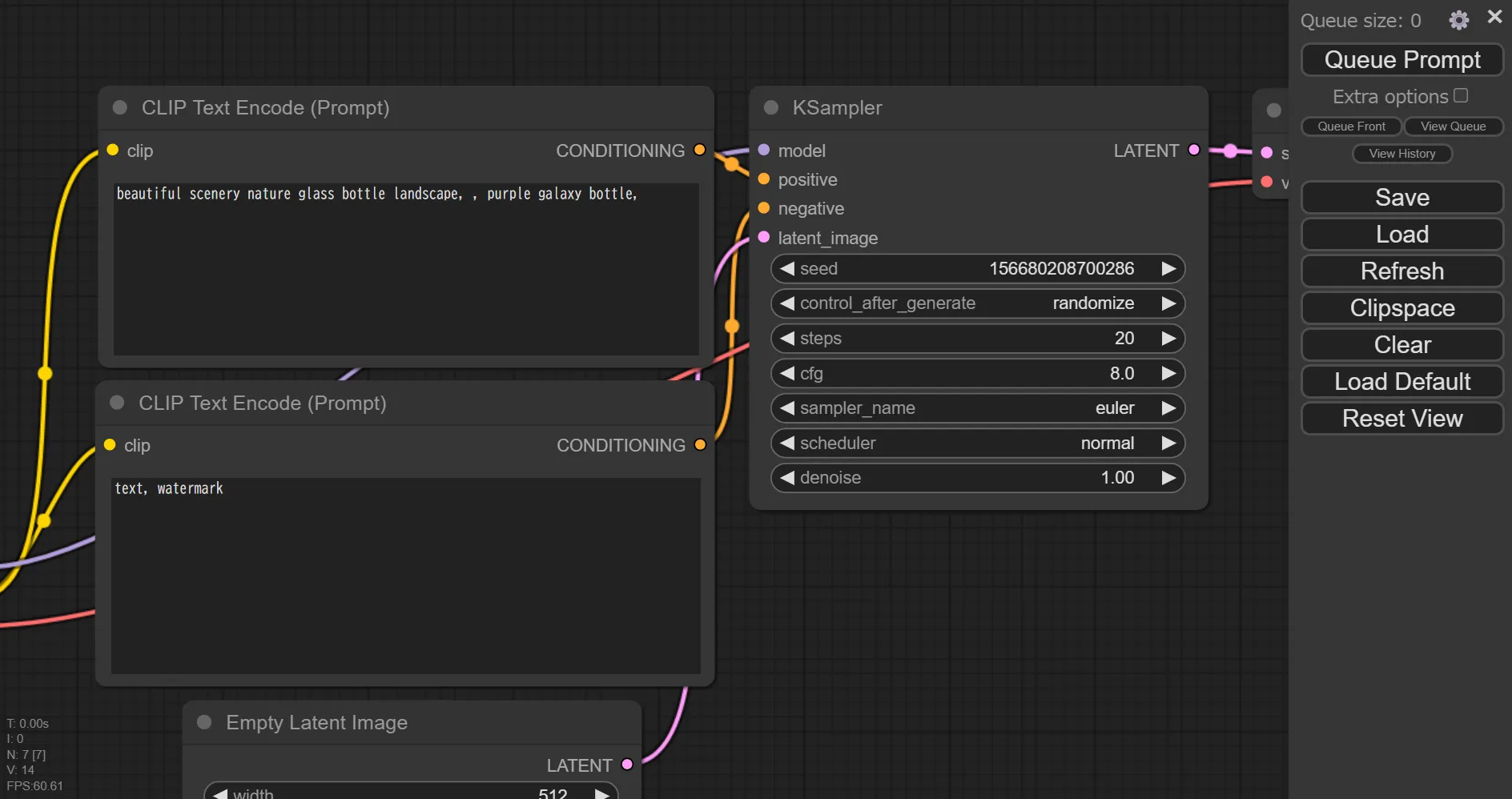

URLにアクセスしてみると、以下のようにCompyUIの起動が確認出来ました。

CompyUIの起動完了

CompyUIの起動完了

ComfyUIでは上記のように、画像生成のプロセスをノードベースで直感的に組み立てることが出来ます。

ComfyUIの用語解説

まずは具体的な使い方の前に、ComfyUIの核となるノードとワークフローの2つの用語について解説します。

ノード

ノードは、画像生成プロセスの各ステップを実行する基本単位です。

各ノードは、特定のタスク(例:テキストのエンコード、画像の生成、画像のデコードなど)を担当し、それぞれが独立して機能します。

ワークフロー

ワークフローは、複数のノードをつなぎ合わせて、画像生成の一連のプロセスを構成するものです。

ワークフローを作成することで、ノード同士のデータフローを視覚的に定義し、複雑な画像生成プロセスを管理できます。

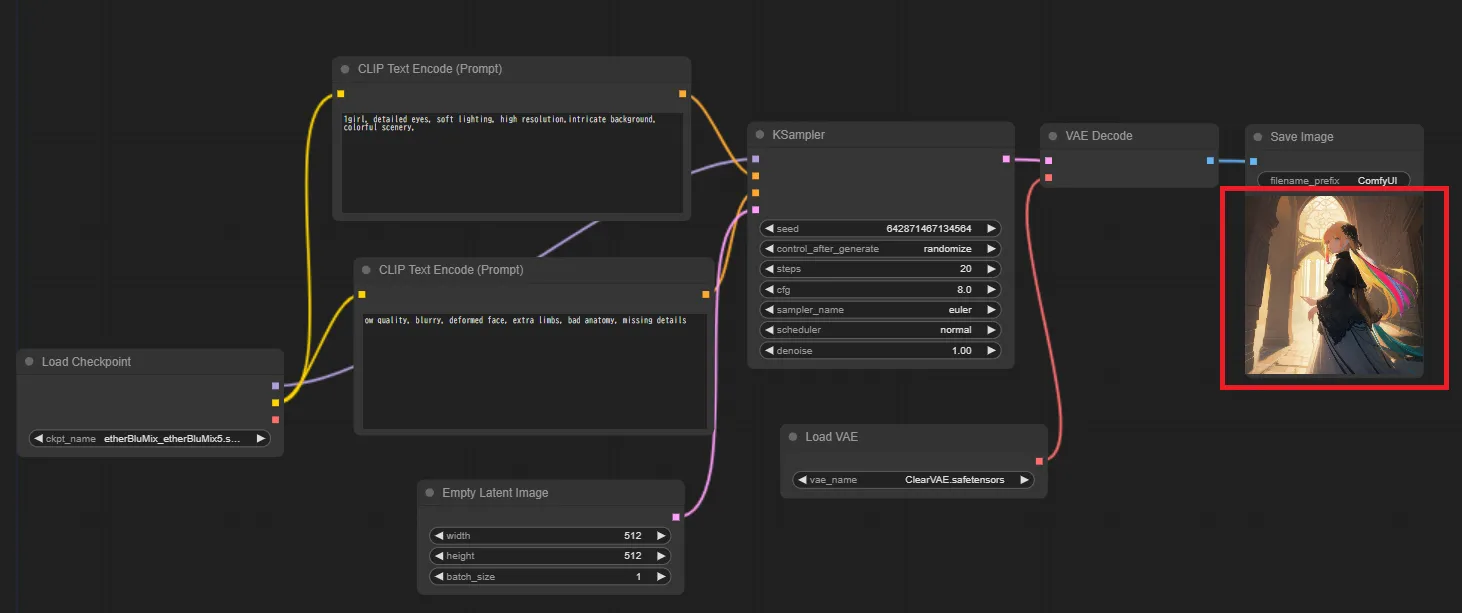

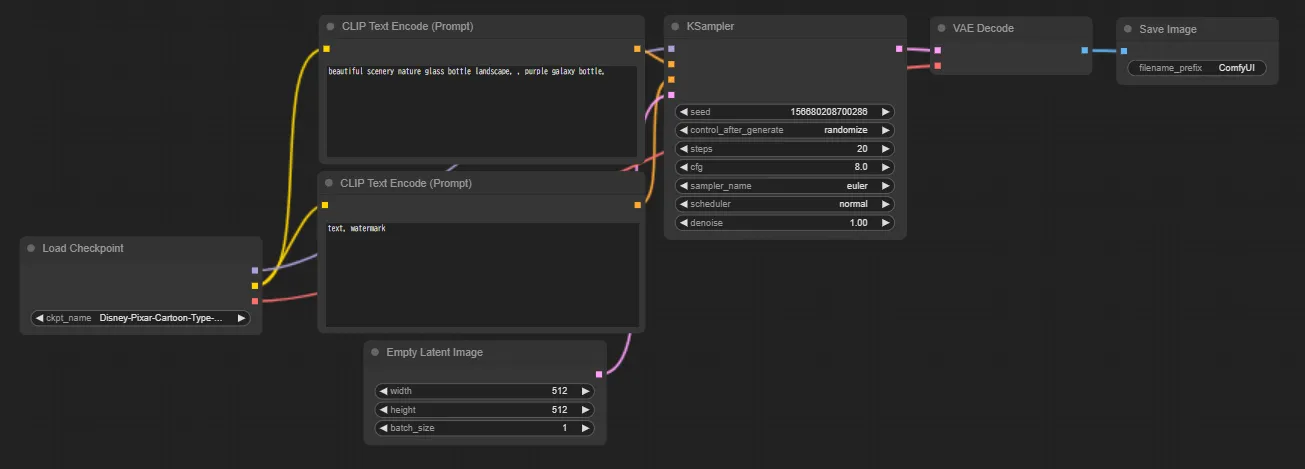

つまり、下記の画像において、いくつもあるグレーの四角形の部品のようなものをノードと呼び、それらが繋がりあっている全体をワークフローと呼びます。

用語解説

用語解説

モデルのダウンロード

実際に画像を生成するには、モデルやVAEを用意する必要があります。

そのため、一旦ComfyUI上ではなく、仮想マシンのターミナル上で作業します。

モデル等の用意には主に以下の2種類の方法があります。

- ComfyUI上に直接ダウンロードする方法

- 既にあるStable diffusion webuiのモデルと共有する方法です。

ComfyUI上に直接ダウンロードする方法

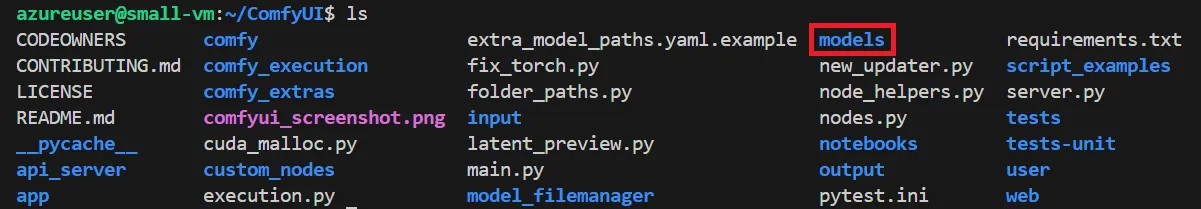

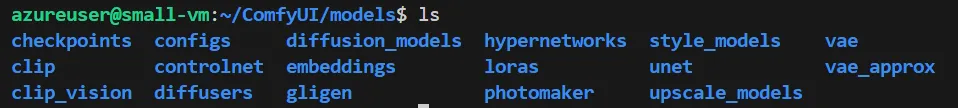

CompyUIのディレクトリの中には、以下のように「models」というフォルダがあります。

CompyUIのディレクトリの中身

CompyUIのディレクトリの中身

そして、「models」の中には、以下のように様々なフォルダが用意されています。

modelsの中身

modelsの中身

モデル等の用意をするには、これらの中の該当フォルダに保存して下さい。

例えば、モデルをダウンロードするなら「checkpoints」に、VAEをダウンロードするなら「vae」に保存するという具合です。

Stable Fiffusion WebUIのモデルと共有する方法

ComfyUI専用でモデル等をダウンロードしていると、ストレージを圧迫してしまいます。

そこで、既にStable diffusion webuiを使用しており、そこにモデル等が保存されている場合、ComfyUIにもそのモデルを共有する事が出来ます。

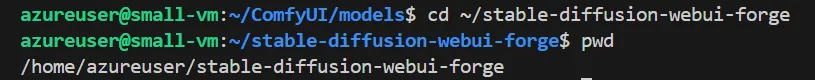

まずは、forgeのパスを取得します。以下のコマンドを順に実行して下さい。

cd ~/stable-diffusion-webui-forge

pwd

すると、下記のようにforgeのパスを取得出来ました。

forgeのパス取得

forgeのパス取得

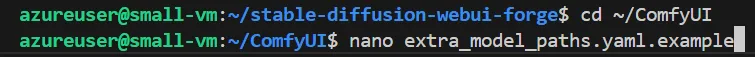

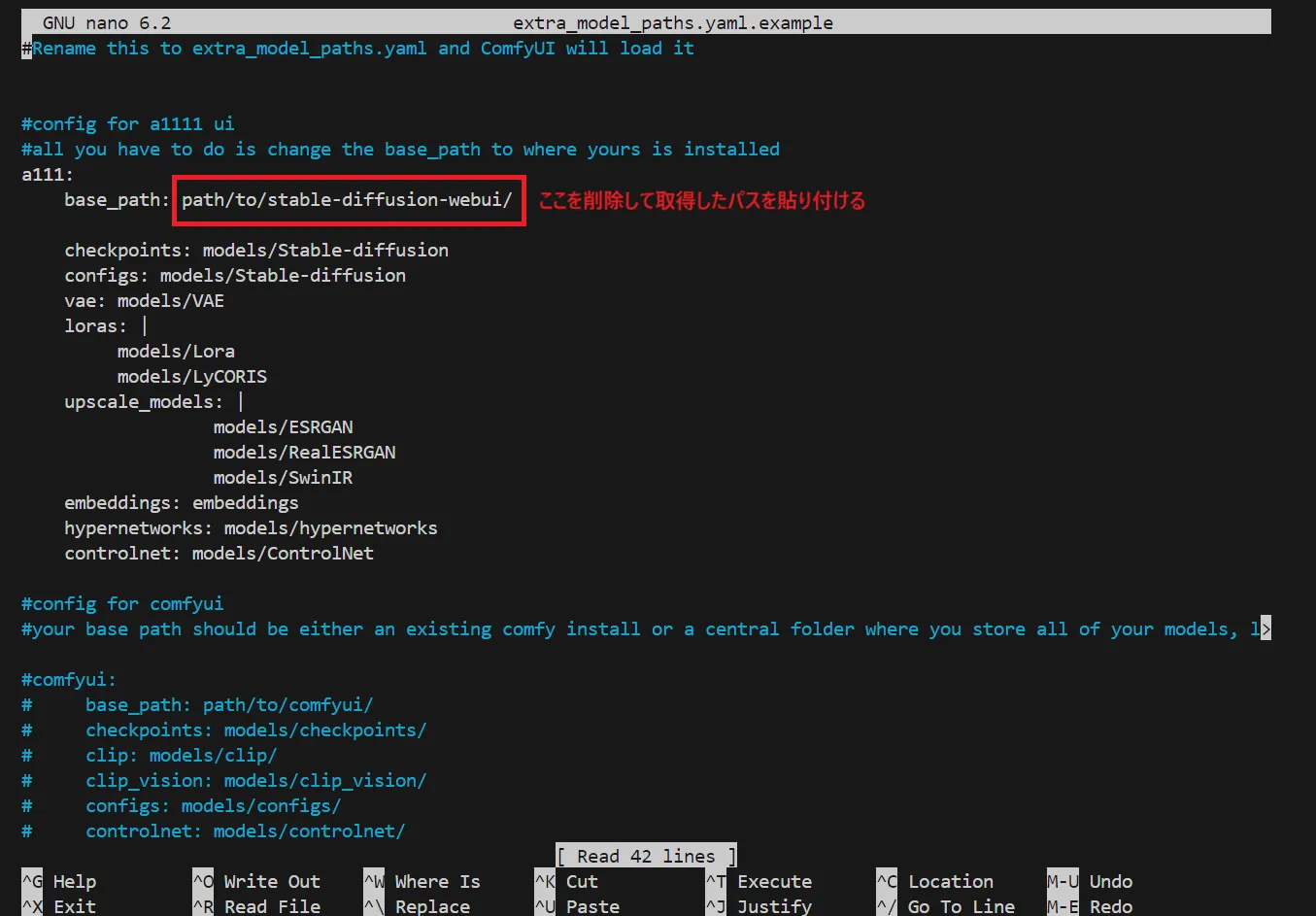

次は、順に以下のコマンドを実行して下さい。

cd ~/ComfyUI

nano extra_model_paths.yaml.example

編集画面起動のコマンド入力

編集画面起動のコマンド入力

すると、編集画面が起動します。

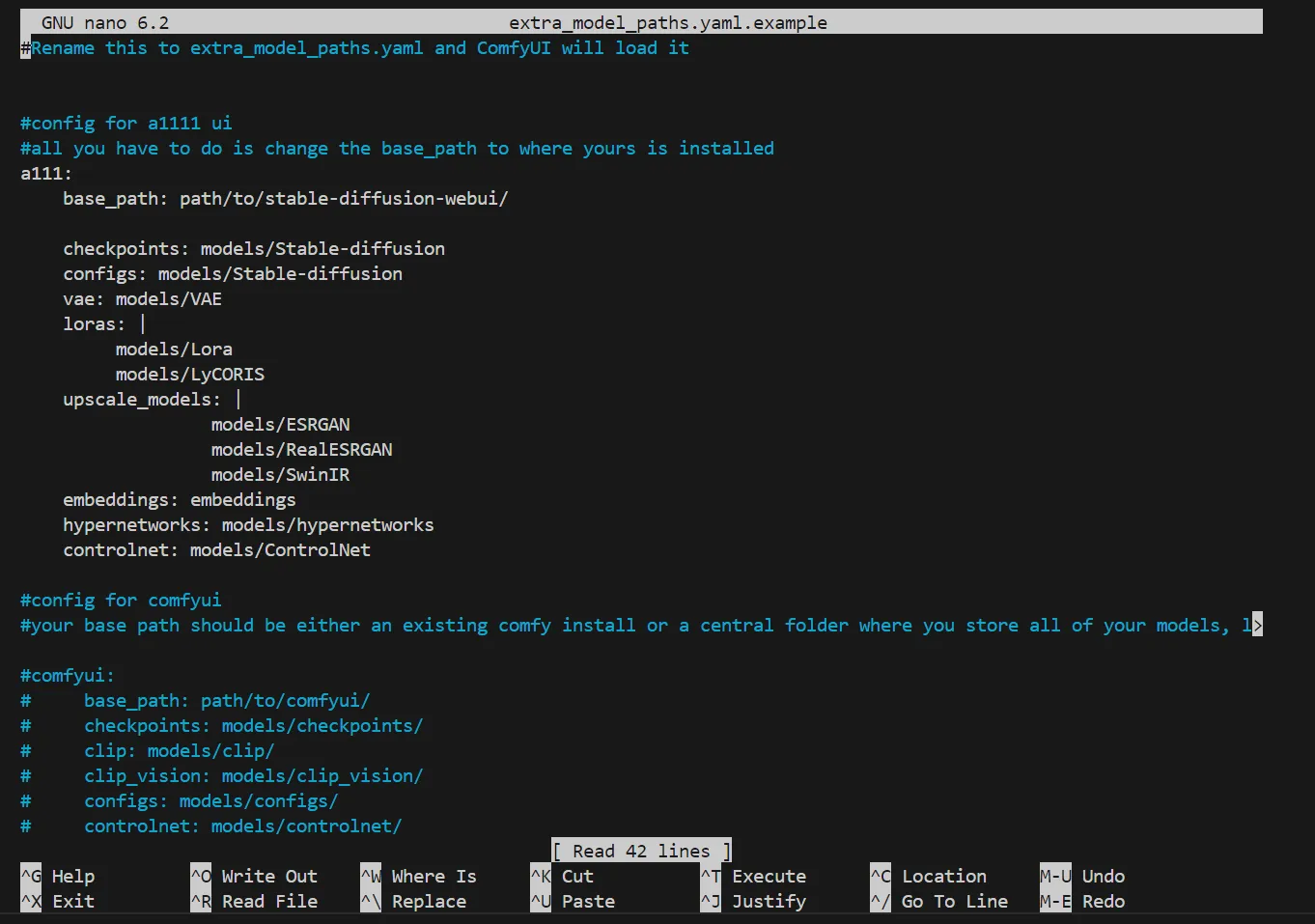

パス編集画面の起動

パス編集画面の起動

赤枠で囲んだ部分を削除し、先ほど取得したforgeのパスを取得します。

パスの編集内容

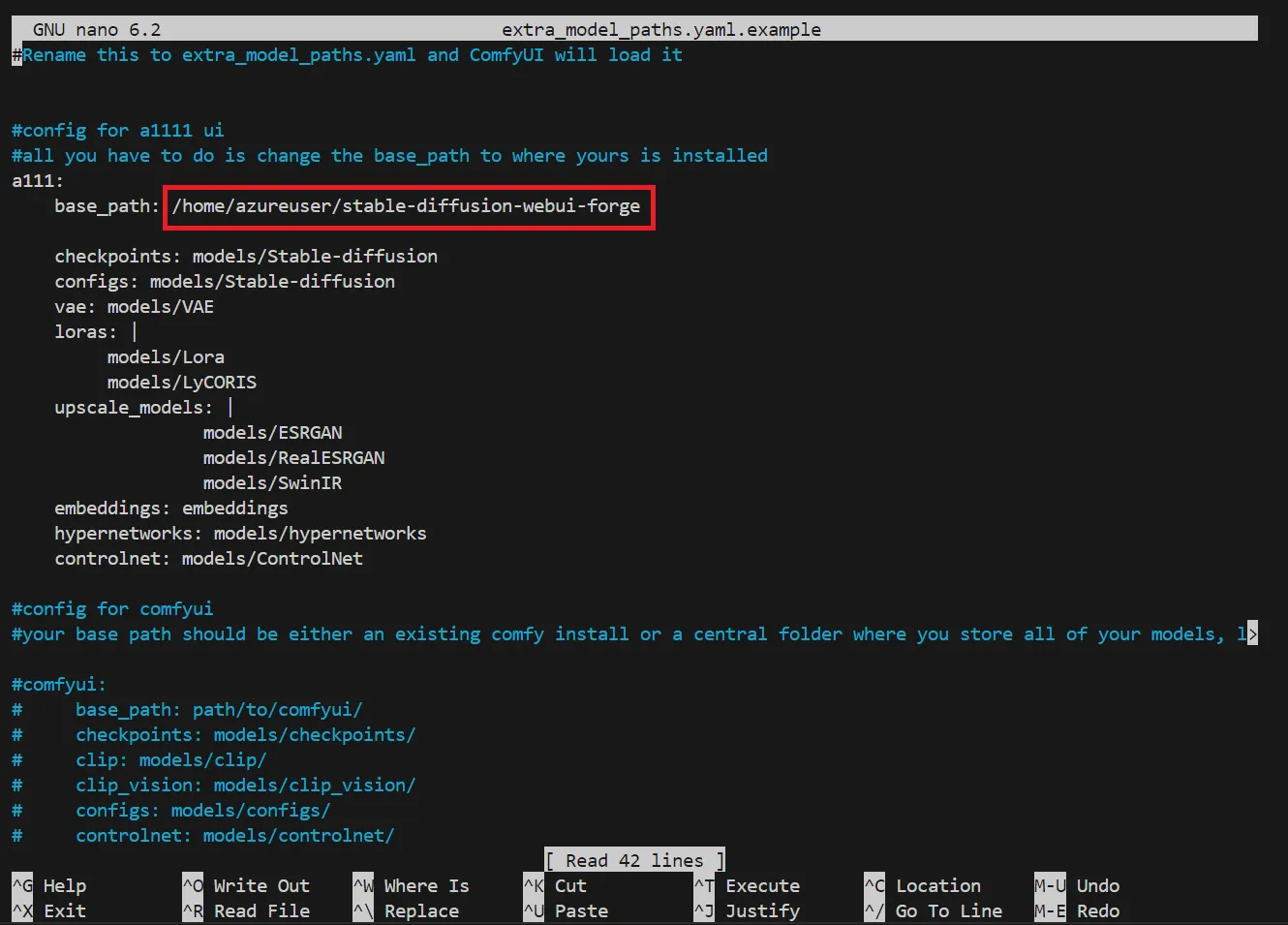

パスの編集内容

以下のように貼り付けることが出来ました。

forgeのパス貼り付け完了

forgeのパス貼り付け完了

「Ctrl + O」>「Enter」>「Ctrl + X」でエディタを抜けます。

次に、以下のコマンドを実行し、ファイル名を変更します。

mv extra_model_paths.yaml.example extra_model_paths.yaml

ファイルの名称変更

ファイルの名称変更

これで、モデルを共有して使用することが出来るようになりました。

基本操作

画面の移動

ダブルクリックしてスクロール

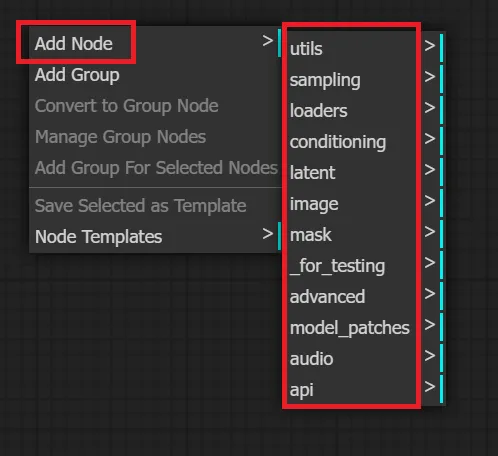

右クリック > 「Add Node」 > 追加したいノードの選択

右クリックによるノードの追加

右クリックによるノードの追加

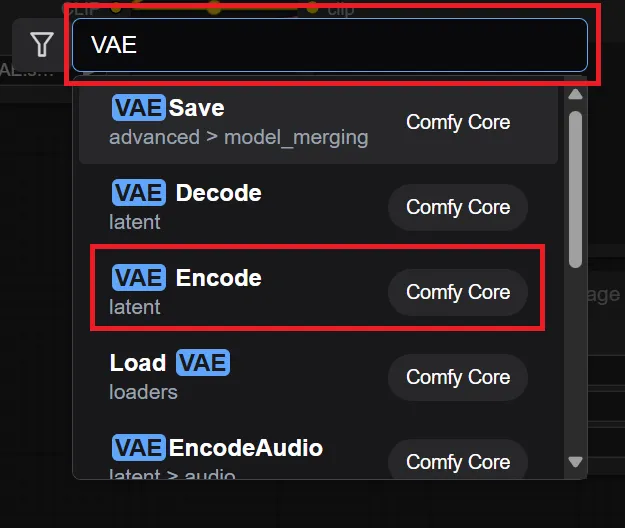

- ダブルクリックの場合

ダブルクリック > 検索バーに名前を入力 > 表示された中から追加したいノードを見つけてクリック

ダブルクリックによるノードの追加

ダブルクリックによるノードの追加

ノードの接続

接続元のポートをドラッグし、接続先のポートにドロップ

ドラッグ中

ドラッグ中

ドラッグして

ドロップ後

ドロップ後

ドロップする

ノードの削除

ノードを選択し、「Delete」または「Backspace」

ノードの削除1

ノードの削除1

ノードを選択すると、白い枠線が出る。

この状態で、「Delete」または「Backspace」をすると、以下のように削除できる

ノードの削除2

ノードの削除2

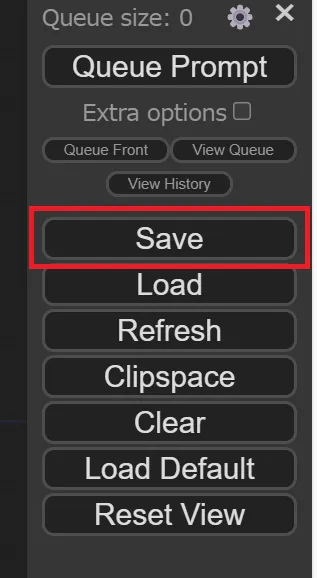

作成したワークフローの保存

右バーの「Save」をクリック > 任意の名前を入力 > 「OK」をクリック

まずは、右バーにある「Save」をクリックします。

Saveのクリック

Saveのクリック

以下のような表示が出てくるので、お好きな名前を入力し、その後「OK」をクリックします。

名前の入力

名前の入力

なお、ご自身のローカルPCにjsonファイルが保存されます。

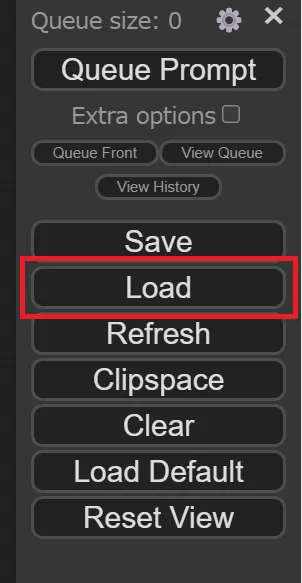

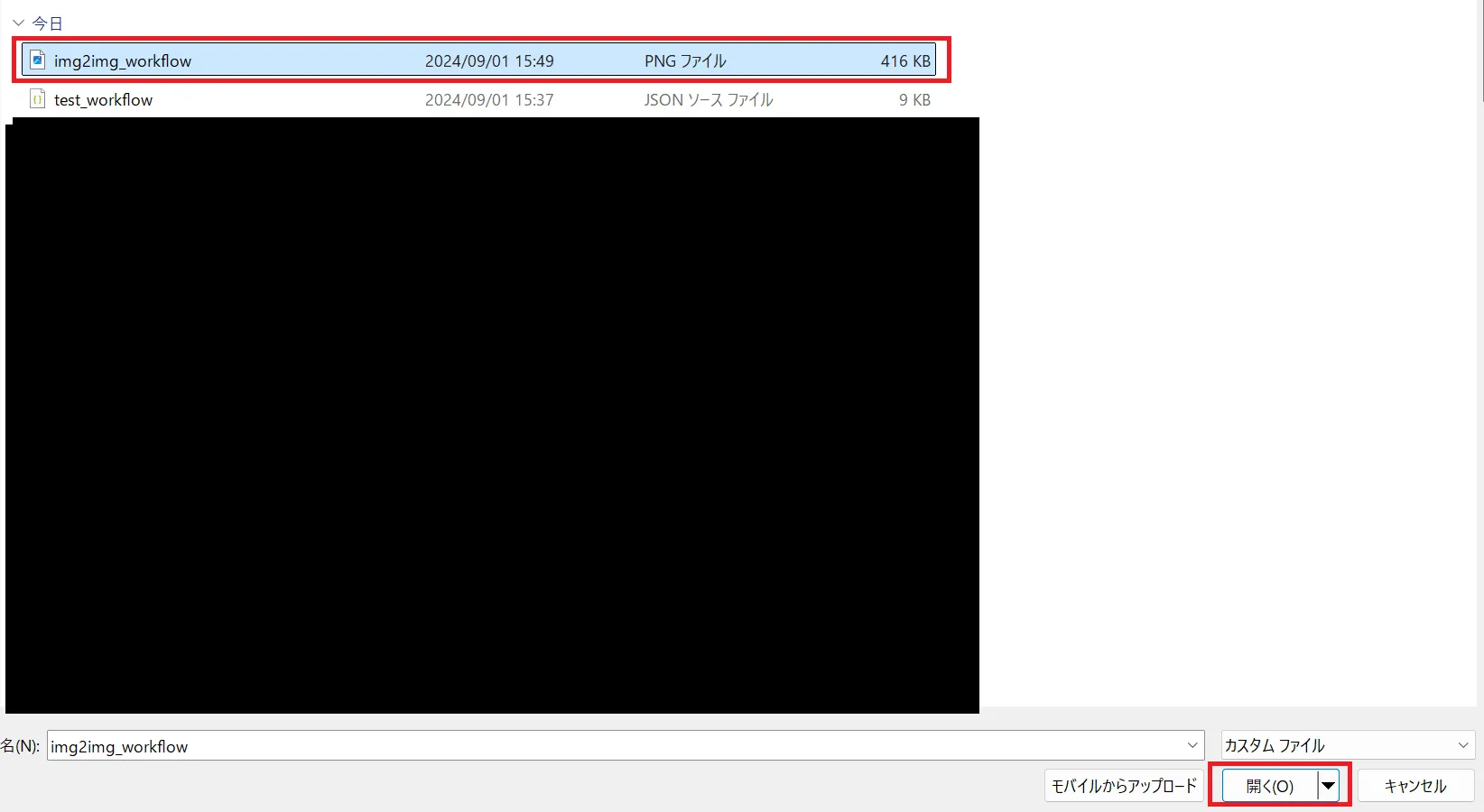

ダウンロードしたワークフローの利用方法

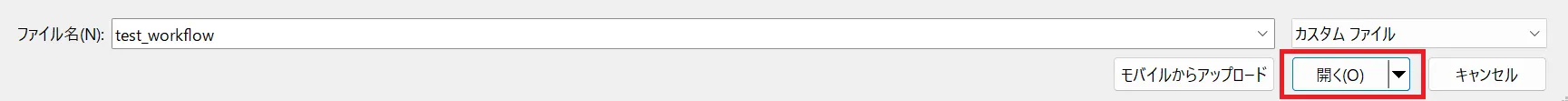

右バーの「Load」をクリック > 使用するワークフローを選択 > 「開く」をクリック

右バーの「Load」をクリックします。

Loadのクリック

Loadのクリック

ローカルPC内のファイル一覧が表示されるので、使用したいワークフローを選択して下さい。なおここで選択するファイルの形式は、jsonファイル以外にも、pngファイルで動作することが確認出来ました。

使用するワークフローの選択

使用するワークフローの選択

ワークフローを選択したら、右下の「開く」をクリックします。

使用するワークフローの起動

使用するワークフローの起動

ComfyUIの各機能の使い方

ノードを組み合わせてワークフローを構築していくという流れになります。ワークフローを構築することで、自由に画像生成の処理を行うことが出来ます。

例えば、入力を画像にしたり、はじめに画像が生成された後に解像度を上げたり、ノイズの除去をすることで、さらに良い出力を狙うといった事が出来るようになります。

ここで、ワークフローはネット上で公開されているものがあり、基本的にはそれらをダウンロードして利用する事が多いです。

テキストから画像生成(txt2img)

まずは最も基本的な、テキストから画像を生成(txt2imgという)する事を試してみましょう。

ComfyUIの初期起動時には、txt2imgのワークフローの大枠が用意されているので、これを活用していきます。

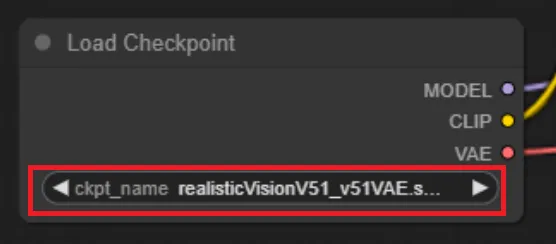

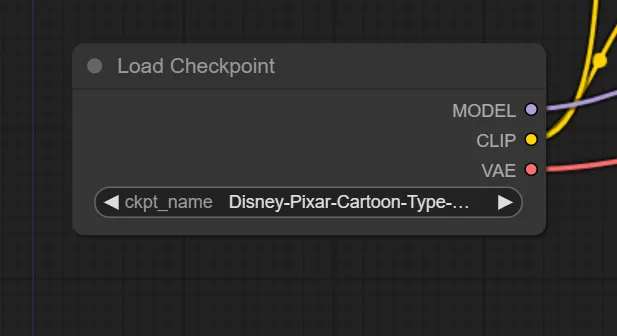

まずは、「Load Checkpoint」でモデルを選択します。

モデルの選択

モデルの選択

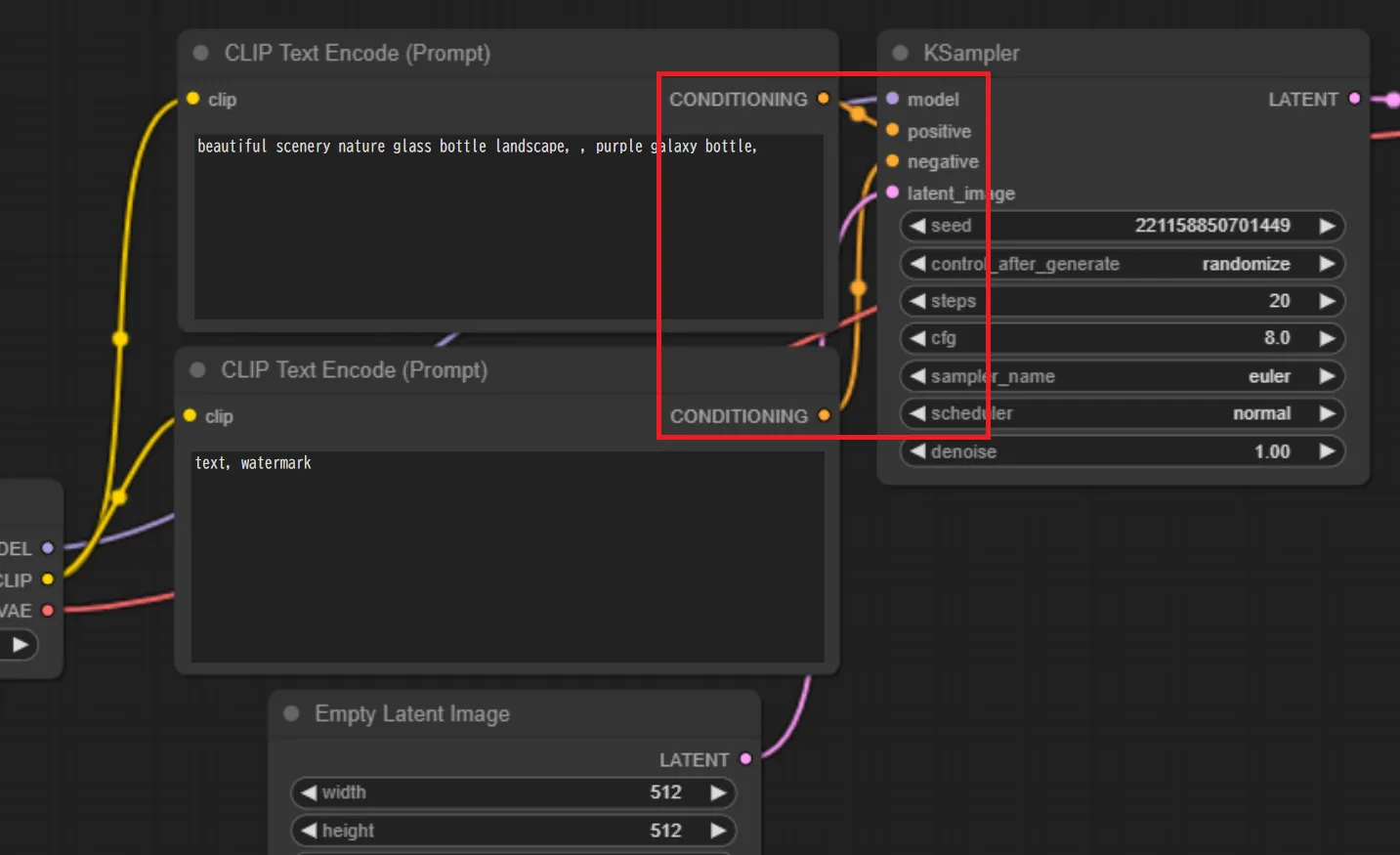

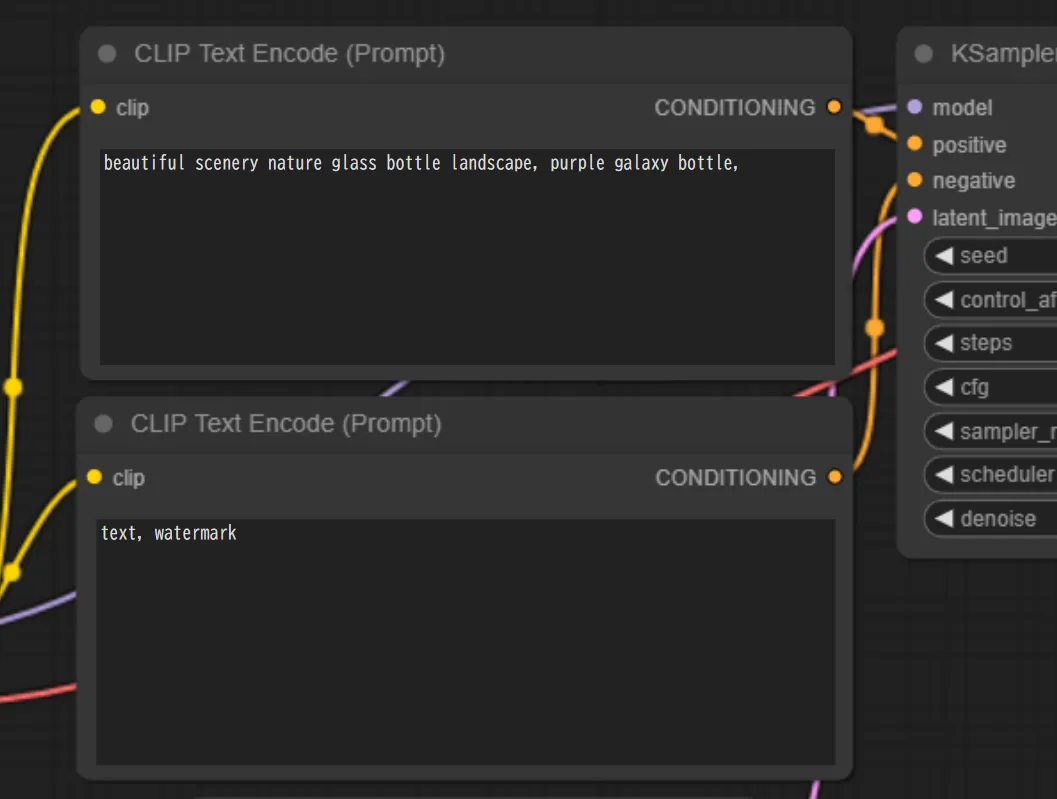

次に、プロンプトを入力します。「CLIP Text Encode(Prompt)」に入力していく事になります。

なお、下記のようにノードに注目すると、上が「positive」、下が「negative」に接続されている事が分かります。

従って、上にはプロンプトを、下にはネガティブプロンプトを入力します。

プロンプトの入力

プロンプトの入力

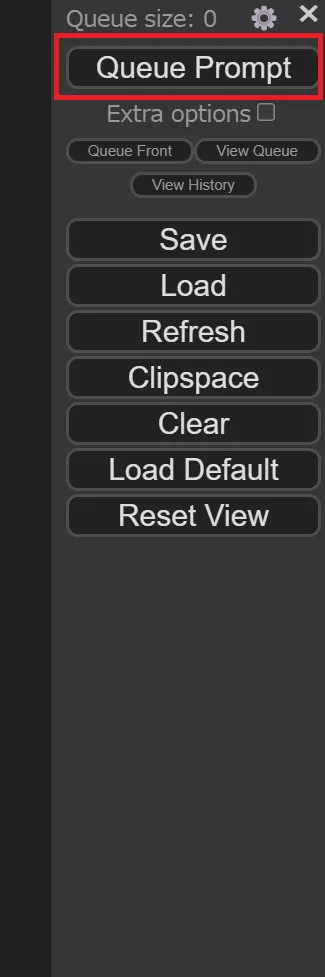

最後に、右バーの「Queue Prompt」をクリックすることで画像を生成することが出来ます。

画像生成の実行

画像生成の実行

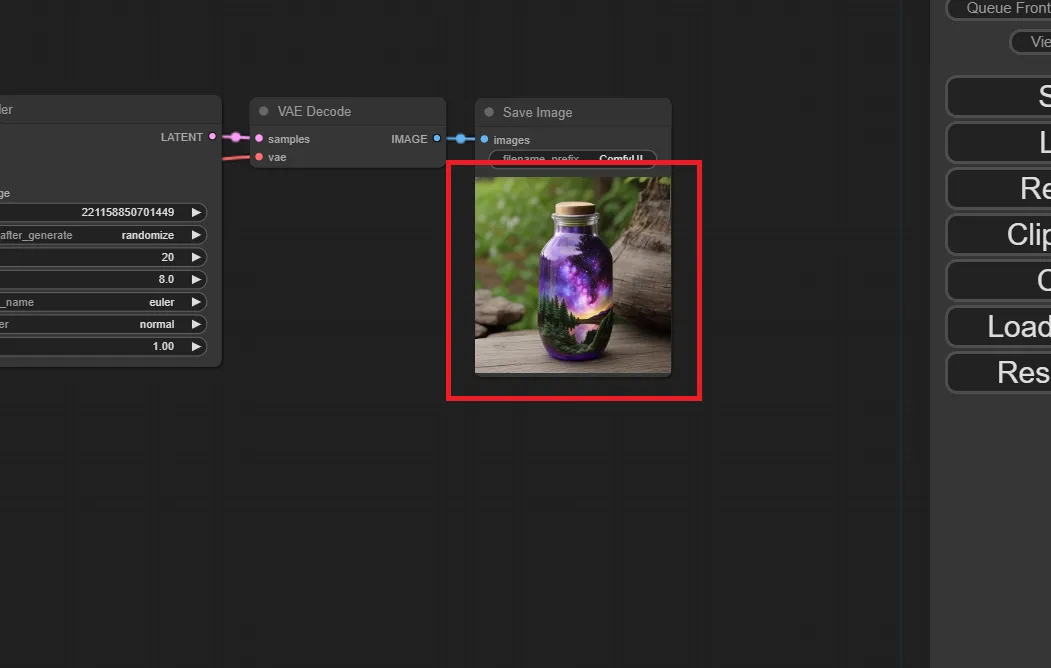

すると以下のように、生成された画像が表示されました。

生成された画像1

生成された画像1

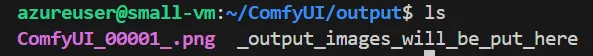

なお生成された画像は、「ComfyUI」ディレクトリの中の「output」フォルダの中に保存されていきます。

ComfyUIで生成した画像の保存場所

ComfyUIで生成した画像の保存場所

VAEの追加

次は、任意のVAEを追加してみましょう。なお、先程のモデルも変えています。

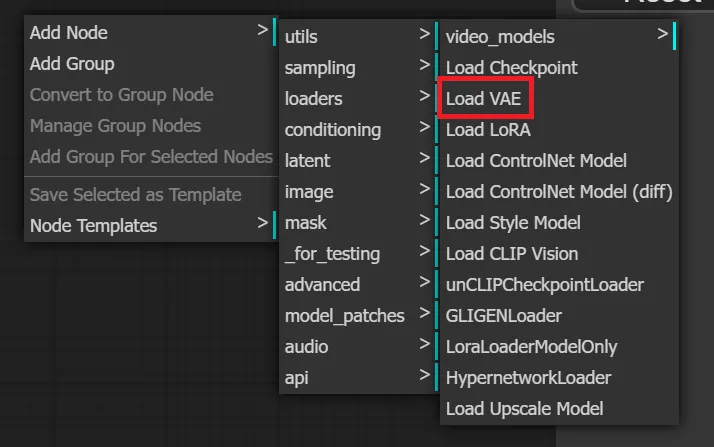

まずは、「Load VAE」のノードを追加します。

VAEノードの追加

VAEノードの追加

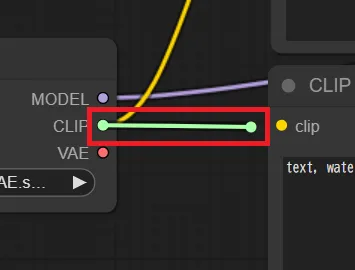

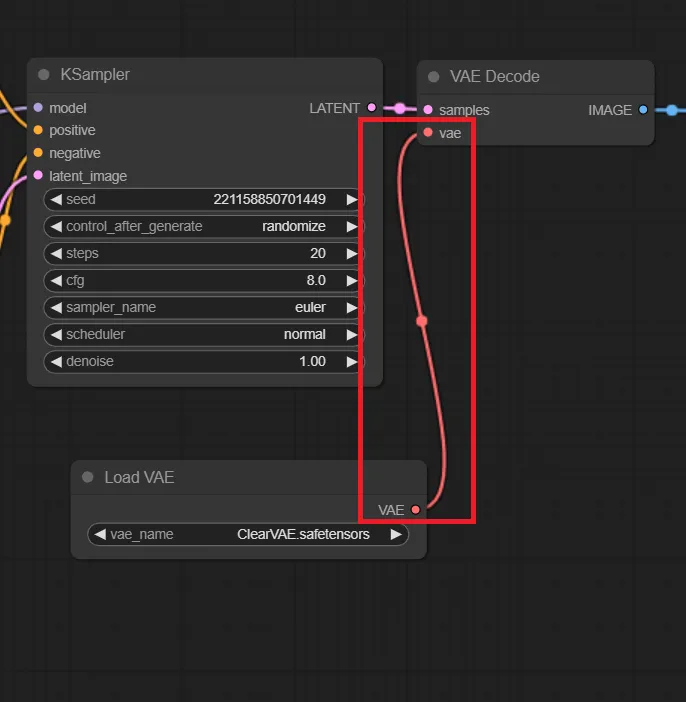

次に、「Load VAE」と「VAE Decode」を接続します。この際、「Load Checkpoint」との接続は自動で解除されます。

VAEノードの接続

VAEノードの接続

「Load VAE」で任意のVAEを選択し、画像を生成してみましょう。

VAE導入後に生成された画像1

VAE導入後に生成された画像1

解説したワークフローでしっかり画像を生成することが出来ました。

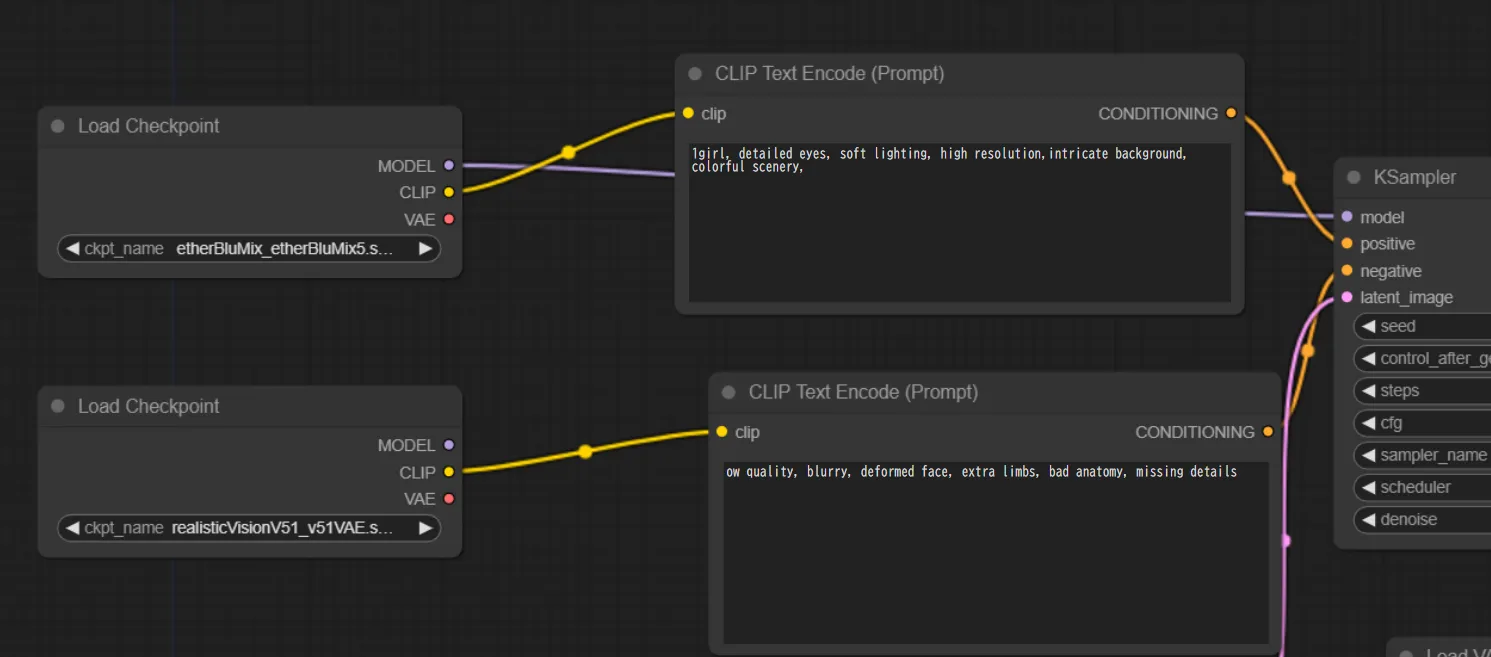

プロンプトに活用するモデルの変更

ここで、プロンプトとネガティブプロンプトに使用するモデルを異なるものにしてみます。

先ほどVAEを追加したワークフローの中で、ネガティブプロンプトに使用するモデルを以下のように変更しました。

プロンプトに活用するモデルの変更

プロンプトに活用するモデルの変更

以下が、生成された画像です。

プロンプトに活用するモデルを変更して生成された画像

プロンプトに活用するモデルを変更して生成された画像

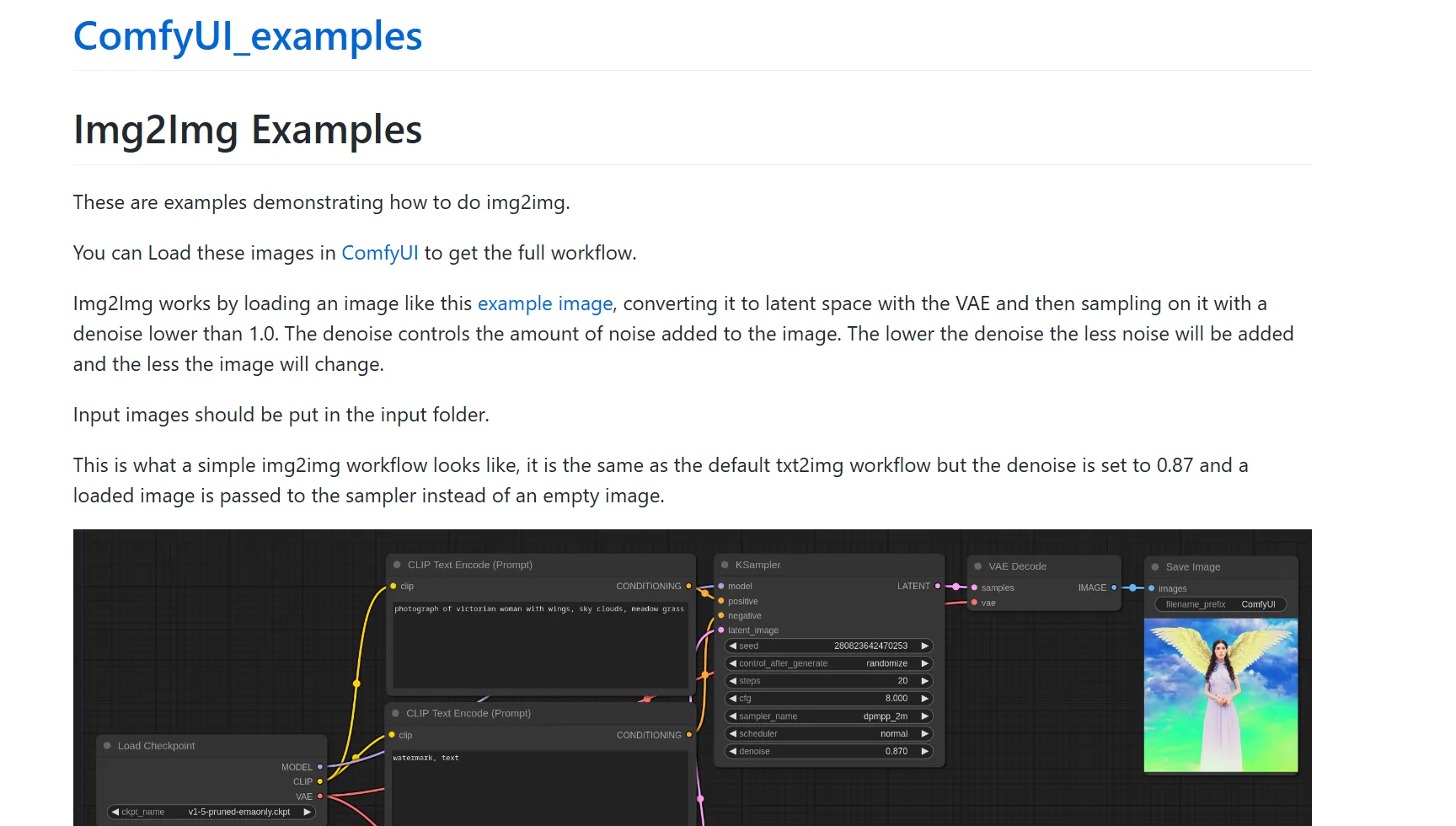

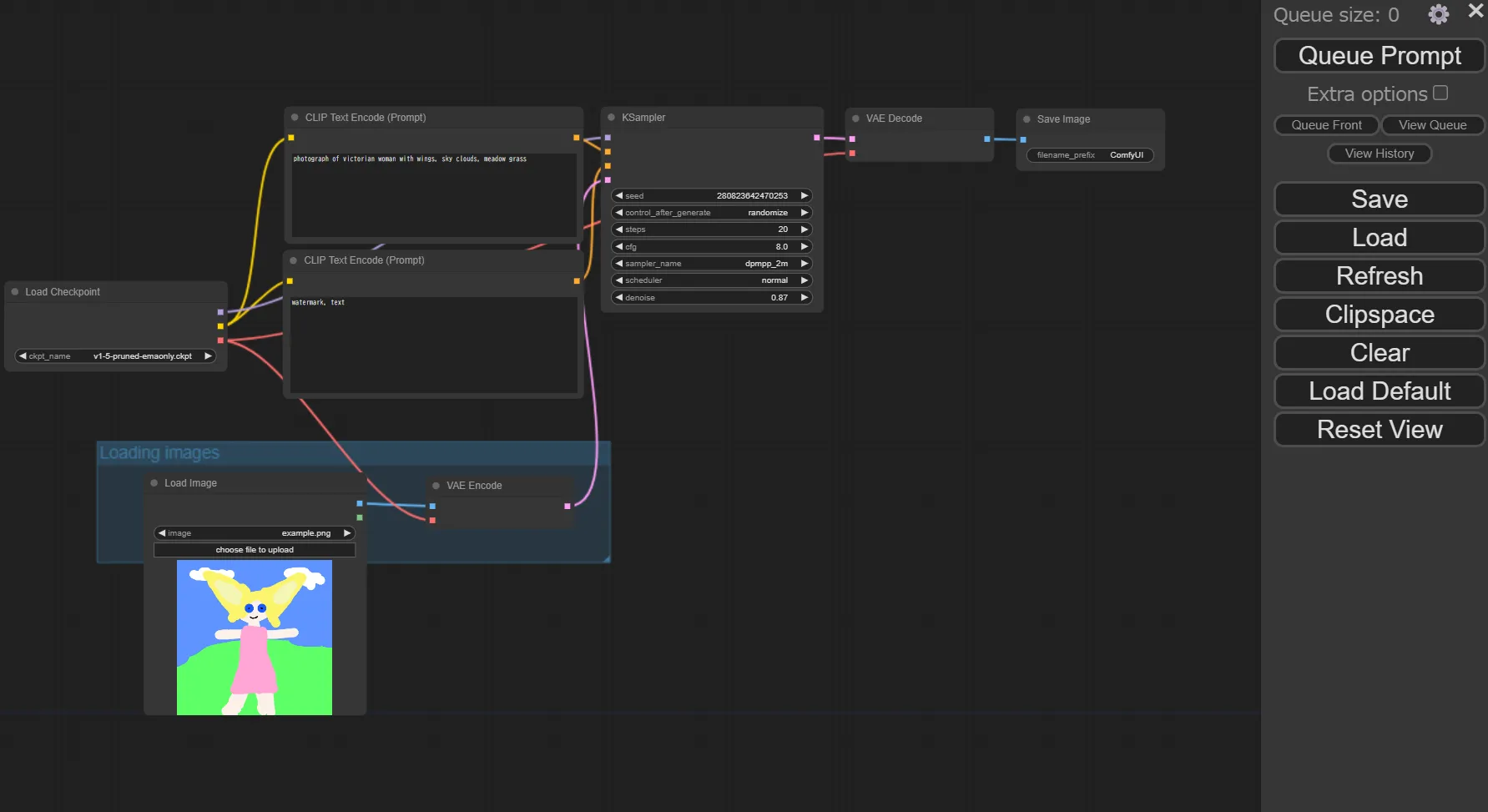

画像から画像生成(img2img)

それでは、既存の画像に対して何らかの変換を施し、新しい画像を生成する事を試してみましょう。

ワークフローは、こちらからダウンロードしたものを使用します。

サイトにアクセスすると、以下のような画面が表示されます。

ワークフローの参照先

ワークフローの参照先

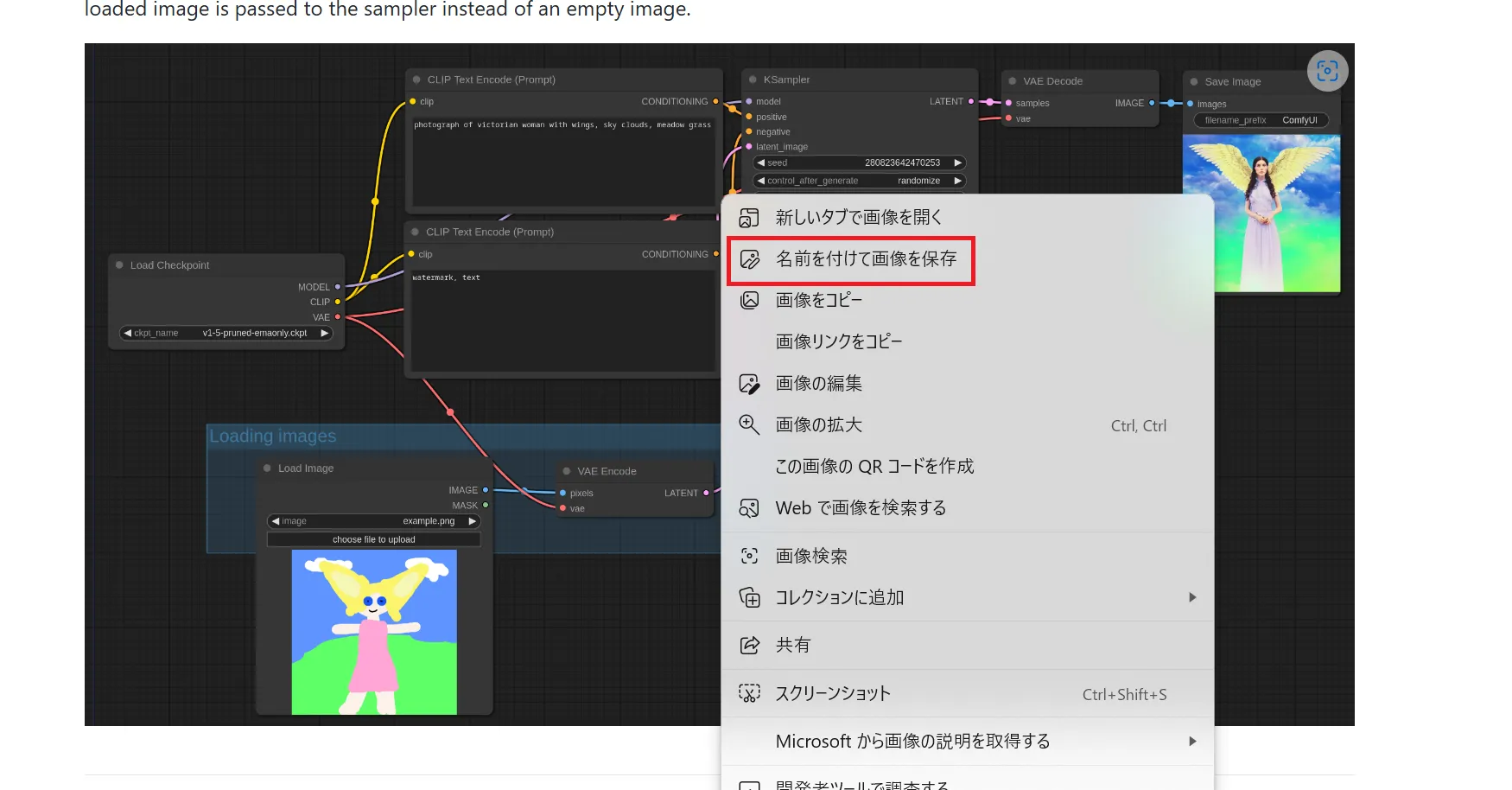

下部にある画像を右クリックし、任意の名前を付けて保存します。

img2img画像の保存

img2img画像の保存

ComfyUI内の「Load」にて、先ほど保存したファイルを選択します。

img2imgの選択

img2imgの選択

以下のように、img2imgのワークフローが読み込まれました。

img2imgワークフローの起動

img2imgワークフローの起動

「開く」をクリックしても、反映されない場合は、何回か繰り返したり、ComfyUIに入り直してLoadし直すことで上手く行く場合があります。

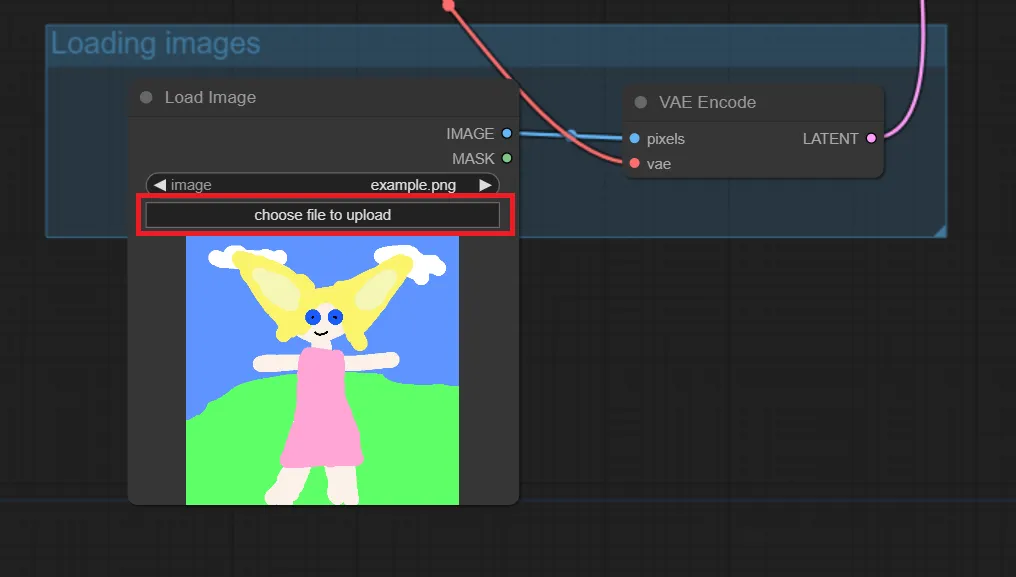

img2imgを使用する際は、下記のように「choose file to upload」をクリックし、入力したい画像を選択します。

入力画像のアップロード

入力画像のアップロード

以下のような画像を設定してみました。

入力画像のアップロード完了

入力画像のアップロード完了

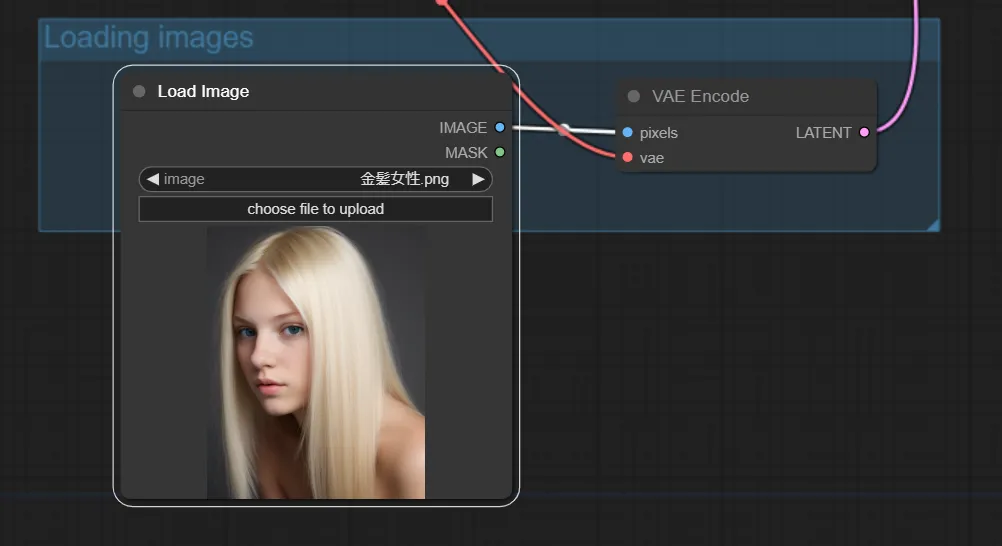

モデルを選択し、以下のプロンプトを入力しました。金髪を青髪にするのが狙いです。

1girl, blue hair

以下が、生成された画像です。

img2img生成画像

img2img生成画像

以下が元画像です。

img2img元画像

img2img元画像

適当にパラメータを設定したので、完全に髪色だけ変更できた訳ではありませんが、なかなか良い出力だと思います。

各種ノードの解説

デフォルトのワークフロー

デフォルトのワークフロー

簡単に、デフォルトのワークフローにあるノードを解説して行きたいと思います。各ノードが参照しているフォルダは、モデル等のダウンロードセクションにて設定したパスを参照しています。

Load Checkpoint

Load Checkpoint

Load Checkpoint

「Load Checkpoint」では、チェックポイントを選択します。つまり、使用するAIモデルを指定します。

CLIP Text Encode

CLIP Text Encode

CLIP Text Encode

「CLIP Text Encode」では、プロンプトを入力します。ノ

ードの接続先を確認してみると、上がpositive、下がnegativeへと接続されています。

これは、上のノードがポジティブプロンプト、下のノードがネガティブプロンプトであることを表しています。

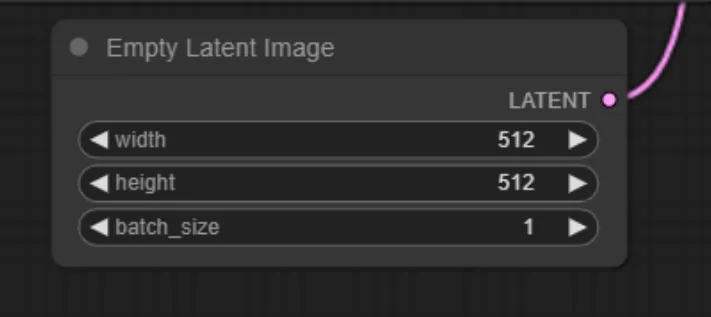

Empty Latent Image

Empty Latent Image

Empty Latent Image

「Empty Latent Image」では、生成される画像のサイズと、バッチ処理の数を決める事が出来ます。バッチ処理の数を大きくすることで、効率的に処理を行うことが出来ます。

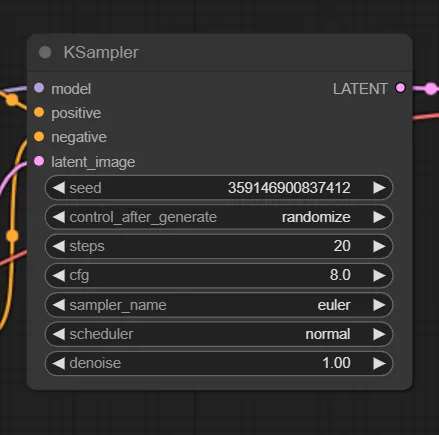

KSampler

KSampler

KSampler

KSamplerでは、画像生成プロセスで使用されるサンプリングアルゴリズムを選択し、パラメータを決定します。また、ここで生成される画像は、潜在空間の画像であり、人間の目で直接見ることができる形ではありません。

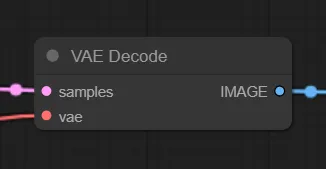

VAE Decode

VAE Decode

VAE Decode

「VAE Decode」では、潜在空間の画像をピクセル空間の画像、つまり私たちが視覚的に認識できる画像に変換しています。

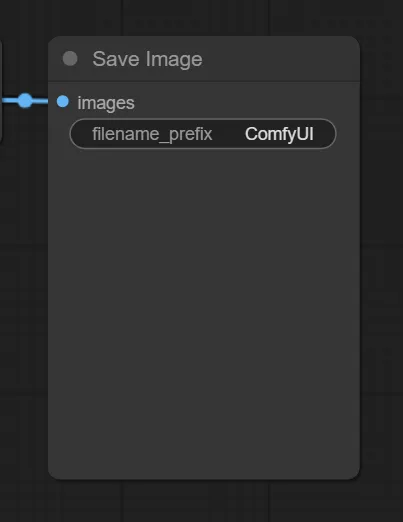

Save Image

Save Image

Save Image

「Save Image」では、画像をフォルダに保存します。

実用上は、カスタムノードといって、ComfyUIのワークフローに新たな機能や処理を追加するための拡張モジュールを使用する事が多いです。

これにより、標準ノードでは実現できない独自の処理や特定のニーズに対応することが可能になります。

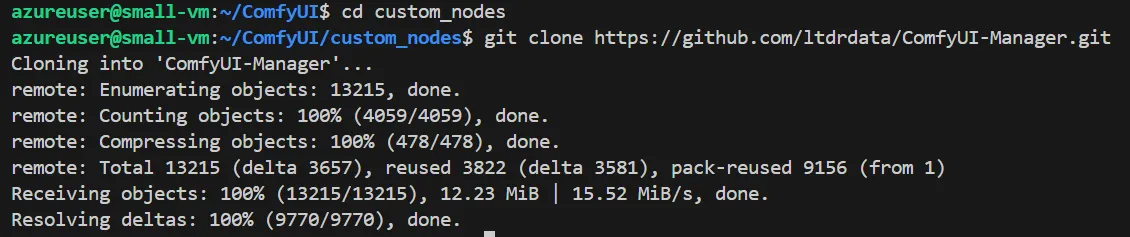

拡張機能

カスタムノードを管理するのに便利な「ComfyUI Manager」のインストール方法を解説します。

CLIインストール環境では、以下のコマンドを実行してください。

cd ~/ComfyUI/custom_nodes

git clone https://github.com/Comfy-Org/ComfyUI-Manager.git

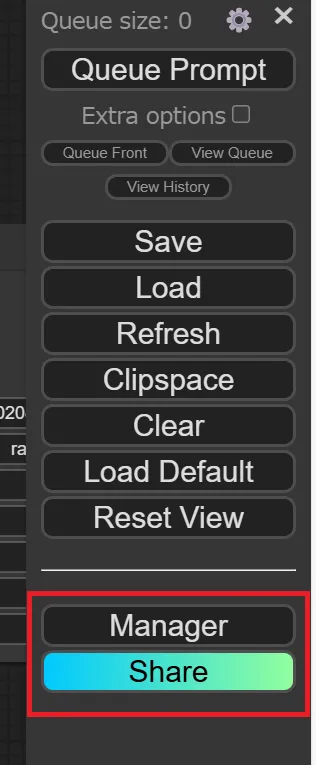

これでインストールが完了です。ComfyUIを開くと、以下のように「Manager」と「Share」のタブが追加されていることが確認できます。

これを使用することで、カスタムノードを簡単に管理することが出来ます。

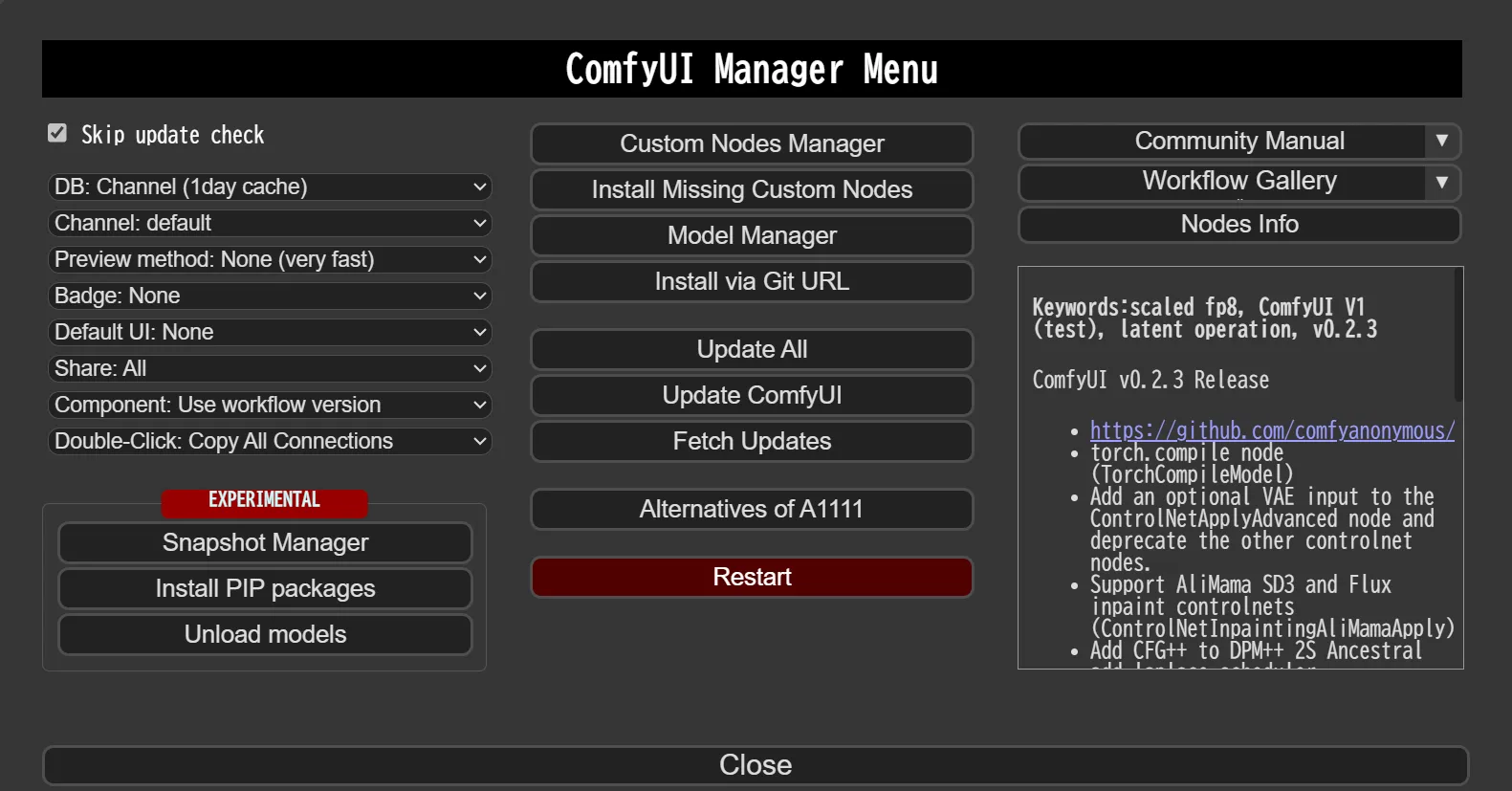

「Maneger」をクリックしてみると、以下のような表示が出てきます。

ComfyUIManagerの表示

ComfyUIManagerの表示

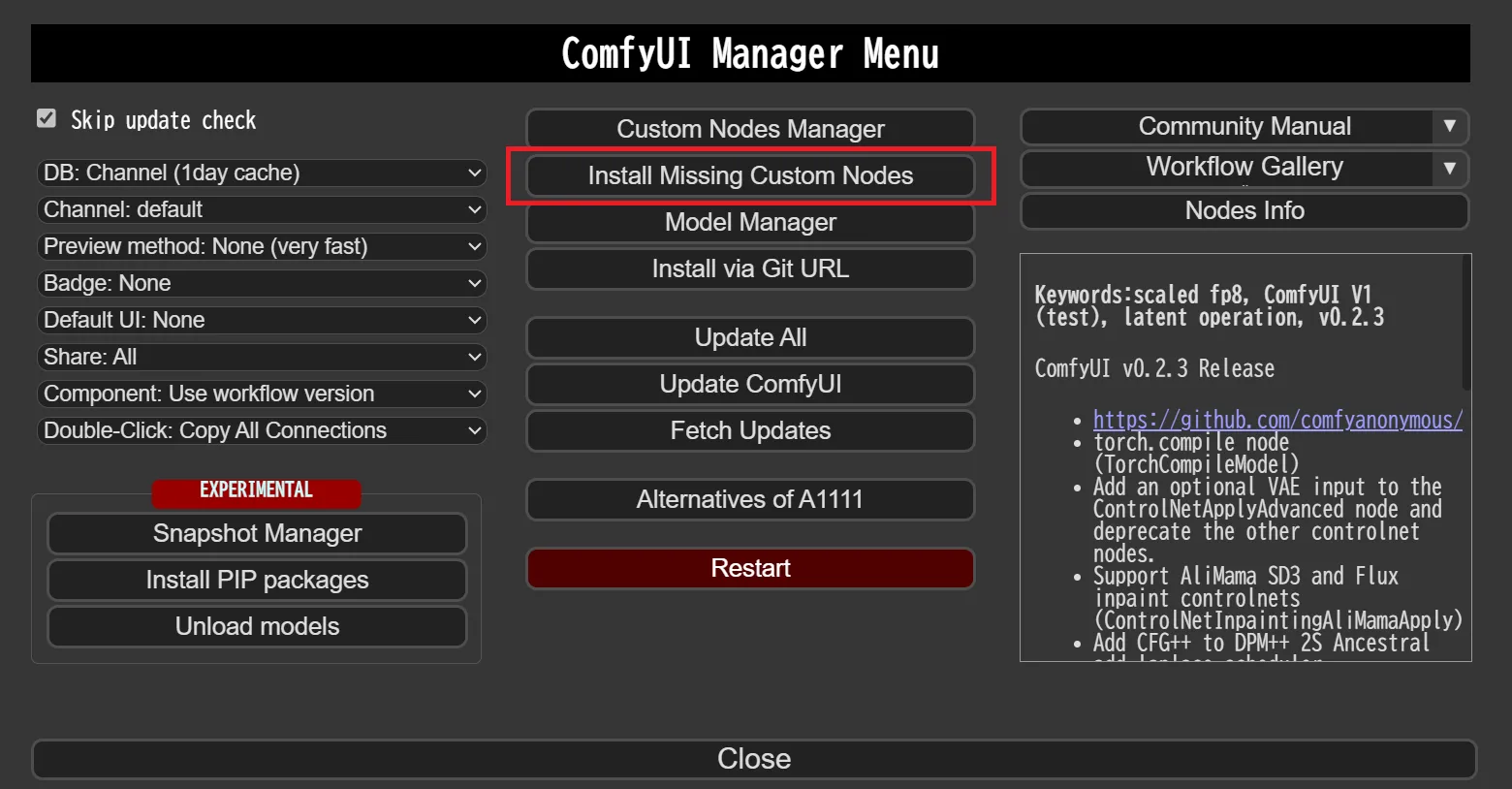

例えば、ネットから持って来た何かしらのワークフローを使用しようとした時に、そのワークフローがカスタムノードを使用していた場合、その時点でのあなたのComfyUIは持ってきたワークフローを使用することが出来ません。

そんな時は、以下の「Install Missing Custom Nodes」を使用することで、数クリックで足りないカスタムノードをインストールすることが出来ます。

Install Missing Custom Nodes

Install Missing Custom Nodes

2回目以降の起動方法

2回目以降は、以下を実行する事で、ComfyUIを起動出来ます。

source ./comfy/bin/activate

cd ~/ComfyUI

python main.py

ComfyUIの商用利用について

ComfyUI本体はGPL v3ライセンスのオープンソースソフトウェアであり、商用利用は可能です。ただし、GPL v3にはいくつかの条件があり、また使用するモデルやカスタムノードにはそれぞれ別のライセンスが適用されるため、注意が必要です。

以下に、商用利用時に確認すべき3つのポイントを整理しました。

1. ComfyUI本体のライセンス(GPL v3)

ComfyUI本体はGPL v3ライセンスで公開されています。商用利用は許可されていますが、ComfyUIを改変して配布する場合は、その改変部分のソースコードも公開する義務があります。ComfyUIをそのまま利用して画像や動画を生成し、その成果物を商用利用する分には、ソースコード公開の義務は生じません。

2. 使用するモデルのライセンス

ComfyUIは多数のAIモデルを利用できますが、モデルごとにライセンスが異なります。商用利用可能なモデルとそうでないモデルがあるため、使用するモデルのライセンスを必ず確認してください。

代表的なモデルのライセンス状況は以下の通りです。

| モデル | ライセンス | 商用利用 |

|---|---|---|

| Stable Diffusion 1.5 | CreativeML Open RAIL-M | 条件付き可 |

| SDXL | SDXL License | 条件付き可 |

| Flux.1 [schnell] | Apache 2.0 | 可 |

| Flux.1 [dev] | 非商用ライセンス | 不可 |

ここで注目すべきは、同じFlux.1でもバリエーションによって商用利用の可否が異なる点です。モデルのダウンロードページ(Hugging FaceやCivitaiなど)で、必ずライセンスを確認してから利用してください。

3. 生成物の著作権と倫理的配慮

AI生成物の著作権は国や地域によって解釈が異なり、日本では文化審議会で議論が続いています。また、他者の著作物を模倣する画像の生成や、差別的な内容の生成など、倫理面での配慮も求められます。

ComfyUIを商用利用する場合は、上記の3点に注意し、責任を持って使用してください。

【関連記事】

➡️Stable Diffusionの商用利用を解説!モデルやライセンス別の確認方法も

ノードベースのAI活用を学んだ先にある組織の業務設計

ComfyUIのワークフロー構築を通じてAIの動作原理や自動化の考え方を体感できたなら、その視点は画像生成に留まらず業務領域にも応用できます。組織としてAIを本格導入するには、どの業務から着手し、どう段階的に拡大するかの設計が欠かせません。

AI総合研究所では、Microsoft環境でのAI業務自動化を段階設計する実践ガイド(220ページ)を無料で配布しています。経費精算や申請業務などの部門別ユースケースを、導入効果のBefore/After付きで具体的に解説しています。

AI総合研究所が、AI技術への理解を組織全体の業務効率化に結びつけるプロセスを伴走支援します。

画像生成AIの活用を業務設計に広げる

段階的なAI導入の実践ガイド(220p)

ComfyUIで画像生成ワークフローを理解した後は、AI活用を画像生成に限らず組織の業務プロセスに広げる段階設計が次のステップです。Microsoft環境でのAI導入ロードマップと部門別ユースケースを220ページの実践ガイドにまとめました。

まとめ

本記事では、ノードベースのAI生成プラットフォーム「ComfyUI」について、基本的な概念からDesktop版のインストール、実践的な使い方まで解説しました。

2026年2月現在のComfyUIは、以下の3つの点で進化を遂げています。

- Desktop版の正式リリースとAMD GPU対応により、ワンクリックインストールで誰でも利用可能に。NVIDIA以外のGPUユーザーにも門戸が広がりました

- Flux.1/Flux.2、WAN 2.1/2.2、LTX-2など最新モデルへの対応が進み、画像だけでなく動画・音声生成まで1つのプラットフォームで完結

- ComfyUI Managerの公式統合とテンプレートライブラリにより、カスタムノードやワークフローの管理がさらに容易に

ComfyUIの特徴であるノードベースのワークフロー構築により、複雑な生成パイプラインも直感的に設計・管理できます。画像生成AIの導入を検討されている方にとって、ComfyUIは強力な選択肢となるでしょう。

【関連記事】

➡️FLUX.1とは?使い方や料金、プロンプトを徹底解説!

➡️Stable Diffusion Web UI Forgeのインストール方法・使い方をわかりやすく解説!

➡️動画生成AIとは?無料サービスの紹介、ローカル利用、使い方まで徹底解説