この記事のポイント

ChatGPTを日常利用しているなら設定変更は不要、自動でGPT-5.5 Instantに切り替わるためまず応答品質の変化を業務文脈で確認すべき

高ステーク領域(医療・法律・金融)の精度が必要なら、ハルシネーション52.5%削減の効果を活かせる用途から優先的にトライアル

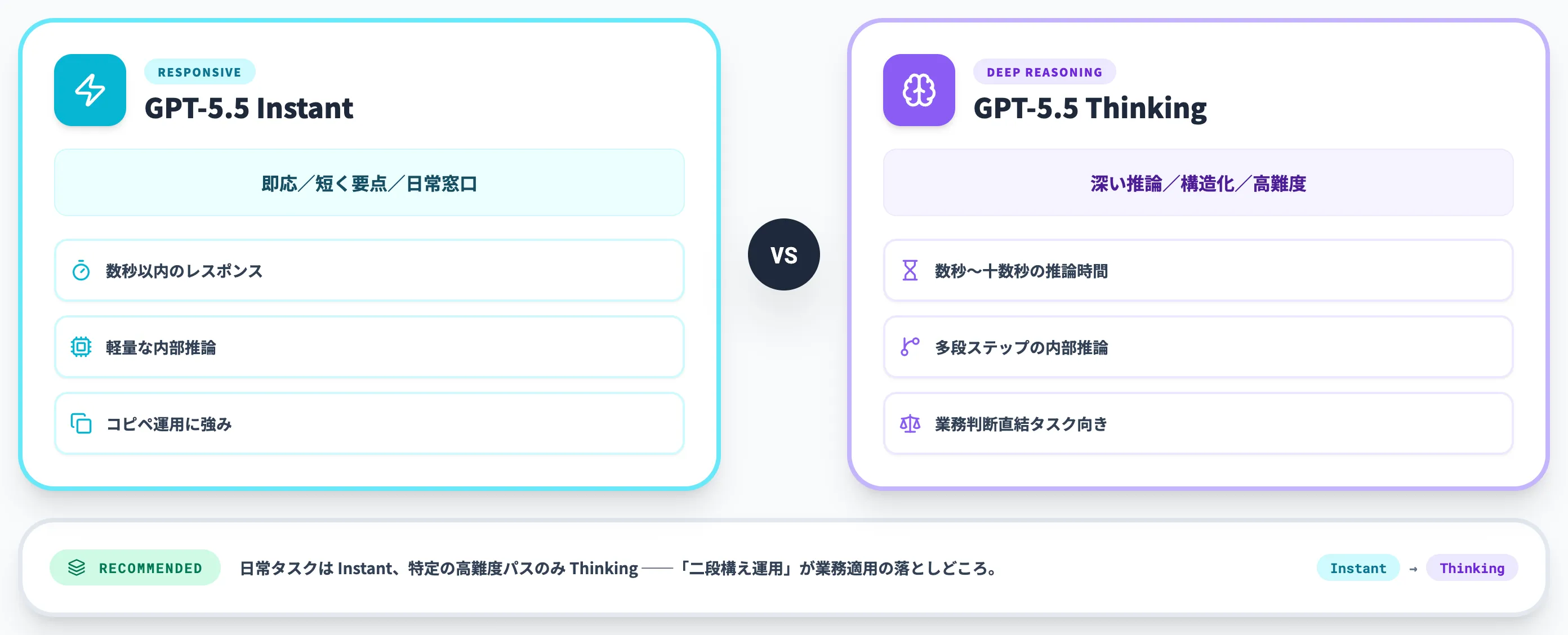

即応性重視のチャット業務はGPT-5.5 Instant、長文推論や複雑な分析はGPT-5.5 Thinkingという二段構えが基本

API連携を運用しているなら、chat-latestへの切替を進めつつ、本番固定モデルは公式のAPI deprecations情報で提供期間を個別に確認して移行計画を引く

メモリソース機能を業務利用するなら、参照対象(保存メモリ・過去チャット・Gmail)の管理権限と削除手順を運用設計に組み込む

Microsoft MVP・AIパートナー。LinkX Japan株式会社 代表取締役。東京工業大学大学院にて自然言語処理・金融工学を研究。NHK放送技術研究所でAI・ブロックチェーンの研究開発に従事し、国際学会・ジャーナルでの発表多数。経営情報学会 優秀賞受賞。シンガポールでWeb3企業を創業後、現在は企業向けAI導入・DX推進を支援。

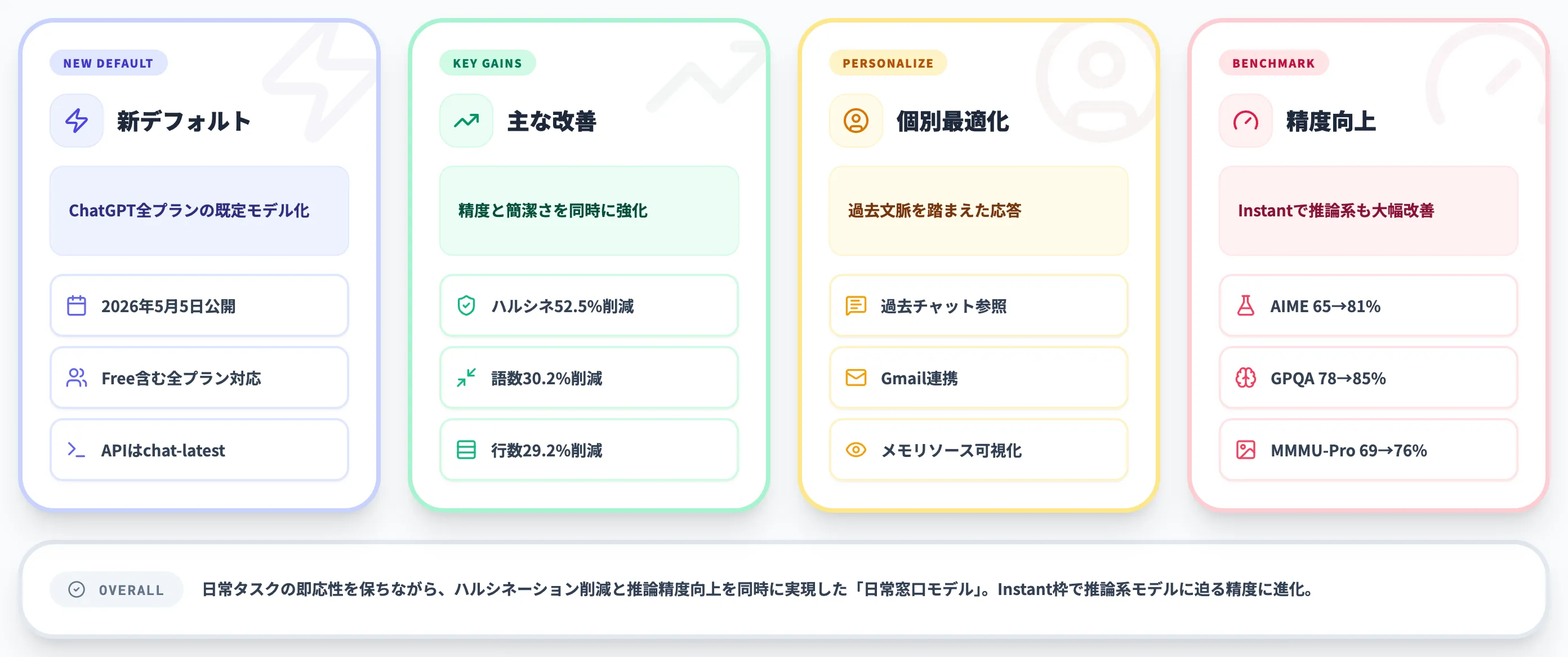

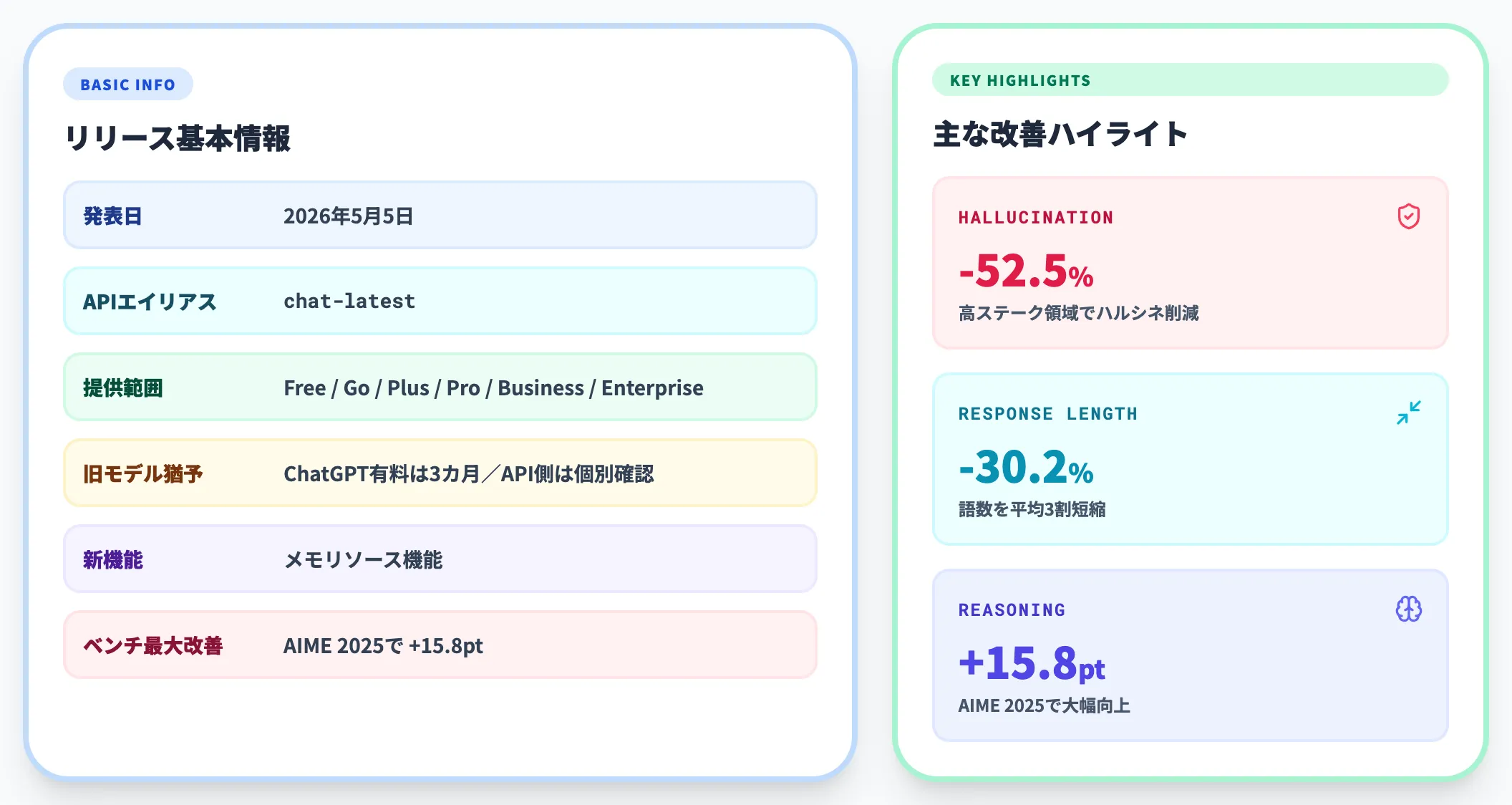

OpenAIは2026年5月5日、ChatGPTのデフォルトモデルを「GPT-5.5 Instant」に切り替えました。

医療・法律・金融など高ステークなプロンプトでハルシネーションを52.5%削減し、応答の語数を30.2%・行数を29.2%短縮しつつ、過去チャット・ファイル・Gmailを参照した個別最適な回答を返せるようになっています。

新機能のメモリソースでは、回答に使われた参照情報をユーザーが確認・削除できるようになり、業務利用での透明性が一段引き上げられました。

本記事では、GPT-5.5 Instantの主な進化ポイント、GPT-5.5 Thinkingとの使い分け、パーソナライゼーション機能、API(chat-latest)の使い方、料金体系、運用上の注意点まで2026年5月時点の公式情報をもとに体系的に解説します。

GPT-5.5 Instantとは?ChatGPT新デフォルトモデルの全体像

GPT-5.5 Instantは、OpenAIが2026年5月5日にChatGPTの新しいデフォルトモデルとして公開した、即応型の最新モデルです。前バージョンのGPT-5.3 Instantを置き換える形で全プランに展開され、APIでは「chat-latest」というエイリアスから呼び出せます。

OpenAIは公式ブログで「Instantは何億人ものユーザーが日常的に触れるモデル」と位置づけており、わずかな改善でも体験全体に大きく波及することを強調しています。GPT-5.5 Instantの方向性は、フラグシップ版GPT-5.5で実現された知性をもう一段「日常タスクで効くサイズ」に最適化することにあり、内部評価ではハルシネーション52.5%削減・応答語数30.2%削減という二つの数値が同時に達成されました。

実務面で重要なのは、ChatGPTのデフォルトとして使われるモデルが切り替わったタイミングは、業務に組み込まれているチャットフローの「挙動が変わる瞬間」と一致するという点です。応答長・トーン・絵文字の使い方まで変化しているため、社内BotやAPI連携を抱えるチームは、何が変わって何が変わっていないかを早めに把握しておく必要があります。

GPT-5.5 Instantのリリース概要

リリース時点の基本情報を整理します。

| 項目 | 内容 |

|---|---|

| 発表日 | 2026年5月5日 |

| APIモデル名 | chat-latest(最新ChatGPT既定を指すエイリアス)。本番固定はgpt-5.5や日付付きスナップショット名 |

| 提供範囲 | 全ChatGPTユーザー(無料・Go・Plus・Pro・Business・Enterprise) |

| 旧モデル提供期間 | ChatGPT上のGPT-5.3 Instantは有料ユーザーに限り3カ月間モデル設定から利用可能。API側のgpt-5.3-chat-latestの廃止スケジュールは公式のAPI deprecations情報で個別確認 |

| 主な改善 | ハルシネーション52.5%削減(高ステーク領域)、応答語数30.2%・行数29.2%削減 |

| パーソナライゼーション | 過去チャット・ファイル・Gmail参照(Plus・Pro先行→順次拡大) |

| 新機能 | メモリソース(参照ソースの可視化と管理) |

| ベンチマーク改善幅(最大) | AIME 2025で65.4%→81.2%、GPQAで78.5%→85.6% |

この表で実務にもっとも効く項目は、APIで最新ChatGPT既定を指すエイリアス「chat-latest」が用意された点と、ChatGPT上のGPT-5.3 Instantが有料ユーザー向けに3カ月残る点の2つです。ChatGPT利用しているチームはこの3カ月で応答品質の差分を業務テストしておく必要があり、API連携を抱えるチームは別軸でgpt-5.3-chat-latestのdeprecation情報を確認して切替時期を見極めます。

特に注意したいのは、chat-latestがChatGPTの最新デフォルトを指す「動くエイリアス」だという性質です。GPT-5.5 Instantが将来さらに新しいInstantモデルに置き換われば、chat-latestもそちらを向きます。本番システムで挙動を固定したい場合は、後段で説明するようにスナップショット型のモデル名で並走運用するのが安全です。

GPT-5.xファミリー内での位置づけ

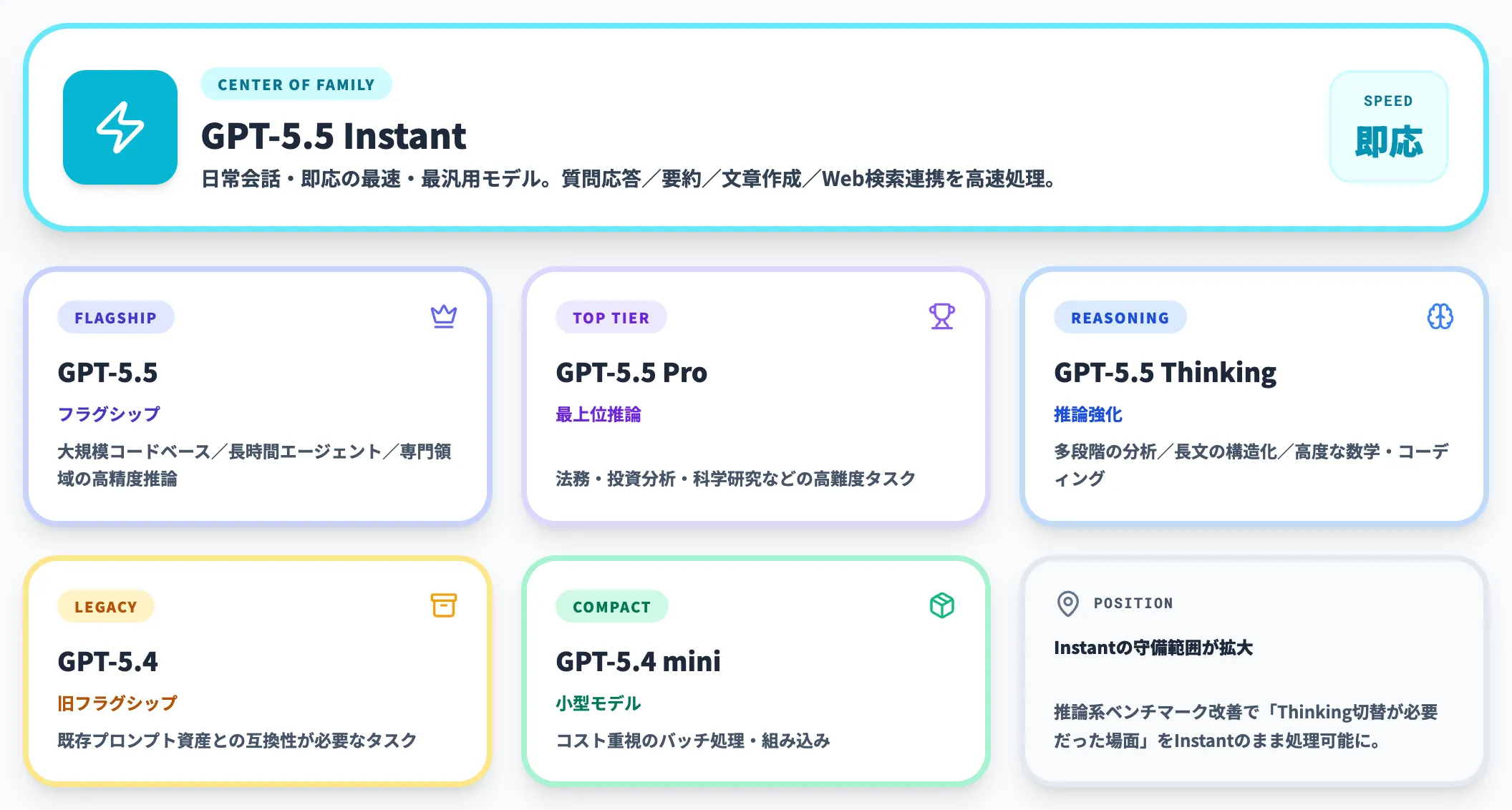

GPT-5.5 Instantは、GPT-5.xファミリーのなかで「最速・最汎用の日常モデル」というポジションを担います。同じファミリーの主要モデルを並べると、それぞれの守備範囲がはっきり見えてきます。

| モデル | 役割 | 主な用途 |

|---|---|---|

| GPT-5.5 | フラグシップ | 大規模コードベース、長時間エージェント、専門領域の高精度推論 |

| GPT-5.5 Pro | 最上位推論 | 法務・投資分析・科学研究などの高難度タスク |

| GPT-5.5 Thinking | 推論強化 | 多段階の分析、長文の構造化、高度な数学・コーディング |

| GPT-5.5 Instant | 日常会話・即応 | 質問応答、文章作成、要約、Web検索連携 |

| GPT-5.4 | 旧フラグシップ | 既存プロンプト資産との互換性が必要なタスク |

| GPT-5.4 mini | 小型モデル | コスト重視のバッチ処理・組み込み |

ファミリー全体を俯瞰すると、フラグシップ・Pro・Thinkingが「処理時間をかけて精度を取りに行く側」、Instantは「処理時間を抑えて回数をさばく側」という役割の分担になっています。

GPT-5.5 Instantが今回のアップデートで重要なのは、Instant枠でありながら推論系ベンチマークも大きく改善したことで、「日常窓口」の守備範囲が一段広がった点です。これまで「精度が必要だからThinkingに切り替える」と判断していた場面の一部を、Instantのまま処理できるようになっています。

GPT-5.5 InstantとGPT-5.5 Thinkingの実務での使い分けは判断に迷うポイントが多いため、後段の専用H2でケース別に整理します。

【関連記事】

GPT-5.5とは?使い方や料金、GPT-5.4との違いを解説!

GPT-5.5 Instantの主な進化ポイント

GPT-5.5 Instantのアップデートは、ベンチマーク数値と日常体験の質感の両方で進化が確認できる構成になっています。OpenAI公式発表をもとに、進化のポイントを5つに分けて整理します。

高ステーク領域でのハルシネーション52.5%削減

GPT-5.5 Instantは、OpenAI内部の評価で医療・法律・金融など「高ステーク」と分類されるプロンプトについて、GPT-5.3 Instant比でハルシネーションを52.5%削減したと公表されています。さらに、ユーザーが事実誤認をフラグした難会話においても、誤った主張が37.3%減少しました。

OpenAIが具体例として挙げているのは数学の連立方程式問題です。GPT-5.3 Instantは「解なし」と誤った結論で停止していましたが、GPT-5.5 Instantは式変形のミスを自分で気付いて修正し、二次方程式を解き直して正しい解にたどり着いています。「初手の誤りを踏襲せず、検算で立て直す」挙動は、業務でファクトチェック工程を挟む側にとって意味のある変化です。

ハルシネーションは確率的に発生するためゼロにはなりません。回答をそのまま業務判断に持ち込まずレビュー工程を挟む業務であれば、レビュー側の負担と差し戻し回数の両方が下がる効果は実用的に期待できます。とくに医療・法律・金融は「もっともらしいが間違った回答」が一番怖い領域なので、社内の情報整理・初稿作成フェーズから慎重にトライアルを始めるのが現実的です。

応答の簡潔化と「絵文字・前置き・追問」の削減

GPT-5.5 Instantは、同じ内容を伝えるのに使う語数を平均30.2%、行数を29.2%削減しています。OpenAIは公式発表のなかでコミュニケーション相談の比較例を示しており、GPT-5.5 Instantはより実務的なスクリプトを短く出す方向に振っているのが特徴です。

応答が短くなったことに付随して、次の3点も意識的に抑えられました。

- 不要な絵文字

冗長な絵文字で会話を装飾するスタイルが整理され、ビジネス文脈での違和感が下がりました。

- 過剰な前置き

回答前に長い注意書きや断りを並べる傾向が削減され、質問の核に直接答える形に寄っています。

- 不必要なフォローアップ質問

答える前に「もう少し詳しく教えてください」と追問するパターンが減り、その場の情報で最善の回答を返す方向に調整されています。

業務での副次的な効果として、チャット応答のコピペ運用がやりやすくなりました。議事録要約・顧客対応のドラフト作成など、「短く・要点で・コピペで使う」シーンとの相性が良くなっています。

一方で、初心者向けの丁寧な解説や雑談的な会話を期待する文脈では「クールになりすぎた」と感じる場合があります。ChatGPTのカスタムインストラクションでトーン指定を入れている場合は、再度プロンプトを調整したほうが意図どおり動きやすいです。

マルチモーダル・STEM精度の強化

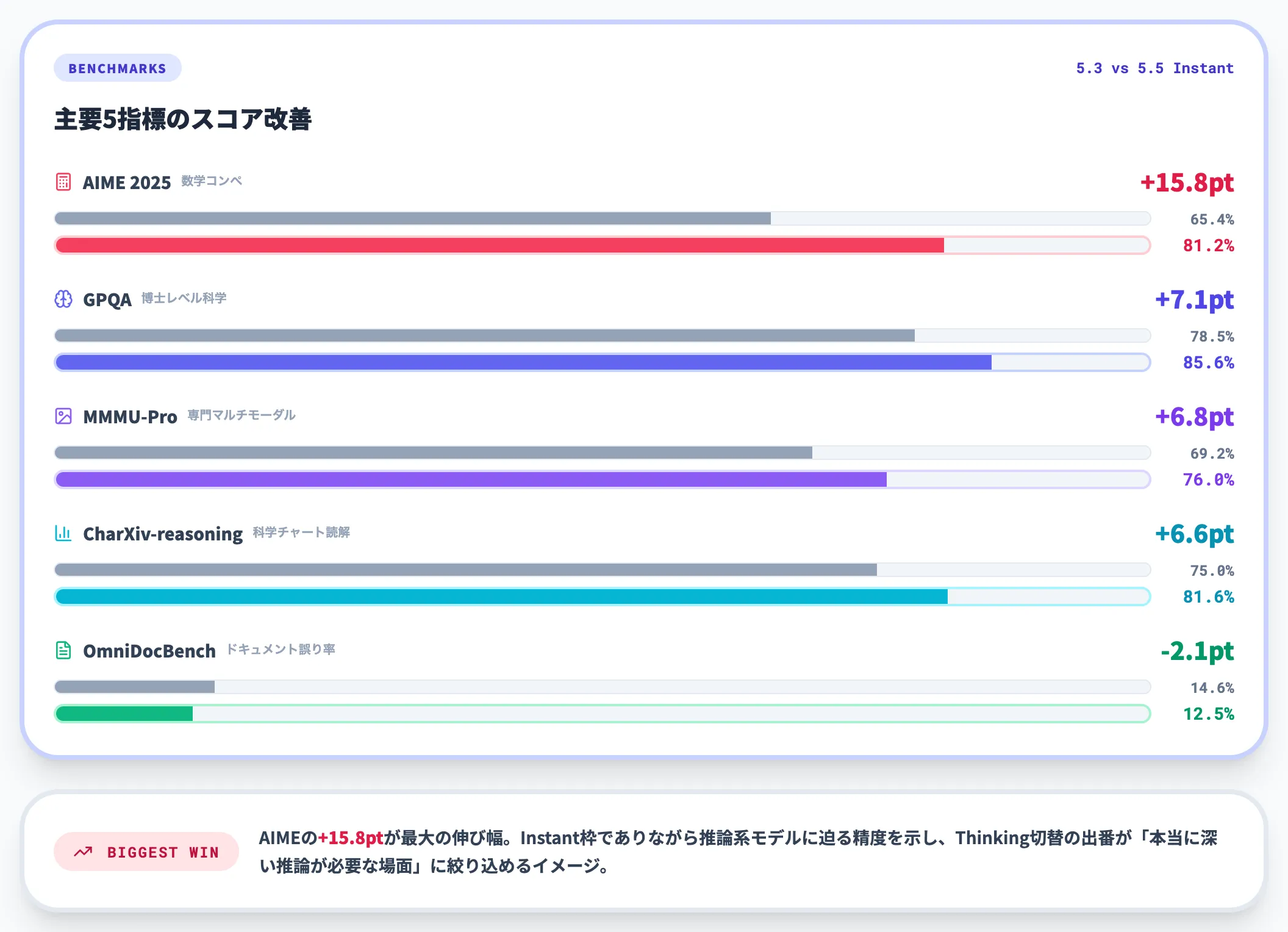

GPT-5.5 Instantは、画像・チャート・ドキュメント解析と、数学・科学領域の推論能力でも明確な前進がありました。OpenAIが公開した主要ベンチマークの数値を整理します。

ベンチマーク用語の解説

- CharXiv-reasoning

arXivに掲載された科学論文のチャートを読み解く能力を測るベンチマーク。グラフから数値を読み、論文の主張と整合的な解釈ができるかを評価します。

- MMMU-Pro

専門領域のマルチモーダル理解を測る難易度の高いベンチマーク。画像と文章を組み合わせた専門問題で、博士レベルの理解が問われます。

- OmniDocBench

ドキュメント(PDF・スキャン文書等)を構造化して読み取る能力の指標。誤り率(低いほど良い)で評価します。

- GPQA

博士号保持者が作成した物理・化学・生物の多肢選択式問題198問の「Google-proof」ベンチマーク。Web検索しても非専門家は34%しか解けず、深い専門理解が問われます。

- AIME 2025

2025年のAmerican Invitational Mathematics Examination。米国の高校数学コンペで、上位選抜のための難問構成。

| ベンチマーク | 評価対象 | GPT-5.3 Instant | GPT-5.5 Instant | 改善幅 |

|---|---|---|---|---|

| CharXiv-reasoning | 科学チャート読解 | 75.0% | 81.6% | +6.6pt |

| MMMU-Pro | 専門マルチモーダル推論 | 69.2% | 76.0% | +6.8pt |

| OmniDocBench | ドキュメント解析(誤り率) | 14.6% | 12.5% | -2.1pt |

| GPQA | 博士レベル科学 | 78.5% | 85.6% | +7.1pt |

| AIME 2025 | 数学コンペ | 65.4% | 81.2% | +15.8pt |

もっとも伸び幅が大きいのはAIME 2025の+15.8ポイントで、競技数学レベルの問題に対するInstant枠の解答力が大きく引き上げられました。GPQAも+7.1ポイントの改善で、博士相当の科学問題に対する基礎力が底上げされています。

数値で見ると、Instant枠でありながら推論系モデルに迫る精度を示しているのが今回のアップデートの肝です。これまで「ChatGPTで数式や論文の確認をやらせるならThinkingに切り替えるべき」と判断していたケースでも、Instantのまま済ませられる場面が増えています。

実務観察では、研究者向け以外の一般業務(社内資料の数値検算、プレゼン用チャートの読み解き、簡易な分析依頼)はInstantで概ね回るようになり、Thinkingの出番が「本当に深い推論が必要な場面」に絞り込めるイメージです。

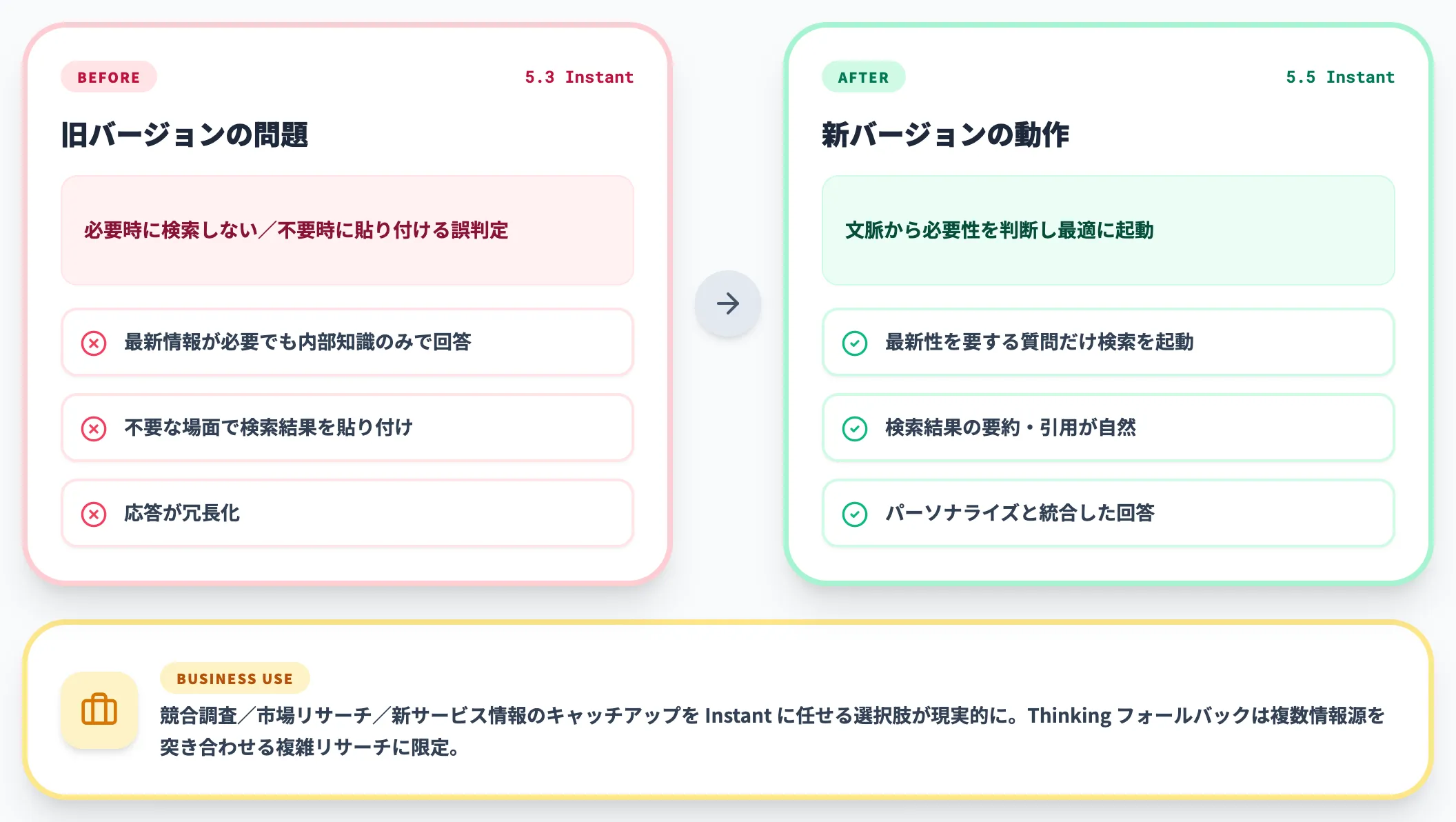

Web検索の使いどころが賢くなった

GPT-5.5 Instantは、回答にWeb検索を使うかどうかの判断精度が向上しています。前バージョンでは検索が必要な質問でも内部知識のみで回答してしまうケースや、逆に不要な場面で検索結果をそのまま貼り付けて応答が冗長になるケースが見られました。

新バージョンでは、ユーザーの質問が「最新情報を要するか」「内部知識で十分か」を文脈から判断する精度が上がっており、検索が走った場合の要約・引用も自然になっています。Plus・ProプランでGmailや過去チャットを連携している場合は、Web検索とパーソナライゼーションを組み合わせた回答が生成されるため、業務リサーチの「下書き」としての精度が一段上がります。

業務適用の観点では、競合調査・市場リサーチ・新サービス情報のキャッチアップなど、これまで担当者が手作業でWeb検索→要約していた業務をInstantに任せる選択肢が現実的になります。Thinkingにフォールバックさせる必要があるのは、複数情報源を突き合わせて結論を出すような複雑なリサーチに限られてきます。

GPT-5.3 Instantとの数値比較

GPT-5.3 Instantから一気に切り替えるユーザー向けに、主な改善幅を1枚にまとめます。

| 評価軸 | GPT-5.3 Instant | GPT-5.5 Instant | 改善内容 |

|---|---|---|---|

| 高ステーク領域のハルシネーション | 基準値 | 52.5%削減 | 医療・法律・金融などのプロンプトで誤情報生成を半減 |

| 難会話の不正確主張 | 基準値 | 37.3%削減 | ユーザーが事実誤認をフラグした難プロンプト群 |

| 応答の語数 | 基準値 | 30.2%削減 | 同じ情報をより簡潔に伝達 |

| 応答の行数 | 基準値 | 29.2%削減 | 行数ベースでも簡潔化を確認 |

| 数学コンペ(AIME 2025) | 65.4% | 81.2% | +15.8pt |

| 博士レベル科学(GPQA) | 78.5% | 85.6% | +7.1pt |

| 専門マルチモーダル(MMMU-Pro) | 69.2% | 76.0% | +6.8pt |

| 科学チャート読解(CharXiv) | 75.0% | 81.6% | +6.6pt |

| ドキュメント誤り率(OmniDocBench) | 14.6% | 12.5% | -2.1pt(誤り減少) |

表の特徴は、定性的な体験品質(ハルシネーション・簡潔性)と定量的なベンチマーク精度の両方が一斉に改善している点です。Instant版のアップデートとしては前世代の比ではない伸び幅で、フラグシップ版のGPT-5.5を支える共通基盤の品質向上がInstantにも波及した結果と考えられます。

【関連記事】

GPT-5.3 Instantとは?主な特徴や使い方、料金を解説!

GPT-5.5 InstantとGPT-5.5 Thinkingの比較

GPT-5.5世代では、ChatGPT上で「Instant」と「Thinking」という2つの利用モードが提供されています。両者は同じGPT-5.5世代の知性をベースにしながら、応答の作り方と適合タスクが異なります。ここでは速度・精度・コスト・適合タスクの4軸で違いを整理します。

速度と応答スタイルの違い

GPT-5.5 Instantは「即応」を優先し、ユーザーの入力後すぐに回答を生成します。一方でGPT-5.5 Thinkingは、回答前に内部で推論時間を使い、必要に応じて短いpreambleやThinking traceを表示する場合があるため、レスポンスまでに数秒から十数秒かかる代わりに、複雑な問題に対する正答率が高くなります。

両モードのスタイルの差を整理すると次のようになります。

| 観点 | GPT-5.5 Instant | GPT-5.5 Thinking |

|---|---|---|

| 平均応答時間 | 数秒以内 | 数秒〜十数秒(推論時間に依存) |

| 応答スタイル | 短く要点 | 構造化・長文も可 |

| 内部推論 | 軽量 | 多段ステップで深く推論 |

| 適合タスク | 質問応答・要約・文章作成 | 数学・コーディング・長文分析 |

| Web検索連携 | 自動・即応 | 自動だが回数は控えめ |

| マルチモーダル | 強化済み | 同水準+深い解釈 |

たとえば「議事録を箇条書きで整理する」業務はInstantで十分ですが、「契約書のリスク条項を法的観点で評価する」のように多段の検討が必要な業務はThinkingに任せた方が品質が安定します。

精度のトレードオフ

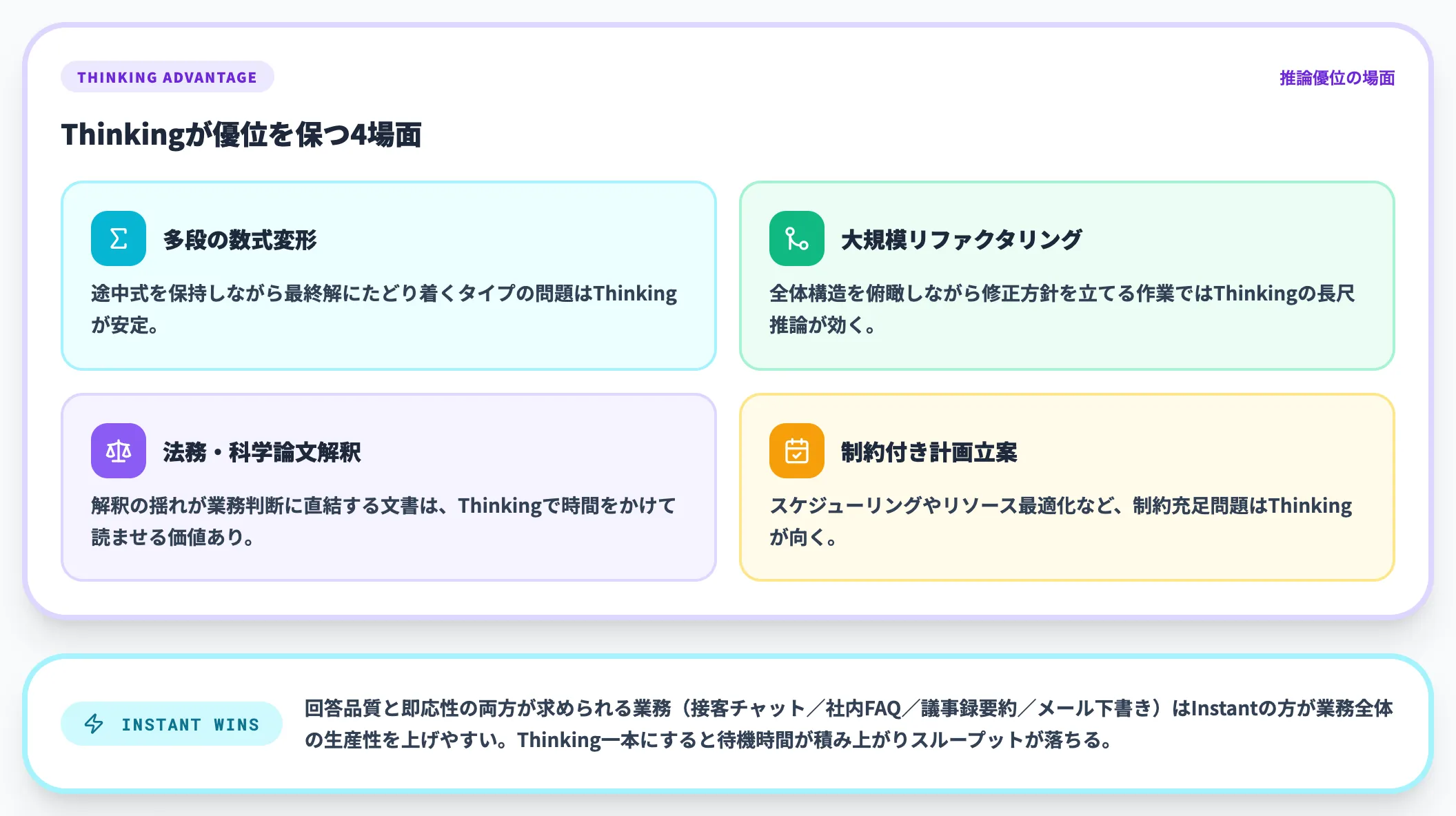

GPT-5.5 Instantは今回のアップデートで推論系ベンチマークも大きく改善しましたが、それでもThinking側にはまだ差があります。とくに次のような場面ではThinking優位が続いています。

- 多段階の数式変形を要する数学問題

途中式を保持しながら最終解にたどり着くタイプの問題はThinkingが安定します。

- 大規模コードベースのリファクタリング設計

全体構造を俯瞰しながら修正方針を立てる作業ではThinkingの長尺推論が効きます。

- 法的文書・科学論文の精緻な解釈

解釈の揺れが業務判断に直結する文書は、Thinkingで時間をかけて読ませる価値があります。

- 複数の制約条件を同時に満たす計画立案

スケジューリングやリソース最適化など、制約充足問題はThinkingが向きます。

逆に、回答品質と即応性の両方が求められる業務(接客チャット、社内FAQ、議事録要約、メール下書き)はInstantの方が業務全体の生産性を上げやすいです。Thinkingで全部回そうとすると待機時間が積み上がり、業務全体のスループットが落ちます。

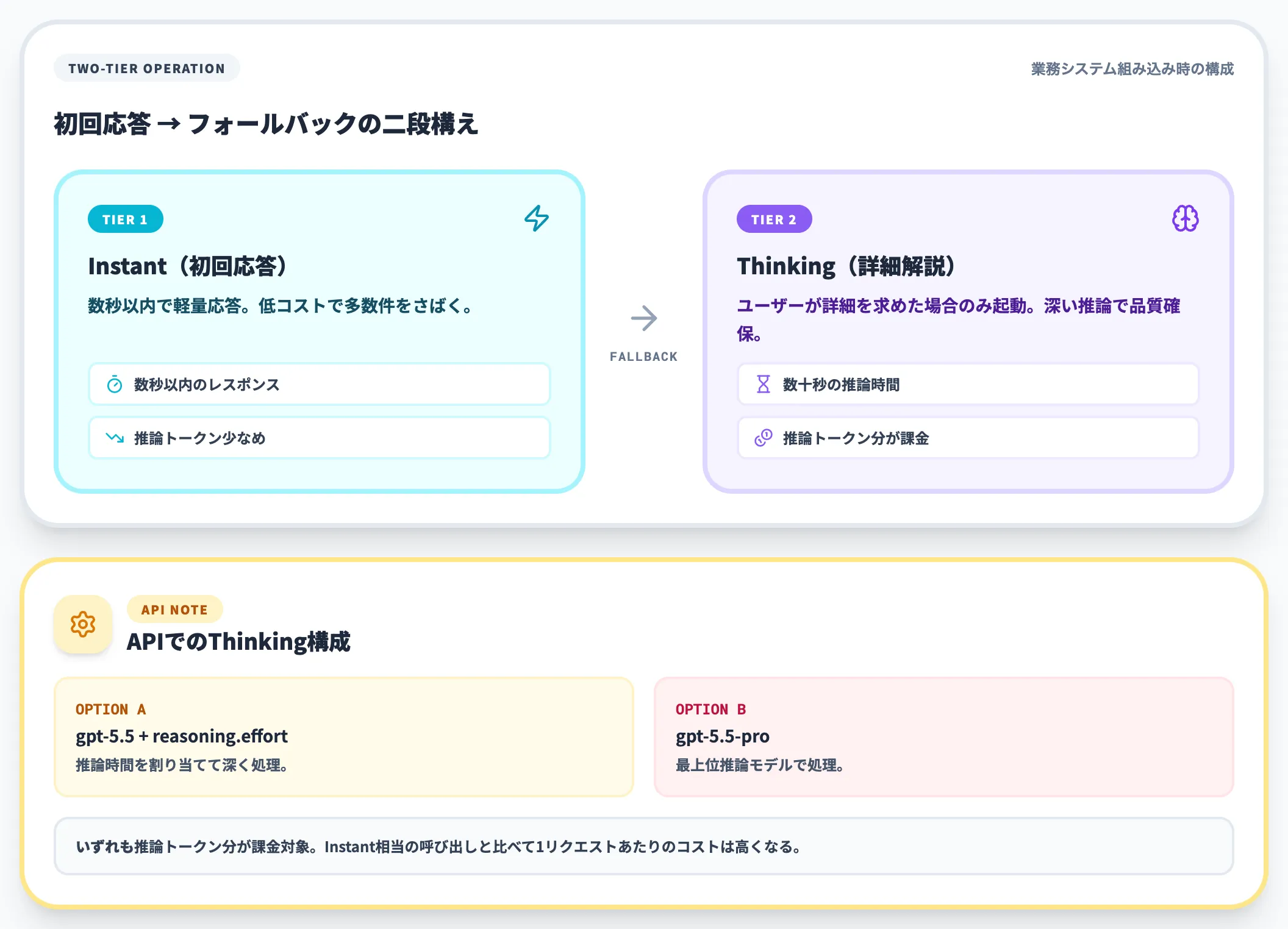

コストとレイテンシの考え方

ChatGPT側ではThinking対応プラン(Plus以上、Business、Enterprise)の枠内で両モードを使えるため、料金面の差はプラン契約内で吸収されます。

一方、API連携で運用する場合は、APIに「GPT-5.5 Thinking」という独立モデル名はなく、gpt-5.5にreasoning.effortを指定して推論時間を割り当てるか、上位のgpt-5.5-proを呼び出す構成になります。

いずれも推論トークン分が課金対象に含まれるため、Instant相当の呼び出し(reasoning.effortを低めに設定したgpt-5.5やchat-latest)と比べて1リクエストあたりのコストが高くなる構造です。

業務システム組み込みの観点では、「初回応答はInstantで返し、ユーザーが詳細解説を求めた場合のみThinkingにフォールバック」という二段構えが現実的です。これは10663で解説しているフラグシップ/Pro/Instantの段階運用にも通じる考え方で、世代をまたいでも応用が利きます。

実務上のもう一つのコツは、「同じ質問に対して両モデルを並走させて差分を取る」ベンチマークサイクルを社内で回すことです。Thinkingでしか正解できないタスクと、Instantで十分なタスクの境界が見えてくるため、ルーティング基準が定量的に固まります。

切り替え基準のチェックリスト

実務でInstantとThinkingのどちらを選ぶか迷ったときは、次のチェックリストで判断するのが扱いやすいです。

- 即応が必要、回答品質に致命的な誤りが許容される範囲なら → Instant

コピペ運用するチャットや初稿生成のような「下書き」用途は、Instantのスピード優位が効きます。

- 回答が業務判断に直結する、多段の推論を要するなら → Thinking

法務レビュー・投資分析・複雑な技術設計など、誤読の影響が大きいタスクはThinkingに任せます。

- 1日に処理する件数が多い、応答速度がそのままユーザー体験に直結するなら → Instant

顧客対応Bot・社内FAQなどは、Instantのレスポンス速度がCXにそのまま跳ね返ります。

- 月数件の高難度タスクで、待ち時間より精度を優先するなら → Thinking

頻度は低いが品質が重要なタスクは、Thinkingで時間をかけて取りに行く方が割に合います。

- 複雑な質問でも「下書き」を素早く欲しいなら → Instantで初稿、必要に応じてThinkingで精緻化

二段構えのルーティングは、現場運用でもっとも安定する型です。

業務での導入判断で詰まりやすいのは、「Thinkingの方が安全だから全部Thinkingにすればいい」と決め打ちしてしまうケースです。

Thinking一本にするとコストとレイテンシが両方かさみ、ユーザーの体感速度も落ちます。実装側で見ると、「日常タスクはInstant、特定の高難度パスのみThinking」という二層構造が業務適用での落としどころになります。

【関連記事】

GPT-5.5とは?使い方や料金、GPT-5.4との違いを解説!

GPT-5.5 Instantのパーソナライゼーション機能

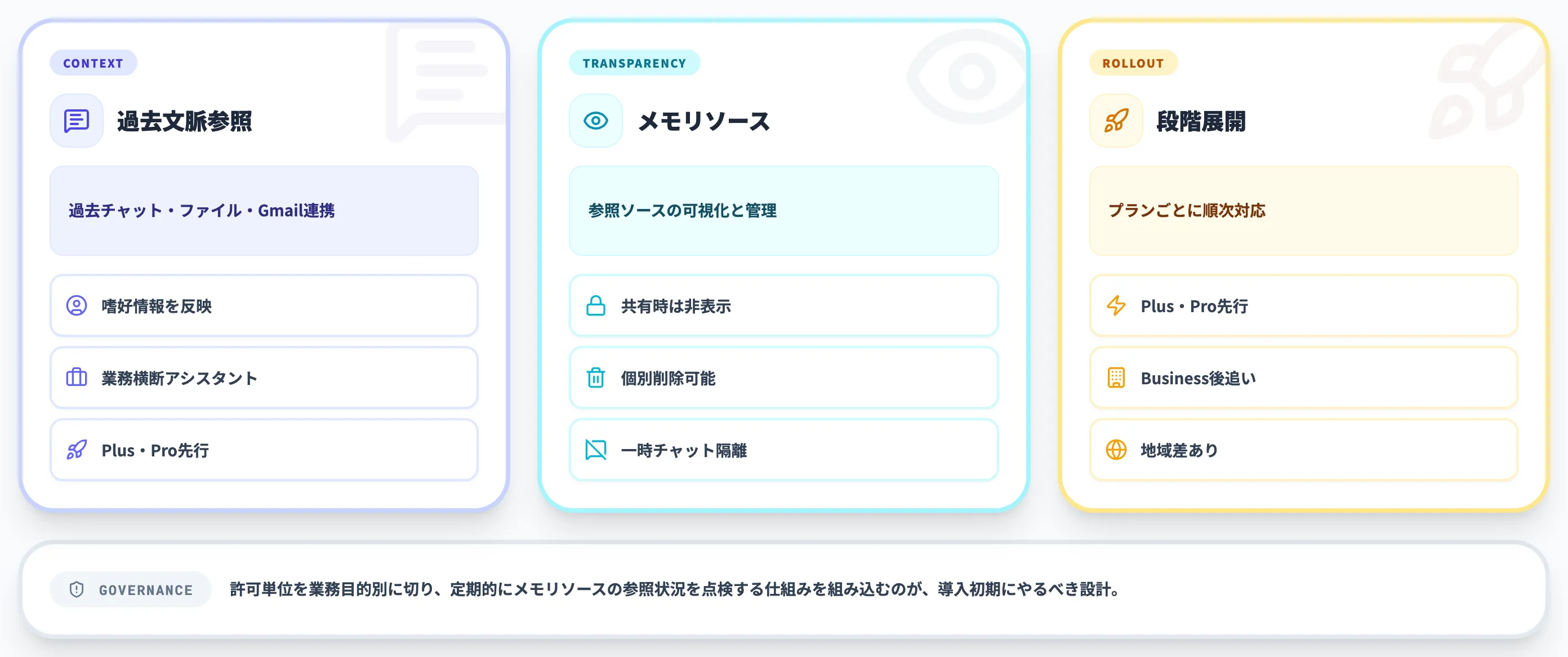

GPT-5.5 Instantのもう一つの大きな進化が、過去の文脈を踏まえた応答を返すパーソナライゼーション機能の強化です。OpenAIは同時に「メモリソース」と呼ばれる新機能をリリースし、参照されたコンテキストをユーザー側で管理できる仕組みも整えました。

過去チャット・ファイル・Gmail連携

GPT-5.5 Instantは、ユーザーが許可した過去チャット・アップロードファイル・連携済みGmailを参照して、応答に文脈を反映させられるようになりました。たとえば「先週話した予算管理ツールについて、続きを設計したい」と問いかけると、過去スレッドから前提条件を取り出した上で議論を再開できます。

OpenAIの公式発表では、サンフランシスコ在住で特定のお茶屋に通っているユーザーに「新しいお茶屋」を聞くと、過去チャットの嗜好情報を踏まえて似た雰囲気の店舗を提案する例が示されています。

汎用的な情報提供ではなく、その人にとって最適化された回答が返る方向にチューニングされています。

業務での応用としては、過去の問い合わせログから「同じ顧客が以前に何を言っていたか」を瞬時に呼び戻す動作が想定でき、議事録・契約書・メールスレッドを横断する「コンテキスト保持型アシスタント」として使えます。

メモリソース機能で参照内容を可視化

GPT-5.5 Instantのアップデートに合わせて、ChatGPT全モデルでメモリソース機能が導入されました。応答が個別文脈に基づいて生成された場合、どのソース(保存メモリ・過去チャット・連携アプリ)が参照されたかをユーザーが確認でき、不要な情報は削除・修正できます。

メモリソースの主な特徴は次のとおりです。

- 共有チャットには参照ソースが含まれない

プライバシー保護の観点で、共有リンクを開いた相手にはメモリソースは表示されません。

- 保存メモリは設定画面から個別に削除・編集可能

不要になったメモリ単位で消せるため、退職者の情報や古いプロジェクト情報をクリーンに保てます。

- 一時チャットを使えばメモリを参照・更新せずに対話できる

検討中の議題やセンシティブな相談は、一時チャットで隔離して進められます。

- 表示は代表的なソースに絞られる

参照された全ソースが表示されるとは限らず、影響度の高いソースが代表として提示されます。

業務利用の観点では、回答に何が使われたかを部分的に確認できるようになったことで、社内のコンプライアンス担当やレビュアーが「この応答は何を根拠にしたか」を点検する起点を持てるようになりました。

とくに金融や医療のように説明責任が重い領域では、メモリソースを「確認の入口」として運用設計するのが現実的です(メモリソースは代表的な参照ソースの可視化機能で、回答形成に影響した全要素を網羅表示するわけではない点には留意が必要です)。

対象プランと展開予定

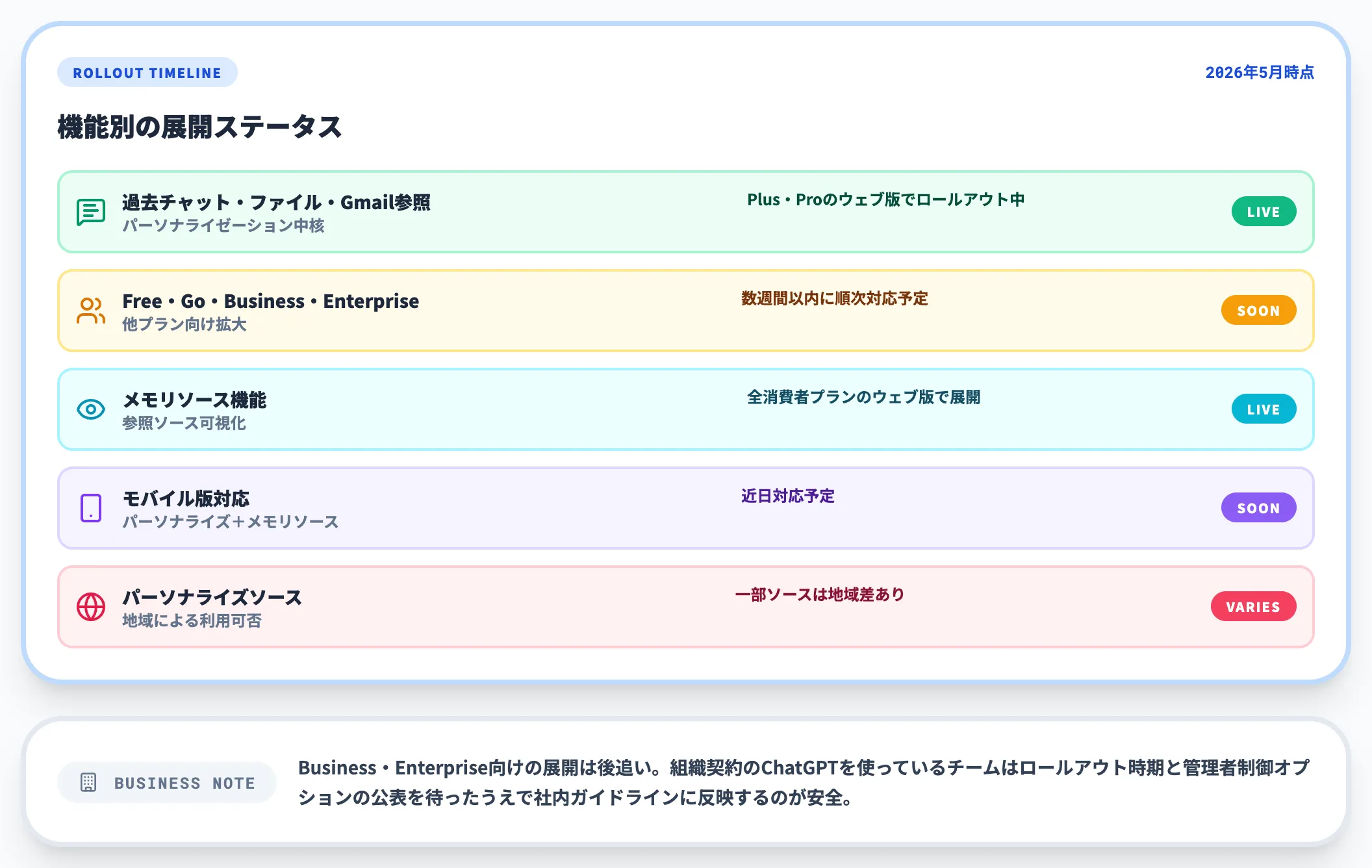

パーソナライゼーション機能の展開は、プランごとに段階的に進みます。OpenAIの公式発表に基づく整理は次のとおりです。

| 項目 | 提供範囲 |

|---|---|

| 過去チャット・ファイル・Gmail参照 | Plus・Proのウェブ版でロールアウト中、モバイル版近日対応 |

| Free・Go・Business・Enterpriseへの拡大 | 数週間以内に順次対応予定 |

| メモリソース機能 | 全消費者プランのウェブ版で展開、モバイル版近日対応 |

| 地域差 | 一部のパーソナライゼーションソースは地域により利用可否が変動 |

業務利用で注意したいのは、Business・Enterprise向けの展開が後追いになっている点です。組織契約のChatGPTを使っているチームは、ロールアウト時期と管理者側の制御オプションの公表を待ったうえで、社内ガイドラインに反映するのが安全です。

導入支援の現場で見ていると、ガイドラインなしに「とりあえず全社展開」してしまうと、運用開始後しばらく経ったタイミングで「機密情報が他部署のChatGPT回答に出てきた」「個人Gmailを誤連携した」といったインシデントが起こるリスクがあります。許可単位を業務目的別に切り、定期的にメモリソースの参照状況を点検する仕組みを組み込むのが、導入初期にやるべき設計です。

【関連記事】

ChatGPTのメモリ機能とは?会話を忘れる原因と対策・使い方を徹底解説

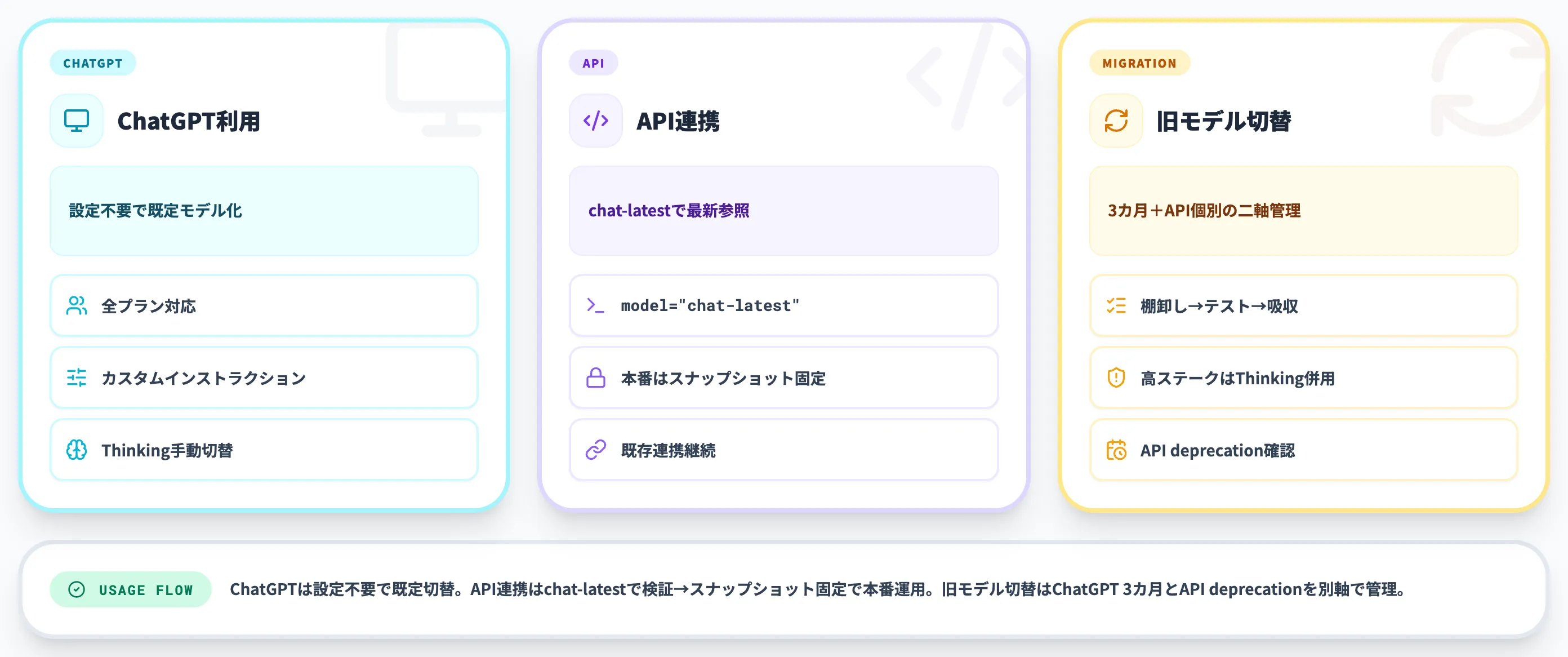

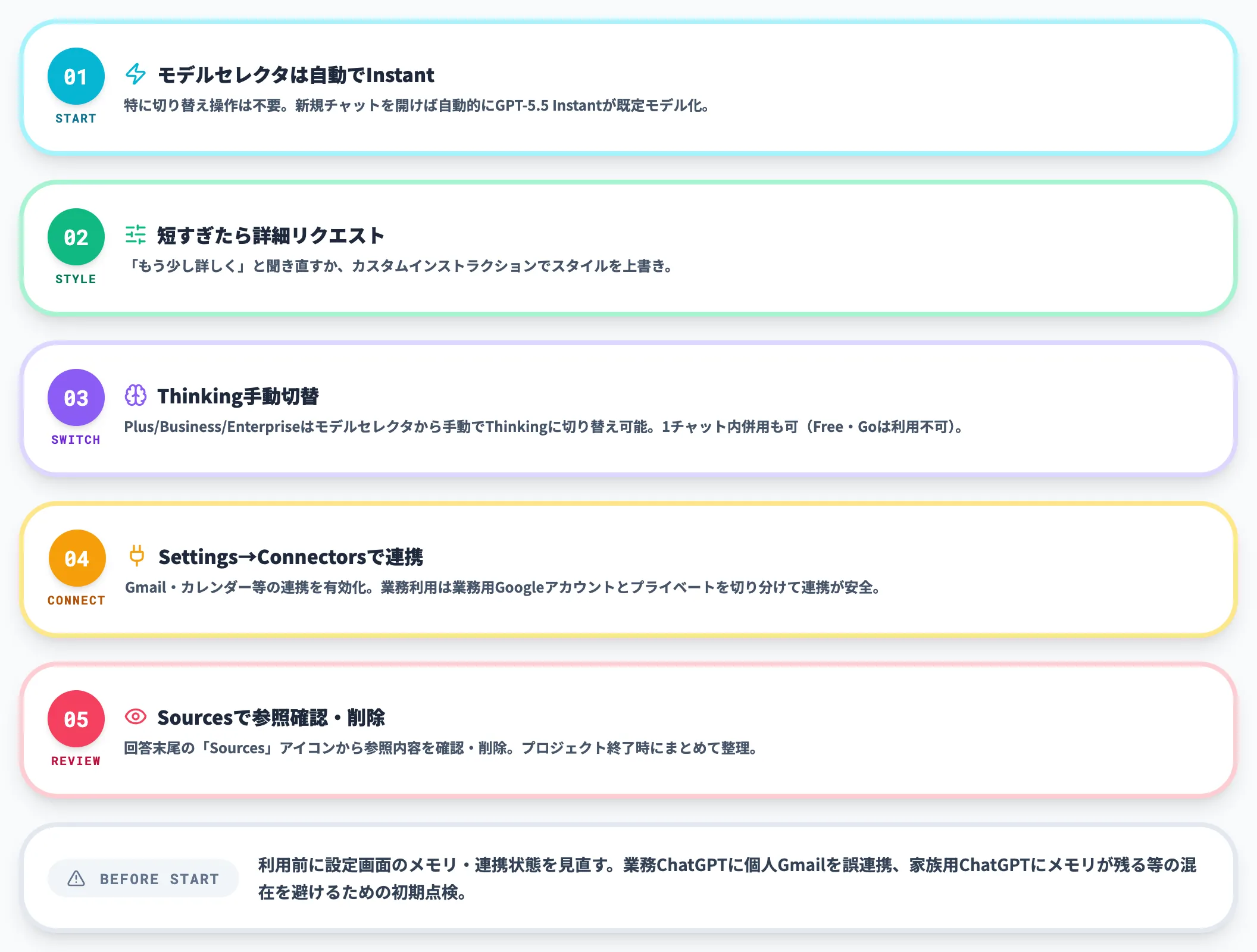

GPT-5.5 Instantの使い方

GPT-5.5 Instantは、ChatGPT・APIの両方から利用できます。ここではユーザーが日常的に使うChatGPT側の操作と、開発者がシステム連携で使うAPI側の呼び出し方をまとめます。

ChatGPTで利用する手順

ChatGPTのウェブ版・モバイルアプリでは、特別な設定なしにGPT-5.5 Instantが既定モデルとして使われます。Free・Go・Plus・Pro・Business・Enterpriseのすべてのプランで利用可能で、無料プランでもメッセージ数の制限内で同じモデルにアクセスできます。

ChatGPTで主に行う操作は次のとおりです。

- モデルセレクタはInstantを指す表記にデフォルトで合っている

特に切り替え操作は不要で、新規チャットを開けば自動的にGPT-5.5 Instantが使われます。

- 応答が短すぎると感じたら「もう少し詳しく」と聞き直すか、カスタムインストラクションでスタイルを上書きする

語数削減の方向性が業務文脈に合わない場合は、明示的に詳細回答を要求します。

- Thinking対応プラン(Plus以上、Business、Enterprise)では、複雑な推論が必要な場面でモデルセレクタからGPT-5.5 Thinkingに手動で切り替える

1チャット内で「初稿はInstant、検証はThinking」のように切り替える運用も可能です(Free・GoプランではThinkingは利用できません)。

- 個別文脈を反映させたい場合は、Gmail・カレンダー等の連携をSettings→Connectorsで有効化する

業務利用なら、業務用Googleアカウントとプライベートを切り分けて連携するのが安全です。

- メモリソースが付与された応答では、回答末尾の「Sources」アイコンから参照内容を確認・削除する

不要な記憶は都度削除し、プロジェクトが終わったタイミングでまとめて整理する運用が現実的です。

初期設定段階で意識したいのは、メモリと連携アプリの権限です。ChatGPTを業務利用しているのに「個人Gmailを連携してしまった」「家族用ChatGPTにメモリが残っている」など環境が混在していると、業務応答に意図しない文脈が混ざります。利用前に一度、設定画面のメモリ・連携状態を見直しておくのが安心です。

APIから利用する手順(chat-latest)

開発者は、OpenAI APIを通してGPT-5.5 InstantをAPI呼び出しから利用できます。OpenAI公式発表によると、APIモデル名はchat-latestというエイリアスで提供され、最新のChatGPT既定モデルが自動で参照される構造になっています。

Pythonでの最小例は次のとおりです。

from openai import OpenAI

client = OpenAI()

response = client.chat.completions.create(

model="chat-latest",

messages=[

{"role": "system", "content": "あなたは丁寧な業務アシスタントです。"},

{"role": "user", "content": "本日のミーティング議事録を3点に要約してください。"},

],

)

print(response.choices[0].message.content)

chat-latestは「常にChatGPTの最新既定モデル」を指すため、OpenAIがさらに新しいInstantモデルをリリースした場合は自動的にそのモデルへ向きます。検証や最新追従にはchat-latestを使い、挙動を固定したい本番システムでは「gpt-5.5」または日付付きの実在スナップショット名(例:gpt-5.5-2026-04-23)を指定するのが安全です。chat-latestは定期的に差し替えられるため本番固定には向きません。

ChatGPT API経由でのストリーミング応答や関数呼び出し、ツール連携などの基本機能は、GPT-5.3 Instantから引き続き利用可能です。プロンプト構造を大きく変える必要はなく、出力スタイルの差分(応答長・トーン)を吸収する調整が中心になります。

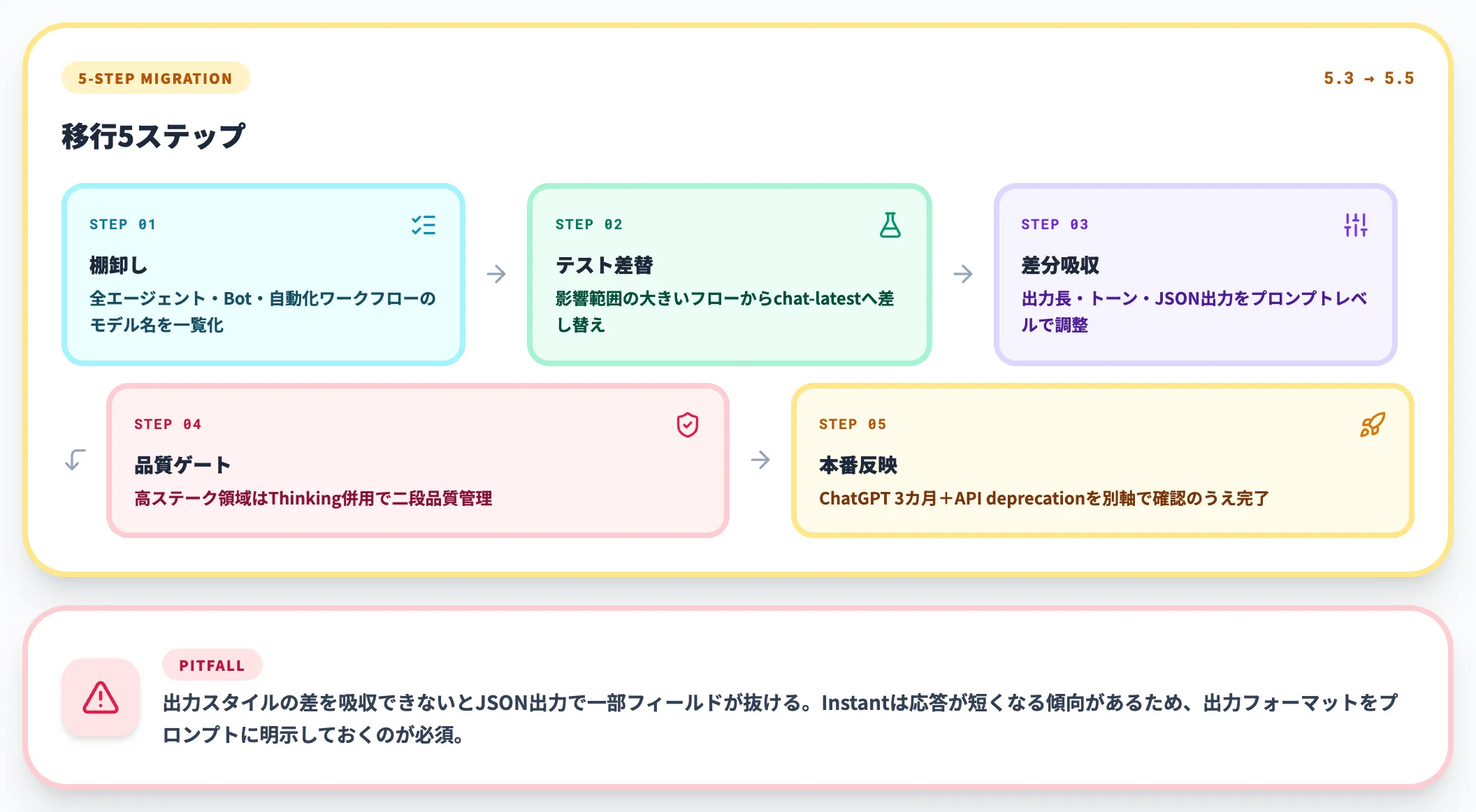

旧モデル(GPT-5.3 Instant)からの切り替え

ChatGPT上のGPT-5.3 Instantは、有料ユーザー(Plus・Pro・Business・Enterprise)に限り3カ月間モデル設定から利用可能です。一方、API側のgpt-5.3-chat-latestの廃止スケジュールは公式のAPI deprecations情報とモデルページで個別に確認する必要があります。ChatGPTとAPIでは提供期間の管理が独立しているため、API連携や業務フローを抱えるチームは両軸で切替計画を立てる必要があります。

切り替えの実務では、次のステップが効きます。

- 連携している全エージェント・Bot・自動化ワークフローのモデル名を棚卸し

APIキーが分散していると、どのコードがどのモデルを叩いているかが見えません。最初に全体像を把握します。

- 影響範囲が大きいフローから順に、テスト環境でchat-latestへ差し替え

顧客向けに直接出力するフローを優先し、社内向けバッチは後回しでも良いです。

- 出力長・トーン・構造化フォーマットの差分をプロンプトレベルで吸収

JSON出力を前提にしているシステムは、出力フォーマットを明示するプロンプトに更新します。

- 高ステーク領域はThinking併用で品質ゲートを設ける

Instantで初稿、Thinkingで最終チェックの二段構えが、移行期のリスク低減に効きます。

- ChatGPT 3カ月猶予とAPI deprecation情報を踏まえて本番反映を完了し、旧モデル名は廃止に備えて削除

ChatGPT上の3カ月猶予と公式のAPI deprecations情報を別軸で確認し、それぞれの期限前にコード・設定・ドキュメントから古いモデル名を整理しきります。

切り替えで詰まりやすいのは、出力スタイルの違いを吸収できていないケースです。GPT-5.5 Instantは応答が短くなる傾向があるため、JSONなど構造化出力を前提にしているシステムでは、プロンプトに出力フォーマットを明示しておかないと一部フィールドが抜けるリスクがあります。

【関連記事】

ChatGPT APIとは?OpenAI APIの使い方や料金、活用事例を解説!

GPT-5.5 Instantと他モデルの使い分け

GPT-5.5 Instantは強力な日常モデルですが、すべての用途を1モデルでさばけるわけではありません。OpenAIのモデルラインナップ全体を俯瞰しながら、ケース別の使い分けを整理します。

業務シーン別の選択マトリクス

主要なモデルを業務シーン別に分類すると、次のようになります。

| 業務シーン | 推奨モデル | 理由 |

|---|---|---|

| 議事録要約・メールドラフト | GPT-5.5 Instant | 即応で十分な精度。コピペ運用と相性が良い |

| 顧客対応Bot・FAQ応答 | GPT-5.5 Instant | レスポンス速度がCXに直結 |

| 法務・契約書レビュー | GPT-5.5 Thinking | 多段の検討が必要、誤読の影響が大きい |

| 大規模コードベース改修 | GPT-5.5(フラグシップ) | 長コンテキストとエージェント性が必要 |

| 投資・金融分析 | GPT-5.5 Pro | 最高精度の推論力 |

| 既存環境のレガシー連携 | GPT-5.4 | 既存プロンプト資産との互換性 |

| バッチ処理・組み込み | GPT-5.4 mini | 大量処理時のコスト効率 |

| エージェント型コーディング | GPT-5.5(Codex経由) | リポジトリ操作・長時間タスク対応 |

表のなかで実務でとくに迷いやすいのは、Thinkingとフラグシップの線引きです。Thinkingは「推論時間で正答率を取りに行く」、フラグシップは「コンテキストとツール連携で長時間タスクを回す」という違いがあり、用途が異なります。日常チャット・FAQはInstant、深い分析はThinking、エージェント運用はフラグシップ、と層を分けて運用するのが扱いやすいです。

コスト・速度・精度のトレードオフ

実装での選定軸を整理すると、コスト・速度・精度は同時には最大化できないため、業務目的に応じた優先度付けが必要です。GPT-5.5世代では次のような関係になっています。

- 速度優先: GPT-5.5 Instant

応答数秒以内で、即応性が業務体験に直結するシーン向き。

- 精度優先: GPT-5.5 Pro/Thinking

数十秒〜分単位の推論時間と引き換えに、誤りが許されないタスクで威力を発揮します。

- コスト優先: GPT-5.4 mini/GPT-5.5 Instant

短いトークンで完結する処理や、大量バッチ処理ではコスト面のアドバンテージが効きます。

- バランス重視: GPT-5.5 Instant

速度・コスト・精度のバランスが取れており、業務の「汎用窓口」として最適なポジションです。

業務システム実装では、「最初の応答はInstant、フォールバックでThinking、月次バッチはmini」のような階層構造が現実的です。1モデルで全部を賄おうとすると、いずれかの軸で必ず無理が出ます。

ケース別のおすすめ構成

導入支援の経験から見ると、次の構成パターンが業務適用でバランスを取りやすいです。

- 社内FAQ・Q&Aアシスタント

Instant単体で十分。応答スピードとコストのバランスが取れる構成です。Thinkingにフォールバックさせる必要があるのは、複数規程をまたぐ複雑な質問に限られます。

- 契約書・法務レビュー支援

ドラフト作成はInstant、最終レビューはThinkingで二段構え。条文ごとにリスク区分を切り替える設計にすると、運用効率と品質が両立します。

- データ分析レポート生成

数値要約はInstant、洞察抽出はThinking、長文ナラティブはフラグシップに振り分け。同じ分析でも「要点抽出」と「物語化」でモデルを分けるのがコツです。

- マーケティングコンテンツ作成

下書きと編集はInstant、SEO戦略やキーワード計画はThinking。短期施策と中長期戦略でモデルを使い分けます。

- コーディング支援

リポジトリ全体の改修はフラグシップ(Codex経由)、即応Q&AはInstant。エージェント運用は別レイヤーとして扱います。

Instantを「日常窓口」として常時稼働させ、特定タスクだけThinkingやフラグシップに切り替える設計にすると、ユーザー体験とコストの両立がしやすくなります。すべてのフローを最高精度モデルで回す構成は、コストと待ち時間が両方かさんで持続しないことが多いです。

【関連記事】

ChatGPTの料金プラン一覧を比較!無料・有料版の違い・支払い方法を解説

GPT-5.5 Instantの料金体系

GPT-5.5 Instantは、ChatGPTの全プランで利用可能です。料金は2026年5月時点の公式料金ページを基準に整理します。為替・税込条件・決済経路により実際の請求額は変動するため、最新の表示を必ず確認してください。

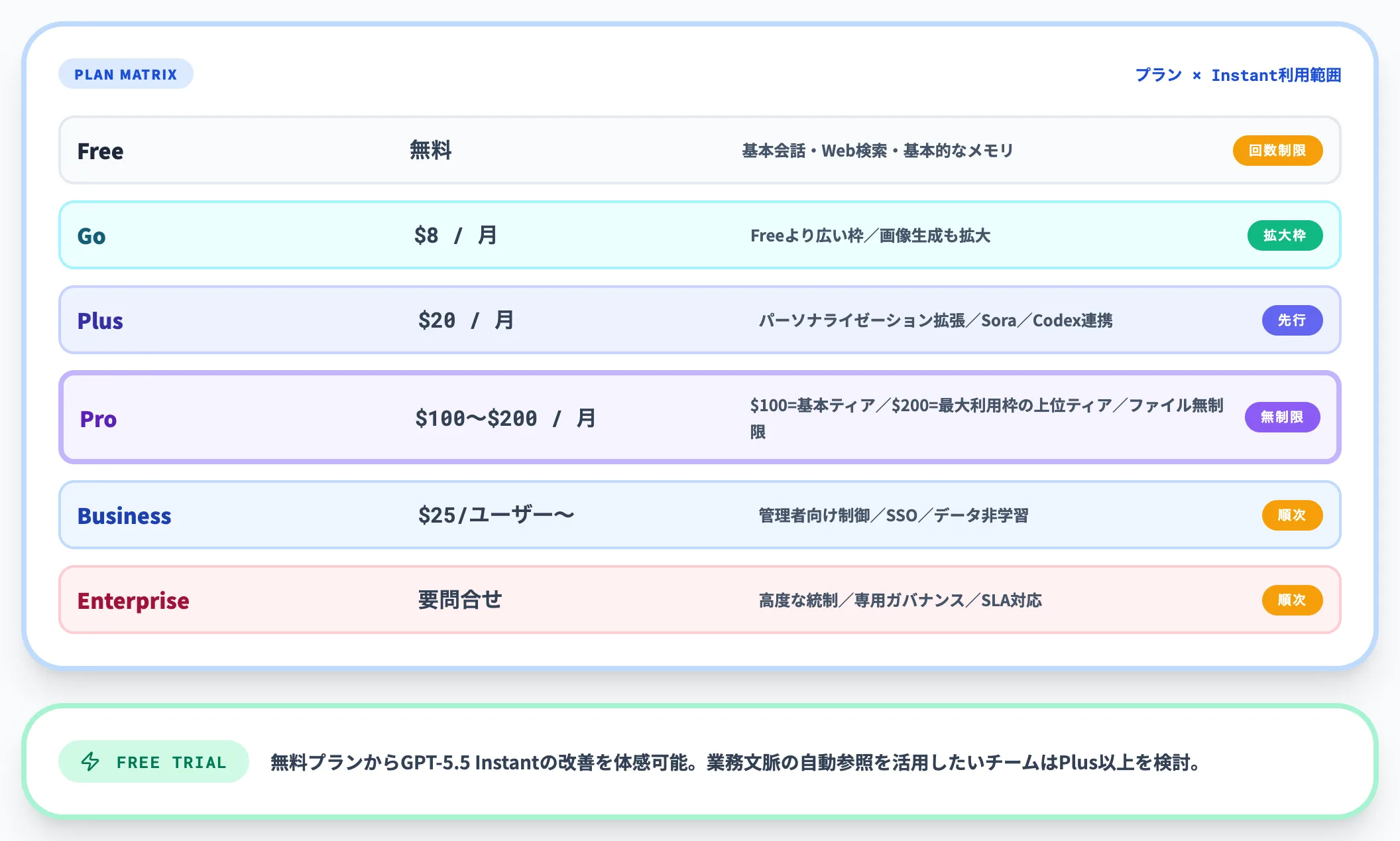

ChatGPTプラン別の利用範囲

ChatGPT各プランでのGPT-5.5 Instantの利用範囲は次のとおりです。

| プラン | 月額(USD) | GPT-5.5 Instant | 主な特徴 |

|---|---|---|---|

| Free | 無料 | 利用可能(回数制限あり) | 基本会話・Web検索・基本的なメモリ |

| Go | $8 | 利用可能 | Freeより広い枠、画像生成も拡大 |

| Plus | $20 | 利用可能 | パーソナライゼーション拡張、Sora、Codex連携 |

| Pro | $100〜$200 | 利用可能(無制限) | Pro $100は基本ティア、Pro $200は最大利用枠の上位ティア。パーソナライゼーション拡張、ファイル無制限 |

| Business | $25/ユーザー〜 | 利用可能(順次) | 管理者向け制御、SSO、データ非学習 |

| Enterprise | 要問い合わせ | 利用可能(順次) | 高度な統制、専用ガバナンス、SLA対応 |

無料プランから利用できるため、個人利用の範囲では追加コストなしでGPT-5.5 Instantの改善を体感できます。一方で、過去チャットやGmailを参照する拡張パーソナライゼーションは2026年5月時点でPlus・Proが先行しているため、業務文脈の自動参照を活用したいチームはPlus以上のプランを検討するのが現実的です。

ChatGPTのプラン詳細・選び方については別記事で解説しています。

API料金とchat-latestのコスト管理

OpenAI APIでGPT-5.5 Instant(chat-latest)を利用する場合、2026年5月時点の公式API Pricingでは入力$5.00/100万トークン、キャッシュ入力$0.50/100万トークン、出力$30.00/100万トークンが公表されています。前バージョンGPT-5.3 Instantは入力$1.75/出力$14だったため、API単価の観点では切り替えに伴うコスト増を見込む必要があります。

API利用時のコスト管理で意識したい点は次のとおりです。

- chat-latestは最新モデル参照のため、コスト変動が起こり得る前提で予算を設計

モデル切替に合わせて単価が見直される可能性があるので、予算は単価固定で組まないのが安全です。

- 本番運用ではスナップショット型のモデル名を併用し、リリースごとに動作検証を挟む

chat-latestを使うのは検証環境、本番はバージョン固定のスナップショット名にする運用が現実的です。

- キャッシュ入力を活用すれば繰り返し送るコンテキストのコストを抑えられる

同一プロンプトを高頻度で送る業務では、キャッシュ割引で実効コストが大きく下がります。

- 高ステーク領域は推論強化側の併用が必要なため、フォールバック側のコストもセットで見積もる

APIではgpt-5.5にreasoning.effortを高めに設定する構成、または上位のgpt-5.5-proを呼び出す構成のコストまで含めて月次予算を組むと、ROIの計算が崩れません。

ChatGPT APIのモデル別料金比較では、料金構造の詳細を整理しています。Instant枠の改善で「これまでThinkingで処理していたタスクをInstantに寄せる」運用変更ができれば、APIコスト全体を圧縮できる余地もあります。

【関連記事】

ChatGPT APIの料金ガイド 2026年3月最新版 モデル別料金一覧とコスト削減のポイント

GPT-5.5 Instant運用で詰まりやすい論点

ここまでの内容を実務に落とし込む際に、現場で詰まりやすい論点を3つ整理します。導入判断の段階で押さえておくと、運用フェーズでの手戻りを減らせます。

旧GPT-5.3 Instantの3カ月猶予をどう使うか

ChatGPT上のGPT-5.3 Instantは3カ月間モデル設定から利用可能で、この期間は「動作確認の時間」と捉えるのが安全です。GPT-5.5 Instantは出力スタイル・トーン・応答長が前バージョンと変わっているため、システム連携やワークフローに組み込んでいるチャットでは、出力前提が崩れるケースが出ます。

具体的には、構造化出力(JSON返答)をしているBotで一部フィールドが省略されたり、特定のトーン(敬語多め・絵文字込み)を期待していたUIで応答が事務的に変わったりします。テスト環境で旧モデルと並行運用しながら、プロンプトの再調整を進めるのが堅実な進め方です。

3カ月という期間は短く感じるかもしれませんが、テスト→本番反映→ユーザー受容のサイクルを2〜3回回すには十分な期間です。早期に着手すれば、期限内にトーンや出力フォーマットの調整まで終わらせられます。

API連携を抱えるチームの場合、ChatGPT上の3カ月とは別に、API側のgpt-5.3-chat-latestの廃止スケジュールを公式のAPI deprecations情報で個別確認する必要があります。本番システムで使っているスナップショット名やエイリアスがいつ無効化されるかは、ChatGPT UIの3カ月猶予とは独立した管理になります。

メモリソースのプライバシー・ガバナンス設計

メモリソース機能は便利な反面、組織で運用する場合は「何を参照させて、何を参照させないか」のルールが必要です。とくに次の論点はガイドラインに含めるべきです。

- 業務ChatGPTで参照対象に含める情報源

過去チャット・Gmail・カレンダーなど、許可する情報源を業務目的別に切り分けます。

- 退職者・異動者の過去チャットの扱い

退職時のメモリ削除手順を運用フローに組み込み、放置されたメモリが他社員の応答に出ないようにします。

- 個人Gmailと業務Gmailの境界

誤連携を防ぐため、業務アカウントでのみ連携を許可するルールを明文化します。

- 一時チャットの活用シーン

メモリを更新したくない検討用途では、一時チャットを使う運用を社内に周知します。

- 共有チャットのプライバシー保護

メモリソースは共有時に表示されない仕様ですが、共有内容そのものに機密が含まれていないかは別途レビューが必要です。

導入支援の現場で見ると、ガイドラインなしで全社展開してしまうと、運用が回り始めたあとに「機密情報が他の社員のChatGPT回答に出てきた」「誤連携で個人情報が混在した」といったインシデントが問題化しやすくなります。導入の初期に許可単位を業務目的別に切り、定期的にメモリソースの参照状況を点検する仕組みを組み込むのが現実的です。

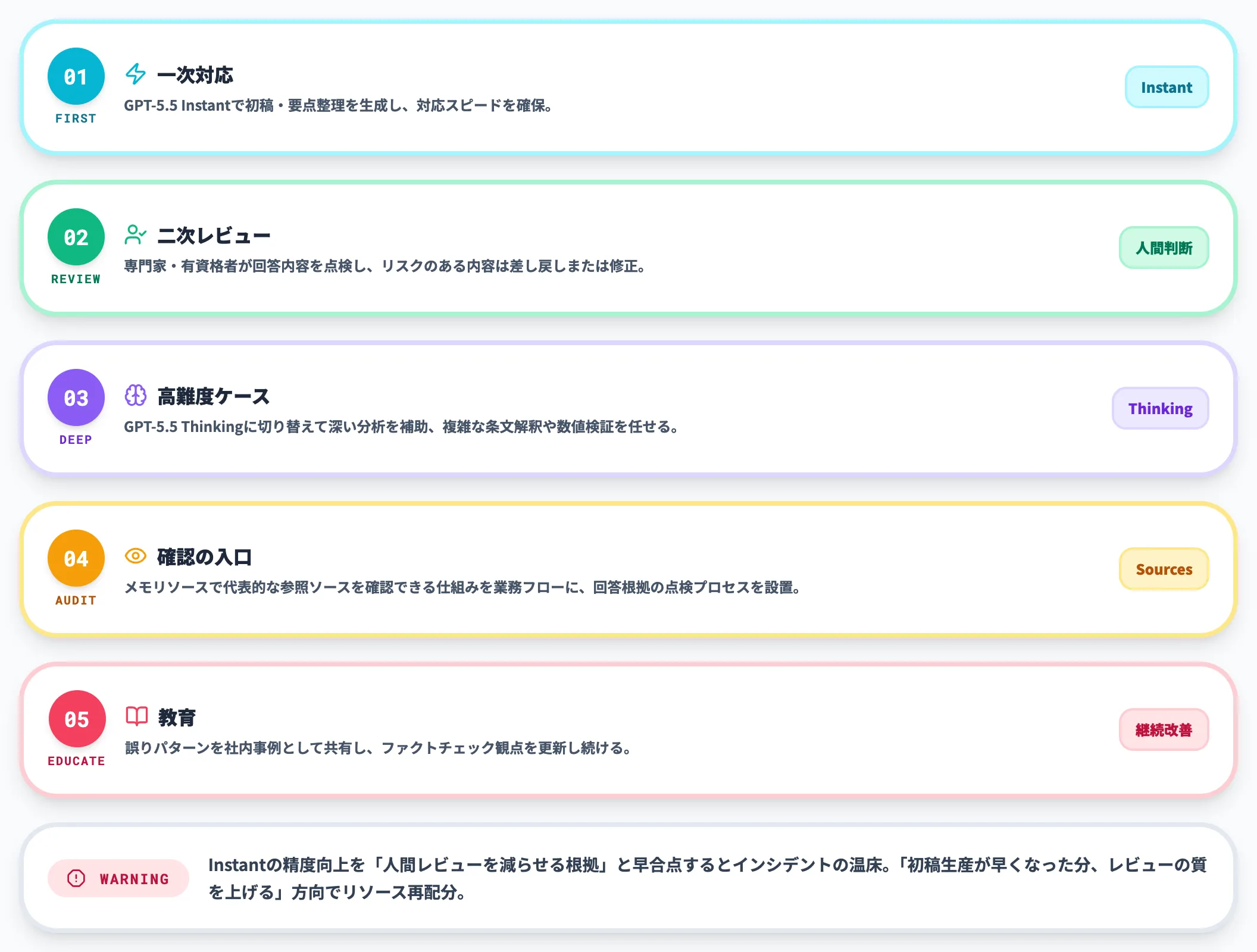

高ステーク領域での扱い方

ハルシネーション52.5%削減は大きな前進ですが、医療・法律・金融のような高ステーク領域では「最終判断を任せられる」レベルではないことを前提にしなければなりません。Instantはあくまで初稿・要約・問い合わせ対応の窓口であり、最終的な専門判断は人間や専門家が担うべき領域です。

実務では次のような運用が現実的です。

- 一次対応

GPT-5.5 Instantで初稿・要点整理を生成し、対応スピードを確保します。

- 二次レビュー

専門家・有資格者が回答内容を点検し、リスクのある内容は差し戻しまたは修正します。

- 高難度ケース

GPT-5.5 Thinkingに切り替えて深い分析を補助し、複雑な条文解釈や数値検証を任せます。

- 確認の入口

メモリソースで代表的な参照ソースを確認できる仕組みを業務フローに組み込み、回答根拠の点検プロセスを設けます。

- 教育

誤りパターンを社内事例として共有し、ファクトチェック観点を更新し続けます。

業務適用の現場で見る限り、Instantの精度向上を「人間レビューを減らせる根拠」と早合点すると、後で必ずインシデントが起きます。むしろ「初稿生産が早くなった分、レビューの質を上げる」方向でリソースを再配分するのが、信頼性と生産性を両立する近道です。

ChatGPTの精度改善を業務システムへ実装するなら

GPT-5.5 InstantのAPI(chat-latest)を使って業務エージェントを試作したところで、現場で本格運用に進むには、Teams連携・基幹システム接続・実行ログ・権限管理を含めた業務実装層の設計が必要になります。「ChatGPTで応答品質が上がった」を組織全体の業務改善に変換するには、モデル単体の進化だけでなくその先の運用基盤が鍵になります。

ここで効いてくるのが、自社のAzureテナント内で動くエンタープライズAIエージェント基盤です。AI総合研究所のAI Agent Hubは、OpenAI API(chat-latest/gpt-5.5+reasoning.effort/gpt-5.5-pro)に加えてClaudeやGeminiも併用可能な構成で、AIエージェントの実行・監視・統制をひとつのダッシュボードに集約できます。

- OpenAI APIで検証したエージェントを業務フローに接続

chat-latestで構築したチャット応答や文書処理を、AI-OCR Agent・請求書受領Agent・自動入力Agentなどの業務Agentと組み合わせ、Teamsから呼び出せる統合エージェントとして社内展開できます。

- OpenAI/Claude/Gemini併用時のガバナンスを一元化

複数モデルを使い分ける構成でも、Agent単位の実行ログ・アクセス権限・セキュリティスキャンを1つのダッシュボードで管理。chat-latestの自動更新でモデルが切り替わった際の影響分析も、個別ツールに分散させずに運用できます。

- 使い慣れたMicrosoft環境をそのまま活用

Teams・Excel・Outlookなど既存ツールの延長でAIエージェントが動作します。新しいツールの学習コストがかからず、現場がすぐに使い始められる設計です。

- データは100%自社テナント内に保持

AIの学習対象から完全除外。Azure Managed Applicationsとして自社テナント内で動作が完結するため、社内ナレッジや業務データをエージェントに渡すユースケースでも外部流出リスクを抑えられます。

AI総合研究所の専任チームが、OpenAI API評価設計から業務Agent実装・運用ガバナンスの整備まで伴走支援します。GPT-5.5 Instantの恩恵を組織全体に行き渡らせる設計図として、まずは無料の資料でAI Agent Hubの全体像をご確認ください。

ChatGPTの精度改善を業務実装まで一気通貫で進める

OpenAI APIで検証したAIをAzure環境の業務フローへ

GPT-5.5 InstantのAPIを使って業務エージェントを試作した先に必要なのが、Teams・基幹システム連携・実行ログ・権限管理を含めた業務実装層の設計です。AI総合研究所のAI Agent Hubは、Azureテナント内で動くエンタープライズAIエージェント基盤として、OpenAI・Claude・Geminiを併用するチームのガバナンスを1画面で運用できます。

まとめ

GPT-5.5 Instantは、ChatGPTのデフォルトモデルとしてリリースされた、即応性と精度を両立する最新モデルです。本記事の要点を3つに整理します。

- 高ステーク領域でのファクト精度が大幅に向上

ハルシネーションを医療・法律・金融などの高ステークプロンプトで52.5%削減し、ユーザーがフラグした難会話でも誤った主張を37.3%減らしました。GPQA(78.5%→85.6%)・AIME 2025(65.4%→81.2%)・MMMU-Pro(69.2%→76.0%)などの主要ベンチマークでも軒並み大きな改善を示し、Instant枠でありながら推論系モデルに迫る精度を実現しています。

- パーソナライゼーション機能で個別最適化された応答へ

過去チャット・ファイル・Gmailを参照して個別文脈を踏まえた応答が可能になり、新機能のメモリソースで参照ソースをユーザー側が確認・管理できるようになりました。業務利用ではガバナンスと利便性のバランスをルール化したうえで活用するのが現実的です。

- Thinkingとの使い分けで業務全体の生産性を最適化

即応性が求められる日常タスクはGPT-5.5 Instant、多段の推論を要する高難度タスクはGPT-5.5 Thinkingに振り分けることで、コスト・速度・精度のバランスを取りやすくなります。API利用時はchat-latestへの切替を進めつつ、ChatGPT上の3カ月猶予とAPI deprecations情報を別軸で確認した移行計画を早めに引くのが安全です。

ChatGPTを業務利用しているチームは、まずは社内のFAQ・議事録要約・メールドラフトといった頻出タスクから新モデルの効果を検証し、徐々に高ステーク領域への適用範囲を広げていくのがおすすめです。GPT-5.5 InstantとThinkingの二段運用に慣れたら、API側ではchat-latestで検証しつつ、本番は日付付きスナップショット名で固定する運用と業務システム連携を進めるロードマップが現実的なステップになります。