この記事のポイント

構図やカメラアングルを厳密に制御したい場合、ControlNet Depthが最も適した選択肢。Cannyより空間構造の再現性が高い

Preprocessorはdepth_midas(汎用)かdepth_zoe(精密)の二択で、実写系ならzoe、イラスト系ならmidasを選ぶべき

Weight値は0.5〜0.7が推奨範囲で、0.8以上にすると深度マップへの依存が強くなりすぎ自然な表現が損なわれる

3Dモデル生成やVR/ARコンテンツでは、Depth単体よりもNormal Mapとの併用が立体感の再現に有効

建築ビジュアライゼーションやプロダクトデザインなど奥行き表現が重要な領域で最大の効果を発揮し、平面的なデザイン用途には向かない

Microsoft MVP・AIパートナー。LinkX Japan株式会社 代表取締役。東京工業大学大学院にて自然言語処理・金融工学を研究。NHK放送技術研究所でAI・ブロックチェーンの研究開発に従事し、国際学会・ジャーナルでの発表多数。経営情報学会 優秀賞受賞。シンガポールでWeb3企業を創業後、現在は企業向けAI導入・DX推進を支援。

ControlNet Depthは、画像の深度情報を活用して構図や空間構造を精密に制御できるStable Diffusion向け拡張機能です。

本記事では、Web UIとComfyUIの両環境での設定・操作手順に加え、Preprocessorの選び方、空間構造を維持した画像生成の実例、3Dモデル生成やVR/ARコンテンツへの活用事例を解説します。

FAQでは深度マップの精度向上や他モデルとの組み合わせについても回答しています。

ControlNet Depthとは?

ControlNet Depthは、Stable Diffusion Web UIの拡張機能であるControlNetの一つで、画像の奥行き情報を用いて画像生成をコントロールする機能です。Preprocessorで画像から深度マップを生成し、その深度情報を基に、構図、奥行き感、空間構造などを制御することができます。

ControlNet Depthでできること

- 構図のコントロール

深度マップを基に、前景・中景・背景の要素を配置し、奥行き感のある画像を生成できます。

- 空間構造の制御

物体の大きさや位置関係を、深度情報に基づいて正確に再現できます。

- カメラアングルのシミュレーション

異なる視点からの画像を生成したり、ズームイン/アウト効果を表現したりできます。

ControlNet Depthの使い方【Stable Diffusion Web UI】

事前準備

ControlNet Depthを使用するには、以下の準備が必要です。

-

Stable Diffusion Web UIのインストール

まだインストールしていない場合は、Stable Diffusion Web UI Forgeのインストール方法の記事を参考にインストールしてください。 -

ControlNetのインストール

Stable Diffusion Web UIの拡張機能として、ControlNet v1.1のモデルファイル(Hugging Face)からControlNetをインストールしてください。

基本設定と操作手順

ControlNet Depthの基本的な設定と操作手順は以下の通りです。

-

元画像のアップロード

奥行き情報を利用したい画像をStable Diffusion Web UIにアップロードします。 -

ControlNetの設定

以下の項目を設定します。

- Enableにチェック — ControlNetを有効化するために「Enable」にチェックを入れます。

- Preprocessorの選択 — depth_midasなど、深度マップを生成するPreprocessorを選択します。

- ControlNet Unit — Depthを選択します。

-

プロンプトの入力

生成したい画像のイメージをプロンプトで入力します。 -

画像生成

「Generate」ボタンをクリックして画像を生成します。

ここまでの流れに関しては、ControlNetの解説記事で詳しく解説しています。

ControlNet Depthの使い方

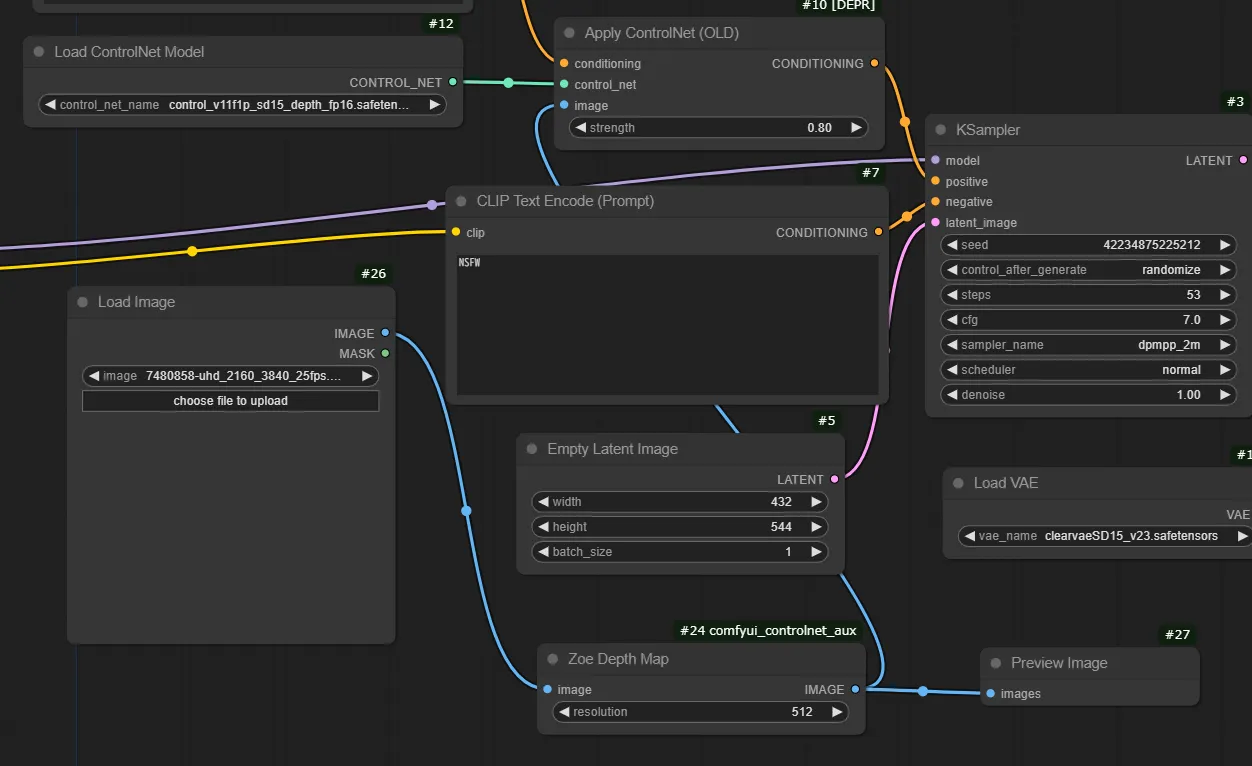

以降の生成では、ComfyUIを使用しています。ComfyUIでControlNetを使用する方法については、ControlNetの解説記事を参照してください。

ここでは、Scribble用のワークフローをDepth用に修正します。

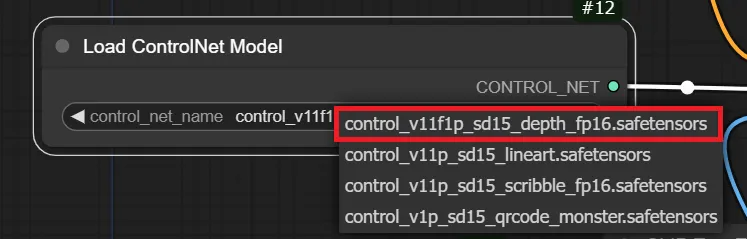

まずは、「Load ControlNet Model」にて、Depth用のモデルを選択します。

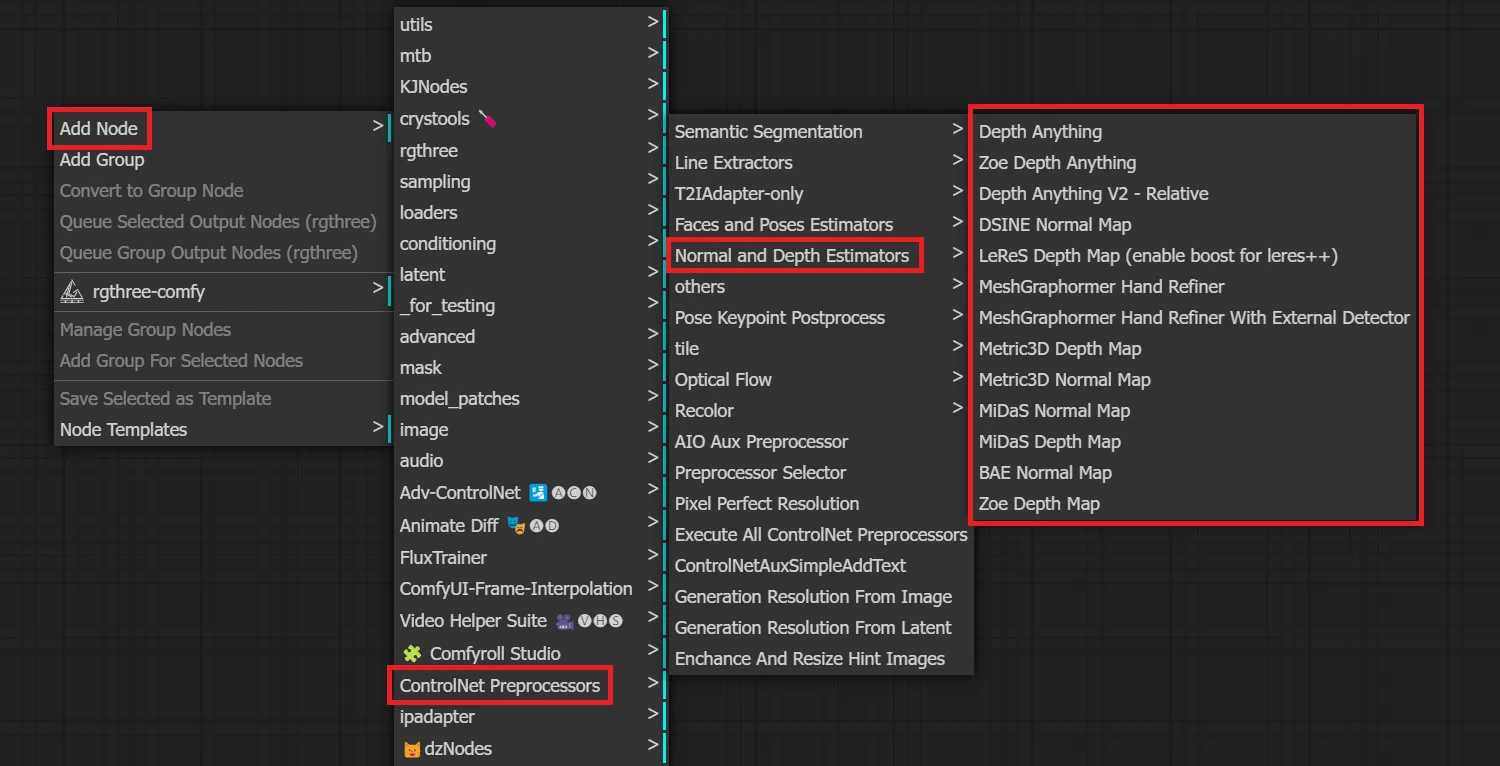

次に、以下の手順にて、Depth用のノードを追加します。

Add Node > ControlNet Preprocessors > Normal and Depth Estimators > お好きなDepthモデル

後は、Scribble用のノードに接続していたものをDepth用に接続し直せば完了です。

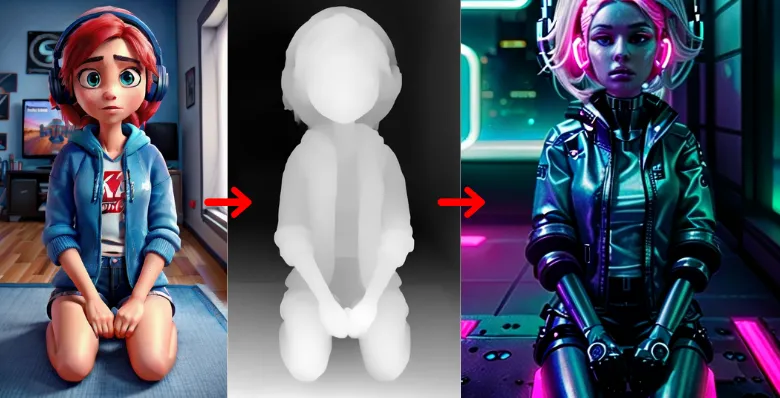

空間構造を制御

Depthを用いて、元画像の空間構造を維持したまま画像を生成します。

以下のプロンプトを使用しました。

A futuristic young woman sitting on a glowing platform in a neon-lit cyberpunk city. She has short, sleek silver hair, cybernetic enhancements, and wears a high-tech outfit with holographic accents. The background features towering skyscrapers, glowing signs, and a vibrant mix of colors like blue, purple, and pink, creating a dynamic and futuristic atmosphere. Depth should emphasize the character’s presence in this urban sci-fi environment, with dramatic lighting and reflections

以下の画像が生成されました。

奥行き感のある画像を生成

以下のプロンプトを使用しました。

A bustling futuristic cityscape at night, illuminated by neon signs and glowing skyscraper windows. The streets are filled with people, holographic advertisements, and autonomous vehicles moving in an orderly flow. Elevated walkways connect towering buildings, while the foreground features a busy street market with vibrant lights and dynamic shadows. The atmosphere is energetic and immersive, blending modern technology with urban vibrancy

以下の画像が生成されました。

ControlNet Depthの活用例

3Dモデルの生成

ControlNet Depthを使用することで、深度情報を活用した3Dモデルの生成が可能です。物体の形状や空間構造を正確に再現できるため、プロトタイプ制作やデジタルアートの制作において有用です。直感的な操作で形状を立体化でき、デザイン作業の効率化が期待できます。

VR/ARコンテンツへの活用

VR/ARコンテンツにおいて、ControlNet Depthはリアルで立体感のある空間表現を実現します。奥行きや立体感を正確に再現することで、仮想空間内での没入感が向上します。ゲームや教育、トレーニングなど、幅広い分野で活用可能です。

自動運転技術への応用

ControlNet Depthは、自動運転技術の分野でも環境認識を支援します。車両の周囲にある道路や障害物、歩行者との距離を深度情報で正確に把握することで、安全性を高め、スムーズな自動運転を実現します。

ControlNet Depthに関するFAQ

生成画像の品質を上げるには?

高画質の元画像を使用し、適切なPreprocessorを選択することが重要です。

深度マップの精度を上げるには?

様々な深度推定モデルが公開されています。用途に合わせて適切なモデルを選択してください。

ControlNet Depthと他のControlNetモデルを組み合わせることはできますか?

はい、他のControlNetモデルと組み合わせて使用できます。例えば、Cannyエッジ検出モデルと組み合わせることでエッジを保持したまま深度情報を反映させたり、OpenPoseと組み合わせてポーズと空間構造を同時に制御したりできます。

奥行き制御のAI技術を業務でのAI活用に結びつける

生成AIの業務活用を体系的に学べるガイド

ControlNet Depthで奥行き情報を活用した画像生成を体験すると、AIが空間認識まで扱えることへの理解が深まります。AI総合研究所では、Microsoft環境で業務プロセスのAI化を段階的に進める手順をまとめたガイドを無料で提供しています。

奥行き制御のAI技術を業務でのAI活用に結びつけるなら

ControlNet Depthでデプスマップを活用した画像生成を体験すると、AIが空間情報を理解して処理できることへの実感が得られます。この空間認識技術は、建築パースの作成支援や製品の3Dイメージ生成など、業務でのビジュアルコンテンツ制作にも応用が広がる分野です。

AI総合研究所では、画像生成AIでの経験を業務プロセス全体のAI化に発展させるための実践手順をまとめた「AI業務自動化ガイド」を無料で提供しています。AIの空間認識能力を理解した今、業務でのAI活用の幅を広げてみてください。

奥行き制御のAI技術を業務でのAI活用に結びつける

生成AIの業務活用を体系的に学べるガイド

ControlNet Depthで奥行き情報を活用した画像生成を体験すると、AIが空間認識まで扱えることへの理解が深まります。AI総合研究所では、Microsoft環境で業務プロセスのAI化を段階的に進める手順をまとめたガイドを無料で提供しています。

まとめ

本記事では、ControlNet Depthの基本から実践的な使い方までを解説しました。

- 深度マップによる構図の精密制御

ControlNet Depthは、画像の奥行き情報を活用して前景・中景・背景の配置やカメラアングルを正確にコントロールできます。プロンプトだけでは難しい空間構造の再現に有効です。

- Web UIとComfyUIの両環境で柔軟に活用可能

Stable Diffusion Web UIでの基本操作に加え、ComfyUIのノードベースワークフローにも対応しています。用途やスキルレベルに応じて環境を選択できます。

- 3Dモデル・VR/AR・自動運転など多分野への応用

深度情報の活用は、画像生成にとどまらず、3DモデルのプロトタイピングやVR/ARコンテンツ制作、自動運転の環境認識支援など、幅広い分野で価値を発揮します。

まずは身近な写真からDepthマップを生成し、プロンプトを変えながら構図の維持効果を確認してみてください。Preprocessorの違いによる出力の変化を比較することで、用途に最適な設定が見つかります。