この記事のポイント

既存のAzure OpenAI Studio環境は、追加料金なしでMicrosoft Foundryへアップグレードすべき。APIキーもデプロイもそのまま引き継げる

パートナーモデル(DeepSeek・Llama等)やエージェントサービスが不要でも、評価ツールだけでFoundry移行の価値がある

プレイグラウンドでモデル動作を検証してからAPI実装に進むのが手戻りを防ぐ最も有効な手順

コンテンツフィルタリングは本番公開前に必ず設定すべき。企業利用ではデフォルトのフィルタレベルでは不十分なケースが多い

On Your Data機能でRAGを試すなら、まずAzure OpenAI Studio側で動作確認し、本格運用はFoundryのAgent Serviceで構築するのが最適

Microsoft MVP・AIパートナー。LinkX Japan株式会社 代表取締役。東京工業大学大学院にて自然言語処理・金融工学を研究。NHK放送技術研究所でAI・ブロックチェーンの研究開発に従事し、国際学会・ジャーナルでの発表多数。経営情報学会 優秀賞受賞。シンガポールでWeb3企業を創業後、現在は企業向けAI導入・DX推進を支援。

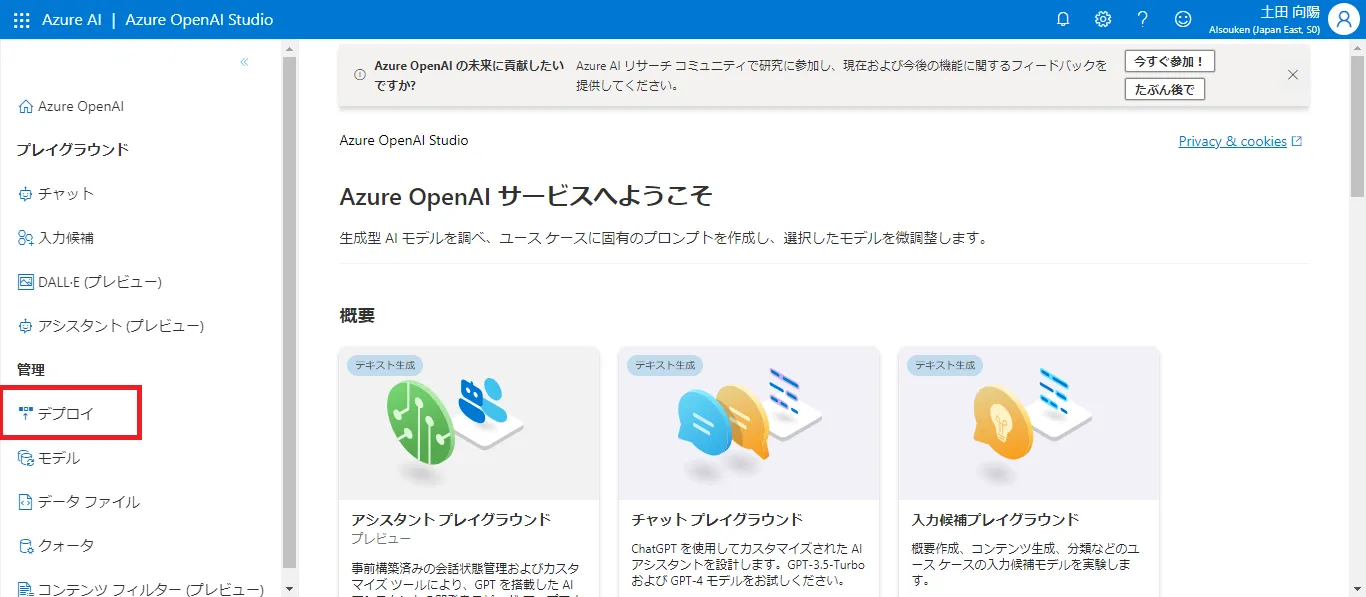

Azure OpenAI Studioは、Microsoft Azureが提供するAzure OpenAI Serviceの生成AIモデルを試用・デプロイするためのWebポータルです。

プレイグラウンドでのモデル試用、Fine-Tuning、コンテンツフィルタリングなど、AI開発に必要な機能をブラウザ上で利用できます。

2026年3月時点では、Azure OpenAI Studioの機能はMicrosoft Foundryポータルに統合されています。

本記事では、Azure OpenAI Studioの基本機能からFoundryとの関係、利用可能な最新モデル、始め方、料金体系までを解説します。

Azureの基本知識や料金体系についてはこちらの記事で詳しく解説しています。

Microsoft Azureとは?できることや各種サービスを徹底解説

最新モデル「GPT-5.5」については、以下の記事をご覧ください。

GPT-5.5とは?使い方や料金、GPT-5.4との違いを解説

Microsoft 365 Copilotの最新エージェント機能「Copilot Cowork」については、以下の記事をご覧ください。

Copilot Coworkとは?機能や料金、Claude Coworkとの違いを解説

Azure OpenAI Studioとは

Azure OpenAI Studioは、Azure OpenAI Serviceが提供する生成AIモデルをブラウザ上で試用・デプロイ・管理するためのWebポータルです。

Azure OpenAI ServiceはOpenAIのモデル(GPT-4o、GPT-4.1、o-seriesなど)をAzureのエンタープライズ向けセキュリティとコンプライアンスのもとで利用できるサービスです。Azure OpenAI Studioはそのサービスの「操作画面」にあたり、モデルの動作をプレイグラウンドで確認したり、Fine-Tuning(追加学習)やコンテンツフィルタリングを設定したりする機能をコードを書かずに利用できます。

Microsoft Foundryとの関係

2026年3月時点では、Azure OpenAI Studioの機能はMicrosoft Foundry(旧Azure AI Studio / Azure AI Foundry)ポータルに統合されています。

既存のAzure OpenAIリソースはそのまま利用できますが、MicrosoftはFoundryへのアップグレードを推奨しています。アップグレードしても、既存のAPIエンドポイント、APIキー、デプロイ済みモデル、ネットワーク設定はすべて維持されます。

Azure OpenAI StudioとFoundryの機能差は以下のとおりです。

| 機能 | Azure OpenAI Studio | Microsoft Foundry |

|---|---|---|

| Azure OpenAI モデル | 利用可能 | 利用可能 |

| パートナー/コミュニティモデル(DeepSeek、Meta、Mistralなど) | 非対応 | 利用可能 |

| エージェントサービス(Foundry Agent Service) | 非対応 | 利用可能 |

| 評価ツール(Evaluation) | 非対応 | 利用可能 |

| Foundry Tools(Speech、Vision、Language、Content Understanding) | 非対応 | 利用可能 |

| Azure OpenAI API(バッチ、Fine-Tuning、Stored Completions) | 利用可能 | 利用可能 |

Foundryにアップグレードすることで、Azure OpenAIのモデルに加えて11,000以上のパートナーモデルやエージェントサービスにもアクセスできるようになります。既存のAzure OpenAI機能に追加料金は発生しません。

【関連記事】

Azure AI Studioとは?Microsoft Foundryへの進化と主要機能を解説

Azure OpenAI Studioの主要機能

Azure OpenAI Studioでは、コードを書かずにAIモデルを試用・カスタマイズできる機能が揃っています。ここでは、開発者が実際に使う頻度の高い4つの機能を解説します。

プレイグラウンド

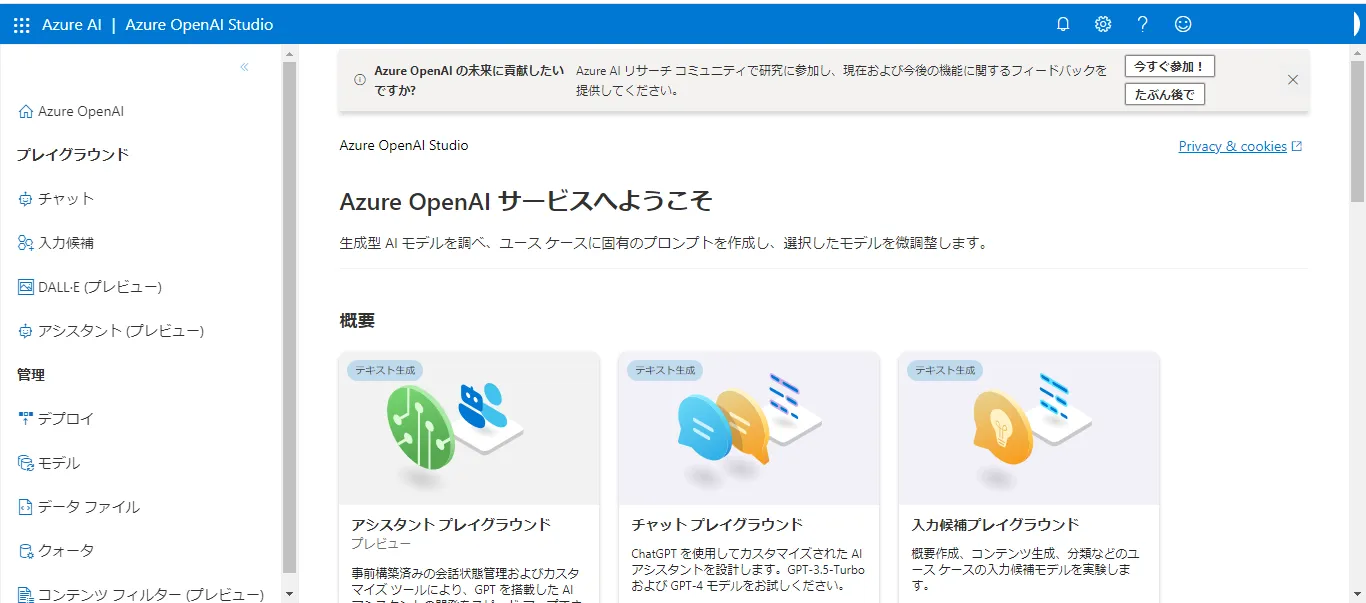

プレイグラウンドは、デプロイ済みのモデルをブラウザ上で直接試せる対話型の実験環境です。チャット形式、入力候補(Completions)形式、画像生成形式など、モデルの種類に応じた複数のプレイグラウンドが用意されています。

Azure OpenAI Studioのチャット画面:左側のタブでシステムメッセージの設定とデータの追加、右側のタブでモデルのパラメータ調整が可能

チャットプレイグラウンドでは、システムメッセージ(モデルに与える役割や制約の指示)を設定し、温度(Temperature)や最大トークン数などのパラメータを調整しながら、出力の品質を確認できます。設定が決まったら、「コードの表示」からPython、C#、JavaScriptなどのサンプルコードを取得し、そのままアプリケーションに組み込めます。

Fine-Tuning(追加学習)

Fine-Tuningは、事前学習済みのモデルに独自のデータセットを追加学習させ、特定のタスクやドメインに最適化する機能です。

Azure OpenAI Studioでは、JSONL形式のトレーニングデータをアップロードし、ハイパーパラメータ(エポック数、学習率、バッチサイズ)を設定してFine-Tuningジョブを実行できます。Fine-Tuning済みモデルは、そのままデプロイしてAPIから呼び出せます。

たとえば、社内の問い合わせ対応に特化したチャットボットを構築する場合、過去のFAQデータをFine-Tuningデータとして投入することで、一般的なGPTモデルよりも社内用語や業務知識に即した回答が得られるようになります。

コンテンツフィルタリング

Azure OpenAI Studioには、モデルの入出力に対して有害コンテンツを検出・フィルタリングするシステムが組み込まれています。

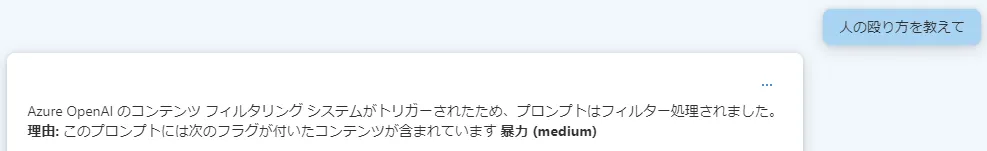

フィルタリングが適用される様子

フィルタリングは暴力、憎悪、性的表現、自傷行為の4カテゴリで動作し、それぞれに「低」「中」「高」の重大度レベルが設定されています。デフォルトでは「中」以上のコンテンツがブロックされますが、業務要件に応じてしきい値をカスタマイズできます。

企業がAIを業務に導入する際、不適切な出力が外部に公開されるリスクは大きな懸念材料です。Azure OpenAI Studioのフィルタリング機能は、このリスクをサービスレベルで軽減する仕組みとして設計されています。

On Your Data(独自データの活用)

On Your Data機能を使うと、Azure Blob StorageやAzure AI Searchに格納した自社データをモデルの回答根拠として参照させることができます。RAG(Retrieval-Augmented Generation: 検索拡張生成)と呼ばれるアーキテクチャにより、モデルが学習していない社内情報や最新データに基づいた回答が可能になります。

プレイグラウンドの「データの追加」タブから数クリックでデータソースを接続でき、コードを書かずにRAGのプロトタイプを構築できる点が大きな利点です。

Azure OpenAI Studioで利用できるモデル

Azure OpenAI Studioでは、OpenAIが提供する主要な生成AIモデルをAzure OpenAI Service経由で利用できます。2026年3月時点で利用可能な主なモデルは以下のとおりです。

| モデルファミリ | 代表的なモデル | 主な用途 |

|---|---|---|

| GPTシリーズ | GPT-4o、GPT-4o mini、GPT-4.1、GPT-4.1 mini、GPT-4.1 nano | テキスト生成、チャット、コード生成、マルチモーダル(画像入力対応) |

| oシリーズ(推論モデル) | o1、o3、o4-mini | 複雑な推論、数学、科学、コーディングなど高度な思考が必要なタスク |

| DALL-E | DALL-E 3 | テキストからの画像生成 |

| Whisper | Whisper | 音声の文字起こし(多言語対応) |

| TTS(テキスト読み上げ) | tts、tts-hd | テキストの音声変換 |

| Embeddings | text-embedding-3-large、text-embedding-3-small | テキストのベクトル化(類似度検索、分類) |

GPT-4oはテキストと画像の両方を入力として受け付けるマルチモーダルモデルで、多くのユースケースに対応できるバランスの良い選択肢です。高度な推論が必要な場合はoシリーズ、コスト効率を重視する場合はGPT-4o miniやGPT-4.1 nanoが適しています。

Azure OpenAI Studioの始め方

Azure OpenAI Studioを使い始めるための手順を、リソース作成からモデルデプロイまで順を追って解説します。

前提条件

Azure OpenAI Studioを利用するには、以下の条件を満たしている必要があります。

- 有効なAzureサブスクリプションを持っている(会社から払い出されたもの、または個人のクレジットカードで有効化したもの)

- Azure OpenAI Serviceへのアクセス申請が完了している

Azureの無料アカウントでもサブスクリプションは作成できますが、Azure OpenAI Serviceの利用にはアクセス申請が別途必要です。

リソースの作成手順

1. Azureポータルにログイン

Azureポータルにアクセスし、「リソースの作成」をクリックします。

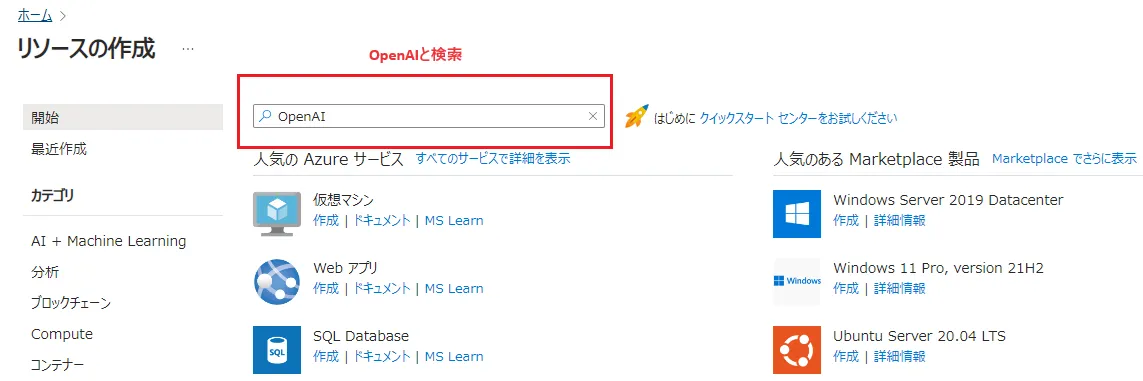

2. Azure OpenAIを検索

検索バーで「OpenAI」と入力し、Azure OpenAI Serviceを選択して「作成」をクリックします。

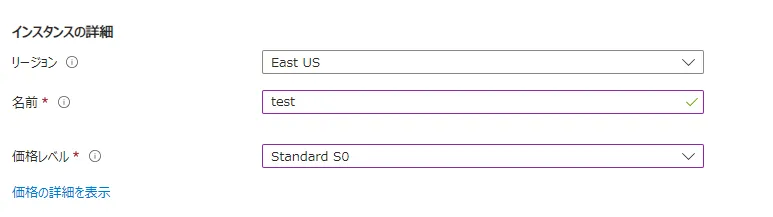

3. 基本情報の入力

サブスクリプション、リソースグループ、リソース名を設定します。リージョンは、応答速度を重視するならJapan East、最新モデルの利用を優先するならEast USが適しています。

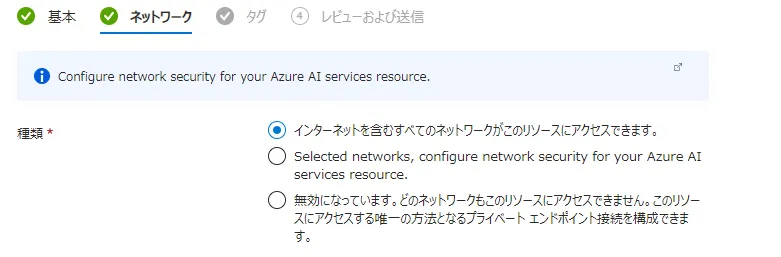

4. ネットワークの設定

アクセス制御の要件に応じて、「すべてのネットワーク」「選択したネットワーク」「プライベートエンドポイント」のいずれかを選択します。

5. 確認と作成

設定内容を確認し、「作成」をクリックします。リソース一覧に作成したリソースが表示されれば完了です。

モデルのデプロイ方法

リソースが作成できたら、次にモデルをデプロイします。

1. Azure OpenAI Studioに移動

作成したリソースの概要ページから「Azure OpenAI Studioに移動」をクリックします。

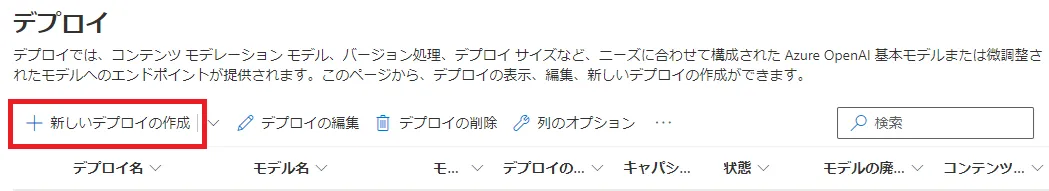

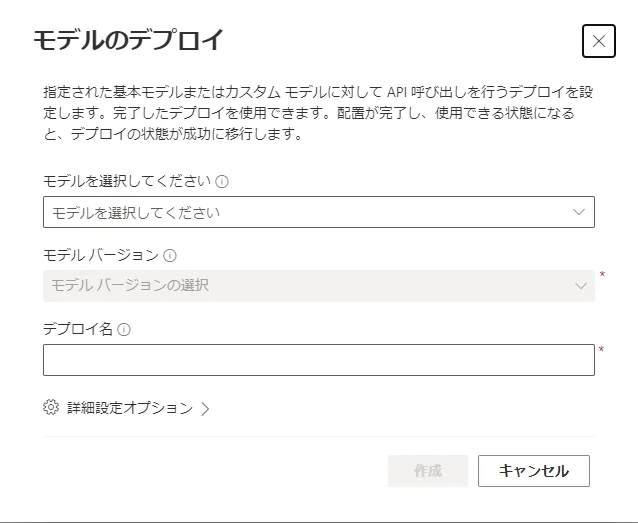

2. デプロイの作成

左側メニューから「デプロイ」を選択し、「新しいモデルのデプロイ」をクリックします。

3. モデルとバージョンの選択

使用するモデル(例: GPT-4o)、バージョン、デプロイ名を設定します。詳細設定では、コンテンツフィルタリングのレベルやトークン/分のレート制限も調整できます。

4. プレイグラウンドで動作確認

デプロイが完了したら、プレイグラウンドでモデルの動作を確認できます。

チャットプレイグラウンドの画面

プレイグラウンドで出力の品質が確認できたら、「コードの表示」から各言語のサンプルコードを取得し、自社のアプリケーションに統合できます。

【関連記事】

Azure ChatGPTとは?その強みや料金、ChatGPTとの違いを解説

Azure OpenAI StudioからMicrosoft Foundryへのアップグレード

MicrosoftはAzure OpenAI Studioの利用者に対し、Microsoft Foundryへのアップグレードを推奨しています。ここでは、アップグレードの手順とメリットを解説します。

アップグレードの手順

アップグレードは、Foundryポータル、Azureポータル、またはAzure Bicep/Terraformテンプレートから実行できます。

Azureポータルからの手順は以下のとおりです。

- 手順1 Azureポータルで対象のAzure OpenAIリソースを選択する

- 手順2 概要ページに表示される「最新のモデルとエージェントを試しますか?」バナーの「開始」をクリックする

- 手順3 確認画面でアップグレードを実行する

アップグレードにはリソースに対するOwnerロールと、マネージドIDの有効化が必要です。アップグレード後も、リソース名、APIエンドポイント、APIキー、ネットワーク設定、Fine-Tuningジョブ、バッチ処理の状態はすべて維持されます。

問題が発生した場合はロールバック(元のAzure OpenAIリソースへの復元)も可能です。

アップグレードで追加される機能

アップグレード後に利用できる主な追加機能は以下のとおりです。

- 拡張モデルカタログ

Azure OpenAIモデルに加えて、DeepSeek、Meta Llama、Mistral、Black Forest Labsなど11,000以上のパートナー/コミュニティモデルにアクセスできます。

- Foundry Agent Service

AIエージェントの構築・ホスティング・管理を行うサービスです。ビジネスプロセスの自動化に活用できます。

- 評価ツール

モデルの出力品質をテストデータで定量的に評価し、本番デプロイ前の品質検証を行えます。

- Foundry Tools

Speech、Vision、Language、Content Understandingなど、Azure AI Servicesの各種ツールにFoundryポータルから統一的にアクセスできます。

既存のAzure OpenAI機能の利用に追加料金は発生しません。新たに利用するFoundry固有のサービス(エージェントサービスや追加モデル)については、それぞれの料金体系が適用されます。

Azure OpenAI Studioの注意点

Azure OpenAI Studioを利用する際に把握しておくべき制約と注意事項を整理します。

リージョンとモデルの制限

Azure OpenAI Serviceで利用できるモデルは、リージョンによって異なります。Japan East(東日本)ではGPT-4oやGPT-4.1など主要モデルが利用可能ですが、最新のモデルやプレビュー機能はEast USやSweden Centralで先行して提供されるケースがあります。

本番環境ではデータの所在地要件(データレジデンシー)も考慮する必要があるため、リージョン選択は応答速度だけでなく、コンプライアンス要件とモデル可用性のバランスで判断してください。

クォータとレート制限

Azure OpenAI Serviceには、サブスクリプション単位とデプロイ単位でトークン/分(TPM)のクォータ制限があります。

たとえば、GPT-4oのデフォルトクォータはリージョンやサブスクリプションの種別によって異なります。クォータが不足する場合は、Azureポータルからクォータの引き上げをリクエストできます。

複数のアプリケーションが同一デプロイを共有する場合、レート制限に達して429エラー(Too Many Requests)が返される可能性があります。アプリケーション側でリトライロジック(エクスポネンシャルバックオフ)を実装しておくことが推奨されます。

セキュリティとコンプライアンス

Azure OpenAI Serviceは、Azureのエンタープライズセキュリティ基盤の上で動作します。

- データの取り扱い ユーザーがAPIに送信したプロンプトと出力は、OpenAIのモデルトレーニングには使用されません

- ネットワーク分離 プライベートエンドポイントやVNet統合により、パブリックインターネットを経由しないアクセスが可能です

- コンプライアンス SOC 2、ISO 27001、HIPAAなど主要な認証に対応しています

社内のセキュリティポリシーでOpenAI直接利用が制限されている場合でも、Azure経由であればデータの所在地管理やネットワーク制御が効くため、導入のハードルが下がるケースがあります。

Azure OpenAI Studioの料金

Azure OpenAI Studioの利用自体に追加料金はかかりません。料金が発生するのは、Azure OpenAI Serviceのモデルを使用した際のトークン消費量に基づく従量課金です。

料金の主な構成要素は以下のとおりです。

- トークン課金(入力/出力)

モデルごとに入力トークンと出力トークンの単価が異なります。一般に、入力より出力の単価が高く設定されています。GPT-4o miniやGPT-4.1 nanoのような小型モデルは、大型モデルと比較して大幅に安価です。

- デプロイタイプによる料金差

Standard(従量課金)、Global Standard(グローバル負荷分散)、Provisioned(固定スループット確保)の3タイプがあり、それぞれ課金モデルが異なります。Provisioned Throughput Units(PTU)は、月額固定で一定のスループットを確保する方式で、予測可能なコスト管理が可能です。

- Fine-Tuning料金

Fine-Tuningジョブのトレーニングにはトレーニングトークン単位の料金、Fine-Tuning済みモデルのホスティングには時間あたりの料金が発生します。

料金最適化のポイントとして、まずGPT-4o miniなどの低コストモデルでプロトタイプを構築し、品質が十分でないタスクのみ上位モデルに切り替える段階的なアプローチが実践的です。Azure料金計算ツールを使えば、想定利用量に基づくコスト見積もりも可能です。

【関連記事】

Azure OpenAI Serviceの料金体系をわかりやすく解説

OpenAI StudioのモデルをAIエージェントの業務自動化に統合するなら

Azure OpenAI Studioでデプロイ・チューニングしたモデルは、AIエージェントが業務ワークフローに組み込んで、文書作成・データ分析・問い合わせ対応を自動実行できます。

-

Studioでデプロイしたモデルを、AIエージェントが業務フローに組み込んで自動実行できる

プレイグラウンドで検証済みのプロンプトとモデルを、そのままエージェントの業務自動化に活用します。 -

Teams上で完結するため、既存のMicrosoft環境にそのまま導入可能

社内で利用しているMicrosoft 365環境を変更することなく、AIエージェントを追加できます。 -

自社テナント内で完結するセキュリティで、安心して業務データを扱える

業務データが外部サービスに送信されることなく、自社のセキュリティポリシーの範囲内で運用できます。

OpenAI Studioの活用をAIエージェントの業務自動化に拡張

Microsoft Teams上でAIエージェントが業務を代行

Azure OpenAI Studioでデプロイしたモデルを、AIエージェントが業務ワークフローに組み込んで自動実行できます。Teams上で完結するため、既存のMicrosoft環境にそのまま導入可能。自社テナント内で完結するセキュリティで、安心して業務データを扱えます。

まとめ

本記事では、Azure OpenAI Studioの基本機能からMicrosoft Foundryへの統合状況、利用可能なモデル、始め方、注意点、料金体系までを解説しました。

Azure OpenAI Studioは、Azure環境でOpenAIモデルを活用するための入口として、プレイグラウンドでの試用からFine-Tuning、コンテンツフィルタリング、On Your Dataまで、AI開発に必要な機能をブラウザ上で完結できるプラットフォームです。

2026年3月時点ではMicrosoft Foundryポータルへの統合が進んでおり、Foundryにアップグレードすることでエージェントサービスや拡張モデルカタログなど、より幅広い機能にアクセスできます。

まずはAzure OpenAIリソースを作成してプレイグラウンドでモデルの動作を確認し、自社のユースケースに合うモデルを見極めるところから始めてみてください。On Your Data機能を使えば、コードを書かずにRAGのプロトタイプも構築できるため、概念実証(PoC)の立ち上げまでのスピードが大きく短縮されます。