この記事のポイント

データ基盤を1つに統合してAI活用まで広げたいなら、AI Data CloudとしてのSnowflakeが第一候補

ストレージとコンピュート分離による「使った分だけ課金」が効くのは、ワークロードに波がある中堅〜大企業のデータ基盤

Cortex AIとSnowflake Intelligenceを使えば、SQLだけで自然言語クエリ・RAG・エージェント構築まで完結する

DatabricksはML/Lakehouse、BigQueryはGoogle Cloud前提、Microsoft FabricはMicrosoft 365との統合が強み。Snowflakeはマルチクラウドと運用の容易さで選ばれる

2026年4月の価格改定でAI Creditsが新設され、AI機能は別単価で計上される。コスト試算は「通常クレジット+AI Credits」の二本立てで考えるのが安全

Microsoft MVP・AIパートナー。LinkX Japan株式会社 代表取締役。東京工業大学大学院にて自然言語処理・金融工学を研究。NHK放送技術研究所でAI・ブロックチェーンの研究開発に従事し、国際学会・ジャーナルでの発表多数。経営情報学会 優秀賞受賞。シンガポールでWeb3企業を創業後、現在は企業向けAI導入・DX推進を支援。

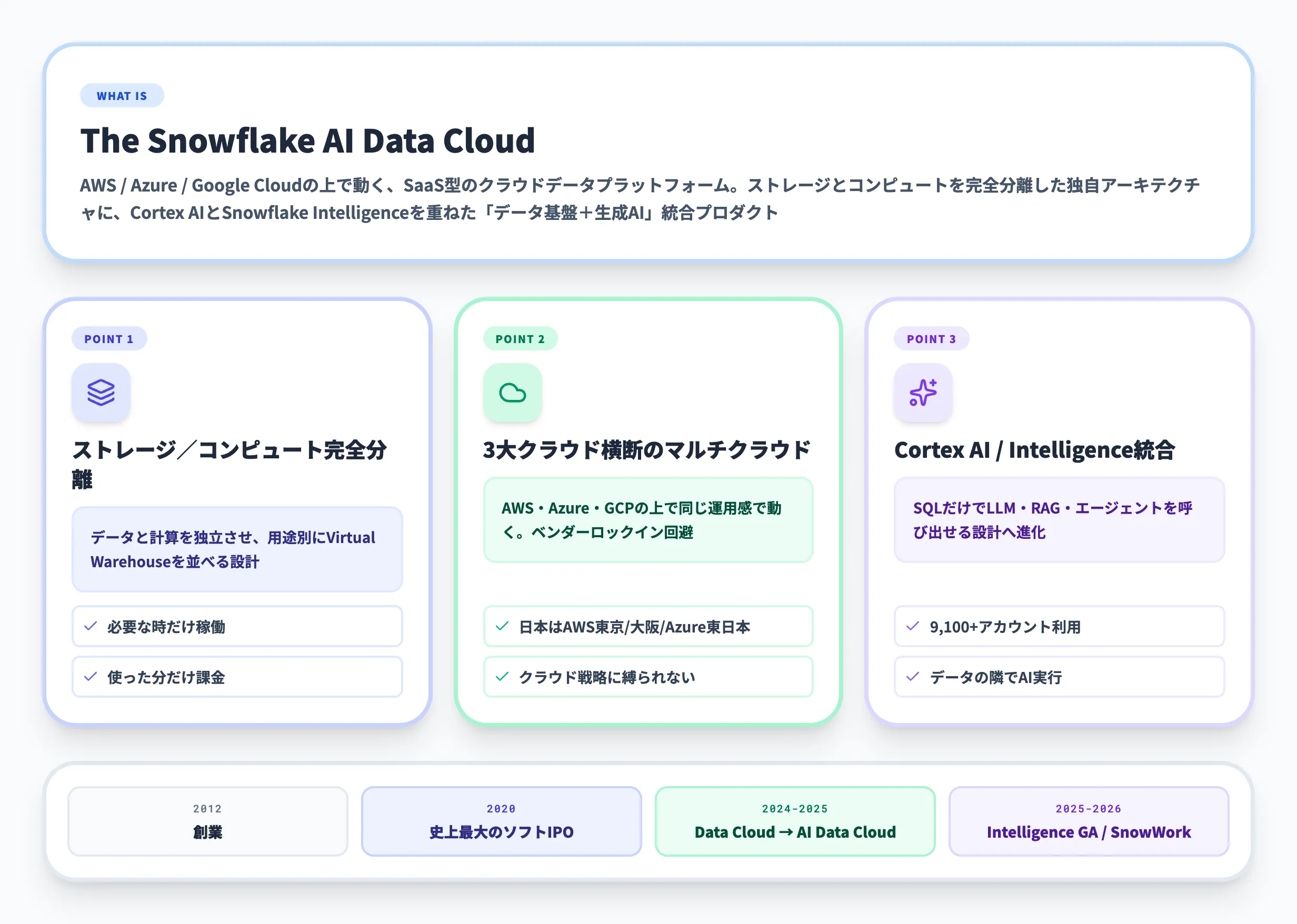

Snowflakeは、AWS・Azure・Google Cloudのいずれの上でも動く、SaaS型のクラウドデータプラットフォームです。

ストレージとコンピュートを完全分離した独自アーキテクチャと、SQLだけでLLMやエージェントを呼び出せるCortex AI群を備え、現在は「The Snowflake AI Data Cloud」としてデータ基盤とAIを一体で扱う製品へ進化しています。

本記事では、Snowflakeの基本概念・アーキテクチャ・主要機能・Cortex AI / Snowflake Intelligence・競合(Databricks / BigQuery / Microsoft Fabric)との違い・2026年4月の価格改定を含む料金体系・導入で詰まりやすい論点までを、SIer視点で体系的に解説します。

目次

AI Data Cloud / Snowflake Platformという呼称

SnowflakeのAI機能(Cortex AI / Snowflake Intelligence)

Snowflakeとは?

Snowflake(スノーフレーク)は、Snowflake社が提供するクラウド型のデータプラットフォームです。AWS / Microsoft Azure / Google Cloudの3大クラウドのいずれの上でも稼働し、構造化データから半構造化データ、近年ではドキュメントなどの非構造化データまでを一元的に扱えます。

公式の現行ブランディングは「The Snowflake AI Data Cloud」で、単なるデータウェアハウスではなくデータ基盤とAIを一体化した製品として位置付けられています。「Snowflake Platform」という呼称も併用されており、本記事ではこの2つを同じものとして扱います。

Snowflakeの最大の特徴は、ストレージ(データ保存)とコンピュート(クエリ処理)を完全に分離した独自アーキテクチャです。データを置く場所と計算する場所を独立させたことで、用途別に複数のVirtual Warehouse(仮想ウェアハウス)を立ち上げ、必要なときだけ動かして使った分だけ課金する運用が可能になりました。従来のオンプレDWHのような「サイジングを誤ると数百万円の追加投資」という痛みから解放される設計です。

ここ数年は、データ基盤の上にCortex AI(LLM呼び出し・RAG・エージェント基盤)とSnowflake Intelligence(自然言語データ対話)を重ねて、データ→分析→生成AI→エージェントを1つのプラットフォームで完結させる方向に進化しています。2025年11月にSnowflake IntelligenceがGAされ、2026年3月にはProject SnowWorkという業務ユーザー向け自律エージェント基盤の研究プレビューも発表されました。

Snowflake誕生の背景

Snowflakeは2012年にアメリカで創業され、2020年に米ソフトウェア企業として史上最大規模のIPOを実現したことで一躍注目を集めました。創業時から「クラウド前提でゼロから設計し直したデータウェアハウス」という思想で作られており、TeradataやOracle Exadataのようなオンプレ型DWHの発想を引きずらない点が支持されています。

特にデータ量の波が大きい業務(決算期に集中する分析、月次のキャンペーン分析、機械学習の前処理など)で、必要なときに必要なだけリソースを立ち上げて使い切る運用が刺さり、北米のテック企業から急速に普及しました。日本でも2020年代前半からNECや日清食品、NTTドコモといった大手企業の採用が続いています。

AI Data Cloud / Snowflake Platformという呼称

「Snowflake AI Data Cloud」と「Snowflake Platform」という2つの呼び方は、いずれもSnowflake全体を指すブランド名として公式が使っています。データウェアハウス機能だけを切り出した呼称ではなく、Cortex AI / Snowflake Intelligence / Snowpark / Iceberg対応 / Snowflake Postgresなど、近年追加された機能群を含めたプラットフォーム全体を指します。

旧名の「Data Cloud」から「AI Data Cloud」へ表記が変わった背景には、2024〜2026年にかけてAI機能の比重が大きくなってきたことがあります。現場で「Snowflakeを導入する」と言う場合、もはやDWH単体ではなくAI機能まで含めた一式を指すケースがほとんどです。

なぜSnowflakeが選ばれるのか

Snowflakeが選ばれる理由は、単に「クラウドでDWHを動かせる」ことではありません。従来のDWHが抱えていた3つの構造的な痛みを、アーキテクチャレベルで解消した点が支持されています。データ基盤の刷新を検討している企業が、最初に候補に挙がる理由をここで整理します。

従来DWHの痛みをアーキテクチャで解消

オンプレ型のDWHは、サイジングをハードウェア調達と一緒に決める必要がありました。1〜2年先のデータ量を予測し、ピークに合わせてサーバを買って、繁閑差で遊ぶリソースを許容する。この設計が古くなったのは、データ量が数年単位で何倍にもなるBI/ML時代に入ってからです。

Snowflakeは、ストレージとコンピュートを分けて、コンピュートを「立ち上げる/止める」だけで料金が変わる仕組みにしたことで、ピークサイジングという発想自体を捨てました。BIユーザーが朝方に集中する時間だけウェアハウスを大きくし、夜間は止める、という運用が当たり前になります。

マルチクラウド対応で囲い込みを避けられる

Snowflakeは特定のクラウドベンダに紐づかず、AWS・Azure・GCPの3大クラウドに展開されている設計です。ただし一部の新機能はクラウド・リージョンによって提供状況に差があるため、採用前に必ず公式のリージョン一覧とリージョン間の機能差を確認してください。日本国内で利用する場合は、現時点でAWS Tokyo(ap-northeast-1)/ AWS Osaka(ap-northeast-3)/ Azure Japan Eastが代表的な選択肢になります。

これは「データ基盤だけは特定クラウドにロックインしたくない」という大企業の要件と相性が良く、AzureやGCPに振っている社内プロダクトを抱えていてもSnowflakeを横断的に使えます。後述のDatabricksやBigQueryと比べて、このベンダーニュートラル性がSnowflakeの大きな差別化軸になっています。

データ共有・マーケットプレイスでエコシステムが厚い

Snowflakeは「データを企業の壁を越えて共有する」ことを最初から設計に組み込んでいます。Snowflake Secure Data Sharingでパートナー企業と直接データを共有したり、Snowflake Marketplaceで外部のデータセット(天気・統計・業界データ等)をその場で取り込んで分析に使ったりできます。

データを「社内DWHの中だけで完結させる時代」から、「社外データと混ぜて意思決定に使う時代」へ移行している現在、このエコシステムが強いことはそのままビジネス上の優位になります。データレイクを別途構築する手間なく、必要なデータをすぐ手元に呼べるという感覚です。

Snowflakeのアーキテクチャ

Snowflakeの技術的な強みは、3層に分離された独自アーキテクチャにあります。一般的なDWHは「ストレージとコンピュートが結合した1層構造」ですが、Snowflakeはストレージ層・クエリ処理層・クラウドサービス層を独立させ、それぞれを別々にスケールできるように設計されています。

3層アーキテクチャの全体像

Snowflakeの内部は、上から「クラウドサービス層」「クエリ処理層(Virtual Warehouse)」「ストレージ層」の3層に分かれます。それぞれの役割をひとことで言うと次のようになります。

-

クラウドサービス層

認証・メタデータ管理・最適化・トランザクション制御など、Snowflake全体を束ねるコントロールプレーンを担当する

-

クエリ処理層(Virtual Warehouse)

SQLクエリを実際に実行するコンピュートクラスタ。サイズ(X-Small〜6X-Large)と数を独立に決められる

-

ストレージ層

データ本体を保管する場所。実体はクラウドのオブジェクトストレージ(S3 / Azure Blob / GCS)で、Snowflakeが独自フォーマット(マイクロパーティション)で管理する

この3層分離があるからこそ、「データはそのままに、用途別のVirtual Warehouseを並べる」「BI用は小さめ、ML前処理は大きめ、夜間バッチは止める」といった柔軟な運用が成立します。同じデータに対して別々のチームが別々の規模のコンピュートで同時アクセスしても、互いに性能干渉しないのが大きな特徴です。

Virtual Warehouseの独立性

Virtual Warehouseは、サイズ(X-Small / Small / Medium / Large / X-Large / 2X-Large / 3X-Large / 4X-Large / 5X-Large / 6X-Large)から選べる仮想クラスタで、サイズが1段階上がるごとにクレジット消費量が2倍になる設計です。X-Smallは1時間で1クレジットを消費します。

複数のVirtual Warehouseを同時に立ち上げて、用途別に使い分ける運用が一般的です。たとえば「BIユーザー向けにSmallを常時1つ」「データエンジニア向けにLargeをジョブ実行時だけ」「ML前処理用に2X-Largeを夜間だけ」のように分けると、利用部門ごとのコストも明確になります。

実務では、自動サスペンド(非利用時に自動停止)と自動レジューム(クエリが来たら自動起動)を有効にしておくのが鉄則です。これを忘れるとVirtual Warehouseが付けっぱなしになり、月末に想定の数倍の請求が来る、という事故が起こります。

マイクロパーティションとデータ圧縮

Snowflakeのストレージ層は、データをマイクロパーティションと呼ばれる50〜500MB程度の塊に自動分割し、列指向(カラムナ)形式で圧縮して保管します。ユーザーが意識する必要はなく、ロードしたデータがそのまま自動的に最適化されます。

この仕組みのおかげで、「インデックスを張る」「パーティション設計する」「統計情報を更新する」といったDBA作業がほぼ不要になります。ニアゼロメンテナンスという言葉が使われるのはこのためで、運用人員を抑えながら大規模データ基盤を回せる点が中堅企業からの支持を集めています。

Snowflakeの主要機能

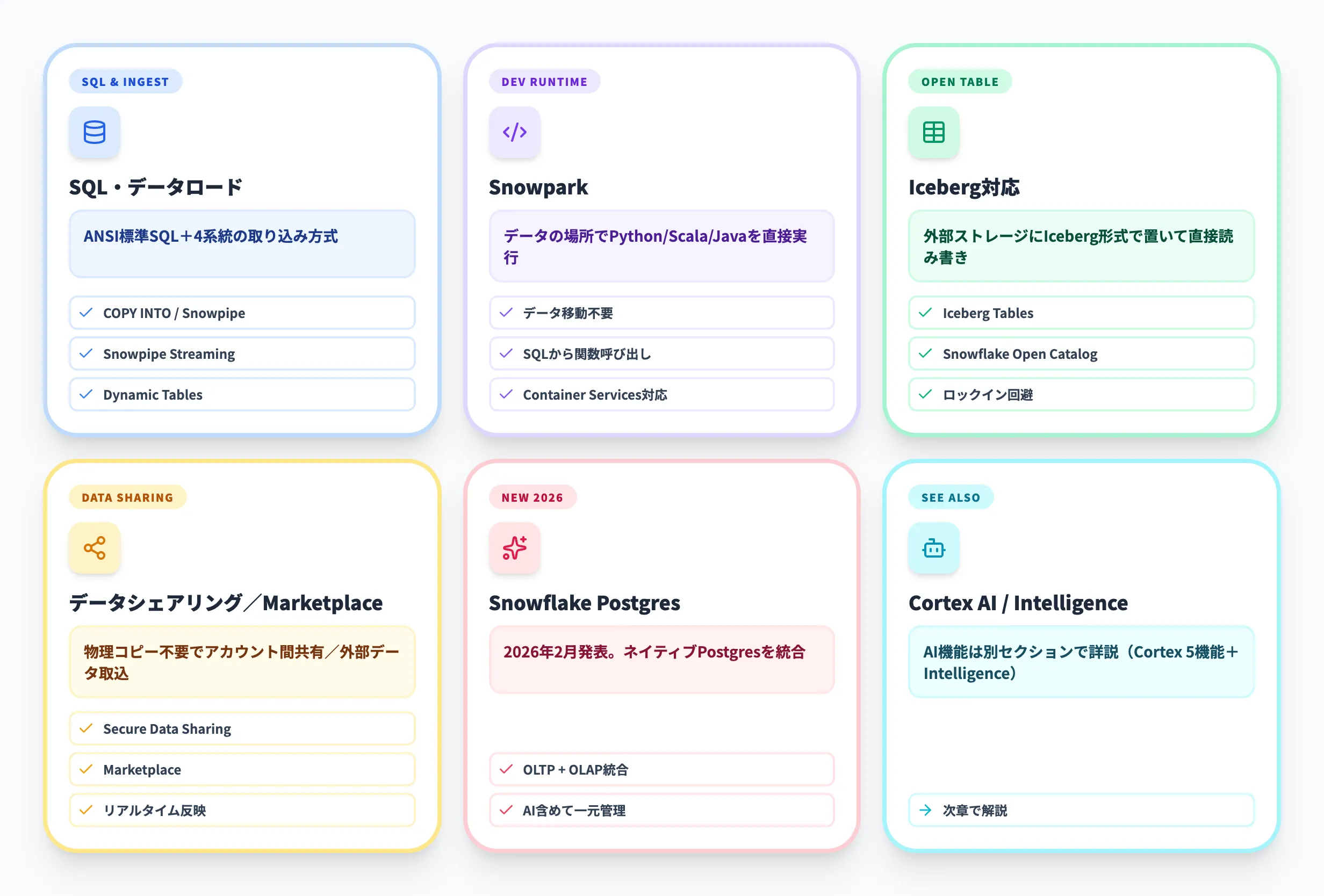

Snowflakeの機能群は、DWH本来のクエリ・データロードに加えて、データ統合・データシェアリング・オープンテーブル・アプリケーション開発と、年々「データ基盤の総合プラットフォーム」へ広がっています。ここでは主要な機能を整理します。

SQL・データロード機能

SnowflakeはANSI標準SQLをそのまま使えるのが基本機能です。既存のDWHから移行する際に、SQLレベルで大幅に書き換える必要がほぼないため、移行プロジェクトのコストを下げやすいという利点があります。

データロードの代表的な方式には、バッチでファイルを取り込む「COPY INTO」、リアルタイムに近い形でストリーム取り込みする「Snowpipe」、行単位でストリーミングを受ける「Snowpipe Streaming」があります。さらに2024年以降、宣言的にデータパイプラインを定義できる「Dynamic Tables」が追加され、ETL処理をSQLだけで構築できるようになりました。

Snowparkでの開発体験

Snowparkは、Python / Scala / JavaのコードをSnowflake内部で直接実行できる開発ランタイムです。データを外部に持ち出さずに、データのある場所でモデル学習や前処理を回せるため、データ移動に伴うセキュリティリスクとコストを抑えられます。

Snowflakeの上でPython関数を定義して、それをSQLから呼び出すといった使い方ができるため、データエンジニアとデータサイエンティストが同じ基盤で連携する設計が組みやすくなります。Snowpark Container Servicesを使えば、コンテナベースのアプリケーションをSnowflake上で実行することも可能です。

Iceberg対応とオープン化

Snowflakeは2024年以降、Apache Icebergというオープンテーブルフォーマットへの対応を強化してきました。Iceberg Tablesを使えば、Snowflakeの中にデータをロックインせず、外部のオブジェクトストレージにIceberg形式で置いたデータをSnowflakeから直接読み書きできます。

これは「データは特定ベンダのフォーマットに閉じ込めたくない」という要件を持つ大企業に特に重要です。さらにSnowflakeは、旧名Polaris Catalogから改名された「Snowflake Open Catalog」というオープンなIcebergカタログサービスも提供しており、DatabricksのUnity Catalogと真っ向から競合する位置付けに立っています。

データシェアリング・Marketplace

Snowflake Secure Data Sharingは、データを物理的にコピーすることなく別アカウント・別組織と共有できる機能です。共有元のテーブルが更新されれば、共有先からも即座に最新データが見える仕組みになっており、データの二重管理を避けられます。

Snowflake Marketplaceでは、外部企業が公開しているデータセット(金融指標・気象・統計・業界データ等)をその場でアカウントに取り込んで使えます。データレイクを自前で整備しなくても、すぐ手元に外部データを呼べるエコシステムは、Snowflakeならではの厚さです。

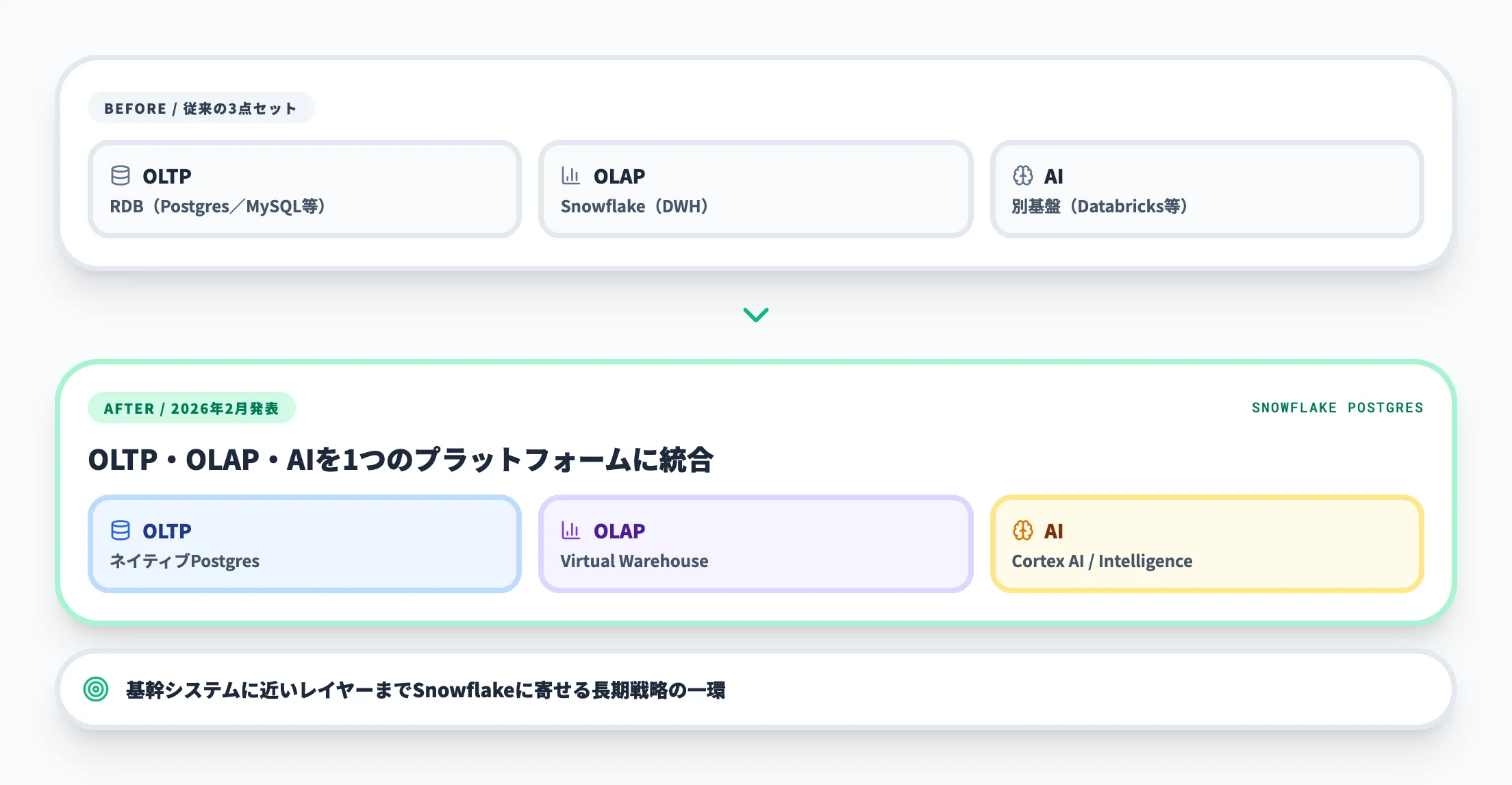

Snowflake Postgres(2026年新機能)

2026年2月には、Snowflakeの内部でネイティブにPostgresが動くSnowflake Postgresが発表されました。これにより、トランザクション処理(OLTP)と分析処理(OLAP)、AIワークロードを単一のセキュアなプラットフォームに統合できるようになります。

従来は「OLTPはRDB、分析はSnowflake、AIは別基盤」という3点セット構成が必要でしたが、Snowflake Postgresによってこの壁をプラットフォーム内で取り払う動きが始まっています。基幹システムに近いレイヤーまでSnowflakeに寄せていく長期戦略の一環と捉えると分かりやすいです。

SnowflakeのAI機能(Cortex AI / Snowflake Intelligence)

Snowflakeが「データ基盤」から「AI Data Cloud」へ呼称を変えた最大の理由が、ここで紹介するCortex AI群とSnowflake Intelligenceです。データを置いている場所でそのままLLMを呼び出し、エージェントまで構築できるという設計が、近年の最大の進化点です。

Snowflake Cortex AIの全体像

Snowflake Cortex AIは、SQLやAPI経由でLLMを呼び出し、データに対して直接推論を実行できるサービスです。データを外部のLLMサービスに渡す必要がなく、Snowflakeのセキュリティ境界の中で生成AI処理を完結させられる点がエンタープライズに支持されています。

Cortex AIに含まれる主要機能は次のとおりです。

-

Cortex Functions

SUMMARIZE / TRANSLATE / EXTRACT_ANSWER / SENTIMENTなど、SQL関数として呼び出せるLLM処理。Meta Llama 3.1 405Bなど主要モデルが利用可能

-

Cortex Analyst

自然言語の質問をSQLに変換し、構造化データに対する問い合わせを返すサービス。BI担当でなくてもデータに直接問い合わせできる

-

Cortex Search

非構造化データに対するセマンティック検索を提供。社内ドキュメントを取り込んでRAG基盤として使える

-

Cortex Agents

構造化データ問い合わせと非構造化データ検索を組み合わせ、自律的にタスクを進めるエージェント基盤

-

Cortex Code

データエンジニアリング・分析・ML・エージェント構築を自然言語で指示できるAIコーディングエージェント

これらは別々の機能ですが、いずれもSQLまたはPythonから直接呼び出せるため、既存のSnowflakeワークフローに組み込みやすいのが特徴です。「LLMを使うために別のAPIキーを管理する」「データを別環境にコピーする」といった面倒がありません。

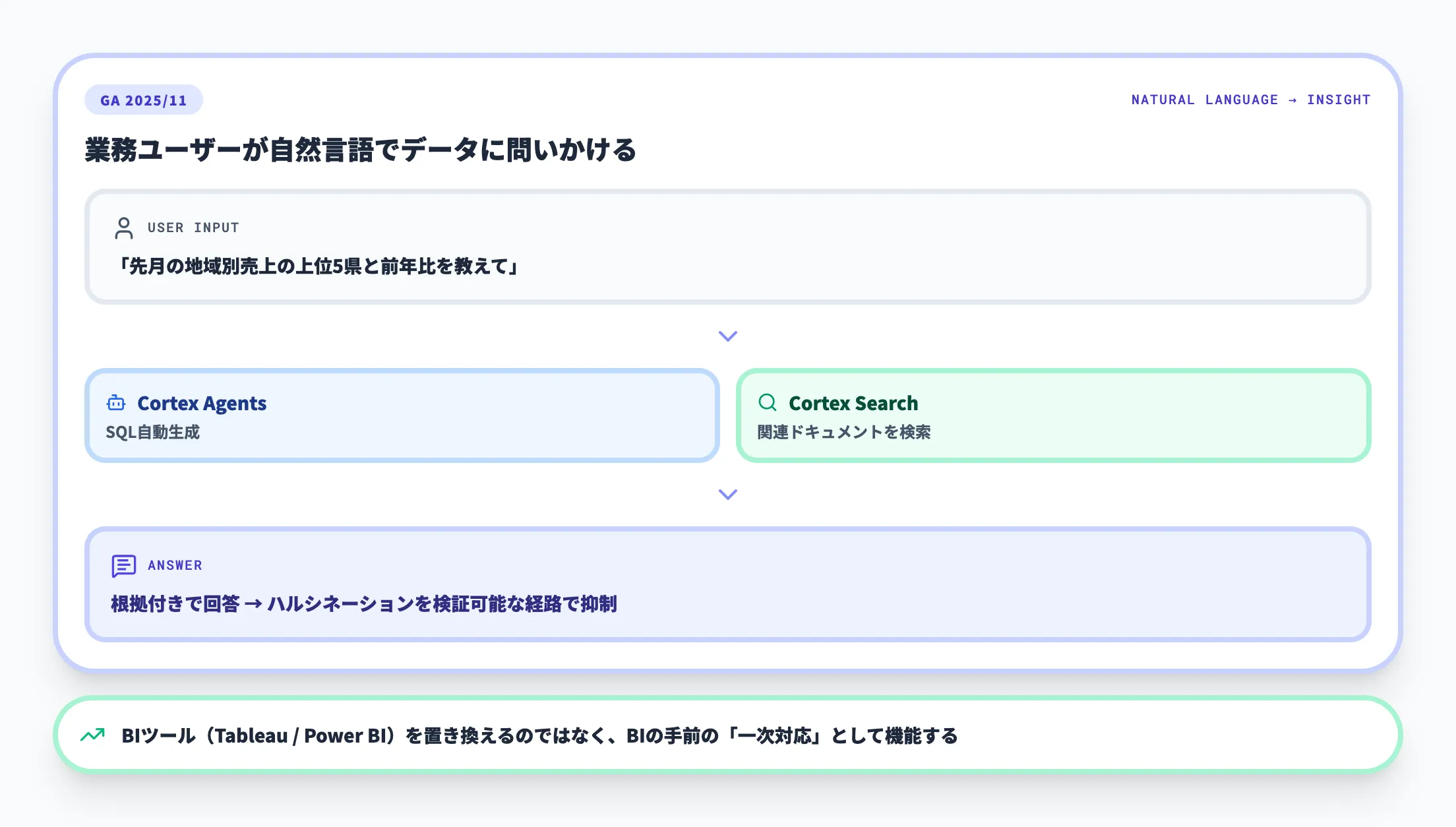

Snowflake Intelligence

Snowflake Intelligenceは、2025年11月にGAされた自然言語データ対話プラットフォームです。専用ポータルから業務ユーザーが社内データに対して質問を投げると、Cortex AgentがSQLを生成し、Cortex Searchが関連ドキュメントを引き、根拠付きの回答を返す仕組みになっています。

この「根拠付きで答える」という点が重要で、生成AIの最大の弱点であるハルシネーションを、SQL実行と検索結果という検証可能な経路で抑えています。BIツール(Tableau / Power BI)に取って代わる存在ではなく、**BIの手前にいる「調べに来たユーザーへの一次対応」**としての役割が期待されています。

Project SnowWorkとエージェント拡張

2026年3月18日には、業務ユーザー向けの自律エージェント基盤Project SnowWorkの研究プレビューが発表されました。Snowflake Intelligenceが「質問に答える」レイヤーであるとすれば、SnowWorkは「業務タスクを最後まで実行する」レイヤーで、たとえば「顧客リストから条件に合う100社を抽出してメール下書きを生成」といったマルチステップ処理を狙っています。

エージェント時代のデータ基盤を考える際、AIエージェント×データ基盤の関係を整理しておくと、なぜSnowflakeがこの方向に舵を切っているのかが見えてきます。データの所有者でない場所でエージェントを作ると、データ移動・権限設計・監査ログがそれぞれ二重になります。データの隣でエージェントを動かすことが、運用上もっともシンプルな解になるからです。

AIワークロードの伸び

Snowflake社のFY2026 Q4決算リリースによれば、Snowflake AI機能を利用するアカウントは9,100を超え、2025年11月にGAしたSnowflake Intelligenceも3か月でほぼ2,500アカウントに採用されています。公式は「AIがワークロードとユーザー層の拡大を牽引している」という言い方をしており、「DWH + AIをまとめて運用したい」というニーズが市場に広がっていることの裏付けになっています。

実務的な使い分けでいうと、すでにSnowflakeを社内DWHとして使っている企業は、まずCortex AnalystとCortex Searchから試すのが筋が良いです。新規にRAG基盤を作るよりも、既存データを直接対話可能にするほうが導入効果が分かりやすく、稟議も通りやすい傾向があります。

Snowflake vs Databricks / BigQuery / Microsoft Fabric

データ基盤を選定するとき、Snowflakeとよく比較されるのがDatabricks、BigQuery、Microsoft Fabricの3つです。それぞれ得意分野が異なるため、自社のクラウド戦略とワークロード特性で選び分けるのが正解です。

4プラットフォーム比較表

以下の表で、4つの主要データプラットフォームの特性を整理しました。

| 観点 | Snowflake | Databricks | BigQuery | Microsoft Fabric |

|---|---|---|---|---|

| 出自 | クラウドネイティブDWH | Apache SparkベースのLakehouse | Google Cloudのサーバーレス分析 | Microsoft Power BI+Azure統合 |

| クラウド対応 | AWS / Azure / GCP | AWS / Azure / GCP | Google Cloudのみ | Azure中心 |

| 主言語 | SQL中心、Snowpark経由でPython/Scala/Java | Python / SQL / Scala / R | SQL中心、Python(Notebooks) | SQL / Python / KQL |

| AI機能 | Cortex AI / Snowflake Intelligence | Mosaic AI / Genie | Vertex AI / BigQuery ML | Fabric Copilot / AI Skills |

| データ共有 | Secure Data Sharing / Marketplaceが強い | Delta Sharing | Analytics Hub | OneLake Shortcut |

| 料金モデル | クレジット制(コンピュート別) | DBU制(コンピュート別) | クエリ課金 or キャパシティ | キャパシティ制(CU) |

| 強み | 運用シンプル・マルチクラウド・データ共有 | ML/AI・ストリーミング・Lakehouse | サーバーレス・Google Adsとの統合 | Microsoft 365との一体運用 |

| 弱み | リアルタイム処理は不利・AIは後発 | 学習コスト高め・SQL中心の組織には重い | GCPロックイン・データ共有が弱い | Azure依存・他クラウドからの参照は手間 |

この表が示すのは、4つのプラットフォームは「同じ問題を解く競合」ではなく、それぞれ違う問題を解いているという事実です。「データ基盤」とひとくくりにされがちですが、社内の主担当者がデータエンジニアか、データサイエンティストか、業務ユーザーかで答えは変わります。

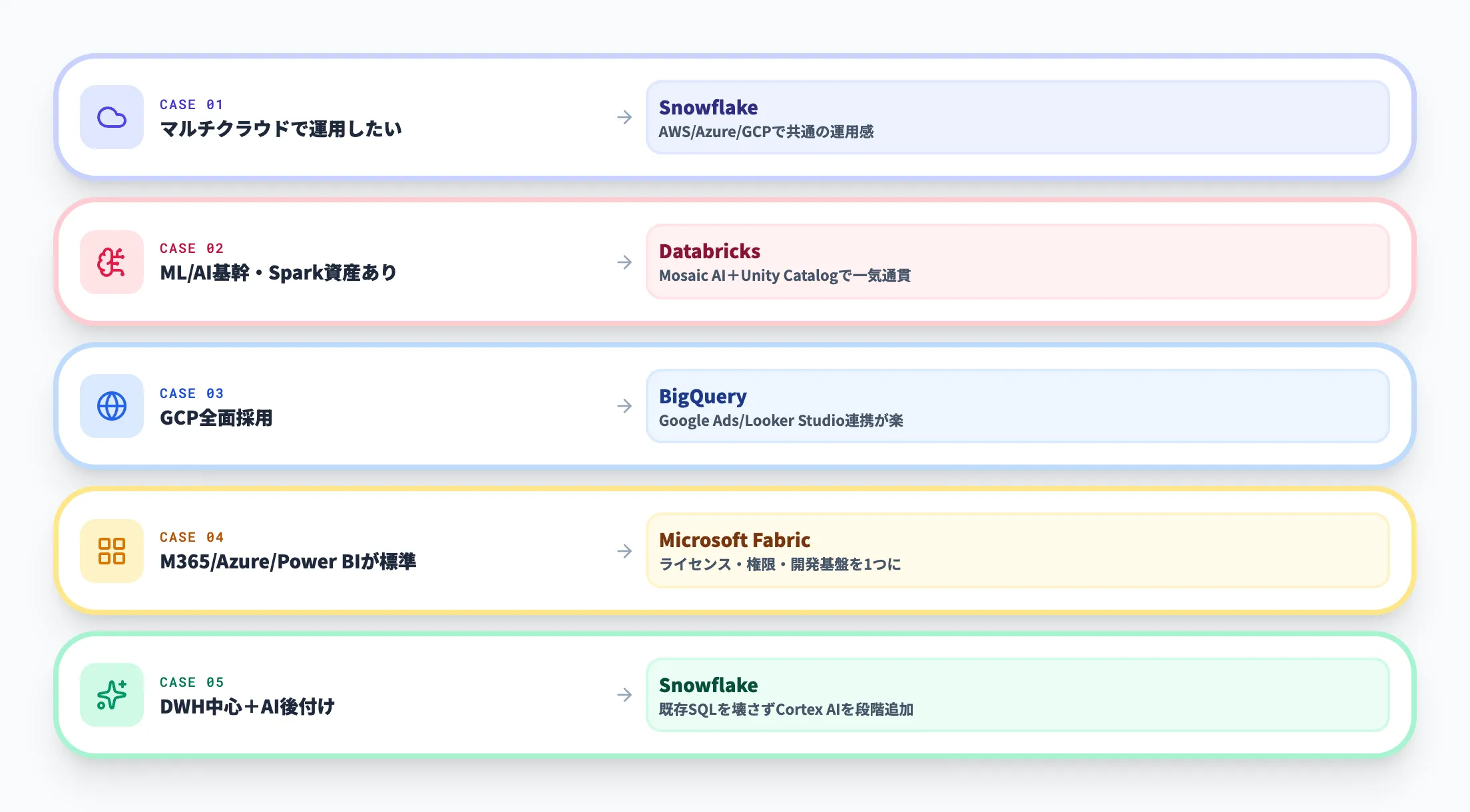

ケース別の使い分け

実際の選定では、次の判断軸でほぼ答えが出ます。

-

マルチクラウドで運用したい / ベンダーニュートラルにしたい

Snowflakeが第一候補。一部の新機能差はあるが、AWS・Azure・GCPで共通の運用感のままマルチクラウドで運用しやすい

-

ML/AIエンジニアリングが基幹業務、Sparkの資産がある

Databricksが有利。Mosaic AIとUnity Catalogでデータからモデル運用まで一気通貫

-

すでにGoogle Cloudを全面採用している

BigQueryが自然な選択。Google AdsやLooker StudioとのID連携が圧倒的に楽

-

Microsoft 365 / Azure / Power BIが社内標準

Microsoft Fabricを選ぶと、ライセンス・権限設計・開発基盤を1つに揃えられる

-

DWH中心の業務にAI機能を後付けしたい

Snowflakeが最短距離。既存のSQLワークロードを壊さずにCortex AIを段階追加できる

支援現場でよくあるパターンは、「クラウド戦略は決まっているが、データ基盤だけは横断的に持ちたい」というケースです。この場合、社内クラウドがAzure中心でもGCP中心でも、データ基盤としてはSnowflakeを選ぶのが運用上いちばん素直です。逆に、すでにDatabricksでML基盤を作り込んでいてSparkの資産がある組織が、無理にSnowflakeに乗り換える必要はありません。

コスト感の違い

Snowflake・Databricks・BigQuery・Microsoft Fabricはいずれもクレジット制またはキャパシティ課金で、単価表だけを並べても実コストは見えません。同じクエリでもデータサイズ・ウェアハウスサイズ・圧縮率・クラスタ設定で結果が大きく変わるため、第三者ブログが出している「A社 vs B社の年間コスト比較」のような数字は、ワークロード前提が自社と同じでない限り参考値に過ぎません。

現実的には、自社の代表的なワークロード(BIクエリ・ETL・ML前処理など)をサンプルとして各プラットフォームでPoCを回し、クレジット消費量と実行時間を実測するのが唯一の正解です。Snowflake側はPricing CalculatorとCredit Consumption Tableを公式に公開しているので、これらを組み合わせれば月額レンジは掴みやすくなります。

Snowflakeの導入事例

Snowflakeは日本でも大手企業を中心に採用が広がっています。ここでは公式に公開されている代表的な事例を紹介します。事例の出典はすべてSnowflake公式の事例ページとパートナー各社のリリースから引用しています。

NECの「One NEC Dataプラットフォーム」

NECは、全社横断のデータ利活用を促すための次世代データプラットフォーム「One NEC Dataプラットフォーム」をSnowflakeで構築しています。「One Data・One Place・One Fact」を柱に、社内に散在していたデータを1つのプラットフォームに集約し、データドリブン経営の基盤として運用しています。

大企業ほどデータが部門ごとに分断されがちですが、Snowflakeのマルチクラウド対応とデータシェアリングを活用して横串で繋ぐ設計が機能した事例です。

日清食品のSnowpark + 生成AI活用

日清食品は、データドリブン経営を目指してSnowflakeで全社データを一元化し、SnowparkとCortex AIを組み合わせて分析レポートの自動生成にも取り組んでいます。「DWH+AIをひとつの基盤で完結させる」というSnowflakeの設計思想がそのまま実務に乗っている例です。

NTTドコモの全社データ基盤

NTTドコモは、グループ全体の数千万顧客に関するデータを扱う全社データ基盤としてSnowflakeを採用し、利活用を推進しています。通信業界のように1日のデータ量が極端に多い組織でも、コンピュート分離による柔軟なスケールが効くことを示している事例です。

三菱UFJ信託銀行グループの金融データ活用

三菱UFJ信託銀行グループでは、グループ内の3社が金融データの利活用課題を解決するためにSnowflakeを導入しています。金融業界はセキュリティとガバナンス要件が厳しく、Business Criticalエディション以上の機能と組み合わせて運用されるケースが多い領域です。

アイシン高丘の「HOKORA」

アイシン高丘は、社内に点在していたデータを集約するDX施策の一環としてSnowflakeを採用し、「HOKORA(祠)」と名付けた統合データプラットフォームを構築しています。製造業の部品メーカーでも、データを集約して各部門が触れるようにすることでデータドリブン文化を醸成する起点になっている事例です。

これらの事例に共通するのは、Snowflakeを単なるDWHとしてではなく、**「データを集めて全社で使う器」**として位置付けていることです。導入の起点はBI/レポーティングだったとしても、半年〜1年のうちにSnowparkやCortex AIへ広げていくケースが目立ちます。最初の導入を「DWH置き換え」だけで終わらせず、その上に乗せるAIワークロードまで見据えて設計するかどうかで、投資対効果が大きく変わります。

Snowflakeの料金体系

Snowflakeの料金は、クレジット制を中心とした使った分だけ課金されるモデルです。ただし2026年4月の改定でAI関連機能向けの「AI Credits」が新設されたため、現在は「通常クレジット+AI Credits」の二本立てになっています。本番採用時は必ず公式の料金ページで最新情報を確認してください。

料金の主要構成要素

Snowflakeの料金は次の3要素で構成されます。

-

コンピュート料金(クレジット消費)

Virtual Warehouseが稼働した時間に応じて、サイズに比例したクレジットを消費する。1クレジット = X-Smallウェアハウスの1時間相当

-

ストレージ料金

保管しているデータ量(TB単位)に対する月額課金。クラウドのオブジェクトストレージ単価に近い

-

データ転送料金

クラウド間・リージョン間でデータを動かした場合の課金。同一クラウド・同一リージョン内なら基本無料

加えて、Cortex AI / Snowflake IntelligenceなどAI機能の利用に対して別途AI Creditsが消費されます。AI Creditsは2026年4月に新設された単位で、通常クレジットとは独立してカウントされます。

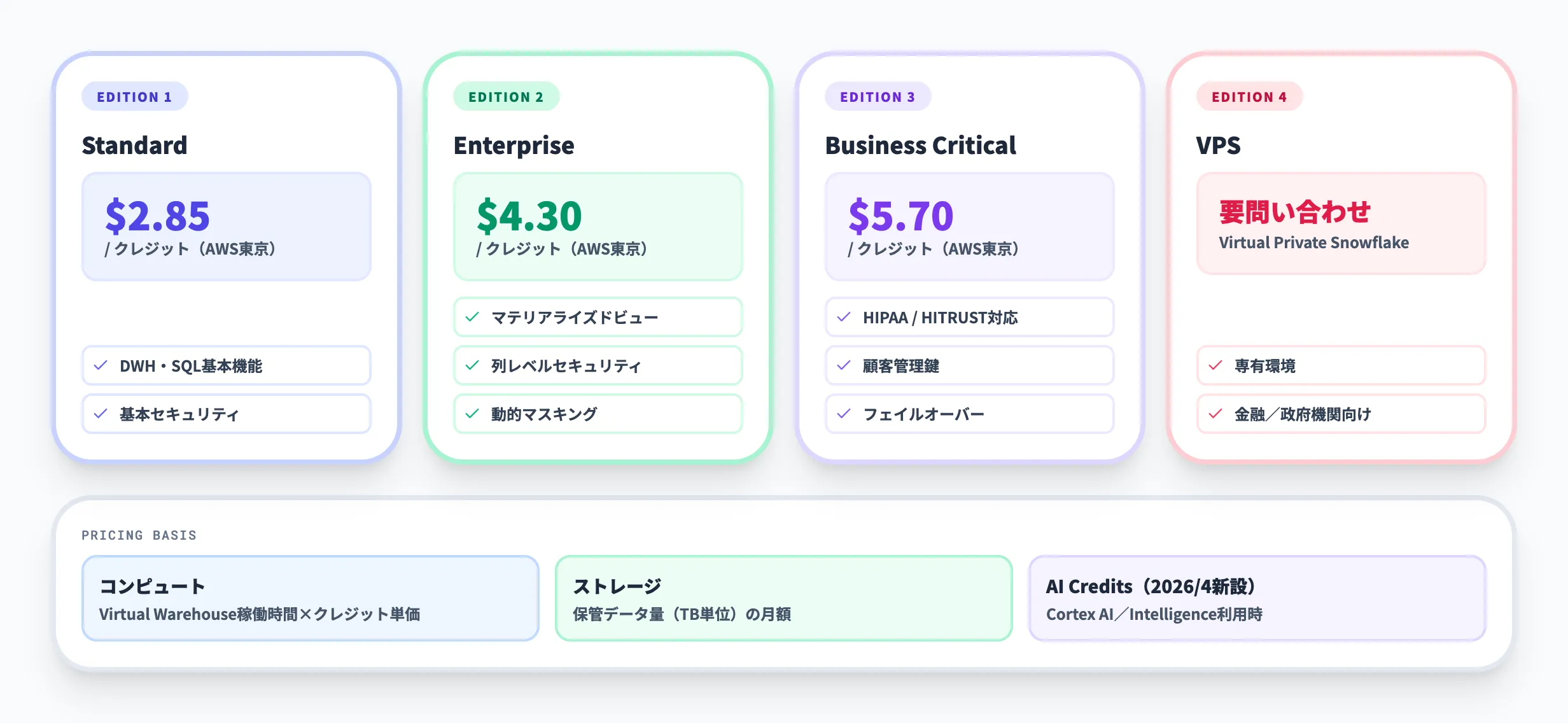

エディションと機能差

Snowflakeのエディションは、上位ほどガバナンスとセキュリティ機能が増える4階建てです。

-

Standard Edition

基本機能。データウェアハウス・データロード・SQL・基本的なセキュリティを含む

-

Enterprise Edition

Standard+マテリアライズドビュー、データの長期保持(最大90日のTime Travel)、列レベルセキュリティ、動的データマスキングなど

-

Business Critical Edition

Enterprise+HIPAA / HITRUST CSF対応、顧客管理鍵、フェイルオーバー機能など、機密性の高いデータを扱う業界向け

-

Virtual Private Snowflake (VPS)

Business Critical+専有環境。金融や政府機関など最も厳格な要件向け

エディションが上がるとクレジット単価も上がるため、必要な機能とコストのバランスを見て選ぶ必要があります。

価格例(2026年4月時点)

Snowflake公式のCredit Consumption Tableによると、AWS東京リージョン(AWS AP Northeast 1 Tokyo)でのOn-Demandクレジット単価は次のとおりです(2026年4月時点)。

| エディション | クレジット単価(AWS東京 / On-Demand) |

|---|---|

| Standard | $2.85 / クレジット |

| Enterprise | $4.30 / クレジット |

| Business Critical | $5.70 / クレジット |

たとえばStandardエディションでX-Smallウェアハウスを1日8時間、月20日稼働させた場合、コンピュート料金は概算で「8時間 × 20日 × 1クレジット × $2.85 = 約$456 / 月」となります。これにストレージ料金とAI Creditsが上乗せされます。

ただし上記はあくまで概算であり、実際の請求はワークロード・オートサスペンド設定・利用エディションで大きく変わります。本番採用時は必ず最新の公式pricingページで確認してください。価格の改定は年に1〜2回あるため、SaaS型サブスクリプションの感覚で「導入時の単価がそのまま続く」とは思わない方が安全です。

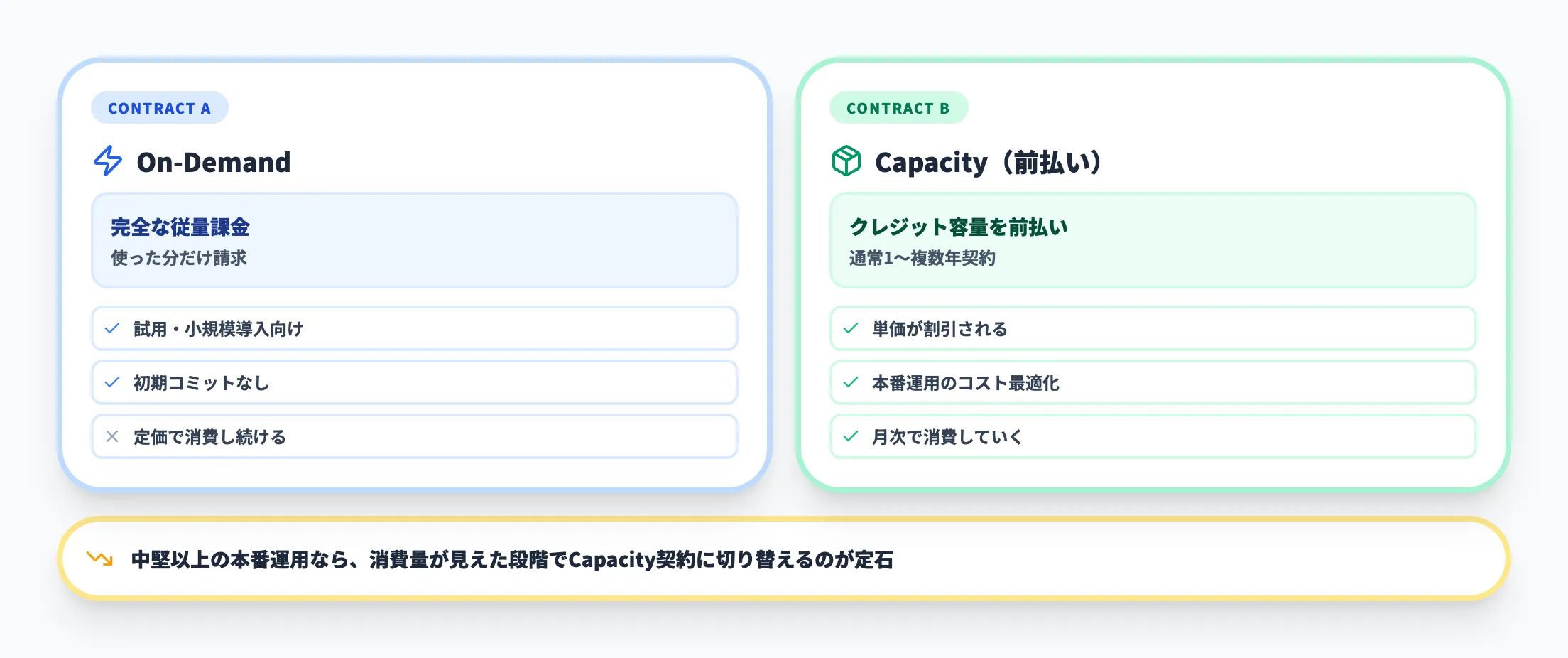

契約形態:On-Demand と Capacity

Snowflakeには2つの契約形態があります。

-

On-Demand

完全な従量課金。クレジットと容量を使った分だけ請求される。試用や小規模導入向け

-

Capacity(前払い)

契約期間(通常1年〜複数年)でクレジット容量を前払いし、月次で消費していく。単価が割引されるためコスト最適化に有効

中堅以上の企業で本番運用するなら、月次のクレジット消費がある程度見えた段階でCapacity契約に切り替えるのがコスト最適化の定石です。On-Demandのまま放置すると、定価で消費し続けるため月額が膨らみます。

Snowflake導入で詰まる論点

Snowflakeの導入を検討する際、特に判断に迷いやすい4つの論点を整理します。これらの論点を事前に詰めずにPoCを始めると、「動いたけど採用できない」という結末になりがちです。

エディション選定を最初に間違えると後で詰む

Standardから始めて、後でBusiness Criticalに乗り換えたくなったときの手戻りが意外と大きいのがエディション選定です。Time Travelの保持期間や動的データマスキング、フェイルオーバーといった機能は、後から追加すると既存テーブルへの再設計が必要になるケースがあります。

実務的なおすすめは、扱うデータに個人情報・機微情報が含まれる可能性があるなら最初からEnterprise以上を選ぶことです。Standardでスタートしてあとから「実はマスキングが必要でした」と気づくと、初期設計をやり直すことになります。データガバナンスの要件は、PoC段階で必ず棚卸ししてください。

コスト見積もりは「やってみないと分からない」部分が大きい

Snowflakeの料金は使った分だけ課金される仕組みなので、事前見積もりがどうしても粗くなります。クエリ頻度・データ量・Virtual Warehouseのサイズ・自動サスペンド設定で結果が大きく変わるため、机上計算で正確な金額を出すのは困難です。

現実的なアプローチは、最初の1〜2か月をパイロット運用と割り切り、実測値を取った上で本番導入時のコストを試算することです。AWSのリザーブドインスタンスのような感覚で、運用が安定したらCapacity契約へ移行して単価を下げるのが定石になります。

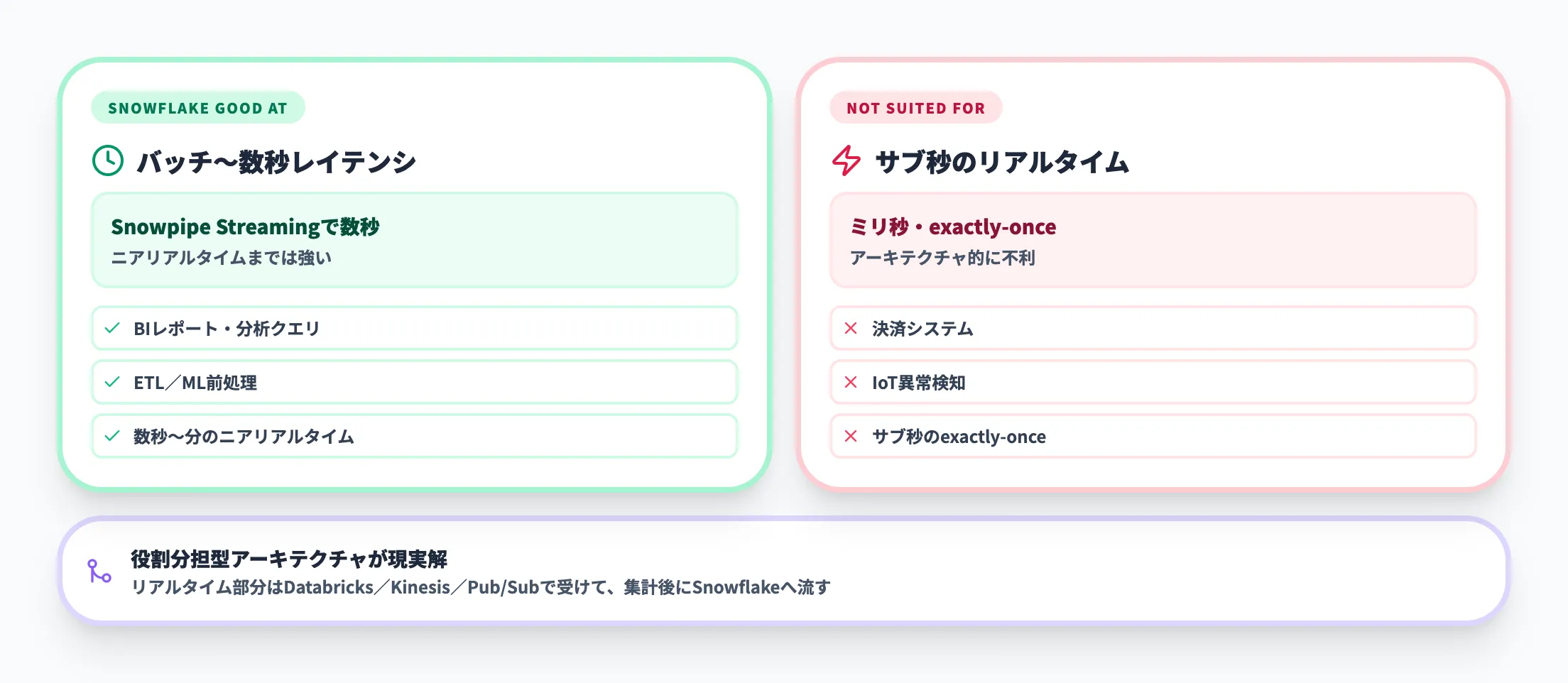

リアルタイム処理が求められるなら別の選択肢も検討

Snowflakeはバッチ〜ニアリアルタイム(数秒〜分単位)には強いですが、ミリ秒単位のリアルタイム処理にはアーキテクチャ的に不利です。Snowpipe Streamingで数秒のレイテンシまでは詰められますが、Databricks Structured StreamingやApache Flinkのように「サブ秒のexactly-once」を求めるユースケースには向きません。

決済システムやIoTのリアルタイム異常検知のような業務では、リアルタイム部分はDatabricksやKinesis / Pub/Subで受けて、集計後にSnowflakeへ流す役割分担型のアーキテクチャを組むのが現実解です。「データ基盤を1つに統合する」という思想と矛盾するように見えますが、無理にSnowflakeで全部やろうとするより、適材適所で分けたほうが運用は安定します。

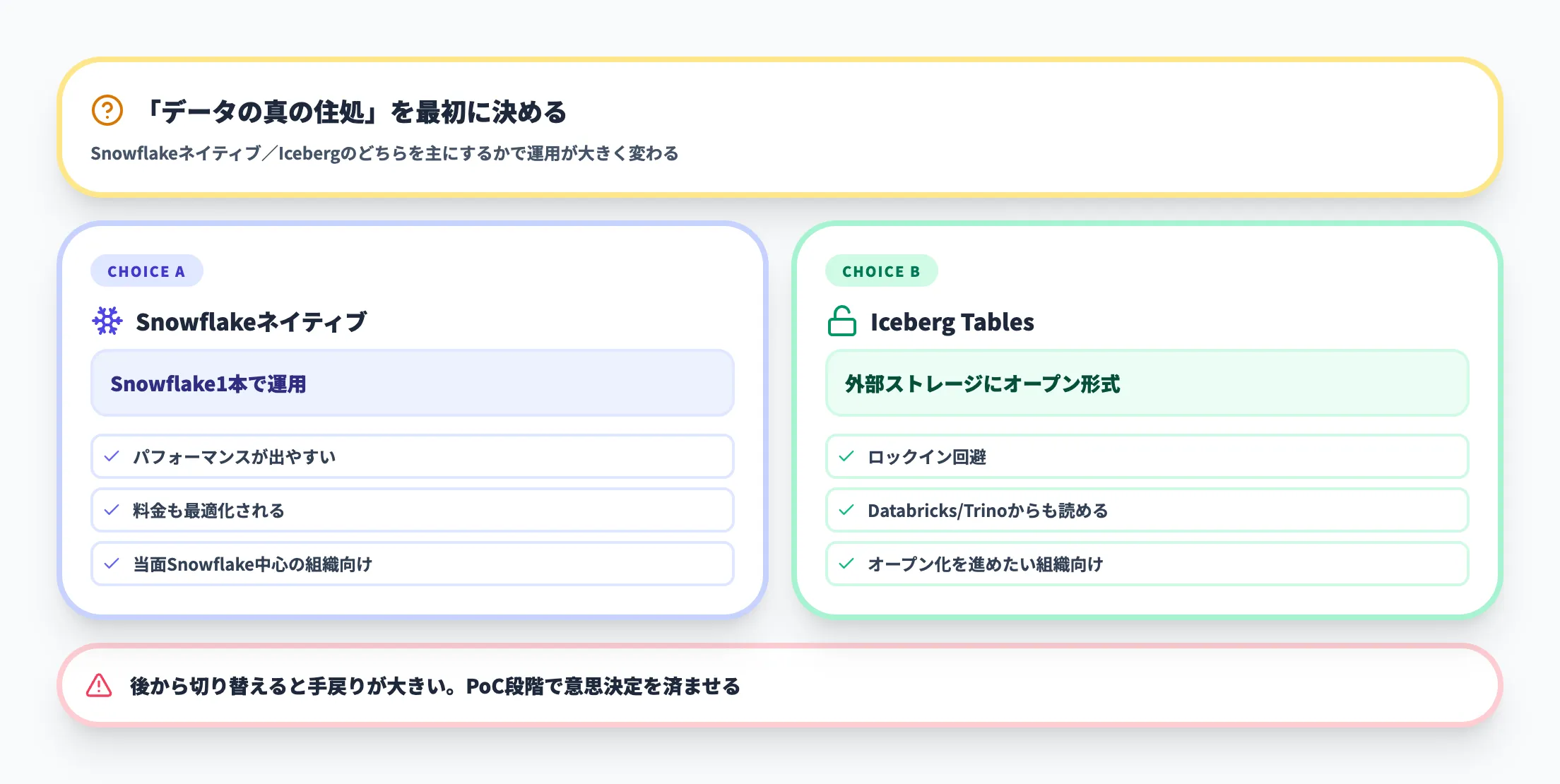

Iceberg移行戦略を最初に決めておく

Snowflakeのネイティブ形式(マイクロパーティション)とApache Iceberg形式は、どちらを主に使うかで運用が大きく変わります。Snowflake内部でロックインを許容するならネイティブ形式、将来的にDatabricksやTrinoなど他のエンジンからも読みたいならIceberg形式、という選択になります。

中期的にデータ基盤のオープン化を進めたい組織は、最初からIceberg Tablesで運用したほうが手戻りが少ないです。逆に当面Snowflake1本で運用するならネイティブ形式の方がパフォーマンスが出やすく、料金も最適化されます。**「データの真の住処を将来どこに置きたいか」**を最初に決めておくことが重要です。

データ基盤とAI活用を同時に前へ進める

Cortex AIを業務に定着させる地図

Snowflakeのようなデータ基盤を整えても、AI機能を業務プロセスにどう落とし込むかの設計が抜けるとROIは出ません。PoCから全社展開までの段階設計、部門別ユースケース、AI活用コストとビジネス価値のバランス策をまとめたAI業務自動化ガイド(220ページ)を無料で公開中です。

まとめ

Snowflakeは、単なるクラウドDWHから「The Snowflake AI Data Cloud」へと進化し、データ基盤と生成AIを1つのプラットフォームに統合する方向へ動いている企業向けデータ基盤の本命プロダクトの1つです。

本記事で解説した3つの価値を再掲します。

- マルチクラウド対応とコンピュート分離で、ベンダーロックインを避けつつ「使った分だけ」のコスト構造を実現できる

- Cortex AIとSnowflake Intelligenceにより、SQLだけでLLM・RAG・エージェントを呼び出せ、データ基盤の上に直接AIを載せられる

- データシェアリング・Marketplace・Iceberg対応で、社内外のデータをオープンに繋いだエコシステムを構築できる

データ基盤の刷新を検討しているなら、まず自社のクラウド戦略と主担当者のスキルセットを起点に、Snowflake / Databricks / BigQuery / Microsoft Fabricのどれが筋が良いかを見極めることが第一歩です。Snowflakeが向くのは「ベンダーニュートラルで運用したい」「DWHを起点にAI活用まで広げたい」「データ共有・横展開を重視したい」というケースです。

導入の最初の一歩としては、既存のDWHから一部のワークロードだけを移してPoCを回すのが現実的です。最初から全面置き換えを狙うと、コスト見積もりや権限設計で詰まるので、影響範囲の狭い領域で実測値を取ってから本格展開に進めてください。