この記事のポイント

IAMやリージョン制御などの運用統制を重視するなら、Gemini APIはVertex AI経由が有力

複雑な業務判断はGemini 2.5 Pro、価格性能重視はGemini 2.5 Flash、大量処理はGemini 2.5 Flash-Liteが基本

初期実装はGoogle Gen AI SDKを軸にすると、Gemini Developer APIとVertex AIの行き来がしやすい

AI Studioの試作を本番化する際は、認証方式、リージョン、チューニング資産の再作成を先に確認すべき

Groundingや長文入力は便利だが、追加課金とデータ保持条件まで見てから構成を決めるべき

Microsoft MVP・AIパートナー。LinkX Japan株式会社 代表取締役。東京工業大学大学院にて自然言語処理・金融工学を研究。NHK放送技術研究所でAI・ブロックチェーンの研究開発に従事し、国際学会・ジャーナルでの発表多数。経営情報学会 優秀賞受賞。シンガポールでWeb3企業を創業後、現在は企業向けAI導入・DX推進を支援。

Gemini APIは、GoogleのGeminiモデル群をアプリや業務システムから呼び出すためのAPIです。2026年4月時点では、Google AI StudioやGemini Developer APIで素早く試作しつつ、IAMやリージョン制御、監視、CMEKなどのGoogle Cloud運用要件がある場合はVertex AI経由で進める設計が有力です。

本記事では、Gemini APIの基本概念から、Vertex AIで使うメリット、Google AI Studioとの違い、Gemini 2.5 Pro / Flash / Flash-Liteの選び方、始め方、料金体系、導入時の注意点までを体系的に解説します。

✅Googleの最新動画生成AIモデル「Gemini Omni」については、以下の記事をご覧ください。

Gemini Omniとは?その性能や使い方、料金体系を徹底解説!

目次

Function callingとStructured outputで業務処理につなぐ

Grounding、RAG、Batch、Context cachingで本番運用に寄せる

低遅延と大量処理はGemini 2.5 Flash-Lite

Google CloudプロジェクトとVertex AI APIを有効化する

Gemini APIとは

Gemini APIは、GoogleのGeminiモデル群をアプリケーションや業務システムから呼び出すためのAPIです。Google CloudのGenerative AI overviewでは、Vertex AI上の主要な生成AI APIとしてGemini APIとImagen APIが案内されており、Gemini APIは高度な推論、マルチターン会話、コード生成、マルチモーダル入力を担う中核に位置づけられています。

この記事で扱うのは、Google CloudのVertex AI経由で使うGemini APIです。試作だけならGoogle AI StudioやGemini Developer APIでも始められますが、社内システム連携や権限管理まで含めて本番運用を考えるなら、Vertex AI経由の設計が選択肢に入ってきます。

Vertex AI経由で使うGemini APIの位置づけ

Googleの比較ページでは、Gemini Developer APIは最速で試作を始める道として案内される一方、Vertex AIはGoogle Cloud上のエンタープライズ向け機能群を伴う実装先として整理されています。

つまり、Gemini APIという言葉自体は同じでも、実際には次の2系統があります。

- Gemini Developer API

APIキー中心で素早く試作しやすい経路です。小規模アプリや個人開発で入りやすい反面、Google Cloud側の運用統制は別途考える必要があります。

- Vertex AI Gemini API

Google Cloudプロジェクト、IAM、リージョン、監視、コスト管理、VPC Service ControlsやCMEKといった企業向けの制御と合わせて使う前提です。これらの運用要件がある場合に有力な選択肢です。

検索意図として多いのは「Gemini APIをどこから使うべきか分からない」という悩みですが、結論としては、試作スピードを優先するならDeveloper API、運用統制まで含めるならVertex AI、と切り分けると判断しやすくなります。

Google AI Studio単体との違い

Google AI Studioはプロンプト検証やUIベースの試作に向いていますが、Vertex AIはGoogle Cloud統制まで含めた実装基盤です。Googleの移行ガイドとVertex AI quickstartをもとに整理すると、違いは次のとおりです。

| 観点 | Google AI Studio / Gemini Developer API | Vertex AI Gemini API |

|---|---|---|

| 主な用途 | 試作、個人開発、少人数開発 | 企業導入、Google Cloud統制が必要な開発 |

| 認証 | APIキー中心 | ADC、サービスアカウント、短命トークン |

| 管理単位 | APIキー、Studio上の資産 | Google Cloudプロジェクト、IAM、監視、課金 |

| リージョン | Developer API側の提供条件に依存 | Vertex AIの対応リージョンと多リージョンを選択可能 |

| 注意点 | 早く始めやすい | AI Studio APIキーはそのまま使えない |

この表から分かるのは、両者は競合というより役割分担だということです。まずAI Studioで確かめ、業務システムに接続する段階でVertex AIに寄せる進め方は十分現実的です。

Gemini APIでできること

Gemini APIを評価するときは、単に文章生成ができるかではなく、どこまで業務処理に組み込めるかを見るべきです。Vertex AIではモデル単体だけでなく、構造化出力、関数呼び出し、グラウンディング、RAG、バッチ処理まで周辺機能を含めて設計できます。

マルチモーダル入力と100万トークン文脈

Gemini 2.5 ProのモデルページとGemini 2.5 Flash-Liteのモデルページでは、2.5系モデルがテキスト、コード、画像、音声、動画を入力でき、最大104万8576トークンの入力を扱えると案内されています。

このため、Gemini APIは単なるチャット応答だけでなく、次のような処理に向きます。

- 長い契約書や仕様書の読解

PDFや複数文書をまとめて読み込み、比較や要点整理を行いやすくなります。

- 画像や動画を含む問い合わせ処理

写真や画面キャプチャを含む問い合わせから、説明文や回答を返す設計ができます。

- コードベースやログを含む解析

コード、設定ファイル、運用ログをまたいで原因調査や修正案生成を行う用途に向きます。

特に、Gemini 2.5 Proの記事やGemini 2.5 Flashの記事でも触れたように、長文処理とマルチモーダルが一体で扱える点がGemini APIの強みです。

Function callingとStructured outputで業務処理につなぐ

Gemini APIを実務で使ううえで重要なのが、自然言語をそのまま返すだけでなく、業務システムが処理しやすい形に落とせることです。Gemini 2.5 ProとGemini 2.5 Flash-Liteの両ページでは、Function callingとStructured outputの対応が明示されています。

これにより、たとえば次のような構成が取りやすくなります。

- 自然言語の依頼をAPI呼び出しに変換

ユーザーの依頼内容を受けて、社内APIや外部SaaSの呼び出しパラメータに変換できます。

- JSON前提の下流処理

承認判定、問い合わせ分類、レコメンド結果などをJSONで返し、後続システムに流しやすくできます。

- 人手承認を挟んだ半自動化

完全自動化ではなく、下書き生成や候補提示までをGemini APIに任せ、人が最終確認する構成にも向いています。

業務導入で詰まりやすいのは、「自然言語で賢い」ことと「システム連携しやすい」ことを混同する点です。Gemini APIは後者まで設計しやすいからこそ、PoCから本番に移しやすいと言えます。

Grounding、RAG、Batch、Context cachingで本番運用に寄せる

Vertex AI経由のGemini APIは、モデル単体よりも周辺機能の厚みが大きな価値です。2024年9月のGoogle Cloud Blogでは、Grounding with Google Search、Batch API、Prompt Management、評価機能などが本番移行の要素として整理されています。

実装上は、次の機能が特に効きます。

- Grounding with Google Search

最新情報を参照しながら回答を返す用途に向きます。Web検索連携の有無をアプリ側で制御できます。

- Vertex AI RAG Engine

社内文書や社内ナレッジを検索対象にした回答生成を構成しやすくなります。

- Batch API

非リアルタイム処理をまとめて流し、コストを抑えながら分類や抽出を回せます。

- Context caching

長い共通プロンプトや共通知識を再利用し、レイテンシとコストを下げやすくなります。

要するに、Gemini APIを評価するときはモデル性能だけを比べるのでは不十分です。検索、社内データ、バッチ、キャッシュまで含めて設計すると、実務での使い勝手が大きく変わります。

Gemini APIで使うモデルの選び方

Vertex AI pricingを見ると、2026年4月時点では、Gemini 3系のプレビュー群と、Gemini 2.5系のGAモデル群が併存しています。安定運用を優先するならGA中心、最新機能の評価を優先するならプレビューも含めて見る、という考え方が実務では扱いやすいです。

まずは用途別の大づかみを表で整理します。

| 用途 | 主な候補 | 向いているケース | 注意点 |

|---|---|---|---|

| 高度な推論・複雑判断 | Gemini 2.5 Pro | 仕様比較、長文読解、複雑な業務ルール判定 | 単価が高め。200K超入力では単価差が広がる |

| 価格性能バランス | Gemini 2.5 Flash | 一般的なチャット、分類、要約、RAG応答 | 高難度推論ではProに劣ることがある |

| 大量処理・低コスト | Gemini 2.5 Flash-Lite | 大量分類、抽出、前処理、定型問い合わせ | Chat Completions非対応など機能差がある |

| 最新機能の検証 | Gemini 3.x Preview | 新機能や性能改善の先行評価 | 価格と仕様の変動が大きく、本番固定には不向き |

この表の読み方として重要なのは、「最強モデルを1つ決める」のではなく、用途ごとに役割分担することです。実務では、難しい判断だけProに寄せ、その他はFlash系に逃がす構成のほうがコストを制御しやすくなります。

高度な推論や複雑な業務判断はGemini 2.5 Pro

Gemini 2.5 Proの公式ページでは、複雑な問題解決、複数情報源の理解、大規模コードベース理解向けの最上位モデルとして説明されています。Function calling、Structured output、Thinking、Context caching、RAG Engine、Chat completionsまで広く対応しているため、機能面で最も選びやすいモデルです。

向いているのは、契約書比較、業務フロー判定、長大な議事録要約、複数文書をまたぐ照合など、判断の質を優先したいケースです。逆に、問い合わせ分類やFAQ要約のような大量処理をすべてProに寄せると、費用効率が悪くなりやすいです。

価格と性能のバランスはGemini 2.5 Flash

Gemini 2.5 Flashは、速度とコストと性能のバランスを取りたいときの中心候補です。Vertex AI pricingでも、Proより明確に低い価格帯で設定されており、Grounding with Google Searchの無料枠も付いています。

RAG応答、一般的なチャット、要約、分類、簡単なツール呼び出しであれば、まずFlashから検証するのが堅実です。PoCで最初に触るモデルとしても扱いやすく、性能不足が見えた部分だけProへ切り替える判断ができます。

低遅延と大量処理はGemini 2.5 Flash-Lite

Gemini 2.5 Flash-Liteの公式ページでは、低レイテンシ用途に最適化されたバランスモデルとして整理されています。1Mトークン文脈、Function calling、Structured output、Grounding、RAG Engineには対応していますが、Chat completionsやLive APIは非対応です。

そのため、Flash-Liteは「安い万能モデル」というより、用途がはっきりした大量処理向けモデルとして考えるべきです。問い合わせ一次分類、ドキュメント抽出、タグ付け、前処理のようなワークロードではかなり相性が良い一方、既存のOpenAI互換実装をそのまま流し込みたい案件では制約が出ます。

Gemini APIの始め方

Gemini APIをVertex AIで使い始める流れは、見た目ほど複雑ではありません。ただし、AI Studioの延長で考えると認証方式や課金条件で詰まりやすいので、最初にGoogle Cloud側の前提を揃えることが重要です。

Google CloudプロジェクトとVertex AI APIを有効化する

Vertex AI quickstartでは、Google Cloudプロジェクトの作成、課金有効化、Vertex AI APIの有効化、gcloud CLIの初期化が最初の前提として案内されています。

実務では、次の順で進めるとぶれません。

- 対象プロジェクトを決める

PoC専用プロジェクトか、本番候補プロジェクトかを最初に分けておきます。

- 課金とAPIを有効化する

Vertex AI APIを有効化し、請求先アカウントを紐づけます。

- リージョン方針を先に決める

後からデータ所在要件が出やすいため、利用リージョンは初期段階で固定したほうが安全です。

特に注意したいのは、公式Quickstartにあるとおり、AI StudioのAPIキーはVertex AIではそのまま使えない点です。ここを見落とすと、試作コードを持ってきた直後に止まります。

認証方式はADCを基本にする

Google Cloud上でのGemini API利用では、ローカル開発ならApplication Default Credentials、サーバー運用ならサービスアカウントを基本にするのが自然です。認証ガイドでも、OpenAIライブラリ互換の呼び出しを含めて、短命のアクセストークン運用が案内されています。

開発初期で迷ったら、次の切り分けで十分です。

- ローカル検証

ADCで始める

- Cloud RunやGKEなどの本番環境

サービスアカウントで権限を絞る

- OpenAI SDK互換コードを活かしたい

Vertex AIのOpenAI互換エンドポイントとアクセストークン運用を使う

最初に認証を雑に決めると、PoC後に権限再設計が発生します。Gemini APIはモデル呼び出し自体より、認証と監査の整理のほうが後で効いてきます。

Google Gen AI SDKから最初の呼び出しを作る

Googleの比較ページでは、Gemini Developer APIとVertex AIの両方がGoogle Gen AI SDKで統一的に扱えると説明されています。新規実装なら、このSDKを軸にするのが最も無難です。

また、Generative AI on Vertex AI deprecationsでは、Vertex AI SDKの旧Generative AI moduleが2025年6月24日に非推奨化され、2026年6月24日に削除予定とされています。新規実装で旧SDK前提にすると、まもなく移行作業が必要になります。

もし自社で最初に試すなら、まずは1つのプロンプトをFlashで呼び、次にFunction callingかStructured outputを足し、最後にRAGかGroundingを加える順序をおすすめします。最初から全部入りで組むより、どの追加機能が本当に必要かを見極めやすいです。

Gemini APIの活用事例

Gemini APIは概念上の便利さだけでなく、すでに複数の企業で本番活用が進んでいます。ここでは、Google Cloudの公式事例から、用途の違う3パターンを見ておきます。

Snap

Google Cloud Blogの事例記事では、SnapがGeminiのマルチモーダル機能をMy AIチャットボットに導入し、米国でのMy AI内エンゲージメントが2.5倍になったと紹介されています。

この事例は、Gemini APIが単なる社内向け自動化だけでなく、消費者向けプロダクトの対話体験改善にも使えることを示しています。画像や文脈を伴う会話体験を強化したい場合、Geminiのマルチモーダルはかなり相性が良いです。

Elanco

同じGoogle Cloud Blogでは、動物医療企業のElancoがVertex AIとGeminiを用いた生成AIフレームワークを構築し、Pharmacovigilance、受注、臨床インサイト支援などの重要業務を支え、推定190万ドルのROIを生んだと説明されています。

この事例が示すのは、Gemini APIの価値がチャットボット単体ではなく、複数業務をまたいだ意思決定支援にあることです。検索、要約、分類、推論を1つのモデル層で扱えるからこそ、部門横断の展開がしやすくなります。

AIHelp

Google CloudのAIHelp事例では、AIHelpがGeminiを使ってサポート体験を改善し、顧客満足度を5%から10%引き上げ、ケース解決効率を30%向上させたと紹介されています。

この事例は、Gemini API導入の成否が「モデルを入れたか」ではなく、「どの業務指標を改善したか」で決まることを示しています。サポート、検索、要約、ケース分類のような定量化しやすい業務から入るほうが、PoC後の説得力が出ます。

もし自社で試すなら、最初のKPIは1つに絞るべきです。たとえば、問い合わせ一次分類時間、要約作成時間、レビュー工数、自己解決率のいずれか1つから始めると、Gemini APIの価値を社内で説明しやすくなります。

Gemini API活用を業務実装へ

モデルAPIの先にある業務接続と運用設計を整理

Gemini APIで推論や自動化を試せても、実運用では業務システム連携、権限設計、実行ログ管理まで含めた設計が必要です。AI Agent Hubの資料で、モデルAPI活用を業務実装へつなぐ全体像をご確認ください。

Gemini APIと他サービスの違い

Gemini APIを選ぶ場面では、Google AI Studio、Vertex AI全体、Gemini for Google Cloudなど似た名前のサービスと混同しやすいです。ここを整理しておくと、導入判断で迷いにくくなります。

Google AI Studio / Gemini Developer APIとの違い

最も大きな違いは、試作最適化か、Google Cloud統制を含む実装かです。Googleの公式比較ページでは、Gemini Developer APIは最速で始めるための経路、Vertex AIはエンタープライズ向け機能を伴う実装基盤として説明されています。

そのため、次の使い分けが基本になります。

- UIで素早くプロンプトを試したい

Google AI Studioが向いています。

- 社内システムやクラウド基盤と統合したい

Vertex AI経由のGemini APIが向いています。

- 試作コードを最小改修で移したい

Google Gen AI SDKを使うと切り替えがしやすくなります。

【関連記事】

Google AI Studioとは?使い方や料金、商用利用を解説!【無料】

Vertex AI全体との違い

Vertex AIとは何かを押さえると分かりやすいのですが、Vertex AIはプラットフォーム全体の名前であり、Gemini APIはその中のモデルアクセス層です。

ざっくり言えば、役割分担は次のとおりです。

- Gemini API

モデル推論、Function calling、Structured outputなど、モデル呼び出しの中心機能

- Vertex AI

モデル利用に加えて、評価、RAG、Agent Builder、Model Garden、監視、コスト管理まで含む広い基盤

この違いを知らないまま「Gemini APIを入れれば運用まで全部付いてくる」と考えるとズレます。実際には、Gemini APIはモデル層であり、周辺運用はVertex AI全体で補う構図です。

導入判断で詰まる論点

概念比較でよく詰まるのは、「まず何を選ぶべきか」ではなく「何を固定してから選ぶべきか」です。判断軸は次の3つに絞るとぶれません。

- 本番運用の統制が必要か

必要ならVertex AI側から設計する

- 高難度推論が中心か、大量処理が中心か

高難度ならPro、大量処理ならFlash系を主軸にする

- Web最新情報や社内データをどこまで混ぜるか

GroundingやRAGの有無で構成もコストも変わる

AI総合研究所としては、社内ワークフローや基幹システム連携に加えて、IAMやリージョン制御まで求めるなら、最初からVertex AI基準でPoCを組むほうが手戻りは少ないと考えます。個人検証ならAI Studioでも十分ですが、企業導入は別の設計論点が入ってきます。

Gemini APIの注意点

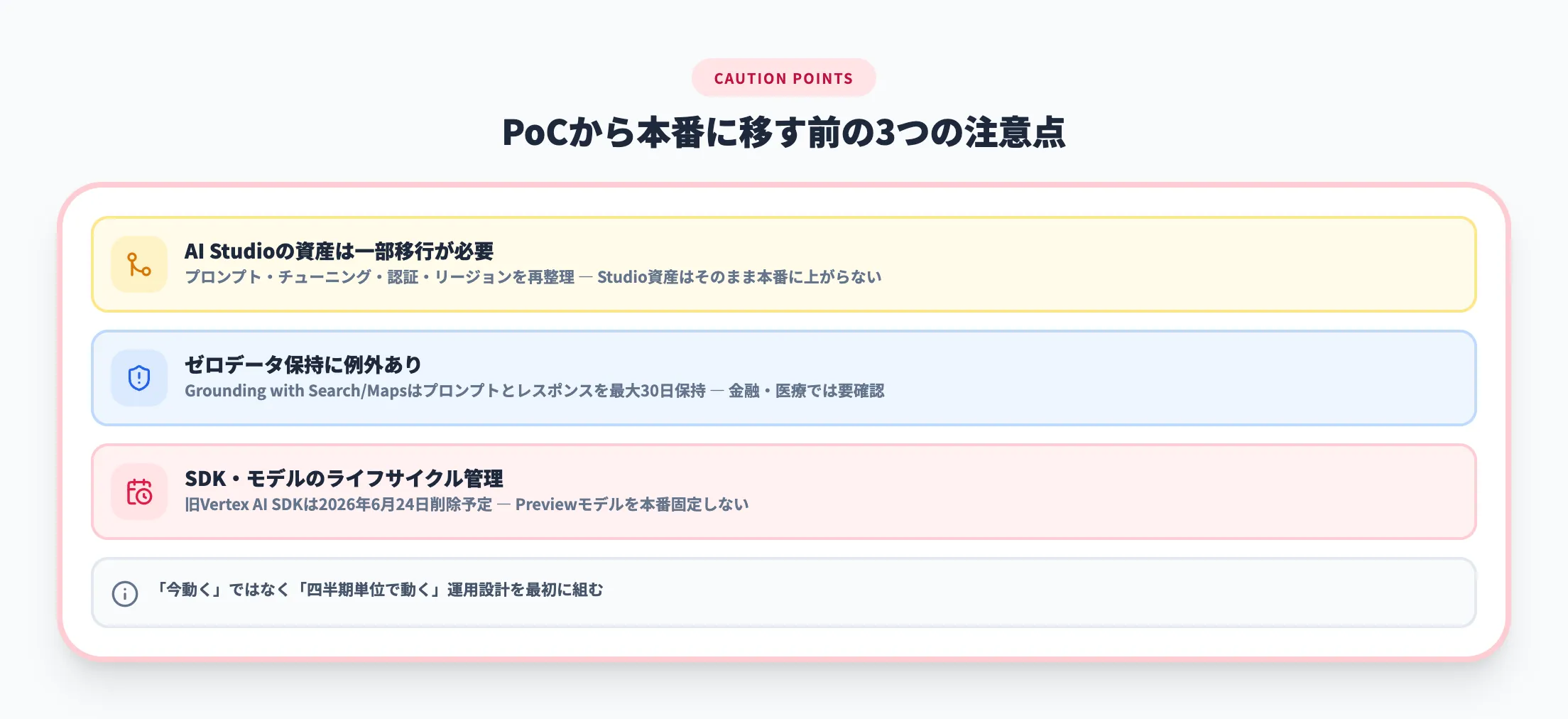

Gemini APIは始めやすい一方で、PoCから本番に移す段階で見落としやすい論点があります。特に、資産移行、データ保持、SDK寿命の3点は先に見ておくべきです。

Google AI Studioの資産は一部移行が必要

Googleの移行ガイドでは、Google AI Studioで作成したモデルはVertex AIで再トレーニングが必要と明記されています。プロンプトや周辺資産もそのまま移せる前提ではなく、再整理が必要になるケースを見込んでおくべきです。

つまり、AI Studioでの試作は無駄ではありませんが、そのまま本番に持ち上がるわけではありません。評価観点としては、次の順に確認するのが安全です。

- プロンプト

再利用できるか

- チューニング資産

再作成が必要か

- 認証とリージョン

本番要件に合うか

ゼロデータ保持要件はGroundingの例外まで確認する

Vertex AI and zero data retentionでは、ゼロデータ保持を有効にした場合でも、Grounding with Google SearchとGrounding with Google Mapsを使うと、プロンプトとレスポンスが検索のために最大30日保持されると説明されています。

そのため、金融、公共、医療などで厳しいデータ保持条件がある場合は、単にVertex AIだから安全と考えるのでは不十分です。検索グラウンディングを使うかどうかで条件が変わるため、法務やセキュリティ部門と前提を合わせる必要があります。

SDK切り替えとモデルライフサイクルを運用に組み込む

Generative AI on Vertex AI deprecationsでは、旧Vertex AI SDKのGenerative AI moduleが2026年6月24日に削除予定とされています。さらに、モデルページには各モデルの提供リージョン、GAかPreviewか、廃止予定日が明記されています。

つまり、Gemini API運用では「今動く」だけでなく、次の点も運用設計に含める必要があります。

- Previewモデルを本番固定しない

仕様変更や価格変更の影響を受けやすいです。

- SDK更新を四半期単位で確認する

旧SDK依存は近いうちに止まります。

- モデルIDの固定方針を決める

エイリアス追随か、明示的なバージョン固定かで保守性が変わります。

Gemini APIの料金体系

Gemini APIの料金は、モデル名だけでなく、入力長、処理方式、Grounding有無でかなり変わります。見積もりでは「どのモデルを使うか」だけでなく、「長文か」「リアルタイムか」「バッチか」「検索連携するか」まで分解して考える必要があります。

料金を決める主な要素

Vertex AI Pricingでは、Gemini 2.5系について、Standard、Priority、Flex/Batch、Grounding追加料金が分かれて掲載されています。見積もりに効く主要要素は次の4つです。

- モデルの種類

Pro、Flash、Flash-Liteで単価が大きく変わります。

- 入力長

Gemini 2.5 Proは200K入力を超えると単価が上がります。

- 処理方式

リアルタイム重視のStandardやPriorityより、Flex/Batchのほうが安いです。

- 追加機能

Grounding with Google Search、Grounding with your data、Google Maps連携は別料金が入ります。

2026年4月時点の主な価格例

まず、よく使う2.5系GAモデルの主要価格を整理します。以下は2026年4月時点の公式価格ページ記載値のうち、200K入力以下で見た代表値で、通貨はUSDです。

| モデル | Standard入力単価 | Standard出力単価 | Flex/Batch入力単価 | Flex/Batch出力単価 |

|---|---|---|---|---|

| Gemini 2.5 Pro | 100万トークンあたり1.25ドル | 100万トークンあたり10ドル | 100万トークンあたり0.625ドル | 100万トークンあたり5ドル |

| Gemini 2.5 Flash | 100万トークンあたり0.30ドル | 100万トークンあたり2.50ドル | 100万トークンあたり0.15ドル | 100万トークンあたり1.25ドル |

| Gemini 2.5 Flash-Lite | 100万トークンあたり0.10ドル | 100万トークンあたり0.40ドル | 100万トークンあたり0.05ドル | 100万トークンあたり0.20ドル |

この表だけでも、ProとFlash-Liteではかなり差があります。分類や抽出を大量に回すならFlash-Lite、複雑な判断が必要な箇所だけPro、と分けるだけでコスト設計は大きく変わります。

Groundingや長文入力で見落としやすい追加コスト

同じ価格ページでは、Grounding with Google SearchはFlash系で1日1500件、Proで1日10000件まで無料枠があり、それを超えると1000件あたり35ドル、Grounding with your dataは1000リクエストあたり2.5ドル、Grounding with Google Mapsは1000 grounded promptsあたり25ドルと案内されています。

さらに、Gemini 2.5 Proは200K入力を超えると入力単価だけでなく出力単価も上がります。長文RAGや動画・音声処理では、この閾値を超えるかどうかで見積もりがぶれやすいです。

料金で詰まる企業は、モデル単価よりも追加機能で想定外の差が出るケースが多いです。PoCの見積もりでは、まずモデル単価、次にGrounding有無、最後に長文入力割合の3段で切ると読みやすくなります。

Gemini APIの活用を業務実装まで進めるなら

Gemini APIは、要約、分類、検索、推論、ツール呼び出しまで幅広く扱えるため、PoCは比較的進めやすいテーマです。ただし、業務で成果を出すには、どのシステムから呼び出すか、誰が何を実行できるか、どの出力を人が確認するかまで設計しなければ定着しません。

特に、Google AI Studioでの試作からVertex AIのような企業向け基盤へ移る段階では、認証、権限、実行ログ、既存SaaS連携の整理が一気に重くなります。モデルAPIの性能だけを見て進めると、ここで止まりやすくなります。

AI総合研究所のAI Agent Hub資料では、Gemini APIのような既存モデルAPIを前提に、業務システム連携、管理ダッシュボード、実行導線の整備をどう進めるかを整理しています。Gemini API活用を個別実験で終わらせず、業務実装へつなぐ判断材料としてご確認ください。

Gemini API活用を業務実装へ

モデルAPIの先にある業務接続と運用設計を整理

Gemini APIで推論や自動化を試せても、実運用では業務システム連携、権限設計、実行ログ管理まで含めた設計が必要です。AI Agent Hubの資料で、モデルAPI活用を業務実装へつなぐ全体像をご確認ください。

Gemini APIのまとめ

Gemini APIは、GoogleのGeminiモデルをアプリや業務システムから利用するための中核APIです。2026年4月時点では、Google AI StudioやGemini Developer APIで素早く試しつつ、IAMやリージョン制御、Google Cloud統制が必要な場合にVertex AIを選ぶ、という住み分けが分かりやすくなっています。

特に重要なのは、モデル性能だけでなく、認証、リージョン、Grounding、RAG、Batch、コスト管理まで含めて設計することです。まずはFlash系で小さく検証し、複雑な判断だけProへ寄せる構成から始めると、PoCでも本番でも手戻りが少なくなります。