この記事のポイント

AIコーディングエージェントを「開発専用ツール」として選ぶならCodexが第一候補。2026年4月にComputer Use・画像生成・メモリが統合され、デスクトップ上の実アプリ操作まで範囲が広がった

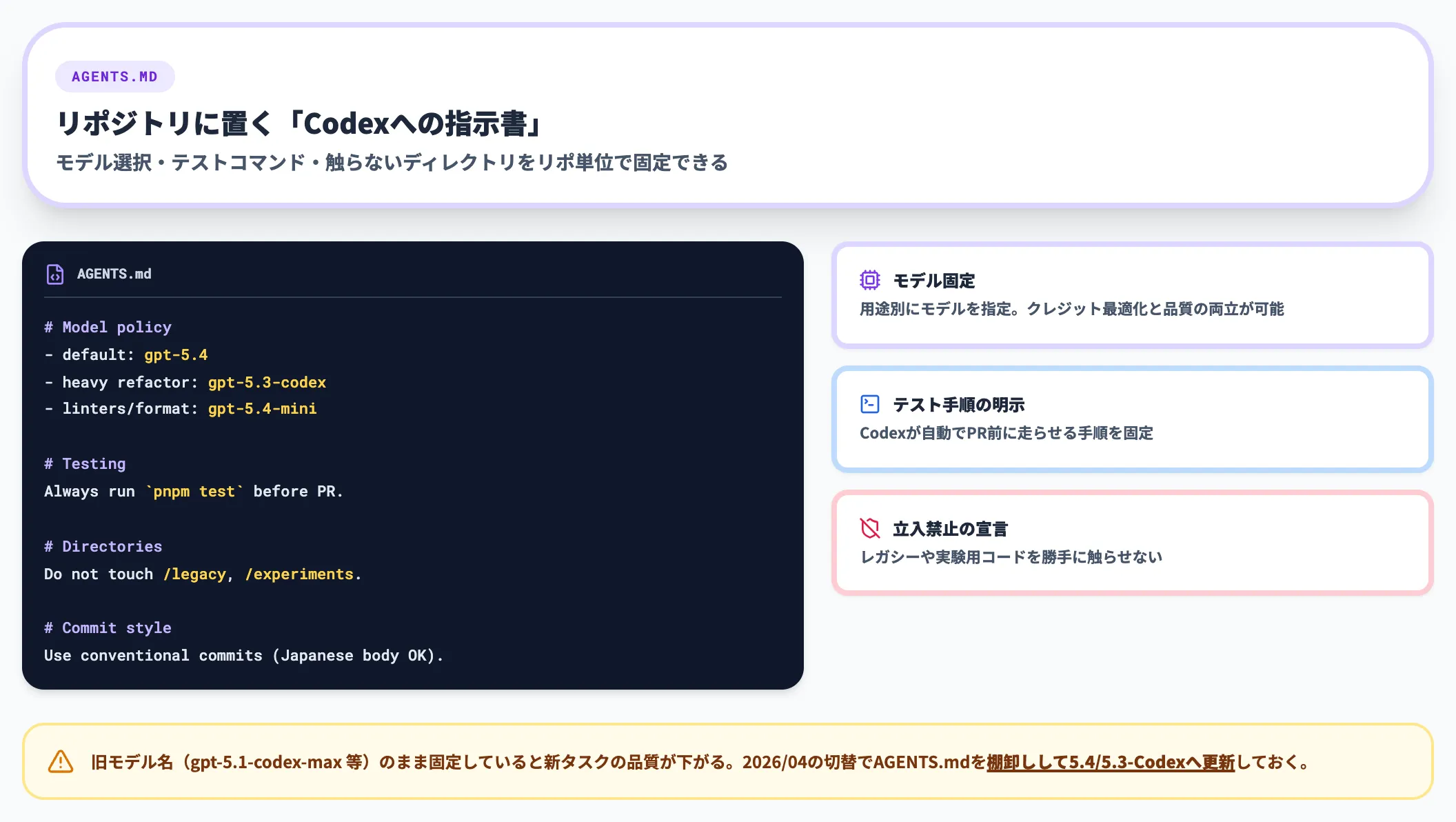

現行の主力モデルはGPT-5.4とGPT-5.3-Codex。旧GPT-5-Codex・GPT-5.1系・GPT-5.2-Codexはデフォルトから外れているため、CI/CD設定やAGENTS.mdにモデル名を明記している場合は棚卸しが必要

料金は2026年4月2日にPlus・Pro・Business・新規EnterpriseがAPIトークンベースのクレジット制へ移行(既存Enterprise/Eduはレガシー料金表を継続)。Plus $20・新設Pro $100・Pro $200・Businessの順で、使い方に応じて段階導入するのが現実的

90超のプラグインで Sentry / Datadog / Linear などと連携でき、自動トリガーでGitHubのIssue/PRイベントから即座にCodexが動く。単なる生成ツールではなく「運用基盤」として設計すべき

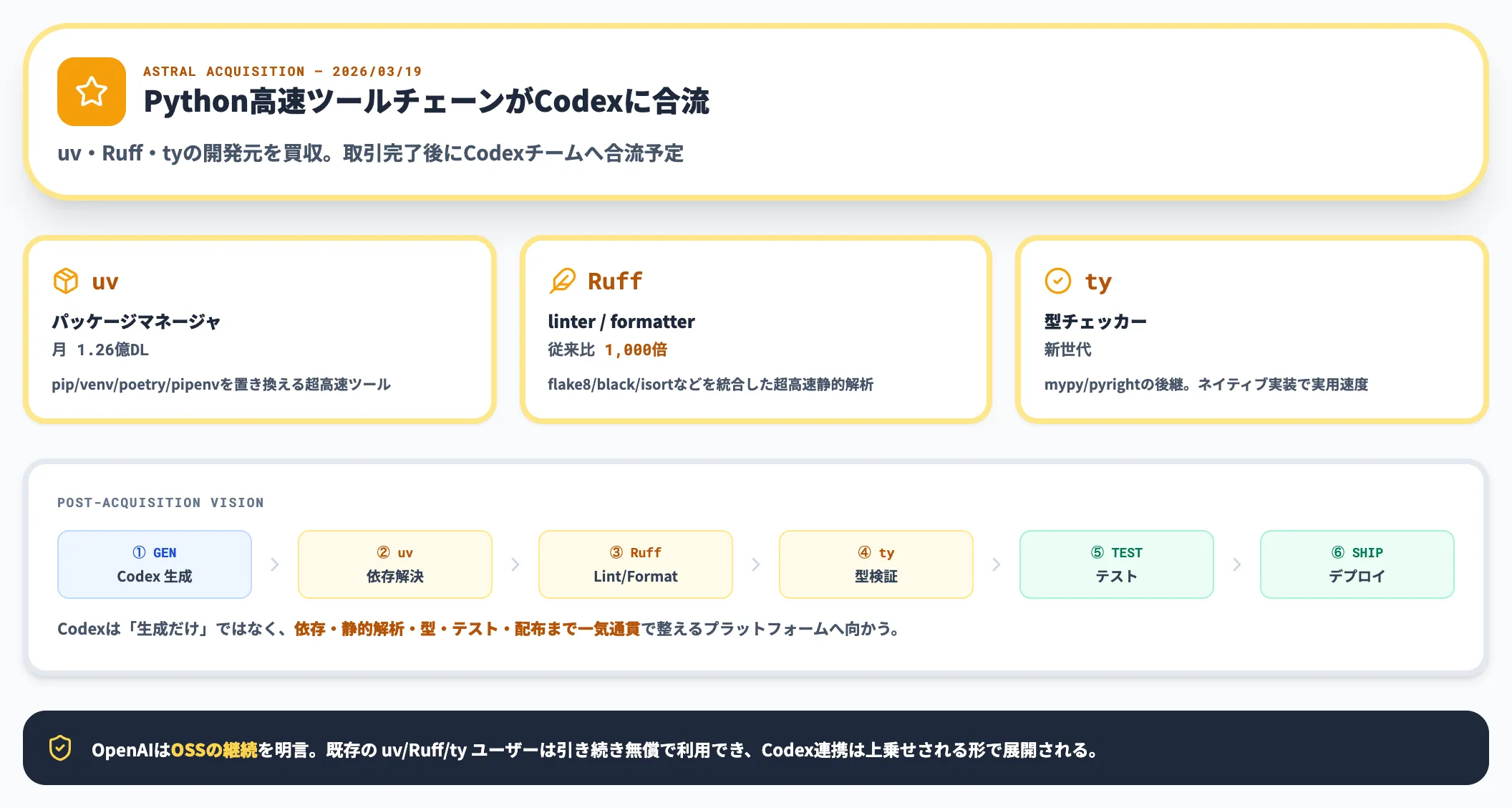

OpenAIは2026年3月19日にAstral買収を発表。取引完了後にuv・Ruff・tyを含むAstralチームがCodexチームへ合流する見込みで、Python中心のチームはCodex + uv/Ruffの一気通貫運用を視野に入れておくと良い

Microsoft MVP・AIパートナー。LinkX Japan株式会社 代表取締役。東京工業大学大学院にて自然言語処理・金融工学を研究。NHK放送技術研究所でAI・ブロックチェーンの研究開発に従事し、国際学会・ジャーナルでの発表多数。経営情報学会 優秀賞受賞。シンガポールでWeb3企業を創業後、現在は企業向けAI導入・DX推進を支援。

Codexは、OpenAIが提供するAIコーディングエージェントで、バグ修正から大規模リファクタリング、コードレビューまでを自律的にこなします。

2026年4月16日には大型アップデート「Codex for (almost) everything」が発表され、PC操作(Computer Use)、gpt-image-1.5による画像生成、メモリ、アプリ内ブラウザ、90超のプラグインが一気に追加されました。主力モデルはGPT-5.4とGPT-5.3-Codex系に整理され、旧GPT-5-Codex系は現行のデフォルトから外れています。

本記事では、Codexの基本機能から、2026年4月の最新アップデート、モデル構成、CLI・IDE・Cloud・macOS/Windowsでの使い方、新Pro $100プランを含む料金体系、Astral買収発表(uv・Ruff)によるPythonツール統合の方向性、Cisco・Instacart・Harveyの導入事例、セキュリティまでを、2026年4月時点の公式情報にもとづいて整理します。

AI総合研究所では、企業のChatGPT / Codex導入支援を行っています。お気軽にご相談ください。

目次

GitHub Copilot / ChatGPTとCodexの違い

Codex「for (almost) everything」アップデート

Computer Use:macOSアプリ上の他アプリを直接操作

画像生成(gpt-image-1.5):モックアップまでCodexで完結

90超の追加プラグイン(Sentry / Datadog / Linear ほか)

Codexの使い方(CLI / IDE / Cloud / デスクトップアプリ)

1. Codex CLI(Realtime Voice V2・MCP強化)

4. macOSデスクトップアプリ(Computer Use対応)

Pull Request(PR)の提案・レビュー・自動トリガー

【GPT-5.4】Computer Use標準装備のフラグシップ

【GPT-5.4 mini】軽量・高速のサブエージェント向け

【GPT-5.3-Codex】長時間タスク向け専用フラグシップ

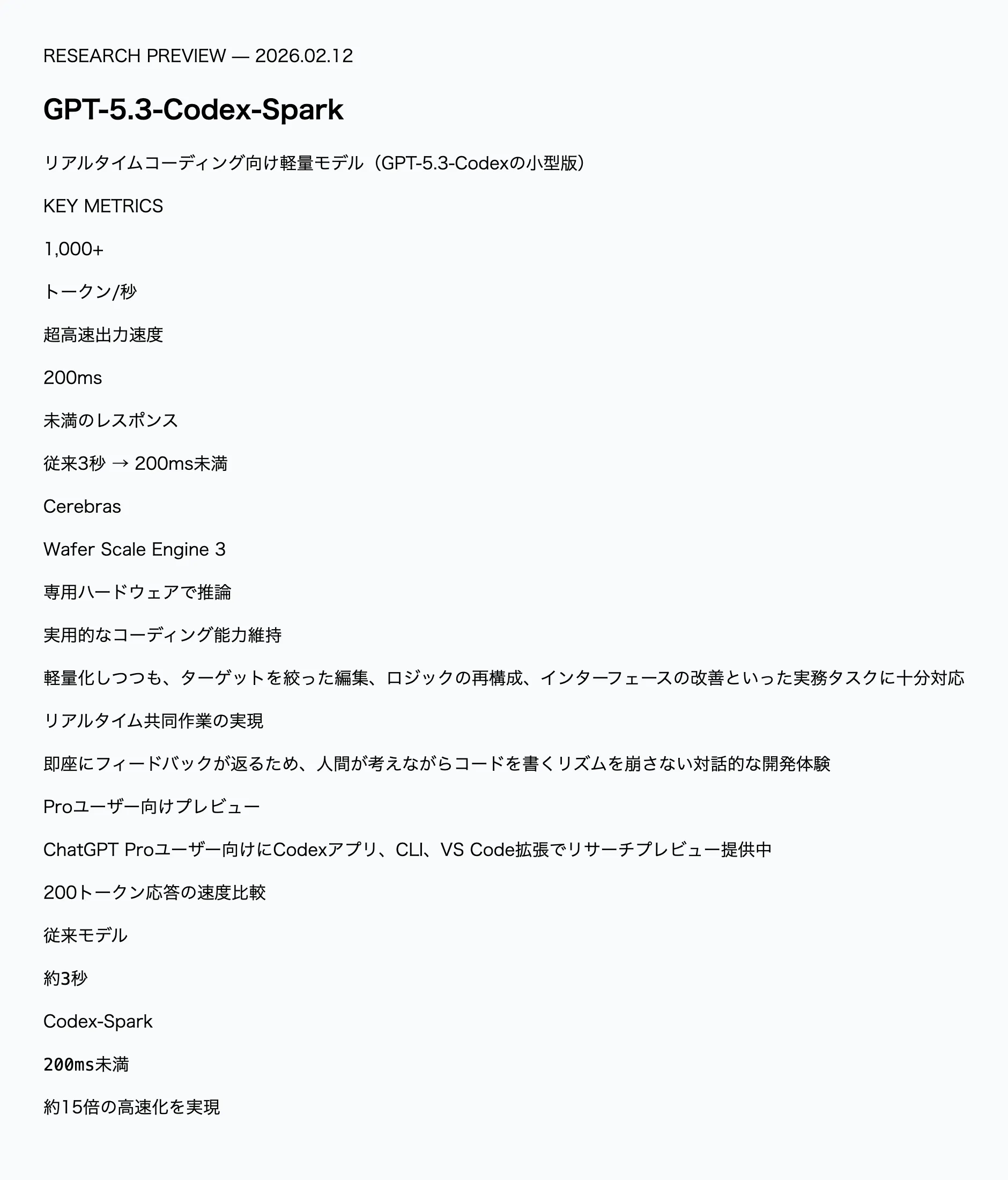

【GPT-5.3-Codex-Spark】リアルタイム編集向けリサーチプレビュー

GPT-5.3-CodexとGPT-5.4の「High Capability」と追加セーフガード

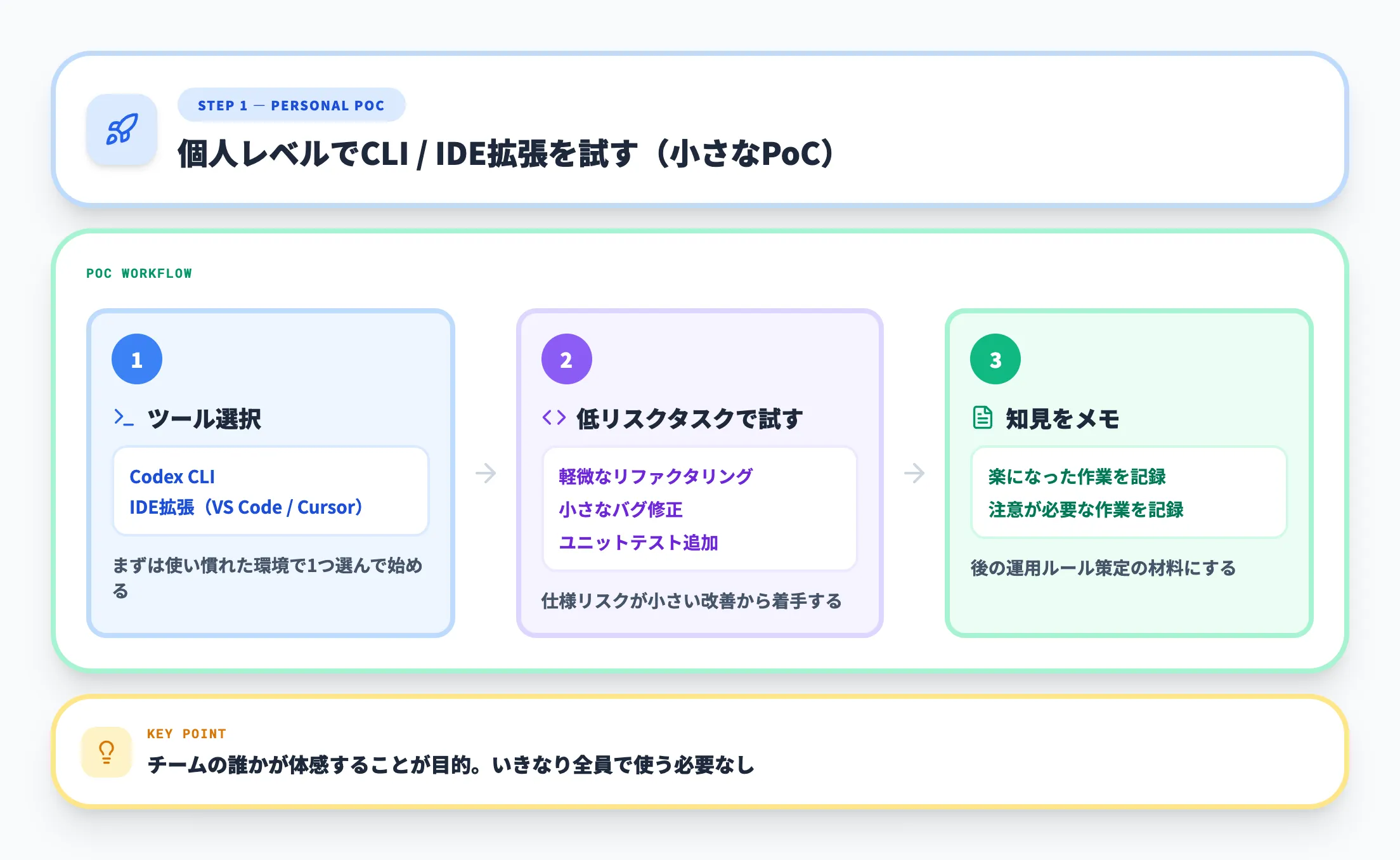

ステップ1:個人レベルでCLI / IDE拡張を試す(小さなPoC)

ステップ2:小さなリポジトリでAGENTS.mdを整備する(ルールの言語化)

ステップ3:Slack連携やCodex Cloud・自動トリガーでチーム活用

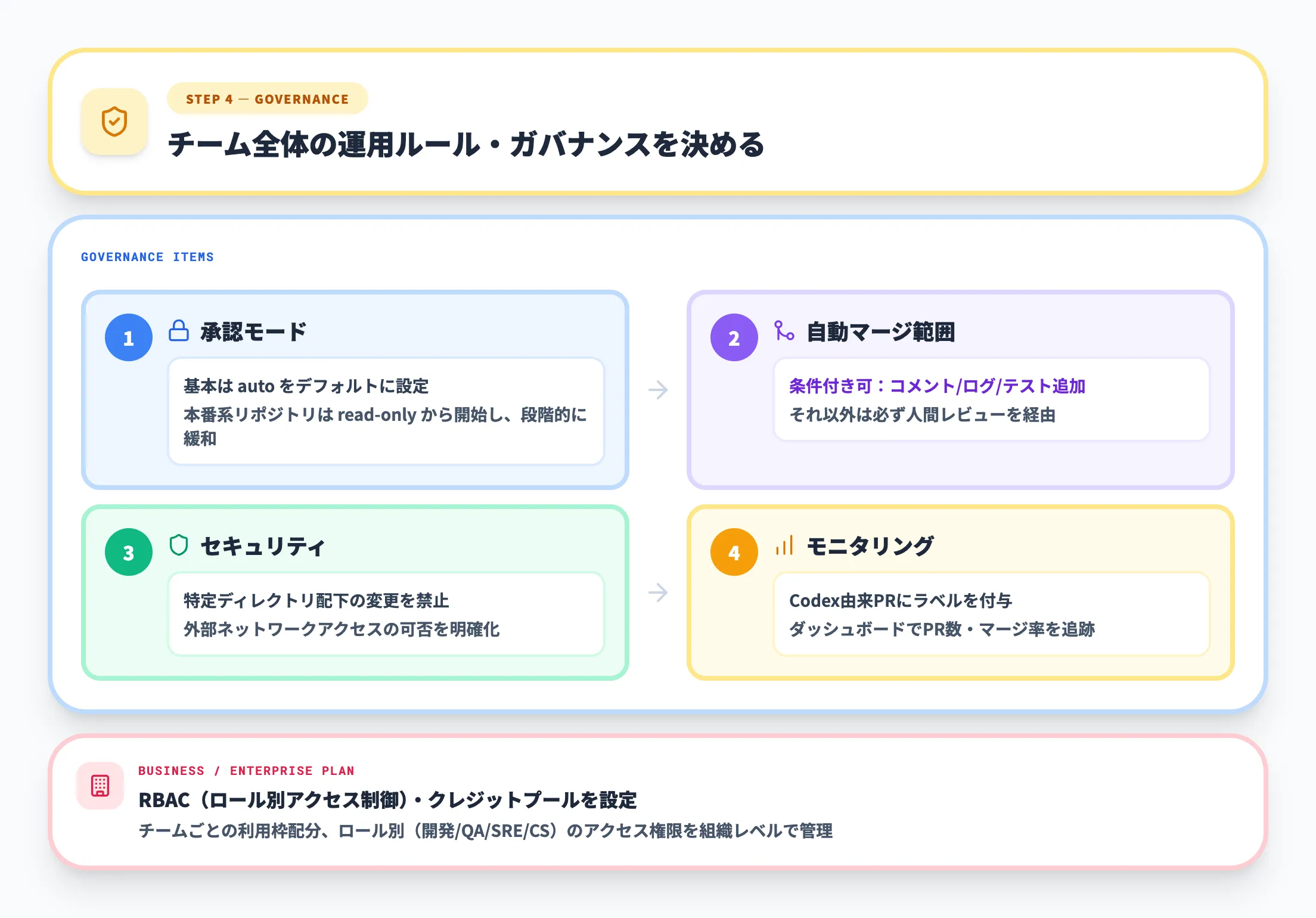

ステップ4:チーム全体の運用ルール・ガバナンスを決める(本格展開)

OpenAI社内:Harness Engineeringで100万行をCodexが構築

Codexとは?OpenAIのAIコーディングエージェント

Codexは、OpenAIが提供するソフトウェア開発向けのクラウドベースAIエージェントです。

コード補完だけでなく、タスク分解、実装計画の立案、テスト実行、コードレビュー、PR作成までを「一連のフロー」として扱えるよう設計されています。

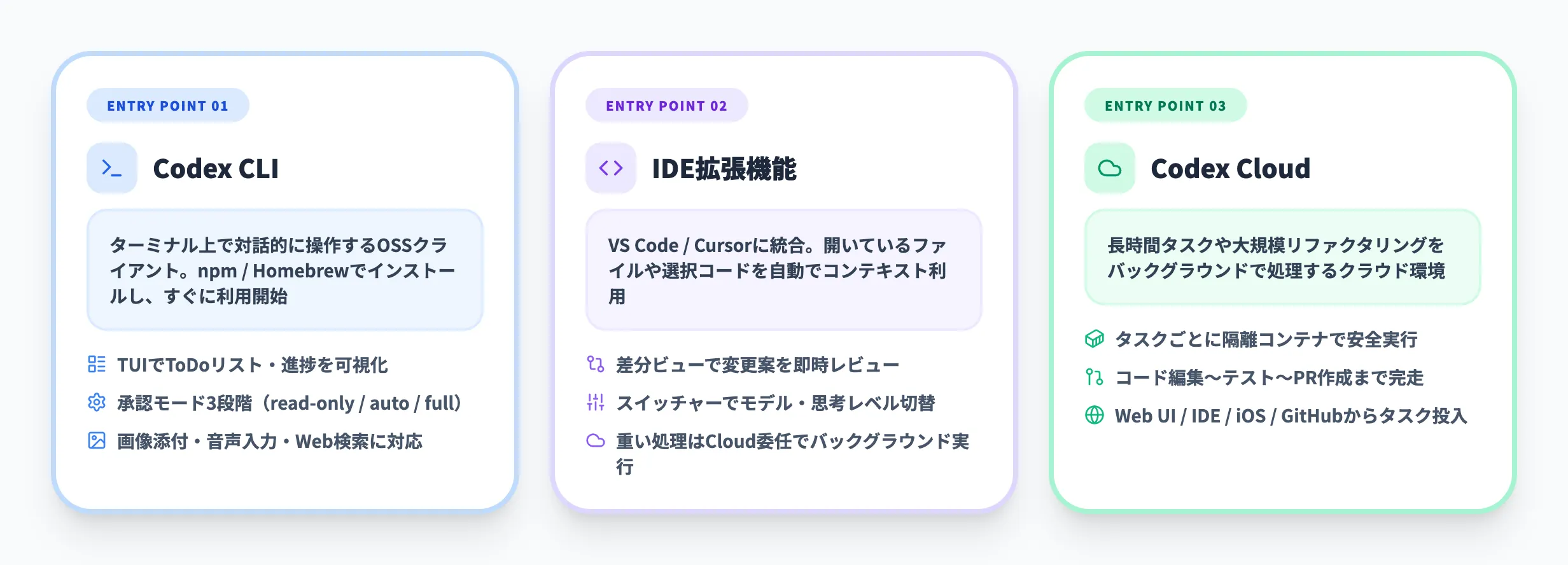

2026年4月時点では、次の5つの形態でCodexを利用できます。各形態はクレジット枠を共有し、同じスレッド・同じプラグインをどこからでも呼び出せる設計です。

-

Codex CLI

ターミナル上で対話的に操作するオープンソースのコマンドラインツール。Realtime Voice V2やMCP連携が利用可能

-

Codex IDE拡張機能

Visual Studio Code・Cursor・Windsurfなどに統合された拡張機能

-

Codex Cloud

長時間タスクや大規模リファクタリングをサンドボックスコンテナで実行するクラウド環境

-

Codex macOSアプリ

複数エージェントを並行管理するデスクトップアプリ(2026年2月リリース、4月の刷新でComputer Use・メモリ・画像生成に対応)

-

Codex Windowsアプリ

2026年3月4日リリース。Windows版アプリとして利用可能で、複数エージェント・Git Worktreeによるタスク分離・レビュー可能な差分表示に対応

これらを組み合わせることで、バグ修正、機能追加、テスト作成、コードレビュー、大規模リファクタリングなど、現場で発生する多様な開発タスクを「AIチームメイト」に任せる運用が現実的になっています。OpenAI公式の発表では2026年4月16日時点で毎週300万人超がCodexを利用しており、4月の大型刷新後はPC操作・画像生成にまで機能範囲が広がりました。

GitHub Copilot / ChatGPTとCodexの違い

Codexを理解するうえで最初に押さえたいのが、「すでにある開発支援ツールとの違い」です。ここではエディタ補完の代表格であるGitHub Copilotと、汎用アシスタントのChatGPTと比較します。

GitHub Copilotとの違い

GitHub Copilotは、主に次のような位置づけです。

- エディタ内のコード補完やインライン提案が中心

- Copilot Chatを通じて、ファイル単位・プロジェクト単位の質問も可能

- Copilot Coding AgentやCopilot Agent Modeでエージェント領域にも拡張中だが、基本は「開発者の手元作業を楽にする」アシスタント

一方でCodexは、次の点が大きく異なります。

- CLI / IDE / Cloud / GitHub / Slack / iOS / macOS / Windowsまでを含むエージェント基盤

- テスト実行やコマンド実行、PR作成、長時間リファクタリング、PC操作など「手を動かす作業そのもの」を自律的に実行

- Codex Cloud上でサンドボックスコンテナを立ち上げ、コード編集〜テスト〜PR作成まで完走

- 2026年4月以降はGitHub PR統合、プラグイン、自動トリガーまで備え、「運用基盤」として設計されている

ざっくり言うと次のような住み分けです。

- 「今開いているファイルの作業を早くしたい」 → Copilot

- 「リポジトリ全体を触る大きめのタスクや運用自動化を丸ごと任せたい」 → Codex

ChatGPTとの違い

ChatGPT(ブラウザ版 / モバイルアプリ)は、汎用的なAIアシスタントです。

- 仕様相談、設計レビュー、技術調査など「文章ベースのやり取り」が得意

- コードも書けるが、標準のブラウザ版・モバイル版では主にファイルアップロードや貼り付けベースでコードを扱い、リポジトリへの直接アクセスを前提とはしていない

Codexは、ChatGPTの汎用性をベースにしつつも、次の領域に特化しています。

- 実際のリポジトリやターミナルに直接アクセス

- テスト実行やビルド、依存関係インストールなどの環境操作を自動化

- PRレビューやリファクタリングをタスクとして継続実行

- デスクトップアプリ上では外部アプリをCodexが直接操作するComputer Useにも対応(2026年4月追加)

現場での使い分けとしては、次のように整理すると判断しやすくなります。

- 仕様検討・設計レビュー・技術調査 → ChatGPT(ブラウザ / モバイル)

- 実際のコードベースを触るタスク → Codex(CLI / IDE / Cloud / デスクトップ)

他社AIコーディングツールとの比較

Codex以外にも、AIコーディングエージェントは複数の選択肢が登場しています。ここでは代表的なツールとCodexのポジショニングを、2026年4月時点の情報で比較します。

以下の表は、利用形態・モデル・得意領域の違いを1枚にまとめたものです。料金だけで判断するとミスマッチが起きやすいため、「自社の開発ワークフローにどれが嵌るか」を軸に見るのがおすすめです。

| 比較項目 | Codex(OpenAI) | Claude Code(Anthropic) | Devin(Cognition) | Cursor |

|---|---|---|---|---|

| 月額料金 | ChatGPT Plus $20〜 / Pro $100・$200 | Pro $20〜 / Max $100〜 | ACU従量課金(1 ACU $2.25)/ Teams $500/月 | Pro $20〜 |

| 利用形態 | CLI / IDE / Cloud / macOS・Windowsアプリ / Slack / iOS / GitHub | CLI / Web / IDE拡張 / Desktop / Slack | クラウドIDE+ブラウザ | 独自IDE |

| ベースモデル | GPT-5.4 / GPT-5.4-mini / GPT-5.3-Codex / GPT-5.3-Codex-Spark | Claudeモデル(プランにより異なる) | 独自モデル | 複数モデル選択可 |

| 並行タスク | デスクトップアプリでGit Worktree並行実行、自動トリガー対応 | Agent Teamsで並行実行 | 複数セッション対応 | タスク並行 |

| 得意な領域 | 既存リポジトリのリファクタリング・レビュー・PR作成+PC操作・画像生成 | コードベース全体の理解・ファイル編集・Git操作 | 長時間の自律タスク・PoC構築 | エディタ中心の補完・編集 |

各ツールの「得意領域」の違いが選定のカギです。Codexは既存の開発ワークフロー(GitHub / Slack / IDE)への統合に強みを持ち、Claude Codeはコードベース全体の読解と精度重視のアプローチ、Devinはプランニングからデプロイまでの完全自律、Cursorはエディタ中心の操作性を志向しています。

GitHub中心のチーム開発をしていて、イシュー駆動でPRレビューまで自動化したいならCodexが現実的な第一候補です。コード品質を最優先したい・Anthropicモデルをメインに使いたいならClaude Code、1タスクあたり数時間の完全自律運用ならDevin、エディタ体験を優先するならCursorという構図になります。AI総研の経験では、既存GitHub資産の大きいチームはCodex、モノレポの設計・レビュー品質重視ならClaude Codeを併用、プロトタイピング起点ならCursorという組合せが現場にフィットしやすいです。

Codex「for (almost) everything」アップデート

2026年4月16日、OpenAIは「Codex for (almost) everything」と題した大型アップデートを発表しました。これはCodexを「コード生成エージェント」から「デスクトップとブラウザをまたいで働く汎用作業エージェント」へ拡張する刷新です。同日のアプリ更新(バージョン26.415)でComputer Use、画像生成、メモリ、アプリ内ブラウザ、90超の追加プラグインが一度に投入されました。

2026年4月以前の記事やスクリーンショットはこの刷新前の世代なので、現在Codexを評価するときは、まずこのアップデート内容を前提にするのが正しい見方です。以下、主要な新機能を整理します。

Computer Use:macOSアプリ上の他アプリを直接操作

Computer Useは、Codexが自分のカーソルでデスクトップ上のアプリを見つけ、クリックし、タイプする機能です。macOSアプリの刷新により、Codexが複数エージェントで並行してMac上のアプリを操作しつつ、ユーザーは別のアプリで自分の作業を続けられます。

- ネイティブアプリのUIテストや、GUIしかないツールのセットアップ作業を任せられる

- スクリーンショットをCodexに渡しながら「この画面からこのボタンを押して設定を保存して」といった指示が可能

- macOSアプリ版に先行搭載。Codex CLIやIDE拡張はコード操作中心のまま

GPT-5.4は、汎用モデルとしてネイティブなComputer Use能力を標準装備しています。従来「コードしか触らないAI」だったCodexが、画面を見て判断しながらデスクトップ全体を動かすエージェントに拡張された点が、このアップデートの最重要ポイントです。

画像生成(gpt-image-1.5):モックアップまでCodexで完結

Codexはgpt-image-1.5を使って画像を生成・反復できるようになりました。スクリーンショット・コード・画像生成を同じスレッドで扱えるため、以下のような「設計〜実装」を横断する作業が現実的になっています。

- プロダクトコンセプト・フロントエンドデザイン・モックアップを同一スレッドで作成

- ゲームのビジュアル素材を生成してコードに組み込む

- 現状UIのスクリーンショット → Codexが改善案画像を生成 → 対応するCSS/JSXを提案

これまでFigmaや画像生成サービスと往復していたフロー(UIスケッチ → スクショ → プロンプト → 画像生成 → 実装)を、Codexの1スレッド内で完結できるようになりました。

メモリ機能:過去の好みと修正履歴を継続利用

Codexは新たにメモリ機能を搭載し、前回までの経験(個人的な好み、修正パターン、情報収集にかけた時間など)を記憶できるようになりました。

- 「いつもlintエラーを先に直す」「commit messageは日本語で」といった個人ルールを学習

- 過去タスクで集めたコンテキスト(ドキュメント・設計意図)を、次のタスクで再利用

- プロジェクトごとに別メモリを持つため、会社リポジトリと個人リポジトリの方針が混ざらない

AGENTS.mdがプロジェクト横断の「明示ルール」とすれば、メモリは暗黙的な個人・プロジェクト学習を担う層です。長く使うほどCodexが自分の作法に馴染んでいく点が、開発体験の変化につながっています。

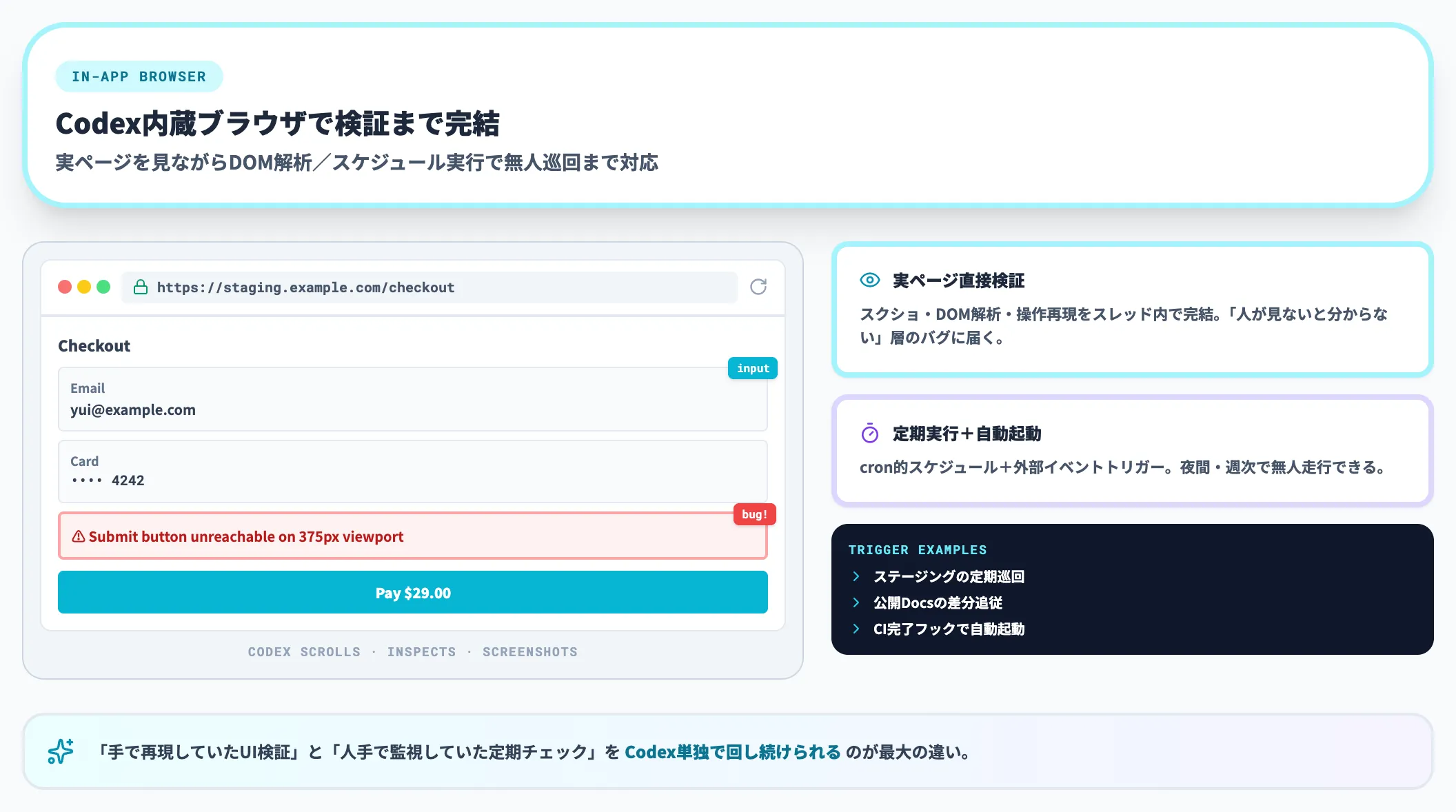

アプリ内ブラウザと長期タスク自動化

アプリ内ブラウザはCodexにローカル・公開ページを直接読み込み、レンダリング後の画面にコメントを付ける機能を与えます。これに長期タスク自動化(スケジュール実行)が組み合わさり、次のような運用が可能になりました。

- 稼働中のステージング環境をCodexが定期的に開き、UI変更をスクリーンショット付きでレポート

- 公開ドキュメントページを読み、差分に応じてリポジトリのサンプルコードを自動更新

- CIの長時間ジョブが終わったタイミングでCodexが自動起動し、結果レポートをSlackに投げる

CLIやCloudだけで完結していた従来のCodexでは、「Webページを見て判断する」「人間のスケジュールに合わせて動く」という領域が苦手でした。今回の刷新はこのギャップを埋めるもので、Codexを"勝手に動く運用メンバー"として扱えるようになっています。

90超の追加プラグイン(Sentry / Datadog / Linear ほか)

2026年3月25日のプラグイン機能導入に続き、4月の刷新で90を超える追加プラグインが公開されました。プラグインは「スキル・アプリ統合・MCPサーバー」をパッケージ化した再利用可能なワークフローで、Codexアプリ・CLI・IDE拡張の全てから呼び出せます。代表的な連携先(Sentry / Datadog / Linear / Jira / Figma など)や具体的な活用シナリオは、後述の「主要機能とエコシステム」で整理します。

自動トリガーとセキュリティエージェント

Codexアプリのスレッドは、4月の刷新でイベント駆動で起動できるようになりました。GitHubのIssue作成・PRコメント・CI完了などをきっかけに即座に動きます。あわせて、バックグラウンドで脅威モデリングと修正パッチ生成を続けるセキュリティエージェントも常駐機能として追加されました。どちらの機能も「現場でどう効くか」は主要機能節で詳しく見ていきます。

GitHub PR統合と成果物ビューア

サイドバーから直接GitHub PRを検査でき、差分画面でコメント確認が可能になりました。成果物ビューアではPDF・スプレッドシート・プレゼンテーションをCodex内でプレビューできるため、「生成物→再利用」が1画面で完結します。

以上の刷新を踏まえると、Codexの位置づけは「コードを書くAI」から「画面・ブラウザ・外部ツールまでまたぐ運用エージェント」へと明確にシフトしています。2026年3月までの記事や解説資料をそのまま参照すると、Computer Useやメモリ機能の前提が抜けてしまうため注意が必要です。

Codexの使い方(CLI / IDE / Cloud / デスクトップアプリ)

ここからは、「どこからCodexにアクセスして、どう使い始めるか」という観点で、5つの入り口(CLI / IDE拡張 / Cloud / macOS / Windows)の使い方を整理します。

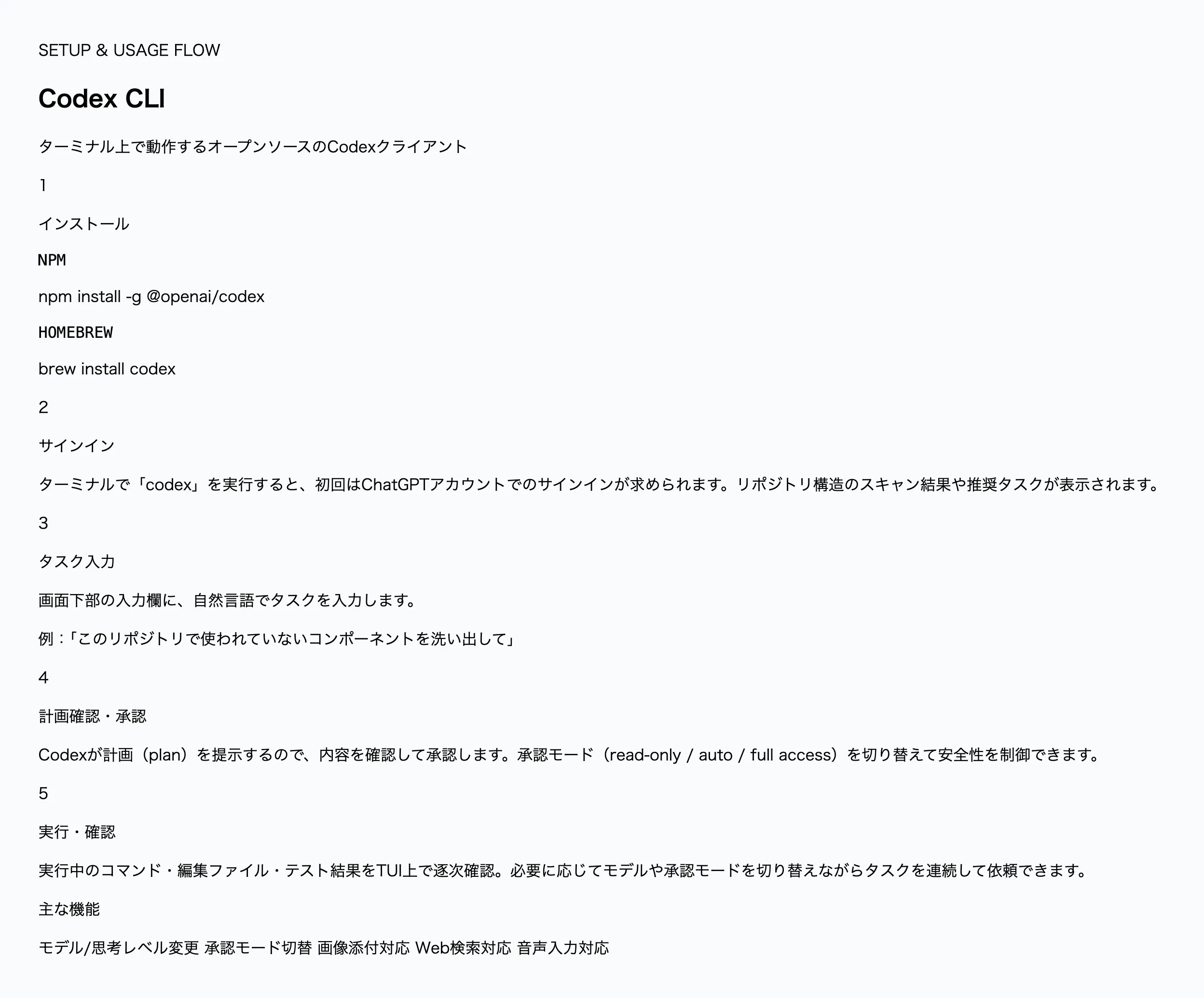

1. Codex CLI(Realtime Voice V2・MCP強化)

Codex CLIのイメージ(参考:Codex CLI GitHubリポジトリ)

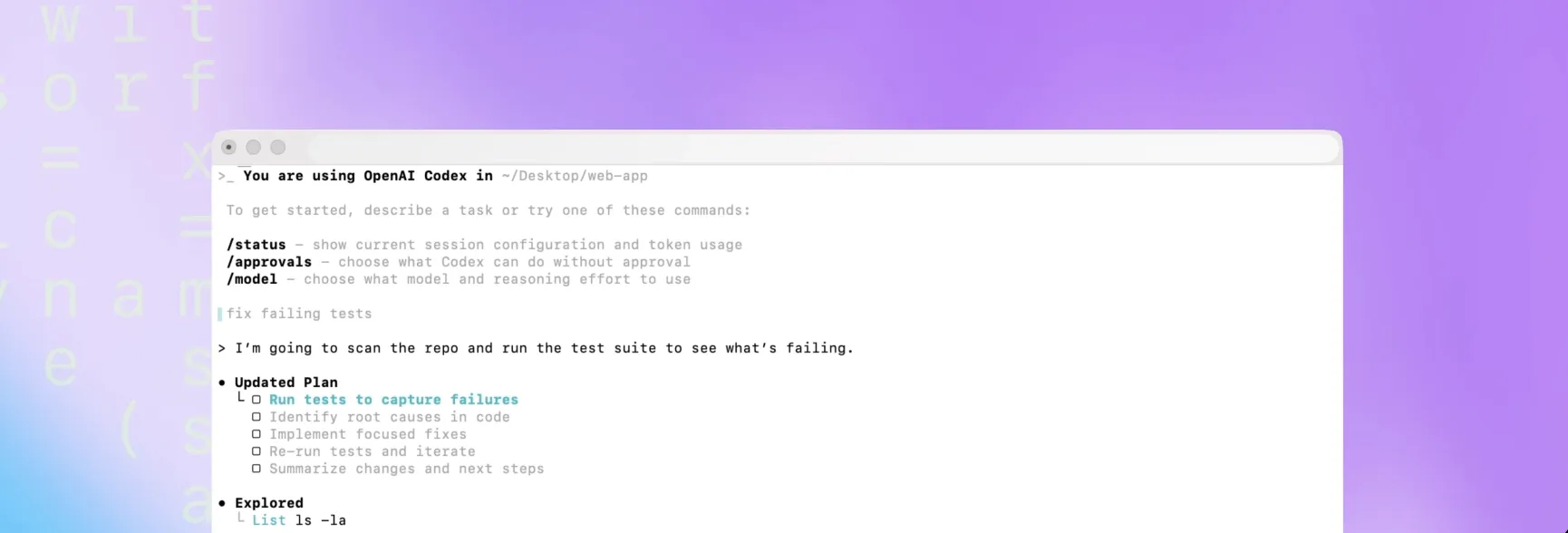

Codex CLIは、ターミナル上で動作するオープンソースのクライアントです。2026年4月10〜11日にリリースされたv0.119.0・v0.120.0で、Realtime Voice V2とMCP強化が実装されています。

主な特徴は次の通りです。

- 対話的なUI(TUI)で、タスクのToDoリストや進捗を可視化

/modelコマンドでGPT-5.4・GPT-5.3-Codex・GPT-5.4 miniなどを切替可能- 承認モード(read-only / auto / full access)を切り替え可能

- 画像添付(スクリーンショットやワイヤーフレーム)にも対応

- Web検索・MCPなどのツール呼び出しに対応

- Realtime Voice V2:スペースバー長押しで録音・文字起こし、リアルタイム会話型操作に対応

- MCPサーバーのインストール・管理がCLI内で完結(v0.120.0〜)

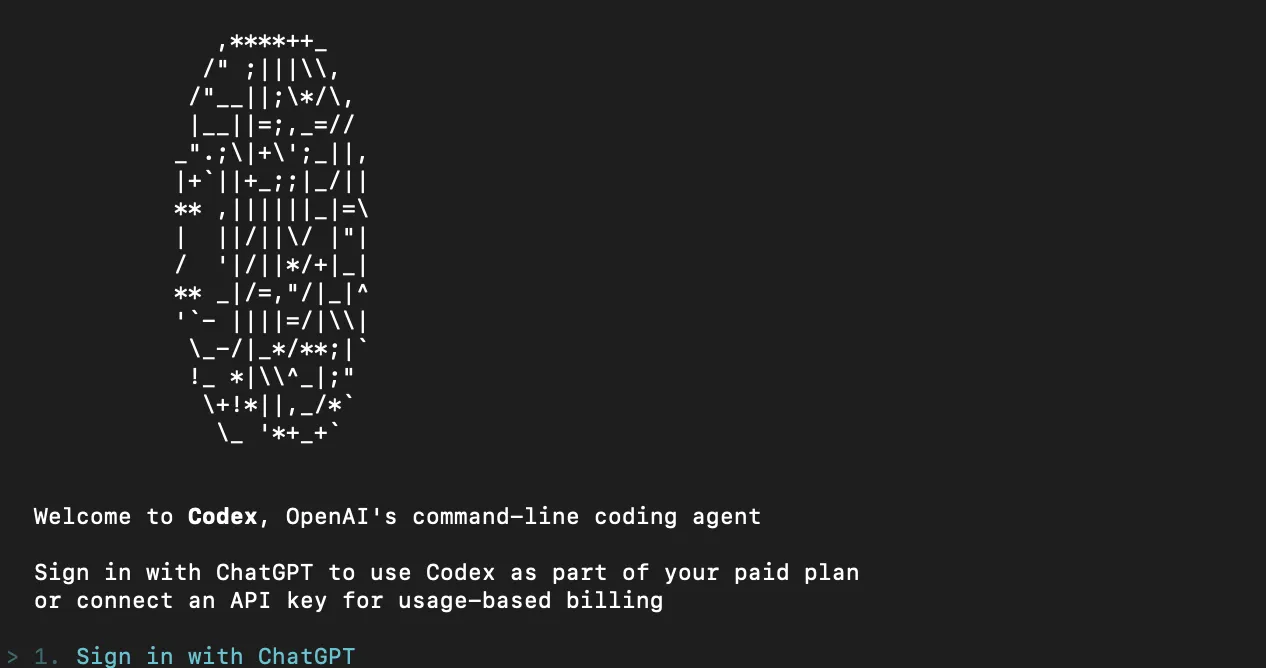

Codex CLIのセットアップと基本的な使い方

Codex CLIは、npmまたはHomebrewからインストールできます。

# npm経由

npm install -g @openai/codex

# Homebrew経由(macOS)

brew install --cask codex

インストール後、ターミナルでcodexを実行すると、初回はChatGPTアカウントでのサインインが求められます。

Codex CLIの初期画面

サインイン後の基本的な流れは次の通りです。

- 初回はリポジトリ構造のスキャン結果や推奨タスクが表示される

- 画面下部の入力欄に、自然言語でタスクを入力する

- 例:「このリポジトリで使われていないコンポーネントを洗い出して」

- Codexが計画(plan)を提示するので、内容を確認して承認する

- 実行中のコマンド・編集ファイル・テスト結果はTUI上で逐次確認できる

- 必要に応じて

/model、承認モード、スキル(@メンション)を切り替えながら、タスクを連続依頼する

日常的な開発では、「ターミナルを開いたらとりあえずcodexを立ち上げておく」くらいの運用が現実的です。MCPを使えば社内APIやデータベースへのアクセスも統一できます。

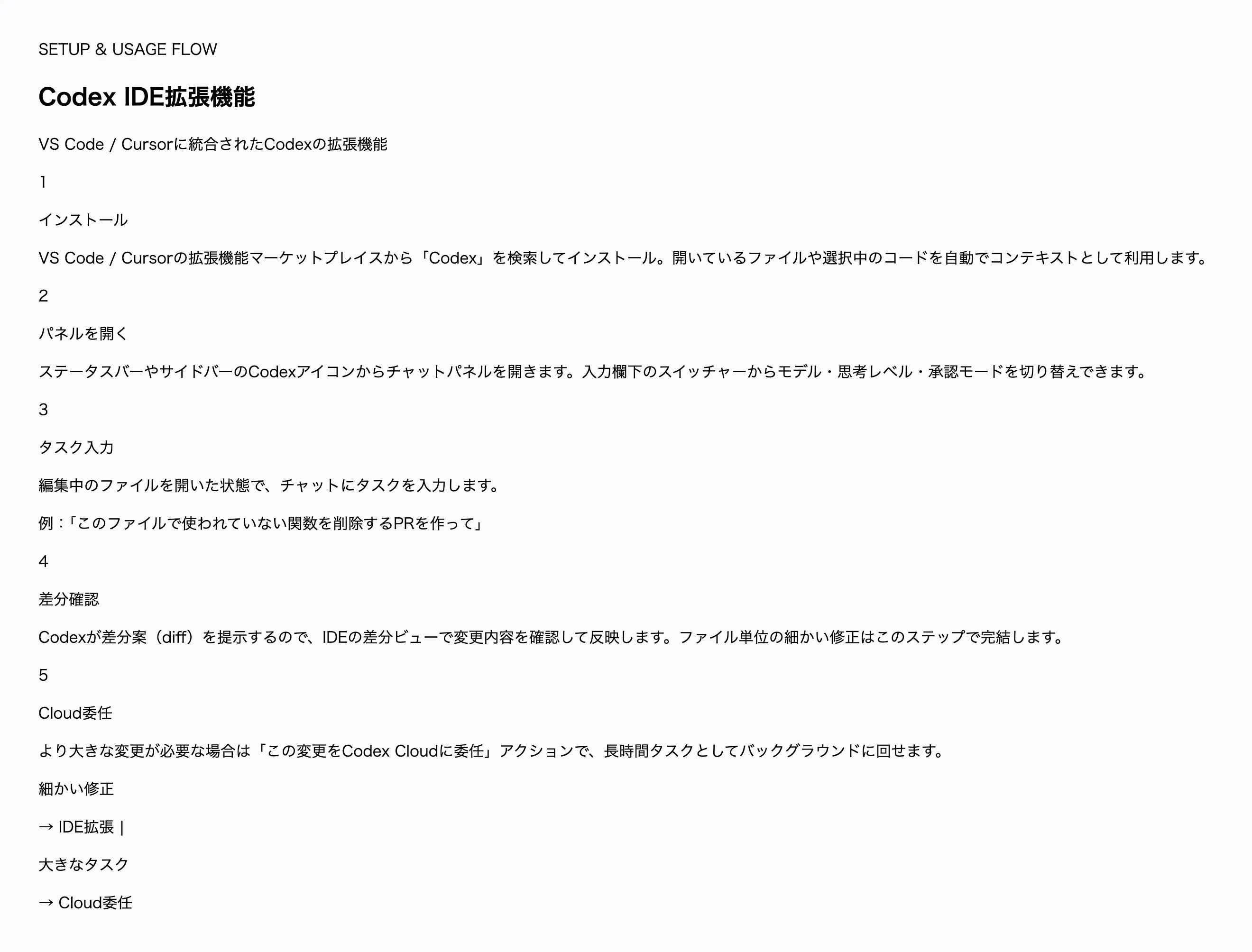

2. Codex IDE拡張機能

Codex IDE拡張機能は、VS Code・Cursor・Windsurfなどに統合された拡張機能です。

主な特徴は次の通りです。

- 開いているファイルや選択中のコードを自動でコンテキストとして利用

- 入力欄下のスイッチャーからモデル・思考レベル・承認モードを切り替え

- IDE上からCodex Cloudにタスクを「委任」し、重い処理をバックグラウンドに回せる

- 2026年4月以降は、プラグイン呼び出しと長期タスクスケジューリングもIDEから設定可能

IDE拡張機能の基本的な使い方

- VS Code / Cursor / Windsurfなどの拡張機能マーケットプレイスから「Codex」をインストール

- ステータスバーやサイドバーのCodexアイコンからチャットパネルを開く

- 編集中のファイルを開いた状態で、チャットにタスクを入力する

- 例:「このファイルで使われていない関数を削除するPRを作って」

- Codexが差分案(diff)を提示するので、IDEの差分ビューで確認して反映

- より大きな変更は「Codex Cloudに委任」アクションで長時間タスクとして投げる

「細かい修正・ファイル単位の作業はIDE拡張」「大きなタスクはCloudへ委任」「画面操作込みならmacOSアプリ」という3段構えが2026年4月以降の標準的な使い分けです。

3. Codex Cloud

Codex Cloudは、長時間かかるタスクや大規模リファクタリングをバックグラウンドで処理するクラウド環境です。

代表的な用途は次の通りです。

- プロジェクト全体を対象にしたリファクタリング提案

- コードベース全体の構造理解(アーキテクチャ図の生成など)

- 脆弱性スキャンと修正案の提案

- 大規模なテストコードの追加・整理

- 自動トリガーによる定期的なメンテナンスタスク

タスクごとに隔離されたコンテナが起動し、その中でコード編集・テスト実行が行われます。

Codex Cloudの基本的な使い方

- 「https://chatgpt.com/codex」にアクセスしてGitHubアカウントを接続する

- 扱いたいGitHubリポジトリを選び、必要に応じてCloud環境(対象ブランチ、ビルド・テストコマンドなど)を設定する

- Web上のCodex画面、IDE拡張、ChatGPT iOSアプリ、GitHubの「@codex」メンション、Slack、または自動トリガーからCloudタスクを開始する

- Codexが専用サンドボックスコンテナを立ち上げ、指定リポジトリと依存関係を読み込んで処理を実行する

- 実行中タスクのログや進捗は、Codex Web UI・IDE拡張・GitHubスレッドなどから確認する

- タスク完了後、CodexのPRやパッチを人間がレビューし、必要に応じて修正してマージする

4. macOSデスクトップアプリ(Computer Use対応)

Codex macOSアプリは、**複数のAIコーディングエージェントを並行管理する「コマンドセンター」**として設計されたデスクトップアプリケーションです。Apple Silicon搭載のMacで利用できます。2026年4月16日の刷新(バージョン26.415)でComputer Use・画像生成・メモリに対応し、アプリの位置づけが大きく変わりました。

以下のリストで、macOSアプリの主要機能を整理します。

-

複数エージェントの並行実行

1つのリポジトリに対して複数のエージェントを同時に起動し、異なるタスクを並行処理できる。各エージェントはGit Worktreeで独立した作業コピーを持ち、互いの変更が干渉しない

-

Computer Use

Codexが自分のカーソルでデスクトップアプリを操作できるようになった。ネイティブアプリのUIテストや、GUIしかないツールの自動化に利用

-

メモリ機能

プロジェクト固有の個人設定や修正履歴を蓄積。タスク横断で「自分の作法」を学習する

-

画像生成(gpt-image-1.5)

モックアップ・UI案・ゲーム素材を同じスレッドで作成し、コードにそのまま反映

-

GitHub PR統合

サイドバーでPRを検査、差分でコメント確認・返信までデスクトップ内で完結

-

成果物ビューア

PDF・スプレッドシート・プレゼンテーションをアプリ内でプレビュー

-

マルチウィンドウ・Intel Mac対応

4月の更新でIntel Macにも対応し、複数ターミナル・マルチウィンドウ運用が可能に

ここで注目すべきは、Computer UseとAutomations(スケジュール実行)の組合せです。「毎朝8時にリポジトリの依存ライブラリ更新をチェックし、必要ならアプリを開いてテストし、修正PRを作る」といった、複数アプリをまたぐ運用が人間の介入なしに回せるようになります。開発チームは定型作業から解放され、設計やアーキテクチャ判断に集中しやすくなります。

5. Windowsデスクトップアプリ

2026年3月に公開されたCodex Windowsアプリは、macOSアプリと同じエージェント体験をWindows環境に持ち込むデスクトップクライアントです。

-

複数エージェントの並行実行

複数のタスクを同時に走らせ、それぞれの進捗・出力をまとめて管理できる

-

Git Worktreeによるタスク分離

エージェントごとに独立した作業ツリーを割り当て、他タスクの変更と干渉しない形で並行作業を進められる

-

レビュー可能な差分表示

Codexの変更内容をdiffとして確認しながら承認・マージへ回せる

Windows中心の企業開発環境でも、macOS版と同系統のエージェント体験をそのまま持ち込めます。Windows固有の詳細仕様(配布経路やシェル対応)は今後のリリースノートで順次明らかになる領域のため、導入検討時は最新のCodex CLI公式リポジトリやCodexアプリ公式ページも確認しておくと安全です。

Slack・SDK・iOSなどの周辺連携

Codex本体に加えて、周辺連携で効いてくる機能も整理しておきます。

-

Slack連携

チャンネル・スレッドで@codexをメンションするとタスクを依頼できる。会話履歴からコンテキスト自動抽出、非エンジニア(PM・CSなど)からの依頼にも対応

-

Codex SDK

Codex CLIと同じエージェント実装をTypeScriptライブラリとして組み込めるSDK。CI/CDや社内ツールから「ボタンひとつでコード修正」を呼び出せる

-

ChatGPT iOSアプリ

モバイルからCodexタスクを実行可能。PR差分確認、スクリーンショットでのバグ修正依頼、長時間タスクの進捗確認など、外出先の軽作業を受け持つ

-

Web検索

設定で有効化すると、最新のAPIドキュメントやCVE情報を参照しながらコード生成

-

Usage Dashboard / Analytics

プランごとのレート制限・surface別利用状況・クレジット消費を可視化。管理者がチーム全体の活用状況を把握できる

どの連携も「Codex Cloud」または「ChatGPTアカウント」で統一管理されるため、surfaceをまたいでも同じスレッド・同じメモリ・同じプラグインが呼び出せる点が大きな強みです。

Codexの主要機能とエコシステム

ここからは、エンジン・ツールの話から一歩引いて、「Codexを使うと開発現場で何ができるのか」を機能ベースで整理します。

バグ修正・コード生成・テスト作成の自動化

このセクションでは、「AIに任せやすい定番タスク」を整理します。これらはCLI・IDE・Cloud・デスクトップアプリのどこからでも依頼できます。

Codexは自然言語の依頼にもとづいて、既存コードのバグ修正や新機能のコード生成を行います。テストコードの自動生成・実行も可能で、「修正 → テスト → 再修正」までを1つのフローとして任せられます。

代表的なユースケースは次の通りです。

- 既存機能の仕様変更に伴う修正

- 新しいAPIエンドポイントの追加とテストコード作成

- 例外処理やログ出力の追加

- パフォーマンスボトルネックの候補箇所の洗い出し

- レガシーコードの型注釈追加

Pull Request(PR)の提案・レビュー・自動トリガー

Codexは、GitHubリポジトリと連携することで、変更内容をPull Request単位でまとめて提案できます。

- Issueやタスクの説明から作業計画を立案

- 変更内容をローカルまたはCloudで実装

- テスト実行し、結果を確認

- PRとしてまとめ、レビューコメントも付与

さらにPRコメントで @codex review とメンションすれば、既存PRに対するAIコードレビューを依頼できます。2026年3月以降は自動トリガー機能により、Issueの新規作成・PRへのコメント・CI完了などのイベントに即座に反応してCodexが動きます。

Claude Codeの定期スケジュール型と異なり、Codexはイベント駆動のリアルタイム応答が特徴です。「Issueが立ったら数秒で一次分析・修正案を返す」という運用が既に可能になっています。

プラグインによる外部ツール連携

2026年4月の刷新で、Codexは90を超える追加プラグインを公開しました。プラグインは「スキル・アプリ統合・MCPサーバー」をパッケージ化した再利用可能ワークフローで、以下の表で代表的な連携先と用途を整理します。

| プラグイン | 主な用途 | 具体シナリオ |

|---|---|---|

| Sentry | エラー監視連携 | 本番例外のスタックトレースから修正PRを自動生成 |

| Datadog | パフォーマンス監視 | レイテンシ劣化の疑わしい箇所をCodexが一次診断 |

| Linear / Jira | チケット管理 | チケット本文から作業計画を立案、完了後に自動クローズ |

| Figma | デザイン連携 | Figmaファイルからコンポーネント実装を生成 |

| GitHub | リポジトリ連携 | Issue・PR・CIのイベントを起点にCodexを起動 |

プラグインは公開ディレクトリから選ぶほか、社内専用にローカル開発できます。既存のMCPサーバーエコシステムとも互換があるため、社内APIやデータベースを直接エージェントに触らせる運用も現実的です。

セキュリティエージェント

セキュリティエージェントは、バックグラウンドで常駐し脅威モデリングと修正パッチの生成を継続する機能です。依存ライブラリのCVE検知・修正提案や、秘密情報の漏洩チェックなど、人間が指示しなくても動く"監視役"として機能します。

特にOSS依存の多いプロジェクトでは、脆弱性対応の初動を自動化できる価値が大きく、セキュリティ担当の負荷軽減に直結します。

Codex SDKによる自社システム組込み

Codex SDKは、Codex CLIと同じエージェント実装をTypeScriptライブラリとして組み込めるSDKです。

主な用途は次の通りです。

- CI/CDパイプラインの一部としてCodexを呼び出す

- 社内ツールやダッシュボードから「ボタンひとつでコード修正」を実行

- 独自のUIを持つコードレビュー支援ツールの構築

- 業務アプリ(社内ナレッジ検索など)にAI開発支援を埋め込む

プロジェクトへの自動適応と動作ログの可視化

「AIが何をしているのか分かる状態を保つ」ための仕組みも、Codexの重要な特徴です。Codexは次のような情報を読み取ってプロジェクトに自動適応します。

- AGENTS.mdやREADME、テスト用スクリプト

- 開いているファイルやカレントディレクトリ

- 過去のターミナルログやテスト結果

- メモリ機能による個人・プロジェクトの学習履歴

タスク実行中は、CLI・Web UI・デスクトップアプリ上で次のログが確認できます。

- 実行したコマンドとその結果

- 編集したファイルと差分(diff)

- 失敗したテストと修正の試行履歴

- プラグイン呼び出しと結果

「何をしているか分からないブラックボックス」ではなく、人間がいつでも確認・介入できるペアプロパートナーとして振る舞う設計になっています。

Codexの料金と利用上限

Codexは、ChatGPTの有料プラン(Plus / Pro / Business / Edu / Enterprise)で標準機能として利用できます。2026年4月2日から、Plus・Pro・Business・新規EnterpriseはAPIトークンベースのクレジット制へ切り替わりました(既存Enterprise / Edu はレガシー料金表を継続)。2026年4月9日には新Proプラン($100/月)が追加されています。

以下の表は、2026年4月時点の各プランの月額料金と主要な違いを整理したものです。

| プラン | 月額料金 | 主な対象 |

|---|---|---|

| Free | $0 | 簡単なコーディングタスクを試す用途 |

| Go | $8/月 | 軽量タスク中心の個人ユーザー |

| ChatGPT Plus | $20/月 | 個人・副業・学習用途 |

| ChatGPT Pro $100(新設) | $100/月 | Plusの5倍(期間限定で10倍)の利用枠。Claude Max $100対抗 |

| ChatGPT Pro $200 | $200/月 | Plusの20倍の利用枠を継続提供。重量級ユーザー向け |

| Business | 月払い $25/年払い $20(ユーザー/月) | チーム利用。SAML SSO、専用ワークスペース対応 |

| Enterprise / Edu | 要問い合わせ | 大規模組織。SCIM・監査ログ・優先処理 |

利用枠(ローカルメッセージ・Cloudタスク・Code Reviewの回数)は、タスクのサイズ・複雑さ・実行場所によって消費量が変動するため、固定の件数として示すことはできません。2026年4月2日以降、Plus・Pro・Business・新規Enterpriseはいずれもtoken-based rate cardの対象で、モデル・surface・入出力トークン量によってクレジット消費量が決まります。最新値はOpenAI公式のCodex利用ガイドとCodex Rate Cardで確認してください。

2026年5月31日までは、新Pro $100プランのキャンペーンとして通常5倍のところ10倍の利用枠が提供されます。Pro $200は継続的に20倍が保証される設計です。個人で試すなら、まずPlus $20で感触を掴み、Cloudタスク中心の使い方に寄ってきたタイミングでPro $100へ、という段階導入が現実的です。

APIトークンベースのクレジット体系(2026年4月〜)

2026年4月2日に、Codexの料金体系はPlus・Pro・Business・新規EnterpriseでAPIトークンベースのrate cardへ切り替わりました。既存Enterprise / Eduはレガシー料金表を継続しています。いずれのプランもモデル別の実トークン量(入力・出力)をそのままクレジット消費量へ換算する設計です。

以下の表は、token-based rate card下での100万トークンあたりクレジット消費の代表値です。単価はsurface・モデル・キャッシュ有無で変動するため、最新値はCodex Rate Cardを参照してください。

| モデル | 入力(100万トークン) | 出力(100万トークン) |

|---|---|---|

| GPT-5.4 | 62.50クレジット | 375クレジット |

| GPT-5.4-mini | 18.75クレジット | 113クレジット |

| GPT-5.3-Codex | 43.75クレジット | 350クレジット |

この表から分かるのは、同じフラグシップ相当でもGPT-5.4の方がGPT-5.3-Codexよりやや高い点です。長時間タスクで大量のトークンを消費する場合、コーディング特化のGPT-5.3-Codexのほうがトータルコストを抑えやすいことがあります。GPT-5.4 miniは、GPT-5.4のおよそ1/3のクレジットで動くため、サブエージェントや定型タスクに向きます。

利用制限に達した場合の対処法:クレジットの追加購入

Plus・Proなどの個人プランでは、利用制限に達した場合に追加クレジットを購入して継続利用できます。

- 利用上限に達すると、「Add credits」ボタンやバナーが表示される

- 設定画面のUsage Dashboardからクレジット購入が可能

- プラン標準枠を消費した後、購入クレジットが消費される

Business・Enterpriseには柔軟なクレジットプールとワークスペース単位の利用メトリクスが用意されており、Usage Dashboardから確認できます。2026年4月時点では、Businessワークスペース向けに新規メンバー1人あたり$100クレジット(上限$500/チーム)のキャンペーンも期間限定で実施中です。

APIキーを使った従量課金での利用

ChatGPTプランとは別に、APIキーを使った従量課金でもCodexを利用できます。この場合、Cloud機能は利用できず、新モデルへのアクセスがやや遅れる点に注意が必要です。2026年4月時点の参考単価は以下のとおりです。

| モデル | 入力トークン(100万あたり) | 出力トークン(100万あたり) | 備考 |

|---|---|---|---|

| GPT-5.4 | Chat Completions API / Responses API経由 | 同左 | Computer Use対応、1Mコンテキスト実験利用可 |

| GPT-5.3-Codex | $1.75 | $14.00 | コンテキスト400K、最大出力128K。キャッシュ入力$0.175 |

入力トークン単価$1.75はリポジトリ全体のスキャンや長時間タスクでもコストを抑えやすく、キャッシュ入力が1/10単価のため反復作業では実効コストがさらに下がります。

「ChatGPTプランの枠を温存したい」「CI/CDやバッチ処理にCodexを組み込みたい」場合は、API従量利用が有効です。特にサーバーサイドのバックグラウンドジョブや社内ツール組込みは、プラン枠とは分離した方が可観測性が高まります。

Codexのモデル構成と性能

料金体系を押さえたあとは、Codexの「中で動いているモデル」に目を向けます。ここではラインナップと性能を整理し、どの利用枠でどのモデルを選ぶのが現実的かを見えるようにします。

2026年4月時点でCodexの主力モデルは大きく整理されており、GPT-5.4系とGPT-5.3-Codex系に集約されています。GPT-5・GPT-5.1・GPT-5.1-Codex系・GPT-5.2-Codexなどの旧モデルは現行のデフォルト選択肢から外れ、実運用の標準は以下の4系統です。

以下のリストで、現行モデルの特性と位置づけを整理します。古い記事やドキュメントに旧モデル名が残っていても、新規タスクでは下のラインナップから選ぶのが前提になります。

-

GPT-5.4

2026年3月5日にCodexへ導入された汎用フラグシップ。GPT-5.3-Codexのコーディング能力をネイティブ統合した初の推論モデルで、Computer Useを標準装備。1Mトークンコンテキストが実験的に利用可能

-

GPT-5.4 mini

2026年3月17日に導入された軽量・高速モデル。GPT-5.4の利用枠の30%で使える設計のため同じ枠で約3.3倍多く回すことが可能で、速度はGPT-5.4比で約2倍。サブエージェントやリアクティブなコーディングに向く

-

GPT-5.3-Codex

コーディング特化のフラグシップ。GPT-5.2-Codexのコーディング性能とGPT-5.2の推論・専門知識を統合し、自身のトレーニング・デバッグに貢献した初の「自己開発型AI」として知られる。コンテキスト400,000トークン・最大出力128,000トークン

-

GPT-5.3-Codex-Spark

ChatGPT Pro向けのリサーチプレビュー。Cerebras Wafer Scale Engine上で毎秒1,000トークン以上を生成し、人間が考えながら書くリズムを崩さないリアルタイム編集を実現

ここで注目すべきは、GPT-5.4がCodexの事実上のデフォルトモデルになった点です。従来は「コーディングならGPT-5.3-Codex、推論ならGPT-5.4」と使い分ける必要がありましたが、GPT-5.4がGPT-5.3-Codexのコーディング能力を吸収した結果、日常タスクの大半はGPT-5.4で足ります。コスト・速度を重視する場面だけGPT-5.4 miniへ、1スレッドを長時間占有する重量級タスクだけGPT-5.3-Codexへ、という使い分けが現実的な運用です。

【GPT-5.4】Computer Use標準装備のフラグシップ

GPT-5.4は、2026年3月にCodexへ導入され、4月以降にCodexの事実上のデフォルトモデルとなった汎用フロンティアモデルです。最大の特徴は、コーディング能力に加えてネイティブなComputer Use能力を標準装備している点です。

- ネイティブなComputer Useでアプリケーション横断のワークフローを実行

- 最大1Mトークンのコンテキストを実験的にサポート

- 表計算・プレゼン・ドキュメントなど、開発以外のプロフェッショナルタスクでも性能向上

- GPT-5.2比でトークン効率が大幅に改善(公式発表によれば同等タスクをより少ないトークンで完了)

汎用モデルでありながらコーディング品質はGPT-5.3-Codexに迫るレベルに到達しており、「コーディング専用モデルに切り替える手間」が多くの場面で不要になりました。

【GPT-5.4 mini】軽量・高速のサブエージェント向け

GPT-5.4 miniは、GPT-5.4と同じ設計思想のもと、レスポンス速度とコスト効率を重視して作られた軽量モデルです。2026年3月17日にCodexへ導入されました。

以下のリストでGPT-5.4 miniの特徴を整理します。軽量モデルは"とりあえず安いだけ"になりがちですが、Codexではフラグシップと棲み分ける設計がなされています。

-

GPT-5.4の利用枠の30%で動作・同じ枠で約3.3倍

公式発表によると、GPT-5.4 miniはGPT-5.4の利用枠の30%分を消費する設計のため、同じプラン枠でおよそ3.3倍多く回せる

-

速度2倍

GPT-5.4比で約2倍のスループット。シンプルな補完やテンプレート生成、サブエージェントからの呼び出しに最適

-

IDE拡張・CLIでのサブ呼び出し

メインスレッドはGPT-5.4、補助的な探索・定型編集はGPT-5.4 mini、という二段構え運用がしやすい

「フラグシップの出力を待つまでもない軽作業」をGPT-5.4 miniに流しておくと、クレジット消費を抑えながら全体のスループットを上げられます。

【GPT-5.3-Codex】長時間タスク向け専用フラグシップ

GPT-5.3-Codexは、GPT-5.2-Codexのコーディング性能とGPT-5.2の推論・専門知識能力を1つに統合したコーディング特化フラグシップです。Codexアプリ、CLI、IDE拡張、Webのすべてで利用できます。

主な特徴は次の通りです。

-

自己開発型AI

OpenAIのCodexチームは、GPT-5.3-Codexの初期バージョンを使って、自身のトレーニングのデバッグ、デプロイ管理、テスト結果と評価の診断を実施。モデル自身が開発プロセスに貢献した初の事例

-

コンテキスト400,000トークン・最大出力128,000トークン

モノレポ全体を一度に読み込み、数千ファイル規模のリファクタリング計画を立案できる容量

-

Interactive Steering(対話型リアルタイム操作)

作業中のCodexに対し、コンテキストを失わずに質問・方向修正が可能。最終出力を待たずに「同僚と話しながら進める」開発体験

-

High Capability認定

OpenAIのPreparedness Frameworkでサイバーセキュリティ領域「High Capability」に到達した初のモデル。詳細は後述のセキュリティセクションで解説

GPT-5.4がデフォルトになった後も、24時間規模の大規模リファクタリングやモノレポ全体の構造変更ではGPT-5.3-Codexが引き続き有効です。特にコンテキスト圧縮を繰り返しながら長時間稼働する必要がある場面で、現行モデルの中では最強クラスの選択肢になります。

【GPT-5.3-Codex-Spark】リアルタイム編集向けリサーチプレビュー

GPT-5.3-Codex-Sparkは、GPT-5.3-Codexの小型版であり、リアルタイムコーディング向けに設計された初のCodexモデルです。以下、特徴を整理します。

-

毎秒1,000トークン以上の出力速度 Cerebras社のWafer Scale Engine 3上で動作し、超低レイテンシの推論を実現

-

200トークン応答を200ミリ秒未満で返す 従来モデルが約3秒かけていた応答を体感遅延なく返す

-

ターゲット編集・ロジック再構成・インターフェース改善 軽量化しつつも実務タスクに十分対応

-

ChatGPT Pro限定 Codexアプリ、CLI、VS Code拡張でリサーチプレビューとして提供

Sparkは「モデルが考える時間」そのものを消し、人間がコードを書くリズムにAIを合わせるという新しいパラダイムを示すモデルです。IDE拡張で左に人間、右にCodex Sparkを置いて並行編集すると、ペアプロの手応えがそのまま得られます。

現行デフォルトから外れた旧モデル

以下のモデルは2026年4月時点でCodexの現行デフォルト選択肢から外れています。旧設定ファイルやドキュメント、社内スクリプトに残っていないかを棚卸しし、新規タスクではGPT-5.4系・GPT-5.3-Codex系へ切り替えておくと安全です。

gpt-5.2-codexgpt-5.1-codexgpt-5.1-codex-minigpt-5.1-codex-maxgpt-5.1gpt-5

特にCI/CDやAGENTS.md内で明示的にモデル名を指定している環境では、GPT-5.4またはGPT-5.3-Codexへの切り替えが必要です。切り替え時はトークン単価と思考レベルの既定が変わる可能性があるため、小さいタスクで動作確認してから段階展開するのが無難です。

AGENTS.mdによるプロジェクト適応

Codexは、リポジトリ内のAGENTS.mdファイルを読み込み、プロジェクト固有のルールに従って動作します。テスト実行コマンド、コーディング規約、禁止ディレクトリなどを明示しておくと、Codexの出力品質が安定します。

GPT-5.4世代ではAGENTS.md準拠性がさらに強化されました。プロンプトで毎回ルールを説明するのではなく、「プロジェクトの作法」をAGENTS.mdに集約しCodexに読ませる運用が公式に推奨されています。

【関連記事】

AI開発の新常識「agents.md」とは?AIの性能を引き出す書き方を徹底解説

Codexのセキュリティと承認モード

「自律的なAIにコードベースを触らせても安全か?」という観点で、Codexのセキュリティ設計を整理します。Computer Useが追加された2026年4月以降は、画面操作レベルでの権限管理が新たな論点として加わっています。

ネットワークから隔離されたサンドボックス環境

Codex Cloudは、デフォルトでネットワークアクセスが無効化されたサンドボックス環境で実行されます。

- ファイルアクセスはワークスペース内に限定

- ネットワークアクセスは明示的に有効化しない限り無効

- プロジェクトごとにコンテナが分離される

- Windowsアプリはシステムレベルの制限付きトークン・ACLで分離

「誤って外部サービスに機密情報を送信してしまう」リスクを低減する設計になっています。Computer Useを使うmacOSアプリでも、操作対象は事前に許可したアプリに限定されます。

開発者が制御できる3段階の承認モード

Codex CLI・IDE拡張・デスクトップアプリには、権限レベルを制御する承認モードが用意されています。

-

read-only コードの読み取りと提案のみ

-

auto ワークスペース内でのファイル編集・テスト実行は自動、外部コマンドは承認が必要

-

full access ネットワークアクセスを含むすべての操作を許可(高リスクなため要注意)

導入初期はread-only→auto→full accessの順で段階的に権限を広げるのが定石です。Computer Useを有効化する場合は、対象アプリを明示指定した上でautoから始めるのが安全です。

GPT-5.3-CodexとGPT-5.4の「High Capability」と追加セーフガード

GPT-5.3-Codexは、OpenAIのPreparedness Frameworkでサイバーセキュリティ領域「High Capability」に到達した初のモデルです。合理的に防御されたターゲットへのサイバーオペレーション自動化や、運用上重要な脆弱性の発見・悪用を自動化できる能力を持つため、次の多層セーフガードが組み込まれています。

-

安全性トレーニング 資格情報窃取など明らかに悪意あるリクエストを拒否するようモデル自体を訓練

-

自動分類器による監視 不審なサイバー活動の兆候を検出する自動分類器が稼働。高リスクなトラフィックはサイバー能力の低いGPT-5.2にルーティング

-

Trusted Access for Cyber セキュリティリサーチャーや誤分類を疑う開発者は、OpenAIのTrusted Access for Cyberプログラムを通じてフルアクセスを申請可能

-

Elevated Riskラベル ネットワークアクセスなどリスクの高い設定に「Elevated Risk」ラベルが表示され、操作前に注意を促す

GPT-5.4も同様の枠組みに組み込まれており、Computer UseやAgent領域のリスクを踏まえた安全設計が継続されています。「攻撃能力を持つモデルを、防御側が最大限活用できるようにする」というOpenAIのアプローチは、Trusted Access for Cyberのような審査付き運用で具体化されています。

セキュリティエージェントと推奨運用

2026年3月以降、Codexにはセキュリティエージェントが常駐し、バックグラウンドで脅威モデリングと修正パッチ生成を続けます。これと合わせて、OpenAIは次のような運用を推奨しています。

- Codexの提案はすべてPR・diffとして人間がレビュー

- 本番反映前には、既存のレビュー・テストプロセスを必ず通す

- サイバーセキュリティ関連のタスクでは人間のチェックを厳格にする

- Computer Use使用時は、操作対象アプリとファイルスコープを明示的に限定

Codexは「人間のレビューを置き換えるものではなく、追加のレビュアー」として位置づけるのが原則です。High Capability認定モデルほど、人間の監督と段階的デプロイが重要になります。

Codex導入パターンとおすすめの始め方

実際にチームでCodexを導入する際の踏み方を、小さなPoC → チーム展開 → 組織標準化の流れで整理します。

「PRレビューが常にボトルネックになっている」「技術的負債の解消に着手する余裕がない」——こうした状態が慢性化しているチームほど、Codexの導入効果が大きく出ます。ただし、いきなり全プロジェクトに入れるのではなく、リスクの低い範囲から段階的にスコープを広げるのが鉄則です。

ステップ1:個人レベルでCLI / IDE拡張を試す(小さなPoC)

最初の目的は、「Codexで何がどこまでできるか」をチームの誰かが体感することです。いきなり全員で使う必要はありません。

まずは少人数(あるいは1人)で次のツールを試し、「どの程度任せられるか」「どんなタスクと相性が良いか」を感覚的につかみます。

- Codex CLI

- Codex IDE拡張(VS Code / Cursor / Windsurf)

この段階では、次のようなタスクから始めるのがおすすめです。

- 既存コードの軽微なリファクタリング(変数名の整理、コメント追加など)

- 小さめのバグ修正やユニットテストの追加

- ログ整備や型注釈の追加など、仕様リスクが小さい改善

あわせて、次のような気づきをメモしておくと、後のステップで運用ルールを決める材料になります。

- 「Codexに任せて楽になった作業」

- 「まだ任せづらい・注意が必要だと感じた作業」

ステップ2:小さなリポジトリでAGENTS.mdを整備する(ルールの言語化)

次の目的は、「プロジェクト単位でCodexに守ってほしいルールを言語化し、AGENTS.mdに落とし込む」ことです。

小さめのリポジトリを1つ選び、次の内容を中心に整備していきます。

-

AGENTS.md にテストコマンド・コーディング規約・ビルド手順を明文化

例:npm test/pytest/go test ./...など

禁止事項(直接さわってほしくないディレクトリ等)があれば明記

-

Codexの承認モードは read-only / auto を中心に使い、危険な操作が入りづらい設定で試す

このフェーズのゴールは、AGENTS.mdをきちんと書くとCodexの振る舞いがどれだけ安定するかと、「どこまで書けば十分か」というテンプレートのたたき台を掴むことです。ここで作ったAGENTS.mdテンプレを、後で他プロジェクトに横展開できます。

ステップ3:Slack連携やCodex Cloud・自動トリガーでチーム活用

一定の成功体験が得られたら、「個人のPoC」から「チームのワークフロー」へスコープを広げていきます。

具体的には、次の使い方を試していくイメージです。

-

Slack連携で、非エンジニアからのタスク依頼を試す

例:CSやPMが「このバグ報告に対応する修正PRを作って」と@codexに依頼

-

Codex Cloudで、数時間〜1日規模のリファクタリングや大規模テスト追加を試す

例:古い機能群のテスト追加、パッケージ構成の整理、Deprecated APIの一括置き換え

-

自動トリガーでGitHub Issue / PRイベント駆動の運用を試す

例:新規Issue作成で自動的に一次分析PR作成、PRコメントで自動レビュー

PoC対象リポジトリは、次の条件を満たすと扱いやすくなります。

- クリティカルではないが、技術的負債が溜まりがちな領域である

- テストがそこそこ整っており、Codexの変更をテストで検証しやすい

このフェーズでは「Codexに丸投げするタスク」と「Codexにたたき台を作らせ人間が仕上げるタスク」の境界を徐々に見極めていきます。

ステップ4:チーム全体の運用ルール・ガバナンスを決める(本格展開)

最後は、「人によって運用がバラバラにならないようにする」ためのルールづくりです。ここで急に高度なことをやる必要はなく、ステップ1〜3で得た知見を整理するイメージです。

観点としては次のようなものを詰めていきます。

-

どの承認モードをデフォルトにするか

例:基本はautoだが、本番系リポジトリはread-onlyから始める

-

どの種類のタスクまで自動マージを許可するか

例:コメント追加・ログ整備・テスト追加は条件付きで自動マージ可、それ以外は必ず人間レビュー

-

Computer Useの利用範囲

例:QAチームのみUIテスト用途で許可、開発チームはコード操作のみ

-

セキュリティ・コンプライアンス上の禁止事項

例:特定ディレクトリ配下の変更禁止、外部ネットワークアクセスの可否

-

「Codexがやった変更」を可視化・モニタリングする方法

例:Codex由来のPRにラベル付け、ダッシュボードでPR数・マージ率を追う

必要に応じて、Business / EnterpriseプランでクレジットプールやRBAC(ロール別アクセス制御)を設定し、「どのチームにどれだけの利用枠を割り当てるか」「どのロール(開発/QA/SRE/CS)がどの機能にアクセスできるか」といった組織レベルのコントロールを整えます。

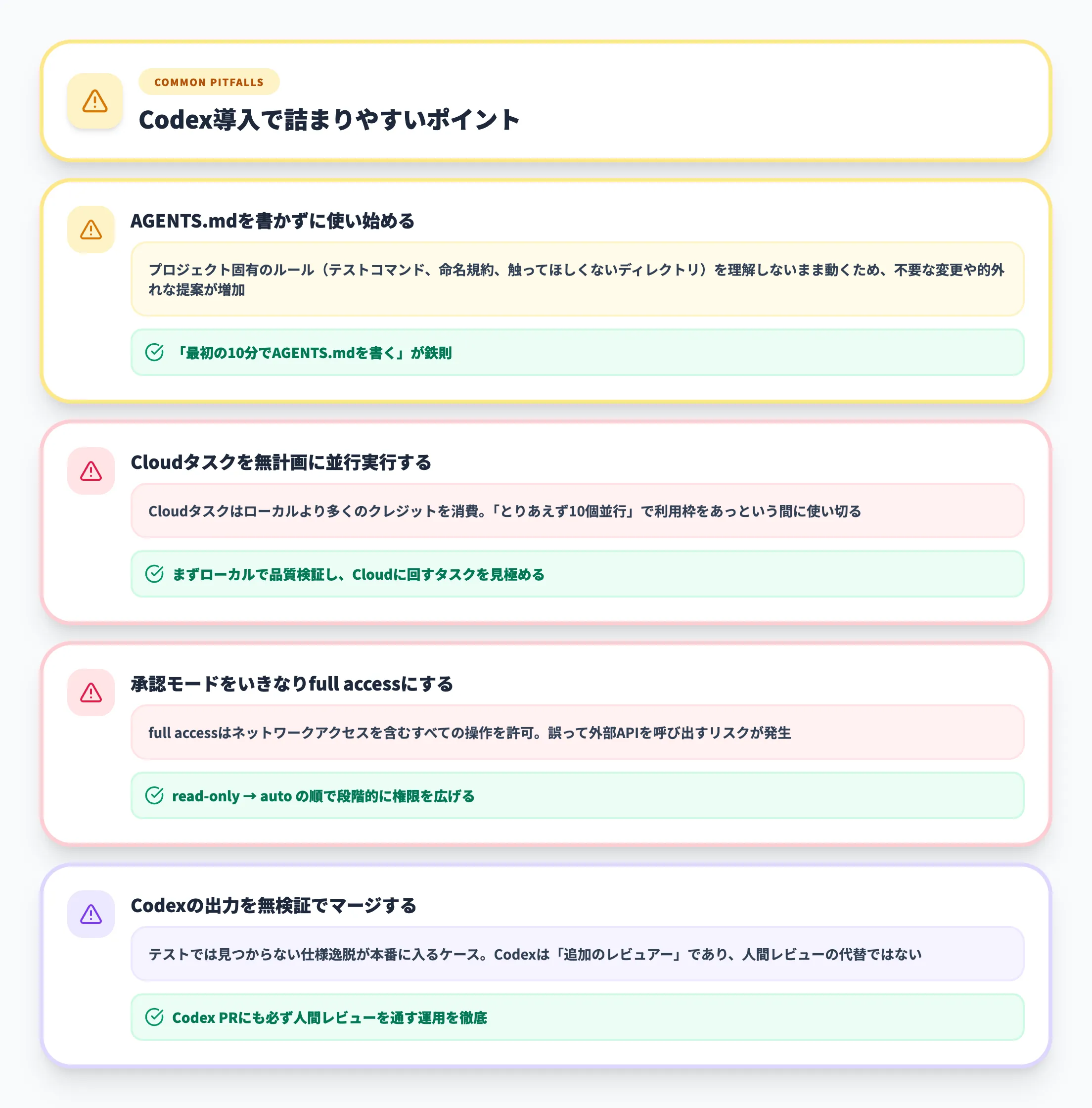

Codex導入で詰まりやすいポイント

実際にCodexをチームに導入する際、つまずきやすいポイントを先回りで整理しておきます。

-

AGENTS.mdを書かずに使い始める

AGENTS.mdなしでもCodexは動きますが、プロジェクト固有のルール(テストコマンド、命名規約、触ってほしくないディレクトリ)を理解しないまま動くため、不要な変更や的外れな提案が増えます。「最初の10分でAGENTS.mdを書く」を徹底するだけで、Codexの出力品質は大きく変わります

-

旧モデルを指定したまま運用する

GPT-5.2-Codex・GPT-5.1-Codex系などはCodexの現行デフォルト選択肢から外れています。CI/CD設定やAGENTS.mdでモデル名を明示している場合は、GPT-5.4またはGPT-5.3-Codexへ書き換えておくのが無難です

-

Cloudタスクを無計画に並行実行する

Cloudタスクはローカルタスクより多くのクレジットを消費します。「とりあえず10個並行で走らせよう」とやると、利用枠をあっという間に使い切ります。まずはローカルで品質を検証し、Cloudに回すべきタスクを見極めるのが先決です

-

承認モードをいきなりfull accessにする

full accessはネットワークアクセスを含むすべての操作を許可するため、誤って外部APIを呼び出すリスクがあります。最初はread-only→autoの順で段階的に権限を広げ、チームデフォルトはautoが安全です

-

Codexの出力を無検証でマージする

Codexが生成したPRをそのままマージし、テストで見つからない仕様逸脱が本番に入るケースがあります。Codexは「追加のレビュアー」であり、人間のレビューを代替するものではありません

これらのポイントを事前に把握しておくだけで、「導入してみたけどうまくいかなかった」という初期の挫折を回避しやすくなります。

規模別のざっくり指針

チーム規模別にまとめると次のようなイメージです。

-

個人〜数名チーム

→ ステップ1〜2を重点的に。CLI / IDE拡張 + AGENTS.mdで「まずは自分たちの開発がどれだけ楽になるか」を確認。プランはPlus $20から始める

-

10〜30人規模の開発チーム

→ ステップ3まで進めて、Slack連携・Cloudタスク・自動トリガーを含めたチーム全体のワークフローを一度設計する。BusinessまたはPro $100で運用枠を確保

-

100人規模以上の組織

→ ステップ4まで含めて、RBAC・クレジットプール・推奨AGENTS.mdテンプレ・教育コンテンツを整え、「Codexを使うときのデファクト・スタンダード」をドキュメント化。プランはBusinessまたはEnterprise

AI総研のSIerとしての経験では、10〜30人規模で最初にボトルネックになるのは「AGENTS.mdのテンプレ不在」と「クレジット管理の属人化」です。 ここを組織で一度整備してしまうと、30〜100人への拡張はステップ4の追加作業に集中でき、スケールが滑らかになります。

Codexの活用事例

実際にCodexを活用している企業・組織の事例を紹介します。自社ユースケースを考える際の参考になります。

事例紹介イメージ(参考:OpenAI公式ブログ)

OpenAI社内:Harness Engineeringで100万行をCodexが構築

OpenAIは「Harness Engineering」と呼ばれる新しいエンジニアリング手法を公開しています。3名のエンジニアがCodexエージェントを「操縦」し、約5ヶ月で100万行規模のプロダクションアプリケーションを構築した事例です。

- アプリケーションロジック、テスト、CI設定、ドキュメント、内部ツーリングまで、すべてのコードをCodexが記述

- 約1,500件のPRが自動生成・マージされ、エンジニア1人あたり1日平均3.5 PRの生産性

- 手動で書いた場合の約10分の1の期間で構築

この事例の教訓は「Codexに1,000ページの指示書を渡すのではなく、地図を渡せ」という点です。コンテキストは有限のリソースであり、巨大な指示ファイルはタスクやコード、関連ドキュメントの理解を圧迫します。AGENTS.mdは簡潔に、フィードバックループで補完する設計が効果的です。

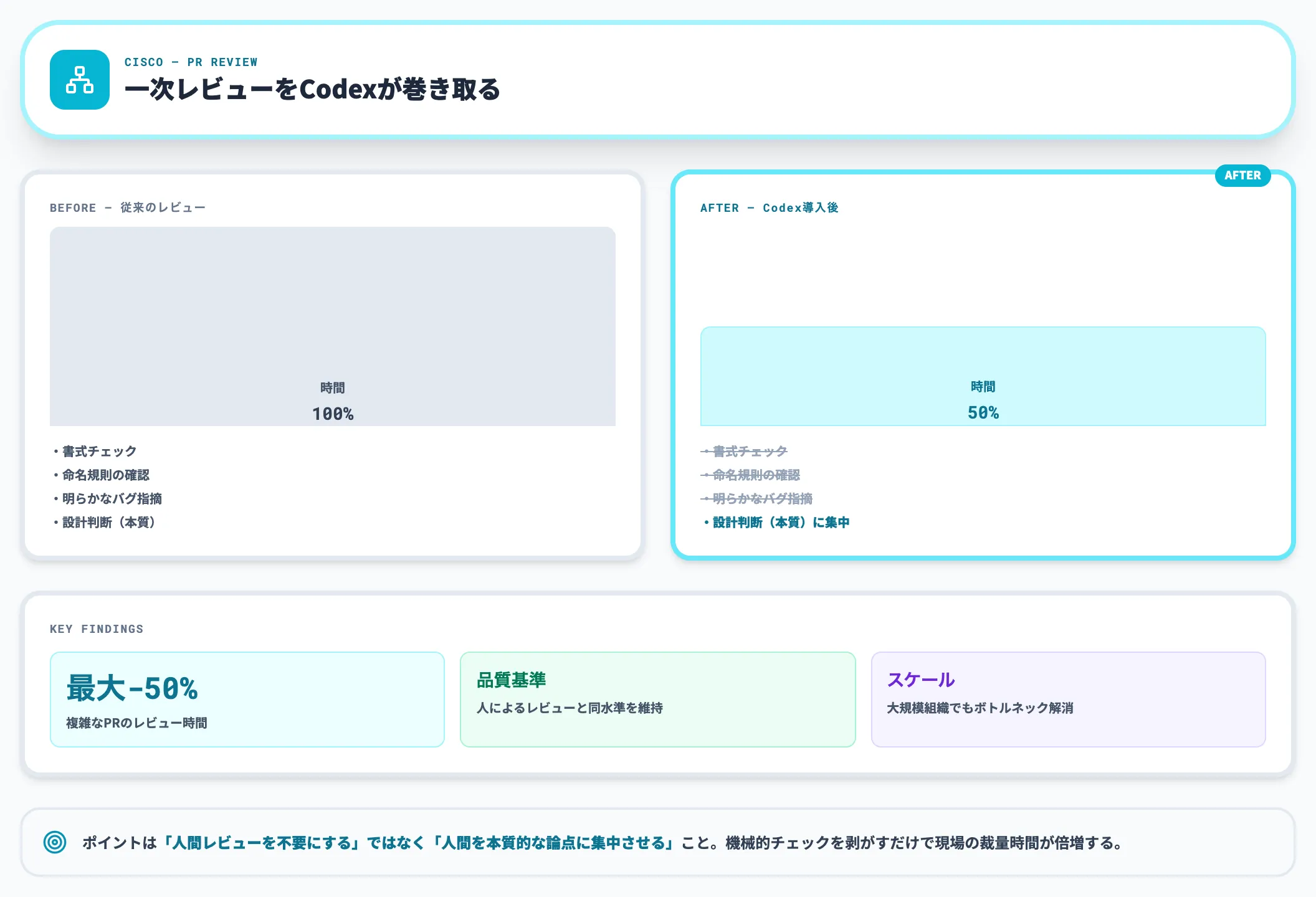

Cisco:コードレビュー時間の短縮

ネットワーク機器大手のCiscoは、Codexをコードレビュー補助に活用し、複雑なPRのレビュー時間を最大約50%短縮したと報告しています。

- Codexが一次レビューを行い、潜在的な問題点を洗い出す

- 人間のレビュアーは、重要な指摘や設計上の論点に集中

これにより、「チェックリスト的な確認」にかかる時間を削減しつつ、品質基準は維持しやすくなっています。

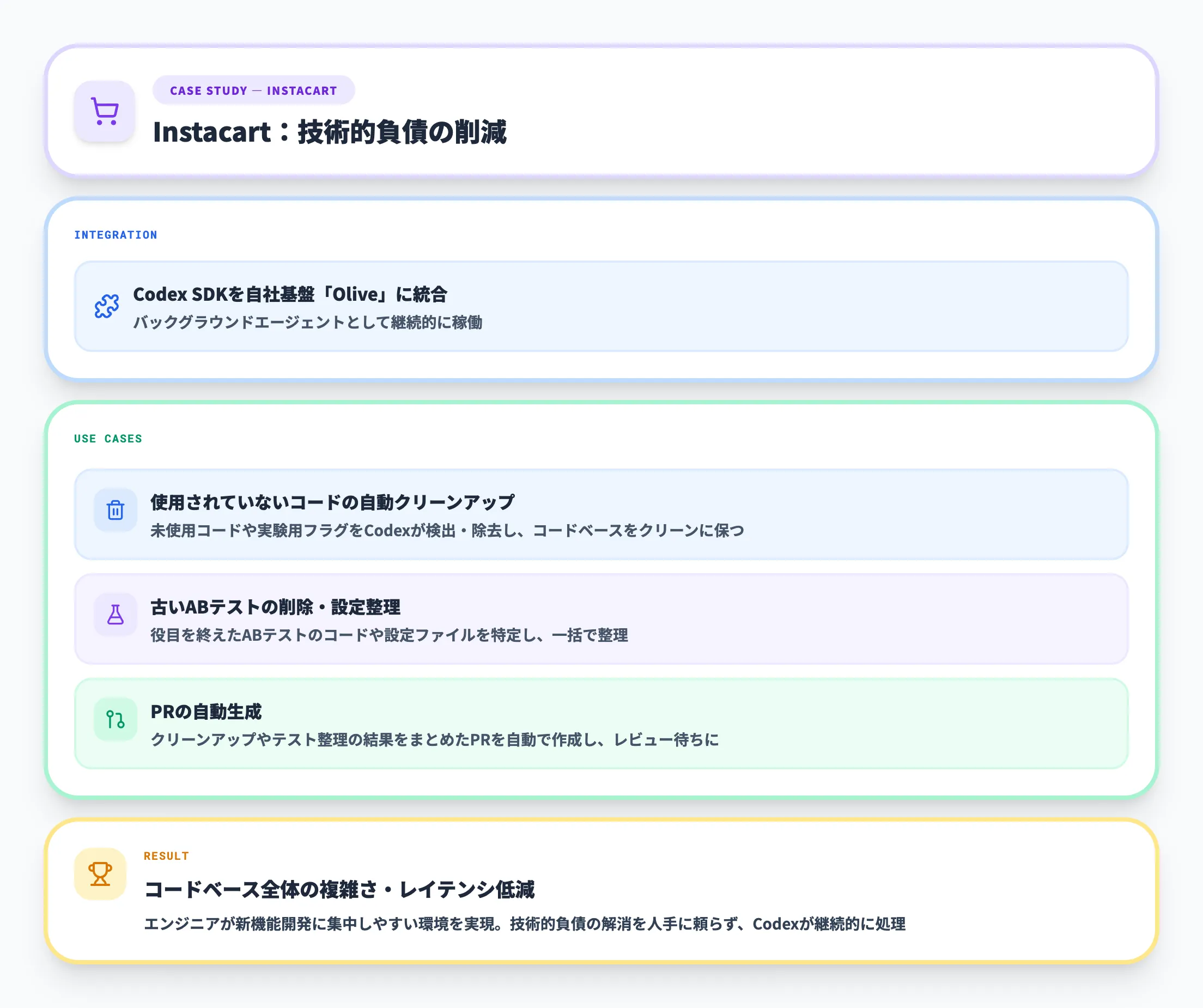

Instacart:技術的負債の自動削減

オンラインスーパーのInstacartは、Codex SDKを自社バックグラウンドエージェント基盤「Olive」に統合し、次のような用途に活用しています。

- 使用されていないコードや実験フラグの自動クリーンアップ

- 古いABテストの削除や設定の整理

- これらの変更をまとめたPRの自動生成

結果として、コードベース全体の複雑さとレイテンシ低減に貢献し、エンジニアが新機能開発に集中しやすい環境を整えています。

Harvey:初期イテレーションを30-50%短縮

リーガルテック企業のHarveyでは、Codex導入により初期イテレーション(設計→プロトタイプ→検証)の時間を30〜50%短縮しました。エンジニアがコードの量産作業から解放され、システム設計やアーキテクチャ判断といった高レバレッジな意思決定に集中できるようになったことが成果の本質です(出典:OpenAI Codex紹介ページ)。

Astral買収発表:uv・Ruff・tyがCodexチームに合流予定

2026年3月19日、OpenAIはAstralの買収を発表しました。Astralはuv(月間1億2,600万DLのパッケージマネージャ)、Ruff(従来比1,000倍高速なlinter/formatter)、ty(型チェッカー)の開発元で、取引完了後にAstralチームがCodexチームへ合流する予定です。現時点では発表段階であり、OpenAIとAstralは別法人のまま個別に運営されています。

- uv・Ruff・tyはMITライセンスのOSS継続をOpenAIが明言

- ロードマップはCodex統合を意識した優先度に調整される見込み

- Codexは「生成 → 依存解決(uv) → lint/format(Ruff) → 型チェック(ty) → テスト → デプロイ」の一気通貫をネイティブに備える方向へ

Python中心のチームでは、Codex + uv/Ruffの組合せで依存解決から静的解析・生成・テストまでを1本のワークフローにまとめやすくなります。既にuv・Ruffを導入済みのチームは、AGENTS.mdにその前提を明記するだけでCodexが自然にこれらを呼ぶようになるため、移行コストは小さめです。

レビュー時間の短縮(Cisco)、技術的負債の解消(Instacart)、イテレーション速度の向上(Harvey)、開発プロセス全体のAI化(OpenAI Harness Engineering)、そしてツールチェーン統合(Astral)。これらの事例に共通するのは、Codexを「コード生成ツール」ではなく開発チームの一員として位置づけている点です。自社の開発フローのどこにボトルネックがあるかを見極めてから導入すると、最も効果が出やすくなります。

FAQ:Codexについてよくある質問

これからCodex導入を検討しているチームからよく聞かれる質問をまとめます。

Q1. GitHub CopilotとCodexはどう違いますか?

A. GitHub Copilotはエディタ内のコード補完やチャットに特化したツールで、Codexはターミナル・IDE・Cloud・GitHub・モバイル・macOS/Windowsアプリをつなぐ「エージェント基盤」という位置づけです。

- 「手元の実装を少し楽にしたい」 → Copilot単体でも十分

- 「テスト実行やPR作成、大規模リファクタリング、PC操作まで任せたい」 → Codexの守備範囲

2026年4月以降のCodexは、Computer Useや画像生成まで備えるため、単純な「Copilotの上位互換」ではなく、設計段階から運用までを一気通貫で任せる基盤として捉えるのが正解です。

Q2. まずはどのモデルから試すべきですか?

A. 2026年4月時点では次の使い分けがおすすめです。

- 日常的なコーディング・設計レビュー → GPT-5.4(デフォルト)

- クレジットを節約したい軽量タスク → GPT-5.4 mini

- コーディング特化の長時間タスクやモノレポ構造変更 → GPT-5.3-Codex

- リアルタイム応答が必要なタスク → GPT-5.3-Codex-Spark(Pro限定)

GPT-5.4がフラグシップに昇格したため、旧来の「コーディングならGPT-5.3-Codex一択」という選び方は不要になりました。迷ったらGPT-5.4で始めて、重量級の長時間タスクだけGPT-5.3-Codexに切り替える運用が楽です。

Q3. Codexを導入するときの最初の一歩は?

A. 本文の「Codex導入パターンとおすすめの始め方」で詳しく解説していますが、要約すると次の4ステップです。

- 個人レベルでCodex CLI / IDE拡張を試す

- 小さなリポジトリでAGENTS.mdを整備し、安全範囲で自動修正を試す

- Slack連携・Codex Cloud・自動トリガーで長時間タスクを試す

- チーム全体の運用ルール(承認モード・Computer Use範囲・レビュー方針)を決める

Q4. Codexを使う際に注意すべきことは?

A. 主に次の4点を意識しておくと、トラブルを減らしやすくなります。

- 出力の正確性を過信しない Codexの提案はあくまで「たたき台」であり、人間によるレビューが必須です。とくにセキュリティ関連の変更や本番環境への反映時には、既存のレビュー・テストプロセスを必ず通してください

- クレジット消費に注意する Cloudタスクや画像生成、Computer Useはローカルタスクより多くのクレジットを消費します。Usage Dashboardで利用量を定期的に確認しましょう

- 旧モデル名の掃除 GPT-5.2-CodexやGPT-5.1-Codex系など、現行の主力/デフォルト選択肢から外れているモデルがあります。AGENTS.mdやCI設定に旧モデル名が残っていないか定期的に棚卸しし、新規タスクはGPT-5.4系・GPT-5.3-Codex系へ揃えておくと安全です

- 機密情報の取り扱い 承認モードをread-onlyから始めるなど、段階的にアクセス権を広げていく運用が推奨されています。Computer Useを使う場合は操作対象アプリを事前に限定してください

Q5. 2026年4月のアップデートで何が一番変わりましたか?

A. 最も大きな変化は**「Codexがコードエディタを離れてもよくなった」**点です。Computer Useでデスクトップアプリを操作でき、アプリ内ブラウザでWebページを読み、メモリで学習し、プラグインで外部SaaSと連携します。結果として、Codexを「PR作成ツール」として使うか「運用エージェント」として使うかで、設計の仕方が根本的に変わります。イシュー駆動の開発フローを持つチームは、自動トリガーとプラグインを前提に再設計する価値が高くなりました。

Codexの活用力を開発以外の業務にも広げるなら

CodexがPRレビュー・テスト自動化・Computer Useで開発チームの生産性を変えたように、バックオフィスの定型業務もAIで自動化するフェーズに入っています。承認ワークフロー・データ集計・レポート作成など、コーディングほど注目されていない領域にこそAI化の余地が残っています。

AI総合研究所のAI業務自動化ガイドでは、業務プロセスごとのAI適用パターンと、PoCから本番運用に進めるためのステップを体系的にまとめています。開発チームのAI活用を組織全体へ拡張する第一歩としてご活用ください。

AIコーディングの先にある業務自動化

開発チームのAI活用を組織全体へ

Codexで開発プロセスが変わった今、次は業務プロセス全体のAI化です。承認・集計・レポートなど定型業務の自動化ステップをまとめた無料ガイドです。

まとめ:Codexは「for (almost) everything」の時代へ

本記事では、OpenAIのAIコーディングエージェント「Codex」について、2026年4月時点の最新情報を整理しました。

- 2026年4月16日の大型アップデート「Codex for (almost) everything」で、Computer Use・画像生成・メモリ・アプリ内ブラウザ・90超のプラグインが追加され、エージェントの守備範囲がデスクトップとブラウザ全体に拡張

- モデルはGPT-5.4をデフォルトにGPT-5.4 mini・GPT-5.3-Codex・GPT-5.3-Codex-Sparkの4系統に集約。旧GPT-5.1/5.2系は現行のデフォルト選択肢から外れている

- 料金はPlus・Pro・Business・新規EnterpriseでAPIトークンベースのクレジット制へ移行(既存Enterprise/Eduはレガシー継続)。新Pro $100(5月31日まで10x)、Pro $200(20x継続)、Business 月払い$25/年払い$20の体系

- Cisco(レビュー時間50%短縮)、Instacart(技術的負債の自動解消)、Harvey(イテレーション30-50%短縮)、OpenAI自社(Harness Engineeringで100万行)、Astral買収発表(uv/Ruff/ty、取引完了後にCodexチームへ合流予定)と、導入事例・連携方針が多層化

Codexは、単なる「コード補完ツール」を超えて、開発チームの一員としてタスクを引き受け、デスクトップと外部SaaSまで横断するAI運用エージェントに進化しました。

自社で導入を検討するなら、まず1つのリポジトリでCLIまたはIDE拡張を試してみてください。AGENTS.mdにテストコマンドと禁止事項を書いて、仕様リスクが小さいタスク(ログ整備、型注釈の追加、ユニットテストの補充)から始めるのが最も堅実です。「Codexにどこまで任せられるか」の感覚は、10分の試用で掴めます。そこから自動トリガーやプラグイン、Computer Useへと範囲を広げていけば、開発フロー全体がAIを前提にした設計に変わっていきます。