この記事のポイント

自動運転AIの研究開発でモデル・シミュレータ・データセットを一括で揃えたいなら、Alpamayoのオープンソース3要素構成が最も効率的

運転判断の説明可能性が求められる場面ではChain-of-Causation推論が決定的な強みとなり、ブラックボックス型モデルでは対応困難な規制要件に有効

Tesla FSDやWaymoとは設計思想が異なるため、OEM独自のカスタマイズ性とオープンな研究環境を重視するならAlpamayoを選ぶべき

Mercedes-Benz S-ClassのLevel 4開発採用が示すとおり、量産車メーカーが自社開発の中核に据えるレベルの実用性がある

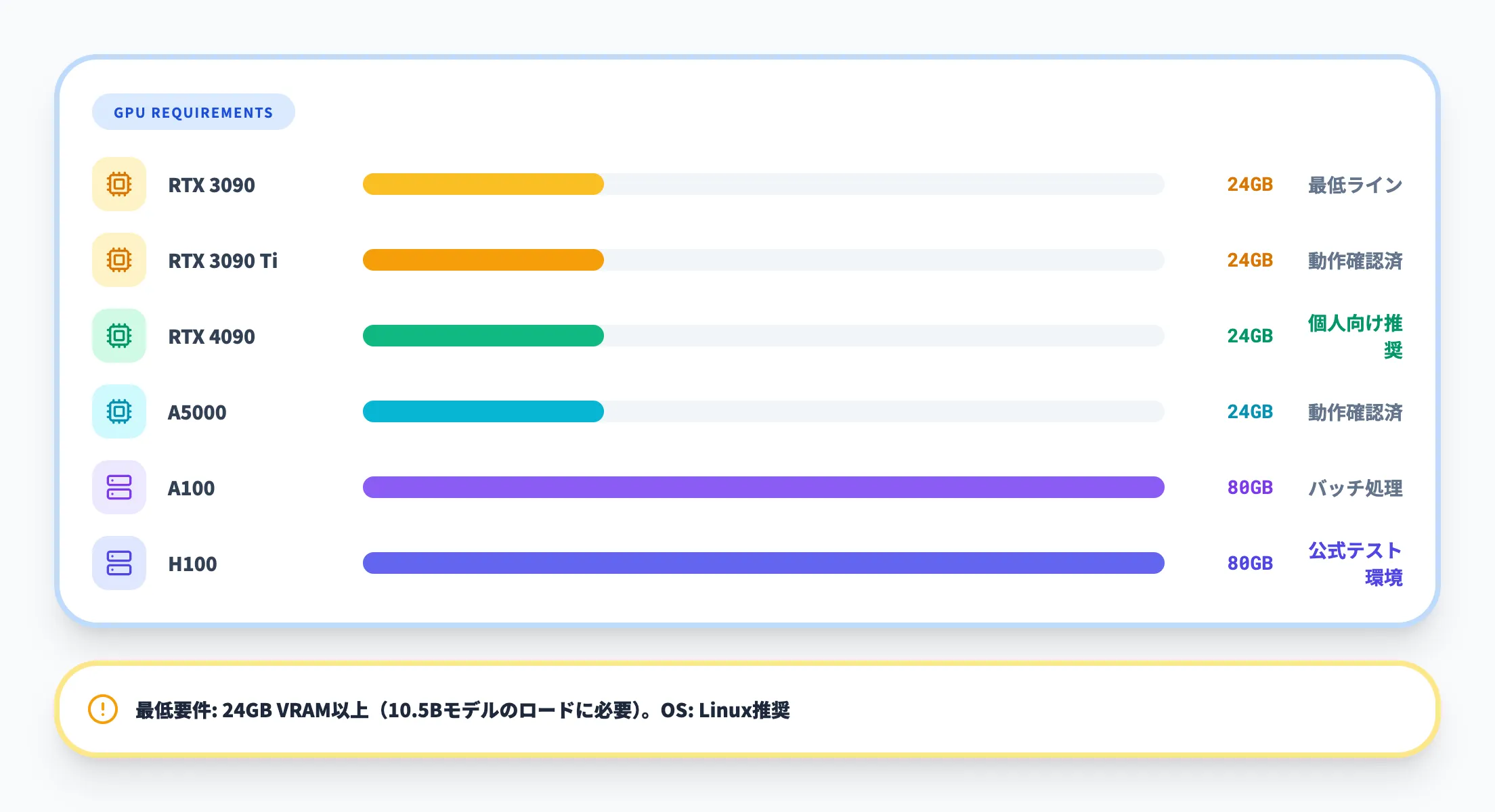

研究・評価は非商用ライセンスで無料だが、24GB VRAM以上のGPUが必須のため、導入前にインフラ要件を確認すべき

Microsoft MVP・AIパートナー。LinkX Japan株式会社 代表取締役。東京工業大学大学院にて自然言語処理・金融工学を研究。NHK放送技術研究所でAI・ブロックチェーンの研究開発に従事し、国際学会・ジャーナルでの発表多数。経営情報学会 優秀賞受賞。シンガポールでWeb3企業を創業後、現在は企業向けAI導入・DX推進を支援。

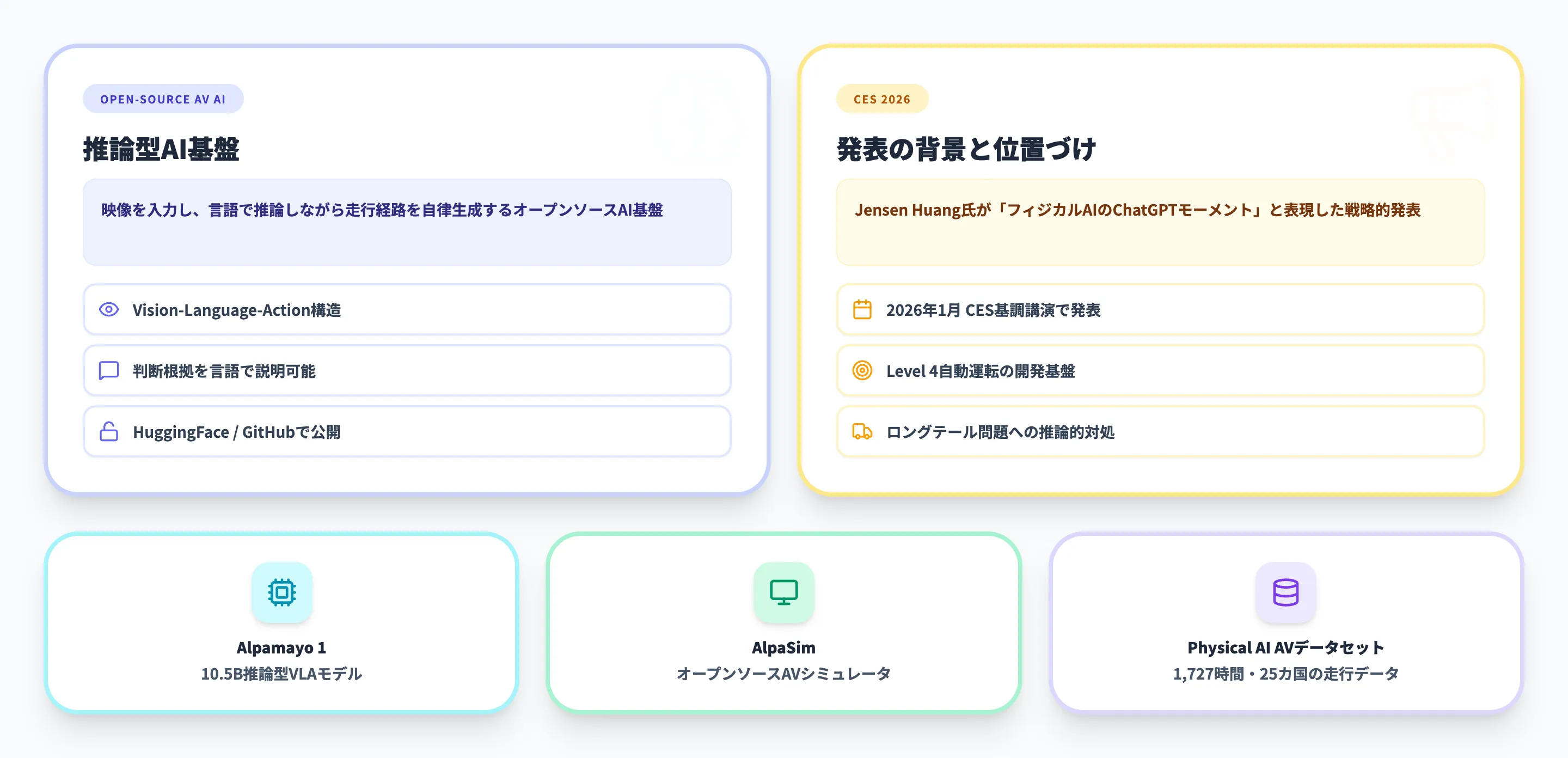

NVIDIAが2026年1月のCES 2026で発表した「Alpamayo(アルパマヨ)」は、自動運転車がヒトのように推論しながら運転できるようにするオープンソースAI基盤です。10.5Bパラメータの推論型VLAモデル「Alpamayo 1」、オープンソースのシミュレータ「AlpaSim」、25カ国・2,500都市以上の走行データセットの3つで構成されています。

本記事では、Alpamayoの技術的な仕組みからTesla FSDやWaymoとの違い、Mercedes-Benz S-Classの開発動向やJLR・Uberの関心表明、開発者向けの始め方、ライセンスと料金まで、2026年3月時点の最新情報をもとに解説します。

NVIDIA Alpamayo(アルパマヨ)とは

NVIDIA Alpamayo(アルパマヨ)は、NVIDIAが提供する自動運転向けのオープンソースAI基盤です。2026年1月のCES 2026で、NVIDIA CEOのJensen Huang氏が「フィジカルAIのChatGPTモーメントが来た」と表現して発表しました。

従来の自動運転AIでは、予測外の状況に遭遇すると判断が不安定になる「ロングテール問題」が課題でした。Alpamayoは、この問題に対して推論(リーズニング)ベースのアプローチで挑んでいます。映像とセンサーデータを受け取り、「なぜそう判断したのか」を言語で説明しながら走行経路を生成する仕組みです。

Alpamayoファミリーは、以下の3つの要素で構成されています。

| 構成要素 | 役割 | 公開先 |

|---|---|---|

| Alpamayo 1 | 10.5Bパラメータの推論型VLAモデル | Hugging Face |

| AlpaSim | オープンソースの自動運転シミュレータ | GitHub |

| Physical AI AVデータセット | 25カ国・2,500都市以上、1,727時間の走行データ | Hugging Face |

3つの要素はそれぞれ独立してダウンロード・利用でき、自動車メーカーや研究機関が自社の自動運転開発に組み込める設計になっています。NVIDIAのフィジカルAI戦略の中核を担うプロジェクトであり、Level 4(特定条件下での完全自動運転)の実現を目指す開発者に向けたツールキットです。

NVIDIAは自動運転ハードウェアとしてNVIDIA DRIVEプラットフォームを展開しており、AlpamayoはそのソフトウェアAI基盤としてDRIVE Hyperionアーキテクチャ上で動作するよう最適化されています。

NVIDIA Alpamayoの3つの構成要素

Alpamayoファミリーは「AIモデル」「シミュレーション環境」「学習データ」の3層構造です。それぞれが独立したオープンソースプロジェクトとして公開されており、開発者は必要な要素だけを取り出して自社の開発パイプラインに統合できます。

Alpamayo 1(推論型VLAモデル)

Alpamayo 1は、NVIDIAが開発した10.5Bパラメータの推論型VLA(Vision-Language-Action)モデルです。業界初のオープンな推論型VLAモデルとして、自動運転のロングテールシナリオ(交通信号の故障、工事区間の急な車線変更など)に対処することを目的としています。

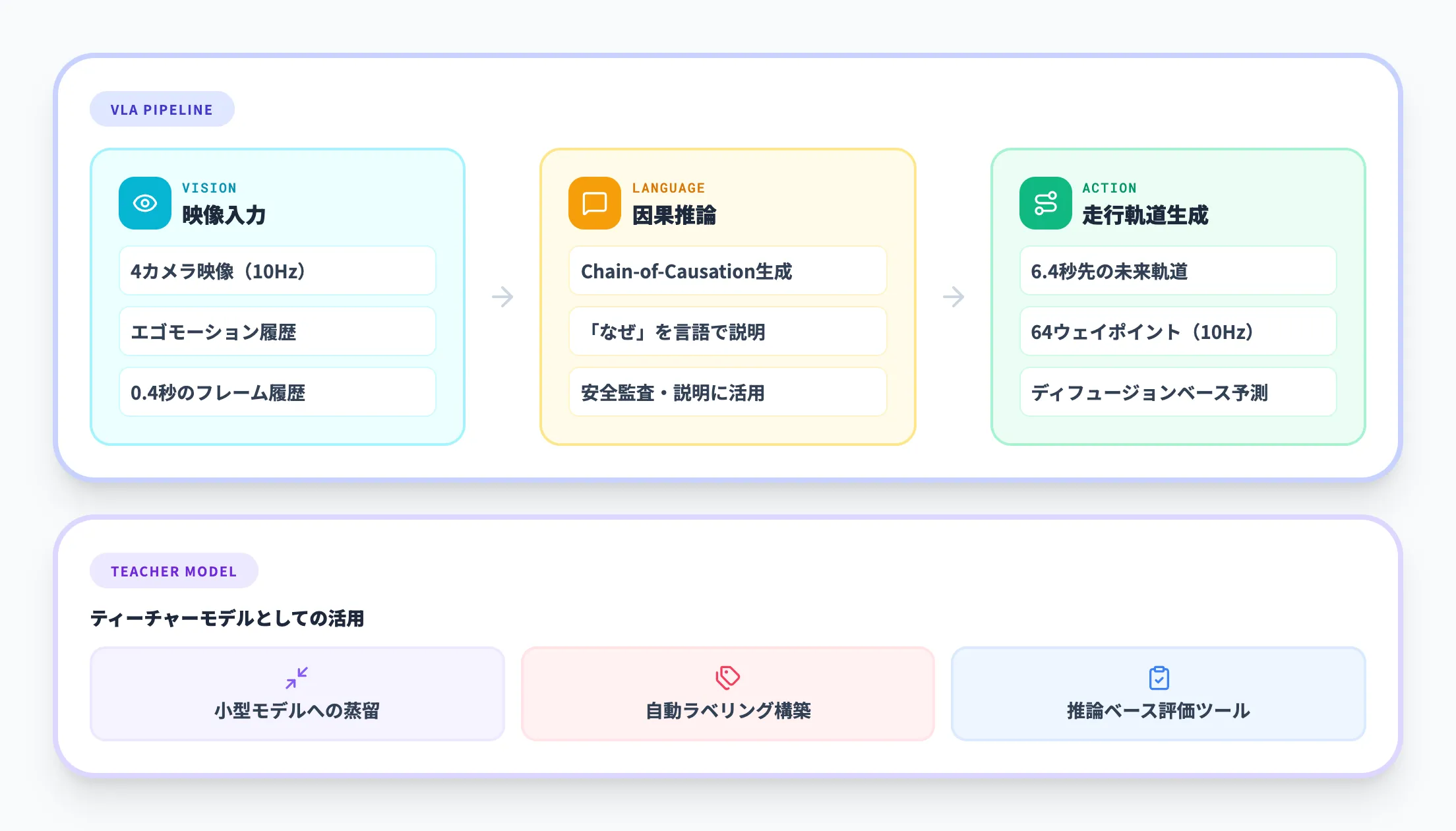

VLAとは、映像(Vision)を入力として受け取り、言語(Language)で状況を推論し、走行経路という行動(Action)を出力するアーキテクチャです。具体的には、車両の4台のカメラ映像を処理し、「工事用コーンが車線に迫っているため、左に寄ってクリアランスを確保する」といった自然言語の推論を生成しながら、6.4秒先の走行軌道を出力します。

この推論プロセスをNVIDIAはChain-of-Causation(因果の連鎖)推論と呼んでいます。判断根拠が言語化されるため、安全監査や規制当局への説明が容易になる点が、ブラックボックス型のAIとの大きな違いです。

Alpamayo 1は「ティーチャーモデル」としても機能します。開発者はこのモデルを蒸留(ディスティレーション)してより小さく高速な車載モデルに変換したり、自動ラベリングシステムや推論ベースの評価ツールの構築に活用できます。

AlpaSim(シミュレーションフレームワーク)

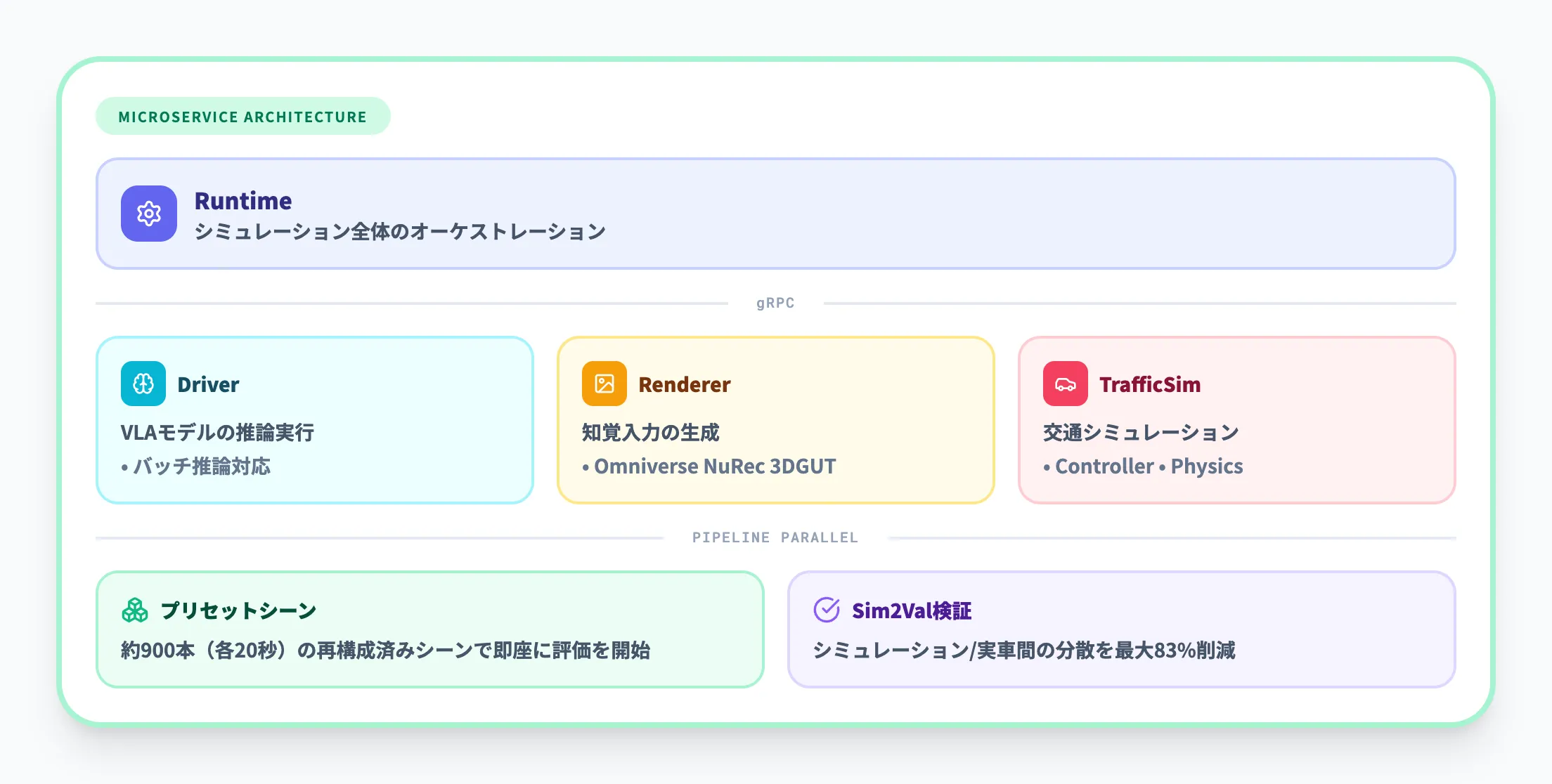

AlpaSimは、Alpamayo 1の検証と改良のために開発されたオープンソースのエンドツーエンド自動運転シミュレータです。GitHubで公開されており、マイクロサービスベースのアーキテクチャを採用しています。

主要な構成サービスは以下のとおりです。

-

Runtime

シミュレーション全体のオーケストレーション(制御・管理)を担当します。

-

Driver

VLAモデルの推論処理を実行するサービスです。複数のシーンにまたがるバッチ推論にも対応しています。

-

Renderer

NVIDIA OmniverseのNuRec 3DGUTを用いて、カメラ映像などの知覚入力を生成します。

-

TrafficSim / Controller / Physics

交通シミュレーション、車両制御、物理演算をそれぞれ担当するサービスです。

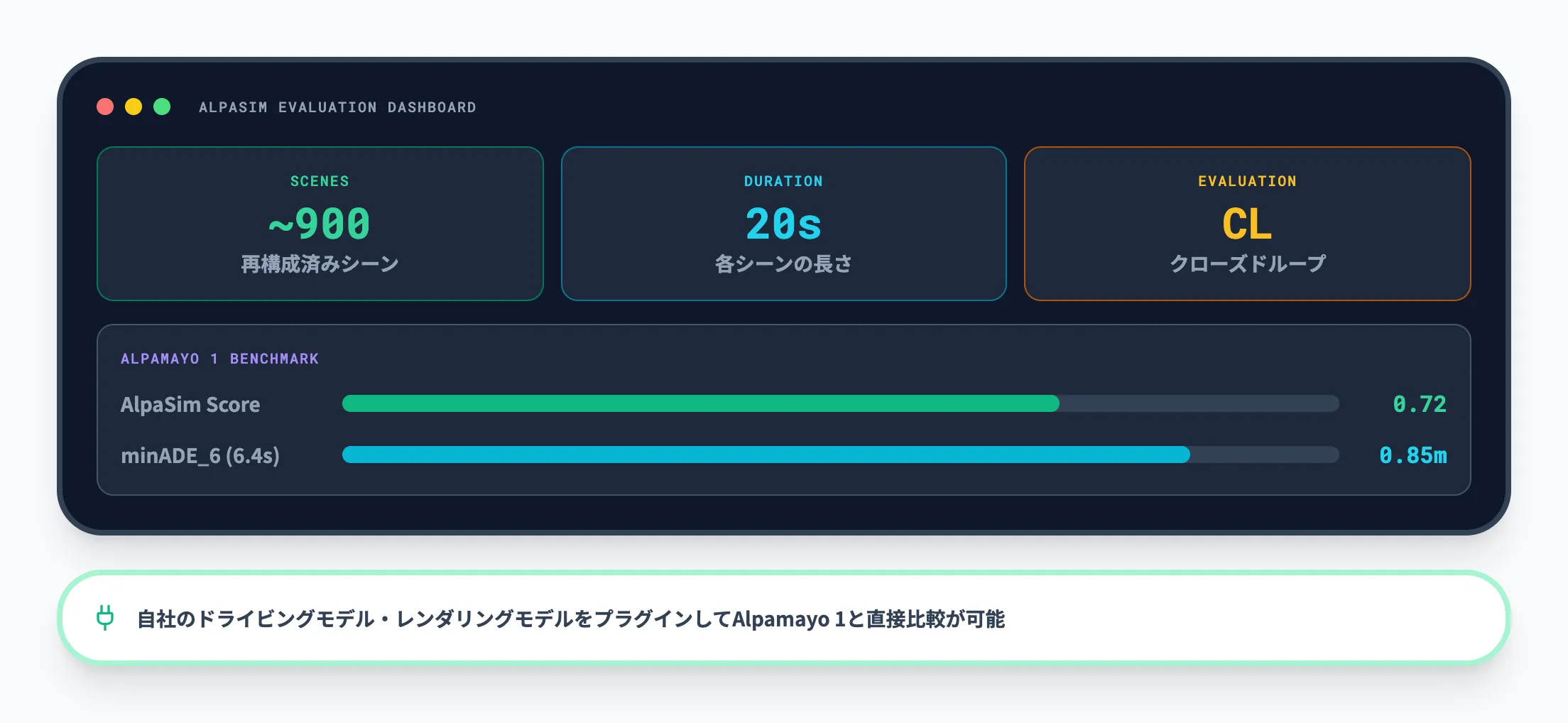

各サービスはgRPCで通信し、パイプライン並列処理によって推論とレンダリングを同時進行させることでスループットを向上させています。約900本の再構成済みシーン(各20秒)がプリセットとして用意されており、すぐにシミュレーションを開始できます。

NVIDIAはSim2Val(シミュレーションから実車検証への妥当性検証)フレームワークも提供しており、シミュレーション結果と実車データの間の分散を最大83%削減できたとNVIDIAの技術ブログで報告しています。

NVIDIA Isaac Simがロボティクス向けの汎用シミュレータであるのに対して、AlpaSimは自動運転のクローズドループ評価に特化したフレームワークです。

Physical AI AVデータセット

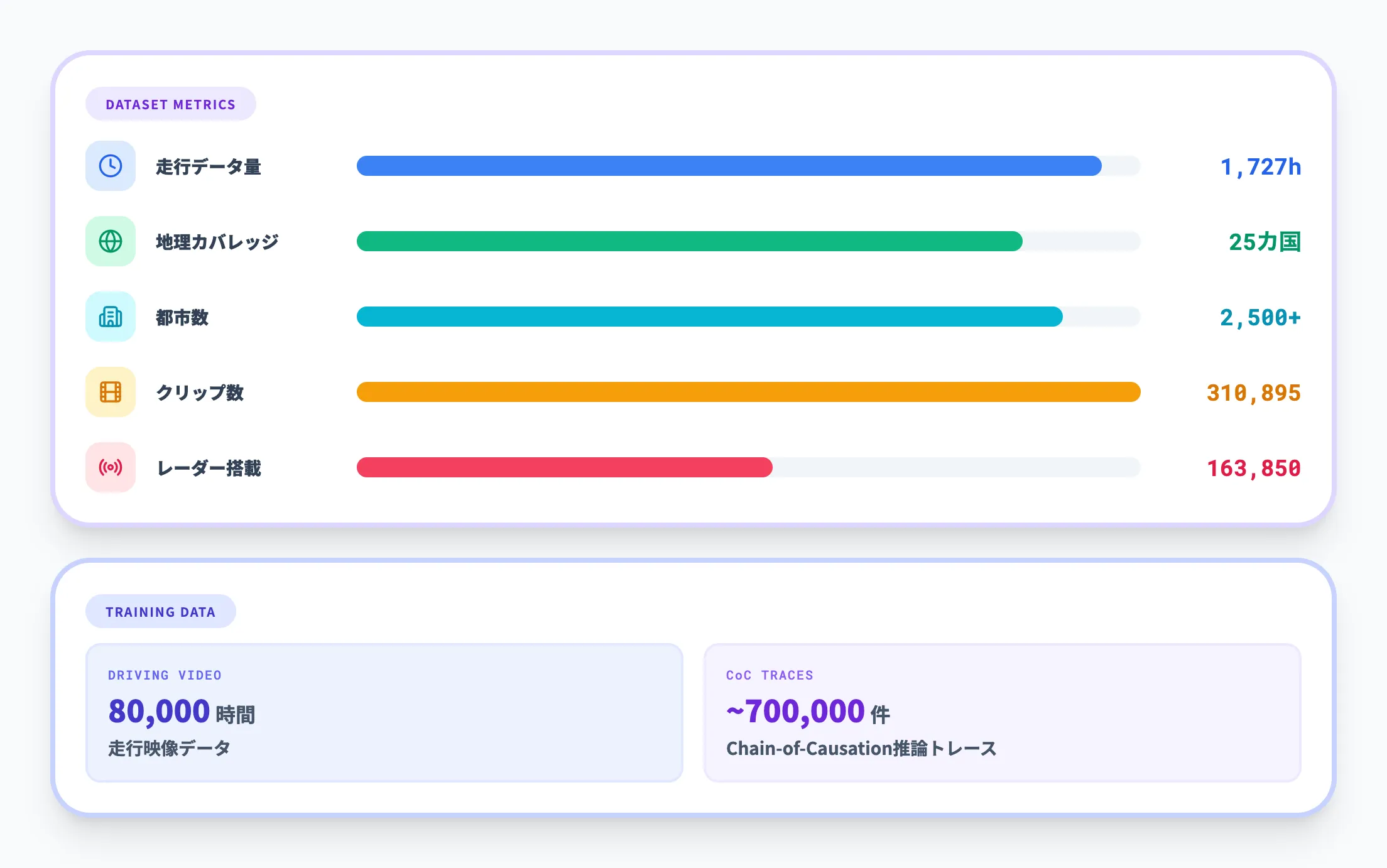

学習データの規模と多様性は、自動運転AIの性能を左右する重要な要素です。NVIDIAが公開したPhysical AI AVデータセットの仕様は以下のとおりです。

| 項目 | 仕様 |

|---|---|

| 走行データ量 | 1,727時間 |

| 地理的カバレッジ | 25カ国、2,500都市以上 |

| クリップ数 | 310,895クリップ(各20秒) |

| カメラ | 全クリップにマルチカメラ映像 |

| LiDAR | 全クリップに搭載 |

| レーダー | 163,850クリップに搭載 |

Alpamayo 1のトレーニングには、80,000時間の走行映像と約70万件のChain-of-Causation推論トレース(構造化された因果推論の記録)が使用されています。データは交通パターン、天候条件、障害物、歩行者など多様なシナリオをカバーしており、レアケースの学習に必要なエッジケースデータが重点的に収集されています。

データセットはHugging Faceで公開されており、研究者は自社のVLAモデルのトレーニングや評価に利用できます。

NVIDIA Alpamayo 1の技術的な仕組み

Alpamayoの技術的な差別化ポイントは、推論(リーズニング)能力を自動運転の意思決定に組み込んだ点にあります。ここでは、Alpamayo 1のアーキテクチャを3つの層に分けて解説します。

VLAアーキテクチャの全体像

Alpamayo 1は、大きく3つのコンポーネントで構成されています。

-

VLM(Vision Language Model)

NVIDIA Cosmos-Reasonをバックボーンに採用した8.2Bパラメータのモデルです。マルチカメラ映像と自車の動き(エゴモーション)の履歴を処理し、Chain-of-Causation推論トレースを生成します。

-

Action Expert(行動予測モジュール)

2.3Bパラメータのテキスト専用Transformerモデルです。VLMが生成した文脈を受け取り、拡散(ディフュージョン)ベースの手法で走行軌道を予測します。

-

Action Space(行動空間)

ユニサイクルモデル(加速度+曲率)を用いて、低次元の制御入力と完全な走行軌道の間を変換するキネマティクスモジュールです。

このパイプラインにより、映像入力から「状況認識→推論→軌道生成」までを一貫して処理できます。推論トレースが言語として残るため、「なぜブレーキをかけたか」「なぜ車線変更したか」を事後的に確認・監査できる点が、安全性検証において大きな利点になります。

Chain-of-Causation推論

Chain-of-Causation(CoC)は、Alpamayo 1の中核をなす推論手法です。一般的なChain-of-Thought(思考の連鎖)と類似していますが、因果関係の連鎖に焦点を当てている点が異なります。

具体的な推論の流れは以下のとおりです。

- 4台のカメラ映像から周囲の状況(車両、歩行者、障害物、道路標識など)を認識する

- 認識した要素間の因果関係を言語で記述する(例:「前方の工事区間により車線が狭くなっている。右側のコーンとの距離を確保するため、左寄りに走行する必要がある」)

- 推論結果に基づいて、6.4秒先までの走行軌道(64ウェイポイント、10Hz)を生成する

この推論プロセスを支えるトレーニングデータとして、約70万件のCoC推論トレースが使用されています。各トレースは構造化された英語テキストで記述されており、因果関係のチェーンが明示されています。

従来のend-to-endモデルでは「映像→走行軌道」を直接学習するため、なぜその軌道を選んだかの説明が困難でした。Alpamayo 1では推論の中間過程が言語として出力されるため、開発者がモデルの判断を検証し、問題があれば推論チェーンのどこに誤りがあるかを特定しやすくなっています。

入力と出力の仕様

Hugging Faceのモデルカードに公開されている入出力仕様を整理します。

入力仕様:

| 項目 | 詳細 |

|---|---|

| カメラ構成 | 4台(前方ワイド、前方テレ、左クロス、右クロス) |

| 画像解像度 | 1080×1920px(処理時に320×576pxにダウンサンプリング) |

| フレームレート | 10Hz |

| 履歴ウィンドウ | 0.4秒(カメラ1台あたり4フレーム) |

| エゴモーション | 3次元並進+9次元回転行列(16ウェイポイント、10Hz) |

入力はRGBカメラ映像とエゴモーション(車両自体の運動履歴)の2種類です。LiDARやレーダーは入力として使用しません。

出力仕様:

| 項目 | 詳細 |

|---|---|

| 推論テキスト | Chain-of-Causation推論トレース(可変長の自然言語テキスト) |

| 走行軌道 | 6.4秒先の未来軌道(64ウェイポイント、10Hz) |

| 座標系 | 自車座標系(x, y, z位置+3×3回転行列) |

入力がカメラ映像のみであるため、LiDARを搭載しない車両でもAlpamayo 1の恩恵を受けられます。ただし、AlpaSimでのシミュレーションではLiDARデータも活用されるため、精密な評価にはマルチセンサー環境が望ましいでしょう。

自動運転AI基盤の動向を業務プロセスのAI化に結びつける

推論型AIの進化を業務自動化に活かす

Alpamayoのような推論型AIの進展は、判断を伴う業務へのAI導入可能性を広げています。ガイドでは業務自動化の設計から実装までを解説しています。

NVIDIA Alpamayoと従来の自動運転AIの違い

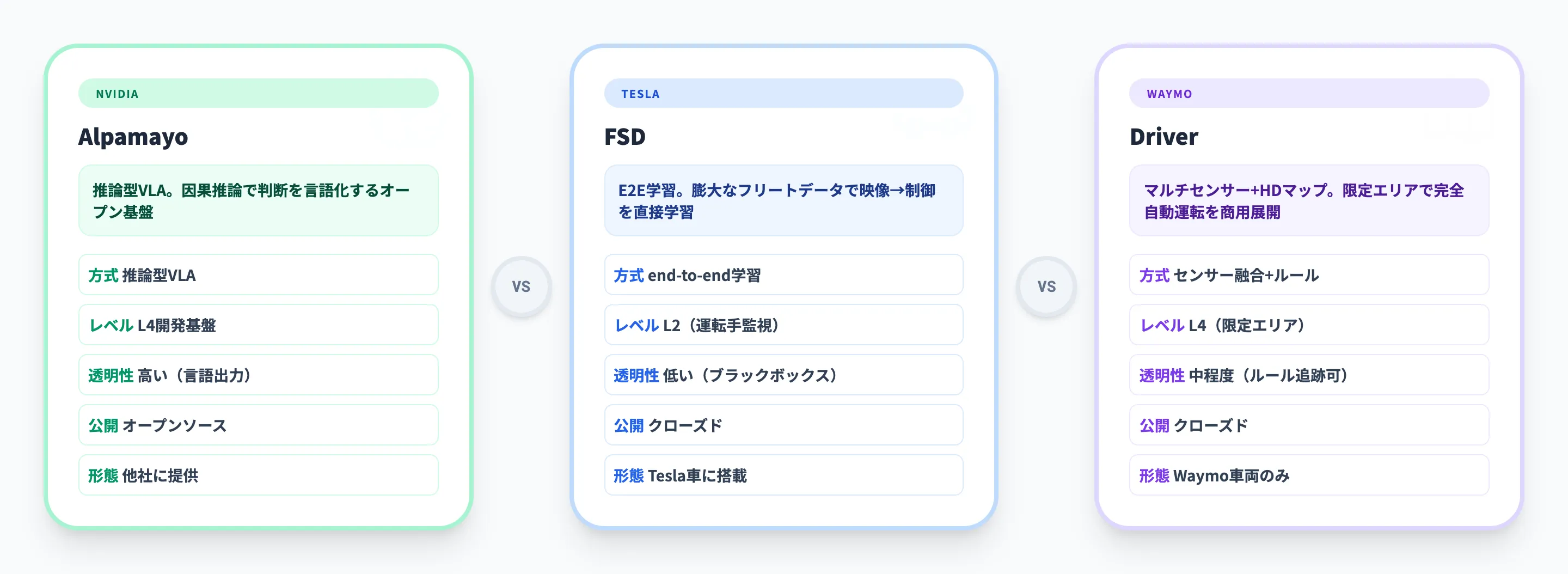

自動運転AIには複数のアプローチがあり、それぞれ設計思想と強みが異なります。Alpamayoがどのような立ち位置にあるかを理解するために、代表的な2つのシステムと比較します。

Tesla FSD / Waymoとの比較

以下の表で、3つのアプローチの特性を整理しました。

| 比較軸 | NVIDIA Alpamayo | Tesla FSD | Waymo |

|---|---|---|---|

| アプローチ | 推論型VLA(言語による因果推論+軌道生成) | end-to-end学習(映像→制御を直接学習) | マルチセンサー融合+HDマップ+ルールベース |

| 自律レベル | Level 4対応を目指す開発基盤 | Level 2(運転手の監視が必要) | Level 4(限定エリアで完全自動) |

| 判断の透明性 | 高い(推論過程が言語で出力される) | 低い(内部判断はブラックボックス) | 中程度(ルールベース部分は追跡可能) |

| オープン性 | オープンソース(非商用ライセンス) | クローズド | クローズド |

| センサー構成 | カメラ映像(モデル入力)、LiDAR / レーダー(データセット) | カメラのみ(ビジョンオンリー) | カメラ+LiDAR+レーダー |

| 走行データ規模 | 1,727時間(公開データセット) | 70億マイル以上(Teslaフリートから収集) | 非公開(4都市以上で商用運行中) |

| 運用地域 | 開発基盤のため限定なし | 米国を中心に拡大中 | 米国4都市以上(ジオフェンスド) |

| 提供形態 | AIモデル・ツールを他社に提供 | Tesla車に搭載 | Waymo車両のみ |

この比較から見えてくるのは、3つのシステムがそもそも異なる目的で設計されているという点です。

Tesla FSDは自社フリートの膨大な走行データを武器にend-to-endで学習する方式で、データ規模では圧倒的です。一方で、判断根拠がブラックボックスであるため、安全認証や規制対応で課題が残ります。

Waymoは限定エリアでの完全自動運転を商用展開しており、実用性では先行しています。ただし、運用エリアの拡大には高精度地図の整備が必要で、スケーラビリティに制約があります。

Alpamayoは「自社で自動運転車を作る」のではなく、自動車メーカーや開発者にAIモデルとツールを提供する立場です。NVIDIAのCEO Jensen Huang氏はCES 2026の基調講演でTesla FSDを「ワールドクラス」と評しつつ、Alpamayoは推論の透明性とオープン性で差別化するアプローチだと説明しています。

オープンソースがもたらす影響

Alpamayoがオープンソースで公開された意義は、自動運転AI開発の参入障壁を下げた点にあります。

従来、推論ベースの自動運転AIを開発するには、大規模なデータ収集、モデル設計、シミュレーション環境の構築まですべて自前で行う必要がありました。Alpamayoファミリーを利用すれば、これらの基盤を「土台」として活用しつつ、自社のユースケースに合わせたカスタマイズに集中できます。

JLRの製品エンジニアリング担当エグゼクティブディレクターであるThomas Müller氏は、「Alpamayoのようなモデルがオープンソース化されることで、自動運転エコシステム全体のイノベーションが加速する」とNVIDIAのプレスリリースでコメントしています。

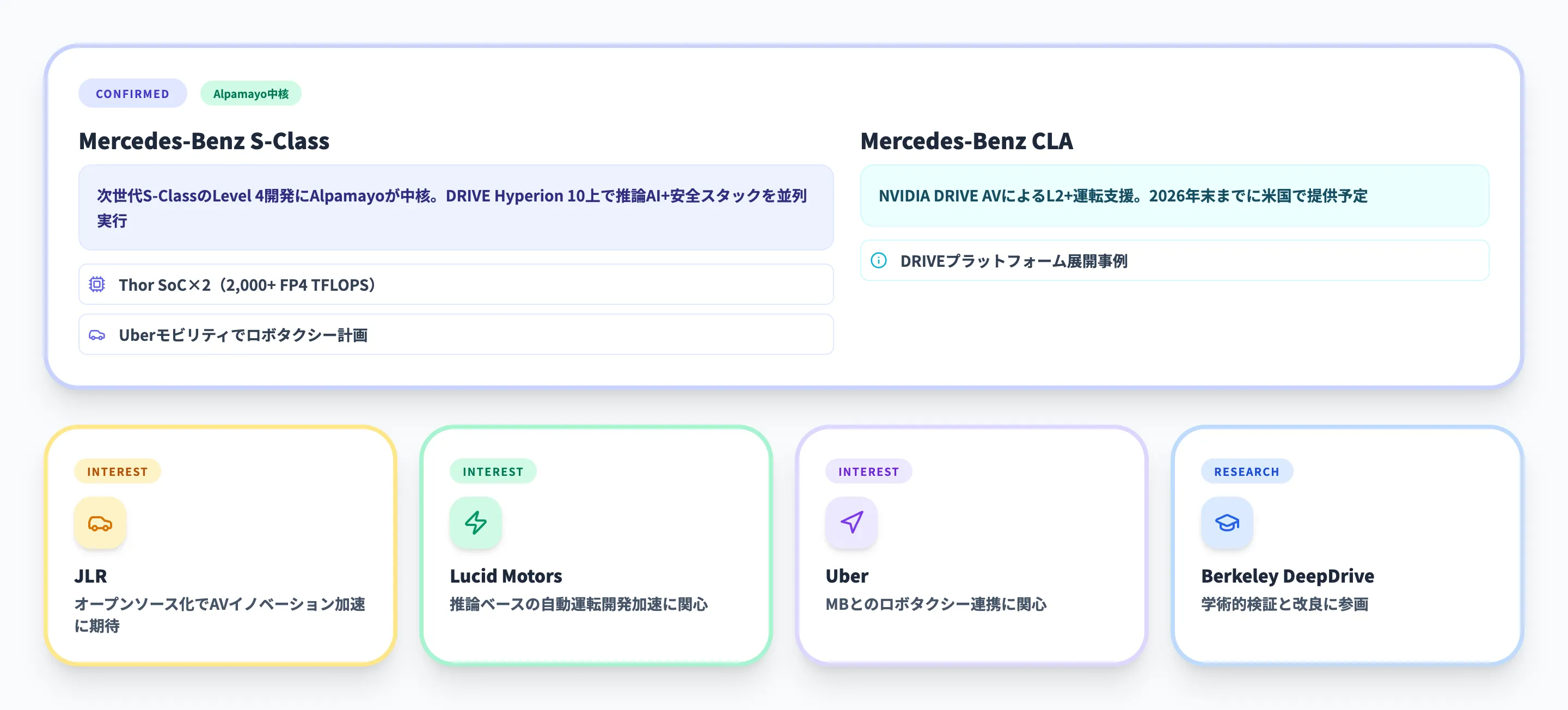

NVIDIA Alpamayoに関連する企業動向

Alpamayoの発表以降、自動車業界の大手企業が関心を示しています。ここでは、2026年3月時点で公式に確認できる動向を紹介します。

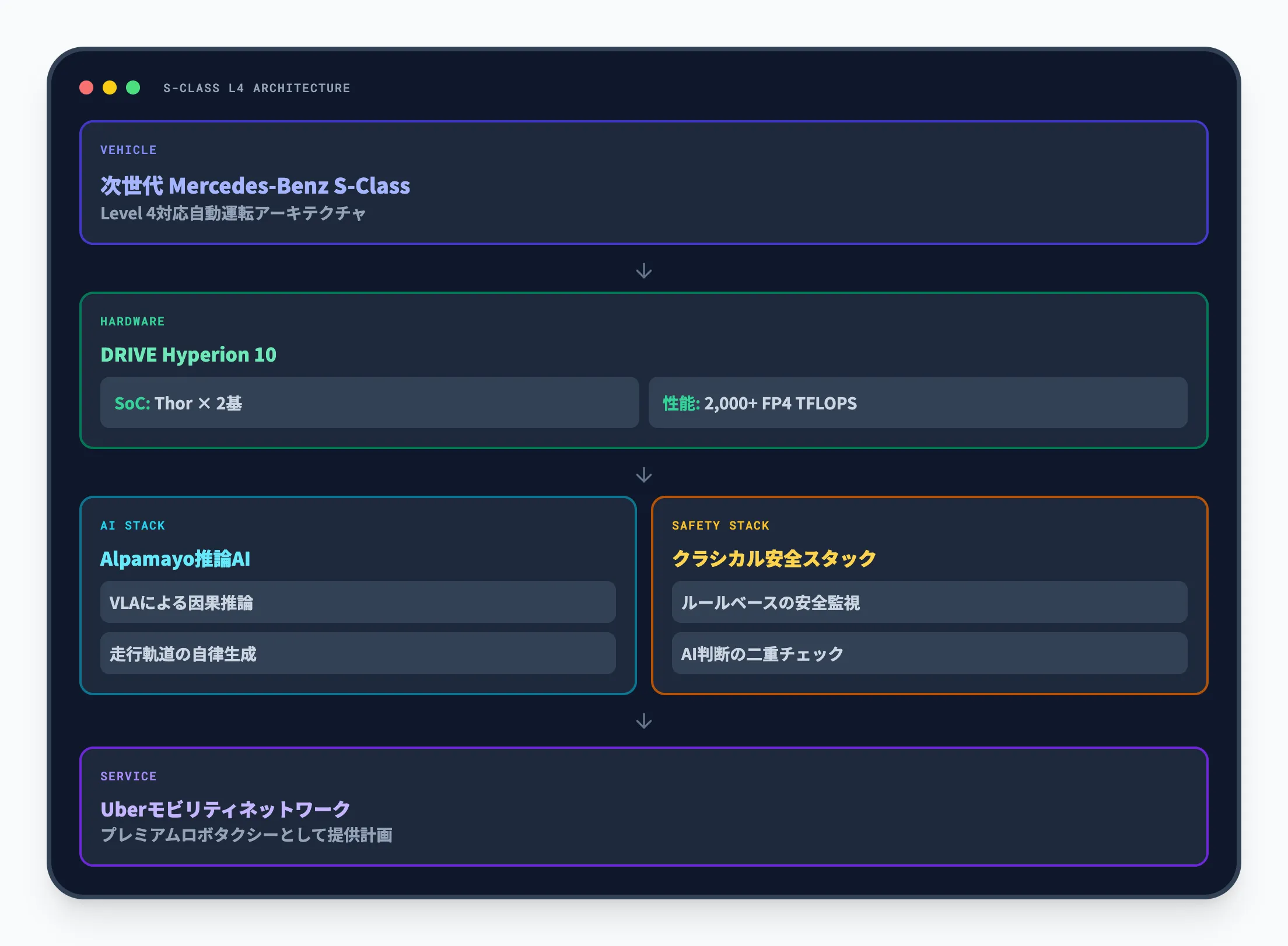

Mercedes-Benz S-Class(Level 4開発)

2026年1月29日、次世代S-ClassがNVIDIA DRIVE AV上にLevel 4対応アーキテクチャで構築されることがNVIDIAの公式ブログで発表されました。同ブログでは「At the core of this work is NVIDIA Alpamayo」と明記されており、Alpamayoの推論型AIがS-Classの自動運転開発の中核に位置づけられています。

このS-Classは、DRIVE Hyperion 10リファレンスアーキテクチャ(Thor SoC×2基、2,000 FP4 TFLOPS以上)上で、推論型AIとクラシカルな安全スタック(ルールベースの安全監視)を並列実行する構成です。Mercedes-BenzとNVIDIAは、この車両をUberのモビリティネットワークを通じてプレミアムロボタクシーとして提供する計画も発表しています。

なお、Mercedes-Benz CLAについては、NVIDIA DRIVE AVソフトウェアによるLevel 2+の運転支援を2026年末までに米国で提供予定と発表されています。CLAはAlpamayoの直接的な搭載事例というよりも、NVIDIA DRIVE AVプラットフォーム全体の量産展開事例として位置づけられています。

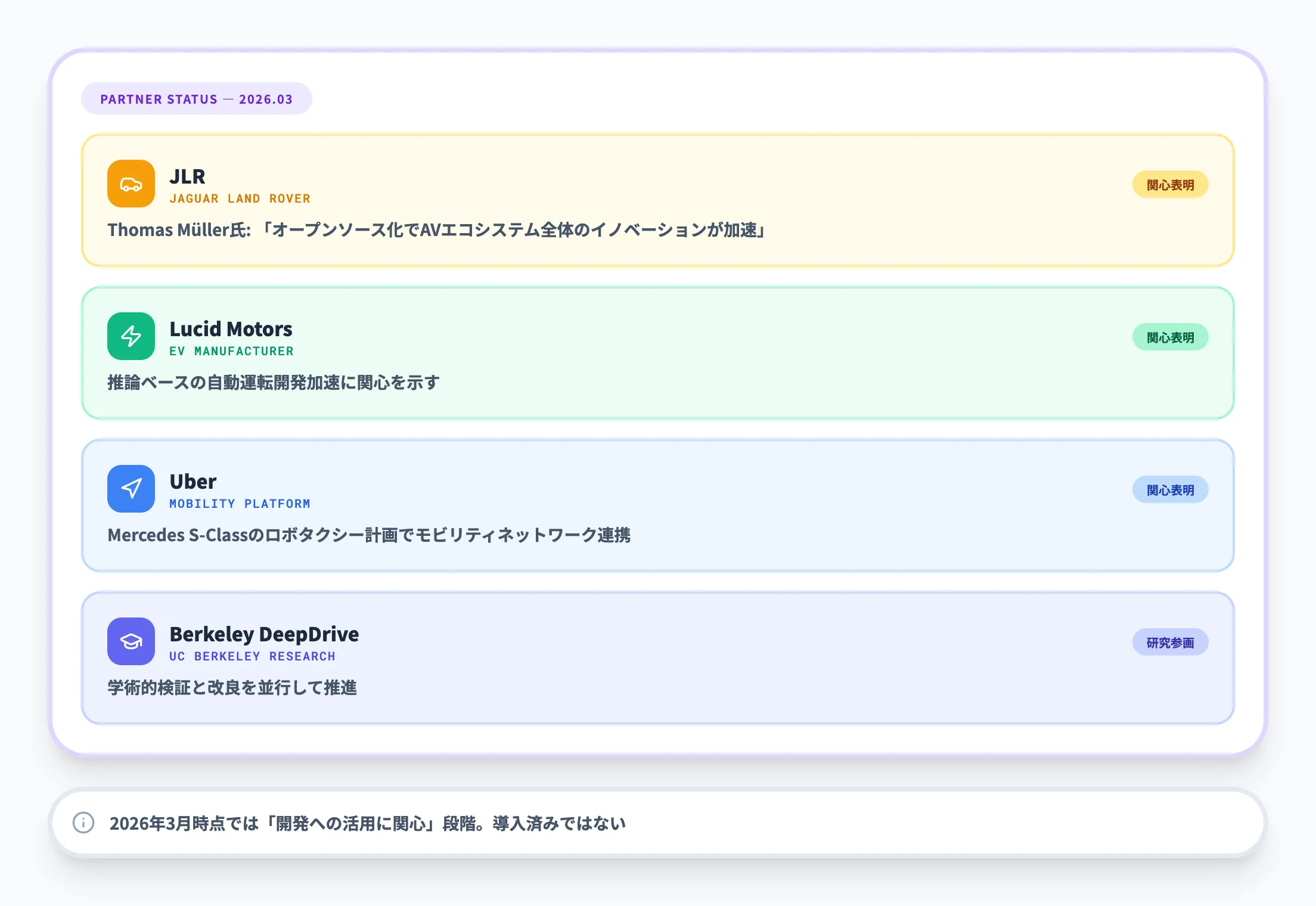

JLR / Lucid Motors / Uber / Berkeley DeepDrive

NVIDIAのプレスリリース(2026年1月5日)では、JLR(ジャガー・ランドローバー)、Lucid Motors、Uberが推論ベースの自動運転開発を加速するうえでAlpamayoに関心を示していると記載されています。

JLRの製品エンジニアリング担当エグゼクティブディレクターThomas Müller氏は同リリースの中で、「Alpamayoのようなモデルがオープンソース化されることで、自動運転エコシステム全体のイノベーションが加速する」とコメントしています。研究機関としてはUC BerkeleyのBerkeley DeepDriveが参画しており、学術的な検証と改良も並行して進められています。

これらの企業は2026年3月時点では「Alpamayoを導入済み」ではなく「開発への活用に関心を示している」段階です。オープンソースであることが、各社が自社の安全基準や車両プラットフォームに合わせて評価・カスタマイズしやすい環境を作っています。

NVIDIA Alpamayoの始め方(開発者向け)

Alpamayoはオープンソースで公開されており、研究者や自動運転開発者が自分の環境で試すことができます。ここでは、2026年3月時点の導入方法と必要な環境を整理します。

ハードウェア要件

Alpamayo 1の推論を実行するには、GPUが必要です。以下はHugging Faceのモデルカードに記載されている動作確認済みの環境です。

| 項目 | 要件 |

|---|---|

| GPU VRAM | 24GB以上 |

| 動作確認済みGPU | NVIDIA RTX 3090 / RTX 3090 Ti / RTX 4090 / A5000 |

| テスト環境 | NVIDIA H100 |

| OS | Linux(公式テスト済み) |

| CUDA | 対応バージョン必須 |

24GB VRAMは、10.5Bパラメータのモデルをロードするために必要な最低ラインです。RTX 4090(24GB)が個人開発者にとって現実的な選択肢になりますが、バッチ処理や並列推論を行う場合はA100やH100が推奨されます。

モデルの入手とセットアップ

Alpamayo 1はHugging Faceのゲートリポジトリで公開されており、アクセス申請を行ったうえでダウンロードします。推論コードはGitHubのNVlabsリポジトリで公開されています。

セットアップの基本的な流れは以下のとおりです。

- Hugging FaceでAlpamayo-R1-10Bのアクセスをリクエストする

- GitHub(NVlabs/alpamayo)から推論コードをクローンする

- Pythonの仮想環境を作成し、依存ライブラリをインストールする(PyTorch 2.8以上、Transformers 4.57.1以上、DeepSpeed 0.17.4以上)

- Jupyter Notebookで推論デモを実行し、動作を確認する

モデルの学術論文はarXiv(2511.00088)で公開されています。アーキテクチャの詳細やトレーニング手法を理解したい場合は、論文とあわせて確認するとよいでしょう。

AlpaSimでのシミュレーション

モデルの動作を確認したら、AlpaSimを使ったクローズドループ評価に進みます。AlpaSimのGitHubリポジトリには、セットアップ手順とサンプルシナリオが用意されています。

AlpaSimでは、約900本の再構成済みシーン上で走行ポリシーをテストでき、DrivingScoreという指標でクローズドループ性能を評価できます。Alpamayo 1のベンチマークでは、AlpaSim Score 0.72、オープンループ評価(minADE_6、6.4秒時点)で0.85mという結果が報告されています。

開発者は自身のドライビングモデルやレンダリングモデルをプラグインして、Alpamayo 1との直接比較も可能です。

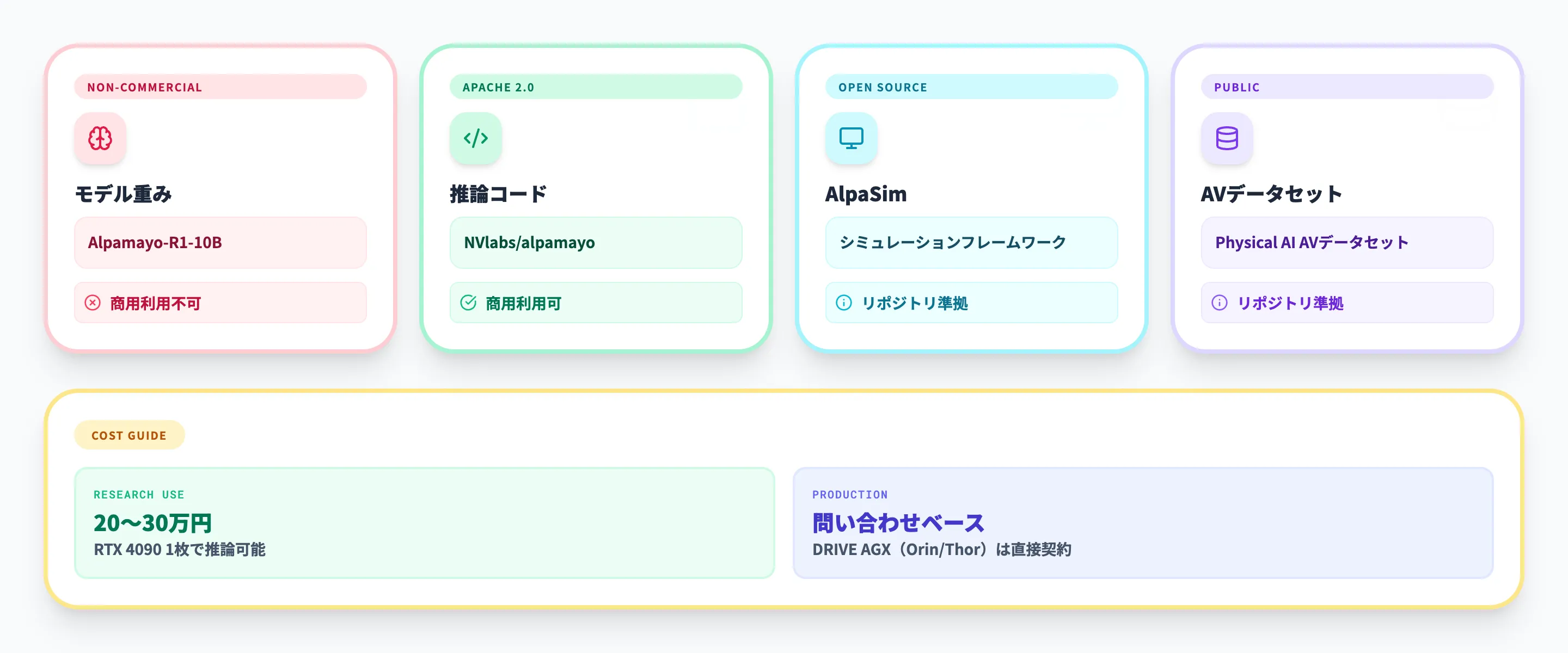

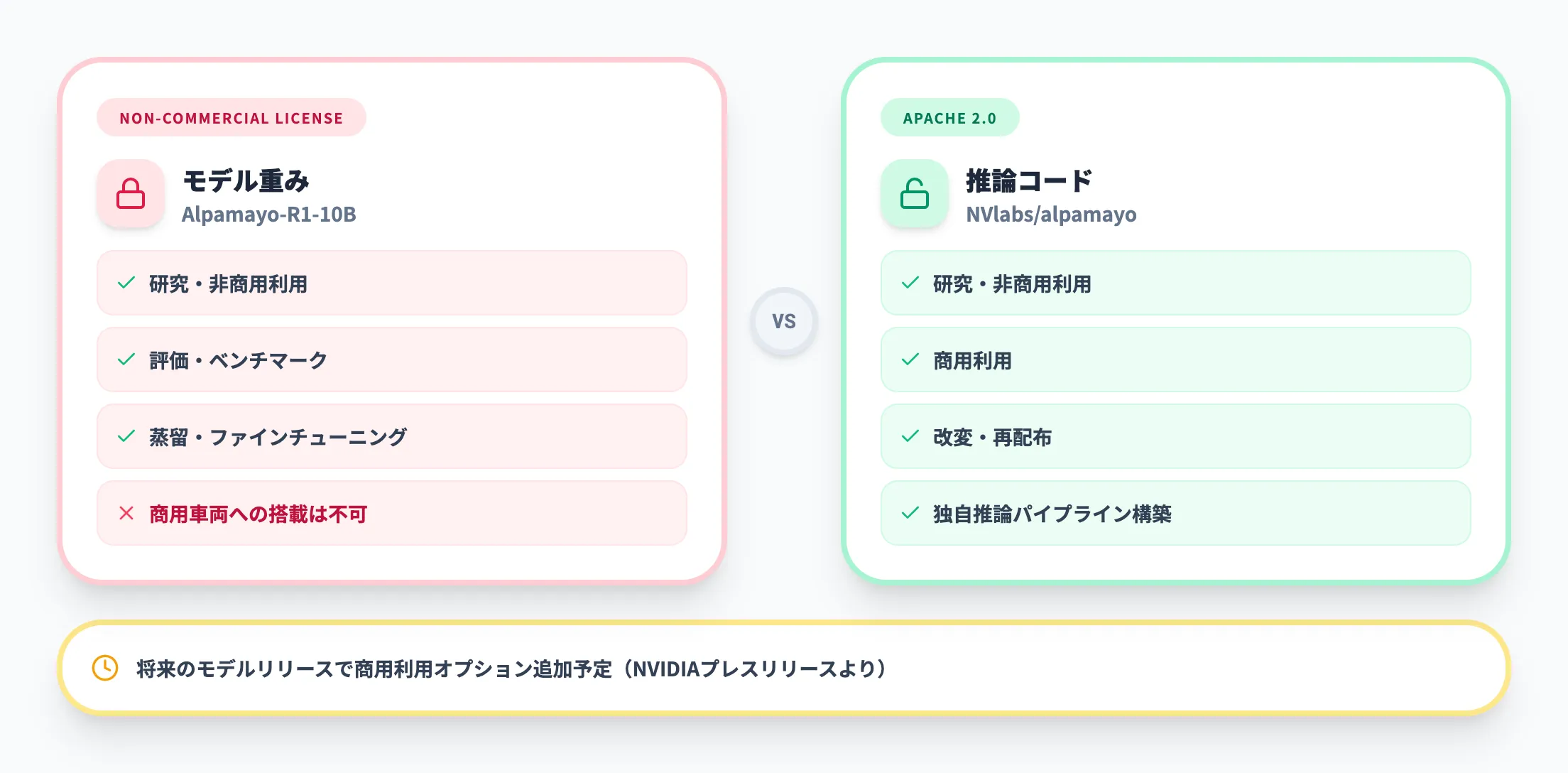

NVIDIA Alpamayoのライセンスと料金

Alpamayoの導入を検討するうえで、ライセンス条件とコスト構造を整理しておくことが重要です。

ライセンス体系

Alpamayoファミリーのライセンスは、コンポーネントによって異なります。

| コンポーネント | ライセンス | 商用利用 |

|---|---|---|

| Alpamayo 1 モデル重み | 非商用ライセンス | 不可(2026年3月時点) |

| 推論コード(GitHub) | Apache 2.0 | 可 |

| AlpaSim | オープンソース | リポジトリの各ライセンスに準拠 |

| Physical AI AVデータセット | 公開ライセンス | リポジトリの各ライセンスに準拠 |

現時点で最も重要な制約は、Alpamayo 1のモデル重みが非商用ライセンスである点です。研究開発や評価目的での利用は可能ですが、そのまま商用の自動運転車両に搭載することはできません。

NVIDIAはプレスリリースの中で、今後のモデルではパラメータ数の拡大や入出力の柔軟性向上とともに商用利用オプションを提供する予定であると述べています。

NVIDIA DRIVEプラットフォームのコスト

Alpamayoを実車に搭載するには、NVIDIA DRIVEプラットフォームのハードウェアが必要です。車載コンピュータとして以下の選択肢があります。

-

DRIVE AGX Orin

現行世代の車載AIコンピュータです。量産車への搭載が進んでおり、NVIDIA DRIVE AVの展開車両で使われる車載計算基盤です。

-

DRIVE AGX Thor

次世代の車載AIコンピュータです。DRIVE Hyperion 10リファレンスアーキテクチャではThor SoC×2基で2,000 FP4 TFLOPS以上の演算性能を提供し、Alpamayoの推論型AIとクラシカルな安全スタックの並列実行に対応します。

DRIVE AGXの具体的な価格はNVIDIAから一般向けには公開されておらず、自動車メーカー向けの直接契約ベースです。開発キット(DRIVE AGX Orin Developer Kit)は開発者向けに提供されていますが、価格は問い合わせベースとなっています。

研究目的でAlpamayo 1の推論のみを試す場合は、RTX 4090(市場価格で20万〜30万円程度)1枚あれば十分です。

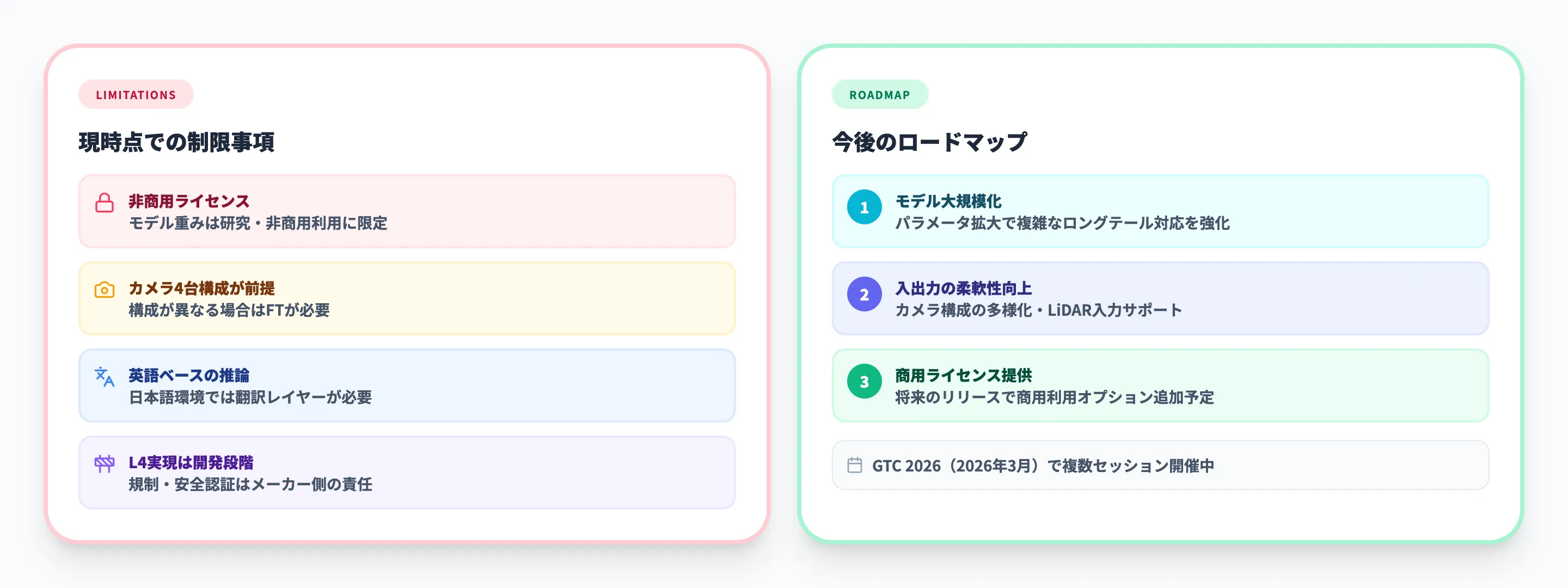

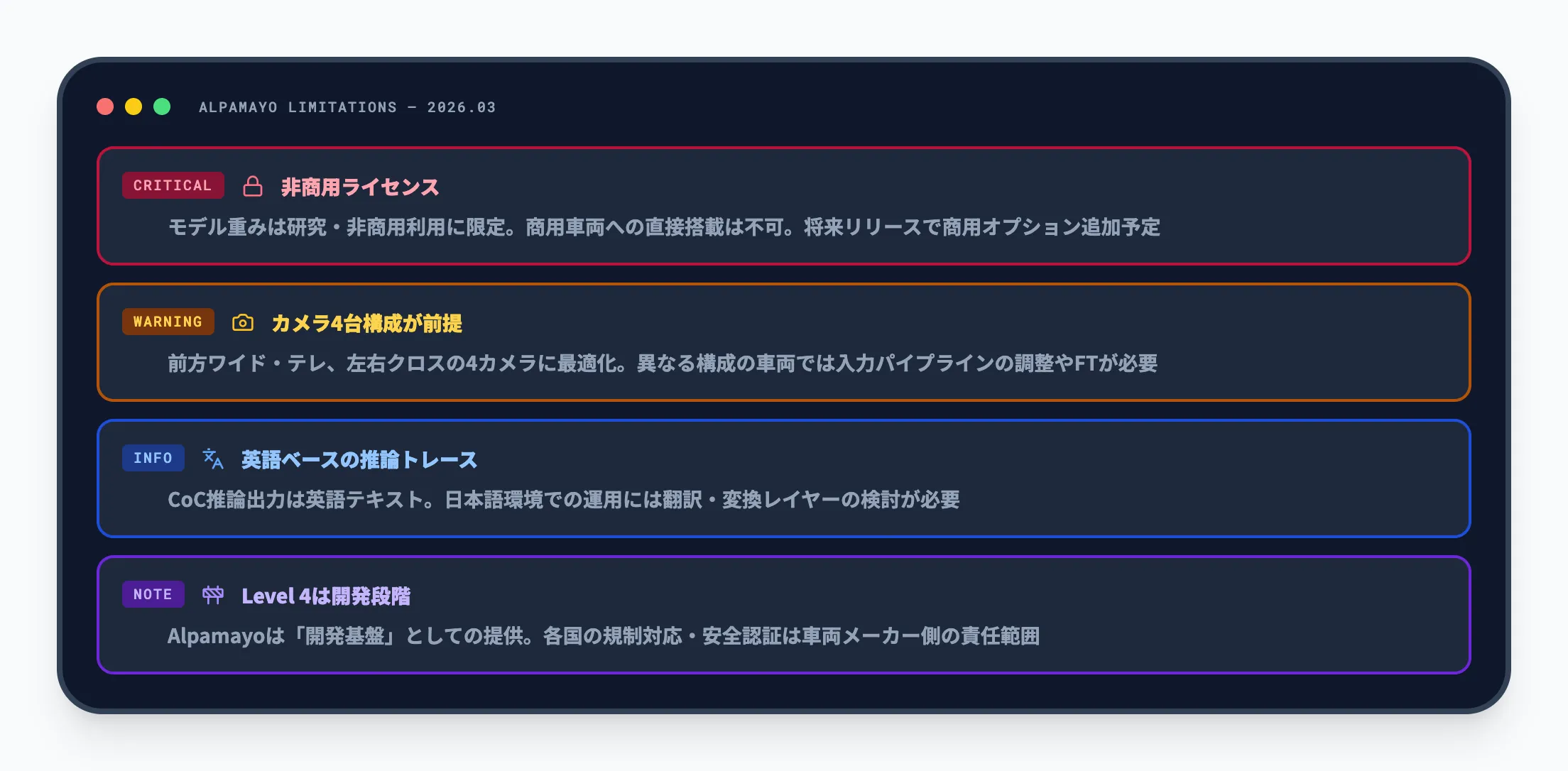

NVIDIA Alpamayoの注意点と今後の展望

Alpamayoは画期的な技術基盤ですが、2026年3月時点でいくつかの制限事項があります。導入を検討する際には、現時点の制約と今後の見通しを把握しておくことが重要です。

現時点での制限事項

主な注意点を以下にまとめます。

-

モデル重みが非商用ライセンス

前述のとおり、Alpamayo 1のモデル重みは研究・非商用利用に限定されています。商用利用は現時点ではできません。

-

カメラ4台構成が前提

Alpamayo 1の入力仕様はフロントワイド・フロントテレ・左クロス・右クロスの4カメラ構成に最適化されています。カメラ構成が異なる車両で使用するには、入力パイプラインの調整やファインチューニングが必要になります。

-

英語ベースの推論トレース

Chain-of-Causation推論の出力は英語テキストです。日本語環境での運用を想定する場合、推論結果の翻訳・変換レイヤーを検討する必要があります。

-

Level 4の完全な実現はまだ先

Alpamayoが目指すLevel 4自動運転は、あくまで「開発基盤」としての提供です。各国の規制対応や安全認証の取得は、車両メーカー側の責任範囲です。

今後のロードマップ

NVIDIAはAlpamayoファミリーの発展について、以下の方針を示しています。

-

モデルの大規模化

次世代モデルではパラメータ数を拡大し、より複雑なロングテールシナリオへの対応力を強化する予定です。

-

入出力の柔軟性向上

カメラ構成の多様化やLiDAR入力のサポートなど、より幅広い車両プラットフォームに対応するための拡張が計画されています。

-

商用ライセンスの提供

将来のモデルリリースでは、商用利用が可能なライセンスオプションが追加される見込みです。

2026年3月のGTC 2026では、Alpamayoに関する複数のカンファレンスセッションが開催されており、シミュレーション手法の改良やパートナー企業の進捗報告が行われています。

NVIDIAのフィジカルAI戦略の中では、自動運転のAlpamayo、ロボティクスのGR00T、エッジAIのJetsonが三本柱となっています。Alpamayoで培われた推論型VLAの技術は、ロボティクスやドローンなど他のフィジカルAI領域への応用も期待されています。

推論型AIの進化を業務全体のAI自動化に活かすなら

Alpamayoが示す「判断の根拠を言語化できるAI」は、自動運転に限らず、承認判断や品質検査など人間の判断が必要だった業務領域にもAI導入の道を開きます。

推論型AIの技術進化を背景に、「AIに判断まで任せる」業務自動化の設計が現実的になっています。AI総合研究所のガイドでは、こうした業務プロセスへのAI導入を段階的に進める方法を解説しています。

AI総合研究所のガイドで、判断を伴う業務のAI化をどう設計するかご確認ください。

自動運転AI基盤の動向を業務プロセスのAI化に結びつける

推論型AIの進化を業務自動化に活かす

Alpamayoのような推論型AIの進展は、判断を伴う業務へのAI導入可能性を広げています。ガイドでは業務自動化の設計から実装までを解説しています。

まとめ

NVIDIA Alpamayoは、推論型VLAモデル「Alpamayo 1」、シミュレータ「AlpaSim」、大規模走行データセットの3要素で構成された自動運転向けオープンソースAI基盤です。Chain-of-Causation推論によって「なぜそう判断したか」を言語で説明できる点が、従来のブラックボックス型自動運転AIとの最大の違いです。

Mercedes-BenzのS-Class Level 4開発でAlpamayoが中核に位置づけられ、JLR、Lucid Motors、Uberも開発への活用に関心を示すなど、自動運転AIの開発基盤として急速に存在感を高めています。モデル重みの非商用ライセンスという制約はあるものの、推論コードやシミュレータはオープンに利用でき、研究・開発目的であれば24GB VRAM以上のGPUがあれば試すことができます。

自動運転AIの開発を検討している企業や研究者にとって、Alpamayoは「ゼロからすべてを構築する」負担を大きく軽減する選択肢になるでしょう。まずはHugging Faceでモデルを入手し、AlpaSimで自社のユースケースに合うかを検証するところから始めてみてください。