この記事のポイント

ヒューマノイドロボットの基盤モデルを選定するなら、視覚・言語・行動を統合したVLAアーキテクチャを持つGR00Tが現時点で最有力候補

N1.6のSystem 1+System 2二重構成は高速動作と推論を両立しており、単一モデルでは実現困難な複雑タスクへの対応力が強み

訓練データ不足の課題にはGR00T Blueprint(Mimic/Gen/Dreams)が有効で、合成データと実データの組み合わせで性能40%向上が実証済み

GXO倉庫でのDigit商用導入が示すとおり、物流・製造領域の自律作業から導入を始めるのが現実的なファーストステップ

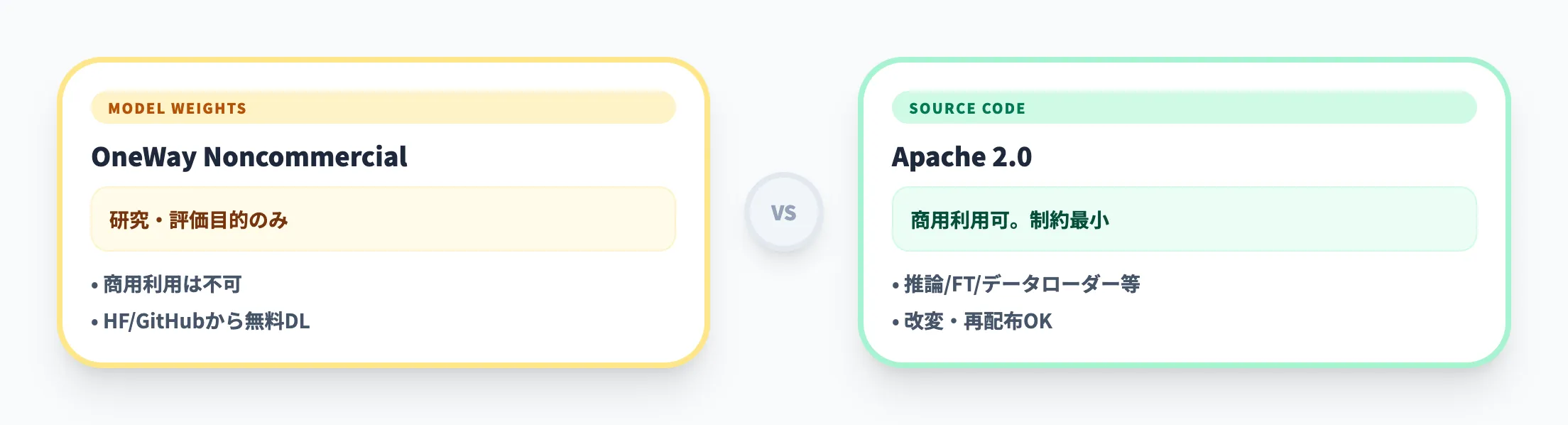

研究・評価目的ならNoncommercialライセンスで無料利用可能だが、商用化にはNVIDIAとの個別契約が必要な点に注意すべき

Microsoft MVP・AIパートナー。LinkX Japan株式会社 代表取締役。東京工業大学大学院にて自然言語処理・金融工学を研究。NHK放送技術研究所でAI・ブロックチェーンの研究開発に従事し、国際学会・ジャーナルでの発表多数。経営情報学会 優秀賞受賞。シンガポールでWeb3企業を創業後、現在は企業向けAI導入・DX推進を支援。

「ロボットの動作訓練に膨大なデータと時間がかかる」「合成データで効率化したいが何から始めればいいかわからない」

NVIDIA GR00T(Generalist Robot 00 Technology)は、こうした課題を解決するために設計された世界初のオープンなヒューマノイドロボット基盤モデルです。

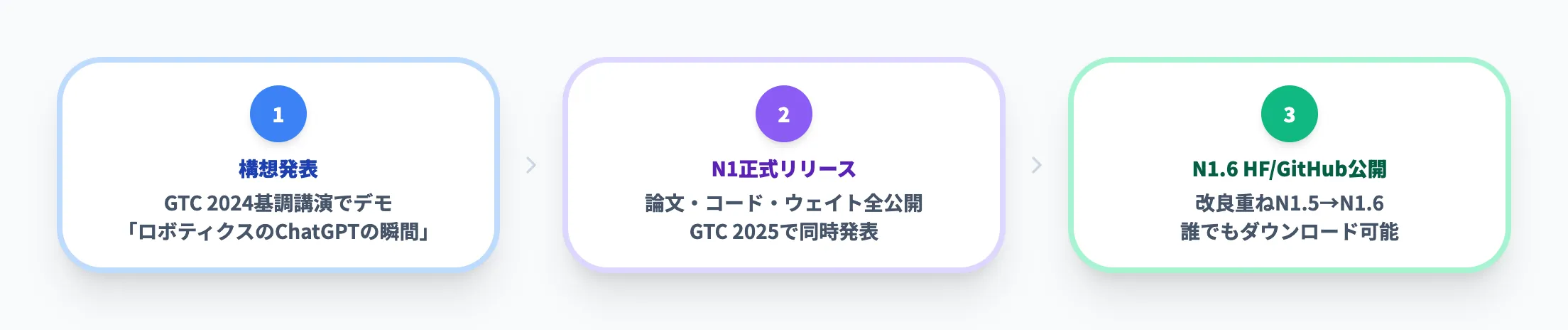

2024年3月のGTC 2024でProject GR00Tとして構想が発表され、2025年3月にN1、同年9月にN1.5/N1.6と急速に進化。Cosmos Reason 2Bを推論エンジンに採用した二重システムアーキテクチャで、視覚・言語・行動を統合的に扱います。

本記事では、GR00T N1.6の技術アーキテクチャ、Blueprint(Mimic/Gen/Dreams)の活用方法、Cosmos・Isaac Simとの連携、1X・Agility等の導入事例、ライセンス・始め方まで網羅的に解説します。

目次

NVIDIA GR00Tの進化(Project GR00T→N1→N1.5→N1.6)

NVIDIA GR00T Blueprintの3つのワークフロー

NVIDIA GR00Tとは?ロボット基盤モデルの全体像

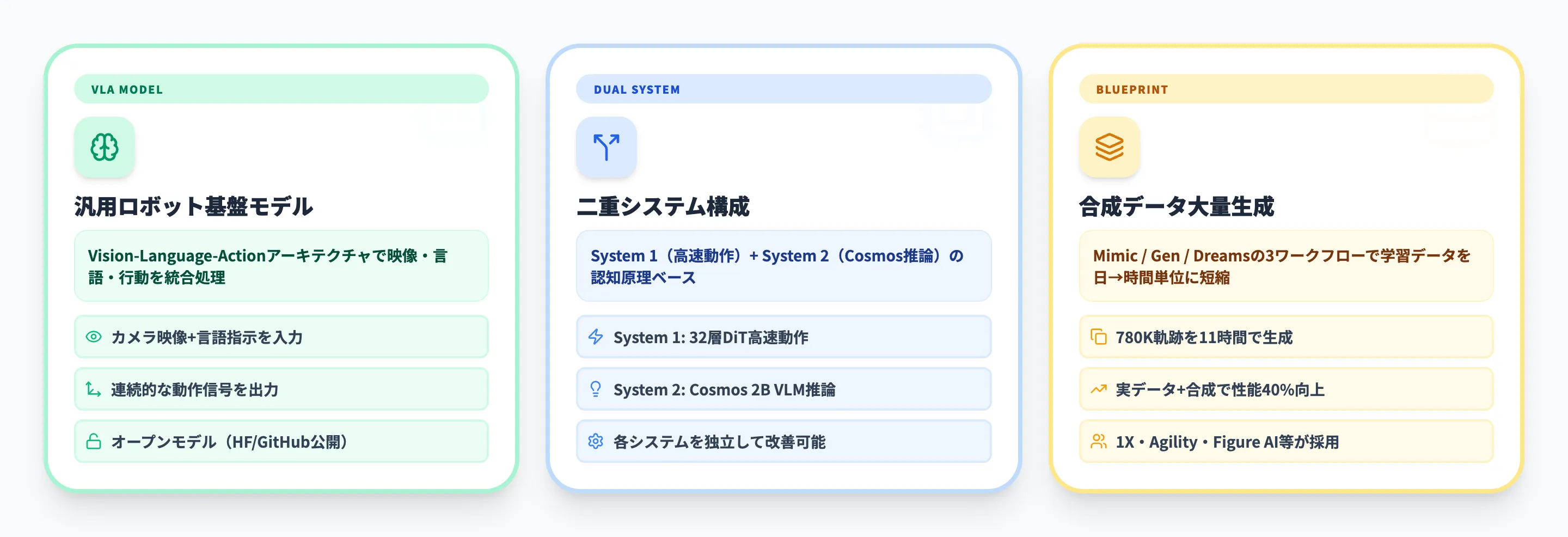

NVIDIA GR00T(Generalist Robot 00 Technology)は、ヒューマノイドロボット向けに設計された世界初のオープンな汎用ロボット基盤モデルです。

カメラ映像と言語指示を入力として受け取り、ロボットの連続的な動作(関節角度やグリッパー制御など)を出力するVLA(Vision-Language-Action)モデルとして設計されています。

ロボットの動作訓練には、従来「人間がお手本を見せる→記録する→大量に繰り返す」というプロセスが必要で、1つの動作パターンを追加するだけでも数日かかることが珍しくありませんでした。GR00Tは、この学習プロセスを根本から効率化するために生まれたプラットフォームです。

Isaacエコシステムにおける位置づけ

GR00TはNVIDIAのIsaacロボティクスプラットフォームの一部として位置づけられており、NVIDIA Cosmos(世界基盤モデル)やIsaac Sim(ロボットシミュレータ)、Omniverse(3Dシミュレーション基盤)と連携して動作します。

GR00Tが「ロボットの頭脳」、Cosmosが「世界の理解」、Isaac Simが「訓練場」という役割分担です。

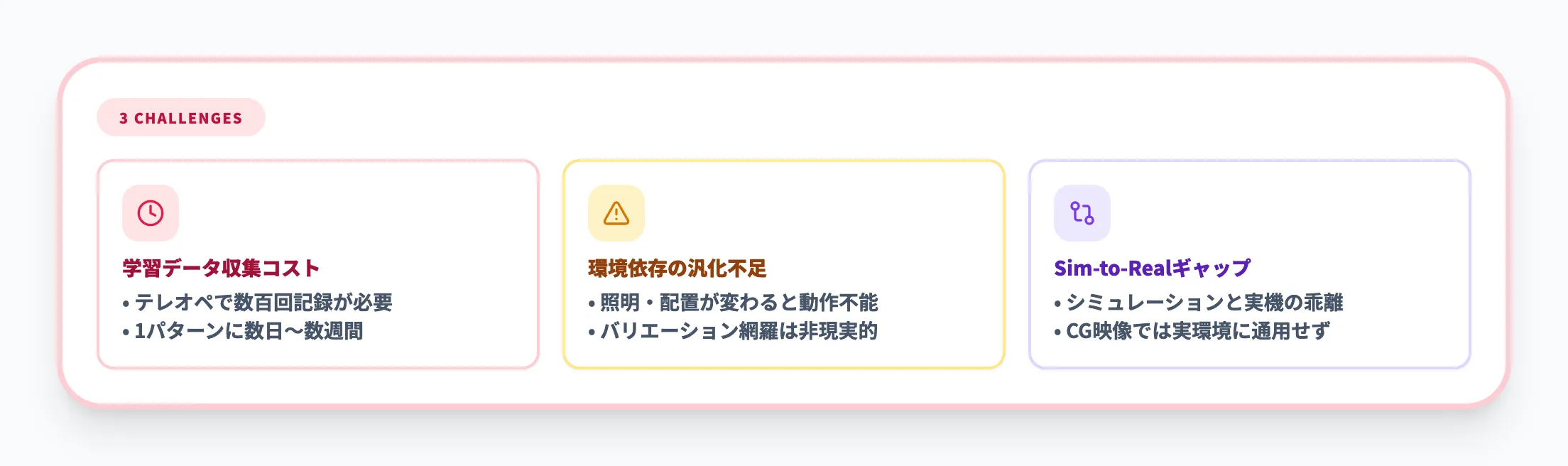

GR00Tが解決する課題

ロボット開発の現場では、以下の課題が長年のボトルネックになっています。

-

学習データの収集コスト

ロボットに新しい動作を教えるには、人間がテレオペレーション(遠隔操作)でお手本を何百回も記録する必要がある。1つの動作パターンあたり数日〜数週間を要する

-

環境依存の汎化不足

特定の環境(照明・物体配置・背景)で訓練したモデルが、少し条件が変わるだけで動かなくなる。実環境のバリエーションを網羅するのは非現実的

-

sim-to-realギャップ

シミュレーションで訓練したモデルが実機では通用しない。仮想環境と現実環境の見た目や物理特性の差が原因

GR00Tは、大規模な事前学習済みモデルをベースに、少量のデータでファインチューニングする方式を採用することで、これらの課題を大幅に軽減します。さらに、GR00T Blueprintの合成データ生成パイプラインを組み合わせることで、学習データの「量」と「多様性」の両方を効率的に確保できます。

NVIDIA GR00Tの進化(Project GR00T→N1→N1.5→N1.6)

GR00Tは2024年の構想発表から急速に進化しており、約1年半で実用レベルの基盤モデルに到達しています。以下の表にバージョンごとの進化を整理しました。

| 時期 | バージョン | 主な内容 |

|---|---|---|

| 2024年3月 GTC 2024 | Project GR00T | 構想発表。ヒューマノイドロボット向け基盤モデルの研究イニシアチブ。Jetson Thor(ロボット向けSoC)も同時発表 |

| 2025年3月 GTC 2025 | GR00T N1 | 世界初のオープン人型ロボット基盤モデル。二重システムアーキテクチャ採用。Blueprint + Isaac Simフレームワーク同時発表 |

| 2025年9月 | GR00T N1.5 / N1.6 | アーキテクチャ・データ・モデリングの全面改良。N1.6はN1.5を上回る操作性能を実機テストで達成 |

| 2026年1月 CES 2026 | N1.6展開拡大 | Cosmos Reason 2連携、新パートナー発表。グローバルパートナーが次世代ロボットを公開 |

注目すべきは、N1(2025年3月)からN1.6(2025年9月)までわずか半年で2世代の改良が行われている点です。

NVIDIAがロボット基盤モデルを最優先の研究領域と位置づけていることが、この開発ペースから読み取れます。

Project GR00Tから実用モデルへ

2024年3月のGTC 2024では、Project GR00Tはまだ「構想」の段階でした。ジェンスン・ファンCEOが基調講演でヒューマノイドロボットのデモを披露し、「ロボティクスのChatGPTの瞬間が来る」と宣言した時点では、具体的なモデルやAPIは公開されていませんでした。

それからちょうど1年後のGTC 2025で、GR00T N1がオープンかつカスタマイズ可能な基盤モデルとして正式リリースされました。

その後N1.5・N1.6と改良が重ねられ、現在は最新のN1.6がHugging FaceとGitHubからダウンロードできる形で提供されています。

NVIDIA GR00T N1.6の技術アーキテクチャ

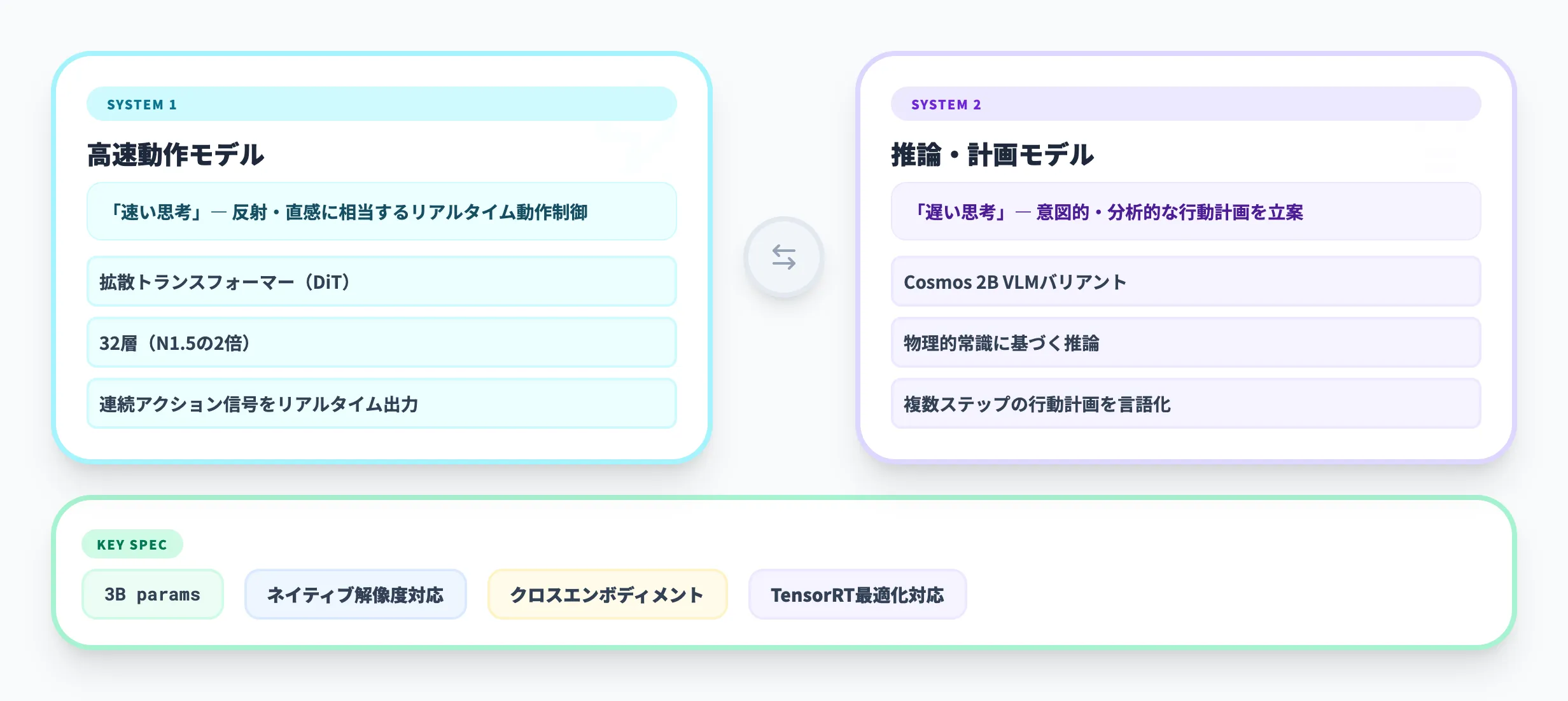

GR00T N1.6の最大の技術的特徴は、人間の認知原理に触発された二重システムアーキテクチャです。「速い思考」と「遅い思考」を分離することで、リアルタイムの動作制御と高度な状況判断を両立させています。

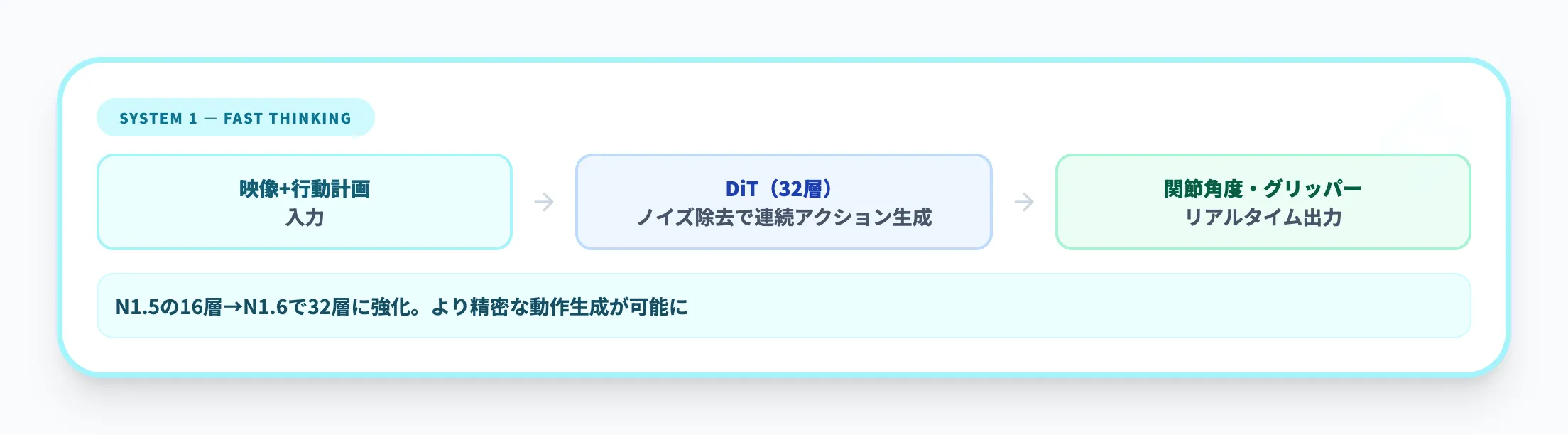

System 1(高速動作モデル)

System 1は、人間の反射や直感に相当する「速い思考」を担当します。カメラ映像と行動計画を入力として受け取り、ロボットの関節角度やグリッパー制御などの連続的なアクション信号をリアルタイムで出力します。

技術的には、拡散トランスフォーマー(Diffusion Transformer = DiT)ヘッドがノイズ除去を行いながら連続アクションを生成する仕組みです。N1.6ではDiTが32層(N1.5の16層から2倍)に強化され、より精密な動作生成が可能になっています。

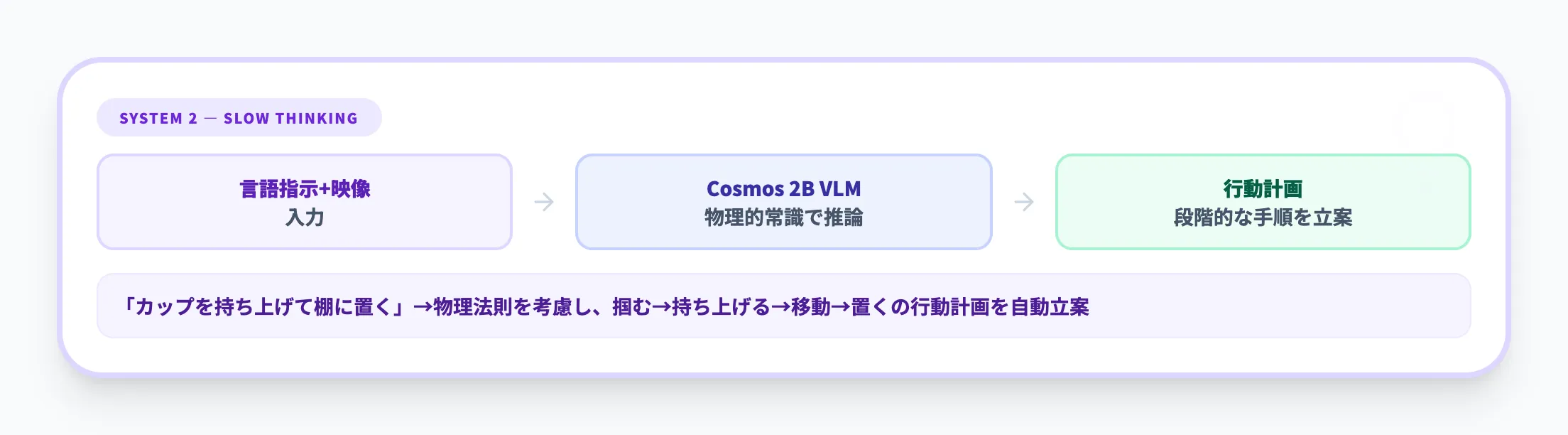

System 2(推論・計画モデル)

System 2は、人間の意図的・分析的な思考に相当する「遅い思考」を担当します。視覚言語モデル(VLM)が環境の状況を観察し、言語指示を解釈して、段階的な行動計画を立案します。

N1.6では、System 2にNVIDIA内製のCosmos 2B VLMバリアントを採用しています。物理的な常識を理解するVLMが推論エンジンとして機能することで、「テーブルの上のカップを持ち上げて棚に置く」といった複数ステップのタスクを、物理法則を考慮しながら計画できます。

主な仕様

以下にGR00T N1.6の主要な技術仕様を整理しました。

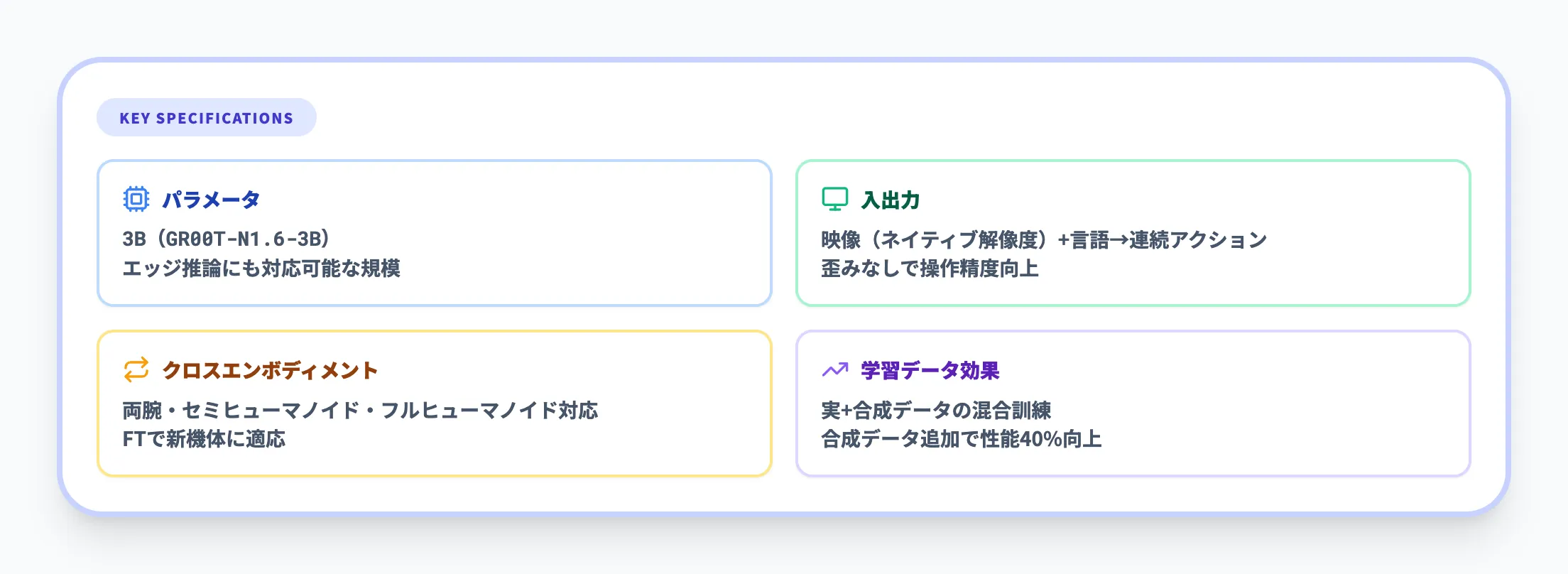

-

パラメータ数

3Bパラメータ(GR00T-N1.6-3B)。ロボット制御に特化したサイズで、エッジデバイスでの推論にも対応可能な規模

-

入出力

入力はカメラ映像(ネイティブ解像度対応)+ 自然言語指示。出力はロボットの連続アクション(関節角度・グリッパー制御等)。ネイティブ解像度対応により画像の歪みを排除し、N1.5比で操作精度が向上

-

クロスエンボディメント

特定のロボットに依存しない設計。両腕操作(bimanual)、セミヒューマノイド、フルヒューマノイドなど多様な機体形状に対応。ファインチューニングで新しい機体への適応が可能

-

学習データ

実キャプチャデータ + GR00T Blueprintによる合成データの混合で訓練。実データと合成データの組み合わせにより、実データのみと比較して性能が40%向上

-

推論の高速化

TensorRTによる推論最適化に対応。getting_startedフォルダにJupyter notebookが含まれており、セットアップから推論まで段階的に試せる

二重システムアーキテクチャの利点は、System 1とSystem 2を独立して改善できる点にもあります。推論能力を強化したいときはSystem 2のVLMだけを更新し、動作精度を上げたいときはSystem 1のDiTだけをファインチューニングする、という分離開発が可能です。

NVIDIA GR00T Blueprintの3つのワークフロー

GR00T Blueprint は、ヒューマノイドロボット向けの学習データを大量生成するためのフレームワークです。GTC 2025で発表され、Omniverse + Cosmos Transfer を組み合わせることで、学習データ生成を**「日単位→時間単位」**に短縮します。

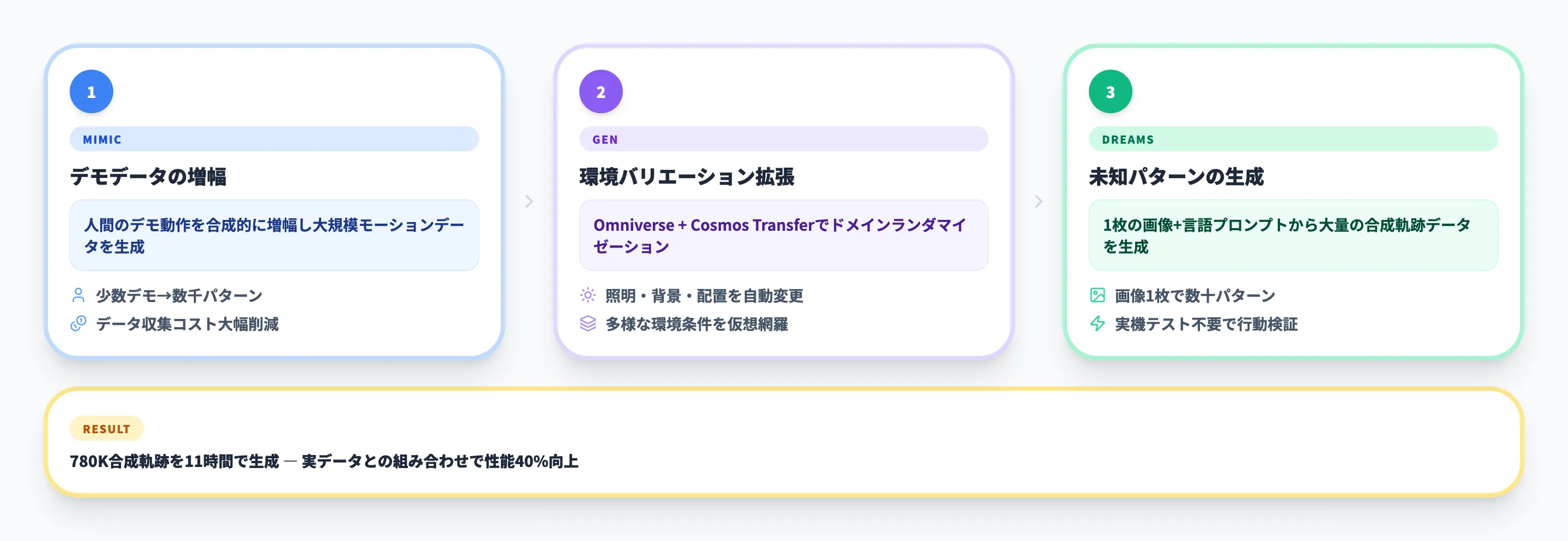

GR00T Blueprintには、目的に応じた3つのワークフローが含まれています。段階的に組み合わせることで、少量のお手本データから大規模な学習データセットを構築できます。

GR00T-Mimic(デモデータの増幅)

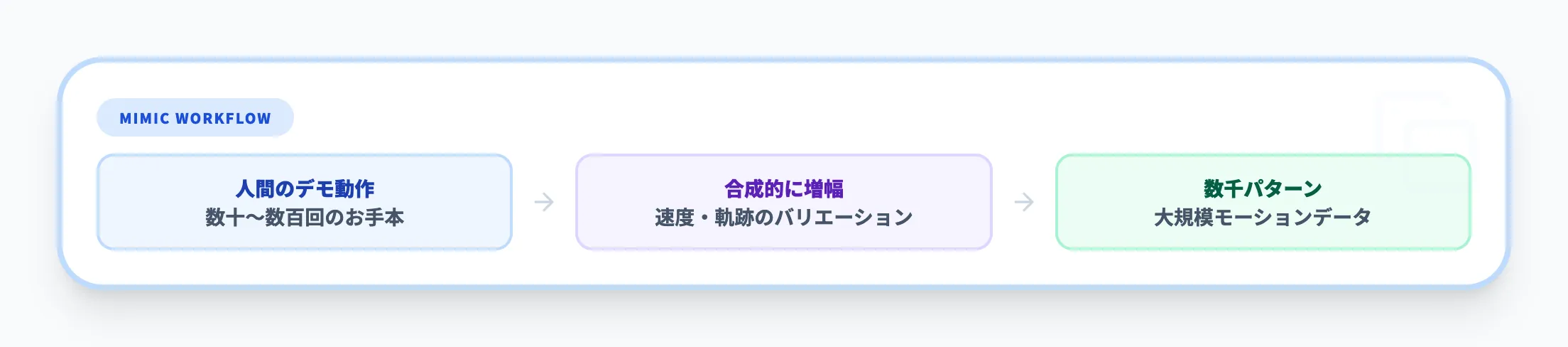

GR00T-Mimicは、人間のデモンストレーション動作をキャプチャし、そのデータを合成的に増幅して大規模なモーションデータセットを生成するワークフローです。

ロボットに「こう動いてほしい」というお手本を少量(数十〜数百回)用意するだけで、そこから数千パターンのバリエーションを自動生成できます。人間の身体的な動きのバリエーション(速度・軌跡のわずかな違い)を学習し、自然な動作の「幅」を持たせるのがMimicの役割です。

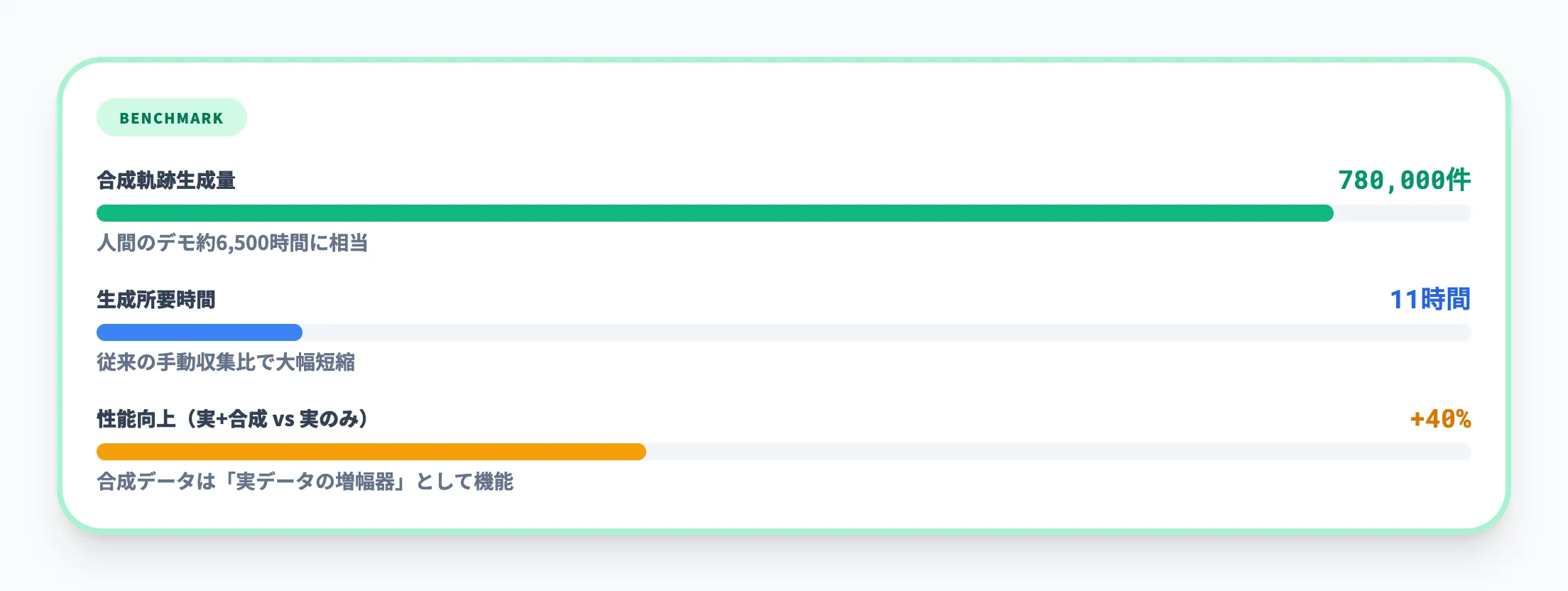

実績として、NVIDIAは780,000件の合成軌跡(人間のデモ約6,500時間に相当)をわずか11時間で生成しています。

GR00T-Gen(環境バリエーション拡張)

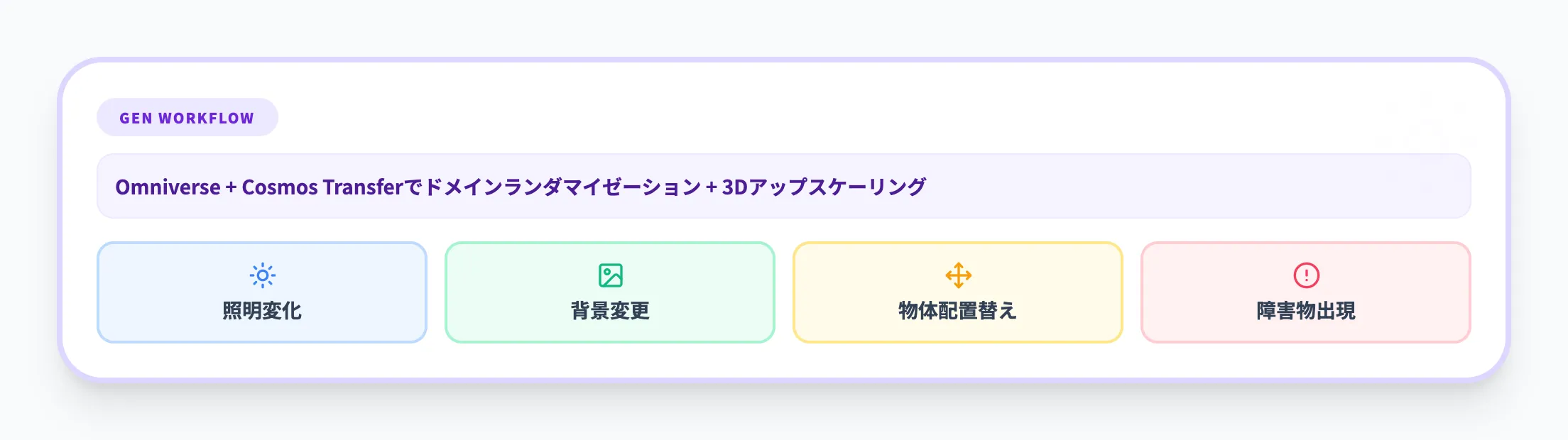

GR00T-Genは、OmniverseとCosmos Transferを組み合わせ、ドメインランダマイゼーション(環境条件のランダム変更)と3Dアップスケーリングでデータセットを拡張するワークフローです。

照明の変化、背景の違い、物体の配置替え、障害物の出現など、ロボットが実環境で遭遇する多様な状況を仮想的に網羅できます。同じ動作でも「明るいオフィス」「薄暗い倉庫」「散らかったキッチン」といった異なる環境で訓練することで、ロボットの汎化能力が飛躍的に向上します。

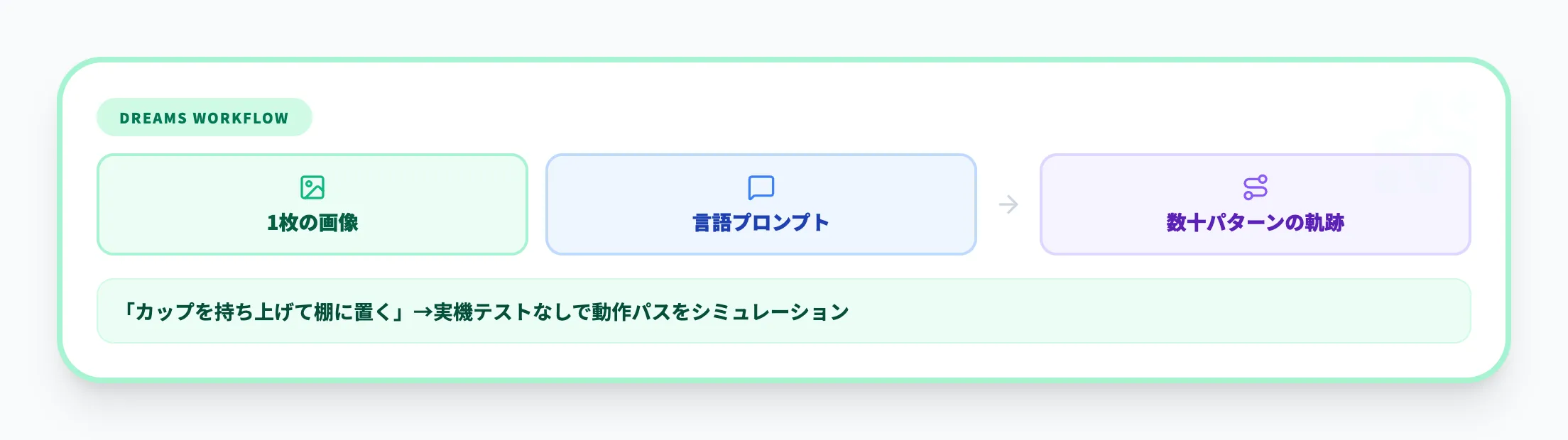

GR00T-Dreams(画像+テキストから軌跡生成)

GR00T-Dreamsは、Cosmosの生成能力を活用し、1枚の画像と言語プロンプトから大量の合成軌跡データを生成するワークフローです。

「ロボットがテーブルの上のカップを持ち上げて棚に置く」という指示と1枚の画像だけで、数十パターンの動作軌跡をシミュレーションできます。実機テストなしで行動計画を仮想的に検証でき、ロボットがまだ経験していない未知のシナリオにも対応パターンを事前に生成できます。

3ワークフローの使い分け

3つのワークフローは段階的に組み合わせるのが効果的です。

- まずMimicで「お手本データの増幅」を行い、基本的な動作バリエーションを確保する

- 次にGenで「環境バリエーションの拡張」を実施し、多様な条件での頑健性を獲得する

- 最後にDreamsで「未知の状況への対応パターン」を生成し、ロングテールのシナリオをカバーする

この段階的アプローチにより、少数の実デモから始めて、段階的に大規模で多様な学習データセットを構築できます。

ロボット基盤モデルの動向を業務プロセスのAI化に結びつける

AI業務自動化ガイド

GR00Tのようなロボット基盤モデルの進化は、AI技術の業務適用範囲が急速に広がっていることの表れです。自社業務にAIを段階的に導入するための実践ステップをガイドにまとめました。

NVIDIA Cosmos・Isaac Simとの連携

GR00Tは単体で動作するモデルではなく、NVIDIAのロボティクスエコシステム全体の中で機能するよう設計されています。ここでは、CosmosとIsaac Simとの関係を整理します。

Cosmos Reason 2BがSystem 2を駆動

GR00T N1.6のSystem 2(推論・計画モデル)は、NVIDIA内製のCosmos 2B VLMバリアントを採用しています。Cosmos Reasonは物理的な常識(重力、衝突、摩擦など)を理解するよう訓練されたVLMで、ロボットの行動計画に必要な「この物体を持ち上げるとどうなるか」「障害物を避けるにはどちらに動くべきか」といった物理的推論を支えています。

この連携により、GR00Tは単なるパターンマッチングではなく、物理法則を考慮した行動計画を立てることができます。

Isaac Sim + Omniverseとの統合フロー

Isaac Sim(ロボットシミュレータ)とOmniverse(3D物理シミュレーション基盤)は、GR00T Blueprintの合成データ生成パイプラインの基盤を担っています。

実用的なフローとしては、以下の4ステップで構成されます。

- Isaac Simでロボットのタスクを定義 センサーモデル・制御アルゴリズム・タスクのゴールをシミュレーション環境で設計する

- Omniverseで3D環境を構築 物理演算(重力・衝突・摩擦)を含むリアルな3Dシーンをレンダリングする

- Cosmos Transferでリアル映像に変換 CG映像をフォトリアリスティックな映像に変換し、sim-to-realギャップを低減する

- GR00Tでロボットの動作を学習 生成されたリアル品質のデータでモデルをファインチューニングする

Isaac Sim 5.0からはCosmosWriterがネイティブに組み込まれ、シミュレーションから直接、RGB・深度・セグメンテーション・エッジデータを同期出力できるようになりました。これにより、Isaac Simでの設計からCosmos Transferでの変換への接続がシームレスになっています。

ロボットの動作訓練に毎回数日かけている開発チームにとって、このパイプラインは反復速度を桁違いに変える可能性があります。まずはIsaac SimとGR00T Blueprintで合成データ生成の検証から始めるのが、最も手軽な第一歩です。

NVIDIA GR00Tの活用事例と導入パートナー

GR00Tは、世界の主要なヒューマノイドロボット企業がパートナーおよび早期アクセス企業として参加しています。NVIDIAの公式発表によると、1X Technologies、Agility Robotics、Apptronik、Boston Dynamics、Figure AI、Fourier Intelligence、Sanctuary AI、Unitree Robotics、XPENG Roboticsなどが名を連ねています。

以下の表に主要なパートナーと活用内容を整理しました。

| 企業 | ロボット | 活用内容 |

|---|---|---|

| 1X Technologies | NEO Gamma | GR00T N1をポストトレーニング。最小限のデータで家事作業(片付け・整理)を自律実行。CES 2026でライブデモ |

| Agility Robotics | Digit | 二足歩行ロボット。Amazonで試験導入後、GXOと業界初の複数年商用契約を締結。GR00Tの合成データで動作学習を加速 |

| Figure AI | — | GR00Tの早期アドプターとして人型ロボットの物理AI開発を推進 |

| Fourier Intelligence | GR-1 | GR00T N1で言語条件付き両腕操作のデモを実施。研究用プラットフォームとしてGR-1を活用 |

| Unitree Robotics | G1 | GR00T N1.6の実機テストに参加。N1.5を上回る操作性能を実証 |

特に注目すべきは、1X TechnologiesのNEO Gammaとの連携です。1XのCEOは「GR00T N1がロボットの推論とスキルに大幅な向上をもたらし、最小限のポストトレーニングデータでフルデプロイが可能になった」と述べています。これは、GR00Tの事前学習済みモデルの品質が十分に高く、少量のカスタムデータで実用レベルに到達できることを示しています。

合成データの実証効果

NVIDIAの実証では、GR00T Blueprintを使って780,000件の合成軌跡(人間のデモ約6,500時間に相当)をわずか11時間で生成し、合成データと実データを組み合わせた結果、実データのみの場合と比較して性能が40%向上しました。

この成果は、合成データが「実データの代替」ではなく「実データの増幅器」として機能することを裏付けています。少量の実データでも、合成データで環境バリエーションを大幅に拡張することで、ロボットの汎化能力を効率的に引き上げられるわけです。

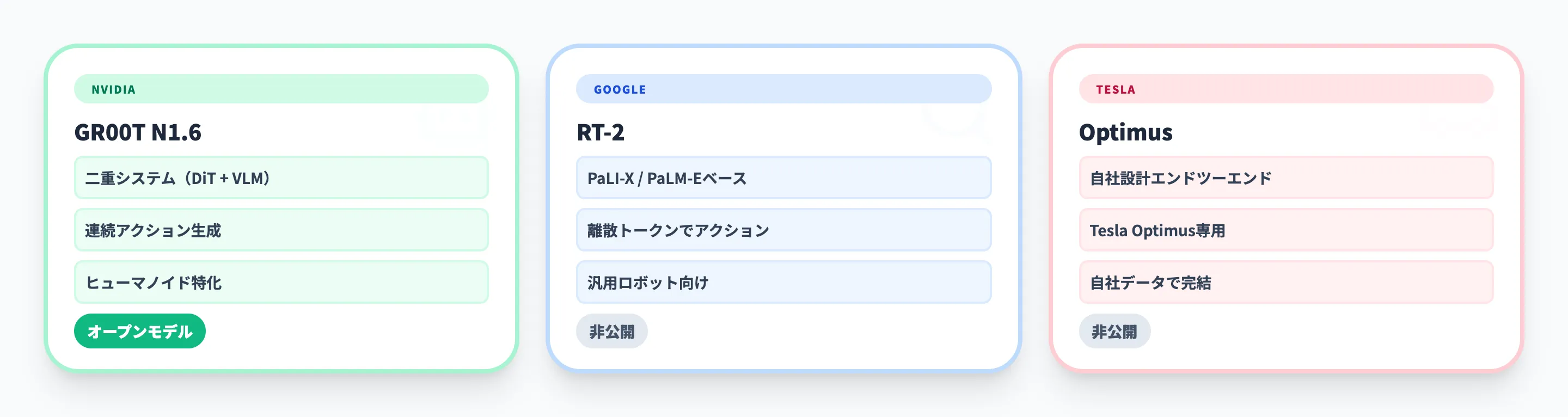

他のロボット基盤モデルとの比較

ロボット基盤モデルの分野は急速に競争が激化しています。ここでは、GR00Tを他の代表的なアプローチと比較します。

| 項目 | NVIDIA GR00T N1.6 | Google RT-2 | Tesla Optimus |

|---|---|---|---|

| 分類 | VLA(Vision-Language-Action) | VLA(Vision-Language-Action) | 自社設計のエンドツーエンドモデル |

| 対象ロボット | ヒューマノイド全般(クロスエンボディメント) | 汎用ロボット(主にGoogle社内ロボット) | Tesla Optimus専用 |

| 公開状態 | オープン(モデル・コード公開) | 非公開(Google内部研究) | 非公開(Tesla内部開発) |

| VLMベース | Cosmos 2B VLM | PaLI-X / PaLM-E | 非公開 |

| アーキテクチャ | 二重システム(System 1 + System 2) | 単一VLMからアクション生成 | 非公開 |

| 合成データ | Blueprint(Mimic/Gen/Dreams) | Google社内データ | Tesla社内データ |

| 商用利用 | 研究・評価目的のみ(OneWay Noncommercial) | 非公開 | 自社製品向け |

GR00Tの最大の差別化ポイントはオープンであることです。RT-2やTesla Optimusが自社内でのみ利用可能なのに対し、GR00TはHugging FaceとGitHubから誰でもダウンロードでき、自社のロボットデータでファインチューニングできます。

TechCrunchが「NVIDIAはロボティクスのAndroidになろうとしている」と報じたように、GR00Tの戦略は「自社でロボットを作る」のではなく「すべてのロボットメーカーに共通の基盤を提供する」というプラットフォームアプローチです。

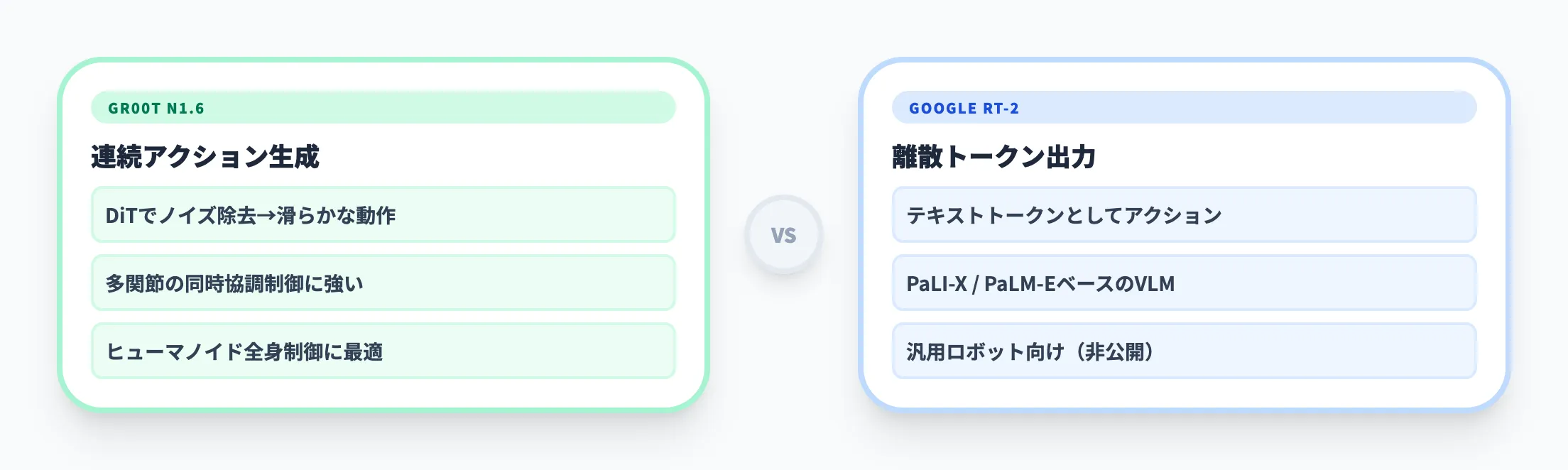

RT-2との技術的な違い

Google DeepMindのRT-2は、PaLI-XやPaLM-Eといった大規模VLMをロボットデモデータでファインチューニングし、テキストトークンとしてロボットアクションを出力するモデルです。アクションを離散トークンとして扱う点がGR00Tとは異なり、GR00TはDiffusion Transformerで連続的なアクションを生成します。

連続アクション生成の利点は、滑らかで精密な動作制御が可能な点です。特にヒューマノイドロボットの全身制御のように、多数の関節を同時に協調させる必要があるタスクでは、この違いが実用性に大きく影響します。

NVIDIA GR00Tの料金・ライセンス

GR00Tの導入を検討するうえで押さえておくべきなのが、ライセンスの制約と利用環境です。

ライセンス体系

GR00T N1.6はNVIDIA OneWay Noncommercialライセンスのもとで公開されています。

| ライセンス | 対象 | 用途 |

|---|---|---|

| NVIDIA OneWay Noncommercial | GR00Tモデルウェイト | 研究・評価目的のみ。商用利用は不可 |

| Apache 2.0 | Isaac-GR00Tリポジトリのコード | オープンソース。商用利用可 |

ここで重要なのは、モデルウェイトとコードでライセンスが分かれている点です。GR00Tのコード(推論パイプライン、データローダー、ファインチューニングスクリプト等)はApache 2.0で自由に商用利用できますが、モデルウェイト自体は研究・評価目的に限定されます。

CosmosのPredict 2.5やTransfer 2.5がNVIDIA Open Model License(商用利用可)で公開されているのとは異なり、GR00Tは現時点では非商用ライセンスであり、商用利用は不可です。

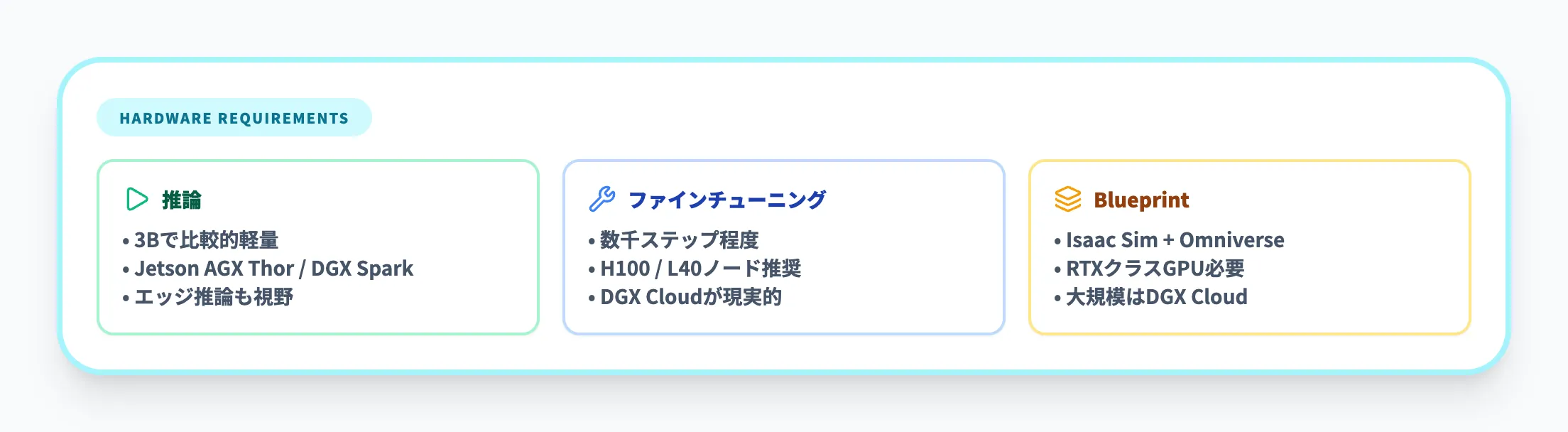

GPU・ハードウェア要件

GR00Tの推論とファインチューニングには、GPU環境が必要です。

-

推論

3Bパラメータのモデルであるため、推論自体は比較的軽量。NVIDIA Jetson AGX ThorやDGX Sparkでの実行事例があり、エッジデバイスでの推論も視野に入る

-

ファインチューニング

公式READMEでは数千ステップ程度のポストトレーニングが推奨されており、推奨環境はH100ノードまたはL40ノード。DGX Cloudなどのクラウド環境が現実的な選択肢になる

-

Blueprint(合成データ生成)

Isaac Sim + Omniverseの実行にはRTXクラスのGPUが必要。大規模生成にはDGX Cloudが現実的

NVIDIA GR00Tの始め方

「何から始めればいいかわからない」という方向けに、GR00Tを試すための具体的なステップを紹介します。

セットアップから推論まで

GR00Tを試すには、以下のステップで進めます。

- Hugging FaceからGR00T-N1.6-3Bモデルをダウンロードする

- GitHubのIsaac-GR00Tリポジトリをクローンする

- getting_startedフォルダのJupyter notebookに沿って環境をセットアップする

- サンプルデータで推論を実行し、動作を確認する

- 自社ロボットのデータを準備し、getting_started/finetune_new_embodiment.mdに沿ってファインチューニングする

まずはHugging Faceのモデルカードでデモを試し、次にJupyter notebookでサンプルデータの推論を実行するのが最も手軽です。

自社データでの本格的なファインチューニングは、推論の結果に手応えを感じてから進めても遅くありません。

ロボット基盤モデルへの関心を業務全体のAI化に結びつけるなら

GR00Tのようなロボット基盤モデルの急速な進化は、AIの適用範囲がロボティクスから業務プロセス全体へと広がっていることを象徴しています。ロボットAIの動向を追う中で得たAI技術への理解は、自社業務のAI化を検討する際の強力な基盤になります。

AI総合研究所では、AI技術の理解を業務プロセスへの導入に結びつけるための実践ガイドを無料で提供しています。ロボティクスに限らず、幅広い業務領域でのAI活用ステップを確認してみてください。

ロボット基盤モデルの動向を業務プロセスのAI化に結びつける

AI業務自動化ガイド

GR00Tのようなロボット基盤モデルの進化は、AI技術の業務適用範囲が急速に広がっていることの表れです。自社業務にAIを段階的に導入するための実践ステップをガイドにまとめました。

まとめ

NVIDIA GR00Tは、ヒューマノイドロボット向けの世界初のオープンな基盤モデルとして、ロボット開発のあり方を根本から変える可能性を持つプラットフォームです。

-

System 1(高速動作)+ System 2(Cosmos 2B VLMによる推論)の二重システムアーキテクチャで、リアルタイム動作制御と物理的推論を両立。N1.6は3Bパラメータ・32層DiTで前世代を上回る操作性能を実現

-

GR00T Blueprint(Mimic/Gen/Dreams)の合成データ生成パイプラインで、学習データ生成を**「日単位→時間単位」**に短縮。780K合成軌跡を11時間で生成し、実データとの組み合わせで性能40%向上

-

1X Technologies・Agility Robotics・Figure AI・Boston Dynamics等の世界の主要ロボット企業がパートナーとして参加。GXO倉庫でのDigit正式商用導入など、実用化が加速中

-

RT-2やTesla Optimusとは異なりオープンモデルとして公開。Hugging Face / GitHubから誰でもダウンロードでき、自社ロボットへのファインチューニングが可能

-

現時点ではNVIDIA OneWay Noncommercialライセンス(研究・評価目的のみ)。商用利用は不可

GTC 2026(2026年3月16〜19日)ではGR00Tのさらなる進化が発表される見込みです。最新情報はNVIDIA GTC公式ページをご確認ください。

AI総合研究所では最新AIの企業導入、開発、研修を支援しています。AI導入の企業の担当者様はお気軽にご相談ください。