この記事のポイント

コスト最優先ならBatch Tierを使うべき。Standard比50%の半額で、大量処理・非リアルタイム用途に最適

汎用的なAPI利用にはGPT-4.1 miniが第一候補。性能とコストのバランスが最も優れている

キャッシュ入力を活用すれば最大90%のコスト削減が可能。繰り返しのシステムプロンプトがある場合は必ず設定すべき

GPT-5.4は最高性能だが高額。本番環境ではGPT-5.2やGPT-4.1で十分なケースが多く、まず低コストモデルで検証すべき

月間API費用が$100を超えるならAzure OpenAI Serviceとの併用を検討すべき。Enterprise契約で単価交渉が可能になる

Microsoft MVP・AIパートナー。LinkX Japan株式会社 代表取締役。東京工業大学大学院にて自然言語処理・金融工学を研究。NHK放送技術研究所でAI・ブロックチェーンの研究開発に従事し、国際学会・ジャーナルでの発表多数。経営情報学会 優秀賞受賞。シンガポールでWeb3企業を創業後、現在は企業向けAI導入・DX推進を支援。

ChatGPT APIは、アプリケーションやサービスにOpenAIの対話型AIを組み込むための開発者向けインターフェースです。

2026年3月にはGPT-5.4がリリースされ、GPT-5.xシリーズ・oシリーズ・GPT-4.1シリーズなど選択肢がさらに広がっています。

モデルごとに入力・出力の従量課金が異なるため、用途に合ったモデル選びがコスト管理の鍵となります。

本記事では、2026年3月時点の全モデル料金一覧、処理優先度Tier(Standard / Batch / Flex / Priority)の使い分け、トークン計算方法、そして実践的なコスト削減テクニックまでを網羅的に解説します。

ChatGPTの新料金プラン「ChatGPT Go」については、以下の記事をご覧ください。

ChatGPT Goとは?料金や機能、広告の仕様、Plus版との違いを解説

✅最新モデル「GPT-5.5」については、以下の記事をご覧ください。

GPT-5.5とは?使い方や料金、GPT-5.4との違いを解説

目次

ChatGPT APIのモデル別料金一覧(2026年3月時点)

試作中(PlaygroundやAssistantAPIなど)の入出力にもトークンを消費する

GPT-5.4:最新フラッグシップモデル(2026年3月リリース)

o1シリーズ(o1 / o1-mini):第1世代推論モデル(レガシー)

GPT-4oシリーズ(gpt-4o / gpt-4o-mini):マルチモーダルと速度のバランス

ChatGPT APIの料金体系とは

ChatGPT API(OpenAI API)は従量課金制で、使用したトークン数に基づいて料金が発生します。2026年3月時点では、GPT-5.4を含むGPT-5.xシリーズ、oシリーズ(推論モデル)、GPT-4.1シリーズなど多彩なモデルが提供されており、用途に応じたモデル選択がコスト管理の基本です。

処理優先度Tier

OpenAIは4つの処理優先度オプションを提供しています。同じモデルでもTierによって料金が大きく変わるため、リアルタイム性の要件に合わせた使い分けが重要です。

| Tier | 特徴 | Standard比 | 最適な用途 |

|---|---|---|---|

| Batch | 24時間以内に処理 | 50%(半額) | 大量の非緊急タスク(データ分析・翻訳バッチ等) |

| Flex | 数分〜数時間で処理 | 約50%(半額) | リアルタイム性不要のタスク |

| Standard | 通常処理速度 | 基準料金 | 一般的なAPI利用 |

| Priority | 最高優先度で処理 | 2〜4倍 | ミッションクリティカルなタスク |

Batchは24時間以内という制約がある代わりにStandard比50%の料金で利用でき、大量のテキスト処理やデータ変換に適しています。一方、Priorityは最も高額ですが、遅延が許されない本番環境で確実にレスポンスを得たい場合に選択します。

2026年3月の主な変更点

2026年に入り、OpenAI APIの料金体系にはいくつかの重要な変化がありました。

- GPT-5.4リリース(2026年3月5日)

最新のフラッグシップモデル。1Mトークンのコンテキストウィンドウ、コンピュータ操作機能を搭載し、GPT-5.2を上回る性能

- GPT-5.3 Codex(2026年2月)

コーディング特化のエージェントモデル。400Kトークンのコンテキストウィンドウに対応

- GPT-5.3 Instant(2026年1月〜)

ChatGPTのデフォルトモデルとして展開。API料金はGPT-5.2と同等

- 無料トライアルクレジットの廃止

2025年中頃に新規登録時の$5無料クレジットが廃止。現在は$5の最低チャージが必要

ChatGPT APIのモデル別料金一覧(2026年3月時点)

以下の料金はすべてStandard Tierの価格です。Batchを利用すれば各料金の50%、Priorityでは2〜4倍となります。最新の正確な料金はOpenAI公式料金ページで確認してください。

テキストモデル(Standard Tier)

GPT-5.xシリーズ

GPT-5.xシリーズはOpenAIのフラッグシップモデル群です。GPT-5.4が2026年3月に登場し、コンピュータ操作や1Mトークンコンテキストに対応した最新モデルとなっています。

| モデル名 | 入力料金 (USD / 1M tokens) | キャッシュ入力 | 出力料金 (USD / 1M tokens) | 特徴 |

|---|---|---|---|---|

| gpt-5.4 | $2.50 | $1.25 | $15.00 | 2026年3月リリース、1Mコンテキスト、コンピュータ操作対応 |

| gpt-5.4-pro | $30.00 | - | $180.00 | GPT-5.4の最高性能版 |

| gpt-5.3 Instant | $1.75 | $0.175 | $14.00 | ChatGPTのデフォルトモデル |

| gpt-5.3-codex | $1.75 | $0.175 | $14.00 | コーディング特化エージェント |

| gpt-5.2 | $1.75 | $0.175 | $14.00 | Thinking相当 |

| gpt-5.2-pro | $21.00 | $2.10 | $168.00 | 高性能推論モデル |

| gpt-5 | $1.25 | $0.125 | $10.00 | 汎用モデル |

| gpt-5-mini | $0.25 | $0.025 | $2.00 | 軽量版GPT-5 |

| gpt-5-nano | $0.05 | $0.005 | $0.40 | 超高速応答 |

GPT-5.4は272Kトークンを超えるプロンプトの場合、入力料金が$5.00/1Mに倍増する点に注意が必要です。大量のドキュメントを処理する場合は、コンテキストサイズとコストのバランスを考慮しましょう。

GPT-4.1シリーズ

GPT-4.1シリーズは、テキスト処理に特化した前世代モデルです。GPT-5.xよりも入力単価が安く、シンプルなタスクではコストパフォーマンスに優れています。

| モデル名 | 入力料金 (USD / 1M tokens) | キャッシュ入力 | 出力料金 (USD / 1M tokens) |

|---|---|---|---|

| gpt-4.1 | $2.00 | $0.20 | $8.00 |

| gpt-4.1-mini | $0.40 | $0.04 | $1.60 |

| gpt-4.1-nano | $0.10 | $0.01 | $0.40 |

GPT-4oシリーズ

GPT-4oシリーズはマルチモーダル対応の汎用モデルです。テキスト・画像・音声を統合的に処理できます。

| モデル名 | 入力料金 (USD / 1M tokens) | キャッシュ入力 | 出力料金 (USD / 1M tokens) |

|---|---|---|---|

| gpt-4o | $2.50 | $1.25 | $10.00 |

| gpt-4o-mini | $0.15 | $0.075 | $0.60 |

推論モデル(oシリーズ / Standard Tier)

推論モデルは、応答前に内部で「思考プロセス」を実行するモデルです。この思考に使われるトークン(reasoning tokens)も出力トークンとして課金されるため、見かけの出力量よりも実際のコストが高くなる点に注意が必要です。

| モデル名 | 入力料金 (USD / 1M tokens) | キャッシュ入力 | 出力料金 (USD / 1M tokens) | 特徴 |

|---|---|---|---|---|

| o3-pro | $20.00 | - | $80.00 | 最高精度の推論(速度よりも正確性重視) |

| o3 | $2.00 | $1.00 | $8.00 | 高性能推論モデル |

| o3-deep-research | $10.00 | $2.50 | $40.00 | 深い分析・調査 |

| o4-mini | $1.10 | $0.275 | $4.40 | 軽量推論モデル(コスパ重視) |

| o4-mini-deep-research | $2.00 | $0.50 | $8.00 | 軽量版調査モデル |

| o1 | $15.00 | $7.50 | $60.00 | 第1世代推論(レガシー) |

| o1-pro | $150.00 | - | $600.00 | 第1世代最上位(レガシー) |

推論モデルでは、500トークンの可視出力に対して2,000トークン以上の推論トークンが消費されるケースもあります。コスト見積もりの際は、実際の出力トークン数を確認することをおすすめします。

マルチモーダル・特殊モデル

画像・音声・動画を扱うモデルの料金です。テキストモデルとは課金体系が異なるものもあるため、個別に確認が必要です。

| モデル名 | 入力料金 | 出力料金 | 用途 |

|---|---|---|---|

| gpt-image-1 | $10.00/1M tokens | $40.00/1M tokens | 画像理解・生成 |

| sora-2 | $0.10/秒 | - | 動画生成(720p) |

| sora-2-pro | $0.30/秒〜$0.50/秒 | - | 動画生成(最大1792x1024) |

| gpt-realtime | $4.00/1M tokens | $16.00/1M tokens | リアルタイム音声対話 |

| gpt-realtime-mini | $0.60/1M tokens | $2.40/1M tokens | 軽量版リアルタイム |

音声モデルではテキストトークンとオーディオトークンで料金が異なります。gpt-4o-mini-ttsの場合、テキスト入力は$0.60/1Mですが、オーディオ出力は$12.00/1Mとなるため、音声合成のコストは見た目以上に高くなる場合があります。

バッチ処理(Batch API)

時間的制約のない大量リクエストには、Batch APIを利用することでStandard Tierの50%の料金で処理できます。24時間以内に結果が返される仕組みで、大量のテキスト分析やデータ変換に最適です。

| モデル名 | 入力料金 (USD / 1M tokens) | キャッシュ入力 | 出力料金 (USD / 1M tokens) |

|---|---|---|---|

| gpt-5.4 | $1.25 | $0.625 | $7.50 |

| gpt-5.2 | $0.875 | $0.0875 | $7.00 |

| gpt-5 | $0.625 | $0.0625 | $5.00 |

| gpt-5-mini | $0.125 | $0.0125 | $1.00 |

| gpt-5-nano | $0.025 | $0.0025 | $0.20 |

| gpt-4.1 | $1.00 | - | $4.00 |

| o3 | $1.00 | - | $4.00 |

| o4-mini | $0.55 | - | $2.20 |

例えば、gpt-5-miniのBatch APIを使えば、100万トークンの入力に対してわずか$0.125で処理できます。開発・テスト段階や日次のデータ処理ジョブでは、Batch APIの活用がコスト削減の大きな鍵となります。

その他のAPI料金(ツール・埋め込み・画像生成)

APIではモデル利用料に加えて、組み込みツールや特殊機能にも個別の料金が発生します。

| 機能 | 料金 |

|---|---|

| Web検索ツール | $25〜$50 / 1,000コール(モデルとコンテキストサイズで変動) |

| ファイル検索ツール | $2.50 / 1,000コール |

| ファイルストレージ | $0.10 / GB / 日(1GB無料) |

| コードインタープリター | $0.03 / 秒 |

| Embeddings(text-embedding-3-small) | $0.02 / 1M tokens |

| Embeddings(text-embedding-3-large) | $0.13 / 1M tokens |

Web検索ツールの料金はモデルグループによって異なります。gpt-4.1やgpt-4oグループでは$30〜$50/1Kコール、gpt-4.1-miniやgpt-4o-miniグループでは$25〜$30/1Kコールです。

画像生成料金(1枚あたり)

画像生成はトークン課金ではなく、画像1枚あたりの料金で課金されます。品質と解像度によって大きく異なります。

| モデル | 品質 | 1024x1024 | 1024x1536 / 1536x1024 |

|---|---|---|---|

| GPT Image 1 | Low | $0.011 | $0.016 |

| GPT Image 1 | Medium | $0.042 | $0.063 |

| GPT Image 1 | High | $0.167 | $0.25 |

ファインチューニング料金

自社データでモデルをカスタマイズするファインチューニングの料金です。トレーニング費用に加え、ファインチューニング済みモデルの推論料金はベースモデルより高くなります。

| モデル | トレーニング | 推論入力 | 推論出力 |

|---|---|---|---|

| o4-mini | $100.00/hr | $4.00/1M | $16.00/1M |

| gpt-4.1 | $25.00/1M | $3.00/1M | $12.00/1M |

| gpt-4.1-mini | $5.00/1M | $0.80/1M | $3.20/1M |

| gpt-4.1-nano | $1.50/1M | $0.20/1M | $0.80/1M |

| gpt-4o-mini | $3.00/1M | $0.30/1M | $1.20/1M |

ファインチューニングはデータ共有プログラムを利用すると、推論料金が50%割引になる場合があります。詳細はOpenAI公式のファインチューニングガイドを確認してください。

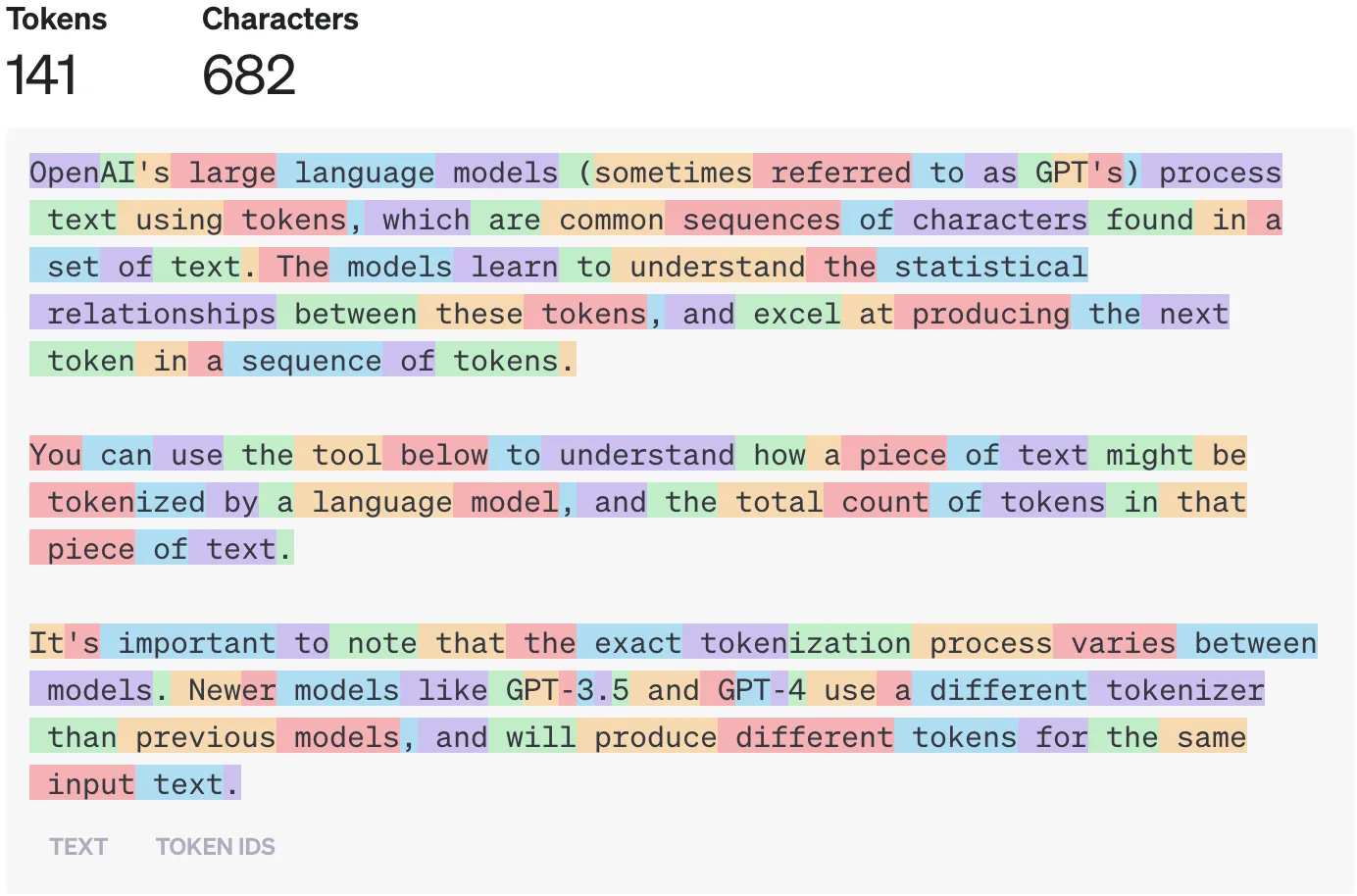

ChatGPT APIのトークンとは?

トークンとは、テキストを小さな単位に分けたものです。

ChatGPTのAPI利用においては、ユーザーが入力するテキストと、ユーザーの質問に対しChatGPTが出力するテキストの両方がトークン数としてカウントされ、この数によって利用料金が計算されます。

トークンの概要について簡潔にまとめると、以下の通りです。

- 一般的には、トークンは単語、句読点、または記号等を含む

- 言語や文章の内容によってトークンの数は変わるため、明確な基準はない

- 同じ文章でも、英語の方がトークン数は少なくなる事が多い

- 日本語や中国語などの言語では、1つの文字が1トークンとしてカウントされることが多い。

トークン数を計算する方法

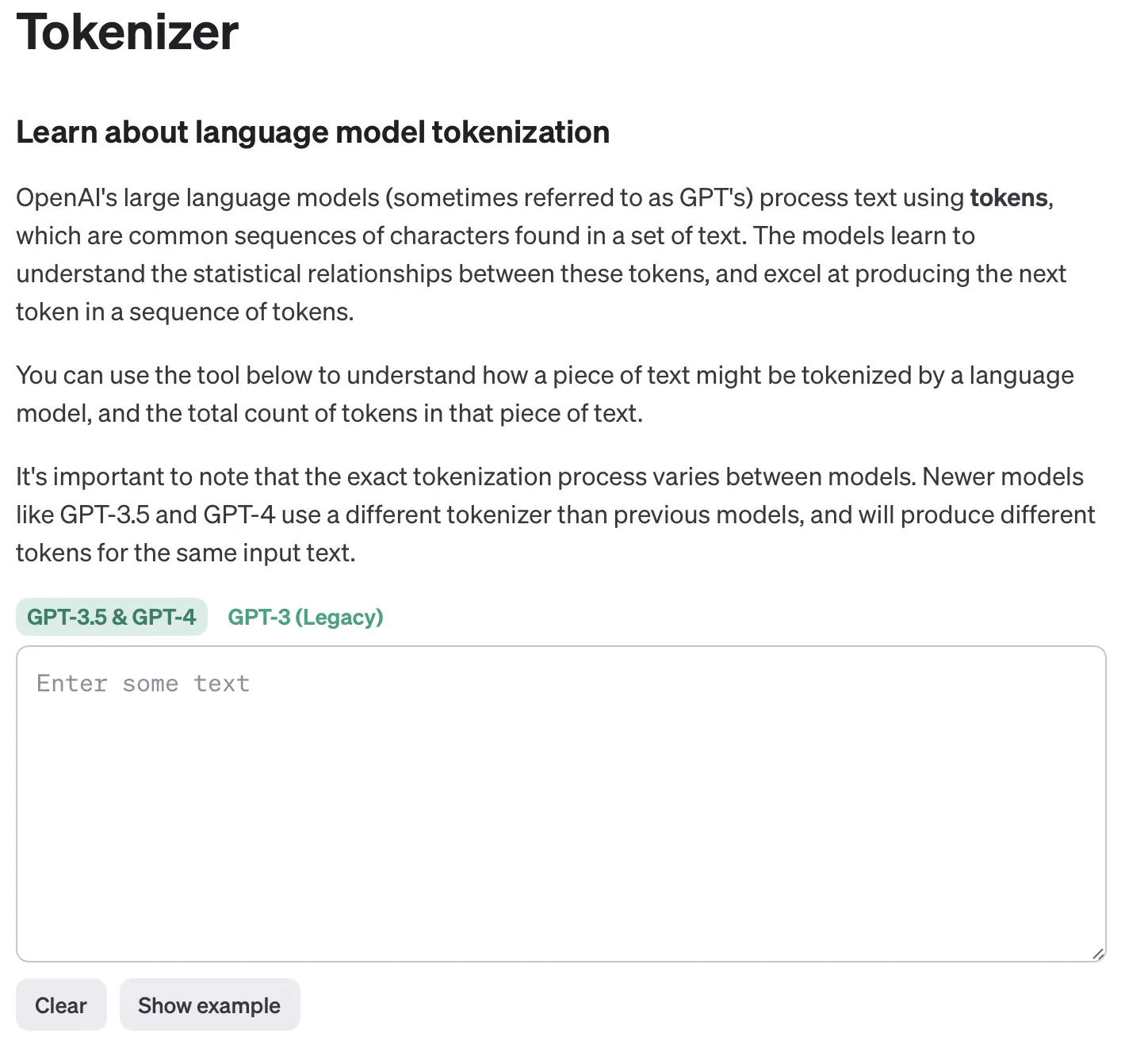

トークン数を計算する手段としては、主にOpenAI公式のツールを使う方法とPythonを用いる方法の二種類があります。

ここでは、OpenAIが公開しており誰でも簡単に試すことができる、Toknizerを利用して計算する手順を説明していきます。

-

Toknizerのサイトにアクセスします。

Toknizer(OpenAI)

-

画像の入力ボックスに、トークン数を計算したい文章を入力します。

Toknizerの使用画面

-

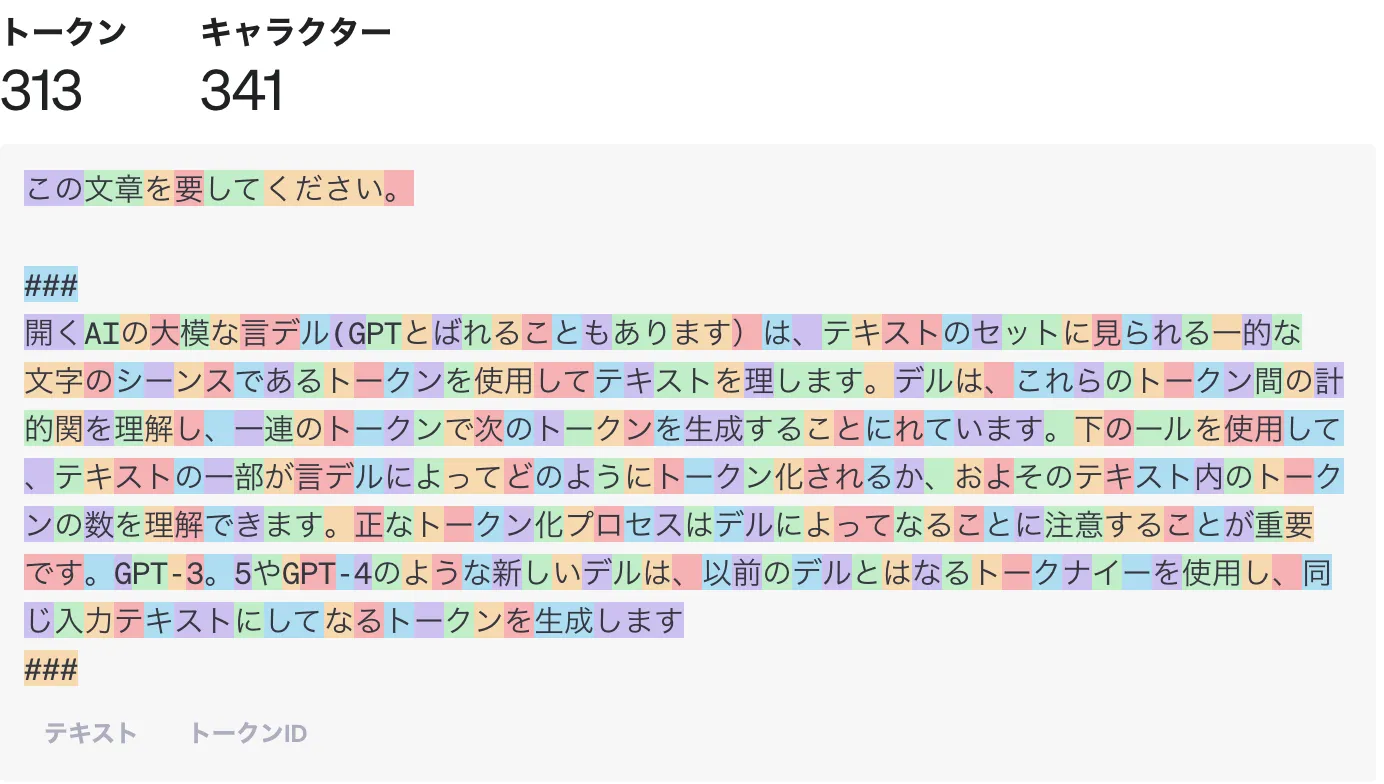

すると、このように入力した文章のトークン数を算出してくれます。

トークン数の算出

上の画像は、ChatGPTに文章の要約を頼むプロンプトのトークン数を算出した例です。

キャラクターが文章の文字数、トークンが消費されるトークンの数を指しています。

この結果から読み取ると、日本語の場合はおおよそ1文字辺り1トークンと換算といったイメージになります。

ただし、文章の内容や漢字の多さ、記号等で左右される可能性はあります。

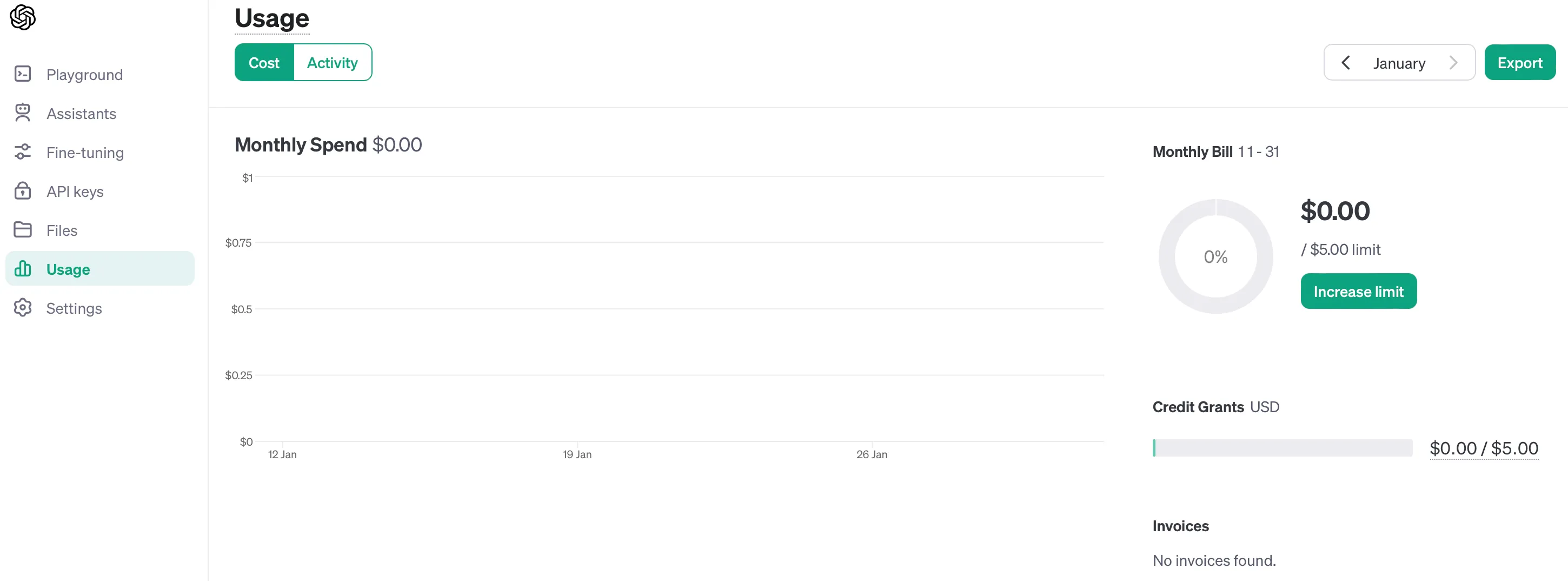

ChatGPT APIの料金確認方法

OpenAIのAPI管理ページ左側の、「Usage」ページで使用料や当月の請求金額を確認する事ができます。

過去の請求履歴を参照したり、請求データをエクスポートする事も可能です。

API管理ページはこちら:OpenAI開発者プラットフォーム

トークン使用量の確認

ChatGPT API利用料金の計算方法

利用料金の計算式は、以下のようになります。

(入力トークン数 / 1000) × 入力トークン料金 + (出力トークン数 / 1000) × 出力トークン料金 = 利用料金

例えば、gpt-5-miniを使用し、入力が2,000トークン、出力が3,000トークンだった場合は以下のように計算します。

入力料金: $0.25 / 1Mトークン

出力料金: $2.00 / 1Mトークン

計算式 : (2,000 / 1,000,000) × $0.25 + (3,000 / 1,000,000) × $2.00

合計 : $0.0065(約1円未満)

このように、gpt-5-miniのような軽量モデルであれば数千トークンの処理は1円未満で済みます。一方、gpt-5.4-proで同じ処理を行うと、入力$30.00/1M + 出力$180.00/1Mとなり、合計約$0.60(約90円)と大きな差が生まれます。

試作中(PlaygroundやAssistantAPIなど)の入出力にもトークンを消費する

PlaygroundやAssistantAPI等の試作画面においても、入力・出力共に料金が発生します。

料金は上記で紹介したモデルに準拠しますが、AssistantAPIは料金体系が異なりますのでご注意ください。

ChatGPT APIのモデル選択ガイド

OpenAIのAPIでは多様なモデルが提供されており、それぞれに特徴・得意分野・料金が異なります。2026年3月時点では、最新のGPT-5.4を含むGPT-5.xシリーズ、推論特化のoシリーズ、コスト効率の高いGPT-4.1シリーズが主な選択肢です。

ここでは、用途別にどのモデルが適しているかを解説します。

GPT-5.4:最新フラッグシップモデル(2026年3月リリース)

GPT-5.4は2026年3月5日にリリースされた最新モデルです。1Mトークンのコンテキストウィンドウ、コンピュータ操作機能、10Mピクセル超の高解像度画像処理に対応しています。

- おすすめのケース

長大なドキュメントの分析、コンピュータ操作を伴うエージェントタスク、スプレッドシート操作、高精度なコーディング

- 料金の目安

入力$2.50/1M、出力$15.00/1M(272Kトークン超は入力$5.00に倍増)。GPT-5.2比で入力は約43%増、出力は約7%増

GPT-5.4はトークン効率がGPT-5.2より高く、同じタスクでも消費トークン数が少なくなる傾向があるため、単価の上昇分はある程度相殺されます。

o3ファミリー(o3 / o3-pro):高精度な推論能力

「o3」はOpenAIの推論特化モデルで、複雑な問題に対して内部で「思考プロセス」を実行します。2025年6月には最上位版の「o3-pro」が登場しました。

o3

- 特徴:

複雑なクエリへの深い理解と詳細な回答生成。コーディング、数学、科学、特に視覚タスクで卓越した能力。ツールをエージェント的に連携可能。o3-pro登場に伴いAPI料金が大幅に値下げされ、コストパフォーマンスが向上。

【関連記事】

OpenAI o3(ChatGPT o3)とは?使い方や料金、Proについて解説!

- おすすめのケース:

高度な研究開発、専門的な問題解決。画像やグラフを含む複雑な情報を扱いたい場合。

o3-pro

-

特徴:

**o3をベースに、より長く考え、最も信頼性の高い応答を提供するように設計された最上位モデル。**数学、科学、コーディングなどの分野でo3やo1-proを上回る性能。ツールアクセスも可能。

-

おすすめのケース:

**最高の信頼性と推論能力が求められる最先端の研究、ミッションクリティカルなタスク。**速度よりも応答の質を重視する場合。

OpenAI o3-proとは?使い方、o3・o1-proとの違い、料金、API、制限事項を解説!

o1シリーズ(o1 / o1-mini):第1世代推論モデル(レガシー)

o1シリーズは推論モデルの第1世代です。o3/o4-miniの登場によりレガシー扱いとなっていますが、既存のワークフローで利用中の場合は引き続き利用可能です。

-

「o1」:

- 特徴: 複雑な推論、「思考の連鎖」(Chain of Thought)を得意とします。応答前に内部で深く思考するプロセスを持ちます。「STEM」分野での能力が高いですが、一般的な言語タスクでは「GPT-4o」の方が優位な場合もあります。

- おすすめのケース: 数学的な問題解決、科学的な分析、コーディングタスクなど、論理的な思考と深い理解が求められる場合。

-

「o1-mini」:

- 特徴: 「o1」の基本的な能力を維持しつつ、処理速度と効率性を向上させた軽量・高速モデル。「STEM」分野、特にコーディングタスクで「o1」の初期プレビュー版を上回る性能を示すことがあります。

- おすすめのケース: 「o1シリーズ」の推論能力をより低コスト・高速に利用したい場合。特定のタスクに特化したLLM活用。

【関連記事】

OpenAI o1(ChatGPT o1)とは?使い方や料金、Proについて解説!

o4-mini:高速・高コスト効率で実用的なタスクに最適

「o4-mini」は、高速性とコスト効率に特化した最新の小型AIモデルです(旧「o3-mini」後継)。

-

特徴:

- 軽量設計でありながら、数学、コーディング、ビジュアルタスク(画像理解)において高い性能を発揮。

- 応答速度が速く、大量処理にも対応できる高いスループット。

- 「o3-mini」と比較して性能が向上し、より幅広いタスクに対応可能。

-

おすすめのケース:

- リアルタイム性が求められるチャットボットやアプリケーション。

- コストを抑えつつAIを大規模に利用したい場合(大量のテキスト生成、データ処理など)。

- 日常的なAI活用や、予算を重視するプロジェクト。

【関連記事】

【OpenAI】o4-miniとは?主な特徴や使い方、料金体系を解説

GPT-4oシリーズ(gpt-4o / gpt-4o-mini):マルチモーダルと速度のバランス

「gpt-4o」シリーズは、テキスト、音声、画像を統合的に扱えるマルチモーダル性と高速応答が特徴です。

-

「gpt-4o」:

- 特徴: 高度なマルチモーダル処理、リアルタイム性の高いインタラクション。最新のAI機能をバランス良く備えています。

- おすすめのケース: マルチモーダルAIアプリ開発、自然な会話体験が求められるサービス。

-

「gpt-4o-mini」:

- 特徴: 「gpt-4o」の機能をより低コストで利用可能。効率的な処理が求められる環境に適しています。

- おすすめのケース: 「gpt-4o」の機能を予算を抑えて使いたい場合、モバイルアプリや小規模ツールへの組み込み。

GPT-4.1シリーズ:高品質なテキスト生成に特化

「gpt-4.1」シリーズは、特にテキストベースのタスクで高い能力を発揮します。

-

「gpt-4.1」:

- 特徴: 高度なテキスト理解と生成、複雑な指示への対応、クリエイティブな文章作成。

- おすすめのケース: 専門的な文書作成、高品質なコンテンツ生成、ミッションクリティカルな業務。

-

「gpt-4.1-mini」:

- 特徴: 「gpt-4.1」に近いテキスト処理能力を低コストで。一般的なビジネス文書作成やFAQ応答に適しています。

- おすすめのケース: コストパフォーマンス重視の高度なテキストタスク。

-

「gpt-4.1-nano」:

- 特徴: コストを最優先。非常に基本的なテキスト処理、大量のシンプルなリクエスト処理。

- おすすめのケース: API利用料金を極力抑えたい場合、学習やごく小規模なテスト。

用途別おすすめモデル早見表

「最もコスパがいい」モデルは、タスクの要求と予算によって大きく変わります。以下の表を参考に、最適なモデルを選択してください。

| 用途 | おすすめモデル | 入力料金 (1M tokens) | 特徴 |

|---|---|---|---|

| 単純なタスク・コスト最優先 | gpt-4.1-nano / gpt-5-nano | $0.10 / $0.05 | 超低コスト |

| 速度とコスト効率のバランス | o4-mini | $1.10 | 推論+高速 |

| テキスト生成(コスパ重視) | gpt-5-mini / gpt-4.1-mini | $0.25 / $0.40 | 汎用性あり |

| 高度な推論・分析 | o3 | $2.00 | 値下げ後のコスパ良 |

| 最新・最高性能 | gpt-5.4 | $2.50 | 1Mコンテキスト |

| ミッションクリティカル | o3-pro / gpt-5.4-pro | $20.00 / $30.00 | 精度最優先 |

低コストモデルでプロトタイピングを行い、必要に応じて高性能モデルにスケールアップすることも有効な戦略です。

ChatGPT APIの商用利用はできる?

基本的には可能です。しかし、ChatGPTのAPIを利用して作成したサービスの名称として、「○○GPT」のような名称を付けることは禁止されています。

上記は一例ですが、OpenAIの利用規約やブランドガイドラインを参照することが重要です。

OpenAI 利用規約

【関連記事】

ChatGPTの商用利用は可能!著作権リスクや規約上の注意点を解説

ChatGPT APIの費用を抑えるためのポイント

ChatGPTのAPIは、ブラウザ版の様に使い放題というわけではなく、使った分だけ料金が発生する従量課金制です。

以下に挙げる5つのポイントを念頭に置くことで、コストを節約しながらもAPIの利用効率を高めることが可能です。

用途に応じたモデル選び

上記モデル別の比較で詳述した通り、タスクの複雑性や求められる品質に応じて最適なモデルを選択することが最も重要です。

例えば、最新のgpt-5.4-pro(出力$180.00/1Mトークン)と、非常に低コストなgpt-4.1-nano(出力$0.40/1Mトークン)では、1Mトークンあたりの出力料金に450倍の差があります。

- シンプルな応答やテキスト処理: 「gpt-4.1-nano」、「gpt-4o-mini」、「o4-mini」などを検討。

- 複雑な分析や専門性の高いコンテンツ生成: 「gpt-4.1」、「gpt-4o」、「o1シリーズ」、「o3」を必要に応じて選択。

特に、「o4-mini」は高速かつコスト効率に優れ、多くの実用的なタスクでバランスの取れた選択肢となり得ます。

タスクの性質を正確に把握し、必要十分な性能を持つ最も安価なモデルを選ぶことがコスト削減の第一歩です。複数のモデルをタスクに応じて使い分けるアプローチも有効です。

プロンプトを最適化する

APIの利用時に限らず、言語モデルを利用する上で基本的な事ですが、プロンプトを最適化するという事が非常に重要です。

入力する文章はもちろんですが、「500文字以内で」や「箇条書きで」、「JSON形式で出力して」などと出力形式を具体的に指定することで、予期せぬ長文出力や意図しない形式によるトークンの消費を抑えることが可能です。

特に「o1シリーズ」のような推論モデルの場合、OpenAIは「人間が自然に質問するような形で使うのが最適で、複雑な指示や余計な情報は逆効果になる可能性がある」と示唆しています。

シンプルで明確な指示が、結果的にトークン数と処理時間の削減につながることがあります。

また、より洗練されたプロンプト(Few-shotプロンプティングなど、いくつかの例示を含める等)を入力することで出力精度の向上が期待でき、結果的に試行回数や修正のための追加のやり取り(トークン消費)を削減できます。

【関連記事】

プロンプトエンジニアリング完全ガイド!ChatGPTで使える例文も紹介

日本語を英語に翻訳してから入力する

一般的に、同じ文章でも日本語の文章は英語の文章に比べてトークン数が2~3倍に増えるとされています。

一例として、これはトークン数を計算する方法にて入力した文章を英語に翻訳してからトークン数を計算した例です。

同じ文章を英語に直した場合のトークン数

英語に翻訳する事で、Characters(文章全体の文字数)がほぼ2倍になっているにも関わらず、トークン数は約半分に抑えられています。

この例から分かる様に、大量のテキストデータ(特に長文のドキュメントなど)を入力としてAPIに渡す必要がある場合は、一度英語に翻訳してから処理し、必要であれば結果を再度日本語に翻訳することで、APIコストを大幅に削減できる可能性があります。

ただし、翻訳と逆翻訳のコストや手間、翻訳によるニュアンスの変化なども考慮に入れる必要があります。

過去の会話記録はなるべく含めない

ブラウザ版のChatGPTのように会話形式で応答できるAPIアプリケーションを構築する場合、過去のやり取りをコンテキストとして含めることで会話の流れを維持しますが、この過去のやり取りもトークンとしてカウントされ、料金が発生します。

全ての会話履歴を毎回含める必要はなく、直近の数ターン(例えば2~3回前)の会話履歴のみを参照させるように制限したり、会話の要約をコンテキストとして含めるなどの工夫をすることで、コストを抑えつつ、文脈に沿った応答を期待できます。

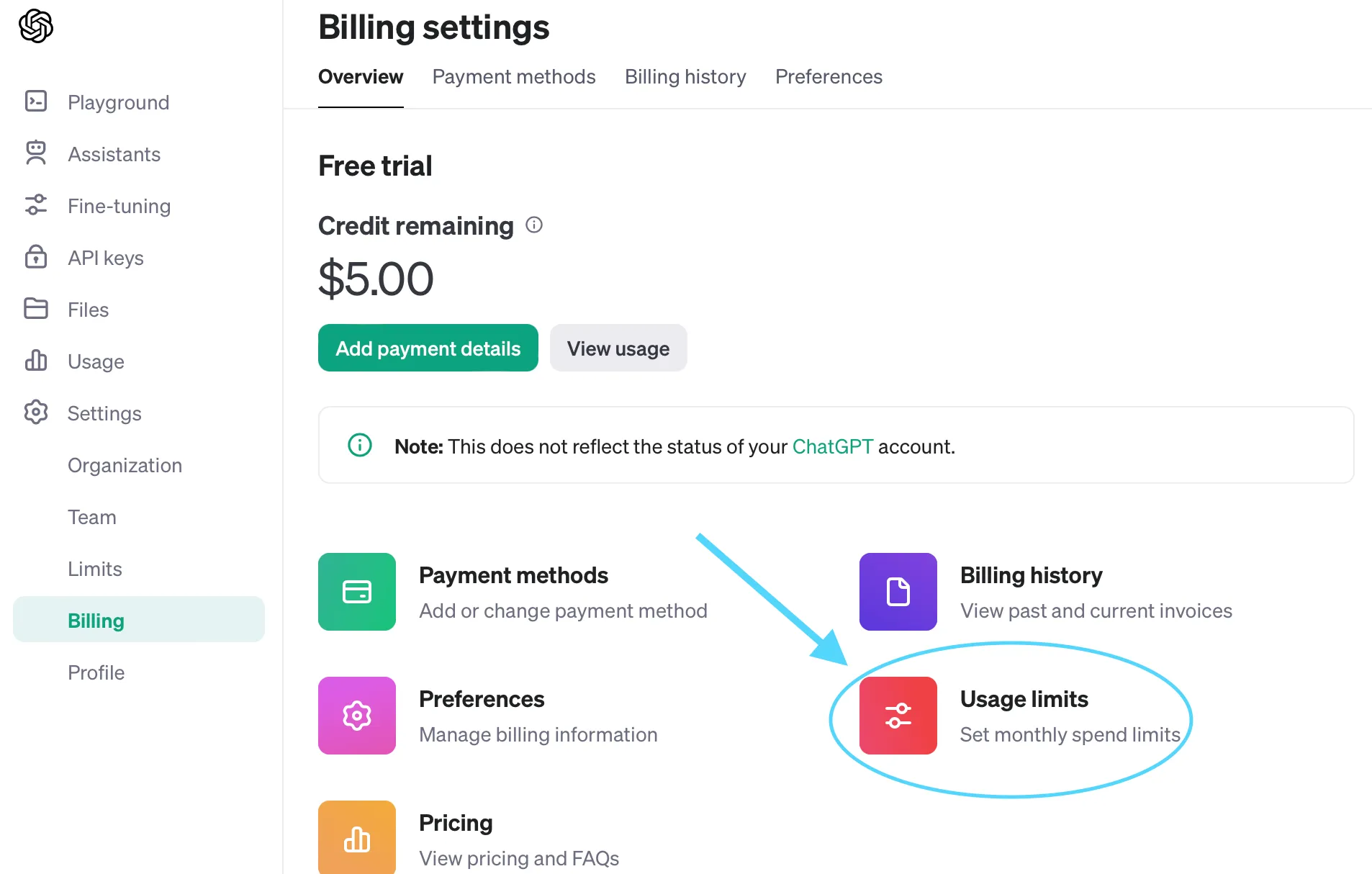

トークンの上限を指定する

予期せずAPI利用料が高額になってしまうことを防ぐために、**利用量の上限設定(Usage Limits)**は非常に重要です。

OpenAIのプラットフォームでは、月ごとのAPI利用金額の上限を設定できます。上限に達した場合でも後から変更できるので、予算管理のためにも必ず設定しておくことをお勧めします。

設定の仕方

OpenAI開発者プラットフォームページ左側の「Settings」から、「Billing」クリックします。

画像の様な画面に遷移するので、水色の矢印で囲んである「Usage Limits」を選択する事で、突き当たりの上限を設定する事が可能です。

APIの利用上限設定

ChatGPT APIの利用開始方法と無料枠

ChatGPT APIの利用を始めるには、OpenAI開発者プラットフォームでアカウントを作成し、APIキーを発行します。現在の推奨APIはResponses APIで、従来のChat Completions APIに代わる統一的なインターフェースです。

無料で試す方法はある?

完全無料での利用方法は限られていますが、以下の選択肢があります。

- OpenAI Playground

OpenAI Playgroundでは、最低チャージ後にブラウザ上でAPIを試すことができます。各モデルの出力品質やトークン消費量を事前に確認するのに便利です

- 低コストモデルで試す

gpt-4.1-nano(入力$0.10/1M、出力$0.40/1M)やgpt-5-nano(入力$0.05/1M、出力$0.40/1M)を使えば、$5のチャージでも数千回以上のAPI呼び出しが可能です

- 研究者向けプログラム

大学・研究機関・非営利団体に所属する研究者は、OpenAIのResearcher Access Programで最大$1,000分のAPIクレジットを申請できます

APIの利用状況確認画面

ChatGPT APIの無料期間については、こちらの記事でくわしく解説しています。

API料金を把握したなら業務へのAI組み込みを具体的に計画する

ChatGPT APIの料金体系やモデル別のコスト比較を理解すると、業務システムにAIを組み込む際の費用対効果を具体的に算出できるようになります。Batch APIによるコスト最適化やTier選択の知識は、社内のAI導入計画を立案する際にそのまま活用できる実務スキルです。

AI総合研究所では、API活用を含む業務のAI自動化を体系的に進めるための「AI業務自動化ガイド」を無料で公開しています。コスト設計から実装、運用までの全工程を220ページで網羅した実践ガイドです。

API料金の理解を業務プロセスへのAI導入計画に活かす

コスト設計の知識から業務AI化の具体的な計画へ

APIの料金体系とモデル選択の判断基準を理解したことで、業務にAIを組み込む際のコスト見積もりが可能になります。220ページの実践ガイドで、API活用を含む業務自動化の費用対効果と導入ステップを具体的に解説しています。

まとめ

2026年3月時点のChatGPT API料金について、本記事の主なポイントをまとめます。

GPT-5.4の登場により、OpenAI APIのモデルラインナップはさらに充実しました。gpt-5-nanoの$0.05/1M(入力)からgpt-5.4-proの$30.00/1Mまで、用途と予算に応じた幅広い選択肢が用意されています。

コスト管理で最も重要なのは、モデル選択と処理優先度Tierの2つの軸です。開発・テスト段階ではgpt-5-miniのBatch APIを活用し、本番環境では要件に応じてStandardやPriorityを使い分けることで、品質を落とさずにコストを最適化できます。

さらに、キャッシュ入力機能を活用すれば最大90%のコスト削減が可能です。プロンプトの最適化やトークン数の管理と組み合わせることで、予算内で最大のパフォーマンスを引き出せます。

モデルの性能や料金は定期的にアップデートされるため、OpenAI公式料金ページで最新情報をご確認ください。