この記事のポイント

コスト効率と応答速度を重視するプロダクション用途では、GPT-5.4 miniがOpenAI小型モデルの第一候補

コンテキスト40万トークン・出力12.8万トークンに対応しており、大規模コードベース解析や長文ドキュメント処理にはGPT-5.4 miniが最適

大量バッチ処理やサブエージェントのように精度よりコストを優先する場面では、GPT-5.4 nanoを選ぶべき

API料金は前世代より高いが、性能向上幅がコスト増を上回るため、GPT-5 miniからの移行は費用対効果で正当化できる

Azure AI Foundry経由ならエンタープライズセキュリティを確保でき、企業導入にはOpenAI API直接利用よりAzure経由が有効

Microsoft MVP・AIパートナー。LinkX Japan株式会社 代表取締役。東京工業大学大学院にて自然言語処理・金融工学を研究。NHK放送技術研究所でAI・ブロックチェーンの研究開発に従事し、国際学会・ジャーナルでの発表多数。経営情報学会 優秀賞受賞。シンガポールでWeb3企業を創業後、現在は企業向けAI導入・DX推進を支援。

OpenAIが2026年3月17日にリリースした「GPT-5.4 mini」は、GPT-5.4ファミリーの小型・高速バージョンです。前世代のGPT-5 miniと比較してコーディング・ツール使用・コンピュータ操作の各ベンチマークで大幅なスコア向上を達成しています。

本記事では、GPT-5.4 miniの基本スペックやベンチマーク結果、同時リリースのGPT-5.4 nanoとの違い、API料金体系、ChatGPT・Azure AI Foundry・GitHub Copilotでの使い方、そして企業の活用事例までを体系的に解説します。

GPT-5.4 miniとは?OpenAIの最新小型モデルの概要

GPT-5.4 mini(ジーピーティー5.4ミニ)は、OpenAIが2026年3月17日にリリースしたGPT-5.4ファミリーの小型・高速バージョンです。

同日にはさらに小型のGPT-5.4 nanoもリリースされており、マルチエージェント時代に向けた軽量AIモデルのラインナップが強化されました。

GPT-5.4 miniは、フルサイズのGPT-5.4に肉薄する性能を、大幅に低いコストと高速な応答で実現しています。前世代のGPT-5 miniと比較して、コーディング・推論・ツール使用の各分野で大幅にスコアが向上しています。

特に注目すべきは、マルチエージェントアーキテクチャにおけるサブエージェントとしての利用を想定した設計思想です。AIシステムが複数のモデルを役割ごとに使い分ける構成が普及するなか、低コストで高速に動作しつつ十分な推論能力を持つモデルへの需要が高まっています。GPT-5.4 miniはまさにこのニーズに応えるモデルとして位置づけられています。

GPT-5ファミリーの時系列

GPT-5.4 miniの位置づけを理解するために、GPT-5ファミリー全体のリリース経緯を整理します。

| 時期 | リリース内容 |

|---|---|

| 2025年後半 | GPT-5、GPT-5 mini、GPT-5 nano |

| 2026年3月5日 | GPT-5.3 Instant、GPT-5.4 Thinking、GPT-5.4 Pro |

| 2026年3月11日 | GPT-5.1モデルの廃止(GPT-5.3/5.4に移行) |

| 2026年3月17日 | GPT-5.4 mini、GPT-5.4 nano |

この表から分かるように、OpenAIはGPT-5系列を約半年かけて段階的に拡充してきました。まずフルサイズのGPT-5と小型モデルを同時に投入し、その後5.3/5.4世代でフルサイズを刷新、そして今回5.4世代の小型モデルが追加された流れです。

GPT-5.1はすでに廃止されているため、2026年3月時点のOpenAI最新ラインナップはGPT-5.3/5.4系列に集約されています。

GPT-5.4 nanoも同時リリース

GPT-5.4 miniと同日にリリースされたGPT-5.4 nanoは、GPT-5.4ファミリーの中で最小・最安のモデルです。

nanoは分類タスク、データ抽出、テンプレート的な文章生成など、精度よりもスループットとコストが重視されるタスクに最適化されています。一方で、miniはより高い推論能力やツール使用能力が求められるタスクに適しています。両者の詳しい違いは後述の「GPT-5.4 miniとGPT-5.4 nanoの違い」セクションで解説します。

GPT-5.4 miniの主な特徴と性能

GPT-5.4 miniは、前世代のGPT-5 miniからすべての主要ベンチマークでスコアが向上し、特にコンピュータ操作(OSWorld)とドメイン特化タスク(tau2-bench)で劇的な改善を見せています。ここでは基本スペックとベンチマーク結果を詳しく見ていきます。

基本スペック

以下の表で、GPT-5.4 miniの主な技術仕様をまとめました。

| 項目 | GPT-5.4 mini |

|---|---|

| コンテキストウィンドウ | 400,000トークン |

| 最大出力トークン | 128,000トークン |

| 知識カットオフ | 2025年8月31日 |

| 入力モダリティ | テキスト、画像 |

| 出力モダリティ | テキスト |

| 推論トークン(Reasoning) | 対応 |

| ファインチューニング | 非対応(Distillation対応) |

40万トークンのコンテキストウィンドウは、フルサイズのGPT-5.4と同等です。大規模なコードベースや長文ドキュメントを一度に読み込ませる用途にも十分対応できます。一方で、音声や動画の入出力には対応しておらず、テキストと画像に特化したモデルです。

ベンチマーク結果

GPT-5.4 miniのベンチマーク結果を、フルサイズのGPT-5.4および前世代のGPT-5 miniと比較しました。数値はOpenAI公式ブログの発表に基づいています。

| ベンチマーク | 分野 | GPT-5.4(フル) | GPT-5.4 mini | GPT-5 mini |

|---|---|---|---|---|

| SWE-Bench Pro | コーディング | 57.7% | 54.4% | 45.7% |

| Terminal-Bench 2.0 | コーディング | 75.1% | 60.0% | 38.2% |

| Toolathlon | ツール使用 | 54.6% | 42.9% | 26.9% |

| MCP Atlas | ツール使用 | 67.2% | 57.7% | 47.6% |

| OSWorld-Verified | コンピュータ操作 | 75.0% | 72.1% | 42.0% |

| GPQA Diamond | 科学推論 | - | 88.0% | 81.6% |

| tau2-bench(通信) | ドメイン特化 | - | 93.4% | 74.1% |

特に差が大きいのがOSWorld-Verified(コンピュータ操作)の結果です。GPT-5 miniの42.0%から72.1%へと30ポイント以上の改善を達成しており、フルサイズGPT-5.4の75.0%にわずか2.9ポイント差まで迫っています。つまり、コンピュータ操作タスクについてはフルモデルとほぼ同等の性能を、大幅に低いコストで利用できるということです。

tau2-bench(通信ドメインのカスタマーサポートタスク)も74.1%から93.4%へと約19ポイント向上しており、ドメイン特化タスクでの実用性が大きく高まっています。

前世代GPT-5 miniからの改善点

前世代からの改善を整理すると、以下の3つの軸が際立ちます。

-

処理速度

OpenAIの発表によると、GPT-5 miniと比較して大幅に高速化されている。リアルタイムアプリケーションやエージェントワークフローでの待機時間短縮が期待される。

-

コーディング能力

SWE-Bench Proで45.7%→54.4%(+8.7ポイント)、Terminal-Bench 2.0で38.2%→60.0%(+21.8ポイント)と、コード生成・修正の精度が向上。開発ワークフローでのサブエージェント利用がより現実的になった。

-

ツール使用・エージェント能力

Toolathlon(ツール使用の総合評価)で26.9%→42.9%(+16.0ポイント)、MCP Atlas(MCPプロトコル対応)で47.6%→57.7%(+10.1ポイント)と、外部ツールとの連携精度が大幅に改善。マルチエージェントシステムのサブエージェントとしての信頼性が高まっている。

これらの改善により、GPT-5.4 miniは「フルモデルの廉価版」という位置づけを超え、マルチエージェント構成の中核モデルとしての役割を担えるようになりました。

GPT-5.4 miniとGPT-5.4 nanoの違い

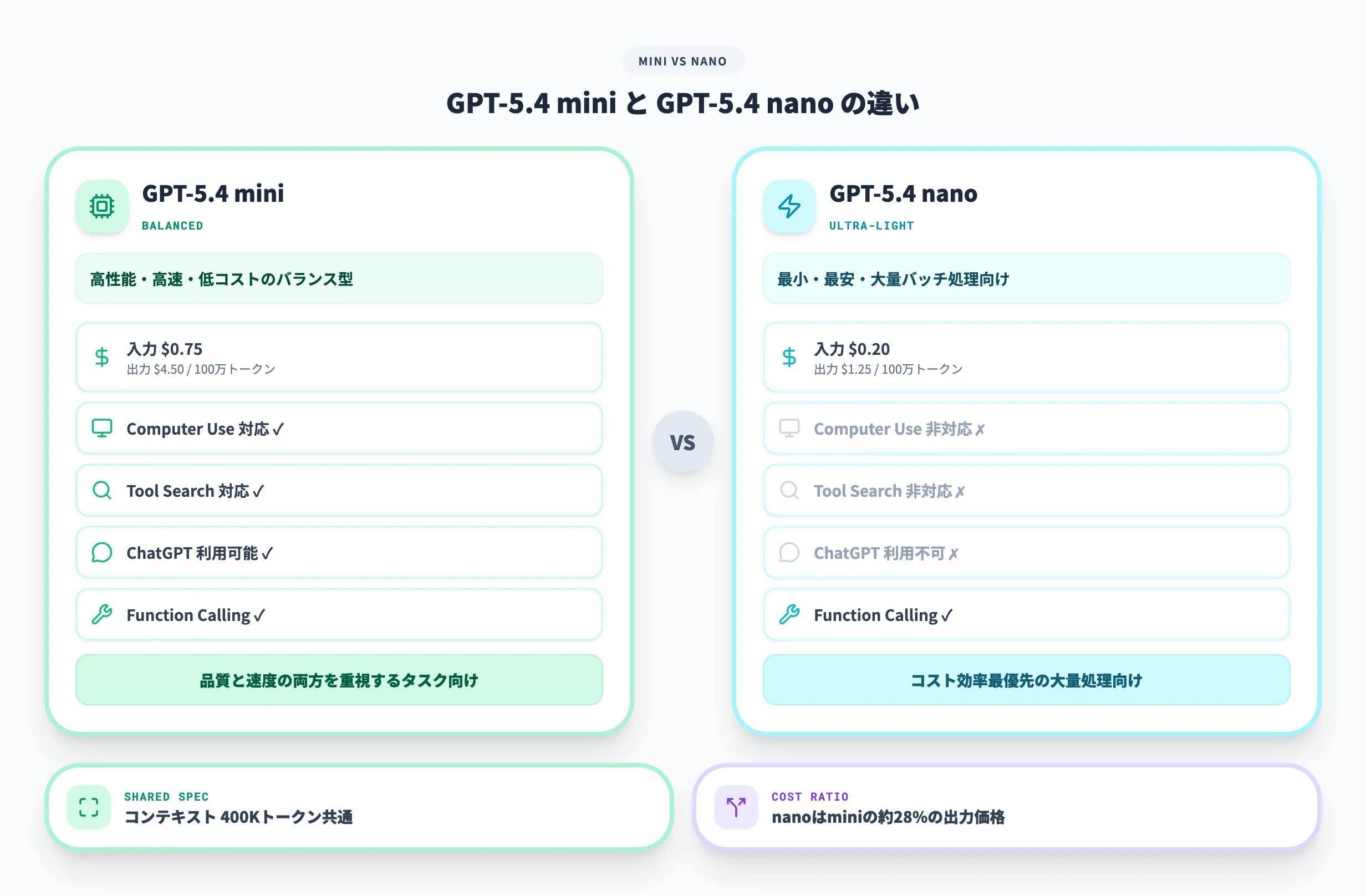

GPT-5.4 miniとGPT-5.4 nanoは同日にリリースされましたが、想定用途と性能特性が明確に異なります。ここでは両者の違いを整理し、どちらを選ぶべきかの判断基準を示します。

スペック・機能の比較

以下の表で、miniとnanoの主要な違いを比較しました。

| 項目 | GPT-5.4 mini | GPT-5.4 nano |

|---|---|---|

| コンテキストウィンドウ | 400,000トークン | 400,000トークン |

| 最大出力トークン | 128,000 | 128,000 |

| 知識カットオフ | 2025年8月31日 | 2025年8月31日 |

| API価格(入力/100万トークン) | $0.75 | $0.20 |

| API価格(出力/100万トークン) | $4.50 | $1.25 |

| Computer Use(PC操作) | 対応 | 非対応 |

| Tool Search | 対応 | 非対応 |

| Web検索 | 対応 | 対応 |

| Function Calling | 対応 | 対応 |

| ChatGPTでの利用 | 利用可能 | 不可(APIのみ) |

コンテキストウィンドウや基本的な入出力仕様は共通ですが、Computer Use(コンピュータ操作)とTool Searchはminiのみの機能です。また、nanoはAPIからのみ利用可能で、ChatGPTのUI上では使えません。

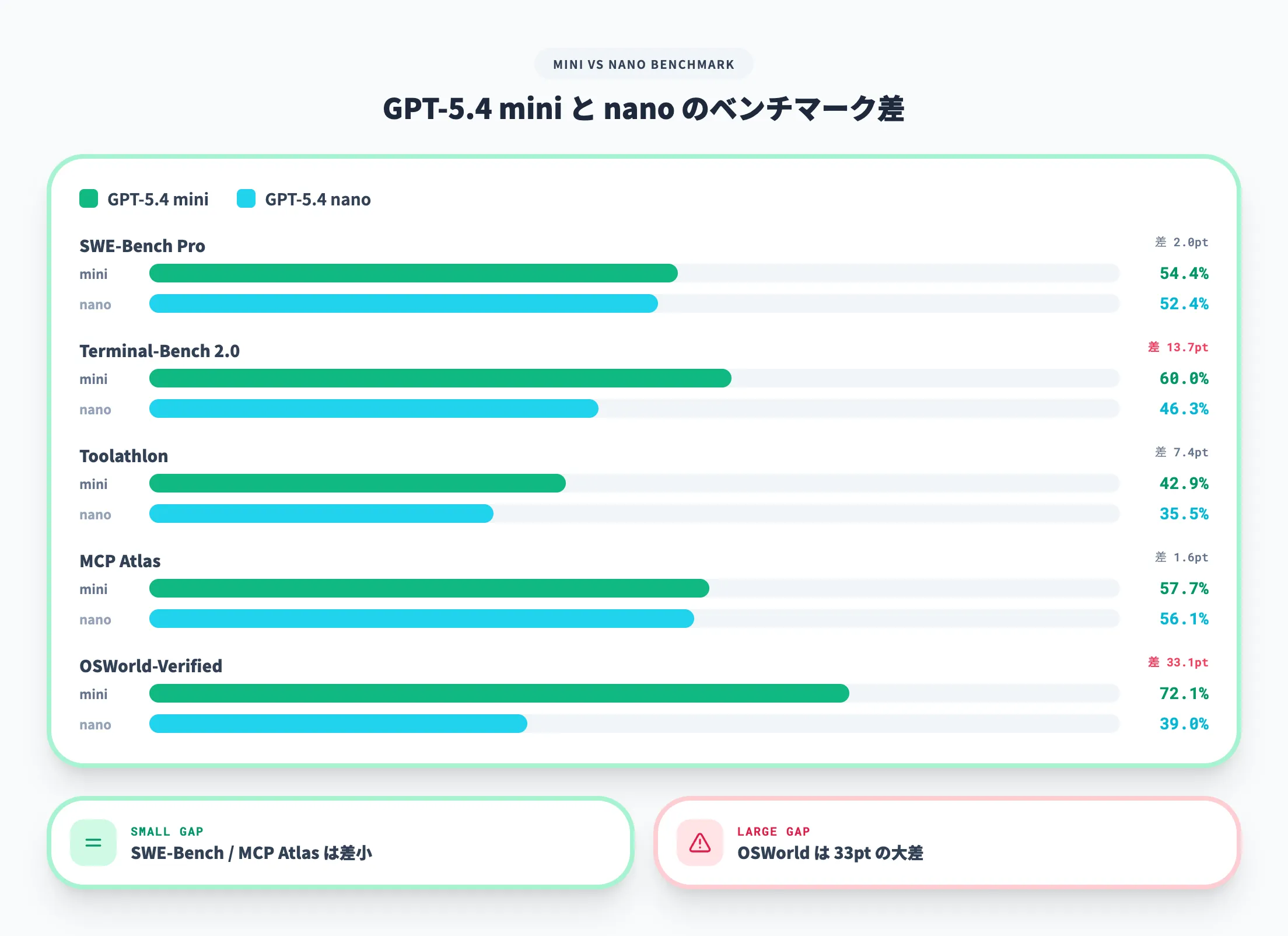

ベンチマークの差

性能面の違いを、主要ベンチマークで確認します。

| ベンチマーク | GPT-5.4 mini | GPT-5.4 nano | 差分 |

|---|---|---|---|

| SWE-Bench Pro | 54.4% | 52.4% | 2.0pt |

| Terminal-Bench 2.0 | 60.0% | 46.3% | 13.7pt |

| Toolathlon | 42.9% | 35.5% | 7.4pt |

| MCP Atlas | 57.7% | 56.1% | 1.6pt |

| OSWorld-Verified | 72.1% | 39.0% | 33.1pt |

SWE-Bench ProやMCP Atlasではminiとnanoの差は小さく、基本的なコーディングやMCPプロトコル対応タスクであればnanoでも実用的な精度が得られます。一方、OSWorld-Verifiedでは33ポイント以上の大差があり、コンピュータ操作タスクではminiが圧倒的に優位です。

使い分けの目安

両モデルの使い分けは、以下の基準で判断すると効率的です。

-

GPT-5.4 miniが向いている場面

コーディングの自動修正、エージェントワークフローのメインタスク実行、コンピュータ操作の自動化、複雑な推論を要する応答生成など、品質と速度の両方が求められるタスクに適している。

-

GPT-5.4 nanoが向いている場面

テキスト分類、データ抽出、定型フォーマットへの変換、大量バッチ処理、マルチエージェントシステムの末端サブエージェントなど、スループットとコスト効率が最優先のタスクに向いている。

実務では、メインの推論・判断をminiが担い、周辺の分類・抽出タスクをnanoが処理するという役割分担が自然です。Simon Willison氏の実験によれば、nanoを使って76,000枚の写真に説明文を付けた場合のコストはわずか約52ドルと試算されており、大量処理におけるコスト効率の高さが実証されています。

小型高速AIモデルの活用を業務プロセスのAI化に結びつける

AI業務自動化ガイドで導入の全体像を把握

GPT-5.4 miniのような低コスト・高速モデルの登場により、AIを業務に組み込むハードルは大幅に下がっています。AI総合研究所のガイドでは、モデル選定から業務への組み込み、運用定着までの実践的なAI導入プロセスを整理しています。

【詳細比較】GPT-5.4 miniと競合モデルの性能・コスト

GPT-5.4 miniの性能と価格を把握したところで、次は同価格帯の競合モデルや上位モデルとの比較を通じて、モデル選定の判断材料を整理します。

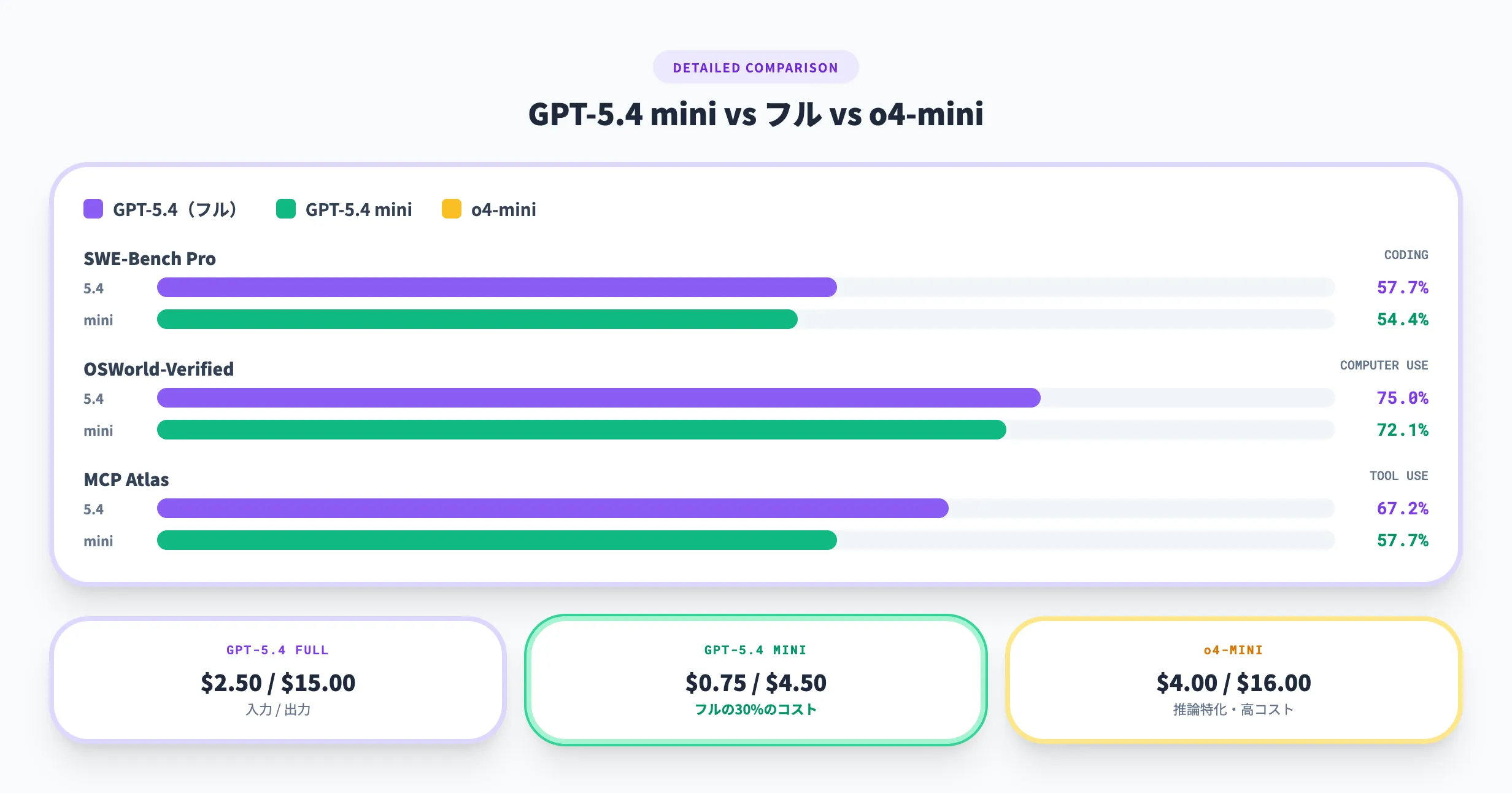

GPT-5.4フルモデルとの比較

まず、同じGPT-5.4ファミリー内でのフルモデルとの差を確認します。

| 項目 | GPT-5.4(フル) | GPT-5.4 mini | コスト比 |

|---|---|---|---|

| API入力(/100万トークン) | $2.50 | $0.75 | miniはフルの30% |

| API出力(/100万トークン) | $15.00 | $4.50 | miniはフルの30% |

| SWE-Bench Pro | 57.7% | 54.4% | 差 3.3pt |

| OSWorld-Verified | 75.0% | 72.1% | 差 2.9pt |

| Terminal-Bench 2.0 | 75.1% | 60.0% | 差 15.1pt |

| MCP Atlas | 67.2% | 57.7% | 差 9.5pt |

コストが約3分の1でありながら、SWE-Bench ProやOSWorldではフルモデルとの差がわずか3ポイント前後にとどまっています。Terminal-BenchやMCP Atlasではやや差が開くものの、多くの実用タスクではminiで十分な品質が得られる水準です。

つまり、最高精度が必要な局面ではフルモデル、コスト効率を重視する大多数のタスクではminiという使い分けが合理的です。現在GPT-5.4フルモデルを利用中のプロジェクトでも、タスクの難易度に応じてminiに振り分けることでAPI費用を大幅に削減できる可能性があります。

o4-miniとの比較

o4-miniはOpenAIの推論特化モデルで、数学やロジック問題に強みがあります。

| 項目 | GPT-5.4 mini | o4-mini |

|---|---|---|

| 設計思想 | 汎用・高速 | 推論特化 |

| API入力(/100万トークン) | $0.75 | $4.00 |

| API出力(/100万トークン) | $4.50 | $16.00 |

| コンテキストウィンドウ | 400,000 | 200,000 |

| Computer Use | 対応 | 非対応 |

o4-miniは数学・科学推論では高いスコアを出しますが、価格はGPT-5.4 miniの5倍以上です。汎用的な開発タスクやエージェントワークフローでは、GPT-5.4 miniのほうがコストパフォーマンスに優れています。o4-miniは数学オリンピック級の高難度推論や、厳密な論理検証が求められる限定的なシナリオでの利用が適切です。

他社モデルとの位置づけ

GPT-5.4 miniと同クラスの小型・高速モデルとして、ClaudeのSonnet 4.6やGeminiの2.5 Flashなどが挙げられます。

各社がそれぞれ異なるベンチマークセットを公開しているため単純な横並び比較は難しいものの、2026年3月時点の小型モデル市場では「コーディングとツール使用に強いGPT-5.4 mini」「総合バランスのClaude Sonnet 4.6」「長文コンテキストと多言語のGemini 2.5 Flash」という棲み分けが見られます。

自社のユースケースに合ったモデルを選定するためには、実際のタスクデータで各モデルを評価(A/Bテスト)することが最も確実です。ベンチマークスコアの差よりも、自社の具体的なタスクでの出力品質とレイテンシが実運用では重要になります。

GPT-5.4 miniの使い方

GPT-5.4 miniは複数のプラットフォームから即日利用可能です。ここでは主要な4つの利用方法を解説します。

ChatGPTでの利用

ChatGPTでのGPT-5.4 miniの提供形態は、プランによって異なります。

2026年3月時点では、ChatGPT上の「Thinking」機能はGPT-5.4 Thinkingとして提供されています。GPT-5.4 miniがChatGPTのUI上でどのように利用されるか(直接選択できるのか、フォールバックとして動作するのか等)の詳細は、OpenAI公式ヘルプで最新の提供状況を確認してください。

なお、GPT-5.4 nanoはChatGPTのUI上では提供されておらず、API経由のみの利用です。

APIでの利用

OpenAI APIからは、モデルIDとしてgpt-5.4-miniを指定するだけで利用できます。

主な対応エンドポイントは以下のとおりです。

- Responses API(現行の推奨エンドポイント)

- Chat Completions(テキスト生成)

- Batch API(大量リクエストの非同期処理)

推論トークン(Reasoning)を有効にすることで、より精度の高い応答を生成させることも可能です。ただし推論トークン分のコストが加算されるため、タスクの複雑さに応じて使い分ける必要があります。

また、Structured Outputs(構造化出力)にも対応しており、JSON形式での出力を厳密に制御できます。APIレスポンスのパース処理を簡素化したい場合に有効です。

Azure AI Foundryでの利用

Azure OpenAI Serviceを通じて、Azure AI Foundryからも利用可能です。

Microsoft Tech Communityの発表によると、以下のデプロイメントオプションが提供されています。

-

Standard Global

利用可能。グローバルリージョンで展開。

-

Data Zone US

利用可能。米国データセンターに限定。

-

Data Zone EU

ロールアウト中。EUデータ主権要件がある場合に選択。

Azure経由で利用する場合、MicrosoftのResponsible AIフレームワークに基づく監視・評価・ガバナンスコントロールが適用されます。エンタープライズのセキュリティ要件やコンプライアンス要件がある場合は、Azure AI Foundry経由での利用が推奨されます。

GitHub Copilotでの利用

GitHub Copilotでも、2026年3月17日からGPT-5.4 miniが利用可能になっています。

GitHub Changelogによると、対象プランと利用環境は以下のとおりです。

- 対象プラン Copilot Pro、Pro+、Business、Enterprise

- リクエスト乗数 0.33x(GPT-5.4フルモデルの約3分の1のクォータ消費)

- 対応IDE Visual Studio Code、Visual Studio、JetBrains、Xcode、Eclipse、github.com Web、GitHub Mobile

リクエスト乗数が0.33xということは、同じクォータでGPT-5.4の約3倍の回数リクエストできるということです。日常的なコーディング支援、コードレビュー、デバッグといったタスクでは、フルモデルの代わりにGPT-5.4 miniを使うことでクォータを効率的に活用できます。

Enterprise管理者は、Copilot設定でGPT-5.4 miniポリシーを有効化する必要があります。Bring Your Own Key機能を使い、自社のAPIキーを設定して利用することも可能です。

GPT-5.4 miniの活用シーン・ユースケース

GPT-5.4 miniの性能と価格帯を踏まえ、実際にどのような場面で効果を発揮するかを具体的に見ていきます。

コーディング・開発ワークフロー

SWE-Bench Pro 54.4%、Terminal-Bench 2.0 60.0%というベンチマーク結果が示すように、GPT-5.4 miniはコードの自動生成・修正・レビューにおいて高い精度を発揮します。

開発ワークフローでの具体的な活用例は以下のとおりです。

-

ターゲット編集

既存コードの特定箇所を修正するタスク。バグ修正やリファクタリングで、変更すべき箇所を正確に特定し修正案を生成する。

-

コードベース探索

大規模リポジトリ内でのファイル検索、関数定義の追跡、依存関係の把握。40万トークンのコンテキストウィンドウにより、広範なコードベースを一度に読み込ませて分析できる。

-

フロントエンド生成

デザイン仕様からUIコンポーネントやページレイアウトのコードを生成するタスク。HTML・CSS・Reactコンポーネントの出力に対応。

-

デバッグループ

エラーメッセージとスタックトレースを入力し、原因特定→修正案生成→テスト実行を反復するワークフロー。

GitHub Copilotとの組み合わせでは、フルモデルの3分の1のクォータ消費でこれらのタスクを実行できるため、日常的な開発業務での利用に適しています。

エージェントワークフロー

GPT-5.4 miniが最も力を発揮するのが、AIエージェントのサブエージェントとしての利用です。

マルチエージェントアーキテクチャでは、全体を統括するオーケストレーターが複雑な判断を行い、個々のサブタスクをサブエージェントに委任します。この構成において、GPT-5.4 miniはサブエージェント側のモデルとして以下の強みを持っています。

- ツール使用の精度が高い(Toolathlon 42.9%、MCP Atlas 57.7%)

- Function CallingとStructured Outputsに対応

- 応答速度が速く、エージェント間の連鎖処理でボトルネックになりにくい

- コストが低く、大量のサブタスクを処理しても費用が膨らみにくい

OpenAIの公式発表によると、GPT-5.4 miniはAPI・Codex・ChatGPTで即日提供されており、Codexのアプリ・CLI・IDE拡張・Web版いずれからも利用可能です。オーケストレーターにGPT-5.4フルモデル、サブエージェントにminiやnanoを配置する構成は、性能とコストのバランスを取る実践的なパターンです。

大量データの分類・抽出

GPT-5.4 nanoはさらに低コストですが、GPT-5.4 miniもBatch APIを利用することで大量処理のコスト効率を高められます。Batch APIでは入力$0.375/100万トークン、出力$2.25/100万トークンと、Standard価格の50%で処理可能です。

たとえば、10万件のカスタマーレビューを感情分析する場合、1件あたりの平均トークン数を500トークン(入力)+50トークン(出力)と仮定すると、Batch API利用時の総コストは約$30程度で済みます。

企業導入事例(Notion・Perplexityなど)

GPT-5.4 miniのリリースに際して、複数の企業が導入効果についてコメントしています。

-

Hebbia(金融・法律AI)

CTOのAabhas Sharma氏は、GPT-5.4 miniが「特定のワークロードではフルサイズのGPT-5.4モデルよりも高いエンドツーエンドのパス率を達成した」とOpenAI公式発表の中でコメントしています。金融・法律分野での引用回想や出力品質を、低コストで実現できた事例です。

-

Notion(生産性ツール)

NotionのAIエンジニアリングリードは、GPT-5.4 miniが「以前はプレミアムモデルに限定されていたエージェント型ツールコーリングを、小型モデルが信頼性高く処理できるようになった」とOpenAI公式発表の中で評価しています。フォーカスされた編集やフォーマットタスクを精度高くこなせる点が評価されています。

-

Perplexity(AI検索エンジン)

Deputy CTOのJerry Ma氏は、「GPT-5.4はMiniとNanoの両方で社内評価においてステップフォワードとなった。Miniは強い推論能力を発揮し、Nanoはライブ会話ワークフローにおいてレスポンシブかつ効率的」とOpenAI公式発表の中で述べています。

OpenAIの公式発表では、これらの企業がGPT-5.4 miniおよびnanoを自社ワークフローで評価・検証していると紹介されています。自社のAIプロダクトでモデルコストに課題を感じている場合、GPT-5.4 miniへの切り替えは検討に値するアプローチです。

GPT-5.4 miniの料金体系

GPT-5.4 miniの料金は、利用方法(Standard / Batch / Flex)によって異なります。ここでは2026年3月時点の公式価格を整理し、前世代との比較も含めて解説します。

API料金

以下の表で、GPT-5.4 miniとGPT-5.4 nanoのAPI料金をまとめました。

| モデル | 利用方法 | 入力(/100万トークン) | キャッシュ入力 | 出力(/100万トークン) |

|---|---|---|---|---|

| GPT-5.4 mini | Standard | $0.75 | $0.075 | $4.50 |

| GPT-5.4 mini | Batch / Flex | $0.375 | $0.0375 | $2.25 |

| GPT-5.4 nano | Standard | $0.20 | $0.02 | $1.25 |

| GPT-5.4 nano | Batch / Flex | $0.10 | $0.01 | $0.625 |

Batch APIやFlex処理を活用すれば、Standard価格の50%で利用可能です。リアルタイム応答が不要な大量処理では、これらの低コストオプションを積極的に活用すべきです。

また、キャッシュ入力(同一プロンプトの再利用時)は通常入力の10%の価格で済むため、システムプロンプトの共通化やプロンプトテンプレートの再利用がコスト削減に直結します。

前世代との価格比較

GPT-5 miniからの価格変動を以下の表で確認します。

| 項目 | GPT-5 mini | GPT-5.4 mini | 倍率 |

|---|---|---|---|

| 入力(Standard) | $0.25 | $0.75 | 3.0倍 |

| 出力(Standard) | $2.00 | $4.50 | 2.25倍 |

Standard価格は前世代の2.25〜3.0倍に上昇しています。しかし、ベンチマークではOSWorldで+30ポイント、tau2-benchで+19ポイントという改善幅を考慮すると、性能向上率がコスト増加率を上回っていると評価できます。

特にBatch APIを活用すればGPT-5 miniのStandard価格(出力$2.00)に近い水準(出力$2.25)で利用可能なため、バッチ処理との組み合わせがコスト管理の鍵となります。

コスト最適化のポイント

GPT-5.4 miniのAPI費用を抑えるには、以下のアプローチが有効です。

-

Batch API / Flex処理の活用

リアルタイム応答が不要なタスクはBatch APIで処理し、Standard価格の50%に抑える。

-

キャッシュ入力の最大化

システムプロンプトや共通コンテキストを固定化し、キャッシュヒット率を高める。キャッシュ入力は通常の10分の1の価格。

-

miniとnanoの使い分け

全タスクにminiを使うのではなく、分類や抽出などの単純タスクはnanoに回す。nanoの出力価格はminiの約28%。

-

推論トークンの制御

推論トークン(Reasoning)が不要なタスクでは無効化し、余分なトークン消費を避ける。

月間100万リクエスト規模のアプリケーションでは、これらの最適化を組み合わせることで数千ドル単位のコスト削減が見込めます。

【関連記事】

ChatGPTのモデルとは?OpenAIの最新モデル一覧と特徴を解説【2026年最新版】

ChatGPT APIの料金ガイド 2026年3月最新版 モデル別料金一覧とコスト削減のポイント

小型高速モデルの理解を業務プロセスへのAI導入に活かすなら

GPT-5.4 miniのような低コスト・高速モデルの登場は、AIを業務に組み込むコスト面のハードルを大きく下げています。マルチエージェント構成のサブエージェントとして、あるいは社内チャットボットや文書処理の基盤として、小型モデルの適用先は多岐にわたります。

AI総合研究所では、モデル選定から業務への組み込み、運用定着までを一貫して支援しています。GPT-5.4 miniの特性を理解した上で、自社業務のどの工程からAI化を始めるべきか検討されている方は、AI業務自動化ガイドで実践的な導入プロセスをご確認ください。

小型高速AIモデルの活用を業務プロセスのAI化に結びつける

AI業務自動化ガイドで導入の全体像を把握

GPT-5.4 miniのような低コスト・高速モデルの登場により、AIを業務に組み込むハードルは大幅に下がっています。AI総合研究所のガイドでは、モデル選定から業務への組み込み、運用定着までの実践的なAI導入プロセスを整理しています。

まとめ

GPT-5.4 miniは、OpenAIが2026年3月17日にリリースした小型・高速モデルで、前世代のGPT-5 miniから全面的に性能が向上しました。

本記事で解説した要点を整理すると、以下の3つに集約されます。

-

フルモデルに肉薄する性能を低コストで実現

SWE-Bench ProやOSWorldでGPT-5.4フルモデルとの差がわずか3ポイント前後でありながら、API料金は約3分の1。多くの実用タスクではminiで十分な品質が得られる。

-

サブエージェント時代の中核モデル

ツール使用・Function Calling・Computer Useへの対応と高速な応答速度により、マルチエージェントアーキテクチャにおけるサブエージェントとして有力な選択肢。Hebbia、Notion、Perplexityなどの企業から肯定的な評価コメントが報じられている。

-

多彩な利用経路

OpenAI API、Azure AI Foundry、GitHub Copilot、ChatGPTと幅広いプラットフォームから利用可能。既存のワークフローに大きな変更を加えずに導入できる。

GPT-5.4 miniの導入を検討する場合は、まず現在利用中のモデル(GPT-5 miniやGPT-4o-miniなど)との性能差を実際のタスクデータで評価し、コスト増に見合う改善が得られるかを検証することが次のステップです。