この記事のポイント

LLMのAPIコストを90%以上削減したいなら、蒸留モデルへの置き換えが最も有効な手段。教師モデルの性能の大部分を維持しながら運用コストを劇的に下げられる

エッジデバイスやオンプレミス環境でのAI活用には、蒸留+量子化の組み合わせが最適解。10億〜40億パラメータ規模ならスマートフォンGPUでも動作可能

蒸留モデルの選定はDeepSeek R1蒸留モデル群(MITライセンス)から始めるべき。無料で利用・改変でき、推論能力も実用水準に達している

ただしAnthropicの不正蒸留告発(2026年2月)が示すように、他社モデルからの無断蒸留は法的リスクを伴うため、ライセンス確認は必須

自社で蒸留を行う場合、教師モデルの推論トレースを蒸留データとして使う手法が主流。「考え方」ごと移植できるため、単純なファインチューニングより高い性能が得られる

Microsoft MVP・AIパートナー。LinkX Japan株式会社 代表取締役。東京工業大学大学院にて自然言語処理・金融工学を研究。NHK放送技術研究所でAI・ブロックチェーンの研究開発に従事し、国際学会・ジャーナルでの発表多数。経営情報学会 優秀賞受賞。シンガポールでWeb3企業を創業後、現在は企業向けAI導入・DX推進を支援。

2025年以降、DeepSeek R1やGemma 3など「蒸留モデル」が続々と登場し、AIの世界に大きな変化をもたらしています。知識蒸留とは、大規模モデル(教師モデル)の知識を小型モデル(生徒モデル)へ効率的に移し替える技術のことです。

本記事では、知識蒸留の基本的な仕組みから、LLM時代の主要な蒸留モデル、2026年2月にAnthropicが告発した蒸留モデルの不正利用問題、さらにはコスト効果までを幅広く解説します。

企業のAI導入を検討される方にとって、モデル選定やコスト最適化の判断材料となる情報を網羅的にお届けします。

目次

AIの蒸留(知識蒸留)とは?

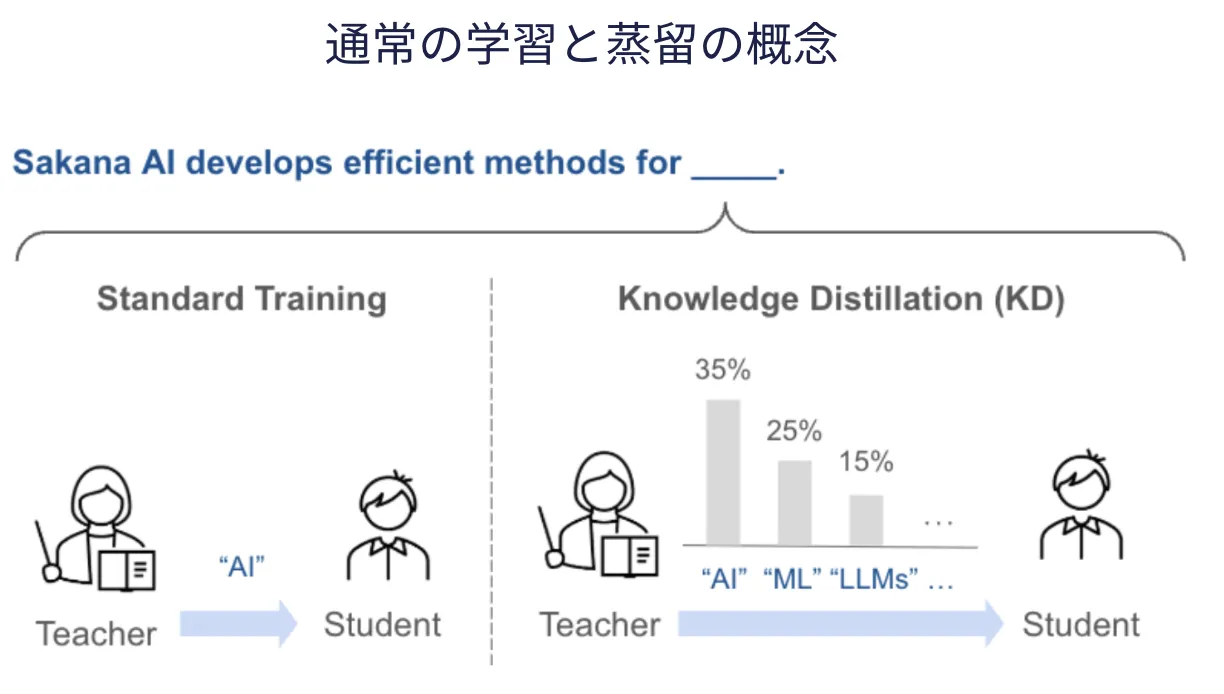

知識蒸留[引用:SakanaAI]](https://sakana.ai/taid-jp/)

知識蒸留(Knowledge Distillation) とは、大きくて高性能なAIモデル(教師モデル / Teacher Model)が持っている知識を、より小さく軽量なモデル(生徒モデル / Student Model)へ移し替える技術のことです。

ディープラーニングの分野では、パラメータ数が多いモデルほど高精度な推論ができる一方で、サイズや推論速度の問題から、実際の利用には高額な計算コストが伴います。知識蒸留を用いると、巨大なモデルが到達した「知識」を小さなモデルに効率良く学習させることが可能になり、推論の高速化やリソース削減を実現できます。

2025年以降、この知識蒸留は大規模言語モデル(LLM)の世界で爆発的に活用されるようになりました。

DeepSeekが公開したR1蒸留モデル群や、GoogleがGemini 2.0から蒸留したGemma 3など、数十億パラメータ規模の蒸留モデルが数百億〜数千億パラメータ規模のモデルに匹敵する性能を示す事例が相次いでいます。

LLM時代における蒸留の位置づけ

2020年代前半まで、知識蒸留はBERTの軽量化(DistilBERT)や画像認識モデルの圧縮が主な用途でした。しかし2025年以降のLLM時代では、蒸留の役割が大きく変わっています。

以下の表に、LLM時代における蒸留の新たな位置づけを整理しました。従来の蒸留がモデルサイズの圧縮を主目的としていたのに対し、現在は推論能力そのものの移植が中心テーマとなっています。

| 観点 | 従来の蒸留(2020年代前半) | LLM時代の蒸留(2025年以降) |

|---|---|---|

| 主な対象 | 画像認識・NLPの分類タスク | LLMの推論・対話・コード生成 |

| 教師モデル | BERT、ResNetなど | GPT-4o、Gemini 2.0、DeepSeek R1など |

| 生徒モデル | DistilBERTなど | Gemma 3、Phi-4、Llama蒸留モデルなど |

| 主な目的 | モデルサイズの圧縮 | 推論能力の移植とコスト削減 |

| 蒸留データ | 既存の学習データ | 教師モデルが生成した推論トレース |

ここで注目すべきは、「蒸留データ」の変化です。従来は既存のデータセットを使って蒸留していましたが、現在は教師モデルに大量のプロンプトを入力して得られる推論トレース(思考過程を含む出力)そのものが蒸留データとして使われています。つまり、優れたモデルの「考え方」を丸ごと別のモデルに教え込む手法が主流になっているのです。

知識蒸留が注目される背景

知識蒸留がこれほどまでに注目されている背景には、AI業界全体を取り巻く複数の構造的な変化があります。ここでは、その主な要因を整理します。

エッジデバイスとオンデバイスAIの需要拡大

スマートフォン、IoT機器、車載システムなど、ネットワーク接続が不安定な環境でもAIを動作させるニーズが急増しています。これらのエッジデバイスではメモリ容量やバッテリー消費量に厳しい制約があるため、数百億パラメータ規模のLLMをそのまま搭載することは現実的ではありません。

知識蒸留によって10億〜40億パラメータ規模に圧縮されたモデルであれば、スマートフォンのGPUやAppleのNeural Engineでも動作が可能です。GoogleのGemma 3(1Bパラメータ版)はまさにこのユースケースを想定して設計されています。

LLMのコスト問題

生成AIを業務に導入する企業が増える一方で、APIの利用コストが大きな課題となっています。GPT-4oクラスのモデルを大量のリクエストで運用すると、月額数十万〜数百万円のコストが発生するケースも珍しくありません。

蒸留モデルは、教師モデルの性能の大部分を維持しながらAPIコストを大幅に削減できるため、企業のAI運用コスト最適化の切り札として位置づけられています。

オープンソースモデルの台頭

2025年はオープンソースAIモデルが飛躍的に成長した年でした。DeepSeek R1の蒸留モデル群がMITライセンスで公開されたことで、誰でも高性能な推論モデルを無料で利用・改変できるようになりました。

以下に、知識蒸留が注目される主な要因をまとめました。これらの要因が複合的に作用することで、蒸留技術への投資と研究が加速しています。

- エッジデバイス需要

モバイル端末やIoT機器でのリアルタイム推論には、軽量化されたモデルが不可欠

- APIコスト削減

大規模モデルのAPI利用料を10分の1以下に抑えることが可能

- オープンソースの民主化

MITライセンスの蒸留モデルにより、中小企業やスタートアップもLLM活用が現実的に

- 推論モデルの進化

推論モデル(Reasoningモデル)の登場により、「考える過程」を蒸留するという新しい手法が確立

特に注目すべきは、推論モデルの進化と蒸留技術の組み合わせです。従来の蒸留では「出力結果」を模倣させていましたが、現在は「思考プロセスそのもの」を蒸留できるようになり、小型モデルでも高度な推論タスクをこなせるようになりました。

知識蒸留の仕組みと主な手法

ここでは、知識蒸留がどのような仕組みで動作するのか、その技術的な基盤を解説します。既存のPyTorch実装例も交えながら、実務で活用する際に必要な知識を整理します。

教師モデルと生徒モデルの関係

知識蒸留において、教師モデルと生徒モデルは以下のような役割を担います。

- 教師モデル(Teacher)

大きくて高精度なネットワーク。あらかじめ学習済みで、推論性能が優れていることが前提となる。GPT-4o、Gemini 2.0、DeepSeek R1などの大規模モデルがこれに該当する

- 生徒モデル(Student)

教師モデルよりもパラメータ数を抑えた小さなネットワーク。最終的にこのモデルがデバイス上やAPIとして動作することを想定する。Gemma 3(4B)、Phi-4-Reasoning(14B)などが代表例

蒸留損失(Distillation Loss)

知識蒸留のカギとなるのが、教師モデルの出力する「ソフトラベル(Soft Label)」を利用することです。

従来の学習では、正解ラベルがone-hot(1つのクラスのみが1で、他は0)になっていることが多いですが、教師モデルのロジット(未正規化の出力)をソフトマックス関数でならして得られる「確率分布」は、クラス間の微妙な確信度の違いを含んでいます。

- 温度パラメータ(Temperature)

ソフトマックスの鋭さを調整するために導入されるパラメータ。高い温度を設定すると出力確率の分布がよりなめらかになるため、生徒モデルが教師モデルから得られる「クラス間の相対的な関係性」を学習しやすくなる

一般的には、生徒モデルの学習時に「蒸留損失(Distillation Loss)」と呼ばれる損失関数を用います。蒸留損失は、以下の2つの要素を組み合わせて計算されます。

- ソフトラベル損失

温度パラメータを適用した教師モデルの出力分布と、同じ温度を適用した生徒モデルの出力分布との間のクロスエントロピー。教師モデルの「判断の傾向」を生徒モデルに伝える役割を持つ

- ハードラベル損失

生徒モデルの出力と正解ラベルとの間の通常のクロスエントロピー。正解データからの学習を維持する役割を持つ

最終的な損失は、この2つをハイパーパラメータ(alpha)で重み付けして合算します。alphaの値によって、教師モデルの知識をどの程度重視するかを調整できます。

蒸留の主な手法

知識蒸留にはいくつかのアプローチがあり、目的や対象モデルによって使い分けられます。以下の表に、代表的な3つの手法を整理しました。

| 手法 | 概要 | 代表例 |

|---|---|---|

| 応答蒸留(Response Distillation) | 教師モデルの最終出力(確率分布)を生徒モデルに学習させる | DistilBERT、DeepSeek R1蒸留モデル |

| 特徴蒸留(Feature Distillation) | 教師モデルの中間層の特徴表現を生徒モデルに学習させる | FitNets、PKT |

| 関係蒸留(Relation Distillation) | データ間の関係性(類似度など)を教師モデルから学習させる | RKD、CRD |

LLM時代の蒸留では、応答蒸留が最も広く使われています。特に、教師モデルに大量のプロンプトを入力して生成された推論トレース(Chain-of-Thought)を学習データとして使う方法が主流です。DeepSeek R1の蒸留モデルは、R1が生成した80万件の推論サンプルを使ってQwen2.5やLlama-3.1を教師あり微調整(SFT)することで作成されています。

PyTorchを用いた蒸留損失の実装例

以下は、蒸留損失を計算するPyTorchの実装例です。教師モデルと生徒モデルのロジットを入力として受け取り、KLダイバージェンスを用いた蒸留損失とクロスエントロピー損失を組み合わせて最終的な損失を算出します。

import torch

import torch.nn.functional as F

def compute_knowledge_distillation_loss(student_logits, teacher_logits, y_true, T=2.0, alpha=0.5):

"""

知識蒸留の損失を計算する関数。

Parameters:

student_logits (Tensor): 生徒モデルのロジット(未正規化の出力)

teacher_logits (Tensor): 教師モデルのロジット(未正規化の出力)

y_true (Tensor): 正解ラベル(クラスのインデックス)

T (float): 温度パラメータ(高いほどソフトな分布になる)

alpha (float): 蒸留損失とハードラベル損失のバランスを決める係数

Returns:

float: 最終的な損失値

"""

# 1. ソフトマックス出力(温度T適用)

p_student = F.log_softmax(student_logits / T, dim=1)

p_teacher = F.softmax(teacher_logits / T, dim=1)

# 2. 蒸留損失(KLダイバージェンスを利用)

distill_loss = F.kl_div(p_student, p_teacher, reduction='batchmean') * (T * T)

# 3. ハードラベル損失(クロスエントロピー)

hard_loss = F.cross_entropy(student_logits, y_true)

# 4. 最終的な損失を計算

total_loss = alpha * distill_loss + (1 - alpha) * hard_loss

# 5. デバッグ用の出力

print("\n=== 知識蒸留の損失計算 ===")

print(f"教師モデルの出力 (logits):\n{teacher_logits}")

print(f"生徒モデルの出力 (logits):\n{student_logits}")

print(f"教師モデルの確率分布 (Softmax):\n{p_teacher}")

print(f"生徒モデルの確率分布 (Log Softmax):\n{p_student}")

print(f"蒸留損失 (Distillation Loss): {distill_loss.item():.4f}")

print(f"ハードラベル損失 (Cross Entropy Loss): {hard_loss.item():.4f}")

print(f"最終的な損失 (Total Loss): {total_loss.item():.4f}")

return total_loss

# サンプルデータを用意(クラス数3、バッチサイズ2のミニバッチ)

torch.manual_seed(42) # 乱数シードを固定

student_logits = torch.randn(2, 3) # 生徒モデルの出力

teacher_logits = torch.randn(2, 3) # 教師モデルの出力

y_true = torch.tensor([0, 2]) # 正解ラベル(クラスインデックス)

# 損失の計算

loss = compute_knowledge_distillation_loss(student_logits, teacher_logits, y_true, T=2.0, alpha=0.5)

出力結果

=== 知識蒸留の損失計算 ===

教師モデルの出力 (logits):

tensor([[ 2.2082, -0.6380, 0.4617],

[ 0.2674, 0.5349, 0.8094]])

生徒モデルの出力 (logits):

tensor([[ 0.3367, 0.1288, 0.2345],

[ 0.2303, -1.1229, -0.1863]])

教師モデルの確率分布 (Softmax):

tensor([[0.6029, 0.1453, 0.2518],

[0.2895, 0.3309, 0.3796]])

生徒モデルの確率分布 (Log Softmax):

tensor([[-1.0478, -1.1518, -1.0989],

[-0.8417, -1.5183, -1.0500]])

蒸留損失 (Distillation Loss): 0.3908

ハードラベル損失 (Cross Entropy Loss): 1.0333

最終的な損失 (Total Loss): 0.7120

上記のコードでは、温度パラメータ T=2.0 を適用した教師モデルのソフトマックス出力と、生徒モデルのlog_softmax出力の間でKLダイバージェンスを計算しています。このアプローチの利点は、教師モデルが持つクラス間の微妙な関係性(たとえば「犬」と「狼」の類似度が高いこと)を生徒モデルに伝達できる点にあります。

さらに、ハードラベル損失と蒸留損失をalpha(ここでは0.5)で混合することで、正解ラベルの情報も失わずに学習を安定させています。実務では、タスクの特性に応じてTとalphaを調整することが重要です。

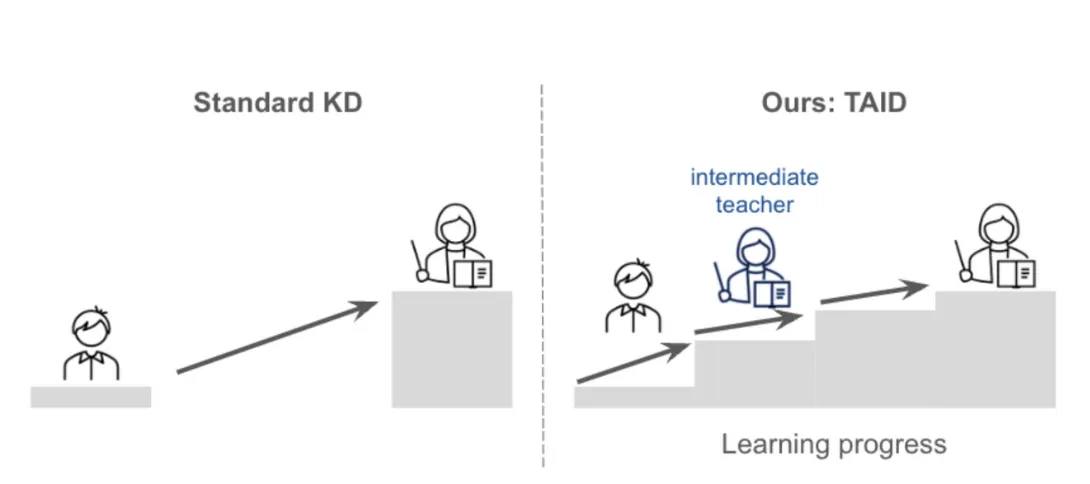

Sakana AIのTAID手法

通常の蒸留とSakanaAIの蒸留引用:https://sakana.ai/taid-jp/

Sakana AIは2025年1月30日に、知識蒸留の新手法「TAID(Temporally Adaptive Interpolated Distillation)」を報告しています。従来の蒸留では、教師モデルと生徒モデルの性能差が大きい場合に知識の伝達が困難でしたが、TAIDでは中間の教師(Intermediate Teacher)を配置することでこの課題を解決しています。

この手法は、教師モデルと生徒モデルの間に段階的な「橋渡し」を設けるイメージです。大きな性能差を一気に埋めるのではなく、段階的に知識を伝達することで蒸留の精度を高めています。

LLM時代の蒸留モデル:主要事例

2025年から2026年にかけて、主要なAI企業から蒸留モデルが相次いで発表されています。ここでは、特に注目すべき事例を整理します。

以下の表に、主要な蒸留モデルの概要をまとめました。教師モデルからどのように知識が移植され、どの程度の性能が実現されているかを確認できます。

| 蒸留モデル | 開発元 | 教師モデル | パラメータ数 | 特徴 |

|---|---|---|---|---|

| DeepSeek R1蒸留モデル | DeepSeek | DeepSeek R1(671B MoE) | 1.5B〜70B(6モデル) | 80万件の推論サンプルでSFT、MITライセンス |

| OpenAI蒸留API | OpenAI | GPT-4o / o1-preview | カスタム | Stored Completions経由でユーザー独自の蒸留が可能 |

| Gemma 3 | Gemini 2.0 | 1B / 4B / 12B / 27B | 4Bモデルが旧Gemma2-27B相当の性能 | |

| Phi-4-Reasoning | Microsoft | o3-mini | 14B | o1-miniやDeepSeek-R1-Distill-70Bを上回る性能 |

| Llama 4 Maverick | Meta | Llama 4 Behemoth(2T) | 17Bアクティブ(128エキスパート) | 共蒸留による動的な損失重み付け |

この表から読み取れる重要なポイントは、蒸留モデルが教師モデルの数十分の1のパラメータ数で、教師モデルに近い性能を発揮している点です。以下、各モデルの詳細を見ていきます。

DeepSeek R1蒸留モデル

DeepSeek R1は671Bパラメータ(MoE構成)の大規模推論モデルですが、そこから蒸留された6つのモデルが2025年1月にMITライセンスで公開され、業界に衝撃を与えました(技術レポート)。

以下の表に、蒸留モデルのラインナップを整理しました。

| モデル名 | パラメータ数 | ベースモデル | 特徴 |

|---|---|---|---|

| DeepSeek-R1-Distill-Qwen-1.5B | 1.5B | Qwen2.5 | 最小モデル。エッジデバイスや組み込み用途を想定 |

| DeepSeek-R1-Distill-Qwen-7B | 7B | Qwen2.5 | 汎用的な推論タスク向け。コストパフォーマンスに優れる |

| DeepSeek-R1-Distill-Llama-8B | 8B | Llama-3.1 | Llamaエコシステムとの互換性が強み |

| DeepSeek-R1-Distill-Qwen-14B | 14B | Qwen2.5 | MATH-500で93.9%の精度を達成。中規模のコーディングタスクにも対応 |

| DeepSeek-R1-Distill-Qwen-32B | 32B | Qwen2.5 | OpenAI o1-miniを複数のベンチマークで上回る性能 |

| DeepSeek-R1-Distill-Llama-70B | 70B | Llama-3.3 | 最大の蒸留モデル。高度な推論や研究用途に適する |

これらのモデルは、DeepSeek R1が生成した80万件の高品質な推論サンプルを使って、Qwen2.5やLlama-3.1をSFT(教師あり微調整)することで作成されています。特筆すべきは、強化学習(RL)の段階を経ずにSFTのみで高い性能を達成している点です。つまり、教師モデルの推論トレースの品質が十分に高ければ、複雑な強化学習プロセスを省略できることを示しています。

OpenAI蒸留API

OpenAIは、独自の蒸留APIをプラットフォーム上で提供しています。開発者は大規模モデル(GPT-4oやo1-previewなど)の出力を自動的に蓄積し、その出力を使ってGPT-4o-miniなどの軽量モデルを微調整できます。

蒸留APIの主要コンポーネントは、以下の3つです。

- Stored Completions

Chat Completions APIで store:true フラグを設定するだけで、入出力ペアを自動保存。レイテンシへの影響なし

- Evals

蒸留したモデルの性能を体系的に評価するための機能

- Fine-tuning連携

保存された出力データをそのままファインチューニングジョブのデータセットとして利用可能

このアプローチの利点は、自社の業務データに特化した蒸留が可能な点です。汎用的なオープンソース蒸留モデルとは異なり、特定のタスクに最適化されたモデルを効率的に作成できます。

【関連記事】

ChatGPT APIとは?OpenAI APIの使い方や料金、活用事例を解説!

Google Gemma 3

Gemma 3は、GoogleがGemini 2.0の技術を基盤として開発したオープンモデルファミリーです。1B / 4B / 12B / 27Bの4サイズ展開で、4B以上のモデルは画像とテキストの両方を処理できるマルチモーダル対応です。

Gemma 3の蒸留効果を象徴するのが、4Bモデルが旧世代のGemma2-27Bモデルと同等の性能を達成している点です。つまり、蒸留によってモデルサイズを約7分の1に圧縮しながら、同じレベルの出力品質を維持しています。27Bモデルに至っては、LMSys Chatbot ArenaでEloスコア1339を記録し、一部のクローズドモデル(非公開モデル)を含むトップ10に入っています。

Microsoft Phi-4-Reasoning

MicrosoftのPhi-4-Reasoningは、14Bパラメータのモデルでありながら、o1-miniやDeepSeek-R1-Distill-Llama-70Bを複数のベンチマークで上回る性能を示しています。

このモデルは、OpenAIのo3-miniが生成した推論デモンストレーションを使ってPhi-4を教師あり微調整することで作成されました。さらに、Phi-4-Reasoning-Plusは短期間の成果ベース強化学習(Outcome-based RL)を追加した強化版で、より長い推論トレースを生成することで精度を向上させています。

14Bパラメータという規模は、ノートPCのような汎用ハードウェアでも動作可能なサイズです。つまり、数十倍のパラメータを持つモデルと同等の推論性能を、手元のデバイスで実現できる可能性を示しています。

Meta Llama 4 Maverick

MetaのLlama 4 Maverickは、約2兆パラメータの巨大モデルLlama 4 Behemothから「共蒸留(Codistillation)」された、17Bアクティブパラメータ(128エキスパート構成のMoE)モデルです。

共蒸留の特徴は、ソフトラベル(教師モデルの出力分布)とハードラベル(正解データ)の損失重みを動的に調整する新しい損失関数を導入している点です。従来の蒸留では固定の重み配分を使うことが一般的でしたが、Llama 4ではトレーニングの進行状況に応じて最適な重み配分を自動で決定します。

GPT-4oやGemini 2.0 Flashを幅広いベンチマークで上回り、100万トークンのコンテキストウィンドウにも対応しています。

蒸留モデルの不正利用問題とAnthropicの告発

2026年2月23日、Anthropicは自社ブログで、Claudeに対する大規模な不正蒸留攻撃を検出・阻止したことを公表しました。この告発は、蒸留技術の倫理的・法的側面に関する重要な議論を提起しています。

不正蒸留の全容

Anthropicが特定した不正蒸留の規模は、以下の通りです。

| 企業 | やり取り件数 | 手法 |

|---|---|---|

| DeepSeek | 15万件以上 | Claudeの推論能力を対象としたクエリ |

| Moonshot AI | 340万件以上 | エージェント推論、ツール使用、コーディングを標的 |

| MiniMax | 1,300万件以上 | 最大規模の蒸留キャンペーン |

合計で約24,000の偽アカウントが作成され、1,600万以上のやり取りが実行されました。これらの企業はClaude商用アクセスが制限されている中国を拠点としており、プロキシサービスを利用して地域制限を回避していたとされています。

特に注目すべきは、攻撃がClaudeの最も差別化された能力、すなわちエージェント推論、ツール使用、コーディングを集中的に標的としていた点です。単にモデルの出力を収集するだけでなく、Chain-of-Thought(思考過程)を大規模に抽出して推論トレーニングデータとして利用していたことが指摘されています。

Anthropicの対策

Anthropicは複数の検出・防御メカニズムを構築しています。

- 行動指紋(Behavioral Fingerprinting)

APIトラフィック内の蒸留攻撃パターンを識別する分類器。アカウント単体ではなく、複数アカウントの連携パターンを検出する

- Chain-of-Thought検出

推論トレースを大規模に引き出すプロンプトパターンを特定するツール

- レスポンスシェーピング

蒸留攻撃と判定されたリクエストに対して、出力を制御・変形する技術

- アクセス制御強化

教育機関アカウントやスタートアッププログラムなど、不正利用されやすい経路の認証を強化

利用規約と法的論点

蒸留の不正利用に関しては、いくつかの法的論点が存在します。

主要なAI企業の利用規約では、モデルの出力を使って競合モデルをトレーニングする行為が明確に禁止されています。OpenAIやAnthropicの利用規約にはこの禁止条項が含まれており、違反した場合はアカウント停止やサービスへのアクセス遮断の対象となります。

一方で、著作権法の観点からは議論が続いています。AIモデルの出力に著作権が成立するか、またモデルの出力を学習データとして使用することがフェアユース(公正利用)に該当するかは、各国の法制度によって判断が分かれる状況です。

企業がAIサービスを利用する際には、利用規約の蒸留禁止条項を確認することが重要です。特に、APIを通じて取得した出力を社内モデルのトレーニングに流用することは、多くのサービスで規約違反となる可能性があります。

知識蒸留と他の軽量化手法との比較

AIモデルの軽量化には、知識蒸留以外にも複数の手法が存在します。ここでは代表的な3つの手法を比較し、それぞれの特性と組み合わせ方を解説します。

以下の表に、主要な軽量化手法の特性を整理しました。

| 手法 | 概要 | 精度への影響 | 推論速度の改善 | 導入の容易さ |

|---|---|---|---|---|

| 知識蒸留 | 教師モデルの知識を生徒モデルに移植 | 小(適切に実施すれば精度劣化は限定的) | 大(モデルサイズ自体が小さくなる) | 中(教師モデルの準備と蒸留プロセスが必要) |

| 量子化(Quantization) | モデルの重みを低ビット精度(INT8、INT4等)に変換 | 小〜中(ビット数に依存) | 中〜大(特にINT4で大幅改善) | 高(既存モデルに後から適用可能) |

| プルーニング(Pruning) | 重要度の低い重みやニューロンを削除 | 中(過度な剪定は精度に影響) | 中(構造化プルーニングで効果大) | 中(再学習が必要な場合あり) |

ここで注目すべきは、これらの手法は相互に排他的ではなく、組み合わせて活用できるという点です。たとえば、DeepSeek R1から蒸留した14Bモデルをさらに4bit量子化すれば、メモリ使用量を大幅に削減しつつ推論性能を維持できます。実際に、ローカルLLMコミュニティでは蒸留モデルの量子化版が広く利用されています。

手法選択の判断基準

どの軽量化手法を選ぶかは、以下の条件によって判断します。

- 精度最優先の場合

知識蒸留を推奨。教師モデルの知識がそのまま移植されるため、タスク固有の精度を最も維持しやすい

- 既存モデルを手軽に高速化したい場合

量子化を推奨。モデルの再学習が不要で、既存の推論パイプラインに後から適用できる

- 特定のハードウェア制約がある場合

プルーニングを推奨。不要なパラメータを削除してモデル構造自体をスリム化する

- 最大限の軽量化が必要な場合

蒸留 + 量子化の組み合わせを推奨。小型モデルをさらに低ビット化することで最小のフットプリントを実現

知識蒸留のメリット・デメリット

知識蒸留は強力な技術ですが、すべてのケースに適しているわけではありません。ここでは、メリットとデメリット、そして向いている場面と向かない場面を整理します。

メリット

知識蒸留の主なメリットは以下の通りです。

- 推論コストの大幅削減

教師モデルの数十分の1のコストで同等レベルの出力品質を実現できる

- エッジデバイスへの展開

モバイル端末やIoT機器など、計算リソースが限られた環境でもAIを活用可能

- レイテンシの改善

モデルサイズが小さいため、応答速度が大幅に向上する。ユーザー体験の改善に直結する

- 知識の選択的移植

特定のタスク(コーディング、推論、多言語対応など)に特化した蒸留が可能

デメリット

一方で、以下のようなデメリットにも注意が必要です。

- 教師モデルの準備コスト

高性能な教師モデルを用意するためには、多大な計算資源とデータが必要。蒸留の恩恵を受けるには、まず大きなモデルのトレーニングが前提

- 性能の上限

生徒モデルの容量には限界があるため、教師モデルとまったく同等の性能を得ることは難しい場合がある

- 蒸留データの品質依存性

教師モデルの出力に誤りやバイアスが含まれている場合、それがそのまま生徒モデルに伝搬する

- ライセンスや法的リスク

前述のAnthropicの告発事例が示す通り、教師モデルの利用規約によっては蒸留行為自体が規約違反となる可能性がある

向いている場面と向かない場面

以下の表に、知識蒸留が向いている場面と向かない場面を整理しました。

| 向いている場面 | 向かない場面 |

|---|---|

| APIコストを削減したい | 教師モデルを用意する予算・リソースがない |

| エッジデバイスでAIを動かしたい | 教師モデルと完全に同じ精度が必要 |

| 特定タスクに特化したモデルが欲しい | 対象タスクが頻繁に変化する |

| 応答速度を高速化したい | 蒸留データ(推論トレース)を大量に生成する余裕がない |

| オフライン環境でAIを使いたい | 教師モデルのライセンスが蒸留を禁止している |

判断のポイントは、「教師モデルの出力を十分に活用できる環境があるか」と「ライセンスの確認が済んでいるか」の2点です。これらが揃っている場合、知識蒸留は非常に費用対効果の高い選択肢になります。

モデル軽量化の知見をAI導入コストの最適化に活かす

AI業務自動化ガイド

知識蒸留によるモデル軽量化は、AI導入のコスト障壁を下げる鍵です。モデル選定からコスト最適化、業務プロセスへのAI組み込みまで、段階的に進めるための実践ステップをガイドにまとめました。

知識蒸留のコスト効果

企業がAIを導入する際、知識蒸留によるコスト削減効果は最も関心の高いテーマの一つです。ここでは、具体的なコスト比較を通じて蒸留の経済的メリットを解説します。

APIコスト比較

以下の表に、代表的なモデルのAPIコストを比較しました。教師モデルと蒸留モデルの間で、どの程度のコスト差が生じるかを確認できます。

2026年2月時点のAPIコスト比較です。価格は各社の公式料金ページに基づいています。

| モデル | 入力コスト(100万トークンあたり) | 出力コスト(100万トークンあたり) | 備考 |

|---|---|---|---|

| GPT-4o | $2.50 | $10.00 | OpenAI のフラッグシップモデル |

| GPT-4o-mini | $0.15 | $0.60 | 蒸留対象として推奨される軽量モデル |

| DeepSeek R1(API) | $0.55 | $2.19 | 671Bパラメータ MoE |

| DeepSeek R1蒸留(セルフホスト) | ホスティング費用のみ | ホスティング費用のみ | MITライセンス、自社サーバーで運用可 |

GPT-4oとGPT-4o-miniを比較すると、入力コストで約94%、出力コストで約94%の削減が可能です。OpenAIの蒸留APIを使えば、GPT-4oの出力品質をGPT-4o-miniに学習させることで、大幅なコスト削減と性能維持の両立を目指せます。

コスト削減のシミュレーション

たとえば、月間100万リクエスト(1リクエストあたり平均500トークンの入出力)を処理する企業のケースを考えてみます。

GPT-4oをそのまま使用した場合の月額コスト概算は、入力・出力合わせて数千ドル規模になります。一方、蒸留APIでGPT-4o-miniにタスク固有の知識を移植して運用すれば、同じワークロードを数百ドル規模で処理できる計算になります。

さらに、DeepSeek R1の蒸留モデル(MITライセンス)を自社サーバーにデプロイすれば、API利用料は不要です。GPU サーバーのホスティング費用のみで運用できるため、大量のリクエストを処理する場合はさらにコストメリットが大きくなります。

ただし、セルフホスティングにはGPUサーバーの初期投資・運用コストやモデルの管理工数が発生するため、リクエスト量やSLAの要件に応じてAPI利用とセルフホスティングを使い分けることが重要です。

モデル軽量化の知見を自社のAI導入コスト最適化に活かすなら

知識蒸留の技術を理解することは、自社に最適なAIモデルの選定とコスト設計に直結します。大規模モデルをそのまま使うのか、蒸留モデルで運用するのかの判断は、AI導入のROIを大きく左右するポイントです。

AI総合研究所では、モデル選定からコスト最適化、業務プロセスへのAI組み込みまで、段階的に進めるための実践ガイドを無料で提供しています。蒸留モデルの活用を含めたAI導入戦略の全体像を確認してみてください。

モデル軽量化の知見をAI導入コストの最適化に活かす

AI業務自動化ガイド

知識蒸留によるモデル軽量化は、AI導入のコスト障壁を下げる鍵です。モデル選定からコスト最適化、業務プロセスへのAI組み込みまで、段階的に進めるための実践ステップをガイドにまとめました。

まとめ

本記事では、知識蒸留の基本概念から最新の蒸留モデル事例、不正利用問題、コスト効果までを解説しました。

知識蒸留は、巨大なAIモデルが持つ豊富な知識をより小型で高速なモデルへと移植する技術であり、2025年以降のLLM時代においてその重要性は飛躍的に高まっています。DeepSeek R1の蒸留モデル群やGoogleのGemma 3、MicrosoftのPhi-4-Reasoningなどの事例が示す通り、蒸留モデルは教師モデルの数十分の1のパラメータ数で匹敵する性能を達成しています。

一方で、2026年2月のAnthropicによる告発が示す通り、蒸留技術の不正利用は業界全体の信頼を揺るがす深刻な問題です。企業がAIモデルの蒸留を検討する際には、利用規約の確認とライセンスの遵守が不可欠です。

これらを踏まえ、知識蒸留を有効に活用するためには以下の3点が重要です。

- 目的に合った蒸留モデルの選定

エッジ展開ならGemma 3(1B〜4B)、推論タスクならDeepSeek R1蒸留モデル(14B〜32B)、自社データ特化ならOpenAI蒸留APIなど、目的に応じた選択が成果を左右する

- ライセンスと規約の確認

MITライセンスのオープンソースモデルを使う場合は自由度が高いが、APIベースの蒸留では各サービスの利用規約を必ず確認する

- 量子化との組み合わせによる最適化

蒸留モデルをさらに量子化することで、エッジデバイスや低コスト環境での展開が現実的になる

AI総合研究所は企業のAI活用をサポートしています。モデル選定や蒸留戦略に関するご相談は、お気軽にお問い合わせください。