この記事のポイント

EU向けに高リスクAIを提供する企業はXAI対応が必須。2026年8月のAI Act全面適用で違反時は最大3,500万ユーロの罰則

XAIツールの第一候補はSHAP。理論的根拠が最も強く、特徴量間の相互作用も考慮できる

リアルタイム性が求められるシステムにはLIMEを選ぶべき。SHAPより計算が軽量でモデル非依存

Chain-of-Thoughtは「説明可能性」ではない。生成AIの内部メカニズム透明化には機構的解釈可能性(回路トレーシング)が必要

不正検知AIにXAIを統合すると検知率25%向上・誤検知30%削減。AIの判断を「根拠を確認して活用する」運用設計が最も高い成果を生む

Microsoft MVP・AIパートナー。LinkX Japan株式会社 代表取締役。東京工業大学大学院にて自然言語処理・金融工学を研究。NHK放送技術研究所でAI・ブロックチェーンの研究開発に従事し、国際学会・ジャーナルでの発表多数。経営情報学会 優秀賞受賞。シンガポールでWeb3企業を創業後、現在は企業向けAI導入・DX推進を支援。

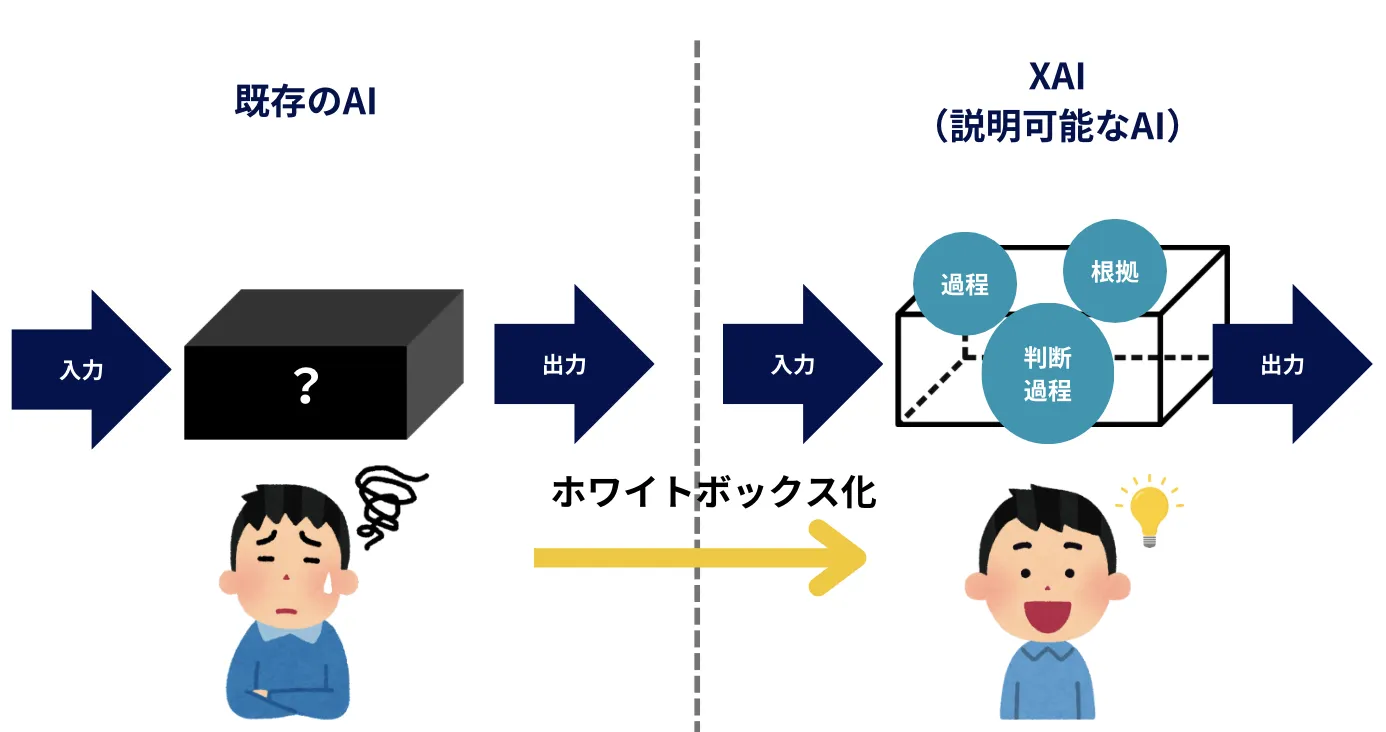

XAI(説明可能なAI)とは、AIの意思決定プロセスを透明化し、人間が理解可能な形で説明する技術です。ディープラーニングのブラックボックス問題を解消し、AIの判断根拠を可視化することで、信頼性・公平性・法令遵守を実現します。

2026年8月にはEU AI規制法の高リスクAI義務が全面適用され、AIの説明可能性は「あると望ましい」から「法的に必須」へと位置づけが変わります。XAI市場は2025年に約112.8億ドル規模に成長し、年平均17.8%で拡大を続けています。

本記事では、XAIの主な手法(SHAP・LIME)から生成AI時代の最新トレンド(機構的解釈可能性・回路トレーシング)、企業活用事例、導入課題、ツール料金比較まで体系的に解説します。

目次

機構的解釈可能性(Mechanistic Interpretability)

コンサルティング — AI導入・運用支援サービス(日立コンサルティング)

金融分野 — 経済予測プラットフォーム(xenodata lab.)

XAI(説明可能なAI)とは

XAIは出力に至るまでの根拠や過程が人間に「説明可能なAI」

XAI(Explainable Artificial Intelligence、説明可能なAI)とは、AIの意思決定プロセスを透明化し、人間が理解可能な形で説明する技術です。従来のAIモデル、特にディープラーニングは「ブラックボックス」と呼ばれ、数百万〜数兆のパラメータが複雑に絡み合うため、AIがなぜその結論に至ったのかを人間が理解することが困難でした。

XAIは、このブラックボックスを開き、「AIがどの入力データのどの特徴に注目して判断を下したのか」を明らかにする技術群です。たとえば、銀行のAIがローン審査で「不承認」と判断した場合、XAIを用いると「年収が基準を下回っていること」と「過去の延滞履歴」が判断の主要因であることを可視化できます。

Precedence Researchの調査によると、世界のXAI市場は2025年に約112.8億ドルに達し、2035年には579億ドルへとCAGR 17.8%で成長する見込みです。この急成長の背景には、2026年8月のEU AI規制法(AI Act)の高リスクAI義務の全面適用があります。AIの説明可能性は「あると望ましい機能」から「法的に必須の要件」へと位置づけが大きく変わりつつあるのです。

以下の表で、XAIの主要な概念を整理します。

| 概念 | 説明 |

|---|---|

| 説明可能性(Explainability) | AIモデルの判断プロセスを人間が理解できる形で提示する能力 |

| 解釈可能性(Interpretability) | AIモデルの内部構造や動作メカニズムを人間が直接理解できる度合い |

| 透明性(Transparency) | AIシステムの設計・学習データ・判断基準が開示されている状態 |

| ブラックボックス | 入力と出力の関係は分かるが内部の判断プロセスが不透明なモデル |

| ホワイトボックス | 内部の判断プロセスが人間に理解可能なモデル(決定木、線形回帰等) |

この表の「説明可能性」と「解釈可能性」は似ていますが、厳密には異なる概念です。解釈可能性はモデルそのものの構造的な理解しやすさを指し、説明可能性はモデルの判断結果に対する事後的な説明能力を指します。決定木のように本来解釈可能なモデルもあれば、複雑なディープラーニングモデルにXAI手法を適用して事後的に説明可能性を付与するアプローチもあります。

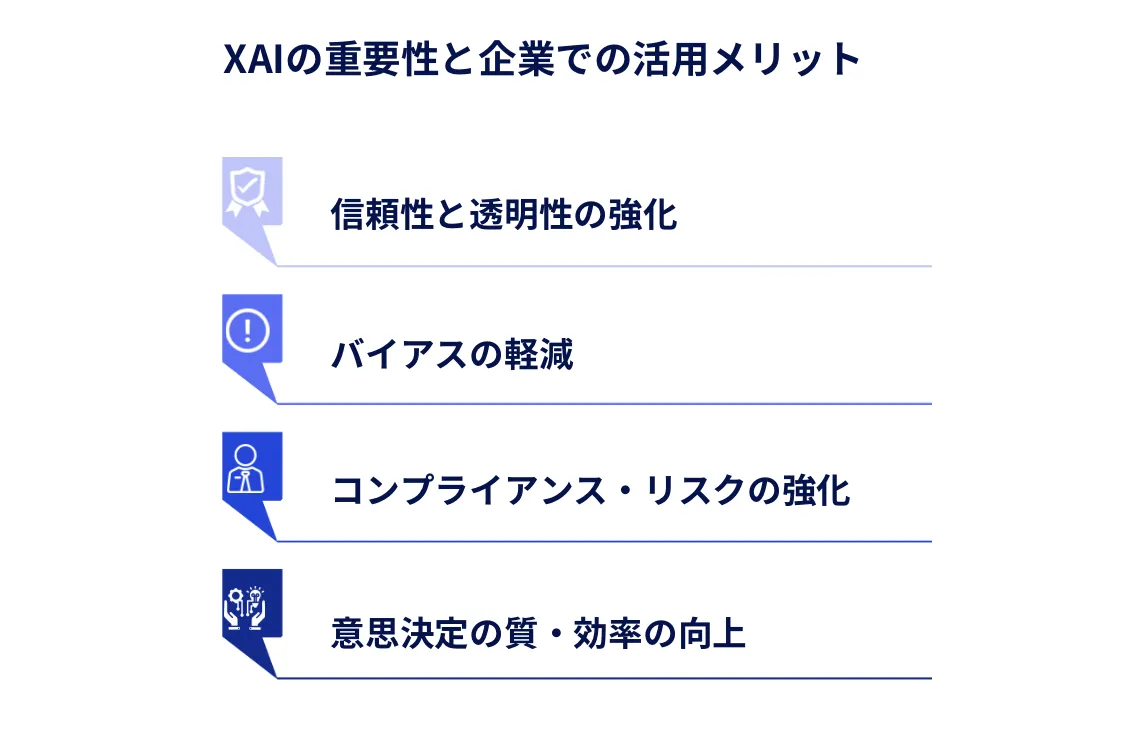

XAIの重要性とメリット

XAIの重要性は、AIが社会のあらゆる分野で意思決定を担うようになるにつれて急速に高まっています。特に2025-2026年は、法規制の本格施行によりXAIが「技術的な選択肢」から「ビジネス上の必須要件」へと変わる転換点です。

XAIの重要性と企業での活用メリット4つ

信頼性と透明性の強化

XAIを活用することで、AIの意思決定プロセスを可視化し、ユーザーや利害関係者の信頼を獲得できます。Deloitteの調査によると、消費者の**70%**がAI利用を透明に開示する企業をより信頼すると回答しています。一方で、グローバルなAI信頼度は過去5年間で61%から53%へ低下しており、透明性の確保が信頼回復の鍵です。

医療診断でAIが「このレントゲン画像にがんの疑いがある」と判断した場合、XAIがなければ医師はその判断を鵜呑みにするか無視するかの二択になります。XAIにより「左肺下葉の陰影パターンがリスク因子として高スコアを示している」と根拠が示されれば、医師はAIの判断を専門知識と照らし合わせて検証でき、AIと人間の協働による精度向上が実現します。

バイアスの検出と公平性の確保

AIモデルには、訓練データに内在するバイアスが反映されるリスクがあります。XAIを用いることで、モデルが特定の属性(年齢・性別・人種等)に基づいて不公平な判断を行っていないかを検証し、必要に応じてモデルを調整できます。

たとえば、採用AIが「女性の応募者に対して系統的に低い評価を与えている」ことをSHAP分析で検出できれば、訓練データの偏りを是正する対策を講じることが可能です。公平性の確保は倫理的な要請であると同時に、企業のレピュテーションリスクを回避するビジネス上の判断でもあります。

法規制への対応(EU AI Act・日本AI法)

2026年は、XAIにとって法規制の観点で最も重要な年です。EU AI規制法(AI Act)は2024年8月に発効し、2026年8月2日に高リスクAIシステムへの義務が全面適用されます。高リスクAIに分類されるシステム(信用審査、採用選考、医療診断等)には、透明性・説明可能性の義務、技術文書の整備、人間による監視体制の構築が求められます。違反時の罰則は最大3,500万ユーロまたはグローバル売上の7%です。

日本でも2025年6月に「人工知能関連技術の研究開発及び活用の推進に関する法律(AI法)」が公布され、9月に全面施行されました。日本版AI法は罰則を伴わないソフトロー型ですが、AIの透明性確保が法律で明文化された意義は大きいです。日本企業がEU向けに高リスクAIを提供する場合はEU AI Act準拠が必須であり、XAIへの対応は輸出ビジネスの前提条件ともなります。

意思決定の質と効率の向上

XAIにより、AIモデルの判断根拠を理解できるため、人間の専門家がその結果を検証し、必要に応じて介入する「ヒューマン・イン・ザ・ループ」の仕組みを構築できます。これにより、AIと人間の協働が促進され、より質の高い意思決定が可能になります。

金融分野の事例では、不正検知AIにXAIを統合したシステムで、アナリストがAIのフラグ理由を確認してから判断するワークフローを導入した結果、不正検知率が25%向上し、誤検知(false positives)が30%削減されたという報告があります。AIの判断を「盲目的に信頼する」のでも「無視する」のでもなく、「根拠を確認して活用する」ことが最も高い成果を生むのです。

XAIの主な手法とツール

XAIには多様な手法がありますが、大きく「大域的説明(Global Explanation)」と「局所的説明(Local Explanation)」の2つのアプローチに分類されます。ここでは、それぞれの代表的な手法と、実務で利用される主要ツールを解説します。

大域的説明(Global Explanation)

大域的説明は、AIモデル全体の振る舞いを解釈するアプローチです。「このモデルは全体としてどの入力特徴を重視しているか」を把握できるため、モデルの設計段階や品質管理で特に有用です。

主な手法を以下に整理します。

-

特徴量重要度

モデル全体で各入力特徴量がどの程度予測に影響しているかを数値化する手法。ランダムフォレストやXGBoostなどのツリーベースモデルでは標準的に算出可能で、最も直感的に理解しやすい

-

部分依存プロット(PDP)

特定の特徴量の値を変化させた場合にモデルの予測がどう変わるかを視覚化する手法。「年収が500万円から800万円に変化するとローン承認確率がどう変わるか」といった関係性を把握できる

-

モデル近似(代理モデル)

複雑なモデルの振る舞いを、より解釈しやすい単純なモデル(決定木など)で近似する手法。全体的な傾向の把握には有効だが、複雑なモデルの挙動を完全に再現できない場合がある

局所的説明(Local Explanation)

局所的説明は、個々の予測や判断に焦点を当て、「この1件の予測結果がなぜこうなったのか」を説明するアプローチです。顧客への説明責任や監査対応で特に重要です。

-

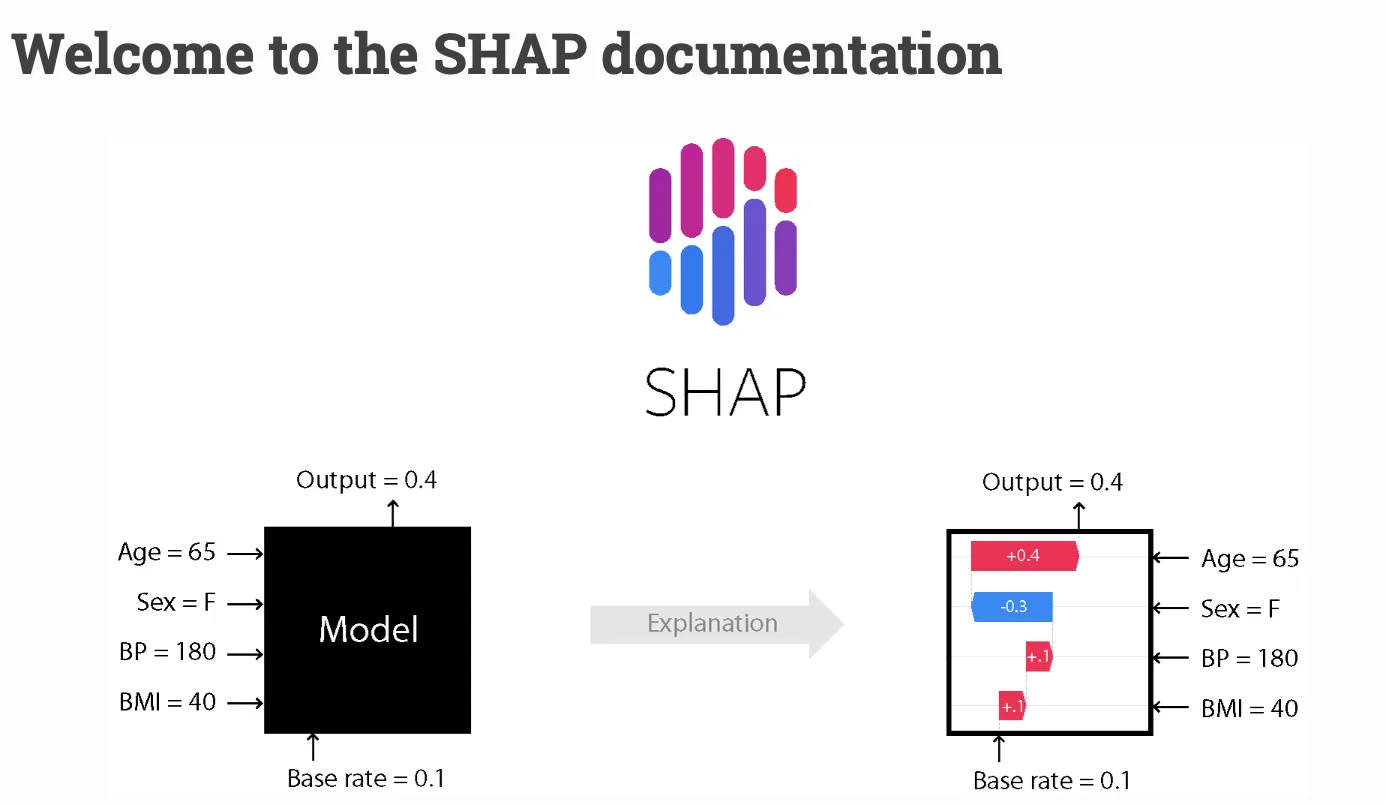

SHAP(SHapley Additive exPlanations)

ゲーム理論のシャープレイ値を応用し、各特徴量が個別の予測にどれだけ貢献したかを定量的に計算する手法。理論的な裏付けが強く、特徴量間の相互作用も考慮できるため、現在最も広く使われているXAI手法

-

LIME(Local Interpretable Model-agnostic Explanations)

予測対象のデータポイント周辺で入力をわずかに変化させ、その結果の変化パターンを線形モデルで近似することで説明を生成する手法。モデルの種類を問わず適用できる汎用性が特徴

-

反事実説明(Counterfactual Explanation)

「もし入力がこう変わっていたら結果はどうなっていたか」を提示する手法。「年収があと50万円高ければローンは承認されていた」のような、行動可能な説明を生成できる

以下の表で、代表的なXAIツールを比較します。

| ツール | 手法 | 対象モデル | 特徴 |

|---|---|---|---|

| SHAP | シャープレイ値 | モデル非依存 | 理論的根拠が強い、可視化が豊富 |

| LIME | 局所的代理モデル | モデル非依存 | 軽量で高速、画像・テキストにも対応 |

| What-If Tool | 反事実分析 | TensorFlow/XGBoost | Google製、インタラクティブな探索が可能 |

| Captum | 勾配ベース手法 | PyTorchモデル | Meta製、IG/DeepLIFT等を統合 |

| InterpretML | 多手法統合 | モデル非依存 | Microsoft製、EBM(解釈可能モデル)を内蔵 |

SHAP

SHapley Additive exPlanations (参考:SHAP)

SHAPは、AIの個々の予測に対して各特徴量の貢献度を定量的に算出するXAIツールです。たとえば、AIが「この植物は水が足りていない」と判断した場合、SHAPを使うと「葉の色」が予測に最も大きく影響し、次いで「土の湿り具合」が重要であることを具体的な数値で示せます。

SHAPの強みは、ゲーム理論のシャープレイ値に基づく数学的に厳密な計算方法を採用していることです。これにより、特徴量間の相互作用を考慮した上で、各特徴量の「公平な」貢献度を算出できます。ウォーターフォールプロット、ビープロット、依存性プロットなど豊富な可視化機能も備えており、技術者だけでなくビジネスサイドへの説明にも活用されています。

LIME

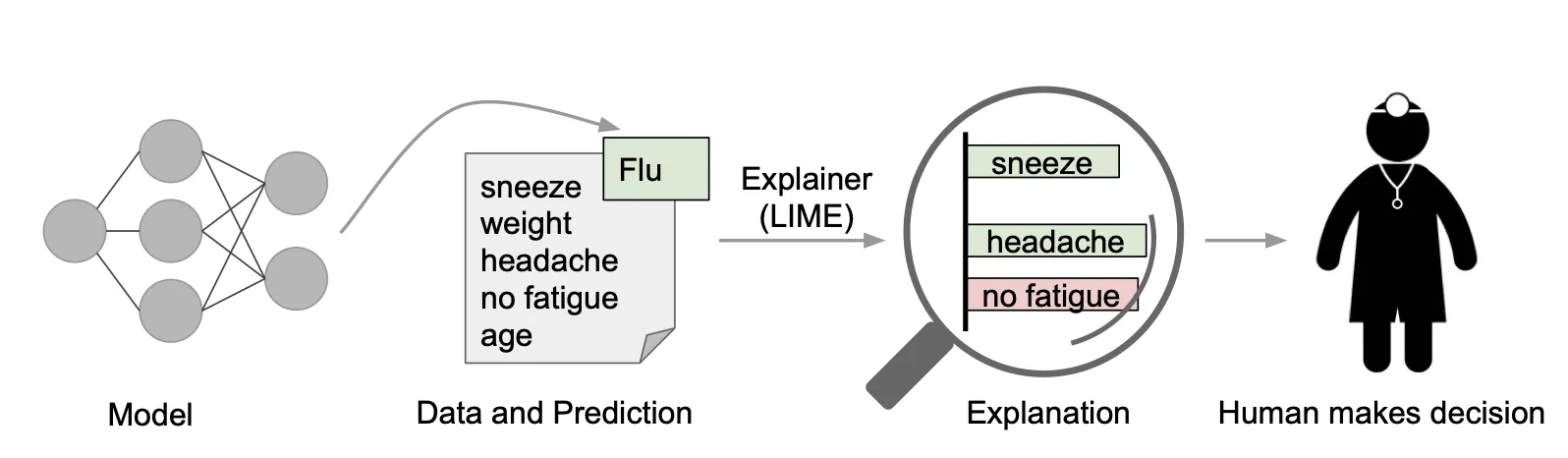

LIMEによる予測要因の可視化例 (参考:"Why Should I Trust You?" Explaining the Predictions of Any Classifier)

LIMEは、複雑なAIモデルの個別予測を、シンプルな線形モデルで局所的に近似することで説明を生成するツールです。予測対象のデータポイント周辺で入力をわずかに変化させ、モデルの出力がどう変わるかを観察して、最も影響の大きい特徴量を特定します。

LIMEの最大の利点はモデル非依存性です。ディープラーニング、ランダムフォレスト、SVM など、どのようなモデルにも適用できます。また、テーブルデータだけでなく、画像(どの領域が判断に影響したか)やテキスト(どの単語が判断に影響したか)にも対応しており、マルチモーダルなAIシステムの説明にも使えます。SHAPと比較して計算が軽量であるため、リアルタイム性が求められるシステムでの利用に適しています。

What-If Tool

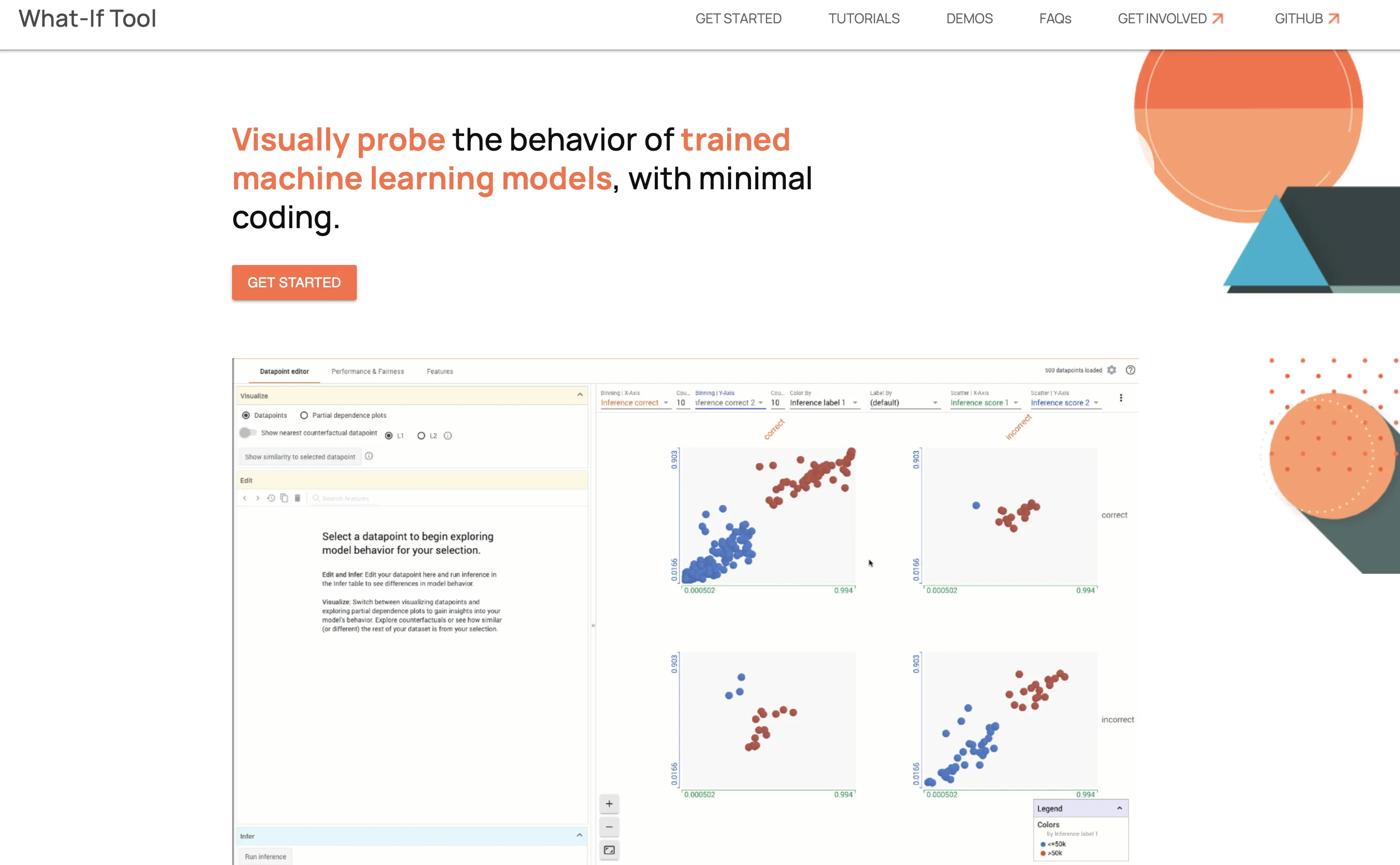

What-If Tool (参考:What-If Tool)

Googleが開発したWhat-If Toolは、AIモデルの振る舞いをインタラクティブに探索できるビジュアル分析ツールです。「もし入力をこう変えたら、AIの判断はどう変わるか」という仮説検証を、コーディングなしで直感的に行えます。

たとえば、AIがローン審査で「不承認」と判断した場合、What-If Toolでは年収や借入額のパラメータをスライダーで変更して、どの条件が変われば承認に転じるかをリアルタイムで確認できます。公平性の分析機能も内蔵しており、性別や年齢によるモデルの判断差異を視覚的に検出できます。TensorFlowおよびXGBoostモデルに対応しており、Jupyter Notebook上で利用可能です。

生成AI時代のXAI

ChatGPTの登場以降、生成AIが急速に普及する中で、XAIの対象と手法にも大きな変化が起きています。ここでは、2025-2026年に注目されている生成AI時代のXAIの最新動向を解説します。

Chain-of-Thoughtは「説明」なのか

生成AIの分野では、Chain-of-Thought(CoT、思考の連鎖)プロンプティングにより、AIが推論過程をステップバイステップで出力する手法が広く使われています。一見するとXAIの役割を果たしているように見えますが、2025年のCHI(Human-Computer Interaction)ワークショップでの研究では、CoTは説明可能性を提供しておらず、エンドユーザーの理解向上にもつながらないと指摘されています。

CoTが出力する「推論ステップ」は、モデルが実際に内部で行っている計算とは必ずしも一致しません。これは「説明なき説明(explanations without explainability)」と呼ばれる問題で、人間にとって理解しやすいテキストが生成されているだけで、モデルの内部メカニズムの透明化には至っていないのです。生成AIの説明可能性には、CoTとは異なるアプローチが必要だという認識が研究コミュニティで広がっています。

機構的解釈可能性(Mechanistic Interpretability)

CoTの限界を超えるアプローチとして注目されているのが、機構的解釈可能性(Mechanistic Interpretability)です。MIT Technology Reviewは、機構的解釈可能性を「2026年のブレークスルー技術」に選定しました。

機構的解釈可能性は、AIモデルの内部でニューロンやパラメータがどのように情報を処理しているかを、「回路」として解析するアプローチです。Anthropicは2025年に回路トレーシング(Circuit Tracing)という技術を発表し、Claudeの内部推論を「帰属グラフ(Attribution Graphs)」で可視化することに成功しました。

回路トレーシングでは、たとえば「ダラスはどの州にありますか」という質問に対して、モデル内部で「ダラス→テキサス→オースティン(州都)」という多段推論の中間表現が形成されていることが確認されています。また、詩を書く際にモデルが韻を踏む単語を事前に計画していることも発見されました。Anthropicはこの技術をClaude Sonnet 4.5のデプロイ前安全性評価に初めて適用し、AIモデルの安全性検証に機構的解釈可能性を実用した世界初の事例となりました。

AIエージェント時代のXAI課題

2025年以降、AIエージェントが自律的にタスクを遂行する時代に入り、XAIの対象がさらに拡大しています。AIエージェントは、マルチステップの計画立案、外部ツールの呼び出し、他システムとの連携を自律的に行うため、既存のSHAPやLIMEのような「入力と出力の関係を説明する」手法だけでは対応できません。

Gartnerは、2026年末までに企業アプリケーションの40%がタスク特化型AIエージェントを組み込むと予測しています。エージェントレベルの説明可能性を確保するには、推論の各ステップとツール呼び出しの全ログを記録・分析する「可観測性(Observability)」の仕組みが必要です。つまり、XAIの対象は「1つのモデルの1つの予測」から「複数のモデルが連携する一連のプロセス全体」へと拡大しており、これは今後のXAI研究の重要な課題です。

XAIの活用事例

XAIは医療・建設・製造・金融・コンサルティングなど多様な産業で活用されています。ここでは、AIの判断根拠を可視化することで実際のビジネス成果につながった事例を紹介します。

医療分野 — 肝がん発症リスク予測(日本IBM)

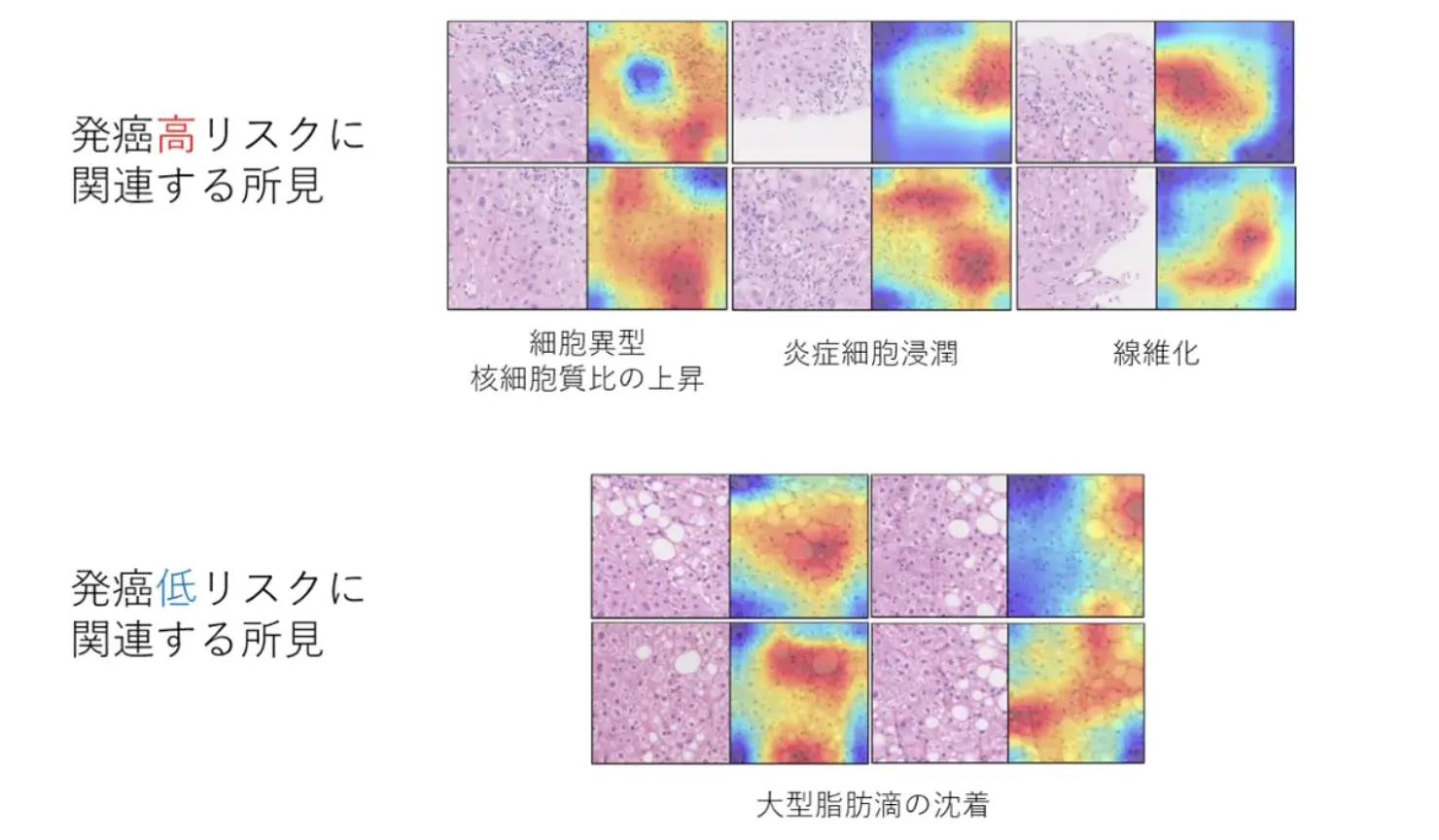

XAIが注目した肝がん発症に関連する病理学的所見

日本IBMは、肝生検デジタル病理画像を基に、脂肪肝から肝がん発症リスクを予測するAIモデルを開発しました。このAIモデルは、従来の指標だけでは発見しにくい肝がんのリスクを、微細な病理所見から高精度で予測します。

XAI技術のGrad-CAM++を用いて、AIがどの病理画像の部分に注目しているのかを明示化し、人の目では見過ごされがちなサインを可視化しました。これにより、病理医がAIの判断根拠を確認したうえで臨床判断を下せるようになり、肝がんの早期発見と適切なフォローアップが可能となっています。XAIが医療現場での「AIと医師の協働」を実現した代表的な事例です。

参考: Deep learning and digital pathology powers prediction of HCC development in steatotic liver disease / 脂肪肝病理画像から発がんを予測するAIモデル

建設分野 — コンクリート構造物の劣化要因診断(IHI)

![]()

AIcon診断のサービス概要

IHIグループは、コンクリート構造物の劣化要因をAIで診断する「AIcon診断サービス」を開発しました。損傷写真から変状を識別する「変状識別AI」と、劣化要因を推定する「劣化推定AI」の2段階のAI機能を備え、XAI技術を利用して劣化要因の根拠を明示します。

診断結果は専門家がチェックし、適切な対策工法を提示する受託サービスとして提供されています。利用者が予算や現場条件に応じた概算工費を算定できるシステムも利用可能です。インフラの老朽化が社会課題となる日本において、XAIによる「根拠の可視化」が専門家不足を補完する仕組みとして機能しています。

参考: 橋梁などインフラ構造物の点検・診断をサポートする2つのツールを開発

製造業 — タイヤ設計支援システム(横浜ゴム)

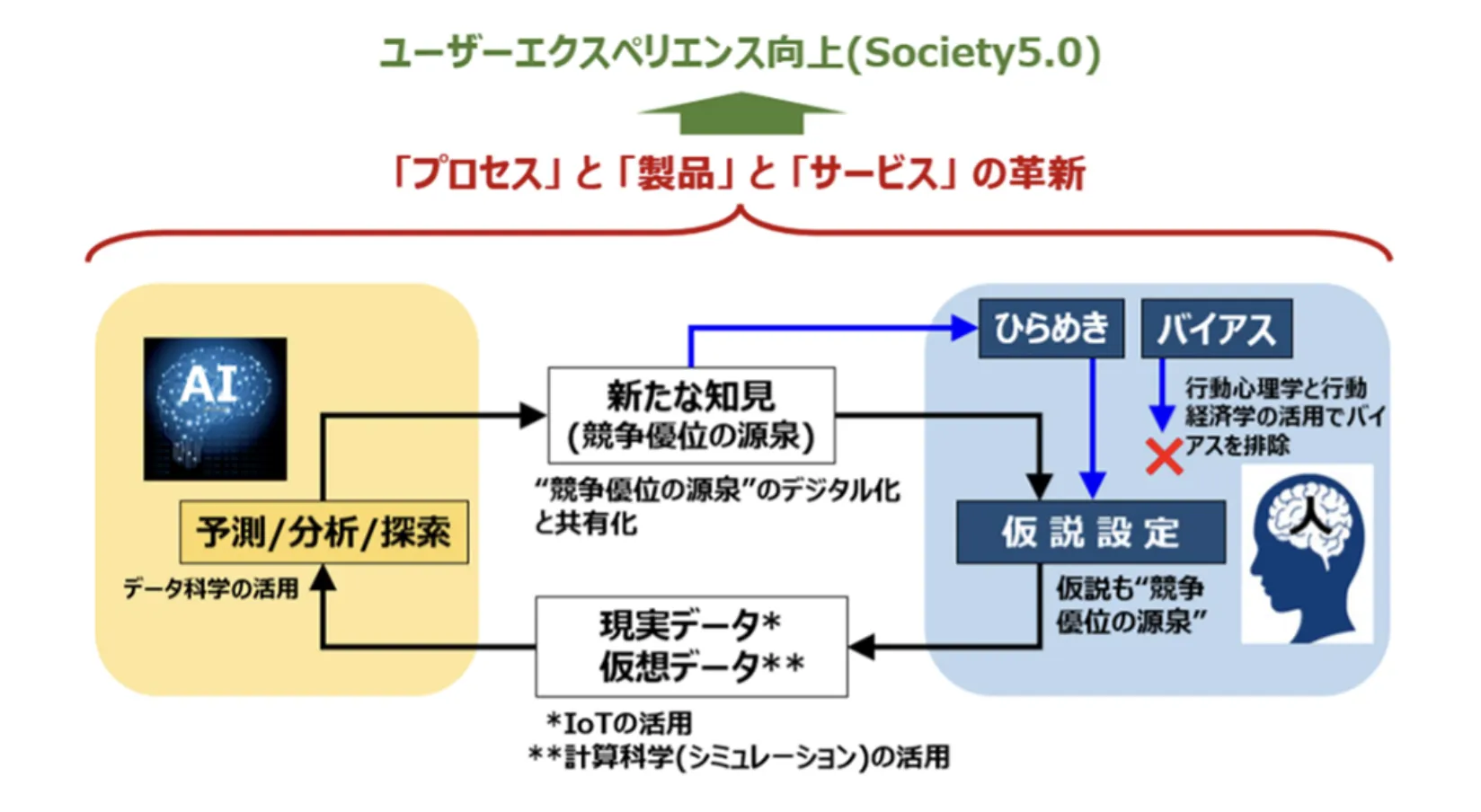

HAICoLabの概念図

横浜ゴム株式会社は2024年7月、XAIを活用したタイヤの設計支援システム「HAICoLab」を独自開発しました。技術者がタイヤ設計において求める特性を効率的に達成できるよう支援し、特に経験の浅い技術者でもスピーディに高性能なタイヤを設計できるように設計されています。

システムはXAI技術のSHAPをカスタマイズしており、タイヤの性能予測に対する各設計パラメータの貢献度を視覚的に表示します。従来はベテラン技術者の暗黙知に依存していた「どのパラメータを変更すれば目標性能に近づくか」という判断を、AIの根拠提示によって経験年数に関わらず実行できるようになりました。製造業における技術知見の継承にXAIが貢献する好例です。

参考: 横浜ゴム、XAIを活用したタイヤ設計支援システムを独自開発

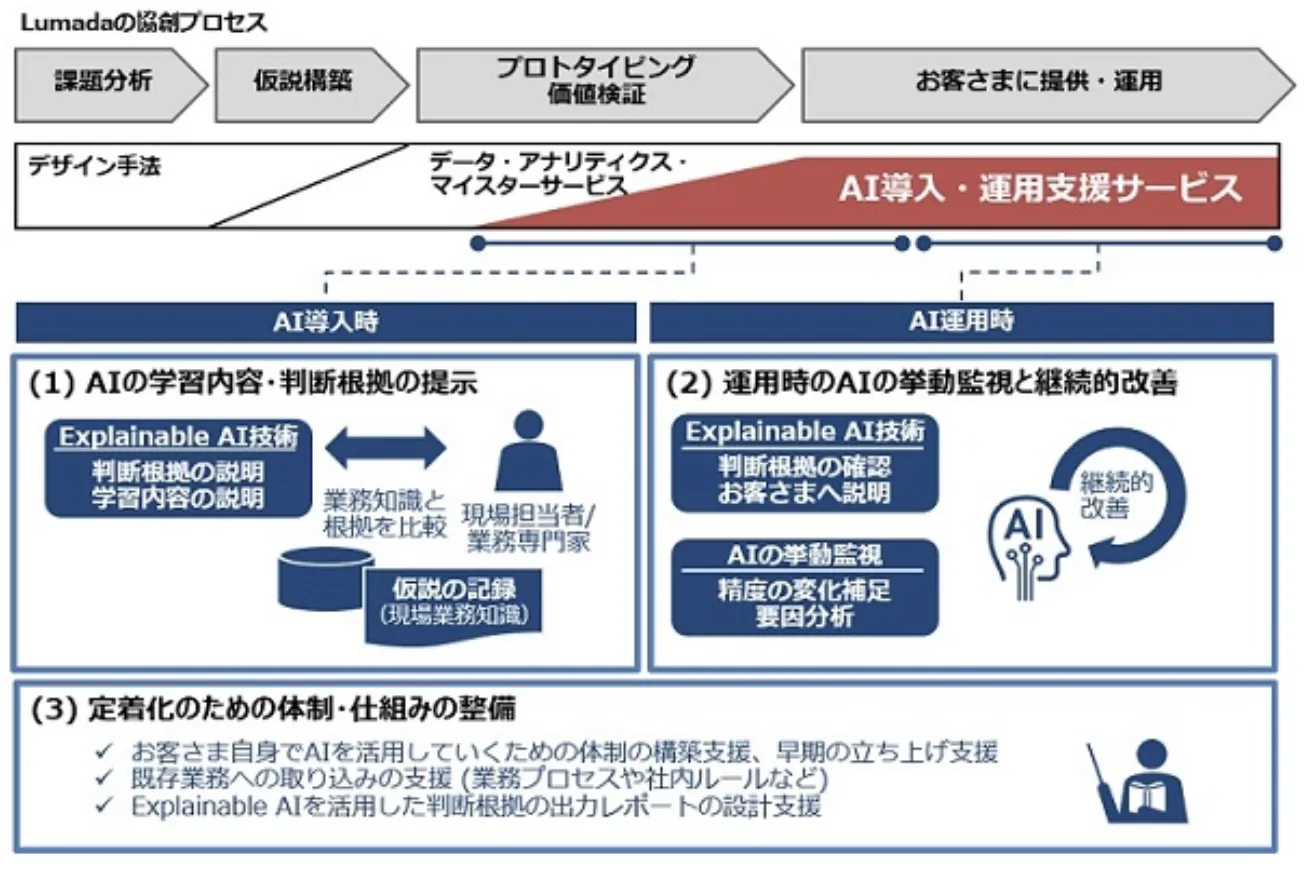

コンサルティング — AI導入・運用支援サービス(日立コンサルティング)

AI導入・運用支援サービスの概要

日立コンサルティングは、XAIを活用した「AI導入・運用支援サービス」を提供しています。業務システムにAIを適用する際、XAIを用いてAIの予測や判断の根拠を明確にし、現場担当者との見解の一致を図りながらAIモデルの継続的な改善を支援します。

運用中のAI挙動を監視し、XAIでモデルの精度低下の原因を特定・改善することで、重要な業務でのAI適用を推進しています。XAIの導入により、現場の「AIの判断が分からないから使いたくない」という心理的障壁を解消し、AI利用率の向上と業務改善の好循環を生み出す仕組みです。体制整備やAIガバナンスの強化も含めた包括的なDX支援として提供されています。

参考: Explainable AI(XAI)を活用し、AI導入・運用支援サービスを提供開始

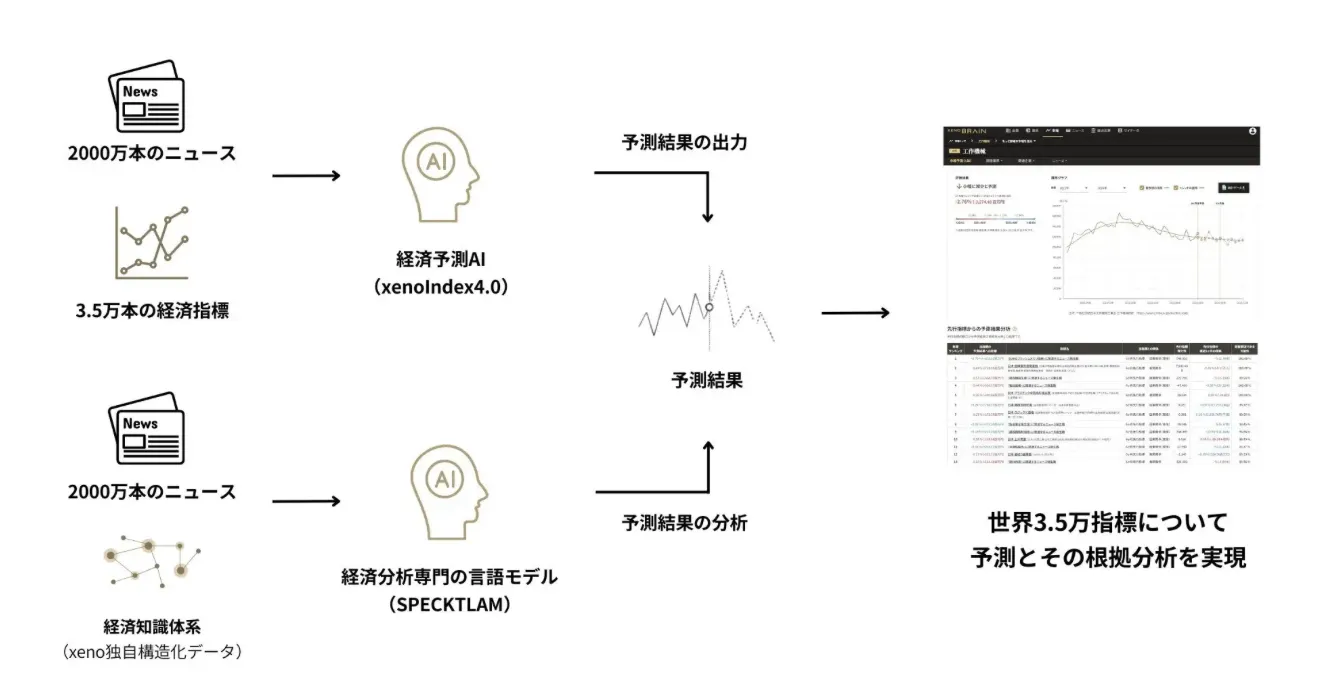

金融分野 — 経済予測プラットフォーム(xenodata lab.)

xenoIndex(ゼノインデックス)「予測根拠分析」機能概要図

株式会社xenodata lab.は、経済予測プラットフォーム「xenoBrain」において、XAIを活用した「予測根拠分析」機能をリリースしました。独自の言語モデル「SPECKTLAM」を使用し、AIが生成した経済予測の要因分析を行います。

この機能により、AIが経済予測を行う際の根拠となる先行指標やニュースの動きを視覚的に確認できるようになりました。予測対象への影響や関連性を詳細に把握できるため、金融機関のアナリストがAI予測を投資判断に活用する際の信頼性が向上しています。金融分野では規制当局への説明責任が特に厳しく求められるため、XAIによる予測根拠の透明化はコンプライアンス対応としても重要です。

参考: 経済特化生成AIのゼノデータ、説明可能なAI(XAI)として経済予測根拠分析機能をリリース

金融分野 — 不正検知のXAI活用(American Express)

American Expressは、SHAPやLIMEを活用したXAI対応の不正検知モデルで、年間8億件以上(取引額1.2兆ドル超)のトランザクションをリアルタイムに分析しています。不正検知率が6%向上し、年間推定20億ドル相当の潜在的不正を新たに特定する成果を上げています。

XAIの導入により、不正対策チームが「なぜこの取引がフラグされたのか」をSHAPの貢献度スコアで即座に把握できるようになり、調査効率と判断精度の両方が向上しました。数百万件の正常な取引の中から不正を検出する作業において、XAIはAIの検知能力と人間の判断力を最適に組み合わせる接点として機能しています。

XAI導入の課題と注意点

XAIには大きなメリットがある一方で、導入にあたって向き合うべき課題も存在します。ここでは、企業がXAIを検討する際に知っておくべき3つの課題を解説します。

XAI導入に向けての課題

精度と説明可能性のトレードオフ

XAIの最も根本的な課題は、AIモデルの予測精度と説明可能性の間にしばしばトレードオフが生じることです。一般に、決定木や線形回帰のように解釈しやすいモデルは精度が低く、ディープラーニングのように高精度なモデルは解釈が困難です。

SHAPやLIMEはこのトレードオフを緩和するために「高精度モデルに事後的に説明を付与する」アプローチを取りますが、その説明がモデルの内部メカニズムを正確に反映しているかどうかには限界があります。2025年の研究では、画像分野においてIntegrated GradientsやSmoothGradがLIMEやGrad-CAMよりも高い忠実度と安定性を示すという結果も報告されており、XAI手法の選択にはドメインとデータ形式に応じた検討が必要です。

導入コストと専門人材

XAIの導入には、ツールのライセンス費用だけでなく、XAIの結果を正しく解釈し業務に適用できる専門人材の確保が必要です。McKinseyの調査(2024年)によると、組織の**40%がXAIを生成AI導入の主要リスクと認識している一方で、対策に取り組んでいるのはわずか17%**にとどまっています。

SHAPやLIMEなどのオープンソースツール自体は無料で利用できますが、それらを自社のAIシステムに統合し、出力結果をビジネスサイドに分かりやすく伝達する仕組みを構築するには、データサイエンスとドメイン知識の両方を持つ人材が不可欠です。AI人材の育成と外部パートナーの活用を組み合わせた体制構築が現実的なアプローチです。

PoC倒れからの脱却

社内で「XAIツールを導入してみたが、出力されるグラフや数値の意味が現場に伝わらず、結局使われていない」という声が上がっている場合、それはXAIの技術選定以前に「誰に、何を、なぜ説明するか」の設計が不足している可能性があります。

XAI導入を成功させるには、まず「説明の受け手」を明確にすることが出発点です。規制当局への説明なのか、現場の業務担当者への説明なのか、顧客への説明なのかによって、求められる説明の粒度と形式が異なります。段階的な導入として、まずは1つの業務プロセス(たとえばローン審査やクレーム検知)でSHAPによる特徴量重要度の可視化から始め、効果を確認してから他の業務に展開するアプローチが有効です。AI導入の課題を理解したうえで計画を立てることが、PoC倒れを回避する第一歩です。

XAIの知見を業務でのAI導入に活かす

AI業務自動化ガイド

AIの判断根拠を説明する技術を理解しているなら、次は業務での実践です。AI総合研究所のAI業務自動化ガイドでは、信頼性の高いAI運用の設計から社内展開までを220ページで体系的にまとめています。

XAIツールの料金比較

XAIの導入を具体的に検討するうえで、主要ツール・サービスの料金体系を把握しておくことは重要です。ここでは、2026年3月時点の主要XAIツールの料金を比較します。

以下の表で、主要ツールの料金と特徴を整理します。

| ツール/サービス | 料金 | 主な機能 |

|---|---|---|

| SHAP(OSS) | 無料 | シャープレイ値による貢献度算出、豊富な可視化 |

| LIME(OSS) | 無料 | モデル非依存の局所的説明、画像・テキスト対応 |

| Captum(OSS) | 無料 | PyTorch向け、Integrated Gradients等の勾配ベース手法 |

| InterpretML(OSS) | 無料 | Microsoft製、解釈可能モデル(EBM)を内蔵 |

| What-If Tool(OSS) | 無料 | Google製、インタラクティブな反事実分析 |

| AWS SageMaker Clarify | 従量課金(処理量ベース) | SHAP統合、バイアス検出、モデル監視 |

| Google Cloud Vertex AI | 従量課金(予測リクエストベース) | 特徴量帰属、モデル評価、What-If Tool統合 |

| Fiddler AI | 要問い合わせ(エンタープライズ) | モデル監視、説明可能性、バイアス検出を統合 |

この料金比較から分かるのは、XAIの主要ツール(SHAP、LIME、Captum、InterpretML、What-If Tool)はすべてオープンソースで無料利用が可能であるという点です。XAI導入のコストは「ツール費用」ではなく「人材確保と統合開発」にかかるということが明確です。

エンタープライズ向けには、AWS SageMaker ClarifyやGoogle Cloud Vertex AIのようにクラウドプラットフォームにXAI機能が組み込まれたサービスが利用できます。既にこれらのクラウドでAIモデルを運用している場合は、追加のXAIツール導入なしに説明可能性を実装できるため、最も効率的なアプローチです。

2026年3月時点の情報です。最新の料金・機能は各サービスの公式サイトで確認してください。

XAIの知見を業務でのAI導入に活かすなら

AIの判断根拠を説明する技術を理解したなら、次は業務のAI化に踏み出す準備が整っています。XAIで培った「AIの出力を検証する」視点は、社内のAI導入プロジェクトで品質管理や意思決定プロセスを設計する際に直接役立つスキルです。

AI総合研究所では、AI導入の計画策定から運用定着までを220ページのガイドにまとめています。説明可能性を担保しながら業務にAIを組み込む具体策を知りたい方は、ぜひダウンロードしてみてください。

XAIの知見を業務でのAI導入に活かす

AI業務自動化ガイド

AIの判断根拠を説明する技術を理解しているなら、次は業務での実践です。AI総合研究所のAI業務自動化ガイドでは、信頼性の高いAI運用の設計から社内展開までを220ページで体系的にまとめています。

まとめ

本記事では、XAI(説明可能なAI)の定義と重要性、主な手法(SHAP・LIME)、生成AI時代の最新トレンド、企業活用事例、導入課題、そしてツール料金比較まで体系的に解説しました。

XAI導入のポイントを整理すると、以下の3点に集約されます。

-

2026年はXAIの「法的義務化元年」

EU AI規制法の高リスクAI義務が2026年8月に全面適用され、AIの説明可能性は法的に必須の要件となる。日本AI法も2025年9月に施行済み。EU向けにAIサービスを提供する日本企業にとって、XAI対応は事業継続の前提条件

-

生成AI時代のXAIは従来手法を超える段階に

Anthropicの回路トレーシングがMIT Technology Review「2026年ブレークスルー技術」に選定されたように、LLMの内部メカニズムを直接解析するアプローチが実用化フェーズに入っている。CoTの限界が明確化する中で、機構的解釈可能性が次世代XAIの中心技術となる見通し

-

XAIツールは無料で始められる

SHAP・LIME・Captumなどの主要ツールはすべてオープンソースで無料利用が可能。導入コストのボトルネックはツール費用ではなく人材と組織体制の構築にある

XAIの導入を検討しているなら、まずは自社のAIシステムの中で最も説明責任が問われる業務(信用審査、人事評価、医療判断等)を特定し、SHAPによる特徴量重要度の可視化から始めてみてください。オープンソースツールでPythonの数行のコードから試せるため、技術検証のハードルは低いです。生成AIの企業導入と合わせて、AIの信頼性と透明性を両立する体制を構築することが、2026年以降のAI活用の成功要件です。