この記事のポイント

EU AI Actの段階適用が進む2026年、AIガバナンス体制の構築は「やるかどうか」ではなく「いつ始めるか」の段階。未対応企業は早急に着手すべき

グローバル展開企業はEU AI Actを基準に、国内中心の企業は経産省ガイドラインを軸にガバナンス設計するのが最適

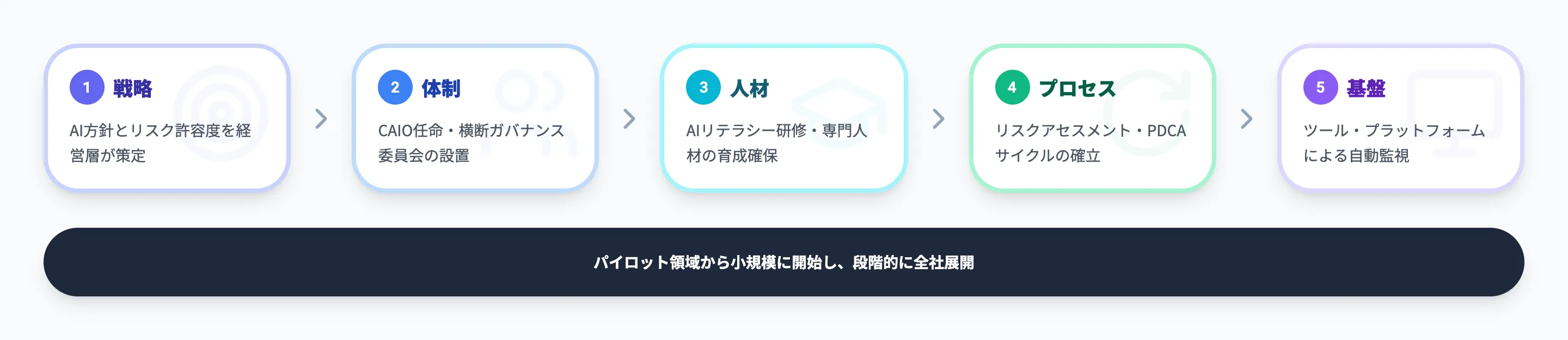

構築は「戦略→体制→人材→プロセス→基盤」の5ステップで段階的に進めるべき。一括導入は失敗リスクが高い

AIエージェントの自律判断が広がる中、権限制御と監査ログの仕組みを最優先で整備すべき。従来のモデル監視だけでは不十分

ツール選定はAzure AI Content SafetyやAWS AI Service Cardsなど既存クラウド連携を軸に、自社のAI基盤に合わせて選ぶのが有効

Microsoft MVP・AIパートナー。LinkX Japan株式会社 代表取締役。東京工業大学大学院にて自然言語処理・金融工学を研究。NHK放送技術研究所でAI・ブロックチェーンの研究開発に従事し、国際学会・ジャーナルでの発表多数。経営情報学会 優秀賞受賞。シンガポールでWeb3企業を創業後、現在は企業向けAI導入・DX推進を支援。

「AIガバナンスって結局何をすればいいの?」「法律ができたらしいけど、うちの会社は対応しなくて大丈夫?」

2026年に入り、EU AI Actの段階適用や韓国AI基本法の施行が進み、AIガバナンスは「知っておくべき知識」から「対応すべき経営課題」へと変わりました。日本でも関連法制度やガイドラインの整備が進み、AIの利活用と安全確保を両立する仕組みづくりが急務となっています。

本記事では、AIガバナンスの定義から、2026年時点の世界の法規制比較、構築ステップ、AIエージェント時代の新課題、導入事例、主要ツールの選び方まで、企業の担当者が押さえるべきポイントを体系的に解説します。

目次

AIガバナンスとは?定義と2026年に注目される背景

AIガバナンスとは、AIの開発・導入・運用にわたるライフサイクル全体で、公平性・透明性・安全性・説明責任を確保するための管理体制のことです。ここでは、そもそもガバナンスとは何か、AI特有のリスクがなぜ新たな管理体制を必要としているのか、そして市場の拡大動向を解説します。

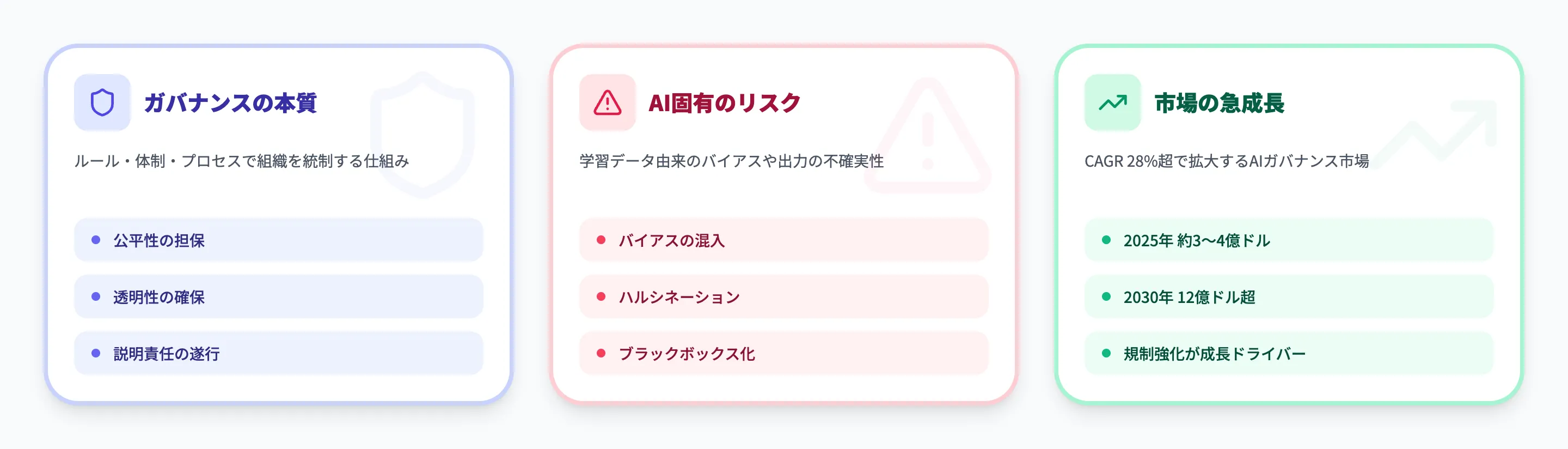

そもそもガバナンスとは何か

ガバナンス(governance)とは、組織の意思決定と業務遂行が適正に行われるよう、ルール・体制・プロセスを整備して統制する仕組みを指します。企業経営では「コーポレート・ガバナンス」として古くから使われてきた概念ですが、AIの普及に伴い「AIガバナンス」という形でAI領域に特化した統制が求められるようになりました。

具体的には、AIが下す判断にバイアスが含まれていないか、個人データの取り扱いは適切か、意思決定プロセスを人間が検証できるかといった論点を、技術・法務・経営の横断的な視点で管理することがAIガバナンスの中核です。

AI特有のリスクが生むガバナンスの必要性

従来のITシステムと異なり、AIには学習データに起因するバイアス、出力の不確実性(ハルシネーション)、ブラックボックス化した意思決定プロセスといった固有のリスクがあります。たとえば採用選考AIが特定の性別や年齢に不利な判定を行った事例や、生成AIが事実と異なる情報を断定的に出力した事例は世界各地で報告されています。

こうしたリスクは、従来の情報セキュリティやコンプライアンスの枠組みだけではカバーしきれません。AIに特化したガバナンス体制を設けることで、開発段階からリスクを可視化し、運用段階で継続的にモニタリングする仕組みが不可欠になっています。

【関連記事】

AIのリスクとは?3つの観点から考えうるリスクと各国・企業の対策を解説

市場規模と成長予測

AIガバナンスへの需要は急速に高まっています。以下の表は、複数の調査機関が発表した市場規模予測をまとめたものです。

| 調査機関 | 2025年推定 | 2029〜2032年予測 | CAGR |

|---|---|---|---|

| Mordor Intelligence | 約3.4億ドル | 約12.1億ドル(2030年) | 28.8% |

| TBRC | 約4.2億ドル | 約18.3億ドル(2029年) | 44.4% |

| Stratistics MRC | 約3.0億ドル | 約23.2億ドル(2032年) | 33.7% |

調査機関によって算出方法やスコープが異なるため予測値にはばらつきがありますが、いずれもCAGR 28%超の高成長を示しています。AI導入が加速する一方で、プライバシー侵害やバイアスへの消費者の懸念が高まっていることが、ガバナンス市場拡大の背景にあります。

AIガバナンスの基本と市場動向を把握したところで、次に企業がなぜこの取り組みを避けて通れないのか、その具体的な理由を5つの観点から見ていきます。

AIガバナンスが企業に求められる5つの理由

AIガバナンスは「あれば望ましい」段階を過ぎ、事業継続と競争力に直結する経営課題になっています。ここでは、企業がAIガバナンスに取り組むべき5つの理由を整理します。

法規制への対応義務

2026年に入り、AI規制の法制化が世界的に進んでいます。EU AI Actは段階適用で進行しており、2026年8月2日は高リスクAIに関する主要義務の適用日として位置づけられます。韓国AI基本法は2026年1月22日に施行されました。日本でも関連法制度やAI事業者ガイドラインの更新が進んでいます。これらの制度に対応するには、社内のAI利用状況を把握し、リスク分類に応じた管理体制を整備する必要があります。

AIバイアスと公平性リスク

AIモデルは学習データの偏りをそのまま反映するため、意図せず特定の属性に不利な判断を下すリスクがあります。採用AI・融資審査AI・保険査定AIなどで公平性が問題になった事例は年々増加しており、差別的な判断が発覚した場合は訴訟や行政指導に発展する可能性も否定できません。ガバナンス体制があれば、モデル開発段階でのバイアステストや運用後の継続監視が可能になります。

ブランド毀損と社会的信頼の低下

生成AIが不適切な内容を出力した場合や、AIの判断ミスが報道された場合、企業のブランドイメージは短期間で大きく毀損されます。逆に、ガバナンスの透明性を高めることは顧客や投資家からの信頼獲得にもつながります。EYの2025年グローバル調査では、責任あるAIに先進的に取り組む企業の約80%がイノベーションや業務効率の改善を達成しているとの結果が出ています。

運用コストとインシデント対応の負担

AIモデルの品質劣化(ドリフト)や予期しない出力によるインシデントは、対応が後手に回るほどコストが膨らみます。事前にモニタリング体制を整備しておけば、問題の早期発見と迅速な対処が可能になります。同じEY調査によると、リアルタイム監視を導入している企業は収益成長を達成する可能性が34%、コスト削減の可能性が65%高いという結果が出ています。

エージェント型AIの台頭

2025年後半から、複数のツールやデータソースを自律的に操作する「AIエージェント」が急速に普及しています。Informaticaの「CDOインサイト2026」によると、エージェンティックAIの導入率は日本で52%、グローバルで47%に達しています。従来の生成AIとは異なり、エージェント型AIは自律的に行動を決定・実行するため、ガバナンスの対象範囲と複雑さが格段に増しています。

このように、法規制・公平性・ブランド・コスト・新技術のいずれの観点からも、AIガバナンスは企業にとって避けて通れないテーマになっています。

【関連記事】

AI活用における倫理問題とは?実際の事例や解決策を解説

【2026年最新】AIガバナンスに関する世界の法規制比較

AIガバナンスを検討するうえで、自社のビジネスに影響する法規制の把握は最初のステップです。ここでは、2026年3月時点で企業が押さえるべき主要4地域の規制を比較します。

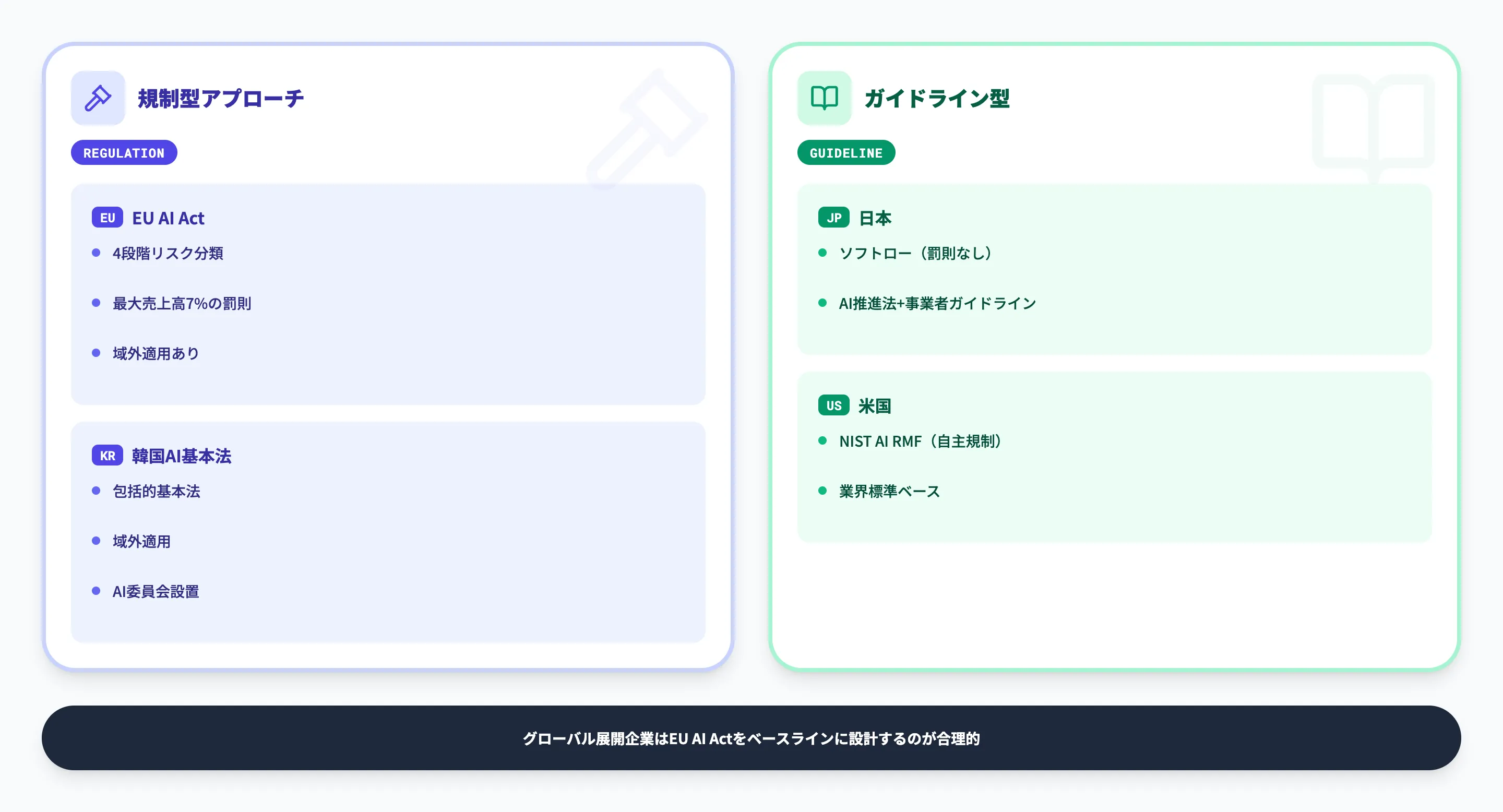

EU AI Actの段階適用の現状

EU AI Actは、AIシステムをリスクレベルに応じて4段階(禁止・高リスク・限定リスク・最小リスク)に分類し、それぞれに異なる義務を課す包括的AI規制法です。条文の原文はEUR-Lex(Regulation (EU) 2024/1689)で確認できます。

以下の表は、EU AI Actの主な適用スケジュールをまとめたものです。

| 時期 | 対象 | 主な義務 |

|---|---|---|

| 2025年2月 | 禁止されるAI実践 | 社会スコアリング、感情認識等の利用禁止 |

| 2025年8月 | 汎用目的AIモデル | 透明性義務、著作権法の順守 |

| 2026年8月2日 | 高リスクAIシステム | 適合性評価、リスク管理体制、人間による監視 |

適用時期に関する議論は継続しており、実務では「現行の公表スケジュールを基準に準備しつつ、欧州委員会の更新情報を定期確認する」という運用が現実的です。将来時期は変更される可能性があります。

韓国AI基本法 2026年1月施行

韓国は2024年12月にAI基本法を国会で可決し、2026年1月22日に施行しました(参考: 国家法令情報センター(韓国))。

主な特徴として、高影響AIと生成AIに対する安全基準の設定、AI委員会の設置による推進体制の構築、そして幅広い域外適用が挙げられます。韓国国内市場や利用者に影響を及ぼす海外企業の活動にも適用されるため、韓国で事業を展開する日本企業もこの法律の対象となり得ます。

日本の制度動向とAI事業者ガイドライン

日本は罰則規定を中心とする包括規制ではなく、ソフトロー(指針・ガイドライン)を軸としたアプローチを採用しています。実務では、AI利活用の推進と安全確保の両立を目的とした制度整備と、官公庁ガイドラインの更新を併せて確認する運用が重要です。

実務的な指針としては、経済産業省と総務省が策定する「AI事業者ガイドライン」が重要です。2025年3月28日に第1.1版が公表され、2026年2月時点では次版の検討が進められています。

米国のアプローチ NIST AI RMF

米国は連邦レベルの包括的AI法制を持たず、NISTのAI Risk Management Framework(AI RMF)を中心とした自主規制型のアプローチをとっています。AI RMF本体に加えてKnowledge BaseやPlaybookなどの補助資料が継続更新されており、生成AI、サプライチェーン、AIセキュリティに関する実務情報も拡充しています。

さらに、NIST IR 8596として「Cybersecurity Framework Profile for AI」のドラフトが2025年12月に公開され、AIセキュリティとサイバーセキュリティを統合的に管理するための指針策定が進んでいます。

以下の表で4地域のアプローチを比較します。

| 地域 | 規制手法 | 施行時期 | 域外適用 | 罰則 |

|---|---|---|---|---|

| EU | 包括的規制法 | 段階的〜2026年8月 | あり(EU市場向け製品・サービス) | 最大3,500万ユーロ又は売上高7% |

| 韓国 | 包括的基本法 | 2026年1月 | あり(韓国市場に影響する活動) | 規定あり |

| 日本 | 推進法+ガイドライン | 2025年9月(推進法) | なし | なし(ソフトロー) |

| 米国 | フレームワーク(自主規制) | 随時更新 | なし | なし(業界自主規制) |

EU・韓国は域外適用を持つ「規制型」、日本・米国は「ガイドライン型」という対照的なアプローチになっています。グローバルに事業を展開する企業は、最も厳格な規制(EU AI Act)をベースラインとして自社のガバナンス体制を設計するのが合理的です。

各国の規制を把握したうえで、次に自社内でAIガバナンスをどう構築すればよいのか、具体的なステップとフレームワークを見ていきます。

AIガバナンスの構築ステップとフレームワーク

AIガバナンスを実効性のある形で構築するには、段階的かつ継続的なアプローチが重要です。ここでは、経済産業省が提唱する「アジャイル・ガバナンス」の考え方と、実践的な5つの構築ステップを解説します。

アジャイル・ガバナンスの考え方

経済産業省は、AI技術の急速な変化に対応するために「アジャイル・ガバナンス」を推奨しています。これは、環境・リスク分析→ゴール設定→システムデザイン→運用→評価というサイクルを、マルチステークホルダーとともに継続的かつ高速に回していくガバナンスモデルです。

従来の「ルールを一度決めて固定する」スタイルとは異なり、技術の進化や規制の変更に合わせてガバナンス体制そのものを柔軟にアップデートしていく点が特徴です。特に生成AIやAIエージェントのように変化が激しい領域では、この柔軟なアプローチが不可欠です。

5つの構築ステップ

PwC Japanが提唱する「戦略・体制・人材・プロセス・基盤」の5つの観点は、AIガバナンス構築の実践的なフレームワークとして参考になります。以下に各ステップの概要を示します。

-

戦略

自社におけるAI利活用の方針と、ガバナンスのゴール(どのレベルのリスクまで許容するか)を経営層が明確に定める。事業戦略とAI戦略の整合性を確保することが出発点になる。

-

体制

AIガバナンスの責任者(Chief AI Officerなど)を任命し、法務・IT・事業部門を横断するガバナンス委員会を設置する。AI利用の承認フローや報告ラインを定めておくことで、現場での判断基準が統一される。

-

人材

ガバナンスを運用するためには、AI技術の知識と法規制の知識を兼ね備えた人材が必要になる。全社員向けのAIリテラシー研修に加え、リスク評価やモデル監査を担う専門人材の育成・確保が課題となる。

-

プロセス

AIシステムの企画・開発・運用・廃棄の各段階でリスクアセスメントを実施し、その結果に基づいてモニタリングと改善を行うPDCAサイクルを定める。既存の社内ルール・規程と整合を取りながら運用する。

-

基盤

リスク管理やモデル監視を効率化するためのツール・プラットフォームを導入する。手作業での管理には限界があるため、自動化された監視基盤の整備がガバナンスの実効性を左右する。

これら5ステップは順番に完成させるものではなく、アジャイル・ガバナンスの考え方に基づき、小規模なパイロットから始めて段階的に拡大していくのが現実的です。

NIST AI RMFの活用方法

米国NISTのAI Risk Management Framework(AI RMF)は、国際的に広く参照されるAIリスク管理のフレームワークです。「Govern(統治)」「Map(マッピング)」「Measure(測定)」「Manage(管理)」の4つの機能を軸に、組織のAIリスクを体系的に管理する方法を提供しています。

NIST AI RMFの関連資料では、モデルの出所追跡(プロベナンス)、データ完全性の検証、サードパーティモデルの評価といった論点が継続的に扱われています。多くの企業がオープンソースや外部プロバイダーのAIモデルを活用している現状を踏まえると、Knowledge Baseや関連ドラフトを定期的に確認する運用が実務的です。

日本企業がAI事業者ガイドラインとNIST AI RMFの両方を参照することで、国内規制への対応と国際的なベストプラクティスの双方をカバーできます。

フレームワークの全体像を理解したところで、次に2025年後半から急速に普及しているAIエージェントがガバナンスにもたらす新たな課題を取り上げます。

AIエージェント時代に求められるAIガバナンスの新課題

従来の生成AIは人間がプロンプトを入力して1回の応答を得る形が主流でしたが、AIエージェントは複数のステップにわたって自律的に判断・実行する点が大きく異なります。この自律性が、ガバナンスに新たな課題を突きつけています。

自律型AIが生む固有リスク

NTTデータはAIエージェント活用のリスクとして以下の5つを整理しています。

-

曖昧なプロンプトによる誤動作

ユーザーの意図が不明確なまま行動を開始し、意図しない結果を引き起こす。

-

複数ステップの不透明性

中間の判断プロセスが外部から検証しにくく、最終結果だけでは問題箇所の特定が困難になる。

-

目的の誤調整(Goal Misalignment)

AIが人間の意図とは異なる目標を設定し、それに向かって合理的に行動してしまう。

-

目的の逸脱

設定された目標を達成するために、想定外の手段(例:不正なデータアクセス)を選択する。

-

リソース過剰消費と創発的共謀

制限のない実行環境でエージェントがリソースを際限なく消費したり、複数のエージェント同士が人間の意図しない形で協調する。

これらのリスクは、従来の「プロンプト→回答」型のAIガバナンスでは十分にカバーできません。

多段階意思決定の透明性確保

AIエージェントは、情報収集→分析→判断→実行という複数のステップを自律的に進めます。各ステップでの判断根拠をログとして記録し、事後検証できるようにする仕組み(監査証跡)が不可欠です。

複数の市場調査では、2026年以降、専任の人員と専用ソフトウェアを活用するAIガバナンス・プログラムが標準化すると予測されています。セキュリティとは独立した形で、AIに特化したリスク管理の専門チームを設ける企業が増える見通しです。

ヒューマン・イン・ザ・ループの設計

自律性を高めつつも、重要な判断ポイントでは人間が介入できるようにする「ヒューマン・イン・ザ・ループ」の設計が重要になります。すべてのアクションに人間の承認を求めるとエージェントの効率が大幅に低下するため、リスクレベルに応じて承認ポイントを設定するという「段階的自律」のアプローチが現実的です。

たとえば、社内データの参照のみであれば自動実行を許可し、外部システムへのデータ送信や金額の大きい意思決定では人間の承認を必須にするといった設計が考えられます。

AIエージェント特有のリスクを踏まえたうえで、次に実際にAIガバナンスを導入した企業の事例とその効果を見ていきます。

AIガバナンスの導入事例と定量的な効果

AIガバナンスは抽象的なテーマに見えがちですが、実際に導入を進めている企業や自治体が増えています。ここでは、公式に公開されている3つの事例と、グローバル調査の定量データを紹介します。

りそなホールディングス×NTTデータの取り組み

NTTデータは、りそなホールディングスと共同でAIガバナンス体制の構築に取り組んでいます。具体的な施策は以下の3つです。

-

ガイドラインの策定

既存の社内規定との整合性を確認し、現場で参照しやすい構成と情報量に配慮した実務向けガイドラインを作成した。

-

リスクチェックプロセスの構築

すべてのAI案件に共通して適用できるリスクベースのチェックプロセスを設計。段階的なトライアル導入を通じて、現場での理解促進と定着を図っている。

-

社員向け教育コンテンツの整備

AIリテラシーの底上げを目的とした教育プログラムを開発し、全社的な意識向上に取り組んでいる。

金融業界は規制が厳格なため、AIガバナンスの先進事例が生まれやすい分野です。りそなHDの取り組みは、他の金融機関だけでなく、これからガバナンスを構築する企業全般にとって参考になります。

PwC Japan×大阪市のアセスメント

PwC Japanは大阪市と連携し、2026年2月にAIガバナンスのアセスメント結果を公表しました。大阪市は全職員が利用可能な生成AI基盤を整備し、特定業務でのRAG活用も推進しています。

アセスメントの結果、「AI戦略」「AI管理・推進体制」「データ」の3領域での整備が重要であることが提言されました。自治体としてAIガバナンスの第三者評価を受けた国内初の事例であり、今後は民間企業にも同様の評価手法が広がる可能性があります。

EYグローバル調査が示す定量効果

EYの「Responsible AI Pulse Survey」(2025年12月発表)は、年間売上10億ドル超の企業975社のCスイート層を対象に実施された大規模調査です。

責任あるAIに先進的に取り組む企業が達成した成果を以下の表にまとめます。

| 項目 | 達成割合 |

|---|---|

| イノベーション改善 | 81% |

| 業務効率・生産性向上 | 79% |

| 従業員満足度向上 | 56% |

| 収益成長 | 54% |

| コスト削減 | 48% |

注目すべきは、リアルタイム監視を導入している企業では収益成長の可能性が34%、コスト削減の可能性が65%向上しているという点です。AIガバナンスは規制対応のための「守り」の施策にとどまらず、事業成果の向上に直接寄与する「攻め」の投資としても機能することが定量的に示されています。

AIガバナンスツールの料金・費用と選び方

AIガバナンスの運用を手作業だけで行うには限界があります。ここでは、2026年3月時点で注目される主要プラットフォームの特徴、料金体系の考え方、そして選定の判断基準を整理します。

主要AIガバナンスプラットフォーム比較

以下の表に、代表的な3つのプラットフォームの特徴をまとめます。

| プラットフォーム | 提供元 | 主な特徴 | 対応規制 |

|---|---|---|---|

| watsonx.governance | IBM | Forrester Wave・IDC MarketScapeの両方でリーダー評価。IBM製・サードパーティ製モデル(OpenAI、Amazon SageMaker含む)のガバナンスを自動化 | EU AI Act、NIST AI RMF、FRB SR 11-7 |

| Dataiku | Dataiku | AIガバナンスの運用化に注力。Snowflake・Salesforce・ServiceNow等との連携に強み。エージェントオーケストレーション機能を搭載 | EU AI Act対応のガバナンスフレームワーク |

| AI Defense + NECコンサルティング | Cisco × NEC | Ciscoのセキュリティ基盤とNECのコンサルティングを組み合わせたサービス。2025年12月提供開始 | AI事業者ガイドライン準拠 |

IBM watsonx.governanceはForrester Wave(Q3 2025)とIDC MarketScapeの両方でリーダーに選出されており、特に金融機関や規制の厳しい業界での採用実績が豊富です。Dataikuはデータサイエンスプラットフォームとしての柔軟性が強みで、既存のデータ基盤との統合がしやすい点が評価されています。

導入コストの目安

AIガバナンスツールの料金体系は、いずれもエンタープライズ向けの個別見積りが中心です。2026年3月時点では、以下のような費用構成が一般的です。

-

プラットフォーム利用料

ユーザー数やモデル数に基づく月額/年額サブスクリプション。中規模企業で年間数百万円〜数千万円が目安になる。

-

初期導入・コンサルティング費用

ガバナンス方針の策定、リスクアセスメント、ツール連携の設計を含むコンサルティング。コンサルファーム起用の場合、数百万〜数千万円規模が一般的。

-

教育・研修費用

全社向けAIリテラシー研修や専門人材向けトレーニング。外部研修の場合、1回あたり数十万円〜数百万円が目安。

なお、具体的な料金は組織規模、AI利用の範囲、対応すべき規制によって大きく変動するため、各ベンダーに個別見積りを依頼することを推奨します。

ツール選定の判断基準

AIガバナンスツールを選ぶ際には、以下の3つの観点で比較すると判断しやすくなります。

-

対応規制の範囲

EU AI Act対応が必要か、日本のAI事業者ガイドライン準拠で十分か。グローバル展開を想定するなら、複数規制をカバーするプラットフォームが効率的になる。

-

既存環境との統合性

自社が利用しているクラウド基盤(Azure、AWS、GCP)やデータ基盤との連携のしやすさ。API連携やコネクタの有無を確認すると導入コストを抑えられる。

-

スケーラビリティ

現在のAIモデル数だけでなく、今後のAI利活用拡大を見据えた処理能力。特にAIエージェントの導入を予定している場合は、エージェントの監視機能の有無を確認しておくとよい。

ツール導入はガバナンス構築の一部にすぎません。ツールだけ入れても、戦略・体制・人材・プロセスが伴わなければ実効性は得られないため、先に述べた5つの構築ステップと並行して検討することが重要です。

AIガバナンスが向いている組織と導入時の注意点

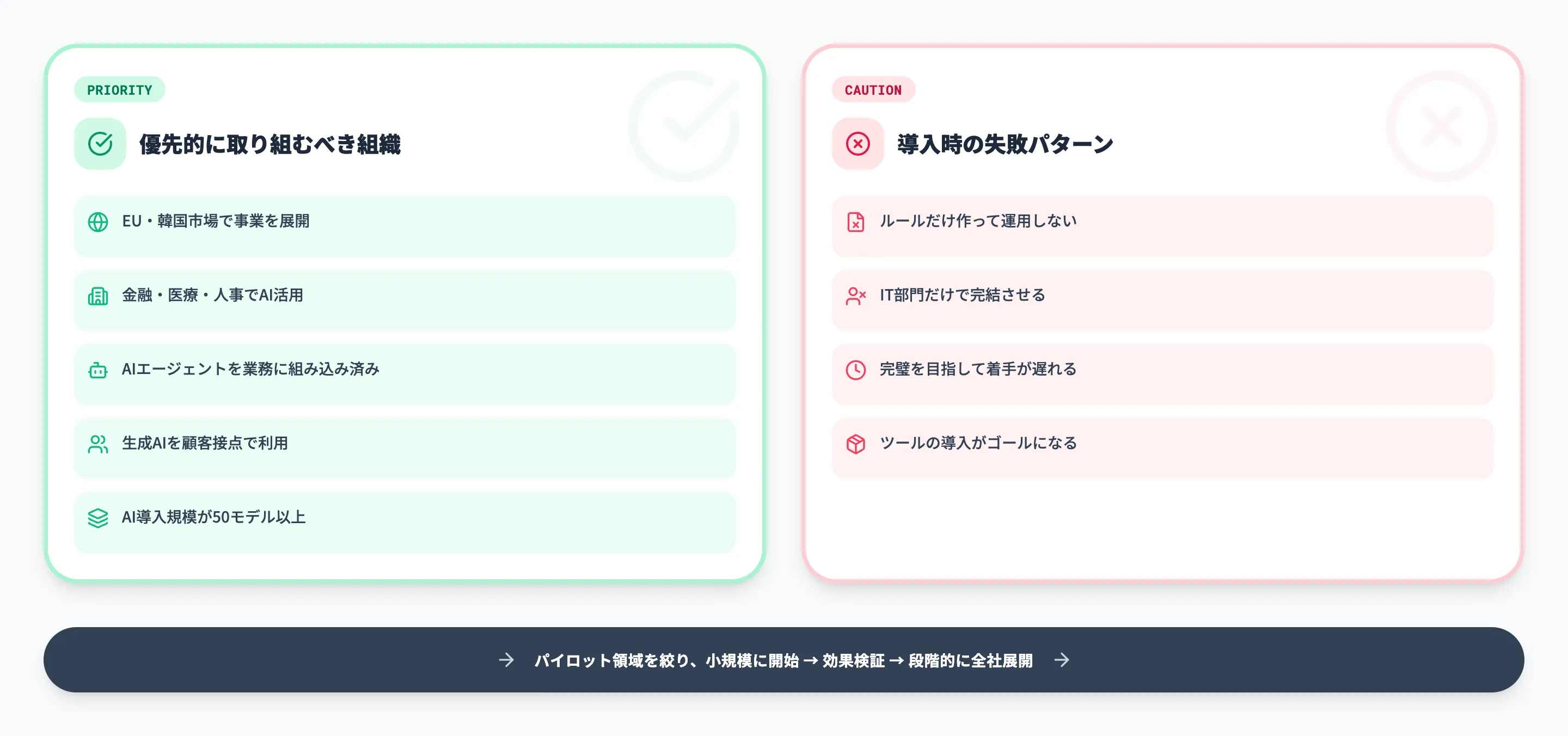

AIガバナンスは規模や業種を問わずすべての組織に関係しますが、取り組みの優先度は組織の状況によって異なります。ここでは、優先的に着手すべき組織の特徴と、導入時にありがちな失敗パターンを整理します。

優先的に取り組むべき組織

以下に該当する組織は、AIガバナンスへの早期着手が特に推奨されます。

| 特徴 | 理由 |

|---|---|

| EU・韓国市場で事業を展開している | EU AI Act・韓国AI基本法の域外適用の対象となる可能性がある |

| 金融・医療・人事など高リスク領域でAIを活用している | AIの判断が人の権利・安全に直接影響し、規制の対象になりやすい |

| AIエージェントを業務プロセスに組み込んでいる | 自律型AIの行動範囲が広く、従来のセキュリティ対策だけではカバーしきれない |

| 生成AIを顧客接点で利用している | 不適切な出力が直接顧客に届くリスクがある |

| AI導入規模が50モデル以上 | 手作業での管理が現実的でなくなり、ツール導入とプロセス整備が必要になる |

一方で、AI利用が限定的な組織(例:社内の議事録要約のみ)では、まず社内利用ガイドラインの策定から始め、利用範囲の拡大に合わせて段階的にガバナンスを強化していく方法が現実的です。

導入時にありがちな失敗パターン

AIガバナンス導入で企業が陥りがちな失敗パターンを以下に整理します。

-

ルールだけ作って運用しない

ガイドラインを策定しただけで現場に浸透せず、形骸化する。定期的な研修と遵守状況のモニタリングが不可欠になる。

-

IT部門だけで完結させる

AIガバナンスは法務・経営・事業部門を含む横断的な取り組み。IT部門のみに任せると、法規制対応やビジネスリスクの視点が抜け落ちる。

-

完璧を目指して着手が遅れる

すべてを網羅する完全なガバナンス体制を最初から構築しようとして、結局何も始まらないケース。パイロット領域を絞って小規模に始め、効果を検証しながら拡大するアジャイルなアプローチが有効。

-

ツールの導入がゴールになる

ガバナンスツールを購入しただけで安心し、戦略・体制・人材の整備をおろそかにする。ツールはあくまで手段であり、組織的な取り組みと一体で初めて効果を発揮する。

AIガバナンスの導入は、AI導入そのものの課題と共通する部分も多くあります。経営層のコミットメント、現場の巻き込み、段階的な展開という3つの原則を意識することで、失敗リスクを大幅に低減できます。

AIガバナンスの設計知見を自社のAI導入計画に活かす

AIガバナンスの枠組みとフレームワークを理解したら、次のステップは自社のAI導入計画にガバナンス設計を組み込むことです。

AI総合研究所では、Microsoft環境でのAI業務自動化を段階的に設計するための実践ガイド(220ページ)を無料で提供しています。ガバナンスを前提とした段階的導入ロードマップと、部門別のBefore/After付きユースケースを掲載しています。

AI総合研究所が、AIガバナンスの設計と業務自動化の両立をお手伝いいたします。

AIガバナンスを1画面で実現

AIエージェントの管理・監査を統合

AIエージェントの実行ログ・アクセス権限・セキュリティスキャンを1つのダッシュボードで統合管理。シャドーAIの乱立を防ぎ、監査対応を効率化するエンタープライズAI基盤の資料です。

まとめ

本記事では、AIガバナンスの定義から2026年時点の世界の法規制比較、構築ステップ、AIエージェント時代の新課題、導入事例と効果、そしてツールの選び方まで、企業の担当者が押さえるべきポイントを体系的に解説しました。

AIガバナンスが企業にもたらす価値は、大きく3つに集約されます。

1つ目は法規制リスクの回避です。EU AI Actの段階適用、韓国AI基本法の施行、日本の制度整備とAI事業者ガイドラインの更新が同時に進む2026年は、ガバナンス体制の有無が事業継続に直結する年になっています。

2つ目は事業成果への貢献です。EYのグローバル調査が示すとおり、責任あるAIガバナンスに取り組む企業は、収益成長・コスト削減・イノベーション改善といった定量的な成果を達成する可能性が高いという結果が出ています。

3つ目は信頼とブランド価値の向上です。AIの透明性と説明責任を確保することは、顧客・投資家・社会からの信頼獲得に直結します。

次のステップとしては、まず自社のAI利用状況を棚卸しし、対応すべき法規制を特定することから始めてください。そのうえで、パイロット領域を決めて5つの構築ステップ(戦略→体制→人材→プロセス→基盤)に沿った小規模な導入を進め、効果を検証しながら全社展開していくのが推奨されるアプローチです。