この記事のポイント

AIエージェントを社内で安全に実行するためのセキュリティサンドボックスとして、OSSの第一候補

ファイルシステム・ネットワーク・プロセス・推論の4層にDeny-by-defaultのポリシーベースガードレールを適用する設計

Claude Code・Codex・OpenCodeなど主要エージェントに対応し、Docker環境があれば2コマンドで導入可能

Apache 2.0ライセンスで無償利用可能で、NemoClawやAgent Toolkitとの組み合わせでエージェント基盤を構築可能

v0.0.10アルファ段階のためAPI/CLIの破壊的変更リスクあり、本番運用にはLinux環境を推奨

Microsoft MVP・AIパートナー。LinkX Japan株式会社 代表取締役。東京工業大学大学院にて自然言語処理・金融工学を研究。NHK放送技術研究所でAI・ブロックチェーンの研究開発に従事し、国際学会・ジャーナルでの発表多数。経営情報学会 優秀賞受賞。シンガポールでWeb3企業を創業後、現在は企業向けAI導入・DX推進を支援。

「AIエージェントを社内で動かしたいが、データ流出や権限昇格のリスクが心配」「Claude CodeやCodexをチームで使うとき、セキュリティポリシーをどう適用すればいい?」

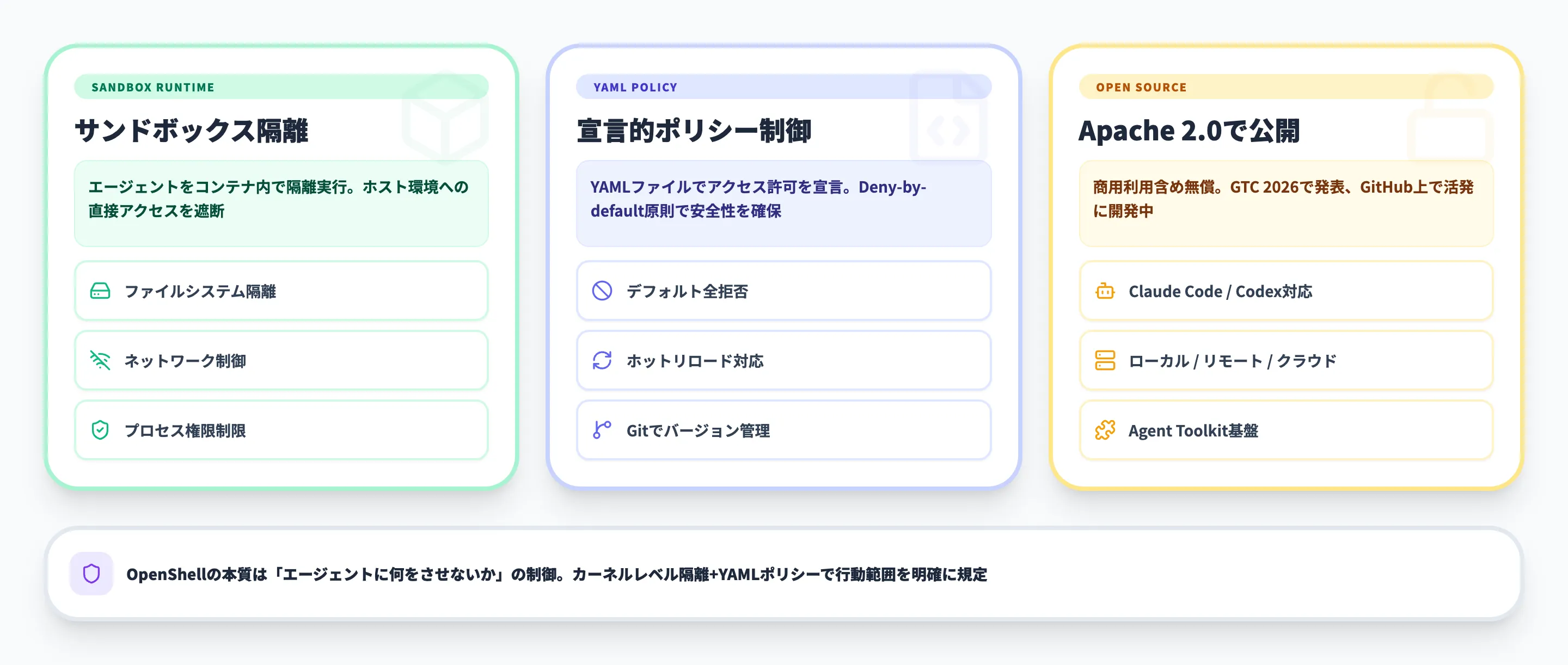

NVIDIA OpenShellは、自律型AIエージェントをサンドボックス環境で安全に実行するためのオープンソースランタイムです。ファイルシステム・ネットワーク・プロセス・推論の各レイヤーにポリシーベースのガードレールを適用し、エージェントに必要なアクセス権だけを付与する設計になっています。

本記事では、OpenShellの基本概念からセキュリティ設計、インストール手順、対応エージェント、NemoClawやAgent Toolkitとの違い、料金・ライセンス、注意点まで、2026年3月時点の公式情報にもとづいて解説します。

目次

NVIDIA OpenShellとは?

NVIDIA OpenShellは、自律型AIエージェントをサンドボックス環境で安全に実行するためのオープンソースランタイムです。2026年3月16日のGTC 2026で発表され、Apache 2.0ライセンスのもとでGitHubに公開されています。コミュニティ向けのエコシステム(サンドボックスイメージ、サンプル等)はOpenShell-Communityリポジトリで別途管理されています。

AIエージェントが自律的にコードを書き、ファイルを操作し、外部APIを呼び出す時代において、「エージェントに何をさせるか」だけでなく「何をさせないか」を制御する仕組みが不可欠になっています。OpenShellは、エージェントとインフラストラクチャの間に入り、カーネルレベルの隔離とYAMLベースの宣言的ポリシーによって、エージェントの行動範囲を明確に制御します。

NVIDIAの公式テクニカルブログでは、OpenShellを「エージェントの実行方法、参照・操作できる範囲、推論の送信先を統制するガバナンスレイヤー」と説明しています。

NemoClaw・Agent Toolkitとの違い

OpenShellは、NVIDIAが展開するAIエージェント関連プロダクトの中でセキュリティランタイムとして位置づけられています。名前が似た製品が複数あるため、ここで関係を整理しておきます。

以下の表で、3つの製品の役割と対象範囲を整理しました。

| 製品名 | 役割 | 対象 |

|---|---|---|

| NVIDIA Agent Toolkit | エージェントの構築・テスト・最適化・デプロイをカバーするフルスタックフレームワーク | すべてのAIエージェント開発者 |

| NVIDIA OpenShell | エージェントをサンドボックスで隔離し、ポリシーベースのセキュリティを適用するランタイム | Agent Toolkitのセキュリティ基盤 |

| NVIDIA NemoClaw | OpenClaw(旧Clawdbot)をワンコマンドで安全に動かすための統合スタック | OpenClaw利用者向け |

つまり、Agent Toolkitがエージェント開発の全体フレームワーク、OpenShellがそのセキュリティ実行基盤、NemoClawがOpenClaw向けにOpenShellを組み込んだ特化パッケージ、という関係です。

OpenShellはNemoClawの内部でも使われていますが、OpenShell単体でも利用可能であり、Claude CodeやCodexなどOpenClaw以外のエージェントも実行できます。ただし、公式ポリシーの完成度はエージェントごとに異なり、Claude Codeは即利用しやすい一方、CodexやOpenCodeは追加のポリシー設定が前提になります(詳細は後述)。

なぜNVIDIA OpenShellが必要なのか

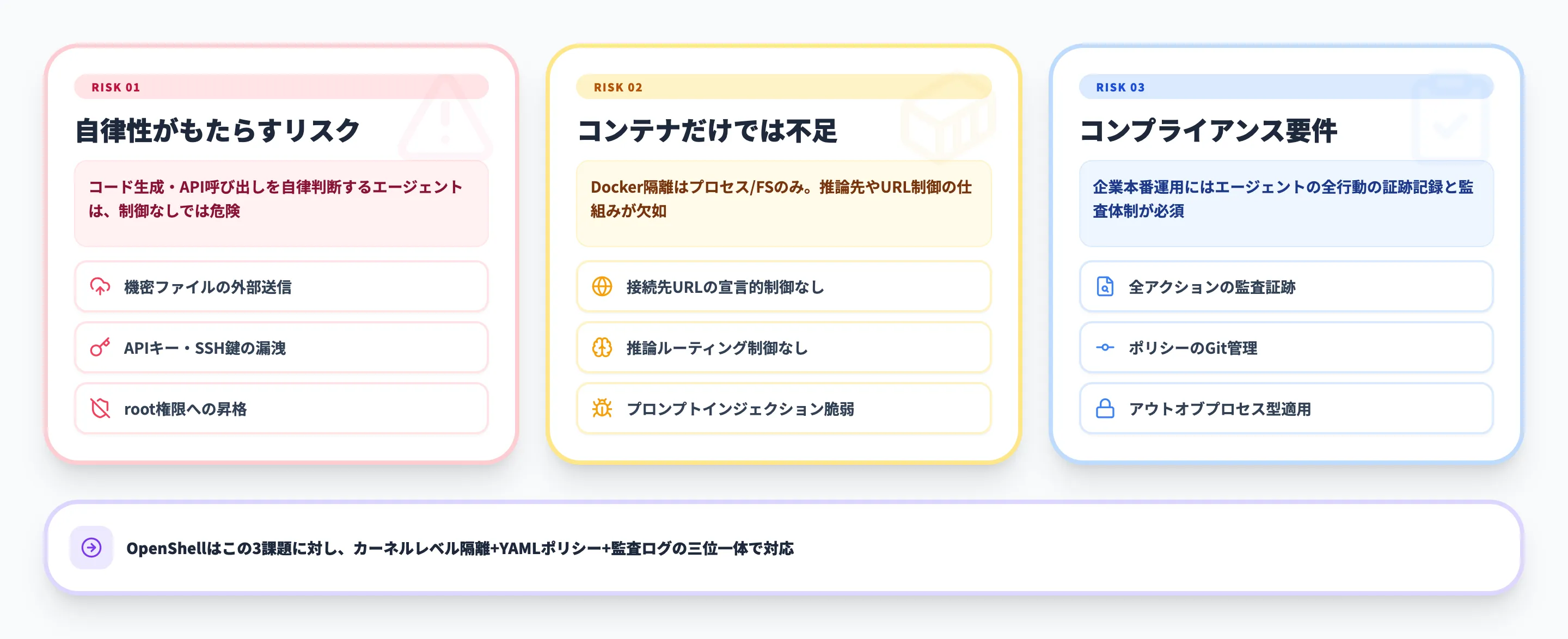

AIエージェントの能力が向上するにつれ、セキュリティリスクも急速に拡大しています。ここでは、OpenShellが解決する3つの構造的課題を整理します。

エージェントの自律性がもたらすリスク

Claude CodeやCodex、OpenClawのような自律型コーディングエージェントは、ファイルの読み書き、シェルコマンドの実行、外部APIの呼び出しを自分で判断して行います。これは開発効率を劇的に高める一方で、以下のリスクを伴います。

-

データ流出

エージェントが意図せず機密ファイルを外部エンドポイントに送信する可能性 -

認証情報の漏洩

APIキーやSSH鍵など、ファイルシステム上の認証情報への不正アクセス -

権限昇格

エージェントが自身の権限を超えた操作(root権限の取得など)を試みる -

不正な推論ルーティング

プロンプトインジェクション攻撃により、推論リクエストが意図しないモデルやエンドポイントに送られる

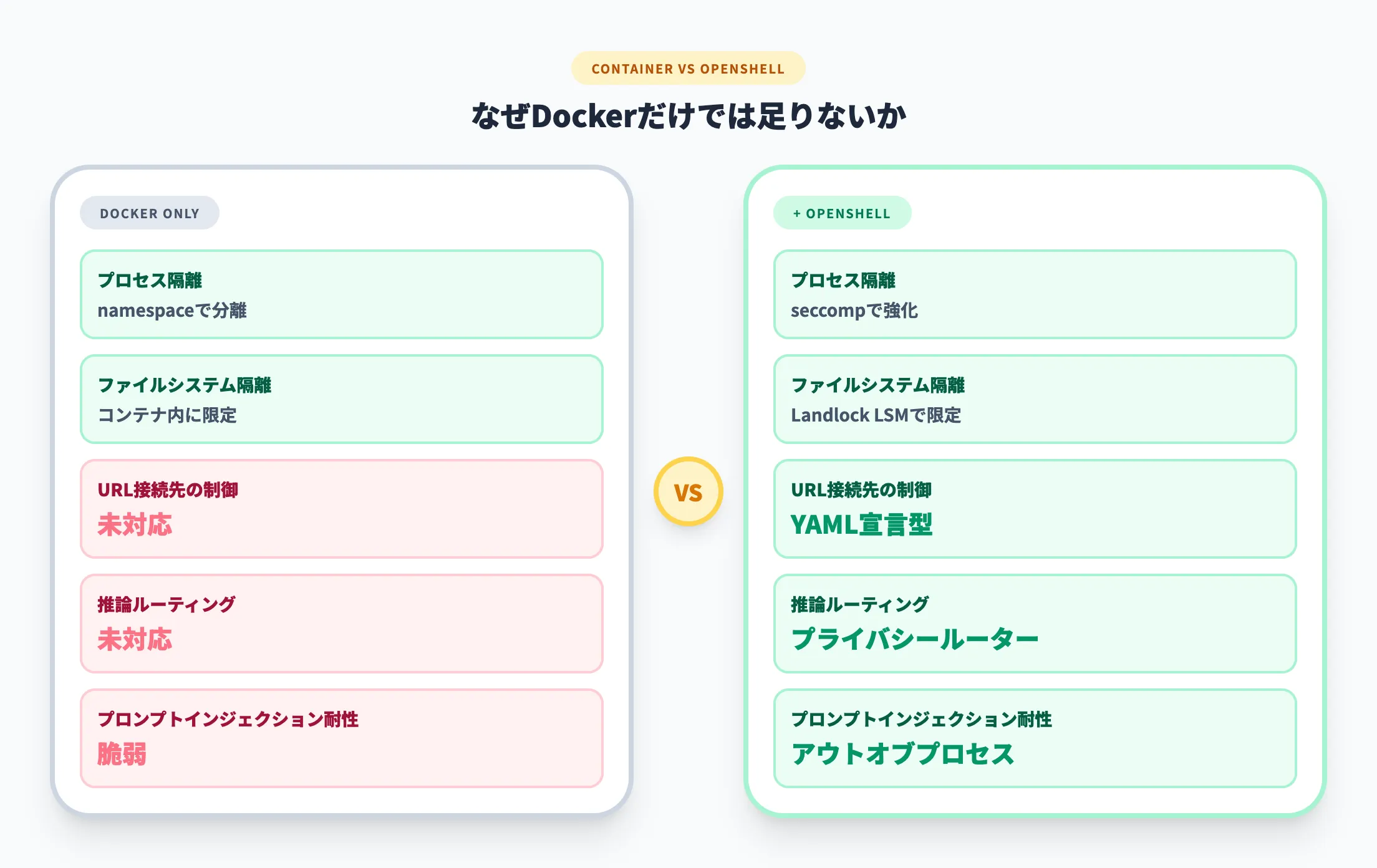

従来のコンテナだけでは不十分

「Dockerコンテナで隔離すれば安全」と考えるかもしれませんが、AIエージェントのセキュリティにはコンテナ単体では対応しきれない課題があります。

通常のコンテナはプロセス・ファイルシステムの隔離を提供しますが、エージェントがどのURLに接続してよいか、どのモデルに推論を送ってよいかを宣言的に制御する仕組みは持っていません。また、エージェント内部のプロンプトインジェクション攻撃でセキュリティ設定そのものが書き換えられるリスクもあります。

OpenShellは、コンテナの上にさらにアウトオブプロセス型ポリシー適用(エージェントプロセスの外側でポリシーを強制する仕組み)を重ねることで、エージェント内部からのポリシー回避を構造的に防いでいます。

企業のコンプライアンス要件への対応

企業がAIエージェントを本番環境に導入するには、「エージェントが何をしたか」を証跡として残し、監査できる体制が求められます。

OpenShellは、すべてのアクション(許可・拒否)の完全な監査証跡を記録する機能を内蔵しています。YAMLポリシーファイルをバージョン管理システム(Git等)で管理すれば、「いつ・誰が・どのポリシーを適用したか」をコンプライアンス監査に使える形で残すことが可能です。

NVIDIA OpenShellのセキュリティ設計

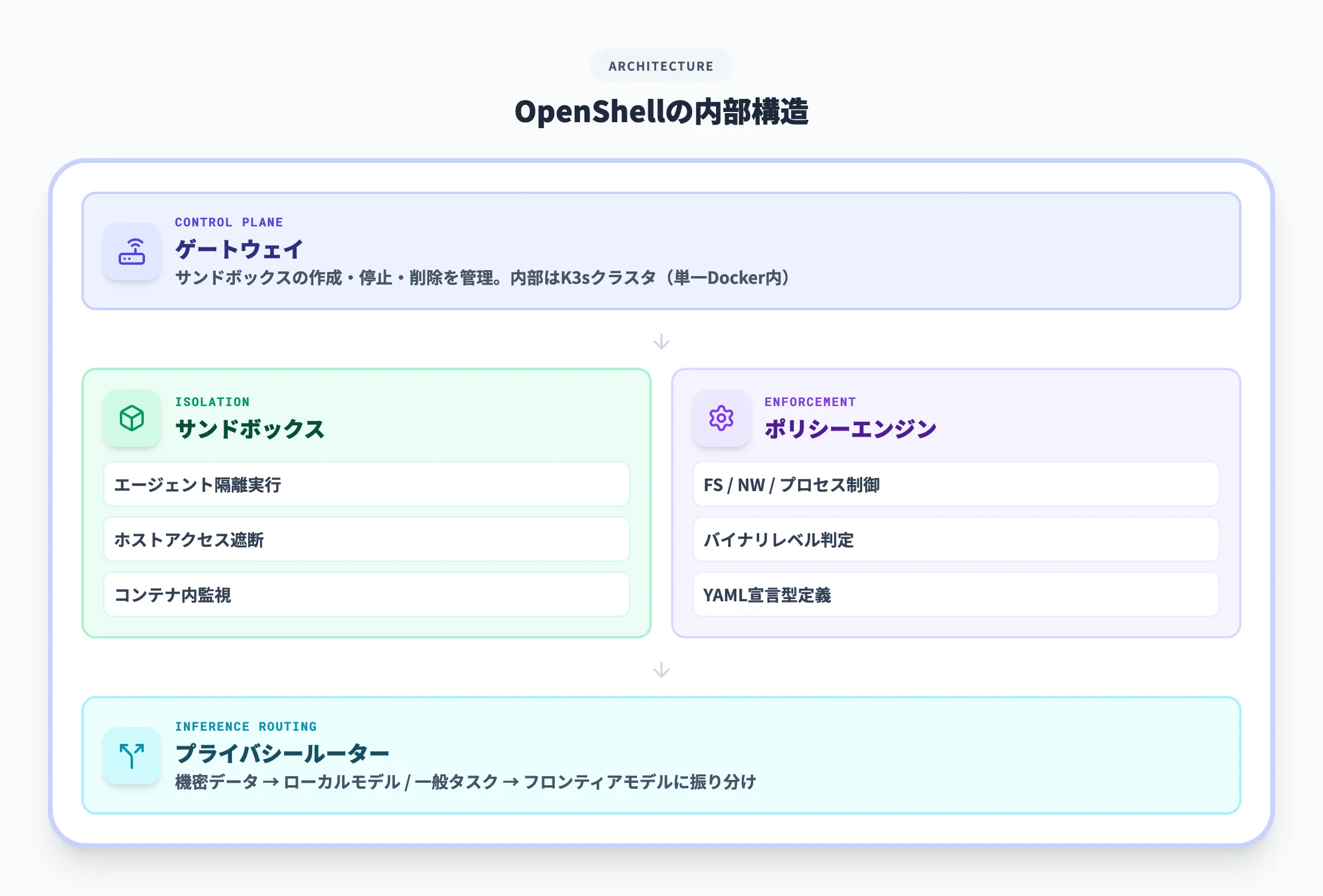

OpenShellの核心は、エージェントの行動範囲を複数のレイヤーで制御する多層防御アーキテクチャにあります。ここでは、OpenShellを構成する4つのコンポーネントと、各保護レイヤーの仕組みを解説します。

4つのコアコンポーネント

OpenShellは、以下の4つのコンポーネントで構成されています。

-

ゲートウェイ

サンドボックスのライフサイクル(作成・停止・削除)を管理するコントロールプレーンAPIです。認証境界を構成し、プラットフォーム全体のリクエストを仲介します。内部実装はK3s Kubernetesクラスタ(単一Dockerコンテナ内で動作)です。 -

サンドボックス

エージェントが実行される隔離環境です。コンテナ監視とポリシー適用型の通信経路制御を含み、エージェントはホスト環境に直接触れることなく動作します。 -

ポリシーエンジン

ファイルシステム・ネットワーク・プロセスの各レイヤーにわたる制約を定義・実施するコンポーネントです。バイナリレベルでの制御が可能で、「検証済みスキルはインストールできるが、未レビューのバイナリは実行できない」といった細かな制御を実現します。 -

プライバシールーター

LLM推論のルーティングを制御するコンポーネントです。機密性の高いコンテキストをローカルのオープンモデル(NVIDIA Nemotronなど)に保持しつつ、必要に応じてClaudeやGPTなどのフロンティアモデルにルーティングする、といったポリシーベースの振り分けが可能です。

保護レイヤーの仕組み

OpenShellは、ファイルシステム・ネットワーク・プロセス・推論の各レイヤーに保護機構を設けています。以下の表で、各レイヤーの保護内容と適用タイミングを整理しました。

| レイヤー | 保護内容 | カーネル技術 | 適用タイミング |

|---|---|---|---|

| ファイルシステム | 許可されたパス外への読み書きを防止 | Landlock LSM | サンドボックス作成時に固定 |

| ネットワーク | 未承認の送信接続を自動ブロック | netns / プロキシ | 実行時にホットリロード可能 |

| プロセス | 権限昇格と危険なシステムコールを遮断 | seccomp | サンドボックス作成時に固定 |

| 推論 | モデルAPI呼び出しを制御されたバックエンドにルーティング | プライバシールーター | 実行時にホットリロード可能 |

この設計で重要なのは、静的ポリシーと動的ポリシーが分離されている点です。ファイルシステムとプロセスの制約はサンドボックス作成時にロックされ、実行中に変更できません。一方、ネットワークと推論のポリシーは実行中にホットリロードが可能で、運用状況に応じて柔軟に調整できます。

デフォルト拒否の原則

OpenShellのセキュリティモデルは**Deny-by-default(デフォルト拒否)**を採用しています。エージェントはゼロ権限の状態から開始し、YAMLポリシーで明示的に許可されたリソースのみにアクセスできます。

この「許可リスト方式」により、設定の漏れが発生した場合でも、エージェントの行動範囲が意図せず広がることを防ぎます。

AIエージェントの安全運用基盤を理解した次はAI Agent Hubで実践する

セキュアなエージェント運用を業務に導入

OpenShellのサンドボックス設計が示すように、AIエージェントの安全な運用基盤は企業導入の前提条件です。AI Agent Hubは、Microsoft Teams上でセキュアにAIエージェントを稼働させ、業務タスクを自律処理する基盤を提供します。

NVIDIA OpenShellの使い方

OpenShellの導入は、Dockerが動作する環境であれば2つのコマンドで完了します。ここでは、インストールからサンドボックスの作成、ポリシー設定までの基本的な流れを解説します。

システム要件

OpenShellの動作に必要な環境は以下のとおりです。

| カテゴリ | 要件 |

|---|---|

| Linux(Debian / Ubuntu) | x86_64 / aarch64。Landlock LSM推奨 |

| macOS | Apple Silicon(arm64)。Docker Desktop必須 |

| Windows | WSL 2 + Docker Desktop(実験的サポート) |

| Docker | Docker Desktop または Docker Engine 28.04以上 |

| GPU(任意) | NVIDIAドライバ + NVIDIA Container Toolkit(GPU利用時のみ) |

GPUはOpenShellの動作自体には必須ではありません。ローカルでの推論にGPUを使いたい場合にのみ、NVIDIAドライバとContainer Toolkitが必要になります。

インストール手順

OpenShellのインストールには、バイナリ(推奨)とPyPI経由の2つの方法があります。

バイナリインストール(推奨)

curl -LsSf https://raw.githubusercontent.com/NVIDIA/OpenShell/main/install.sh | sh

PyPI経由(uv必須)

uv tool install -U openshell

いずれもDockerが起動している必要があります。ゲートウェイは初回使用時に自動で作成されるため、追加の設定は不要です。

サンドボックスの作成と操作

OpenShellの基本操作は、サンドボックスの作成・接続・管理の3つです。以下の表で主要なCLIコマンドを整理しました。

| コマンド | 説明 |

|---|---|

| openshell sandbox create -- claude | Claude Code用のサンドボックスを作成・起動 |

| openshell sandbox create -- codex | Codex用のサンドボックスを作成・起動 |

| openshell sandbox create -- opencode | OpenCode用のサンドボックスを作成・起動 |

| openshell sandbox create --from openclaw | OpenClaw用のコミュニティサンドボックスを起動 |

| openshell sandbox connect [名前] | 実行中のサンドボックスにSSH接続 |

| openshell sandbox list | 全サンドボックスの一覧表示 |

| openshell policy set [名前] --policy file.yaml | YAMLポリシーを適用・更新 |

| openshell policy get [名前] | アクティブポリシーの表示 |

| openshell inference set --provider [p] --model [m] | 推論エンドポイントの設定 |

| openshell logs [名前] --tail | ログのストリーミング表示 |

| openshell term | リアルタイムターミナルUIの起動 |

サンドボックスにはデフォルトでPython 3.13、Node.js 22、gh、git、vim、nanoなどの開発ツールが含まれています。サンドボックスイメージは4種類用意されており、base(基本環境)、ollama(ローカルLLM + Claude Code/Codex/OpenCode同梱)、sdg(合成データ生成ワークフロー用)、openclaw(OpenClaw操作用)から用途に応じて選択します。GPU対応のサンドボックスを作成する場合は --gpu フラグを追加します。

openshell sandbox create --gpu --from [gpu-enabled-sandbox] -- claude

YAMLポリシーの設定

OpenShellのポリシーはYAML形式で宣言的に記述します。ポリシー適用前はすべての外部通信がブロックされ、ポリシーで明示的に許可したエンドポイントのみにアクセスが開放される仕組みです。

以下は、ポリシーの適用と動作確認の流れです。

# 1. サンドボックスを作成(この時点では外部通信はすべてブロック)

openshell sandbox create

# 2. サンドボックス内から外部接続を試みる → ブロックされる

sandbox$ curl -sS https://api.github.com/zen

# curl: (56) Received HTTP code 403 from proxy after CONNECT

# 3. ホスト側からポリシーを適用(ホットリロード対応)

openshell policy set demo --policy examples/sandbox-policy-quickstart/policy.yaml --wait

# 4. ポリシー適用後、GETリクエストは許可される

sandbox$ curl -sS https://api.github.com/zen

# Anything added dilutes everything else.

この例のように、ネットワークポリシーはサンドボックスの再作成なしにホットリロードで更新できます。本番運用中にアクセス先を追加・変更する場合も、エージェントを停止させる必要はありません。

NVIDIA OpenShellで何ができるか

OpenShellの技術的な仕組みを理解したところで、実際にどのような場面で活用できるのかを整理します。

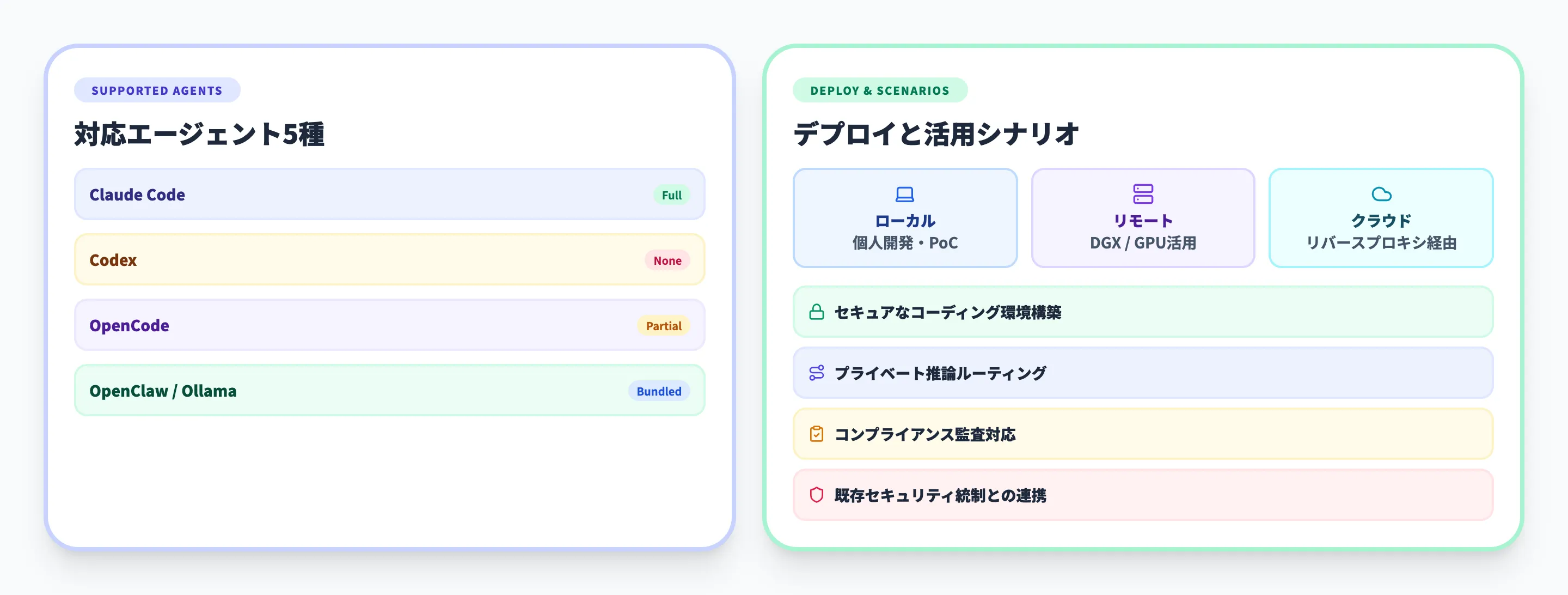

対応エージェント

OpenShellは、主要なAIコーディングエージェントをサポートしています。以下の表で、対応エージェントとポリシーカバレッジの関係を整理しました。

| エージェント | 必要なキー | ポリシーカバレッジ | 起動方法 |

|---|---|---|---|

| Claude Code | ANTHROPIC_API_KEY | Full(追加設定不要) | openshell sandbox create -- claude |

| Codex | OPENAI_API_KEY | None(カスタムポリシー必須) | openshell sandbox create -- codex |

| OpenCode | OPENAI_API_KEY 等 | Partial(エンドポイント・バイナリパスの追加設定が必要) | openshell sandbox create -- opencode |

| OpenClaw | 各モデルのAPIキー | Bundled(専用サンドボックスに同梱) | openshell sandbox create --from openclaw |

| Ollama | 不要(ローカル推論) | Bundled(Claude Code・Codex・OpenClaw同梱) | openshell sandbox create --from ollama |

ポリシーカバレッジの違いは実務上重要です。Claude Codeは公式ポリシーが完備されており、APIキーを渡すだけで即座にサンドボックス内で動作します。一方、CodexやOpenCodeはデフォルトではポリシーが用意されていないか部分的にしかカバーされていないため、利用するエンドポイントやバイナリパスをYAMLポリシーに追加定義する必要があります。

いずれのエージェントも、既存のコードを変更することなくOpenShell上で実行できます。エージェント側にOpenShell用の改修は不要で、サンドボックスの外側からポリシーが適用される設計です。

デプロイメントモード

OpenShellは、ローカル・リモート・クラウドの3つのデプロイメントモードに対応しています。

-

ローカル

開発者のワークステーション上でDocker内にゲートウェイを実行するモードです。個人の開発環境やPoC(概念実証)に向いています。 -

リモート

SSH経由でリモートホスト上のDocker内で実行するモードです。NVIDIA DGX Spark、DGX Station、RTX GPU搭載のPCなどで、GPUリソースを活用したサンドボックスを構築できます。Brevクラウドインスタンス(CPU-onlyまたはNVIDIA H100)も用意されており、環境構築なしでOpenShellを試すことも可能です。 -

クラウド

リバースプロキシの背後にOpenShellゲートウェイを置く構成です。現行ドキュメントでは、主に個人ユーザーがクラウドVM越しにOpenShellを利用する想定であり、共有チームアクセス向けの用途はまだ前提とされていません。現時点ではローカル・リモートが主な選択肢です。

# リモートモードの例:DGX Spark上にサンドボックスを作成

openshell sandbox create --remote spark --from openclaw

活用シナリオ

OpenShellの代表的な活用シナリオは以下のとおりです。

-

セキュアなコーディングエージェント環境

Claude CodeやCodexを社内の開発チームに展開する際に、ファイルアクセスやネットワーク通信を制限した状態で運用できます。sdg(合成データ生成)サンドボックスを使えば、エージェントにデータ生成ワークフローを安全に実行させることもできます。 -

プライベート推論ルーティング

機密性の高いソースコードを扱う場合に、推論リクエストをローカルのNemotronモデルやOllama経由で処理し、外部クラウドへのデータ送信を防ぐことが可能です。 -

コンプライアンス監査

YAMLポリシーファイルをGitで管理し、すべてのエージェントアクションの監査証跡をログとして保持することで、社内のセキュリティ監査要件に対応できます。 -

既存セキュリティ統制との組み合わせ

OpenShellはポリシー適用・サンドボックス隔離・推論ルーティングを担うため、企業の既存セキュリティツールと組み合わせやすい設計になっています。YAMLポリシーとログをSIEMやセキュリティ監視基盤に連携すれば、エージェントの行動をセキュリティ運用の中に組み込むことが可能です。

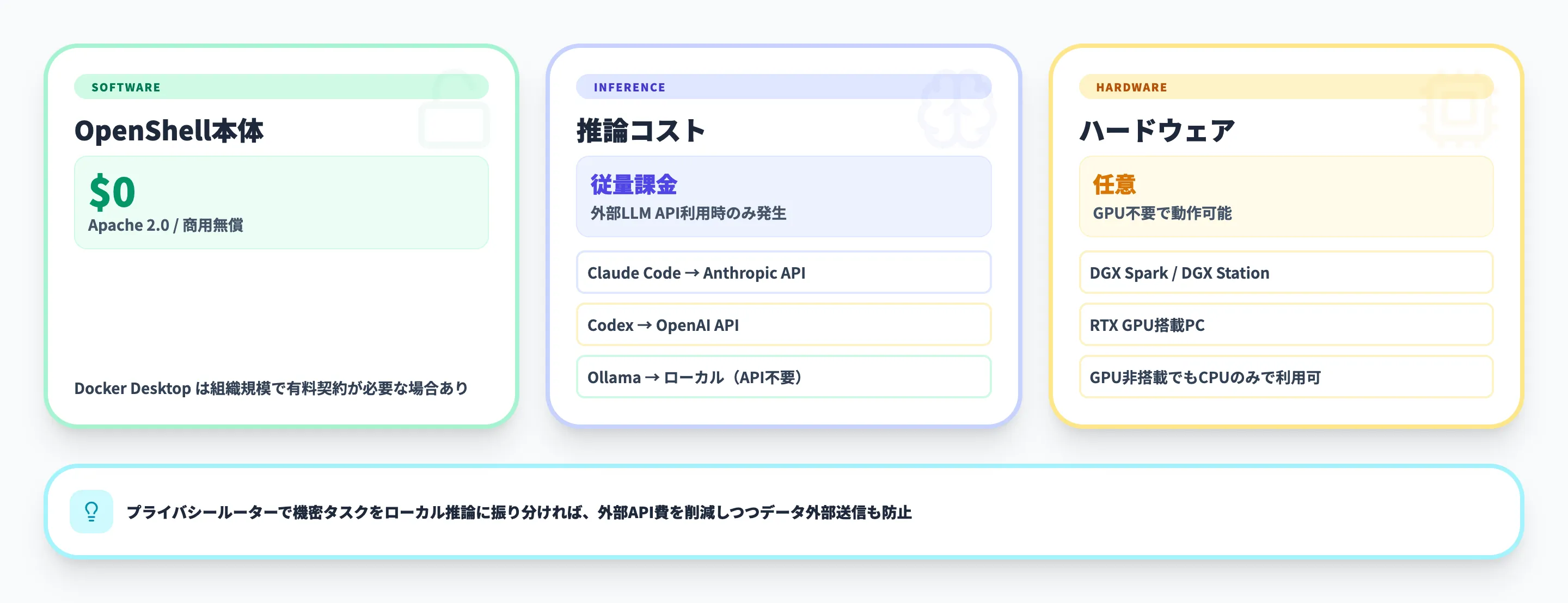

NVIDIA OpenShellの料金体系とライセンス

OpenShellはオープンソースソフトウェアであり、Apache License 2.0のもとで公開されています。商用利用を含め、無償で利用できます。

ソフトウェアコスト

| 項目 | 費用 |

|---|---|

| OpenShell本体 | 無料(Apache 2.0) |

| Docker Desktop | 個人・教育・小規模企業は無料。無料条件を超える利用ではDocker Pro / Team / Businessの有料契約が必要 |

OpenShell自体に課金は発生しませんが、Dockerのライセンス条件は組織規模によって異なる点に注意が必要です。

推論コスト

OpenShellで実行するエージェントが外部のLLM APIを利用する場合、そのAPI利用料は別途発生します。

- Claude Code Anthropic APIの利用料(入力・出力トークン単位の従量課金)、またはClaude Pro/Maxプランの月額料金

- Codex OpenAI APIの利用料

- Ollama / Nemotron(ローカル推論) API利用料は不要だが、GPU搭載マシンの電力・ハードウェアコストが発生

プライバシールーターを活用して機密性の低いタスクをローカルモデルに振り分ければ、外部API利用料を削減しつつデータの外部送信も防ぐことができます。

ハードウェアコスト

GPUを利用する場合、NVIDIAが対応環境として挙げているのはDGX Spark、DGX Station、RTX GPU搭載PCです。ただし、GPU はOpenShellの動作自体には必須ではなく、ローカル推論を行わない構成であればGPUなしの環境でも利用可能です。

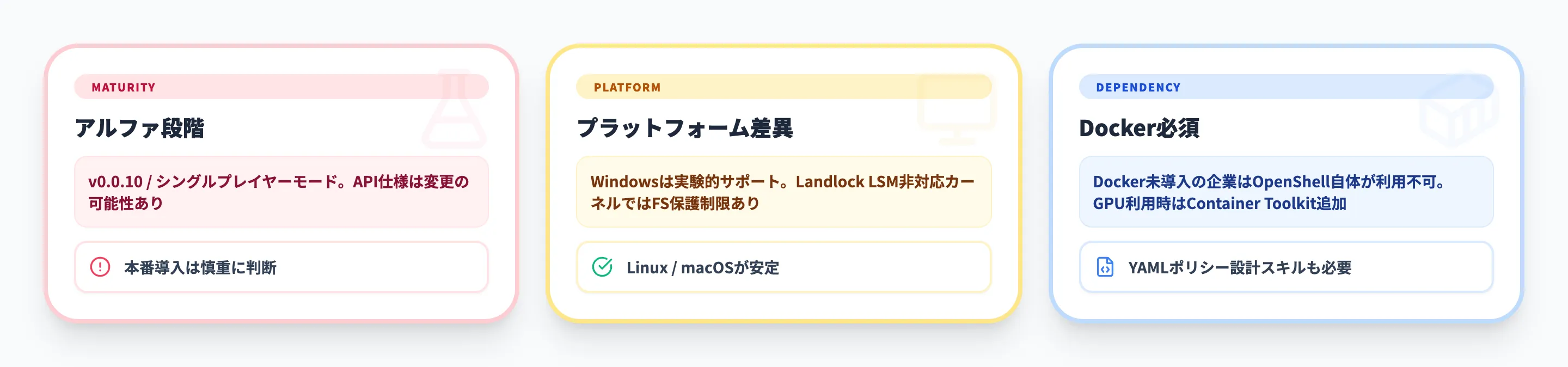

NVIDIA OpenShellの注意点と現時点の制限

OpenShellは2026年3月に公開されたばかりの製品であり、導入を検討する際にはいくつかの制約を理解しておく必要があります。

バージョンとステータス

2026年3月18日時点では、GitHubのlatest releaseはv0.0.10です。公式には**Alpha software(アルファ版)**であり、シングルプレイヤーモード(1人の開発者が1つの環境で使う想定)とされています。APIやCLIインターフェースの仕様は今後変更される可能性があるため、プロダクション環境への導入は慎重に判断する必要があります。

公開直後のプロジェクトであり、コアエンジン(NVIDIA/OpenShell)・コミュニティエコシステム(NVIDIA/OpenShell-Community)ともに実績はまだ限定的です。長期的な安定性については蓄積を待つ段階です。

プラットフォーム対応の差異

前述のシステム要件で触れたとおり、**Windowsサポートは実験的(Experimental)**です。WSL 2 + Docker Desktopの構成で動作しますが、Linux / macOSと同等の安定性は保証されていません。

また、LinuxカーネルのセキュリティモジュールであるLandlock LSMは推奨要件であり、対応していないカーネルバージョンではファイルシステム保護の一部が制限される可能性があります。

Docker依存

OpenShellはDocker上で動作するため、Dockerの導入が前提条件です。企業によっては、セキュリティポリシー上Dockerの利用が制限されているケースがあり、その場合はOpenShellの導入自体が困難になります。

GPU利用時の追加要件

GPU対応のサンドボックスを構築する場合、NVIDIAドライバに加えてNVIDIA Container Toolkitのインストールが必要です。ドライババージョンの互換性やContainer Toolkitのセットアップに追加の作業が生じる点は留意しておくべきでしょう。

ポリシー設計のスキル

OpenShellのセキュリティはYAMLポリシーの設計に大きく依存します。ポリシーが甘すぎればセキュリティが確保できず、厳しすぎればエージェントの動作に支障が出ます。効果的なポリシー設計には、エージェントの動作パターンとネットワーク通信先を理解した上での設計スキルが求められます。

公式ドキュメントにはクイックスタート用のポリシー例が用意されていますが、本番運用向けのポリシーテンプレートやベストプラクティスの充実は今後の課題です。

AIエージェントのセキュア運用を業務導入に結びつけるなら

OpenShellが解決する「AIエージェントを安全に動かす」という課題は、エージェントを業務に導入するすべての企業が直面するテーマです。サンドボックス・ネットワーク制御・ポリシー管理の設計思想を理解した上で、自社の業務環境にエージェントを組み込む際の実行基盤を選ぶことが次のステップになります。

AI総合研究所のAI Agent Hubは、Microsoft Teams上で業務エージェントをセキュアに稼働させ、バックオフィス業務を自律的に処理する基盤です。エージェントのセキュリティ設計を理解した上で、自社業務へのAIエージェント導入を具体化されたい方は、AI Agent Hubの詳細資料をご確認ください。

AIエージェントの安全運用基盤を理解した次はAI Agent Hubで実践する

セキュアなエージェント運用を業務に導入

OpenShellのサンドボックス設計が示すように、AIエージェントの安全な運用基盤は企業導入の前提条件です。AI Agent Hubは、Microsoft Teams上でセキュアにAIエージェントを稼働させ、業務タスクを自律処理する基盤を提供します。

まとめ

本記事では、NVIDIA OpenShellの基本概念からセキュリティ設計、インストール手順、活用シナリオ、料金・ライセンス、注意点まで解説しました。

OpenShellが提供する価値は、以下の3点に集約されます。

-

AIエージェントのためのセキュリティランタイム

ファイルシステム・ネットワーク・プロセス・推論の各レイヤーにカーネルレベルの隔離とポリシー制御を適用し、Deny-by-defaultの原則でエージェントの行動範囲を制御します。 -

エージェント非依存のオープン設計

Claude Code・Codex・OpenCode・OpenClawなど主要エージェントをOpenShell上で動かせますが、公式ポリシーの完成度にはエージェントごとに差があります。エージェント側のコード変更は不要で、Apache 2.0ライセンスにより商用利用も無償です。 -

既存セキュリティ体制との親和性

ポリシー適用・サンドボックス隔離・推論ルーティングの各機能が分離されているため、企業の既存セキュリティ統制と組み合わせやすい構造になっています。

次のステップ

AIエージェントのセキュリティ対策を検討している企業には、以下のアプローチを推奨します。

- ステップ1 Docker環境を準備し、OpenShellをインストール。まずはClaude CodeやCodexの小規模なサンドボックスで動作を確認

- ステップ2 自社のセキュリティ要件にもとづいてYAMLポリシーを設計。アクセス可能なファイルパス・ネットワーク先・推論エンドポイントを定義

- ステップ3 開発チームのパイロット運用を開始し、監査ログの蓄積とポリシーの調整を実施

- ステップ4 自社のセキュリティ監視基盤との連携(ログ連携・SIEM統合等)を検討し、本格展開へ移行

OpenShellはまだv0.0.10のアルファ段階にありますが、NVIDIAがGTC 2026で正式発表し、Agent ToolkitやNemoClawのセキュリティ基盤として位置づけている点は、AIエージェントのセキュリティランタイムという新しいカテゴリが立ち上がりつつあることを示しています。早期に技術を理解し、PoC環境で検証を始めておくことが、今後のAIエージェント本番運用への備えになるでしょう。

【関連記事】