この記事のポイント

レビュー漏れやセキュリティ脆弱性の見落としに課題のあるチームはClaude Codeコードレビューが第一候補、マルチエージェント並列分析で網羅性向上

Anthropic社内実績ではレビューコメント率が16%→54%に向上し、誤検出は1%未満。人間レビュアーの負荷軽減と品質向上を両立できる

GitHub App連携の自動レビューを基本導入し、REVIEW.mdでプロジェクト固有観点をカスタマイズ、CLIプラグインはローカル検証に併用

1レビューあたり$15〜$25のコストは、シニアエンジニアのレビュー工数削減で十分に回収可能。月次支出上限の設定を必ず行うべき

Research Preview段階のためミッションクリティカルな承認フローへの組み込みは避け、人間レビュアーの補助ツールとして段階導入

Microsoft MVP・AIパートナー。LinkX Japan株式会社 代表取締役。東京工業大学大学院にて自然言語処理・金融工学を研究。NHK放送技術研究所でAI・ブロックチェーンの研究開発に従事し、国際学会・ジャーナルでの発表多数。経営情報学会 優秀賞受賞。シンガポールでWeb3企業を創業後、現在は企業向けAI導入・DX推進を支援。

2026年3月9日、AnthropicはClaude Codeの新機能「コードレビュー」(Code Review)を発表しました。

PRが作成されるたびに複数のAIエージェントが並列でコードを分析し、ロジックエラーやセキュリティ脆弱性、リグレッションを自動検出する仕組みです。

本記事では、マルチエージェント構成の仕組みからセットアップ手順、REVIEW.mdによるカスタマイズ、料金体系、GitHub Copilot Code Reviewとの違いまでを体系的に解説します。

Claude Codeのコードレビュー機能とは?

Claude Codeのコードレビュー(Code Review)は、2026年3月9日にAnthropicが発表したClaude Codeの新機能です。

プルリクエスト(PR)が作成されるたびに、複数のAIエージェントが並列でコードを分析し、ロジックエラー・セキュリティ脆弱性・壊れたエッジケース・リグレッションを自動検出します。

Claude Codeのコードレビュー機能が生まれた背景には、AI生成コードの急増があります。Anthropicは公式ブログで、同社エンジニアのコード出力が過去1年間で200%増加したと報告しています。コード量が増えれば、人間のレビュアーにかかる負荷も比例して増大します。この「レビューボトルネック」を解消するために、Anthropic自身が社内で運用していたマルチエージェントレビューシステムを製品化したのがこの機能です。

以下の点がClaude Codeのコードレビュー機能の基本的な設計思想です。

-

検出対象はロジックの正確性に集中

フォーマットの好みやリンター(静的解析ツール)が検出できる問題はスキップし、LLMの推論能力でしか見つけられない論理的なバグに集中する

-

PRの承認やブロックは行わない

発見した問題をインラインコメントとして投稿するが、PRを承認するかどうかの判断は人間のレビュアーに委ねる設計になっている

-

既存のレビューワークフローを壊さない

重要度タグ(後述)を付けるだけで、既存のCI/CDパイプラインやレビュー承認フローには介入しない

つまり、Claude Codeのコードレビュー機能は「人間のレビュアーを置き換える」のではなく、人間が見落としやすい問題を先に検出して、レビューの質と網羅性を底上げする補助ツールとして設計されています。

Claude Codeコードレビューの仕組み

Claude Codeのコードレビュー機能の最大の特徴は、1つのAIモデルが1回だけコードを読む方式ではなく、複数の専門エージェントが並列で分析する「**マルチエージェント構成」を採用している点です。

ここでは、エージェント構成の概要、重要度レベル、検出対象と検出しないものを順に解説します。

マルチエージェント構成の詳細

PRが作成または更新されると、Claude Codeのコードレビュー機能は以下の流れで動作します。

1. 複数エージェントの並列起動

PRの差分とリポジトリ全体のコンテキストをもとに、複数のエージェントが同時に起動します。各エージェントは異なる観点からコードを分析します。

2. 問題候補の検出

各エージェントがそれぞれの視点でバグ候補を洗い出します。

3. 検証パス

追加のエージェントが候補を実際のコード挙動と照合し、false positive(誤検知)を除外します。

4. 重要度ランキングと出力

結果を重複排除し、重要度でランク付けしたうえで、PR上にインラインコメントとして投稿します。

レビューの深度はPRの複雑さに応じて自動的にスケールします。大きく複雑な変更にはより多くのエージェントとより深い分析が投入され、些末な変更には軽量なパスで処理される仕組みです。

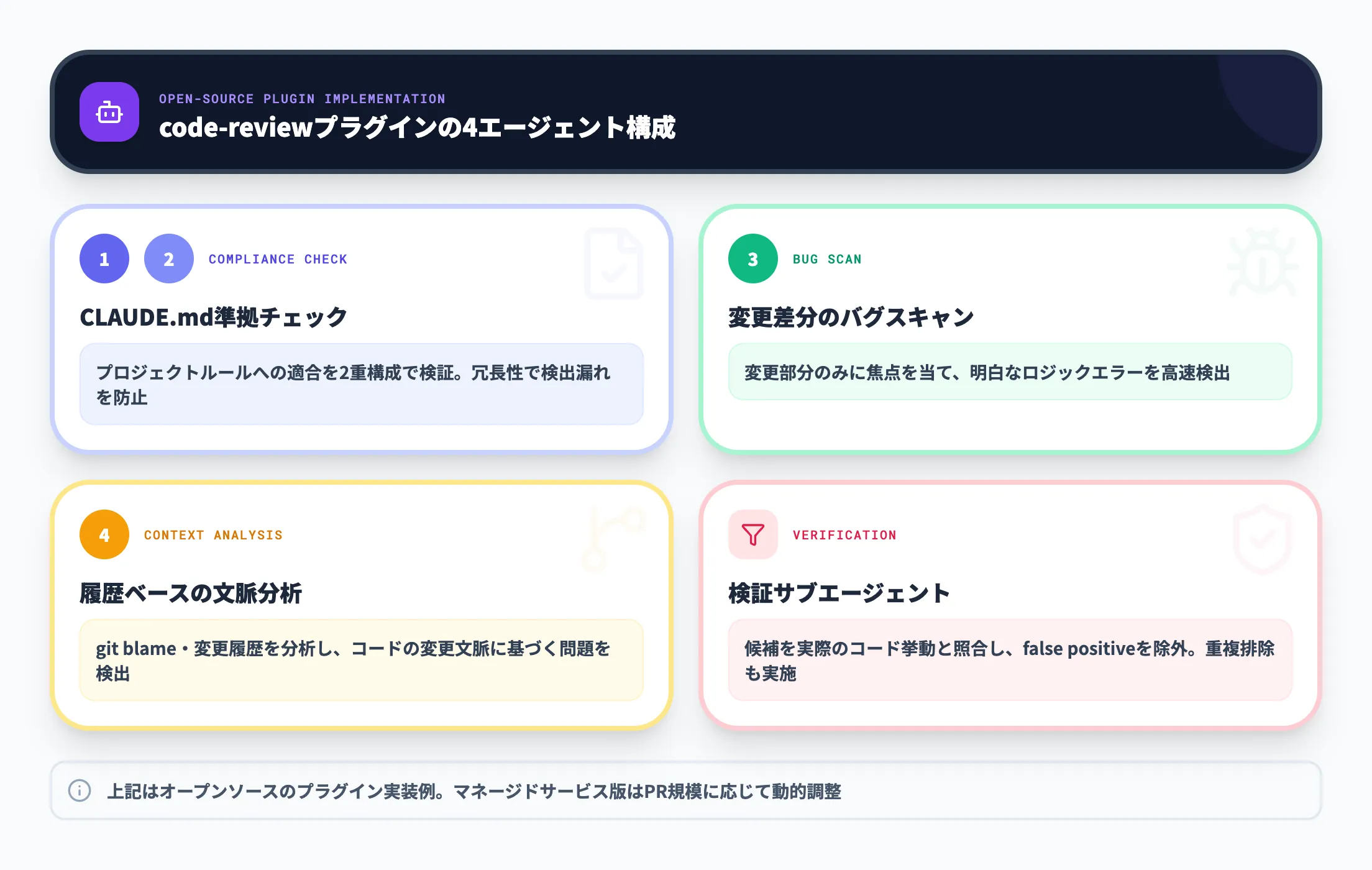

なお、Anthropicが公開しているオープンソースのレビュープラグイン実装(GitHub上の code-review plugin)では、以下のようなエージェント構成が確認できます。

| エージェント | 役割 |

|---|---|

| Agent #1・#2 | CLAUDE.md(プロジェクトのルールファイル)への準拠チェック。冗長性を持たせた2重構成で検出漏れを防ぐ |

| Agent #3 | 変更部分のみに焦点を当てた明白なバグスキャン |

| Agent #4 | git blameや履歴を分析し、コードの変更文脈に基づく問題検出 |

この構成はあくまでオープンソースのプラグイン実装例であり、マネージドサービス版(GitHub App連携)のエージェント構成は公開されていません。

マネージドサービス版ではPRの規模に応じてエージェント数や分析深度が動的に調整されることが公式ブログで説明されています。

いずれにしても、単一の視点では見落としやすい問題を多角的に捕捉しつつ、検証ステップで誤検知を絞り込むというのが設計の狙いです。

重要度レベル

検証ステップを通過した問題には、以下の3段階の重要度レベルが付けられます。

| マーカー | レベル | 意味 |

|---|---|---|

| 🔴 | Normal | マージ前に修正すべきバグ |

| 🟡 | Nit | 軽微な問題。修正が望ましいがブロッキングではない |

| 🟣 | Pre-existing | このPRで導入されたものではなく、コードベースに既存のバグ |

注目すべきは**Pre-existing(既存バグ)**の検出です。PRの差分だけでなくリポジトリ全体を分析するため、今回の変更とは無関係に存在していたバグも発見できます。

各コメントには折りたたみ可能な「extended reasoning」セクションが含まれており、なぜその問題がフラグされたのか、どのように検証されたのかを確認できます。

検出対象と検出しないもの

Claude Codeのコードレビュー機能が何を見つけ、何を見つけないのかを明確にしておくことは重要です。

以下の表で整理します。

| 分類 | 内容 |

|---|---|

| 検出する | ロジックエラー、セキュリティ脆弱性、壊れたエッジケース、リグレッション、CLAUDE.md違反(nitレベル) |

| 検出しない | フォーマットの好み、テストカバレッジの不足、リンターで検出できる問題 |

この設計は意図的なもので、公式ブログでは「リンターが既に処理できる問題を二重に報告するのではなく、LLMの推論能力でしか発見できない問題に集中する」という方針が示されています。

つまり、既存の静的解析ツール(SonarQube、ESLintなど)とは競合ではなく補完関係にあるということです。

Anthropic社内での実績データ

Claude Codeのコードレビュー機能は、Anthropic自身が社内のほぼすべてのPRに対して運用してきたシステムを製品化したものです。

公式ブログで公表されている実績データを以下の表にまとめます。

| 指標 | 数値 |

|---|---|

| 導入前にレビューコメントを受けたPRの割合 | 16% |

| 導入後にレビューコメントを受けたPRの割合 | 54% |

| 大規模PR(1,000行以上の変更)での検出率 | 84%で問題を検出、平均7.5件 |

| 小規模PR(50行未満の変更)での検出率 | 31%で問題を検出、平均0.5件 |

| incorrectとマークされた指摘の割合 | 1%未満 |

| 平均レビュー時間 | 約20分 |

特に注目すべきは、指摘のうちincorrectとマークされたものが1%未満という数値です。AIコードレビューツールの課題として「的外れな指摘が多く、開発者が無視するようになる」というノイズ問題がありますが、検証パスの仕組みにより、高い精度が実現されています。

また、大規模PRほど検出率が高い点も実務上の価値が大きいポイントです。1,000行を超える大きな変更は人間のレビュアーにとっても負荷が高く、見落としが起きやすい領域です。

そこで84%のPRから平均7.5件の問題を見つけているのは、まさに「人間が手薄になる部分をAIが補う」という設計思想が機能していることを示しています。

【関連記事】

Claude Code Agent Teamsとは?できることや使い方、料金体系を解説!

Claude Codeコードレビューの使い方

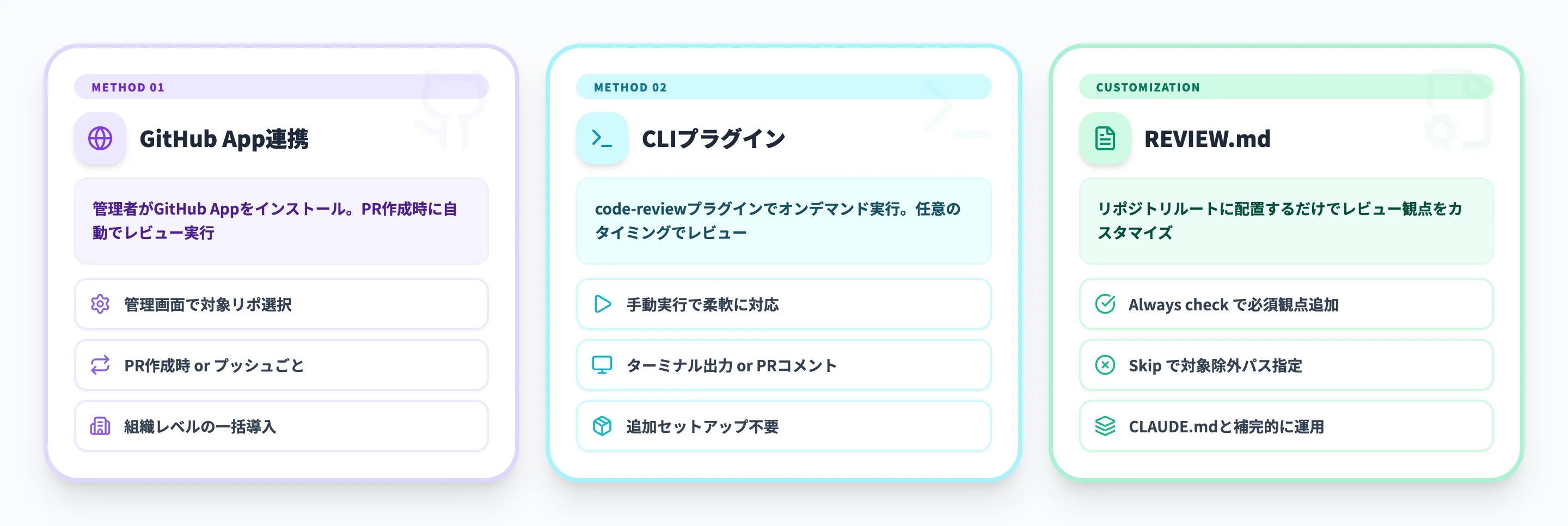

Claude Codeのコードレビュー機能には、組織の管理者がGitHub App連携で自動レビューを設定する方法と、開発者がCLIのcode-reviewプラグインでオンデマンドレビューを実行する方法の2つがあります。

ここでは、それぞれのセットアップ手順と、REVIEW.mdによるレビュー観点のカスタマイズ方法を解説します。

GitHub App連携(組織レベル)

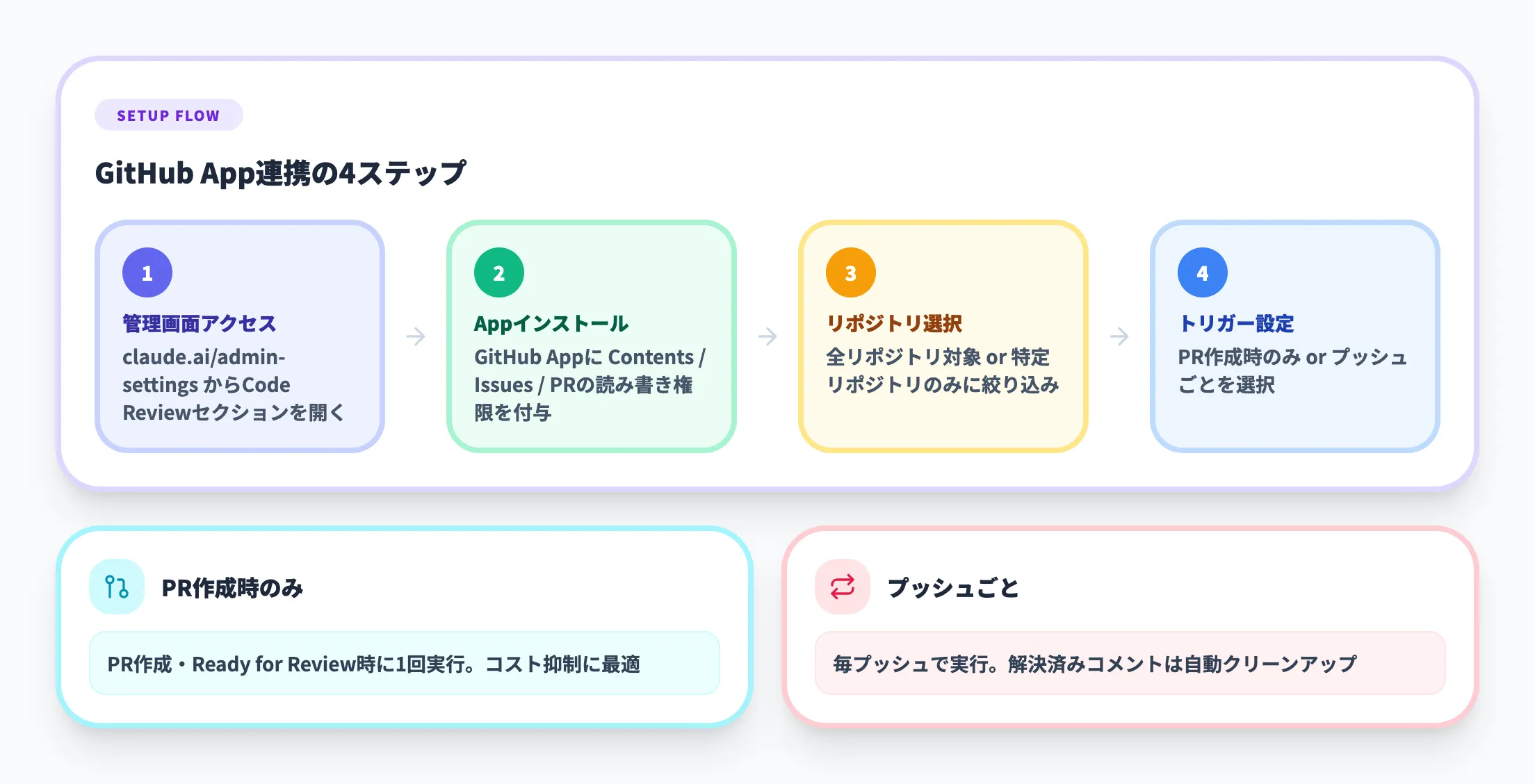

組織全体でClaude Codeのコードレビュー機能を導入する場合は、管理者がGitHub Appを設定します。以下の手順で進めます。

1. 管理画面にアクセス

claude.ai/admin-settings/claude-code にアクセスし、Code Reviewセクションを開きます。

2. GitHub Appをインストール

「Setup」をクリックすると、GitHub Appのインストールフローが開始されます。Claude GitHub Appには以下の権限が必要です。

| 権限 | 種類 |

|---|---|

| Contents | 読み取り・書き込み |

| Issues | 読み取り・書き込み |

| Pull requests | 読み取り・書き込み |

3. 対象リポジトリを選択

レビュー対象とするリポジトリを選択します。全リポジトリを対象にすることも、特定のリポジトリだけに絞ることもできます。

4. レビュートリガーを設定

リポジトリごとに、レビューが実行されるタイミングを選択します。

-

PR作成時のみ(After PR creation only)

PRが新規作成されたとき、またはドラフトからready for reviewに変更されたときに1回だけレビューを実行する。コストを抑えたい場合に適している

-

プッシュごと(After every push to PR branch)

PR branchにプッシュされるたびにレビューを実行する。解決済みのレビューコメントは自動でクリーンアップされる。継続的にコード品質を確認したい場合に適しているが、プッシュ回数分のコストがかかる

設定が完了すると、対象リポジトリでPRが作成されるたびにClaude Codeのコードレビュー機能が自動的に起動し、レビュー結果がPRコメントとして投稿されます。

CLIプラグインによるオンデマンド実行

GitHub App連携を設定していない場合や、特定のPRだけをレビューしたい場合は、CLIのcode-reviewプラグインを使ってオンデマンドでレビューを実行できます。

Anthropicが公開しているcode-reviewプラグイン実装では、現在のブランチの差分をマルチエージェントが分析し、結果がターミナルに出力されます。PRコメントとして直接投稿するオプションも用意されています。

CLI版を利用するには、以下の前提条件が必要です。

- Gitリポジトリで作業していること

- GitHub CLI(gh)がインストール・認証済みであること

- CLAUDE.mdファイル(任意だが、ガイドラインチェックに推奨)

CLI版はGitHub App連携と異なり追加のセットアップが不要で、開発者が任意のタイミングでレビューを実行できる手軽さが利点です。

REVIEW.mdによるカスタマイズ

Claude Codeのコードレビュー機能は、デフォルトでロジックの正確性に焦点を当てたチェックを行いますが、REVIEW.mdファイルをリポジトリのルートに配置することで、チーム固有のレビュー観点を追加できます。

REVIEW.mdは自動検出されるため、設定ファイルの変更や管理画面での操作は不要です。以下のような内容を記述できます。

# Code Review Guidelines

## Always check

- New API endpoints have corresponding integration tests

- Database migrations are backward-compatible

- Error messages don't leak internal details to users

## Style

- Prefer match statements over chained isinstance checks

- Use structured logging, not f-string interpolation in log calls

[](https://www.ai-souken.com/business/training)

## Skip

- Generated files under src/gen/

- Formatting-only changes in *.lock files

REVIEW.mdに記述した観点は、デフォルトの正確性チェックに追加される形で適用されます。「Always check」に書いた項目は常にレビュー対象となり、「Skip」に書いたパスやパターンはレビュー対象から除外されます。

REVIEW.mdとCLAUDE.mdの使い分けは以下のとおりです。

| ファイル | 用途 | 適用範囲 |

|---|---|---|

| REVIEW.md | コードレビュー専用のルール定義 | Code Review機能でのみ参照 |

| CLAUDE.md | プロジェクト全般の指示・規約 | レビューを含むClaude Codeの全セッションで参照 |

レビュー専用のルール(テストの必須化、スキップ対象のファイルなど)はREVIEW.mdに、プロジェクト全体のコーディング規約やアーキテクチャ方針はCLAUDE.mdに書くのが推奨されます。

【関連記事】

CLAUDE.mdとは?書き方やメモリ管理を徹底解説

マネージドサービス版とプラグイン版の違い

Claude Codeのコードレビュー機能には、**マネージドサービス版(GitHub App連携)とプラグイン版(CLIのcode-reviewプラグイン)**の2つの実行形態があります。

同じ「コードレビュー」という名前ですが、実行場所やレビュー深度、コストが異なるため、利用シーンに応じた選択が必要です。以下の表で両者の違いを整理します。

| 比較項目 | マネージドサービス版 | プラグイン版 |

|---|---|---|

| 実行場所 | Anthropicのインフラ上 | ユーザーのローカル環境 |

| 起動方法 | PR作成時に自動実行 | code-reviewプラグインで手動実行 |

| レビュー深度 | PRの規模に応じてエージェント数・分析深度が動的にスケール | オープンソース実装では4エージェント構成 |

| コスト | 1レビューあたり$15〜$25(トークン従量課金) | Claude Codeの通常利用分として課金 |

| セットアップ | 管理者がGitHub Appをインストール | 追加セットアップ不要 |

| 出力先 | PRコメントとして自動投稿 | ターミナル出力(--commentでPRコメントも可) |

| 対象プラン | Teams / Enterprise | Claude Codeが使える環境(サブスクリプションまたはAPIキー) |

マネージドサービス版は「PRを作るだけで自動的にレビューが走る」利便性が最大の強みです。チーム全体のレビュー品質を底上げしたい場合に適しています。

一方、プラグイン版は「特定のPRだけをレビューしたい」「コミット前にローカルで確認したい」といった柔軟な使い方ができます。コスト面でもマネージドサービス版より軽量です。

なお、AnthropicはGitHub Actionsを使ったセルフホスト型の統合や、GitLab CI/CD向けの統合も別途提供しています。CI/CDパイプラインに組み込みたい場合はこれらの選択肢も検討できます。

他のAIコードレビューツールとの比較

AIコードレビューツールの市場には、Claude Codeのコードレビュー機能以外にも複数の選択肢があります。ここでは、最も直接的な競合であるGitHub CopilotのCode Reviewと、従来型の静的解析ツールとの違いを整理します。

GitHub Copilot Code Reviewとの比較

GitHub Copilot Code Reviewは、2026年3月5日にエージェントアーキテクチャへ移行したGitHubのAIコードレビュー機能です。

Claude Codeのコードレビュー機能とほぼ同時期に大幅強化されており、直接の比較対象となります。

以下の表で主な違いを整理します。

| 比較項目 | Claude Code Code Review | GitHub Copilot Code Review |

|---|---|---|

| 提供元 | Anthropic | GitHub(Microsoft) |

| アーキテクチャ | マルチエージェント並列処理 | エージェントアーキテクチャ(2026年3月5日移行) |

| レビュー深度 | 深い(複数エージェントによる検証パス) | 深い(リポジトリ全体のコンテキスト取得) |

| レビュー時間 | 約20分 | 通常30秒未満 |

| 料金 | トークン従量課金($15〜$25/レビュー) | Premium requestベース。ライセンスユーザーはquota消費、無ライセンス許可ユーザーは組織overage課金 |

| 無料プラン | なし(Teams/Enterprise限定) | 個人向けCopilot FreeではVS Codeの「Review selection」のみ。ただし組織がBusiness/Enterpriseを導入済みならライセンス未付与メンバーもGitHub.com上でcode reviewを利用可能 |

| 自動修正 | なし(指摘のみ) | Coding Agent連携で修正を依頼可能(一部機能はpublic previewでopt-inが必要) |

| PRの承認 | しない(設計方針) | しない |

| 累計実績 | Anthropic社内で運用(具体数未公開) | 累計6,000万件以上のレビュー実施 |

| ステータス | Research Preview | GA(一般提供中) |

両者の最も大きな違いは料金モデルとエコシステムです。

なお、GitHub Copilot Code Reviewも2026年3月5日にエージェントアーキテクチャへ移行しており、複数の観点からコードを分析する仕組みを採用しています。

そのため、「マルチエージェント vs シングルエージェント」という単純な構図ではなく、エージェント構成の詳細と検証アプローチの違いが両者の差別化ポイントです。

Claude Codeのコードレビュー機能は、複数エージェントの並列処理と検証パスにより、特に大規模PRでの論理バグ検出に強みがあります。一方で、1レビューあたり$15〜$25という従量課金コストと約20分のレビュー時間は、GitHub Copilotと比較して大きなコスト差があります。

GitHub Copilot Code Reviewは、GitHubプラットフォームにネイティブ統合されており、追加のセットアップが最小限で済む点と、premium requestベースで利用でき組織設定に応じて課金形態が変わる柔軟さが強みです。

さらに、レビュー結果からGitHub Copilot Coding Agentに修正を依頼できる連携機能(一部public preview)も差別化ポイントです。

実務上は「どちらか一方」ではなく、用途や予算に応じた使い分けが現実的です。少数の重要なPR(セキュリティ関連の変更、コアアーキテクチャの変更など)にはClaude Codeの深いレビューを、日常的なPRにはGitHub Copilotの軽量レビューを適用する、といった運用が考えられます。

【関連記事】

GitHub Copilotコードレビューとは?使い方や料金、おすすめ設定を解説

静的解析ツールとの違い

SonarQubeやCodacyなどの静的解析ツールとClaude Codeのコードレビュー機能は、補完関係にあります。

| 比較項目 | Claude Code Code Review | 静的解析ツール(SonarQube / Codacy等) |

|---|---|---|

| 分析手法 | LLMによる推論ベースの論理検証 | ルールベースのパターンマッチング |

| 検出対象 | ロジックエラー、設計上の問題 | コードスメル、セキュリティパターン、依存関係の脆弱性 |

| 検出精度 | コンテキスト依存のため高精度だがコスト高 | ルールが明確なため安定しているが文脈理解は限定的 |

| CI/CD統合 | PRコメントとして出力 | 品質ゲートとしてマージをブロック可能 |

| 言語対応 | 言語非依存 | ツールにより30〜49言語 |

静的解析ツールは「既知のパターンに基づく問題」を高速かつ安定的に検出するのに対し、Claude Codeのコードレビュー機能は「コードの文脈を理解したうえでの論理的な問題」を検出します。

そのため、静的解析ツールでフォーマットやセキュリティパターンを網羅し、Claude Codeのコードレビュー機能でロジックの正確性を検証するという併用が理想的です。Claude Codeのコードレビュー機能自体が、リンターで検出できる問題をスキップする設計になっていることからも、この併用を前提としていることが分かります。

【関連記事】

Claude Code Securityとは?機能や使い方を徹底解説

Claude Codeコードレビューの料金体系

Claude Codeのコードレビュー機能はトークン使用量に基づく従量課金で提供されています。ここでは、料金の内訳とコスト管理機能を解説します。

トークン従量課金の仕組み

公式ドキュメントによると、1レビューあたりの平均コストは**$15〜$25**です。

この金額はPRのサイズ、コードベースの複雑さ、検証が必要な問題の数によって変動します。小規模な修正であれば$15を下回ることもあり、大規模で複雑な変更では$25を上回る場合もあります。

レビュートリガーの設定もコストに影響します。

- PR作成時のみを選択した場合、1つのPRにつき原則1回のレビューが実行される

- プッシュごとを選択した場合、PRブランチへのプッシュ回数分だけレビューが実行される

たとえば、1つのPRに対して5回プッシュする運用であれば、「プッシュごと」設定ではコストが5倍になる計算です。開発チームのワークフローに合わせてトリガー設定を選ぶことが重要です。

コスト管理機能

Claude Codeのコードレビュー機能には、コストを可視化・制御するための管理機能が用意されています。

-

月次の組織支出上限

claude.ai/admin-settings/usage で月額の上限金額を設定できる。上限に達するとレビューが一時停止される

-

リポジトリ単位の有効/無効

コストが不要なリポジトリ(個人の実験リポジトリなど)を個別に無効化できる

-

分析ダッシュボード

claude.ai/analytics/code-review で、レビュー済みPR数、週次コスト、開発者が対応した(自動解決された)コメント数、リポジトリ別の内訳を確認できる

特にダッシュボードの「リポジトリ別の平均レビューコスト」は、コスト最適化の判断に役立ちます。

レビューコストが高いリポジトリについては、PRのサイズを小さくする(こまめにPRを出す)運用に変えることで、1レビューあたりのコストを抑えられます。

【関連記事】

Claude Codeの料金体系ガイド!利用制限や確認・可視化方法を解説【2026年版】

Claude Codeコードレビューの利用条件と注意点

Claude Codeのコードレビュー機能を導入する前に、以下の利用条件と制限事項を把握しておく必要があります。

利用条件

2026年3月時点での利用条件を以下の表にまとめます。

| 条件 | 詳細 |

|---|---|

| 対応プラン | Claude for Teams / Claude for Enterprise のみ。Pro / Maxプランでは利用不可 |

| 提供状況 | Research Preview(一般提供の日程は未発表) |

| GitHub連携 | GitHub App連携またはGitHub CLI(gh)が必要 |

| Zero Data Retention(ZDR) | ZDRが有効な組織では利用不可 |

最も重要な制限は、TeamsまたはEnterprise限定であるという点です。個人開発者がPro/Maxプランで利用することはできません。組織としてClaude for TeamsまたはEnterprise契約が必要です。

また、ZDR(Zero Data Retention)が有効な組織では利用できない点も注意が必要です。

コードレビューの実行にはPRの内容をAnthropicのインフラに送信する必要があるため、データ保持ゼロのポリシーとは両立しません。

利用時の注意点

導入を検討する際に留意すべき点を整理します。

-

レビュー時間は約20分

速度より深度を優先する設計のため、即時のフィードバックを期待する運用には向かない。急ぎのhotfixなどではCLI版のプラグインや他のツールとの使い分けが現実的

-

PRの承認は行わない

レビュー結果はコメントとして投稿されるのみで、Approve/Request Changesの判定は行わない。最終的なレビュー承認は人間が行う必要がある

-

1レビューあたりのコストが高め

$15〜$25/レビューは、GitHub Copilot Code Review(プラン内のPremium Request消費)と比較すると高額。全PRへの適用よりも、重要なPRに絞った運用がコスト効率が良い

-

Research Previewの段階

2026年3月時点ではResearch Previewであり、機能の変更や料金体系の見直しが行われる可能性がある。本番環境のワークフローに組み込む場合はこの点を考慮したうえで判断する

これらの制約を踏まえると、Claude Codeのコードレビュー機能はセキュリティクリティカルなリポジトリや、大規模な変更が頻繁に発生するプロジェクトに重点的に適用するのが効果的です。

すべてのPRに一律で適用するよりも、リスクの高いPRにピンポイントで投入する運用が、コストと効果のバランスが取れます。

【関連記事】

Claude Codeの企業利用ガイド!プラン選定からセキュリティ設計・PoCの進め方を解説

AIコードレビューの導入から開発プロセス全体のAI化を検討するなら

Claude Codeのコードレビュー機能のように、AIが開発ワークフローの一部を担う時代が到来しています。

コードレビューの自動化で得られた効果を、テスト自動化やドキュメント生成、デプロイプロセスなど開発全体に広げることで、チームの生産性はさらに向上します。AI総合研究所のガイドでは、開発業務に限らず業務プロセス全体へのAI導入方法を体系的に解説しています。

AI総合研究所のガイドで、開発チームのAI化を全社の業務改善に展開する方法をご確認ください。

AIコードレビューの効率化を開発チーム全体のAI化に展開する

開発プロセスへのAI導入を実践解説

Claude Codeのコードレビュー機能を理解した次は、開発プロセス全体にAIを組み込む計画を検討しましょう。ガイドではAI導入の実践的な進め方を解説しています。

まとめ

本記事では、2026年3月9日に発表されたClaude Codeのコードレビュー機能(Code Review)について、マルチエージェント構成の仕組みから使い方、料金体系、競合ツールとの比較までを解説しました。

Claude Codeのコードレビュー機能がもたらす価値は、大きく3つに集約できます。

- 1. 人間が見落としやすいバグの事前検出

複数のAIエージェントが並列で分析し、検証パスでfalse positiveを除外する仕組みにより、ロジックエラーやセキュリティ脆弱性といった「コードの文脈を理解しないと見つけられない問題」を高精度で検出します。Anthropic社内ではレビューコメントを受けるPRが16%から54%に増加しています。

- 2. レビュー品質の組織的な底上げ

GitHub App連携による自動実行とREVIEW.mdによるカスタマイズにより、チーム固有のレビュー基準を一貫して適用できます。レビュアーの経験やスキルに依存しない、安定したレビュー品質を実現します。

- 3. 既存ワークフローとの共存

PRの承認やブロックは行わず、インラインコメントとして指摘するだけの設計です。静的解析ツールやGitHub Copilot Code Reviewとも補完的に併用でき、既存のCI/CDパイプラインやレビュー承認フローを変更する必要がありません。

2026年3月時点ではResearch Previewの段階であり、Claude for TeamsまたはEnterpriseの組織に限定されています。まずはセキュリティクリティカルなリポジトリや大規模PRの多いプロジェクトで試験的に導入し、コスト対効果を検証してから展開範囲を広げていくのが現実的なアプローチです。

なお、AI総研では日本語の業務文書生成や日次運用に対応したAgent Skillsやワークフローを整備し、GitHubで公開しています。日本語環境でClaude Codeを活用する際の参考としてご利用ください。

AI総研 Claude Code日本語ワークフロー集