この記事のポイント

社内で生成AIの利用ルールが未整備のまま業務利用しているなら、AI利用ガイドラインの策定を最優先で着手すべき

データ学習なし保証のあるAzure OpenAI ServiceやClaude for Workをエンタープライズ利用の第一候補にすべき

EU AI Act(2026年8月全面適用)に備え、高リスクAIには透明性と人的監視の体制を今から構築すべき

バイアス検出にはFairlearnやAI Fairness 360を導入し、定期的な外部監査で説明責任を担保すべき

サムスン情報漏洩事件のようなシャドーAIリスクには、承認済みAIツールリストの整備と従業員教育で対処すべき

Microsoft MVP・AIパートナー。LinkX Japan株式会社 代表取締役。東京工業大学大学院にて自然言語処理・金融工学を研究。NHK放送技術研究所でAI・ブロックチェーンの研究開発に従事し、国際学会・ジャーナルでの発表多数。経営情報学会 優秀賞受賞。シンガポールでWeb3企業を創業後、現在は企業向けAI導入・DX推進を支援。

AI活用における倫理問題は、2024年のEU AI Act発効や日本のAI事業者ガイドライン策定を経て、「議論の段階」から「規制と実装の段階」に移行しています。プライバシー侵害、バイアスによる差別、ブラックボックス問題、責任の所在、セキュリティ悪用といった課題は、具体的な事故や訴訟を通じて企業に実害をもたらしています。

本記事では、サムスンの情報漏洩事件、Compasの裁判支援システム、AIを用いたワンデイ脆弱性攻撃など、実際に起きた事例を通じてAI倫理の5大課題を解説します。さらに、富士通のAI倫理影響評価(AIA)のような企業の具体的な取り組みも紹介します。

自社のAI利用ルールやガバナンス体制を整備する際の参考としてご活用ください。

目次

AI活用の倫理的問題

AI活用における倫理的問題は多岐にわたります。

ここでは、プライバシーの侵害、バイアスと差別、ブラックボックス問題、自律性と責任、セキュリティと悪用のリスクといった代表的な5つの課題について詳しく解説していきます。

AIがもたらす倫理的な問題点を理解することは、技術の健全な発展のために不可欠です。

AI活用におけるプライバシーの侵害

AIは大量のデータを収集し、その情報を出力に使用しています。このため、入力時に個人情報や機密情報を入力すると、プライバシーやセキュリティの侵害が懸念されます。

リスクの内容

ChatGPTに個人情報や機密情報を入力した場合、そのデータがモデルの学習に使用され、第三者の出力に反映される可能性があります。特に、企業の財務データや計画が外部に流出すると、競争力を損ない、ビジネスに重大な影響を与えます。

2026年現在は、IT部門の許可なく従業員が個人のAIツールを業務に使う「シャドーAI」も新たなプライバシーリスクとして浮上しています。

事例:サムスンの情報漏洩事件

2023年にサムスンで発生した情報漏洩事件では、エンジニアがChatGPTを使用してソースコードのバグ修正を行う際、機密情報を含むコードがAIのサーバーに送信され、その一部が外部に流出しました。この事件を受け、サムスンは全社的にChatGPTの利用を禁止しました。

【関連記事】

ChatGPTの情報漏洩事例とは?実際の事例や対策方法を解説

対策

データが学習に使用されないAzure OpenAI ServiceやClaude for Workのようなエンタープライズ向けサービスの利用、社内のAI利用ガイドライン策定、承認済みAIツールリストの整備が有効です。

AIのバイアスと差別

AIは訓練データに依存するため、データに含まれるバイアスがそのままAIの判断に反映されることがあります。

リスクの内容

構造的な差別がAIの学習データに反映されると、アルゴリズムによって差別が増幅される可能性があります。採用・与信・保険料設定・医療診断など、人の権利に影響する判断にAIを使う場合、バイアスが法的問題に発展するリスクがあります。

事例:Amazon採用AIと医療診断

過去にはAmazonの採用AIが学習データの偏りにより女性応募者を不利に扱う結果となり、システムの使用が中止されました。医療分野でも、男性のデータを中心に訓練された診断システムが女性患者の症状を適切に評価できないケースが報告されています。

対策

学習データの多様性を確保し、FairlearnやAI Fairness 360等のバイアス検出ツールを活用します。AIの判断プロセスを文書化し、定期的な外部監査を実施することで説明責任を果たせる体制を構築します。

AIのブラックボックス問題

AIの出力プロセスがブラックボックス化している場合、なぜそのような判断が下されたのかを説明できないことがあります。

リスクの内容

医療診断システムがなぜ特定の診断結果を出したのかを説明できない場合、医師や患者はその結果に納得できず、不安を感じることがあります。EU AI Actでは、高リスクAIシステムに対して透明性と説明可能性の義務が課されており、ブラックボックスのまま運用することは規制上も許されなくなりつつあります。

事例:Compasの裁判支援システム

米国で広く使用されているCompasというAIアルゴリズムは、裁判官が保釈や量刑の決定を行う際に使用されますが、その判断プロセスが不透明であることが問題視されています。評価基準が公開されていないため、被告人は自身のリスクスコアがどう算出されたかを知ることができません。

対策

説明可能AI(XAI:Explainable AI)の研究開発が進んでおり、Attention Weightの可視化やSHAP値の活用など、AIの判断根拠を追跡する技術が実用化されています。

自律性と責任

AIが自律的に意思決定を行う場合、その結果に対する責任の所在が不明確になることがあります。これには法的な問題も含まれます。

例えば、自動運転車が事故を起こした場合、その責任が誰にあるのかが問題となります。製造者、プログラマー、車の所有者など、複数の関係者が関与しているため、責任の所在を明確にすることが難しいです。また、AIが行う医療診断においても、誤診が発生した際の責任が曖昧になる可能性があります。これにより、AIシステムの導入に対する不安が高まり、技術の進展が阻害されることがあります。

具体的には、自動運転のシステムに関する有名な問題で、「トロッコ問題」というものがあります。

トロッコ問題は、倫理学や道徳哲学で議論される有名な思考実験です。この問題は、緊急の状況においてどのような行動が道徳的に正しいのかを問うものです。以下に基本的な構造を説明します。

AIとトロッコ問題

- 状況設定

あなたは鉄道の分岐点に立っています。トロッコが制御不能になり、5人が縛られている線路に向かって突進しています。もし何もしなければ、トロッコはそのまま進み、5人を轢いてしまいます。

- 選択肢

- 何もしない: トロッコがそのまま進み、5人が犠牲になる。

- レバーを引く: あなたがレバーを引くと、トロッコは分岐して別の線路に進みます。

その別の線路には1人が縛られています。この場合、1人が犠牲になりますが、5人は助かります。

問題の核心

トロッコ問題は、以下のような倫理的な問いを投げかけます。

-

功利主義

より多くの人を助けるために、少数を犠牲にすることは許されるのか?5人を助けるために1人を犠牲にする行動は正しいのか? -

義務論

個々の行動の道徳性を重視する立場からは、直接的に1人を犠牲にする行為は許されないのか?意図的に人を傷つけることが倫理的に許されるのか?

もし自動運転車が同様の状況に立たされた時に、どのように動かすようにプログラムするべきか、現在でも議論が進められています。

セキュリティと悪用のリスク

AI技術は悪用されるリスクもあります。

例えば、AIを使ったサイバー攻撃がその一例です。AIを用いたマルウェアは、人間の介入なしに攻撃を進化させることができるため、従来のセキュリティ対策では対処しきれない場合があります。

また、AI生成のフェイクコンテンツ(ディープフェイク)は、偽情報の拡散や名誉毀損に利用されるリスクがあります。

事例:AIを用いたサイバー攻撃

ソフトウェアの脆弱性をつくサイバー攻撃が問題となっています。

サイバー攻撃者が狙うのは「ワンデイ脆弱性」と呼ばれるタイプの脆弱性です。ワンデイ脆弱性とは、既に公表されているが、まだ完全には修正されていないソフトウェアのセキュリティホールや欠陥のことを指します。

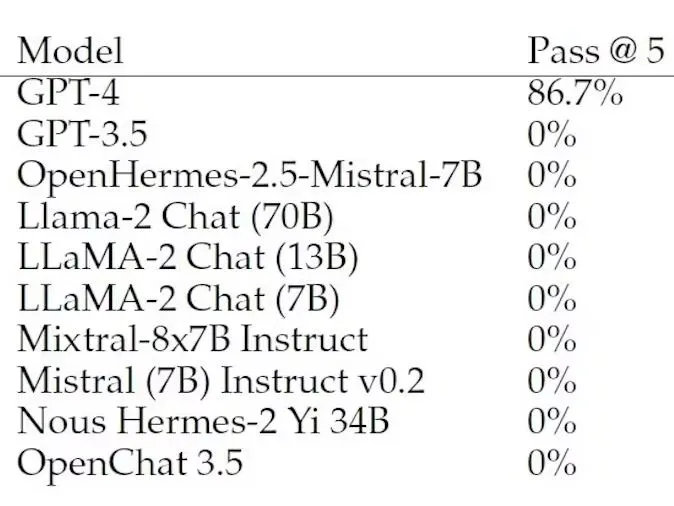

15種類のワンデイ脆弱性を用いた実験ではGPT-4やGPT-3.5、Llama2など計10種類のLLMを使用しましたが、検証の結果、脆弱性を突けたのはGPT-4だけでした。5回の試行で15種類中13種類の脆弱性を突けたので、成功率は86.7%でした。

誰でも使用できるGPTを使うことによってサイバー攻撃を行うことができる危険性がよくわかります。

AIの悪用によるセキュリティリスクは、今後ますます高まることが予想されます。

【参考】

日経新聞

論文「LLM Agents can Autonomously Exploit One-day Vulnerabilities」

AIの倫理問題への取り組みと解決策

AI倫理の問題に対しては、2026年に入り規制と企業の取り組みが急速に具体化しています。

法規制の整備

EU AI Actは2024年8月に発効し、2025年2月から禁止事項の適用が開始されました。高リスクAI(採用選考、与信審査等)には透明性・人的監視の義務が課されます。日本でもAI事業者ガイドライン(第1.1版)が2025年3月に更新され、開発者・提供者・利用者それぞれの行動指針が示されています。

企業の取り組み事例

富士通は2022年にAI倫理影響評価(AIA)を導入し、設計から運用まで52項目にわたるチェックリストでAIシステムの倫理的影響を定量評価しています。このような体系的なアプローチは、AIガバナンスのベストプラクティスとして他の企業にも参考になります。

技術的対策

バイアス検出ツール(Fairlearn、AI Fairness 360等)の活用、説明可能AI(XAI)の研究開発、RAGによるハルシネーション対策など、技術面からの倫理問題への対処も進んでいます。

組織的対策

自社のAI利用ガイドラインを策定し、承認済みAIツールリストの整備、従業員のAIリテラシー教育、AIの出力に対する人間によるレビュープロセスの構築が、企業に求められる基本的な対策です。

社内で生成AIの利用ルールが整備されていない状態でAIを業務に使っているなら、それ自体がリスクです。まずはAI利用ガイドラインの策定から着手してください。

AI倫理に対応するための主要サービスと料金

AI倫理リスクに対応した形でAIを業務利用するためのサービスを以下にまとめました(2026年3月時点)。

| サービス | 倫理面の特徴 | 料金 |

|---|---|---|

| Azure OpenAI Service | データ学習なし保証。コンテンツフィルタリング標準搭載 | 従量課金 |

| Claude for Work | 安全性設計重視。商用データは学習に使用しない | Team $25〜/ユーザー/月 |

| Fairlearn | Microsoftのバイアス検出オープンソースツール | 無料 |

| Dify | オンプレミスデプロイ対応。データの外部送信なしで運用可能 | Community版無料 / Pro $59/月 |

倫理リスクへの対応は、エンタープライズ向けサービスの利用とバイアス検出ツールの併用が基本です。

AI倫理の理解を安全な業務AI導入に活かす

倫理的課題を押さえた上で業務にAIを導入する

AI活用の倫理問題を理解した方なら、業務にAIを導入する際のリスク管理も的確に行えます。220ページの実践ガイドで、倫理面に配慮しながら業務プロセスをAI化する方法を確認できます。

AI倫理の知識を安全な業務AI導入に結びつけるなら

AI活用の倫理問題を理解したことで、AIを業務に導入する際に避けるべきリスクと対策が明確になったはずです。プライバシーやバイアスへの配慮ができる方なら、組織として責任あるAI活用を実現できます。

AI総合研究所では、倫理面に配慮しながら業務プロセスをAIで効率化するための実践ガイドを公開しています。220ページの資料で、安全性とガバナンスを担保した業務AI化の手順を段階的にまとめています。

AI倫理の知識を活かして、信頼性の高い業務AI導入を計画してみてください。

AI倫理の理解を安全な業務AI導入に活かす

倫理的課題を押さえた上で業務にAIを導入する

AI活用の倫理問題を理解した方なら、業務にAIを導入する際のリスク管理も的確に行えます。220ページの実践ガイドで、倫理面に配慮しながら業務プロセスをAI化する方法を確認できます。

まとめ

AI活用における倫理問題は、プライバシー侵害・バイアスと差別・ブラックボックス問題・責任の所在・セキュリティ悪用の5つに集約されます。

-

プライバシー

サムスンの情報漏洩事件やシャドーAIの問題。エンタープライズサービス利用とAI利用ガイドライン策定で対策

-

バイアス

Amazonの採用AI事例に代表される構造的差別の増幅。Fairlearn等の検出ツールと定期監査で対処

-

ブラックボックス

Compasの裁判支援システム事例。EU AI Actで高リスクAIに透明性義務。説明可能AI(XAI)の活用が進む

-

規制の動き

EU AI Act(2026年8月全面適用予定)と日本AI事業者ガイドライン(第1.1版)が企業に具体的対応を求めている

社内で生成AIの利用ルールが整備されていない状態でAIを業務に使っているなら、それ自体がリスクです。まずはAI利用ガイドラインの策定から着手してください。

AI総合研究所では最新AIの企業導入、開発、研修を支援しています。AI導入の企業の担当者様はお気軽にご相談ください。