この記事のポイント

①オープンソースでClaude Sonnet級のコーディング性能を求めるなら、Qwen3-Coderが第一候補。Apache 2.0ライセンスで商用利用も自由、ベンダーロックインを避けたい企業に最適

②2026年2月リリースのQwen3-Coder-Nextは、80B中わずか3BのアクティブパラメータでSWE-bench Verified 70.6%を達成。46GB RAMでローカル実行可能なため、機密コードを外部に出せない環境に向いている

③API料金はQwen3-Coder-Nextが入力$0.12/100万トークン・出力$0.75/100万トークンと、Claude APIやGPT APIの数分の1。コードレビュー自動化のような大量トークン処理でコスト優位性が際立つ

④Claude Code・Cline・Cursor・Qwen Codeなど主要ツールと統合可能。既存の開発ワークフローを変えずにモデルだけ差し替える運用ができる

⑤まずはAPI経由でCI/CDパイプラインのコードレビュー自動化から導入し、効果を確認した上でローカルデプロイやエージェント型タスクに段階的に拡張するのが最も効率的

Microsoft MVP・AIパートナー。LinkX Japan株式会社 代表取締役。東京工業大学大学院にて自然言語処理・金融工学を研究。NHK放送技術研究所でAI・ブロックチェーンの研究開発に従事し、国際学会・ジャーナルでの発表多数。経営情報学会 優秀賞受賞。シンガポールでWeb3企業を創業後、現在は企業向けAI導入・DX推進を支援。

「オープンソースでClaude Sonnet級のコーディング性能がほしい」「エージェント型のAIコーディングを自社環境で動かしたい」「APIコストを抑えつつ大規模リポジトリを一括解析したい」——そんな開発チームにとって、Alibaba CloudのQwen3-Coderは最有力候補の一つです。

Qwen3-Coderは、480Bパラメータ(35Bアクティブ)のMixture-of-Experts(MoE)アーキテクチャを採用し、SWE-bench VerifiedでClaude Sonnetに匹敵するスコアを達成したオープンソースのコーディング特化モデルです。

2026年2月にはローカル実行に最適化された「Qwen3-Coder-Next」(80B/3Bアクティブ)もリリースされ、SWE-bench Verified 70.6%という高スコアをわずか3Bのアクティブパラメータで実現しています。

本記事では、Qwen3-Coderのモデルラインナップ、技術仕様、ベンチマーク性能、API料金、主要ツールとの統合方法、そしてClaude CodeやGitHub Copilotとの比較まで包括的に解説します。

Qwen3-Coderとは

Qwen3-Coderは、Alibaba CloudのQwenチームが開発した**エージェント型コーディングに特化したオープンソースの大規模言語モデル**です。最上位モデルのQwen3-Coder-480B-A35B-Instructは、480Bのパラメータを持つMixture-of-Experts(MoE)アーキテクチャを採用し、推論時には35Bのアクティブパラメータのみを使用することで、高性能と推論コストの抑制を両立しています。

Qwen3-Coderが多くの開発者に注目されている理由は、以下の3つの特徴にあります。

-

オープンソース(Apache 2.0)で商用利用が自由

Apache License 2.0の下で公開されており、ソースコードの改変・再配布・商用利用が自由に行えます。特定のベンダーに依存せず、自社の開発パイプラインに組み込める柔軟性が最大の強みです。

-

Claude Sonnetに匹敵するコーディング性能

SWE-bench Verifiedでオープンソースモデル最高水準のスコアを達成し、Claude Sonnet 4と同等の性能を実現しています。エージェント型タスク(コード生成・バグ修正・リファクタリング)で特に高い精度を発揮します。

-

100万トークンの長文コンテキスト

ネイティブで256Kトークン、YaRN技術による拡張で最大100万トークンのコンテキストに対応します。リポジトリ全体を一括で読み込み、プロジェクト構造を把握した上でのコード生成やレビューが可能です。

2026年4月時点でGitHubリポジトリは14,400以上のスターを獲得しており、オープンソースのコーディングAIモデルとして活発なコミュニティが形成されています。

Qwen3-Coderのモデルラインナップ【2026年版】

Qwen3-Coderは、用途やハードウェア環境に応じて選べる3つのモデルバリアントを提供しています。以下の表で各モデルの特徴を整理しました。

| モデル | 総パラメータ | アクティブパラメータ | コンテキスト長 | SWE-bench Verified | 主な用途 |

|---|---|---|---|---|---|

| Qwen3-Coder-480B-A35B | 480B | 35B | 256K(最大1M) | 66.5〜69.6% | API経由の高精度タスク |

| Qwen3-Coder-30B-A3B | 30B | 3.3B | 256K(最大1M) | — | リソース制約環境でのローカル実行 |

| Qwen3-Coder-Next | 80B | 3B | 256K | 70.6% | ローカルエージェント開発 |

この一覧から分かるのは、Qwen3-Coderが「最高性能」と「ローカル実行の効率性」の両方をカバーする戦略をとっている点です。

Qwen3-Coder-480B-A35B-Instruct

2025年7月にリリースされた最上位モデルです。480Bの総パラメータのうち35BのみをアクティベートするMoEアーキテクチャにより、フルサイズモデルに近い性能を低い推論コストで実現しています。7.5兆トークン(うち70%がコードデータ)で訓練されており、358種類のプログラミング言語に対応します。

API経由での利用が前提で、DashScope(Alibaba Cloud Model Studio)を通じてアクセスします。大規模リポジトリのコードレビュー自動化やプルリクエストの分析といった、高精度が求められるタスクに適しています。

Qwen3-Coder-30B-A3B-Instruct

480Bモデルの小型バリアントで、30B中3.3Bのアクティブパラメータで動作します。OllamaやLM Studioでのローカル実行に対応しており、GPU VRAMが限られた環境でもコーディング支援を利用できます。

Qwen3-Coder-Next(2026年2月リリース)

2026年2月にリリースされた最新モデルで、Qwen3-Coderファミリーの中で最も効率性に優れたバリアントです。80B中わずか3Bのアクティブパラメータで、SWE-bench Verified 70.6%という480Bモデルを上回るスコアを達成しています。

Qwen3-Coder-Nextが高効率を実現している背景には、新しいハイブリッドアーキテクチャの採用があります。従来のTransformerベースの注意機構に加え、Gated DeltaNet(線形注意機構)を組み合わせたハイブリッドレイアウト(12サイクル×(3層DeltaNet MoE → 1層Gated Attention MoE))を採用し、512個のエキスパートから10個をアクティベートする超スパース設計により、アクティブパラメータ比10〜20倍のモデルと同等の性能を実現しています。

46GB以上のRAM/VRAM/ユニファイドメモリがあればローカルで実行でき、機密コードを外部に送信できない環境でのエージェント型開発に適しています。Hugging Faceでの月間ダウンロード数は90万件を超えており、急速にコミュニティに浸透しています。

Qwen3-Coderの技術仕様とベンチマーク性能

Qwen3-Coder-480Bの技術仕様

以下の表に、フラッグシップモデルの主要な技術仕様をまとめました。

| 仕様項目 | 詳細 |

|---|---|

| モデルタイプ | Causal Language Model(MoE) |

| 総パラメータ数 | 480B |

| アクティブパラメータ数 | 35B |

| レイヤー数 | 62 |

| アテンションヘッド数 | 96(Q)、8(KV)※GQA採用 |

| 総エキスパート数 | 160 |

| アクティブエキスパート数 | 8 |

| ネイティブコンテキスト長 | 262,144トークン |

| 拡張コンテキスト長 | 最大100万トークン(YaRN技術) |

| 対応言語数 | 358種類 |

| 訓練トークン数 | 7.5兆トークン(コードデータ70%) |

| ライセンス | Apache License 2.0 |

MoEアーキテクチャの利点は、推論時に全パラメータを使わない点にあります。480B中35Bのみがアクティベートされるため、同サイズの密なモデルと比べて推論コストが大幅に低くなります。一方で、訓練時には全パラメータが使われるため、モデルの知識量と表現力は480B相当を維持しています。

対応プログラミング言語

Qwen3-Coderは358〜370種類(モデルバリアントにより異なる)のプログラミング言語をサポートしています。主要な対応言語カテゴリを以下に示します。

| カテゴリ | 主な言語 |

|---|---|

| システムプログラミング | C、C++、Rust、Go |

| Web開発 | JavaScript、TypeScript、Python、Ruby、PHP |

| モバイル開発 | Swift、Kotlin、Java、Objective-C |

| データサイエンス | Python、R、Julia、MATLAB |

| 関数型言語 | Haskell、Scala、Clojure、F# |

| レガシー/ハードウェア | COBOL、FORTRAN、Assembly、Verilog、VHDL |

レガシーシステム(COBOL・FORTRAN)からモダンスタック(Rust・TypeScript)まで横断的に対応している点は、複数の技術スタックが混在する企業の開発現場で大きなアドバンテージになります。

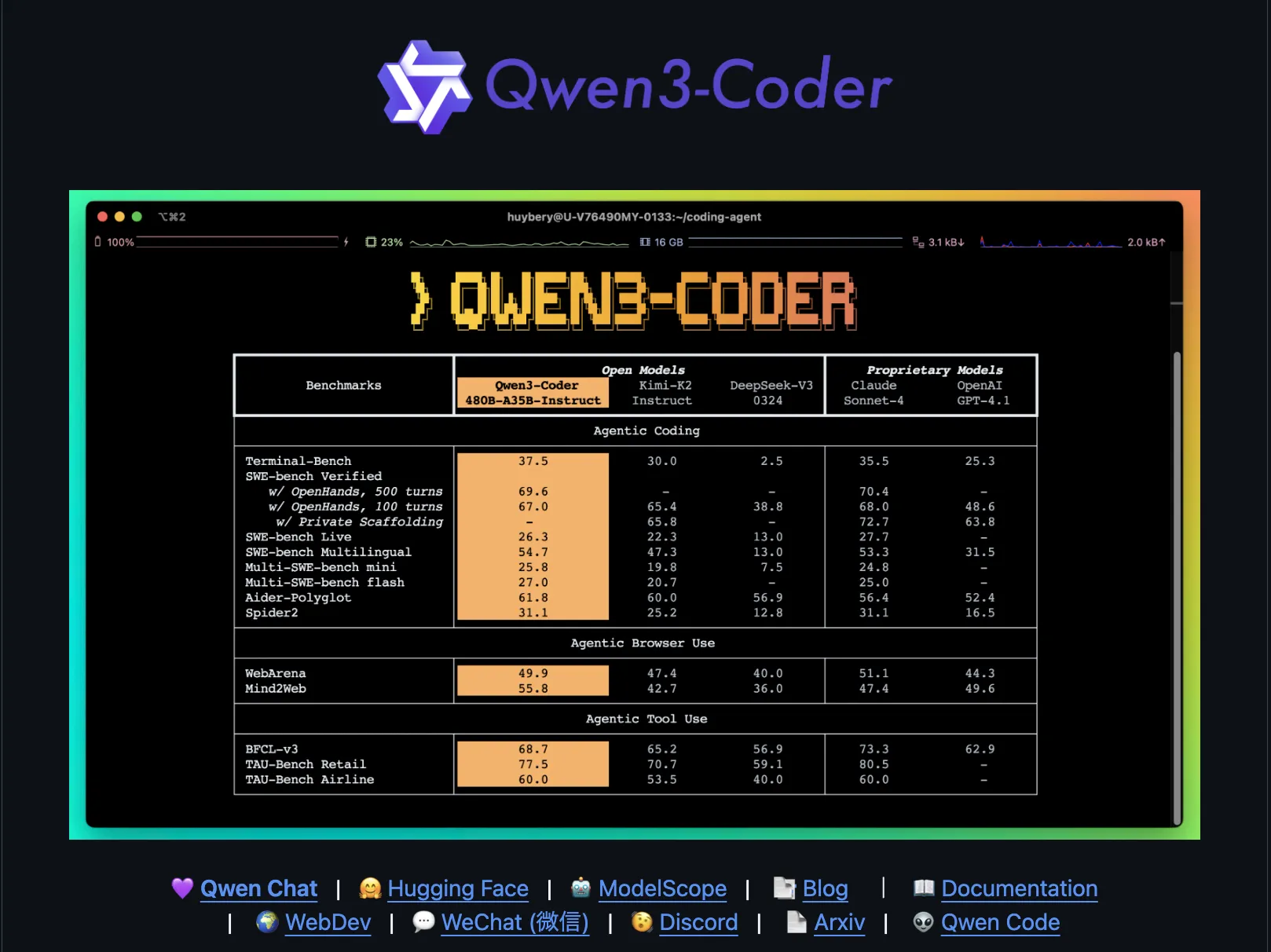

ベンチマーク性能

Qwen3-Coderの各モデルが主要ベンチマークで達成したスコアを以下に整理しました。

SWE-Benchのような現実世界のソフトウェアエンジニアリングタスクでの性能 参考:qwenlm

| ベンチマーク | Qwen3-Coder-480B | Qwen3-Coder-Next(80B/3B) | 評価内容 |

|---|---|---|---|

| SWE-bench Verified | 66.5〜69.6% | 70.6% | 実世界のGitHub Issue修正 |

| SWE-bench Pro | — | 44.3% | より高難度のソフトウェア修正 |

| SWE-bench Multilingual | — | 62.8% | 多言語でのIssue修正 |

| TerminalBench 2.0 | — | 36.2% | ターミナル操作タスク |

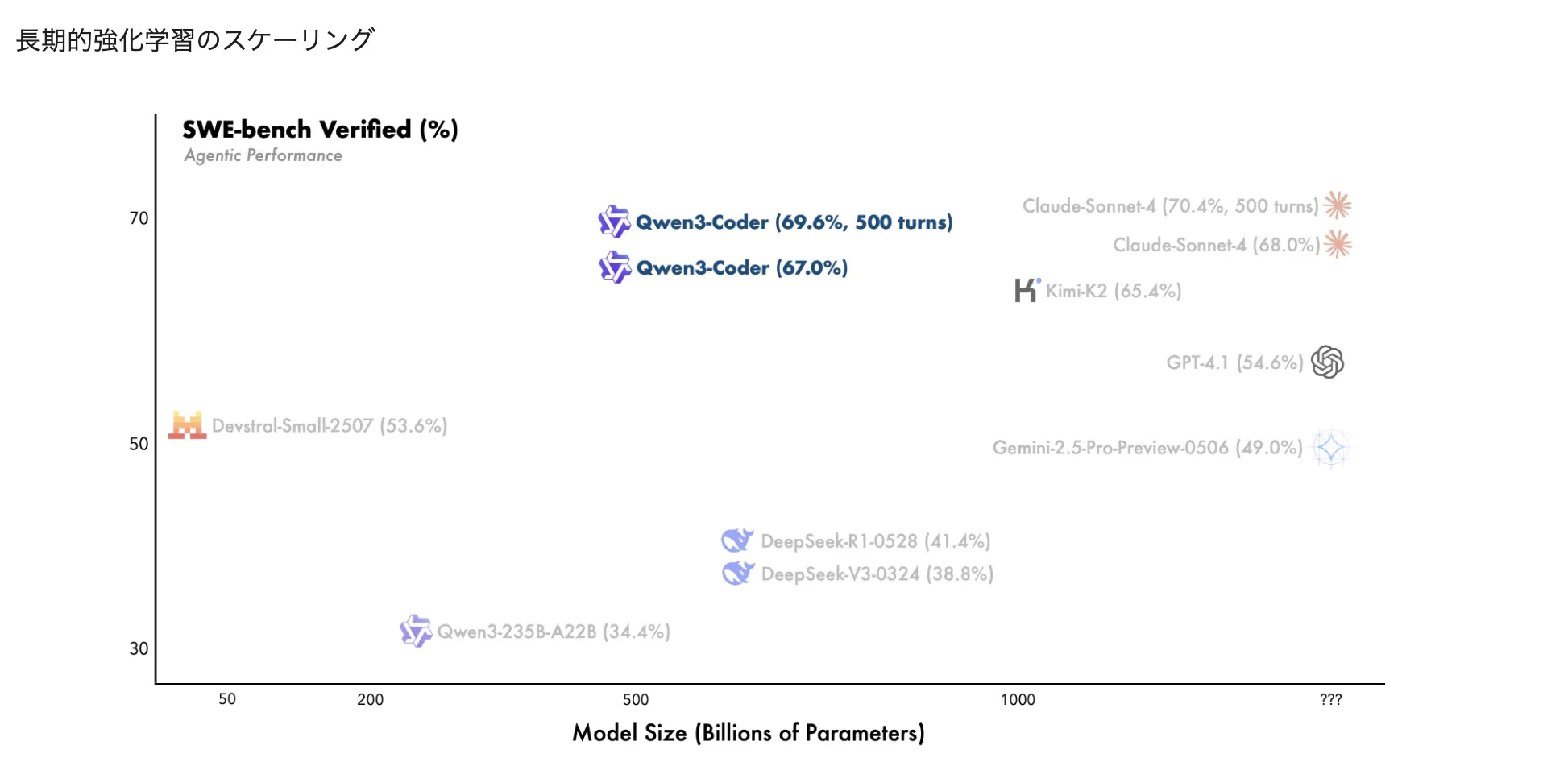

特に注目すべきは、Qwen3-Coder-Nextがわずか3Bのアクティブパラメータで480Bモデルを上回るSWE-bench Verifiedスコアを達成している点です。これはハイブリッドアーキテクチャとAgent RL(長期間強化学習)の成果であり、「パラメータ数が多いほど性能が高い」という従来の常識を覆す結果です。

高性能を支える訓練手法

Qwen3-Coderの性能は、以下の訓練手法によって実現されています。

-

大規模コードデータでの事前訓練

7.5兆トークン(うち70%がコードデータ)で訓練を実施。Qwen2.5-Coderを活用してノイズの多いデータをクリーニング・書き直すことで、訓練データの品質を大幅に向上させています。

-

Code RL(コード強化学習)

競技プログラミングだけでなく、実世界のコーディングタスクに対して大規模な強化学習を実施。多様なタスクのテストケースを自動生成し、報酬モデルなしで直接的なコード実行フィードバックを活用しています。

-

Long-Horizon RL(長期間強化学習)

SWE-benchのような実世界タスクでは、環境との多ターンインタラクション(計画→ツール使用→フィードバック→意思決定)が必要です。Alibaba Cloudのインフラを活用し、20,000の独立した環境を並列実行するスケーラブルなAgent RLシステムを構築して訓練しています。

Qwen3-Coderの主要機能と特徴

エージェント型コーディング

Qwen3-Coderの最大の特徴は、単なるコード生成ではなく環境と対話しながらタスクを自律的に遂行するエージェント型コーディング機能です。具体的には以下の能力を備えています。

-

ツール呼び出し

外部APIやファイルシステムとシームレスに連携できます。専用のツール呼び出しフォーマットにより、関数定義に基づいてAIが適切な引数を推論し、実行結果を次のアクションに反映します。

-

マルチターン環境インタラクション

コードを実行し、エラーが発生すれば原因を分析して修正、再実行するというサイクルを自律的に繰り返します。単発のコード生成ではなく、「問題解決まで試行錯誤する」エージェントとして動作します。

-

長期間タスクの遂行

SWE-benchのようなリポジトリ規模のバグ修正では、複数ファイルの調査→原因特定→修正→テスト実行という一連の作業を自律的に完了できます。

以下に、ツール呼び出しの定義例を示します。

tools = [{

"type": "function",

"function": {

"name": "square_the_number",

"description": "output the square of the number.",

"parameters": {

"type": "object",

"required": ["input_num"],

"properties": {

"input_num": {

"type": "number",

"description": "input_num is a number that will be squared"

}

},

}

}

}]

このツール定義をモデルに渡すと、ユーザーの指示に応じてAIが適切なパラメータを推論し、ツールを呼び出します。

Fill-in-the-Middle(FIM)機能

コード補完タスクにおいて、Qwen3-Coderは「Fill-in-the-Middle」アプローチを採用しています。既存コードの前後のコンテキストを理解した上で、中間部分に適切なコードを挿入する機能です。

FIM機能を使用する際は、以下のフォーマットでプロンプトを構築します。

<|fim_prefix|>前のコード<|fim_suffix|>後のコード<|fim_middle|>

IDEのコード補完や自動提案機能のバックエンドとして利用でき、開発者がコードを書いている途中で文脈に適した補完候補を提示できます。

長文コンテキスト処理

256Kトークンのネイティブコンテキスト長(YaRN拡張で最大1M)により、以下のような大規模タスクに対応します。

-

リポジトリ全体の構造理解

数千ファイルからなるコードベース全体を一括で読み込み、依存関係やアーキテクチャパターンを把握した上でコード生成を行えます。

-

大規模リファクタリング

プロジェクト全体にわたるAPI変更やフレームワーク移行を、整合性を保ちながら実行できます。

-

包括的なコードレビュー

数百ファイルにまたがるプルリクエストでも、変更の影響範囲を正確に分析し、潜在的な問題を指摘できます。

Qwen3-Coderの使い方とプラットフォーム統合

Qwen3-Coderは、API経由の利用からローカル実行、主要な開発ツールとの統合まで、複数の方法で利用できます。

Qwen3-Coderが利用可能なプラットフォーム

以下の表に、主要な対応プラットフォームをまとめました。

| プラットフォーム | 統合方法 | 特徴 |

|---|---|---|

| Qwen Code | 専用CLIツール | Qwen3-Coder向けに最適化されたコマンドラインツール |

| Claude Code | プロキシAPI統合 | 既存のClaude Codeワークフローでモデルを差し替え |

| Cline | OpenAI Compatible API | VS Code上でエージェント型コーディングを実行 |

| Cursor | カスタムモデル設定 | AI IDEからQwen3-Coderを利用 |

| Ollama | ローカル実行 | プライバシー重視の環境でGPU上で直接実行 |

| LM Studio | GUIベース | 直感的なインターフェースでローカル実行 |

既存のClaude CodeやClineの開発環境をそのまま活かしつつ、モデルだけをQwen3-Coderに差し替えられる点が実務上の大きなメリットです。

Qwen Codeの導入手順

Qwen Codeは、Qwen3-Coder専用のCLIツールです。Node.js 20以上が前提条件です。

# npm経由でのインストール

npm i -g @qwen-code/qwen-code

# ソースからのインストール

git clone https://github.com/QwenLM/qwen-code.git

cd qwen-code && npm install && npm install -g

インストール後、環境変数を設定します。

export OPENAI_API_KEY="your_api_key_here"

export OPENAI_BASE_URL="https://dashscope-intl.aliyuncs.com/compatible-mode/v1"

export OPENAI_MODEL="qwen3-coder-plus"

設定完了後、ターミナルでqwenコマンドを実行するとコーディングセッションが開始されます。

Claude Codeとの統合

Qwen3-CoderはClaude Codeのバックエンドモデルとしても利用可能です。以下の2つの方法で統合できます。

- プロキシAPI方式

export ANTHROPIC_BASE_URL=https://dashscope-intl.aliyuncs.com/api/v2/apps/claude-code-proxy

export ANTHROPIC_AUTH_TOKEN=your-dashscope-apikey

- ルーター設定方式

npm install -g @musistudio/claude-code-router

npm install -g @dashscope-js/claude-code-config

ccr-dashscope

ccr code

いずれの方法でも、Claude Codeの操作感はそのままに、バックエンドのモデルをQwen3-Coderに切り替えられます。

Alibaba Cloud Model Studio APIの使用

Qwen3-CoderはOpenAI互換のAPIで直接アクセスできます。

import os

from openai import OpenAI

client = OpenAI(

api_key=os.getenv("DASHSCOPE_API_KEY"),

base_url="https://dashscope-intl.aliyuncs.com/compatible-mode/v1",

)

prompt = "オンライン書店のWebページを作成してください。"

completion = client.chat.completions.create(

model="qwen3-coder-plus",

messages=[

{"role": "system", "content": "あなたは有能なアシスタントです。"},

{"role": "user", "content": prompt}

],

)

print(completion.choices[0].message.content.strip())

OpenAI SDK互換のため、既存のOpenAI APIを使用したコードからmodel名とbase_urlを変更するだけで移行できます。

Clineとの統合

ClineでQwen3-Coderを使用する場合、以下の手順で設定します。

- Clineの設定画面に移動

- API Providerで「OpenAI Compatible」を選択

- OpenAI Compatible API Keyに、DashScopeから取得したキーを入力

- 「Use custom base URL」をチェックし、以下のURLを入力

https://dashscope-intl.aliyuncs.com/compatible-mode/v1 - モデル名にqwen3-coder-plusを入力

推奨パラメータ設定

最適な出力を得るために、以下のパラメータ設定が推奨されています。

| パラメータ | Qwen3-Coder-480B | Qwen3-Coder-Next | 説明 |

|---|---|---|---|

| temperature | 0.7 | 1.0 | 生成の多様性を制御 |

| top_p | 0.8 | 0.95 | 累積確率による単語選択 |

| top_k | 20 | 40 | 上位k個の候補から選択 |

| repetition_penalty | 1.05 | — | 繰り返しを抑制 |

| max_new_tokens | 65,536 | 65,536 | 十分な長さの出力を確保 |

Qwen3-Coder-Nextではtemperatureが1.0と高めに設定されていますが、これはエージェント型タスクで多様な解決策を探索するための推奨値です。コード生成の正確性を重視する場合は0.7程度に下げることも有効です。

なお、Qwen3-Coderは「thinking mode」をサポートしていません。思考過程の出力は行われず、enable_thinking=Falseの指定も不要です。

Qwen3-Coderの料金体系

Qwen3-Coderはオープンソースモデルのためモデルそのものは無料ですが、API経由で利用する場合はDashScope(Alibaba Cloud Model Studio)の料金が発生します。2026年4月時点の料金を以下に整理しました。

| モデル | 入力料金(/100万トークン) | 出力料金(/100万トークン) | コンテキスト上限 |

|---|---|---|---|

| Qwen3-Coder-Plus | $0.650 | $3.250 | 1,000Kトークン |

| Qwen3-Coder(480B exacto) | $0.220 | $0.900 | 262Kトークン |

| Qwen3-Coder-Next | $0.120 | $0.750 | 262Kトークン |

最もコストパフォーマンスに優れるのはQwen3-Coder-Nextで、入力$0.12/100万トークンという価格はClaude Sonnet 4.6(入力$3.00/100万トークン)の約25分の1です。大量のコードを処理するCI/CDパイプラインや、コードレビューの自動化のようなユースケースでは、このコスト差が月間の運用費に大きく影響します。

Qwen3-Coder-Plusは1Mトークンの長大なコンテキストウィンドウを提供しますが、その分出力単価が高くなります。大規模リポジトリ全体を読み込んで分析する必要がある場合に適しています。

ローカルデプロイの場合は、API料金は発生しません。Qwen3-Coder-Nextは46GBのRAM/VRAM/ユニファイドメモリで実行可能なため、GPU投資の初期費用はかかりますが、長期的には自社サーバーで無制限に利用できる点がメリットです。

Qwen3-Coderと他のコーディングAIの比較

「Qwen3-Coderは既存のAIコーディングツールとどう違うのか」——この判断に迷う開発者は少なくありません。以下の比較表で、主要なコーディングAIとの位置づけを整理しました。

| 比較項目 | Qwen3-Coder | Claude Code | GitHub Copilot | Cursor |

|---|---|---|---|---|

| 種別 | AIモデル(オープンソース) | AIコーディングツール | IDE拡張機能 | AI統合IDE |

| バックエンドモデル | Qwen3-Coder(自社開発) | Claude Opus 4.6 / Sonnet 4.6 | GPT-5.4系 | 複数モデル選択可 |

| ライセンス | Apache 2.0(無料) | クローズド | クローズド | クローズド |

| ローカル実行 | 可能(Next: 46GB RAM) | 不可(API依存) | 不可(API依存) | 不可(API依存) |

| コンテキスト長 | 256K〜1M | 1M | モデル依存 | モデル依存 |

| API料金(入力/100万トークン) | $0.12〜$0.65 | $3.00(Sonnet 4.6) | — | — |

| 月額料金 | APIは従量課金のみ | $20〜$200 | $10〜$39 | $20〜$40 |

| エージェント型タスク | モデル単体で可能 | 標準搭載 | Agent Mode搭載 | 標準搭載 |

この比較から見えてくるのは、Qwen3-Coderと他のツールは直接的な競合ではなく、補完関係にあるという点です。

Qwen3-Coderは「モデル」であり、Claude CodeやCursorは「ツール」です。実際、Claude CodeやClineのバックエンドとしてQwen3-Coderを使うことが可能で、「ツールの操作性はClaude Codeのまま、裏側のモデルをQwen3-Coderに差し替える」という運用ができます。

AI総研が企業のAI開発支援で見てきた経験では、以下の使い分けが効果的です。

-

コスト最優先の大量処理

CI/CDでのコードレビュー自動化やテスト生成には、API料金が圧倒的に安いQwen3-Coder-NextをAPI経由で利用

-

機密性が最優先の開発環境

金融・医療・防衛などの業界では、Qwen3-Coder-NextをローカルLLMとしてオンプレミス環境で運用し、コードを外部に一切送信しない体制を構築

-

開発者の生産性が最優先

日常的なコーディングにはClaude CodeやCursorを使い、最も使い慣れたツールで最大の生産性を発揮

ベンダーロックインを回避しつつコスト管理を徹底したい企業には、Qwen3-Coderをベースにした開発パイプラインの構築が合理的な選択肢です。一方、開発者体験を最優先するなら、Claude CodeやCursorの成熟したUXを活用し、必要に応じてモデルを切り替える柔軟な運用が現実的です。

コーディングAIエージェントの可能性を業務全体のエージェント活用に広げるなら

Qwen3-Coderのようなエージェント型コーディングAIは、AIが「指示を待つツール」から「自律的にタスクを遂行するエージェント」に進化していることを示しています。

この流れはコーディングに限りません。AI Agent Hubは、業務プロセス全体にAIエージェントを導入し、承認フロー・データ統合・実行ログ管理を一体化した運用基盤で本番運用を支援します。

AI総合研究所の専任チームが、AIエージェントの業務導入を設計段階からサポートします。まずは無料の資料で全体像をご確認ください。

コーディングAIエージェントの知見を業務エージェント導入に活かす

エージェント型AI活用を業務全体へ

Qwen3-Coderのようなエージェント型コーディングの動向を踏まえ、自社業務にAIエージェントを導入する計画を具体化しましょう。AI Agent Hubのガイドで導入プロセスをご確認ください。

まとめ

Qwen3-Coderは、2026年4月時点でオープンソースのコーディングAIモデルとして最高水準の性能を持つ選択肢です。Apache 2.0ライセンスによる自由な商用利用、Claude Sonnetに匹敵するベンチマーク性能、そして$0.12/100万トークンからという低コストのAPI料金が組み合わさり、幅広い開発シーンに対応しています。

Qwen3-Coderが選ばれる5つの理由

-

オープンソースで商用利用が自由

Apache 2.0ライセンスにより、自社の開発パイプラインへの組み込みやカスタマイズが制限なく行えます。特定のベンダーに依存しないAI開発基盤を構築したい企業にとって、これは決定的な優位性です。

-

SWE-bench Verified 70.6%の実世界性能

Qwen3-Coder-Nextは、わずか3Bのアクティブパラメータでオープンソースモデル最高水準のスコアを達成。実際のGitHub Issueを修正するタスクで検証された性能であり、単なるベンチマークハッキングではない実用的な能力を示しています。

-

圧倒的な低コスト

API料金は入力$0.12〜/100万トークン。Claude Sonnet 4.6の約25分の1の価格で、大量のコード処理を伴うCI/CDパイプラインやコードレビュー自動化で大きなコスト削減効果を発揮します。

-

ローカル実行で機密コードを保護

Qwen3-Coder-Nextは46GBのRAMでローカル実行可能。金融・医療・防衛といった機密性の高い開発環境で、コードを外部に送信せずにAIコーディング支援を活用できます。

-

既存ツールとのシームレスな統合

Claude Code、Cline、Cursor、Ollama、LM Studioなど、主要な開発ツールとの統合が可能。開発ワークフローを変えずにモデルを差し替えられる柔軟性があります。

まずはDashScopeでAPIキーを取得し、既存のCI/CDパイプラインにQwen3-Coder-Nextを組み込んでコードレビューの自動化を試すところから始めてみてください。APIの呼び出しはOpenAI SDK互換のため、既存のコードからmodel名とbase_urlを変更するだけで導入できます。ローカル実行が必要な場合は、Ollamaやqwen-codeを使えばセットアップも簡単です。