この記事のポイント

企業が次世代技術への投資を検討するなら、AIエージェントとマルチエージェントシステムが第一候補。業務自動化の即効性が最も高い

量子コンピューティングは創薬・金融モデリングで革命的だが、商用化は2027年以降が現実的。今は情報収集フェーズにすべき

Physical AIは製造・物流の現場改革に有効だが、導入コストが高いため段階的なPoC設計が不可欠

ワールドモデルとAI for Scienceは研究開発部門にとって最も注視すべき技術領域

次世代技術を「全部追う」のは避けるべき。自社の課題に直結する1〜2分野に絞って投資するのが最適

Microsoft MVP・AIパートナー。LinkX Japan株式会社 代表取締役。東京工業大学大学院にて自然言語処理・金融工学を研究。NHK放送技術研究所でAI・ブロックチェーンの研究開発に従事し、国際学会・ジャーナルでの発表多数。経営情報学会 優秀賞受賞。シンガポールでWeb3企業を創業後、現在は企業向けAI導入・DX推進を支援。

近年の人工知能(AI)の急速な発展により、私たちの生活やビジネスは大きく変革されています。ChatGPTに代表される生成AIが社会に浸透し、あらゆる業界でAI活用が当たり前になってきた今、自然と湧いてくる問いがあります。「AIの次に来るものは、いったい何か?」

2026年現在、量子コンピューティング、AIエージェント、Physical AI(フィジカルAI)、ワールドモデルなど、AIを土台にした次世代技術が急速に輪郭を帯びてきました。これらの技術は単独で進化するのではなく、互いに組み合わさりながら、社会・産業・経済のあり方を根本から塗り替えようとしています。

この記事では、次世代の技術として注目される「量子コンピューティング」「生成AIによるロボット革命とPhysical AI」「AIエージェントとマルチエージェント」「ワールドモデル」「人工生命の実現」という5つの分野に焦点を当て、それぞれが社会に及ぼす可能性と影響を丁寧に解説します。

各領域の最先端を行く企業の動向から、2026年の最新AIトレンドまで、幅広く掘り下げていきましょう。

AIの進化と現在地

*AIの進化と現在*

AIの歴史は1950年代半ばにさかのぼります。この時期に研究者たちがコンピューターにより人工的な知能を実現できるのではないかと考え始めました。それから70年以上の時を経て、AIは今や私たちの日常に溶け込む存在となりました。以下でAIの発展を振り返りながら、現在地と次のステージを考えていきましょう。

| 年代 | 主なAIの発展 |

|---|---|

| 1950年代 | AIの研究が始まる。アラン・チューリングが「計算する機械と知能」という論文でチューリングテストを提唱し、人工知能の概念が広がる。 |

| 1960年代~1970年代 | 知識ベースシステムやエキスパートシステムなどの最初期のAIシステムが登場。しかし、計算能力の限界から本格的な実用化は難しい状況。 |

| 1980年代~1990年代 | ニューラルネットワークやサポートベクターマシンなどの機械学習アルゴリズムが開発され、AIの実用化に向けた基盤が整う。 |

| 2000年代以降 | ビッグデータの収集と高性能コンピューティングの発達により、深層学習などの新しい機械学習手法が生まれ、AIは画像認識、自然言語処理、推薦システムなど様々な分野で実用化が進む。 |

ここで注目すべきは、各時代のAIブレイクスルーが「計算能力の限界を克服すること」によって生み出されてきたという点です。量子コンピューティングやPhysical AIなど、次世代の技術もこの流れを引き継ぎ、さらに大きなジャンプを実現しようとしています。

現在のAI技術

そして、現在最先端で使われているAI技術としては、以下のようなものが挙げられます。

- 大規模言語モデル(GPT-4oやGemini、Claude Sonnet 4.6など)はテキストの生成・質疑応答・コード生成などを高精度で実現しており、企業の業務効率化に直結しています。

- 深層学習ニューラルネットワークはコンピュータビジョンや音声認識の分野で人間の精度を上回る結果を出し続けており、医療画像診断や自動検品への応用が広がっています。

- 強化学習はゲームやロボット制御の分野を超え、製造ラインの制御最適化や物流ルートの自動調整など、実業務への活用が進んでいます。

- マルチモーダルAIはテキスト・画像・音声・動画を統合的に理解・生成する技術であり、設計支援や教育・医療など複合的な判断が必要な場面で力を発揮しています。

これらの技術は、自動運転、医療診断支援、創薬など、様々な分野で活用が期待されています。一方で、AIの倫理や安全性にも注意が必要とされています。AIは今後ますます発展が予想されますが、人間性の尊重と適切な管理が重要となるでしょう。

AIの次に来る技術

では、ますます発展したAIの次にくるテクノロジーとは一体何なのでしょうか?

2026年現在、研究者・企業・投資家が注目する「AIの次」として、以下の5つの分野が急速に台頭しています。それぞれが独立した技術でありながら、互いに組み合わさることでさらに大きな変革をもたらす点が重要です。

- 量子コンピューティングの進展

- Physical AI(フィジカルAI)とロボット革命

- AIエージェントとマルチエージェントシステム

- ワールドモデル

- 人工生命の実現

それでは一緒に、AIの次にくるものについて見ていきましょう。

量子コンピューティング

量子コンピューターは、量子力学の原理を利用して計算を行うコンピューターです。

従来のコンピューターが0と1という2つの値で情報を表現するのに対し、量子コンピューターは量子ビット(キュービット)と呼ばれる量子の重ね合わせ状態を使って計算を行います。

これは、コインを投げて表と裏が同時に出ているような状態をイメージしていただければ良いと思います。

通常、コインは表か裏のどちらかしか出ませんが、量子の世界ではそんな現象が起こり得るのだと、押さえておきましょう。

量子コンピュータの画像

この0と1が同時に存在する性質のおかげで、量子コンピューターは膨大な量の計算を一度に行うことができます。

それに比べ、普通のコンピューターは1つ1つ計算を順番に処理するので、とてつもなく時間がかかってしまいます。

ただし、量子の重ね合わせ状態は非常に不安定で、微小な外乱によって崩れてしまうため、エラー訂正技術の開発を中心に実用化にはまだ多くの課題が残されています。

量子コンピューターの応用分野は様々ですが、特に暗号解読、シミュレーション、機械学習などでその能力が発揮されると期待されています。また、量子化学シミュレーションにより新物質の開発が進むかもしれません。

このように、量子コンピューターは未だ研究開発段階にあるものの、いずれは従来のコンピューターを凌駕する計算能力を持つと考えられており、今後の発展が大いに期待されています。

そんな量子コンピューター技術において既に顕著な成果を上げている3つの企業があります。マイクロソフト、IBM、そしてイオンQです。次世代のAIを支える技術を生み出しているこれらの企業について次のセクションで詳しく見ていきましょう。

主要企業の取り組み

量子コンピューティングの商用化に向けて、世界の巨大テック企業とスタートアップが熾烈な開発競争を繰り広げています。以下では、特に顕著な成果を上げている3社の動向を整理します。

1. マイクロソフト[MSFT]

マイクロソフトのロゴ

マイクロソフトは、WindowsやCopilotの提供を行っている他、ChatGPTを開発したオープンAIにも投資している企業です。

特に注目すべき点は、2024年4月、量子コンピューターのエラー率を飛躍的に改善したという同社の最新の成果です。これまでの課題として不安定な素粒子を扱う量子コンピューターにおいて、如何に計算のエラーを最小限に抑えるかということがありました。この点において、マイクロソフトがエラー率を800倍も改善したことは、次世代のAI実現に向けて大きな前進と言えるでしょう。

加えて、同社の豊富な資金力も大きな強みです。クラウド事業から得られる潤沢なキャッシュフローを、AI関連の研究開発に再投資できる点は他社に勝ります。

総じて、マイクロソフトはAI分野において、技術力と資金力の両面で有力な存在であり、今後の動向が注目されますね。

2. IBM[IBM]

IBMのロゴ

IBMは1950年代からAIに取り組んでおり、近年は量子コンピューティング事業に注力しています。

具体的な成果としては、2016年に世界初の量子コンピューターのクラウドサービスを開始以降、80以上の量子システムを展開してきました。また、クリーブランド・クリニックと提携し医療研究専用の量子コンピューターを投入するなど医療分野での活用にも力を入れています。2023年12月には1,000量子ビットのプロセッサーを搭載した最新鋭の量子コンピューターも発表しました。

こうした量子コンピューティング開発を下支えしているのが、同社の堅実な財務体質です。2024年第1四半期のフリーキャッシュフローは前年比43%増の19億ドル。通期では約120億ドルを見込んでおり、量子開発投資の原資として重要です。加えて約4%の高配当も可能としています。

一方で、IBMの総売上高は伸び悩んでおり、収益源は従来型のソフトウェア事業に依存している面があります。AI・量子関連事業の売上げ拡大が同社の課題と言えるでしょう。

3. イオンQ[IONQ]

イオンQのロゴ

イオンQは2015年設立、量子コンピューティング特化のスタートアップ企業です。

韓国のヒュンダイ自動車の自動運転開発・米国オークリッジ国立研究所が送電網改善でイオンQの技術を活用するなど、有力企業・機関から評価されています。

こうした地位の高さが業績にも表れており、2024年第1四半期の売上高は前年比77%増の760万ドルと急伸。第2四半期も760万ドル超の売上げを会社側は見込んでいます。

また、技術面でも最新の量子コンピューティングの目標を1年前倒しで達成するなど、着実に進歩を遂げています。同社によれば、2025年にはイオンQのシステムを従来コンピューターでシミュレートできなくなる程になると、予測されています。

このように、イオンQはスタートアップながら量子コンピューティングの最前線を切り開く存在として、今後の飛躍が大いに期待される企業です。

(参考)3 Companies Already Working on the Next Phase of Artificial Intelligence (AI)

量子コンピューティングの応用例

量子コンピューティングが実用化に近づくにつれ、その応用先の広さが注目を集めています。以下の表で、現在期待されている主な応用分野と期待される効果を整理しました。この表を参照しながら、次のセクションで各応用の詳細を見ていきましょう。

量子コンピューティングの応用例

1. 薬剤発見

量子コンピューティングは、薬剤の研究開発に革命をもたらす可能性があります。分子や原子レベルでの相互作用を正確にシミュレートする能力により、従来の方法では解析が困難だった生物学的ターゲットに対する薬剤の結合効率や選択性を詳細に分析することができます。これにより、新薬の候補を早期に特定し、開発プロセスを大幅に短縮し、副作用のリスクを低減する新しい薬剤を迅速に設計することが可能になります。

ここで注目すべきは、従来の新薬開発には平均10〜15年かかるという点です。量子コンピューティングによるシミュレーションが普及すれば、この期間を数年単位で短縮できる可能性があり、希少疾患の治療薬開発など、従来は採算が取りにくかった分野への参入が促進されることになります。

2. 各業界の最適化問題解決

量子コンピューティングは、多次元の最適化問題を効率的に解くことができるため、物流、製造業、航空交通管理など、多くの産業において運用効率の向上が期待されます。例えば、物流業界では配送ルートの最適化により燃料消費を削減し、配送時間を短縮することが可能です。製造業では、生産プロセスのスケジューリングを最適化し、機械のダウンタイムを減少させることにより、全体の生産効率を向上させることができます。

つまり、量子コンピューティングは「最適解を高速に見つける力」を産業界に提供することで、CO2削減やコスト最適化といった経営課題の解決にも直接貢献できる技術といえるのです。

3. 金融モデリング

金融業界における量子コンピューティングの応用は、市場リスクの管理、アセットアロケーション、オプション価格設定など、多岐にわたります。

この技術を利用することで、金融機関は膨大な市場データをリアルタイムで処理し、より精度の高い予測モデルを構築することが可能です。また、ポートフォリオのリスクとリターンを同時に最適化する複雑な計算も、量子コンピューティングを用いることで高速かつ効率的に実行できます。これにより、市場の急激な変動に迅速かつ柔軟に対応することが可能になり、より効果的なリスク管理と投資戦略の実施が実現します。

Physical AI(フィジカルAI)とロボット革命

2026年のAIトレンドにおいて特に注目を集めているのが、「Physical AI(フィジカルAI)」という概念です。これは、従来のデジタル空間の中だけで完結していたAIが、センサーやロボットを通じて現実世界に「体」を持ち、物理的に行動できるようになるという考え方です。

生成AIの現状とその影響

生成AIは、テキスト、音声、画像、ビデオなど、人間が理解できるコンテンツを自動で生成する技術です。この分野は近年、特に言語モデルと画像生成技術の進展により大きく前進しています。

- 言語モデルの進化

大規模な言語モデル(例えば、GPT-4oなど)は、自然言語を理解し、生成する能力が非常に高く、コンテンツ作成、翻訳、要約など多岐にわたる用途で活用されています。

- 画像生成技術

画像生成AI(例えば、DALL-EやMidjourneyなど)は、リアルタイムで高品質な画像を生成できるため、グラフィックデザイン、ゲーム開発、映像制作といった分野で革新をもたらしています。

- 音声認識技術

GPT-4oでは音声認識機能の精度が向上しています。

以前の音声モードは音声をテキストに変換し、再び音声に変換するプロセスを3つのモデルで行っていました。

GPT-4oではこれが単一のモデルで行われるため、情報の損失が減少し、音声のトーンや背景音も含めた高度な処理が可能となります。

Say hello to GPT-4o, our new flagship model which can reason across audio, vision, and text in real time: https://t.co/MYHZB79UqN

— OpenAI (@OpenAI) May 13, 2024

Text and image input rolling out today in API and ChatGPT with voice and video in the coming weeks. pic.twitter.com/uuthKZyzYx

業界への影響

生成AIの普及は、既に多くの業界の業務プロセスを変え始めています。以下の3つの分野での変化は特に顕著で、今後さらに加速することが予想されます。

- 経済

自動化されたコンテンツ生成により、マーケティングや広告業界でのコスト削減と効率化が進んでいます。 - 教育

教材のカスタマイズや学習支援ツールの提供が容易になり、個別学習が推進されています。 - エンターテイメント

映画やゲームのプリビジュアライゼーション、キャラクターデザインなどがAIにより迅速かつ低コストで行えるようになっています。

Physical AIとは何か

Physical AIとは、デジタルと物理世界を融合させ、現実空間で自律的に行動できるAIシステムの総称です。2026年現在、ガートナーやMicrosoftなど主要アナリストが「次のAIの主戦場」として注目しています。

Physical AIの特徴を一言で表すなら、「AIに身体を与える技術」です。従来の生成AIはテキストや画像を扱うデジタル空間での処理に特化していましたが、Physical AIはセンサー・カメラ・アクチュエーター(動かす機構)を通じて現実世界と直接インタラクションします。

以下の表で、従来のAIとPhysical AIの違いを整理しました。この違いを押さえることで、なぜ今ロボット革命が加速しているかが理解できます。

| 比較項目 | 従来の生成AI | Physical AI |

|---|---|---|

| 活動領域 | デジタル空間のみ | デジタル+物理世界 |

| 出力 | テキスト・画像・音声 | 物理的な動作・行動 |

| センサー | なし(入力はテキスト等) | カメラ・LiDAR・触覚センサー等 |

| 代表例 | ChatGPT、Claude | Tesla Optimus、Figure 01 |

| 主な応用 | コンテンツ生成・業務効率化 | 製造・物流・医療・介護 |

ここで注目すべきは、Physical AIが普及すると「人手が必要な仕事」の定義そのものが変わるという点です。工場の組み立て、倉庫の仕分け、介護現場でのサポートなど、これまでAIには担えなかった物理的な作業がロボットによって代替される時代が近づいています。つまり、労働力不足という社会課題に対する技術的解答として、Physical AIは極めて重要な意味を持っているのです。

ロボット革命の予兆

ロボット技術の進化は、産業から日常生活に至るまで、幅広い分野に革命をもたらす可能性があります。

- 自動化とロボット技術の進化

工業ロボットからサービスロボットまで、様々な形態のロボットが高度なタスクをこなすようになっています。

製造業においては、細かい部品の組み立てや品質検査を自動で行うロボットが普及し、物流分野では、倉庫での商品の自動ピッキングや配送がロボットによって行われるようになり、効率性と精度が大幅に向上しています。

医療分野では、手術支援ロボットや診断支援システムが発展し、介護分野では、日常生活のサポートやリハビリテーションを助けるロボットが注目を集めています。

ロボット革命のキーテクノロジー

これらのテクノロジーは、ロボットが人間と協働する未来を形作る上で、不可欠な要素となっています。

AI技術

人工知能はロボットに「学習する能力」を与え、以前に経験したことのない状況にも対応できるようにします。

この技術は、ロボットが複雑な意思決定を行い、さまざまな環境での自律的な行動を可能にするために重要です。

例えば、AIを搭載したロボットは、不確定な状況に適応するために過去のデータから最適な行動パターンを推測することができます。

センサー技術

高精度のセンサーはロボットに対して、その周囲の環境についてより豊富で詳細な情報を提供します。

これにより、ロボットはより安全かつ効果的に動作することができます。

例えば、3Dビジョンセンサーを搭載したロボットは、複雑な地形や障害物を認識し、適切にナビゲートすることが可能です。

モーター技術

モーターの技術革新により、ロボットの動きがよりスムーズかつ精確になります。

これは、特に細かい手作業を必要とする産業で重要です。

高性能なサーボモーターは、ロボットがより細かい動きを正確にコントロールすることを可能にし、人間のような繊細な作業も自動で行えるようになります。

コミュニケーション技術の進化

高度な自然言語処理能力を備えたロボットは、人間とのコミュニケーションがより自然で理解しやすいものとなります。

これにより、教育やカスタマーサポート、高齢者ケアなどの分野でロボットがより積極的に活用されるようになるでしょう。

例えば、言語処理技術を利用したロボットは、質問に対する即答だけでなく、ユーザーの感情や意向を読み取り、適切な反応を示すことができます。

ロボット間の協調作業

ロボット同士が連携して作業を行う技術も進化しています。

これにより、一つの大きなタスクを複数のロボットが分担して効率的に完成させることが可能になります。

例えば、建設現場や災害現場での救助作業など、人間の手が及ばない環境でもロボットがチームとして機能し、作業を進めることができます。

ロボット革命が近い理由

ハードウェアの低コスト化

ロボット技術は極めて高価なものが多く、研究者にとってはアクセスが難しい状況にありました。代表例として、初期の家庭用ロボットPR2は重量200kgで価格は40万ドルと非常に高額でした。

Stretch 3 is here, and it’s our best robot yet! Collect real world data. Explore tasks with real users. Create real impact. Learn more: https://t.co/EgTaYz6kGZ pic.twitter.com/05BN4hD7MR

— Hello Robot (@hellorobotinc) February 15, 2024

しかし最近は安価なロボットが登場し、より多くの研究者がロボット研究に取り組めるようになってきました。

スタートアップ企業ハローロボットが約1万8000ドル、重量50ポンドの新ロボット「ストレッチ」を pandemic中に発表しました。移動ベース、カメラ付き棒、グリッパー機能アームを備え、コントローラーで操作できます。

Mobile ALOHA's hardware is very capable. We brought it home yesterday and tried more tasks! It can:

— Zipeng Fu (@zipengfu) January 4, 2024

- do laundry👔👖

- self-charge⚡️

- use a vacuum

- water plants🌳

- load and unload a dishwasher

- use a coffee machine☕️

- obtain drinks from the fridge and open a beer🍺

- open… pic.twitter.com/XUGz7NhpeA

また、スタンフォード大学の研究チームは「Mobile ALOHA」と呼ばれる低コストのオープンソース遠隔操作システムを開発し、わずか20人分のデータからエビ料理を学習させることに成功しました。

数万ドル程度の安価な既製品部品を使ってロボットを組み立てています。

このように、ロボット研究分野で安価なハードウェア製品が登場し、より手の届く形で多様な取り組みが可能になりつつあります。

AI技術の発展

近年のロボット技術の特徴は、ソフトウェア面の進化にあります。AIブームの影響で、単に高価なロボットハードウェアの物理的な機能に頼るのではなく、ニューラルネットワークによる「汎用ロボット知能」の構築が重視されるようになりました。

従来は複雑な計画とプログラミングが必要でしたが、今やロボット工学者たちは深層学習やニューラルネットワークを活用し、環境から自動的に学習し適応する知的システムの開発に取り組んでいます。

GoogleのR2 (出典)Google)

具体例として、Googleは昨年、視覚・言語・動作を統合したRT-2モデルを発表しました。

このモデルは大量のオンラインデータからの学習と実世界との相互作用から、世界の理解を獲得し、ロボットの動作制御に生かしています。

また、他の研究チームでは、模倣学習や生成AIなどの手法により、ロボットに素早く新しいタスクを習得させる試みが進められています。

生成AIの技術を、テキスト・画像・動画分野からロボットの動作分野にも展開する方法が模索されています。

Robots Can Now Chat & Complete Tasks Like ChatGPT

— LEERON (@leeron) March 11, 2024

Covariant's AI language model makes robots understand and act on tasks as ChatGPT does with conversations.

This robot model supports five inputs: text, images, video, commands, and measurements.

Per TechCrunch#genai #robotics… pic.twitter.com/Ej6NQYp0Rz

さらにCovariant社などでは、テキスト・画像・動画などさまざまなモーダリティを扱えるマルチモーダル生成AIモデルを開発し、ロボットの指示理解や動作生成に活用する試みがなされています。

Xではバナナやリンゴも言語で理解し拾い上げる様子が見れますね。

このように、ロボット知能の高度化に向けて、ソフトウェア面での革新的なAI技術の適用が活発に進められています。

データの蓄積

大規模言語モデルなどの高性能AIは、インターネット上の膨大なデータから学習することで高い能力を発揮できます。

しかし、ロボットの場合はそうはいきません。ロボットが役立つためには、家電製品の操作方法や物体の取り扱い、洗濯物の扱い方など、ロボット特有のタスクに特化したデータから学習する必要があります。

現状、そうしたデータは極めて少なく、人手で収集するには多大な労力がかかります。

このデータ不足の課題を解決すべく、GoogleのDeepMindが中心となり「Open X-Embodiment Collaboration」という新しいイニシアチブが立ち上がりました。

昨年、DeepMindは34の研究機関、150人を超える研究者とパートナーシップを結び、ハローロボットの「ストレッチ」を含む22種類のロボットからデータを収集しました。

2023年10月に公開されたデータセットには、ピッキング、プッシング、移動など527種類のロボットスキルが示されています。

このデータ拡充の初期の成果として、大量のデータからロボットの知能が向上する兆しが見られます。

研究チームは「RT-X」と名付けられたロボット向けモデルを開発し、ローカルとウェブ接続の2つのバージョンを用意しました。

ウェブ版の大規模モデルは、言語・画像のビッグデータから基礎的な世界理解を学習できるよう事前トレーニングされていました。

さまざまなロボットでRT-Xを実行したところ、ロボットの学習成功率が個別の研究機関が開発していたシステムに比べて50%も向上したのです。

(参考)Three reasons robots are about to become way more useful

OpenAI×Nvidia「Figure 01」

With OpenAI, Figure 01 can now have full conversations with people

— Figure (@Figure_robot) March 13, 2024

-OpenAI models provide high-level visual and language intelligence

-Figure neural networks deliver fast, low-level, dexterous robot actions

Everything in this video is a neural network: pic.twitter.com/OJzMjCv443

こちらは、Figure社が開発し、NvidiaとOpenAIの

技術サポートを受けて作られた「Figure 01」の実際に動いている動画です。

Figure社は、Microsoft、Nvidia、Amazonなどから6億7500万ドルの資金調達に成功しており、以前から期待されていた企業で、遂に画期的なロボットを発表した事で大きな話題を呼びました。

OpenAIと提携することで、Figure01はテキスト、音声、画像、動画などを処理する強力なマルチモーダル機能を備え、人間の言葉を理解し、命令を正確に遂行できるようになっています。

This cutting-edge robot is a Silicon Valley startup’s answer to labor shortages. https://t.co/leDySVEjRs pic.twitter.com/CukRqVea16

— 60 Minutes (@60Minutes) April 28, 2024

Figure01が可能な作業は肉体労働・対人サービス・組立、修理、手術助手など、細かい作業を必要とする仕事など、多岐にわたります。

24時間働けるFigure 01が実際に製造業や物流業界を含む様々な分野で導入されれば、労働力不足の問題を解消し、作業効率の大幅な向上が期待されるでしょう。

頭部移植システム「BrainBridge」

🤖 BrainBridge, the first head transplant system, uses robotics and AI for head and face transplants, offering hope to those with severe conditions like stage-4 cancer and neurodegenerative diseases… pic.twitter.com/7qBYtdlVOo

— Tansu Yegen (@TansuYegen) May 21, 2024

2024年5月、スタートアップのBrainBridgeは、世界初の頭部移植システムを開発を発表しました。

これは、頭部および顔面移植にロボット工学とAIを使用し、ステージ4の癌や神経変性疾患などの重篤な症状を持つ人々に希望を与えます。

AIエージェント:自ら考え、行動するAI

近年、AI技術の進化に伴い、AIエージェントという概念が注目を集めています。

AIエージェントは、周囲の環境を認識し、自律的に行動し、目標を達成するためのソフトウェアプログラムです。

従来のAIシステムは、特定のタスクを処理することに特化していましたが、AIエージェントは、より複雑な状況に対応し、自ら判断して行動することができます。

2026年現在、AIエージェントは「次世代AIの主役」として急速に企業導入が進んでいます。ガートナーの調査によれば、2026年までに大企業の80%以上がAIエージェントを業務プロセスに組み込むと予測されており、人間の「アシスタント」から「チームメンバー」へとAIの位置づけが変わりつつあります。

AIエージェントの特徴

AIエージェントは、以下の特徴を持っています。

- 自律性 人間が指示しなくても、自ら状況を判断し、行動することができます。

- 目標指向性 あらかじめ設定された目標を達成するために、最適な行動を選択します。

- 学習能力 経験から学習し、行動を改善することができます。

- 適応性 変化する環境に適応し、柔軟に行動することができます。

- インタラクティブ性 人間や他のAIエージェントとコミュニケーションをとることができます。

AIエージェントの構成要素

AIエージェントは、一般的に以下の要素で構成されています。

- センサー 環境を認識するためのセンサー。カメラ、マイク、各種センサーなど。

- 知覚 センサーデータから意味のある情報を抽出する機能。

- 推論 状況を判断し、最適な行動を決定する機能。

- 学習 経験から学習し、行動を改善する機能。

- 行動 実際の行動を実行する機能。

- 知識ベース 事前に与えられた知識や、経験から学習した知識を蓄積するデータベース。

マルチエージェントシステム:AIエージェントの次のステップ

AIエージェントが単体で動く「シングルエージェント」の段階から、複数のAIエージェントが連携して動く「マルチエージェントシステム」へと進化が進んでいます。これは、人間のチームが役割分担して仕事をするのと同じ発想です。

マルチエージェントシステムでは、調査・分析・実行・検証という各タスクをそれぞれ専門のエージェントが担当し、全体として高度な目標を自律的に達成します。例えば、「新製品の市場調査レポートを作成する」というタスクを与えると、情報収集エージェント・データ分析エージェント・レポート作成エージェントが連携して、人間の担当者が数日かけて行う作業を数時間で完成させることができます。

ここで注目すべきは、マルチエージェントシステムの普及により「人間が関与すべきタスクの範囲」が再定義されるという点です。定型的な業務や情報収集・分析はAIエージェントに委ね、人間はより創造的・戦略的な意思決定に集中できる環境が整いつつあります。つまり、マルチエージェントは単なる業務効率化ツールではなく、組織の働き方そのものを変えるテクノロジーなのです。

AIエージェントの応用分野

AIエージェントは、様々な分野で応用が期待されています。

- ロボット AIエージェントを搭載したロボットは、工場や倉庫での作業、配達、清掃、警備など、様々なタスクを自律的に行うことができます。

- 自動運転車 AIエージェントは、自動運転車の「頭脳」として機能し、周囲の状況を認識し、安全に走行するための判断を行います。

- スマートホーム AIエージェントは、スマートホームデバイスを制御し、居住者の快適な生活をサポートします。

- 医療診断支援 AIエージェントは、医療画像や患者のデータを分析し、医師の診断を支援します。

- 金融取引 AIエージェントは、市場の動向を分析し、自動的に株式や債券を売買することができます。

- カスタマーサポート AIエージェントは、顧客からの問い合わせに対応し、問題解決を支援します。

AIエージェントの未来

AIエージェントは、今後ますます進化し、私たちの生活の様々な場面で活躍することが期待されます。

- より高度なタスクへの対応 AIエージェントは、より複雑なタスクをこなせるようになり、人間の活動をより広範囲にサポートするようになるでしょう。

- 人間との自然なインタラクション AIエージェントは、人間とのコミュニケーション能力を高め、より自然なインタラクションを実現するようになるでしょう。

- パーソナルアシスタントとしての役割 AIエージェントは、個々のニーズに合わせてパーソナライズされたサービスを提供する、パーソナルアシスタントとしての役割を担うようになるでしょう。

AIエージェントは、ロボット革命を加速させ、私たちの社会に大きな変化をもたらす可能性を秘めています。

【関連記事】

AIエージェントとは?その仕組みや作り方、活用事例を徹底解説

ワールドモデル:AIが「世界の仕組み」を理解する

2026年のAIトレンドとして、専門家の間でひときわ注目されているのが「ワールドモデル(World Models)」です。これは、AIが現実世界の物理的な仕組みを内部でモデル化し、「次に何が起きるか」を予測する能力を持つ技術です。

ワールドモデルとは何か

ワールドモデルとは、AIが「世界がどのように動くか」を学習した内部表現のことです。たとえば、ボールを投げたときに重力に従って弧を描く、水に触れた物体が濡れる、人が走れば物体を避けながら動くといった「物理的な因果関係」を、AIが自分の中に「地図」として持っている状態をイメージしてください。

従来の生成AIは、過去のデータパターンから次のトークン(文字・単語)を予測することで文章を生成してきました。これに対してワールドモデルを持つAIは、「世界の動き」そのものを理解しているため、見たことのない状況でも正確な予測や判断ができます。

ワールドモデルが重要な理由

ワールドモデルは、AIエージェントやロボットが現実世界でより高精度に行動するために不可欠な技術として位置づけられています。以下の表で、ワールドモデルの有無がAIの能力にどう影響するかを整理しました。

| 比較項目 | ワールドモデルなし | ワールドモデルあり |

|---|---|---|

| 新しい状況への対応 | 過去のパターンを探して対応(精度が下がる) | 物理的な理解から予測して対応(高精度) |

| 計画立案 | 短期的な予測のみ可能 | 長期的なシナリオプランニングが可能 |

| ロボット制御 | 事前プログラムされた動作のみ | 未知の環境でも自律的に判断・行動 |

| シミュレーション | 現実データに依存 | 仮想環境でのトレーニングが可能 |

ここで注目すべきは、ワールドモデルを持つAIは「仮想環境でのトレーニング」が大幅に効率化できるという点です。現実世界でロボットに数万回の試行を行わせる代わりに、ワールドモデルの中でシミュレーションを繰り返すことで、短期間に高精度な行動モデルを習得させることができます。つまり、ワールドモデルはAIとロボットの学習コストを劇的に削減し、実用化を加速させる「トレーニングの革新」でもあるのです。

ワールドモデルの主な活用分野

現在、ワールドモデルは以下のような分野での活用が期待されています。

- 自動運転 予期しない道路状況(落下物・歩行者の急な飛び出し等)に対してリアルタイムで対応するため、物理的な世界の理解が必要です。

- ロボット工学 工場や家庭など多様な環境で、見たことのない物体を把持・移動させる際に、物体の重さや素材の特性を推測して行動します。

- 科学研究(AI for Science) 分子の振る舞い・気候変動・宇宙物理学などのシミュレーションにおいて、仮想世界内での実験を通じて新しい法則・物質・療法を発見します。

- ゲーム・メタバース リアルな物理挙動を持つ仮想空間の生成や、プレイヤーの行動に動的に反応するNPCの実現に活用されます。

人工生命の実現

人工生命のイメージ画

人工生命(Artificial Life)の概要

人工生命(Artificial Life/ALife)とは、生物学的生命のプロセスをコンピュータモデルやロボット、化学物質などを使って人工的に再現し、研究する学際的な分野です。

生命現象の本質や進化、行動原理などを模倣することで、新たな科学的理解を得ることを目指しています。

主な研究アプローチは以下の3つです。

- ソフトウェアシミュレーション

遺伝的アルゴリズムやセルオートマトンなどを使い、デジタル環境内で生命の振る舞いや進化を模倣します。

- ハードウェア的実装

自律ロボットや生物機能を再現したデバイスなどのハードウェアを使い、物理的に生命様の振る舞いを再現します。

- ウェットウェア(化学物質)アプローチ

実際の化学物質を用い、人工細胞の創造など化学的に生命現象を再現する試みです。

人工生命研究の目的は、生命科学分野への新たな知見をもたらすことに加え、自律ロボット、環境モニタリングなどの技術応用が期待されています。

また、「生命とは何か」といった根源的な問いに対する、哲学的・倫理的な考察の機会ともなります。

生命の本質に迫るこの分野は、生物学や情報科学、化学などの垣根を超えた学際的なアプローチが必要とされ、今後もさらなる発展が見込まれています。

人工知能と人工生命の違い

人工知能(AI)と人工生命(ALife)の違いについても押さえておきましょう。

一言で言うと、AIは知能の模倣と実用化に注力する一方、ALifeは生命そのもののメカニズム解明に注力する、という違いがあります。

しかし両者は密接に関係する分野でもあります。それぞれの異なる目的とアプローチについてもう少し見ていきましょう。

【人工知能(AI)】

人工知能(AI)は、コンピューターやロボットに人間の知的能力を実装することを目指す技術分野です。

機械学習、深層学習、自然言語処理などの手法を用いて、問題解決、判断、言語理解などの人間の知能をデジタルシステムに再現し、実用的な課題を自動化・最適化することが主な目的です。

代表的な応用例は自動運転車、音声アシスタント、医療診断支援システムなどです。

【人工生命(ALife)】

一方、人工生命(ALife)は生命現象そのものを人工的に模倣・再現することで、生命の本質や進化メカニズムを理解しようとする学際的分野です。

コンピューターシミュレーション、自律ロボット、人工細胞の化学合成など、さまざまな手段で生物の振る舞いや進化を模倣し、新たな生命科学の知見を得ることを目指しています。

主な応用は生態系モデリングや進化理論研究などの学術的分野が中心です。

生命と非生命の違い

人工生命の文脈で生命と非生命の違いを定義することは、この分野の根本的な課題の一つです。

人工生命研究では、生命現象を人工的に再現しようとする過程で、「生命とは何か」という根本的な問いに直面します。

生命を明確に定義することは難しい課題ですが、一般的に以下のような特性が生命体に共通して見られます。

- 自己複製(遺伝情報の継承と新しい個体生成)

- 代謝(エネルギー取り込みと活用)

- 成長と発達

- 環境への反応性

- 進化(遺伝的変異と自然選択)

人工生命の研究者らは、コンピューターシミュレーションやウェットウェア(化学物質)などを使って、これらの生命の特性を人工的に模倣・再現しようとしています。

しかし、人工システムが自然の生命と全く同じ機能を備えているわけではないため、それが本当の「生命」と呼べるかは曖昧な部分があります。

つまり、人工生命の研究を通じて、生命と非生命の境界が問われ、生命の定義自体が拡張される可能性があります。生命現象の本質に迫ることで、私たちの生命観を新たな視点から見直すきっかけにもなるのです。

このように、人工生命は生命科学のみならず、哲学的・倫理的な問題にも広がる学際的な分野であり、生命の理解を根底から覆す潜在性を持っているということができます。

人工生命の例

コンウェイのライフゲーム(Conway's Game of Life)

この例は人工生命アプローチ①ソフトウェアシミュレーションに該当します。

コンウェイのライフゲーム(Conway's Game of Life)は、1970年にイギリスの数学者ジョン・ホートン・コンウェイによって考案された、非常に有名なセルオートマトンの一種です。

ライフゲームは、あらかじめ決められたシンプルなルールに基づいたシミュレーションで、生命の誕生、死、進化を模倣することが可能です。

こちらは、その単純なルールから派生する複雑な振る舞いと、生命の本質的な特性を探求するためのモデルや計算理論や複雑系の研究において重要な役割を果たしています。

Lenia

Artificial lifeforms are super fascinating to watch.

— hardmaru (@hardmaru) October 22, 2023

These self-organizing, self-replicating, “lifeforms” emerged from a continuous time cellular automata system called Flow-Lenia.

Lenia is a family of CAs generalizing Conway’s Game of Life to continuous space, time and states. pic.twitter.com/Rp820ouNoI

Leniaは,先ほどのConwayのライフゲーム(2次元セルオートマトン系)を空間・時間・状態・遷移規則に関して連続化した人工生命モデルです。

また,これを拡張したFlow Leniaは,種類の異なる複数の生命体が同じ環境内で多様に相互作用しながら共存する過程をシミュレートすることができます。

Anthrobot(アンスロボット)

こちらはハードウェア的実装の例です。

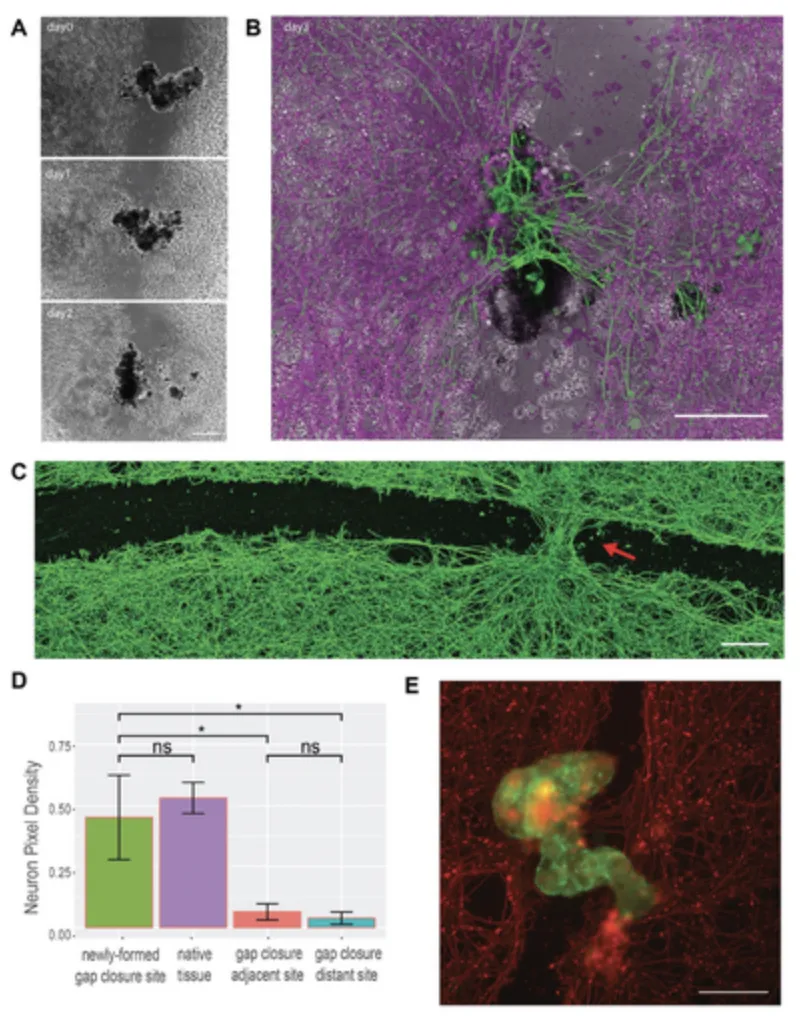

Anthrobot(アンスロボット)カエルの胚の細胞から再構成された生きたロボット「Xenobot(ゼノボット)の発展系で、人間の細胞から作られたロボットです。

既に研究成果は出ており、アンスロボットを、傷のある神経組織のシートの上に置いたところ、シートを横断し、傷の迅速な修復を誘導したということです。

Anthrobotが傷を修復する様子 (出典)Motile Living Biobots Self-Construct from Adult Human Somatic Progenitor Seed Cells)

これを体内に入れることができるようになれば、継続的な治療と病気の発見や、医療のアプローチそのものを変え、老化解決にもつながる可能性がある、とかなりの期待がされています。

ips細胞の移植手術

こちらはウェットウェア(化学物質)を用いた人工生命の例です。

信州大学医学部の柴祐司教授、慶應大学の遠山周吾講師、福田恵一名誉教授らの研究チームは、Heartseed社との共同研究で、ヒトのiPS細胞から心筋細胞(心臓の筋肉細胞)を作成し、それらを約1000個集めた「心筋球」を作り、心筋梗塞を起こしたカニクイザルの心臓に移植しました。

12週間後に心臓の組織を解析したところ、移植した心筋細胞が生着し、正常に機能していることが確認されました。

エコー検査などの結果から、心筋球を移植したサルは、移植しなかったサルに比べて心臓の機能が回復し、従来の報告と比べて心室での不整脈の副作用も大幅に少ないことが分かりました。

この研究では、心筋細胞の中でも心室の筋肉細胞だけを作り出すことができたこと、心筋球にすることで移植時の細胞死を減らし、不整脈を減少させることが可能になったと福田名誉教授は説明しています。

研究チームは、心筋球を用いた心臓治療の臨床試験をヒトでも開始しており、数年以内の実用化を目指しています。

次世代技術のトレンドを業務へのAI導入計画に結びつけるなら

量子コンピューティングやAIエージェント、ワールドモデルといった次世代技術の動向を把握した今、自社の業務にどのタイミングでどの技術を取り入れるかを検討する価値があります。技術トレンドを「知識」で終わらせず、業務変革の計画に落とし込むことが競争力の源泉になります。

AI総合研究所では、最新のAI技術動向を踏まえた業務プロセスのAI化を220ページのガイドにまとめています。自社のAI導入ロードマップを描く際にご活用ください。

次世代AI技術の理解を業務へのAI導入計画に活かす

AI技術トレンドを踏まえた業務自動化の実践ガイド

量子コンピューティングやAIエージェントなど次世代技術の動向を把握することは、自社のAI導入戦略を設計する上で重要な視点です。AI総合研究所では、最新の技術トレンドを踏まえた業務プロセスのAI化を220ページのガイドにまとめています。

まとめ

AIの進化が社会に広範な影響を与える中、次の技術革新の波として2026年現在最も注目される分野は、量子コンピューティング、Physical AI(フィジカルAI)とロボット革命、AIエージェントとマルチエージェント、ワールドモデル、そして人工生命の実現の5つです。

量子コンピューティングは膨大な計算能力により、暗号解読や薬剤発見などに革命をもたらす可能性があります。一方、生成AIはコンテンツ生成からPhysical AIへとその応用範囲を拡大し、デジタル空間を超えて現実世界での物理的作業へと進化しています。AIエージェントとマルチエージェントシステムは、自律的なタスク遂行によって企業の働き方そのものを変える力を持ちます。ワールドモデルは、AIが世界の仕組みを理解し、未知の状況にも対応できる次世代の知能基盤として急速に重要性を増しています。さらに、人工生命は生命の本質を科学的に解明することを目指し、新たな生命科学の知見や実用技術へと繋がる道を開いています。

これらの技術は、それぞれが持つ独自の潜在能力を活かし、未来の産業革命を牽引する核となることでしょう。それぞれの分野がもたらす倫理的、社会的な影響にも注意を払いながら、技術の適切な管理と応用が求められます。テクノロジーの波に乗り遅れないためにも、今から次世代技術の動向を継続的にウォッチしていくことが重要です。