この記事のポイント

UIプロトタイプの初期検証を高速化したいなら、Google Stitchを第一候補にすべき。Standard 350回+Experimental 200回/月の無料枠があり、Vibe Designによりビジネス目標を言葉で伝えるだけで複数のデザイン案が生成される

2026年3月のリニューアルでGemini 3統合・Vibe Design・マルチスクリーンプロトタイプ・SDK/MCPサーバーが追加され、Claude Code・Gemini CLI・Cursorとの連携でデザインから開発までが一気通貫で進む

Figma貼り付け(Standardモード中心)+HTML/CSS・React Appエクスポート+Google AI Studio連携により、デザイナー・エンジニア間のハンドオフ工数を大幅に削減できる

静的コード(HTML/CSS)に加えてReact App生成にも対応。ただしリアルタイムコラボレーションは非対応のため、本番デザインシステムへの全面採用は避け、PoC・初期プロトタイプ・クライアント提案用モックアップに限定するのが最善策

v0やLovableとの使い分けでは、UIデザインの高速プロトタイピングにはStitch、Next.js/Viteのプロダクションコード生成にはv0/Lovableが適する

Microsoft MVP・AIパートナー。LinkX Japan株式会社 代表取締役。東京工業大学大学院にて自然言語処理・金融工学を研究。NHK放送技術研究所でAI・ブロックチェーンの研究開発に従事し、国際学会・ジャーナルでの発表多数。経営情報学会 優秀賞受賞。シンガポールでWeb3企業を創業後、現在は企業向けAI導入・DX推進を支援。

Google Stitchは、自然言語や画像からUIデザインとフロントエンドコードを自動生成する、Google Labs発のAIネイティブデザインプラットフォームです。

2026年3月の大規模リニューアルで、Gemini 3統合、Vibe Design、マルチスクリーンプロトタイプ、SDK/MCP連携などが追加され、静的なUI生成ツールから開発ワークフロー全体を支援するプラットフォームへと進化しました。

本記事では、Google Stitchの全機能、使い方、料金(Standard 350回+Experimental 200回/月無料)、Figma AI・v0・Lovableとの比較、制限事項までを2026年3月時点の公式情報にもとづいて整理します。

AI総合研究所では、企業のAI導入・UI/UX改善を支援しています。お気軽にご相談ください。

✅Nano Banana 2については、以下の記事をご覧ください。

Nano Banana 2とは?特徴・料金・使い方を徹底解説

目次

DESIGN.md — デザイン一貫性を保つ自然言語ファイル

Vibe Design — ワイヤーフレーム不要の設計アプローチ

Prototypes — マルチスクリーンのインタラクティブプロトタイプ

Google Stitchとは?

Google Stitchとは、Google Labsが提供するAIネイティブのソフトウェアデザインプラットフォームです。自然言語や画像からUIデザインとフロントエンドコードを自動生成でき、2025年5月にGoogle I/Oで発表されました。

2026年3月18日の大規模リニューアルにより、Googleはこのツールを「Vibe Design(バイブデザイン)」プラットフォームと位置づけ、従来のワイヤーフレーム中心の設計プロセスを根本から変えるアプローチを打ち出しています。

ビジネス目標やユーザー体験のイメージを言葉で伝えるだけで、複数のデザイン案が生成される仕組みです。

基本無料で利用でき、Standardモードで月間350回、Experimentalモードで月間200回の生成が可能です(stitch.withgoogle.comからGoogleアカウントでアクセス)。

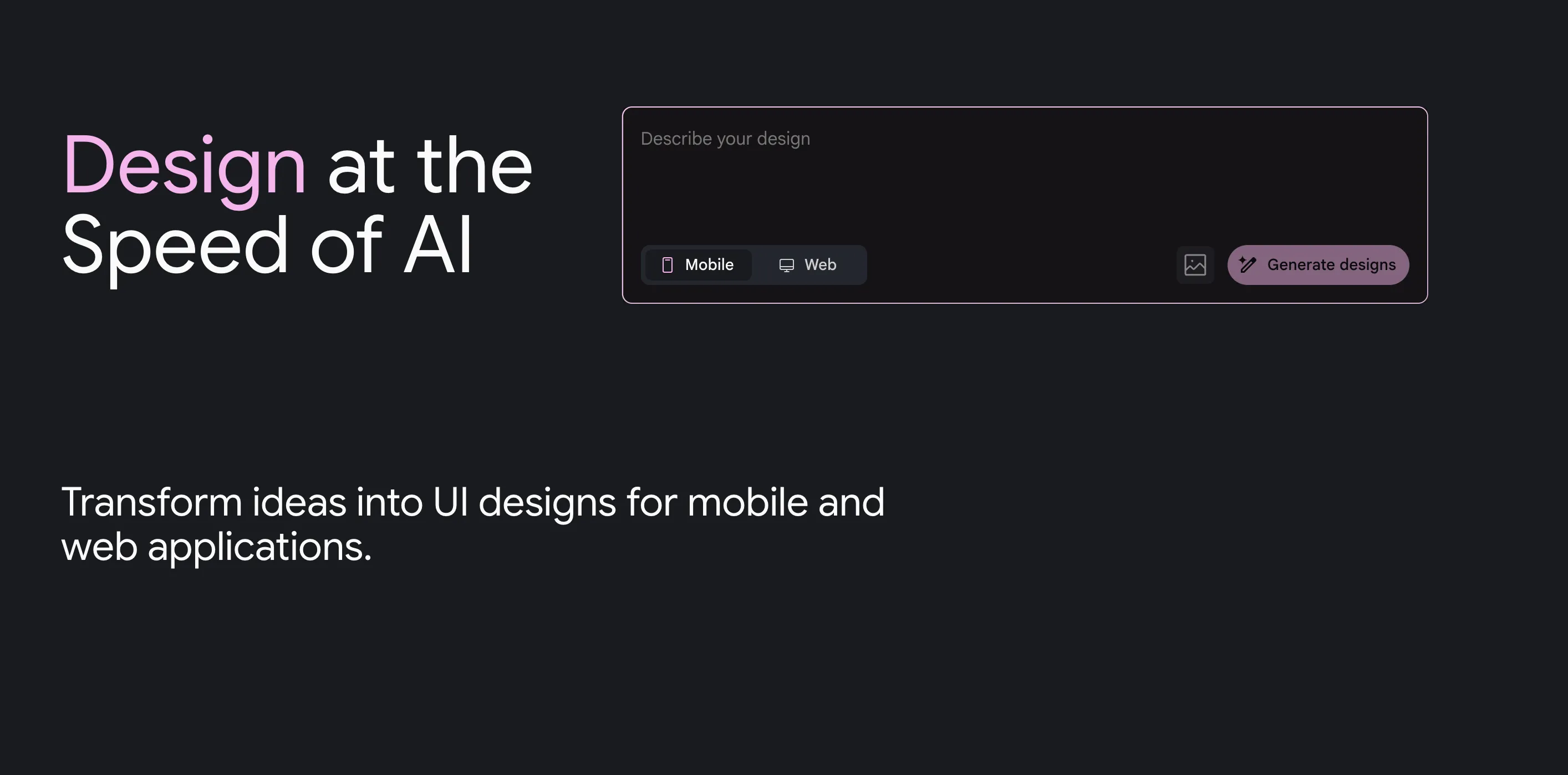

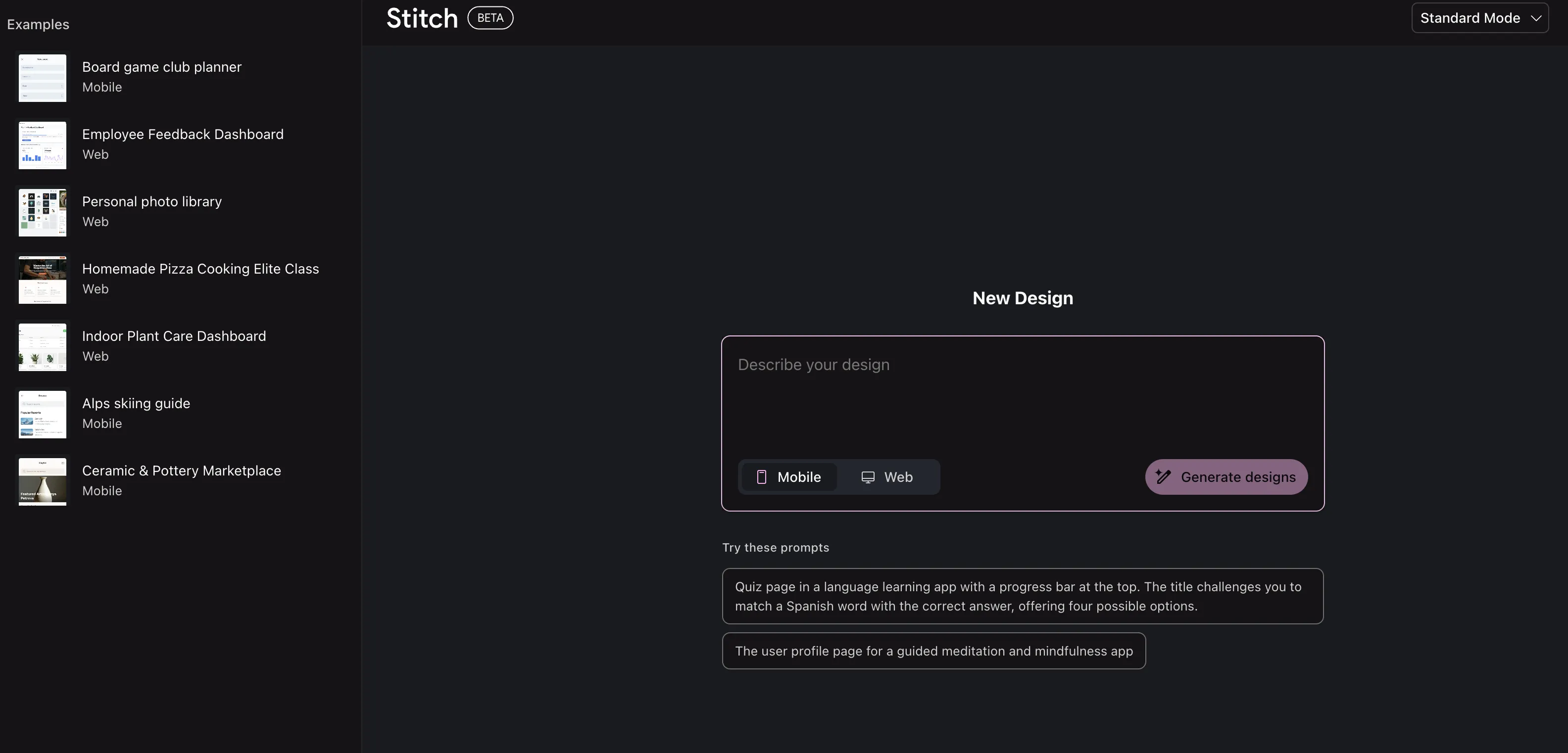

実際のGoogle Stitchトップ画面

Stitchが登場した背景

従来、アプリケーションの開発ではデザイナーとエンジニアの間で多くのやり取りが発生し、デザインからコードへの変換に手間と時間がかかっていました。Googleが2025年に買収したGalileo AIの技術を基盤に、自社のマルチモーダルAI「Gemini」を統合する形でStitchは開発されました。

このリニューアル発表後、競合のFigmaの株価が約8%下落したことからも、市場がStitchのインパクトをどう評価しているかが分かります。

Google Stitchの技術的背景とAIモデル

Google Stitchの中核を担うのが、GoogleのマルチモーダルAI「Gemini」シリーズです。2026年3月時点では、用途に応じて複数のモデルを切り替えて利用できます。

| モデル | 特徴 | 想定用途 |

|---|---|---|

| Gemini 3.0 Flash | 標準モデル。テキスト・画像を統合的に処理 | 日常的なUI生成、Vibe Design |

| Gemini 3.1 Pro | 最大忠実度モード。より精緻なデザイン出力 | 高品質なプロトタイプ、クライアント提案用 |

※モデルの更新頻度が高いため、最新の選択肢はstitch.withgoogle.comで確認してください。

日常的な作業ではFlashモデルで十分ですが、クライアント向けのプレゼン用モックアップを作る場合はProモデルを選択すると、細部の仕上がりが一段上がります。

Redesign Agent — AIによる設計改善

現行のStitch UIには、生成済みのデザインをAIが分析・改善するRedesign機能が搭載されています。プロンプトやスクリーンショットをもとに、レイアウトやコンポーネントの改善提案を行い、反復的にデザインを洗練させることができます。

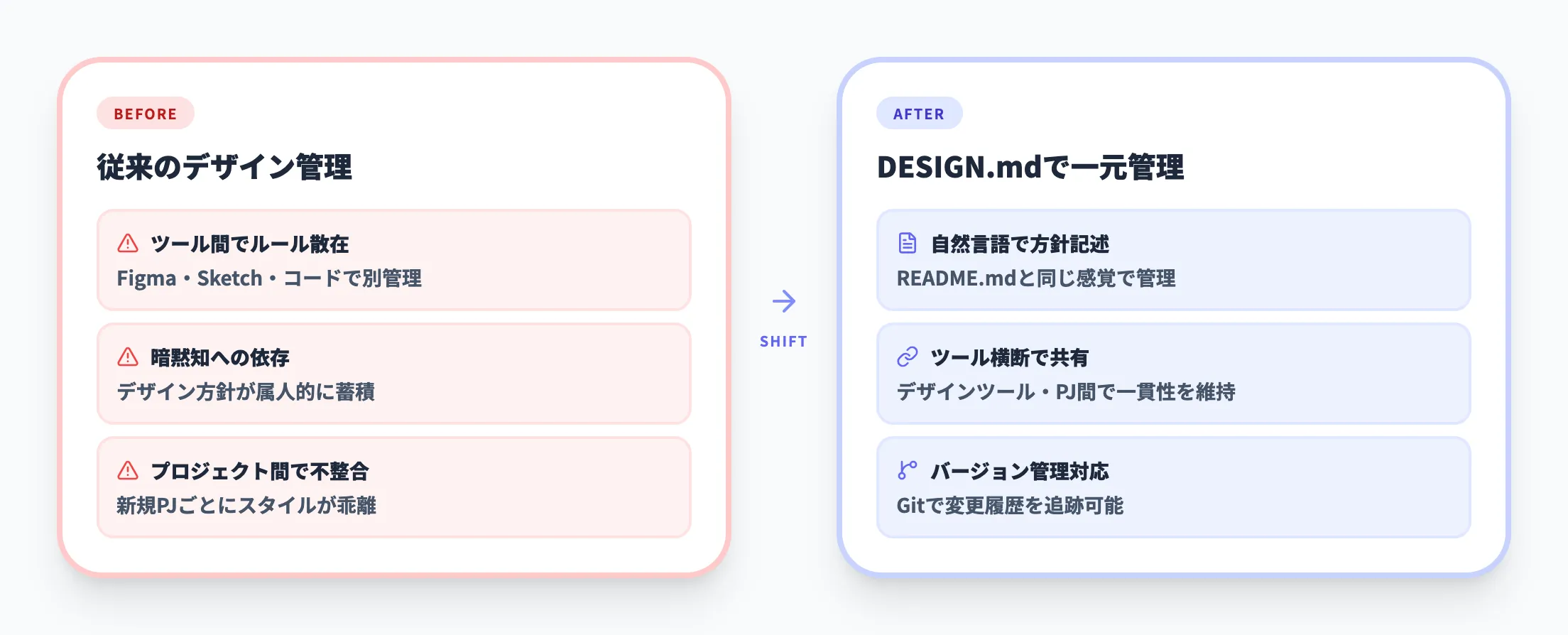

DESIGN.md — デザイン一貫性を保つ自然言語ファイル

Stitchは、デザインの詳細をDESIGN.mdという自然言語ファイルに保存する仕組みを導入しました。デザインツールやプロジェクト間でデザインの一貫性を維持するための仕組みで、開発者がコードベースのREADME.mdと同じ感覚でデザイン方針を管理できます。

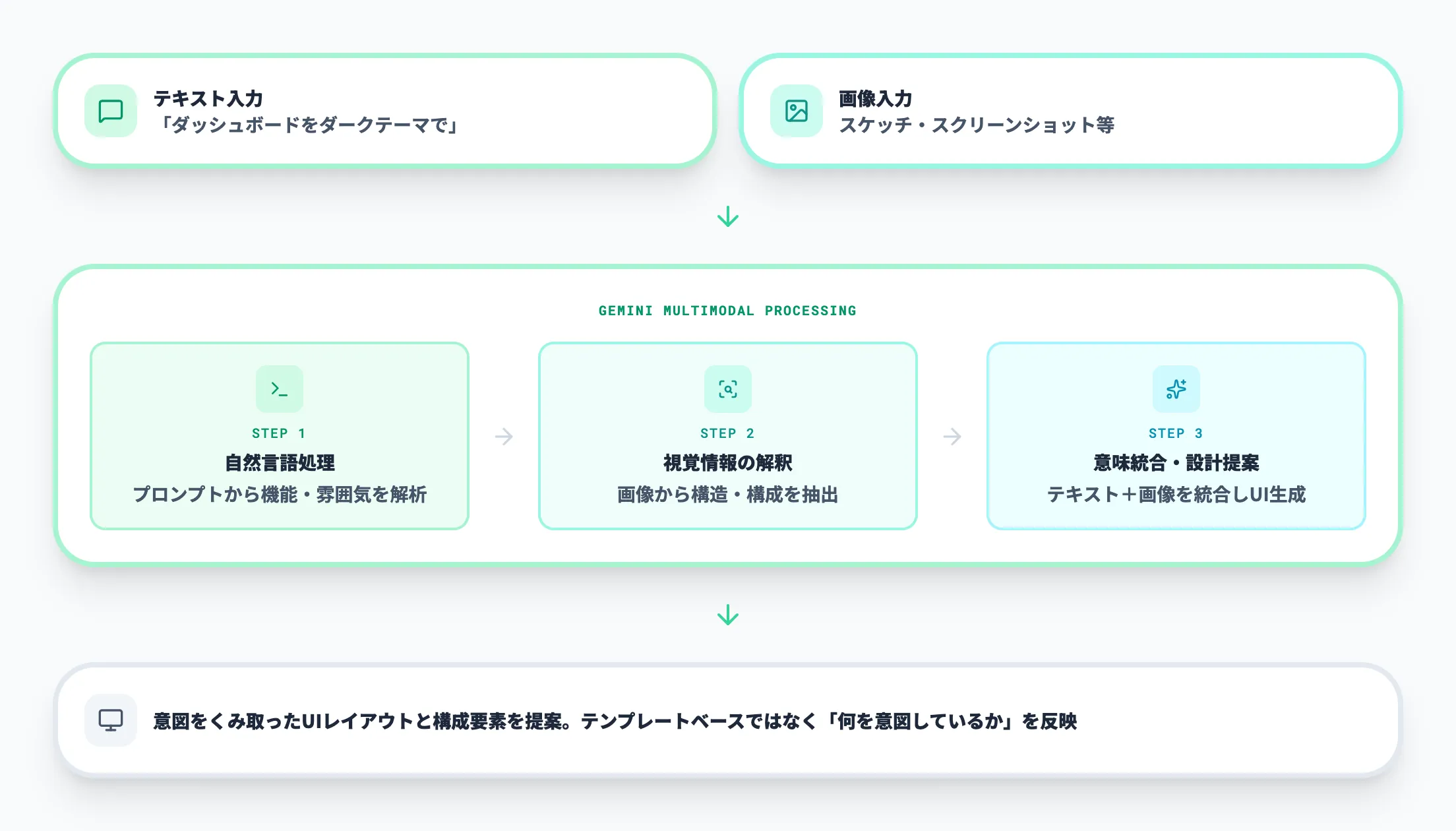

StitchにおけるAI活用の仕組み

Stitchは、Geminiのマルチモーダル処理能力を活かして、UI設計の最初の工程を大幅に効率化しています。具体的なステップは以下の通りです。

- 自然言語処理 入力されたプロンプトを解析し、UIに求められている機能や雰囲気を理解

- 視覚情報の解釈 アップロードされた画像(スケッチ、スクリーンショットなど)を解析し、構造や構成を抽出

- 意味統合と設計提案 テキストと画像の意味を統合し、実際のデザイン案としてUIを生成

たとえば、手描きのスケッチ画像と「このレイアウトでダークテーマのダッシュボードを作って」という説明文を同時に送ると、Geminiはそれらを統合的に読み取り、適切なUIレイアウトと構成要素を提案します。テンプレートベースのツールとは異なり、「何を意図しているか」をくみ取って反映する力がある点が大きな特長です。

【関連記事】

Gemini 2.5 Proとは?I/O edition・ディープリサーチなど機能や使い方、料金をわかりやすく解説

Google Stitchの主な機能

Stitchは2025年5月の発表以降、2026年3月のGemini 3統合・大規模リニューアルを経て、機能が大幅に拡張されています。ここでは、現在利用できる主要機能を整理します。

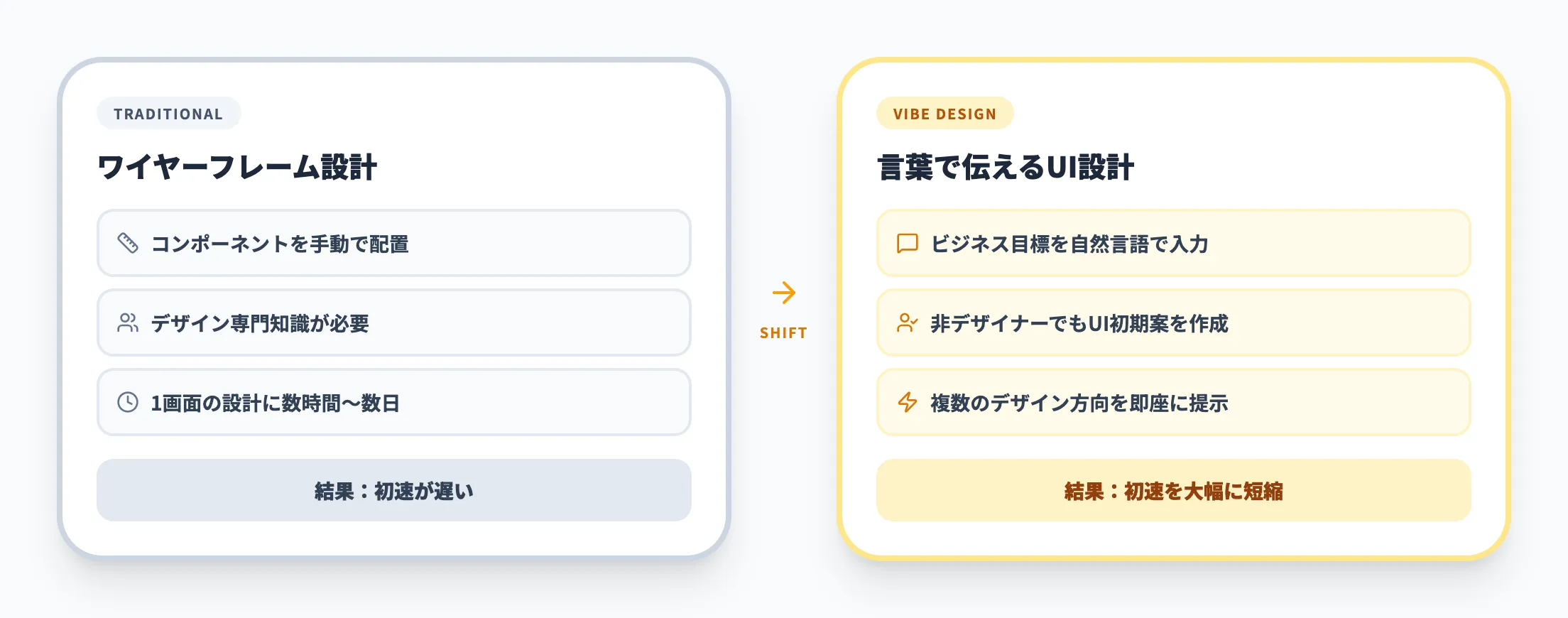

Vibe Design — ワイヤーフレーム不要の設計アプローチ

2026年3月のリニューアルで導入されたVibe Designは、Stitchの設計思想を象徴する新機能です。従来のワイヤーフレーム中心のワークフローを置き換え、ビジネス目標やユーザー体験のイメージを自然言語で伝えるだけで、複数のデザイン案が自動生成されます。

たとえば「高級感のあるフィンテックアプリのダッシュボード。ユーザーが安心感を感じるデザインで」と入力すると、その「バイブ(雰囲気)」に合った複数のデザイン方向が提示されます。具体的なコンポーネントを指定する必要がないため、デザインの専門知識がないプロダクトマネージャーやビジネスサイドの担当者でもUIの初期案を作成できます。

Prototypes — マルチスクリーンのインタラクティブプロトタイプ

キャンバス上の複数画面を「つなげる」ことで、画面遷移を含むインタラクティブなプロトタイプを作成できます。2026年3月のアップデートでは、最大5画面を同時に生成できるようになり、アプリ全体のユーザーフローをまとめて設計・確認できます。

Annotate — AIが解析するフィードバック注釈

生成されたUI画面に直接コメントや視覚的な注釈を書き込むと、Gemini AIがフィードバックを解析し、文脈に即したUI修正を自動で実行します。「このボタンをもっと目立たせて」と手書きで囲むだけで修正が反映されるため、デザインレビューの効率が上がります。

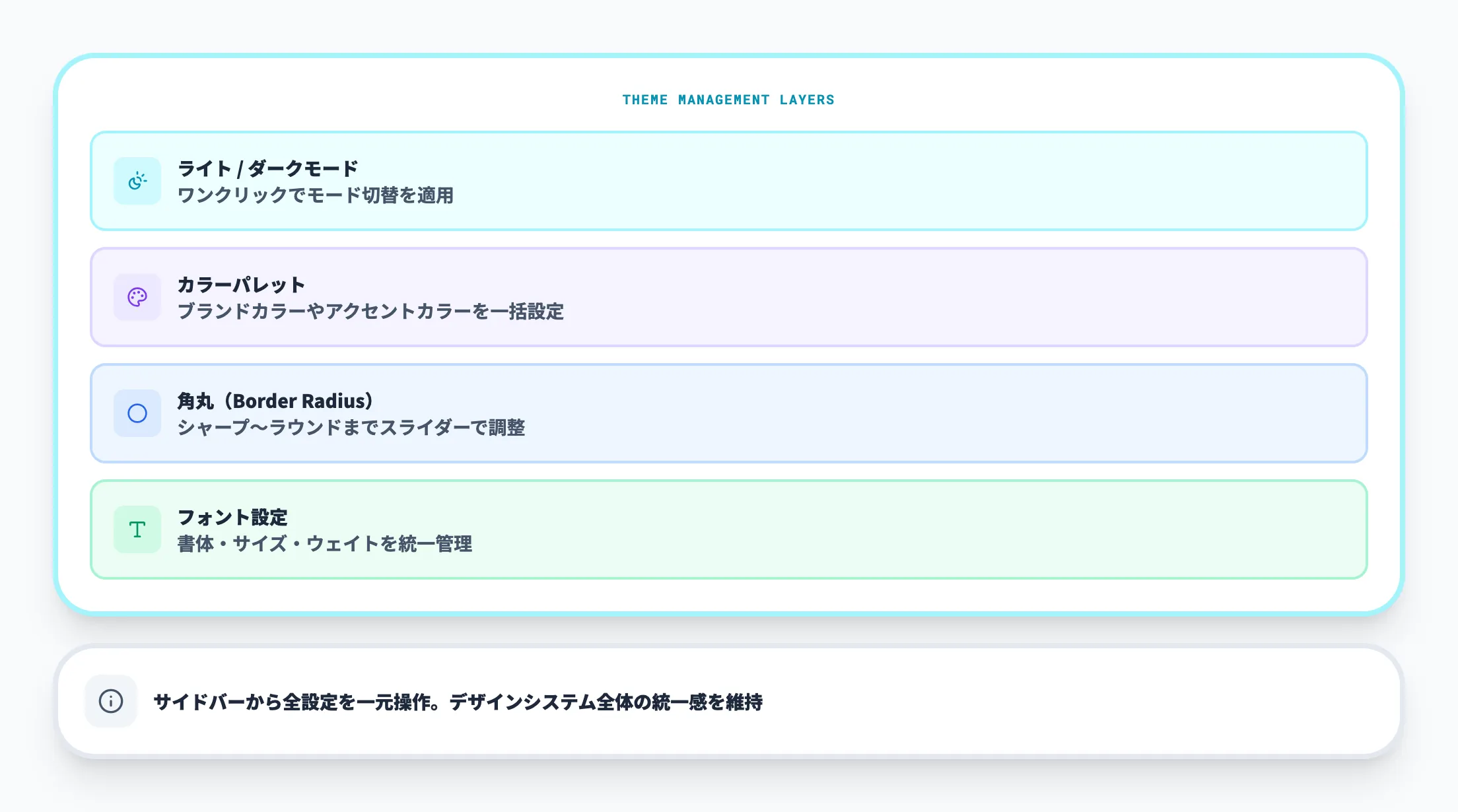

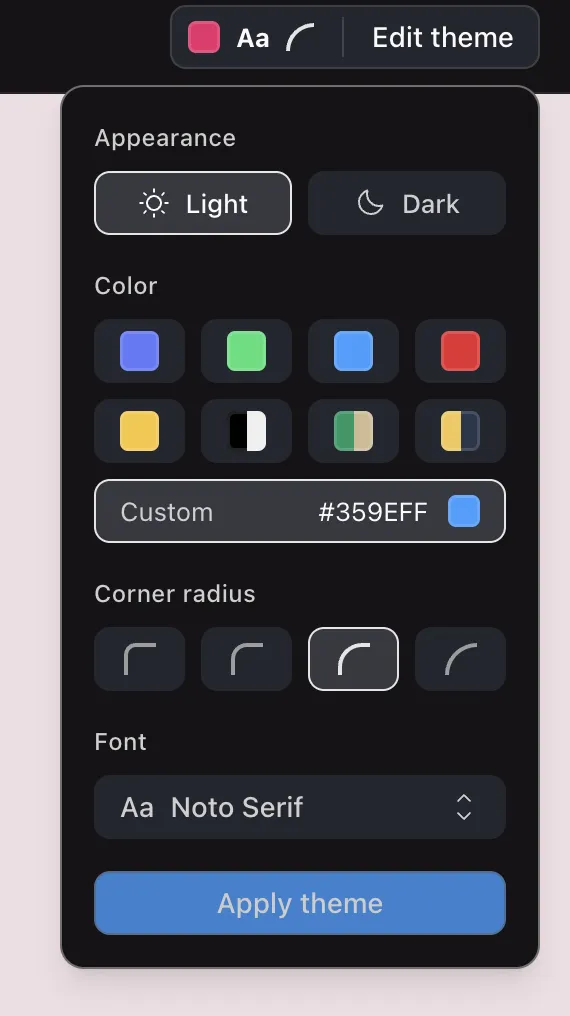

Theme — デザインシステムの統一管理

ライト/ダークモードの切り替え、カラーパレットの選択、角丸の調整、フォント設定など、デザインシステム全体を統一的に管理できるサイドバーが用意されています。

SDK/MCPサーバー — 開発ツールとの連携

2026年3月のリニューアルで、SDK(ソフトウェア開発キット)とMCPサーバーが新たに提供されました。これにより、以下のコーディングアシスタントとStitchを直接連携できます。

- Claude Code Anthropicのターミナルベースコーディングエージェント

- Gemini CLI GoogleのAIコーディングツール

- Cursor AI搭載コードエディタ

また、Google AI StudioやAntigravity(Google製のAI搭載IDE)とも連携しており、Stitchで作成したデザインをそのまま開発環境に引き渡せます。現行UIではGoogle AI Studioへのエクスポートに対応しています。

この連携の実務的な価値は、「デザイン→コード」のハンドオフ工程を大幅に短縮できる点です。従来はデザイナーがFigmaでデザインを仕上げ、エンジニアがそれを見ながらコードを書くという二段階プロセスでしたが、Stitchでは設計からコード生成までが一気通貫で進みます。

Google Stitchの使い方

では、早速Google Stitchを使ってみましょう。以下に、基本的な操作手順と実際の使用例を紹介します。

利用方法と必要な環境

Google Stitchは、専用サイト stitch.withgoogle.com から誰でも無料で利用できます。ただし、以下の条件が必要です。

- Googleアカウントでのログインが必要

- 日本語プロンプトにも対応(英語が推奨だが、日本語でもUIを生成可能)

- 最新のブラウザ環境(Chrome推奨)での利用が推奨

このツールはまだ実験的な位置づけのため、動作が不安定な場合や機能制限がある可能性もあります。

WebUIの操作フロー(例付き)

Stitchの操作は非常に直感的で、以下のようなステップで利用できます。

トップ画面

-

英語でプロンプトを入力

例:「Create a dashboard UI with a sidebar and a dark theme.」

→ ダッシュボード画面にサイドバー付き、ダークテーマのUIが生成されます。 -

必要に応じて画像をアップロード

手書きスケッチや既存UIのスクリーンショットをドラッグ&ドロップで追加できます。 -

自動生成されたUI候補を確認

数秒以内に複数の候補が表示され、それぞれのUIをビジュアルで比較できます。 -

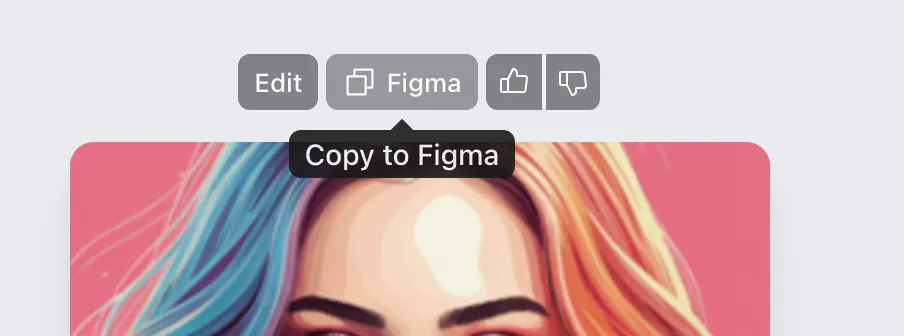

Figmaにコピーまたはコードをエクスポート

気に入ったデザインはFigmaに貼り付け可能です(Standardモードで生成したデザインが対象)。加えて、HTML/CSSコードやReact Appもその場でエクスポートできます。

Figmaにワンクリックで貼り付け

試してみた実例

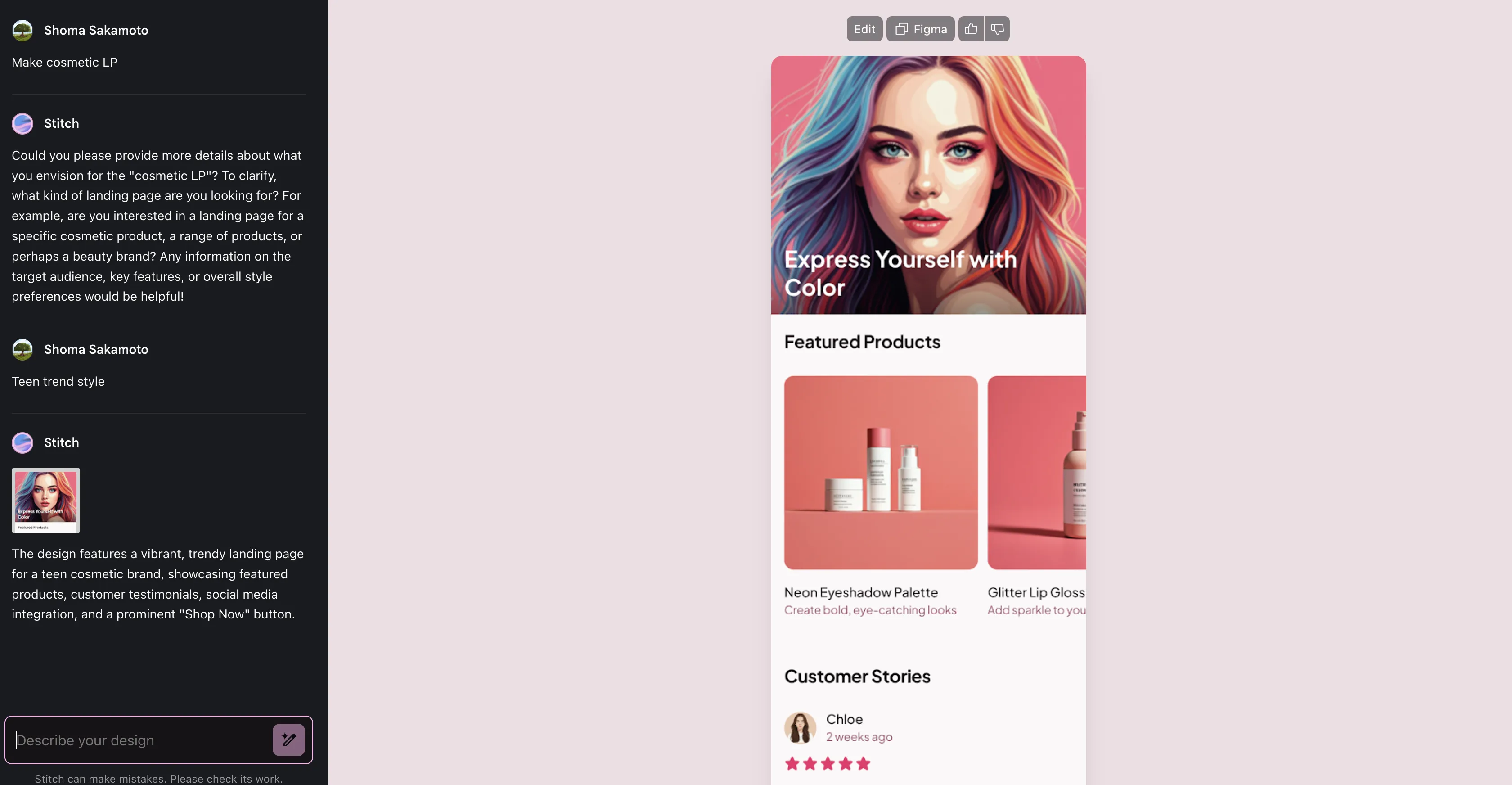

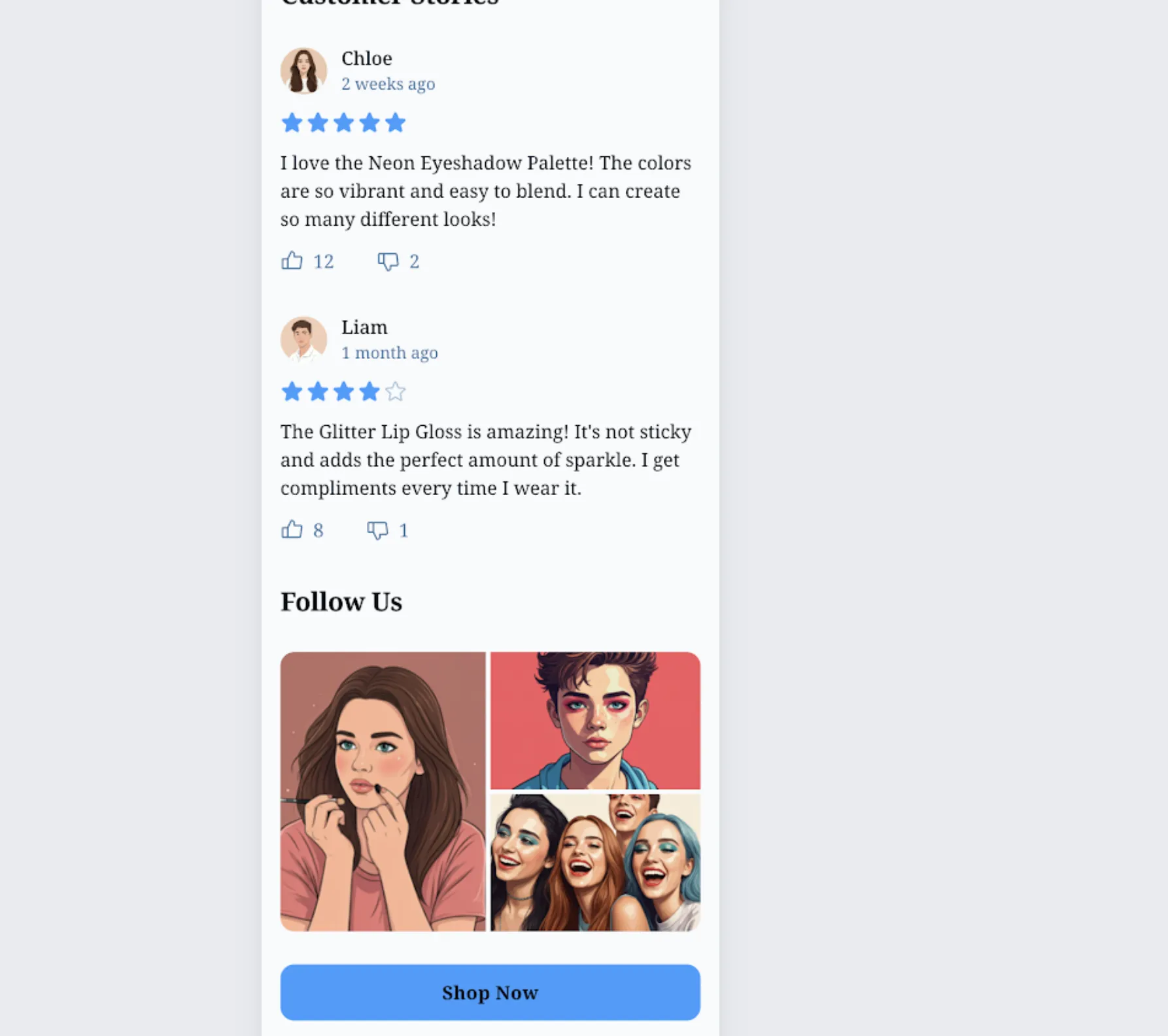

- 実際に「化粧品のLPを生成するプロンプト」を入力した結果

実際の生成画面

- 生成画像を元に編集することも可能です。色の変更を試してみました。

色やパターンの選択

実際に青色パターンに変更した結果

Google Stitch vs 他のAI UI生成ツール

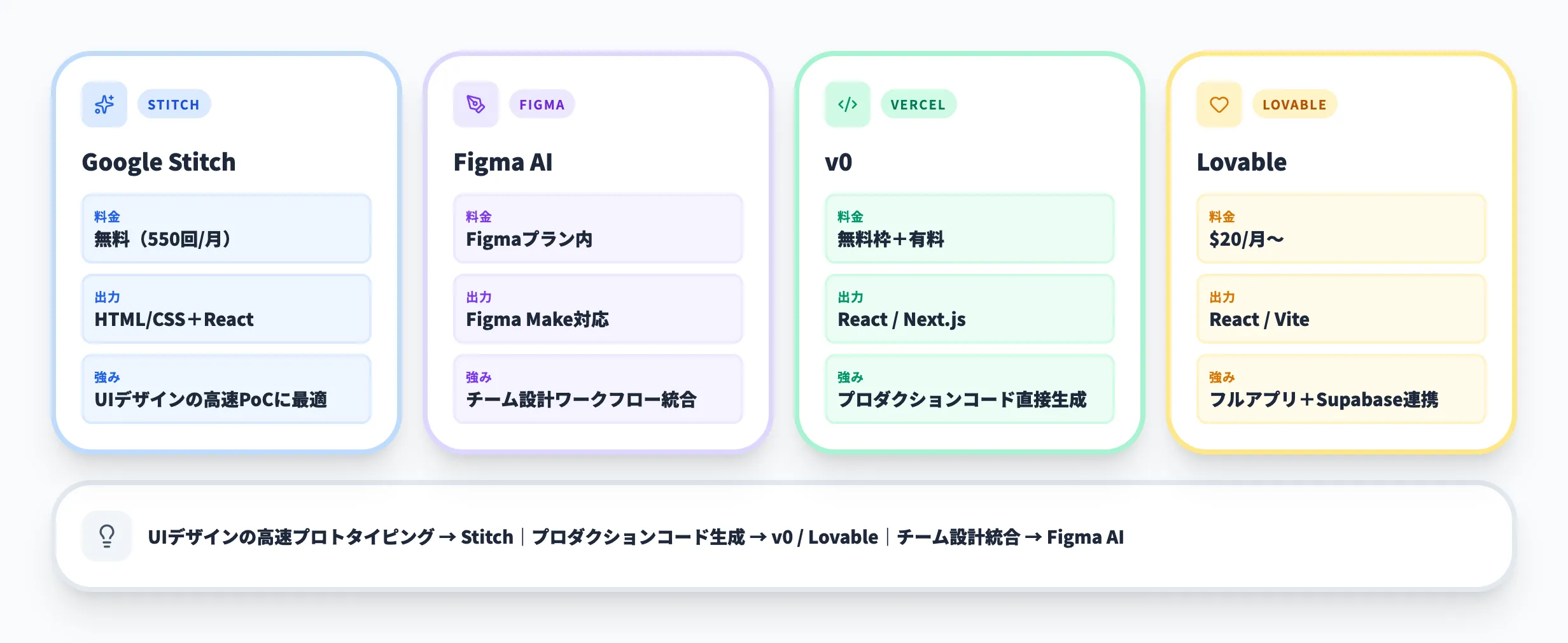

AI搭載のUI生成ツールは2026年に入って選択肢が急増しています。ここでは、代表的なツールとStitchのポジショニングを比較します。

| 比較項目 | Google Stitch | Figma AI | v0(Vercel) | Lovable |

|---|---|---|---|---|

| 料金 | 無料(Standard 350回+Experimental 200回/月) | Figmaプラン内 | 無料枠+有料 | $20/月〜 |

| 入力方式 | テキスト+画像 | テキスト+デザインファイル | テキスト+画像 | テキスト+画像 |

| AIモデル | Gemini 3.0 Flash / 3.1 Pro | 独自モデル | Claude等 | Claude等 |

| コード出力 | HTML/CSS+React App | コード/機能プロトタイプ生成(Figma Make) | React / Next.js | React / Vite |

| プロトタイプ | マルチスクリーン(5画面同時) | Figmaネイティブ | プレビュー | フルアプリ |

| デザインツール連携 | Figma貼り付け+Google AI Studio | Figmaネイティブ | なし | なし |

| 開発ツール連携 | SDK/MCP(Claude Code / Gemini CLI / Cursor) | Dev Mode | Vercelデプロイ | Supabase連携 |

ツール選定の軸は「何をゴールにするか」で変わります。StitchはUIデザインの高速プロトタイピングに強みがあり、v0やLovableはデザインよりも動くアプリケーションの生成に寄っています。Figma AIはFigma Makeによるコード/機能プロトタイプ生成も含め、チーム全体のデザイン〜開発ワークフローへの統合が強みです。

UIプロトタイプの初期検証を高速化したいなら、無料で月550回(Standard+Experimental)使えるStitchが最もコスト効率が良い選択です。一方、Next.js/Viteのプロダクションコードが必要な場合はv0やLovableが適しています。既にFigmaをチーム全体で使い込んでいる場合は、Figma AIのほうが既存ワークフローへの統合コストが低く済みます。

導入判断で詰まる3つの論点

「プロトタイプ1画面を作るのに3日かけている」「クライアントへの提案資料にモックアップが間に合わない」——こうした状況が繰り返されているなら、AI UI生成ツールの導入を検討するタイミングです。ただし、ツール選定で判断が分かれるのは以下の3点です。

-

「デザインの初速」と「コードの品質」のどちらを優先するか

StitchはHTML/CSSに加えてReact App生成にも対応していますが、v0やLovableのようにNext.js/Viteのプロダクション向けコードを直接出力するわけではありません。初期デザインの素早い具現化には最適ですが、本番コードとしてそのまま使うにはエンジニアの手直しが必要です

-

「Googleエコシステムへの依存度」をどう考えるか

StitchはGoogle AI Studio、Antigravityとの連携が強みですが、逆に言えばGoogleのエコシステムに寄った設計です。AWS/Azure中心の技術スタックのチームでは、この連携の恩恵が薄くなります

-

「チーム設計」か「個人プロトタイプ」か

2026年3月時点のStitchはリアルタイム共同編集には非対応です(共有リンクやread-only共有、remixは可能)。チーム全体でリアルタイムにデザインを共同編集する場合はFigmaが依然として強い選択肢です

UIデザインのAI化をきっかけに業務全体の自動化を検討するなら

StitchがUI生成のリードタイムを劇的に短縮したように、AIは業務プロセスの中でも「繰り返し・ルールベース・データ集約」が多い領域で大きな効果を発揮します。デザインに限らず、社内の承認・集計・報告業務にもAIを適用する企業が急速に増えています。

AI総合研究所のAI業務自動化ガイドでは、業務領域ごとのAI適用パターンと導入の優先順位づけを整理しています。デザインツールのAI化で手応えを感じた方は、次のステップとしてぜひご覧ください。

デザインAIの次は業務プロセスのAI化

UIの自動生成から業務全体の自動化へ

Google StitchのようにUIデザインがAIで効率化されたのと同じく、業務プロセスもAIで自動化できます。導入ステップを整理した無料ガイドです。

Google Stitchの料金と利用制限

Google Stitchは2026年3月時点で完全無料で利用できます。クレジットカード登録やサブスクリプション契約は不要で、Googleアカウントでログインするだけで使い始められます。

ただし、月間の生成回数には上限が設けられています。

| モード | 月間生成回数 | 特徴 |

|---|---|---|

| Standard(標準) | 350回 | 通常の生成。ほとんどのユースケースに対応 |

| Experimental(実験的) | 200回 | より高度な生成。新機能のテスト用途 |

月350回の生成回数は、日常的なプロトタイピング作業には十分な量です。1日あたり約11回の生成が可能で、UIの初期案作成→修正→バリエーション確認というサイクルを回すには過不足ありません。

Google Stitchの制限事項

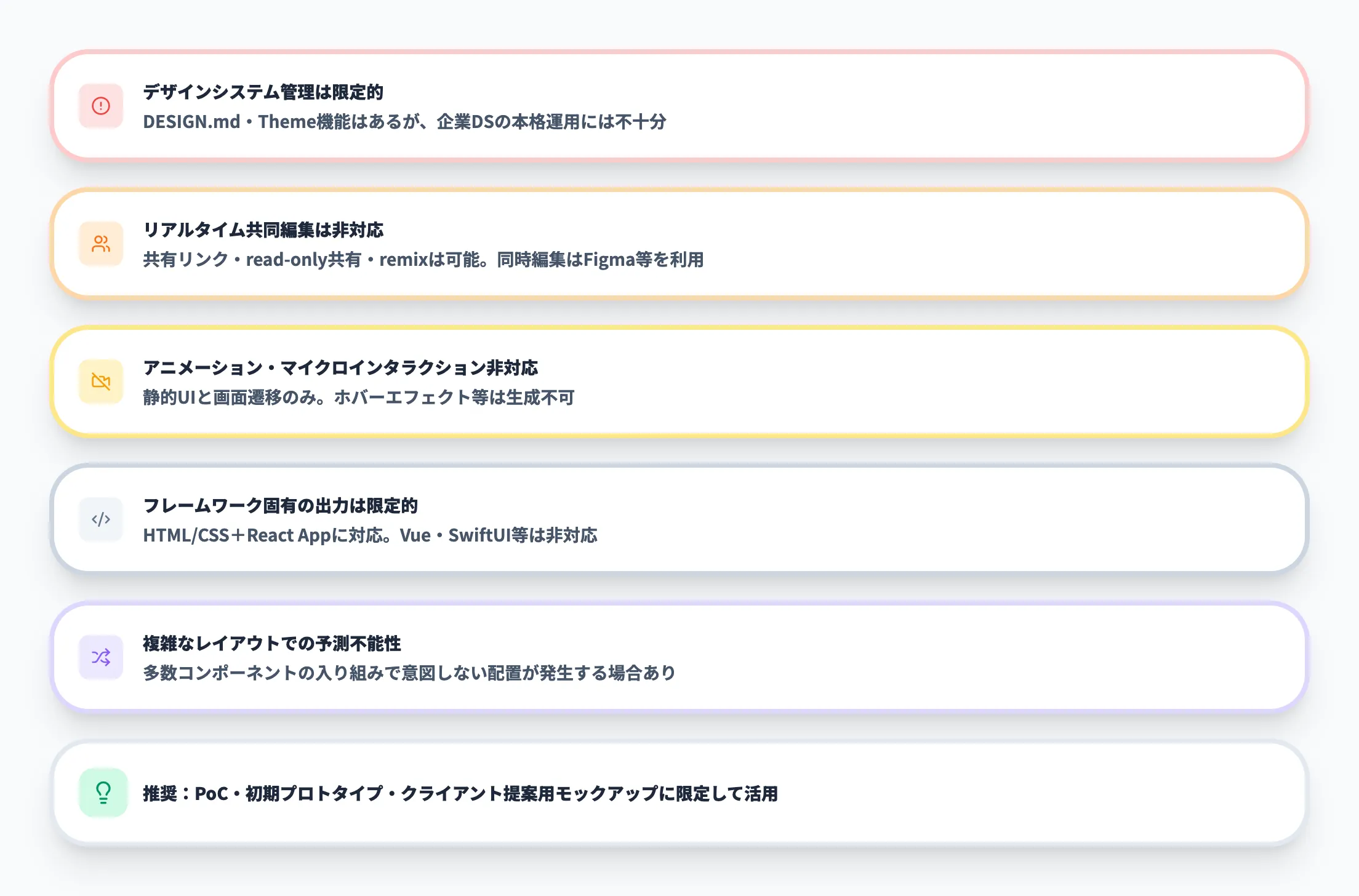

現時点でのStitchには、以下の制限があります。導入前に把握しておくと、期待値のズレを防げます。

-

デザインシステム管理は限定的

DESIGN.mdやTheme機能でデザインの一貫性を保つ仕組みはありますが、Figmaのように既存の企業デザインシステムやコンポーネントライブラリを本格的に読み込んで運用する機能は限定的です

-

リアルタイム共同編集は非対応

共有リンクやread-only共有、remixは可能ですが、リアルタイムでの共同編集には対応していません。チームで同時にデザインを編集する場合はFigma等の利用が必要です

-

アニメーション/マイクロインタラクションの設計は非対応

静的なUIデザインとプロトタイプの画面遷移は対応していますが、ボタンのホバーエフェクトやモーダルのアニメーションなどは生成できません

-

フレームワーク固有のコード出力は限定的

HTML/CSSエクスポートに加えてReact App生成にも対応していますが、Vue、SwiftUIなど他フレームワークのコンポーネント出力には対応していません

-

複雑なレイアウトでのAI出力の予測不能性

多数のコンポーネントが入り組んだ複雑なレイアウトでは、意図しない配置になる場合があります。修正プロンプトやAnnotate機能で対応可能ですが、一発で完璧な出力を期待するのは現実的ではありません

これらの制限を踏まえると、Stitchは企業デザインシステムへの全面採用よりも、PoC・初期プロトタイプ・クライアント提案用モックアップに限定して活用するのが現時点での最善策です。

まとめ:Google Stitchは「アイデアからUI」のリードタイムを圧縮するツール

本記事では、Google Stitchの全機能、使い方、料金、競合比較、制限事項までを2026年3月時点の公式情報にもとづいて整理しました。

- 2026年3月のリニューアルで、Gemini 3統合・Vibe Design・マルチスクリーンプロトタイプ・SDK/MCPサーバー・React App生成が追加され、静的なUI生成ツールからAIネイティブのデザインプラットフォームへと進化した

- Gemini 3系モデルをベースに、テキスト・画像の入力に対応。最大5画面の同時生成でアプリ全体のユーザーフローをまとめて設計できる

- 完全無料(Standard 350回+Experimental 200回/月)で利用でき、Figma貼り付け・コードエクスポート・Google AI Studioへのエクスポートに対応

- ただし、企業デザインシステムの本格運用やリアルタイムコラボレーションは限定的。本番のデザインシステムへの全面採用には時期尚早

自社での活用を検討しているなら、まずは次回のPoC開発やクライアント提案で「モックアップ作成」に使ってみてください。stitch.withgoogle.comにアクセスし、手元にあるラフスケッチや参考UIのスクリーンショットをアップロードして、Vibe Designで2〜3パターンを生成するところから始めるのが最も手軽です。5分の作業で、Stitchがチームに合うかどうかの判断ができます。