この記事のポイント

ChatGPTは8年間でGPT-1(1.17億パラメータ)からGPT-5.4(100万トークン対応)へ進化。この加速ペースは今後も続くと見るべき

AGI実現に向けたStargateプロジェクト(5,000億ドル規模)が始動しており、2027〜2028年にかけてAIの能力は非連続的に跳ね上がる可能性が高い

企業はAI導入を「待つ」べきではない。まず小規模トライアルから始め、段階的に業務プロセスに組み込むべき

雇用への影響は避けられないが、AIを使いこなす人材の市場価値は急上昇する。個人レベルでのAIスキル習得は最優先事項

競合AI(Claude・Gemini・Llama)の追い上げは激しいが、ユーザー基盤9億人のChatGPTがエコシステムの中心であり続ける可能性が最も高い

Microsoft MVP・AIパートナー。LinkX Japan株式会社 代表取締役。東京工業大学大学院にて自然言語処理・金融工学を研究。NHK放送技術研究所でAI・ブロックチェーンの研究開発に従事し、国際学会・ジャーナルでの発表多数。経営情報学会 優秀賞受賞。シンガポールでWeb3企業を創業後、現在は企業向けAI導入・DX推進を支援。

ChatGPTは2026年3月時点で、週間アクティブユーザー9億人を擁する世界最大のAIサービスに成長しました。GPT-5.4のリリース、5,000億ドル規模のStargateプロジェクト、1,100億ドルの史上最大民間資金調達など、OpenAIの進化は加速し続けています。

本記事では、ChatGPTの進化の歴史から最新モデルの性能、AGIへのロードマップ、競合AIとの比較、料金まで、2026年3月時点の最新情報を網羅的に解説します。

ChatGPTの最新モデル「GPT-5.5」については、以下の記事をご覧ください。

GPT-5.5とは?使い方や料金、GPT-5.4との違いを解説

目次

ChatGPTの進化の歴史(2018-2026年)

ChatGPTの歴史と進化

ChatGPTは、OpenAIが2018年にリリースしたGPT-1を起点として、わずか8年間で驚異的な進化を遂げてきました。以下の表で、GPTシリーズの進化の軌跡を時系列で整理しました。

| 年月 | モデル / イベント | 主な特徴 |

|---|---|---|

| 2018年6月 | GPT-1 | 1.17億パラメータ。言語モデルの事前学習の有効性を実証 |

| 2019年2月 | GPT-2 | 15億パラメータ。生成品質が高すぎるとして当初フルリリースを遅延 |

| 2020年6月 | GPT-3 | 1,750億パラメータ。エッセイ執筆、コーディング、高度な会話が可能に |

| 2022年11月 | ChatGPT | GPT-3.5ベース。一般公開により2ヶ月で1億ユーザー突破 |

| 2023年3月 | GPT-4 | マルチモーダル対応(画像入力可能)。司法試験上位10%の成績 |

| 2024年9月 | o1 | 初の推論特化モデル。数学・科学で飛躍的な性能向上 |

| 2025年4月 | o3 / o4-mini | ツール統合型推論モデル。o4-miniはAIME 2025で99.5%正答 |

| 2025年8月 | GPT-5 | GPT-4oを置き換え。自然な会話と深い推論を統合 |

| 2025年12月 | GPT-5.2 | ARC-AGI-1で90%突破。3モード(Instant/Thinking/Pro) |

| 2026年3月 | GPT-5.4 | ネイティブcomputer-use対応、100万トークンコンテキスト |

GPT-1の1.17億パラメータからGPT-4の推定1兆パラメータ超へと、モデルの規模は約1万倍に拡大しました。しかし、GPT-5以降ではパラメータ数の増加だけでなく、推論能力(Chain-of-Thought)やツール連携、自律的なタスク実行能力が進化の主軸となっています。GPT-5.4ではネイティブのコンピュータ操作機能が搭載され、AIが人間のようにマウスやキーボードを操作してタスクを完了できるようになりました。

OpenAIの企業構造も大きく変化しています。2015年に非営利団体として設立されましたが、2019年にCapped-profit構造に移行し、2025年10月にはPublic Benefit Corporation(PBC)への転換が完了しました。非営利部門のOpenAI Foundationが26%の株式(約1,300億ドル相当)を保有し、Microsoftが27%を保有する構造で、営利と公益の両立を目指しています。2026年2月には史上最大の民間資金調達として1,100億ドルを調達し、企業評価額は7,300億ドルに達しています。

【関連記事】

ChatGPT(チャットGPT)とは?日本語での始め方や料金、使い方を徹底解説!

ChatGPTの現在地(2026年3月版)

ChatGPTは2026年3月時点で、週間アクティブユーザー9億人を擁する世界最大のAIサービスに成長しました。ここでは、最新モデルの性能とビジネスの成長を解説します。

最新モデルの性能

2026年3月時点でChatGPTから利用できる主要モデルの特徴を以下の表に整理しました。

| モデル | リリース日 | 主な特徴 | 対象プラン |

|---|---|---|---|

| GPT-5.4 | 2026年3月 | ネイティブcomputer-use、100万トークン、虚偽主張33%減 | Plus以上 |

| GPT-5.2 | 2025年12月 | ARC-AGI-1で90%突破、3モード対応 | Free(Instant)/ Plus以上 |

| GPT-5.3-Codex | 2026年2月 | エージェント型コーディング特化、25%高速化 | Plus以上 |

| o3 / o3-pro | 2025年4月 / 6月 | 推論特化、重大エラー20%減 | Plus以上 / Pro |

| o4-mini | 2025年4月 | AIME 2025で99.5%正答、o3の約半額 | Free以上 |

GPT-5.4は、従来のテキスト生成にとどまらず、画面上のボタンをクリックしたりフォームに入力したりといったコンピュータ操作をネイティブに実行できる初のメインラインモデルです。コンテキストウィンドウが100万トークンに拡張されたことで、書籍1冊分に相当する情報を一度に処理することが可能になりました。また、GPT-5.3-Codexはエージェント型コーディングに特化しており、OpenAI自身がこのモデルを使ってGPT-5.4の開発を行ったと公表しています。

【関連記事】

ChatGPT-5(GPT-5)とは?使い方や料金、回数制限について解説!

推論モデル(reasoningモデル)とは?仕組みや学習モデルとの違いを徹底解説

ユーザー数と収益の成長

OpenAIの成長速度はテック史上でも類を見ないペースです。以下の表で、主要指標の推移を整理しました。

| 指標 | 2023年 | 2024年 | 2025年 | 2026年(最新) |

|---|---|---|---|---|

| 週間アクティブユーザー | 約1億 | 約3億 | 8億 | 9億 |

| 年間経常収益(ARR) | 20億ドル | 60億ドル | 200億ドル | 250億ドル(年換算) |

| 利用企業数 | 非公開 | 60万社 | 100万社超 | 100万社超 |

| 企業評価額 | 290億ドル | 1,570億ドル | 3,000億ドル | 7,300億ドル |

(参考)OpenAI raises $110B in one of the largest private funding rounds in history

わずか3年間でARRが20億ドルから250億ドルへと12.5倍に成長しており、SaaS企業として史上最速の成長曲線を描いています。2026年2月の1,100億ドル資金調達ではAmazon(500億ドル)、NVIDIA(300億ドル)、SoftBank(300億ドル)が参加しました。また、ChatGPTは2026年2月からFree/Goティアで広告表示を開始しており、サブスクリプション以外の収益源の多角化も進めています。

【関連記事】

ChatGPTの仕組みとは?全体像や図解で基礎から解説!

OpenAIのロードマップとAGIへの道筋

長期的な視点: AGIへの道

OpenAIのミッションは「人類全体にAGI(汎用人工知能)の利益を確実にすること」です。このセクションでは、そのミッション実現に向けた具体的な計画と、業界の専門家による予測を解説します。

Stargateプロジェクトとカスタムチップ

OpenAIは、AGI実現に不可欠な計算インフラの確保に向けて、前例のない規模の投資を行っています。

(参考)Announcing The Stargate Project

Stargateプロジェクトは、4年間で総額5,000億ドルを投じるAIインフラ構想です。Oracle、NVIDIA、SoftBankと共同で、2029年までに合計10ギガワットの電力容量を確保することを目指しています。展開拠点はテキサス、ニューメキシコ、ウィスコンシン、オハイオ、ミシガンの米国5州に加え、アブダビ、ノルウェー、英国にも拡大予定です。

さらに、OpenAIはNVIDIA GPUへの依存度を下げるため、Broadcomと共同でカスタムAIチップ「Titan」を開発しています。TSMCの3nmプロセスで製造され、2026年後半に量産を開始する予定です。第2世代の「Titan 2」も既に開発中で、2027年のスケール展開を見据えています。5,000億ドルのインフラ投資とカスタムチップ開発を並行して進めるOpenAIの戦略は、AGI実現が単なるビジョンではなく、具体的な工程表に基づいて推進されていることを示しています。

【関連記事】

ChatGPTとNVIDIAの関係とは?GPUの役割や2026年最新動向を解説

OpenAI o3(ChatGPT o3)とは?使い方や料金、制限について解説!

AGI実現の専門家予測

AGI(人間と同等以上の知的能力を持つAI)の実現時期については、業界の専門家の間でも見解が分かれています。以下の表で、主要な予測を整理しました。

| 予測者 | 所属 | AGI実現時期 | 根拠 |

|---|---|---|---|

| Sam Altman | OpenAI CEO | 2028年頃 | 「AGIの構築方法を知っている」と発言 |

| Dario Amodei | Anthropic CEO | 2026-2027年 | 「ほぼ全てで全人類より優れたAI」が数年以内 |

| Shane Legg | DeepMind共同創設者 | 2028年(50%確率) | Minimal AGIの実現確率として |

| Metaculus | 集合知プラットフォーム | 2029年(25%)/ 2033年(50%) | 多数の予測者の中央値 |

| Gary Marcus | AI研究者(懐疑派) | 2027年末までは不可能 | LLMは「収穫逓減」に達している |

Sam Altman氏は2025年のブログ記事「The Gentle Singularity」で、シンギュラリティは映画のような劇的なものではなく穏やかに到来するとの見解を示しています。一方、AnthropicのDario Amodei CEOは2026年のダボス会議で「予想より早い可能性がある」と述べています。楽観派と慎重派の予測が2026-2033年の幅に収まっていること自体が、AGIがもはや遠い未来の話ではなくなっていることを示唆しています。

【関連記事】

AGIとは?従来のAIとの違いや活用領域、今後の課題を徹底解説

o4-miniとは?主な特徴や使い方、料金体系を解説

ChatGPTが変える業界と働き方

ChatGPTをはじめとする生成AIは、働き方や業界構造に根本的な変革をもたらしつつあります。このセクションでは、最新のデータに基づいてその影響を分析します。

雇用市場への影響

世界経済フォーラム(WEF)の「Future of Jobs Report 2025」によると、AIの普及は2030年までに9,200万の職を置換する一方、1億7,000万の新しい職を創出し、純増で7,800万の雇用が生まれると予測されています。

(参考)WEF Future of Jobs Report 2025

ただし、この変化は均等に起きるわけではありません。事務職の26%、カスタマーサービスの20%がAIによる自動化のリスクにさらされている一方、プロンプトエンジニアやAI倫理責任者といった新職種が約35万件創出されています。特に22-25歳の若年層において、AI高露出職種での雇用が2022年以降13%減少しているというダラス連銀のデータは、世代間格差の拡大を示す重要な指標です。AI失職への不安を感じる労働者の割合は2024年の28%から2026年には40%に上昇しており、企業にはリスキリング支援と段階的なAI導入が求められています。

【関連記事】

ChatGPT・AIによってなくなる仕事一覧!その特徴も解説

日本のAI導入状況は?現状や実際の導入事例、メリットデメリットを解説

教育・医療分野の変革

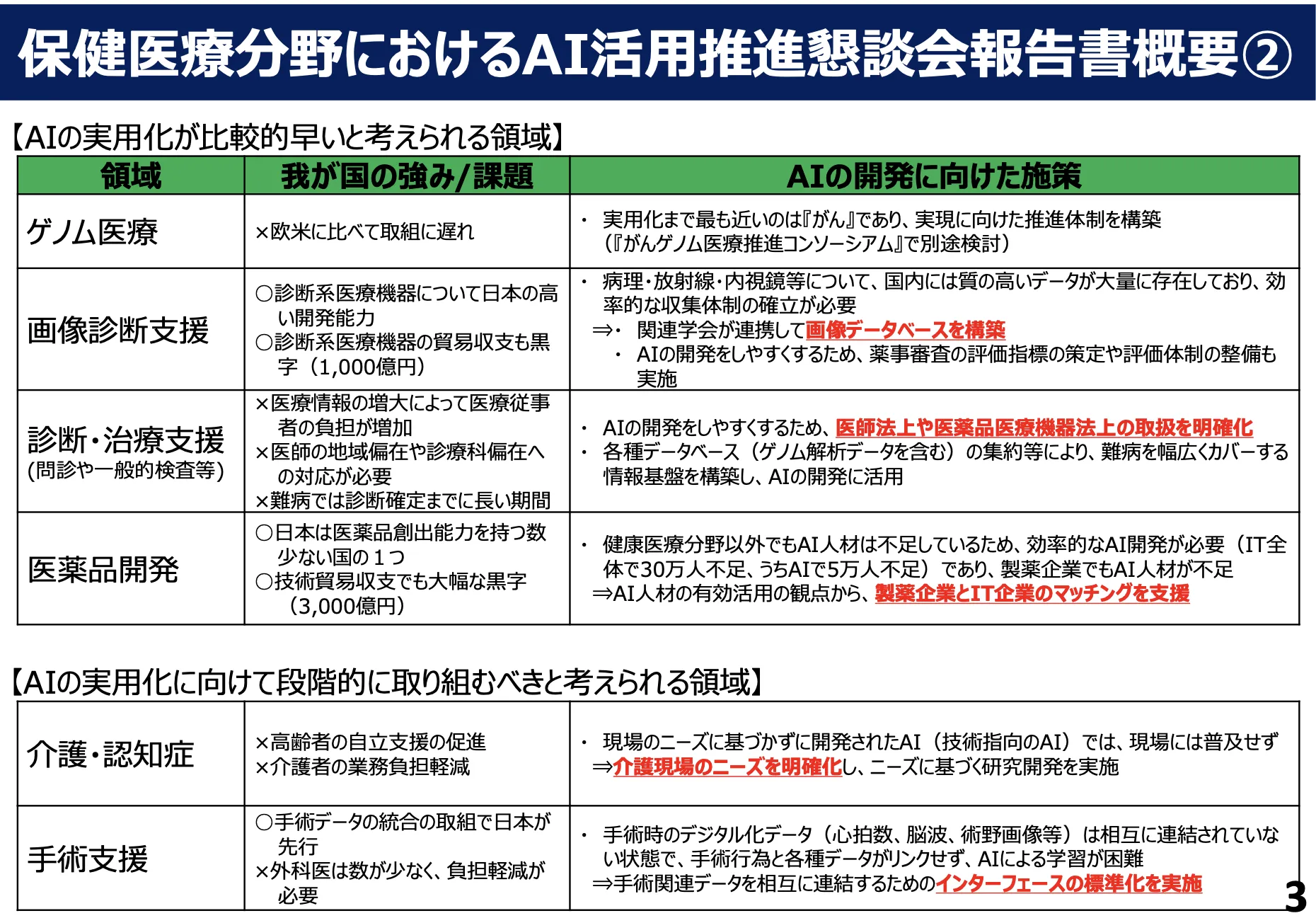

出典:厚生労働省「保健医療分野におけるAI活用推進懇談会報告書概要」

教育分野では、学生の86%が学業にAIを使用しており(ChatGPTが66%で最多)、K-12教師の83%が授業計画やフィードバックに生成AIを活用しています。ハーバード大学の物理学研究では、AIチューターを利用した学生が従来の能動学習と比較して2倍以上の学習量を短時間で達成したという結果が報告されています。一方で、剽窃(33%)やAI依存(30%)への懸念も高まっており、教育現場ではAIリテラシーの育成が急務となっています。

医療分野では、日本の人口1,000人あたりの医師数が2.4人と先進国の中で少ない水準にある中、AIによる診断支援や創薬加速への期待が高まっています。AIによる画像診断は既に一部のがん検出で放射線科医と同等以上の精度を達成しており、日本政府も「保健医療分野におけるAI活用推進」を重点施策として推進しています。ChatGPTの医療分野への応用としては、問診支援や医療文書の作成効率化が進んでいます。

【関連記事】

大規模言語モデル(LLM)とは?その仕組みやAIとの違い、活用例を解説

ディープラーニングとは?その仕組みや種類、機械学習との違いを解説

競合AIの動向と将来展望

ChatGPTが依然として市場をリードしていますが、競合AIサービスも急速に台頭しています。

市場シェアの推移

以下の表で、主要AIサービスの市場シェアと特徴を比較しました。

| サービス | 提供元 | 2025年初頭シェア | 2026年Q1シェア | 主な強み |

|---|---|---|---|---|

| ChatGPT | OpenAI | 約60% | 約64-68% | ユーザー規模、エージェント機能、広告収入 |

| Gemini | 約10% | 約18-21% | Android/Chrome/Workspace統合 | |

| Claude | Anthropic | 約2% | 約2% | 安全性、コーディング精度、長文処理 |

| DeepSeek | DeepSeek | 新興 | 急成長中 | コスト効率、オープンソース |

| Grok | xAI | 約1% | 約1% | X(旧Twitter)統合、リアルタイム情報 |

Geminiの急成長が際立っています。Googleが検索エンジン、Android、Chrome、Google Workspaceという既存のディストリビューション網を活用した結果、8ヶ月間で月間ユーザーが3.5億人から7.5億人へと倍増しました。一方、Claudeはコーディングと精密な文章作成で独自のポジションを確立しており、Anthropicの年換算収益は22億ドルに達しています。

各社の戦略的差別化

OpenAIが消費者スケール(9億WAU、広告収入開始)を追求する一方、Anthropicはエンタープライズ顧客(安全性・信頼性重視)、Googleはプラットフォーム統合(ディストリビューション優位)と、それぞれ異なる戦略を取っています。今後はエージェント機能(AIが自律的にタスクを実行する能力)が各社の差別化の主戦場となる見通しです。OpenAIはGPT-5.4でcomputer-useを、GoogleはProject Marinerを、AnthropicはClaude Coworkをそれぞれ展開しており、2026年はAIエージェント元年としての性格を帯びています。

企業がAIサービスを選定する際は、自社のユースケースに最も適したモデルを選ぶことが重要です。汎用的な業務効率化ならChatGPT、コーディングや精密な分析ならClaude、Google Workspace中心の企業ならGeminiという使い分けが実務的な判断基準となります。

【関連記事】

ChatGPT-4とは?できることや料金、GPT-3.5との違いを徹底解説!

AIエージェント(AI agent)とは?その仕組みや作り方、活用事例を解説

Sora2とは?PC・スマホでの使い方や料金、新アプリについて解説!

ChatGPTの課題とリスク

ChatGPTの急速な普及と能力向上に伴い、倫理的・社会的・法的な課題も顕在化しています。このセクションでは、主要な課題とリスクを整理します。

AI規制の世界動向

世界72カ国以上が1,000以上のAI政策イニシアチブを開始しており、AI規制は急速にグローバルな議題となっています。以下の表で、主要地域の規制動向を比較しました。

| 地域 | 規制名称 | 施行状況 | 特徴 |

|---|---|---|---|

| EU | AI Act | 2026年8月に完全施行 | リスクベースの包括規制。違反罰則は最大3,500万ユーロ |

| 日本 | AI推進法 | 2025年5月制定 | イノベーション重視の軽規制。罰則なし、企業名公表のみ |

| 米国 | 大統領令 + 州法 | 連邦法は未制定 | カリフォルニア等の州法が先行 |

日本は「世界で最もAIフレンドリーな国」を標榜し、罰則なしの軽規制アプローチを採用しています。これはEUの厳格な規制とは対照的で、AI企業の日本進出を促進する狙いがあります。一方で、規制が緩いことでAIのリスク管理が企業の自主性に委ねられる側面もあり、企業独自のAIガバナンス体制の構築が重要です。

ハルシネーションと倫理的課題

ChatGPTを業務で活用する際に最も注意すべき課題の一つがハルシネーション(AIが事実と異なる情報を自信を持って生成する現象)です。GPT-5.4ではハルシネーションが前世代比33%減少していますが、完全に解消されたわけではありません。

医療、法律、金融といった正確性が求められる分野では、AIの出力を人間が必ず検証する体制が不可欠です。データプライバシー(学習データに個人情報が含まれるリスク)、著作権(AI生成コンテンツの権利帰属)、フェイクニュース(精巧な偽情報の大量生成)なども継続的な課題として認識されています。OpenAIは各モデルのSafety Cardを公開して安全性評価の透明性向上に取り組んでいますが、AI倫理の枠組みは技術の進化に追いついていないのが現状です。

【関連記事】

AI規制法とは?日本・海外の事例を踏まえ、その内容と影響を徹底解説

AI活用における倫理問題とは?実際の事例や解決策を解説

ハルシネーションとは?その原因やリスク、対策方法を解説!

ChatGPTのセキュリティリスクとは?実際の事例を踏まえて対策を解説

AIガバナンスとは?企業に必要な理由・導入方法を徹底解説

ChatGPTの進化を見据えた業務AI導入を始める

AI業務自動化ガイド

ChatGPTの未来像を把握できたなら、次は自社業務へのAI導入計画です。AI総合研究所のAI業務自動化ガイドでは、GPT-5世代のAIを業務に取り込む段階的な導入手法を220ページでまとめています。

ChatGPT料金比較(2026年3月版)

ChatGPTの利用を検討する際、プラン選びはコストパフォーマンスの観点で重要な判断材料です。以下の表で、2026年3月時点のサブスクリプションプランを比較しました。

| プラン | 月額料金(USD) | 主な機能 | 広告 |

|---|---|---|---|

| Free | 無料 | GPT-4o mini、制限付きメッセージ | あり |

| Go | $8 | GPT-5.2 Instant、Free比10倍の利用量 | あり |

| Plus | $20 | GPT-5.2/5.4フルアクセス、高速応答 | なし |

| Pro | $200 | 全モデル無制限、拡張思考、優先容量 | なし |

| Team | $25〜30/ユーザー | GPT-5利用増量、共有ワークスペース | なし |

| Enterprise | カスタム | 強化セキュリティ、無制限、専任サポート | なし |

2026年1月に追加されたGoプラン(月額8ドル)は、無料プランでは物足りないがPlusの20ドルは高いと感じるユーザー層をターゲットにしています。Free/Goプランには広告が表示される点に注意が必要です。

API利用の場合の料金は以下の通りです(100万トークンあたり)。

| モデル | 入力料金 | 出力料金 | 特徴 |

|---|---|---|---|

| GPT-5 | $1.25 | $10.00 | コストパフォーマンス最良 |

| GPT-5.2 Instant | $1.25 | $10.00 | GPT-5と同等のコスト |

| GPT-5.4 Thinking | $2.50 | $15.00 | 最新モデル、computer-use対応 |

| o3 | プレミアム | プレミアム | 推論特化(内部推論トークンで課金) |

| o4-mini | o3の約半額 | o3の約半額 | 推論モデルのコスト最適版 |

o系列モデルは内部的に「推論トークン」を消費するため、500トークンの可視出力でも2,000トークン以上が消費される場合があります。コスト管理の観点では、用途に応じてGPT-5系(汎用)とo系列(推論特化)を使い分けることが重要です。

【関連記事】

ChatGPT APIの料金ガイド 2026年3月最新版 モデル別料金一覧とコスト削減のポイント

ChatGPT料金完全ガイド!GPT-5・GPT-4o・Proプラン徹底比較

ChatGPTのメリットとデメリットをわかりやすく解説!

ChatGPTの進化を見据えた業務AI導入を始めるなら

GPT-5やo系列モデルの進化を見据えたAI導入を考えているなら、今から準備を始めることで先行者利益を得られます。モデルの進化スピードを把握していることで、導入タイミングや投資規模の判断が的確になります。

AI総合研究所では、最新AIモデルの業務適用から段階的な組織展開まで220ページのガイドにまとめています。ChatGPTの進化を自社の業務改善に結びつけたい方は、ぜひご活用ください。

ChatGPTの進化を見据えた業務AI導入を始める

AI業務自動化ガイド

ChatGPTの未来像を把握できたなら、次は自社業務へのAI導入計画です。AI総合研究所のAI業務自動化ガイドでは、GPT-5世代のAIを業務に取り込む段階的な導入手法を220ページでまとめています。

まとめ

AIと人間が導く未来への考察

ChatGPTは、2022年11月のリリースからわずか3年余りで週間アクティブユーザー9億人・ARR 250億ドルという驚異的な規模に成長しました。GPT-5.4のcomputer-use機能やエージェントモードに象徴されるように、AIは「対話するツール」から「自律的にタスクを実行するパートナー」へと進化しています。OpenAIの5,000億ドル規模のStargateプロジェクトとカスタムチップ開発は、この進化が今後さらに加速することを示しています。

一方で、雇用市場への影響(2030年までに9,200万職の置換と1.7億職の創出)、AI規制の整備(EU AI Act 2026年8月完全施行)、ハルシネーションの課題など、社会が対応すべき課題も山積しています。企業や個人がChatGPTの恩恵を最大化しつつリスクを管理するためには、段階的なアプローチが有効です。

具体的には、次の3ステップでChatGPT活用を始めることを推奨します。

-

Step 1 業務での試験利用

ChatGPTの無料プランまたはGoプラン(月額8ドル)で、議事録作成、メール文案、情報収集といった日常業務での活用を試します

-

Step 2 チームでの導入検討

効果が確認できた業務プロセスについて、TeamまたはEnterpriseプランの導入を検討します。データの取り扱いポリシーとAIガバナンス体制の整備を並行して進めます

-

Step 3 エージェント機能の活用

GPT-5.4のcomputer-useやDeep Researchを活用し、定型的なリサーチ業務やデータ処理の自動化を段階的に拡大します