この記事のポイント

Microsoft環境でリアルタイムデータ基盤を構築するなら、Azure Event Hubsを第一候補にすべき

本番環境ではStandard以上を選ぶべき。BasicはCapture・Kafka互換・コンシューマーグループ追加が使えない

パーティション数は作成後に変更できないため、ピーク負荷を見据えて初期設計で多めに確保すべき

既存のKafkaアプリケーションがあるなら、Kafka 3.x互換プロトコルでコード変更なしの移行が可能

Microsoft Fabric Eventstreamとの統合で取り込みから分析まで一気通貫で構築できるのが最大の差別化要因

Microsoft MVP・AIパートナー。LinkX Japan株式会社 代表取締役。東京工業大学大学院にて自然言語処理・金融工学を研究。NHK放送技術研究所でAI・ブロックチェーンの研究開発に従事し、国際学会・ジャーナルでの発表多数。経営情報学会 優秀賞受賞。シンガポールでWeb3企業を創業後、現在は企業向けAI導入・DX推進を支援。

IoTデバイスやアプリケーションから生成される大量のリアルタイムデータを効率的に収集・処理する基盤は、企業のデジタル変革において不可欠な要素です。2026年現在、Microsoft Fabric Real-Time Intelligence統合やスキーマレジストリの強化により、Azure Event Hubsの活用範囲は大幅に拡大しています。

本記事では、Azureのイベントストリーミングサービスについて、2026年の最新機能から導入手順、料金体系、Amazon Kinesis・GCP Pub/Sub・Apache Kafkaとの比較まで包括的に解説します。

大規模ストリーミングデータ処理とリアルタイム分析基盤の構築に取り組む方々に向けた実践ガイドです。

目次

Microsoft Fabric Eventstream統合とスキーマレジストリ強化が変えるAzure Event Hubsの2026年動向

名前空間作成からイベントハブ構成までのステップバイステップガイド

Amazon Kinesis Data Streams・GCP Pub/Sub・Apache Kafkaとの4サービス比較と選定基準

Azure Event Hubsとは(2026最新ガイド)

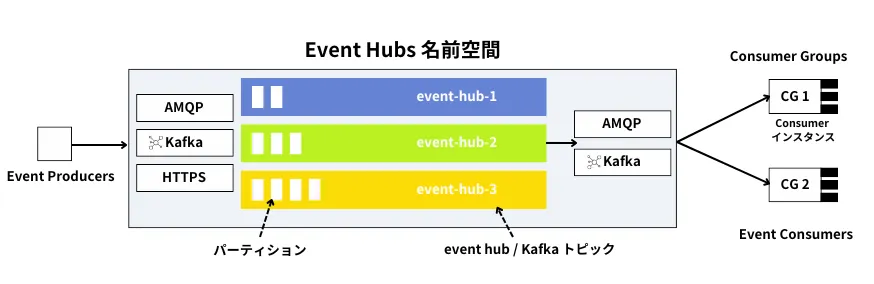

Azure Event Hubsは、Microsoft Azureが提供するフルマネージドのリアルタイムデータインジェストサービスで、毎秒数百万件のイベントを低レイテンシで取り込むことができるビッグデータストリーミングプラットフォームです。AMQP、HTTPS、Apache Kafkaプロトコルをネイティブサポートし、IoTデバイスからのセンサーデータ、アプリケーションログ、クリックストリーム、金融取引データなど、あらゆるソースからのイベントデータを統合的に収集・処理します。

2026年現在、Microsoft Fabric Real-Time Intelligence(Eventstream/Eventhouse)との統合が本格化し、取り込んだストリーミングデータをリアルタイムダッシュボードやKQLクエリで即座に分析できる環境が整っています。スキーマレジストリのAvro/JSON Schema対応やパスワードレス認証(Azure Entra ID)の強化により、エンタープライズでの運用品質が大幅に向上しました。イベントストリーミング市場全体も$285億(2025年)から$863億(2032年)への成長が見込まれており、企業のリアルタイムデータ基盤としての重要性は増しています。

以下の表で、Azure Event Hubsの基本情報を整理しました。

| 項目 | 内容 |

|---|---|

| サービス名 | Azure Event Hubs |

| 提供元 | Microsoft Azure(Azure Messagingサービスの一部) |

| 主要機能 | イベントインジェスト・パーティション分割・Capture・スキーマレジストリ |

| 対応プロトコル | AMQP 1.0・HTTPS・Apache Kafka 3.x |

| 最新統合先 | Microsoft Fabric Real-Time Intelligence(Eventstream/Eventhouse) |

| データ保持 | 最大90日間(Premium/Dedicated) |

| 市場規模 | イベントストリーミング市場 $285億(2025年)→ $863億(2032年) |

Azure Event Hubsの強みは、パーティション分割による水平スケーリングと、Azure Monitorとの統合による運用監視の一元化です。Azure Functionsをトリガーとしたサーバーレスイベント処理や、Azure Blob StorageへのCapture機能による自動アーカイブにより、リアルタイム処理とバッチ分析の両方をカバーするデータパイプラインを構築できます。

(出典元:公式ホームページ)

(出典元:公式ホームページ)

Azure Event Hubsイメージ

Azure Event Hubsイメージ

Microsoft Fabric Eventstream統合とスキーマレジストリ強化が変えるAzure Event Hubsの2026年動向

2026年のAzure Event Hubsにおける最も注目すべき進化は、Microsoft Fabric Real-Time Intelligenceとの統合深化です。Eventstream機能により、Event Hubsに取り込んだストリーミングデータをFabric Eventhouse(KQLデータベース)にリアルタイムで流し込み、KQLクエリによる即時分析やReal-Time Dashboardでの可視化が可能になっています。この統合により、従来は別途構築が必要だったストリーミング分析パイプラインが、Fabricプラットフォーム上でシームレスに完結します。

スキーマレジストリの強化も重要な進展です。Avro形式に加えてJSON Schemaのサポートが追加され、プロデューサーとコンシューマー間のスキーマ互換性を自動的に検証できるようになりました。スキーマの進化(フィールド追加・削除)をバージョン管理し、互換性を保ちながらデータ構造を変更できるため、マイクロサービスアーキテクチャにおけるイベント駆動設計の信頼性が向上しています。

パスワードレス認証では、Azure Entra IDのマネージドIDやトークンベース認証がデフォルトの推奨方式となり、接続文字列ベースの認証からの移行が加速しています。Geo-Disaster Recovery機能も強化され、プライマリ名前空間からセカンダリ名前空間への自動フェイルオーバーが改善されました。Apache Kafka 3.x互換プロトコルのサポートにより、既存のKafkaアプリケーションをコード変更なしでEvent Hubsに接続できる範囲も拡大しています。

Azure Event Hubsの主要機能と導入の実践

Azure Event Hubsの機能は、データインジェスト、パーティション管理、データ保持・アーカイブ、セキュリティの4カテゴリに大別されます。以下の表で各機能の概要と活用場面を整理しました。

| 機能 | カテゴリ | 概要 |

|---|---|---|

| リアルタイムインジェスト | データ取り込み | 毎秒数百万件のイベントを低レイテンシで取り込み。IoT・ログ・クリックストリームの収集に活用 |

| パーティション分割 | スケーリング | データを最大32(Standard)/100(Premium)パーティションに分割し並列処理。スループットの水平拡張を実現 |

| Event Hubs Capture | アーカイブ | 受信データを自動的にBlob StorageまたはData Lakeに保存。Apache Parquetフォーマットに対応 |

| スキーマレジストリ | データ管理 | Avro/JSON Schemaでイベントスキーマをバージョン管理。プロデューサー・コンシューマー間の互換性を保証 |

| Geo-Disaster Recovery | 可用性 | プライマリ/セカンダリ名前空間間のメタデータ自動フェイルオーバー。リージョン障害時の事業継続を確保 |

| Apache Kafka互換 | プロトコル | Kafka 3.xプロトコルをネイティブサポート。既存Kafkaアプリを無変更でEvent Hubsに接続可能 |

実務上特に重要なのは、リアルタイムインジェストとCapture機能の組み合わせです。リアルタイム処理でイベントを即座に分析しつつ、同時にCapture機能で全データをBlob Storageに自動保存するラムダアーキテクチャを、追加コードなしで構築できます。CaptureデータはAzure Data Lakeに保存することで、Azure Databricksでのバッチ分析やMLモデルのトレーニングデータとしても活用可能です。

パーティション分割はEvent Hubsのスケーラビリティの核心で、各パーティションが独立したイベントシーケンスを保持します。Azure IoT HubからのデバイスデータをEvent Hubsに流し込む構成では、デバイスIDをパーティションキーとして設定することで、同一デバイスのイベントが同一パーティションに集約され、順序保証付きの処理が実現します。

Azure Event Hubsの構成要素

Azure Event Hubsの構成要素

名前空間作成からイベントハブ構成までのステップバイステップガイド

Azure Event Hubsの導入は、Azureポータルでの名前空間(Namespace)作成から開始します。名前空間はEvent Hubの管理コンテナで、この中に複数のEvent Hubを作成します。

ステップ1として、Azureポータルにサインインし、「リソースの作成」からEvent Hubsを検索して選択します。

Azureポータル画面

Azureポータル画面

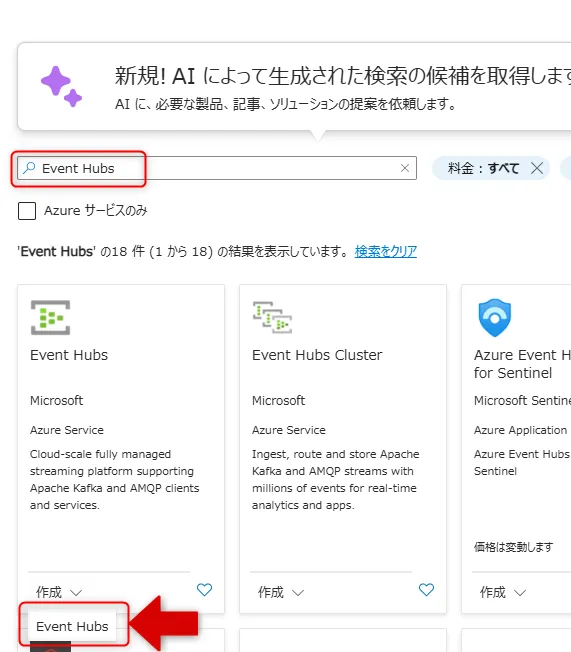

EventHubs選択画面

EventHubs選択画面

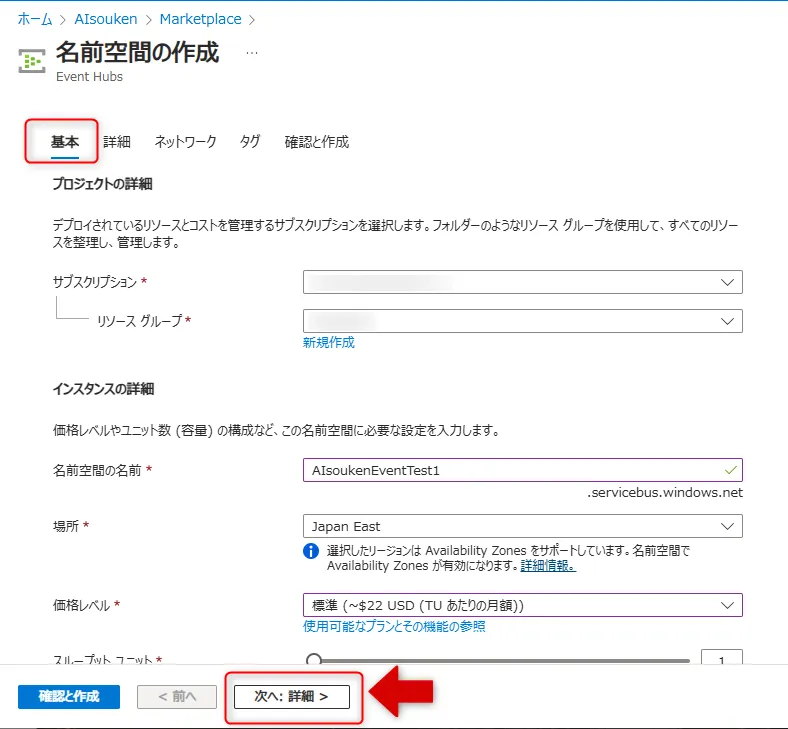

ステップ2として、「名前空間の作成」画面でBasicsタブの基本設定を行います。サブスクリプション、リソースグループ、名前空間名、リージョン(Japan Eastを推奨)、価格レベルを選択します。Standardプランでは最大40スループットユニット(TU)、Premiumでは最大16処理ユニット(PU)まで設定可能です。

基本タブ画面

基本タブ画面

詳細タブではTLSの最小バージョンやKafkaサポートの設定を行います。

詳細タブ画面

詳細タブ画面

ネットワークタブでは、パブリックアクセスまたはプライベートエンドポイントによるアクセス制御を設定します。セキュリティ要件の高い環境では、プライベートエンドポイントを有効化し、Azure Virtual Network内からのみアクセスを許可する構成を推奨します。

ネットワークタブ画面

ネットワークタブ画面

確認と作成タブで設定内容を検証し、作成を実行します。

確認と作成タブ画面

確認と作成タブ画面

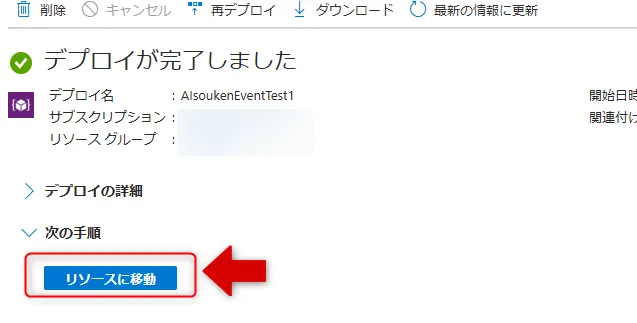

デプロイ完了後、リソースに移動します。

デプロイ完了画面

デプロイ完了画面

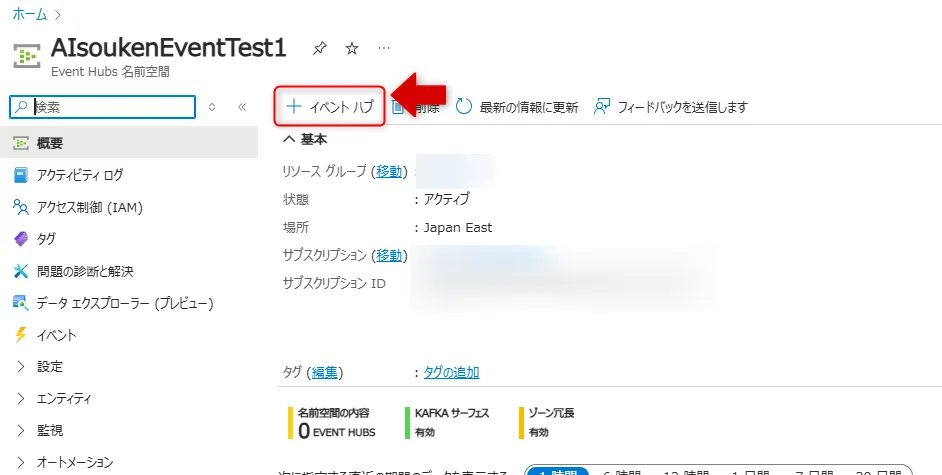

ステップ3として、作成した名前空間内にイベントハブを作成します。名前空間のリソース画面から「イベント ハブ」を選択します。

イベントハブ選択画面

イベントハブ選択画面

イベントハブの作成画面で、名前、パーティション数(2〜32、Premiumは最大100)、データ保持期間を設定します。Captureを有効化する場合は、保存先のBlob StorageまたはData Lakeアカウントも指定します。

イベントハブ基本タブ画面

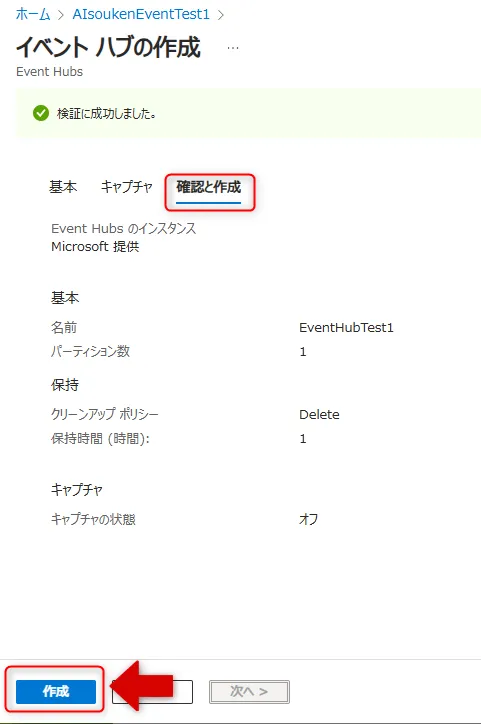

確認と作成で設定を確定し、イベントハブの作成は完了です。

イベントハブ確認と作成画面

イベントハブ確認と作成画面

イベントハブ作成後は、Azure DevOpsパイプラインとの統合によるCI/CDベースのイベント処理アプリケーションのデプロイや、Azure Logic Appsを使ったノーコードのイベント駆動ワークフローの構築も可能です。

料金体系と競合サービス比較

Azure Event Hubsは、ワークロード規模に応じて4つの価格レベルが用意されています。以下の表で、2026年3月時点のJapan East(東日本)リージョンにおける主要な料金を整理しました。

| プラン | 単位料金 | イベント受信 | Capture | 保持期間 | パーティション上限 | Kafka対応 |

|---|---|---|---|---|---|---|

| Basic | $0.015/TU/時間 | $0.028/100万件 | 利用不可 | 1日 | 32 | 不可 |

| Standard | $0.030/TU/時間 | $0.028/100万件 | $0.10/TU/時間 | 7日(最大) | 32 | 対応 |

| Premium | $1.537/PU/時間 | 含む | 含む | 90日 | 100 | 対応 |

| Dedicated | $8.563/CU/時間 | 含む | 含む | 90日 | 1,024 | 対応 |

この料金体系で実務上重要なのは、BasicとStandardの選択基準です。Basicプランはイベントの受信と送信のみに対応し、CaptureやKafka互換、コンシューマーグループの追加(1つのみ)ができません。開発・検証用途にはBasicで十分ですが、本番環境ではStandard以上を選択すべきです。Premiumプランはスループットユニットの管理が不要な処理ユニット(PU)ベースで、ネットワーク分離やゾーン冗長性も含まれるため、ミッションクリティカルなワークロードに適しています。Azureの料金体系の中でも、Auto-Inflate機能(Standardプラン)を活用することで、トラフィック急増時にスループットユニットを自動的にスケールアップし、手動調整なしでパフォーマンスを維持できます。

Amazon Kinesis Data Streams・GCP Pub/Sub・Apache Kafkaとの4サービス比較と選定基準

イベントストリーミングサービスの選定では、スループット、レイテンシ、エコシステム統合、コスト構造を総合的に評価する必要があります。以下の表で、主要4サービスの特性を比較しました。

| 項目 | Azure Event Hubs | Amazon Kinesis Data Streams | GCP Pub/Sub | Apache Kafka(Confluent Cloud) |

|---|---|---|---|---|

| インジェスト料金 | $0.015〜$0.030/TU/時間 | オンデマンド $0.080/GB | $40/TiB(最初の10GiB無料/月) | $0.11〜$0.21/GB(ベーシック/スタンダード) |

| スループット | Standard 1TU=1MB/秒受信 | オンデマンド 200MB/秒 | 自動スケーリング | クラスタ依存 |

| データ保持 | 最大90日(Premium) | 最大365日 | 最大31日 | 無制限(ストレージ依存) |

| Kafka互換 | ネイティブ対応(3.x) | MSK(別サービス) | 非対応 | ネイティブ |

| スキーマ管理 | スキーマレジストリ(Avro/JSON) | Glue Schema Registry | スキーマ検証 | Schema Registry(Avro/Protobuf/JSON) |

| エコシステム | Fabric/Functions/Monitor | Lambda/Firehose/Redshift | BigQuery/Dataflow/Cloud Run | Connect/ksqlDB/Stream Designer |

| 推奨シナリオ | Microsoft環境でのリアルタイムデータ基盤 | AWSネイティブのストリーミング | GCPワークロードのPub/Sub | マルチクラウド/オンプレミスKafka運用 |

この比較から分かるのは、各サービスが異なる強みを持つ点です。Azure Event HubsはKafka 3.x互換とMicrosoft Fabric統合が差別化要因で、既存のKafkaアプリケーションをそのままAzure上で実行しつつ、Fabricでリアルタイム分析まで一気通貫で構築できます。Amazon KinesisはFirehoseとの統合によるRedshift/S3への自動配信が強力で、GCP Pub/Subはサーバーレスで完全自動スケーリングという運用負荷の低さが魅力です。マルチクラウドやオンプレミスとの併用が必要な場合はConfluent Cloudが有力な選択肢となります。

導入注意点と活用ガイド

Azure Event Hubsを本番環境で運用する際には、いくつかの注意点を事前に把握しておく必要があります。以下の表で主要な検討項目を整理しました。

| 注意点 | 詳細 |

|---|---|

| パーティション数の変更不可 | イベントハブ作成後はパーティション数を変更できない(Premiumのパーティション拡張機能を除く)。初期設計時にピーク負荷を考慮した設定が必要 |

| スループットユニットの適正設計 | Standard/Basicでは1TU=受信1MB/秒・送信2MB/秒。Auto-Inflateを有効化し、上限値を適切に設定してコスト超過を防止すること |

| Capture対象のストレージ設計 | CaptureデータはBlob StorageまたはData Lakeに保存。パーティション単位でフォルダ構造が作成されるため、保存先の命名規則とライフサイクル管理を事前に設計すること |

| Event Gridとの使い分け | Event Hubsは大量の連続データストリーム向け、Event Gridは離散的なイベント通知向け。用途に応じて適切なサービスを選択すること |

| パスワードレス認証への移行 | 接続文字列ベースの認証からAzure Entra IDベースの認証への移行を推奨。マネージドIDを使用し、Azure Key Vaultでのキー管理を組み合わせること |

特に注意が必要なのは、パーティション数の初期設計です。Standard/Basicプランではイベントハブ作成後のパーティション数変更ができないため、将来のデータ量増加を見据えた設計が不可欠です。コンシューマーの並列処理数はパーティション数に制約されるため、過少な設定はスケーラビリティのボトルネックとなります。

段階的導入ステップとFAQ

Azure Event Hubsの導入は、以下の3ステップで段階的に進めることを推奨します。

-

ステップ1 Standardプランでの機能検証とPoC(1〜2週間)

Standard名前空間を1TUで作成し、テストデータの送受信とCapture機能を検証します。Azure Functionsトリガーによるサーバーレス処理と、Fabric Eventstreamへの接続を確認し、リアルタイムダッシュボードでの可視化までの一連のフローを構築します。

-

ステップ2 パーティション設計とアプリケーション統合(2〜4週間)

本番データのスループットを測定し、必要なパーティション数とTU数を算定します。Azure Virtual MachinesやAzure Functions上にイベント処理アプリケーションを構築し、スキーマレジストリを設定してプロデューサー・コンシューマー間のデータ契約を確立します。

-

ステップ3 本番環境展開とパフォーマンス最適化(1〜3か月)

本番トラフィックでの運用を開始し、Azure Monitorでスループット・レイテンシ・エラー率を継続的に監視します。Auto-Inflateの上限値調整、CaptureデータのAzure SQL Databaseへの集計パイプライン構築、Geo-Disaster Recoveryの設定による事業継続性の確保も、この段階で実施します。

以下は、Azure Event Hubsの導入を検討する際によくある質問とその回答です。

-

Azure Event HubsのBasicプランで本番運用は可能か

技術的には可能ですが、Basicプランではコンシューマーグループが1つのみ、Capture機能やKafka互換が利用できないなど制約が多いため、本番環境にはStandard以上を推奨します。開発・テスト環境での利用に適しています。

-

Apache KafkaアプリケーションをEvent Hubsに移行する手順は

Event HubsのKafka互換エンドポイントを使用すれば、Kafkaアプリケーションのブートストラップサーバー設定をEvent Hubsの名前空間FQDNに変更するだけで接続できます。プロトコルレベルで互換性があるため、アプリケーションコードの変更は基本的に不要です。

-

Event HubsとEvent Gridはどう使い分けるべきか

Event Hubsは高スループットの連続データストリーム(IoTテレメトリ、ログ集約、クリックストリーム)に最適化されています。Event Gridは離散的なイベント(リソース変更通知、Blobアップロード、カスタムイベント)のルーティングに特化しています。両方を組み合わせて使うことも一般的です。

-

データ保持期間を超えたデータはどうなるか

保持期間を超えたイベントは自動的に削除されます。長期保存が必要な場合は、Capture機能を有効化してBlob StorageまたはData Lakeに自動保存する設定を推奨します。Captureデータはイベントの完全なコピーを保持するため、後からバッチ分析や監査に活用できます。

-

Fabric Real-Time Intelligenceとの統合に追加費用は発生するか

Event Hubs側の料金は通常どおり発生しますが、FabricのEventstream機能によるEvent Hubsからのデータ取り込みはFabricのキャパシティユニット(CU)消費として課金されます。Fabric F2以上のキャパシティが必要で、Event Hubsとは独立した課金体系です。

イベントストリーミングの知見をAI業務自動化にも活かすなら

Azure Event Hubsでリアルタイムデータ処理を構築してきた経験は、AI業務自動化のイベント駆動設計にもそのまま活きます。AI業務自動化ガイドでは、ストリーミング基盤の知見を活かしたAI導入の進め方を220ページにわたって解説しています。

イベントストリーミングからAI業務自動化へ

Event Hubsのデータ基盤をAI活用に展開

Azure Event Hubsでリアルタイムデータ処理を構築してきた経験は、AI業務自動化のイベント駆動設計にも活きます。220ページの実践ガイドで、Microsoft環境でのAI導入を計画してみませんか。

まとめ

本記事では、Azure Event Hubsの2026年最新機能、主要機能、導入手順、料金体系、競合サービスとの比較について解説しました。

Azure Event Hubsは、毎秒数百万件のイベントインジェスト、Apache Kafka 3.x互換、Microsoft Fabric Real-Time Intelligence統合、スキーマレジストリによるデータ契約管理など、エンタープライズのリアルタイムデータ基盤に必要な機能を統合的に提供するサービスです。Standard料金は$0.030/TU/時間、イベント受信は$0.028/100万件と予測可能なコスト体系であり、Auto-Inflate機能によるスケーリングの自動化も利用できます。

まずはステップ1のStandardプランでの機能検証から着手し、パーティション設計とスキーマレジストリの設定を経て、Azure MonitorとFabric連携による本番リアルタイム分析基盤の構築を推奨します。