この記事のポイント

定型の問い合わせ対応にはルールベース型、顧客サポートにはAI型、複雑な対話には生成AI型を選ぶべき

対話型AIの応答精度を上げるならRAGの導入が必須。社内データを参照させることでハルシネーションを大幅に抑制できる

2026年の対話型AIはTransformer+LLMが中核。GPT-5.2・Claude 4.6・Gemini 3.1が実用水準に達している

導入効果はリコーの事例が参考になる。電話問い合わせを1日30〜40件から1〜2件へ削減し約100時間の工数削減を達成

まずは社内FAQチャットボットから始め、効果を検証した上で顧客向け対話AIへ段階的に展開すべき

Microsoft MVP・AIパートナー。LinkX Japan株式会社 代表取締役。東京工業大学大学院にて自然言語処理・金融工学を研究。NHK放送技術研究所でAI・ブロックチェーンの研究開発に従事し、国際学会・ジャーナルでの発表多数。経営情報学会 優秀賞受賞。シンガポールでWeb3企業を創業後、現在は企業向けAI導入・DX推進を支援。

ChatGPTやClaude、Geminiなど、対話型AIが急速に進化し、企業の業務から日常生活まで幅広く浸透しています。

グローバルの対話型AI市場は2025年時点で約147億ドル規模に達し、年平均25%超の成長率で拡大を続けています。

しかし、AIがどのように人間の言葉を理解し、自然な応答を生成しているのか、その仕組みを正確に把握している方は多くありません。

この記事では、自然言語処理やTransformer、RAGといった対話型AIの基盤技術から、応答生成プロセス、種類ごとの比較、具体的な活用事例、導入時の課題、そして主要サービスの料金比較まで体系的に解説します。

対話型AIの導入を検討している企業担当者やエンジニアの方に最適な内容です。

目次

AIが会話する仕組みとは

AI(人工知能)が人間のように自然な会話を行う技術は、対話型AI(Conversational AI)と呼ばれています。対話型AIとは、テキストや音声を通じてユーザーの質問や指示を理解し、文脈に応じた適切な応答を生成するAIシステムの総称です。

対話型AIの市場は急速に成長しています。Fortune Business Insightsの調査によると、グローバルの対話型AI市場は2025年に約147億9,000万ドルに達し、2034年には824億6,000万ドル規模へ拡大すると予測されています(出典)。国内でもITRの調査で2025年度の対話型AIエンジン市場は前年比45.7%増の成長が見込まれており(出典)、企業導入が加速しています。

対話型AIの技術は、以下の4つの段階を経て進化してきました。

| 世代 | 時期 | 代表的な技術 | 特徴 |

|---|---|---|---|

| 第1世代 | 1960〜1990年代 | ELIZA、ルールベース型 | 事前定義のパターンマッチング |

| 第2世代 | 2000〜2010年代 | 統計的機械学習 | データから応答パターンを学習 |

| 第3世代 | 2017〜2022年 | Transformer、BERT | 文脈を双方向に理解 |

| 第4世代 | 2023年〜現在 | GPT-5.2、Claude 4.6、Gemini 3.1 | マルチモーダル対話、長文脈理解 |

この進化の流れにおいて、2017年にGoogleが発表したTransformerアーキテクチャが転換点となりました。それ以降、大規模言語モデル(LLM)の急速な発展により、AIは単なるキーワード応答から文脈を深く理解した自然な会話へと飛躍的に進化しています。2026年現在では、テキストだけでなく音声・画像・動画を含むマルチモーダルな対話が実現しています。

対話型AIを支える基盤技術

AIが自然な会話を実現するためには、複数の技術が階層的に組み合わされています。ここでは、対話型AIの中核を成す4つの基盤技術について解説します。

以下の表で、各基盤技術の役割と具体例を整理しました。

| 基盤技術 | 役割 | 代表的な手法・モデル |

|---|---|---|

| 自然言語処理(NLP) | 人間の言語の解析・理解 | 形態素解析、構文解析、意味解析 |

| 機械学習・ディープラーニング | データからのパターン学習 | ニューラルネットワーク、RNN、CNN |

| 大規模言語モデル(LLM) | 文脈理解と文章生成 | GPT-5.2、Claude 4.6、Gemini 3.1 |

| 音声認識・音声合成 | 音声とテキストの相互変換 | Whisper、Azure Speech、ElevenLabs |

対話型AIでは、これらの技術がパイプラインとして連携して動作します。ユーザーの入力(テキストまたは音声)を受け取り、言語を理解し、適切な応答を生成し、出力するという一連のプロセスを実現しています。

自然言語処理(NLP)

自然言語処理(NLP)は、人間が日常的に使う言葉をコンピュータに理解・処理させるための技術です。対話型AIにおいてNLPは、ユーザーの発言を受け取り、その意味や意図を正確に把握するための基礎レイヤーとして機能します。

NLPの処理は、大きく3つのステップで構成されます。まず形態素解析によって文章を単語単位に分割し、次に構文解析で文の構造(主語・述語・目的語の関係)を把握します。そして意味解析によって、文全体が伝えようとしている内容を理解します。日本語のように単語の区切りが明確でない言語では、形態素解析の精度が応答品質に直結するため、MeCabやSudachiといった高精度な形態素解析器が活用されています。

さらに、文脈の理解も重要な役割を果たします。「それ」「あれ」などの指示語が何を指しているか(照応解析)、ユーザーの発言が質問なのか依頼なのか(意図分類)を正しく判定することで、AIは適切な応答を選択できるようになります。

機械学習とディープラーニング

機械学習は、大量のデータからパターンやルールを自動的に学習する技術です。対話型AIでは、膨大な会話データを分析することで、人間らしい応答の生成方法をAIが獲得します。

特にディープラーニング(深層学習)は、多層のニューラルネットワークを用いてデータの複雑な特徴を捉える手法であり、従来の機械学習手法では困難だった高度な言語理解を可能にしました。ディープラーニングの登場以前は、言葉の「意味」を数値的に表現すること自体が大きな課題でしたが、Word2VecやBERTといったモデルにより、単語や文の意味をベクトル空間上で表現する「分散表現」が実現しています。

この分散表現により、AIは「犬」と「猫」が似た概念であること、「東京」と「日本」に関連性があることを数値的に理解できるようになりました。対話型AIが文脈に沿った応答を生成できるのは、こうした意味の数値化技術が基盤にあるためです。

大規模言語モデル(LLM)とTransformer

大規模言語モデル(LLM)は、膨大なテキストデータを学習し、人間のような自然な文章を生成できるAIモデルです。現在の対話型AIの中核技術であり、ChatGPTやClaude、GeminiといったサービスはすべてこのLLMを基盤としています。

LLMの飛躍的な性能向上を支えたのが、Transformerアーキテクチャです。2017年にGoogle研究チームが論文「Attention Is All You Need」で発表したこの手法は、自己注意機構(Self-Attention)によって入力文全体の単語間の関係性を同時に計算できます(出典)。従来のRNNやLSTMが文の先頭から順番に処理していたのに対し、Transformerは文全体を並列処理できるため、長い文脈の理解と高速な学習の両方を実現しました。

2026年現在では、GPT-5.2(OpenAI)、Claude 4.6(Anthropic)、Gemini 3.1(Google)といった最新のLLMが、数十万トークンの長文脈を理解し、マルチターンの複雑な対話にも高い精度で対応しています。

音声認識と音声合成

音声による対話を実現するためには、音声認識(ASR)と音声合成(TTS)の2つの技術が不可欠です。音声認識は人間の話し言葉をテキストに変換する技術であり、ChatGPTの音声機能やSiri、Alexaなどの音声アシスタントの基盤となっています。

音声認識の分野では、OpenAIのWhisperが2022年の公開以降、多言語対応の高精度モデルとして広く採用されています。一方の音声合成では、ElevenLabsやAzure Speechなどのサービスが、人間の話し方に近い自然な抑揚やイントネーションを再現しています。2026年には感情認識技術との組み合わせにより、ユーザーの声のトーンや話し方から感情を読み取り、それに応じた応答スタイルに切り替える技術も実用化が進んでいます(出典)。

音声AIエージェントの領域では、Bland AI、Vapi、Retell AIといったプラットフォームが24時間365日の電話対応や予約受付を自動化しており、コールセンター業務の効率化に大きく貢献しています。

AIが応答を生成するプロセス

対話型AIがユーザーの入力を受け取ってから応答を返すまでには、複数のステップが連携して動作しています。このプロセスは、テキスト入力と音声入力で異なる経路をたどりますが、中核となる言語処理の部分は共通です。

テキスト入力の場合、AIは以下の5つのステップで応答を生成します。

ステップ1 入力の受け取りとトークン化

ユーザーが入力したテキストは、まず「トークン」と呼ばれる処理単位に分割されます。日本語の場合は形態素単位、英語の場合はサブワード単位で分割され、LLMが処理できる数値ベクトルに変換されます。

ステップ2 文脈の理解

トークン化されたデータはLLM内部のTransformer層で処理されます。自己注意機構により、入力文中の各トークン間の関係性が計算され、文全体の文脈が把握されます。過去の会話履歴がある場合はそれも含めて分析されるため、マルチターンの対話でも文脈を維持できます。

ステップ3 応答の生成

文脈を理解したLLMは、次に来る可能性の高いトークンを確率的に予測し、1トークンずつ応答文を生成します。温度パラメータやTop-pなどの設定により、応答の創造性と正確性のバランスが調整されます。

ステップ4 後処理とフィルタリング

生成された応答は、安全性チェックやフォーマット調整などの後処理を経ます。有害なコンテンツのフィルタリング、文法の最終確認、出力フォーマット(Markdownやプレーンテキスト)への変換が行われます。

ステップ5 応答の出力

最適化された応答がユーザーに返されます。音声出力が必要な場合は、音声合成(TTS)によってテキストが音声に変換されます。

このプロセスは高速に実行され、GPT-5.2やClaude 4.6などの最新LLMでは、数百トークンの応答を数秒以内に生成できます。

現在の対話型AIでは、さらに2つの重要な拡張技術が応答品質を向上させています。1つ目がRAG(検索拡張生成)です。RAGは、LLMが応答を生成する前に外部のデータベースやドキュメントを検索し、関連情報を取得してプロンプトに追加する技術です。LLM単体では学習データに含まれない最新情報や社内固有の知識に対応できませんが、RAGを組み合わせることで、常に最新かつ正確な情報に基づく応答が可能になります。

2つ目がFunction Callingです。LLMが会話の中で外部ツールやAPIを呼び出し、天気情報の取得、データベースの検索、予約の実行といったアクションを対話の一部として実行できます。これにより、対話型AIは単なる情報提供にとどまらず、実際の業務処理を代行するAIエージェントとしても機能するようになっています。

対話型AIの種類と比較

対話型AIは、その技術的な仕組みと応答の柔軟性によって大きく3つのタイプに分類されます。以下の比較表で、各タイプの特性を整理しました。

| 項目 | ルールベース型 | AI型チャットボット | 生成AI型対話システム |

|---|---|---|---|

| 応答方式 | 事前定義のシナリオに沿って応答 | 学習済みデータから類似パターンを検索 | LLMが文脈を理解して応答を生成 |

| 柔軟性 | 低い(シナリオ外の質問に対応不可) | 中程度(学習データの範囲内で対応) | 高い(未知の質問にも対応可能) |

| 導入コスト | 低い | 中程度 | 高い |

| 精度の安定性 | 高い(想定内の質問に限定) | 中程度 | 回答にばらつきが出る場合あり |

| 代表的なサービス | FAQ型チャットボット | Watson Assistant、RICOH Chatbot | ChatGPT、Claude、Gemini |

| 適した用途 | 定型の問い合わせ対応 | カスタマーサポート | 複雑な質問対応、コンテンツ生成 |

この比較から見えるのは、用途に応じて最適なタイプが異なるという点です。定型業務にはルールベース型、顧客対応にはAI型、複雑な対話には生成AI型が適しており、実際の導入ではこれらを組み合わせるハイブリッド構成も増えています。

ルールベース型チャットボット

ルールベース型は、事前に設定したシナリオやフローチャートに基づいて応答する最もシンプルなタイプです。「Aの質問にはBと回答する」というルールを人手で定義するため、想定された質問に対しては正確で一貫性のある応答が可能です。

一方で、シナリオに含まれない質問には対応できず、柔軟な会話が苦手という制約があります。銀行のATM操作案内や、ECサイトの注文ステータス確認など、質問パターンが限定される業務に適しています。導入コストが低く、誤回答のリスクも小さいため、初めてチャットボットを導入する企業にとっては堅実な選択肢です。

AI型チャットボット

AI型チャットボットは、機械学習の教師あり学習や教師なし学習を活用して、FAQデータや過去の対話ログからパターンを学習するタイプです。ルールベース型と異なり、ユーザーの表現が多少異なっても意図を推定して適切な回答を返せます。

リコージャパンでは、社内向けにRICOH Chatbot Serviceを導入し、経理部門への電話問い合わせを1日30〜40件から1〜2件へ削減することに成功しました。3か月間で約1,000件の問い合わせを自動対応し、約100時間の業務工数を削減しています(出典)。

AI型チャットボットの導入では、初期の学習データの品質が精度に直結するため、FAQの整理と継続的なチューニングが重要です。

生成AI型対話システム

生成AI型は、ChatGPTやClaude、Geminiに代表される、LLMを基盤とした最新の対話システムです。事前に用意されたFAQやシナリオに依存せず、入力された文脈を理解して自由形式の応答を生成できます。

生成AI型の最大の強みは、未知の質問や複雑な要求にも柔軟に対応できる点です。コード生成、文書要約、翻訳、データ分析など、多様なタスクを会話形式で処理できます。一方で、事実と異なる情報を生成する「ハルシネーション」のリスクがあるため、業務利用ではRAGによる知識の補完やヒューマンレビューの仕組みが求められます。

チャットボットの種類を選ぶ際には、対応する質問の複雑さ、求められる応答精度、運用コスト、メンテナンスの容易さを総合的に評価することが重要です。

対話型AIの活用事例

対話型AIは、顧客サービス、教育、ヘルスケア、エンターテインメントなど幅広い分野で導入が進んでいます。ここでは、具体的な数値効果が確認されている代表的な活用事例を紹介します。

顧客サービスでの活用

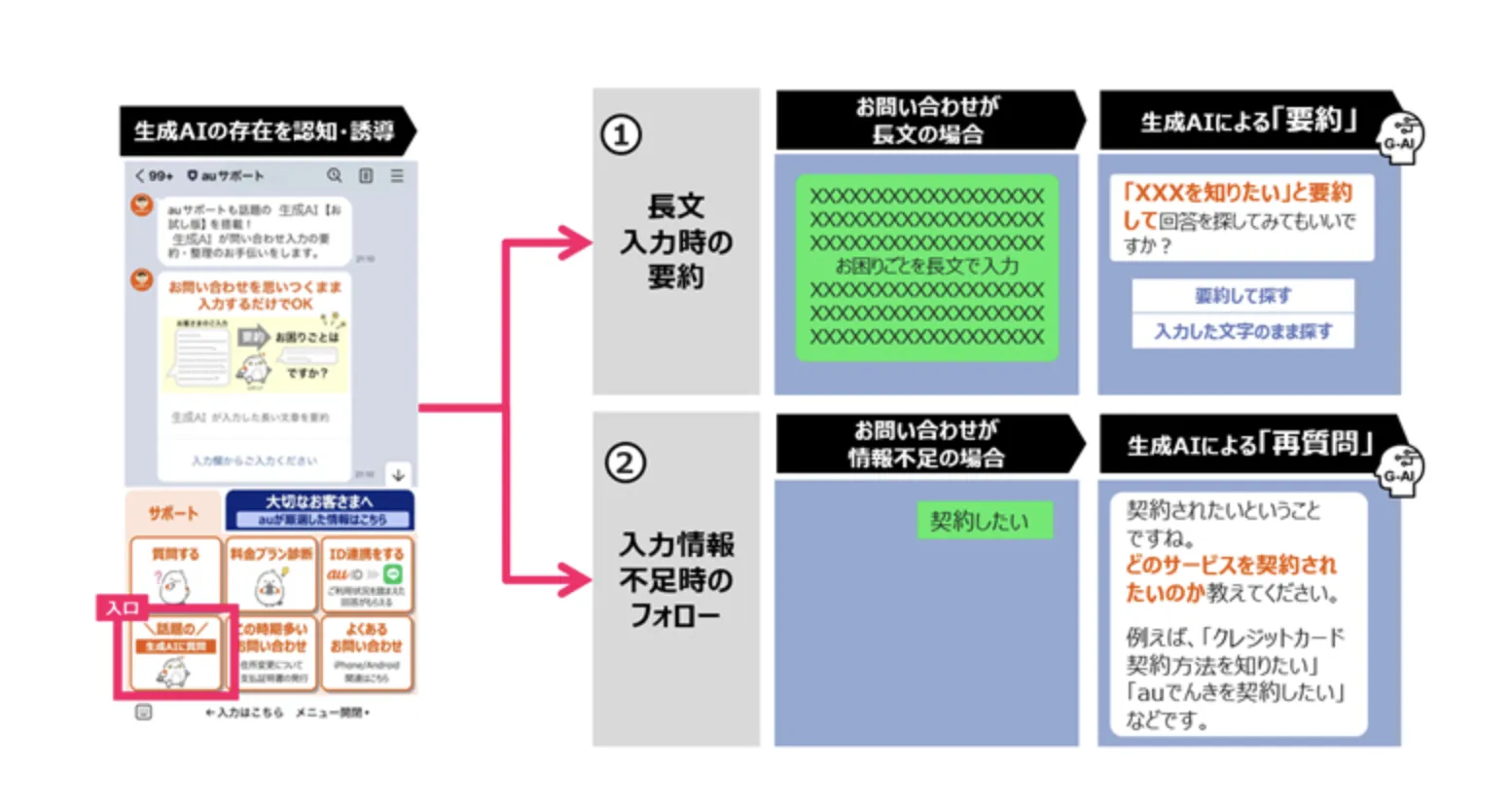

KDDIとアクセンチュアのジョイントベンチャーであるARISE analyticsは、KDDIのカスタマーサポート業務に生成AIを活用したチャットボットを導入しています。

このシステムでは、チャットボットの回答が顧客の問い合わせ内容の解決につながらなかった場合に、生成AIが会話を要約してアドバイザーに引き継ぐ仕組みを採用しています。事前検証では、従来のチャットボット単独の場合と比較して問い合わせ対応時間を約20%短縮できることが確認されました。

生成AIと既存の定型AIのそれぞれの特長を活かすハイブリッド活用により、顧客満足度の向上と対応コストの削減を両立しています。このように、ルールベース型と生成AI型を組み合わせるアプローチは、企業のAI導入における現実的かつ効果的な戦略として注目されています。

教育分野での活用

AI英語教材abceedは、学習最適化エンジン「abceed AI」を活用した問題レコメンド機能により、個人の習熟度に合わせた最適な問題を複数の教材から自動選出します。400を超える人気英語教材コンテンツへのアクセスが可能で、TOEIC、英検の出題形式に合わせたトレーニングを提供しています。

AIおすすめの問題を1日30問、1か月間学習することでTOEIC予測スコアが96点アップするという実績が確認されています。

参考:abceed

数学学習支援アプリQANDAは、全世界で6,500万以上のダウンロード数を誇る人気アプリです。ユーザーが課題や宿題の写真を撮影して送信するだけで、AIが問題の解き方や考え方を詳しく解説します。単に答えを教えるのではなく、解法のプロセスを段階的に説明するアプローチにより、教育分野でのAI活用の可能性を示しています。

参考:PR TIMES

ヘルスケアでの活用

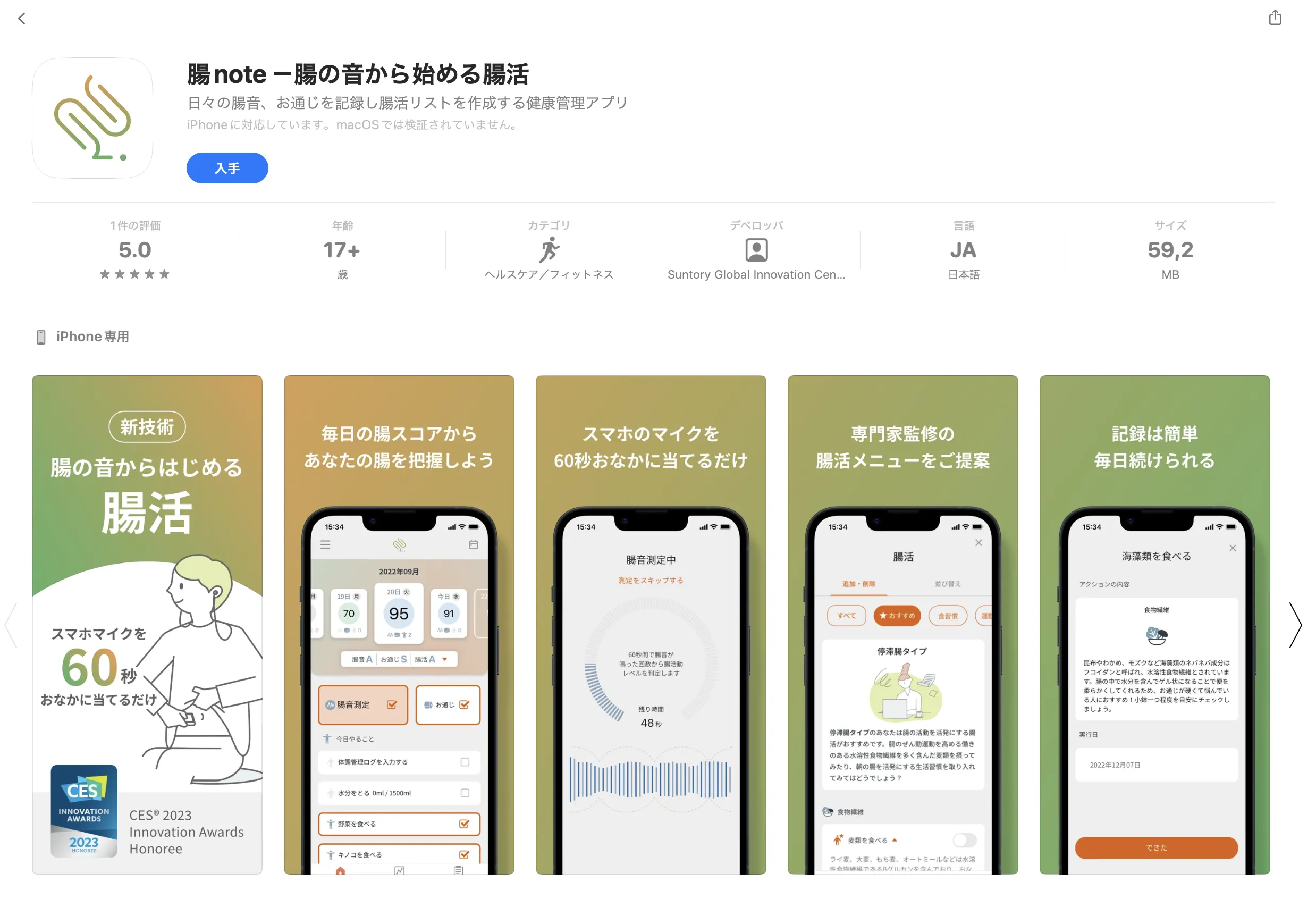

サントリーが提供する健康管理アプリ「腸note」は、独自のAI技術による腸音解析機能を搭載しています。スマートフォンのマイクで腸の音を読み取り、腸の状態を解析したうえで、個人に合った食事や生活習慣を提案します。

腸活記録を毎日つけることで自分専用の腸活リストが作成され、カレンダーで振り返りながら効果的な腸活方法を見つけられる仕組みです。音声・画像入力とAI解析を組み合わせたこのアプローチは、医療・ヘルスケア領域でのAI活用の一例として注目されています。

エンターテインメントでの活用

AItec entertainment株式会社が開発した「Oshichat」は、ユーザーが好きなキャラクター(推し)と会話できるアプリです。キャラクターの性格や世界観を忠実に再現するための対話モデルを採用しており、テキストチャットだけでなくボイスチャット機能も搭載されています。

参考:PR TIMES

エンターテインメント領域では、対話型AIがキャラクターとのインタラクションや物語の分岐生成など、従来にない体験を創出しています。AIと会話できるサービスは今後さらに多様化していくと予想されます。

対話型AI導入のメリットと課題

対話型AIの導入は企業に多くのメリットをもたらしますが、同時に適切な対策が必要な課題も存在します。導入の意思決定にあたっては、両面を正確に把握することが重要です。

対話型AIを導入することで、企業は以下の5つのメリットを享受できます。

-

24時間365日の対応体制

営業時間外でもユーザーの問い合わせに即座に対応できるため、顧客満足度の向上と機会損失の防止につながります。

-

対応コストの削減

定型的な問い合わせをAIが自動処理することで、人的リソースを複雑な対応や付加価値の高い業務に集中させられます。リコージャパンの事例では約100時間の工数削減を実現しています。

-

対応品質の均一化

人によるばらつきがなくなり、一貫した品質の回答を提供できます。新人教育の負担軽減にもつながります。

-

多言語対応の容易さ

LLMベースの対話型AIは、追加のモデル構築なしに多言語での対応が可能です。グローバル展開する企業にとって大きな利点です。

-

データに基づく改善サイクル

対話ログの分析により、顧客のニーズや不満をリアルタイムで把握でき、サービス改善のための意思決定を支援します。

一方で、対話型AIの導入には以下の5つの課題に注意が必要です。社内にAI活用の知見を持つ人材がいない、どのタイプの対話型AIを選べばよいかわからないといった導入時の課題を感じている企業も少なくありません。

-

ハルシネーション(事実誤認)のリスク

生成AI型の対話システムは、事実と異なる回答を自信を持って返す場合があります。企業利用では、RAGの導入やファクトチェック体制の構築が不可欠です。

-

データプライバシーとセキュリティ

対話データに個人情報や機密情報が含まれる場合、データの保管場所や処理方法について厳格な管理が求められます。AI活用における倫理への配慮も重要な論点です。

-

初期導入とチューニングのコスト

AI型や生成AI型の導入には、学習データの準備、システム連携、プロンプト設計などの初期コストがかかります。導入後も継続的なチューニングと運用監視が必要です。

-

AI人材の不足

対話型AIの設計、導入、運用を担える人材は依然として不足しています。プロンプトエンジニアリングやRAG構築のスキルを持つ専門家の確保が課題となっています。

-

ユーザー体験の設計

AIによる対応と人間による対応のシームレスな切り替え(エスカレーション)の設計が、顧客満足度を左右します。AIに任せる範囲と人間が対応すべき範囲の線引きを明確にする必要があります。

対話型AIサービスの料金比較(2026年3月版)

対話型AIの導入を検討する際、コストは重要な判断基準です。ここでは、主要なLLM APIサービスとチャットボットプラットフォームの料金を比較します。

以下の表は、2026年3月時点の主要LLM API料金をまとめたものです。すべて従量課金制で、1Mトークン(約75万語)あたりの料金を示しています。

| サービス | モデル | 入力料金(/1Mトークン) | 出力料金(/1Mトークン) | 特徴 |

|---|---|---|---|---|

| OpenAI | GPT-5.2 | $2.50 | $10.00 | 高精度、マルチモーダル対応 |

| OpenAI | GPT-4.1 mini | $0.40 | $1.60 | コスト効率重視 |

| Anthropic | Claude Sonnet 4.6 | $3.00 | $15.00 | 長文脈、高い安全性 |

| Anthropic | Claude Haiku 4.5 | $0.80 | $4.00 | 高速応答、低コスト |

| Gemini 3.1 Pro | $1.25 | $5.00 | 100万トークン対応 | |

| Microsoft | Azure OpenAI GPT-5.2 | $2.50 | $10.00 | エンタープライズ向けセキュリティ |

LLM APIの選択では、応答精度とコストのバランスが鍵となります。大量の定型質問を処理する用途にはGPT-4.1 miniやClaude Haiku 4.5などの軽量モデルが適しており、複雑な分析や専門的な対話にはGPT-5.2やClaude Sonnet 4.6が適しています。

チャットボットプラットフォームの料金体系は、以下のとおりです。

| サービス | 無料枠 | 有料プラン(月額) | 主な用途 |

|---|---|---|---|

| ChatGPT Plus | 無料版あり | $20/月(Plus) | 個人・小規模チーム向け対話 |

| Claude Pro | 無料版あり | $20/月(Pro) | 長文分析、コーディング支援 |

| Gemini Advanced | 無料版あり | $19.99/月 | Google Workspace連携 |

| RICOH Chatbot Service | なし | 18,000円〜/月 | 社内FAQ、顧客対応 |

| Azure AI Bot Service | 従量課金 | 従量課金 | エンタープライズ向けボット構築 |

生成AIの企業導入においては、まず無料枠や個人プランで効果を検証し、成果が確認できた段階でAPI連携やエンタープライズプランへ移行する段階的アプローチが推奨されます。クラウドサービスのリザーブドインスタンスやスポットインスタンスを活用すれば、本番環境のコストを30〜70%削減できる場合もあります。

対話型AIの仕組みを業務での活用に結びつける

生成AIの業務活用を体系的に学べるガイド

対話型AIの仕組みを理解すると、社内チャットボットの導入や顧客対応の自動化など、会話AIを業務に活かす設計が具体的に描けるようになります。AI総合研究所では、対話AIを含む生成AI全般を業務に導入する手順をまとめたガイドを無料で提供しています。

対話型AIの仕組みを業務での活用に結びつけるなら

対話型AIの仕組みを理解すると、社内向けのFAQチャットボットや顧客対応の自動化など、会話AIを業務に組み込む設計がより現実的に描けるようになります。自然言語処理の進化によって、問い合わせ対応だけでなく議事録要約やナレッジ検索など多様な業務タスクへの応用も広がっています。

AI総合研究所では、対話AIの導入を含む業務全般のAI化を段階的に進める手順をまとめた「AI業務自動化ガイド」を無料で提供しています。会話AIの仕組みを理解した今、業務への具体的なAI導入を始めてみてください。

対話型AIの仕組みを業務での活用に結びつける

生成AIの業務活用を体系的に学べるガイド

対話型AIの仕組みを理解すると、社内チャットボットの導入や顧客対応の自動化など、会話AIを業務に活かす設計が具体的に描けるようになります。AI総合研究所では、対話AIを含む生成AI全般を業務に導入する手順をまとめたガイドを無料で提供しています。

まとめ

この記事では、AIが会話する仕組みについて、基盤技術から応答生成プロセス、対話型AIの種類と比較、具体的な活用事例、導入のメリットと課題、そしてサービスの料金比較まで体系的に解説しました。

対話型AIは、自然言語処理、ディープラーニング、大規模言語モデル(LLM)、そしてRAGやFunction Callingといった拡張技術の組み合わせにより、2026年現在では人間に近い自然な会話を実現しています。KDDIの対応時間20%短縮やリコージャパンの問い合わせ1,000件削減に見られるように、適切に導入すれば業務効率化と顧客満足度向上の両方を達成できます。

対話型AIの導入を検討されている方は、まずChatGPTやClaudeの無料版で自社の業務課題に対する応答品質を検証し、効果が見込める領域から段階的に導入を進めてみてください。小規模なPoC(概念実証)から始めることで、投資リスクを抑えながらAI導入による業務変革を着実に実現できます。